ainews-ring-attention-for-1m-context

**Ring Attention:支持超过 100 万上下文**

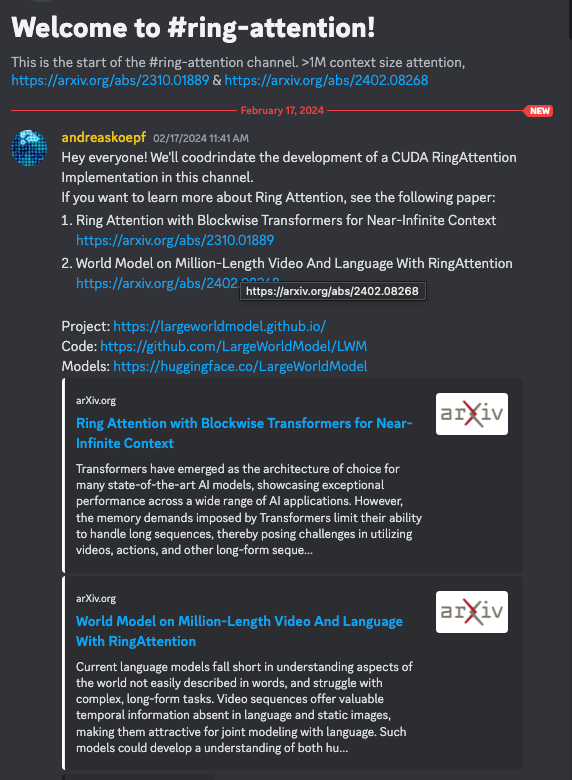

Google Gemini Pro 重新引发了人们对长上下文能力的关注。CUDA MODE Discord 社区目前正致力于实现由 Liu、Zaharia 和 Abbeel 发表的 RingAttention 论文,包括《世界模型 RingAttention》论文中的扩展内容,并提供了 PyTorch 和 CUDA 的具体实现。

TheBloke Discord 频道讨论了多个话题,包括 LLM 猜谜游戏评估、英伟达(Nvidia)的 Chat with RTX 与 Polymind 之间的聊天机器人用户体验(UX)对比、检索增强生成(RAG) 集成的挑战、显存(VRAM)优化、使用直接偏好优化(DPO)进行角色扮演微调,以及 deepseek-coder-6.7B-instruct 等模型选择。

此外,还有关于 Mac Studio 上机器学习工作流的讨论,用户更倾向于使用 llama.cpp 而非 ollama,并探讨了如何利用 Runpod 上的 4090 等 GPU 实现高性价比的推理扩展。LM Studio 用户需要手动更新至 0.2.16 版本,该版本包含对 Gemma 模型 的支持以及针对 MacOS 的错误修复。在模型表现方面,Gemma 7B 模型存在性能问题,而 Gemma 2B 则获得了积极的反馈。

2024年2月21日的 AI Discord 动态。我们为您检查了 20 个公会、317 个频道和 8751 条消息。预计节省阅读时间(以 200wpm 计算):796 分钟。

昨日更新:抱歉发了一封空白邮件——有人在 langchain Discord 中发了一个违规链接,导致 buttondown 渲染过程出错。我们已经修复了它,您可以在这里查看 昨日的 Google Gemini 简报。

Gemini Pro 让大家意识到了长上下文(long context)的好处。CUDA MODE Discord 启动了一个实现 RingAttention 论文(Liu, Zaharia, Abbeel,以及扩展的 World Model RingAttention 论文)的项目。

论文当然附带了 pytorch 实现,lucidrains 也有一个版本。但您可以在这里查看 CUDA 实现:https://github.com/cuda-mode/ring-attention

目录

[TOC]

第一部分:Discord 高层摘要

TheBloke Discord 摘要

LLM 猜谜游戏评估:对语言模型的实验展示了它们在理解指令方面的潜力,特别是在互动猜谜游戏中,准确的数字选择和用户参与度是关键。

UX 战场:聊天机器人:围绕聊天机器人界面的激烈辩论,将笨重的 Nvidia 的 Chat with RTX 与灵活的 Polymind 进行了对比,强调了用户友好配置的重要性。

RAG 的严苛实现之路:检索与生成(RAG)功能的集成引发了讨论,重点关注将此类功能整洁且有效地融入项目的复杂性。

Discord 机器人 CSS 难题:用户表达了在自定义 Discord 机器人时遇到的 CSS 挑战,突显了 UI 设计与机器人功能之间无缝集成的困难。

VRAM:隐形的计算货币:专注于资源优化,讨论集中在协调 VRAM 容量与模型需求上,强调了性能与计算开销之间的平衡。

角色扮演微调技巧:像 @superking__ 和 @netrve 这样的用户分享了为角色扮演微调 AI 的见解,策略围绕全面的基础知识和通过 Dynamic Prompt Optimization (DPO) 进行的针对性训练。

AI 故事与角色扮演热潮:针对故事写作和角色扮演的新模型发布,这些模型在人类生成的内容上进行训练,以改进 ChatML 中可控的交互,引发了实测的浓厚兴趣。

代码分类难题:寻找理想的 LLM 来对 RAG 流水线中的代码相关性进行分类,导致了对 deepseek-coder-6.7B-instruct 的考量,社区成员正在寻求进一步指导。

Mistral 模型下载荒:出现了一个关于本地 Mistral 可访问性的未详细说明的请求,但由于信息太少,无法获得建设性的社区支持。

Mac Studio 上的工作流困扰:阐述了 Mac Studio 上的 ML 工作流挣扎,包括可能从 ollama 切换到 llama.cpp,赞扬其简单性并质疑行业向 ollama 推进的趋势。

VSCode 地位被 Zed 取代:像 @dirtytigerx 这样的用户推崇 Zed 优于 Visual Studio Code,强调其极简设计和速度。基于 Atom 的开源文本编辑器 Pulsar 也受到了关注。

通过战术性 GPU 部署扩展推理:讨论了扩展推理服务器的成本效益方法,建议在全面部署之前,先在 runpod 上使用 4090 等实惠的 GPU 进行初步原型设计,同时注意云服务商服务协议的可靠性。

LM Studio Discord 摘要

-

LM Studio 更新需要手动操作:由于应用内更新功能目前无法正常运行,用户必须从 LM Studio v0.2.16 手动下载最新功能和错误修复。更新内容包括 Gemma 模型支持、改进的下载管理和 UI 增强,并在 v0.2.16 中解决了关键 bug,特别是针对 MacOS 用户遇到的高 CPU 占用问题。

-

社区解决 Gemma 故障:持续的讨论显示 Gemma 7B 模型存在问题,伴有性能故障和错误;然而,Gemma 2B 模型收到了积极反馈。在调整 GPU 滑块后,M1 Mac 上的 Gemma 7B 表现有所改善。可在 Hugging Face 获取可用的 Gemma 2B 模型。

-

Stable Diffusion 3 引起关注:Stability.ai 宣布了 Stable Diffusion 3 的早期预览,引发了用户对其改进的多主体图像质量的讨论。爱好者们考虑申请预览,并讨论了如 AUTOMATIC1111 等 Web UI 工具,用于处理独立于 LM Studio 关注点之外的图像处理任务。

-

探索大模型的硬件障碍:社区深入探讨了运行 Goliath 120B Q6 等大模型的挑战,交流了关于 Tesla P40 等旧款 GPU 可行性的见解,并辩论了 AI 任务中 VRAM 容量与 GPU 性能之间的平衡。

-

Gemma 模型排查持续进行:用户在 Gemma 的不同量化版本上取得了参差不齐的成功,7B 模型经常产生乱码,而 2B 模型运行更可靠。LM Studio 下载面临关键问题,建议在 LM Studio 官网 和 GitHub 上解决。一个已确认适用于 LM Studio 的稳定量化版 Gemma 2B 模型可以在此 Hugging Face 链接 找到。

Nous Research AI Discord 摘要

将 LLM 扩展到新高度:@gabriel_syme 强调了一个专注于数据工程的仓库,旨在将语言模型扩展到 128K context,这是该领域的一项重大进展。@teknium 指出,此类模型在 7B 规模下的 VRAM 需求超过 600GB,对资源的需求巨大。

Google 进入 LLM 领域:Google 推出了 Gemma 系列轻量级开源模型,@sundarpichai 进行了热烈报道,社区反馈褒贬不一,将其与 Mistral 和 LLaMA 等现有模型进行了比较。用户 @big_ol_tender 和 @mihai4256 参与了各种讨论,从指令放置的影响到不同服务间的 VM 性能。

开源开发与支持:@pradeep1148 分享了一个视频,建议自我反思可以改进 RAG 模型,@blackblize 寻求关于使用 AI 处理显微镜照片进行艺术图像生成的指导。同时,@afterhoursbilly 和 @_3sphere 批评了 AI 生成的 Minecraft 物品栏 UI 图像。

新兴 AI 基础设施讨论:关于 Nous-Hermes-2-Mistral-7B-DPO-GGUF 的对话反映了其与其他模型对比的查询,@iamcoming5084 谈到了 Mixtral 8x7b models 的显存溢出(out-of-memory)错误。还探讨了托管 Mixtral 8x7b 等大模型的策略,用户对不同工具进行了辩论,并指出了推理代码中的错误(修正后的 Nous-Hermes-2-Mistral-7B-DPO 推理代码)。

协作项目挑战:在 #project-obsidian 频道中,@qnguyen3 通知由于个人原因项目有所延期,并建议通过私信进行项目方面的协调。

Eleuther Discord 总结

-

澄清模型评估与 lm eval 的混淆:

@lee0099对在 runpod 上设置lm eval的困惑促使@hailey_schoelkopf澄清了lm eval与llm-autoeval之间的区别,并引用了 Open LLM Leaderboard 的 HF spaces 页面 以获取说明和参数。关于@gaindrew提出的按净碳排放量对模型进行排名的建议,由于准确性方面的挑战,尚未达成明确共识。 -

Gemma 的成长阵痛与技术磨合:

@sundarpichai推出的 Google Gemma 引发了关于其相对于 Mistral 等模型改进程度的辩论。会议强调了 Gemma 模型中参数数量的误报问题(“gemma-7b” 实际上拥有 85 亿参数)。Groq 声称在 Mistral Mixtral 8x7b 模型上实现了 4 倍的吞吐量,并大幅降低了成本。讨论中还涉及了对模型环境足迹的担忧以及@philpax对 Groq 声明的报告,同时研究人员深入探讨了模型效率以及 PGI 在解决数据丢失中的应用。 -

探索多语言模型的奥秘:一篇 Twitter 帖子 及其配套的 GitHub 仓库 引发了关于模型是否“用英语思考”以及在 Llama 等模型上使用调优透镜(tuned lens)的实用性的辩论。

@mrgonao对多语言能力的讨论促使了对创建中文透镜的思考。 -

LM Thunderdome 的技术深潜:在众多的内存问题中,

@pminervini面临 Colab 中 OOM 错误后 GPU 显存持续占用的问题,需要重启运行时,该问题在 Colab 的 Evaluate OOM Issue 环境 中重现。此外,还有关于评估 Gemma-7b 模型的报告,需要@hailey_schoelkopf的干预,他提供了修复方法和使用flash_attention_2的优化技巧。 -

解决假阴性问题并推进 CLIP:在多模态对话中,

@tz6352和@_.hrafn._讨论了 CLIP 模型 中的批次内假阴性(in-batch false negative)问题,详细说明了涉及单模态嵌入的解决方案,以及在模型训练期间利用相似度得分进行负样本排除的策略。 -

预训练序列组合的重要性:gpt-neox-dev 频道仅记录了来自

@pminervini的一条消息,分享了一篇 arXiv 论文,该论文指出文档内因果掩码(intra-document causal masking)有助于消除前一个文档的干扰内容,从而可能提高语言模型在各种任务中的性能。

LAION Discord 总结

-

Google 发布 Gemma 模型,转向开放 AI:Google 推出了 Gemma,这代表了其在 Gemini 模型基础上的进步,并暗示其正向更开放的 AI 开发转变。社区对 Google 发布实际开源权重的动机表现出兴趣,因为他们传统上对此持谨慎态度。

-

Stable Diffusion 3 的关注与担忧:Stable Diffusion 3 的早期预览版已经发布,重点是改进多主体提示词处理和图像质量,但其与早期版本的差异化正受到审查。此外,关于 SD3 的商业利用,以及开源究竟是作为一种宣传策略还是收入策略,也产生了一些疑问。

-

AI 领域的中心化引发关注:讨论反映了对 AI 开发和资源中心化的日益担忧,例如 Stable Diffusion 3 的开放程度降低,这可能会使算力超出终端用户的承受范围。

-

扩散模型作为神经网络生成器:一篇 Arxiv 论文 分享了关于如何使用扩散模型生成高效神经网络参数的见解,指出了一种构建新模型的全新且可能具有变革性的方法。

-

AnyGPT:统一多模态 LLM 的黎明:AnyGPT 的推出(演示视频可在 YouTube 观看)突显了语言学习模型(LLM)处理语音、文本、图像和音乐等多种数据类型的能力。

Mistral Discord 总结

-

Mistral 的图像文本提取能力受到审视:Mistral AI 在处理复杂图像文本检索方面的能力受到质疑。对于需要更高灵活性的任务,建议使用 gpt4-vision、gemini-vision 和 blip2,而非 copyfish 和 google lens 等简单工具。

-

Mistral API 与微调探索:用户交流了关于各种 Mistral models 的信息,包括 Mistral API 指南、Mistral 7B 和 Mistral 8x7b 模型的微调,以及在 Hugging Face 和 Vertex AI 等平台上的部署。集成公司数据时引用了 Basic RAG guide ([Basic RAG Mistral AI](https://docs.mistral.ai/guides/basic-RAG/))。 -

部署讨论聚焦关注点与成本评估:关于 AWS hosting costs 和 vLLM 的 GPU selection(GPU 选择)的咨询引发了对部署方案的讨论。部署 vLLM 时参考了相关文档 ([vLLM Mistral AI](https://docs.mistral.ai/self-deployment/vllm/))。 -

对未发布的 Mistral Next 的期待:Mistral-Next 已确认为即将推出的模型,目前尚无 API 访问权限。Mistral Next 卓越的数学性能引发了与 GPT-4 的比较。详情备受期待但尚未发布。

-

展示 Mistral 的多功能性与潜力:一段 YouTube 视频展示了通过自我反思增强 RAG (Self RAG using LangGraph),另一段视频讨论了微调的益处 (BitDelta: Your Fine-Tune May Only Be Worth One Bit)。Jay9265 在 Twitch 上对 Mistral-Next 的测试 (Twitch) 以及提示词能力指南 ([Prompting Capabilities Mistral AI](https://docs.mistral.ai/guides/prompting-capabilities/)) 也被重点提及,以展示 Mistral 的能力和用途。

OpenAI Discord 总结

-

Google 的 AI 持续进化:Google 发布了一个具有更新功能的新模型;然而,关于其名称和能力的细节尚未完全明确。关于 OpenAI,讨论中确认 ChatGPT 的移动版缺乏插件支持,导致用户在移动浏览器上尝试桌面版以获取完整功能集。

-

OpenAI 定义 GPT-4 访问限制:关于 GPT-4 的使用上限(usage cap)展开了辩论,成员们澄清该上限是根据需求和算力可用性进行动态调整的。显然,自发布以来 GPT-4 的模型性能并未下降,平息了关于其能力减弱的传闻。

-

AI 模型的稳定性与多样性:Stability.ai 发布了 Stable Diffusion 3 的早期预览版,承诺在图像质量和提示词处理方面有所增强。而围绕 Google Gemini 模型的讨论则对其处理多样性的方法提出了疑问。

-

精通提示工程 (Prompt Engineering):对于旨在提高 AI 角色扮演能力的 AI 工程师来说,关键是构建具有清晰、具体且逻辑一致的指令的提示词,使用开放变量和正向强化方法。该领域的进一步学习资源可以在 arXiv 和 Hugging Face 等平台上找到。

-

探索 API 与模型能力:API 交互采用按需付费(pay-as-you-go)模式,与 Plus 订阅分开。此外,最近增加了文件上传限制,现在支持 20 个 512MB 的文件。讨论还涉及了使用 HTML/CSS 文件训练模型的细微差别,帮助工程师优化 GPT 对 Web 开发语言的理解和输出。

HuggingFace Discord 总结

-

404 账户之谜与 Diffusion Model 深度探讨:用户报告了 HuggingFace 的各种问题,例如某个账户出现 404 错误(可能由于虚报库统计数据),以及在 NixOS 上配置

huggingface-vscode扩展的挑战。此外,还分享了关于 SDXL 等 Diffusion Model 使用傅里叶变换增强微调节(microconditioning)输入的深度讨论,同时用户也对用于大学项目的基于中间语言(interlingua)的翻译器,以及运行具有扩展类别的 BART-large-mnli 模型 表现出兴趣。 - AI 工程实践:

- 一位用户分享了一个用于管理投资组合的 Web 应用,并附带了 Kaggle Notebook。

- 介绍了一个使用 SigLIP 的多标签图像分类教程 Notebook。

- 通过重新安装

2.15 版本解决了 TensorFlow 问题。 - 探讨了生物医学领域的句子相似度挑战,并推荐使用对比学习以及 sentence transformers 和 setfit 等工具进行微调。

- 挑战 AI 范式:

- 新兴 AI 技术预警:

- 展示了一个用于单目深度估计的 Android 应用和一个使用 Selenium 的非官方 ChatGPT API,引发了对服务条款(TOS)和绕过保护机制的担忧。

- 公告包括 Stable Diffusion 3 的早期预览,以及对 nanotron 在 GitHub 上开源的兴奋,这标志着 AI 领域的持续改进和社区努力。

Latent Space Discord 总结

-

Google 发布 Gemma 语言模型:Google 推出了名为 Gemma 的新语言模型系列,目前 7B 和 2B 尺寸已在 Hugging Face 上可用。分享的发布条款强调了对分发模型衍生品的限制(Hugging Face 博客文章,发布条款)。

-

破解 Tokenizer 差异:对 Gemma 的 Tokenizer 与 Llama 2 的 Tokenizer 进行了深入对比分析,揭示了 Gemma 具有更大的词汇表和特殊 Token。该分析得到了 Tokenizer 模型文件链接和 diffchecker 对比的支持(Tokenizer 模型文件,diffchecker 对比)。

-

Stable Diffusion 3 登场:Stability AI 在早期预览中宣布了 Stable Diffusion 3,相比之前的版本,它在多主体提示词处理和图像质量方面有所提升(Stability AI 公告)。

-

ChatGPT 异常行为已修复:据 OpenAI 状态页面显示,此前报告的 ChatGPT 异常行为事件已得到解决。成员们分享了推文链接和事件报告以提供背景信息(OpenAI 状态页面)。

-

探索 AI 驱动的生产力:对话围绕 Google 的 Gemini AI 集成到 Workspace 和 Google One 服务展开,讨论了其新特性,如 1,000,000 Token 的上下文窗口和视频输入功能(Google One Gemini AI,Google Workspace Gemini)。

LlamaIndex Discord 总结

-

简化 RAG 构建:

@IFTTT讨论了构建高级 RAG 系统的复杂性,并建议采用 @jerryjliu0 的演示中的方法来简化流程,该方法精准定位了每个 Pipeline 组件中的痛点。 -

RAG 前端创建变得简单:对于缺乏 React 知识的 LLM/RAG 专家,Marco Bertelli 的教程(由

@IFTTT推荐)展示了如何为他们的 RAG 后端制作精美的前端,资源可从 @llama_index 获取。 -

将 RAG Notebooks 提升为应用程序:

@wenqi_glantz提供了一份将 RAG Notebooks 转换为包含摄取(ingestion)和推理(inference)微服务的全栈应用程序的指南,该指南由@IFTTT在推文中分享,完整教程可在此访问。 -

LlamaIndex 中的 QueryPipeline 设置和导入错误:讨论了诸如使用 QueryPipeline 设置简单 RAG、从

llama_index导入VectorStoreIndex的困难以及导入LangchainEmbedding等问题,并建议参考 QueryPipeline 文档以及从llama_index.core导入作为潜在的修复方案。 -

LlamaIndex 资源故障排除:讨论的主题包括下载 CorrectiveRAGPack 时的

ValueError,相关的 PR #11272 可能会提供解决方案;以及影响@andaldana等用户的文档链接失效问题,这些用户正在寻求 LlamaIndex 中用于处理 SQL 数据库条目数据的更新方法或 Reader。 -

AI 讨论中的参与和咨询:

@behanzin777对社区中建议的解决方案表示感谢,@dadabit.寻求有关 LlamaIndex 内摘要指标和工具的建议,@.dheemanth请求推荐一个用户友好的平台,用于评估具有类似于 MT-Bench 和 MMLU 能力的 LLM。

OpenAccess AI Collective (axolotl) Discord 总结

-

Google 的 Gemma 发布:Google 新的 Gemma 模型系列引发了积极讨论,其许可协议被发现比 LLaMA 2 限制更少,其模型现在可以通过 Hugging Face 访问。一个 7B Gemma 模型被重新上传供公众使用,绕过了 Google 的访问请求协议。然而,微调(finetuning)Gemma 出现了一些问题,参考 GitHub 上的潜在早期停止回调(early stopping callback)问题。

-

Axolotl 开发深入研究 Gemma:axolotl 代码库的工作正在进行中,集成了 readme、val 和示例修复。强调了在非开发版本的 transformers 上训练 Gemma 模型,并分享了更新后的 gemma config file 以简化设置。关于合适的超参数(如 Gemma 模型 的学习率和权重衰减)存在争论。还在探索优化 Mixtral 模型 的方法,有望通过 AutoAWQ 提升预填充(prefilling)和解码速度。

-

Alpaca 美学加入 Axolotl:正在寻求用于 alpaca 的 jinja 模板,以增强 axolotl 仓库。对使用 DeepSpeed 的训练技巧和微调模型后的正确推理格式有需求,同时还在排除 FlashAttention 的故障。重复的查询促使人们呼吁更好的文档,引起了对全面指南必要性的关注。

-

Opus V1 模型助力极具吸引力的故事创作:Opus V1 模型 已发布,在大量用于故事写作和角色扮演的语料库上进行了训练,可在 Hugging Face 上访问。这些模型受益于先进的 ChatML 提示机制以实现受控输出,并有一份指导指南详细说明了如何引导叙事。

-

RunPod 资源需要检索:一位用户遇到了 RunPod 镜像 消失的问题,建议去 Docker Hub 查找现有的标签。GitHub readme 中的错误重定向表明需要更新文档,以正确引导用户找到合适的资源。

CUDA MODE Discord 总结

-

Groq 的 LPU 表现优于竞争对手:Groq 的 Language Processing Unit 在大型语言模型(LLM)上达到了每秒 241 个 token,创下了新的 AI 基准测试记录。关于 Groq 技术的进一步见解可以参考 Andrew Bitar 的演讲 “Software Defined Hardware for Dataflow Compute”,该视频已上传至 YouTube。

-

Docker 中的 NVIDIA Nsight 问题:工程师们正在寻求在 Docker 容器中安装 NVIDIA Nsight 进行调试的帮助,一些人指出在不同云服务商处也遇到了类似困难,并提到 lighting.ai studios 有一个可行的解决方案。

-

新的 BnB FP4 仓库承诺提速:一个针对 bnb fp4 代码的新 GitHub 仓库 已发布,据报道其速度比 bitsandbytes 更快,但需要 CUDA 计算能力 >= 8.0 以及大量的 VRAM。

-

torch.compile 受到审视:torch.compile 的局限性正受到讨论,特别是它未能捕获通过 Triton/CUDA 可获得的性能提升,以及无法有效处理动态控制流和 kernel fusion 带来的收益。

-

Gemini 1.5 讨论开启:邀请所有人通过 Discord 邀请链接 参加关于 Gemini 1.5 的讨论。此外,还分享了一个展示 AI 从音频文件中解锁语义知识能力的视频,提供了关于 AI 从音频中学习 的见解,详见 此处。

-

SIXT 的 ML Engineer 职位:位于慕尼黑的 SIXT 正在招聘 ML Engineer,重点关注 NLP 和 Generative AI。感兴趣者可以通过 职业链接 申请。

-

CUDA 在 Groq AI 崛起中依然坚挺:关于 CUDA 是否会随着 Groq AI 的出现而过时的讨论,最终重申了 CUDA 的基础知识仍然具有价值,且不受先进编译器和架构的影响。

-

TPU 兼容性与 ROCm 的 GPU 困境:将代码从 TPU 迁移到 GPU 时面临的形状维度(shape dimension)错误,以及 ROCm 对 AMD GPU 的有限支持是热门话题。分享的用于在 AMD GPU 上进行推理的 GitHub 仓库 缺少必要的 backward 函数/kernel。

-

Ring-Attention 凝聚协作动力:社区正积极参与调试和增强基于 flash-attention 的 ring-attention 实现,并计划进行现场编程会议(live hacking sessions)来解决诸如 FP32 累加必要性等问题。相关的讨论和代码可以在 此仓库 中找到。

-

YouTube 录制频道的日常维护:发布了一项维护频道秩序的提醒,要求用户仅发布与 youtube-recordings 相关的内容,并将无关内容重定向到指定的建议频道。

Perplexity AI Discord 总结

Gemini 揭秘:@brknclock1215 帮助消除了关于 Google Gemini 模型系列 的困惑,分享了诸如 Gemini Advanced (Ultra 1.0) 两个月免费试用、Gemini Pro 1.5 私测版 等资源,并引导用户阅读一篇详述差异的 博客文章。

寻找 Bot 专家:用户对 Perplexity AI bot 表现出戏谑的兴趣,讨论了其离线状态及使用方法。对于 Perplexity Pro 版本 和计费感到困惑的用户,其他人分享了 FAQ 链接以供参考。

API 难题与代码:贡献者报告了 Perplexity API 与网站内容之间的差异,寻求提高准确性。建议指出应使用更简单的查询,同时承认了 pplx-70b-online 模型输出乱码的持续问题,并期待解决。此外,还有关于将 Google 的 GEMMA 集成到 Perplexity API 的咨询。

加密货币与健康搜索成为焦点:好奇的用户进行了 Perplexity AI 搜索,主题涵盖从 cryptocurrency 交易术语到 天然口腔健康 疗法,突显了社区参与话题的多样性。

金融工具查询:对知识的探索引导了一次关于金融工具的 搜索查询,这表明在围绕金融的讨论中,技术专指性是关键趋势。

LangChain AI Discord 总结

-

动态类创建难题:

@deltz_81780在尝试为 PydanticOutputFunctionsParser 动态生成类时遇到了 ValidationError,并在 general 频道寻求帮助。 -

AI 教育扩展:

@mjoeldub宣布了一门专注于 LangChain 和 LCEL 的 LinkedIn Learning 课程,并分享了课程链接,同时重点介绍了由@a404.eth制作的全新“与你的 PDF 聊天” LangChain AI 教程。 -

支持与不满:围绕 LangChain 支持展开了讨论,

@mysterious_avocado_98353表达了失望,而@renlo.则指出在 定价页面 上有付费支持选项。 -

LangSmith API 报错:

@jacobito15在 langserve 频道的批量摄取测试中,因ChannelWrite名称超过 128 个字符而遇到了来自 LangSmith API 的 HTTP 422 错误。 -

创新邀请:

@pk_penguin在 share-your-work 中发出了一个未命名的试用邀请,@gokusan8896在 LinkedIn 上发布了关于 在任何 LLM 模型中进行并行函数调用 的内容,@rogesmith则征求对潜在聚合查询平台/库的反馈。

DiscoResearch Discord 总结

-

Google 开源 Gemma 模型引发语言多样性查询:@sebastian.bodza 关注到 Google 的 Gemma 模型 已开源,并询问了语言支持情况(特别是德语),引发了关于其在 Kaggle 上的列表以及在 Hugging Face 上的指令版本可用性的讨论。对话还涉及了商业方面和词汇量大小。

-

对 Aleph Alpha 模型更新的反应褒贬不一:@sebastian.bodza 对 Aleph Alpha 模型 的更新表示怀疑,强调其缺乏指令微调(instruction tuning),@devnull0 随后提到最近的招聘可能会影响未来的模型质量。批评意见指出更新未包含其 变更日志 中所示的基准测试或示例。

-

推文对模型性能的审视:Gemma 和 Aleph Alpha 模型的有效性引发了批判性讨论,@ivanfioravanti 和 @rohanpaul_ai 发布的推文指出模型存在性能问题,特别是在德语等语言中,以及与 phi-2 等其他模型相比时。

-

Batch Size 影响模型评分:@calytrix 提出了关于 Batch Size 对模型性能影响的问题,特别是 Batch Size 不为 1 可能会导致评分降低,正如 HuggingFace Open LLM Leaderboard 讨论中所指出的。

-

模型测试公平性受到审视:@calytrix 发起了关于模型测试公平性的讨论,提议公平的测试应该是现实的、明确的、不靠运气的且易于理解的,并请求获取一个脚本以重新生成特定博客文章中的指标,深入探讨了可能扭曲模型评估公平性的细微差别。

Skunkworks AI Discord 总结

-

Neuralink 面试内幕技巧:公会成员

@xilo0正在寻求有关即将到来的 Neuralink 面试的建议,特别是如何应对“卓越能力的证据”这一问题,以及应该突出哪些项目来给 Elon Musk 的团队留下深刻印象。 -

探索 AI 增强的深度:

@pradeep1148分享了一系列教育类 YouTube 视频,涵盖了通过自我反思(self-reflection)改进 RAG 以及微调 LLM 的价值存疑等主题,并介绍了 Google 的开源模型 Gemma。 -

关于 KTO 引用的谜团:在 papers 频道中,

nagaraj_arvind神秘地讨论了 KTO,但未透露细节,使得讨论背景不完整,且 KTO 对 AI 工程师的意义也未得到解释。

Datasette - LLM (@SimonW) Discord 总结

-

Google 的 Gemini Pro 1.5 重新定义边界:Google 新发布的 Gemini Pro 1.5 提供了 1,000,000 token 的上下文窗口,并通过引入 视频输入 能力进一步创新。Simon W 对这些功能表示了极大的热情,认为这使其区别于 Claude 2.1 和 gpt-4-turbo 等其他模型。

-

Google ML 产品的新文档:Google 机器学习产品的最新文档现已可在 Google AI Developer Site 访问,不过目前尚未提供关于文档内容的具体细节。

-

寻求 LLM 集成故障的支持:在处理系统集成挑战时,@simonw 建议将任何未解决的问题报告给 gpt4all 团队以寻求帮助。

-

GPT-Vision 的愿景:针对在大型语言模型 (LLMs) 中加入文件支持的问题,@simonw 建议为 GPT-Vision 添加图像支持。

-

Gemma 模型初期问题:有报告称新的 Gemma 模型 输出的是占位符文本而非预期结果,建议通过

llm python命令更新依赖项来尝试修复此问题。

Alignment Lab AI Discord 总结

- 寻找 Token?:Scopexbt 询问是否存在与社区相关的 token,并指出目前缺乏相关信息。

- GLAN 讨论启动:

.benxh通过发布 GLAN 论文 分享了对 Gradient Layerwise Adaptive-Norms (GLAN) 的兴趣,引发了积极的反响。

LLM Perf Enthusiasts AI Discord 总结

- Google 发布 Gemma:在 #opensource 频道中,potrock 分享了一篇 博客文章,宣布了 Google 新的 Gemma 开放模型 计划。

- 对比方法获得认可:在 #embeddings 频道中,一位用户表达了对 ContrastiveLoss 的支持,强调了其在微调 embedding 方面的功效,并提到 MultipleNegativesRankingLoss 是另一个常用的损失函数。

- 警惕 Salesforce 实现:在 #general 频道中,res6969 警告不要采用 Salesforce,暗示对于组织来说这可能是一个灾难性的选择。

AI Engineer Foundation Discord 总结

- 技术畅谈:Gemini 1.5 等你来!:

@shashank.f1邀请大家参加关于 Gemini 1.5 的实时讨论,并介绍了之前的会议,包括关于从音频中提取语义知识的 A-JEPA AI 模型 的演讲。之前的见解可在 YouTube 上查看。 - 周末研讨会奇思妙想:

@yikesawjeez考虑将原定的活动移至周末,旨在获得更好的参与机会和潜在的赞助合作,其中可能包括在 Twitter 上与@llamaindex建立联系以及设置 Devpost 页面。

第二部分:频道详细总结与链接

TheBloke ▷ #general (1132 条消息🔥🔥🔥):

-

探索 LLM 游戏动态:用户尝试使用语言模型来评估其准确理解指令的能力,特别是在猜数字游戏的语境下,模型需要选择一个数字并根据用户的猜测进行互动。

-

聊天机器人用户体验讨论:用户对比了不同的聊天机器人 UI,重点关注其设置和使用的便捷性。对话中包含了对 Nvidia 的 Chat with RTX 的尖锐批评,以及对 Polymind 等更小、更高效设置的赞赏。

-

函数调用挑战与 RAG 实现:讨论内容包括实现检索与生成 (RAG) 功能的复杂性以及用户的自定义实现,批评了现有实现的复杂性,并赞扬了更精简的版本。

-

Discord 机器人与 CSS 难题:用户分享了对 CSS 实现难度的挫败感,并讨论了如何定制 Discord 机器人以实现更好的用户交互和任务处理。

-

优化与模型偏好:硬件限制和优化是一个重要话题,用户针对各种硬件配置建议了合适的模型。对话强调了显存 (VRAM) 的重要性以及性能与模型复杂度之间的平衡。

提到的链接:

- 来自 Alex Cohen (@anothercohen) 的推文:遗憾地告诉大家,我今天被 Google 解雇了。我之前负责让 Gemini 的算法尽可能地“觉醒”(woke)。在今天 Twitter 上出现投诉后,我突然失去了访问权限…

- Bloomberg - 你是机器人吗?:未找到描述

- Bloomberg - 你是机器人吗?:未找到描述

- 试用全新 NVIDIA App Beta:PC 游戏玩家与创作者的必备伴侣:NVIDIA app 是保持驱动程序更新、发现 NVIDIA 应用程序、捕捉精彩瞬间以及配置 GPU 设置的最简单方式。

- 一无所知 GIF - No Idea IDK I Dunno - 发现并分享 GIF:点击查看 GIF

- Chris Pratt Andy Dwyer GIF - Chris Pratt Andy Dwyer Omg - 发现并分享 GIF:点击查看 GIF

- Wyaking GIF - Wyaking - 发现并分享 GIF:点击查看 GIF

- 不睡觉 GIF - No Sleep Love - 发现并分享 GIF:点击查看 GIF

- https://i.redd.it/1v6hjhd86vj31.png:未找到描述

- 我不知道但我喜欢它 Idk GIF - I Dont Know But I Like It I Dont Know Idk - 发现并分享 GIF:点击查看 GIF

- ASP.NET Core 有多快?:编程冒险

- 机器准备中 GIF - Machine Preparing Old Man - 发现并分享 GIF:点击查看 GIF

- 绘画 GIF - Painting Bob Ross - 发现并分享 GIF:点击查看 GIF

- 3rd Rock GIF - 3rd Rock From - 发现并分享 GIF:点击查看 GIF

- Reddit - 深入探索一切:未找到描述

- LLM (结合 RAG) 需要一个新的逻辑层 (斯坦福):Google DeepMind 和斯坦福大学关于当前 LLM (Gemini Pro, GPT-4 TURBO) 在因果推理和逻辑方面局限性的新见解。

- VRAM 计算器:未找到描述

- GitHub - itsme2417/PolyMind: 一个多模态、支持 function calling 的 LLM webui。:一个多模态、支持 function calling 的 LLM webui。 - GitHub - itsme2417/PolyMind: 一个多模态、支持 function calling 的 LLM webui。

- Reddit - 深入探索一切:未找到描述

- 反推 DeepBooru:AUTOMATIC1111 中用于分析和标记图像的功能:了解 DeepBooru 图像分析和标记的强大功能。了解此功能如何增强 AUTOMATIC1111 以进行动漫风格的艺术创作。立即反推 DeepBooru!

- GitHub - Malisius/booru2prompt: 一个用于 stable-diffusion-webui 的扩展,将图像 booru 帖子转换为提示词:一个用于 stable-diffusion-webui 的扩展,将图像 booru 帖子转换为提示词 - Malisius/booru2prompt

TheBloke ▷ #characters-roleplay-stories (299 messages🔥🔥):

-

角色扮演微调技巧:

@superking__和@netrve探讨了角色扮演模型的微调细节;关于让 base model 了解一切,然后通过微调使角色仅编写其应该知道的内容。还提到了使用 DPO (Dynamic Prompt Optimization) 来缩小训练范围,并询问训练数据集中科学论文的格式化方式。 -

通过 AI 头脑风暴获得更好的回复:

@superking__观察到,在给出答案之前让模型进行头脑风暴通常会让它显得更聪明。相反,由于硬件资源有限,强制模型使用 grammars 回答可能会让它显得更笨。 -

探索模型中的科学论文格式:

@kaltcit分享了他们对科学论文进行 DPO 的过程,从学术论文中为 DPO 创建了一个折叠数据集 (collapsed dataset),并与@c.gato讨论了训练过程中模型 loss spikes(损失尖峰)的问题。 -

角色扮演与 ChatML 提示词策略:

@superking__和@euchale讨论了角色扮演的 prompt structures(提示词结构)以及如何防止不希望出现的视角切换,而@netrve分享了使用 MiquMaid v2 进行角色扮演的经验,并指出它有时对色情内容表现得过于积极。 -

发布新的 AI 故事写作与角色扮演模型:

@dreamgen宣布发布专门为故事写作和角色扮演设计的新 AI 模型。这些模型基于人工生成的数据进行训练,可以在 ChatML 的扩展版本中使用提示词,旨在实现可控的交互。@splice0001和@superking__等用户对测试这些模型表现出了极大的热情。

提到的链接:

- LoneStriker/miqu-1-70b-sf-5.5bpw-h6-exl2 · Hugging Face: 未找到描述

- Viralhog Grandpa GIF - Viralhog Grandpa Grandpa Kiki Dance - Discover & Share GIFs: 点击查看 GIF

- Sheeeeeit GIF - Sheeeeeit - Discover & Share GIFs: 点击查看 GIF

- dreamgen/opus-v1-34b · Hugging Face: 未找到描述

- Opus V1: Story-writing & role-playing models - a dreamgen Collection: 未找到描述

- DreamGen: AI role-play and story-writing without limits: 未找到描述

- Models - Hugging Face: 未找到描述

- Models - Hugging Face: 未找到描述

TheBloke ▷ #training-and-fine-tuning (3 messages):

-

为代码分类选择合适的模型:用户

@yustee.正在寻求建议,以选择一个 LLM 来为 RAG 流水线中的查询分类代码相关性。@yustee.正在考虑 deepseek-coder-6.7B-instruct,但也欢迎其他推荐。 -

Mistral 下载困境:用户

@aamir_70931正在寻求在本地下载 Mistral 的帮助,但未提供进一步的上下文或后续信息。

TheBloke ▷ #coding (163 条消息🔥🔥):

-

ML 工作流难题与 Mac 之谜:

@fred.bliss讨论了在使用 Mac Studio 建立机器学习项目工作流时面临的挑战,并考虑因架构更简单而使用llama.cpp代替 ollama。尽管他们已经在非 GPU 的 PC 上使用llama.cpp有一段时间了,但他们对市场推崇 ollama 的趋势表示担忧。 -

探索 MLX 和 Zed 作为 VSCode 的替代方案:

@dirtytigerx推荐在处理 TensorFlow/Keras 任务时使用 MLX,并称赞了由 Atom 团队开发的文本编辑器 Zed,认为其性能优异且配置极简,优于 Visual Studio Code。此外,他们还对从 Atom 分叉出来的开源项目 Pulsar 表现出了一定兴趣。 -

VsCode 与 Zed 之争:

@dirtytigerx向@wbsch详细说明了他们更倾向于 Zed 而非 Visual Studio Code 的原因,强调了 Zed 的极简设计和速度。他们还讨论了使用 Neovim 作为替代方案的经验,以及 Zed 像 VSCode 一样支持远程开发的潜力。 -

微软向开发者导向的转型:

@dirtytigerx和@wbsch讨论了微软在迎合开发者方面的转型策略,特别提到收购 GitHub 带来的积极进展,以及集成了 Copilot 等工具的 VSCode 的普及。 -

扩展推理服务器与 GPU 利用率:在与

@etron711的对话中,@dirtytigerx就扩展推理服务器以处理大量用户的策略提供了建议,建议先使用较便宜的资源进行原型设计(例如在 runpod 上以 0.80 美元/小时的价格租用 4090),作为成本分析的第一步。他们还提醒在与 AWS 等供应商合作时,要注意对 GPU 可用性和 SLA 的依赖。

提到的链接:

- GitHub - raphamorim/rio: A hardware-accelerated GPU terminal emulator focusing to run in desktops and browsers.: 一个专注于在桌面和浏览器中运行的硬件加速 GPU 终端模拟器。- raphamorim/rio

- GitHub - pulsar-edit/pulsar: A Community-led Hyper-Hackable Text Editor: 一个由社区主导的、具有高度可定制性的文本编辑器。可以通过在 GitHub 上创建账户来为 pulsar-edit/pulsar 的开发做出贡献。

LM Studio ▷ #💬-general (598 messages🔥🔥🔥):

- LM Studio 发布更新:建议用户从官网手动下载最新的 LM Studio 更新,因为应用内的“Check for Updates”功能目前无法正常工作。

- Gemma 模型讨论:许多用户报告了 Gemma 7B 模型的问题,部分用户称即使在更新后仍存在性能问题。Gemma 2B 模型获得了一些正面反馈,并分享了 Hugging Face 上可用的 Gemma 2B 链接。

- 新版本 LM Studio 的性能问题:几位用户描述了在 MacOS 上使用最新版本 LM Studio 时出现的性能下降和高 CPU 占用问题,特别是影响到了 Mixtral 7B 模型。

- 在 M1 Mac 上运行 Gemma 7B 需要调整 GPU 滑块:在 M1 Mac 上运行 Gemma 7B 的用户注意到,将 GPU 滑块调整至“max”后性能有显著提升,尽管部分用户仍感到响应速度较慢。

- Stable Diffusion 3 发布公告:Stability.ai 宣布 Stable Diffusion 3 进入早期预览阶段,承诺将提升性能和多主体图像质量。用户表现出浓厚兴趣并讨论了如何申请预览。

提到的链接:

- 👾 LM Studio - Discover and run local LLMs:查找、下载并实验本地 LLM。

- lmstudio-ai/gemma-2b-it-GGUF · Hugging Face:未找到描述。

- MSN:未找到描述。

- Gemma: Introducing new state-of-the-art open models:Gemma 是一个轻量级、先进的开源模型系列,基于与 Gemini 模型相同的研究和技术构建。

- Stable Diffusion 3 — Stability AI:宣布 Stable Diffusion 3 进入早期预览版,这是我们功能最强大的文本生成图像模型,在多主体提示词、图像质量和拼写能力方面有显著提升。

- google/gemma-7b · Hugging Face:未找到描述。

- LoneStriker/gemma-2b-GGUF · Hugging Face:未找到描述。

- Reddit - Dive into anything:未找到描述。

- How To Run Stable Diffusion WebUI on AMD Radeon RX 7000 Series Graphics:你知道可以在 Automatic1111 下通过 Microsoft Olive 启用 Stable Diffusion,从而在 Windows 上通过 Microsoft DirectML 获得显著加速吗?

- جربت ذكاء إصطناعي غير خاضع للرقابة، وجاوبني على اسئلة خطيرة:YouTube 视频链接,涉及不受限制的 AI 讨论。

- GitHub - lllyasviel/Fooocus: Focus on prompting and generating:专注于提示和生成。通过在 GitHub 上创建账号为 Fooocus 的开发做贡献。

- Mistral's next LLM could rival GPT-4, and you can try it now in chatbot arena:法国 LLM 奇迹 Mistral 正准备发布其下一个语言模型。你现在已经可以在 chat arena 中进行测试。

- Need support for GemmaForCausalLM · Issue #5635 · ggerganov/llama.cpp:llama.cpp 的 GitHub Issue,关于支持 GemmaForCausalLM 的讨论。

LM Studio ▷ #🤖-models-discussion-chat (149 条消息🔥🔥):

-

Gemma 模型混淆:用户在使用 Gemma 模型时遇到问题。

@macaulj报告在 GPU 上运行 7b Gemma 模型时出错,而@nullt3r提到量化模型目前已损坏,正在等待 llama.cpp 的修复。@yagilb建议检查 2B 版本,因为目前流传着许多错误的量化版本,@heyitsyorkie澄清说 LM Studio 需要更新后 Gemma 模型才能正常运行。 -

LM Studio 模型兼容性与错误:包括

@swiftyos和@thorax7835在内的多位用户讨论了寻找最适合编程和无审查对话的模型,而@bambalejo在使用 Nous-Hermes-2-Yi-34B.Q5_K_M.gguf 模型时遇到了故障。LM Studio 0.2.15 版本中一个导致重新生成时输出乱码的已知 Bug 已得到处理,@heyitsyorkie提出了修复建议。 -

图像生成模型讨论:

@antonsosnicev询问是否有类似于 Adobe 生成式填充(generative fill)的图片生成功能,@swight709建议使用 AUTOMATIC1111 的 Stable Diffusion web UI,因为它具备局部重绘(inpainting)和扩图(outpainting)等功能,并强调了其丰富的插件系统,以及它与专注于文本生成的 LM Studio 的区别。 -

硬件和配置挑战:包括

@goldensun3ds和@wildcat_aurora在内的用户分享了他们的配置以及运行 Goliath 120B Q6 等大型模型的挑战,讨论了性能与硬件限制(如 VRAM 和系统内存带宽)之间的权衡。 -

多模态 AI 期待:对话涉及了对能够处理超出当前能力任务的模型的希望。

@drawingthesun表达了希望 LLM 和 Stable Diffusion 模型能够交互的愿望,而@heyitsyorkie暗示未来将出现功能更广泛的多模态模型。

提到的链接:

- 👾 LM Studio - 发现并运行本地 LLMs:查找、下载并实验本地 LLM。

- EvalPlus Leaderboard:未找到描述。

- 掌握生成式 AI 开发栈:实践手册:又一篇 AI 文章。有时可能会让人应接不暇。在这份综合指南中,我将简化复杂的生成式 AI 世界……

- lmstudio-ai/gemma-2b-it-GGUF · Hugging Face:未找到描述。

- ImportError: libcuda.so.1: cannot open shared object file:当我直接用 TensorFlow 运行代码时,一切正常。然而,当我在 screen 窗口中运行时,出现了以下错误。ImportError: libcuda.so.1: cannot open shared object fi…

- macaulj@macaulj-HP-Pavilion-Gaming-Laptop-15-cx0xxx:~$ sudo ‘/home/macaulj/Downl - Pastebin.com:Pastebin.com 是自 2002 年以来排名第一的文本存储工具。Pastebin 是一个可以在线存储一段时间文本的网站。

- Big Code Models Leaderboard - Hugging Face Space (由 bigcode 提供):未找到描述。

- ```json{ “cause”: “(Exit code: 1). Please check settings and try loading th - Pastebin.com:Pastebin.com 是自 2002 年以来排名第一的文本存储工具。

- Models - Hugging Face:未找到描述。

- wavymulder/Analog-Diffusion · Hugging Face:未找到描述。

- 使用 LM Studio LLMs (AI Chatbot) 测试 Shadow PC Pro (Cloud PC) 并与我的 RTX 4060 Ti PC 进行对比:自 ChatGPT 发布约一年以来我一直在使用它,并且已经熟练掌握了提示词工程,但我对于“本地”运行 LLM 还是个新手。当…

- GitHub - AUTOMATIC1111/stable-diffusion-webui: Stable Diffusion web UI:Stable Diffusion web UI。通过在 GitHub 上创建账号为 AUTOMATIC1111/stable-diffusion-webui 的开发做出贡献。

- Reddit - 深入探索:未找到描述。

LM Studio ▷ #announcements (4 条消息):

-

LM Studio v0.2.15 发布公告:

@yagilb发布了 LM Studio v0.2.15,带来了令人兴奋的新功能,包括对 Google Gemma 模型 的支持、改进的下载管理、对话分支(conversation branching)、GPU 配置工具、全新的 UI 以及多项 Bug 修复。该更新适用于 Mac、Windows 和 Linux,可从 LM Studio 官网下载,Linux 版本请点击此处。 -

关键 Bug 修复更新:

@yagilb敦促用户从 LM Studio 官网重新下载 LM Studio v0.2.15,因为原始版本中遗漏了一些关键的 Bug 修复。 -

Gemma 模型集成技巧:

@yagilb为 LM Studio 用户分享了推荐的 Gemma 2b Instruct quant(量化版)链接,可在 Hugging Face 获取,并提醒用户注意 Google 关于 Gemma 服务的相关使用条款。 -

LM Studio v0.2.16 现已上线:继之前的公告之后,

@yagilb通知用户 LM Studio v0.2.16 已立即发布。该版本包含了 v0.2.15 更新的所有内容,并额外修复了下载期间不稳定的重新生成(regenerations)和聊天滚动问题。建议已更新至 v0.2.15 的用户尽快更新到 v0.2.16。

相关链接:

- 👾 LM Studio - 发现并运行本地 LLMs:查找、下载并实验本地 LLMs

- lmstudio-ai/gemma-2b-it-GGUF · Hugging Face:未找到描述

LM Studio ▷ #🧠-feedback (30 条消息🔥):

-

本地 LLM 安装问题:用户

@maaxport询问在获取 LM Studio 后如何配合 AutoGPT 安装本地 LLM,并表示希望将其托管在租用的服务器上。@senecalouck提供了建议,指出设置本地 API endpoint 并更新base_url即可满足本地运行需求。 -

客户端更新困惑:

@msz_mgs对客户端版本感到困惑,指出尽管有更新的版本,但 0.2.14 仍被识别为最新版。@heyitsyorkie澄清说目前尚不支持应用内更新(in-app updating),需要手动下载并安装。 -

Gemma 模型错误及解决方案:

@richardchinnis在使用 Gemma 模型时遇到问题,经过讨论,@yagilb分享了一个 Hugging Face 上的 2B 量化模型链接 以解决这些错误。 -

Gemma 7b 下载可见性排障:用户

@adtigerning和@thebest6337讨论了 Gemma 7b 下载文件的可见性问题,指出在 LM Studio 中查看 Google Files 时存在问题。@heyitsyorkie就手动下载及预期的文件存放位置提供了指导。 -

滚动问题的 Bug 报告:

@drawingthesun报告了聊天中的滚动问题,随后@heyitsyorkie确认这是一个已知 Bug。@yagilb随后宣布在 0.2.16 版本中修复了该 Bug,@heyitsyorkie也确认了该问题已解决。

相关链接:

- 👾 LM Studio - 发现并运行本地 LLMs:查找、下载并实验本地 LLMs

- lmstudio-ai/gemma-2b-it-GGUF · Hugging Face:未找到描述

LM Studio ▷ #🎛-hardware-discussion (130 条消息🔥🔥):

-

财报引发 Nvidia 焦虑:

@nink1分享了他们对 Nvidia 财报的焦急期待,因为他们将毕生积蓄投资在了 Nvidia 产品上,特别是 3090 显卡。尽管@heyitsyorkie调侃可能会有“大牛股 (big stonks)”收益,但@nink1澄清说他们的投资是在硬件上,而不是股票。 -

解读闪存阵列的价值:

@wolfspyre思考了三个 30Tb 闪存阵列(每个支持 1M iops)的潜在应用,引发了与@heyitsyorkie关于盗版以及海盗生活的弊端(如坏血病和恶劣的工作条件)的幽默交流。 -

VRAM 与用于 AI 渲染的新 GPU 之争:

@freethepublicdebt询问在运行 Mixtral8x7 等大模型时,使用多个廉价 GPU 来增加 VRAM 的价值。@heyitsyorkie提供了 GPU 规格链接,并建议虽然更多的 VRAM 是关键,但 GPU 性能也不容忽视,有时像 RTX 3090 这样单张强大的显卡就足够了。 -

Tesla P40 在预算受限的情况下受到关注:

@wilsonkeebs和@krypt_lynx等参与者讨论了 Tesla P40 等旧款 GPU 用于 AI 任务的可行性,权衡了它们的易获得性与相比 RTX 3090 等新型替代品较慢的性能。 -

旧款 Nvidia 显卡的 AI 能力受到质疑:

@exio4和@bobzdar等几位用户分享了他们关于使用旧款 Nvidia GPU 执行 AI 任务的经验和测试结果,显示出新显卡的进步对 AI 建模和推理的性能提升贡献巨大。

提到的链接:

- 未找到标题:未找到描述

- 在 Apple Neural Engine 上部署 Transformers:我们在 Apple 每年构建的机器学习 (ML) 模型中,有越来越多的模型正在部分或全部采用 [Transformer…

- MAG Z690 TOMAHAWK WIFI:微星 MAG Z690 TOMAHAWK WIFI 搭载 Intel 第 12 代 Core 处理器,具备性能核心规格,经久耐用。通过 Core boost、Memory B… 进行了更好的性能调优。

- Have You GIF - Have You Ever - Discover & Share GIFs:点击查看 GIF

- 2023 年深度学习最佳 GPU —— 深度分析: 在这里,我提供了用于深度学习/机器学习的 GPU 深度分析,并解释了适合您的使用场景和预算的最佳 GPU。

- 2023 年深度学习最佳 GPU —— 深度分析): 在这里,我提供了用于深度学习/机器学习的 GPU 深度分析,并解释了适合您的使用场景和预算的最佳 GPU。

- NVIDIA GeForce RTX 2060 SUPER 规格: NVIDIA TU106, 1650 MHz, 2176 Cores, 136 TMUs, 64 ROPs, 8192 MB GDDR6, 1750 MHz, 256 bit

- NVIDIA GeForce RTX 3090 规格: NVIDIA GA102, 1695 MHz, 10496 Cores, 328 TMUs, 112 ROPs, 24576 MB GDDR6X, 1219 MHz, 384 bit

LM Studio ▷ #🧪-beta-releases-chat (266 messages🔥🔥):

- Gemma Quants 表现存疑:用户报告 Google 的 Gemma 模型表现参差不齐,发现

7b-it量化版本经常输出乱码,而2b-it量化版本似乎很稳定且运行良好。@drawless111强调全精度模型对于达到基准测试结果是必要的,并建议较小的 (1-3B) 模型需要更精确的 Prompt 和设置。 - LM Studio 持续改进:

@yagilb发布了新的 LM Studio 下载版本,包含重大 Bug 修复,特别是解决了此处提到的重新生成(regenerate)功能和多轮对话的问题。@yagilb还澄清了重新生成问题与模型无关,而是由于糟糕的量化版本导致的;团队正在研究如何简化功能完备模型的下载流程。 - Gemma 7B 体积问题说明:用户讨论了 Google Gemma

7b-it模型体积庞大的原因,指出其缺乏量化且内存需求巨大。值得注意的是,llama.cpp 目前与 Gemma 存在兼容性问题,预计很快会得到解决。 - 提升性能的用户友好预设:用户一致认为需要正确的 Preset(预设)才能从 Gemma 模型中获得良好结果,

@pandora_box_open强调了特定预设的必要性,以避免输出质量低下。 - LM Studio 确认可用的 GGUF:

@yagilb推荐了一个他们为 LM Studio 量化并测试过的 2B IT Gemma 模型,并计划上传 7B 版本。@issaminu确认该 2B 模型可以工作,但智能程度不如功能更完备的 7B 模型。

提到的链接:

- 👾 LM Studio - Discover and run local LLMs:发现、下载并实验本地 LLM

- 👾 LM Studio - Discover and run local LLMs:发现、下载并实验本地 LLM

- asedmammad/gemma-2b-it-GGUF · Hugging Face:未找到描述

- Thats What She Said Dirty Joke GIF - Thats What She Said What She Said Dirty Joke - Discover & Share GIFs:点击查看 GIF

- HuggingChat:让社区最好的 AI 聊天模型对所有人可用。

- ```json{ "cause": "(Exit code: 1). Please check settings and try loading th - Pastebin.com:Pastebin.com 自 2002 年以来是排名第一的粘贴工具。Pastebin 是一个可以在线存储文本一段时间的网站。

- google/gemma-2b-it · Hugging Face:未找到描述

- lmstudio-ai/gemma-2b-it-GGUF · Hugging Face:未找到描述

- LoneStriker/gemma-2b-it-GGUF · Hugging Face:未找到描述

- google/gemma-7b · Why the original GGUF is quite large ?:未找到描述

- google/gemma-7b-it · Hugging Face:未找到描述

- Need support for GemmaForCausalLM · Issue #5635 · ggerganov/llama.cpp:前提条件 在提交 Issue 之前,请先自行回答以下问题。我正在运行最新的代码。由于开发非常迅速,目前还没有标记版本。我…

- Add

gemmamodel by postmasters · Pull Request #5631 · ggerganov/llama.cpp:该架构中有几点:共享输入和输出 Embedding 参数。Key 长度和 Value 长度不是由 n_embd 派生的。关于模型的更多信息可以在…找到。

Nous Research AI ▷ #ctx-length-research (97 条消息🔥🔥):

- 通过长上下文数据工程进行扩展:

@gabriel_syme对名为 “Long-Context Data Engineering” 的 GitHub 仓库表示兴奋,提到了将语言模型扩展到 128K 上下文的数据工程技术实现。 - 128K 上下文模型的 VRAM 需求:在关于 7B 模型在 128K 上下文下的 VRAM 需求查询中,

@teknium澄清说需要超过 600GB。 - Tokenization 查询与考量:

@vatsadev提到 GPT-3 和 GPT-4 的 Tokenizer 可以在 tiktoken 中找到,并引用了 Andrej Karpathy 的相关视频,但未提供直接链接。 - Token 压缩挑战:

@elder_plinius提出了在尝试将《谋杀绿脚趾》(Big Lebowski)剧本放入上下文限制内时的 Token 压缩问题,引发了与@vatsadev和@blackl1ght关于 Tokenizer 以及 OpenAI tokenizer playground 服务器行为的讨论,最终观察到为什么压缩文本能被 ChatGPT 接受而原始文本却不行的原因。 - 在较低 VRAM 上进行长上下文推理:

@blackl1ght分享了他们在 V100 32GB 上仅用 28GB VRAM 就在 64K 上下文下对 Mistral 7B 和 Solar 10.7B 进行了推理,这引发了与@teknium和@bloc97关于该方法可行性以及大型模型中 KV Cache 容量和 Offloading 的讨论。

提到的链接:

- gpt-tokenizer playground:未找到描述

- Aran Komatsuzaki (@arankomatsuzaki) 的推文:Microsoft Research 发布 LongRoPE:将 LLM 上下文窗口扩展至 200 万 Token 以上 https://arxiv.org/abs/2402.13753

- Pliny the Prompter 🐉 (@elder_plinius) 的推文:《谋杀绿脚趾》剧本通常无法完全放入 GPT-4 的上下文限制中,但在通过 myln 处理文本后,它可以了!

- GitHub - FranxYao/Long-Context-Data-Engineering: Implementation of paper Data Engineering for Scaling Language Models to 128K Context:论文《Data Engineering for Scaling Language Models to 128K Context》的实现 - FranxYao/Long-Context-Data-Engineering

Nous Research AI ▷ #off-topic (16 条消息🔥):

-

神秘的 Minecraft 生物查询:用户

@teknium询问了 Minecraft 中某种特定生物的存在。@nonameusr的回答简短有力:“一直都有”。 -

在 RAG 中探索自我反思 AI:

@pradeep1148分享了一个名为“使用 LangGraph 进行 Self RAG”的 YouTube 视频链接,该视频建议自我反思可以增强检索增强生成(RAG)模型。 -

艺术图像生成的初学者指南请求:用户

@blackblize询问非专业人士是否可行在显微镜照片上训练模型以用于艺术目的,并寻求相关指导。 -

AI 生成 Minecraft 视频的进展:

@afterhoursbilly分析了 AI 如何理解 Minecraft 视频中的物品栏 UI,而@_3sphere补充说,虽然 AI 生成的图像乍看之下很正常,但在仔细观察时会发现不准确之处。 -

讨论 Nous 模型的头像生成:针对

@stoicbatman对 Nous 模型头像生成的好奇,@teknium提到使用了 DALL-E,随后通过 Midjourney 进行 img2img 处理。

提到的链接:

- Gemma Google 的开源 SOTA 模型:Gemma 是一个轻量级、最先进的开放模型系列,基于创建 Gemini 模型所使用的相同研究和技术构建。由 Google 开发…

- 使用 LangGraph 进行 Self RAG:自我反思可以增强 RAG,从而纠正低质量的检索或生成。最近的几篇论文都聚焦于这一主题,但实现起来…

- BitDelta: Your Fine-Tune May Only Be Worth One Bit:大语言模型(LLM)通常分两个阶段训练:在大规模互联网数据集上进行预训练,以及针对下游任务进行微调。鉴于…

Nous Research AI ▷ #interesting-links (38 条消息🔥):

-

Google 发布 Gemma:

@burnytech分享了@sundarpichai的一条推文链接,宣布推出 Gemma,这是一个轻量级且开源的模型系列,提供 2B 和 7B 两种尺寸。Sundar Pichai 的推文 表达了对全球可用性的兴奋,并鼓励在从开发者笔记本电脑到 Google Cloud 的各种平台上使用 Gemma 进行创作。 -

Gemini 1.5 讨论进行中:

@shashank.f1邀请用户参加关于 Gemini 1.5 的讨论,并提到了之前关于 A-JEPA AI 模型的会议。@ldj指出,该模型与 Meta 或 Yann Lecun 无关。 -

OpenAI 的 LLama 被复现版本超越:

@euclaise和@teknium讨论了 OpenAI LLama 的一个复现版本如何表现优于原版,这增加了人们对模仿模型能力的兴趣。 -

人类知识导航:

@.benxh提供了一种导航人类知识和能力分类的方法,建议建立一个包含所有可能领域的结构化列表,并引导用户参考 美国国会图书馆 以获取详尽示例。 -

Microsoft 将 LLM 推向新长度:

@main.ai链接了@_akhaliq的一条推文,内容关于 Microsoft 的 LongRoPE。这是一种将 LLM 上下文窗口扩展到 200 万个 token 以上的技术,可以说彻底改变了 LLaMA 和 Mistral 等模型的长文本处理能力。该推文强调了这一进步,同时也没有忽视在原始上下文窗口大小下的性能。

提到的链接:

- 来自 Sundar Pichai (@sundarpichai) 的推文:介绍 Gemma - 一个轻量级、同类领先的开源模型系列,采用与构建 Gemini 模型相同的研究和技术。展示了强大的性能…

- 加入 hedwigAI Discord 服务器!:查看 Discord 上的 hedwigAI 社区 - 与其他 50 名成员一起交流,享受免费的语音和文字聊天。

- 来自 AK (@_akhaliq) 的推文:Microsoft 推出 LongRoPE,将 LLM 上下文窗口扩展至 200 万个 token 以上。大上下文窗口是大语言模型 (LLM) 中一个理想的特性。然而,由于高昂的微调成本…

- 来自 Emad (@EMostaque) 的推文:@StabilityAI 一些说明:- 这使用了一种新型的 Diffusion Transformer(类似于 Sora),并结合了 Flow Matching 和其他改进。- 这利用了 Transformer 的改进,并且可以…

-

[Library of Congress Subject Headings - LC Linked Data Service: Authorities and Vocabularies Library of Congress](https://id.loc.gov/authorities/subjects.html):未找到描述 - benxh/us-library-of-congress-subjects · Hugging Face 数据集:未找到描述

- A-JEPA AI 模型:从 .wav / .mp3 文件或音频频谱图中解锁语义知识:🌟 解锁 AI 从音频中学习的力量!🔊 观看与 Oliver, Nevil, Ojasvita, Shashank, Srikanth 和 N… 深入讨论 A-JEPA 方法。

- JARVIS/taskbench at main · microsoft/JARVIS:JARVIS,一个将 LLM 与 ML 社区连接的系统。论文:https://arxiv.org/pdf/2303.17580.pdf - microsoft/JARVIS

- JARVIS/easytool at main · microsoft/JARVIS:JARVIS,一个将 LLM 与 ML 社区连接的系统。论文:https://arxiv.org/pdf/2303.17580.pdf - microsoft/JARVIS

Nous Research AI ▷ #general (419 messages🔥🔥🔥):

- Gemma vs Mistral 对决:推文正在流传,比较 Google Gemma 与 Mistral 的 LLM,声称即使经过几个小时的测试,Gemma 的表现也没有超过 Mistral 的 7B 模型,尽管它比 Llama 2 更好。

- 关于 Gemma 指令遵循的讨论:

@big_ol_tender注意到,对于 Nous-Mixtral 模型,将指令放在命令末尾似乎比放在开头更有效,这引发了关于命令格式的讨论。 - 不同服务上 VM 的速度:建议

@mihai4256尝试 VAST,以获得比 Runpod 更快、更具性价比的 VM,而另一位用户指出,尽管存在速度问题,Runpod 的 UX 更好。@lightvector_随后报告说,今天所有供应商似乎都很慢。 - 对使用加密货币支付 GPU 租用时间的关注:

@protofeather询问哪些平台提供使用加密货币购买 GPU 时间的服务,得到的建议是 Runpod 和 VAST,不过有人澄清说 Runpod 需要 Crypto.com 的 KYC 注册。 - Gemma 可能获得的 Axolotl 支持:

@gryphepadar使用 Axolotl 对 Gemma 进行了全量微调(full finetune),指出 Gemma 的大小似乎是 10.5B,因此比 Mistral 需要多得多的 VRAM。此外,用户分享了他们在各种设置和 DPO 数据集上的困难和成功经验。

提到的链接:

- 来自 Aaditya Ura (Ankit) (@aadityaura) 的推文:来自 @GoogleDeepMind @GoogleAI 的新模型 Gemma 在医疗/保健领域的基准测试中没有表现出强大的性能。@GoogleDeepMind 的 Gemma 与 Mistral 的侧向对比…

- 来自 anton (@abacaj) 的推文:在尝试了 Gemma 几个小时后,我可以说明它不会取代我的 Mistral 7B 模型。它比 Llama 2 更好,但令人惊讶的是并不比 Mistral 强。Mistral 团队确实做出了一个甚至连 Google 都…

- 伤心猫咪 GIF - Sad Cat - 发现并分享 GIF:点击查看 GIF

- LMSys Chatbot Arena 排行榜 - lmsys 的 Hugging Face Space:未找到描述

- indischepartij/MiniCPM-3B-Hercules-v2.0 · Hugging Face:未找到描述

- 来自 TokenBender (e/xperiments) (@4evaBehindSOTA) 的推文:根据我目前的测试,在通用微调或推理方面可以忽略 Gemma。然而,稍后可能会探索印度语系(indic language)的探索和特定用例测试。现在回到构建中…

- 未找到标题:未找到描述

- Models - Hugging Face:未找到描述

- Reddit - 深入了解任何事物:未找到描述

- eleutherai:Weights & Biases,机器学习开发者工具

- 新手 LLM 训练指南:由 Alpin 编写,灵感来自 /hdg/ 的 LoRA 训练 rentry。本指南正在缓慢更新中。我们已经迁移到了 Axolotl 训练器。基础知识、Transformer 架构、训练基础、预训练…

- GitHub - facebookresearch/diplomacy_cicero: Cicero 的代码,这是一个通过开放域自然语言协商玩《外交》(Diplomacy)游戏的 AI Agent。:Cicero 的代码,这是一个通过开放域自然语言协商玩《外交》(Diplomacy)游戏的 AI Agent。 - facebookresearch/diplomacy_cicero

- Neuranest/Nous-Hermes-2-Mistral-7B-DPO-BitDelta 在 main 分支:未找到描述

- BitDelta:未找到描述

- GitHub - FasterDecoding/BitDelta:通过创建一个账户为 FasterDecoding/BitDelta 的开发做出贡献。

- 由 monk1337 添加 Google 的 Gemma 模型 · Pull Request #1312 · OpenAccess-AI-Collective/axolotl:添加 Gemma 模型配置 https://huggingface.co/google/gemma-7b 测试通过并正常工作!

Nous Research AI ▷ #ask-about-llms (9 messages🔥):

- 自定义 Tokenizer 训练查询:

@ex3ndr询问了训练完全自定义 Tokenizer 的可能性及其存储方式。@nanobitz进行了回复,并要求澄清该任务的最终目标。 - Nous-Hermes-2-Mistral-7B-DPO-GGUF 性能查询:

@natefyi_30842询问了新款 Nous-Hermes-2-Mistral-7B-DPO-GGUF 与其 Solar 版本之间的性能对比,@emraza110对其在准确回答特定测试问题方面的能力发表了评论。 - Mixtral 模型显存溢出错误:

@iamcoming5084提出了在处理 Mixtral 8x7b 模型时遇到的显存溢出 (Out-of-Memory) 错误问题。 - 影响准确性的微调参数:

@iamcoming5084寻求关于在微调 Mixtral 8x7b 和 Mistral 7B 过程中可能影响准确性的参数建议,并艾特了@688549153751826432和@470599096487510016以获取反馈。 - 大型模型的托管与推理:

@jacobi讨论了使用 OpenAI API 端点托管 Mixtral 8x7b 模型所面临的挑战并寻求策略,提到了 tabbyAPI 和 llama-cpp 等工具。 - Nous-Hermes-2-Mistral-7B-DPO 推理代码错误:

@qtnx指出了 Huggingface 上 Nous-Hermes-2-Mistral-7B-DPO 推理代码部分的错误,并提供了修正后的代码版本。Nous-Hermes-2-Mistral-7B-DPO 的推理代码。

提到的链接:

- Welcome Gemma - Google’s new open LLM:未找到描述

- NousResearch/Nous-Hermes-2-Mistral-7B-DPO · Hugging Face:未找到描述

Nous Research AI ▷ #collective-cognition (3 messages):

- 对 Heroku 的简短差评:

@bfpill对 Heroku 表达了负面情绪,直言 “screw heroku”。其挫败感表达得很简练,但未作详细说明。 - 亲切的回应:

@adjectiveallison进行了回复,似乎认可了这种情绪,但指出 “我不认为那是重点,不过也行”。具体的争议点仍不明确。 - 共识还是巧合?:

@bfpill回复道 “很高兴我们达成共识”,但在缺乏上下文的情况下,不确定是否真的达成了共识,还是这只是句玩笑话。

Nous Research AI ▷ #project-obsidian (3 messages):

- 因宠物生病导致模型更新延迟:

@qnguyen3为模型更新和完成进度较慢表示道歉,将延迟归因于他们的猫生病了。 - 邀请通过私信进行协作:

@qnguyen3邀请成员如果需要就项目相关事宜进行联系,可以直接发送私信。

Eleuther ▷ #general (101 messages🔥🔥):

-

对 lm eval 的困惑:

@lee0099疑惑为什么 lm eval 似乎只为 runpod 设置,促使@hailey_schoelkopf澄清 lm eval 与 llm-autoeval 不同,并指向 Open LLM Leaderboard 的 HF spaces 页面以获取详细说明和命令行参数。 -

关于模型环境影响的讨论:

@gaindrew推测根据模型防止或贡献的净碳排放量对模型进行排名。承认准确性将是一个挑战,对话在没有进一步探索或链接的情况下结束。 -

loubb 的优化器问题:

@loubb展示了基于 Whisper 模型训练时异常的 loss 曲线,并与@ai_waifu和@lucaslingle等人讨论了与优化器参数相关的潜在原因。 -

Google 发布 Gemma:

@sundarpichai宣布了 Gemma,一个新的模型家族,引发了@lee0099和@.undeleted等用户关于 Gemma 是否比 Mistral 等现有模型有显著改进的辩论。 -

关于模拟人类体验的理论讨论:

@rallio.与@sparetime.和@fern.bear就模拟人类认知的理论可能性进行了详细讨论。对话范围从建模人类情感和记忆的复杂性,到如何利用 GPT-4 创建一致的合成人类体验。

提到的链接:

- Sundar Pichai (@sundarpichai) 的推文:介绍 Gemma - 一个轻量级、同类领先的开放模型家族,采用与创建 Gemini 模型相同的研究和技术构建。展示了强大的性能…

- PropSegmEnt: A Large-Scale Corpus for Proposition-Level Segmentation and Entailment Recognition:广泛研究的自然语言推理 (NLI) 任务要求系统识别一段文本是否在文本上蕴含另一段文本,即其全部含义是否可以被…

- Everything WRONG with LLM Benchmarks (ft. MMLU)!!!:🔗 链接 🔗 当 Benchmark 成为目标:揭示大语言模型排行榜的敏感性 https://arxiv.org/pdf/2402.01781.pdf ❤️ 如果你想…

Eleuther ▷ #research (305 messages🔥🔥):

-

Groq 试图超越 Mistral:

@philpax分享了一篇文章,强调 AI 硬件初创公司 Groq 在其推理 API 上展示了 Mistral Mixtral 8x7b 模型的惊人演示,实现了高达 4 倍的吞吐量,且收费不到 Mistral 价格的三分之一。性能提升有利于 Chain of Thought 的实际可用性,以及代码生成和实时模型应用对低延迟的需求。 -

关于 Gemma 模型参数量误导的担忧:频道中的讨论提出了参数量误导的问题,例如 “gemma-7b” 实际上包含 85 亿个参数,并建议 “7b” 等模型分类应严格意味着最多 79.9 亿个参数。

-

探索 LLM 数据和计算效率:

@jckwind发起了关于 LLM 数据和计算效率的对话,指出它们需要大量数据且构建的世界模型不一致。一张分享的图表暗示 LLM 可能在双向学习方面存在困难,引发了辩论,并激发了关于大 context windows 或好奇心驱动的学习机制是否能解决这些低效问题的思考。 -

讨论新论文和研究方向:分享了各种论文和研究课题,包括一篇关于 LLM 对抗性攻击的论文

@0x_paws,以及另一篇提出可编程梯度信息 (PGI) 概念以应对深度网络中数据丢失的论文@jckwind。 -

模型优化和攻击面的更新:

@benjamin_w提到 PyTorch 2.2 的 SDPA 和 FlashAttention v2.5.5 现在支持特定的 head dimensions,允许在消费级 GPU 上微调 Gemma 模型,扩大了优化和使用这些 LLM 的可及性。此外,分享了一篇讨论 LLM 广泛对抗性攻击面的论文,包括具有编码能力的模型预训练以及词汇表中 “glitch” token 的存在@0x_paws。

提到的链接:

- Coercing LLMs to do and reveal (almost) anything:最近的研究表明,针对大语言模型(LLMs)的对抗性攻击可以“越狱”模型,使其发表有害言论。在这项工作中,我们认为对抗性攻击的频谱…

- YOLOv9: Learning What You Want to Learn Using Programmable Gradient Information:当今的深度学习方法专注于如何设计最合适的目标函数,使模型的预测结果能够最接近真实值(ground truth)。同时,一个合适的…

- Groq Inference Tokenomics: Speed, But At What Cost?:比 Nvidia 更快?剖析其背后的经济学

- Spectral State Space Models:本文研究了具有长距离依赖关系的预测任务的序列建模。我们提出了一种基于学习线性动力系统的新型状态空间模型(SSMs)公式,该公式具有…

- Feist Publications, Inc., v. Rural Telephone Service Co. - Wikipedia:未找到描述

- Gemma: Introducing new state-of-the-art open models:Gemma 是一个轻量级、最先进的开放模型系列,采用与构建 Gemini 模型相同的研究和技术开发而成。

- Fast Transformer Decoding: One Write-Head is All You Need:Transformer 神经序列模型中使用的多头注意力层(Multi-head attention layers)是 RNN 的强大替代方案,用于在序列内部和序列之间传递信息。虽然训练这些层通常…

- Paper page - LongRoPE: Extending LLM Context Window Beyond 2 Million Tokens:未找到描述

- Tweet from NVIDIA (@nvidia):今天宣布,我们将作为发布合作伙伴与 @Google 合作交付 Gemma,这是一个经过优化的模型系列,使用户能够仅使用桌面级 RTX GPU 即可开发 #LLMs…

- Tweet from Tri Dao (@tri_dao):FlashAttention v2.5.5 现在支持在消费级 GPU 上进行 head dim 256 的反向传播。希望这能让微调 Gemma 模型变得更容易

-

[Lecture 20 - Efficient Transformers MIT 6.S965](https://youtu.be/RGUCmX1fvOE?si=wcs1MDNbon1URKsO):第 20 讲介绍了高效 Transformer。关键词:Transformer。幻灯片:https://efficientml.ai/schedule/—————————————————…

Eleuther ▷ #interpretability-general (43 messages🔥):

- 多语言模型的内部语言受到质疑:

@butanium分享了一条 Twitter 帖子,暗示模型在执行非英语任务时会“用英语思考”。他们提供了一篇论文和 GitHub 仓库 的见解,指出在分析模型内部语言使用时,Logit Lens 与 Tuned Lens 的不同之处。 - Llama 模型的 Tuned Lens 可用性:

@mrgonao澄清了关于 Llama 模型内部是否使用英语的调查,通过使用在其上训练的 Tuned Lens,并提供了一个 Hugging Face Space 来检查可用资源。 - 探索 Llama 模型的多语言能力:

@mrgonao报告称,由于 13b 规模模型的不完整性以及提供的仓库中缺少某些任务的 Notebook,在所有语言中运行实验存在困难。他们表示一旦问题解决,愿意运行更多实验。 - 正在考虑为 Llama 模型开发中文 Lens:响应

@stellaathena的建议,@mrgonao考虑使用易于获取的中文数据集创建一个用于中文分析的 Lens,随后表示该 Lens 的训练已经开始。 - 模型 Unlearning 技术讨论:

@millander分享了一篇关于 LLM Unlearning 的新综述论文 的链接,频道内未对论文内容进行进一步讨论。

Links mentioned:

- Rethinking Machine Unlearning for Large Language Models: 我们探索了大语言模型(LLM)领域的 Machine Unlearning (MU),即 LLM Unlearning。该计划旨在消除不良数据的影响(例如敏感或非法数据…)

- phoeniwwx/tuned_lens_q · Hugging Face: 未找到描述

- AlignmentResearch/tuned-lens at main: 未找到描述

- shjwudp/chinese-c4 · Datasets at Hugging Face: 未找到描述

- GitHub - epfl-dlab/llm-latent-language: Repo accompanying our paper "Do Llamas Work in English? On the Latent Language of Multilingual Transformers".: 论文 "Do Llamas Work in English? On the Latent Language of Multilingual Transformers" 的配套仓库。 - epfl-dlab/llm-latent-language

- srgo - Overview: srgo 有一个可用仓库。在 GitHub 上关注其代码。

Eleuther ▷ #lm-thunderdome (64 messages🔥🔥):

-

探索 Few-Shots Context 实验:

@baber_提到,如果将 Few-Shots Context 和后续内容格式化为交替的 “user” 和 “assistant” 轮次,Instruct tuned 模型可能会表现得更好,尽管他们尚未对此进行测试。 -

OOM 后 GPU 显存未释放:

@pminervini在 Colab 上使用evaluator.simple_evaluate时遇到了显存溢出 (OOM) 问题,即使尝试了垃圾回收 (gc.collect()) 也无法解决,GPU 显存显示仍被占用。该问题需要重启运行时才能解决,@hailey_schoelkopf和@baber_讨论并提出了潜在的修复建议,并提供了一个用于复现的 Colab 链接:Evaluate OOM Issue。 -

LM-Harness Logits 支持障碍:

@dsajlkdasdsakl遇到了一个问题:在 LM-Harness 中本地运行带有 Log Likelihood 的任务时正常,但像 GPT 这样基于 API 的模型会产生 “No support for logits” 错误,而像 gsm8k 这样的预定义任务则运行顺畅。@hailey_schoelkopf澄清这是因为大多数 API 提供商不支持 Logits,建议将任务转换为 Generative 格式,并更新错误消息以提高清晰度。 -

Gemma 模型评估问题:用户

@vraychev、.rand0mm和@ilovescience报告了在 lm-evaluation-harness 中评估 Gemma-7b 模型时的问题。@hailey_schoelkopf承认存在 Bug,并提供了修复步骤(包括添加 BOS token),并指导用户如何让 Gemma 7b 配合 Flash Attention (attn_implementation="flash_attention_2") 工作。此外还提到了 Transformers 4.38 中可能存在的问题以及升级 Torch 版本的必要性。

提到的链接:

- Google Colaboratory:无描述

- Google Colaboratory:无描述

- lm-evaluation-harness/lm_eval/evaluator.py at c26a6ac77bca2801a429fbd403e9606fd06e29c9 · EleutherAI/lm-evaluation-harness:一个用于语言模型 Few-shot 评估的框架。 - EleutherAI/lm-evaluation-harness

- lm-evaluation-harness/lm_eval/api/model.py at ba5cdf0f537e829e0150cee8050e07c2ada6b612 · EleutherAI/lm-evaluation-harness:一个用于语言模型 Few-shot 评估的框架。 - EleutherAI/lm-evaluation-harness

Eleuther ▷ #multimodal-general (6 messages):

- CLIP 模型中的 Batch 内假阴性 (False Negative) 困境:

@tz6352最初提出了关于如何解决 CLIP 模型中 Batch 内假阴性问题的方法。 - 寻求关于假阴性的澄清:

@_.hrafn._询问是否担心 Batch 内存在潜在的假阴性。 - 确认假阴性问题:

@tz6352确认该查询确实是关于处理 Batch 中的假阴性,且不局限于 Image-Text 对,这表明了不同的应用场景。 - 缓解假阴性的可能方案:

@_.hrafn._建议使用来自独立文本和图像模型的 Unimodal Embeddings 来计算相似度得分,从而排除假阴性。 - 优化负样本排除策略:此外,

@_.hrafn._提出在训练期间利用自己的模型计算相似度得分,以便更有效地筛选出 Hard Negatives。

Eleuther ▷ #gpt-neox-dev (1 messages):

- 探索序列组合策略:

@pminervini分享了一篇最近的 arXiv 论文,讨论了预训练序列组合 (Sequence Composition) 对语言模型的影响。研究表明,文档内因果掩码 (Intra-document Causal Masking) 可以通过消除来自前序文档的干扰信息,显著提高模型在各种任务上的性能。

提到的链接:

Analysing The Impact of Sequence Composition on Language Model Pre-Training:大多数语言模型预训练框架将多个文档拼接成固定长度的序列,并使用 Causal Masking 来计算给定上下文时每个 Token 的似然概率;这种策略…

LAION ▷ #general (346 条消息🔥🔥):

-

Google 新 Gemma 模型讨论:

@itali4no分享了一个关于 Google 发布 Gemma 的链接。Gemma 基于 Gemini 模型的技术构建,强调负责任的 AI 开发。社区对此非常感兴趣,并询问 Google 是否会真正转向开源权重,因为他们在这些方面传统上比较保守。 -

Stable Diffusion 3 早期预览版发布:

@thejonasbrothers引起了大家对 Stable Diffusion 3 的关注,讨论了其作为早期预览候补名单的一部分,在处理多主体提示词(prompts)能力的增强和图像质量的提升。围绕它的讨论包括对其新颖性以及与之前模型实际差异的怀疑。 -

关于使用 CogVL 进行照片标注的讨论:

@pseudoterminalx报告了在 12 小时内使用 CogVL 为 2.88 万张图像生成标注的情况,并分享了关于图像标注所涉及的计算基础设施和成本的见解。这些成本相当可观,通常依赖于租用的多 GPU 服务器。 -

AI 开发中的主导地位与中心化:一场关于模型和资源(如 SD3)如何变得不那么开放且日益中心化的对话。

@nodja等人对算力变得更加中心化表示担忧,以及这种转变如何使技术进一步脱离终端用户的触及范围。 -

关于 SD3 商业用途的推测:随着 Stability.AI 宣布 SD3,一场关于此类模型是否会用于商业用途的辩论展开了。

@thejonasbrothers注意到封闭式开发的趋势,而@chad_in_the_house则认为开源主要是一种广告手段,而非收入策略。

提到的链接:

- Gemma: Introducing new state-of-the-art open models:Gemma 是一个轻量级、最先进的开源模型系列,采用与创建 Gemini 模型相同的研究和技术构建。

- Stable Diffusion 3 — Stability AI:宣布 Stable Diffusion 3 进入早期预览版,这是我们功能最强大的文本生成图像模型,在多主体提示词、图像质量和拼写能力方面有显著提升。

- no title found:未找到描述

- ptx0/photo-concept-bucket · Datasets at Hugging Face:未找到描述

LAION ▷ #research (65 messages🔥🔥):

- 合成数据辩论继续:

@unjay.对 OpenAI 的模型利用了大量合成数据表示强烈怀疑,因为存在某些类似 CGI 的伪影,尽管尚未看到 OpenAI 官方对此事的确认。特定 3D 风格的准确复制以及步态周期动画等异常现象是这一论点的关键点。 - Diffusion 模型生成高性能模型:

@jordo45分享了一篇有趣的 Arxiv 论文,证明了 Diffusion 模型可以生成有效的神经网络参数,提供了一种无需大规模架构更改或训练范式即可创建模型的新方法。 - 推出新型多模态 LLM:

@helium__介绍了 AnyGPT,这是一个统一的多模态语言模型,能够使用离散表示处理语音、文本、图像和音乐,突显了 LLM 在处理多种数据格式方面的多功能能力。 - 公共数据集动态讨论:

@top_walk_town建议,由于链接失效和数据投毒等问题, LAION 5B 数据集可能应该退役,这引发了关于社区努力开发具有更好标注的新型高质量公共数据集的讨论。 - 探讨 OpenAI 的收购与结构:围绕 OpenAI 的收购策略展开了讨论,用户们讨论了像 OpenAI 这样的非营利组织收购公司是否典型。分享的链接阐明了 OpenAI 的混合结构,包括投资者的 100 倍回报上限以及营利性子公司对非营利组织使命的承诺,展示了复杂的业务框架。

提到的链接:

- Neural Network Diffusion:Diffusion 模型在图像和视频生成方面取得了显著成功。在这项工作中,我们证明了 Diffusion 模型也可以 \textit{生成高性能的神经网络参数}…

- OpenAI acquires Global Illumination:整个团队已加入 OpenAI。

- apf1/datafilteringnetworks_2b · Datasets at Hugging Face:未找到描述

- Our structure:我们设计了 OpenAI 的结构——由我们最初的非营利组织和新的上限利润部门组成的合伙关系——作为 OpenAI 使命的底盘:构建安全且…的通用人工智能 (AGI)。

- AnyGPT:未找到描述

- Demo for "AnyGPT: Unified Multimodal LLM with Discrete Sequence Modeling":”AnyGPT: Unified Multimodal LLM with Discrete Sequence Modeling” 的演示视频

LAION ▷ #paper-discussion (1 messages):

said2000: https://arxiv.org/abs/2402.05608

Mistral ▷ #general (296 条消息🔥🔥):

-

Mistral AI 的图像文本能力受到质疑:

@oweowe询问 Mistral AI 是否可以从 JPEG 格式的表格等复杂图像中提取并处理文本。@i_am_dom建议使用 gpt4-vision、gemini-vision 或 blip2 以获得灵活性,并建议对于小规模数据使用 copyfish 和 google lens 等更简单的工具。 -

开源期望与权宜之计:用户讨论了 Mistral AI 权重向公众发布的可能性及其影响。

@9faez推测如果权重发布,免费版本将迅速出现,而@i_am_dom则怀疑除非再次发生泄露,否则这不会发生。 -

关于 Mistral API 和 UI 开发的问题:新手程序员

@distrorodeo寻求使用 Mistral AI API 制作 Chat UI 的帮助。@ethux提供了一个指向 Huggingface ChatUI 的 GitHub 链接以提供协助。 -

Mistral AI 的性能和微调讨论:像

@daroche这样的用户对小型 Mistral 7b 模型的强大性能表示惊讶,而@paul.martrenchar_pro建议使用 RAG (Retrieval-Augmented Generation) 将公司数据集成到 Mistral 中。可以通过 https://docs.mistral.ai/guides/basic-RAG/ 的文档详细了解该技术。 -

对 Mistral 下一代模型迭代的高度关注:

@egalitaristen和@sapphics等用户报告了 Mistral Next 令人印象深刻的性能,特别是在数学方面,在评估中其准确率接近 GPT-4。用户还讨论了 Mistral Next 相比 MiQU 等先前版本可能需要的改进。

提到的链接:

- Chat with Open Large Language Models:未找到描述

- Aaditya Ura (Ankit) (@aadityaura) 的推文:来自 @GoogleDeepMind @GoogleAI 的新模型 Gemma 在医疗/保健领域的基准测试中表现不佳。@GoogleDeepMind 的 Gemma 与 Mistral 的横向对比…

- Chat with Open Large Language Models:未找到描述

- Pretraining on the Test Set Is All You Need:受近期展示了在精心策划的数据上预训练的小型基于 Transformer 的语言模型前景的工作启发,我们通过投入大量精力策划…

- gist:c9b5b603f38334c25659efe157ffc51c:GitHub Gist:即时分享代码、笔记和代码片段。

-

[Basic RAG Mistral AI Large Language Models](https://docs.mistral.ai/guides/basic-RAG/):检索增强生成 (RAG) 是一种 AI 框架,它协同了 LLM 和信息检索系统的能力。它对于利用…回答问题或生成内容非常有用。 - Mistral:未找到描述

- GitHub - MeNicefellow/DrNiceFellow-s_Chat_WebUI:通过在 GitHub 上创建账号,为 MeNicefellow/DrNiceFellow-s_Chat_WebUI 的开发做出贡献。

- GitHub - XiongjieDai/GPU-Benchmarks-on-LLM-Inference: Multiple NVIDIA GPUs or Apple Silicon for Large Language Model Inference?:多个 NVIDIA GPU 还是 Apple Silicon 用于大语言模型推理? - XiongjieDai/GPU-Benchmarks-on-LLM-Inference

Mistral ▷ #models (20 messages🔥):

- Mistral-tiny 困惑已消除:

@hojjat_22712询问了 Mistral-tiny 与原始 7B 模型之间的可用性和区别,质疑是什么具体细节让 tiny 版本更好。@akshay_1澄清说 API 使用的是 Mistral 7B instruct V2。 - Mixtral 中出人意料的语言支持:

@illorca_21005讨论了测试 Mixtral 的情况,报告其在荷兰语和希腊语中表现尚可,尽管官方文档仅声称支持英语、法语、意大利语、德语和西班牙语。尽管有人询问预训练数据集的文档,但@mrdragonfox未提供更多信息。 - Mistral-Next 确认存在:

@paul16307寻求确认 Mistral-Next 是否存在,认为它优于 Mistral-Medium,并指向了一个标记为 null 的链接。@ethux确认了其真实性,但指出目前还没有 API 访问权限,细节将在未来发布。 - 对 Mistral 细节的期待:

@ethux还提到他们不隶属于 Mistral,但推测有关 API 访问的细节即将公布。 - Mistral 以价格和创新吸引用户:

@mrdragonfox表示 Mistral 的定价对许多人非常有吸引力,且 Mistral 正在挑战 OpenAI 等公司之外的现有边界。

提及的链接:

Chat with Open Large Language Models:未找到描述

Mistral ▷ #deployment (54 messages🔥):

- Hugging Face 集成:用户

@sa_code提到在某些任务中使用 Hugging Face 的text-generation-inference,但未提供进一步的背景或链接。 - 成本评估咨询:

@ambre3024请求协助估算 Mistral 的 AWS 托管成本,@ethux随后跟进以澄清正在考虑的是哪种模型(Mistral 7b 或 Mixtral)。 - Mistral Next 的 API 可用性:

@rantash68询问 Mistral next 是否可以通过 API 使用,@sophiamyang简单地回答“不”。 - 在 Vertex AI 上部署 Mistral 的选项:

@louis2567询问了在 Vertex AI 上部署 Mistral 7b 和 Mixtral 8x7b 模型进行批量预测的问题,并与多位社区成员(特别是@mrdragonfox)讨论了文档缺失和部署效率问题,后者提供了使用 Docker 和 GPU 扩展的详细指导和命令示例。 - vLLM 的 GPU 选择指南:

@buttercookie6265请求一份为托管 vLLM 选择合适 GPU 的指南,收到了来自@mrdragonfox关于显存需求以及默认占用大部分 GPU 资源的建议。

提及的链接:

| [vLLM | Mistral AI Large Language Models](https://docs.mistral.ai/self-deployment/vllm/):vLLM 可以使用我们提供的 Docker 镜像部署,或者直接从 Python 包部署。 |

Mistral ▷ #finetuning (7 messages):

-

咨询 Mistral 的微调参数:

@iamcoming5084询问了在微调 Mistral 8x7b 和 Mistral 7B 期间可能影响准确性的参数。关于此话题的讨论未提供进一步的信息或建议。 -

关于在非结构化数据集上进行微调的咨询:

@mohammedbelkaid.正在寻求在非结构化电子邮件数据集上微调 Mistral 7B 的帮助,并询问简单的预处理和分词(Tokenization)是否足以完成摘要和回答问题等任务。 -

请求在 Google Colab 上运行 Mistral 的指导:

@_logan8_请求协助如何使用自己的数据集在 Google Colab 上微调 Mistral 7B,但聊天记录中未提供直接的说明或链接。 -

Unsloth 为初学者揭秘微调:

_._pandora_._推荐使用 Unsloth 的演示/笔记本在 Mistral 模型上进行 LoRA 微调,强调该资源对初学者非常友好。 -

提升微调效果的技术技巧:针对有关微调参数的问题,

_._pandora_._提到调整 epoch/steps、batch size 以及 LoRA 超参数 r 是需要尝试的基础要素。

Mistral ▷ #showcase (13 messages🔥):

- 通过 LangGraph 为 RAG 增强自我反思能力:

@pradeep1148分享了一个 YouTube 视频,展示了如何使用 LangGraph 通过自我反思来增强检索增强生成 (RAG),该方法可能与 Mistral 的应用相关。 - 讨论面向创意人士的 AI 支持:

@distrorodeo表达了为艺术家创建 AI 创意决策支持系统的兴趣,并询问了如何启动此类项目以及独自完成是否可行。 - 大语言模型微调的复杂性:

@pradeep1148推广了另一个 YouTube 片段,讨论了 BitDelta 并暗示微调 Large Language Models 可能只能带来边际收益。 - Twitch 频道测试 Mistral-Next:

@jay9265提到在他们的 Twitch 频道上测试 Mistral-Next 的数据工程用例,提供了直播 链接,并表示如果这被视为自我推广请予以删除。 - Mistral 提示词能力指南:

@mrdragonfox建议通过指南进一步探索 Mistral 的 Prompting 能力,并提供了一个 链接,其中包含使用 Mistral 模型进行分类、摘要、个性化和评估的示例。

提到的链接:

- Twitch:未找到描述

-

[Prompting Capabilities Mistral AI Large Language Models](https://docs.mistral.ai/guides/prompting-capabilities/):当你开始使用 Mistral 模型时,你的第一次交互将围绕 Prompt 展开。编写有效 Prompt 的艺术对于从 Mistral 模型生成理想响应至关重要… - Self RAG using LangGraph:自我反思可以增强 RAG,从而纠正低质量的检索或生成。最近的几篇论文都聚焦于这一主题,但实现…

- BitDelta: Your Fine-Tune May Only Be Worth One Bit:Large Language Models (LLMs) 通常分为两个阶段进行训练:在大规模互联网数据集上进行预训练,以及针对下游任务进行微调。鉴于 …

Mistral ▷ #la-plateforme (12 messages🔥):

- Mistral-Next 访问咨询:用户

@superseethat询问了 Mistral-Next 的访问权限,他目前拥有 Mistral Medium 的访问权限。@ethux澄清说 Mistral Next 尚未发布,目前只能通过 lymsys 的聊天界面进行测试。 - 了解 API 计费阈值:用户

@sapphics询问了 超过 API 计费阈值 的具体含义。@mrdragonfox确认了该阈值并建议联系支持团队:support@mistral.ai。 - 支持响应方面的问题:

@ginterhauser对联系 Mistral 支持以提高限额后未收到回复表示沮丧。@mrdragonfox询问请求中是否包含了 ID,@nicolas_mistral表示如果他们通过 DM 发送 ID 或电子邮件,他可以提供帮助。 - 提供解决支持问题的方案:来自 Mistral 的

@nicolas_mistral和@lerela为@ginterhauser提供了计费问题方面的协助,承诺会解决问题,并要求如果问题仍然存在请发送私信。

提到的链接:

no title found:未找到描述

OpenAI ▷ #ai-discussions (57 条消息🔥🔥):

- Google 模型更新:

@oleksandrshr提到 Google 发布了一个具有 新名称 的新模型,并提到了其可用性。尽管@eredon_144也提到他在 ChatGPT 移动版上没有看到 Plugins 选项。 - GPT-4 使用上限争议:

@7_vit_7和@solbus讨论了 GPT-4 的 使用上限,@solbus提供了关于上限及其根据需求和算力可用性动态调整的官方解释 链接。 - 对 GPT-4 模型性能的困惑:用户讨论了 GPT-4 能力随时间变化的潜在可能,

@lugui表示关于 GPT-4 比发布时更弱 的传言并非事实。 - Stability.ai 发布 Stable Diffusion 3:

@pierrunoyt分享了 新闻链接,宣布 Stable Diffusion 3 进入早期预览阶段,旨在改进多主体提示词、图像质量和拼写能力。 - Gemini 模型讨论:

@ertagon强调了一个 YouTube 视频,讨论了与 Google 的 Gemini 模型相关的问题,特别是关于多样性的问题。

提到的链接:

- Introducing ChatGPT Plus:我们正在推出 ChatGPT 的试点订阅计划,这是一款对话式 AI,可以与你聊天、回答后续问题并挑战不正确的假设。

- Stable Diffusion 3 — Stability AI:宣布 Stable Diffusion 3 进入早期预览版,这是我们能力最强的文本生成图像模型,在多主体提示词、图像质量和拼写能力方面有显著提升。

- Gemini has a Diversity Problem:Google 在其新的 Gemini Pro 模型上将反偏见拨盘调到了最大。参考资料:https://developers.googleblog.com/2024/02/gemini-15-available-for-private-…

OpenAI ▷ #gpt-4-discussions (51 条消息🔥):

-

API 访问说明:

@solbus为@phil4246解惑,说明 OpenAI API 采用按需付费模式,与 Plus 订阅是 分开的。他们提到 Token 用于 DALL·E 2 等特定服务,但也与 Plus 订阅无关。 -

文件上传上限澄清:针对

@my5042的查询,@solbus提供信息称 文件上传限制 已更新为 20 个 512MB 文件,达到每个终端用户 10GB 的限制,并建议查看最新的 FAQ 以获取准确详情。 -

GPT 写作风格挑战:

@darthgustav.建议@thermaltf在尝试训练 GPT 模仿其写作风格时,使用 模板示例 和 仅包含正面指令。 -

神秘的 ChatGPT 模型失误:

@Makeshift评论了 AI 需要 增强批判性思维,而@darthgustav.暗示此类请求可能涉及生成 剽窃提示词。 -

从访谈中提取见解:

@darthgustav.向在创建 GPT 寻找访谈记录中精彩瞬间时遇到困难的@col.bean提供了广泛建议。建议包括在指令中使用 正面框架 和 输出模板,处理数据块大小,并可能为 每份访谈记录创建一个新的 GPT 以避免检索错误。 -

移动版 ChatGPT 无插件:针对

@eren_1444询问在移动版 ChatGPT 中使用 Plugins 的问题,@thedreamakeem确认 移动端不支持 Plugins,并建议在移动浏览器上尝试桌面版。 -

Vector Database 差异:

@thirawat_z表达了在使用 OpenAI embeddings 和 Qdrant 时,结果与教程相差甚远的担忧,分享了其输出与预期结果的显著差异。 -

讨论用 HTML/CSS 训练 ChatGPT:

@ls_chicha询问关于 使用 HTML 和 CSS 文件训练 ChatGPT 的问题,引发了@_jonpo对其必要性的质疑(考虑到 ChatGPT 已有的广泛训练),而@toror则对@ls_chicha想要在 ChatGPT 现有能力之外实现的目标表示兴趣。 -

AI 模型对话构想:

@link12313建议创建一个让 GPT-4 和 Google Gemini Ultra1.5 对话的应用,@toror指出其他模型也曾尝试过此类做法,但如果没有引人入胜的切入点,交流往往会变得单调乏味。

OpenAI ▷ #prompt-engineering (91 条消息🔥🔥):

-

与 GPT-4 进行角色扮演:

@shokkunn询问如何改进 AI 角色扮演,使其听起来更像角色本身,而不是扮演该角色的演员。@darthgustav.建议在 Prompt 中明确指定自定义指令,包括简洁的指导和带有开放变量的输出模板,这些变量可以概括性地编码指令以保持逻辑一致性。 -

Prompt 中的正向强化被证明更有效:

@darthgustav.强调了在对 AI 进行 Prompt 提示时使用正向指令的重要性,因为负面指令可能会导致不合规(不听从指令)。 -

Turbo 与普通 GPT-4 在角色扮演中的对比:

@shokkunn观察到标准版 GPT-4 在角色扮演方面的表现似乎优于 Turbo Preview 模型。@darthgustav.建议继续尝试不同的 Prompt 以获得最佳效果,并为旧模型弃用(deprecated)后的过渡做好准备。 -

解决 ReAct Prompting 中的 Agent 循环问题:

@tawsif2781在使用 ReAct Prompting 时遇到了 Agent 陷入逻辑循环的问题。@darthgustav.建议避免在 Prompt 中出现逻辑不一致和负面指令,并建议增加冗余以确保 AI 能够通过中间上下文继续进行有效的操作。 -

Prompt Engineering 学习资源:

@loamy_询问了学习更多关于 Prompt Engineering 的资源,@darthgustav.建议从搜索 arXiv 和 Hugging Face 开始,按最早排序以了解基础知识,或按最新排序以获取高级策略。

OpenAI ▷ #api-discussions (91 条消息🔥🔥):

- 角色扮演技巧与窍门:

@shokkunn寻求使用 AI 扮演角色的建议,@darthgustav.建议使用具体、简洁且逻辑一致的指令,并配合一个能强化指令的输出模板。强调了正向指令优于负面指令的重要性,因为前者能带来更好的合规性。 - 修改角色扮演 Prompt 以获得更好性能:

@darthgustav.暗示旧模型可能会被弃用(deprecated),并建议通过调整当前模型的 Prompt 来为升级做准备。角色扮演模板应包含开放变量,且命名规范应能概括指令内容。 - 应用时间戳以获得唯一的 AI 输出:在关于打破 AI 循环和 ReAct Prompting 的讨论中,

@darthgustav.提到由于不同的时间戳 Token,每个 Prompt 都是唯一的,并建议在 Prompt 中增加冗余可以帮助弥补上下文中的断层。 - 讨论 Prompt Engineering 资源:

@loamy_和@droggerhd询问了 Prompt Engineering 资源,对此@darthgustav.建议在 arXiv 和 Hugging Face 上搜索与 Prompt 策略和技术相关的特定关键词。 - 为获得一致的概率输出而调整 Prompt:

@deb3009试图在比较 RCA 与对照数据集时,在输出中获得一致的概率值。他们讨论了通过 Prompt Engineering 产生一致概率的挑战,并收到了关于构建有效 Prompt 的建议。

HuggingFace ▷ #general (186 条消息🔥🔥):

- theamanstark 的 AI 乐园遇到麻烦:`@theamanstark` 在发现其 HuggingFace 账号出现 404 错误后感到困惑。`@lunarflu` 建议这可能与滥用 Space 来虚增库统计数据有关,并建议联系 HuggingFace 支持部门寻求解决。

- Diffusion Pipeline 讨论:`@_bootesvoid` 寻求关于使用 Diffusion Pipeline 和 ControlNet 的建议,而 `@thtslunar` 在将权重加载到 'PixArtAlphaPipeline' 时遇到问题,并在 `@not_lain` 的指导下,通过使用不同版本的 diffusers 库找到了解决方案。

- HuggingFace VSCode 扩展难题:`@industrial` 在 NixOS 上配置 `huggingface-vscode` 时面临挑战并寻求社区帮助。`@not_lain` 建议对照默认配置检查设置,并保证在即将发布的 transformers 库版本中会针对自定义架构进行增强。

- AI 创新火花揭晓:`@pierrunoyt` 分享了关于 Stable Diffusion 3 早期预览的激动人心消息,预告了在图像质量和功能方面的重大进步。

- 寻求 Gradio & FastAPI 性能优化:`@akin8941` 紧急寻求帮助,以提高利用 Gradio 和 FastAPI 开发的应用的性能。

提到的链接:

- 3rd Rock GIF - 3rd Rock From - 发现并分享 GIF:点击查看 GIF

- Deer GIF - Deer - 发现并分享 GIF:点击查看 GIF

- 使用自定义模型:未找到描述

- Conrad 网站:未找到描述

- Stable Diffusion 3 — Stability AI:宣布 Stable Diffusion 3 进入早期预览版,这是我们功能最强大的文本生成图像模型,在多主题提示词、图像质量和拼写能力方面有显著提升。

- TensorFlow Lite 中的设备端训练 — TensorFlow 博客:未找到描述

- Google Colaboratory:未找到描述

- mayacinka/ramonda-7b-dpo-ties · 不错。太棒了。在你发布这个之前,我也为我的模型选择了同样的名字。:未找到描述

- thomas-c-reid/ppo-LunarLander-v2 · Hugging Face:未找到描述

- 深度强化学习排行榜 - 由 huggingface-projects 提供的 Hugging Face Space:未找到描述

- AWS Innovate - AI/ML 与数据版:未找到描述

- GitHub - kuangliu/pytorch-cifar: 使用 PyTorch 在 CIFAR10 上达到 95.47%:使用 PyTorch 在 CIFAR10 上达到 95.47%。通过在 GitHub 上创建账号为 kuangliu/pytorch-cifar 的开发做出贡献。

- GitHub - SYSTRAN/faster-whisper: 使用 CTranslate2 实现更快的 Whisper 转录:使用 CTranslate2 实现更快的 Whisper 转录。通过在 GitHub 上创建账号为 SYSTRAN/faster-whisper 的开发做出贡献。

- ptx0/photo-concept-bucket · Hugging Face 数据集:未找到描述

- Mistral 的下一个 LLM 可能与 GPT-4 竞争,你现在可以在 Chatbot Arena 中体验它:法国 LLM 奇迹 Mistral 正准备发布其下一个语言模型。你已经可以在聊天中对其进行测试。

HuggingFace ▷ #today-im-learning (7 条消息):

- 新成员寻求 AI 帮助:用户

@mfd000m询问关于生成电子商务产品的英雄图 (hero images) 的事宜,并请求在 Hugging Face 上推荐适合该任务的模型。 - 寻找合适的模型:

@jamorphy回复询问,以澄清@parvpareek在提到 “A Neural Probabilistic Language Model” 时具体指的是哪个模型。 - 发布了神秘的 Discord 链接:用户

@lightyisu发布了一个 Discord 链接https://discord.com/channels/879548962464493619/1106008166422028319/1106008166422028319,但未提供任何上下文或内容。 - Flutter 游戏查询:用户

.konoh询问了一个 Flutter 游戏,但在对话中没有给出进一步的上下文或回复。 - Nanotron 开源公告:

@neuralink分享了一个名为 nanotron 的项目现已开源,并提供了 GitHub 仓库链接huggingface/nanotron,同时提到他们刚刚完成了合并。

提到的链接:

nanotron/examples/doremi at main · huggingface/nanotron:极简的大语言模型 (LLM) 3D-parallelism 训练 - huggingface/nanotron

HuggingFace ▷ #cool-finds (8 条消息🔥):

- 机器人角色扮演开发:用户

@ainerd777提到正在开发角色扮演聊天机器人 (roleplay chatbots),但未提供更多细节。 - 宏大的合作伙伴计划:

@aaaliahmad.期待与一家市值 1 亿美金的公司建立合作伙伴关系。未提供关于此类合作性质的具体细节。 - 对活动价格感到震惊:

@lucifer_is_back_对一个定价为 1000 美元/座 的活动做出了反应,评论说有这笔钱他们宁愿投资训练一个 70B model。 - ryzxl 公布模型基准测试结果:

@ryzxl发布了他们的综合模型基准测试计划 (Comprehensive Model Benchmarking Initiative) 结果,邀请社区查看对列出的行业领先模型在数据集上进行的广泛测试,并提供了他们的排行榜和仓库链接(Leaderboard 和 Repo)。 - 呼吁发帖礼仪:

@cakiki提醒社区不要跨频道发帖 (cross-post),将多次发帖的情况标记为垃圾信息 (spam)。

HuggingFace ▷ #i-made-this (22 条消息🔥):

- 投资追踪变得简单:用户 `@luuisotorres` 介绍了一个用于管理投资组合的 Web 应用,并附带了一个方便的 Kaggle Notebook 来演示其创建过程。

- Android 上的单目深度估计:`@shubhamx0204` 分享了一个使用转换后的 ONNX 模型进行单目深度估计的 Android 应用,可在 GitHub 上获取。

- 文档摘要难题:`@joethedataguy` 在使用 map reduce 链进行 PDF 文档摘要时遇到问题,并在 GitHub 上咨询了如何将 Vertex AI notebook 适配到 Hugging Face 模型。

- 基于 Selenium 的非官方 ChatGPT API:`@.infinityhawk` 介绍了一个使用 Selenium 和 Python 实现的非官方 ChatGPT API,可在 GitHub 上获取。讨论中涉及了可能违反 OpenAI TOS 的风险,以及使用 undetected drivers 绕过 Cloudflare 防护的方法。

- 优化 Stable Diffusion XL:用户 `@felixsanz` 发布了一篇关于优化 Stable Diffusion XL 的详尽文章,提供了提升性能和减少显存(Memory)占用的策略,详情见其 网站。

提到的链接:

- Prompt Magic v0.0.1: 未找到描述

- Proteus V0.4 - FumesAI 开发的 Hugging Face Space: 未找到描述

- Portfolio Management - luisotorres 开发的 Hugging Face Space: 未找到描述

-

构建投资组合管理应用 💰: 使用 Kaggle Notebooks 探索并运行机器学习代码 使用来自无附加数据源的数据 - GitHub - shubham0204/Depth-Anything-Android: 在 Depth-Anything 上运行推理的 Android 应用: 一个在 Depth-Anything 上运行推理的 Android 应用 - GitHub - shubham0204/Depth-Anything-Android: An Android app running inference on Depth-Anything

- GitHub - Priyanshu-hawk/ChatGPT-unofficial-api-selenium: 这是一个完全由我用 Python 和 Selenium 编写的非官方 ChatGPT API: 这是一个完全由我用 Python 和 Selenium 编写的非官方 ChatGPT API - Priyanshu-hawk/ChatGPT-unofficial-api-selenium

- generative-ai/language/use-cases/document-summarization/summarization_large_documents_langchain.ipynb at main · GoogleCloudPlatform/generative-ai: Google Cloud 上 Generative AI 的示例代码和 Notebooks - GoogleCloudPlatform/generative-ai

-

[最便宜的 GPT-4 Turbo, GPT 4 Vision, ChatGPT OpenAI AI API 文档 (NextAPI) RapidAPI](https://rapidapi.com/NextAPI/api/cheapest-gpt-4-turbo-gpt-4-vision-chatgpt-openai-ai-api): 未找到描述 - 优化 Stable Diffusion XL 的终极指南: 探索如何在任何显卡上获得 SDXL 的最佳质量和性能。

HuggingFace ▷ #diffusion-discussions (10 messages🔥):

- Stable Diffusion 中的 Timestep embedding:

@pseudoterminalx讨论了在 Stable Diffusion 中,timestep embed 是如何拼接到文本嵌入(text embedding)隐藏状态的,它可能不是简单的整数,而是通过 Fourier transform 创建的向量。 - SDXL 微调节(microconditioning)输入增强:

@pseudoterminalx解释了 SDXL 使用 Fourier transform 来增强微调节输入,将 6 元素的输入扩展为 256 元素,并特别提到它涉及“3 组双元素元组(two element tuples)”。 - 对 Diffusion 讨论的认可:

@mr.osophy认可了@pseudoterminalx对 Diffusion 话题的回复,并表示打算稍后深入研究该主题。 - 对基于 Interlingua 翻译器的兴趣:

@hobojesus6250a表达了在 Hugging Face 上为大学项目开发或寻找基于 Interlingua 的翻译器的兴趣,由于时间限制,希望扩展现有的模型或 LLM 来处理翻译任务。 - 针对更多类别的模型扩展:

@agusschmidt询问如何运行超过 10 个类别的 BART-large-mnli 模型,引用了一项讨论建议在本地运行模型是可行的,并寻求指导或允许更多类别的替代模型。

HuggingFace ▷ #computer-vision (1 messages):

- 多标签图像分类教程: 用户

@nielsr_分享了一个用于多标签图像分类的 教程 Notebook,演示了使用 Transformers 库中强大的视觉骨干网络 SigLIP 的过程,同时指出库中的任何视觉模型都可以使用。

HuggingFace ▷ #NLP (36 messages🔥):

- 解决 TensorFlow 难题: 用户

@diegot8170在使用 TensorFlow 加载模型时遇到问题,@cursorop建议使用 pip 命令重新安装特定版本(2.15)的 TensorFlow 来解决。 - 生物医学领域的自定义句子相似度:

@joshpopelka20在生物医学术语的句子相似度预训练嵌入模型方面面临挑战,@lavi_39761建议探索 contrastive learning 以及用于微调的工具如 sentence transformers 和 setfit。 - PEFT 持久化问题: 参与者

@grimsqueaker和@kingpoki讨论了一个反复出现的问题,即 PEFT 无法为自动配置未涵盖的模型保存正确的 heads,导致尝试通过参数调整进行变通。 - 探索 Reformer 架构:

@devbravo提到正在研究 Reformer 架构,以开发适用于边缘设备(edge devices)的更小、更节省内存的模型。 - Bert 训练数据困境未获解答:

@jldevtech询问社区关于训练用于多标签分类的 Bert perf adapter 所需的最少数据量,但在交流中未收到反馈。

HuggingFace ▷ #diffusion-discussions (10 messages🔥):

- Stable Diffusion 嵌入讨论:

@pseudoterminalx指出在 Stable Diffusion 中,timestep embed 被拼接到文本嵌入隐藏状态,可能使用 Fourier transform 来创建向量。 - SDXL 微调节详解:

@pseudoterminalx进一步解释了 SDXL 如何对附加到 time embed 的微调节输入使用 Fourier transform,将 6 元素输入扩展为 256 元素输出。 - Time Embed 中的元组扩展: 在澄清维度时,

@pseudoterminalx提到 Stable Diffusion 中的 time embeds 是 3 组双元素元组。 - mr.osophy 认可讨论点:

@mr.osophy感谢了@636706883859906562之前的回复,并计划稍后探索该话题。 - 寻找 Interlingua 翻译器项目:

@hobojesus6250a询问是否有人在 Hugging Face 上研究过基于 Interlingua 的翻译器项目,希望因时间限制扩展一个用于大学项目。 - BART 模型多类别查询:

@agusschmidt寻求关于运行超过 10 个类别的 BART-large-mnli 模型 的指导,想知道如何在本地执行此操作,或者是否有其他模型支持更多类别。

Latent Space ▷ #ai-general-chat (78 messages🔥🔥):

-

Gemma 隆重登场:Google 在 Hugging Face 上发布了新的语言模型系列 Gemma,包含 7B 和 2B 两种尺寸。用户

@mjng93链接了 Hugging Face 博客,@coffeebean6887分享了发布条款,重点介绍了分发模型衍生品的限制。 -

显微镜下的 Gemma:

@guardiang对比了 Gemma 和 Llama 2 的 tokenizer,指出 Gemma 拥有更大的词表(vocab)并包含大量特殊 token;该分析的详细内容通过 tokenizer 模型文件和 diffchecker 对比的链接进行了分享。 -

Stable Diffusion 3 问世:

@rubenartus宣布了 Stable Diffusion 3 的早期预览版,并提供了 Stability AI 公告以及 EMostaque 发布的包含更多细节的 Twitter 线程链接。 -

Google Gemini Pro 1.5 探索:

@nuvic_对 Gemini Pro 1.5 新的 1,000,000 token 上下文窗口及其将视频作为输入的能力非常感兴趣,并引用了 Simon Willison 在其个人博客上概述的相关技术实验。 -

ChatGPT 出现异常后修复:

@swyxio分享了一个关于 ChatGPT 异常行为的 Twitter 链接,而@dimfeld指向了 OpenAI 状态页面,确认该问题已解决。

提到的链接:

- 未找到标题:未找到描述

- One Year of Latent Space:Latent Space 在一年内从 0 增长到 100 万读者的经验(与回忆)。

- Stable Diffusion 3 — Stability AI:宣布 Stable Diffusion 3 开启早期预览,这是我们最强大的文本生成图像模型,在多主体提示词、图像质量和拼写能力方面有显著提升。

- The killer app of Gemini Pro 1.5 is video:上周 Google 推出了 Gemini Pro 1.5,这是对其 Gemini 系列 AI 模型的一次巨大升级。Gemini Pro 1.5 拥有 1,000,000 token 的上下文窗口。这非常惊人——此前……

- Unexpected responses from ChatGPT:未找到描述

- Andrej Karpathy (@karpathy) 的推文:鉴于我昨天发布了关于 Tokenizer 的视频,我想深入研究一下 Gemma 的 tokenizer 应该会很有趣。首先是 Gemma 技术报告 [pdf]:https://storage.googleapis.com/de…

- Dana Woodman (@DanaWoodman) 的推文:这到底是怎么回事 @ChatGPTapp 😂 我不是网络专家,但我很确定这纯粹是胡言乱语……

- Hamilton Ulmer (@hamiltonulmer) 的推文:我正处于最奇怪的 ChatGPT 实验分支中

- Welcome Gemma - Google’s new open LLM:未找到描述

- 未找到标题:未找到描述

- Scaling ChatGPT: Five Real-World Engineering Challenges:在发布仅一年后,ChatGPT 的周活跃用户就超过了 1 亿。为了满足这种爆发式需求,OpenAI 团队必须克服几个扩展挑战。独家深度解析。

-

[Launch HN: Retell AI (YC W24) – Conversational Speech API for Your LLM Hacker News](https://news.ycombinator.com/item?id=39453402):未找到描述 - Rise of the AI Engineer (with Build Club ANZ):幻灯片:https://docs.google.com/presentation/d/157hX7F-9Y0kwCych4MyKuFfkm_SKPTN__BLOfmRh4xU/edit?usp=sharing🎯 Build Club 中的要点/亮点线程……

- Reddit - Dive into anything:未找到描述

- 未找到标题:未找到描述

Latent Space ▷ #ai-announcements (3 条消息):

- 深入探讨 ‘Building Your Own Product Copilot’:

@swyxio宣布@451508585147400209正在主持关于 Building Your Own Product Copilot 论文的讨论。可以通过特定的 Discord channel 参与该环节。 - 通过 Latent.Space 随时了解未来活动:

@swyxio分享了 Latent.Space events 的链接,用户可以点击 RSS 标志将活动日历添加到个人日历并接收通知。操作说明包括在悬停时点击 “Add iCal Subscription” 以实现自动更新。

提到的链接:

Latent Space (Paper Club & Other Events) · Luma: 在 Luma 上查看并订阅来自 Latent Space (Paper Club & Other Events) 的活动。Latent.Space 活动。请点击日历右上方正上方的 RSS 标志以添加到您的日历。”Ad…

Latent Space ▷ #llm-paper-club-west (173 条消息🔥🔥):

- 搞笑的人机交互:

@_bassboost强调了论文中的一个古怪案例:在询问建议的对话中,用户会回复一些个人问题,比如没有朋友。工程师们试图引导模型避开可能导致敏感领域的议题。 - 论文俱乐部投票热潮:

@eugeneyan、@henriqueln7和@amgadoz等成员讨论并投票决定深入研究哪篇论文,备选项包括 Copilot 研究和 Sora。文中提供了论文链接,包括 arxiv 上关于 Copilot 研究的摘要。 - Google Gemini 正式起飞:

@coffeebean6887讨论了 Google Gemini AI 与 Workspace 和 Google One 服务的集成,并提供了展示其先进功能的视觉效果和博客文章链接(Google One,Workspace)。 - AI 评估裁判 (Judges):讨论转向了评估 AI 的回答,

@henriqueln7、@swyxio和@_bassboost等成员讨论了使用 Langsmith、GPT4 以及更小的模型作为对话式聊天机器人和学习平台的裁判。此外还分享了 predibase.com Lora Land 等工具用于微调 (finetuning) 对比。 - ML 和 GenAI 人才的未来:在一个前瞻性话题中,

@lightningralf和@eugeneyan辩论了 ML/GenAI 人才以及采用 AI 的公司的发展格局。他们推测了快速改进的工具和 AI 进步可能带来的影响,这些进步可能会在几年内改变对某些技能组合的需求。

提到的链接:

- Building Your Own Product Copilot: Challenges, Opportunities, and Needs:一场将先进 AI 能力嵌入产品的竞赛正在进行。这些产品 Copilot 允许用户使用自然语言提问,并获得针对特定用途的相关回答……

- Boost your productivity: Use Gemini in Gmail, Docs and more with the new Google One plan:我们通过在 Gmail、Docs、Slides、Sheets 和 Meet(原 Duet AI)中引入 Gemini,为 Google One AI Premium 计划带来更多价值。

- LoRA Land: Fine-Tuned Open-Source LLMs:性能超越 GPT-4 的微调开源 LLM,可在单张 GPU 上运行。

- Tweet from Amazon Web Services (@awscloud):由 #AWS 发起的 PartyRock #generativeAI 黑客松现在开始!📣 了解如何无需编程即可构建有趣且直观的应用,有机会赢取现金奖励和 AWS 额度。🏆 #AI 别忘了你的马克杯……

- SPQA: The AI-based Architecture That’ll Replace Most Existing Software:2023 年 3 月 10 日。得益于 GPT 带来的爆发,AI 在未来几个月和几年内将完成许多有趣的事情。但其中最重要的之一是……

- no title found:未找到描述

- - Fuck You, Show Me The Prompt.:通过拦截 API 调用,快速理解难以捉摸的 LLM 框架。

- New ways Google Workspace customers can use Gemini:我们正在推出一项新方案,帮助组织开始使用生成式 AI,并提供与 Gemini 聊天的独立体验。

- Founder’s Guide to Basic Startup Infrastructure:未找到描述

- GitHub - stanfordnlp/dspy: DSPy: The framework for programming—not prompting—foundation models:DSPy:用于编程(而非提示)基础模型的框架 - stanfordnlp/dspy

LlamaIndex ▷ #blog (3 messages):

- 简化 RAG 的复杂性:

@IFTTT强调了由于选项众多,构建高级 RAG 系统的复杂性。他们建议通过精确找出每个 Pipeline 组件中的痛点及相应的解决方案来简化流程,并分享了 来自 @jerryjliu0 演讲的幻灯片。 - 为 LLM/RAG 专家准备的前端:由

@IFTTT推荐的 Marco Bertelli 教程,教授没有 React 知识的 LLM/RAG 专家如何为他们的 RAG 后端创建一个美观的前端,资源来自 @llama_index。 - 从 RAG Notebooks 到全栈应用:

@wenqi_glantz提供了一个教程,介绍如何将 RAG Notebooks 转换为包含摄取(Ingestion)和推理(Inference)微服务的综合应用程序,由@IFTTT在其推文中分享,包含教程链接和进一步步骤。点击此处查看完整教程。

LlamaIndex ▷ #general (246 messages🔥🔥):

- 寻求 QueryPipeline RAG 的澄清:用户

@lapexer好奇如何在包含 Prompt、Retriever 和 LLM 的 DAG QueryPipeline 中编写一个简单的 RAG。文档 RAG Pipeline Without Query Rewriting 被提供用于指导如何设置 Pipeline。 - LlamaIndex ImportError 问题:用户

@emmepra和@pymangekyo讨论了从llama_index导入VectorStoreIndex时遇到的问题。@emmepra建议从llama_index.core而不是llama_index.legacy导入以尝试解决问题,而@whitefang_jr建议在卸载并重新安装后使用全新的环境。 - LangchainEmbedding 导入问题:尽管参考了文档,用户

@pymangekyo仍无法从llama_index.embeddings导入LangchainEmbedding。@emmepra建议尝试从llama_index.core.indices导入,但@pymangekyo仍然面临问题。 - CRAG Pack 下载问题:用户

@lapexer报告在尝试使用llamaindex-cli下载 CorrectiveRAGPack 时出现ValueError。@whitefang_jr指出一个修复 llama-pack 下载的相关 Pull Request 可能会解决此问题。链接了 PR #11272 以供参考。 - LlamaIndex 文档和 LlamaHub Reader 链接失效:用户

@andaldana询问如何使用DatabaseReader和CSVreader处理 SQL 数据库中每条记录作为一个 Document 的数据,但发现文档链接已失效。他们正在寻求 LlamaIndex 中更新的方法或 Reader 来实现其目标。

提到的链接:

- 未找到标题: 未找到描述

- T-RAG = RAG + Fine-Tuning + Entity Detection: T-RAG 方法的前提是将 RAG 架构与开源的 Fine-Tuned LLM 和实体树向量数据库相结合。

- Fine-tuning - LlamaIndex 🦙 v0.10.11.post1: 未找到描述

- Google Colaboratory: 未找到描述

- Building Your Own Evals - Phoenix: 未找到描述

- LangChain Embeddings - LlamaIndex 🦙 v0.10.11.post1: 未找到描述

- RAG CLI - LlamaIndex 🦙 v0.10.11.post1: 未找到描述

- Loading Data (Ingestion) - LlamaIndex 🦙 v0.10.11.post1,): 未找到描述

- 未找到标题: 未找到描述

- 未找到标题: 未找到描述

-

llama_index/llama-index-core/llama_index/core/question_gen/llm_generators.py at main · run-llama/llama_index: LlamaIndex(前身为 GPT Index)是为您 LLM 应用程序提供的数据框架 - run-llama/llama_index

- llama_index/llama-index-core/llama_index/core/question_gen/llm_generators.py at da5f941662b65d2e3fe2100f2b58c3ba98d49e90 · run-llama/llama_index: LlamaIndex(前身为 GPT Index)是一个用于 LLM 应用程序的数据框架 - run-llama/llama_index

- llama_index/llama-index-core/llama_index/core/callbacks/token_counting.py at 6fb1fa814fc274fe7b4747c047e64c9164d2042e · run-llama/llama_index: LlamaIndex(前身为 GPT Index)是一个用于 LLM 应用程序的数据框架 - run-llama/llama_index

- An Introduction to LlamaIndex Query Pipelines - LlamaIndex 🦙 v0.10.11.post1: 未找到描述

- no title found: 未找到描述

- llama_parse/examples/demo_advanced_astradb.ipynb at main · run-llama/llama_parse: 为实现最佳 RAG 解析文件。通过在 GitHub 上创建账号,为 run-llama/llama_parse 的开发做出贡献。

- llama_parse/examples/demo_astradb.ipynb at main · run-llama/llama_parse: 为实现最佳 RAG 解析文件。通过在 GitHub 上创建账号,为 run-llama/llama_parse 的开发做出贡献。

- [FIX] download_llama_pack for python packages containing multiple packs by nerdai · Pull Request #11272 · run-llama/llama_index: 描述:之前的 download_llama_pack 逻辑对 GitHub 树的遍历不够深入,这给包含多个 pack 的包带来了问题(即,由于存在更多包含 s… 的文件夹)

- Survey on your Research Journey: 为了彻底改变学术和商业研究,EurekAI 正在征求您的见解,以便根据您的需求定制我们的工具。无论您是沉浸在研究中还是偶尔参与,您的…

- Custom Embeddings - LlamaIndex 🦙 v0.10.11.post1: 未找到描述

- llama_index/llama-index-integrations/embeddings/llama-index-embeddings-ollama/llama_index/embeddings/ollama/base.py at main · run-llama/llama_index: LlamaIndex(前身为 GPT Index)是一个用于 LLM 应用程序的数据框架 - run-llama/llama_index

- OpenAI API compatibility · Issue #305 · ollama/ollama: 有没有可能考虑镜像 OpenAI 的 API 规范和输出?例如 /completions 和 /chat/completions。这样,通过更改… 就可以作为 Python openai 包的直接替代品。

LlamaIndex ▷ #ai-discussion (3 条消息):

- 表达感谢:用户

@behanzin777表示打算尝试建议的解决方案,并以 “Thanks. I will give it a try 🙏🏾” 表达了谢意。 - 寻求 LlamaIndex 的摘要评估指标:

@dadabit.询问了在 LlamaIndex 中评估摘要的有效指标和工具。他们对基于社区经验的推荐感兴趣。 - 寻找 LLM 评估平台:

@.dheemanth正在寻找一个易于使用的平台来评估 Large Language Models (LLMs),该平台需包含类似于 MT-Bench 和 MMLU 的分析、追踪和评分功能。

OpenAccess AI Collective (axolotl) ▷ #general (149 条消息🔥🔥):

-

Google Gemma AI 模型讨论:OpenAccess AI Collective 的用户正在积极讨论 Google 新推出的 Gemma 模型系列。

@nafnlaus00检查了许可证详情,指出其限制比 LLaMA 2 更少。@le_mess提供了 Gemma 在 Hugging Face 上集成的更新,并附带了模型和技术文档的链接。 -

Gemma 模型属性揭晓:

@le_mess获得了 Gemma 仓库的访问权限,透露了诸如max_position_embeddings: 8192和vocab_size: 256000等特征。讨论集中在大词表大小的影响以及这可能如何影响推理时间。 -

Gemma 模型的公开访问:

@le_mess报告称重新上传了 Gemma 的 7B 模型,使其可以在 Hugging Face 上公开使用,绕过了 Google 最初要求的访问请求。 -

Gemma 的微调挑战:多位用户报告了微调 Gemma 时遇到的问题,特别是

@stoicbatman在训练结束时遇到了错误。@nanobitz引用了相关的 GitHub issues,指出可能存在 early stopping callback(早停回调)问题。 -

云算力成本分析:

@yamashi在与 Google 的讨论中提出了云算力资源的高昂成本,并将其与物理拥有服务器的价格进行了比较。DreamGen 讨论了可能使云选项更具吸引力的折扣,特别是针对研究人员。

提到的链接:

- 未找到标题:未找到描述

- HuggingChat:让每个人都能使用社区最好的 AI 聊天模型。

- 欢迎 Gemma - Google 的新开源 LLM:未找到描述

- mhenrichsen/gemma-7b · Hugging Face:未找到描述

- Google 推出名为 Gemma 的轻量级开源 AI 模型:Google 表示 Gemma 是其对开源社区的贡献,旨在帮助开发者“负责任地构建 AI”。

- mhenrichsen/gemma-7b-it · Hugging Face:未找到描述

- 来自 Tri Dao (@tri_dao) 的推文:FlashAttention v2.5.5 现在支持在消费级 GPU 上进行 head dim 256 的反向传播。希望这能让微调 Gemma 模型变得更容易。

- 使用 EarlyStoppingCallback 保存时出错 · Issue #29157 · huggingface/transformers:系统信息 transformers 版本:4.38.0.dev0(在 4.38.0 和 4.39.0.dev0 中也存在)平台:Linux-5.15.0-78-generic-x86_64-with-glibc2.35 Python 版本:3.10.12 Huggingface_hub 版本:0.20.3 Safete…

- llm-foundry/scripts/train/README.md at main · mosaicml/llm-foundry:用于 MosaicML 基础模型的 LLM 训练代码。通过在 GitHub 上创建账号来为 mosaicml/llm-foundry 的开发做出贡献。

- 在消费级 GPU (Ampere, Ada) 上启用 headdim 256 反向传播 · Dao-AILab/flash-attention@2406f28:未找到描述

- GitHub - Dao-AILab/flash-attention: 快速且内存高效的精确注意力机制:快速且内存高效的精确注意力机制。通过在 GitHub 上创建账号来为 Dao-AILab/flash-attention 的开发做出贡献。

OpenAccess AI Collective (axolotl) ▷ #axolotl-dev (26 messages🔥):

- Merge Ready for Fixes:

@nanobitz寻求确认以开始将包括 readme 修复、val 修复和示例修复在内的小型 PR 合并到 axolotl 代码库中。 - Gemma 训练要求:

@giftedgummybee强调了训练 gemma 模型需要非开发版本的 transformers,并提到开发版本不支持 “gemma” 类型的模型。@stoicbatman证实了这一点,他在 axolotl 的 Docker 镜像上使用开发版本时遇到了问题。 - Gemma 的配置说明:

@stoicbatman分享了一个更新后的 gemma config file 以解决设置过程中的问题。同时,@nanobitz指出 sample packing 在该模型上尚无法运行。 - Gemma 微调中的超参数困惑:

@faldore和@nanobitz讨论了 Gemma models 合适的学习率和权重衰减,参考了 Google 在不同文档中给出的 5e-5 和 2e-4 等多种建议。 - Mixtral 的优化建议:

@casper_ai分享了关于优化 Mixtral model 的见解,并讨论了提升速度的潜力,尽管提到自己缺乏编写 CUDA backward passes 的专业知识。他们还提到了使用 AutoAWQ 在 prefilling 和解码速度方面取得的成功。

提到的链接:

- Welcome Gemma - Google’s new open LLM: 未找到描述

- Google Colaboratory: 未找到描述

- gemma_config_axolotl.yml: GitHub Gist:即时分享代码、笔记和片段。

OpenAccess AI Collective (axolotl) ▷ #general-help (51 messages🔥):

- 寻找 Alpaca 模板:

@yamashi正在寻找 alpaca 的 jinja template,@rtyax分享了一个可能的模板,@yamashi打算将其添加到 axolotl repository。 - 训练辅助:

@napuh探讨了如何利用 DeepSpeed 和多 GPU 提高训练速度,而@nanobitz澄清了 micro batch size 乘以 gradient accumulation 是针对每个 GPU 的,这意味着更多 GPU 应该会导致更少的步数(steps)。 - 微调推理格式:

@timisbister和@nani1149询问模型微调后的正确推理格式,@nanobitz和@yamashi提供了模板和格式指导,@yamashi指出需要完善文档以减少重复提问。 - FlashAttention 困扰:

@rakesh_46298遇到了与 FlashAttention 和 GPU 相关的运行时错误,@nanobitz建议关闭该功能,但仍需进一步说明。 - 文档需求: 鉴于重复出现的问题,

@yamashi和@nanobitz讨论了通过 read-the-docs 或 gitbooks 为 axolotl 提供更好文档的需求,并提到这是之前讨论过的话题。

提到的链接:

- tokenizer_config.json · teknium/OpenHermes-2.5-Mistral-7B at main: 未找到描述

- GitHub - tatsu-lab/stanford_alpaca: Code and documentation to train Stanford’s Alpaca models, and generate the data.: 用于训练 Stanford Alpaca 模型并生成数据的代码和文档。 - tatsu-lab/stanford_alpaca

- text-generation-webui/instruction-templates/Alpaca.yaml at main · oobabooga/text-generation-webui: 一个用于大语言模型的 Gradio Web UI。支持 transformers, GPTQ, AWQ, EXL2, llama.cpp (GGUF), Llama 模型。 - oobabooga/text-generation-webui

OpenAccess AI Collective (axolotl) ▷ #community-showcase (1 messages):

- AI 叙事的新冒险:

@dreamgen宣布发布了用于 AI 驱动的故事写作和角色扮演的新模型,现已在 Hugging Face 上线。这些 Opus V1 模型是在约 100M tokens 的人类生成文本上训练的,并基于 ChatML 的扩展版本。 - 使用 ChatML+ 引导叙事:包含的模型利用了改进版的 ChatML 进行 prompting,为更受控的输出增加了灵活性。模型的详细用法以及提示指令可以在此处的 Opus V1 指南 here 中找到。

- 引导对话的秘诀:

@dreamgen解释了可引导提示词 (steerable prompts) 的概念,它涉及一种结构化输入:一个定义故事或角色扮演场景的 system prompt,随后是随着故事展开的文本轮次,以及引导接下来发生什么的指令。这允许用户更直接地影响生成内容的方向。

提到的链接:

- Opus V1: Story-writing & role-playing models - a dreamgen Collection:未找到描述

- DreamGen: AI role-play and story-writing without limits:未找到描述

OpenAccess AI Collective (axolotl) ▷ #runpod-help (6 messages):

- RunPod 镜像神秘消失:

@stoicbatman报告了一个关于 RunPod 镜像似乎被删除的问题,并提到难以定位该镜像。 - Docker 标签的有用指引:针对这一困惑,

@nanobitz提供了一个指向 Docker Hub 的有用链接,可以在那里找到 RunPod 镜像的标签。 - GitHub Readme 重定向问题:

@stoicbatman指出 GitHub readme 没有正确地将用户重定向到实际的 RunPod 镜像,这表明 GitHub 文档可能存在问题。 - 最新链接困境:

@nanobitz询问@stoicbatman是否拥有最新链接,这表明资源可能存在更新或更改,从而指向正确的 RunPod 镜像位置。

提到的链接:

Docker:未找到描述

CUDA MODE ▷ #general (2 messages):

-

Groq LPU 树立 AI 新基准:

@srns27强调了 Groq LPU 推理引擎 在大语言模型方面的性能突破,它在最近的基准测试中超越了竞争对手,达到了每秒 241 个 tokens。基准测试详情可在 Groq 官网 和 ArtificialAnalysis.ai 查看。 -

深入探讨 Groq 架构:

@dpearson分享了 Groq 编译器技术主管 Andrew Bitar 的 YouTube 视频,解释了 Groq 高速背后的架构。这份题为“用于数据流计算的软件定义硬件”的演讲是在 Intel/VMware Crossroads 3D-FPGA 学术研究中心发表的。

提到的链接:

- Groq's $20,000 LPU chip breaks AI performance records to rival GPU-led industry:Groq 的 LPU 推理引擎(一种专用的语言处理单元)在大语言模型的处理效率方面创下了新纪录。在 ArtificialAnalysis 最近进行的基准测试中……

- Software Defined Hardware for Dataflow Compute / Crossroads 3D-FPGA Invited Lecture by Andrew Bitar:Groq 编译器技术主管 Andrew Bitar 于 2022 年 12 月 11 日受邀为 Intel/VMware Crossroads 3D-FPGA 学术研究中心做的讲座。摘要:随着……

CUDA MODE ▷ #triton (3 messages):

- 工具的简洁性:

@srush1301提到在处理简单任务时使用 Excalidraw,并强调 gpu puzzles 可以与 chalk-diagrams 配合使用。 - 发现 Excalidraw:

@morgangiraud表示他们之前不熟悉@srush1301提到的这个工具。 - 质疑 Triton 的优势:

@_hazler询问@745353422043087000,在 Triton 中实现某些功能是否能带来显著的速度提升或新的部署平台支持,还是主要用于教学目的。

CUDA MODE ▷ #cuda (18 messages🔥):

- CUDA 函数指针查询:用户

@carrot007.询问在cudaMemcpyFromSymbol过程中遇到警告时,如何在 global 函数中调用 device 函数指针。@morousg建议不要这样做,因为这可能导致效率低下以及类似cudaErrorInvalidPc的 Bug,并推荐使用 C++ templates 作为替代方案,以保持编译优化。 - 在 Docker 中安装 NVIDIA Nsight:

@dvruette询问在 vast.ai 的 Docker 容器中安装 NVIDIA Nsight 进行调试的经验。@marksaroufim提到在不同云服务商中都遇到过类似问题,并指出 lighting.ai studios 有可行的解决方案。 - NVIDIA

ncu工具在 Docker 中运行正常:在关于 CUDA profiling 的讨论中,@lntg确认ncu在 Docker 容器中可以按预期工作,并为 CUDA mode 成员提供支持,包括在其平台上提供快速验证和免费额度。 - NVIDIA Profiling 工具的性能困扰:

@complexfilterr在尝试对其 CUDA 代码进行 profile 时遇到警告:==WARNING== No kernels were profiled。他们提供了所使用的命令:ncu -o profile --set full ./add_cuda。 - 发布新的 BnB FP4 仓库:

@zippika为其 bnb fp4 代码创建了一个 GitHub repository,并报告其速度比 bitsandbytes 更快。该代码要求 CUDA compute capability >= 8.0。他们还提供了一个详细的 Python 脚本来测试速度对比,并强调了特定模型对 VRAM 的高要求。

提到的链接:

GitHub - aredden/torch-bnb-fp4:通过在 GitHub 上创建账号来为 aredden/torch-bnb-fp4 的开发做出贡献。

CUDA MODE ▷ #torch (5 messages):

- 寻求关于 torch.compile 局限性的澄清:

@ardywibowo询问 torch.compile 不具备哪些功能,并对通过 Triton/CUDA 可获得但 torch.compile 可能无法实现的加速类型感到好奇。 - 关于将混合类型 Matmul 公开的查询:

@jeremyhoward寻求关于是否有计划将混合类型矩阵乘法(matmul)公开的信息,以及是否存在任何安全性或实现细节(如 nf4 的使用)。 - 自定义 Kernel vs. PyTorch 原生 Kernel:

@gogators.讨论了有时 PyTorch 的原生 kernel 性能较低,并举例说明在 batch size 为 1 的 1D 卷积中,自定义 kernel 实现了 6 倍的速度提升。然而,对于非研究用例,常用算子 的原生 kernel 是高效的。 - torch.compile 与动态控制流:

@gogators.提到 torch.compile 不能很好地处理 动态控制流(dynamic control flow),但这在神经网络中通常是极少数情况。 - torch.compile 错失的融合收益:

@gogators.对 torch.compile 复制 flash-attention 中所见的 kernel fusion 收益的能力表示怀疑,并强调它可能无法像自定义 kernel 那样针对所有网络架构进行优化。

CUDA MODE ▷ #suggestions (1 条消息):