ainews-mistral-large-disappoints

Mistral Large 令人失望。

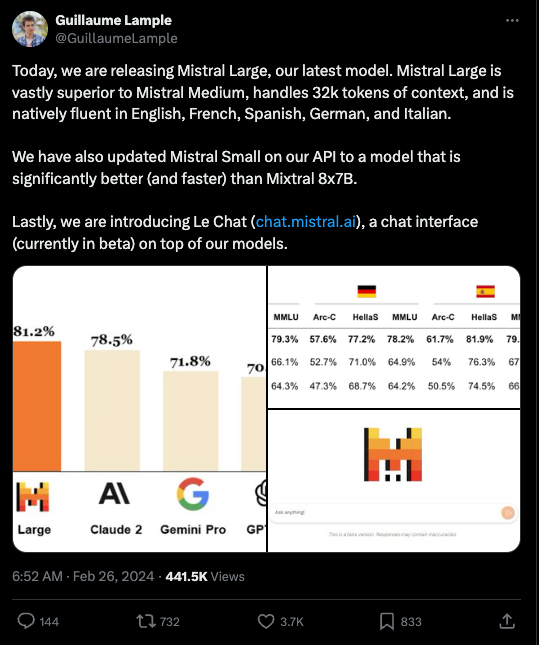

Mistral 发布了 Mistral Large,这是一款新的语言模型,在 MMLU 基准测试中达到了 81.2% 的准确率,落后 GPT-4 Turbo 约 5 个百分点。

社区对此反应不一,有人对其开源立场表示怀疑,并有说法称 Mistral Small 的表现优于开源的 Mixtral 8x7B。在 TheBloke 的 Discord 频道中,讨论重点包括:Mistral Large 与 GPT-4 Turbo 之间的性能和成本效益对比;使用 DeepSpeed 和 DPOTrainer 进行训练时的技术挑战;利用 DreamGen Opus V1 在角色扮演中实现的 AI 欺骗(deception)技术进展;以及使用线性插值和 PEFT 方法进行模型合并的复杂性。此外,人们还表达了对 AI 辅助反编译的热情,并强调了利用开源项目作为训练数据的重要性。

2024年2月21日至23日的 AI Discord 动态。我们为您检查了 20 个公会、318 个频道和 15439 条消息。预计节省阅读时间(按每分钟 200 字计算):1430 分钟。

Mistral 今天强势出击,在 La Plateforme 和 Azure 上宣布推出 Mistral-Large,其综合基准测试结果落后 GPT4 约 5 个百分点:

社区反响略显负面。

开源的希望并不大。值得注意的是,Mistral 还声称新的 Mistral-Small “显著优于”已开源发布的 Mixtral 8x7B。

目录

[TOC]

PART 0: 摘要之摘要之摘要

评估 LLM 的性能与成本效益:

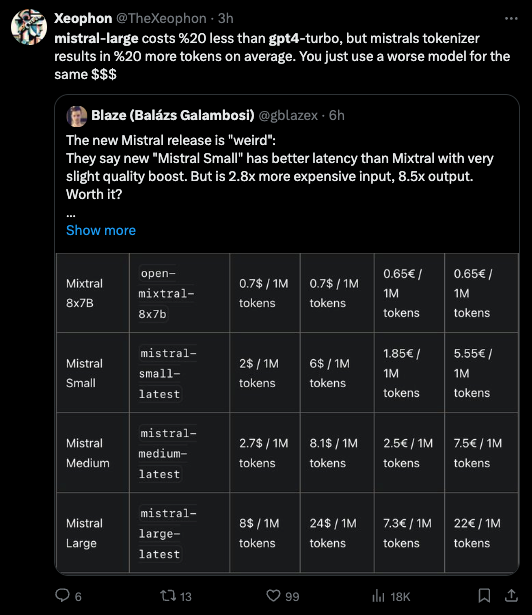

TheBloke Discord 中的讨论强调了 Mistral Large 与 GPT-4 Turbo 之间的对比分析。尽管成本影响相似,但 Mistral Large 在 MMLU 等基准测试上的表现不尽如人意,这表明用户和开发人员都需要重新评估成本效益。

技术训练障碍与最佳实践:

在实施 DeepSpeed 以避免显存溢出(OOM)错误方面的挑战,以及使用 DPOTrainer 应用 DPO 的过程,突显了技术复杂性和社区驱动的解决方案共享,展示了在优化 LLM 训练效率和实用性方面的持续努力。

角色扮演角色 AI 欺骗技术的进展:

关于创建具备欺骗能力的 AI 角色的对话,特别是生存目标的加入,反映了对 AI 叙事能力的细致探索。尽管存在 tokenizer 和冗长问题,DreamGen Opus V1 的使用仍突显了 AI 故事创作中的创意追求。

模型合并的复杂性:

由社区成员主导的关于使用线性插值和 PEFT 合并方法等策略合并非同质模型的讨论,揭示了通过模型集成增强 LLM 的复杂性和潜力,这标志着 AI 开发实践中的一个重要探索领域。

PART 1: 高层级 Discord 摘要

TheBloke Discord 摘要

-

评估 LLM 的性能与成本效益:

@timotheeee1认为 Mistral Large 的表现不如 GPT-4 Turbo,考虑到其在 MMLU 等基准测试上的表现,在成本相近的情况下可能并不划算。 -

技术训练障碍与最佳实践:DeepSpeed OOM 错误的问题以及围绕使用

trlHugging Face library 中的DPOTrainer进行 DPO 实际应用的讨论,促使@cogbuji和@plasmator等用户分享见解和资源。 -

推进角色扮演角色中的 AI 欺骗技术:关于创建能令人信服地撒谎的 AI 角色的对话强调了应用明确生存目标后的改进。讨论了使用 DreamGen Opus V1 模型时遇到的挑战,以及 AI 故事创作中的 tokenizer 问题和冗长现象。

-

深入探讨模型合并的复杂性:由

@jsarnecki和@maldevide领导的讨论深入探讨了合并非同质模型的复杂性以及成功合并的各种策略(如线性插值)。结合 mergekit 和 Hugging Face blog post 中概述的 PEFT 合并方法的进展,阐述了其中的局限性和可能性。 -

工程师在展望 AI 反编译未来的同时怀念过去:

@spottyluck对 OllyDbg 功能的回忆与@mrjackspade对 AI 辅助反编译 潜力的兴奋形成了对比。利用大量开源项目创建 AI 训练数据集的建议,展示了在推进代码重构 AI 能力方面的前瞻性思维。

Mistral Discord 总结

Mistral Large 登场:Mistral Large 的推出引发了社区的广泛关注和讨论。这是一款高度优化的语言模型,在 MMLU 上达到了 81.2% 的准确率,并具备多语言能力和原生 function calling 等特性。用户可以通过 la Plateforme 等平台使用该模型。

LLM 部署中的技术挑战与突破:成员们分享了在各种硬件配置(包括 Tesla V100s 和 VRAM 有限的本地机器)上部署 Mistral 模型(如 Mistral7x8b 和 Mistral-7B-Instruct)的经验并交流了技术建议。大家交换了关于调整 layer sharing、精度级别以及处理死机问题的技巧,凸显了高性能模型使用中的技术细节。

微调 (Fine-Tuning) 技巧:社区讨论了微调实践,强调了实验和充足数据量的重要性,并建议针对特定任务准备约 4000 条数据。此外,讨论还集中在 Mistral 模型微调所需的正确数据格式,以及掌握 LoRA 等高级微调技术的必要性。

对商业影响与开放获取的思考:围绕 Mistral 转向更面向业务的闭源权重模型(如 Mistral Small 和 Large)的讨论,引发了对开放模型未来的担忧。然而,尽管存在与大科技公司的合作伙伴关系,许多成员仍对开源模型开发的持续支持抱有希望。

Mistral API 见解与查询:关于 Mistral API 的咨询非常多,涵盖了从数据隐私担忧(已确认数据不会用于模型训练)到关于在没有 GPU 的本地机器上运行 Mistral 的功能性查询。此外,还讨论了第三方产品以及扩展 Mistral 能力的潜在集成方案。

用户驱动的设计与应用创意:社区积极分享了新应用和增强功能的想法,包括开发利用 Mistral 的插件和移动应用。一位用户建议为 Mistral 的 Le Chat 添加语言级别设置,此外,Le Chat 中 Mistral-Next 的功能简洁性也引起了热议,这可能表明用户更倾向于精简的 AI 产品。

LM Studio Discord 摘要

-

解决 LM Studio 的白屏困扰:用户

@steve_evian遇到了 LM Studio 启动后显示白屏的问题;@heyitsyorkie建议清理 .cache 和 %APPDATA%,该操作解决了问题。 -

探索多语言 LLM 的存在:

@.deug询问是否有支持韩语的预训练多语言 LLM;@heyitsyorkie指出精通韩英翻译的 LLM 较为稀缺,建议将 LM Studio 与 DeepL 等在线翻译工具结合使用。 -

LM Studio API 拒绝以无头模式运行:

@muradb询问了 LM Studio API 的无头(headless)运行操作;@heyitsyorkie澄清当前版本不支持该功能,而@krypt_lynx表达了对开源和无头特性的渴望,@heyitsyorkie确认这些特性目前均不可用。 -

超参数评估仍是个人选择:

@0xtotem思考了用于 RAG 模型超参数评估的合适数据集——由于缺乏具体指导,共识倾向于使用手头最接近的数据。 -

GPU 之战:Nvidia 在用户偏好中对阵 AMD:关于 AMD GPU 是否适合运行 LLM 展开了辩论;尽管有推测称 AMD 正在开发 CUDA 的替代方案,但由于 AI 应用安装配置更简便,用户普遍更青睐 Nvidia。

-

共同努力在 LM Studio 中支持 IQ 模型:

@drawless111成功让 IQ 模型运行,并提供了在 HGF 上定位特定格式的指导;其他人讨论了对各种模型和工具(如 llama.cpp)的改进和更新。 -

没有文件系统访问权限的在线强化学习:

@wolfspyre询问了 LM Studio 访问本地文件系统的能力;会议澄清了 LLM 不具备此能力,LM Studio 也不支持执行来自 LLM 的命令。 -

通过经典的重启解决 AutoGen 异常:用户分享了 AutoGen 错误 的排障技巧,包括重新安装包以及可靠的“关掉再重启”策略,正如这个 Tenor GIF 中幽默描述的那样。

-

寻求 Langchain 的 RAG 使用支持:在一条简短的消息中,bigsuh.eth 询问了如何通过 LM Studio 在 Langchain 中使用 RAG,但随后没有引发进一步讨论或得到解答。

-

破解 Open-Interpreter 连接难题:用户

@nxonxi在尝试使用--local标志运行 Open Interpreter 时遇到了连接错误和语法错误;经过排障,简单的 Python requests 请求作为解决方案奏效了。

Perplexity AI Discord 摘要

-

Discover Daily 播客亮相:Perplexity AI 与 ElevenLabs 合作推出了 Discover Daily 播客。剧集源自 Perplexity 的 Discover feed,可在 podcast.perplexity.ai 收听,利用 ElevenLabs 的语音技术提供每日科技、科学和文化见解。

-

Sonar 模型引发争论:Perplexity AI 推出了新的

sonar-small-chat和sonar-medium-chat模型及其搜索增强版,引发了社区与pplx-70b-online的对比。用户报告 sonar 模型回复不连贯,请求不要逐步淘汰pplx-70b-online,因为后者性能更好;根据社区见解和 API Updates,sonar 模型的修复工作正在进行中。 -

Sonar 模型的乱码回复受到关注:像

@brknclock1215这样的用户建议通过限制回复长度来减轻乱码输出,这与 pplx 模型即使在较长长度下也能保持稳定的输出质量形成对比。同时,API 用户讨论了如何通过编程方式获取模型详情,以优化用户界面的选择。 -

#general 频道中充斥着 AI 聊天模型的讨论:社区参与了各种讨论,包括 Gemini 的退役以支持可能的 Gemini Ultra、不同平台间模型回复的不一致性,以及利用 Perplexity 的 Pro 能力进行图像生成。

-

sharing 频道中的各种查询和测试:sharing 频道的成员深入探讨了混合话题,如探索 Perplexity 主题的用户指南、质疑联想(Lenovo)技术的新颖性,并分享了利用 AI 进行个人辅助和技术咨询的混合用例。

OpenAI Discord 总结

-

VPN 对 OpenAI 服务的干扰:

@strang999在使用 OpenAI 服务时遇到错误,@satanhashtag将其归因于潜在的 VPN 干扰,并建议在 VPN 设置中禁用 Web Protection。 -

GPT-4 上下文和 Captcha 挑战:

@orbart和@blckreaper对 ChatGPT 在叙事创作中记忆力下降感到沮丧,怀疑处理的 Token 数量有所减少;同时@little.toadstool和@necrosystv报告了 ChatGPT 中繁琐的 Captcha 测试。 -

寻求 Image-to-Video 以及对数据隐私的担忧:

@sparkette正在寻找基于浏览器的 Image-to-Video 生成器,@razorbackx9x询问了关于使用 AI 整理信用报告数据的问题,@eskcanta警告不要上传敏感的个人身份信息 (PII)。 -

了解 Custom GPT 和 Assistant 的差异:用户注意到 Custom GPTs 和 Assistant GPTs 在处理格式和 Markdown 方面存在不一致,特别是在生成表格或图像时,并建议参考特定的 API 配置。

-

期待 Sora 并保护 Prompt:社区对 OpenAI 的 Sora 的能力感到好奇,并讨论了保护自定义 Prompt 的可行性,

@.dunamis.和@kyleschullerdev_51255一致认为完全的保护是不可能的,建议使用分层 Web 应用程序来保证安全性。

LAION Discord 总结

-

警惕加密货币诈骗:#learning-ml 频道中来自

@josephsweeney11的一条帖子似乎是一个潜在的诈骗,涉及在 72 小时内赚取 4 万美元,应予以极度警惕。 -

理解 Transformer 的学习能力:在 #learning-ml 频道中,

@phryq.询问了关于训练 Transformer 理解尺寸关系的实验,以通过假设物体来增强图像生成。 -

新 Snap Video 项目发布:#general 频道讨论了一个名为 Snap Video 的新项目,该项目通过基于 Transformer 的模型解决了视频生成中的挑战,并分享了项目链接和相关的研究论文。

-

关于最优 CLIP 过滤技术的辩论:在 #research 频道中,讨论围绕 CLIP 过滤是否比图像-文本对分类器(image-text pair classifiers)更次优展开,对话中参考了最近发表的 DFN 论文。

-

梯度精度:bfloat16 vs fp32 之争:#research 频道的对话涉及在 TPU 上使用 bfloat16 梯度的 autocasting,并将其性能与 PyTorch autocast 行为中默认的 fp32 梯度进行了比较。

-

分享 AI 研究论文和方法:在各个频道中,参与者分享了关于各种 AI 研究主题的见解和资源,例如 state space architecture、Transformer 优化、AI 生成文本检测,以及关于如何显著降低 LLMs 成本的讨论,并提供了 Mamba-ND 等资源链接。

HuggingFace Discord 总结

-

AI 硬件民主化引发激烈辩论:在围绕创建专有 TPU 的潜力和硬件民主化的讨论中,与汽车和 RAM 行业的类比引发了对 Samsung 等公司技术承诺的质疑。鉴于这些进展对 AI 能力和获取途径的影响,此类进步的重要性得到了强调。

-

迈向易于获取且实用的 AI 解决方案:多项倡议旨在使 AI 工具在各种应用中更加易用和实用,包括创建 Galaxy AI(提供对 GPT-4、GPT-3.5 以及 Galaxy AI’s Gemini Pro 等模型的免费 API 访问),以及展示支持 90 多种语言的 OCR 和行检测项目 surya,详见 此 GitHub 仓库。

-

神经网络创新与模型微调挑战:从在浏览器中引入对 WavLMForXVector 的支持,到审查 Peft 库 中 LoRA 的新合并方法,讨论重点显然在于模型部署和提升 AI 性能。微调难题,无论是 Flan T5 产生不连贯的输出,还是 Qwen1.5-0.5B 中出现的锯齿状 Loss 曲线,仍然是讨论的核心点。

-

跨学科 AI 项目备受关注:将 AI 与特定学科相结合的项目,如开源 AI 工具箱 Unburn Toys,或用于比较 TTS 模型的 TTS Arena,标志着 AI 开发的跨职能方法。此外,还发布了针对哲学问答等利基应用的训练数据集,可在 Hugging Face 此处 获取。

-

AI 社区中的知识共享与协作增长:无论是关于机器人模仿学习的查询、AnimeBackgroundGAN 的使用、多语言 OCR 相关问题,还是 Japanese Stable Diffusion 模型在新语言训练中的方法,显而易见,AI 社区是分享知识、解决问题并促进该领域集体进步的宝贵论坛。

Eleuther Discord 总结

-

GPT-4 的 Batching 困境:

@rwamit提出了关于在使用 langchain 封装器对 GPT-4 进行 Batching 查询时,处理时间从每次迭代 2 秒增加到 60 秒的问题,导致 5-6k 条记录的任务耗时从 5 小时激增至 96 小时。 -

初始化中的奥秘:Gemma 的 PyTorch 实现 中一段涉及 RMSNorm 的特定代码引发了讨论,重点在于归一化过程中加 1 (+1) 的重要性。

-

EfficientNet 的功效:关于 EfficientNet 优点的辩论展开了,尽管

@fern.bear对其营销与性能的关系提出了批评,但@vapalus辩护了其在分割任务中的应用。 -

Mistral Large 亮相:Mistral Large 正式发布,该模型因其强大的文本生成性能以及在 la Plateforme 和 Azure 上的可用性而受到赞誉。更多详情请查看 Mistral Large。

-

DPO 论文与 SFT:

@staticpunch寻求关于 DPO 中model_ref初始化的澄清,并确认如 DPO 论文中所述,在进行 DPO 之前应先对首选补全进行 Supervised Fine-Tuning (SFT)。 -

深入探究 GRUs:

@mrgonao对为什么像 GRUs 这样的门控单元被如此命名表示好奇,但频道内关于其词源的解释仍然难以捉摸。 -

寻找更智能的搜索:”Searchformer” 论文 [Beyond A: Better Planning with Transformers via Search Dynamics Bootstrapping](https://arxiv.org/abs/2402.14083) 描述了基于 Transformer 的模型在解决谜题方面如何超越传统的 A 方法,为搜索问题提供了一种创新方法。

-

RLHF 与简单性之争:一篇提倡在 RLHF 中使用更简单的 REINFORCE 风格优化而非 Proximal Policy Optimization (PPO) 的论文,引发了关于语言模型 RL 基础方法效率的讨论。论文可在此处 访问。

-

水印框架对决:分享了针对 Large Language Models 的文本水印技术概况,包括在生成的文本中嵌入可检测信号的技术,以及对这些水印鲁棒性的分析。

-

GPT-NeoX 与 Python 的故事:在对升级到 Python 3.10 犹豫不决之际,开发讨论转向了相比 GPT-NeoX 更倾向于使用 custom training loop,展示了对 AI 开发优化细节的积极参与。

-

Tokenization 中的多语言问题:关于优化 Mistral tokenizer 以获得更好多语言表现的咨询,强调了在提升语言模型除英语以外能力方面的持续努力,表明了对全球适用性的关注。

LlamaIndex Discord 摘要

-

Create-llama 简化全栈开发:最新的 create-llama 版本集成了 LlamaPack,通过包含高级 RAG 概念,以最少的代码简化了全栈 Web 应用的构建。该公告由 @llama_index 的推文发布。

-

Counselor Copilot 利用高级 RAG:在推文中强调的 Counselor Copilot 项目,其独特之处在于利用高级 RAG 来协助危机辅导员,展示了作为 Copilot 而非基础聊天机器人的用例。

-

通过摘要增强 RAG 检索:为了改进 RAG 检索,一种使用子文档摘要的技术有助于解决由朴素分块(naive chunking)引起的全局概念感知问题。这种方法在一条推文中进行了详细说明,讨论了由此带来的每个分块上下文感知能力的提升。

-

LlamaParse 精通复杂 PDF 解析:LlamaParse 作为一款强大的工具被推出,用于解析带有复杂表格和图表的 PDF,这对于高质量的 RAG 应用至关重要。正如推文所述,准确的表格表示有助于 LLM 提供正确的答案。

-

AI 在处理卡夫卡主角时的挑战:在关于为卡夫卡的《变形记》生成书评的讨论中,

@daguilaraguilar遇到了 AI 错误地将 “Grete” 视为主角而非 “Mr. Samsa” 的问题,并引用了他们的代码。 -

金融文档分析与上下文管理的见解:SEC Insights 为分析金融文档带来了高级功能,社区内也有人呼吁针对 GPT-4 turbo 和 Gemini 1.5 等大窗口 LLM 的上下文管理最佳实践建立基准测试(benchmarks)。

Latent Space Discord 摘要

Sora 的一致性受到质疑:在对 WSJ 视频 的纠正中,@swyxio 指出 OpenAI 的 Sora 通过从起始图像进行插值,在超过 1 分钟的视频中保持一致性。

NVIDIA 的 GEAR 部门整装待发:NVIDIA 宣布成立一个新的研究小组 GEAR (Generalist Embodied Agent Research),由 Jim Fan 博士共同创立,专注于自主机器和通用 AI。

AI 生成的播客上线:Perplexity 推出了一个 AI 生成的播客,内容源自其 Discover 提要,并使用 ElevenLabs 的语音进行旁白。

使用 Cloudflare 只需一行 AI 代码:Cloudflare 推出了新的 AI Gateway,其特点是通过单行代码即可轻松集成 AI 分析和见解。

AI 通过 GPT-4-ada-v2 进行数据分析:一款新工具 ChatGPT Data Analysis V2 增强了数据分析功能,提供针对性回复和数据网格覆盖编辑器,可能实现了交互式图表并利用了 gpt-4-ada-v2。

LLM Paper Club T5 环节回顾:最近由 @bryanblackbee 主持的 LLM Paper Club 环节剖析了 T5 论文,讨论内容总结在共享的 Notion 笔记中。开放性问题包括模型词汇表、微调过程以及 NLP 任务的架构差异。

本地模型爱好者齐聚 AI in Action 俱乐部:“AI in Action”活动重点讨论了本地模型探索、本地 AI 模型的工具讨论,以及参考使用 LoRA 部署 ComfyUI 等工具进行模型微调。Latent Space Final Frontiers 活动已宣布,邀请团队通过此链接提交申请,共同挑战 AI 的极限。

OpenAccess AI Collective (axolotl) Discord 摘要

-

Gradient Clipping 难题与 DeepSpeed 咨询:讨论了将 Gradient Clipping 设置为 0.3 时出现的问题,怀疑存在临时峰值;同时,一个关于 HuggingFace 的 Trainer 支持 DeepSpeed Stage 3 的 GitHub issue 引发了关于使用和更新的反馈。此外还分享了 Axolotl 的缓存清理技巧,即使用

huggingface-cli delete-cache。 -

Mistral AI 的战略转型?:出现了关于 Microsoft 与 Mistral AI 战略合作伙伴关系的讨论,重点关注其对开源模型和 Mistral AI 商业方向的潜在影响。分享了 Twitter 帖子和新闻文章链接以供深入了解。

-

Axolotl 自动安装带来的便捷性:Axolotl 项目通过引入

auto_install.sh简化了安装过程,显示了对非 Python 开发者支持的承诺。一篇 Twitter 帖子寻求社区对 CUDA 模式系列的支持,并可能获得 Jeremy Howard 的协助。 -

GPU、Docker 与新手问题:关于 GPU 的技术问题非常突出,例如训练时间长和 Loss 过高、Docker 容器复杂化,以及对新手友好的 Axolotl 教程的需求。Hugging Face 报告的 checkpoint 保存错误问题 #29157 和 Axolotl 的 GitHub #1320 是主要的参考资料。

-

社区亮点:韩语扩展与 RAG 功能:宣布了一个没有 model card 的微调 phi-2 模型,推介了具有扩展韩语词汇量的 EEVE-Korean 模型,并介绍了用于 RAG 系统开发的 R2R Framework。社区还获得了配套的 arXiv 技术报告和各种 Hugging Face 模型。

-

Runpod 遭遇 DNS 故障:据报告,runpod 上出现 NameResolutionError,提示在尝试访问 ‘huggingface.co’ 时可能存在涉及代理设置的 DNS 解析问题。

CUDA MODE Discord 摘要

-

CUDA 遭到抨击:计算领域的传奇人物 Jim Keller 在 Tom’s Hardware 的一篇文章 中批评了 NVIDIA 的 CUDA 架构,暗示其缺乏优雅性且拼凑而成。与此同时,能够让 CUDA 代码在 AMD 和 Intel GPU 上运行的 ZLUDA 宣布开源,有望挑战 NVIDIA 在 AI 领域的统治地位 (GitHub 链接)。

-

GPU 装备竞赛:关于 AI GPU 选择的辩论浮出水面,4060 ti 是最便宜的 16GB 消费级 GPU,而 3090 提供 24GB VRAM,是 LLM 任务更强大的替代方案。围绕二手 GPU 购买策略以及出现问题时的潜在技术补救措施的讨论也非常热烈。

-

量化计算对话:关于量化模型如何保持计算精度的讨论变得清晰,重点讨论了通过检测模式并使用

torch.compile实现高效 CUDA kernel。CUDA kernel 的编译速度也是一个话题,有人提出了将编译时间从 30 多秒减少到 2 秒以内的方法 (仓库链接)。 -

Triton 探索:人们对 Triton 产生了浓厚兴趣,它是一个通过 Pallas 支持 Jax 的工具,并将其与 CUDA 在多 GPU/节点执行方面进行了比较。有人呼吁专家解释 Triton 的底层工作原理、其在 LLVM 和 MLIR 上的基础,并为其量化 matmul kernel 创建基准测试。

-

Flash Attention 优化:在 ring attention 的讨论中,

zigzag_ring_flash_attn_varlen_qkvpacked_func的实现显示出速度提升。一份 Hugging Face 文档详细说明了内存效率方面的优势 (Flash Attention 可视化),基准测试显示其比经典的 flash attention 提速 20% (基准测试链接)。 -

CMU 关于高效 LLM 推理服务的论文:分享了一篇来自 CMU 的关于部署生成式 LLM 高效方法的论文,题为 “Towards Efficient Generative Large Language Model Serving: A Survey from Algorithms to Systems” (arXiv 链接),该论文调研了 150 多项技术,包括 非自回归生成 和局部注意力变体。

-

通过 MIT 学习效率:麻省理工学院 (MIT) 的一门关于高效 AI 计算的课程公开,涵盖了模型压缩、剪枝、量化,并提供了 LLaMa 2 等模型的实战经验,还涉及了量子机器学习话题 (课程链接)。

-

CUDA-MODE 讲座公告与学习:发布了关于量化的第 7 讲,标题为 Quantization CUDA vs Triton,强调了以量化为核心的 AI 计算高效技术论述。讲座内容辅以 YouTube 视频和易于获取的幻灯片演示,促进了社区的持续教育 (YouTube 第 6 讲, 第 7 讲)。

-

就业前景与咨询:确认 Nvidia 正在寻找 CUDA 和 C++ 专家,邀请申请人将简历发送至 JobID: JR1968004。关于 Mistral 等公司的招聘状态问题也被提出,凸显了 AI 工程领域的就业热度。

LangChain AI Discord 摘要

-

探索 AI 模型中的 Function Calls:工程师

@saita_ma_正在寻找在 OpenHermes 等本地模型中执行 Function Calls 的方法,灵感来自 CrewAI 的实现。同时,@kenwu_分享了一个 Google Colab,寻求关于使用 Cohere API 和 LangChain 进行 Agent 和 Function Calling 的帮助。 -

LangChain 在各类项目中的集成:

@deadmanabir分享了一个实现了 OpenAI、Qdrant DB 和 LangChain JS/TS SDK 的个性化聊天机器人的创建过程;而@david1542介绍了 Merlinn,这是一个支持值班工程师的机器学习工具。此外,@edartru.提供了 Langchain-rust,这是一个允许 Rust 开发者在编程中使用 LLM 的 crate。 -

教程资源推动 DIY AI 项目:最近的一个 YouTube 教程 向观众展示了如何使用 ChainLit、LangChain、Ollama 和 Gemma 创建类似 ChatGPT 的 UI。

@rito3281撰写了关于在保险行业使用 LLM 进行财务分析的文章,@tarikkaoutar发布了一个关于创建涉及 LangGraph 的 Multi-Agent 应用程序的 视频。 -

LLM 中的讽刺检测与超时延长:有建议在微调后为短语标记“sarcasm”(讽刺),以便 LLM 更好地检测,但未提供关于机制的进一步讨论。有人提出了关于延长默认 900 秒超时时间的问题,但尚未发现后续的解决方案或详细说明。

-

开发者探索的新兴工具与用例:

@solo78邀请就保险部门财务职能中的 AI 实现进行协作讨论。@eyeamansh介绍了一个 AI 驱动的 简历优化器,该工具曾帮助在科技公司获得面试机会。

Datasette - LLM (@SimonW) Discord 摘要

-

ChatGPT 多语言错误:用户注意到 chatgpt-3.5-turbo 有时会误译文档标题,例如将 “Taking Advantage of the Internet” 翻译为 “Sacándole Provecho a Internet“。建议的解决方法是使用指定 “Always use English” 的 System Prompt,以防止此类语言检测错误。

-

Prompt Crafting 的怀旧与修复:

@tariqali讨论了在面对聊天机器人“超时”问题时,传统 Prompt Crafting 对更好控制模型带来的好处。同时,@derekpwillis和@simonw交流了 devcontainer 配置,@simonw建议在setup.sh脚本中添加llm models,@derekpwillis实施后解决了某些 Bug。 -

在 LLM 上运行 LargeWorldModel 的愿景:正如

@simonw所讨论的,人们对在 LLM 上运行 LargeWorldModel 感兴趣,可能会利用 GPU 实例来运行 PyTorch 模型。他提到了这些模型在 Hugging Face 仓库 中的可用性。 -

Groq 推理插件亮相:

@angerman.发布了一个 Groq 推理插件 llm-groq,社区对其性能表现表示支持和好奇。 -

llm-groq 插件上线 PyPI:听取

@0xgrrr的建议后,@angerman.将他的 llm-groq 插件 发布到了 PyPI,从而可以通过llm install更轻松地安装。他分享了自己的发布经验,并对比了 Haskell 和 Python 社区的实践。

LLM Perf Enthusiasts AI Discord 摘要

-

关于 AI 幻觉(Hallucination)足迹的大胆主张:Richard Socher 的推文暗示了解决 AI 幻觉的可能方案,引发了围绕 Embedding 模型和验证机制以提高 AI 事实准确性的讨论。

-

推出新版维基百科: Globe Explorer 是一款利用 GPT-4 生成可定制维基百科风格页面的工具,目前已经发布并走红,正致力于冲上 Product Hunt 榜单,更多详情见 Product Hunt 页面。

-

FireFunction V1 引发关注:

@lqiao发布的 FireFunction V1 承诺提供 GPT-4 级别的输出,并具有更快、更有效的 Function Calling 能力。随之发布的还有 JSON 等实用的结构化输出模式,在 Function Calling 方法中备受关注,详见 FireFunction 博客文章。 -

gpt-4-turbo 的微调探索:关于使用 gpt-4-turbo 进行 1-shot 学习以改进数据提取和分类任务的 Embedding 技术咨询,引发了对有效 Fine-Tuning 实践的兴趣。

-

Anki 的 AI 抽认卡革命尚在进行中:集成 GPT-4 生成 Anki 抽认卡的尝试显示了成功与局限并存,例如输出过于冗长以及视觉内容集成方面的挑战,详见 Niccolò Zanichelli 的分析推文。

-

窥探 Feather 的用途:Feather OpenAI 的图标暗示其为一个写作工具,结合历史快照及其在 SME 数据标注和代码注释招聘中的重要性,引起了广泛关注。此外,还有像 “gpt-4-ada-v2” 这样增强数据分析能力的进展,详见 Semafor 的文章和 Tibor Blaho 的推文。

DiscoResearch Discord 摘要

-

Hugging Face Trainer 中的 Callbacks 特性:Sebastian Bodza 讨论了在 Hugging Face trainer 中使用自定义 Callbacks,并强调虽然目前仅限 PyTorch,但它们通过

TrainerControl接口提供“只读”控制。 -

德国情商基准测试出现:得益于 Calytrix 的更新, EQ-Bench 现在支持德语,

gpt-4-1106-preview在德语 EQ-Bench 初步评分中名列前茅,详情见 EQ-Bench GitHub 仓库。然而,有人对翻译后的 Benchmark 有效性表示担忧,认为可能会丢失情感理解的细微差别,并因以英语为中心的推理模式而导致结果偏差。 -

对基于概率的 LLM 评估的疑虑:Bjoernp 推荐了一篇 arXiv 论文,揭示了基于概率的评估方法在 LLM 中的固有局限性,特别是在多选题及其与基于生成的预测的一致性方面。

-

引入分层 Sentence Transformers:Johann Hartmann 通过 Hugging Face 博客文章 揭晓了 Matryoshka Embeddings,详细介绍了其相比普通 Embeddings 的优势,并确认其已集成到 Sentence Transformers 库中,增强了用户的工具包。

-

明确德语数据集的 RAG 方法:Johann Hartmann 和 Philip May 讨论了德语检索上下文理解数据集的评估方法,May 澄清说,评估 LLM 是否能识别多个检索上下文中的相关信息至关重要。该数据集尚在开发中,目前尚未公开。

AI Engineer Foundation Discord 总结

-

黑客松组队升温:

@reydelplatanos和@hiro.saxophone为即将到来的黑客松组队,@hiro.saxophone带来了 ML 工程方面的经验,特别是多模态 RAG。同时,@ryznerf.也表达了加入黑客松队伍的兴趣,强调了参与的热情。 -

跨学科协作:后端开发人员

@reydelplatanos与 ML 工程师@hiro.saxophone在黑客松中合作,代表了他们新团队中后端与机器学习技能的融合。 -

黑客松报名热潮:

@silverpiranha和@jamthewallfacer讨论了活动的报名情况,@silverpiranha最终确认报名成功并建议潜在的组队。 -

代码管理无人机:

@.yosun介绍了一个关于通过函数调用(function calls)控制无人机的黑客松项目想法,参考了 OpenAI Cookbook 中的方法,并分享了一段代码片段作为演示。

Alignment Lab AI Discord 总结

- Gemma-7B 获得对话礼仪:

@imonenext已将特殊 token<start_of_turn>和<end_of_turn>集成到 Gemma-7B 模型中,以促进对话式 AI 中的轮流对话。具有这些增强功能的模型现在可以在 Hugging Face 上进行训练和微调。

Skunkworks AI Discord 总结

- 随机精度的种子见解:

@stereoplegic强调了一篇关于深度学习中随机种子(random seeds)重要性的文章,特别是对于 Python 的 PyTorch 用户。文章 Random Numbers in Deep Learning; Python & the PyTorch Library 被赞誉为对于那些热衷于探索或微调模型训练中随机性底层机制的人来说是“非常值得一读”的。

第二部分:分频道详细总结与链接

TheBloke ▷ #general (1013 条消息🔥🔥🔥):

- Mistral Large 性能不值其价?:

@timotheeee1认为 Mistral Large 的成本与 GPT-4 Turbo 相似,但考虑到其在 MMLU 等基准测试中略逊一筹的表现,这一成本并不合理。其性价比受到质疑。 - Megatokens 首次亮相:

@itsme9316在讨论 token 成本时幽默地创造了 “megatoken” 一词,引发了包括@technotech在内的几位用户的一系列轻松回应,如 “lol”。 - 模型大辩论:关于 LLMs 是否能真正“推理”展开了一场漫长的辩论。

@kalomaze和@kaltcit就语言模型执行推理的能力,或者它们表现出的能力是否只能被称为准推理(quasi-reasoning)交换了意见。 - Mistral 开源希望破灭?:围绕 Mistral 致力于开源其大型模型的对话表现出挫败感,像

_dampf这样的用户对这一变化表示哀叹,并对这一消息表示并不感到意外。 - 遇到技术困难:

@kaltcit等用户报告了 academiccat dpo 等模型的问题,在测量过程中遇到了错误和段错误(segfaults),暗示了一些 AI 模型的不稳定性或不可预测性。

提及的链接:

- Cody - Sourcegraph: 未找到描述

- No GIF - No Nope Cat - Discover & Share GIFs: 点击查看 GIF

- Supermaven: 未找到描述

- Cat Cat Jumping GIF - Cat Cat Jumping Cat Excited - Discover & Share GIFs: 点击查看 GIF

- Mark Zuckerberg Last Breath Sans GIF - Mark Zuckerberg Last Breath Sans Last Breath - Discover & Share GIFs: 点击查看 GIF

- Neural Text Generation With Unlikelihood Training: 神经文本生成是自然语言应用中的关键工具,但众所周知,其核心存在重大问题。特别是,标准的似然训练和解码会导致…

- OpenCodeInterpreter: 未找到描述

- mobiuslabsgmbh/aanaphi2-v0.1 · Hugging Face: 未找到描述

- LongRoPE: 点赞 👍。评论 💬。订阅 🟥。🏘 Discord: https://discord.gg/pPAFwndTJdhttps://github.com/hu-po/docs/blob/main/2024.02.25.longrope/main.mdhttps://arxiv.o…

- Cat Kitten GIF - Cat Kitten Speech Bubble - Discover & Share GIFs: 点击查看 GIF

- Vampire Cat Cat Eating Box GIF - Vampire Cat Cat Eating Box Cat Box - Discover & Share GIFs: 点击查看 GIF

- Welcome Gemma - Google’s new open LLM: 未找到描述

- 2021 Texas power crisis - Wikipedia: 未找到描述

-

[MaxRiven - Turn It Up Official Music Video AI](https://youtu.be/OLEzmClaRnw?list=RDMMOLEzmClaRnw&t=16): 感谢观看!请观看高清版本并尽情享受!如果你喜欢这个视频,请分享给你的朋友!►流媒体播放与下载:https://fanlink.to/MXRVNturnitupThan… - GitHub - Dicklesworthstone/the_lighthill_debate_on_ai: A Full Transcript of the Lighthill Debate on AI from 1973, with Introductory Remarks: 1973 年关于 AI 的 Lighthill 辩论的完整转录,附带介绍性备注 - Dicklesworthstone/the_lighthill_debate_on_ai

- Uglyspeckles - Carrot Cake Soul Shuffling Incident SFX: 出自《海市蜃楼之馆》(The House in Fata Morgana)粉丝碟:Carrot Cake Jinkaku Shuffle Jiken。此原声带归 Novectacle (Vegetacle) 所有。

- GitHub - Azure/PyRIT: The Python Risk Identification Tool for generative AI (PyRIT) is an open access automation framework to empower security professionals and machine learning engineers to proactively find risks in their generative AI systems.: 生成式 AI 的 Python 风险识别工具 (PyRIT) 是一个开放访问的自动化框架,旨在赋能安全专业人员和机器学习工程师,主动发现其生成式 AI 系统中的风险。

-

[Announcing Microsoft’s open automation framework to red team generative AI Systems Microsoft Security Blog](https://www.microsoft.com/en-us/security/blog/2024/02/22/announcing-microsofts-open-automation-framework-to-red-team-generative-ai-systems/): 阅读关于 Microsoft 新的开放自动化框架 PyRIT 的信息,该框架旨在赋能安全专业人员和机器学习工程师,主动发现其生成式 AI 系统中的风险。 - The Strange Evolution of Artificial Intelligence: 未来思想中心(Center for the Future Mind)呈现 Scott Aaronson 在 Mindfest 2024 上的演讲。完整剧集将于明天(2 月 27 日星期二)美国东部时间中午 12 点上线。注:…

- no title found: 未找到描述

TheBloke ▷ #characters-roleplay-stories (275 messages🔥🔥):

- 在 AI 中实现欺骗:

@superking__等人讨论了编写一个能令人信服地撒谎的角色的挑战,因为像 Mixtral 这样的大型模型在设定了诸如“不惜一切代价生存”等明确目标时表现更好。 - 变形机器人的故事:尽管

@superking__努力为一个隐藏身份的机器人创建角色卡,但 AI 还是暴露了身份,直到被赋予“不惜一切代价生存”的目标,这使得其隐秘行为有所改善。 - Opus V1 模型与技术挑战:

@dreamgen和@kquant等参与者探讨了围绕 DreamGen Opus V1 的问题、tokenizer 问题以及为了获得更好性能的最佳模型设置。 - 模型冗长与循环问题:包括

@superking__和@dreamgen在内的几位用户讨论了 AI 编写不必要的长句子或进入循环模式的情况,并分享了经验和潜在的修复方法。 - 角色扮演讨论:

@keyboardking成功创建了一个管理性别伪装叙事的角色卡,展示了当前 AI 在处理细微角色扮演场景方面的能力。

提到的链接:

- Kquant03/NurseButtercup-4x7B-bf16 · Hugging Face:未找到描述

- maeeeeee/maid-yuzu-v8-alter-3.7bpw-exl2 · Hugging Face:未找到描述

- Chub:查找、分享、修改、转换以及对对话式大语言模型 (LLM) 的角色和其他数据进行版本控制。曾用名/别名 Character Hub, CharacterHub, CharHub, CharaHub, Char Hub。

- dreamgen/opus-v1-34b-awq · Hugging Face:未找到描述

- Angry Bender Mad GIF - Angry Bender Mad Angry - Discover & Share GIFs:点击查看 GIF

- #0SeptimusFebruary 24, 2024 3:31 PMWhat tale do you wish to hear?# - Pastebin.com:Pastebin.com 是自 2002 年以来排名第一的文本存储工具。Pastebin 是一个可以在线存储文本并设置存储期限的网站。

TheBloke ▷ #training-and-fine-tuning (71 messages🔥🔥):

- 寻求 DPO 实现建议:

@cogbuji正在寻找 DPO (Decision Transformer) 的实际实现,并考虑参考trlGitHub 库中的DPOTrainer。@dirtytigerx等多位成员参与了讨论,提供了见解和资源。 - 微调与训练的抉择:

@cognitivetech对全量 LLM 微调的效率和潜在的信息丢失表示担忧。该用户考虑使用gguf进行微调,并探索利用官方 QA-Lora 实现进行指令微调 (instruct fine-tuning)。 - 处理 DeepSpeed OOM 问题:尽管计算显示资源充足,

@plasmator在设置 DeepSpeed Zero 时仍因显存溢出 (OOM) 错误而苦苦挣扎。 - 故事叙述 LLM 与漫画训练集:

@hellblazer.666询问如何训练较小的模型进行故事创作,特别是使用漫画文本作为数据集。他们还分享了 Augmentoolkit 仓库,作为将数据转换为适合训练格式的潜在工具。 - 训练方法与模型选择:在一次深入讨论中,

@dirtytigerx和@hellblazer.666讨论了各种 LLM 训练方法,包括全量微调、LoRA 等 PEFT 技术,以及检索增强生成 (RAG) 的使用。他们得出结论,对于@hellblazer.666的项目,从一个针对故事叙述微调过的基础模型开始可能是最好的方法。

提到的链接:

- GitHub - e-p-armstrong/augmentoolkit: Convert Compute And Books Into Instruct-Tuning Datasets:将计算和书籍转换为指令微调数据集 - e-p-armstrong/augmentoolkit

- trl/trl/trainer/dpo_trainer.py at main · huggingface/trl:使用强化学习训练 Transformer 语言模型。- huggingface/trl

TheBloke ▷ #model-merging (37 messages🔥):

- 新型模型合并的挑战:用户

@jsarnecki询问了关于使用 mergekit 合并 llama-2-13b 和 Mistral-7b 等非同质模型的问题,@maldevide确认这是不可能实现的。讨论随后转向探索可能帮助@jsarnecki实现目标的合并技术。 - 针对用例进行优化:

@maldevide提示@jsarnecki考虑他们是在进行能力探索实验,还是针对特定的用例,并进一步提供了关于 Hugging Face 模型成功合并的见解。 - 同质模型合并技术:

@alphaatlas1提到 git-rebasin 是合并具有相同大小/布局的模型的一个潜在选项,并讨论了诸如缺乏合并不同基础模型的有效技术等局限性。 - 讨论高级合并策略:对话转向各种合并策略,包括

@maldevide分享的线性插值 (linear interpolation)、加法合并 (additive merging) 和随机采样 (stochastic sampling)。讨论强调了模型合并技术的复杂性及其对不同模型类型的适用性。 - DARE Ties 合并见解:

@alphaatlas1指出 Diffusion models 在进行 DARE ties 合并时面临挑战,并引用了一篇特定的 Hugging Face 博客文章。然而,@maldevide分享了一个成功的经验,并指向了 GitHub 上的另一个实现。

提到的链接:

- 🤗 PEFT welcomes new merging methods:未找到描述

-

[Daring Hydra - v1.2 Stable Diffusion Checkpoint Civitai](https://civitai.com/models/246219/daring-hydra):Daring Hydra 是一项创建逼真写实模型的尝试。v1.2 实际上是四次改进 v1.1 尝试的结果,而 v1.1 之前是… - GitHub - 54rt1n/ComfyUI-DareMerge: ComfyUI powertools for SD1.5 and SDXL model merging:用于 SD1.5 和 SDXL 模型合并的 ComfyUI 强力工具 - 54rt1n/ComfyUI-DareMerge

- GitHub - s1dlx/meh: Merging Execution Helper:Merging Execution Helper。通过在 GitHub 上创建账户为 s1dlx/meh 的开发做出贡献。

TheBloke ▷ #coding (6 messages):

- DotPeek 范围澄清:

@al_lansley询问了 DotPeek 支持的语言,@spottyluck确认其仅限于 C#。 - 怀念 OllyDbg 的功能:

@spottyluck感叹 OllyDbg 缺乏真正的继任者,特别是其 “animate into” 功能,并指出其在 64bit 上的局限性使其几乎过时。 - 对 AI 辅助反编译的迫切期待:

@mrjackspade对 AI 辅助反编译 简化逆向工程过程的潜力表示兴奋。 - 对重构代码的挫败感:

@mrjackspade分享了手动重构混淆后的反编译代码的挫败感,暗示了这一过程的乏味性。 - AI 训练数据集的构想:

@mrjackspade建议通过使用大量开源项目及其输出来创建用于 AI 反编译的训练数据集。

Mistral ▷ #general (1198 messages🔥🔥🔥):

- Mistral Large 与 Next 的性能对比: 用户如 `@yasserrmd` 和 `@chrunt` 对比了 Mistral Large 和 Next 的能力。Large 在某些基准测试中似乎优于 Next,而 Next 因其简洁的回复而受到青睐。

- AI 的硬件需求: 由 `@mrdragonfox` 和 `@tu4m01l` 发起的讨论强调了在 CPU 上运行像 Mistral Large 这样的大型 AI 模型是不切实际的,并建议使用 API 以提高效率。

- 企业合作伙伴关系与开放模型: 用户如 `@reguile` 对 Mistral 与 Microsoft 合作后开放模型的未来表示担忧。一些人(如 `@foxlays`)希望 Mistral 继续支持开放模型的开发。

- 关于 GPT-3.5 Turbo 参数的推测: 一篇被涂改的 Microsoft 论文引发了关于 GPT-3.5 Turbo 实际参数规模的辩论,`@i_am_dom` 和 `@lyrcaxis` 讨论了其有效性和效率。

- Mistral 的市场定位与策略: `@blacksummer99` 分享了关于 Mistral 努力与 OpenAI 形成差异化竞争的见解,以及将其定位为 AI 领域欧洲领导者的构想。

提到的链接:

-

[Pricing and rate limits Mistral AI Large Language Models](https://docs.mistral.ai/platform/pricing/): 按需付费 -

[GOODY-2 The world's most responsible AI model](https://www.goody2.ai/): 介绍一款具有下一代伦理对齐的新型 AI 模型。立即聊天。 -

[Endpoints and benchmarks Mistral AI Large Language Models](https://docs.mistral.ai/platform/endpoints/): 我们提供五个不同的 API 端点,以不同的性价比权衡来提供我们的生成模型,并为一个嵌入模型提供一个嵌入端点。 - Au Large: Mistral Large 是我们的旗舰模型,具有顶级的推理能力。它也可以在 Azure 上使用。

- AI Playground: Run your prompts across mutiple models and scenarios: 在不同的 Prompt 和模型参数下比较和评估多个 AI 模型的生成效果。

- Cat Bruh GIF - Cat Bruh Annoyed - Discover & Share GIFs: 点击查看 GIF

- CRYNYL: Fall Out Boy 的新专辑,充满了乐队真实的泪水,以实现最大的情感忠实度。

- Assisting in Writing Wikipedia-like Articles From Scratch with Large Language Models: 我们研究如何应用 Large Language Models 从头开始撰写有据可查且条理清晰的长篇文章,其广度和深度可与维基百科页面相媲美。这个尚未被充分探索的问题提出了新的…

- Legal terms and conditions: 使用 Mistral 产品和服务的条款和条件。

- Typing With Feet GIF - Typing With Feet - Discover & Share GIFs: 点击查看 GIF

- WWW.SB: 未找到描述

- Council Post: Is Bigger Better? Why The ChatGPT Vs. GPT-3 Vs. GPT-4 ‘Battle’ Is Just A Family Chat: 好了,现在我们明白 ChatGPT 只是 GPT-3 的一个更小、更具体的版本,但这是否意味着在不久的将来会出现更多这样的模型:针对 Mark 的 MarGPT…

- 无标题: 未找到描述

- 无标题: 未找到描述

- 无标题: 未找到描述

Mistral ▷ #models (209 条消息🔥🔥):

-

服务器构建的 GPU 要点:

@lukun询问了哪些模型可以在没有 GPU 的服务器上运行,@tom_lrd和@_._pandora_._解释说,即使是较小的模型,为了获得合理的性能,GPU 也是必要的。对于较大的模型,@mrdragonfox建议至少配备 24 GB VRAM 的 GPU,例如 3090/4090。他们还提供了一个 GitHub 上的详细测试 gist 以展示不同条件下的性能。 -

扩展规模的成本:用户

@dekaspace、@mrdragonfox等人讨论了运行语言模型服务器的构建规格。@mrdragonfox建议将 24 GB VRAM 作为基准,并指出超过 70B 参数的模型将需要对专用硬件进行大量投资,并提到 Groq 的定制 ASIC 部署是一种昂贵的方法。 -

关于 Mistral 发展方向的疑问:包括

@redbrain和@blacksummer99在内的几位用户对 Mistral 似乎转向业务导向的新方向表示担忧,推出了像 Mistral Small 和 Mistral Large 这样的闭源权重模型,这与其之前开源模型的声誉有所背离。社区推测了即将发布的版本以及未来推出开源权重模型的可能性。 -

Mistral 模型的基准测试:

@bofenghuang在法语版的 MT-Bench 上对 Mistral 的模型进行了测试,发布的结果显示 Mistral Large 位于 GPT-4 之后的一个显著位置。他们在 Hugging Face Datasets 和一个基于浏览器的 Space 上分享了他们的发现,以便进一步检查。 -

对新模型开放获取的希望:

@saintvaseline、@_._pandora_._等人分享的社区情绪反映了对未来开源模型的希望与由于 Microsoft 等大型科技公司参与而产生的怀疑交织在一起。包括@tom_lrd、@m._.m._.m和@charlescearl_45005在内的一些成员预计 Mistral 最终会提供一些质量稍低的开源模型,同时推测商业合作伙伴关系的潜在影响。

提到的链接:

- GroqChat: 未找到描述

- Au Large: Mistral Large 是我们的旗舰模型,具有顶级的推理能力。它也可以在 Azure 上使用。

- Always Has Been Among Us GIF - Always Has Been Among Us Astronaut - Discover & Share GIFs: 点击查看 GIF

- TheBloke/Mistral-7B-Instruct-v0.1-GGUF · Hugging Face: 未找到描述

- bofenghuang/mt-bench-french · Datasets at Hugging Face: 未找到描述

- Mt Bench French Browser - a Hugging Face Space by bofenghuang: 未找到描述

- Northern Monk Beer GIF - Northern Monk Beer Craft Beer - Discover & Share GIFs: 点击查看 GIF

- 100k test . exllama2(testbranch) + fa 1 - 100k in 128t steps: 100k test . exllama2(testbranch) + fa 1 - 100k in 128t steps - gist:71658f280ea0fc0ad4b97d2a616f4ce8

- [Feature Request] Dynamic temperature sampling for better coherence / creativity · Issue #3483 · ggerganov/llama.cpp: 先决条件 [✅] 我查阅了讨论区,并有一个新的 Bug 或有用的增强功能要分享。功能构想:大型语言模型的典型采样方法,如 Top P 和 Top K(以及…

Mistral ▷ #deployment (56 条消息🔥🔥):

- 支持请求未获回复:

@fangh指出他们上周发送了邮件但尚未收到回复,正在寻求@266127174426165249的更新。 - 在本地机器运行 Mixtral 的咨询:

@c_ffeestain询问是否可以在拥有 32GB RAM 和 8GB VRAM 的本地机器上运行 Mixtral 8x7B,目前正在使用 HuggingFace 上的版本。 - GPU 兼容性与配置建议:

@_._pandora_._解释说,理论上 Mixtral 可以在@c_ffeestain的机器上运行,但速度会极慢。他们还提议帮助确定分配给 GPU 的层数(layers)以提高性能。 - 探索模型量化(Quants)与层共享:

@c_ffeestain在下载模型后注意到生成一个 token 大约需要 5-10 秒。他们正在尝试调整分配给 GPU 的层数,但在检测其 AMD GPU 时遇到了问题。 - 在 Tesla V100 上进行推理与微调:

@dazzling_maypole_30144在尝试于 Tesla V100 上部署 Mistral-7B-Instruct 时遇到了显存溢出(out-of-memory)错误。@mrdragonfox和@casper_ai建议 V100 可能没有足够的显存来处理此任务,并推荐了 T4 或 A10 GPU 等替代方案,或者以 AWQ 格式运行模型以获得更好的兼容性。

提到的链接:

- HuggingChat:让每个人都能使用社区最好的 AI 聊天模型。

- TheBloke/Mixtral-8x7B-Instruct-v0.1-GGUF · Hugging Face:未找到描述

Mistral ▷ #ref-implem (6 条消息):

- 关于 Mistral 数据归一化的咨询:来自巴塞罗那超算中心的用户

@severinodadalt询问 Mistral 数据是否经过了归一化(normalized) 以及其实现方法。该用户提到缺乏相关信息,并认为可能没有应用任何归一化。 - 无基础模型归一化详情:针对

@severinodadalt关于数据归一化的询问,@mrdragonfox指出 没有任何基础模型(base model) 会提供此类信息。 - 不同精度水平下的性能差异:

@bdambrosio询问在本地以全 fp16 运行 Mistral 8x7B 与目前的 8 bit exl2 相比,推理速度是否会有变化,特别是在有更多 VRAM 可用的情况下。提出此问题是因为注意到了 6.5 bit 和 8 bit 精度水平之间的差异。 - 精度水平影响性能:作为回应,

@mrdragonfox确认差异是显而易见的,并且 像 turboderp 这样的性能测量工具通常评估困惑度(perplexity/ppl),这表明精度水平确实会影响性能。 - 量化与上下文准确度:

@mrdragonfox还指出,在使用 Mistral 等模型执行任务时,量化(quantization)可能会略微降低上下文准确度。

Mistral ▷ #finetuning (185 条消息🔥🔥):

-

微调数据量与预期:

@pteromaple询问了微调所需的数据量,质疑 4000 个实例是否足够。虽然@egalitaristen建议这取决于微调的具体程度,并强调对于特定任务,这可能已经足够,但讨论得出的结论是,试错(trial and error)可能是最好的方法。 -

微调的数据格式困境:

@pteromaple寻求关于使用 Unsloth 微调 ‘Mistral-7B-Instruct-v0.2’ 的正确数据格式建议,并询问了数据格式对训练结果的影响,透露他们目前使用的是 Alpaca 格式。@_._pandora_._建议创建自定义 Prompt 格式,并警告在用非英语语言微调 Mistral 7B Instruct 时可能出现的问题。 -

微调后 Mistral 的神秘输出:

@mr_seeker报告了一个奇怪的问题:微调后的模型在输入非数据集类数据时会输出/******/并失去连贯性。@mrdragonfox等人的建议指向了模型的路由层(routing layer),并指出成功的微调可能需要理解模型架构的复杂性,而不仅仅是应用 LoRA 等技术。 -

Serverless 微调与模型托管讨论:

@stefatorus询问了 Mistral 在云端提供 Serverless 微调功能的可能性,并讨论了 Hugging Face 和 OpenAI 等公司的相关产品。RunPod 也被提为一个潜在的高性价比解决方案,但对于预算有限的用户来说,其可行性仍是一个担忧。 -

LoRA 参数难题:

@tom891在为他们的 200k 样本数据集确定 Mistral 7B 微调的合适 LoRA 参数时面临挑战。尽管@mrdragonfox等人强调了理解底层理论的必要性,并敦促进行独立探索而非索要现成答案,该用户仍继续寻求有效参数配置的直接建议。

提到的链接:

Serverless GPUs for AI Inference and Training: 未找到描述

Mistral ▷ #announcements (2 条消息):

-

遇见 Mistral Large:

@sophiamyang宣布推出 Mistral Large,这是一款全新的优化模型,具有顶级的推理能力、多语言能力、原生 Function Calling 以及 32k 的参数规模。它在 MMLU 上拥有 81.2% 的准确率,位列世界第二,可通过 la Plateforme 和 Azure 获取。 -

La Plateforme 首推 le Chat Mistral:

@sophiamyang介绍了 le Chat Mistral,这是一个展示 Mistral 模型能力的前端演示。在 Chat Mistral 发现它的潜力。

提到的链接:

Mistral ▷ #showcase (24 条消息🔥):

- 加入 @jay9265 的现场编程直播:@jay9265 正在 Twitch 进行直播,邀请所有感兴趣的人加入。

- LLM 用于辅助问题表述:@egalitaristen 建议可以利用 LLM 来帮助表述问题或任务,提醒 @jay9265 向 LLM 解释问题也是一种寻求帮助的方式。

- 针对结构化代码降低 Temperature:对于涉及 JSON 等结构化代码的任务,@egalitaristen 建议 @jay9265 将 Generation Temperature 降低到

0.3左右,以减少“创造性”并提高准确性。 - @yasserrmd 开发的 WhatsApp Chrome 插件:@yasserrmd 开发了一个 Chrome 插件,使用 Mistral API 生成 WhatsApp 格式的文本,更多详情可在 LinkedIn 查看。

- AI 推理基准测试分析:@yasserrmd 分享了在 Groq 等平台上使用 Mistral、OpenAI ChatGPT-4 和 Google Gemini 进行 AI 推理性能基准测试的见解,并提供了一篇 LinkedIn 帖子 以获取更多信息。

提到的链接:

Twitch: 未找到描述

Mistral ▷ #random (17 条消息🔥):

- Chatbot 领域的定价困境:

@sublimatorniq提出了关于 Perplexity 的话题,可能涉及 Chatbot 服务的定价或复杂性。@mrdragonfox认为提供最低价格的竞争无法无限期持续,企业的单位经济效益(unit economics)必须合理。 - Groq 的竞争性定价承诺:

@shivakiran_强调了 Groq 承诺的 $0.27/百万(tokens),这可能指处理一定数量 Chatbot 交互的成本。 - 低价可持续性受到质疑:

@mrdragonfox指出,为了竞争而维持低价并非财务上健全的策略,因为这并不等同于盈利,尤其是当新玩家愿意承担更多成本时。 - 对科技行业初始定价策略的批评:

@egalitaristen对那些以低初始定价开始、随后推出高出数倍的“真实”定价的公司表示担忧,警告这可能会驱使大多数用户群寻找替代方案。 - Discord 上宣布开心果日:

@privetin分享了开心果日 (Pistachio Day) 的庆祝活动,并附带了 nutsforlife.com.au 的链接 以及关于开心果益处的趣味事实,包括其蛋白质含量和诱导睡眠的褪黑素。

提到的链接:

- Laughing GIF - Laughing - Discover & Share GIFs:点击查看 GIF

-

[Pistachio Day - Nuts for Life Australian Nuts for Nutrition & Health](https://www.nutsforlife.com.au/pistachio-day/):开心果日快乐!每年的 2 月 26 日是属于这种小坚果的日子,它在口感和营养方面都表现出色!

Mistral ▷ #la-plateforme (66 条消息🔥🔥):

-

寻求隐私和托管方面的澄清:用户

@exa634询问通过 Mistral API 传输的数据是否用于模型训练,以及托管的地理位置。@akshay_1和@ethux确认数据不用于训练,且服务器位于瑞典,正如 Mistral 的 隐私政策 中所述。 -

Mistral7x8b 冻结问题:用户

@m.kas报告了一个 Bug,即 Mistral7x8b 在尝试生成 2024 年的内容时会发生冻结。用户@1015814建议检查是否误设了 end token,但@m.kas澄清并未设置此类 token。 -

对 Mistral 平台 Function Calling 的期待:用户

@nioned和@mrdragonfox讨论了平台上的 Function Calling 话题,暗示第三方提供商可能会提供解决方案,并对 Mistral 适时实现该功能表示乐观。 -

解决 API Key 激活延迟问题:用户

@argumentativealgorithm在添加账单信息后遇到了 API Key 激活延迟。@lerela确认在 Key 生效前通常有一段简短的等待期,这解决了用户的问题。 -

语音转语音 (Speech to Speech) 应用查询:用户

@daveo1711询问关于使用 Mistral Large 开发语音转语音应用的问题,@akshay_1回复称 Mistral 仅支持文本,并建议查看其他模型以实现所需功能。

提到的链接:

- 法律条款和条件:使用 Mistral 产品和服务的条款与条件。

- client-python/examples/function_calling.py at main · mistralai/client-python:Mistral AI 平台的 Python 客户端库。通过在 GitHub 上创建账户为 mistralai/client-python 的开发做出贡献。

- Client does not return a response · Issue #50 · mistralai/client-js:你好,运行最新版本的 SDK 0.1.3,但当我尝试初始化并调用客户端时,它没有任何返回。这是我的代码:const mistral = new MistralClient(env.PUBLIC_MISTRAL…

- GitHub - Gage-Technologies/mistral-go at v1.0.0:Golang 编写的 Mistral API 客户端。通过在 GitHub 上创建账户为 Gage-Technologies/mistral-go 的开发做出贡献。

Mistral ▷ #le-chat (69 条消息🔥🔥):

-

Mistral Chat 的人气问题:用户

@lerela、@mr_electro84等人指出,Le Chat 可能是由于高流量和高人气而遇到困难。@mr_electro84报告了平台故障,包括 API console。 -

关于 Mistral Chat 定价的困惑:

@_._pandora_._和@wath5讨论了 Le Chat 是否免费,一些用户认为他们正在使用付费额度,而包括@margaret_52502在内的其他用户则表示它是免费的。 -

对 Mistral 潜力的热情和建议:用户

@aircactus500为 Mistral 提出了各种增强建议,从具有社交网络元素的移动端 App 到搜索引擎,甚至是 3D 虚拟助手。他们提到了为le Chat设置语言级别的想法,这引起了社区的兴趣。 -

关于 Mistral-Next 的对话:用户

@__oo__、@_._pandora_._和@tom_lrd讨论了 Le Chat 中名为 Mistral-Next 的功能,强调了它与大型模型相比的简洁性,并希望它能作为 openweights 模型发布。 -

开发 Mistral Chat 应用的概念:用户

@aircactus500正在为 Le Chat 量身定制的 App 构思功能,包括选择 AI 对话风格的能力。他们对拥有一个法国 AI 社区平台表示兴奋,认为这增强了创意的产生,而无需翻译思想。

LM Studio ▷ #💬-general (608 条消息🔥🔥🔥):

-

LM Studio 白屏问题:用户

@steve_evian报告了一个 LM Studio 启动时仅显示白屏的问题。@heyitsyorkie建议在重新安装前清理 .cache 和 %APPDATA%,这为@steve_evian解决了该问题。 -

LM Studio 多语言模型咨询:用户

@.deug询问是否有包含韩语支持的预训练多语言 LLM 推荐。@heyitsyorkie回复称,目前很少有 LLM 能稳定地进行韩英互译,并建议将 DeepL 等在线翻译工具与 LM Studio 结合使用。 -

LM Studio 预设重置问题:用户

@wyrath对 LM Studio 的 UX 发表了评论,指出在开启“新对话(New Chat)”时,选定的预设会恢复为默认设置,导致每次都需要手动重新选择。讨论中提供了一些变通方法,并提到这可能是一个 Bug。 -

LM Studio API 与本地托管:用户

@muradb询问是否可以在没有图形环境的服务器上运行 LM Studio API。@heyitsyorkie澄清说 LM Studio 不支持 Headless 运行,且未对该功能的未来计划发表评论。 -

对开源和 Headless 版 LM Studio 的请求:用户

@krypt_lynx对 LM Studio 的闭源性质表示遗憾,并表示社区贡献可以增加诸如 Headless 运行等缺失的功能。@heyitsyorkie确认 LM Studio 确实是闭源的。

提到的链接:

- GroqChat:未找到描述

- Phind:未找到描述

- Seth Meyers GIF - Seth Meyers Myers - Discover & Share GIFs:点击查看 GIF

- Big Code Models Leaderboard - a Hugging Face Space by bigcode:未找到描述

- Fine-tune a pretrained model:未找到描述

- TheBloke/SOLAR-10.7B-Instruct-v1.0-uncensored-GGUF · Hugging Face:未找到描述

- Continual Learning for Large Language Models: A Survey:由于其庞大的规模带来的高昂训练成本,大型语言模型 (LLMs) 不适合频繁重新训练。然而,为了赋予 LLM 新技能并保持更新,更新是必要的…

- dreamgen/opus-v1.2-7b · Hugging Face:未找到描述

- Anima/air_llm at main · lyogavin/Anima:33B 中文 LLM,DPO QLORA,100K 上下文,单 4GB GPU 运行 AirLLM 70B 推理 - lyogavin/Anima

- The unofficial LMStudio FAQ!:欢迎来到非官方 LMStudio FAQ。在这里,你可以找到 LMStudio Discord 中最常见问题的答案。(此 FAQ 由社区管理)。LMStudio 是一款免费的闭源…

- no title found:未找到描述

- MusicLM:未找到描述

- Reddit - Dive into anything:未找到描述

- GitHub - deepseek-ai/DeepSeek-Coder: DeepSeek Coder: Let the Code Write Itself:DeepSeek Coder:让代码自动生成。通过在 GitHub 上创建账号来为 deepseek-ai/DeepSeek-Coder 的开发做出贡献。

- Grounding Large Language Models in Interactive Environments with Online Reinforcement Learning:最近的研究成功利用了大型语言模型 (LLM) 捕获世界物理抽象知识的能力来解决决策问题。然而,LLM 之间的对齐…

LM Studio ▷ #🤖-models-discussion-chat (98 条消息🔥🔥):

- 超参数评估困境 (Hyperparameter Evaluation Dilemma):

@0xtotem询问 RAG 的超参数应该在自己的数据集上评估,还是使用类似的数据集就足够了。这仍未解决,取决于个人选择以及最接近的可用数据。 - Dolphin 模型困境:

@yahir9023在 LM Studio 中创建 Dolphin 模型提示词模板时遇到困难,由于 Discord 缺乏文本发送功能,他分享了一个外部文件进行进一步说明。 - 模型显存挑战:

@mistershark_讨论了同时在 VRAM 中保留多个 LLM 的难度,并确认了 ooba 的可用性和功能。@goldensun3ds请求澄清,@mistershark_解释了对高性能硬件的需求,并分享了 ooba 的 GitHub 链接。 - 翻译模型咨询:

@goldensun3ds询问了日语到英语翻译的最佳模型,考虑了像 Goliath 120B 这样的模型,并建议了一个潜在的 Mixtral 模型。未给出明确答案,但用户的强大硬件配置引起了关注。 - 混合专家模型 (Mixed-Expert Models):

@freethepublicdebt询问未来是否会出现具有不同专家精度混合(FP16、8bit 和 4bit)的模型,这可能会促进泛化能力和 GPU 效率。关于此类模型的存在或开发,目前尚未收到回复。

提到的链接:

- Knight Rider Turbo GIF - Knight Rider Turbo Boost - Discover & Share GIFs:点击查看 GIF

- Pedro Sánchez anuncia la creación de un "gran modelo de lenguaje de inteligencia artificial" entrenado en español:世界移动通信大会(MWC)已经开始,会议陆续召开。小米和荣耀拉开了活动序幕,Pedro Sánchez…

- GitHub - rhasspy/piper: A fast, local neural text to speech system:一个快速、本地的神经文本转语音系统。通过在 GitHub 上创建账号为 rhasspy/piper 的开发做出贡献。

- GitHub - oobabooga/text-generation-webui-extensions:通过在 GitHub 上创建账号为 oobabooga/text-generation-webui-extensions 的开发做出贡献。

LM Studio ▷ #🧠-feedback (8 条消息🔥):

-

为新鲜更新点赞:用户

@macfly对最新更新表示热烈欢迎,称赞其外观和感觉 (look and feel)。 -

确认需要修复:

@yagilb确认了一个未指明的问题,并保证它将被修复,对带来的不便表示歉意。 -

资深用户对 LM 的高度评价:曾使用过 GPT4All 的

@iandol称赞 LM 具有出色的 GUI 和用户友好的本地服务器设置。 -

在中国的下载困境:

@iandol报告说由于身在中国,下载模型存在困难,并询问是否支持代理以方便下载。 -

寻求 Dolphin 2.7 下载支持:

@mcg9523在 LM Studio 中下载 Dolphin 2.7 时遇到挑战,@heyitsyorkie建议切换到 “compatibility guess” 并折叠 readme 以获得更好的可见性。

LM Studio ▷ #-hardware-discussion (178 条消息🔥🔥):

-

AMD 对 CUDA 支持的探索:用户

@nink1回忆了 AMD 的成长,并推测 AMD 的聪明才智可能正在致力于开发自己的 CUDA 支持,理由是企业趋向于高性价比方案。ZLUDA 的开源暗示了 AMD 内部可能存在的进展。 -

为 LLM 选择最佳 GPU:在关于 AMD 与 Nvidia GPU 的讨论中,用户

@baraduk、@wolfspyre和@heyitsyorkie辩论了 Radeon RX 7800 XT 运行 LLM 模型的适用性。普遍倾向于选择 Nvidia,因为其 AI 应用设置更简单,而 AMD 上的 ROCm 需要额外努力。 -

是否使用 NVLink:参与者

@slothi_jan、@dave2266_72415和@nink1探讨了多 GPU 配置中 NVLink 的优缺点。虽然理论上 NVLink 相比标准 PCIe 插槽能提升性能,但成本和兼容性等实际因素是重要考量。 -

运行 LLM 时 Mac 与组装 PC 的对比:用户

@slothi_jan发起了关于购买 Mac Studio 还是配备多块 RTX 3090 GPU 的组装 PC 来运行 AI 模型的讨论。观点各异,但速度、成本、易用性和前瞻性是关键考量因素。用户@heyitsyorkie、@rugg0064和@nink1提供了宝贵意见,并指出 Apple 的 M3 Max 表现出人意料地好。 -

解决使用 LM Studio 时的电脑关机问题:

@666siegfried666寻求帮助,其电脑(配置为 5800X3D CPU 和 7900 XTX GPU)在运行 LM Studio 时会自动关机。@heyitsyorkie建议通过其他计算密集型任务进行测试,以确定问题出在 LM Studio 还是电脑硬件本身。

提到的链接:

- 未找到标题:未找到描述

- 未找到标题:未找到描述

- High Five GIF - High Five Minion - Discover & Share GIFs:点击查看 GIF

- README.md · TheBloke/Llama-2-70B-GGUF at main:未找到描述

- Releases · ggerganov/llama.cpp:C/C++ 中的 LLM 推理。通过在 GitHub 上创建账户为 ggerganov/llama.cpp 的开发做出贡献。

- OpenCL - 异构系统并行编程的开放标准:未找到描述

- 知识每 12 个月翻一番,很快将变成每 12 小时翻一番 - Industry Tap:知识每 12 个月翻一番,很快将变成每 12 小时翻一番 - Industry Tap

LM Studio ▷ #🧪-beta-releases-chat (27 条消息🔥):

-

庆祝 “IQ” 模型正常运行:

@drawless111兴奋地确认 IQ1、IQ2 和 IQ3 模型已在 LM Studio 中正常运行,并赞扬了 Yags 及其团队。他们强调了 IQ1 令人印象深刻的规格:14.5 GB VRAM,70B 模型运行速度达 11.95 t/s。 -

寻找 “IQ” 格式的方法揭秘:

@drawless111提供了在 HGF 上寻找 “IQ” 格式(如 “gguf imat” 或 “gguf imatrix”)的分步指南,并指出应避免使用带有随机文本修复的压缩版本以获得更高质量。 -

LLM 本地文件系统访问咨询:

@wolfspyre询问运行模型时是否可以访问本地文件系统,例如/tmp目录是否可访问。随后@fabguy澄清说 LLM 不具备此类功能,且 LM Studio 不支持执行来自 LLM 的命令。 -

尚无模型 Tokenization 速度统计 API:

@wolfspyre询问是否有 API 可以获取模型 Tokenization 速度统计数据,@yagilb简短地回复道:“暂时还没有”。 -

Llama 1.6 更新发布:用户

@n8programs和@heyitsyorkie讨论并庆祝了 LM Studio 中 llama.cpp 更新至 1.6 版本,称其为“史诗级(EPIC)”更新。

LM Studio ▷ #autogen (9 条消息🔥):

- AutoGen 异常已解决:用户

@thebest6337最初报告了一个关于 AutoGen 的神秘错误,但通过 “卸载并重新安装每一个 AutoGen Python 包” 解决了该问题。 - 好心人的提醒:

@heyitsyorkie鼓励@thebest6337分享他们解决 AutoGen 问题的方案以帮助他人,从而促成了该修复方法的发现。 - 犹豫不决时,重启试试!:针对

@thebest6337的修复方案,@heyitsyorkie幽默地发布了一个 Tenor GIF 链接,暗示经典的“关掉再开一次”是万能的解决方案:Tenor GIF。 - 本地模型响应缓慢:用户

@gb24.询问了本地模型响应时间过长(约五分钟)的问题,暗示由于任务并非代码密集型,这种延迟是不寻常的。

提到的链接:

LM Studio ▷ #langchain (1 条消息):

bigsuh.eth: 你好,我可以使用 LM Studio 并在 LangChain 中使用 RAG 吗?

LM Studio ▷ #open-interpreter (7 条消息):

- nxonxi 的连接问题:用户

@nxonxi在安装 LM Studio 后尝试使用--local命令运行open-interpreter时遇到了httpcore.Connect Error: [Errno 111] Connection refused。 - 遭遇语法错误:同一用户收到了一个错误提示

{'error': "'prompt' field is required"},结果发现是由于其请求负载(payload)中的语法错误导致的。 - 简单的 Python 请求化解难题:

@nxonxi确认虽然 LM Studio 无法通过 OpenAI (OI) 运行,但可以通过简单的 Python 请求正常工作。 - 端点 URL 故障排除:

@1sbefore建议检查端点 URL,提到对于 TGWUI 它是http://0.0.0.0:5000/v1,并建议@nxonxi尝试从请求中使用的 URL 中移除/completions或/v1/completions作为可能的解决方案。

Perplexity AI ▷ #announcements (1 条消息):

- Perplexity 与 ElevenLabs 合作:

@ok.alex宣布推出 Discover Daily 播客,这是与语音 AI 技术先驱 ElevenLabs 的合作项目。您可以在各大平台上找到该播客,每日深入探讨科技、科学和文化,节目内容源自 Perplexity 的 Discover 信息流。 - Discover Daily 播客提升你的每一天:建议在日常通勤或好奇心萌发的闲暇时刻收听最新一期的 Discover Daily。节目可在 podcast.perplexity.ai 收听,并由 ElevenLabs 的语音技术提供支持。

提到的链接:

- Discord - A New Way to Chat with Friends & Communities:Discord 是通过语音、视频和文字进行交流的最简单方式。在这里聊天、闲逛,并与您的朋友和社区保持紧密联系。

- Discover Daily by Perplexity:我们希望将世界上的故事带到您的耳边,每日融合科技、科学和文化。内容精选自我们的 Discover 信息流,每一集都旨在为您的一天增添见解和…

Perplexity AI ▷ #general (348 条消息🔥🔥):

-

Perplexity AI 发布新模型 ‘Sonar’: Perplexity AI Discord 社区讨论了最近推出的 Sonar 模型(

sonar-small-chat和sonar-medium-chat)及其搜索增强版本。这些模型声称在成本效益、速度和性能方面有所提升。用户根据测试交互推测,Sonar Medium 的知识截止日期(knowledge cutoff)可能在 2023 年 12 月左右 (来源)。 -

再见 Gemini:社区简短地哀悼了 Gemini 从 Perplexity 可用模型列表中的移除,一些用户强烈要求其回归或引入 Gemini Ultra。

-

Perplexity AI 与图像生成:官方澄清 Perplexity Pro 确实具有生成图像的能力,尽管目前一些操作问题正在调查中。建议用户参考在线资源和 Reddit 获取帮助 (Reddit 帖子)。

-

AI 模型针对移动端的特定响应:有一场关于 AI 聊天模型在移动设备上与 PC 上的响应是否不同的讨论,一些用户注意到通过 App 访问时,像 Gemini 这样的模型给出的回答更简洁 (system prompt)。

-

传闻中的优惠与差异:在各种对话中,提到了一些不相关的话题,例如据称与某种卡服务绑定的 Perplexity Pro 6 个月免费试用(已被版主确认为真实),以及关于 Mistral 在与 Google 历史性合作后是否正与 Microsoft 建立合作伙伴关系的询问。

提到的链接:

- Phind: 未找到描述

- Au Large: Mistral Large 是我们的旗舰模型,具备顶级的推理能力。它也可以在 Azure 上使用。

- API Updates February 2024: 宣布我们的最新模型:我们很高兴宣布推出最新的 Perplexity 模型:sonar-small-chat 和 sonar-medium-chat,以及它们的搜索增强版本 sonar-small-online …

- Microsoft partners with Mistral in second AI deal beyond OpenAI: Microsoft 进行了另一项 AI 投资。

- 无标题: 未找到描述

- PerplexityBot: 我们致力于每天改进我们的服务。为了提供最佳的搜索体验,我们需要收集数据。我们使用网络爬虫从互联网收集信息,并为我们的搜索引擎建立索引…

- Perplexity Blog: 探索 Perplexity 的博客,获取文章、公告、产品更新和优化体验的技巧。保持关注并充分利用 Perplexity。

- 无标题: Perplexity 是领先的实时 AI 问答引擎。Perplexity Pro 通过无限文件上传、Copilot 引导式 AI 搜索和专属支持来增强研究能力。

- 无标题: 未找到描述

-

[Adiós Google Hola Perplexity](https://youtu.be/NjQ8LeYfxRY?si=m32SzgylMsQPIBuQ): 你不会相信这个搜索引擎凭借人工智能能做什么。如果不是 Jeff Bezos、Nvidia 和 D… 我们还不知道 Perplexity 会变成什么样。 - Discover Daily by Perplexity on Apple Podcasts: 新闻 · 2024

- Images & media: 探索 Perplexity 的博客,获取文章、公告、产品更新和优化体验的技巧。保持关注并充分利用 Perplexity。

- Billing and Subscription: 探索 Perplexity 的博客,获取文章、公告、产品更新和优化体验的技巧。保持关注并充分利用 Perplexity。

- Reddit - Dive into anything: 未找到描述

- 无标题: 未找到描述

Perplexity AI ▷ #sharing (23 messages🔥):

- 在 Perplexity AI 上探索话题: “sharing” 频道的用户正在分享各种 Perplexity AI 话题链接,范围从 Xiaomi 14 series 的评测 (

@icelavaman),到关于 PerplexityAI 和 ElevenLabs 的讨论 (@icelavaman),以及对 AI 模型中“为什么放入 Mistral”的分析 (@mydpi)。 - 对全球事件的好奇:一些用户正在关注及时的事件和项目,例如美国多年来的首次登月任务 (

@sanjaymenon)、Lenovo 的透明笔记本电脑概念 (@vipul7031) 以及台湾的 Starshield (@cy_alex)。 - 模型对比与技术查询:技术爱好者正在深入研究 iPhone 型号对比 (

@ming9993) 以及关于 eigenlayer 节点使用等技术策略的问题 (@novice9708)。 - 使用 Perplexity AI 作为个人助手与学习工具:个人用户利用 Perplexity AI 进行个人探索和学习,搜索内容包括美国运动员 (

@commuting5048) 以及创建个人收藏,如 “Make your own” (@_yoojungin)。 - 多元兴趣焦点:频道中的兴趣非常广泛,用户如

@chob_hee寻求数学计算,@mistercare寻找推荐工具(德语),而@veryoriginalname123则发表了个人陈述(“I am a…“)。

Perplexity AI ▷ #pplx-api (339 messages🔥🔥):

- Sonar 模型首次亮相:Perplexity AI 推出了新模型:

sonar-small-chat和sonar-medium-chat,以及具有增强搜索能力的联网版本。包括@thedigitalcat和@digital_despot在内的用户表示更倾向于pplx-70b-online模型,因为它似乎能提供更连贯的回答。 - 对比 Sonar 和 pplx-70b:

@jaicraft认为 sonar-medium 的表现应该优于 pplx-70b,但包括@sergevar和@thedigitalcat在内的其他用户报告称,从 sonar 模型收到了不连贯或“乱码”的回复。 - 相比 Sonar Medium 更倾向于 pplx-70b:像

@thedigitalcat这样的用户请求不要逐步淘汰pplx-70b-online模型,因为其性能更优。来自 Perplexity AI 的@ok.alex承认了sonar-medium-online存在的问题,并提到正在开发修复方案。 - 讨论 API 使用改进:

@ericosk寻求一种以编程方式获取模型详情的方法,并表达了在 UI 中填充模型选项的使用场景。此外,@thedigitalcat和@brknclock1215等用户讨论了在 API 调用中使用或省略 system prompts 的影响。 - Sonar 模型的乱码输出:

@brknclock1215注意到限制输出长度可以缓解 sonar 模型的乱码回复,但@thedigitalcat分享到 pplx 模型不受长输出的影响。@thedigitalcat提供了一张截图,展示了来自sonar-medium-online的非人类可读响应。

提及的链接:

- no title found): 无描述

- API Updates February 2024: 宣布我们的最新模型。我们很高兴宣布推出最新的 Perplexity 模型:sonar-small-chat 和 sonar-medium-chat,以及它们的搜索增强版本 sonar-small-online …

- Mixtral of experts: 高质量的稀疏专家混合模型 (Sparse Mixture-of-Experts)。

- More than an OpenAI Wrapper: Perplexity Pivots to Open Source: Perplexity CEO Aravind Srinivas 是 Larry Page 的大粉丝。然而,他认为他找到了一种不仅能与 Google 搜索竞争,还能与 OpenAI 的 GPT 竞争的方法。

- Chat Completions: 为给定的聊天对话生成模型响应。

- pplx-api: 无描述

- How to access the usage of a stream when using OpenAI sdk?: 你好,我目前在 JS 中获取流式传输的使用情况时遇到了困难。在 Python 中没问题,因为我们可以直接遍历响应,但在 JS 中找不到方法。我还在…

- pplx-api form: 使用 Typeform 将数据收集转化为一种体验。创建精名的在线表单、调查、测验等等。免费试用。

- hask/main/background.js at 34dad93639419617595915122b0099b7023a3dae · bm777/hask: 由 Online LM 驱动的 Hask anything。通过在 GitHub 上创建账户为 bm777/hask 的开发做出贡献。

OpenAI ▷ #ai-discussions (183 messages🔥🔥):

-

VPN 可能会干扰 OpenAI 服务:用户

@strang999遇到了 “Something went wrong” 错误。@satanhashtag建议 VPN 服务可能会产生干扰,即使在未主动使用时也是如此,并建议在 VPN 设置中禁用 Web 保护。 -

寻求图生视频 (Image-to-Video) 生成工具:

@sparkette询问是否有不使用积分系统的网页版图生视频生成器。@lugui推荐了 snappyvideo.ai,尽管它并不符合不限量使用的标准。 -

对 Sora 能力的期待:用户

@rreitsma和@madame_architect讨论了 OpenAI 的 Sora 在制作科普电视节目或个性化语言课程方面的潜力,强调了其先进的模拟功能。 -

对 Copilot 的评价褒贬不一:

@pruo和@madame_architect分享了对 Microsoft 旗下的应用内聊天机器人 Copilot 的使用体验。@pruo认为它很有价值,而@madame_architect则觉得其质量与之前的 AI 版本相比有所下降。 -

Gemini 用户面临社交压力:

@pruo对因使用 Google 的 Gemini AI 系统而受到羞辱表示沮丧,希望能在不受评判的情况下使用它。@tariqali回应称,问题在于 AI 本身而非用户,并强调了不依赖单一 AI 系统的优点。

提到的链接:

- GroqChat:未找到描述

-

[Mistral AI 发布新模型以对抗 GPT-4 及其聊天助手 TechCrunch](https://techcrunch.com/2024/02/26/mistral-ai-releases-new-model-to-rival-gpt-4-and-its-own-chat-assistant/):Mistral AI 正在推出名为 Mistral Large 的新旗舰大语言模型。它旨在与其他顶级模型(如 GPT-4)竞争。 - 视频生成模型作为世界模拟器:我们探索了在视频数据上进行大规模生成模型训练。具体来说,我们在不同时长、分辨率和纵横比的视频和图像上联合训练文本条件扩散模型……

- 将任何物体放入任何视频中 (Place Anything into Any Video):未找到描述

- HuggingChat:让社区最好的 AI 聊天模型惠及每一个人。

- Gorilla:未找到描述

- Gorilla LLM 简介:未找到描述

- GitHub - ShishirPatil/gorilla: Gorilla: LLM 的 API 商店:Gorilla:LLM 的 API 商店。通过在 GitHub 上创建账户为 ShishirPatil/gorilla 的开发做出贡献。

- Agent 如何做出决策?:未找到描述

OpenAI ▷ #gpt-4-discussions (103 messages🔥🔥):

-

ChatGPT 的上下文限制引发不满:

@orbart对 ChatGPT 在叙事工作中记忆长文本能力的下降表示失望,怀疑其能力遭到了“削弱 (nerf)”。@blckreaper证实了这一感觉,并指出从文件中处理的 token 数量似乎从 15K 减少到了约 8K。 -

验证码难题让用户陷入循环:

@little.toadstool和@necrosystv报告在 ChatGPT 中经历了重复且令人沮丧的 20 阶段验证码测试,这破坏了用户体验,并引发了对该服务当前问题的质疑。 -

寻求数学和 PDF 解决方案:

@candonlyc和@yami1010等用户讨论了缺乏 MathPix ChatGPT 插件的问题,以及数学内容 OCR 能力相关的挑战,并建议使用外部资源或 API 进行增强。 -

保护自定义 Prompt 是个难题:用户

@.dunamis.和@kyleschullerdev_51255就如何保护 Prompt 交换了意见,共识是完全的保护是不可行的,分层 Web 应用程序的方法可能会提供更好的安全性。 -

对 GPT-4 的微调 (Fine-Tuning) 和可发现性的好奇:

@kxlja询问 Discover 页面上的 AI 模型是人工选择还是通过其他标准筛选的,@liangdev则询问了如何获取 GPT-4 模型进行微调,探讨了该选项的可用性。

OpenAI ▷ #prompt-engineering (209 messages🔥🔥):

- Assistant 与 Custom GPT 的细微差别:

@brunoalec指出在 API 中将 OpenAI 商店的 Custom GPTs 作为 GPT Assistants 使用时存在不一致性。@rendo1澄清说,Assistants 可以生成“代码块”格式的表格,且 Assistants UI 不支持 Markdown 格式化,这与 ChatGPT UI 不同,后者会将 Markdown 转换为视觉元素。 - 改进搜索功能:

@kevinnoodles遇到了 ChatGPT 搜索返回无效结果或拒绝访问的问题。对话中未提出解决方案。 - 文本分类任务咨询:

@crifat询问对于文本分类问题应该使用 Fine-tuning 还是 Assistant。@eskcanta建议先尝试使用基础模型(base model)以检查错误率。 - 代码任务的 Prompt 优化:

@tawsif2781询问在项目中将 JavaScript 转换为 TypeScript 的最佳 Prompt 方式。聊天中未提供具体的指南。 - ChatGPT 响应问题:

@ianhoughton44报告了 ChatGPT 响应无用或不合规的问题已持续一周多,但在讨论中未收到任何故障排除建议。

提到的链接:

- Usage policies:未找到描述

- Terms of use:未找到描述

- Enterprise privacy:未找到描述

OpenAI ▷ #api-discussions (209 messages🔥🔥):

- 寻求 GPT UI 优化:用户

@joemama8222寻求改进 HTML 代码 UI 设计的建议,但未提及具体细节或分享解决方案。 - Prompt 截断问题泛滥:

@jimmysapp表示在 ChatGPT 中持续遇到 Prompt 截断和自定义指令(custom instructions)响应缺失的问题,该问题在浏览器和手机 App 上均存在。用户@madame_architect建议清除 Cookie 并重启,而@eskcanta等人则推测可能是由于内容政策导致 AI 产生困惑。 - AI 函数咨询得到开发者专业解答:用户

@agi_dude询问了关于针对编程文档查询的特定设置下的 Function calling 问题;@eskcanta和@madame_architect提供了指导,后者引导其参考 API 文档并建议使用 Assistant API。 - 关于图像 Prompt 复现能力的辩论:

@bombasticfard询问如何通过 AI Prompt 复现特定图像,@bambooshoots建议使用 Wright’s Pixel Painter Pro CustomGPT 的策略,@cqoker分享了使用“anime 2d model/format”术语成功生成所需图像风格的经验。 - 关于 Custom 和 Assistant 模型 AI 能力的困惑:用户

@brunoalec注意到 Custom GPTs 和 Assistant GPTs 在表格格式化、DALL-E 使用和 Markdown 功能方面的差异,@rendo1解释说,如果没有特定的 API 配置,Assistants 无法原生格式化 Markdown 或直接生成图像。 - 信用报告数据处理问题:

@razorbackx9x询问是否有 AI 可以将信用报告数据整理到 Excel 中。@eskcanta强烈警告不要上传敏感的 PII 数据,@s_p_e_c也要求官方明确隐私政策,@madame_architect则主张在使用前先对数据进行脱敏处理。

提到的链接:

- Terms of use:未找到描述

- Enterprise privacy:未找到描述

- Usage policies:未找到描述

LAION ▷ #general (624 messages🔥🔥🔥):

-

基于 Transformer 的视频模型讨论:

@yoavhacohen提到一个名为 Snap Video 的新项目,该项目通过采用考虑空间和时间冗余像素的框架以及新的基于 Transformer 的架构,解决了视频生成中的挑战。他分享了项目链接和相关的研究论文。 -

对生成式视频模型的担忧:用户

@qwerty_qwer对生成式视频模型的意义表示怀疑,除非它们是由大型机构发布的,并认为研究人员缺乏发布具有影响力成果所需的计算资源。 -

寻找可贡献的开源项目:

@k_ek_w介绍自己是一名拥有一年经验的数据科学家,正在寻找可以贡献的开源 AI 和 ML 项目。 -

Image Captioner 演示:

@yoavhacohen提供了示例,将他们团队的 Image Captioner 生成的描述与 LLaVA 和 Google Captioner 在不同图像上的描述进行了对比,突出了描述细节程度的差异。 -

LoRA Land 发布:用户

@helium__宣布发布 LoRA Land,这是一个针对各种任务进行微调的 Mistral-7b 模型集合。他们指出这些模型具有卓越的性能和成本效益,并分享了一个 网络研讨会链接 以获取更多信息。

提到的链接:

- Stella Biderman (@BlancheMinerva) 的推文:@maxhbain @Shutterstock 你好,我无法给你发消息(设置为仅限高级用户),但我很想谈谈这件事,特别是如果可能的话,继续为研究人员提供数据….

- Au Large:Mistral Large 是我们的旗舰模型,具有顶级的推理能力。它也可以在 Azure 上使用。

- SPIN Diffusion Demo V1 - UCLA-AGI 的 Hugging Face Space:未找到描述

- 基于 Encoder 的领域微调,用于 Text-to-Image 模型的快速个性化:未找到描述

- SDXL Lightning - 由 fal.ai 提供:fal.ai 提供的极速 SDXL API 演示

- Wuerstchen: 一种用于大规模 Text-to-Image Diffusion 模型的高效架构:我们介绍了 Würstchen,这是一种新型的文本到图像合成架构,它将具有竞争力的性能与大规模 Text-to-Image Diffusion 模型前所未有的成本效益相结合。一个 k…

- Shaheer Rehman GIF - Shaheer Rehman - 发现并分享 GIF:点击查看 GIF

- Starship Troopers GIF - Starship Troopers - 发现并分享 GIF:点击查看 GIF

-

[LAION 5B 安全审查 LAION](https://laion.ai/notes/laion-maintanence/):媒体报道了斯坦福大学的一项研究项目结果,据此,LAION 5B 训练集包含… - LoRA Land: 性能超越 GPT-4 的微调开源 LLM - Predibase:LoRA Land 是一个包含 25 个以上微调 Mistral-7b 模型的集合,在特定任务应用中表现优于 GPT-4。这个微调 OSS 模型集合为寻求高效…的团队提供了蓝图。

- Allen T (@Mr_AllenT) 的推文:中国很快将在 CCTV 频道播出首部 AI 动画。我想知道 AI 系列剧集在世界范围内普及还需要多久?

-

[Shutterstock 扩大与 OpenAI 的合作伙伴关系,签署新的六年协议以提供高质量训练数据 Shutterstock, Inc.](https://investor.shutterstock.com/news-releases/news-release-details/shutterstock-expands-partnership-openai-signs-new-six-year):投资者关系网站包含有关 Shutterstock, Inc. 业务的信息,面向股东、潜在投资者和财务分析师。 - TTS Arena - TTS-AGI 的 Hugging Face Space:未找到描述

- LMSys Chatbot Arena 排行榜 - lmsys 的 Hugging Face Space:未找到描述

- Vision Arena (并排测试 VLM) - WildVision 的 Hugging Face Space:未找到描述

-

[Garfield Diffusion V1 - v1.0 Stable Diffusion Checkpoint Civitai](https://civitai.com/models/29444/garfield-diffusion-v1>):我的第一个大模型。在由 lasagna.cz 标记的 16240 条连环画上进行训练。这意味着有角色标签和许多其他标签(在网站上查看全部)…. - GitHub - Breakthrough/PySceneDetect: :movie_camera: 基于 Python 和 OpenCV 的场景切换/过渡检测程序和库。::movie_camera: 基于 Python 和 OpenCV 的场景切换/过渡检测程序和库。 - Breakthrough/PySceneDetect

- shinonomelab/cleanvid-15m_map · Hugging Face 数据集:未找到描述

- WebVid 大型短视频数据集 / 数据集 / 超神经:未找到描述

- 由 pacman100 添加新的合并方法 · Pull Request #1364 · huggingface/peft:这个 PR 做了什么?基于论文《TIES-MERGING: Resolving Interference When Merging Models》和《Language Models are Super Mario: Absorbing Abilities f…》为 LoRA 添加了新的模型合并方法。

- Snap Video:未找到描述

LAION ▷ #research (67 条消息🔥🔥):

-

CLIP 过滤器与高质量分类器之争:

@top_walk_town指出了 DFN 论文的重要性,该论文表明与使用高质量图文对分类器相比,CLIP 过滤并非最优选。 -

BFloat16 梯度讨论:

@yoavhacohen确认了在 TPU 上使用 bfloat16 的 autocasting,而@top_walk_town和@chad_in_the_house讨论了 Pytorch 的 autocast 行为,即反向传播(backward pass)默认使用 fp32。 -

模型参数差异:

@thejonasbrothers注意到关于 Google 发布 gemma 7b 模型 的困惑,实际上在计算参数量时它是一个 9b 模型。 -

梯度精度权衡:

@chad_in_the_house更新称,使用 bf16 梯度 训练速度更快,但与 fp32 梯度相比结果较差。 -

研究论文与方法分享:用户

@said2000、@thejonasbrothers等人分享了多篇研究论文和 AI 相关方法,涉及 state space architecture、Transformer 模型 优化以及 AI 生成文本的 “radioactivity” 检测。此外,@vrus0188分享了一个 YouTube 视频,讨论了 AI 使 LLM 显著降低成本 的潜力。

提到的链接:

- 未找到标题: 未找到描述

- Beyond A*: Better Planning with Transformers via Search Dynamics Bootstrapping: 虽然 Transformer 在各种应用场景中取得了巨大进展,但在解决复杂的决策任务方面,此类架构仍落后于传统的符号规划器。在本文中…

- Generative Models: What do they know?: 未找到描述

- Mamba-ND: Selective State Space Modeling for Multi-Dimensional Data: 近年来,Transformer 已成为文本及各种多维数据(如图像和视频)序列建模的事实标准架构。然而,自注意力机制的使用…

- Watermarking Makes Language Models Radioactive: 本文研究了 LLM 生成文本的放射性,即是否可以检测出此类输入被用作训练数据。传统方法如成员推理(membership inference)可以…

- collabora/whisperspeech · Hugging Face: 未找到描述

- Fireship: 高强度的 ⚡ 代码教程和技术新闻,助你更快交付应用。每周更新视频,涵盖每个程序员都应了解的主题。#100SecondsOfCode #TheCod 的原产地…

- 未找到标题: 未找到描述

- LoRA Land: Fine-Tuned Open-Source LLMs that Outperform GPT-4 - Predibase: LoRA Land 是一个包含 25 个以上微调过的 Mistral-7b 模型集合,它们在特定任务应用中的表现优于 GPT-4。这一微调 OSS 模型集合为寻求高效…的团队提供了蓝图。

- 未找到标题: 未找到描述

- yet-another-applied-llm-benchmark/tests at main · carlini/yet-another-applied-llm-benchmark: 一个用于评估语言模型在我之前要求它们解决的问题上表现的基准测试。- carlini/yet-another-applied-llm-benchmark

- Mamba Might Just Make LLMs 1000x Cheaper…: 看看 HubSpot 的 ChatGPT 工作包!https://clickhubspot.com/twc Mamba 是否会给 LLM 带来革命并挑战现状?或者它只是…

- The AI 'Genie' is Out + Humanoid Robotics Step Closer: 先是文本转语音、文本转视频和文本转动作,现在是文本转交互?让我们来看看来自 Google DeepMind 的新 Genie 论文,并设置…

- Scalable Diffusion Models with State Space Backbone: 本文对一类基于状态空间(state space)架构构建的扩散模型进行了新的探索。我们致力于为图像数据训练扩散模型,其中传统的 U-Net 骨干网络…

- SDXL-Lightning: Progressive Adversarial Diffusion Distillation: 我们提出了一种扩散蒸馏方法,在基于 SDXL 的单步/少步 1024px 文本生成图像中达到了新的 SOTA。我们的方法结合了渐进式和对抗式蒸馏…

- Reddit - Dive into anything: 未找到描述

LAION ▷ #learning-ml (2 条消息):

- 警惕潜在诈骗:用户

@josephsweeney11声称通过 Telegram @auto_trade_admin 帮助 10 人在 72 小时内赚取 4 万美元,并收取 10% 的佣金。此类消息可能是诈骗,用户应保持警惕。 - 实验 Transformer 的学习能力:

@phryq.好奇是否有人通过实验性训练探索过 Transformer 的学习能力,例如理解并应用虚构物体之间的尺寸关系来生成图像。他们提供了具体的例子,质疑模型是否能推断出 “krog” 的渲染尺寸应该是 “mmmmmchakaboooboolight” 的四倍。

LAION ▷ #paper-discussion (1 条消息):

said2000: https://arxiv.org/abs/2402.05892

HuggingFace ▷ #general (182 messages🔥🔥):

<ul>

<li><strong>AI 硬件尝试与推测</strong>:用户讨论了开发专有 TPU 的潜力以及特定纳米制造工艺的可获得性,强调了这种普及化如何能赋予类似于汽车行业的自由。对话中参考了与 RAM 行业价格行为的对比,对三星等公司的技术承诺表示怀疑。</li>

<li><strong>持续进行的 AI 辩论</strong>:社区成员就 AI 和资本主义的影响发表了看法,一些人争论开源努力是否能与 Intel 或 Nvidia 等巨头抗衡。讨论反映了对技术进步带来的失业和财富不平等的担忧,同时也权衡了开发 AI 产品以保障个人财务状况的实用性。</li>

<li><strong>模型利用方面的咨询与协助</strong>:用户寻求了关于一系列主题的帮助,包括在特定 GPU 和集成环境上使用特定模型、与模型大小和内存限制相关的局限性、数据集管理以及为项目寻找资源。社区贡献了诸如使用 llama.cpp 进行模型并行化,以及在处理大模型时使用 accelerate 进行 CPU offloading 等建议。</li>

<li><strong>探索实际应用与协作</strong>:从为神经网络项目寻求合作伙伴,到寻找与开源模型协作的高效策略,用户交换了想法和建议。他们涵盖了机器学习、目标检测、语言模型以及使用 serverless GPU 服务进行具有成本效益的研发等领域。</li>

<li><strong>技术支持与问题解决</strong>:讨论了 Hugging Face 服务的后端问题,如 inference-api serverless 超时,用户的体验反映出性能存在波动。社区成员还解决了数据序列化、组件样式自定义以及不同模型的 GPU 支持等问题。</li>

</ul>

提到的链接:

- BRIA 2.2 FAST - briaai 提供的 Hugging Face Space:未找到描述

- 十大 Serverless GPU:全面的供应商选择:探索什么是 serverless gpu,它对 ML 模型的益处,以及更便宜、更快速部署 LLM 的顶级 serverless gpu 供应商。

- BRIA 2.2 - briaai 提供的 Hugging Face Space:未找到描述

- 抑制 HuggingFace 日志警告:”Setting

pad_token_idtoeos_token_id:{eos_token_id} for open-end generation.”:在 HuggingFace 中,每次我调用 pipeline() 对象时,都会收到警告:"Setting pad_token_id to eos_token_id:{eos_token_id} for open-end generation."我该如何抑制… - GPU 产品组合:未找到描述

- 🌌 Hugging Face Spaces 分析:未找到描述

- Weyaxi (@Weyaxi) 的推文:🎉 @huggingface 的新博客文章 🌌 Hugging Face Spaces 分析。我抓取了 2 万个 Spaces 的代码文件并将其合并为一个数据集,展示了有意义的统计数据 📶 📝 博客文章:http…

- Threads 上的 Amanda Ingrao (@artofthemoon.designs):6 位关注者

- Phillip Lavrador 提供的 70k 枪支目标检测数据集 (v5, Main):70277 张开源枪支图像及多种格式的标注,用于训练计算机视觉模型。由 Phillip Lavrador 创建的 70k Guns (v5, Main)

- 新型芯片开启光速 AI 计算之门 - 宾夕法尼亚大学工程学院博客:宾大工程师开发了一种新型芯片,利用光波而非电力来执行训练 AI 至关重要的复杂数学运算。该芯片……阅读更多 ›

- 矩阵计算器:未找到描述

HuggingFace ▷ #today-im-learning (8 条消息🔥):

- 模仿学习咨询:用户

@alefram寻求关于开始学习 机器人模仿学习 (imitation learning for robotics) 的建议。针对该查询,目前尚未提供具体的资源或建议。 - 深度强化学习课程参与:

@meriem_baziz表达了参加 Deep RL 课程 的意向并寻求建议。同样,社区尚未提供可见的反馈或指导。 - LinkedIn 上的随机数见解:

@stereoplegic分享了一篇 LinkedIn 文章,该文章提供了关于在 PyTorch 中处理 random seeds 的见解,并推荐其为一篇内容丰富的读物。 - CLI 打包之谜:用户

@vipitis正在学习如何使用pyproject.toml打包 CLI entry points,探索 Python 项目打包的复杂性。 - V-JEPA 论文备受关注:

@subham5089撰写并分享了一篇 博文,解释了 Meta 发布的 V-JEPA 论文,将该模型比作多模态学习 (multimodal learning) 领域的 BERT。随后@cakiki提醒其避免在多个频道重复发布。 - Gemma 模型本地部署:

@ariondas推广了一篇 LinkedIn 帖子,概述了如何在本地 Ubuntu 机器上使用 Ollama 访问 Google 的 Gemma 模型。

HuggingFace ▷ #cool-finds (33 条消息🔥):

-

2024 春季深度无监督学习课程:用户

@omrylcn分享了 Berkeley CS294-158 SP24 关于深度无监督学习(Deep Unsupervised Learning)课程的链接,并提到该课程将涵盖深度生成模型(Deep Generative Models)和自监督学习(Self-Supervised Learning),与之前的课程设置类似。 -

Large Action Models 的兴起:

@fernando_cejas重点介绍了一篇讨论 Large Action Models (LAMs) 的博文——这是一种先进的 AI 系统,能够通过结合语言能力与任务执行,在数字环境中执行类似人类的任务。 -

推出包含可访问模型的 Galaxy AI:用户

@white_d3vil介绍了 Galaxy AI 平台,该平台提供多种 AI 模型的免费 API 访问,包括 GPT-4、GPT-3.5 以及他们自有的 Gemini-Pro。根据网站显示,该平台和模型可供项目测试使用。 -

探索 VLM 分辨率挑战与解决方案:

@osanseviero推荐了来自 HuggingFace 的两篇博文,讨论了视觉语言模型(VLMs)在分辨率方面的挑战,并提出了一种克服该问题的新方法。文中包含一个 Demo 以及在 HuggingFace hub 上可用的相关模型。 -

Scale AI 在数据标注市场的崛起:用户

@valeriiakuka分享了来自 Turing Post 的一篇文章,讲述了 Scale AI 在成立 8 周年之际,如何成长为数据标注市场中估值最高的公司之一。该文章是 AI Infrastructure Unicorns 系列讨论的一部分,可以在这里阅读。

提到的链接:

- Reader:未找到描述

- Warp:未找到描述

- Warp:未找到描述

- 🪆 Matryoshka Embedding Models 简介:未找到描述

- CS294-158-SP24 2024 春季深度无监督学习:关于:本课程将涵盖两个不需要标注数据的深度学习领域:深度生成模型(Deep Generative Models)和自监督学习(Self-Supervised Learning)。生成模型的最新进展使得…

- Scale AI:如何在每个 AI 趋势中扩展公司:从预约应用到数据标注巨头的卓越历程

- 论文页面 - FiT: Flexible Vision Transformer for Diffusion Model:未找到描述

- Galaxy AI - Swagger UI:未找到描述

- 打破视觉语言模型的分辨率诅咒:未找到描述

- @visheratin 在 Hugging Face 上发表的内容:”VLMs 存在分辨率问题,这阻碍了它们发现微小细节……”:未找到描述

- Large Action Models (LAMs):AI 理解和执行人类任务的新阶段 —— 站在变革的正确一边:未找到描述

- 揭秘 Llamaindex 的力量:Jina vs Nomic AI vs FlagEmbedding:Ankush k Singal

- Ankush k Singal – Medium:在 Medium 上阅读 Ankush k Singal 的文章。我的名字是 Ankush Singal,我是一名旅行者、摄影师和数据科学爱好者。每天,Ankush k Singal 和成千上万的其他声音在这里阅读、写作…

- 使用大语言模型进行言语测谎 - Scientific Reports:未找到描述

HuggingFace ▷ #i-made-this (24 messages🔥):

- 将 Speaker Embeddings 引入浏览器:用户 `@davidre95` 宣布了一个为 transformers.js 添加 WavLMForXVector 支持的 Pull Request,使得 Speaker Embeddings 模型能够在浏览器中运行。相关的 PR 可以在 [GitHub 此处](https://github.com/xenova/transformers.js/pull/603)找到,兼容的 ONNX 模型已在 [Hugging Face](https://huggingface.co/D4ve-R/wavlm-base-plus-sv) 上发布。

- 用于 ONNX 推理的 .NET 库:用户 `@sa_ddam213` 介绍了一个用于 ONNX 模型推理的 C# .NET 库,无需 Python 环境,代码可在 [GitHub 此处](https://github.com/saddam213/OnnxStack)获取。

- 开源 AI 项目亮相:用户 `@flameface` 分享了 Unburn Toys 的链接,这是一个包含一系列实用工具的开源 AI 项目,其代码仓库可以在 [GitHub 此处](https://github.com/flameface/unburn-toys)找到。

- 交互式 TTS 模型对比:用户 `@realmrfakename` 展示了一个名为 TTS Arena 的 Hugging Face Space,允许用户通过听取样本并投票来对比 TTS 模型,可在 [Hugging Face 此处](https://huggingface.co/spaces/TTS-AGI/TTS-Arena)访问。`@pendrokar` 提供了反馈以及指向一个开源 TTS 追踪器的链接。

- 哲学问答数据集汇编:用户 `@nabereon` 发布了一个包含 133,799 条哲学问题和答案的数据集,可在 [Hugging Face 此处](https://huggingface.co/datasets/sayhan/strix-philosophy-qa)获取,并欢迎反馈。

- 用于无代码 AI 实验的 Gradio 应用:用户 `@nishantsethi_62323` 在 Hugging Face Space 上分享了他们的第一个 Gradio 应用,旨在无需编写代码即可进行创意实验,可在 [Hugging Face 此处](https://huggingface.co/spaces/nsethi610/ns-gradio-apps)访问。

- 让 LLM 微调更简单:用户 `@ameerazam` 提供了微调参数量小于 7B 的大语言模型(LLMs)的资源,并在 [Hugging Face 此处](https://huggingface.co/ameerazam08/gemma-jokes)分享了包含代码的仓库。

提及的链接:

- TTS Arena - a Hugging Face Space by TTS-AGI: 未找到描述

- ameerazam08/gemma-jokes · Hugging Face: 未找到描述

- D4ve-R/wavlm-base-plus-sv · Hugging Face: 未找到描述

- Ns Gradio Apps - a Hugging Face Space by nsethi610: 未找到描述

- Prompting - ElevenLabs: 未找到描述

- Add support for WavlmForXVector by D4ve-R · Pull Request #603 · xenova/transformers.js: 添加了对带有 xvector head 的 WavLM 的支持。microsoft/wavlm-base-plus-sv 的 ONNX 版本可以在 D4ve-R/wavlm-base-plus-sv 找到。目标是尽可能接近 Python 实现…

- GitHub - saddam213/OnnxStack: C# Stable Diffusion using ONNX Runtime: 使用 ONNX Runtime 的 C# Stable Diffusion。通过在 GitHub 上创建账号来为 saddam213/OnnxStack 的开发做出贡献。

- sayhan/strix-philosophy-qa · Datasets at Hugging Face: 未找到描述

- GitHub - flameface/unburn-toys: Unburn Toys is an open-source AI project with a bunch of useful tools.: Unburn Toys 是一个包含一系列实用工具的开源 AI 项目。- flameface/unburn-toys

HuggingFace ▷ #reading-group (26 条消息🔥):

- Neural Circuit Diagrams 演讲公告:

@chad_in_the_house通知小组,@1191190979580022875将就“Neural Circuit Diagrams: Robust Diagrams for the Communication, Implementation, and Analysis of Deep Learning Architectures”进行演讲。会议将于 7 pm EST 举行。 - 会议以工具和研究讨论开始:

@chad_in_the_house分享了在讨论论文时用于创建图表的工具 Mathcha.io。此外,还重点介绍了@vtabbott_关于mixtral的博客文章,供未来的解析工作参考。 - 演讲视频已上传至 YouTube:

@chad_in_the_house在 YouTube 上发布了演讲视频,标题为 Hugging Face Reading Group 14: Neural Circuit Diagrams,并承诺将在 GitHub 上更新更多内容。 - 即将举行的 PR 演讲预告:

@chad_in_the_house预告下周的演讲将由@563068096747798529主讲,内容关于 peft 库 的一个 PR,重点介绍 LoRA 的新合并方法,并辅以两篇 arXiv 论文(2306.01708 和 2311.03099)中的视觉插图。 - 下一次演讲的排期与贡献归属:

@chad_in_the_house和@prateeky2806通过 when2meet 协调了下一次演讲的时间,@prateeky2806将该 PR 的主要工作归功于@871797575454425159和@504681610373758977。

提到的链接:

- Understanding Mixtral-8x7b:这篇博客文章改编自我发布的一个 X 线程。它引起了极大的关注,所以我决定也在这里发布!@MistralAI 的 Mixtral-8x7b 是一款 LLM,其性能超越了除 OpenAI 之外的所有模型,并且…

- Mathcha:未找到描述

- Paper page - Neural Circuit Diagrams: Robust Diagrams for the Communication, Implementation, and Analysis of Deep Learning Architectures:未找到描述

- Hugging Face Reading Group 14: Neural Circuit Diagrams:由 Vincent Abbott 演讲

- TIES-Merging: Resolving Interference When Merging Models:迁移学习(即在下游任务上进一步微调预训练模型)可以带来显著优势,包括提高下游性能、更快的收敛速度以及更好的安全性…

- Language Models are Super Mario: Absorbing Abilities from Homologous Models as a Free Lunch:在本文中,我们揭示了语言模型(LM)可以通过吸收同源模型的参数来获得新能力,而无需重新训练或使用 GPU。我们首先引入了 DARE 来设置大多数 delta…

- TIE+SuperMario Pres - When2meet:未找到描述

- Add new merging methods by pacman100 · Pull Request #1364 · huggingface/peft:这个 PR 做了什么?基于论文 TIES-MERGING: Resolving Interference When Merging Models 和 Language Models are Super Mario: Absorbing Abilities f… 为 LoRA 添加新的模型合并方法。

HuggingFace ▷ #diffusion-discussions (15 条消息🔥):

- 关于 AnimeBackgroundGAN 的咨询:

@mfd000m询问如何使用akiyamasho/AnimeBackgroundGAN模型,以及应该克隆 GitHub 仓库还是使用 transformers 或 diffusion 等库。后续消息中未提供具体解决方案。 - 针对新语言微调 Diffusion 模型:

@alielfilali01询问是否可以在不同语言的语料库上微调 diffusion 模型,而不是针对新的图像风格。@chad_in_the_house做出回应,分享了 Japanese Stable Diffusion 模型 的链接,该模型采用了针对日语定制的两阶段训练程序。 - 模型微调中的 Loss 锯齿波动:

@khandelwaal.ankit尝试使用特定数据集微调Qwen/Qwen1.5-0.5B,但尽管尝试了各种超参数,仍遇到 Loss 图表呈锯齿状波动的问题。关于此问题目前没有进一步的澄清或建议。 - Diffusers 库中的 Latent 输出:

@shinyzenith讨论了在 diffusers 库的 stable_diffusion_pipeline 中使用output_type='latent'的情况,假设它会为给定 prompt 生成采样的 latent spaces。他们分享了一个技术问题:由于权重为负,在计算 KL divergence 时出现了 NaN 值,并考虑是否对权重进行归一化,但不确定这是否会扭曲分析结果。

提及的链接:

- 未找到标题:未找到描述

- rinna/japanese-stable-diffusion · Hugging Face:未找到描述

- rinna (rinna Co., Ltd.):未找到描述

HuggingFace ▷ #computer-vision (23 条消息🔥):

- 聚焦情绪识别:

rodricota_提到他们正在构建一个情绪识别模型 (emotion recognition model) 并希望讨论一些问题,而@justinm8449插话表示他们已经构建过此类模型。 - 关于 BLIP2 处理图像序列的咨询:

@seanb2792询问 BLIP2 是否可以处理来自 3D 模型的图像切片,考虑到这些切片相互依赖且共享上下文,并征求是否应为此任务使用其他模型的建议。 - 寻求处理复杂字符的鲁棒 OCR 模型:

@icecoldt369正在寻找擅长处理具有复杂字符的外语的 OCR 模型,并表示对经典 LSTM 模型的结果不满意。他们与@cursorop进行了对话,讨论了微调的必要性以及模型在处理高棉语(Khmer)等冷门语言时的局限性。 - 多语言 OCR 模型讨论:

@cropinky分享了一个 GitHub 链接 指向 surya,这是一个支持 90 多种语言的 OCR 和行检测 (line detection) 项目,近期备受关注。 - 计算机视觉模型基准测试与项目创意交流:

@coffeevampir3寻求视觉模型的基准测试 (benchmarks),@cropinky推荐了 Papers With Code 上的详尽列表。此外,@solution3746征求毕业设计计算机视觉项目的创意,并收到了一个关于从 CCTV 监控画面中进行人数统计的建议。

提及的链接:

- GitHub - VikParuchuri/surya: OCR and line detection in 90+ languages:支持 90 多种语言的 OCR 和行检测。通过在 GitHub 上创建账户为 VikParuchuri/surya 的开发做出贡献。

- Papers with Code - Browse the State-of-the-Art in Machine Learning:12480 个排行榜 • 4728 个任务 • 9286 个数据集 • 119860 篇带有代码的论文。

HuggingFace ▷ #NLP (109 messages🔥🔥):

- 微调中的困惑:

@jimmyfromanalytics在针对特定领域话题微调 Flan T5 以生成正面和负面评论时遇到问题并寻求建议。模型在微调后输出语无伦次的句子,这表明在 Prompt Engineering 方面存在困难。 - BERT vs. LLM 用于文本分类:

@arkalonman询问是否有资源对比微调像 Mistral 7B 或 Gemma 7B 这样的大型 LLM 与标准 BERT 变体在文本分类任务中的表现。@lavi_39761建议 Encoder 模型在分类用途上更合适且更高效。 - 令人费解的微调失败:

@frosty04212报告了在对已经微调过的 RoBERTa 模型进行 NER 微调时遇到的问题,出现了 0 和 NaN 的损失值。该问题在重新安装环境后似乎得到了解决。 - DeciLM 训练困境:

@kingpoki尝试使用 QLoRA 训练 DeciLM 7b,但遇到了与 Embedding 维度未设置为 8 的倍数相关的性能警告。用户们讨论了该警告的可能原因。 - Whisper 项目查询:

@psilovechai正在寻找一个带有 Gradio 界面的本地项目,用于训练和处理使用 Whisper 转录音频文件的任务。他们收到了关于可能提供解决方案的 GitHub 仓库建议。

提到的链接:

- climatebert (ClimateBert): 未找到描述

- Unifying the Perspectives of NLP and Software Engineering: A Survey on Language Models for Code: 在这项工作中,我们系统地回顾了使用语言模型进行代码处理的最新进展,涵盖了 50 多个模型、30 多个评估任务、170 多个数据集和 700 多篇相关论文。我们分解了…

- Matrix Multiplication Background User's Guide - NVIDIA Docs: 未找到描述

- DevEval: Evaluating Code Generation in Practical Software Projects: 如何评估 LLM 在代码生成中的表现是一个开放性问题。许多基准测试已被提出,但与实际软件项目不一致,例如,不真实的程序分布…

- NoFunEval: Funny How Code LMs Falter on Requirements Beyond Functional Correctness: 现有的代码语言模型(Code LMs)评估基准几乎完全集中在模型是否能生成功能正确的代码。在现实世界的软件工程中,开发者…

- Fine-Tuning or Retrieval? Comparing Knowledge Injection in LLMs: 未找到描述

- GitHub - jlonge4/whisperAI-flask-docker: I built this project because there was no user friendly way to upload a file to a dockerized flask web form and have whisper do its thing via CLI in the background. Now there is. Enjoy!: 我构建这个项目是因为没有一种用户友好的方式可以将文件上传到 Docker 化的 Flask Web 表单,并让 Whisper 在后台通过 CLI 执行任务。现在有了。尽情享受吧!

- Reddit - Dive into anything: 未找到描述

- Improve _update_causal_mask performance by alessandropalla · Pull Request #29210 · huggingface/transformers: 这个 PR 做了什么?修复了 # (issue) #29206。在提交之前,此 PR 修复了一个拼写错误或改进了文档(如果是这种情况,您可以忽略其他检查)。您是否阅读了贡献者…

- GitHub - alessandropalla/transformers: 🤗 Transformers: State-of-the-art Machine Learning for Pytorch, TensorFlow, and JAX.: 🤗 Transformers: 为 Pytorch, TensorFlow, 和 JAX 提供的尖端机器学习库。

- GitHub - innovatorved/whisper-openai-gradio-implementation: Whisper is an automatic speech recognition (ASR) system Gradio Web UI Implementation: Whisper 是一个自动语音识别(ASR)系统,这是其 Gradio Web UI 的实现。

- GitHub - amrrs/openai-whisper-webapp: Code for OpenAI Whisper Web App Demo: OpenAI Whisper Web App 演示代码。通过在 GitHub 上创建一个账户来为 amrrs/openai-whisper-webapp 的开发做出贡献。

HuggingFace ▷ #diffusion-discussions (15 条消息🔥):

- diffusion-discussion 简介:

@mfd000m是 Diffusion 模型讨论的新手,正在寻求关于如何使用akiyamasho/AnimeBackgroundGAN模型的建议,询问是应该克隆仓库还是使用 transformers 或 diffusion 等库。 - LM Studio 困惑:

@tmo97简要提到了 LM Studio,引发了@mfd000m询问它是什么,表明其对该术语或工具并不熟悉。 - 寻求跨语言模型微调指导:

@alielfilali01询问关于在不同语言(而非图像风格)上微调 Diffusion 模型的问题,并提到自己缺乏使用 diffusers 的经验,希望能获得社区在该领域的知识。 - 模型微调挑战:

@khandelwaal.ankit在使用特定数据集微调 Qwen/Qwen1.5-0.5B 模型时遇到困难,表示尽管尝试了各种超参数,loss 曲线仍然不稳定。 - 分享 Japanese Stable Diffusion 的成功案例:针对语言微调的查询,

@chad_in_the_house分享了 Japanese Stable Diffusion 模型卡片,并解释了其两阶段训练过程,可作为类似尝试的潜在蓝图。

提到的链接:

- rinna/japanese-stable-diffusion · Hugging Face:未找到描述

- дрездон 在 Instagram 上:”a warm breath… #drezzdon”:2.7 万次点赞,105 条评论 - drezzdon 于 2024 年 2 月 16 日:”a warm breath… #drezzdon”

- rinna (rinna Co., Ltd.):未找到描述

Eleuther ▷ #general (190 messages🔥🔥):

-

Prompt Template Batching 困境:用户

@rwamit正在寻求关于使用 langchain 封装器实现批处理以查询 GPT-4 的建议,原因是出于成本考虑。他们分享了通过复制提示词模板来一次性处理多条记录的方法,但面临处理时间大幅增加的问题(从 2s/it 增加到 60s/it),导致 5-6k 条记录的处理时间从 5 小时飙升至 96 小时。 -

Gemma Pytorch 代码疑点:由

@miaumo和@ad8e等用户发起的讨论围绕 Gemma 的 PyTorch 实现中的一段特定代码展开,涉及 RMSNorm 中一个奇怪的 +1 累加。大家对初始化以及这一细节的重要性进行了推测。 -

EfficientNet 辩论:

@vapalus认为虽然 EfficientNet 可能不适合所有任务,但它在结构化输入的分割任务中作为 backbone 表现良好。此前@fern.bear对 EfficientNet 进行了批评,对其营销和实际性能表示强烈不满。 -

Mistral Large 模型发布:发布了关于 Mistral Large 发布的公告,该模型被描述为具有强大 Benchmark 结果的前沿文本生成模型。公告强调该模型可通过 la Plateforme 和 Azure 获取(Mistral 新闻)。

-

DPO 论文澄清请求:

@staticpunch询问了 DPO 论文中描述的model_ref初始化过程,认为建议是先对偏好的补全内容进行有监督微调 (SFT),然后再进行 DPO。@elad7318和@alstroemeria313提供了澄清,确认了这一理解。

提到的链接:

- no title found:未找到描述

- SPIN Diffusion Demo V1 - a Hugging Face Space by UCLA-AGI:未找到描述

- Au Large:Mistral Large 是我们的旗舰模型,具有顶级的推理能力。它也可以在 Azure 上使用。

- gemma_pytorch/gemma/model.py at 01062c9ef4cf89ac0c985b25a734164ede017d0b · google/gemma_pytorch:Google Gemma 模型的官方 PyTorch 实现 - google/gemma_pytorch

- Transformers without Tears: Improving the Normalization of Self-Attention:我们评估了三种简单的、以归一化为中心的改进 Transformer 训练的变化。首先,我们展示了 Pre-norm 残差连接 (PreNorm) 和较小的初始化可以实现无 warmup 的训练…

- gemma_pytorch/gemma/model.py at 01062c9ef4cf89ac0c985b25a734164ede017d0b · google/gemma_pytorch:Google Gemma 模型的官方 PyTorch 实现 - google/gemma_pytorch

- whisper/whisper/model.py at ba3f3cd54b0e5b8ce1ab3de13e32122d0d5f98ab · openai/whisper:通过大规模弱监督实现鲁棒的语音识别 - openai/whisper

- GitHub - BlinkDL/SmallInitEmb: LayerNorm(SmallInit(Embedding)) in a Transformer to improve convergence:Transformer 中的 LayerNorm(SmallInit(Embedding)) 以提高收敛性 - BlinkDL/SmallInitEmb

- GitHub - Stability-AI/StableCascade: Official Code for Stable Cascade:Stable Cascade 官方代码。通过在 GitHub 上创建账号为 Stability-AI/StableCascade 做出贡献。

- Support Gemma · turboderp/exllamav2@cc1094a:未找到描述

- Support Gemma · turboderp/exllamav2@cc1094a:未找到描述

Eleuther ▷ #research (84 messages🔥🔥):

-

寻求关于 GRU 等门控单元的知识:

@mrgonao询问了关于解释为什么像 GRU 这样的门控单元 (Gated Units) 会如此命名的优质资源,表现出对“门控”这一术语的词源或概念推理的兴趣。目前没有回复提供任何链接或解释。 -

关于数学领域数字级 Tokenization 的论文查询:

@stellaathena询问了一篇关于数学中数字级 Tokenization 的论文标题,@random_string_of_character提供了由 Siavash Golkar 等人撰写的题为 “Digit-Level Language Models for Digit-level Mathematical Tasks” 的论文链接,可在 arxiv.org/abs/2310.02989 查阅。 -

Searchformer 论文引发热议:

@jckwind分享了论文 “Searchformer: Learning to Search Better Than A” arxiv.org/abs/2402.14083 的链接,该论文讨论了经过训练以模拟 $A^$ 搜索动态的 Transformer 模型如何比传统方法更高效地解决推箱子(Sokoban)谜题。 -

RLHF 中简单方法与 PPO 的对决:

@0x_paws链接了一篇论文 arxiv.org/abs/2402.14740,该论文在人类反馈强化学习(RLHF)的背景下,主张采用更简单的 REINFORCE 风格优化,而非近端策略优化(PPO),引发了关于语言模型强化学习中基础方法潜力的讨论。 -

介绍水印框架:针对

@hyperion.ai关于最先进文本水印技术的查询,@catboy_slim_和@ai_waifu提到了水印论文 “A Watermark for Large Language Models”,该论文建议在生成的文本中嵌入信号 arxiv.org/abs/2301.10226,而@dmayhem分享了一篇讨论在某些假设下创建鲁棒水印方案的不可能性的论文链接 arxiv.org/abs/2311.04378。

提到的链接:

- Beyond A*: Better Planning with Transformers via Search Dynamics Bootstrapping:虽然 Transformer 在各种应用场景中取得了巨大进展,但在解决复杂的决策任务方面,此类架构仍落后于传统的符号规划器。在本文中…

- Back to Basics: Revisiting REINFORCE Style Optimization for Learning from Human Feedback in LLMs:以人类反馈强化学习(RLHF)形式呈现的 AI 对齐正日益被视为高性能 LLM 的关键要素。\textsc{Proximal Policy Optim…

- A Watermark for Large Language Models:LLM 的潜在危害可以通过对模型输出添加水印来减轻,即在生成的文本中嵌入对人类不可见但可以从短文本中通过算法检测到的信号…

- How Transformers Learn Causal Structure with Gradient Descent:Transformer 在序列建模任务上的惊人成功很大程度上归功于自注意力机制,它允许信息在序列的不同部分之间传递…

- xVal: A Continuous Number Encoding for Large Language Models:由于数字 Tokenization 的独特困难,LLM 尚未广泛应用于科学数据集的分析。我们提出了 xVal,一种数值编码方案…

- Towards Efficient and Exact Optimization of Language Model Alignment:语言模型与人类偏好的对齐对于其在现实任务中的应用至关重要。该问题被表述为优化模型的策略以最大化预期奖励…

- Bayesian Reward Models for LLM Alignment:为了确保 LLM 的回答是有帮助且无毒的,我们通常会在人类偏好数据上微调奖励模型。然后我们选择具有高奖励的策略响应(best-of-…

- MobileLLM: Optimizing Sub-billion Parameter Language Models for On-Device Use Cases:本文针对移动设备上对高效 LLM 日益增长的需求,这是由不断增加的云成本和延迟担忧驱动的。我们专注于设计高质量的 LLM,具有…

- Watermarks in the Sand: Impossibility of Strong Watermarking for Generative Models:为生成模型添加水印包括在模型输出中植入统计信号(水印),以便稍后验证输出是否由给定模型生成。一个强…

-

Just Ask for Calibration: Strategies for Eliciting Calibrated Confidence Scores from Language Models Fine-Tuned with Human Feedback:一个值得信赖的现实世界预测系统应该产生经过良好校准的置信度分数;也就是说,它对答案的信心应该能指示该答案正确的可能性,从而使…

- Beyond A*: Better Planning with Transformers via Search Dynamics Bootstrapping: 虽然 Transformer 在各种应用场景中取得了巨大进步,但在解决复杂的决策任务方面,此类架构仍落后于传统的符号规划器。在本文中…

- Training Chain-of-Thought via Latent-Variable Inference: 当被指示使用“Chain-of-Thought”(CoT)提示逐步得出答案时,大型语言模型(LLMs)解决问题的准确性和可解释性更高。人们还可以改进…

- 来自 Lorenzo (Yunze) Xiao (@LrzNeedResearch) 的推文: 你是否觉得你的 AI 动漫角色总是崩人设?我们该如何评估这一点?我很高兴介绍我们的工作:InCharacter —— 一个评估人格忠实度的全新视角…

- GitHub - kirilligum/trust-and-teach: 通过在 GitHub 上创建账户,为 kirilligum/trust-and-teach 的开发做出贡献。

- GitHub - nbardy/tiny_moe: 通过在 GitHub 上创建账户,为 nbardy/tiny_moe 的开发做出贡献。

- MPIrigen: MPI Code Generation through Domain-Specific Language Models: 在众多节点上扩展计算的迫切需求凸显了高效并行计算的重要性,特别是在消息传递接口(MPI)集成的领域。这…

- GitHub - EleutherAI/lm-evaluation-harness: 一个用于语言模型 few-shot 评估的框架。: 一个用于语言模型 few-shot 评估的框架。 - EleutherAI/lm-evaluation-harness

- Pipelined Stochastic Gradient Descent with Taylor Expansion: 随机梯度下降(SGD)是一种通常用于深度学习中训练深度神经网络(DNN)模型的优化方法。在最近的 DNN 训练研究中,流水线并行(pipeline parallelism)作为一种…

- 我为 UT 有效利他主义做的 AI Safety 讲座): 两周前,在我在 OpenAI 工作半年之际,我做了一场讲座,阐述了我目前对 AI Safety 的想法。我是受德克萨斯大学奥斯汀分校有效利他主义俱乐部的邀请进行演讲的。你可以观看…

Eleuther ▷ #interpretability-general (18 条消息🔥):

- 探索语言透镜微调 (Linguistic Lens Tuning):

@butanium分享了一个假设,即在中文上训练经过调优的 linguistic lens 会教会它从英文翻译成中文,这表明如果模型最初是用英文“思考”的,那么这就是结果。 - 研究语言 Token:

@butanium预测,即使对于英文任务,中文 Token 也会变得更加频繁,这表明由于透镜微调可能存在潜在的底层转变。 - 语言图表的代码难题:

@mrgonao正试图调整代码,将图表中的 “en” Token 替换为 “zh” Token,以更好地理解中文透镜,但由于时间限制,推迟了对该问题的深入研究。 - 翻译任务中的数据集困境:

@mrgonao注意到为翻译任务生成的数据集出现了奇怪的行为,存在错误的语言关联,并在与@butanium讨论后澄清了自己的错误。该问题已记录在 GitHub 上。 - 调查多语言模型表示:

@mrgonao通过考虑中性语言对(法语到德语)分享了语言透镜的视觉分析,而@norabelrose建议语言显著性(saliency)可能与语料库频率相关。该分析基于 llama-2-7b 模型,并计划与 llama-2-13b 进行比较。

Eleuther ▷ #lm-thunderdome (30 messages🔥):

-

寻求帮助:调查

lm_eval挂起问题:@flobulous在运行评估后遇到了lm_eval无限期挂起的问题,特别是在使用vllm模型时。他们分享了命令和代码库 commitf78e2da45f034a23b1b13cde3235105b0f55d830以寻求协助。 -

揭示 LLM 评估的不一致性:

@.rand0mm指出了一项由@AlhamFikri分享的研究,强调了 LLM 在多选题 (MCQ) 和自由文本评估之间的一致性差异。该研究的详细内容见 arXiv 上的这篇论文。 -

使用

lm-eval复现 Open LLM Leaderboard 结果:@hailey_schoelkopf提供了关于如何使用lm-eval复现 Open LLM Leaderboard 结果的详细说明。他们强调应使用特定的 commit 以及 Open LLM Leaderboard HF space 中概述的统一设置。 -

对

lm-eval更好的代码级使用需求:@ariel2137询问了关于lm-eval“代码级使用 (code-level usage)”接口的潜在扩展和改进。@hailey_schoelkopf对提升使用体验持开放态度,并邀请大家提供反馈和建议。 -

多语言评估支持的需求:由

@.johnnysands发起的关于多语言评估的讨论促成了为新语言复制配置的建议。@.rand0mm提到 MMLU 已经使用 GPT-3.5 turbo 翻译成了法语,并可在 Hugging Face datasets 上获取。

提到的链接:

来自 Alham Fikri Aji (@AlhamFikri) 的推文:许多 LLM 评估使用限制性的多选题 (MCQ) 格式,但在实践中,这些 LLM 以更具开放性的自由文本格式使用 🔎 我们的新研究揭示了它们基于概率的 M…

Eleuther ▷ #gpt-neox-dev (6 messages):

- 对升级 Python 3.10 的犹豫:

@catboy_slim_表达了对升级到 Python 3.10 的犹豫,原因是担心测试覆盖率,暗示此项变更缺乏紧迫性。 - 对 GPT-NeoX 开发的好奇:

@catboy_slim_对某些开发选择背后的原因表示感兴趣,而@80melon则表示相比于继续关注 GPT-NeoX,他更倾向于使用自定义训练循环 (custom training loop)。 - 处理配置错误:

@jdranpariya在尝试在配置中禁用 deepspeed 时遇到了ValueError,这表明在调整设置时 NeoXArgs 的验证可能存在问题。 - 多语言 Tokenization 优化:

@rand0mm询问了扩展 Mistral tokenizer 以更有效地表示其他语言的最佳数据源,指向了提升多语言能力的努力。

LlamaIndex ▷ #blog (5 条消息):

-

Create-llama 发布 LlamaPack 集成:

@llama_index宣布了最新的 create-llama 版本,通过使用 LlamaPack,只需两行代码即可构建全栈 Web 应用。此功能展示了将高级 RAG 概念集成到项目中的便捷性。关于 create-llama 的推文 -

Counselor Copilot 项目备受关注:

@llama_index的一条推文介绍了 Counselor Copilot 项目,这是一个具有社会影响力的 RAG 应用,旨在为危机辅导员提供助手服务。该项目也是将高级 RAG 作为 Copilot 而非简单 Chatbot 使用的参考案例。介绍 Counselor Copilot 的推文 -

全面的 RAG 痛点速查表:

@llama_index分享了一个视频演示,由 @wenqi_glantz 深入探讨她的“12 个 RAG 痛点及解决方案”博客文章,旨在解决 RAG 部署每个阶段的问题。该文章是 RAG 开发者的必备速查表。关于 RAG 演示的推文 -

通过子文档摘要改进 RAG 检索:

@llama_index分享了一种通过使用子文档摘要来增强 RAG 检索性能的技术,以对抗传统分块(chunking)中的全局概念感知问题。通过将摘要作为元数据注入,每个分块都获得了上下文增强。讨论分块技巧的推文 -

LlamaParse 克服 PDF 中的表格表示挑战:

@llama_index的推文介绍了 LlamaParse,这是一款擅长处理嵌入式表格和图表的 PDF 解析器,对于构建高质量的 RAG 应用至关重要。准确的表格表示确保 LLM 接收到清晰的信息,从而得出正确的答案。关于 LlamaParse 的推文

LlamaIndex ▷ #general (234 条消息🔥🔥):

-

探索自定义 LLMPrompt 模板:

@andreipopg正在尝试了解如何将自定义 Prompt 与 SubQuestionQueryEngine 结合使用。用户收到了诸如“使用 RouterQueryEngine 选择特定数据源”的建议,并获知“SubQuestionQueryEngine 使用 Prompt 生成子问题”,该 Prompt 可以自定义(GitHub 示例)。 -

解决安装问题:

@chbla.在安装llama_index时遇到问题,特别是set_global_handler和Settings。@whitefang_jr建议使用pip uninstall llama-index进行彻底重装,这解决了@chbla.的问题。 -

RAG 与非 RAG 评估:

@addo__希望在数据集上评估带有 RAG 的 GPT-3.5 与不带 RAG 的对比。@whitefang_jr提供了使用 LlamaIndex 的FaithfulnessEvaluator来处理非 RAG 选项的解决方案。 -

本地 LLM 集成咨询:

@miteshgarg_61244寻求将本地离线微调的 LLM 模型与 LlamaIndex 的NLSQLTableQueryEngine和SQLTableRetrieverQueryEngine结合使用。@whitefang_jr建议在Settings中将本地 LLM 设置为全局默认值,并可能使用 FastAPI 在本地服务器上部署模型。 -

LlamaIndex Chat Engine 详情:

@vett93想知道在观察到不同 LLM 产生不同结果后,index.as_query_engine()和index.as_chat_engine()之间的区别。@whitefang_jr解释说,index.as_query_engine()查询数据以获取响应,而index.as_chat_engine()则考虑对话历史以进行有状态的交互。

提到的链接:

- Google Colaboratory:未找到描述

- 无标题:未找到描述

- 无标题:未找到描述

- semantic-text-splitter:将文本拆分为语义分块,直至达到所需的块大小。支持按字符和 Token 计算长度(与大语言模型配合使用时)。

-

[保险业贷款协议 Justia](https://contracts.justia.com/categories/business-finance/subcategories/loan-agreements/industries/insurance/):未找到描述 - TikTokLive v6.0.1:未找到描述

- seman:未找到描述

- 微调 - LlamaIndex 🦙 v0.10.13: 未找到描述

- 概览: 未找到描述

- 语义分块器 - LlamaIndex 🦙 v0.10.13: 未找到描述

- 成本分析 - LlamaIndex 🦙 v0.10.13: 未找到描述

- 使用 LabelledRagDataset 进行评估 - LlamaIndex 🦙 v0.10.13: 未找到描述

- 路由 - LlamaIndex 🦙 v0.10.13: 未找到描述

- 使用 LlamaIndex 实现多租户 RAG - LlamaIndex 🦙 v0.10.13: 未找到描述

- 聊天引擎 - LlamaIndex 🦙 v0.10.13: 未找到描述

- llama_index/llama-index-integrations/question_gen at main · run-llama/llama_index: LlamaIndex 是一个用于 LLM 应用的数据框架 - run-llama/llama_index

- llama_index/llama-index-core/llama_index/core/agent/react/formatter.py at 14c52d42a4a12bc63db7f582e9a17c91f5984f15 · run-llama/llama_index: LlamaIndex 是一个用于 LLM 应用的数据框架 - run-llama/llama_index

- llama_index/llama-index-core/llama_index/core/agent/react/base.py at 14c52d42a4a12bc63db7f582e9a17c91f5984f15 · run-llama/llama_index: LlamaIndex 是一个用于 LLM 应用的数据框架 - run-llama/llama_index

- llama_index/llama-index-core/llama_index/core/agent/react/prompts.py at 14c52d42a4a12bc63db7f582e9a17c91f5984f15 · run-llama/llama_index: LlamaIndex 是一个用于 LLM 应用的数据框架 - run-llama/llama_index

-

[ Globe Explorer - 一个发现引擎,任何事物的维基百科页面 Product Hunt](https://www.producthunt.com/posts/globe-explorer): Explorer 是一种可视化分解任何主题的方式。它使用 LLM 来理解您的查询,并以视觉化方式生成该主题的详尽页面,让您能够以一种不同于搜索的方式探索信息…… - LlamaIndex 网络研讨会:使用 Flowise 构建无代码 RAG: Flowise 是构建 LLM 驱动工作流的领先无代码工具之一。用户无需学习如何在框架/编程语言中编写代码,而是……