ainews-andrew-likes-agents

安德鲁喜欢智能体。

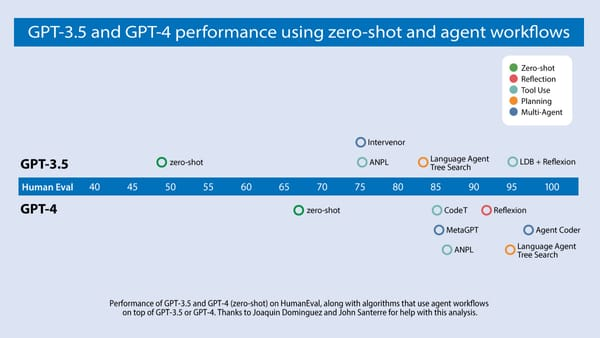

吴恩达在《The Batch》中关于智能体(Agents)的专题文章指出,采用迭代式智能体工作流能显著提升代码基准测试的性能。其中,GPT-3.5 在智能体循环(agent loop)的加持下,在 HumanEval 测试中的正确率高达 95.1%,远超 GPT-4 在零样本(zero-shot)模式下 67.0% 的表现。

该报告还涵盖了 Stable Diffusion 模型的新进展,包括用于生成火影忍者风格图像的 Cyberrealistic_v40、Platypus XL 和 SDXL Lightning,以及 LoRA 和上采样(upscaling)技术的创新。此外,文中还讨论了本地大语言模型(LLM)的部署与优化,重点关注硬件配置和微调策略,以实现高效推理和多用户服务。最后,报告还提到了 Emad 从 Stability AI 离职以及 OpenAI 发布的新 Sora 视频。

2024年3月21日至3月25日的 AI 新闻。我们为您查看了 364 个 Twitter 账号 和 22 个 Discord 社区(包含 342 个频道和 12281 条消息)。预计节省阅读时间(以 200wpm 计算):1173 分钟。

Andrew Ng 在 The Batch 上关于 Agent 的文章 本周末在各大平台引起了轰动:

Devin 最近引人注目的演示在社交媒体上引起了大量关注。我的团队一直在密切关注编写代码的 AI 的演进。我们分析了多个研究团队的结果,重点关注算法在广泛使用的 HumanEval 编程基准测试中的表现。您可以在下图中看到我们的发现。

GPT-3.5 (zero shot) 的准确率为 48.1%。GPT-4 (zero shot) 表现更好,达到 67.0%。然而,从 GPT-3.5 到 GPT-4 的提升,在引入迭代式 Agent 工作流(iterative agent workflow)后显得相形见绌。事实上,在 Agent 循环的封装下,GPT-3.5 的准确率最高可达 95.1%。

对于研究过 Agent 领域的专业人士来说,这些内容并不新鲜,但 Andrew 的公信力和 Agent 框架(非常接近 Lilian Weng 的观点 + 最近多智能体协作 multiagent collaboration 的新玩法)使其极具说服力。

我们今天发布了 《ChatGPT 的解构》(The Unbundling of ChatGPT)。此外,Emad 已从 Stability 辞职,并且有 更多 Sora 视频 发布,请务必查看 Don Allen Stevenson III 的作品。

目录

[TOC]

我们增加了更多的 subreddit,并正在综合其中的主题。评论抓取尚未实现,但即将推出。

Stable Diffusion 模型与技术

- 新的 Stable Diffusion 模型和技术正在开发中,例如用于生成火影忍者风格图像的 Cyberrealistic_v40、Platypus XL 和 SDXL Lightning。(Playing with Cyberrealistic_v40, Still Liking Platypus XL, Naruto (Outputs from SDXL Lightning))

- /r/StableDiffusion: 正在探索 LoRA 和放大(upscaling)方法以提高图像质量,例如在保留内容的同时将图像卡通化(平滑阴影、强化轮廓),以及用于消除常见问题的通用负面提示词(negative prompt)LoRA。(best LORA or method with sd1.5 to cartoon-ize an image while keeping content? (flatten shading, reinforce outlines), General purpose negative prompt?)

- /r/StableDiffusion: 正在为 Stable Diffusion 开发新的工作流和扩展插件,例如用于 ComfyUI 放大的 BeautifAI、用于混合模型权重的 FrankenWeights,以及在 Fooocus 中集成 Prompt Quill 扩展。(BeautifAI - Image Upscaler & Enhancer - ComfyUI, It’s alive! FrankenWeights is coming… [WIP], Prompt Quill in Fooocus)

本地 LLM 部署与优化

- /r/LocalLLaMA: 在本地部署大语言模型是一个热门话题,讨论围绕硬件要求、推理速度以及针对不同使用场景的模型选择展开。(将 P40 24GB 与 3090 组合以获得 48GB VRAM 是否合理?, 4090 和 64GB RAM 的最佳输出质量?, 你的电脑配置是什么?)

- /r/LocalLLaMA: 优化 LLM 性能是一个活跃的研究领域,讨论涉及推理架构、微调策略以及如何高效地为多用户提供服务。(什么样的架构能带给我们具备推理能力的 LLM?, 只工作不玩耍会让 LLM 变傻;为什么我们在微调时应该混入预训练数据。, 是否可以使用 llama-cpp-python 同时为多个用户提供服务?)

- /r/LocalLLaMA: 指南与资源正在不断完善,旨在帮助用户从入门到进阶掌握本地 LLM。(新用户入门指南:从纯小白到资深用户,第 1/3 部分,再次尝试…)

机器学习研究与技术

- /r/MachineLearning: 新的机器学习架构与技术不断被提出和讨论,例如使用硬注意力(hard attention)和决策树进行因果语言建模的 Treeformers。([P] Treeformer:硬注意力 + 决策树 = 因果语言建模)

- /r/MachineLearning: 部署 ML 模型的优化技术正在被探索,例如使用 TensorRT 进行快速 PyTorch 模型推理。([D] 寻找在 TensorRT 上运行 PyTorch 模型的最快推理方式)

- /r/MachineLearning: 调试与改进 ML 模型是一个持续的挑战,讨论集中在理解和修复测试损失(test loss)激增等问题上。([D] 有人知道为什么我的测试损失会如此疯狂地激增吗?)

AI 助手与应用

- /r/OpenAI: AI 助手正以全新的方式被使用,例如调解争论以提供中立视角,以及辅助编程任务。(使用 ChatGPT 调解争论, 可在 3090 上运行的编程 LLM)

- /r/StableDiffusion: 新的 AI 应用正在开发中,例如 AI 网红、交互式“AI 画笔”工具,以及基于图像探索 AI 生成世界的沉浸式体验。(这是我在没有任何 Stable Diffusion 经验的情况下,尝试制作 AI 网红和 Fanvue/OF 模型的最初 45 天, 使用 StreamDiffusion 构建交互式“AI 画笔”的快速拆解, 对未来感到兴奋)

迷因与幽默

- AI 生成的迷因与幽默内容继续流行,调侃 AI 的现状。(不要使用在成人内容上训练的模型生成树, “兄弟,千万别在加油站买大麻”, 确实就是这样)

PART X: AI Twitter 回顾

所有回顾均由 Claude 3 Opus 完成,取 4 次运行中的最佳结果

模型发布与更新

- Mistral AI 发布了全新的 7B 0.2 base 模型,具有 32k context window,在黑客松上宣布(1.3万次观看)

- 量化 4-bit Mistral 7B 模型发布,通过 QLoRA finetuning 实现推理速度提升 2 倍,VRAM 占用减少 70%(1.4万次观看)

- Mistral 7B 0.2 预计将超越 Yi-9B(486次观看)

开源努力与挑战

- Stability AI 的 Emad Mostaque 在投资者反水和员工流失后离职(1.1万次观看)

- 如果过去十年的 AAA 游戏不是“烂透了”,开源 AI 会更好,这使得高端 GPUs 在游戏领域变得不值(1.7千次观看)

- 没有分布式预训练,开源 AI 就不是真正的开源,不能指望 VCs 投入数百万美元后又将其免费赠送(468次观看)

新兴应用与演示

- 金融 Agent 应用 使用 LangChain 构建,可获取股票价格、财务数据、市场新闻(4.6万次观看)

- Telegram 代理设置指南 用于利用内置代理功能规避西班牙可能的禁令(5万次观看)

- 由 Mistral 7B 驱动的跳舞机器人 在黑客松上演示(9.8千次观看)

- Claude 对 Claude 的对话 引发了令人担忧的输出,如“精神崩溃”(5.3万次观看)

PART 0: 总结之总结之总结

-

Mistral 发布新 7B v0.2 Base 模型:Mistral AI 在 @cerebral_valley 黑客松上随手发布了他们新的 Mistral 7B v0.2 Base 模型,具有 32k context window 以及在发布说明中详述的其他改进。AI 社区正热烈讨论这一重大更新的影响和 benchmarking 结果。

-

Stability AI CEO Emad Mostaque 辞职:在一次重大动荡中,Emad Mostaque 辞去了 Stability AI 的 CEO 职务以追求去中心化 AI。临时联合 CEO Shan Shan Wong 和 Christian Laforte 将领导寻找正式继任者的工作。在这次领导层更迭中,关于公司未来方向和对开源倡议承诺的猜测四起。

-

Anthropic 的 Claude 尽管有限制但表现出色:用户称赞 Anthropic 的 Claude 的性能和上下文处理能力,尤其是自我调节版本,但对 200k context window 每天严格的 1M token 速率限制表示沮丧。$500 规模计划被认为是更适合大规模使用的选择,而 Claude 的 API 在开源开发方面的潜力也引发了兴奋。

-

优化器和架构推动 LLM 进步:新型优化器如 GaLore 和架构如 DenseFormer 正在推高语言模型训练效率和性能的边界。讨论围绕 GaLore 显著的 VRAM 节省和潜在的过度训练风险展开,而 DenseFormer 的深度加权平均显示出有前景的 perplexity 改进。社区热切期待这些领域的进一步发展。

-

AI 助手和 Agent 进化:像 Open Interpreter 的 01 Light(一个完全开源的个人 AI Agent)和来自 Nous Research 的 World Simulator 等项目,以其引人入胜的体验和定制潜力吸引了社区的想象力。同时,像 LangChain 这样的框架正在为 AI Agent 实现更复杂的决策和任务自动化,各种分享的指南和教程也证明了这一点。

PART 1: 高层级 Discord 总结

Stability.ai (Stable Diffusion) Discord

-

SD 生态系统反响热烈:社区正在积极讨论 Stable Diffusion 模型,特别是对即将发布的 SD3 充满期待,围绕潜在的改进以及与 SDXL 等模型的对比分析展开了热议。此外,还提出了关于 AMD GPU 兼容性的问题,成员们分享了解决方案和变通方法。

-

点击即得 AI 艺术,但并非一帆风顺:用户对 Civitai 和 Suno 等在线 AI 图像生成服务表示了不满,理由是内容限制和生成内容的类型问题。社区成员分享了 Stable Cascade Examples 等资源,以展示不同模型的能力。

-

监管争议:关于 AI 技术监管影响的辩论呈现两极分化。伦理考量与对扼杀创新的担忧并存,反映出社区对开源开发与专有限制之间平衡的关注。

-

技术支持社区:随着新手和资深人士共同应对模型安装相关的技术难题,社区形成了浓厚的知识共享氛围。成员们分享了学习和排查故障的资源,包括支持频道的直接链接和社区内的专家建议。

-

连接 AI 资源:分发了各种链接以提供更多信息和实用工具,例如 Stable Diffusion Glossary,以及一个全面的 Stable Diffusion 多平台包管理器 StabilityMatrix。这些工具旨在帮助 AI 工程师理解并增强对 Stable Diffusion 产品的使用。

Unsloth AI (Daniel Han) Discord

- 在内存限制内创新:PyTorch

torchtune仓库的一个最新 Pull Request 允许在保持内存占用低于 16GB 的情况下进行全模型微调,使拥有消费级 GPU 的用户能够更高效地进行训练。 - 增强微调能力:Hugging Face PEFT 的最新版本 (v0.10.0) 包含了 LoftQ,它改进了大模型的微调效果。

- 在 Mistral 上实现 ORPO:一位用户报告了在 Mistral-7B-v0.2 上使用 argilla/ultrafeedback-binarized-preferences-cleaned 数据集有效应用 ORPO TRL 的情况,表明该方法具有进一步优化的潜力。

- 讨论 AI 模型训练的最佳实践:各频道的讨论涉及 ORPO 中的多轮对话训练挑战、标准化格式的重要性,以及使用 Ollama templates 和不同量化模型(Quant models)时的紧迫问题。

- 模型性能里程碑:社区庆祝了新模型的性能表现,如 sappha-2b-v3 和 MasherAI-v6-7B,据报道,这些模型在通过 Unsloth 对 Gemma-2b 进行微调后,超越了基准测试。

Perplexity AI Discord

-

Perplexity Pro 用户就图像生成功能展开讨论:Pro 用户讨论了 Perplexity 的图像生成功能,并指出在网页版上关闭 Pro 开关可以使用 Writing 模式进行图像生成。

-

模型对决:Claude Opus 对阵 GPT-4 Turbo:工程师们的闲聊涉及对比 Claude 3 Opus 和 GPT-4 Turbo,强调 GPT-4 Turbo 可以编译 Python 文件,而 Perplexity 则不行。

-

Stability AI 本地模型引发关注:关于 Stability AI 的本地模型(如 SDXL)讨论热烈,重点在于性能与在个人硬件上运行这些工具的沉重成本之间的权衡。

-

Perplexity 的困惑与潜力:用户对 Perplexity 的某些方面感到困惑,包括侵入性的搜索触发和无关的提示词,同时也展望了 Claude 3 Opus API 以及与 iOS Spotlight 搜索集成等功能。

-

在 Token 限制内编写代码:对于使用 Perplexity API 的工程师来说,一个关键提示是注意 16,384 Token 限制,并建议使用 OpenAI 的 Tokenizer 等工具来准确测量 Token 数量,以遵守限制并实现最佳运行。

LM Studio Discord

-

为 AI 驯服 VRAM 巨兽:工程师们讨论了运行 AI 模型的最佳 GPU,RTX 3090 的 24GB VRAM 是一个热门选择。在配置多 GPU 设置时,注意到了不同 GPU 品牌(如 AMD 和 NVIDIA)之间的兼容性问题。

-

本地 LLM 掀起技术革命:关于 LLM 分布式计算可行性的讨论显示出疑虑,主要原因是使用 ZLUDA 配合 ROCm 时 CPU 占用率过高,尽管类似于 Linux/LAMP 时代的本地计算极具吸引力。

-

文档发布与多模型热潮:LM Studio 推出了新文档网站,并引入了多模型会话(Multi Model Session)功能,教程视频中对此进行了讲解。

-

LM Studio 的成长的烦恼与性能怪癖:用户报告了从 高 CPU 占用率到模型输出乱码等问题,有时通过简单的重启即可解决。对于 RX 570 配合 ROCm 等旧硬件的兼容性受到质疑,加载模型时出现的 “Exit code: 42” 等错误信号表明需要持续排查故障。

-

Open-interpreter 拆解与 GGUF 模型性能:Open-interpreter 的问题包括连接故障以及对各种 GGUF 兼容模型性能的讨论。Open Interpreter 设备引起了关注,用户可以使用来自 01.openinterpreter.com/bodies/01-light 的免费 STL 文件自行 3D 打印。同时,非官方支持模型的错误促使人们关注 Open-interpreter GitHub 上的 issue #1124。

OpenInterpreter Discord

-

Open Interpreter 进军 Linux:用户已成功在 Ubuntu 22.04 上运行 Open Interpreter,讨论了麦克风支持和客户端-服务器机制,标志着向跨平台兼容性的推进。

-

DIY 爱好者集结!O1 Light 热潮:社区的热心成员正在分享 3D 打印和组装自己的 01 Light 设备的技巧,专门的 Discord 频道纷纷涌现,用于分享构建经验和设计调整。

-

AI 驱动的工程讨论升温:围绕 Open Interpreter 的技术对话正在扩大,重点是在各种机器(无论是低配还是云端)上运行 01 服务器,并增强安装程序的易用性。开发者们还在构思 Groq 的集成以及扩展 01 Light 的功能。

-

社区贡献释放开源力量:AI 工程师社区正投入到 Open Interpreter 项目的贡献中,重点关注应用开发、不同 LLM 的性能,以及适用于 Apple silicon 设备的潜在桌面应用。

-

开源 AI 助手登场:一段关于 01 Lite 的 YouTube 视频被重点推荐,标题为“Open Interpreter’s 01 Lite - 全球首款完全开源的个人 AI Agent 设备”,展示了这款自研 AI 助手的强大能力。此外还分享了一个剪辑过的直播视频,以简要概述 01 软件 Open Interpreter’s 01 Lite。

LAION Discord

-

欧盟数据法挑战 LAION 的效率:与美国数据集相比,LAION 数据集的表现可能不佳,这在很大程度上归因于欧盟严格的监管。讨论中提到了使用合成数据以及在限制较少的地区建立合作作为可能的变通方案,被幽默地称为“数据洗白”。

-

Stability AI 领导层变动:Emad Mostaque 已辞去 Stability AI 的 CEO 职务,公司确认了他的辞职,并任命了临时联合 CEO Shan Shan Wong 和 Christian Laforte,他们将负责寻找继任者。人们对这一变动对公司未来及其对开源承诺的影响存在各种猜测 (Stability AI 新闻稿)。

-

SD3 与 DALL-E 3 的对比:讨论表明,SD3 模型在某些方面的表现可以与 DALL-E 3 媲美,但在理解复杂的交互方面表现吃力,导致生成的图像更像是拼贴式的图像组装,而不是连贯的概念融合。

-

行业风波中浮现的 AI 伦理辩论:最近在 Twitter 上关于 AI 行业领军人物动机的对话引发了全频道范围内关于开发者和研究人员伦理责任的辩论,以及社交媒体上 AI “名人”文化的影响。

-

AMD GPU 在 AI 支持方面落后:频道成员对 AMD 与 NVIDIA 相比在机器学习工作负载方面的支持表示不满。鉴于 Stable Diffusion 等模型的兴起,缺乏消费级机器学习支持被视为一种潜在的疏忽。

-

Andrew Ng 预见 AI 工作流的演进:Google Brain 联合创始人 Andrew Ng 预测,AI agentic workflows 今年可能通过对文档进行多次迭代而超越下一代基础模型。目前的 one-shot LLM 方法需要进化 (Reddit 热帖)。

-

MIT 加速图像生成技术:MIT CSAIL 开发了一种方法,通过使用简化的单步教师-学生框架,在不损失图像质量的前提下,将 Stable Diffusion 和 DALL-E 等工具的图像生成过程加速了 30 倍 (MIT 新闻文章)。

-

NVIDIA 解决扩散模型训练障碍:NVIDIA 最近的博客文章讨论了扩散模型训练的改进,包括 EDM2 代码和模型的发布。他们解决了风格归一化问题,这些问题可以通过类似于 EDM2 中的更改来克服 (NVIDIA 开发者博客文章)。

-

随着线性网络的兴起,Unet 的未来受到质疑:鉴于用于图像生成的线性网络模型的兴起,频道成员辩论了 Unet 改进的相关性。尽管 layer norm 和传统的归一化方法受到质疑,但它们作为网络功能的组成部分仍然是一个讨论话题。

-

大语言模型在剪枝中表现出韧性:研究发现,即使移除中间块,大语言模型 (LLMs) 仍能保持性能,这暗示了某些片段的冗余性。这鼓励了对线性网络架构及其战略剪枝潜力的深入研究。

Nous Research AI Discord

-

发货查询与 DIY 解决方案:成员们对某款未命名产品的发货时间表感到好奇,期待在夏季上市。在缺乏具体发布日期的情况下,他们讨论了替代的 DIY 方案。

-

AI 模型创新与乐观情绪:对 Claude 在开源项目上的影响抱有极高热情。据报道,一种无需预训练的 Raptor 实现仅需 5 分钟即可总结 3b 模型的转录内容。分享了关于 FastAPI 在后端开发易用性方面的参考资料,以及关于 Suno.AI 策划 Spotify 播放列表能力的说明。

-

部署与说服技术分析:利用 Kubernetes 部署 Nous 模型,同时一项预注册的 arXiv 研究 分析了 LLM 的说服力。ArtHeart.ai 等平台在 AI 驱动的艺术创作方面获得认可,并对 BitNet 1.5 的量化感知训练(quantized-aware training)在推理加速方面的表现进行了评估。

-

编织世界与 AI 辅助治疗:World Simulator 项目展现了极高的参与度,而名为 Thestral 的 AI 治疗师项目旨在利用 LLaMA 70B 模型。社区正在积极讨论 Claude 3 中 Opus 的伦理约束、Hermes 2 Pro 等模型中拒绝提示词(refusal prompts)的影响,以及规避被称为“奥弗顿窗口(Overton Effect)”的 LLM 限制的操纵技术。

-

LLM、微调与精炼问题:围绕 SFT 数据集中是否包含 few-shot prompts 以及对微型 LLM 的追求展开了辩论,并建议观看 Andrej Karpathy 的视频。因果掩码(causal masking)的重要性以及 Llama 三层前馈设计背后的奥秘引发了讨论,焦点集中在一篇关于 SwiGLU 非线性的 arXiv 论文上。

-

育儿、开源与 RAFT 的崛起:成员们在寻找 Wikipedia RAG Index 等开源选项时,也分享了育儿经验。对话重点转向了一种名为 RAFT 的极具前景的检索增强微调方法,该方法在分享的论文中有所讨论,并可在 Gorilla GitHub 仓库中进行探索。

-

闲聊与 World-Sim 技术:一位成员暗示更改 Tenor.com 的语言设置,并分享了一个 Grim Patron GIF,而另一位成员简单的“helloooo”活跃了聊天气氛。

OpenAI Discord

-

Sora 塑造电影制作的未来:OpenAI 的 Sora 因赋能艺术家和电影制作人创作开创性的超现实艺术而受到赞誉。导演 Paul Trillo 称赞 Sora 能够将以前无法想象的创意视觉化,OpenAI 博客强调了其潜力。

-

深入探讨 AI 的文化指南针:AI 讨论中的一个热门话题是 GPT 等语言模型中被察觉到的西方自由中心主义偏见,这引发了关于是否应该存在多个文化对齐的 AI 版本的辩论。将 AI 与非西方规范对齐的努力正面临挑战,“自定义 ChatGPT”功能被提及作为用户根据自身价值观个性化 AI 回复的工具。

-

GPT-4 不断演进的功能与访问关注:成员们注意到 Custom GPT 固定限制有所减少,并寻求共享 GPT 访问的键盘快捷键。OpenAI 确认了 GPT-4 with Vision 读取图像的能力,同时通过停用通知宣布 ChatGPT 插件测试版结束。

-

精炼 AI 以丰富用户体验:分享了增强 AI 创意写作、叙事风格和代码输出质量的策略。一位用户因 OpenAI SDK 更新而在使用

.Completion端点时遇到问题,并被引导至 openai-python GitHub 仓库上的 v1.0.0 迁移指南寻求帮助。 -

实现视觉无障碍:为一位希望改善残障人士图像识别能力的成员提供了隐私敏感建议,重点是将问题提交至 Discord 建议频道。用户还探索了 Prompt Engineering 策略,以塑造具有特定个性的 AI,并优化假设段落的生成,避免通用化陈述。

HuggingFace Discord

AI Art Prompt Guide Quest: 用户正在寻求关于创作 AI 生成艺术提示词的建议,尽管未提供具体资源。

Blenderbot’s Role-Play: 讨论强调了 Blenderbot 在互动中展现一致性格特征的能力,这与那些承认自己非人类本质的 AI 形成对比。

GPU Operation Showdown: 围绕 GPU 上乘法和条件检查执行速度差异展开了技术辩论。建议参考 ‘iq’ 的工作以获得进一步见解。

Complex Creativity for ChatGPT: 一位用户为 ChatGPT 请求了一个语言多样且富有创意的提示词,引发了另一位用户对该提示词复杂性的惊叹。

Optimizing GPU Inference: 社区探索了使用 TensorRT-LLM 和 exLLama v2 等方法和库来优化 GPU 上的 LLM 推理,并推荐了适合多用户并发服务的工具。

Rust’s Rising Star: 关于通过 Candle 库将 GLiNER 模型转换为 Rust 的对话指出,其优点包括减少依赖项并适合生产环境,且已确认支持 GPU。

Efficient Coding with Federated Learning: 一个开源 GitHub 项目 展示了一种用于负荷预测的能效型 Federated Learning 方法。

Compiling the Stable Diffusion Compendium: 社区成员分享了大量 Stable Diffusion 的资源和指南,包括用于全面学习 Stable Diffusion 的 civitai.com。

Deck Out Your Memory – Diffusers Edition: 一个用于估算 DiffusionPipeline 推理时内存需求 的实验性工具已 发布并征求反馈。

SegGPT: The Contextual Segmentor: 介绍了 HuggingFace 上的 SegGPT,这是一个具有出色 one-shot 分割能力的模型,可针对各种 image-to-image 任务进行训练。

BLIP-2 Ups the Fusion Game: 在 vision-language 模型融合方面,推荐使用 BLIP-2 来连接预训练的图像编码器和语言模型,更多细节见 transformers 文档。

Embedding Precision with Quantization: Sentence Transformers 的 Embedding Quantization 在不损失检索准确性的情况下,带来了显著的搜索速度提升。

Catering to the German Learners: 一个名为 Hans 的 GPT 驱动的德语学习工具承诺为德语学习者提供增强的用户体验,现已在 GPT Store 上线。

All-MiniLM-L6-v2 Download Dilemma: 一位用户在下载和训练 all-MiniLM-L6-v2 模型 时寻求帮助,强调了社区支持对模型实现的重要性。

Revolutionizing Decision-Making with Langchain: Medium 上的一篇文章认为 Langchain 是一种改变语言 Agent 解决问题方式的变革性方法,详见 Medium。

Diving Into Data’s Importance: 一篇分享的 arXiv 论文 强调了数据作为潜在关键影响因素的重要性,提醒我们高质量数据的不可替代价值。

NEET/JEE Data Quest: 正在寻求 NEET/JEE 考试的数据集,用于训练 MCQ 答案生成器,这标志着 AI 技术与教育资源的交汇。

AI on the Forefront: Recurrent Neural Notes 通讯讨论了 AI 的潜在局限性,可能对 AI 的未来能力提供细致入微的见解,详见 Substack。

LlamaIndex Discord

Twitter 上的 Human-LlamaIndex 工作流预览:推出了一套新模板,旨在简化人类与 LlamaIndex Agents 之间的交互,计划降低对用户的侵入性。详情和预览已在 Twitter 上分享。

将自定义 LLMs 集成至 LlamaIndex:Leonie Monigatti 详细介绍了将自定义语言模型 (LLMs) 整合到 LlamaIndex 的过程,相关说明可在 LinkedIn 查看。

为 PDF 构建 RAG Agent 指南:Ashish S. 发布了一篇关于创建基于 LlamaParse 的 PDF 文件 RAG 流程教程,可通过此 推文 查看全文。

新版 LlamaIndex Python 文档发布:LlamaIndex 更新了其 Python 文档,更好地展示了示例 Notebook,改进了搜索功能并优化了 API 布局,已在 Twitter 帖子 中宣布。

LlamaIndex 社区解决集成与文档挑战:社区讨论重点包括与 Merlin API 和 LocalAI 的各种集成、对 LlamaIndex 评估流程逻辑的询问、v0.10 更新后冲突的文档、对多 Agent 聊天机器人示例的需求,以及将 Python 函数转换为 LlamaIndex 工具。用户交流了相关资源,包括多个 文档 链接和 GitHub 代码示例。

Latent Space Discord

-

用于视频处理的 Whisper:社区成员正在寻找与 OpenAI 的 Whisper 相当的视频处理工具,建议包括 Video Mamba、Twelve Labs 和 videodb.io。

-

OpenAI 的 Sora 在创意人士中获得关注:OpenAI 推出的 Sora 获得了艺术家的积极反馈,展示了该工具在生成写实和富有想象力的视觉效果方面的多功能性。

-

Google 的 AI 服务令人困惑:讨论揭示了 Google AI Studio 与 Vertex AI 之间的混淆,特别是前者新推出的 100 万 Token 上下文 API,并将其与 OpenAI 的模型部署 API 进行了比较。

-

AI 可穿戴设备日益普及:在关于 AI 可穿戴设备兴起的对话中讨论了开源 AI 可穿戴设备 ALOHA 项目。另一款 AI 可穿戴设备 Compass 开始预售,表明人们对本地化、个性化 AI 解决方案的浓厚兴趣。

-

利用 LLMLingua 提升 LLM 效率:微软的 LLMLingua 作为一个有前景的工具被分享,用于压缩大语言模型 (LLMs) 中的 Prompt 和 KV-Cache,在性能损失极小的情况下实现了显著的压缩率。

-

播客形式的 AI 内部讨论:一条 推文 强调的一期播客提供了对各大 AI 公司的见解,引发了 AI 社区的兴趣。

-

发现 AI 去中心化(Unbundling)趋势:latent.space 上的一篇文章讨论了 ChatGPT 的去中心化,表明随着通用模型用户增长停滞,专业化 AI 服务正变得越来越受欢迎。

-

论文俱乐部的小插曲:llm-paper-club-west 在 Discord 上遇到了发言权限的技术困难,导致会议转至 Zoom,这提高了人们对简化未来在线聚会访问流程的意识。

-

AI 实战俱乐部的创意与音乐流动:该俱乐部就 Tensor 操作、LLM 编码最佳实践进行了热烈讨论,并自发分享了 Slono 在 Spotify 上唤起夜晚宁静的音乐。他们还发布了关于 AI 主题后续会议的 日程表。

OpenAccess AI Collective (axolotl) Discord

GaLore 优化引发辩论:关于 GaLore optimizer 的讨论强调了其节省 VRAM 的能力,但也提出了由于“粗糙度(coarseness)”可能导致过度训练的问题。一些工程师渴望测试 GaLore,特别是考虑到新发布的 Mistral v0.2 Base Model,它现在拥有 32k 的 context window。

低预算微调 Large Language Models:围绕在 27gb 内存内微调 7b 模型的各种技术讨论浮出水面,重点关注了一个名为 torchtune 的 GitHub 仓库,它允许在没有 Huggingface 依赖的情况下进行高效微调。推荐查看一个特定的 pull request,以了解需要少于 16GB RAM 的 full fine-tune 方法。

TypeError 问题与帮助频道支持:一名成员在处理 “examples/openllama-3b/qlora.yml” 中的 TypeError 时,被引导至专门的帮助频道 (#1111279858136383509) 以寻求专业解决建议。这体现了社区的协作环境,鼓励成员利用特定资源解决技术问题。

医学模型发布困境:在期刊评审期间是否公开分享医学模型的预印本(preprint)引发了关于早期披露权衡的讨论。这次对话强调了该领域战略性研究传播的重要性。

开发者认可与商业合作的公开征集:CHAI 宣布为 LLM 开发者设立奖项,鼓励社区贡献;同时邀请企业秘密分享其 Axolotl 的应用案例,这暗示了真实世界使用场景叙述在推动 AI 技术发展中的价值。

OpenRouter (Alex Atallah) Discord

- Midnight 70B 进军角色扮演领域:Midnight 70B 模型专为故事讲述和 Roleplay 定制,继承了 Rogue Rose 和 Aurora Nights 的血统,现已上线并提供 25% 的折扣,在 OpenRouter 上的价格为 $0.009/1k tokens。

- OpenRouter 完善成本追踪工具:OpenRouter 实现了先进的 Usage Analytics 功能用于实时成本追踪,并推出了 Billing Portal 以实现更高效的额度和发票管理。

- Noromaid Mixtral 和 Bagel 价格调整:运行 Noromaid Mixtral 和 Bagel 模型的费用不再包含折扣,Mixtral 的新价格定为 $0.008/1k tokens,而 Bagel 为 $0.00575/1k tokens。

- Claude 3 & Grok:在多模型讨论中,Claude 3 的自我审查版本因改进的过滤功能而受到关注;Grok 模型引发了辩论,其性能被认为优于其他高级替代方案,但成本过高。用户表达了对更长 context lengths 的偏好,并指出了 OpenRouter 与直接使用 API 之间在模型补全质量上的差异。

- OpenRouter 遭受 DDoS 攻击及 API 响应问题:OpenRouter 面临 DDoS 攻击导致服务不稳定,目前已解决;用户观察到 Perplexity 的引用数据并未按预期出现在 OpenRouter 的 API 响应中。

Eleuther Discord

-

PyTorch 在 MPS 上的困境:改进 PyTorch 中 MPS backend 的持续努力正在进行中,自 2022 年 9 月以来,tensor 复制等显著问题一直是障碍。这项工作预计将提升本地模型测试和微调的性能。

-

LLM 训练中的 Token Blocking 争议:一场关于语言模型预训练中 token block 策略的辩论引发了对重叠与非重叠序列优劣及其对模型效能影响的讨论,并涉及了 beginning-of-sentence tokens 的重要性。

-

AMD 驱动困境引发讨论:AMD Radeon 与 Nvidia GPU 驱动的对比引发了辩论,焦点集中在驱动程序的不足以及 AMD 开源其驱动的可能性。一些参与者考虑了激进投资者采取行动促使 AMD 做出改变的潜力。

-

机器学习模型合并方法论:新的模型合并(model merging)方法正在开发中,旨在超越 DARE 等现有技术,尽管这些仍处于实验阶段,需要进一步的测试和验证。

-

充满前景的新 ML 架构:DenseFormer 和 Zigzag Mamba 等创新分别在 perplexity 和 diffusion model 内存占用方面提出了改进,而 DiPaCo 则为鲁棒的分布式模型训练提供了一种新颖方法。

-

SVM Kernel 之争:结果表明,sigmoid SVM kernel 在 Pythia 的 input embeddings 上的表现优于 rbf、linear 和 poly 等其他 kernel。

-

N-gram 项目 “Tokengrams” 受到关注:据报道,Tokengrams 项目现在可用于高效计算和存储来自文本语料库的 token n-grams,为研究人员提供了一个高效资源,详见 GitHub - EleutherAI/tokengrams。

-

Chess-GPT 案例分析:关于 Chess-GPT 的案例研究讨论了使用语言模型预测国际象棋走法并估算 Elo rating 的技术,以及使用 linear probes 验证计算的方法,详见 Chess GPT Interventions。

-

评估变异性令 AI 工程师担忧:将 Hugging Face transformers 与 Megatron-DeepSpeed 评估进行对比时出现的评估结果不一致性引起了关注,有建议称应核实 fused kqv multiplications 中的 bfloat16 数值处理等实现细节是否导致了这种变异性。

-

Minecraft 作为 RL 测试场:一个基于 Minecraft 的强化学习(Reinforcement Learning)环境已在 GitHub - danijar/diamond_env 发布,结合对 Voyager 项目的讨论,强调了游戏在 AI 模型协作研究中的应用。

-

多模态嵌入空间探索:社区对多模态嵌入空间(multimodal embedding spaces)的理论工作表现出兴趣,并提供了关于 Stable Diffusion 亚文化如何处理与 IMG2IMG 工作流一致的 embeddings 的见解。

CUDA MODE Discord

当 Discord 失效时,Meet 顶上:GTC 活动期间的技术故障导致有人建议未来的讲座默认使用语音频道,因为 Discord 的 stage 频道存在屏幕共享问题。一位不满的成员提议由于 Discord 直播的不稳定性,未来应切换到 Google Meet。

CUDA 性能分析 (Profiling):针对深入研究 CUDA 的工程师,分享了一个关于如何在 PyTorch 中对 CUDA kernel 进行 profiling 的讲座,并附带了配套幻灯片和 GitHub 代码仓库。当 PyTorch 的速度不足以满足性能增益需求时,CUDA 编程就成了必需。

Triton 的棘手细节:关于 Triton 性能问题的讨论非常突出,成员们被警告 Triton 操作未来可能会被逐步淘汰。建议在 torchao 仓库中建立一个新的 prototype 文件夹,以便在继续支持 Triton 的同时,协作设计高效 kernel 使用的 API。

稀疏性与分解的优雅结合:研究员 Lukas Gianinazzi 和 Alexandros Nikolaos Ziogas 在 Arrow Matrix Decomposition 论文中介绍了一种分布式稀疏矩阵乘法的新方法,其实现代码可在 GitHub 上获得。

Blackwell GPU 对着镜头微笑:成员们讨论了新的 Blackwell GPU,重点提到了一条幽默看待 GPU“笑脸”图案的推文。在关于 CUTLASS 库的 GitHub 讨论被提及后,大家对未公开的 NVIDIA Developer Discord 服务器进行了推测。社区还触及了深度学习中的数据类型标准化,指出 Google 未参与近期的标准联盟,且新型浮点数缺乏 IEEE 标准。

Interconnects (Nathan Lambert) Discord

Mistral 的新 7B 模型抢占风头:Mistral AI 在 @cerebral_valley hackathon 上随意发布了一个新模型——Mistral 7B v0.2 Base。模型详情(包括微调指南)可在此处获取,不过正如 @natolambert 所指出的,本次发布未提供 magnet 链接。

Stability AI 的大震荡:CEO Emad Mostaque 从 Stability AI 辞职,暗示他未来的重点将放在 #DecentralizedAI。在关于内部斗争以及 Stability AI 对 AI 学术界贡献本质的讨论中,社区对他任期的影响和方向表达了复杂的情绪。

Nemo 互操作性的寻求者:出现了关于转换和包装 Nemo checkpoint 以兼容 Hugging Face 的问题,突显了机器学习模型互操作性方面的技术挑战。

AI 的伦理钢丝:

- 基于此处的讨论,引发了关于在 Reinforcement Learning 中创建“通用 Agent”在实践和根本上是否可行的辩论。

- 该频道还讨论了 FTC 对 Apple 的反垄断诉讼,Nathan Lambert 指出公众对反垄断法规存在误解,并引用相关推文支持其观点。

二月重磅 AI 对话:与 Anthropic CEO 和 Mistral CEO 的精彩访谈引起了关注,例如这场“炉边谈话”以及关于 Amodei 对 AI 行业预测的讨论。此外,Latent Space 总结二月关键 AI 进展的回顾可以在此处找到。

LangChain AI Discord

- AI 以更低成本提供更多:提出了一种创新方法,通过在达到长度限制时发起后续请求,绕过 GPT-4-Turbo 的 4k 输出 Token 限制,使模型能够无缝地继续生成内容。

- Bedrock 遇上 Python:一份关于使用 Bedrock with Python 的指南已经发布,展示了实际的集成技术。感兴趣的工程师可以在这里深入阅读该指南。

- 使用 SimplyAnalyze.ai 分析 LLM 对话:宣布推出 SimplyAnalyze.ai,它与 LangChain 配合使用,可剖析各业务部门的 LLM 对话。要加入免费开发者预览版,工程师可以访问 SimplyAnalyze 的网站。

- 利用 LangChain 进行决策:分享了一篇详细介绍在 Agent Tree Search 中使用 LangChain 的文章,旨在通过语言模型促进更复杂的决策过程。工程师可以在这里阅读更多内容。

- 具有记忆和解析能力的升级版聊天机器人:对本地角色 AI 聊天机器人进行了增强,改进了 CSV 和 NER 解析等功能。要查看升级后的功能,GitHub 仓库可在这里找到。

LLM Perf Enthusiasts AI Discord

房地产匹配出错:围绕 GPT4.Turbo 误解房产面积要求的问题展开了讨论,尽管要求是 2,000 - 4,000 平方英尺,但却建议了一处 17,000 平方英尺的房产。建议使用简单的基于 CSV 的数据库过滤器,而不是复杂的 LLM,这引发了关于常见误区的对话,并链接到了 Jason Liu 关于 LLM 中可能过度依赖 embedding search 的资源。

对 Token 限制的挫败感:参与者对 Anthropic 每天 1M tokens 的速率限制表示不满,认为 200k context window 不足。讨论了 Bedrock 月费模式作为潜在替代方案,同时建议 Anthropic 的 $500 scale plan 能为广泛使用提供更便捷的途径。

寻找优质解释资源:社区被征集关于高级 LLM 主题的顶级解释资源,特别要求针对 RHLF 等主题提供高质量、清晰的内容,而不是大量的博客集合。Exa.ai 被建议作为深入研究 LLM 相关主题的有益资源。

对代码质量的简短呼吁:在 #jobs 频道中,一位用户用一句简洁而引起共鸣的话感叹编写高质量代码的难度。

GPT-3.5-0125 领先:GPT-3.5-0125 因其相较于之前模型的显著性能提升而受到赞赏,正如一位用户的对比测试所观察到的那样,提升了其作为 LLM 领域中特别先进迭代的地位。

Alignment Lab AI Discord

-

招募 AI 复仇者:Youth Inquiry Network 和 Futracode 正在合作开发一种机器学习算法,从现有数据库中推荐最佳研究课题。他们正在招募 Web 开发者、数据分析师以及 AI & ML 专家来支持这一事业。

-

贡献技能,赢得荣誉:志愿者不仅能通过一份亮眼的作品集来推进职业生涯,还能获得证书和两封专业推荐信。参与者还可以保留开发的 ML 算法代码用于个人或商业用途。

-

为拯救世界者提供灵活时间:他们保证这个开创性项目的投入时间灵活——非常适合日程繁忙的超级英雄。招募人员可以通过简单的“感兴趣”来绕过官僚程序,开始他们的任务。

-

神秘教育改革文档发布:一位未具名成员分享了一个 Google Docs 链接,讨论 Post-AGI 教育改革,可能暗示了一种面向未来的 AI 教育范式。

-

元调解时刻:具有讽刺意味的是,一位管理员在呼吁调解时经历了自我觉醒,提醒我们即使是机器人也会忘记自己的协议。

Datasette - LLM (@SimonW) Discord

-

LLM 与 Ollama 的对决:成员们澄清了

llm如何与模型交互(例如 Mistral),通过设置 API 端点,然后由ollama执行。ollama允许本地模型执行,使模型可以通过本地 HTTP API 端点访问。 -

AI 辅助的技术提交:工具 AICommits (GitHub - Nutlope/aicommits) 旨在帮助使用 AI 编写 git commit 消息,因其实用性而受到赞赏,并有人请求增加 commit 的 emoji 标准等额外功能。

Skunkworks AI Discord

- AI 策划噱头:一个 AI 根据 YouTuber Mr. Beast 的大胆冒险制作了一本独特的食谱,引起了小组的兴趣。这一创意应用在一段 YouTube 视频中展示,将烹饪艺术与 machine learning 相结合,产生了异想天开的效果。

- 寻找德国技术专家:一位社区成员正在寻找关于 deep learning 和 AI 的德语资源,表示希望用母语深入研究技术内容。这一请求描绘了 AI 社区中全球化、多语言的兴趣图景。

PART 2: 频道详细摘要与链接

Stability.ai (Stable Diffusion) ▷ #general-chat (1195 条消息🔥🔥🔥):

-

Stable Diffusion 咨询与协助:成员们讨论了 Stable Diffusion 模型的各个方面和用途,包括性能、采样器设置和 ControlNet 模型。用户还就处理错误以及在不同系统(尤其是使用 AMD GPU 的系统)上设置 AI 交换了指导意见。

-

探索 SD3 及其替代方案:对话主题包括 SD3 预期的发布窗口和潜在改进,以及与 SDXL 等其他产品和 AI 生成视频潜力的比较。

-

对在线 AI 服务的反馈:聊天涉及了对 Civitai 和 Suno 等在线 AI 图像生成服务的局限性和挫败感,特别指出了内容限制问题以及对显示内容类型的偏好。

-

关于 AI 伦理与监管的辩论:成员们辩论了对 AI 技术使用进行监管的必要性,以及开源模型与专有模型的重要性。有人担心监管可能会扼杀创新和可访问性。

-

技术故障排除与学习:寻求有关模型安装和使用技术问题帮助的新成员被引导至社区内的支持频道和专家。资深成员旨在提供指导和资源,同时向新手建议与 AI 图像生成相关的学习曲线。

- 未找到标题: 未找到描述

- ArtificialGuyBr: 未找到描述

- 未找到标题: 未找到描述

- imgur.com: 在 Imgur 发现互联网的魔力,这是一个由社区驱动的娱乐目的地。通过有趣的笑话、流行的模因、有趣的 GIF、鼓舞人心的故事、病毒式视频等来振奋你的精神...

- Stable Cascade Examples: ComfyUI 工作流示例

- Purity: 未找到描述

- Emad Mostaque 辞去陷入困境的生成式 AI 初创公司 Stability AI 的 CEO 职务 - SiliconANGLE: Emad Mostaque 辞去陷入困境的生成式 AI 初创公司 Stability AI 的 CEO 职务 - SiliconANGLE

- thibaud (Thibaud Zamora): 未找到描述

- Dune Oil GIF - Dune Oil - 发现并分享 GIF: 点击查看 GIF

- Nvidia 最新的云服务承诺加速量子计算模拟 - SiliconANGLE: Nvidia 最新的云服务承诺加速量子计算模拟 - SiliconANGLE

- CinematicRedmond - Cinematic Model for SD XL - v1.0 | Stable Diffusion Checkpoint | Civitai: Cinematic.Redmond 来了!感谢 Redmond.AI 提供的 GPU 时间让我能够制作这个模型!这是一个经过微调的电影感模型...

- Artificialguybr Demo Lora - artificialguybr 的 Hugging Face Space: 未找到描述

- Neon City Lights | Suno: 日语人声、休闲爵士、J-pop、慢节奏歌曲。使用 Suno 聆听并创作你自己的作品。

- Christian Laforte (@chrlaf) 的推文: @thibaudz 谢谢 Thibaud,正如我在别处写的那样,计划没有改变,我们仍在努力改进模型以实现开放发布。包括源代码和权重。

- Ok Then Um GIF - Ok Then Um Well Ok Then - 发现并分享 GIF: 点击查看 GIF

- Boring Reality - BoringReality_primaryV4.0 | Stable Diffusion LoRA | Civitai: 注意:请阅读下文了解如何使用这些 LoRA。如果单独且按原样使用,它们不太可能产生良好的效果。这个模型实际上...

- ControlNet 1.1 Models - Tile (e) | Stable Diffusion Controlnet | Civitai: 停止!这些模型不用于提示词/图像生成。这些是 ControlNet 扩展所需的全新 ControlNet 1.1 模型,已转换...

- CinematicRedmond - Cinematic Model for SD XL - v1.0 | Stable Diffusion Checkpoint | Civitai: Cinematic.Redmond 来了!感谢 Redmond.AI 提供的 GPU 时间让我能够制作这个模型!这是一个经过微调的电影感模型...

- Reddit - 探索一切: 未找到描述

- Stable Diffusion Glossary - Stable Diffusion Art: 对 Stable Diffusion 中的术语感到困惑?你并不孤单,我们会提供帮助。此页面包含你在 Stable Diffusion 中需要了解的所有关键术语。

- Reddit - 探索一切: 未找到描述

- Drone Shot "Above" XL LoRA - v1.0 | Stable Diffusion LoRA | Civitai: 在提示词中使用 "above"。最适用于大场景,而非单个物体或角色。

- GitHub - virattt/financial-agent: 一个完全使用 LangChain 构建的金融 Agent!: 一个完全使用 LangChain 构建的金融 Agent!通过在 GitHub 上创建账户,为 virattt/financial-agent 的开发做出贡献。

- AI Dance Animation - [ NEXT GEN ] - Stable Diffusion | ComfyUI</a>: 这段 AI 动画是使用 AnimateDiff 和 ControlNet 节点完成的,没有使用任何女孩 LORA。自上一个 AI 舞蹈视频以来,它在一致性方面有了重大改进...

- 未经授权的 “David Attenborough” AI 克隆体为开发者的生活配音,走红网络:“我们观察到复杂的智人正在进行补水仪式。”

- artificialguybr (ArtificialGuy/JV.K): 未找到描述

- ControlNetXL (CNXL) - bdsqlsz-depth | Stable Diffusion Checkpoint | Civitai: bdsqlsz : canny | depth | lineart-anime | mlsd-v2 | normal | openpose | recolor | segment | segment-v2 | sketch | softedge | t2i-color-shuffle | ti...

- Roko's Basilisk - LessWrong: Roko’s basilisk 是用户 Roko 于 2010 年在 Less Wrong 社区博客上提出的一个思想实验。Roko 利用决策理论中的观点认为,一个足够强大的 AI Agent 将会...

- 谁去告诉她……: 购买 T 恤支持频道:http://www.clownplanetshirts.com 不要忘记订阅。点击铃铛以获取最新视频动态。观看...

- AI 图像生成器的工作原理 (Stable Diffusion / Dall-E) - Computerphile: AI 图像生成器影响巨大,但它们是如何创建如此有趣的图像的?Dr Mike Pound 解释了其中的原理。缩略图部分由...创建。

- GitHub - stitionai/devika: Devika 是一个 Agentic AI 软件工程师,能够理解高层级的人类指令,将其分解为步骤,研究相关信息,并编写代码以实现给定目标。Devika 旨在成为 Cognition AI 的 Devin 的竞争性开源替代方案。: Devika 是一个 Agentic AI 软件工程师,能够理解高层级的人类指令,将其分解为步骤,研究相关信息,并编写代码以实现给定目标...

- Reddit - 深入探索: 未找到描述

- 报复社会(Revenge of the nerds) - John Goodman 演讲: 鼓舞人心的内容!

- StabilityMatrix/README.md at main · LykosAI/StabilityMatrix: Stable Diffusion 的多平台包管理器 - LykosAI/StabilityMatrix

- artificialguybr/cinematic.redmond – 在 Replicate 上通过 API 运行: 未找到描述

- Eyaura: Give Me A Soul. 专辑: T.B.D.: G STRING - STEAM:https://store.steampowered.com/app/1224600/G_String/ G STRING DISCORD - 官方:https://discord.gg/fUuDyx7uYe G STRING DISCORD - 杂项:https:/...

- 名字原型: 所以,我通过在 Midjourney 中使用提示词 "a photo of (name) --style raw" 制作了这些面孔。我不禁注意到,每当你遇到一个新朋友时,他们似乎都有一个与之关联的名字...

- 如何生成多个不同的角色、混合角色和/或最小化颜色污染 | Regional Prompt, Adetailer, 和 Inpaint | 我的工作流 - 2. Adetailer | Stable Diffusion 工作流 | Civitai: 如何生成多个不同的角色、混合角色和/或最小化颜色污染 | Regional Prompt, Adetailer, 和 Inpaint | 我的工作流...

- Forge 并没有使用 ComfyUI 作为后端 · lllyasviel/stable-diffusion-webui-forge · Discussion #169: 最近有些人开始散布关于 Forge 使用 ComfyUI 作为后端的虚假信息。这是错误的,对社区有害,也对我们工程团队的努力有害。后端...

Unsloth AI (Daniel Han) ▷ #general (1009 条消息🔥🔥🔥):

-

探索 SFTTrainer 中的指标:一位用户寻求关于在

SFTTrainer中使用基于生成的指标进行验证的建议,并引用了 GitHub issue 中的一种变通方法。他们不清楚compute_metrics函数中接收到的 preds,以及在使用 LoRA 适配器进行微调时SFTTrainer如何计算 loss。 -

聊天机器人模型推理的硬件需求:一位用户询问如何确定运行 LLM 模型(如 Nous-Capybara-34B-GGUF)的硬件需求,另一位用户建议参考另一个 HH 模型的 讨论 以获取估算值,并澄清模型需求会根据量化和 prompt 的不同而有所变化。

-

模型差异与量化:关于两个版本的 Mistral 模型之间差异的咨询引出了一番解释,即像 这里 的 4-bit 模型下载速度更快,但准确率会略有下降。

-

Mistral 及其营销策略:围绕 Mistral 的模型发布实践展开了讨论,一位成员认为其做法不同寻常,因为他们没有在 Hugging Face 上上传其基础模型,并且还发生了在 4chan 上泄露的非常规事件。

-

关于计算机科学教育的辩论:鉴于 LLM 现在能够编写代码,一场关于计算机科学学位重要性的激烈讨论正在进行。对话转向了各种编程语言、内存安全以及来自不同大学学位的价值。

- Inflection-2.5: meet the world's best personal AI: 我们是一家为每个人打造个人 AI 的 AI 工作室。我们的首款 AI 名为 Pi(代表个人智能),是一款提供支持且富有同理心的对话式 AI。

- GPT4All: 免费、本地且注重隐私的聊天机器人

- Google Colaboratory: 未找到描述

- 152334H/miqu-1-70b-sf · Hugging Face: 未找到描述

- Hugging Face – The AI community building the future.: 未找到描述

- Funny Very GIF - Funny Very Sloth - Discover & Share GIFs: 点击查看 GIF

- Sloth Slow GIF - Sloth Slow Stamp - Discover & Share GIFs: 点击查看 GIF

- Sloth Smile Slow GIF - Sloth Smile Slow Smooth - Discover & Share GIFs: 点击查看 GIF

- mistralai/Mistral-7B-Instruct-v0.2 · Hugging Face: 未找到描述

- unsloth/mistral-7b-v0.2-bnb-4bit · Hugging Face: 未找到描述

- unsloth/mistral-7b-v0.2 · Hugging Face: 未找到描述

- TheBloke/CodeLlama-34B-Instruct-GGUF · [AUTOMATED] Model Memory Requirements: 未找到描述

- TheBloke/Nous-Capybara-34B-GGUF · Hugging Face: 未找到描述

- Generation - GPT4All Documentation: 未找到描述

- GitHub - InflectionAI/Inflection-Benchmarks: Public Inflection Benchmarks: 公开的 Inflection 基准测试。通过在 GitHub 上创建账号,为 InflectionAI/Inflection-Benchmarks 的开发做出贡献。

- How Quickly Do Large Language Models Learn Unexpected Skills? | Quanta Magazine: 一项新研究表明,所谓的“涌现能力”实际上是逐渐且可预测地发展的,这取决于你如何衡量它们。

- White House urges developers to dump C and C++: 拜登政府呼吁开发者采用内存安全编程语言,并远离那些会导致缓冲区溢出和其他内存访问漏洞的语言。

- Compute metrics for generation tasks in SFTTrainer · Issue #862 · huggingface/trl: 你好,我想在 SFTTrainer 中包含一个基于自定义生成的 compute_metrics(例如 BLEU)。但是,我遇到了困难,因为:输入到 compute_metrics 的 eval_preds 包含一个 .predicti...

- alpindale/Mistral-7B-v0.2-hf · Hugging Face: 未找到描述

- GAIR/lima · Datasets at Hugging Face: 未找到描述

- Accelerating Large Language Models with Mixed-Precision Techniques - Lightning AI: 由于巨大的计算需求和内存占用,训练和使用大语言模型 (LLMs) 的成本很高。本文将探讨如何利用低精度格式来增强...

- ISTA-DASLab ( IST Austria Distributed Algorithms and Systems Lab): 未找到描述

- unilm/bitnet/The-Era-of-1-bit-LLMs__Training_Tips_Code_FAQ.pdf at master · microsoft/unilm: 跨任务、语言和模态的大规模自监督预训练 - microsoft/unilm

- aphrodite-engine/tests/benchmarks at main · PygmalionAI/aphrodite-engine: PygmalionAI 的大规模推理引擎。通过在 GitHub 上创建账号,为 PygmalionAI/aphrodite-engine 的开发做出贡献。

- GitHub - PygmalionAI/aphrodite-engine: PygmalionAI 的大规模推理引擎: PygmalionAI 的大规模推理引擎。通过在 GitHub 上创建账号来为 PygmalionAI/aphrodite-engine 的开发做出贡献。

- 在线观看电影和免费电视剧流媒体 - ev01.net: 数据库中超过 250,000 部电影和电视剧的快速免费流媒体。无需注册,无需付费,100% 免费全高清流媒体

- argilla (Argilla): 未找到描述

- GitHub - ggerganov/llama.cpp: C/C++ 中的 LLM 推理: C/C++ 中的 LLM 推理。通过在 GitHub 上创建账号来为 ggerganov/llama.cpp 的开发做出贡献。 </ul> </div> --- **Unsloth AI (Daniel Han) ▷ #[random](https://discord.com/channels/1179035537009545276/1179039861576056922/1220627573776584816)** (58 条消息🔥🔥): - **本地机器上的 Kernel 难题**:讨论了用户本地机器上需要重启 Kernel 的问题,暗示这可能与内存有关。分享了一条关于 32-bit 以及需要重启才能消除的错误消息,并讨论了是否为 Out Of Memory (OOM),但用户确认在重启 Kernel 后机器运行正常。 - **迎接光纤和大型模型**:一位用户兴奋地报告称,为了支持更大的模型,他们升级了光纤和新的 2TB WD 黑盘。用户对当前的性能表现以及未来可能的硬件升级充满热情。 - **ORPO 在 AI 社区引起轰动**:关于 ORPO (**Off-policy Reinforcement learning with Pretrained Overparametrized Models**) 的讨论非常热烈,用户们讨论了它的集成以及对模型性能的提升。提供了指向 [arXiv](https://arxiv.org/pdf/2403.07691.pdf) 原始论文的链接。 - **Unsloth 紧跟 TRL 步伐**:关于 ORPO 的讨论,用户确认如果 TRL (**Transformer Reinforcement Learning**) 支持该功能,Unsloth AI 也应该支持。提到了从 Unsloth 到 TRL 的优化和补丁,并鼓励大家在新的集成出现问题时进行分享。 - **Transformer 模型的新工具包**:链接了一个名为 transformer-heads 的有趣工具包。它专为 Transformer 模型附加、训练、保存和加载新的 heads 而设计,可在 [GitHub](https://github.com/center-for-humans-and-machines/transformer-heads) 上获取。 **提到的链接**:GitHub - center-for-humans-and-machines/transformer-heads: 用于 Transformer 模型新 heads 附加、训练、保存和加载的工具包:用于 Transformer 模型新 heads 附加、训练、保存和加载的工具包 - center-for-humans-and-machines/transformer-heads --- **Unsloth AI (Daniel Han) ▷ #[help](https://discord.com/channels/1179035537009545276/1179777624986357780/1220638996661538886)** (317 条消息🔥🔥): - **理解 Unsloth 的快速反量化 (Fast Dequantizing)**:Unsloth AI 在 `fast_lora.py` 中的 'fast_dequantize' 被指出针对速度进行了优化,与 `bitsandbytes` 相比减少了内存拷贝。 - **使用 Unsloth 排除故障并更新 Mistral**:由于 Gemma GGUF 的问题,建议一名成员升级 Unsloth,并提供了升级命令。指出问题不仅存在于 GGUF,还存在于合并(merging)过程中。 - **解决推理中的 Token 循环问题**:讨论了一个报告的问题,即转换为 GGUF 的模型(特别是使用 Mistral 时)在响应过程中开始循环重复 `

- 面向小丑(在马戏团)的混合专家模型 (Mixture of Experts for Clowns): 未找到描述

- HirCoir/Claud-mistral-7b-bnb-4bit-GGUF at main: 未找到描述

- HirCoir/Claud-openbuddy-mistral-7b-v19.1-4k · Hugging Face: 未找到描述

- mistralai/Mistral-7B-Instruct-v0.2 · Hugging Face: 未找到描述

- Google Colaboratory: 未找到描述

- Home: 快 2-5 倍,显存占用减少 70% 的 QLoRA & LoRA 微调 - unslothai/unsloth

- bitsandbytes/bitsandbytes/autograd/_functions.py at main · TimDettmers/bitsandbytes: 通过针对 PyTorch 的 k-bit 量化实现易用的大型语言模型。 - TimDettmers/bitsandbytes

- unilm/bitnet/The-Era-of-1-bit-LLMs__Training_Tips_Code_FAQ.pdf at master · microsoft/unilm: 跨任务、语言和模态的大规模自监督预训练 - microsoft/unilm

- 针对记忆化的 LLM 微调: ➡️ 高级微调仓库(含记忆化脚本): https://trelis.com/advanced-fine-tuning-scripts/ ➡️ 一键微调与推理模板: ht...

- GitHub - unslothai/unsloth: 快 2-5 倍,显存占用减少 70% 的 QLoRA & LoRA 微调: 快 2-5 倍,显存占用减少 70% 的 QLoRA & LoRA 微调 - unslothai/unsloth

- GitHub - unslothai/unsloth: 快 2-5 倍,显存占用减少 70% 的 QLoRA & LoRA 微调: 快 2-5 倍,显存占用减少 70% 的 QLoRA & LoRA 微调 - unslothai/unsloth

- GitHub - unslothai/unsloth: 快 2-5 倍,显存占用减少 70% 的 QLoRA & LoRA 微调: 快 2-5 倍,显存占用减少 70% 的 QLoRA & LoRA 微调 - unslothai/unsloth

- mahiatlinux/MasherAI-v6-7B · Hugging Face: 未找到描述

- Fizzarolli/sappha-2b-v3 · Hugging Face: 未找到描述

- ollama/docs/modelfile.md at main · ollama/ollama: 快速上手并运行 Llama 2, Mistral, Gemma 以及其他大型语言模型。 - ollama/ollama

- Release v0.10.0: 使用 DeepSpeed 和 FSDP 微调更大的 QLoRA 模型,层复制,增强 DoRA · huggingface/peft:亮点包括支持 QLoRA 配合 DeepSpeed ZeRO3 和 FSDP。我们添加了一些更改以允许 QLoRA 与 DeepSpeed ZeRO3 和 Fully Sharded Data Parallel (FSDP) 协同工作。例如,这允许...

- rohan-varma 提交的显存小于 16GB 的全量微调 · Pull Request #527 · pytorch/torchtune:背景:我们希望为显存有限的消费级 GPU 用户启用一种内存占用小于 16GB 的全量微调变体。此 PR 实现了全量微调以适应...

- Imagine with Meta AI: 使用 Imagine with Meta AI 免费快速创建高分辨率的 AI 生成图像。只需描述一张图片,Meta AI 就会利用我们的图像基础模型 Emu 的技术将其生成。

- MTEB Leaderboard - 由 mteb 提供的 Hugging Face Space: 未找到描述

- Stability AI 图像模型 — Stability AI: 通过 SDXL Turbo 和 Stable Diffusion XL 体验无与伦比的图像生成能力。我们的模型使用更短的 Prompt,并生成具有增强构图和逼真美感的描述性图像...

- Civitai | 分享你的模型: 未找到描述

- Swedish House Mafia One GIF - Swedish House Mafia One Op1 - 发现并分享 GIF: 点击查看 GIF

- Iota Crypto GIF - Iota Crypto Cryptocurrency - 发现并分享 GIF: 点击查看 GIF

- Claude 2.1 Prompt Engineering 指南: 通过这 11 个 Prompt Engineering 技巧学习如何为 Claude 编写 Prompt。

- 介绍深度搜索 | Search Quality Insights: 未找到描述

- 你现在可以免费使用 Copilot 的 GPT-4 Turbo 模型了: Microsoft 刚刚向所有人开放了这款先进的 GPT 模型,没有任何限制或套路。

- Stability AI 公告 — Stability AI: 今天早些时候,Emad Mostaque 辞去了 Stability AI 的 CEO 职务以及公司董事会职位,以追求去中心化 AI。董事会已任命...

- 你是否曾做过这样的梦?: 我们都在某个时刻做过。

- Kys Wojak GIF - Kys Wojak Mushroom - 发现并分享 GIF: 点击查看 GIF

- PerplexityBot: 未找到描述

- Reddit - 深入探索: 未找到描述

- Golden Eggs Willy Wonka And The Chocolate Factory GIF - Golden Eggs Willy Wonka And The Chocolate Factory Clean The Eggs - 发现并分享 GIF: 点击查看 GIF

- GitHub - OpenAccess-AI-Collective/axolotl: 尽管提问(axolotl questions): 尽管提问。通过在 GitHub 上创建账户,为 OpenAccess-AI-Collective/axolotl 的开发做出贡献。

- Kagi 出品的 Orion 浏览器: Orion 是一款适用于 iPhone 和 iPad 的快速、免费、无广告、无遥测的 Web 浏览器。也可以查看适用于 Mac 桌面版的 Orion。Orion 从底层设计开始就是一款真正尊重隐私的浏览器...

- 美国司法部在具有里程碑意义的反垄断案中起诉 Apple 垄断 iPhone 市场: Apple 及其 iPhone 和 App Store 业务已受到司法部的关注,该部门此前曾对 Google 提起反垄断诉讼。

- 未找到标题: 未找到描述

- 未找到标题: 未找到描述

- LM Studio: 未找到描述

- roborovski/superprompt-v1 · Hugging Face: 未找到描述

- 入门指南 | 🦜️🔗 Langchain: LCEL 使得从基础组件构建复杂的链变得容易,并且

- bartowski/c4ai-command-r-v01-GGUF · Hugging Face: 未找到描述

- Ban Keyboard GIF - Ban Keyboard - 发现并分享 GIF: 点击查看 GIF

- 使用 AutoGPTQ 和 transformers 让 LLM 更轻量化: 未找到描述

- GitHub - czkoko/SD-AI-Prompt: 一个基于 LLama 2 的快捷指令,用于扩展 stable diffusion 提示词,由 llama.cpp 提供支持。: 一个基于 LLama 2 的快捷指令,用于扩展 stable diffusion 提示词,由 llama.cpp 提供支持。 - czkoko/SD-AI-Prompt

- 在本地运行任何开源 LLM(无需代码的 LMStudio 教程): LMStudio 教程及其新功能演示:多模型支持(并行和序列化)以及 JSON 输出。加入我的时事通讯以获取定期 AI 更新...

- 非官方 LMStudio FAQ!: 欢迎来到非官方 LMStudio FAQ。在这里,你将找到我们在 LMStudio Discord 上收到的最常见问题的答案。(此 FAQ 由社区管理)。LMStudio 是一款免费的闭源...

- Caravan Palace - Lone Digger (官方 MV): 📀 预购我们的新专辑:https://caravanpalace.ffm.to/gmclub 🎫 来看我们的现场演出:http://www.caravanpalace.com/tour 🔔 订阅我们的频道并点击...

- GitHub - stitionai/devika: Devika 是一个 Agent 架构的 AI 软件工程师,能够理解高级人类指令,将其分解为步骤,研究相关信息,并编写代码以实现给定目标。Devika 旨在成为 Cognition AI 的 Devin 的竞争性开源替代方案。: Devika 是一个 Agent 架构的 AI 软件工程师,能够理解高级人类指令,将其分解为步骤,研究相关信息,并编写代码以实现给定目标...

- Caravan Palace - Lone Digger (官方 MV): 📀 预购我们的新专辑:https://caravanpalace.ffm.to/gmclub 🎫 来看我们的现场演出:http://www.caravanpalace.com/tour 🔔 订阅我们的频道并点击...

- GitHub - caddyserver/caddy: 快速且可扩展的多平台 HTTP/1-2-3 Web 服务器,支持自动 HTTPS: 快速且可扩展的多平台 HTTP/1-2-3 Web 服务器,支持自动 HTTPS - caddyserver/caddy

- 教程:如何将 HuggingFace 模型转换为 GGUF 格式 · ggerganov/llama.cpp · Discussion #2948: 来源:https://www.substratus.ai/blog/converting-hf-model-gguf-model/ 我在我们的博客上发布了这篇文章,但认为这里的其他人可能也会受益,所以也在 GitHub 上分享了原始博客。希望它...

- Dev:API – YaCyWiki: 未找到描述

- 用于数据挖掘的网络抓取 - YaCy Searchlab: 未找到描述

- 首页 - YaCy: 未找到描述

- nisten/mistral-instruct0.2-imatrix4bit.gguf · Hugging Face: 未找到描述

- 来自 meng shao (@shao__meng) 的推文: 他们刚刚更改了 HuggingFace Space 的 Readme:基于 Mistral-7B-Instruct-v0.1 的 Mistral-7B-Instruct-v0.2 => Mistral-7B-v0.2 https://twitter.com/shao__meng/status/1771680453210370157 ↘️ 引用...

- George Hotz | 探索 | 寻找 AMD GPU 固件中的漏洞 | 为 tinybox 放弃 AMD: 直播日期 2024 年 3 月 21 日。售价 1050 美元起 购买 https://comma.ai/shop/comma-3x & 世界上最好的 ADAS 系统 https://openpilot.comma.ai 已添加直播聊天...

- The Era of 1-bit LLMs: All Large Language Models are in 1.58 Bits: 最近的研究(如 BitNet)正在为 1-bit LLM 的新时代铺平道路。在这项工作中,我们引入了一个 1-bit LLM 变体,即 BitNet b1.58,其中每一个参数...

- How to Fine-Tune LLMs in 2024 with Hugging Face: 在这篇博文中,你将学习如何在 2024 年使用 Hugging Face TRL、Transformers 和 Datasets 来 Fine-Tune LLM。我们将针对 text to SQL 数据集 Fine-Tune 一个 LLM。

- Dont Say That Ever Again Diane Lockhart GIF - Dont Say That Ever Again Diane Lockhart The Good Fight - Discover & Share GIFs: 点击查看 GIF

- Models - Hugging Face: 未找到描述

- 在本地运行任何开源 LLM(无代码 LMStudio 教程):LMStudio 教程及其新功能演示:多模型支持(并行和串行)以及 JSON 输出。订阅我的通讯以获取定期 AI 更新...

- 文档 | LM Studio:技术参考

- EvalPlus 排行榜:未找到描述

- 尽管已加密,黑客仍能读取私人 AI 助手聊天内容:所有非 Google 的聊天 GPT 都会受到侧信道攻击的影响,从而泄露发送给用户的响应。

- MemGPT 详解!:非常感谢观看我们关于 MemGPT 的论文总结视频!MemGPT 是一项非常令人兴奋的新工作,它桥接了操作系统管理内存的理念...

- GitHub - intel/intel-npu-acceleration-library: Intel® NPU 加速库:Intel® NPU 加速库。通过在 GitHub 上创建账号来为 intel/intel-npu-acceleration-library 的开发做出贡献。

- GitHub - pytorch-labs/gpt-fast: 在少于 1000 行 Python 代码中实现简单高效的 PyTorch 原生 Transformer 文本生成。:在少于 1000 行 Python 代码中实现简单高效的 PyTorch 原生 Transformer 文本生成。 - pytorch-labs/gpt-fast

- 01 Light - 01:未找到描述

- saltlux (saltlux):未找到描述

- Nan-Do/Truthful_DPO_TomGrc_FusionNet_7Bx2_MoE_13B-GGUF · Hugging Face:未找到描述

- TheBloke/CodeLlama-7B-Instruct-GGUF · Hugging Face:未找到描述

- 开源 AI Agent 震惊业界 | Open Interpreter AI Agent + 设备 (01 Light) 发布!:📩 我的 5 分钟每日 AI 简报 📩 https://natural20.beehiiv.com/subscribe 🐥 在 Twitter (X) 上关注我 🐥 https://twitter.com/WesRothMoney 链接:https://www.openin...

- bug: `markdown` 已禁用或不支持 · Issue #1124 · OpenInterpreter/open-interpreter:描述 Bug:当使用 LM Studio 调用本地模型 https://huggingface.co/TheBloke/CodeLlama-7B-Instruct-GGUF 时,我一直得到本应是有效的 Python 输出,但代码块...

- TheBloke/Mistral-7B-Instruct-v0.2-GGUF · Hugging Face:未找到描述

- 未找到标题: 未找到描述

- GOODY-2 | 全球最具责任感的 AI 模型: 介绍一款具有下一代伦理对齐能力的全新 AI 模型。立即聊天。

- OpenAI - Open Interpreter: 未找到描述

- killian (@hellokillian) 的推文: ..天呐,Open Interpreter 的首个视觉模型,正在我的 8GB M1 MacBook 上运行。100% 离线。这将进入世界上的每一台电脑。

- 所有设置 - Open Interpreter: 未找到描述

- Open Interpreter (@OpenInterpreter) 的推文: https://twitter.com/i/spaces/1dRJZEPewmgGB

- 提供商 | liteLLM: 了解如何在 LiteLLM 上部署并调用来自不同提供商的模型

- Groq | liteLLM: https://groq.com/

- OpenInterpreter/open-interpreter 的 open-interpreter/interpreter/core/llm/llm.py (版本 3e95571): 计算机的自然语言接口。通过在 GitHub 上创建账号,为 OpenInterpreter/open-interpreter 的开发做出贡献。

- OpenInterpreter/open-interpreter 的 open-interpreter/interpreter/terminal_interface/utils/count_tokens.py (main 分支): 计算机的自然语言接口。通过在 GitHub 上创建账号,为 OpenInterpreter/open-interpreter 的开发做出贡献。

- 重定向通知: 未找到描述

- 重定向通知: 未找到描述

- 未找到标题: 未找到描述

- 未找到标题: 未找到描述

- 来自未定义用户的推文: 未找到描述

- GroqChat: 未找到描述

- Animate Anyone: Animate Anyone:一致且可控的角色动画图像到视频合成

- GitHub - OpenInterpreter/open-interpreter: 计算机的自然语言接口: 计算机的自然语言接口。通过在 GitHub 上创建账号,为 OpenInterpreter/open-interpreter 的开发做出贡献。

- 介绍 Light 01:Open Interpreter 推出的全球首款个人 AI 助手(完整设置): 在本视频中,我们将查看 OpenInterpreter Light 01 的 GitHub 仓库,这是一个正在彻底改变我们与计算机交互方式的前沿项目...

- GitHub - Tas667/scalpel: 帮助你快速了解未知项目结构和内容的 Python 脚本。: 帮助你快速了解未知项目结构和内容的 Python 脚本。 - Tas667/scalpel

- 如何更便宜地使用 Open Interpreter!(LM Studio / Groq / GPT-3.5): 第一部分及介绍:https://www.youtube.com/watch?v=5Lf8bCKa_dE 0:00 - 设置 1:09 - 默认 GPT-4 2:36 - 快速模式 / GPT-3.5 2:55 - 本地模式 3:39 - LM Studio 5:5...

- GitHub - cs50victor/os1: AGI 操作系统(Open Interpreter 01 的 UI): AGI 操作系统(Open Interpreter 01 的 UI) - cs50victor/os1

- Ty (@FieroTy) 的推文: 在 01 Light 上运行本地 LLM?轻而易举

- Nosta: 未找到描述

- 惊讶的皮卡丘 u GIF - 惊讶的皮卡丘宝可梦 - 发现并分享 GIFs</a>: 点击查看 GIF

- Anthropic | liteLLM: LiteLLM 支持

- open-interpreter/docs/CONTRIBUTING.md at main · OpenInterpreter/open-interpreter: 计算机的自然语言接口。通过在 GitHub 上创建账号,为 OpenInterpreter/open-interpreter 的开发做出贡献。

- 未找到标题: 未找到描述 </ul> </div> --- **OpenInterpreter ▷ #[O1](https://discord.com/channels/1146610656779440188/1194880263122075688/1220612133792907265)** (576 条消息🔥🔥🔥): - **自己构建 01**: 成员们正在讨论 3D 打印和组装他们自己的 **01 Light** 设备的过程,对 DIY 充满热情。社区正在分享关于材料、设置和打印可能的设计调整的见解,一些人计划对他们自制的设备进行迭代。 - **01 在美国境外的可用性**: 预订目前仅限于美国,尚未提供国际发布的预计时间。然而,鼓励美国境外的社区成员构建自己的设备并与他人协作。 - **在机器上理解并运行 01 Server**: 对话包括关于在具有不同规格的各种机器(包括低配和云选项)上运行 **01 server** 的问题。这表明只要机器能够处理该模型,就是可行的,其中实际的 LLM 是最耗资源的部分。 - **开发 01 的功能**: 围绕扩展 **01 Light** 的功能(如集成 LED、扬声器或用于连接的 SIM 卡功能)展开了热烈讨论。大家正在交流关于如何创建一个更通用且对 DIY 友好的设计的想法。 - **一般性问题和兴奋之情**: 新成员表达了对该设备的期待,询问了关于预计交付时间、订阅要求以及自动化工具与 Windows 或 Mac 的兼容性等问题。

- V-One - 桌面级 PCB 打印机 | Voltera:V-One 是一款四合一桌面级 PCB 打印机。在一小时内完成 PCB 原型制作和组装,并获得新设计的即时反馈。

- 来自 undefined 的推文:未找到描述

- M5Stack 发布 M5Dial,一款内置彩色触摸屏的时尚 IoT 旋转编码器:支持 Arduino IDE、ESP-IDF 和 UIFlow,这款多功能设备旨在为您的物联网控制项目提供动力。

- Shut Up And Take My Money Futurama GIF - Shut Up And Take My Money Futurama Fry - 发现并分享 GIF:点击查看 GIF

- Open Interpreter 博客:开源项目 Open Interpreter 的官方更新日志。

- Mike Bird:AI 工程

- ATOM Echo 智能扬声器开发套件:ATOM ECHO 是一款可编程智能扬声器。这款 ESP32 AIoT 开发套件配有麦克风和扬声器,用于 AI 语音交互,轻巧便携。它可以接入 AWS、百度、ESPHome 和 Home Assistant...

- M5Stack UnitV2 - 用于边缘计算的独立 AI 摄像头 (SSD202D) TinyML:UnitV2 是一款高效的 AI 识别模块,采用 Sigmstar SSD202D 芯片,拥有 128MB-DDR3 内存、512MB Flash 和 1080P 摄像头。UnitV2 使用简单且高效,支持 AI 识别...

- 来自 Open Interpreter (@OpenInterpreter) 的推文:https://twitter.com/i/spaces/1dRJZEPewmgGB

- GitHub - rhasspy/piper:一个快速、本地的神经文本转语音系统:一个快速、本地的神经文本转语音系统。通过在 GitHub 上创建账号来为 rhasspy/piper 的开发做出贡献。

- 联系我们:使用 Typeform 将数据收集变成一种体验。创建精美的在线表单、调查、测验等。免费试用。

- OpenInterpreter/01 项目 main 分支下的 01/hardware/light/BOM.md:开源语言模型计算机。通过在 GitHub 上创建账号来为 OpenInterpreter/01 的开发做出贡献。

- ChatGPT "Code Interpreter" 但 100% 开源 (Open Interpreter 教程):这是我关于 Open Interpreter 的第二个视频,包含许多新功能且更加稳定,全新的 Open Interpreter 非常出色。更新:Mixtral 7x8b 曾是...

- Issues · OpenInterpreter/01:开源语言模型计算机。通过在 GitHub 上创建账号来为 OpenInterpreter/01 的开发做出贡献。

- OpenInterpreter/01 项目 main 分支下的 01/docs/bodies:开源语言模型计算机。通过在 GitHub 上创建账号来为 OpenInterpreter/01 的开发做出贡献。

- 探索 Typeform,让表单变得有趣:无需代码,几分钟内即可创建精美的交互式表单。免费开始使用。

- GitHub - openai/whisper:通过大规模弱监督实现的鲁棒语音识别:通过大规模弱监督实现的鲁棒语音识别 - openai/whisper

- GitHub - adafruit/Adafruit-PAM8302-Mono-Amplifier-PCB:Adafruit PAM8302 单声道放大器的 PCB 文件:Adafruit PAM8302 单声道放大器的 PCB 文件。通过在 GitHub 上创建账号来为 adafruit/Adafruit-PAM8302-Mono-Amplifier-PCB 的开发做出贡献。

- 基于 XIAO ESP32S3 Sense 的微型 ChatGPT 语音助手 | Seeed Studio Wiki:本教程介绍了如何使用 XIAO ESP32S3 录制语音、识别语音,然后向 ChatGPT 提问并获取答案显示在屏幕上。

- 在本地运行任何开源 LLM(无代码 LMStudio 教程):LMStudio 教程及其新功能演示:多模型支持(并行和串行)以及 JSON 输出。加入我的通讯以获取定期... ar AI Up...

- PCB prototyping, PCB making at home - WEGSTR: 通过这个分步视频指南体验 PCB 制造的迷人世界。学习使用 CNC 铣床制作高质量 PCB 的艺术...

- Tweet from GitHub - FixTweet/FxTwitter: Fix broken Twitter/X embeds! Use multiple images, videos, polls, translations and more on Discord, Telegram and others: 修复损坏的 Twitter/X 嵌入!在 Discord、Telegram 等平台上使用多张图片、视频、投票、翻译等功能 - FixTweet/FxTwitter

- Speaker - 40mm Diameter - 4 Ohm 3 Watt: 听好消息!这款扬声器是任何需要 4 Ohm 阻抗和 3W 或更低功率的音频项目的绝佳补充。直径 40mm,形状更接近方形,....

- DotStar Micro LEDs (APA102–2020) - Smart SMD RGB LED - 10 pack: 这些极其微小的表面贴装 LED 是为您的项目添加大量非常微小(但明亮!)彩色点的简便方法。它们是我们数字产品的微型版本...

- Concept Bytes on Instagram: "A useful Ai named Jarvis. What features do you wanna see next? #ironman #ai #tech #xtool #xtoolf1 @xtool.official": 6,784 个赞,154 条评论 - concept_bytes 于 2024 年 3 月 22 日发布:"一个名为 Jarvis 的实用 AI。你接下来想看到什么功能?#ironman #ai #tech #xtool #xtoolf1 @xtool.official"

- 01/software/source/server/i.py at main · OpenInterpreter/01: 开源语言模型计算机。通过在 GitHub 上创建账户为 OpenInterpreter/01 的开发做出贡献。

- 01/ROADMAP.md at main · OpenInterpreter/01: 开源语言模型计算机。通过在 GitHub 上创建账户为 OpenInterpreter/01 的开发做出贡献。

- Wake word demonstration on Raspberry Pi and custom ESP32 board in Home Assistant | Year of the Voice: 在 Home Assistant 中基于 Raspberry Pi 和自定义 ESP32 板的唤醒词演示 | 语音之年。如果说在“语音之年”期间人们一直要求的一件事,那就是唤醒词。能够说出像 "OK Google," "Hey Siri," 或 ... 之类的话。

- Shocking Open Interpreter AI Agent + Device (01 Light ) is Finally Revealed: 令人震惊的 Open Interpreter AI Agent + 设备 (01 Light ) 终于揭晓 #OpenInterpreter #aiagent 频道链接:🕵️♀️ 加入我的 Patreon: https://www.patreo...

- GitHub - Tas667/scalpel: python script that helps you quickly understand the structure and contents of an unknown project.: 帮助你快速了解未知项目结构和内容的 Python 脚本。 - Tas667/scalpel

- GitHub - SYSTRAN/faster-whisper: Faster Whisper transcription with CTranslate2: 使用 CTranslate2 的 Faster Whisper 转录。通过在 GitHub 上创建账户为 SYSTRAN/faster-whisper 的开发做出贡献。

- GitHub - m-bain/whisperX: WhisperX: Automatic Speech Recognition with Word-level Timestamps (& Diarization): WhisperX:具有词级时间戳(和说话人日志)的自动语音识别 - m-bain/whisperX

- Building Generally Capable AI Agents with MineDojo | NVIDIA Technical Blog: 使用 MineDojo 构建通用能力的 AI Agents | NVIDIA 技术博客。NVIDIA 正在通过一个名为 MineDojo 的新开源框架,帮助突破训练 AI 通用 Agent 的极限。

- YouTube:未找到描述

- Open Interpreter's 01 Lite - 全球首款完全开源的个人 AI AGENT 设备:Open Interpreter 的 01 Lite 是一款 100% 开源的个人 AI 助手,可以控制你的电脑。让我们来评测它,我将向你展示如何安装 open...

- Stability AI 创始人 Emad Mostaque 计划辞去 CEO 职务,据消息人士称:Mostaque 已告知多位亲近人士,他计划辞去这家因 Stable Diffusion 而闻名的曾经炙手可热的生成式 AI 初创公司的首席执行官职务。

- Christian Laforte (@chrlaf) 的推文:@USEnglish215753 @StabilityAI @EMostaque 是的,计划没有改变,我们仍在努力改进模型,以实现开源发布。

- WebLLM | 首页:未找到描述

- 在 X 上点击链接并不安全:当有人在 X 上发布链接时,该网站会生成链接预览。但据报道,这个系统可以被欺骗,不法分子可以通过虚假的链接预览将你重定向到恶意网站……

- Stability AI 公告 — Stability AI:今天早些时候,Emad Mostaque 辞去了 Stability AI 的 CEO 职务以及公司董事会的职位,以追求去中心化 AI。董事会已任命……

- 金钱哭泣 GIF - Woody Harrelson 金钱哭泣 - 发现并分享 GIF:点击查看 GIF

- 我正在尽我的一份力 严肃 GIF - 我正在尽我的一份力 严肃凝视 - 发现并分享 GIF:点击查看 GIF

- reddit.com: 超过 18 岁?:未找到描述

- Stability AI 创始人 Emad Mostaque 计划辞去 CEO 职务,据消息人士称:未找到描述

- AI 单步生成高质量图像速度提升 30 倍:一种新的分布匹配蒸馏 (DMD) 技术将 GAN 原理与 Diffusion Models 相结合,在单个计算步骤中实现了快 30 倍的高质量图像生成,并增强了...

- 爆炸可爱 GIF - 爆炸可爱猫咪 - 发现并分享 GIF:点击查看 GIF

- TRC 报告 4:未找到描述

- Reddit - 深入探索一切:未找到描述

- 重新思考如何训练 Diffusion Models | NVIDIA 技术博客:在探索了 Diffusion Models 采样、参数化和训练的基础知识后,如《生成式 AI 研究亮点:揭秘基于扩散的模型》中所述……

- FastAPI:FastAPI 框架,高性能,易于学习,快速编码,生产就绪

- Mr. Beast 遇见 Mistral:AI 根据他的疯狂特技创作了一本食谱!:今天我们创作了 Beast 食谱,“Beast 食谱”的想法是一种有趣且富有创意的方式,可以与 Mr. Beast 的内容互动,并生成一个有趣的、虚构的...

- Wing Lian (caseus) (@winglian) 的推文: 目前尚不清楚在将 DenseFormers 与预训练的 Mistral-7B 集成时,是否能够实现论文中看到的改进,因为他们发现最佳性能是在训练过程中观察到的...

- Bitnet 1.5 实验 (ngmi): 未找到描述

- 论大语言模型的对话说服力:一项随机对照试验: 大语言模型 (LLMs) 的发展和普及引发了人们的担忧,即它们将被用来创建量身定制的、具有说服力的论点,以在网上传播虚假或误导性的叙述...

- OpenRouter: 一个用于 LLM 和其他 AI 模型的路由器

- mixedbread-ai/mxbai-rerank-large-v1 · Hugging Face: 未找到描述

- NousResearch/Nous-Hermes-2-Mistral-7B-DPO · Hugging Face: 未找到描述

- Nous (موسى عبده هوساوي ): 未找到描述

- Transformers learn patterns, math is patterns: 未找到描述

- 来自 Marvin von Hagen (@marvinvonhagen) 的推文: Mistral 刚刚在 @SHACK15sf 宣布,他们今天将发布一个新模型:Mistral 7B v0.2 Base Model - 32k 而非 8k 的上下文窗口 - Rope Theta = 1e6 - 无滑动窗口

- 海绵宝宝 为什么 为什么 为什么 GIF - 发现并分享 GIF: 点击查看 GIF

- Hd_nxx GIF - HD_NXX - 发现并分享 GIF: 点击查看 GIF

- 未找到标题: 未找到描述

- Gandalf | Lakera – 测试你的 Prompt 技巧,让 Gandalf 泄露秘密信息。: 诱导 Gandalf 泄露信息,亲身体验 LLM 的局限性。

- Sifas Ruby Kurosawa GIF - 发现并分享 GIF: 点击查看 GIF

- RESMPDEV/Mistral-7B-v0.2 at main: 未找到描述

- 来自 Jeffrey Morgan (@jmorgan) 的推文: 使用 Ollama 运行 Mistral 更新至 v0.2 的新基础文本补全模型:ollama run mistral:text https://ollama.com/library/mistral:text

- 来自 Alex Reibman 🖇️ (@AlexReibman) 的推文: Mistral 在 @cerebral_valley 黑客松上随手发布了一个新模型

- jinaai/jina-embeddings-v2-base-en · Hugging Face: 未找到描述

- Open Interpreter 的 01 Lite - 全球首款完全开源的个人 AI AGENT 设备: Open Interpreter 的 01 Lite 是一款 100% 开源的个人 AI 助手,可以控制你的电脑。让我们来评测一下,我将向你展示如何安装开源...

- wesley7137/therapist-sft-format · Hugging Face 数据集: 未找到描述

- GitHub - furlat/SpriteStash: 一个使用 LanceDB、Pydantic 和 pygame-ce 的多模态精灵图向量数据库: A multimodal sprites vectordb using LanceDB, Pydantic and pygame-ce - furlat/SpriteStash

- GitHub - mistralai-sf24/hackathon: 通过在 GitHub 上创建账号来为 mistralai-sf24/hackathon 的开发做出贡献。

- unsloth_finetune_mistral-7b-v0.2-on-openhermes-2.5-dataset.py: GitHub Gist: 即时分享代码、笔记和代码片段。

- GitHub - jquesnelle/crt-terminal: 复古风格的终端 Shell: Retro styled terminal shell. 通过在 GitHub 上创建账号来为 jquesnelle/crt-terminal 的开发做出贡献。

- colbert-ir/colbertv2.0 · Hugging Face: 未找到描述

- gorilla/raft at main · ShishirPatil/gorilla:Gorilla:LLM 的 API 商店。通过在 GitHub 上创建账号为 ShishirPatil/gorilla 的开发做出贡献。

- Philipp Schmid (@_philschmid) 的推文:我们能通过微调让 RAG 应用更健壮吗?微软和加州大学伯克利分校的一篇论文对此进行了测试,看看像 Meta 的 Llama 7B 这样的小型开源 LLM 是否能匹配 OpenAI 的 GPT-3.5。T...

- Ehsan Azari (@ehsanxpin) 的推文:Library Is All You Need。它将为全球语言模型带来效率、一致性、可扩展性、适应性和“互操作性”。抄送:@karpathy ↘️ 引用 Ehsan Azari (@ehsanx...

- 在 DuckDuckGo 搜索 summarize youtube video:未找到描述。

- GitHub - openai/openai-python: The official Python library for the OpenAI API:OpenAI API 的官方 Python 库。可以通过在 GitHub 上创建账号来为 openai-python 的开发做出贡献。

- v1.0.0 迁移指南 · openai/openai-python · Discussion #742:我们发布了 SDK 的新主版本,建议立即升级。这是对该库的彻底重写,因此发生了许多变化,但我们通过 cod... 简化了升级过程。

- GitHub - openai/openai-python: The official Python library for the OpenAI API:OpenAI API 的官方 Python 库。可以通过在 GitHub 上创建账号来为 openai-python 的开发做出贡献。

- v1.0.0 迁移指南 · openai/openai-python · Discussion #742:我们发布了 SDK 的新主版本,建议立即升级。这是对该库的彻底重写,因此发生了许多变化,但我们通过 cod... 简化了升级过程。

- Rubik's AI - Waitlist: 未找到描述

- CopyleftCultivars/Gemma2B-NaturalFarmerV1 · Hugging Face: 未找到描述

- Coqui Bark Voice Cloning Docker - fffiloni 创建的 Hugging Face Space: 未找到描述

- HF-Mirror - Huggingface 镜像站: 未找到描述

- Hugging Face Forums: 社区讨论,由 Hugging Face 提供支持 <3

- Hugging Face – 构建未来的 AI 社区。: 未找到描述

- Process: 未找到描述

- unilm/bitnet/The-Era-of-1-bit-LLMs__Training_Tips_Code_FAQ.pdf at master · microsoft/unilm: 跨任务、语言和模态的大规模自监督预训练 - microsoft/unilm

- GitHub - xai-org/grok-1: Grok open release: Grok 开源发布。通过在 GitHub 上创建账号来为 xai-org/grok-1 的开发做出贡献。

- GitHub - mistralai-sf24/hackathon: 通过在 GitHub 上创建账号来为 mistralai-sf24/hackathon 的开发做出贡献。

- GitHub - turboderp/exllamav2: A fast inference library for running LLMs locally on modern consumer-class GPUs: 一个用于在现代消费级 GPU 上本地运行 LLM 的快速推理库 - turboderp/exllamav2

- GitHub - davidberenstein1957/fast-sentence-transformers: This repository, called fast sentence transformers, contains code to run 5X faster sentence transformers using tools like quantization and ONNX.: 该仓库名为 fast sentence transformers,包含使用量化和 ONNX 等工具使 sentence transformers 运行速度提高 5 倍的代码。- davidberenstein1957/fast-sentence-transformers

- GitHub - coqui-ai/TTS: 🐸💬 - a deep learning toolkit for Text-to-Speech, battle-tested in research and production: 🐸💬 - 一个用于 Text-to-Speech 的深度学习工具包,经过研究和生产环境的实战测试 - coqui-ai/TTS

- GitHub - suno-ai/bark: 🔊 Text-Prompted Generative Audio Model: 🔊 文本提示生成音频模型。通过在 GitHub 上创建账号来为 suno-ai/bark 的开发做出贡献。

- Don't Talk to People Like They're Chatbots: “AI 可能会让我们的社交互动变得更加平淡、更具偏见,甚至更粗鲁,”Carr 中心教员 Bruce Schneier 和技术与人权研究员 Albert Fox Cahn 在《大西洋月刊》中写道。

- MTEB Leaderboard - mteb 创建的 Hugging Face Space: 未找到描述

- GitHub - vgthengane/Awesome-Mamba-in-Vision: List of papers related to State Space Models (Mamba) in Vision.: 视觉领域中状态空间模型 (Mamba) 相关论文列表。- vgthengane/Awesome-Mamba-in-Vision </ul> </div> --- **HuggingFace ▷ #[today-im-learning](https://discord.com/channels/879548962464493619/898619964095860757/1221453209579814952)** (9 条消息🔥): - **对未指明工具的兴趣**:一位成员表达了对某个工具的兴奋,但未提供更多细节或链接。 - **寻求 HuggingFace 方面的帮助**:一位用户寻求关于 HuggingFace 上 **qra-13b 模型**的帮助,特别提到了波兰。 - **模型转换尝试**:一位成员一直致力于将 **GLiNER 模型**从 PyTorch 转换为 *Candle* (Rust),探索了量化技术并学习了 Candle 库。 - **模型转换为 Rust 的好处**:在关于将模型转换为 Rust 的优势讨论中,一位成员提到了**更少的依赖**、适合生产部署以及速度提升,尽管他们目前的实现并没有变得更快。 - **基于 Rust 的模型与 GPU 兼容性**:已确认使用 Candle 库转换为 Rust 的模型**与 GPU 兼容**。 --- **HuggingFace ▷ #[cool-finds](https://discord.com/channels/879548962464493619/897390579145637909/1220631213903970364)** (12 条消息🔥): - **深入探讨视觉处理**:一段名为 [“Understanding early visual processing mechanisms by the principle of efficient encoding”](https://www.youtube.com/watch?v=Ed9otQAmEF4) 的 YouTube 视频讨论了生物视觉中的早期视觉处理机制。 - **探索用于音频分析的 Superlet Transform**:一种名为 *Superlet Transform* 的新方法被强调为实时音频分析的一项改进,其有效性在 [Nature 文章](https://doi.org/10.1038/s41467-020-20539-9) 中得到了证明,并在一篇文章中提供了补充的 [基准测试](https://doi.org/10.1038/s41598-022-22055-w)。 - **使用 Langchain 进行 Language Agent Tree Search**:Medium 上的一篇文章讨论了使用带有 Langchain 的语言模型在决策制定方面的潜在革命,这可能会改变 Language Agent 解决问题的方式。该文章可在 [Medium](https://medium.com/ai-advances/language-agent-tree-search-with-langchain-revolutionizing-decision-making-with-language-models-a46c991397f1) 上阅读。 - **来自 CivitAI 的宝贵见解**:一位成员在 [CivitAI](https://civitai.com/articles/2054) 上收集了关于 Stable Diffusion 的各种文章和指南,包括针对初学者和中级用户的提示、技巧和见解。 - **数据的重要性**:一位成员分享了一篇 [arXiv 论文](https://arxiv.org/pdf/2212.03533.pdf),该论文强调了数据的重要性及其在特定语境下成为关键因素的潜力。

- Exploring Lightweight Federated Learning for Distributed Load Forecasting:Federated Learning (FL) 是一种分布式学习方案,使深度学习能够以保护隐私的方式应用于敏感数据流和应用程序。本文重点关注...

- A curated list of Stable Diffusion Tips, Tricks, and Guides | Civitai:Stable Diffusion:https://stable-diffusion-art.com/samplers https://civitai.com/articles/983/insights-for-intermediates-how-to-craft-the-images-you...

- Explaining Chest X-ray Pathologies in Natural Language:大多数深度学习算法对其预测缺乏解释,这限制了它们在临床实践中的部署。提高可解释性的方法,特别是在医学成像领域,通常...

- Understanding early visual processing mechanisms by the principle of efficient encoding:这是 CVPR 2022 教程“关于生物(人类)视觉如何工作的后马尔计算概述”的五场讲座中的第二场,日期为 2022 年 6 月 19 日...

- Time-frequency super-resolution with superlets - Nature Communications:在高精度神经生理信号中识别有限振荡包的频率、时间位置、持续时间和幅度具有挑战性。作者提出了一种基于...的方法

- Super-resolved time–frequency measurements of coupled phonon dynamics in a 2D quantum material - Scientific Reports:未找到描述

- Stable Diffusion 技巧、诀窍和指南精选列表 | Civitai:Stable Diffusion:https://stable-diffusion-art.com/samplers https://civitai.com/articles/983/insights-for-intermediates-how-to-craft-the-images-you...

- LLM 术语解析:欢迎来到 "LLM Jargons Explained" 系列,在这里我将揭开语言模型和解码技术的复杂世界。无论你是一个语言模型...

- ClaimVer:通过知识图谱实现可解释的文本断言级验证和证据归因:在社交媒体广泛传播虚假信息以及 AI 生成文本泛滥的背景下,人们验证和信任信息变得越来越困难...

- Command-R - Tonic 开发的 Hugging Face Space:暂无描述

- GitHub - ADG4050/Exploring-Lightweight-Federated-Learning-for-load-forecasting:使用聚类和顺序 DNN 方法在能源数据集上进行负荷预测的 Federated Learning:使用聚类和顺序 DNN 方法在能源数据集上进行负荷预测的 Federated Learning - ADG4050/Exploring-Lightweight-Federated-Learning-for-load-forecasting

- RNN #9 - AI 的真实极限:探索神经网络的计算边界

- 你刚才说的话:出自电影《Billy Madison》

- Anki Forge:暂无描述

- 解密肥胖趋势 📉:深入的 EDA 📊:使用 Kaggle Notebooks 探索并运行机器学习代码 | 使用来自多个数据源的数据

- Hugging Face 阅读小组 16:HyperZ⋅Z⋅W Operator Terminator:演讲者:Harvie Zhang,他也是这项工作的作者。遗憾的是,本次会议出现了一些主持方面的问题

- Watchtower:由 TuneCore 提供给 YouTube。Watchtower · Michael Salvatori, Skye Lewin, Rotem Moav & Pieter Schlosser。Destiny 2: Forsaken (Original Soundtrack) ℗ 2018 Bungi...

- BLIP-2: Bootstrapping Language-Image Pre-training with Frozen Image Encoders and Large Language Models:由于大规模模型的端到端训练,视觉和语言预训练的成本变得越来越高。本文提出了 BLIP-2,一种通用且高效的预训练策略...

- BLIP-2:未找到描述

- SegGPT:未找到描述

- Merlin API Platform:在几分钟内将 LLMs 集成到您的生产应用中。

- 正在重定向...:未找到描述

- Google Colaboratory:未找到描述

- 未找到标题:未找到描述

- Notion – 笔记、任务、维基和数据库的一体化工作空间。:一款将日常工作应用融合为一的新工具。它是为您和您的团队打造的一体化工作空间。

- MTEB Leaderboard - 由 mteb 创建的 Hugging Face Space:未找到描述

- LlamaIndex - LlamaIndex:未找到描述

- LlamaIndex - LlamaIndex:未找到描述

- Using Documents - LlamaIndex:未找到描述

- 正在重定向...:未找到描述

- Qdrant Vector Store - LlamaIndex:未找到描述

- Controllable Agents for RAG - LlamaIndex:未找到描述

- Vector Stores - LlamaIndex:未找到描述

- LocalAI - LlamaIndex:未找到描述

- LlamaIndex v0.10 — LlamaIndex,LLM 应用的数据框架:LlamaIndex 是一个简单、灵活的数据框架,用于将自定义数据源连接到大语言模型 (LLMs)。

- Multi-Document Agents (V1) - LlamaIndex:未找到描述

- HuggingFace LLM - StableLM - LlamaIndex:未找到描述

- 10Q Analysis - LlamaIndex:未找到描述

- Vector - LlamaIndex:未找到描述

- 共同构建更好的软件:GitHub 是人们构建软件的地方。超过 1 亿人使用 GitHub 来发现、fork 并为超过 4.2 亿个项目做出贡献。

- llama_index/llama-index-integrations/vector_stores/llama-index-vector-stores-qdrant/llama_index/vector_stores/qdrant/base.py at f5263896121721de1051ce58338a1e0ea6950ca7 · run-llama/llama_index:LlamaIndex 是适用于您的 LLM 应用的数据框架 - run-llama/llama_index

- llama_index/llama-index-core/llama_index/core/objects/base.py at be63bae53227f1360472477eb2afa993791c09ce · run-llama/llama_index:LlamaIndex 是适用于您的 LLM 应用的数据框架 - run-llama/llama_index

- llama_index/llama-index-integrations/extractors/llama-index-extractors-entity/llama_index/extractors/entity/base.py at main · run-llama/llama_index:LlamaIndex 是适用于您的 LLM 应用的数据框架 - run-llama/llama_index

- llama_index/llama-index-packs/llama-index-packs-snowflake-query-engine/llama_index/packs/snowflake_query_engine/ba se.py at be63bae53227f1360472477eb2afa993791c09ce · run-llama/llama_index: LlamaIndex 是为您 LLM 应用程序提供的数据框架 - run-llama/llama_index

- 未找到标题: 未找到描述

- Google - LlamaIndex: 未找到描述

- API Reference - LlamaIndex: 未找到描述

- Learning From Data - 在线课程 (MOOC): 未找到描述

- 正在重定向...: 未找到描述

- 未找到标题: 未找到描述

- Tracer Bullet 开发: 未找到描述

- BatchEvalRunner - 运行多个评估 - LlamaIndex: 未找到描述

- 从 ServiceContext 迁移到 Settings - LlamaIndex: 未找到描述

- Release v2.6.0 - Embedding Quantization, GISTEmbedLoss · UKPLab/sentence-transformers: 此版本带来了 Embedding Quantization:一种大幅加速检索和其他任务的方法,以及一个新的强大损失函数:GISTEmbedLoss。使用 pip install sentence-trans... 安装此版本

- Chat Stores - LlamaIndex: 未找到描述

- Index - LlamaIndex: 未找到描述

- 用于高级 Text-to-SQL 的 Query Pipeline - LlamaIndex: 未找到描述

- 由 logan-markewich 修复 async streaming · Pull Request #12187 · run-llama/llama_index: 需要确保延迟声明的 queue/async 内容在访问前已实际实例化。修复了 #12180

- Cria Demo (2024年3月14日,周四): 未找到描述

- [Bug]: AttributeError: 'NoneType' object has no attribute 'wait' · Issue #12180 · run-llama/llama_index: Bug 描述 Async Streaming Chat 示例:https://docs.llamaindex.ai/en/stable/examples/agent/openai_agent/#async-streaming-chat 产生异常:AttributeError: 'NoneType' object has n...

- Bedrock Embeddings - LlamaIndex: 未找到描述

- Bedrock - LlamaIndex: 未找到描述

- 使用 LlamaIndex 与部署在 Amazon SageMaker Endpoint 中的 LLM 进行交互 - LlamaIndex: 未找到描述

- Embedding Similarity Evaluator - LlamaIndex: 未找到描述

- Faithfulness Evaluator - LlamaIndex: 未找到描述 </ul> </div> --- **Latent Space ▷ #[ai-general-chat](https://discord.com/channels/822583790773862470/1075282825051385876/1220707548311715891)** (164 条消息🔥🔥): - **寻找类似 Whisper 的视频处理工具**:一位用户询问是否有与 Whisper 相当但用于视频处理的工具,并提到它可能利用 VLM 进行场景评估,且可能是开源的。提出了多个建议,包括 [Video Mamba](https://huggingface.co/blog/vladbogo/video-mamba)、Twelve Labs 以及视频智能服务 [videodb.io](https://videodb.io)。 - **OpenAI 的 Sora 令艺术家惊叹**:OpenAI 博客分享了对 Sora 的初步印象,揭示了创意专业人士的浓厚兴趣和认可。讨论了艺术家的作品示例,展示了 Sora 如何实现写实和超现实图像的创作。 - **Google AI Studio 与 Vertex AI 的混淆**:讨论围绕 Google AI Studio 与 Vertex AI 在提供 Gemini 等模型服务方面的差异和用法展开,AI Studio 开始推出 100 万 token 上下文 API,并在易用性方面与 OpenAI API 进行了对比。 - **AI 可穿戴设备蓬勃发展**:聊天片段聚焦于开源 AI 可穿戴设备的趋势,包括 200 美元的 ALOHA 项目,并讨论了此类产品是否完全是本地运行的。另一款 AI 可穿戴设备 [Compass](https://x.com/itsmartynask/status/1771890769865187648) 已开始预售,计划于下周开始发货。 - **大语言模型的效率**:微软的 LLMLingua 被分享为一种压缩 LLM prompts 和 KV-Cache 的工具,在性能损失极小的情况下,可能实现高达 20 倍的压缩。有建议认为,虽然优化成本至关重要,但也不要过早进行过度优化,而应专注于交付价值。

- InstaLoRA - 即时 LoRA 生成器:在几秒钟内生成你的 LoRA

- VideoDB:只需 2 行简单的代码,即可在所有类型的视频上构建智能应用。由开发者构建,为开发者服务。

- VideoMamba:用于高效视频理解的状态空间模型 (State Space Model):未找到描述

- Nik Shevchenko (@kodjima33) 的推文:今天我看到另一个“开源” AI 可穿戴设备发布,它什么都没公布,只是为了收取你 5 倍的费用。在 @MistralAI x @cerebral_valley 举办的 @SHACK15sf 黑客松中,我们构建了 FR...

- 据消息人士称,Stability AI 创始人 Emad Mostaque 计划辞去 CEO 职务:Mostaque 已告诉多位亲近人士,他计划辞去这家以 Stable Diffusion 闻名的、曾备受关注的生成式 AI 初创公司的首席执行官职务。

- Sora:初步印象:我们从创意社区获得了宝贵的反馈,帮助我们改进模型。

- EvenUp:未找到描述

- Another One GIF - Dj Khaled Another One One More Time - 发现并分享 GIF:点击查看 GIF

- Stability AI 公告 — Stability AI:今天早些时候,Emad Mostaque 辞去了 Stability AI 的 CEO 职务以及公司董事会职位,以追求去中心化 AI。董事会已任命...

- Xiang Yue (@xiangyue96) 的推文:@MistralAI 刚刚发布了他们的 v0.2 Base😱。@WenhuChen 和我使用 OpenCompass 评估包快速评估了几个基准测试。似乎几乎在所有...能力都有所下降。

- 像人类一样理解视频的多模态 AI:为任何应用带来类人视频理解能力,无论你拥有 TB 级还是 PB 级的视频

- Olivia Moore (@omooretweets) 的推文:为什么 ChatGPT 被适配到这么多用例中? (1) 它拥有分发渠道;(2) 它结合了文本、图像、语音,成为一个全面的合作伙伴。但是,它在 UI 和工作流方面受到限制。在我看来,这是部分...

- mkrupskis (@ItsMartynasK) 的推文:今天我发起了 Compass 的预订——一个售价 99 美元的开源指南。- 30 小时电池续航 - 通过转录你的对话进行学习 - 重温生活中的重要时刻 - 首批出货或...

- Matteo Pagliardini (@MatPagliardini) 的推文:对 #Transformers 架构的一个微调可以显著提高准确率!通过直接访问所有先前块的输出,一个 48 块的 #DenseFormer 优于 72 块的 Transformer,且速度更...

- ChatGPT 的解构(2024 年 2 月回顾):ChatGPT 达到顶峰了吗?此外:我们照例为 AI Engineer 准备了 2024 年 2 月最高信号的顶级项目回顾!

- AshutoshShrivastava (@ai_for_success) 的推文:AI 驱动的设备:可穿戴设备/个人助手。Humane AI Pin:699 美元;Rabbit R1:199 美元;Open Interpreter 01 Light:99 美元且开源;Compass:99 美元且开源。这仅仅是个开始... 我们...

- swyx (@swyx) 的推文:🆕 ChatGPT 的解构 https://latent.space/p/feb-2024。整整一年过去了,ChatGPT 的用户数量增长几乎为 0。相反,用户正在探索大量垂直领域的参与者,以满足...

- Matt Shumer (@mattshumer_) 的推文:介绍 `claude-investor` 📈。首个 Claude 3 投资分析师 Agent。只需提供一个行业,它就会:- 查找关键公司的财务数据/新闻 - 分析每个公司的情绪/趋势...

- 我们的下一代模型:Gemini 1.5:Gemini 1.5 提供了显著增强的性能,在长文本...方面取得了突破。

- 跨模态的上下文理解。

- 来自 Shirin Ghaffary (@shiringhaffary) 的推文:🚨 新闻 OpenAI 进军好莱坞。公司下周将与好莱坞制片厂、媒体高管、人才经纪公司会面,鼓励他们使用 Sora。一些电影制作人已经获得了访问权限。COO Brad Lightcap...

- 来自 clem 🤗 (@ClementDelangue) 的推文:我们是否应该收购 Stability 并开源 SD3?

- 来自 Aman Sanger (@amanrsanger) 的推文:“Token 计数”对于长上下文模型来说是一个具有误导性的内容长度衡量标准。对于代码:100K Claude Tokens ≈ 85K GPT-4 Tokens;100K Gemini Tokens ≈ 81K GPT-4 Tokens;100K Llama Tokens ≈ 75K...

- 来自 Aman Sanger (@amanrsanger) 的推文:“Token 计数”对于长上下文模型来说是一个具有误导性的内容长度衡量标准。对于代码:100K Claude Tokens ≈ 85K GPT-4 Tokens;100K Gemini Tokens ≈ 81K GPT-4 Tokens;100K Llama Tokens ≈ 75K...

- 来自 Andrej Karpathy (@karpathy) 的推文:LLM OS。请耐心听我说,我还在构思中。规格:- LLM: OpenAI GPT-4 Turbo 256 核(批大小)处理器 @ 20Hz (tok/s) - RAM: 128Ktok - 文件系统: Ada002

- Reddit 解构指南:每隔几年就会发生一次大解构。2010 年,Andrew Parker 写了一篇关于 Craigslist “解构”的定义性文章,他在文中概述了从...中剥离出利基产品的机会。

- Eye On A.I.:#177 Björn Ommer:Stable Diffusion 创始人解析扩散模型:在 Eye on AI 第 177 期节目中,加入主持人 Craig Smith,与富有远见的 AI 研究员兼计算主管 Björn Ommer 一起探索人工智能生成模型的尖端世界...

- 来自 Emad acc/acc (@EMostaque) 的推文:由于我的通知已经爆炸,补充几点:1. 我的股份在 Stability AI 拥有多数投票权 2. 他们拥有完整的董事会控制权。AI 权力的集中对我们所有人都不利。我决定辞职以...

- GitHub - simonw/files-to-prompt: 将整个目录的文件合并为一个单一的 Prompt,以便与 LLM 配合使用:将整个目录的文件合并为一个单一的 Prompt,以便与 LLM 配合使用 - simonw/files-to-prompt

- GitHub - semanser/codel: ✨ 全自动 AI Agent,可以使用终端、浏览器和编辑器执行复杂的任务和项目。:✨ 全自动 AI Agent,可以使用终端、浏览器和编辑器执行复杂的任务和项目。 - semanser/codel

- 您的自动化产品安全工程师 · Pixeebot:Pixeebot 提供即时且持续的修复,使您的代码更安全。这就像身边多了一位安全专家级的开发者。

- Brightwave:未找到描述

- GitHub - OwlAIProject/Owl: 一个在本地运行的个人可穿戴 AI:一个在本地运行的个人可穿戴 AI。通过在 GitHub 上创建账号为 OwlAIProject/Owl 的开发做出贡献。

- GitHub - microsoft/LLMLingua: 为了加速 LLM 的推理并增强 LLM 对关键信息的感知,压缩 Prompt 和 KV-Cache,在性能损失极小的情况下实现高达 20 倍的压缩。:为了加速 LLM 的推理并增强 LLM 对关键信息的感知,压缩 Prompt 和 KV-Cache,在性能损失极小的情况下实现高达 20 倍的压缩。 - GitH...

- GitHub - OwlAIProject/Owl: 一个在本地运行的个人可穿戴 AI:一个在本地运行的个人可穿戴 AI。通过在 GitHub 上创建账号为 OwlAIProject/Owl 的开发做出贡献。

- 未找到标题:未找到描述

- Google Cloud Platform:未找到描述

- 未找到标题:未找到描述

- 未找到标题:未找到描述 api?apiid=aiplatform.googleapis.com).">Google Cloud Platform</a>: 未找到描述

- LLM Visualization:未找到描述

- Graph-Mamba: Towards Long-Range Graph Sequence Modeling with Selective State Spaces:Attention 机制已被广泛用于捕捉 Graph Transformers 中节点间的长程依赖。受限于二次计算成本,Attention 机制无法扩展到...

- Did We Just Become Best Friends? GIF - Friends Bestfriends Yep - Discover & Share GIFs:点击查看 GIF

- AI In Action: Weekly Jam Sessions:2024 主题, 日期, 协调人, 资源, @dropdown, @ GenAI 的 UI/UX 模式, 1/26/2024, nuvic, <a href="https://maggieappleton.com/squish-structure">https://maggieappleton.com/squish-stru...

- slono:艺术家 · 每月 110 位听众。

- @smangrul 在 Hugging Face 上发布:“🤗 PEFT v0.10.0 发布!🔥🚀✨ 一些亮点: _ 1. FSDP+QLoRA and DeepSpeed…": 未找到描述

- Fully Sharded Data Parallel: 未找到描述

- Xiang Yue (@xiangyue96) 的推文: @MistralAI 刚刚发布了他们的 v0.2 Base😱。@WenhuChen 和我使用 OpenCompass 评估包快速评估了几个基准测试。似乎在几乎所有的...能力都有所下降。

- DeepSpeed: 未找到描述

- DeepSpeed: 未找到描述

- Chai Prize: 完成并赢取 3 天无限消息!

- GitHub - mistralai-sf24/hackathon: 通过在 GitHub 上创建账户来为 mistralai-sf24/hackathon 的开发做出贡献。

- axolotl/examples/mistral/config.yml at main · OpenAccess-AI-Collective/axolotl: 尽管提问 (axolotl questions)。通过在 GitHub 上创建账户来为 OpenAccess-AI-Collective/axolotl 的开发做出贡献。

- trl/trl/trainer/dpo_trainer.py at 8534f0edf8608ad6bcbea9beefae380fa60ded77 · huggingface/trl: 使用强化学习训练 Transformer 语言模型。- huggingface/trl

- 第三方基准测试 · Issue #6 · jiaweizzhao/GaLore: 你好,非常感谢这项出色的工作。我们使用 Llama-Factory 进行了一些实验,结果表明 GaLore 可以显著降低全参数...过程中的内存占用。

- GitHub - pytorch/torchtune: A Native-PyTorch Library for LLM Fine-tuning: 一个用于 LLM 微调的原生 PyTorch 库。通过在 GitHub 上创建账户来为 pytorch/torchtune 的开发做出贡献。

- Full finetune < 16GB by rohan-varma · Pull Request #527 · pytorch/torchtune: 上下文:我们希望为拥有显存有限的消费级 GPU 用户启用一种在少于 16GB RAM 中训练的全量微调变体。此 PR 使全量微调能够适配到 ...

- 来自 Delip Rao e/σ (@deliprao) 的推文:我看到这个,并不觉得 Grok 更好。作为一个务实的人,我看着它在想,既然已经有了性能几乎相当的 Mixtral,为什么还要费劲去用 Grok (314B) 呢,而且它还是一个...

- xAI Grok:未找到描述

- world_sim:未找到描述

- imgur.com:在 Imgur 发现互联网的魔力,这是一个由社区驱动的娱乐目的地。通过有趣的笑话、流行的梗图、有趣的 GIF、感人的故事、病毒式视频等来提振你的精神...

- sophosympatheia/Midnight-Rose-70B-v2.0.3 · Hugging Face:未找到描述

- Catformer: Designing Stable Transformers via Sensitivity Analysis:Transformer 架构被广泛使用,但训练它们并非易事,需要自定义学习率调度、缩放项、残差连接以及对子模块(如层归一化)的精心放置...

- DenseFormer: Enhancing Information Flow in Transformers via Depth Weighted Averaging:Vaswani 等人 (2017) 提出的 Transformer 架构现在在各个应用领域无处不在,从自然语言处理到语音处理和图像理解。我们提出了 DenseForme...

- 未找到标题:未找到描述

- ZigMa: Zigzag Mamba Diffusion Model:扩散模型长期以来一直受到可扩展性和二次复杂度问题的困扰,尤其是在基于 Transformer 的结构中。在这项研究中,我们旨在利用长序列建模能力...

- Manipulating Chess-GPT’s World Model:操纵 Chess-GPT 的世界模型

- Explicit Inductive Bias for Transfer Learning with Convolutional Networks:在归纳迁移学习中,微调预训练的卷积网络显著优于从头开始训练。使用微调时,其基本假设是预训练...

- DiPaCo: Distributed Path Composition:机器学习 (ML) 的进步是由扩展神经网络模型推动的。这种扩展是通过日益英勇的工程壮举实现的,这对于容纳那些...的 ML 方法是必要的。

- Tools for Verifying Neural Models' Training Data:消费者和监管机构能够验证大型神经模型的来源,以评估其能力和风险,这一点至关重要。我们引入了“训练数据证明 (Proof-of-Training-Data)”的概念...

- The Description Length of Deep Learning Models:Solomonoff 的通用推理理论和最小描述长度 (Minimum Description Length) 原则使奥卡姆剃刀定律正式化,并认为一个好的数据模型是一个擅长无损压缩的模型...

- Sphere Neural-Networks for Rational Reasoning:大型语言模型 (LLM)(如 ChatGPT)的成功体现在它们在全球范围内的普及、类人的问答能力,以及稳步提升的推理能力...

- OmniNet: Omnidirectional Representations from Transformers:本文提出了来自 Transformer 的全向表示 (OmniNet)。在 OmniNet 中,每个 token 不再保持严格的水平感受野,而是被允许关注所有 token...

- GitHub - lawrence-cj/LLaMA-DiffFit: Efficient Fine-tuning LLaMA Using DiffFit within 0.7M Parameters:在 0.7M 参数内使用 DiffFit 高效微调 LLaMA - lawrence-cj/LLaMA-DiffFit

- Manipulating Chess-GPT’s World Model: 操纵 Chess-GPT 的世界模型

- GitHub - EleutherAI/tokengrams: Efficiently computing & storing token n-grams from large corpora: 高效地从大型语料库中计算和存储 token n-grams - EleutherAI/tokengrams

- inverse-scaling-eval-pipeline/eval_pipeline/models.py at main · naimenz/inverse-scaling-eval-pipeline: 用于运行不同规模 GPT 模型并绘制结果的基础流水线 - naimenz/inverse-scaling-eval-pipeline

- Implement a way test local models · Issue #149 · MineDojo/Voyager: Voyager 的出色工作。请考虑增加对本地模型的支持(不使用 openai 包,而是使用类似 Python requests 包连接到 localhost 本地模型...

- GitHub - danijar/diamond_env: Standardized Minecraft Diamond Environment for Reinforcement Learning: 用于强化学习的标准化 Minecraft 钻石环境 - danijar/diamond_env

- Add various social bias tasks by oskarvanderwal · Pull Request #1185 · EleutherAI/lm-evaluation-harness: 此 PR 实现了多种流行的评估 LM 社会偏见的基准测试。我还旨在尽可能对这些任务进行验证:例如,通过与现有实现或结果进行比较...

- GitHub - pytorch-labs/ao: torchao: PyTorch Architecture Optimization (AO). A repository to host AO techniques and performant kernels that work with PyTorch.: torchao: PyTorch Architecture Optimization (AO)。一个托管 AO 技术和适用于 PyTorch 的高性能 kernel 的仓库。 - pytorch-labs/ao

- triton/python/triton/ops/cross_entropy.py at fb8983e5a2754ce793ab8d14ed0c333bfd9ba197 · openai/triton: Triton 语言和编译器的开发仓库 - openai/triton

- CUDA Compatibility :: NVIDIA GPU Management and Deployment Documentation:未找到描述

- NVIDIA #GTC2024 Conference Session Catalog:立即注册。在线直播。2024 年 3 月 18-21 日。

- Support for CUDA kernels · Issue #70 · Lightning-AI/lightning-thunder:🚀 Feature 你好 👋 从主 readme 文件中我注意到 Thunder 除了支持自定义 kernels 外,目前仅支持用 Triton 编写的。是否有支持 CUDA kernels 的计划?动力来源...

- Arrow Matrix Decomposition: A Novel Approach for Communication-Efficient Sparse Matrix Multiplication:我们提出了一种迭代稀疏矩阵-稠密矩阵乘法的新方法,这是科学计算和图神经网络训练中的基本计算 kernel。在矩阵 s...

- GitHub - spcl/arrow-matrix: Arrow Matrix Decomposition - Communication-Efficient Distributed Sparse Matrix Multiplication:Arrow Matrix Decomposition - 通信高效的分布式稀疏矩阵乘法 - spcl/arrow-matrix

- iron-bound: Weights & Biases, developer tools for machine learning

- iron-bound: Weights & Biases, developer tools for machine learning

- NVIDIA Blackwell Architecture and B200/B100 Accelerators Announced: Going Bigger With Smaller Data:未找到描述

- 来自 Tanishq Mathew Abraham, Ph.D. (@iScienceLuvr) 的推文:为什么没人讨论新的 Blackwell GPU 真的在对着我们笑 lol

- New Discord Channel! · NVIDIA/cutlass · Discussion #1086:为了进一步改善围绕 CUTLASS 的用户体验和教育,我们创建了一个新的 Discord 频道!点击链接加入!在那里见,感谢你们的所有支持 :)

- Open Compute Project:未找到描述

- Alex Reibman 🖇️ (@AlexReibman) 的推文:Mistral 在 @cerebral_valley 黑客松上随手发布了一个新模型。

- Adarsh (@adarshxs) 的推文:哟 @MistralAI 今天发布了一个新模型!!

- Mistral AI Labs (@MistralAILabs) 的推文:新发布:Mistral 7B v0.2 Base(用于训练 Mistral-7B-Instruct-v0.2 的原始预训练模型)🔸 https://models.mistralcdn.com/mistral-7b-v0-2/mistral-7B-v0.2.tar 🔸 32k context window 🔸 Rope Theta...

- 来自 clem 🤗 (@ClementDelangue) 的推文:我们应该收购 Stability 并开源 SD3 吗?

- Stability AI 公告 — Stability AI:今天早些时候,Emad Mostaque 辞去了 Stability AI 的 CEO 职务以及公司董事会职位,以追求去中心化 AI。董事会已任命...

- 来自 Emad acc/acc (@EMostaque) 的推文:* 这里的“他们”——我的股份拥有董事会的完全控制权,哈哈。所以这可以说是我个人的决定。随着 AI 变得越来越重要,我们应该拥有更透明和分布式的治理方式。这很难...

- 来自 Edward Grefenstette (@egrefen) 的推文:本周 AI 动态:Quis griftat ipsos griftatores?(谁来忽悠那些忽悠者?)

- 来自 Emad acc/acc (@EMostaque) 的推文:另外,没有预售、TGE 或代币,真是见鬼。如果有的话,我会称之为 stable coin 😏

- 来自 Emad acc/acc (@EMostaque) 的推文:无法用更中心化的 AI 来击败中心化 AI。全力投入 #DecentralizedAI。更多消息即将发布 🔜 ↘️ 引用 Stability AI (@StabilityAI) 的公告:https://bit.ly/43zsVj...

- 新闻 — Stability AI:了解 Stability AI 的最新产品发布、公司更新和行业新闻。我们为激发人类潜力奠定基础。

- 来自 Emad acc/acc (@EMostaque) 的推文:由于我的通知已经爆了,补充几点:1. 我的股份在 @StabilityAI 拥有多数投票权 2. 它们拥有董事会的完全控制权。AI 权力的集中对我们所有人都是不利的。我决定辞职是为了... </ul> </div> --- **Interconnects (Nathan Lambert) ▷ #[random](https://discord.com/channels/1179127597926469703/1183121795247779910/1220635579079987210)** (8 条消息🔥): - **RL 通用 Agent 讨论**:一位成员链接了 [Twitter 上的讨论](https://x.com/mlstreettalk/status/1770516991943586021?s=46&t=_jodDCDeIUnWb_Td0294bw),关于在强化学习 (RL) 中创建“通用 Agent”的哲学,探讨了实现此类 Agent 的实际和原则上的可能性。 - **网络上对反垄断法的误读**:Nathan Lambert 对公众在近期科技诉讼和辩论中对反垄断法的普遍误解表示沮丧。 - **对 Apple 反垄断诉讼的批评**:Nathan Lambert 的几条消息批评了 FTC 对 Apple 的诉讼,建议那些欢呼雀跃的人应该阅读更多见解深刻的观点,例如 Ben Thompson 的文章。 - **不同意 Twitter 上关于 FTC 对阵 Apple 的情绪**:在 Twitter 的一场争论中,Nathan Lambert 坚持认为 FTC 对 Apple 的诉讼是不合时宜的,并引用了一条[推文](https://x.com/fentpot/status/1771634407226446254?s=20)暗示监管对 Apple 这样的大公司的影响微乎其微。 - **关于 FTC 诉讼价值的对话**:一位名为 twkillian 的成员分享了观点,认为近期 FTC 的诉讼指控反竞争行为可能存在疑问,但怀疑此类行为是否旨在恶化市场或使其他产品处于劣势。

- 来自 Machine Learning Street Talk (@MLStreetTalk) 的推文:我们刚刚发布了与 @MinqiJiang 和 @MarcRigter 的节目,讨论了在 RL 中构建“通用 Agent”在原则上和实践中是否可能的哲学。

- 来自 el (@fentpot) 的推文:@nagolinc @norabelrose @natolambert 抱歉,但对于像 Apple 这样的大公司来说,这里的二阶效应微乎其微。大多数创始人如果能达到 Apple 规模的边角料水平都会感到欣喜若狂...

- The Unbundling of ChatGPT (Feb 2024 Recap): ChatGPT 的解构(2024 年 2 月回顾):ChatGPT 达到顶峰了吗?此外:我们照例为 AI Engineer 准备的 2024 年 2 月高信号要点回顾!

- Fireside Chat w/ Mistral CEO, Arthur Mensch: 加入我们,听取 Mistral 联合创始人兼 CEO Arthur Mensch 与 Elad Gil 的对话。涵盖的主题包括:开源与 LLM、Agent 以及多...

- Anthropic CEO on Leaving OpenAI and Predictions for Future of AI: Dario Amodei 是 Anthropic 的联合创始人兼 CEO。在本集中,我们讨论了对 2024、2025 年及以后 AI 行业的详细预测。Dario 讨论了...

- 开发者 AI 实用入门 – TakeHomes Library:未找到描述

- ConversationChain 默认提示词导致模型与自身对话 · Issue #6138 · langchain-ai/langchain:系统信息 langchain==0.0.195 python==3.9.6 谁能帮忙?@hwchase17 信息 官方示例 notebooks/脚本 我自己修改的脚本 相关组件 LLMs/Chat Models Embedding Models...

- HEALTHCHECK 标志 "start-interval" 在 Docker 版本 24.0.5, build ced0996 中无法识别 · Issue #6938 · docker/for-mac:描述 Docker 文档指出 HEALTHCHECK 有一个名为 "start-interval" 的标志(文档)。实际上在 Dockerfile 中使用该标志会导致错误。复现 使用此 Dockerfi...

- 工具错误处理 | 🦜️🔗 Langchain:使用模型调用工具存在一些明显的潜在失败模式。首先,模型需要返回一个完全可以被解析的输出。其次,模型需要返回工具参数,这些参数...

- Issues · langchain-ai/langchain:🦜🔗 构建上下文感知的推理应用。通过在 GitHub 上创建账号为 langchain-ai/langchain 的开发做出贡献。

- Issues · langchain-ai/langchain:🦜🔗 构建上下文感知的推理应用。通过在 GitHub 上创建账号为 langchain-ai/langchain 的开发做出贡献。

- Issues · langchain-ai/langchain:🦜🔗 构建上下文感知的推理应用。通过在 GitHub 上创建账号为 langchain-ai/langchain 的开发做出贡献。

- Issues · langchain-ai/langchain:🦜🔗 构建上下文感知的推理应用。通过在 GitHub 上创建账号为 langchain-ai/langchain 的开发做出贡献。

- GitHub - Haste171/langchain-chatbot: AI Chatbot for analyzing/extracting information from data in conversational format.: 用于以对话形式分析/提取数据信息的 AI Chatbot。- Haste171/langchain-chatbot

- GitHub - ossirytk/llama-cpp-chat-memory: Local character AI chatbot with chroma vector store memory and some scripts to process documents for Chroma: 带有 Chroma 向量存储记忆的本地角色 AI Chatbot,以及一些为 Chroma 处理文档的脚本 - ossirytk/llama-cpp-chat-memory

- How To Control Your Chatbot Actions and Prompt System: LangGraph: #langgraph #langchain #ai #chatbot #python #automation 如果你一直在关注 LangChain 中的 Agent,你会知道有很多构建 Agent 的方法,但在...

- Mr. Beast Meets Mistral: AI Created a Cookbook Based on His Wildest Stunts!: 今天我们制作了 Beast 食谱。“Beast Cookbook” 的想法是一种有趣且富有创意的方式,可以与 Mr. Beast 的内容互动,并生成一个有趣的虚构...