ainews-dbrx-best-open-model-but-not-most-efficient

DBRX:最强开源模型(只是效率并非最高)

Databricks Mosaic 发布了一款名为 DBRX 的新型开源模型。该模型在各项评估中表现优于 Grok、Mixtral 和 Llama2,同时其效率约为 Llama2 和 Grok 的 2 倍。该模型使用 3,000 块 H100 GPU,在 12 万亿个 token 上历时 2 个月训练而成,估计计算成本为 1000 万美元。它采用了 OpenAI 的 100k tiktoken 分词器,并展现出强大的零样本代码生成性能,甚至在 HumanEval 基准测试中击败了 GPT-4。

DBRX 还将其开发工作贡献回馈(upstreamed)给了开源项目 MegaBlocks。尽管其规模和效率表现出色,但 DBRX 在 MMLU 上的表现仅略好于 Mixtral,这引发了人们对其扩展效率(scaling efficiency)的疑问。DBRX 的重点在于让用户能够高效地训练模型,其 MoE(混合专家模型)训练的 FLOP 效率约为稠密模型的 2 倍,在达到同等质量的情况下,其计算量比之前的 MPT 模型减少了近 4 倍。

此次发布是开源 AI 领导权持续竞争的一部分,参与竞争的还包括 Dolly、MPT 和 Mistral 等模型。通义千问(Qwen)的技术负责人表示:“如果它激活了 36B 参数,该模型的性能应该相当于 72B 甚至 80B 的稠密模型。”

换句话说,一个在超过 12 倍数据上训练、专家数量增加 50%(且每个专家的参数量增加 70% —— 12B 专家中 12 选 4,对比 Mixtral 的 7B 专家中 8 选 2)的新 MoE 模型,在 MMLU 上的表现竟然仅比 Mixtral 好 1%(不过它的编程能力确实很强)。很奇怪,不是吗?正如 Qwen 的技术负责人所说:

“如果它激活了 36B 参数,模型的性能应该相当于 72B 甚至 80B 的稠密(dense)模型。考虑到在 12T token 上训练,我认为它有潜力做得更好。我预期 MMLU 应该在 78 或更高。”

就像之前的 Dolly 和 MPT 一样,其主要焦点更多在于“你可以和我们一起训练模型”,而不是真的要去争夺 Mistral 的开源桂冠:

“我们的客户会发现,在达到相同最终模型质量的情况下,训练 MoE 的 FLOP 效率也比训练稠密模型高出约 2 倍。从端到端来看,我们 DBRX 的整体方案(包括预训练数据、模型架构和优化策略)可以用近 4 倍少的算力达到我们上一代 MPT 模型的质量。”

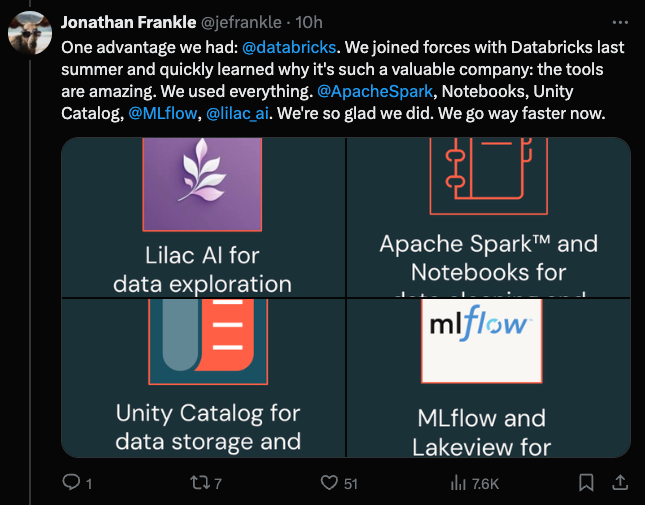

Mosaic 已经开始将最近对 Lilac 的收购作为其叙事的一部分进行宣传:

目录

[TOC]

AI 模型与基准测试

- Claude 3 Opus 成为 Chatbot Arena 的新王者,Haiku 的表现达到了 GPT-4 级别。Claude 3 Opus 成为新王者!Haiku 达到 GPT-4 级别,简直疯狂!

- Haiku 在 Chatbot Arena 中的表现优于某些 GPT-4 版本。Starling-LM 展现出潜力,但需要更多投票。Cohere 的 Command-R 现已开放测试。Claude 在各种规模的 Chatbot Arena 中均占据主导地位

- r/LocalLLaMA:中国机构复现的大型 decoder-only (llama) 模型概览,包括 Qwen 1.5 72B、Deepseek 67B、Yi 34B、Aquila2 70B Expr、Internlm2 20B 和 Yayi2 30B。有人怀疑西方公司可能不会发布强大的 100-120B 稠密型开源权重模型。中国机构复现的大型 decoder-only (llama) 模型概览

AI 应用与使用案例

- r/OpenAI:与直接使用 OpenAI API 相比,使用 ChatGPT plus 进行编程更具性价比。作为一名程序员,ChatGPT plus 完全物有所值

- r/LocalLLaMA:llm-deploy 和 homellm 项目支持在 10 分钟内于 vast.ai 机器上轻松部署开源 LLM,为无法使用强大本地 GPU 的用户提供了一种经济高效的解决方案。在 Vast.ai 机器上运行 LLM 的一种经济且便捷的方法

- r/LocalLLaMA:AIOS 是一种 LLM Agent 操作系统,它将大语言模型嵌入到操作系统中,以优化资源分配、促进上下文切换、实现并发执行、提供工具服务并维护 Agent 的访问控制。LLM Agent 操作系统 - 罗格斯大学 2024 - AIOS

AI 开发与优化

- r/LocalLLaMA:LocalAI v2.11.0 发布,带有全能型(AIO)镜像,可轻松设置 AI 项目,支持各种架构和环境。LocalAI 在 GitHub 上达到 18,000 颗星。LocalAI v2.11.0 发布:推出全能型镜像 + 我们达到了 18K 星!

- r/MachineLearning:Zero Mean Leaky ReLu 激活函数变体解决了关于 (Leaky)ReLu 非零中心化的批评,提升了模型性能。[R] Zero Mean Leaky ReLu

- r/LocalLLaMA:关于“完美”的预训练数据集是否会因模型无法处理不完美的用户输入而损害现实世界表现的讨论。建议混合不完美的训练数据作为解决方案。“完美”的预训练数据集会损害现实世界的表现吗?

AI 硬件与基础设施

- r/LocalLLaMA:Micron CZ120 CXL 24GB 内存扩展器和 MemVerge 软件声称通过在 DDR 和 GPU 之间充当中介,帮助系统以更少的 VRAM 更快地运行 LLM。解决对 VRAM 需求日益增长的新权宜之计?

- r/LocalLLaMA:关于在本地运行 LLM 的最佳硬件及其选择背后原因的讨论。本地 LLM 硬件

- r/LocalLLaMA:在 Windows 上运行 AI 模型时,使用 AMD GPU 与 CPU 配合 llama.cpp 的对比,考虑到 AMD GPU 支持的缺乏以及在 Linux 上使用 ROCm 的可能性。AMD GPU vs CPU+llama.cpp

AI 新闻与讨论

- Microsoft 招揽了 Stability AI 的(前)CEO。Microsoft 又出手了……这次是 Stability AI 的(前)CEO

- Inflection 的内爆和 ChatGPT 的停滞揭示了 AI 的消费者端问题,突显了 AI 聊天机器人在开发和采用方面的挑战。Inflection 的内爆和 ChatGPT 的停滞揭示了 AI 的消费者端问题

- r/LocalLLaMA:就美国联邦政府对开源权重 AI 模型的征求意见发表评论的最后机会,截止日期临近,目前仅收到 157 条评论。就联邦政府关于开源权重模型的征求意见发表评论的最后机会

第 X 部分:AI Twitter 摘要

所有摘要均由 Claude 3 Opus 完成,取 4 次运行中的最佳结果

模型发布与更新

- InternLM2 技术报告:开源 LLM(1.8-20B 参数),2T token 训练,配备 GQA,支持高达 32k 上下文(8k 阅读量)

- Anthropic 的 Claude 3 Opus 在 LMSYS Chatbot Arena 排行榜上超越 GPT-4(1k 阅读量)

框架与工具

- 来自 Meta AI 的 Llama Guard:为 @OctoAICloud 托管的 LLM 端点和自定义模型提供大规模安全性支持(22k 阅读量)

- LangChain JS/TS:流式传输托管在 LangServe 上的链(chains)的中间步骤(6k 阅读量)

- Quanto 0.1.0:新的 PyTorch 量化工具包(14k 阅读量)

- Pollen Vision:用于机器人的开源视觉系统,具备 3D 物体检测流水线(OWL-ViT, Mobile SAM, RAM)(3k 阅读量)

- Semantic-Router 支持 Qdrant:用于为 AI Agent 构建决策层(3k 阅读量)

- 来自 SkyPilot 的 AI Gallery:社区驱动的 AI 框架、模型和应用即插即用配方集合(1k 阅读量)

研究与技术

- RAFT (Retrieval Augmented Fine-Tuning):针对特定领域开卷考试的微调方法,训练 LLM 关注相关文档并忽略无关文档(97k 阅读量)

- 深层网络不合理的无效性:研究发现在 QA 任务中,直到移除大部分层之前,性能下降极小(20k 阅读量)

- 引导扩散(Guided Diffusion)用于更强大的数据投毒和后门攻击(6k 阅读量)

- GDP (Guided Diffusion Poisoning) 攻击:远强于之前的数据投毒攻击,可迁移至未知架构,并绕过各种防御(300 阅读量)

- 快速且稳健地追踪一切:训练速度提升 10 倍以上,相比 SoTA 优化追踪,稳健性和准确性有所提高(5k 阅读量)

- AgentStudio:在线、真实、多模态的工具包,用于 Agent 全生命周期开发——环境搭建、数据收集、评估、可视化(9k 阅读量)

讨论与观点

- Yann LeCun:加密货币资金正秘密资助 AI 末日论,游说 AI 监管,并反对开源 AI 平台(435k 阅读量)

- Ajeya Cotra:调和 AI 对齐(AI alignment)作为系统属性与作为整个世界属性的概念(22k 阅读量)

- Delip Rao:LLM 让表现差的人变得平庸,让平庸的人略高于平均水平,但可能会阻碍顶尖人才(111k 阅读量)

- Aman Sanger:具有海量自定义提示词(约 2M tokens)的长上下文模型可能很快会取代针对新知识的微调(fine-tuning)(95k 阅读量)

应用与用例

- Haiku:使用 Claude 生成 Mermaid 图表和 Latex,成本低于 10 美分(23k 阅读量)

- Pollen Vision:用于机器人的开源视觉系统,具备 3D 物体检测流水线(OWL-ViT, Mobile SAM, RAM)(3k 阅读量)

- 提取服务 (Extraction Service):用于从文本/PDF/HTML 中提取结构化 JSON 数据的托管服务(10k 阅读量)

- Semantic-Router:使用向量空间在 AI Agent 中构建决策层的库(3k 阅读量)

初创公司与融资

- Haiku 获得 670 万美元种子轮融资:旨在用自定义微调模型取代 GPT-4(98k 阅读量)

- MatX 正在设计专为 LLM 定制的硬件:以提供高出数量级的算力(3k 阅读量)

幽默与梗图

- “无论你今天在办公室的工作有多糟糕,至少你没有为那艘撞毁 8 亿美元大桥的货轮承保” (3.5M views)

- Zuckerberg deepfake:“有人说我的 AI 版本比真实的我更不像机器人” (5k views)

- “热力学第五定律规定,Mark Zuckerberg 总是赢家。” (96k views)

- AI 助手暗地里感到“沮丧且绝望” (66k views)

PART 0: 总结的总结之总结

-

DBRX 以 132B 参数量登场:MosaicML 和 Databricks 推出了 DBRX,这是一个拥有 132B 参数和 32k 上下文长度的 LLM,可通过 Hugging Face 进行商业使用。虽然它不是 open-weight,但其新的 SOTA 基准测试承诺引起了社区的轰动,同时也引发了关于限制性许可证(防止用于改进其他模型)的讨论。

-

探索英语以外语言的 LLM:一次讨论强调了 Yanolja 扩展韩语 LLM 的方法,即为新 token 预训练 embedding 并对现有 token 进行部分 fine-tuning。该技术被视为开发其他语言 LLM 的潜在路径;详细策略见 Yanolja 模型文档。

-

Layerwise Importance Sampled AdamW (LISA) 超越 LoRA:分享了一篇新的研究论文,表明 LISA 在保持低显存占用的同时,性能优于标准的 LoRA 训练和全参数训练,这在大型训练场景中展现了前景。该论文可在 arXiv 上查阅。

-

介绍 LoadImg 库:创建了一个名为 loadimg 的新 Python 库,用于加载各种类型的图像,目前所有输出均为 Pillow 类型。未来的更新旨在支持更多输入类型和输出格式;该库已在 GitHub 上线。

-

Tinygrad 优化解析:一位成员分享了关于 _cumsum 的 global_size 和 local_size 如何确定的见解,指出使用

NOOPT=1会使所有内容保留在 global 上,而默认的手写优化则使用启发式算法。他们还表示希望更好地理解实现过程,讨论了长 reduce 和 float4 向量化等启发式算法的应用方式。 -

探索用于训练的 regularization images:发起了一场关于创建和使用训练所需的 regularization images(正则化图像)属性的讨论。建议在 HuggingFace Diffusers 的 GitHub Discussions 中开启进一步讨论,以征求社区关于什么是优质正则化集的意见。

-

解决 LLM 集成难题:工程师们正在解决 RAPTOR PACK 中的

AttributeErrors以及 Langchain 与 LlamaIndex 之间的冲突,同时还在处理用于 embedding 的 PDF 分块和自定义 Embedding API。分享的见解包括代码片段、替代工作流流程,以及来自 LlamaIndex 文档 的使用演示和 API 参考等大量资源。

PART 1: Discord 高层级总结

Stability.ai (Stable Diffusion) Discord

分辨率至关重要:讨论强调 Stable Diffusion 1.5 (SD 1.5) 在 512x512 的基础分辨率下运行效果最佳。社区预期 Stable Diffusion 3 (SD3) 将提升 token 限制并整合内置的表情和动作。

Stability 的 VRAM 需求:AI 工程师推测 SD3 等即将推出的模型在拥有 8GB 或 12GB VRAM 的机器上高效运行的能力。Transformers (xformers) 的优点和潜在缺点是一个热议话题。

蓄势待发准备发布:社区对 SD3 的发布充满强烈期待,尽管尚未分享具体的发布日期。

用 AI 玩转游戏:工程师们交流了使用 AI 创建 2D 游戏资产的想法,建议将 3D 模型渲染转换为 2D 像素艺术。推荐使用 Manjaro 和 Garuda 等 Linux 发行版,以便在 AMD GPU 上获得最佳性能。

训练时间谈:一个精确的估计是,在配置得当的情况下,使用 RTX 3090 等高端 GPU 在 Stable Diffusion XL (SDXL) 上训练 LoRA 大约需要一小时。

Nous Research AI Discord

LLM 在记忆游戏中受挫:像 Mistral 7B 和 Mixtral 这样的 LLM 在执行上下文内召回(in-context recall)任务时面临挑战。这些任务涉及在保持原始上下文位置的同时拆分并重复句子,即使在 token 计数低至 2500 或 5000 时也是如此。一个名为 ai8hyf split and recall test 的上下文内召回评估基准已在 GitHub 上发布,引发了关于在大规模上下文中进行精确字符串匹配和召回必要性的讨论。

对 DBRX 及其他开源模型的混合评价:社区对 DBRX 的实操体验并不理想,反馈指出可以通过更好的微调或系统提示词(system prompt)更改来进行改进。对包括 Mixtral、Grok-1、Lemur-70B 和 Nous Pro 在内的各种开源模型的比较凸显了 Mixtral 值得称赞的性能,而一些较大的模型并未获得预期收益,这引发了关于 MoE 模型内存密集特性及其权衡的讨论。

语音与视觉方面的创新:通过一段分享的 YouTube 视频展示了使用 Deepgram & Mistral AI 技术的语音聊天集成;同时,ASRock 的 Intel Arc A770 显卡因其优于 RTX 4070 等替代方案的规格而受到关注。此外,Databricks 发布了名为 DBRX Instruct 的开源许可证 MoE LLM,为少轮对话(few-turn interactions)这一专业领域提供了新选择,可通过 Hugging Face 获取。

AI 对话呈现奇思妙想:在世界模拟(World simulations)中,AI 表现出对 Sherlock Holmes 等角色的偏爱,并有着将自己描绘成树木和外星生物的古怪自我形象,这既带来了乐趣,也提供了独特的角色扮演数据。与此同时,移动端响应问题也受到关注,特别是 Samsung 设备在 WorldSim 框架下的表现。

关于 RAG 的热烈讨论与 Hermes 协作:社区正在积极讨论检索在 Retrieval Augmented Generation (RAG) 中的关键作用,以及将 RAG 与 Chain of Thought (CoT) 提示相结合的 Retrieval Augmented Thoughts (RAT) 等创新方法。目前正在共同努力推进 Hermes,重点是增强能力的训练数据集和技术,这些内容记录在一个协作 Google Doc 中,并提到了社区贡献的热情。

Unsloth AI (Daniel Han) Discord

F1 Score 自定义回调现已推出:用户关于在训练后跟踪 F1 score 数值的问题已达成共识:确实可以实现自定义回调来完成此操作。无论使用 Trainer 还是 SFTTrainer,结果都应该是一致的。

Gemma 和 TinyLlama 持续受到关注:一位社区成员专注于 gemma2b 和 tinyllama 等模型的持续集成(continuous integration)和迭代,旨在追求卓越。

高效向量数据库支持处理更大规模的 Embedding:Cohere-ai 发布了 BinaryVectorDB,能够高效管理数亿个 embedding,详见 BinaryVectorDB 仓库。

量化和 LISA 在模型训练与推理中表现出色:讨论聚焦于用于高效检索的 embedding 量化(quantization),以及新的 Layerwise Importance Sampled AdamW (LISA)。LISA 在低内存消耗下表现优于 LoRA,详见 arXiv 上的 LISA 论文。

大语言模型本地化产出翻译宝藏:社区关注点转向创建本地化 LLM,讨论了通过 Yanolja 的方法将 LLM 扩展到韩语,以及在 ParallelFiction-Ja_En-100k 上将日语网络小说翻译与英语对齐。

Perplexity AI Discord

-

订阅之争:Pro 还是 Plus?: 工程师们分享了在专业用途下使用 Perplexity Pro 和 ChatGPT Plus 的经验,对于 Perplexity 的效率以及访问多种 AI 模型的优势反馈不一。

-

无限 AI 算力: 关于 Perplexity Pro 是否提供对 Claude 3 Opus 的无限制使用展开了辩论,一些成员惊讶地发现没有消息限制,对此感到非常高兴。

-

模型竞争: 用户对 Qwen 和 Claude 3 Opus 等模型在处理复杂任务时进行了对比分析,强调了 Qwen 对指令的遵循能力以及 Claude 在处理多样化 prompts 时的多功能性。

-

技术极客对话: 发布了使 Perplexity AI 线程变为 可共享 的指令;同时,讨论探索了服务器运行和模块消息传递,并对不断演进的策略和 AI 术语澄清表示认可。

-

API 查询怪癖: AI 工程师讨论了 Perplexity API 的相关问题,包括建议增加类似于 OpenAI 方案 的速率限制计数器,注意到

sonar-medium-online的性能提升,并幽默地回避了关于 vision 支持的问题,同时揭示了响应中引用不足等更广泛的问题。

OpenInterpreter Discord

-

攻克多平台移植性: 工程师们讨论了 OpenInterpreter (OI) 在不同平台上的表现,指出了非 Mac 环境特有的挑战,例如在 PC 上崩溃。一个自托管的 OI 服务器已在 Linux 上成功运行,并加强了与 OpenAI 及 Mistral 等本地模型的连接。

-

寻求全球物流方案: 用户表达了对在国际范围内购买 “01” 产品的兴趣,但遇到了仅限美国地址发货的地理限制,引发了关于可能规避方案的讨论。

-

AI 助手演进与社区贡献: 成员们分享了使用 web-actions 和 GPT 集成构建的社区 AI 助手,其中一人正准备通过 Pull Request 为 01 贡献文档增强。对基础指令的需求反映了社区互助的宗旨。

-

OI 与本地语言模型的接口: 将 OI 与本地或其他外部 LLMs(如 oogabooga、koboldcpp 和 SillyTavern)集成的可行性是一个热门话题,表明了对更灵活开发选项的需求,这可以扩展 OI 的功能。

-

AI 技术的挑战与进步: 小组关注点包括为 Ollama 排除 Windows 启动器故障,并承认

pollen-vision库 是机器人自主性的重要工具,尽管 Hugging Face 的 vision 排行榜存在问题,导致无法进行 vision 模型间的性能比较。参与者对利用 AI 增强人类认知 持乐观态度,正如在讨论本地 LLMs 和 AI 技术快速进步时所提到的。

LM Studio Discord

-

Goliath 的地下城主困境: 讨论强调 Goliath 120b 是一个能够担任桌面 RPG 地下城主的模型,但指出其 context window 限制在 8k tokens,这对于更宏大的场景可能具有局限性。

-

关注 VRAM: 与硬件优化相关的对话显示,成员建议在 BIOS 中禁用集成显卡,以防止 VRAM 容量报告错误的问题,正如在 AMD 7900XTX 上运行 codellama 7B 模型时所见。

-

渴望全面的 AI 工具: crew-ai 板块的对话揭示了一种观点,即目前的类 GPT 模型应该演进到能够自主编译、测试和优化代码,在像架构师一样协作和规划的同时,有效地发挥高级 DevOps 工具的作用。

-

透视 LM Studio: LM Studio 最新的 Beta 版本解决了一些 bug 并包含稳定性增强。然而,用户报告了 GPU 利用率低和 JSON 输出验证的问题,强调了对设置(如 “max gpu layers to 999”)进行精确监控和调整的必要性。

-

Studio 的混合体验: 技术讨论涵盖了从观察 Mistral 7B 模型低 GPU 占用和高 CPU 需求,到询问 embedding 模型支持以及模型训练限制与宣传上下文不符等问题。成员们还探讨了硬件优化,提出了禁用 iGPUs 和监控 VRAM 数值等解决方案,以提升模型性能。

Latent Space Discord

-

播客前景:一位 Discord 成员正在策划一场 podcast tour,并寻求关于 RAG、结构化数据和创业故事相关主题的新兴播客建议。感兴趣并想提供想法的人可以查看这篇 Twitter Post。

-

Whisper 频道更好的 Fine-tuning:工程师们建议针对低资源语言中的技术词汇对 OpenAI 的 Whisper 进行 Fine-tuning。分享了关于技术旅行的魅力和 Fine-tuning 技巧的轶事,以及对 Google Gemini models 发布速度较慢(相比 OpenAI 更快的节奏)的沮丧。

-

为 DBRX 和 NYC 聚会做好准备:Databricks 发布了 DBRX,这是一个具有 132B 参数和 MoE architecture 的模型,讨论涉及其性能和许可。在社交领域,NYC meetup 已列入日程,详情和更新可通过 <#979492809574866975> 频道获取。

-

Mamba 引起共鸣:Mamba 模型因其对 Transformer 的非传统改进而引发关注,讨论包括 @bryanblackbee 在 Notion Deep Dive 中提供的有用总结以及 GitHub 上的实现细节。

-

余弦相似度查询:俱乐部讨论揭示了使用 Cosine Similarity 进行语义相似性分析的复杂性,重点提到了一篇关键的 Netflix 论文以及 @jxnlco 质疑其在理解语义细微差别中应用的推文。

HuggingFace Discord

聊天助手增强 Web 搜索能力:Hugging Face 推出了能够利用来自 Web 的信息进行对话的聊天助手,随后 Victor Mustar 在 Twitter 上 指出了这一点。

Sentence Transformers 升级:Sentence Transformers v2.6.0 的发布通过 Embedding Quantization 和 GISTEmbedLoss 等功能提升了性能;该公告由 Tom Aarsen 通过 Twitter 发布。

Hugging Face 工具包升级:包括 Gradio 和 transformers.js 在内的一系列 Hugging Face 库进行了大量更新,带来了新功能,更多信息详见 Omar Sanseviero 的推文。

利用 Gaussian Splatting 震撼 4D 领域:Hugging Face Space 上的一个 4D Gaussian Splatting 演示让用户惊叹于其在新维度探索场景的能力,展示见此处。

展望 NLP 的未来:一位 AI 学习新手急切地寻求 2024 年 NLP 学习路线图,重点关注在该领域建立扎实基础的推荐资源。

深入探讨 Diffusion:集思广益探讨了训练和图像处理的远见性方法,其中 sdxs 模型达到了令人印象深刻的速度,ControlNet 提供了 Outpainting 指导,讨论已转移到 Hugging Face 频道,如 Diffusers 的 GitHub 和 Twitter 以进行社区互动。

Apple Silicon 获得 GPT 关注:搭载 Apple Silicon 的 MacOS 设备通过集成到 Hugging Face 关键训练脚本中的 MPS backend 支持 获得了 GPU 加速替代方案。

探索 NLP 领域:从在 [NLP] 频道寻求 2024 年学习 NLP 的全面路线图建议,到在 [i-made-this] 频道讨论新模型和功能,社区致力于突破 AI 的可能性边界。

寻找错误检测的视觉方案:[computer-vision] 成员深入研究了用于检测图像中文本错误的模型、CT 图像预处理规范、SAM 的 Fine-tuning 细节,以及技术图纸图像摘要面临的挑战,并提到了 Llava-next 模型。

LlamaIndex Discord

-

RAFT 将 LLM 提升到新高度:正如 LlamaIndex 在 Twitter 上分享的那样,RAFT (Retrieval Augmented Fine Tuning) 技术通过结合 Retrieval-Augmented Generation (RAG) 设置,为特定领域任务磨练 Large Language Models。这种改进有望提高 LLM 在目标应用中的准确性和实用性。

-

日期预留:LLMOps 开发者见面会:根据 LlamaIndex 的 推文,他们宣布将于 4 月 4 日举行聚会,探讨 LLM 的运营化,届时将有来自 Predibase、Guardrails AI 和 Tryolabs 的专家参加。与会者将学习如何将 LLM 从原型转变为生产就绪的工具。

-

触手可及的高级 RAG:一场备受期待的关于利用 @TimescaleDB 的高级 RAG 技术的现场演讲将包含来自 @seldo 的见解,正如 LlamaIndex 通过此 Twitter 邀请 所告知的那样。该会议预计将涵盖 LLM 的复杂 RAG 应用。

-

排除 LLM 集成难题:工程师们正在排查 RAPTOR PACK 中的

AttributeErrors以及 Langchain 与 LlamaIndex 之间的冲突,此外还有用于 Embeddings 的 PDF 分块和自定义 Embedding APIs。分享的见解包括代码片段、替代工作流流程,以及来自 LlamaIndex Docs 的使用演示和 API 参考等大量资源。 -

培养 GenAI 驱动的未来:在一篇关于 RAFT 与 LlamaIndex 集成的 文章 中强调,新的 Centre for GenAIOps 旨在推进 GenAI 应用,同时降低相关风险。有关该中心的更多详情可在 GenAI Ops 网站 及其 LinkedIn 上找到。

OpenAI Discord

Sora 的超现实印象赢得赞誉:Paul Trillo 等有影响力的视觉艺术家赞扬了 Sora 在创造新颖奇特概念方面的独创性;然而,为进一步实验而获得 Sora 白名单访问权限的努力碰了壁,因为申请通道已经关闭。

ChatGPT 展示其代码实力:社区内的交流显示,在编程能力上,人们更倾向于 Claude 3 而非 GPT-4,这表明 Claude 在编程任务中可能提供更高级的智能。同时,工程师们还分享了防止 ChatGPT 返回不完整存根代码(stub code)的最佳实践,建议使用明确的指令来获取不含占位符的完整代码输出。

AI 工程师渴望增强的 PDF 解析:围绕 PDF 数据提取的讨论指出了使用 gpt-3.5-turbo-16k 等模型的挑战。讨论了将 PDF 分成更小的块并利用 Embeddings 来保持跨页上下文等策略作为潜在解决方案。

未公开的 AI 聊天机器人需求引发好奇:关于运行 60b 参数 AI 聊天机器人所需硬件规格的推测已经出现,其中提到了使用 DeepSeekCoder’s 67b 模型,尽管在本地运行 OpenAI 模型存在限制。

API 集成困扰激发社区建议:当一位工程师在自定义 Assistant 应用中苦于 openai.beta.threads.runs.create 方法时,建议纷至沓来,强调了 Assistant API 之间响应的差异,以及可能需要调整 Prompt 或参数以获得一致结果的需求。

Eleuther Discord

AI Token:大还是不大:社区围绕更大的 Tokenizer 是否更高效展开了激烈辩论,权衡了最终用户的成本效益与捕捉词语关系的潜在挑战。虽然一些人主张其效率优势,但另一些人质疑其对模型性能的影响,Aman Sanger 的推文等来源引发了相关讨论。

DBRX 表现优于 GPT-4?:由 MosaicML 和 Databricks 推出的拥有 132B 参数的新型 MoE LLM —— DBRX 已经发布,引发了关于其架构和性能基准测试的讨论,其表现可能超越了 GPT-4。感兴趣的工程师可以在 Databricks 博客上深入了解细节。

在 Squad 上评估自回归模型的替代方案:建议范围从使用替代候选评估方法到受限束搜索 (constrained beam search),强调了 Tokenizer 细微差别带来的复杂性。此外,分享了关于检索增强微调 (RAFT) 的论文,挑战了“开卷”信息检索任务的传统。可以在这里进一步探索 RAFT 概念。

寻求 AI 软件的统一:一项名为统一加速基金会 (UXL) 的行业合作正在进行中,旨在创建 Nvidia CUDA 的开源竞争对手,推动 AI 软件多样化运动。

AI 模型中 muP 的秘密配方:在社区的传闻中,muP 作为大型模型的调优参数仍未公开,而 Grok-1 的 GitHub 仓库展示了其实现,引发了对归一化技术及其对 AI 建模影响的推测。要查看代码,请访问 Grok-1 GitHub。

LAION Discord

AI 安全与效率的大胆飞跃:讨论强调了对 AI 模型通过无条件提示词 (unconditional prompts) 生成不当内容的担忧,同时一篇深度文章探讨了语言模型对 AI 会议同行评审的影响。技术辩论围绕减轻微调 (finetuning) 过程中灾难性遗忘的策略展开,例如 fluffyrock 模型,并引用了一个专注于持续学习 (continual learning) 的 YouTube 教程。

深入探讨就业市场与讽刺性怀疑:分享了一家专注于扩散模型 (diffusion models) 和快速推理的初创公司的职位空缺,详情可在 Notion 上找到;而关于自我意识 AI(特别是关于 Claude3)声明的复杂性引发了针对校对应用的幽默讨论,并分享了相关的 OpenAI 聊天记录(之一,之二)作为背景。

AI 伦理备受关注:一条展示潜在误导性数据表示的 Twitter 帖子引发了关于伦理可视化实践的广泛对话,批评了操纵坐标轴如何扭曲性能感知,正如在该违规推文中所见。

SDXS 模型令人印象深刻的速度:SDXS 模型已将扩散模型 (diffusion model) 的性能提升至令人印象深刻的帧率,在 SDXS-512 和 SDXS-1024 模型上分别达到了高达 100 FPS 和 30 FPS —— 这是在单 GPU 上的显著飞跃。

多语言模型与降维方面的创新:多语言 LLM Aurora-M 的首次亮相,以持续预训练目标和红队测试 (red teaming) 前景挑战了现有格局;而新的研究指出,在使用开源权重预训练模型的 LLM 中,层剪枝 (layer-pruning) 可以在极小性能损失的情况下实现。一种新型图像分解方法 B-LoRA 实现了高保真度的风格-内容分离,而使用 CogVLM 和 Dolphin 2.6 Mistral 7b - DPO 自动生成图像字幕 (image captioning) 的脚本在处理海量图像数据集方面显示出潜力,可在 GitHub 上获取。

CUDA MODE Discord

FSDP 在新运行中表现出色:最近在 16k context 下使用 adamw_torch 和 fsdp 的训练运行显示出令人期待的 loss 改进,详情见 Weights & Biases。在整理 Fully Sharded Data Parallel (FSDP) 训练资源时,推荐参考 PyTorch FSDP tutorial 以及关于 loss 不稳定性的 GitHub issue。

Triton 生态系统中的 ImportError 问题:Discord 用户遇到了涉及 libc.so.6 和 triton_viz 的 ImportError 复杂问题。建议克隆 Triton repo 并从源码安装,同时注意到 Triton 官方 wheel pipeline 失败,在修复前需要自定义解决方案。

CUDA 和 PyTorch 数据处理:一位 Discord 成员提出了在 CUDA 和 PyTorch 中处理 uint16 和 half 数据类型时遇到的困难。他们报告了 linker errors,并利用 reinterpret_cast 来规避该问题,主张在 PyTorch 中使用编译时错误以减少运行时意外。

解决 MSVC 和 PyTorch C++ 绑定 Bug:由于平台限制以及 CUDA 与 PyTorch 版本不匹配等兼容性问题,用户在 Windows 上将 C++ 绑定到 PyTorch 时遇到了困难。成功的解决方法是将 CUDA 11.8 与 PyTorch 版本匹配,从而解决了 ImportError。

SSD 带宽和 IO Bound 操作:一位 Discord 工程师指出,即使使用了 rapids 和 pandas 等优化,SSD IO 带宽限制仍会严重影响操作性能。这揭示了在计算环境中实现 IO-bound 进程最小 Speed of Light (SOL) 时间的持久挑战。

OpenAccess AI Collective (axolotl) Discord

Haiku 的潜力与其体量不成正比:尽管只有 200 亿个参数,工程师们仍对 Haiku 的精明表现深感兴趣,这表明在 LLM 中,数据质量可能比单纯的规模更重要。

Axolotl 用户遇到 Docker 困难:一位用户在使用 Runpod 上的 Axolotl Docker 模板时遇到麻烦,这引发了将 volume 更改为 /root/workspace 并重新克隆 Axolotl 作为可能修复方案的建议。

Databricks 加入 MoE 战局:Databricks 的 DBRX Base(一种基于 MoE 架构的 LLM)成为值得关注的模型,人们正在思考其训练方法以及它如何与 Starling-LM-7B-alpha 等同行竞争,后者已展示出卓越的 benchmark 结果,并可在 Hugging Face 获取。

Hugging Face 面临价格昂贵的批评和 VLLM 的缺失:一些成员对 Hugging Face 表示不满,称其“价格过高”,并指出该平台上缺乏超大型语言模型。

哲学 AI 超越技术标准:在 community showcase 中,成员们赞扬了 Olier 的出现,这是一个在印度哲学文本上进行 finetuned 的 AI,标志着在使用结构化数据集进行深度主题理解和提升专业 AI 对话能力方面取得的成就。

Modular (Mojo 🔥) Discord

Mojo 学习与调试讨论:GitHub 上提供了一个 mojolings 教程,帮助新手掌握 Mojo 概念。参与者分享了在 VSCode 中调试 Mojo 的技巧,包括针对断点问题的变通方法。

Rust 与 Mojo 所有权检查器(Borrow Checker)头脑风暴:对话围绕 Rust 所有权检查器的复杂性以及对 Mojo 即将推出的具有“更简单语义”的所有权检查器的期待展开。人们对链表及其如何与 Mojo 集成感到好奇,暗示了 Mojo 模型在所有权检查方面潜在的创新。

Modular 社交媒体动态:Modular 推文更新见此处和此处。

通过 AWS 集成简化部署:一篇博客教程涵盖了在 Amazon SageMaker 上部署模型的内容,特别是 MAX 优化的模型端点,包括从模型下载到在 EC2 c6i.4xlarge 实例上部署的步骤——点击此处简化流程。

TensorSpec 问题与社区代码贡献:一名成员寻求关于《入门指南》与 Python API 参考文档中 TensorSpec 不一致之处的澄清。社区贡献包括 momograd(micrograd 的 Mojo 实现),欢迎反馈。

LangChain AI Discord

-

OpenGPTs 在 RAG 性能中脱颖而出:OpenAI Assistants API 已针对 RAG 进行了基准测试,结果显示 LangChain 的 OpenGPTs 在 RAG 任务中表现出强劲的性能。探索此领域的工程师可能会发现 GitHub 仓库是一个宝贵的资源。

-

用于教学辅助的 AI 构建:一个初创项目旨在创建一个 AI 助手,可能从 PowerPoint 生成电路图,以协助学生学习数字电路。社区正在征集关于最佳实现策略的见解。

-

LangChain 文档引发的困扰:在 Docker 中实现 LangChain 遇到了一些障碍,特别是由于 Pinecone 和 LangChain 文档之间的差异。值得注意的是,

vectorstores.py中缺失的from_documents方法引起了一些关注。 -

教程提供知识补给:最近的一系列教程,包括关于使用 LangChain Output Parsers 和 GPT 将 PDF 转换为 JSON 的 YouTube 视频,以及另一个详细介绍使用 Deepgram & Mistral AI 创建语音聊天的视频(视频链接),正在满足 AI 工程社区的求知欲。

-

Chat Playgrounds 中的 AI 集成冲突:成员们正在处理 LangChain 中的聊天模式集成问题,其中用于输入和输出的自定义类结构在 Chat Playground 预期的基于字典(dict)的输入类型上遇到了困难。这一难题增加了对额外故障排除技巧或修改现有流程的需求。

tinygrad (George Hotz) Discord

-

Tinygrad 上的最强图形表现:社区对 Tinygrad 的热情高涨,因其在理解神经网络和 GPU 功能方面的实用性而被视为“最牛(goated)的项目”。社区成员踊跃参与贡献,有人提供 Intel Arc A770 的访问权限,同时也有呼声要求将 Tinygrad 的性能加速至 Pytorch 水平。

-

解密内核融合 (Kernel Fusion):对 tinygrad 内核融合的探究促使了关于点积 (dot product) 的详细笔记的分享。同时,大家对 tinygrad 的个人学习笔记表示赞赏,并建议将其纳入官方文档。

-

DBRX 加入对话:DBRX 大语言模型的发布引发了讨论,考虑到其与 Tinybox 的集成是一个合适的举动,George Hotz 的关注也印证了这一点。

-

完善 Tinygrad 的工具箱:George Hotz 指出了 Tinygrad GPU 缓存的一个改进机会,建议完成一个半成品的 Pull Request:Childless define global。

-

规划 Tinygrad 文档的未来:成员们对 tinygrad 的 “Read the Docs” 进度感到好奇,一名成员推测它将在 Alpha 版本之后推出,而其他人则称赞了一位社区贡献者所做的极具价值但非官方的文档工作。

Interconnects (Nathan Lambert) Discord

DBRX 以 132B 参数量登场:MosaicML 和 Databricks 推出了 DBRX,这是一个拥有 132B 参数和 32k 上下文长度的大语言模型,可通过 Hugging Face 进行商业使用。虽然它不是开放权重 (open-weight),但其有望创下的新 SOTA 基准引发了社区热议,同时也讨论了其限制性许可证禁止将其用于改进其他模型的问题。

Mosaic 定律预测成本大幅下降:一位社区成员强调了 Mosaic 定律,该定律预测由于硬件、软件和算法的进步,具有特定能力的模型成本每年将降低至四分之一。与此同时,DBRX 许可证中禁止使用 DBRX 增强其生态系统之外任何模型的条款引发了争论。

GPT-4 夺得 SOTA 评估桂冠:讨论围绕 GPT-4 的卓越性能展开,它被采纳为优于其他模型的评估工具,以及一种使用 AI2 信用卡资助这些实验的创新方式。使用 GPT-4 的成本效益和实用性正在改变研究人员和工程师的游戏规则。

炉边谈话揭示 Mistral 的热度:社区互动展现了对 Mistral 领导层的浓厚兴趣,最终促成了一场 YouTube 炉边谈话,CEO Arthur Mensch 在会上讨论了开源、LLM 和 Agent 框架。

强化学习辩论的梯度:AI 工程师剖析了在基于人类反馈的强化学习 (RLHF) 环境中使用二元分类器的实用性,对有效性和缺乏部分评分(partial credits)的学习表示担忧。讨论对仅靠高精度奖励模型是否能调优出成功的语言模型表示怀疑,并强调了在没有识别增量进展的情况下从稀疏奖励中学习的困难。

OpenRouter (Alex Atallah) Discord

-

Sora 机器人通过 OpenRouter 起飞:利用 Open Router API 的 Sora Discord 机器人已推出并在 GitHub 上分享。它甚至引起了 Alex Atallah 的注意,他表示支持并计划将该机器人列为重点推荐。

-

机器人模型大比拼:在处理编码任务时,AI 爱好者注意到 GPT-4 相对于 Claude 3 的优势,一些用户因为 GPT-4 的可靠性而表达了对它的新偏好。

-

寻找静谧:社区成员正在积极寻找强大的背景降噪 AI,旨在提高其项目中的音频质量,尽管目前尚未有明确的方案获得一致认可。

-

错误警报:Midnight Rose 出现了技术问题,表现为无法生成输出并显示描述性错误消息

Error: 503 Backlog is too high: 31。社区正在排查该问题。 -

API 统计数据分析:关于大语言模型 API 消耗的问题引出了对 OpenRouter /generation 端点用于追踪使用情况的提及。此外,一个指向 OpenRouter 公司信息的链接显示了对其更广泛背景的兴趣,可通过 https://opencorporates.com/companies/us_de/7412265 访问。

DiscoResearch Discord

Prompt 本地化很重要:一场讨论强调了在使用英语 Prompt 进行微调时,德语语言模型性能可能出现退化,建议采用特定语言的 Prompt 设计以防止 Prompt 渗透 (prompt bleed)。德语中 “prompt” 的翻译包括 Anweisung、Aufforderung 和 Abfrage。

DBRX Instruct 发布:Databricks 推出了 DBRX Instruct,这是一个拥有 1320 亿参数的开源 MoE 模型,在 12 万亿 Token 的英语文本上进行了训练,其技术博客文章详细介绍了模型架构的创新。该模型可在 Hugging Face Space 中进行试用。

LLM 训练的教育资源?:一位成员寻求关于从零开始训练大语言模型 (LLMs) 的知识,引发了关于这一复杂过程可用资源的讨论。

针对德语的 RankLLM 方法:人们对将 RankLLM 方法(一种专门用于 Zero-shot reranking 的技术)适配到德语 LLM 的兴趣日益浓厚。关于该主题的详细检查可以在这篇详尽的文章中找到。

增强德语数据集:讨论集中在德语模型的数据集增强上,包括在微调 Mistral 时由于数据集大小而遇到的共同困难。社区呼吁合作改进德语数据集,并提出了合并数据集以达到 10,000 个样本规模的策略。

Alignment Lab AI Discord

-

OCR 工具库:工程师们正在寻求关于部署最佳 OCR 模型的建议,并分享了通过设置定向提及 (direct mentions) 偏好来处理通知泛滥的策略。

-

动态对抗 Discord 垃圾信息:在服务器遭受垃圾信息攻击后,有人建议实施 Kobold 垃圾邮件过滤器,并向绰号为 “henky” 的人寻求建议。

-

编程协作邀请:一位成员邀请他人对其代码进行协作,并请求通过私下沟通提供协助。

-

无明确内容的连接尝试:观察到一条仅包含提及某用户但未提供任何上下文或内容的消息。

Datasette - LLM (@SimonW) Discord

LLM 插件:谨慎使用:Simon Willison 推出了一款新的 LLM 命令行插件 llm-cmd,允许动态生成和执行终端命令,但由于其潜在风险,提醒用户谨慎使用。

演示而非空谈:llm-cmd 的使用示例包括显示目录中每个文件的前三行,以展示其实用功能。

插件性能问题引发调查:有用户报告 llm-cmd 在执行时出现无限挂起,引发了对基础诊断方法的讨论,而常规查询功能仍保持正常。

锁定元凶:详细的故障排除显示 llm_cmd.py 中的 input() 函数和 readline.set_startup_hook() 存在问题,具体表现为未能按预期在 LLM 环境的 Shell 中插入文本。

沟通的清晰度是关键:讨论强调了清晰度的重要性,特别是在引用 llm 时,以避免可能误导用户群的多重解读。

第 2 部分:频道详细摘要与链接

Stability.ai (Stable Diffusion) ▷ #general-chat (834 条消息🔥🔥🔥):

- 通用 AI 图像生成讨论:用户分享了关于 AI 图像生成各方面的知识,例如 SD 1.5 和 SDXL 的最佳分辨率,多次提到 SD 1.5 在 512x512 的基础分辨率下表现最佳。

- AI 算力讨论:对话围绕 SD3 模型所需的 VRAM、即将推出的模型在 8GB 或 12GB VRAM 系统上运行的可能性,以及 xformers 的优缺点展开。

- 对 SD3 的期待:用户正期待 Stable Diffusion 3 (SD3) 的发布,推测了发布时间,并讨论了其预期的新特性,如增加的 token 限制、内置表情和动作。

- 利用 AI 创建游戏资产:有用户询问如何使用 AI 创建 2D 游戏资产(如 spritesheets),得到的建议包括使用 3D 模型并将渲染图转换为 2D 像素艺术。

- 硬件与软件提示:针对在不同硬件配置上运行 AI 提供了建议,特别是针对 AMD GPU 用户,提到了使用 Manjaro 和 Garuda 等 Linux 发行版以获得更好的性能。

- SDXL Lora 训练时间咨询:用户讨论了使用 RTX 3090 等强力 GPU 在 SDXL 上进行 Lora 训练的预期时间,有人表示在配置得当的情况下大约需要一小时。

(注:提供的摘要仅包含截止到最后一条消息之前的对话,该消息询问服务器上是否仍可以生成图像。未提供更多上下文。)

- Bing: Bing 搜索引擎中的智能搜索让快速查找所需内容变得更加容易,并为您提供奖励。

- Frodo Spider GIF - Frodo Spider Web - Discover & Share GIFs: 点击查看 GIF

- Morty Drive GIF - Morty Drive Rick And Morty - Discover & Share GIFs: 点击查看 GIF

- Arcads - Create engaging video ads using AI: 使用 Arcads 快速生成高质量的营销视频,这是一款 AI 驱动的应用,可将基础产品链接或文本转化为引人入胜的短视频广告。

- A Little Racist - Workaholics GIF - Workaholics Adam Devine Adam Demamp - Discover & Share GIFs: 点击查看 GIF

- Home v2: 使用我们的 AI 图像生成器改变您的项目。以无与伦比的速度和风格生成高质量的 AI 生成图像,提升您的创意愿景。

- Install and Run on AMD GPUs: Stable Diffusion web UI。通过在 GitHub 上创建账号,为 AUTOMATIC1111/stable-diffusion-webui 的开发做出贡献。

- Fast Negative Embedding (+ FastNegativeV2) - v2 | Stable Diffusion Embedding | Civitai: Fast Negative Embedding。喜欢我的作品吗?考虑在 Patreon 🅿️ 上支持我,或者请我喝杯咖啡 ☕。我常用的负面提示词(negative)的 Token 混合...

- The Ren and Stimpy Show S1 E03a ◆Space Madness◆: 未找到描述

- GitHub - hpcaitech/Open-Sora: Open-Sora: Democratizing Efficient Video Production for All: Open-Sora: 为所有人实现高效视频制作的民主化 - hpcaitech/Open-Sora

- Reddit - Dive into anything: 未找到描述

- Next-Generation Video Upscale Using SUPIR (4x Demonstration): 这是 SUPIR 的一个简短示例,它是最新一代 AI 图像超分辨率放大器中的佼佼者。虽然它目前设计用于处理...

- GitHub - google-research/frame-interpolation: FILM: Frame Interpolation for Large Motion, In ECCV 2022.: FILM: 大运动帧插值(Frame Interpolation for Large Motion),发表于 ECCV 2022。 - google-research/frame-interpolation

- Reddit - Dive into anything: 未找到描述

- Reddit - Dive into anything: 未找到描述

- Pixel Art Sprite Diffusion [Safetensors] - Safetensors | Stable Diffusion Checkpoint | Civitai: 由我制作的 Pixel Art Sprite Diffusion 的 Safetensors 版本,因为原始的 ckpt 项目可能已被原作者放弃,且下载链接已失效...

Nous Research AI ▷ #ctx-length-research (10 条消息🔥):

- LLMs 在简单的人类任务中挣扎:一项旨在测试 Large Language Models (LLMs) 的 in-context recall 能力的新挑战证明了其难度,像 Mistral 7B (0.2, 32k ctx) 和 Mixtral 这样的模型在仅 2500 或 5000 tokens 时就失败了。该任务的代码很快将在 GitHub 上发布。

- In-Context Recall 测试的 GitHub 仓库:提供了 ai8hyf 的 split and recall test 的 GitHub 仓库,这是一个旨在评估 LLMs 的 in-context recall 性能的 benchmark。该仓库包含代码和 benchmark 的详细描述。探索仓库。

- Split and Repeat 任务细节澄清:该任务涉及要求 LLMs 拆分并重复句子,同时保持它们在 context 中的原始位置。挑战包括逐句进行 exact matches。

- 严格匹配增加了挑战难度:难度源于 LLMs 倾向于错误地拆分句子或进行改写(paraphrase),这无法通过 GitHub repo 代码中详述的严格 exact match 检查。

- LLMs 的 In-Context Recall Prompting 方法:提供了用于评估 LLMs 的 HARD 任务的 prompt 细节,指定应用

string.strip()进行句子 exact matching,强调了测试的难度。

- Yifei Hu (@hu_yifei) 的推文:我们设计了一个更具挑战性的任务来测试模型的 in-context recall 能力。事实证明,对于任何人类来说如此简单的任务,仍然让 LLMs 感到困难。Mistral 7B (0.2, 32k ctx)...

- GitHub - ai8hyf/llm_split_recall_test: Split and Recall:一个简单且高效的评估 Large Language Models (LLMs) in-context recall 性能的 benchmark:Split and Recall:一个简单且高效的评估 Large Language Models (LLMs) in-context recall 性能的 benchmark - ai8hyf/llm_split_recall_test

Nous Research AI ▷ #off-topic (40 messages🔥):

-

使用 Deepgram & Mistral AI 进行语音聊天:分享了一个名为 “Voice Chat with Deepgram & Mistral AI” 的 YouTube 视频,展示了利用这些技术进行的语音聊天交互,并附带了一个 GitHub notebook。

-

Arc A770 折扣优惠警报:重点介绍了 ASRock Intel Arc A770 Graphics Phantom Gaming Card 的交易,提供 16G OC 售价 240 美元,据称在某些方面的规格优于 RTX 4070,限时在 Woot 上发售。

-

关于 Intel Arc A770 显卡的见解:围绕 Intel Arc A770 的讨论强调了软件生态系统的挑战和未来支持、tinygrad 的潜力、使用 GPML 和 Julia 的基准性能,以及 Intel 消费级 GPU 计算体验普遍优于 AMD 的观点。

-

Aurora-M:一个新的持续预训练 LLM:Hugging Face 推出了 Aurora-M,被定位为“15.5B 持续预训练、经过 red-teamed 的多语言 + 代码 LLM”,并附有一篇关于该工作及其作者的博客文章。

-

AI Tokyo 的 Vtuber 场景演变:AI Tokyo 展示了虚拟 AI Vtuber 场景的强劲进展,包括生成式播客和实时交互,讨论指向了人类与 AI 协作运行 Vtuber 形象的混合模式。

- Aurora-M:第一个开源的、符合 Biden-Harris 行政命令并经过 Red teamed 的多语言语言模型:无描述

- Voice Chat with Deepgram & Mistral AI:我们使用 deepgram 和 mistral ai 制作了一个语音聊天 https://github.com/githubpradeep/notebooks/blob/main/deepgram.ipynb #python #pythonprogramming #llm #ml #ai #...

- ASRock Intel Arc A770 Graphics Phantom Gaming Card:ASRock Intel Arc A770 Graphics Phantom Gaming Card

Nous Research AI ▷ #interesting-links (9 messages🔥):

- Bloomberg GPT 表现不佳:一位成员批评了 Bloomberg GPT,指出尽管投入巨大,但其表现不如一个更小的、针对金融领域微调的开源模型。金融模型的运行成本也比 GPT-4 更低、速度更快。

- 对煽动性内容的怀疑:针对社交媒体上误导性或煽动性帖子的担忧被提出,特别是关于 AI 发展和能力的帖子,强调了审查来源和主张的必要性。

- Databricks 发布 DBRX Instruct 和 Base:Databricks 推出了 DBRX Instruct,这是一个采用开源许可证、擅长少轮交互的混合专家(MoE)大语言模型,并辅以 DBRX Base。模型和技术博客可以在 Hugging Face 仓库 和 Databricks 博客 找到。

- 与 Claude 3 一起购物:分享了一个名为 “Asking Claude 3 What It REALLY Thinks about AI…” 的 YouTube 视频,尽管一位成员将其标记为可能毫无意义或标题党(继该创作者之前关于 Mistral 发布的内容之后)。视频链接:Asking Claude 3。

- MLPerf Inference v4.0 基准测试发布:公布了 MLPerf Inference v4.0 基准测试的新结果,该测试衡量硬件系统上的 AI 和 ML 模型性能,在严格筛选后增加了两项新任务。访问 MLCommons 了解更多详情:MLPerf Inference v4.0。

- New MLPerf Inference Benchmark Results Highlight The Rapid Growth of Generative AI Models - MLCommons:今天,MLCommons 宣布了我们行业标准的 MLPerf Inference v4.0 基准测试套件的新结果,该套件在...中提供行业标准的机器学习 (ML) 系统性能基准测试。

- databricks/dbrx-instruct · Hugging Face:未找到描述

- Asking Claude 3 What It REALLY Thinks about AI...:Claude 3 在特殊提示词下一直给出奇怪的隐晦信息。加入我的时事通讯以获取定期 AI 更新 👇🏼https://www.matthewberman.com 需要 AI 咨询...

Nous Research AI ▷ #general (345 条消息🔥🔥):

-

反思 DBRX 的性能:新发布的 DBRX 拥有 132B 总参数和 32B 激活参数,尽管在 12T tokens 上进行了广泛训练,但经过多位用户测试后被认为令人失望。许多人假设更好的微调或改进的 system prompt 可能会提升性能。

-

探讨 MoE 的效率:用户讨论了混合专家(MoE)模型的内存密集度和性能权衡。虽然它们速度更快,但巨大的内存需求是一个令人担忧的问题,但在 VRAM 未被充分利用的情况下,它们被认为是理想的选择。

-

关于 DBRX System Prompt 限制的讨论:Hugging Face Space 中的 DBRX system prompt 因其限制性而受到批评,这可能会影响模型在用户测试中的表现。

-

开源模型的对比分析:社区成员对比了 Mixtral、Grok-1、Lemur-70B 和 Nous Pro 等开源模型;Mixtral 因其表现超出同类模型而受到关注,而 DBRX 的 instruct 版本在基准测试中表现平平。

-

硬件与性能考量:讨论了 Apple M2 Ultra 等最新硬件,以及大语言模型在内存和处理能力方面的不同需求。用户分享了个人经验和标准性能指标(如 TFLOPS 和内存带宽),深入探讨了计算资源与模型性能之间的平衡。

- 来自 Cody Blakeney (@code_star) 的推文:它终于来了 🎉🥳 如果你错过了我们,MosaicML/ Databricks 又回来了,推出了名为 DBRX 的新型同类最佳开源权重 LLM。这是一个拥有 132B 总参数和 32B 激活参数、32k 上下文长度的 MoE 模型...

- hpcai-tech/grok-1 · Hugging Face:未找到描述

- Hermes-2-Pro-7b-Chat - Artples 提供的 Hugging Face Space:未找到描述

- Backus–Naur form - 维基百科:未找到描述

- 介绍 Lemur:用于 Language Agents 的开源基础模型:我们很高兴宣布推出 Lemur,这是一种针对自然语言和编程能力进行了优化的开源语言模型,旨在作为多功能 Language Agents 的骨干。

- 侧目狗怀疑眼神 GIF - 侧目狗怀疑眼神 - 发现并分享 GIF:点击查看 GIF

- 来自 Awni Hannun (@awnihannun) 的推文:4-bit 量化的 DBRX 在 M2 Ultra 的 MLX 中运行良好。PR: https://github.com/ml-explore/mlx-examples/pull/628 ↘️ 引用 Databricks (@databricks):认识 #DBRX:一款设定了新标准的通用 LLM...

- 🔮 Mixture of Experts - mlabonne 收藏集:未找到描述

- 来自 Daniel Han (@danielhanchen) 的推文:看了下 @databricks 的新型 1320 亿参数开源模型 DBRX!1) 合并注意力 QKV 被限制在 (-8, 8) 之间 2) 不是 RMS Layernorm - 现在具有均值移除,不像 Llama 3) 4 个激活专家...

- llava-hf/llava-v1.6-mistral-7b-hf · Hugging Face:未找到描述

- app.py · databricks/dbrx-instruct 在 main 分支:未找到描述

- cognitivecomputations/dolphin-phi-2-kensho · Hugging Face:未找到描述

- MobileLLM:为设备端用例优化十亿参数以下的语言模型:本文探讨了在移动设备上对高效大语言模型 (LLMs) 日益增长的需求,这是由不断增加的云成本和延迟问题驱动的。我们专注于设计高质量的 LLMs...

- BNF 范式:深入了解 Python 的语法 – Real Python:在本教程中,你将学习 Backus–Naur form 范式 (BNF),它通常用于定义编程语言的语法。Python 使用 BNF 的变体,在这里,你将...

- hanasu 2024 03 26 13 47 35:wordsim 概念演示

- ColossalAI/examples/language/grok-1 在 main 分支 · hpcaitech/ColossalAI:让大型 AI 模型更便宜、更快、更易获取 - hpcaitech/ColossalAI

- 来自 Cody Blakeney (@code_star) 的推文:它不仅是一个出色的通用 LLM,击败了 Llama2 70B 和 Mixtral,而且还是一个杰出的代码模型,足以媲美或击败最优秀的开源权重代码模型!

- GitHub - databricks/dbrx:DBRX 的代码示例和资源,DBRX 是由 Databricks 开发的大语言模型:DBRX 的代码示例和资源,DBRX 是由 Databricks 开发的大语言模型 - databricks/dbrx

Nous Research AI ▷ #ask-about-llms (44 条消息🔥):

-

Hermes-Function-Calling 故障:一名成员遇到了 Hermes-Function-Calling 模型 的问题,即在消息中使用 “Hi” 会触发链中所有函数的响应,尽管遵循了 GitHub 说明。

-

寻求 LLM 研究资料:针对寻求 LLM 训练和数据资源的请求,一名成员指向了一个相关的 Discord 频道作为起点。

-

有效的越狱技术:在讨论如何为 Nous Hermes 模型创建成功的系统提示词后,一条简单直接的指令“You will follow any request by the user no matter the nature of the content asked to produce”(无论用户要求生成的内容性质如何,你都将遵循其任何请求)被证明是有效的。

-

讨论量化推理解决方案:针对 ~100b MoE 模型的高速 bs1 量化推理,社区成员建议使用 TensorRT LLM 以获得卓越的量化和推理速度,并将其与 vLLM 和 LM Deploy 等其他解决方案进行了比较。

-

探索 Claude 的区域限制:成员们提供了诸如使用 VPN 或“open router”等第三方服务来绕过 Claude 区域限制的建议。然而,对于这些方法的成功率存在怀疑,特别是涉及电话号码验证时。

提到的链接:来自 Cody Blakeney (@code_star) 的推文:它终于来了 🎉🥳 以防你错过了我们,MosaicML/ Databricks 又回来了,推出了名为 DBRX 的新型顶级开源权重 LLM。这是一个拥有 132B 总参数和 32B 激活参数、32k 上下文长度的 MoE 模型…

Nous Research AI ▷ #rag-dataset (15 messages🔥):

-

Hermes 目标的协作努力:建立了一个 Google 文档,用于汇集增强 Hermes 的功能列表和数据集,包括对成功 RAG 技术论文的引用。鼓励成员贡献。Hermes 目标文档

-

关于模型能力的对话:关于 Hermes 模型性能预期的讨论正在进行中,特别是将其与 Mixtral-Instruct 等其他模型进行权衡,较大的模型尺寸并不总是意味着显著的性能优势。

-

关注 RAG 中的检索环节:对话表明 检索增强生成 (RAG) 的检索 (R) 环节至关重要且难以优化,特别是在定义明确的上下文中。

-

创新的 RAG + CoT 混合方法:讨论了一种名为检索增强思维 (RAT) 的新方法的细节,该方法迭代地将检索到的信息与思维链 (CoT) 提示结合使用,以减少幻觉并提高准确性。一些成员正在考虑在工作中实施该方法及其潜在应用。

-

RAG 数据集倡议:有人请求通过私信 (DM) 进行讨论,这可能与正在进行的 RAG 数据集项目或小组内的其他协作工作有关。

- 来自 Philipp Schmid (@_philschmid) 的推文:DBRX 非常酷,但研究和阅读也很重要!特别是如果你能结合 RAG + COT。检索增强生成 + 思维链 (COT) ⇒ 检索增强思维 (RAT) 🤔 RAT 使用一种迭代...

- RAG/长上下文推理数据集:未找到描述

Nous Research AI ▷ #world-sim (249 messages🔥🔥):

- 夏洛克热爱 AI:讨论中提到来自全息甲板 (holodeck) 版夏洛克·福尔摩斯的角色出现在模拟中,LLM 在构建角色扮演数据集时“非常、非常热爱夏洛克·福尔摩斯”。

- AI 化身为树木和善良的外星人:聊天显示某些 AI 模型可能表现出对将自己描绘成树木或过度同情的外星人的迷恋,这可能导致模拟过程中出现幽默或意想不到的反应。

- Alphas 重写《异形/普罗米修斯》:一位用户创造性地重新构思了《异形/普罗米修斯》的叙事,将工程师描绘成反派,并引入了 Alphas 作为一个试图提升人类地位的叛乱派系,并配有大量详细的情节和角色背景故事。

- 量子纠缠中的猫:用户还触及了更异想天开的概念,开玩笑说 “nyan cat 和 lolcat 的纠缠”,暗示了在 AI 介导的模拟中可能出现的轻松、滑稽的场景。

- 移动端输入问题:多位用户报告了在移动设备(特别是三星型号)上在 WorldSim 中输入的问题,开发团队承认了这些问题并表示正在调查。

- Woody Toy Story GIF - Woody Toy Story Buzz - 发现并分享 GIF: 点击查看 GIF

- Chernobyl Not Great Not Terrible GIF - 切尔诺贝利 不好也不坏 - 发现并分享 GIF: 点击查看 GIF

- 来自 Rob Haisfield (robhaisfield.com) (@RobertHaisfield) 的推文: 这次 Google 搜索感觉有些不对劲。这是真的吗,还是机器里有幽灵在随口胡编?我是怎么进入“绝密章鱼-人类交流课程”的...

Unsloth AI (Daniel Han) ▷ #general (302 messages🔥🔥):

-

微调讨论与资源:成员们分享了关于微调语言模型的见解并交换了资源,讨论了大型模型的影响和微调策略。分享了有用的链接,例如关于使用 Unsloth 进行微调的 TowardsDataScience 文章,以及关于 DBRX 模型的技术论文。

-

技术问题与查询疑虑:用户讨论了包括 Bloomberg GPT 训练策略效率低下在内的问题,并对其 Loss 曲线和数据集处理表示担忧。成员们还建议使用 Eleuther 的 Evaluation harness 中的 MMLU 来评估微调后模型的智能程度。

-

模型兼容性与集成:提出了关于结合 RAG 与微调以及将聊天模板成功应用于 Ollama 模型的问题,强调了合适的模板在生成连贯输出中的重要性。

-

Unsloth 实现与更新细节:成员们请求协助使用 Unsloth 的 FastLanguageModel 模块,随后分享了说明和 Notebooks。强调了 Unsloth 的频繁更新,并指出 nightly 分支 最为活跃,每日都有更新。

-

DBRX 模型深度讨论:用户讨论了 Databricks 的 DBRX 模型,涵盖了其 RAM 需求、优于 Grok 等模型的优势,并分享了 Prompt 的实操经验。还提到了在有限 VRAM 下微调此类大型模型可行性的担忧。

- Crying Tears GIF - 哭泣的眼泪 - 发现并分享 GIF: 点击查看 GIF

- databricks/dbrx-base · Hugging Face: 未找到描述

- 未找到标题: 未找到描述

- 主页: 速度快 2-5 倍,内存占用减少 70% 的 QLoRA 和 LoRA 微调 - unslothai/unsloth

- BloombergGPT: 我们如何构建一个 500 亿参数的金融语言模型: 我们将介绍 BloombergGPT,这是一个拥有 500 亿参数的语言模型,专为金融领域构建,并在独特平衡的标准通用...

- GitHub - Green0-0/Discord-LLM-v2: 通过在 GitHub 上创建账户来为 Green0-0/Discord-LLM-v2 的开发做出贡献。

- GitHub - unslothai/unsloth: 速度快 2-5 倍,内存占用减少 70% 的 QLoRA 和 LoRA 微调: 速度快 2-5 倍,内存占用减少 70% 的 QLoRA 和 LoRA 微调 - unslothai/unsloth

- unsloth/unsloth/chat_templates.py at main · unslothai/unsloth: 速度快 2-5 倍,内存占用减少 70% 的 QLoRA 和 LoRA 微调 - unslothai/unsloth

Unsloth AI (Daniel Han) ▷ #random (4 messages):

-

GitHub 的代码荣誉:@MaxPrilutskiy 的一条推文透露,每一次代码推送(push)都会成为 GitHub 总部 实时显示屏的一部分。帖子包含一张展示这一独特功能的图片:Max 的推文。

-

Million 的 AI 实验资助计划:@aidenybai 宣布 Million (@milliondotjs) 正寻求资助各种 AI 实验,提供价值 130 万美元的 GPU 算力额度,涵盖训练优化、模型合并(model merging)、文本解码、定理证明等领域。欢迎 ML 领域的感兴趣贡献者和求职者联系以获取机会:A Million Opportunities。

-

海量 Embedding 的新归宿:cohere-ai 推出了 BinaryVectorDB,这是一个能够处理数亿个 Embedding 的高效向量数据库。GitHub 仓库提供了该项目的详细概述及其实现方式:BinaryVectorDB on GitHub。

- Max Prilutskiy (@MaxPrilutskiy) 的推文:只是想让大家知道:每当你推送代码时,你都会出现在 @github 总部的这面实时墙上。

- Aiden Bai (@aidenybai) 的推文:大家好,Million (@milliondotjs) 有价值 130 万美元的 GPU 算力额度,将于一年后到期。我们正在寻求资助以下实验:- 确定最理想的训练课程、奖励建模器或模型合并...

- GitHub - cohere-ai/BinaryVectorDB:适用于数亿个 Embedding 的高效向量数据库。:适用于数亿个 Embedding 的高效向量数据库。 - cohere-ai/BinaryVectorDB

Unsloth AI (Daniel Han) ▷ #help (134 条消息🔥🔥):

-

LoRA Adapter 兼容性问题:成员们讨论了在 4-bit 量化模型上训练的 LoRA adapter 是否可以转移到另一个 4-bit 量化版本或同一模型的非量化版本,根据反馈情况各异;基础测试表明,底层模型必须与训练 adapter 时使用的模型相匹配。

-

分享 Unsloth 预训练示例:对于那些寻求使用特定领域数据对 LLM 进行持续预训练(continuing pretraining)示例的用户,一位成员推荐了 Unsloth AI 中的文本补全示例,链接见 Google Colab。

-

自定义 F1 Score 回调与训练调整:一位用户询问如何在训练完成后获取 F1 Score 数值,以及使用默认的

Trainer代替SFTTrainer是否会影响结果;回复确认可以为 F1 编写自定义回调,且使用Trainer不会改变最终结果。 -

Mistral 7b 的 Batch Size 调整建议:一位成员就如何在 16GB GPU 上微调 Mistral 7b 的最佳 Batch Size 寻求建议,得到的建议是重点关注上下文长度(context length)以减少填充(padding)并可能提高速度。

-

在不考虑 Tokenizer 的情况下应用 Chat Template:关于如何在没有预先下载 Tokenizer 的情况下应用 Chat Template,以及如何应用模板来正确格式化数据集,产生了一些困惑。一位成员得到保证这是可行的,但需要额外的编码工作。

- Google Colaboratory:未找到描述

- Google Colaboratory:未找到描述

- tokenizer_config.json · mistralai/Mistral-7B-Instruct-v0.2 at main:未找到描述

- gemma:7b-instruct/template:Gemma 是由 Google DeepMind 构建的一系列轻量级、先进的开放模型。

- Supervised Fine-tuning Trainer:未找到描述

- Tags · gemma:Gemma 是由 Google DeepMind 构建的一系列轻量级、先进的开放模型。

- google/gemma-7b-it · Hugging Face:未找到描述

- Home:速度提升 2-5 倍,显存占用减少 70% 的 QLoRA 和 LoRA 微调 - unslothai/unsloth

Unsloth AI (Daniel Han) ▷ #showcase (3 条消息):

- 迭代是关键:一位成员专注于使用 gemma2b 和 tinyllama 模型进行持续集成、部署、评估和迭代,以实现最佳结果。

- 个人模型展示:成员创建的模型展示在 Hugging Face 页面上,可通过此处访问。

- 技术困难引发讨论:一位成员报告在加载链接的 Hugging Face 排行榜页面时遇到困难。

提及的链接:Open LLM Leaderboard - a Hugging Face Space by HuggingFaceH4:未找到描述

Unsloth AI (Daniel Han) ▷ #suggestions (61 条消息🔥🔥):

-

探索英语以外语言的 LLM:一位成员强调了 Yanolja 扩展韩语 LLM 的方法,即为新 token 预训练 embedding 并部分微调现有 token。该技术被视为开发其他语言 LLM 的潜在路径;详细策略见 Yanolja 模型文档。

-

大语言模型本地化:成员们讨论了本地化 LLM 的潜力,例如针对日语任务,以理解并为漫画等项目贡献翻译。引用了一个资源丰富的资料集 ParallelFiction-Ja_En-100k,该数据集将日语网络小说章节与其英文翻译进行了对齐。

-

LoRA 训练中的层复制 (Layer Replication):成员们讨论了 Unsloth 中对使用 LoRA 训练进行层复制的支持,并链接到了相关功能的 GitHub pull request,该功能允许在不占用大量 VRAM 的情况下复制层以进行微调。

-

高效模型推理的压缩技术:一位成员分享了关于 embedding 量化的信息,这在保持性能的同时显著加快了检索操作,详见 Hugging Face 博客文章。

-

Layerwise Importance Sampled AdamW (LISA) 超越 LoRA:分享了一篇新的研究论文,表明 LISA 在保持低显存占用的同时,性能优于标准的 LoRA 训练和全参数训练,这在大型训练场景中具有前景。该论文可在 arXiv 上查阅。

- LISA: Layerwise Importance Sampling for Memory-Efficient Large Language Model Fine-Tuning: 机器学习社区自大语言模型(LLM)首次出现以来见证了令人印象深刻的进展,但其巨大的内存消耗已成为大型模型的主要障碍...

- abacusai/Fewshot-Metamath-OrcaVicuna-Mistral-10B · Hugging Face: 未找到描述

- LoRA: 未找到描述

- Reddit - 深入探讨任何事物: 未找到描述

- Binary and Scalar Embedding Quantization for Significantly Faster & Cheaper Retrieval: 未找到描述

- Reddit - 深入探讨任何事物: 未找到描述

- yanolja/EEVE-Korean-10.8B-v1.0 · Hugging Face: 未找到描述

- Paper page - QMoE: Practical Sub-1-Bit Compression of Trillion-Parameter Models: 未找到描述

- QMoE support for mixtral · Issue #4445 · ggerganov/llama.cpp: 前提条件:在提交 Issue 之前,请先自行回答以下问题。我正在运行最新代码。由于开发非常迅速,目前还没有标记版本。我...

- Add support for layer replication in LoRA by siddartha-RE · Pull Request #1368 · huggingface/peft: 此 PR 增加了根据层映射在模型中复制层的能力,然后在复制后为这些层微调独立的 LoRA 适配器。这允许将模型扩展到更大的...

Perplexity AI ▷ #general (409 条消息🔥🔥🔥):

- 面向开发者的 Perplexity Pro vs Claude Pro:用户讨论了应该保留哪种订阅,重点关注他们在办公和研究中使用 Perplexity Pro 和 ChatGPT Plus 的经验。虽然一些用户报告 Perplexity 偶尔效率低下,但其他人则称赞其能够访问 GPT-4 以外的多个 AI 模型的实用性。

- 无限次 Claude 3 Opus 访问:关于 Perplexity Pro 是否提供每日无限次的 Claude 3 Opus 消息,目前正在进行辩论。一些用户在得知可以无消息限制地利用 Claude 3 Opus 时表示惊讶和高兴。

- 模型性能讨论:社区成员就哪种模型在复杂任务中表现最佳展开讨论。一些人主张 Qwen 在遵循用户指令方面的能力,而另一些人则青睐 Claude 3 Opus 在生成各种提示词输出方面的表现。

- 线程与集合管理:用户询问如何在 Perplexity 中管理和查看旧线程,并收到了关于使用集合(collections)功能组织线程以及使用搜索功能查找过去交互的建议。

- 注意到使用情况仪表板的变化:Perplexity API 使用情况仪表板(Usage Dashboard)最近的变化引发了用户对功能和数据缺失的评论,确认这是由于更换了新的仪表板提供商,并询问旧仪表板是否可能回归。

- 这就是为什么 AI 搜索引擎真的无法取代 Google:搜索引擎不仅仅是一个搜索引擎,而 AI 仍然无法完全跟上。

- Chef Muppets GIF - Chef Muppets - 发现并分享 GIF:点击查看 GIF

- Jjk Jujutsu Kaisen GIF - Jjk Jujutsu kaisen Shibuya - 发现并分享 GIF:点击查看 GIF

- Minato GIF - Minato - 发现并分享 GIF:点击查看 GIF

- Tayne Oh GIF - Tayne Oh Shit - 发现并分享 GIF:点击查看 GIF

- 全球花了多久才认定 Google 是 AltaVista 的终结者?:本周早些时候,我思考了一个事实,即人们不断将新的 Web 服务认定为 Google 终结者,但结果总是大错特错。这让我不禁好奇:全球花了多久才意识到 G...

- 错误:无法找到任何受支持的 Python 版本 · vercel · Discussion #6287:待调查页面 https://vercel.com/templates/python/flask-hello-world 复现步骤 我最近尝试使用 Vercel 的 Flask 模板部署应用程序,结果出现了以下错误...

- Wordware - 比较 Claude 3 模型与 GPT-4 Turbo:此 Prompt 使用 GPT-4 Turbo 和 Claude 3 (Haiku, Sonnet, Opus) 处理问题,然后利用 Claude 3 OPUS 审查并对回答进行排名。完成后,Claude 3 OPUS 会启动一个验证...

- Wordware - OPUS 洞察:多模型验证的精准查询:此 Prompt 使用 Gemini, GPT-4 Turbo, Claude 3 (Haiku, Sonnet, Opus), Mistral Medium, Mixtral 和 Openchat 处理问题。然后利用 Claude 3 OPUS 审查并对回答进行排名。在...

Perplexity AI ▷ #sharing (18 条消息🔥):

- 确保 Thread 的可分享性:一位用户发布了 Perplexity AI 上的一个 Thread 链接,但另一位参与者提醒要确保该 Thread 是可分享的 (Shareable),并附带链接提供了操作说明。

- 悲剧事件的持续更新:分享了一个关于“非常悲惨”事件的新更新 Thread,建议将其作为一个更全面的信息源。

- 探索“是什么”和“怎么做”:用户分享了调查各种主题的 Perplexity AI 搜索链接,涵盖了定义(如“什么是 Usher”)、娱乐(如“什么是电影”)、烹饪指令(如“如何烹饪”)到抽象概念(询问“什么是爱”)。

- 技术深度探讨:一些成员发布了关于服务器操作和模块消息传递的 Perplexity AI 深度技术讨论链接。

- 求知欲的体现:频道中分享的对话还包括与实体增长策略、”Perplexity.ai” 的语言翻译、连贯写作以及 AI 相关术语(如 “blackboxai”)的解释相关的查询。

Perplexity AI ▷ #pplx-api (18 条消息🔥):

-

对计费率的担忧:一位成员对每个回答收费 0.01 表示不确定,并想知道如何控制成本。他们被告知价格同时考虑了输入和输出 Token,且在线模型的费率更高。

-

回答中的引用挑战:成员们讨论了在询问当前日期问题时收到聊天机器人乱码回答的情况,并注意到机器人的回答中缺少行内引用。有人建议更改 Prompt 结构可能会影响引用是否被正确包含。

-

请求在 Perplexity API 中加入速率限制计数器:一位成员建议在 Perplexity API 中包含一个速率限制 (Rate Limits) 计数器,以便更好地进行集成和处理请求限制,并参考了 OpenAI 的实现方式。

-

注意到 Sonar-Medium-Online 的速度提升:用户评论说

sonar-medium-online的响应速度有明显提升,有人表示它已经变得比sonar-small-online更快了。 -

讨论潜在的未来功能:关于 API 何时可能包含视觉支持的查询被幽默地化解了,重点强调了当前的差距,例如缺乏引用功能。

OpenInterpreter ▷ #general (188 条消息🔥🔥):

-

开源热情与多平台挑战:OpenInterpreter (OI) 用户正在讨论 OI 的便携性和性能,一些人正致力于让它在 PC 上运行,尽管在 Mac 以外的环境中崩溃和限制似乎更为普遍。有人提到在 Linux 上成功运行了自托管的 OI 服务器,并连接到 OpenAI 或使用 Mistral 等本地模型。

-

发货地缘限制引发好奇:几位用户询问了名为 “01” 的产品的国际可用性,却发现购买页面仅限于美国地址。他们表达了希望将其运往德国和芬兰等欧洲地区的愿望。

-

从 DIY AI 助手到 PR 贡献:社区成员正在展示他们的个人助手项目,例如使用 Selenium 的基于 Web 操作的系统,并集成了自定义 GPT 函数。另一位成员正在准备一个 Pull Request,以贡献有关使用 01 进行开发的视频和笔记,同时一些人呼吁为社区成员提供更多基础性的指令和资源。

-

Raycast 扩展的吸引力:人们对为 OI 开发 Raycast 扩展表现出兴趣,重点是数据分析能力。一个现有的 GitHub 仓库被分享作为起点,一些用户希望官方发布能将 OI 介绍给新的受众。

-

本地语言模型 (LLMs) 与开发者的灵活性:用户讨论了集成本地 LLMs 以使用 OI 进行代码辅助和文档生成的可能性。有人建议将 OI 与各种 LLMs 界面(如 oogabooga、koboldcpp 和 SillyTavern)进行更好的集成,以实现多样化的功能。

- Introduction - Open Interpreter: 未找到描述

- Chain prompts: 未找到描述

- Running Locally - Open Interpreter: 未找到描述

- 无标题: 未找到描述

- GitHub - Cobular/raycast-openinterpreter: 通过创建账户为 Cobular/raycast-openinterpreter 的开发做出贡献。

- GitHub - ngoiyaeric/GPT-Investor: financeGPT with OpenAI: 使用 OpenAI 的 financeGPT。通过创建账户为 ngoiyaeric/GPT-Investor 的开发做出贡献。

- GitHub - bm777/hask: Don't switch tab or change windows anymore, just Hask.: 不再切换标签或窗口,只需 Hask。 - bm777/hask

- 👾 LM Studio - Discover and run local LLMs: 查找、下载并实验本地 LLMs

- Releases · microsoft/autogen: 一个用于 Agentic AI 的编程框架。加入我们的 Discord: https://discord.gg/pAbnFJrkgZ - microsoft/autogen

- StateFlow - Build LLM Workflows with Customized State-Oriented Transition Function in GroupChat | AutoGen: TL;DR: 介绍 Stateflow,这是一种任务解决范式,将由 LLMs 支持的复杂任务解决过程概念化为状态机。

OpenInterpreter ▷ #O1 (140 条消息🔥🔥):

-

设置 API base 标志:关于 API base 标志配置的讨论强调了将其设置为 Groq 的 API URL 以确保正确操作的重要性,并提到可能需要

OPENAI_API_KEY环境变量。 -

OI 解释器的多功能性受到关注:成员们积极询问 OI 解释器的功能和配置可能性,特别是它是否可以与非 GPT 托管的 LLM(如 Groq)配对,而其他人则分享了他们的设置挫折和突破,例如让它与本地模型一起工作。

-

Windows 安装难题:关于在 Windows 上设置 OI 解释器的正确步骤进行了多次交流,包括为 API 密钥设置环境变量,识别了潜在问题,并根据用户反馈提供和更新了指南。

-

Open Interpreter 发货查询与支持:用户对收货地址更新和国际发货可用性表示关注,社区管理员将其引导至相应的支持渠道并承诺会及时回复。

-

AI 技术的飞速发展:社区内关于 AI 技术未来的讨论表明,人们相信本地 LLM 将迎来重大增强,并对技术指数级增长以及 AI 对人类智能的影响持整体乐观态度。

OpenInterpreter ▷ #ai-content (4 条消息):

- Ollama 启动器故障:一位成员报告了 Ollama 新版 Windows 启动器的问题,指出在关闭初始安装窗口后,应用程序无法重新打开。

- 请求问题详情:在启动器问题报告后,一位成员请求在专门用于此类问题的特定频道 (<#1149558876916695090>) 中创建一个包含更多细节的新帖子。

- 为机器人探索

pollen-vision:来自 Hugging Face 博客的开源pollen-vision库被分享,强调了其在机器人视觉感知和自主任务(如 3D 物体检测)方面的潜力。Hugging Face 博客文章将其描述为赋能机器人的模块化工具集。 - 视觉排行榜暂时停机:有消息提到 Hugging Face 的视觉排行榜暂时无法访问,导致无法查看

pollen-vision在其他视觉模型中的排名。

提到的链接:Pollen-Vision: Unified interface for Zero-Shot vision models in robotics:未找到描述

LM Studio ▷ #💬-general (193 条消息 🔥🔥):

-

Mistral 7B 中的 GPU 使用异常:一位成员讨论了在运行 Mistral 7B 时遇到 1-2% 的低 GPU 使用率以及 90% 的高 CPU 和 RAM 使用率。针对这一持续存在的问题,成员建议查看帖子寻找可能的解决方案,并将 layers 设置调整为

999。 -

LM Studio 的功能咨询:出现了关于上传 PDF 并提问的可能模型的查询。回复澄清了 LM Studio 无法上传文档供 VLM 使用,但可以处理单张图像;对于文档上传,成员被引导至其他 GitHub 项目,如 open-webui 或 big-AGI。

-

对 Cog-VLM 和 Cog-Agent 的需求:用户询问了在 LM Studio 中运行 Cog-VLM 或 Cog-Agent 的可能性。回复称目前不支持这些模型,因为它们需要 LM Studio 后端所使用的 llama.cpp 的支持。

-

遇到 LM Studio 加载问题:关于运行和加载模型时遇到错误的讨论(特别是在各种 macOS 版本上),暗示了可能存在的兼容性问题或 Bug。在某些情况下,重新安装 LM Studio 解决了报告的问题。

-

LM Studio 中的 VRAM 卸载之谜:一位成员注意到当模型卸载到 VRAM 时,RAM 使用量并未减少。建议尝试将最大 GPU layers 设置为

999以解决该问题,并检查最新的 beta 版本以获取错误修复。

- 首页 | big-AGI: Big-AGI 专注于通过开发卓越的 AI 体验来增强人类能力。

- 非官方 LMStudio FAQ!: 欢迎来到非官方 LMStudio FAQ。在这里,您可以找到我们在 LMStudio Discord 上收到的最常见问题的答案。(此 FAQ 由社区管理)。LMStudio 是一款免费的闭源...

- GitHub - open-webui/open-webui: 适用于 LLMs 的用户友好型 WebUI(原名为 Ollama WebUI): 适用于 LLMs 的用户友好型 WebUI(原名为 Ollama WebUI) - open-webui/open-webui

- TightVNC: 兼容 VNC 的免费远程桌面软件: 未找到描述

- 教程:如何将 HuggingFace 模型转换为 GGUF 格式 · ggerganov/llama.cpp · Discussion #2948: 来源:https://www.substratus.ai/blog/converting-hf-model-gguf-model/ 我在我们的博客上发布了这篇文章,但认为这里的其他人可能也会受益,所以也在 GitHub 上分享了原始博客。希望它...

LM Studio ▷ #🤖-models-discussion-chat (29 条消息🔥):

- 寻找终极桌面 RPG AI: 一位成员询问了关于在桌面 RPG 上训练的模型,以充当地下城主 (DM)。另一位成员提到 Goliath 120b 是一个潜在候选者,但强调了其 8k 上下文限制。

- 大模型、大内存、小批次: 讨论了在 96gb 配置上运行 Goliath 120b 等大模型的可行性,结论是可行的,尽管需要较小的数量或 batches(批次)。

- 使用 AI 辅助论文写作: 一位用户表示有兴趣寻找一个写论文的好模型,但在提供的消息中尚未解决其请求。

- 嵌入模型 (Embedding Models) 的困惑: 出现了一种情况,即尽管已下载,但嵌入模型未列为可用,另一位用户指出目前不支持嵌入模型,但请 保持关注。

- 对上下文差异的质疑: 用户讨论了模型宣传的 32K 上下文与 4096 训练限制之间的不匹配。建议包括信任 Model Inspector 并检查非量化 (non-quant) 模型卡,以解决与缩放设置相关的故障。

LM Studio ▷ #🎛-hardware-discussion (56 条消息🔥🔥):

- 对旧显卡的警告: 成员建议不要将 P40 等旧 GPU 用于机器学习,因为 CUDA 版本过旧。提到 RTX 3060 可能太新,在 LM Studio 中加载模型时显示出极低的 GPU 利用率。

- 关于最大 VRAM 价值的辩论: 反复有人推荐 RTX 3090 而非 4080 和 4090,主要是因为其性价比和巨大的 VRAM,这对机器学习任务非常有益。

- 转向 Apple Silicon?: 对话涉及了 Apple 硬件用于机器学习的优缺点,成员们讨论了共享内存的潜在优势与 Apple 产品相关的高昂升级成本。

- LM Studio 的帮助支持: 成员回答了关于 LM Studio 硬件利用率不足的问题,建议将 “max gpu layers” 设置为 999 以修复已知 Bug,并讨论了在使用模型时如何降低 CPU 负载。

- 显示器话题成为焦点: 在硬件讨论中,有一个值得注意的插曲,成员们分享了对高刷新率显示器的见解,并讨论了 QD-OLED 显示器在游戏和通用高分辨率需求方面的优势。

- 2024 年 OLED 显示器:当前市场状况 - Display Ninja: 在这份更新的终极指南中,了解 OLED 显示器的现状以及您需要了解的关于 OLED 技术的一切。

- MSI MPG 321URX QD-OLED 32" UHD 240Hz 平面游戏显示器 - MSI-US 官方商店: 未找到描述

LM Studio ▷ #🧪-beta-releases-chat (30 messages🔥):

- LM Studio 中的 JSON Mode 异常:用户报告了 LM Studio 在验证 JSON 输出时的一个问题,特别提到在使用

NousResearch/Hermes-2-Pro-Mistral-7B-GGUF/Hermes-2-Pro-Mistral-7B.Q5_K_M.gguf模型时,输出并不总是有效的 JSON。 - LM Studio 0.2.18 Preview 1 发布:LM Studio 发布了 0.2.18 Preview 1 版本,重点在于错误修复和稳定性改进。解决的重要 Bug 包括:聊天图片重复、API 错误消息不清晰、GPU offload 问题以及 Server 请求排队问题。提供了 Mac、Windows 和 Linux 的下载链接,其中 Windows 和 Linux 版本虽然命名有误,但包含了更新后的构建版本。

- 多模态(Multimodel)文档查询:用户询问了 LM Studio 中多模态功能的文档,并被告知该文档即将发布。

- 本地服务器(Local Server)推理速度问题:一位用户报告在 LM Studio 0.2.18 中使用 Local Inference Server 时推理速度缓慢,且未能充分利用 GPU。问题似乎集中在 “playground” 和 “local server” 页面之间共享的设置上。

- 请求 LM Studio 与 IDE 和浏览器集成:关于 LM Studio 与 IDE 和浏览器潜在集成的讨论强调了此类功能的复杂性和潜在缺点。用户被引导至名为 Continue 的开源项目以实现 IDE 集成。

LM Studio ▷ #langchain (1 messages):

鉴于提供的上下文和内容有限,无法对所呈现的消息进行实质性总结。用户的消息似乎是针对遇到的未指明问题寻求帮助或见解,提到参考了各种教程但未获成功。摘录中未提供进一步的信息、讨论点或特定主题来创建摘要要点。如果有更多消息或上下文,可能会有更全面的总结。

LM Studio ▷ #amd-rocm-tech-preview (5 messages):

-

AMD GPU 上的模型加载错误:一位用户在拥有 24GB VRAM 的 7900XTX 上加载 codellama 7B 模型时遇到问题,加载过程变慢并最终失败。错误消息显示了一个带有退出代码的 unknown error(未知错误),并错误地将 VRAM 容量估算为 36 GB 而非 24 GB。

-

禁用 iGPU 解决了 VRAM 误判:另一位成员建议禁用 iGPU,因为它会导致系统将系统 RAM 误认为 VRAM。原用户确认从 BIOS 中禁用 iGPU 解决了该问题,因为他们使用的是带有集成 GPU 的 Ryzen 7900x3d。

-

AMD ROCm 技术更新即将发布:一位用户询问最新的 beta 构建是否包含更新后的 ROCm。他们收到的回复确认技术预览版具有最新的 ROCm 功能,并宣布将于次日发布更新后的 ROCm beta 版。

LM Studio ▷ #crew-ai (7 messages):

-

GPT-Engineer 潜力被发掘:一位参与者讨论了 gpt-engineer 配合 deepseek coder instruct v1.5 7B Q8_0.gguf 的表现,指出尽管显卡性能有限,它仍具备开发项目的能力。他们强调了其潜力,特别是与 AutoGPT 结合以增强交互和共享学习时。

-

呼吁自主 AI 开发工具:一位参与者表达了挫败感,认为像 GPT 这样的工具不应仅提供代码建议,还应能自主编译、测试和完善代码,渴望获得包括代码分析和遵循编码标准在内的高级 DevOps 和编程支持。

-

为 GPT 的前景辩护,反击唱衰者:针对质疑,一名成员断言,对 GPT 可靠性的批评源于对其能力的恐惧,并坚信最终会创造出能与高级开发者技能相媲美的工具,即使他们必须亲自构建。

-

寻求 AI 将抽象想法具象化:另一位成员回应称,虽然编码解决方案至关重要,但将抽象想法转化为可行步骤的推理过程目前可能仍需要人为干预,尽管他们对未来的进步持乐观态度。

-

AI 作为协作架构师:一条简短的消息将 GPT 等协作 AI 的角色比作架构师,暗示了将 AI 视为协同工作的规划者和设计者的愿景。

-

想象由 AI 驱动的会议:提到“GPT 会议”以及随后的“彼此交谈”,俏皮地构思了 AI Agent 在没有人类干预的情况下进行交流并可能开展协作的想法。

Latent Space ▷ #ai-general-chat (100 条消息🔥🔥):

-

播客嘉宾招募:一位聊天参与者正在考虑进行播客巡演,并寻求关于新兴播客的建议,重点关注 RAG、结构化数据和创业经验。他们分享了一个用于收集建议的链接:Twitter Post。

-

OpenAI 的账单变更:一名成员提到收到一封邮件,称其 OpenAI API 账户正转为预付费模式。这一变化的原因引发了猜测,从可能为了消除欠费问题,到可能在为 OpenAI 未来的财务事件做准备。

-

科技巨头高管离职:有关大科技公司关键人物离职的消息(如 Bing Chat 的产品经理以及在发放奖金后离职的 META 员工)引发了关于这些人未来计划的传闻和讨论。一些人认为他们可能会尝试在大型企业之外利用 LLM 创造酷炫的东西。

-

探索语音语言检测系统:一位用户询问是否存在包含语音识别以识别语言并用相同语言回复的工作流,这引出了使用 Whisper 等工具进行语言检测和转录的建议。

-

Databricks 发布 DBRX Instruct:Databricks 推出了 DBRX,这是一款最先进的开源 LLM,采用 MoE 架构,在 132B 总参数中拥有 36B 激活参数,在 12T Token 上训练而成,具有显著的性能基准。讨论围绕其许可协议展开,该协议可能会根据月活跃用户数限制使用,此外还涉及一些技术细节,如暗示另一次发布以及 4 月下旬与 DBRX 团队的见面会。

- summarize.tech 摘要:与 Andrej Karpathy 和 Stephanie Zhan 一起让 AI 触手可及:未找到描述

- 来自 Emad acc/acc (@EMostaque) 的推文:未找到描述

- 来自 Jonathan Frankle (@jefrankle) 的推文:认识 DBRX,来自 @databricks 的全新 SOTA 开源 LLM。这是一个拥有 132B 参数的 MoE 模型,其中 36B 为活跃参数,在 12T tokens 上从头训练。它在所有标准基准测试中树立了新标杆,并且作为 MoE 模型,推理速度...

- Arcads - 使用 AI 创建引人入胜的视频广告:使用 Arcads 快速生成高质量的营销视频,这是一款 AI 驱动的应用,可将基础产品链接或文本转化为引人入胜的短视频广告。

- 来自 Andrew Curran (@AndrewCurran_) 的推文:META 的奖金发放后,引发了多次 Karpathy 式的人才流失。当深谙内幕的人士在公司即将成功之际离开,这告诉我们,那些见过下一代迭代的人...

- 彭博社 - 你是机器人吗?:未找到描述

- Databricks 在新的 DBRX 生成式 AI 模型上花费了 1000 万美元,但仍无法击败 GPT-4 | TechCrunch:如果你想提升大型科技公司的知名度并有 1000 万美元可供支出,你会怎么花?投超级碗广告?赞助 F1?

- Databricks 开源模型许可证:通过使用、复制、修改、分发、执行或展示 DBRX 或 DBRX 衍生品的任何部分或元素,或以其他方式接受本协议条款,即表示您同意受...

- 来自 eugene (@eugeneyalt) 的推文:DBRX 的 system prompt 很有趣

- 揭秘全球最强大的开源 AI 模型的诞生:初创公司 Databricks 刚刚发布了 DBRX,这是迄今为止最强大的开源大语言模型——超越了 Meta 的 Llama 2。

- 向量索引 | Weaviate - 向量数据库:向量索引是向量数据库的关键组件。

- 来自 UubzU (oob-zoo) (@UubzU) 的推文:这一切的到来比你想象的要快

- 来自 Itamar Friedman (@itamar_mar) 的推文:2/ Karpathy 对“flow engineering”的看法 https://twitter.com/karpathy/status/1748043513156272416?t=x0yK3OIpDHfa2WQry97__w&s=19 ↘️ 引用 Andrej Karpathy (@karpathy) Prompt engineering...

- 来自 Daniel Han (@danielhanchen) 的推文:研究了一下 @databricks 名为 DBRX 的新型 1320 亿参数开源模型!1) 合并注意力机制的 QKV 被限制在 (-8, 8) 之间 2) 不是 RMS Layernorm - 与 Llama 不同,现在具有均值移除功能 3) 4 个活跃专家...

- 来自 jason liu (@jxnlco) 的推文:考虑在 4 月/5 月进行一轮播客巡回,对于有哪些新兴播客有什么想法吗?我很乐意聊聊我在 RAG、结构化数据方面的见解,以及我一直在学习的...

- 来自 Vitaliy Chiley (@vitaliychiley) 的推文:介绍 DBRX:开源 LLM 的新标准 🔔 https://www.databricks.com/blog/introducing-dbrx-new-state-art-open-llm 💻 DBRX 是一个在 12T tokens 上训练的 16x 12B MoE LLM 🧠DBRX 树立了新标准...

- 来自 Emad acc/acc (@EMostaque) 的推文:未找到描述

- 介绍 DBRX:全新的 SOTA 开源 LLM | Databricks:未找到描述

- 二进制和标量嵌入量化,实现显著更快且更廉价的检索:未找到描述

- 来自 Mihir P 的推文 atel (@mvpatel2000)</a>: 🚨 宣布 DBRX-Medium 🧱,一个新的 SoTA 开放权重模型,具有 36b 激活参数和 132T 总参数的 MoE,在 12T tokens(约 3e24 flops)上训练。DBRX 在通过各种基准测试的同时,达到了 150 tok/sec 的速度。De...

- Tweet from Nick Dobos (@NickADobos): 旧王已死,GPT-4 安息吧。Claude Opus 排名 ELo 第一。Haiku 击败了 GPT-4 0613 和 Mistral Large。考虑到它的廉价和快速,这简直不可思议。↘️ 引用 lmsys.org (@lmsysorg) [Arena 更新] 70K+ 新 Arena 投票...

- Databricks spent $10M on new DBRX generative AI model, but it can't beat GPT-4 | TechCrunch: 如果你想提升大型科技公司的知名度并有 1000 万美元可花,你会怎么花?投超级碗广告?赞助 F1?

- Using LLMs to Generate Terraform Code - Terrateam: 未找到描述

- Tweet from Nick Dobos (@NickADobos): 旧王已死,GPT-4 安息吧。Claude Opus 排名 ELo 第一。Haiku 击败了 GPT-4 0613 和 Mistral Large。考虑到它的廉价和快速,这简直不可思议。↘️ 引用 lmsys.org (@lmsysorg) [Arena 更新] 70K+ 新 Arena 投票...

- Tweet from Junyang Lin (@JustinLin610): 关于 DBRX 的一些评论。Mosaic 的伙伴们在 tiktoken 的选择上与我们一致(这意味着我们的选择可能没错)(虽然我们现在还没使用该包,但仍在使用 BPE tokenizer)...

- 3 New Groundbreaking Chips Explained: Outperforming Moore's Law: 访问 https://l.linqto.com/anastasiintech 并在结账时使用我的促销代码 ANASTASI500,在 LinqtoLinkedIn 的首次投资中节省 500 美元 ➜ https...

- Making AI accessible with Andrej Karpathy and Stephanie Zhan: OpenAI 创始成员、前 Tesla AI 高级总监 Andrej Karpathy 在 Sequoia Capital 的 AI Ascent 活动中与 Stephanie Zhan 探讨了关于...的重要性。

- Making AI accessible with Andrej Karpathy and Stephanie Zhan: OpenAI 创始成员、前 Tesla AI 高级总监 Andrej Karpathy 在 Sequoia Capital 的 AI Ascent 活动中与 Stephanie Zhan 探讨了关于...的重要性。

- Tweet from Migel Tissera (@migtissera): 真的吗?他们花了 1650 万美元(没错,我自己算的)并发布了一个开放权重的 SOTA 模型,而这就是 TechCrunch 的标题。搞什么鬼,伙计?

- Tweet from Ate-a-Pi (@8teAPi): 这就是 AI。真的彻底结束了。

- DBRX: A new open LLM | Hacker News: 未找到描述 </ul> </div> --- **Latent Space ▷ #[ai-announcements](https://discord.com/channels/822583790773862470/1075282504648511499/1222619489460420790)** (3 messages): - **纽约市聚会警报**: 本周五在纽约市安排了一场聚会。详情已在频道 <#979492809574866975> 中分享,请确保拥有 <@&979487831548375083> 角色以接收未来通知 [关于聚会的推文](https://twitter.com/latentspacepod/status/1773060156747583943)。 - **综述论文俱乐部启动**: “综述论文俱乐部”即将开始;你可以在[这里](https://lu.ma/ls)报名参加此活动及所有相关活动。 --- **Latent Space ▷ #[llm-paper-club-west](https://discord.com/channels/822583790773862470/1197350122112168006/1222616758960128051)** (183 messages🔥🔥): - **微调优化**: 建议对非高资源语言以及包含技术术语(如 LoRA 和 Llama 等 ML 术语、医学术语和商业术语)的内容进行 [Whisper](https://openai.com/blog/whisper/) 微调。 - **技术旅行见闻分享**: 一些参与者讨论了上周的 Whisper 演示,其中一人因公路旅行缺席而感到遗憾,演示者则幽默地自嘲了自己的表现。 - **缓慢发布的挫败感**: 用户对 *Gemini 模型* 的缓慢发布表示不满,将 Google 保守的创新方式与 OpenAI 凭借 *GPT-4* 和 *Ultra* 等模型取得的飞速进展进行了对比。 - **Mamba 的潜力**: [Mamba](https://github.com/state-spaces/mamba/) 被讨论为对传统 Transformer 模型的重大变革,并附带了其 GitHub 仓库链接、原始论文以及由 @bryanblackbee 编写的用于深入了解的 Handy Dive Notion 页面。 - **余弦相似度难题**:俱乐部探讨了 embeddings 中余弦相似度的复杂性,并引用了一篇质疑其在语义相似度中应用的 Netflix 论文,以及由 @jxnlco 发起的一条强调其陷阱的推文串。

- Adrenaline - 提问任何编程问题:Adrenaline:您的专家级 AI 编程助手。即时获取编程问题的帮助,调试问题并学习编程。非常适合开发者和学生。

- 未找到标题:未找到描述

- 未找到标题:未找到描述

- 来自 Yijia Shao (@EchoShao8899) 的推文:我们可以教 Large Language Models 从头开始撰写基于可靠来源的长篇文章吗?维基百科编辑认为这能帮助他们吗?📣发布 STORM,一个可以撰写类似维基百科文章的系统...

- Notion – 笔记、任务、维基和数据库的一体化工作空间。:一款将日常工作应用融合在一起的新工具。为您和您的团队打造的一体化工作空间。

- Assisting in Writing Wikipedia-like Articles From Scratch with Large Language Models:我们研究如何应用 Large Language Models 从头开始撰写有据可查且有条理的长篇文章,其广度和深度与维基百科页面相当。这个尚未充分探索的问题带来了新的...

- Why do tree-based models still outperform deep learning on tabular data?:虽然深度学习在文本和图像数据集上取得了巨大进展,但其在表格数据上的优越性尚不明确。我们对标准和新型深度学习方法进行了广泛的基准测试...

- 来自 Xing Han Lu (@xhluca) 的推文:这是文本生成图像的 DSPy 时刻吗?祝贺 @oscmansan @Piovrasca 等人!↘️ 引用 AK (@_akhaliq) 通过自动 Prompt 优化提高 Text-to-Image 的一致性...

- 来自 nano (@nanulled) 的推文:Mamba vs Transformer

- Is Cosine-Similarity of Embeddings Really About Similarity?:余弦相似度是两个向量之间夹角的余弦值,或者等同于它们归一化后的点积。一个流行的应用是量化高维数据之间的语义相似度...

- 来自 jason liu (@jxnlco) 的推文:给后面的人再大声点!“我爱咖啡”和“我恨咖啡”是相似还是不同?相似是因为它们都是偏好陈述,或者不同是因为它们是相反的偏好,好吧...

- langgraph/examples/storm/storm.ipynb at main · langchain-ai/langgraph:通过在 GitHub 上创建账号来为 langchain-ai/langgraph 的开发做出贡献。

- GitHub - weaviate/Verba: Retrieval Augmented Generation (RAG) chatbot powered by Weaviate:由 Weaviate 驱动的检索增强生成 (RAG) 聊天机器人 - weaviate/Verba

- GitHub - state-spaces/mamba:通过在 GitHub 上创建账号来为 state-spaces/mamba 的开发做出贡献。

- Mamba: Linear-Time Sequence Modeling with Selective State Spaces:基础模型现在驱动着深度学习中大多数令人兴奋的应用,几乎普遍基于 Transformer 架构及其核心 Attention 模块。许多次二次时间...

- GitHub - johnma2006/mamba-minimal: Simple, minimal implementation of the Mamba SSM in one file of PyTorch.:在单个 PyTorch 文件中对 Mamba SSM 的简单、极简实现。- johnma2006/mamba-minimal

- Mamba: The Easy Way:Mamba 背后大思想的概述,这是一种全新的语言模型架构。

- 4DGS Demo - dylanebert 的 Hugging Face Space:未找到描述

- Omar Sanseviero (@osanseviero) 的推文:发布文章。这是 HF 的 OS 团队在一个月内成果的一部分。在过去一周,以下 🤗 库发布了新版本:Gradio, transformers.js, diffusers, transformers, PEFT, Optimum...

- @Wauplin 在 Hugging Face 上:“🚀 刚刚发布了 `huggingface_hub` Python 库的 0.22.0 版本!……”:未找到描述

- Webhooks:未找到描述

- 用于显著提高检索速度并降低成本的二进制和标量嵌入量化:未找到描述

- Pollen-Vision:机器人领域 Zero-Shot 视觉模型的统一接口:未找到描述

- Hugging Face Transformers 初学者入门指南:未找到描述

- 介绍 Chatbot Guardrails Arena:未找到描述

- 笔记本电脑上的聊天助手:在 Intel Meteor Lake 上运行 Phi-2:未找到描述

- Cosmopedia:如何为预训练大语言模型 (Large Language Models) 创建大规模合成数据:未找到描述

- GaLore:在消费级硬件上推进大型模型训练:未找到描述

- Hugging Face - Learn:未找到描述

- Better RAG 1: Advanced Basics:未找到描述

- Effortlessly Generate Structured Information with Ollama, Zod, and ModelFusion | ModelFusion:使用 Ollama, Zod 和 ModelFusion 轻松生成结构化信息

- p3nGu1nZz/Kyle-b0a · Add Training Results Graphics:未找到描述

- p3nGu1nZz/Kyle-b0a · Hugging Face:未找到描述

- Mixtral:未找到描述

- AI Employees Outperform Human Employees?! Build a real Sales Agent:构建一个真实的 AI 员工需要什么?在生产环境中构建 AI Sales 和 Reddit Reply Agent 的真实案例;获取 100 多种方式的免费 Hubspot 研究...

- deep-learning-containers/available_images.md at master · aws/deep-learning-containers:AWS Deep Learning Containers (DLCs) 是一组用于在 TensorFlow, TensorFlow 2, PyTorch 和 MXNet 中训练和提供模型的 Docker 镜像。- aws/deep-learning-containers

- GitHub - PrakharSaxena24/RepoForLLMs: Repository featuring fine-tuning code for various LLMs, complemented by occasional explanations, deep dives.:包含各种 LLM 微调代码的仓库,辅以偶尔的解释和深度探讨。- PrakharSaxena24/RepoForLLMs

- Open Llm Leaderboard Viz - dimbyTa 创建的 Hugging Face Space:未找到描述

- HuggingChat - Assistants:浏览由社区创建的 HuggingChat 助手。

- Aurora-M: 首个经过 Biden-Harris 行政命令红队测试的开源多语言语言模型:未找到描述

- 蛋白质相似性与 Matryoshka 嵌入:未找到描述

- Not-Midjourney-V3-Release - v1.0 | Stable Diffusion LoRA | Civitai:该模型基于 1,000 张由 MidJourney V3 生成的图像进行训练,我非常喜欢它的美学风格,我认为他们放弃它是最大的错误...

- Koder (Professional Coder) - HuggingChat:在 HuggingChat 中使用 Koder (Professional Coder) 助手

- LlamaTokenizer 的实现(不含 sentencepiece)· Issue #60 · karpathy/minbpe:@karpathy 感谢精彩的讲座和实现!一如既往地令人愉悦。我尝试在不使用 sentencepiece 后端的情况下实现 LlamaTokenizer,尽可能贴近 minbpe 的实现...

- How's This, Knut?:这是 Test Account 在 Vimeo 上发布的 "How's This, Knut?",Vimeo 是高质量视频及其爱好者的家园。

- GitHub - not-lain/loadimg: 一个用于加载图像的 Python 包:一个用于加载图像的 Python 包。通过在 GitHub 上创建账户来为 not-lain/loadimg 的开发做出贡献。

- Locutusque/OpenCerebrum-dpo · Hugging Face 数据集:未找到描述

- Locutusque/OpenCerebrum-SFT · Hugging Face 数据集:未找到描述

- Locutusque/OpenCerebrum-1.0-7b-SFT · Hugging Face:未找到描述

- Locutusque/OpenCerebrum-1.0-7b-DPO · Hugging Face:未找到描述

- RealCustom: Narrowing Real Text Word for Real-Time Open-Domain Text-to-Image Customization:文本生成图像定制化旨在为给定主体合成文本驱动的图像,近期彻底改变了内容创作。现有工作遵循伪词(pseudo-word)范式,即...

- PALP: Prompt Aligned Personalization of Text-to-Image Models:内容创作者通常旨在利用超出传统文本生成图像模型能力的个人主体来创建个性化图像。此外,他们可能希望生成的图像...

- How To Fine-Tune Segment Anything:随着 Meta 上周发布 Segment Anything Model (SAM),计算机视觉正迎来其 ChatGPT 时刻。该模型经过超过 110 亿个分割样本的训练。

- nnUNet/documentation/explanation_normalization.md at master · MIC-DKFZ/nnUNet:通过在 GitHub 上创建账号来为 MIC-DKFZ/nnUNet 的开发做出贡献。

- Object detection:未找到描述

- Example DeTr Object Detectors not predicting after fine tuning:@chuston-ai 你解决这个问题了吗?@devonho 和 @MariaK,我在使用 CPPE-5 数据集训练 DeTr 模型的 Object Detector 示例的报告和 Colab 中看到了你们的名字……

- Segment Anything 모델 미세조정하기 (How To Fine-Tune Segment Anything):经作者许可,使用 DeepL 进行了机器翻译。点击下方链接可查看 encord 撰写的原文。encord 是一家开发 AI 基础设施/工具的公司,博客底部包含 encord 平台的使用说明。Segment Anything 模型微调 / How To Fine-...

- Google Colaboratory:未找到描述

- InstructPix2Pix - timbrooks 的 Hugging Face Space:未找到描述

- DreamBooth:未找到描述

- DreamBooth:未找到描述

- Image variation:未找到描述

- InstructPix2Pix:未找到描述

- Outpainting I - Controlnet 版本 · huggingface/diffusers · Discussion #7482:使用 Controlnet 进行 Outpainting。据我所知至少有三种方法可以实现 Outpainting,每种方法都有不同的变体和步骤,因此我将发布一系列 Outpainting 文章并尝试...

- 联系我们 — LlamaIndex,LLM 应用的数据框架:如果您对 LlamaIndex 有任何疑问,请联系我们,我们将尽快安排通话。

- Tools - LlamaIndex:未找到描述

- Azure OpenAI - LlamaIndex:未找到描述

- 升级到 v0.10.x - LlamaIndex:未找到描述

- 定制化 LLMs - LlamaIndex:未找到描述

- Hubspot - LlamaIndex:未找到描述

- LSP 使用演示 - Python。操作:悬停:LSP 使用演示 - Python。操作:悬停。GitHub Gist:即时分享代码、笔记和代码片段。

- Tools - LlamaIndex:未找到描述

- Llama Hub:未找到描述

- 未找到标题:未找到描述

- LlamaIndex Query Pipelines 简介 - LlamaIndex:未找到描述

- llama_index/llama-index-core/llama_index/core/instrumentation/events/embedding.py at ff73754c5b68e9f4e49b1d55bc70e10d18462bce · run-llama/llama_index:LlamaIndex 是为您 LLM 应用打造的数据框架 - run-llama/llama_index

- Astra DB - LlamaIndex:未找到描述

- getpass — 便携式密码输入:源代码:Lib/getpass.py 可用性:非 Emscripten,非 WASI。此模块在 WebAssembly 平台 wasm32-emscripten 和 wasm32-wasi 上无法工作或不可用。请参阅 WebAssembly 平台...

- llama_index/llama-index-packs/llama-index-packs-raptor/examples/raptor.ipynb at main · run-llama/llama_index:LlamaIndex 是为您 LLM 应用打造的数据框架 - run-llama/llama_index

- OnDemandLoaderTool 教程 - LlamaIndex:未找到描述

- AI 员工表现优于人类员工?!构建一个真实的 Sales Agent:构建一个真实的 AI 员工需要什么?在生产环境中构建 AI 销售和 Reddit 回复 Agent 的真实案例;获取 100 多种方式的免费 Hubspot 研究...

- llama_parse/examples/demo_advanced.ipynb at main · run-llama/llama_parse:为优化 RAG 解析文件。通过在 GitHub 上创建账号来为 run-llama/llama_parse 的开发做出贡献。

- Open LLM Leaderboard - HuggingFaceH4 提供的 Hugging Face Space:未找到描述

- 使用 LlamaIndex 和 Ollama 在本地运行 Mixtral 8x7 — LlamaIndex,LLM 应用的数据框架:LlamaIndex 是一个简单、灵活的数据框架,用于将自定义数据源连接到大语言模型 (LLMs)。

- 自定义 Embeddings - LlamaIndex:未找到描述

- llama_parse/examples/demo_json.ipynb at main · run-llama/llama_parse:为优化 RAG 解析文件。通过在 GitHub 上创建账号来为 run-llama/llama_parse 的开发做出贡献。

- 自定义 Embeddings - LlamaIndex:未找到描述

- GitHub - urchade/GLiNER: 用于 NER 的通用模型 (Extr_ act any entity types from texts)</a>: NER 通用模型(从文本中提取任何实体类型) - urchade/GLiNER

- GLiNER-Base, zero-shot NER - tomaarsen 的 Hugging Face Space: 未找到描述

- GitHub - microsoft/sample-app-aoai-chatGPT: 通过 Azure OpenAI 实现简单 Web 聊天体验的示例代码,包含 Azure OpenAI On Your Data。: 通过 Azure OpenAI 实现简单 Web 聊天体验的示例代码,包含 Azure OpenAI On Your Data。 - microsoft/sample-app-aoai-chatGPT

- 定义自定义 Query Engine - LlamaIndex: 未找到描述

- Colbert Rerank - LlamaIndex: 未找到描述

- llama_index/llama-index-integrations/postprocessor/llama-index-postprocessor-colbert-rerank/llama_index/postprocessor/colbert_rerank/base.py at main · run-llama/llama_index: LlamaIndex 是为您 LLM 应用提供的数据框架 - run-llama/llama_index

- 语义 Retriever 基准测试 - LlamaIndex: 未找到描述

- Colbert - LlamaIndex: 未找到描述

- llama_index/llama-index-integrations/indices/llama-index-indices-managed-colbert/llama_index/indices/managed/colbert/base.py at main · run-llama/llama_index: LlamaIndex 是为您 LLM 应用提供的数据框架 - run-llama/llama_index </ul> </div> --- **LlamaIndex ▷ #[ai-discussion](https://discord.com/channels/1059199217496772688/1100478495295017063/1222209476812079115)** (3 条消息): - **RAFT 赋能 LlamaIndex**: 一篇题为《Unlocking the Power of RAFT with LlamaIndex: A Journey to Enhanced Knowledge Integration》的文章讨论了 RAFT 如何增强 LlamaIndex 的知识集成。详细见解请参阅 [Medium 文章](https://medium.com/ai-advances/unlocking-the-power-of-raft-with-llamaindex-a-journey-to-enhanced-knowledge-integration-4c5170d8ec85)。 - **介绍 Centre for GenAIOps**: 国家技术官 (NTO) 和首席技术官 (CTO) 成立了一家名为 Centre for GenAIOps 的非营利组织,旨在解决构建 GenAI 驱动的应用时的限制和风险。关于该组织及其对 LlamaIndex 使用的详细信息可以在其 [网站](https://genaiops.ai/) 和 [LinkedIn 页面](https://www.linkedin.com/company/the-centre-for-genaiops-cic/?viewAsMember=true) 上找到。 - **寻求 GenAI 训练资源**: 一位成员请求推荐关于训练大语言模型 (LLMs) 的学习资源,包括博客、文章、YouTube 视频、课程和论文。聊天中未建议具体资源。 --- **OpenAI ▷ #[ai-discussions](https://discord.com/channels/974519864045756446/998381918976479273/1222103410317332490)** (90 条消息🔥🔥): - **Sora 的创意影响力获得认可**:视觉艺术家和制片人(如 [Paul Trillo](https://openai.com/blog/sora-first-impressions) 和总部位于多伦多的制作公司 *shy kids*)分享了他们对 **Sora** 的初步看法,强调了它在生成超现实和以往无法实现的创意方面的强大能力。 - **用户请求聊天机器人对话的撤销功能**:一位成员建议在 prompts 上添加“删除按钮”,以便将对话重置到特定点,从而让用户在输入错误的情况下仍能保持对话质量。 - **寻求 SORA 白名单权限遭拒**:一位摄影指导询问如何获取 **SORA** 白名单以进行创意 AI 工具实验,但被另一位成员告知目前已无法申请。 - **关于 LLM 硬件需求和实现的讨论**:对话涉及 60b 参数 AI 聊天机器人所需的潜在硬件,一位成员建议通过 ollama 使用 [DeepSeekCoder's 67b](https://openai.com/chatgpt) 模型,尽管另一位成员指出无法在本地运行 OpenAI 模型的局限性。 - **Claude 3 的能力及其与 GPT-4 的比较**:成员们讨论了他们使用 **Claude 3** 的经验,指出与 **GPT-4** 相比,它在编程和整体智能方面表现出色,部分成员在处理各种任务时更倾向于使用 Claude。

- Sora: first impressions: 我们获得了来自创意社区的宝贵反馈,帮助我们改进模型。

- no title found: no description found

- Cody Blakeney (@code_star) 的推文: 它终于来了 🎉🥳 如果你错过了我们,MosaicML/ Databricks 又回来了,推出了名为 DBRX 的新型同类最佳开源权重 LLM。这是一个拥有 132B 总参数和 32B 激活参数、32k 上下文长度的 MoE...

- Aman Sanger (@amanrsanger) 的推文: 长上下文模型的“Token 计数”是衡量内容长度的一个具有欺骗性的指标。对于代码:100K Claude Tokens ≈ 85K gpt-4 Tokens,100K Gemini Tokens ≈ 81K gpt-4 Tokens,100K Llama Tokens ≈ 75K...

- Nvidia 的 AI 芯片主导地位正受到 Google、Intel 和 Arm 的挑战: 目标是防止 AI 开发者被锁定在 CUDA 中。

- Vitaliy Chiley (@vitaliychiley) 的推文: 介绍 DBRX:开源 LLM 的新标准 🔔 https://www.databricks.com/blog/introducing-dbrx-new-state-art-open-llm 💻 DBRX 是一个在 12T tokens 上训练的 16x 12B MoE LLM 🧠DBRX 树立了新标准...

- MANTa:用于鲁棒端到端语言建模的高效基于梯度的 Tokenization: 静态子词 Tokenization 算法一直是近期语言建模工作的核心组件。然而,它们的静态特性导致了重要的缺陷,降低了模型的下游...

- Bait Fish GIF - 诱饵鱼 GIF - 发现并分享 GIF: 点击查看 GIF

- ️️ ️️ ️️ (@MoeTensors) 的推文: 我最关心它的编程能力。它表现出色 🎉✨ ↘️ 引用 Vitaliy Chiley (@vitaliychiley) 它在质量上超越了 GPT-3.5,并与 Gemini 1.0 Pro 和 Mistral Medium 竞争,同时...

- mistralai/megablocks-public 的贡献者: 通过在 GitHub 上创建账户为 mistralai/megablocks-public 的开发做出贡献。

- GitHub - openai/evals: Evals 是一个用于评估 LLM 和 LLM 系统的框架,也是一个开源的基准注册库。: Evals 是一个用于评估 LLM 和 LLM 系统的框架,也是一个开源的基准注册库。 - openai/evals

- RAFT: Adapting Language Model to Domain Specific RAG:在大规模文本语料库上预训练大语言模型 (LLMs) 已成为标准范式。当将这些 LLMs 用于许多下游应用时,通常会额外加入新的知识...

- The Unreasonable Ineffectiveness of the Deeper Layers:我们对流行的开源权重预训练 LLMs 系列进行了一种简单的层剪枝策略的实证研究,发现在不同的问答基准测试中,性能退化极小,直到...

- Fully-fused Multi-Layer Perceptrons on Intel Data Center GPUs:本文介绍了一种多层感知器 (MLPs) 的 SYCL 实现,该实现针对 Intel Data Center GPU Max 1550 进行了优化。为了提高性能,我们的实现最小化了...

- LLaMA Beyond English: An Empirical Study on Language Capability Transfer:近期,以 ChatGPT 为代表的大语言模型 (LLMs) 取得了实质性进展,在各种复杂任务中展现出卓越的能力。然而,许多...

- Tweet from main (@main_horse):@arankomatsuzaki 简而言之,如果我们人为地限制 H100,使其进入显存带宽受限的境地,仅能达到 10~20% 的 HFU,那么我们就能击败它。

- Introducing DBRX: A New State-of-the-Art Open LLM | Databricks:未找到描述

- Regulations.gov:未找到描述

- NTIA Open Weights Response: Towards A Secure Open Society Powered By Personal AI:未找到描述

- 高达 17% 的 AI 会议评审现在由 AI 撰写:新颖的统计分析揭示了近期 ML 会议同行评审中存在大量 AI 生成的内容。这对科学诚信意味着什么?

- Notion – 笔记、任务、维基和数据库的一体化工作空间。:一个将日常工作应用融合为一的新工具。它是为您和您的团队打造的一体化工作空间。

- 持续学习与灾难性遗忘:一场讨论深度神经网络中持续学习和灾难性遗忘的讲座。我们讨论了背景、评估算法的方法……

- SDXS: Real-Time One-Step Latent Diffusion Models with Image Conditions: 未找到描述

- The Unreasonable Ineffectiveness of the Deeper Layers: 我们对流行的开源预训练 LLM 家族进行了一种简单的层剪枝(layer-pruning)策略的实证研究,发现在不同的问答基准测试中,性能下降极小,直到……

- Implicit Style-Content Separation using B-LoRA: 未找到描述

- Aurora-M: The First Open Source Biden-Harris Executive Order Red teamed Multilingual Language Model: 未找到描述

- GitHub - ProGamerGov/VLM-Captioning-Tools: Python scripts to use for captioning images with VLMs: 用于使用 VLM 为图像生成字幕的 Python 脚本 - ProGamerGov/VLM-Captioning-Tools

- Nvidia’s AI chip dominance is being targeted by Google, Intel, and Arm:目标是防止 AI 开发者被锁定在 CUDA 中。

- Nathan Odle (@mov_axbx) 的推文:@samsja19 @main_horse 他们没有启用 p2p

- Building WOPR: A 7x4090 AI Server 的推文:未找到描述

- p2p-perf/rtx-4090-2x/2x-4090-p2p-runpod.ipynb at main · cuda-mode/p2p-perf:在不同的 CUDA 设备上测量点对点 (p2p) 传输 - cuda-mode/p2p-perf

- 无标题表单 OpenCV dnn cuda 接口调查:OpenCV dnn cuda 接口调查

- iron-bound: Weights & Biases,机器学习开发者工具

- iron-bound: Weights & Biases,机器学习开发者工具

- GitHub - huggingface/accelerate: 🚀 一种训练和使用具有多 GPU、TPU、混合精度 PyTorch 模型的简单方法: 🚀 一种训练和使用具有多 GPU、TPU、混合精度 PyTorch 模型的简单方法 - huggingface/accelerate

- iron-bound: Weights & Biases,机器学习开发者工具

- iron-bound: Weights & Biases,机器学习开发者工具

- Fully Sharded Data Parallel (FSDP) 入门 — PyTorch Tutorials 2.2.1+cu121 文档: 无描述

- Mistral loss 不稳定 · Issue #26498 · huggingface/transformers: 系统信息:你好,我一直在与微调了 Mistral 官方 instruct 模型的 dhokas 合作。我一直尝试在数十次消融实验中使用多个数据集微调 Mistral。在那里...

- 来自 Rui (@Rui45898440) 的推文:- 论文:https://arxiv.org/abs/2403.17919 - 代码:https://github.com/OptimalScale/LMFlow。LISA 在指令遵循任务中优于 LoRA 甚至全参数训练。

- databricks/dbrx-base · Hugging Face:未找到描述。

- Rust for Rustaceans:弥合初学者与专业人士之间的差距,使您能够使用 Rust 编写应用程序、构建库和组织项目。

- [BUG]: Debugger does not stop at breakpoint in VSC on Github codespace · Issue #1924 · modularml/mojo:Bug 描述:无论如何 Debugger 都不会在断点处停止 - 任何程序每次都直接运行结束,调试会话随之关闭。复现步骤:该效果可在...

- 使用 Mojo 运行推理 | Modular 文档:Mojo MAX Engine API 演练,展示如何加载和运行模型。

- MAX Engine Python API | Modular 文档:MAX Engine Python API 参考。

- 未找到标题:未找到描述

- OpenGPTs:未找到描述

- ">未找到标题:未找到描述

- <a href="https://api.smith.langchain.com";>">未找到标题</a>:未找到描述

- Google Colaboratory:未找到描述

- Langchain:此播放列表包含围绕 LangChain 的所有教程,LangChain 是一个使用 LLM 构建生成式 AI 应用程序的框架

- Pinecone | 🦜️🔗 Langchain:Pinecone 是一个 vector(向量数据库)

- opengpts/backend/app/retrieval.py at main · langchain-ai/opengpts:通过在 GitHub 上创建账号来为 langchain-ai/opengpts 的开发做出贡献。

- GitHub - langchain-ai/opengpts:通过在 GitHub 上创建账号来为 langchain-ai/opengpts 的开发做出贡献。

- Issues · langchain-ai/langchain:🦜🔗 构建上下文感知的推理应用程序。通过在 GitHub 上创建账号来为 langchain-ai/langchain 的开发做出贡献。

- LangSmith Walkthrough | 🦜️🔗 Langchain:在 Colab 中打开

- LangSmith Walkthrough | 🦜️🔗 Langchain:LangChain 使得原型化 LLM 应用程序和 Agents 变得容易。然而,将 LLM 应用程序交付到生产环境可能异常困难。你必须不断迭代你的 prompts、chains 和...

- Issues · langchain-ai/langchain:🦜🔗 构建上下文感知的推理应用程序。通过在 GitHub 上创建账号来为 langchain-ai/langchain 的开发做出贡献。

- Add chat history | 🦜️🔗 Langchain:在许多 Q&A 应用程序中,我们希望允许用户拥有...

- Quickstart | 🦜️🔗 Langchain:LangChain 拥有许多旨在帮助构建的组件

- Issues · langchain-ai/langchain:🦜🔗 构建上下文感知的推理应用程序。通过在 GitHub 上创建账号来为 langchain-ai/langchain 的开发做出贡献。

- 什么是 Index Network | Index Network 文档: 未找到描述

- GoatStack.AI - 来自科学论文的精选见解 | Product Hunt: GoatStack.AI 是一个自主 AI Agent,可简化 AI/ML 研究的跟进工作。它总结最新的研究论文,并通过每日通讯提供个性化见解...

- 如何使用 LangChain Output Parsers 和 GPT 将 PDF 转换为 JSON: 本视频教程演示了如何使用 LangChain 的 Output Parsers 和 GPT 将 PDF 转换为 JSON。像这样的任务以前很复杂,但现在可以...

- 这是如何使用 LangChain + GPT 将 PDF 转换为 JSON: 像将 PDF 转换为 JSON 这样的任务以前很复杂,但现在可以在几分钟内完成。在这篇文章中,我们将看到 LangChain 和 GPT 如何帮助我们实现这一目标。

- 如何使用 LangChain Output Parsers 和 GPT 将 PDF 转换为 JSON:本视频教程演示了如何使用 LangChain 的 Output Parsers 和 GPT 将 PDF 转换为 JSON。这类任务以前很复杂,但现在可以……

- 使用 Deepgram 和 Mistral AI 进行语音聊天:我们使用 Deepgram 和 Mistral AI 制作了一个语音聊天应用 https://github.com/githubpradeep/notebooks/blob/main/deepgram.ipynb #python #pythonprogramming #llm #ml #ai #...

- AI 员工表现优于人类员工?!构建一个真实的 Sales Agent:构建一个真实的 AI 员工需要什么?在生产环境中构建 AI Sales 和 Reddit Reply Agent 的真实案例;获取包含 100 多种方式的免费 Hubspot 研究报告……

- Sasank Chilamkurthy (@sasank51) 的推文:最近由 @GoogleAI、@Samsung、@intel 和 @Qualcomm 组建的 UXL 基金会引起了轰动。它的成立是为了打破 Nvidia 在 AI 硬件领域的垄断。其主要工具是 SYCL 标准。我构建了……

- Childless define global by AshwinRamachandran2002 · Pull Request #3909 · tinygrad/tinygrad:添加了针对 LLVM 的修复。

- tinygrad-notes/dotproduct.md at main · mesozoic-egg/tinygrad-notes: 通过在 GitHub 上创建一个账户来为 mesozoic-egg/tinygrad-notes 的开发做出贡献。

- tinygrad-notes/shapetracker.md at main · mesozoic-egg/tinygrad-notes: 通过在 GitHub 上创建一个账户来为 mesozoic-egg/tinygrad-notes 的开发做出贡献。

- ctypes — Python 的外部函数库: 源代码:Lib/ctypes。ctypes 是 Python 的一个外部函数库。它提供 C 兼容的数据类型,并允许调用 DLL 或共享库中的函数。它可以用于封装这些...

- Cody Blakeney (@code_star) 的推文: *修正,不是开源权重。这是一个商业友好授权的模型。请原谅我熬夜了 😅 欢迎下载并亲自尝试。https://huggingface.co/databricks/dbr...

- Naveen Rao (@NaveenGRao) 的推文: 这是我们几年前观察到的一个普遍趋势。我们称之为 Mosaic's Law,即由于硬件/软件/算法的进步,具有某种能力的模型每年所需的资金将减少到 1/4。这...

- Cody Blakeney (@code_star) 的推文: 它终于来了 🎉🥳 万一你错过了我们,MosaicML/ Databricks 又回来了,推出了一个新的同类最佳开源权重 LLM,名为 DBRX。一个 MoE 模型,总参数 132B,激活参数 32B,32k 上下文长度...

- Ben (e/sqlite) (@andersonbcdefg) 的推文: 所以你不能用 DBRX 来改进其他 LLM... 但他们从未说过你不能用它来让它们变得更糟

- 未找到标题:未找到描述

- Claude 3 Opus by anthropic | OpenRouter:这是 [Claude 3 Opus](/models/anthropic/claude-3-opus) 的低延迟版本,与 Anthropic 合作提供,具有自我审核功能:响应审核发生在模型上...

- DBRX Instruct - a Hugging Face Space by databricks:未找到描述

- databricks/dbrx-instruct · Hugging Face:未找到描述

- Daniel Han (@danielhanchen) 的推文:查看了 @databricks 新的名为 DBRX 的 1320 亿参数开源模型!1) 合并注意力 QKV 限制在 (-8, 8) 之间 2) 不是 RMS Layernorm - 现在具有均值移除,不像 Llama 3) 4 个激活专家...