ainews-cohere-command-r-anthropic-claude-tool-use

Cohere Command R+、Anthropic Claude 工具使用、OpenAI 微调

Cohere 推出了 Command R+,这是一个拥有 1040亿参数的稠密模型,具备 128k 上下文长度,专注于 RAG(检索增强生成)、工具调用以及涵盖 10 种主要语言的多语言能力。它支持多步工具调用,并开放了研究权重。Anthropic 为 Claude 引入了工具调用测试版(beta),支持超过 250 种工具,并发布了用于实际应用的新指南(cookbooks)。OpenAI 升级了其微调 API,并分享了来自 Indeed、SK Telecom 和 Harvey 的案例研究,以推广自助微调和定制模型训练。微软在量子计算领域取得突破,将错误率降低了 800 倍,并实现了迄今为止最实用的量子比特。Stability AI 发布了 Stable Audio 2.0,提升了音频生成的质量和控制力。Opera 浏览器增加了对 Meta 的 Llama、谷歌的 Gemma 和 Vicuna 等大语言模型的本地推理支持。Reddit 上的讨论聚焦于 Gemini 的大上下文窗口、GPT-3.5-Turbo 模型规模的分析,以及使用 Mistral 和 Gemma 等本地 7B 模型进行的 Claude 3 与 ChatGPT 之间的对战模拟。

2024年4月3日至4月4日的 AI 新闻。我们为您检查了 5 个 subreddits、364 个 Twitter 账号 和 26 个 Discord 社区(385 个频道,5656 条消息)。预计节省阅读时间(按 200wpm 计算):639 分钟。

今天非常忙碌。

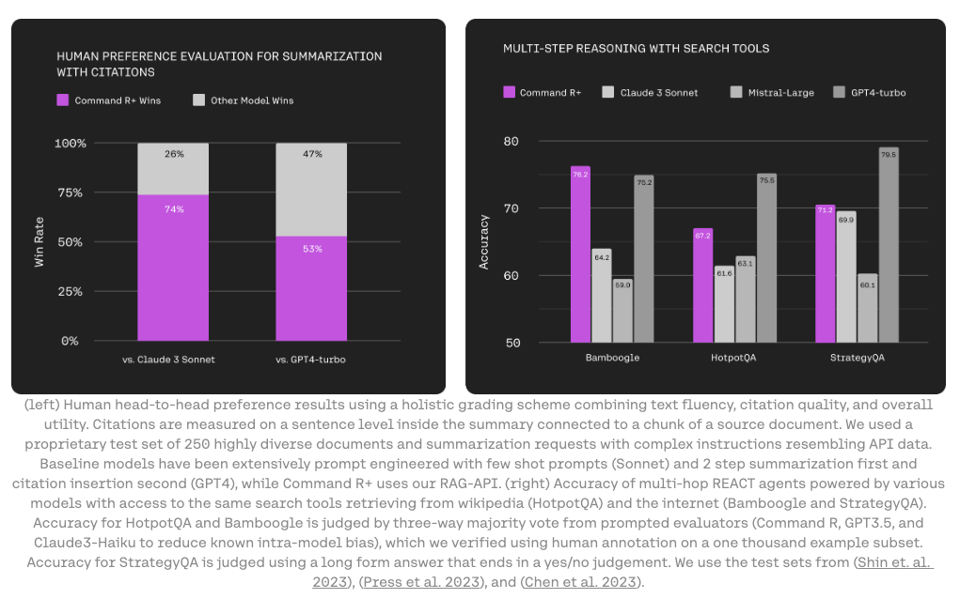

- 获得了至少 5 亿美元融资的 Cohere 推出了上个月 Command R 的快速跟进版本 Command R+(官方博客,权重)。这是一个拥有 104B 参数的稠密模型,具有 128k 上下文长度,专注于 RAG、tool-use 和多语言(“10 种核心语言”)用例。权重对研究开放,但 Aidan 表示,如果你想获得授权(而不是支付其 每百万 token $3/$15 的价格),“直接联系即可”。它现在支持 Multi-Step Tool use。

- 获得了 27.5 亿美元融资 的 Anthropic 按照之前的承诺推出了 tool use 的 Beta 版本(官方文档)。详尽的文档包含许多值得注意的特性,最显著的是宣传其处理超过 250 个工具的能力,这实现了一种与以往截然不同的 function calling 架构。这大概归功于过去一年中上下文长度和召回率(recall)的提升。更多详情请参阅其 3 本新的 cookbook:

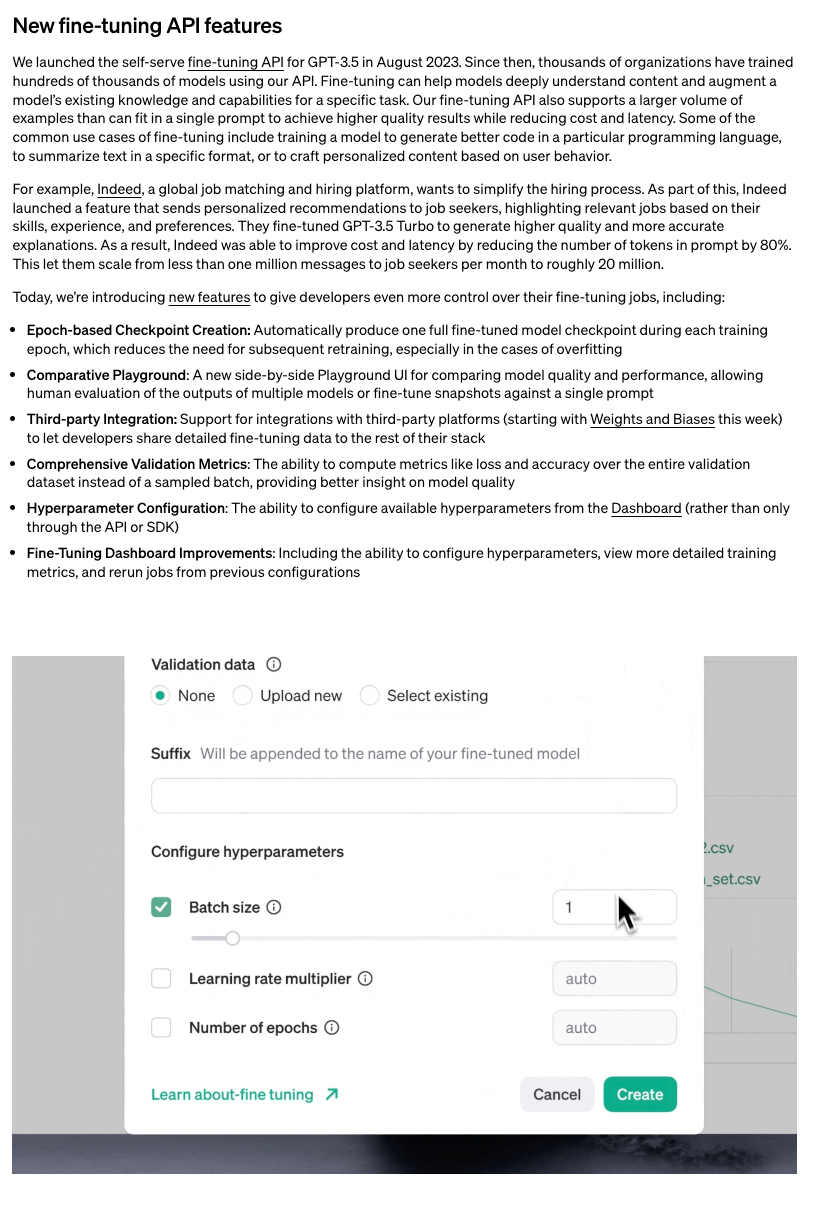

- OpenAI(据我们所知,上个月没有进行任何融资)为原本非常 MVP 式的微调体验增加了一系列备受欢迎的升级,并发布了与 Indeed、SK Telecom 和 Harvey 合作的三个案例研究,基本上是在说“你现在可以更好地 DIY,但我们也欢迎你来找我们微调和训练你的模型”。

目录

[TOC]

AI Reddit 回顾

涵盖 r/LocalLlama, r/machinelearning, r/openai, r/stablediffusion, r/ArtificialInteligence。评论抓取功能尚未实现,但即将推出。

AI 技术进展

- 量子计算突破:在 /r/singularity 中,微软在量子计算领域取得了突破,将错误率降低了 800 倍,并拥有迄今为止最实用的量子比特,这是量子计算能力的重大进步。

- Stable Audio 2.0 发布:在 /r/StableDiffusion 中,Stability AI 推出了 Stable Audio 2.0,通过提升质量和控制力增强了音频生成能力。

- 浏览器集成大语言模型:在 /r/LocalLLaMA 中,Opera 浏览器已添加对在本地运行 Meta 的 Llama、Google 的 Gemma 和 Vicuna 等大语言模型的支持,使其更易于访问。

模型能力与对比

- Gemini 的超大上下文窗口:在 /r/ProgrammerHumor 中,一张图片强调了 Gemini 的 Context Window 远大于其他模型,从而能够实现更强的上下文理解。

- GPT-3.5-Turbo 模型规模分析:在 /r/LocalLLaMA 中,分析表明 GPT-3.5-Turbo 可能是一个 8x7B 模型,规模与 Mixtral-8x7B 相似。

- Claude 3 vs ChatGPT 对战模拟:在 /r/LocalLLaMA 中,一段视频展示了 Claude 3 与 ChatGPT 在“街头霸王”风格战斗中的对比,使用了 Mistral 和 Gemma 等本地 7B 模型。

AI 研究与教育

- 斯坦福 Transformers 课程向公众开放:在 /r/StableDiffusion 中,斯坦福大学的 CS 25 Transformers 课程向公众开放,邀请顶尖研究人员讨论架构、应用等方面的突破。

- 股票预测研究的挑战:在 /r/MachineLearning 中,一场讨论探讨了为什么股票预测研究论文通常无法转化为现实世界的生产应用。

- 检索增强生成辩论:在 /r/MachineLearning 中,关于 检索增强生成(RAG)是否只是美化版的 Prompt Engineering 引发了辩论。

AI 工具与应用

- GPT-4-Vision 用于在线模仿:在 /r/singularity 中,一段视频演示了如何使用 GPT-4-Vision 在电子邮件或任何网站上一键模仿用户本人。

- 自动视频精彩片段检测:在 /r/singularity 中,展示了一个通过自定义搜索词自动在长视频中寻找精彩片段的工具。

- Daz3D AI 驱动图像生成:在 /r/StableDiffusion 中,Daz3D 与 Stability AI 合作推出 Daz AI Studio,用于根据文本生成风格化图像。

AI 梗与幽默

- Gemini 上下文窗口梗:在 /r/ProgrammerHumor 中,一张幽默图片描绘了“Gemini 的 Context Window 比其他任何人都大”。

- 《超级银河战士》恶搞预告片:在 /r/singularity 中,使用 Dalle3 和 GPT 制作了一个 《超级银河战士》(Super Metroid)恶搞电影预告片。

- 卧室二维码梗:在 /r/singularity 中,分享了一张卧室二维码梗图。

AI Twitter 回顾

所有回顾均由 Claude 3 Opus 完成,取 4 次运行中的最佳结果。我们正在尝试使用 Haiku 进行聚类和 Flow Engineering。

Cohere Command R+ 发布

- 新型开源模型:@cohere 发布了 Command R+,这是一个拥有 104B 参数、128k 上下文长度的模型,其权重针对非商业用途开放,并具备强大的多语言和 RAG 能力。该模型已在 Cohere playground 和 Hugging Face 上线。

- 针对 RAG 工作流优化:Command R+ 针对 RAG 进行了优化,具备拆解复杂问题的 multi-hop 能力和强大的 tool use(工具调用)能力。它已与 @LangChainAI 集成,用于构建 RAG 应用程序。

- 多语言支持:Command R+ 在包括英语、法语、西班牙语、意大利语、德语、葡萄牙语、日语、韩语、阿拉伯语和中文在内的 10 种语言中表现出 强劲性能。@JayAlammar 指出,其 tokenizer 对 阿拉伯语和其他非英语语言 更为高效,所需的 token 更少,从而降低了成本。

- 定价与可用性:@cohere 提到 Command R+ 在可扩展市场类别中处于领先地位,助力企业投入生产。它已在 Microsoft Azure 上可用,并将很快登陆其他云服务提供商。@JayAlammar 补充道,凭借 multi-hop 能力,它将 RAG 提升到了一个新高度。

- LangChain 集成:@hwchase17 和 @LangChainAI 宣布推出

langchain-cohere软件包,以提供 chat models 和 model-specific agents 等集成功能。@cohere 对该集成在 adaptive RAG 方面的应用感到兴奋。 - Hugging Face 与性能:@osanseviero 指出该模型已在 Hugging Face 上提供,并附带了 playground 链接。@seb_ruder 强调了其 10 种语言的多语言能力。@JayAlammar 提到了针对 阿拉伯语等语言的 tokenizer 优化,以降低成本。

- 微调与效率:@awnihannun 展示了 在 M2 Ultra 上使用 MLX 通过 QLoRA 对 Command R+ 进行 fine-tuning。@_philschmid 总结了这个 104B 模型的特点:开放权重、支持 RAG 和 tool use 以及多语言支持。

DALL-E 3 Inpainting 发布

- 新功能:@gdb 和 @model_mechanic 宣布 DALL-E 3 inpainting(局部重绘)现已对所有 ChatGPT Plus 订阅用户开放。这允许用户根据文本指令 编辑和修改图像的局部。

- 使用方法:@chaseleantj 提供了一个指南:涂抹需要替换的区域,输入描述更改的 prompt;为了获得最佳效果,请勿涂抹所有文字。目前仍存在一些 局限性,例如无法在空白区域生成文字。

用于高效 Transformer 的 Mixture-of-Depths

- 方法:@arankomatsuzaki 分享了 Google 的 Mixture-of-Depths 方法,用于在 Transformer 模型中 动态分配计算资源。它通过限制每一层 self-attention/MLP 中的 token 数量来强制执行总计算预算。

- 优势:@rohanpaul_ai 解释说,这种方法通过将更多计算资源分配给难以预测的 token,而不是像标点符号这样容易预测的 token,从而最大限度地减少计算浪费。计算支出在 总体上是可预测的,但在 token 级别是动态且上下文敏感的。

RAG 与 Agent 进展

- 自适应 RAG 技术:Adaptive RAG 和 Corrective-RAG 等新论文提出根据查询复杂度动态选择 RAG 策略。相关实现已在 LangChain 和 LlamaIndex 的 cookbook 中提供。

- 基于 RAG 的应用:基于 RAG 的应用示例包括 AI 驱动的知识库 Omnivore,以及用于扩展复杂推理的 Elicit 任务分解架构。将 RAG 与 tool use 相结合,可以构建更具 Agent 特性的系统。

开源模型与框架

- Anthropic 越狱:@AlphaSignalAI 分享了 Anthropic 关于“many-shot jailbreaking”的研究,该研究通过构建良性对话来绕过 LLM 安全措施。它利用大上下文窗口来生成通常会被规避的响应。

- @AssemblyAI 推出了 Universal-1,一个多语言语音识别模型,在 1250 万小时的数据上训练而成。它在准确率和幻觉率方面优于 Whisper 等模型。

- 开源模型与数据集:新的开源模型包括来自 01.AI 的 Yi、来自清华大学的 Eurus、来自 AI21 Labs 的 Jamba 以及来自 AssemblyAI 的 Universal-1。来自 Hugging Face 的大型 OCR 数据集推动了文档 AI 的研究。

- 高效推理技术:BitMat 减少了量化模型的内存占用。Mixture-of-Depths 在 Transformer 中动态分配计算资源。HippoAttention 和 MoE 优化 加速了推理过程。

- 便捷的模型部署:Hugging Face 降低了托管推理的价格,而 Koyeb 和 SkyPilot 简化了在任何云平台上部署模型的过程。

梗与幽默

- 一段由 AI 生成的忧郁女孩演唱 MIT License 的视频在网上疯传。

- 人们对 Apple 的 AI 雄心 进行了猜测,并开玩笑说 AI 将取代软件工程师。

- 还有一些梗在调侃 AI 炒作 和 大语言模型的局限性。

AI Discord 回顾

摘要之摘要的摘要

- LLM 进展与集成:

- Cohere 发布 Command R+,这是一款 104B 参数的多语言 LLM,专为企业级使用而优化,具备先进的检索增强生成 (RAG) 和多步工具能力,引发了人们对其与其他模型性能对比的关注。

- JetMoE-8B 代表了一个成本低于 10 万美元 的里程碑,仅使用 2.2B 激活参数 就超越了 Meta AI 的 LLaMA2 性能。

- 关于将 HQQ 等 LLM 与 gpt-fast 集成的讨论,探索了 4/3 bit 量化 方法,例如 Mixtral-8x7B-Instruct 量化模型。

- 优化 LLM 推理与训练:

- Mixture-of-Depths (MoD) 使 Transformer 能够在序列中动态分配计算资源,相比均匀分布,这可能提高效率。

- Visual AutoRegressive (VAR) 建模 重新定义了自回归图像生成,在质量和速度上均优于 Diffusion Transformers。

- 根据《The Era of 1-bit LLMs》论文,BitMat 等技术提供了 高效的 1-bit LLM 实现。

- LLM 评估与基准测试:

- 评估 LLM 情感智能的新基准:Creative Writing EQ-Bench 和 Judgemark,使用相关性指标进行衡量。

- COMET 分数 突显了 Facebook WMT21 模型的翻译实力,其最高分达到了 0.848375。

- 关于 AI 产品系统化评估实践的讨论,Hamel Husain 的文章 被视为具有开创性。

- 开源 AI 框架与工具:

- LlamaIndex 发布了使用 MistralAI 构建 RAG 系统的指南 (cookbooks),包括路由和查询分解。

- Koyeb 通过连接 GitHub 仓库部署 Serverless 应用,实现 LLM 应用的轻松全球扩展。

- SaladCloud 提供针对 AI/ML 工作负载的托管容器服务,以避免高昂的云成本。

- transformer-heads GitHub 仓库 提供了通过附加新的模型头来扩展 LLM 能力的工具。

第一部分:Discord 高层摘要

Stability.ai (Stable Diffusion) Discord

-

谨慎对待高分辨率:从业者讨论了 Stable Diffusion 模型在放大时的最佳设置,主张使用 35 步以及特定的 Upscalers 和 Control Nets 来减轻图像失真。正如 Visual Autoregressive Modeling: Scalable Image Generation via Next-Scale Prediction 中所述,更高的分辨率(尤其是 2k)会导致更长的生成时间并可能出现问题。

-

AI 在创意过程中的角色:关于 AI 对创意产业日益增长的影响进行了热烈讨论,特别是思考其取代好莱坞和游戏开发中某些角色的潜力。小组探讨了像 SDXL 这样的 AI 工具如何改变就业格局,可能会提高产出高质量内容的准入门槛。

-

针对性 Lora 训练技术:为了训练用于生成特定服装(如束身衣)图像的 Lora,建议使用该物品在排除无关细节后的多角度拍摄照片。其目的是帮助 AI 专注于核心元素,从而避免在输出中引入不必要的特征。

-

成本、投资者与 AI 市场动态:公会讨论了 Stability AI 的战略障碍——在吸引投资、丰富数据集和开发新模型之间取得平衡。对话围绕在计算成本上升和模型研究兴趣波动的背景下,企业数据集货币化策略的创新展开。

-

随机闲聊依然活跃:在技术讨论之余,成员们进行了随意的闲聊,包括文化引用和问候。有人分享了一个滑稽歌曲的非话题链接,展示了社区在技术参与之外轻松的一面。

Perplexity AI Discord

API 兴奋感与支付难题:一位 Perplexity API 用户遇到了令人困惑的支付问题,其交易状态卡在“Pending”且未更新账户余额。与此同时,讨论围绕 API 的潜力以及在 Pro Subscription 与 pay-as-you-go API 之间的选择展开,观点倾向于在初始业务构思阶段选择订阅模式,因为其成本具有可预测性。

模型混搭狂热:用户深入探讨了模型偏好,倾向于在更高的消息数量和足够的 context window 之间寻找平衡。他们还应对了复杂编程语言(如 Rust)带来的模型限制挑战,并采用了自定义的“metaprompt”策略来实现结构化输出。

内容分享注意事项:提醒在 Discord 上发布内容时,确保将 threads 设置为可分享,以便促进更广泛的社区参与。

对 Sonar 模型来源链接的渴望:有关于 sonar-medium-online 模型返回带有数据的来源链接能力的咨询,但该功能实现的明确时间表仍未确定。

LLM Leaderboard 的奇闻与疑问:LLM Leaderboard 引发了关于模型排名的分析性讨论,其中夹杂着对模型名称误用的幽默调侃,指出了 system prompts 的清晰度对于提升 AI 性能的重要性。

OpenAI Discord

-

DALL·E 迎来创意新功能:DALL·E 现在在 Web、iOS 和 Android 平台上推出了编辑套件(Editing Suite),用于图像编辑和风格灵感,增强了整个 ChatGPT 平台的创意潜力。与此同时,Fine-tuning API 引入了新的仪表板、指标和集成,方便开发者构建自定义模型,详情见近期博客文章。

-

AI 的存在主义沉思:工程师们围绕 AI 展开了激烈的对话,探讨了 AI 是否在“思考”的问题,广泛共识是否认 AI 具有意识,认为其本质是复杂的数据模式执行。实时讨论中的分歧还涉及纠正公众中普遍存在的 AI 与 AGI 的误解,并以训练 LLM 执行目标导向序列的提议告终。

-

定制化还是复杂性:在 GPT-4 讨论中,工程师们争论了 Custom GPTs 的益处、DALL·E 图像特定新功能的实用性,并提出了关于数据保留政策的问题——确保即使是被删除的聊天记录也会保留一个月。

-

提示词完美化的前奏:技术人员钻研了将 Markdown 翻译成各种语言时遇到的问题,并建议在 AI role play 期间使用额外的上下文来优化 AI 的理解。还讨论了推进文本生成和在使用 LLM 时确保文档完整性的策略,建议使用“continue”等方法来扩展回复。

-

提示词精准度的耐心:当成员们努力解决 Markdown 翻译问题并寻求构建有效提示词的建议时,他们被引导至重新设计的 #1019652163640762428 获取资源。关于提示词效力的见解(特别是在角色扮演场景中)也浮出水面,强调了提供清晰上下文以塑造 AI 回复的重要性。

Unsloth AI (Daniel Han) Discord

CmdR 即将加入 Unsloth 行列:向 Unsloth AI 添加 CmdR 支持的工作正在进行中,社区正热切期待其在当前任务完成后集成。这一预期与计划于 4 月 22 日发布的开源 CPU optimizer 相关联,旨在为 GPU 资源有限的用户提升 AI 模型的易用性。

Continue 自动补全的界面创新:Continue 扩展推出了一项实验性的预发布 tab autocomplete 功能,旨在通过在开发环境中直接咨询语言模型,简化 VS Code 和 JetBrains 中的编码流程。

错误消除与优化对话:AI 工程师分享了针对命名相关 tokenizer 错误的解决方案,并讨论了 model.save_pretrained_merged 和 model.push_to_hub_merged 函数,以便在 Huggingface 上无缝保存和共享模型。尽管在 GemmaForCausalLM 中遇到了 AttributeError,但已引导用户通过更新 Unsloth 来解决。

保存与服务器端设置中的障碍:用户在处理 GGUF 转换和 Docker 设置时遇到了挑战,解决了诸如 python3.10-dev 依赖项以及在不同平台上进行 finetuning 期间内存错误的变通策略。

即将深入探索 Unsloth Studio 的下一迭代:由于当前的 Bug 修复,Unsloth Studio 的发布更新定于下月中旬,以确保与 Google Colab 的持续兼容性,并为利用 Studio 能力的开发者提供改进。

Latent Space Discord

Stable Audio 达到新高度:Stability AI 推出了 Stable Audio 2.0,能够利用单个 prompt 创建高质量的长篇音乐曲目。访问 stableaudio.com 测试模型,并在其 blog post 中了解更多详情。

AssemblyAI 表现优于 Whisper:AssemblyAI 发布了 Universal-1,这是一款语音识别模型,其准确率比 Whisper-3 高出 13.5%,且 hallucinations 减少了高达 30%。该模型仅需 38 秒即可处理一小时的音频,可在 AssemblyAI’s playground 进行试用。

使用 ChatGPT Plus 增强您的图像:ChatGPT Plus 用户现在可以修改 DALL-E 生成的图像和 prompt,该功能已在 Web 和 iOS 平台上可用。其 help article 提供了完整的操作指南。

作为可扩展微服务的 AI Agent:讨论集中在利用事件驱动架构构建可扩展的 AI Agent,并引用了 Actor Model 作为灵感,同时展示了一个用于协作反馈的 Golang 框架。

Opera One 直接下载 AI:Opera 集成了让用户在本地运行 LLM 的能力,首先从开发者流(developer stream)中的 Opera One 开始,利用 Ollama 框架,详见 TechCrunch 的报道。

DSPy 成为焦点:成员们评估了 DSPy 在优化基础模型 prompt 方面的表现,重点关注模型迁移和优化,同时警惕 API 速率限制。对 Devin 的详细研究揭示了众多 AI 项目机会,涵盖了从语音集成的 iOS 应用到文档重构计划等多种应用,引起了浓厚兴趣。

Nous Research AI Discord

- LoRA 提升了 Mistral?:工程师们讨论了在 Mistral 7B 上采用 Low-Rank Adaptation (LoRA) 以增强特定任务性能,并计划创新超出标准方法的句子切分和标注技术。

- 网络爬虫的困境与胜利:可扩展网络爬虫的实际问题是热门话题,讨论涉及反爬措施和 JavaScript 渲染等障碍。然而,大家在 Common Crawl 的效用以及囤积高质量数据集的神秘存档组织方面达成了共识。

- 学习资源扩展:分享的资源包括 lollms 结合 Ollama Server 的指南、来自 Intellifusion 的廉价 AI 芯片,以及 Hugging Face 的数据集加载工具 Chug。同时,CohereForAI 新推出的多语言 104B LLM 引起了关注,OpenAI 探索性的 GPT-4 微调定价也成为了讨论焦点。

- LLM 创新处于前沿:工程师们交流了关于语言模型剪枝的见解,特别是剪枝 25% 的 Jamba 模型,以及 Google 提倡 Transformer 学习动态分配计算资源的论文,这引发了对投机采样(speculative decoding)与 Google 方法的深入分析。

- 多样化的微调对话:成员们介绍了针对推理优化的 Eurus-7b-kto,辩论了 BitNet-1.58 中用于三元编码的“按比例除法”,商讨了 Hermes-Function-Calling 的实现问题,考虑了 QLoRA 的 VRAM 效率,并注意到 Genstruct 7B 在指令生成方面的实力。

- Project Obsidian 中的故障排除:正在为 “llava” 项目中的 ChatML 进行快速修复,并打算解决 Hermes-Vision-Alpha 的问题,但具体细节尚不明确。

- Finetuning Subnet Miner 意外:finetuning-subnet 仓库中的一个矿工脚本错误指向了可能存在的依赖缺失问题。

- RAG 数据集讨论:关于 Glaive 的 RAG 样本数据集以及 grounded mode 和正确引用标记(包括 XML 指令格式)等方法的讨论,强调了未来的应用。还重点介绍了 RAG 响应中的过滤建议以及 Cohere 的 RAG 文档。

- WorldSim 中的复制难题与指令探索:WorldSim 令人困惑的复制粘贴机制、对移动端性能的担忧,以及指向详尽 WorldSim Command Index 的链接,带来了生产力技巧以及在越狱 Claude 模型和 ASCII 艺术谜团中的文化片段。

Modular (Mojo 🔥) Discord

Mojo 在行动:工程师们分享了 Mojo 现在可以在 Snapdragon 685 CPU 等 Android 设备上运行,并讨论了将 Mojo 与 ROS 2 集成,强调了 Mojo 相比 Python 的内存安全性,特别是在 Python 的 GIL 限制 Nvidia Jetson 硬件性能的机器人领域。

性能突破与最佳实践:显著的库性能提升被提及,执行时间缩短至分钟级,超越了之前的 Golang 基准测试。建议采用预设字典容量等优化方法,并鼓励字符串专用排序算法的设计者与 Mojo 的最新版本保持一致,详见 mzaks/mojo-sort。

从解析器到 FASTQ:引入了功能完备的新型 FASTQ 解析器 BlazeSeq🔥,提供了一个符合 BioJava 和 Biopython 基准测试的 CLI 兼容解析器。他们实现的缓冲行迭代器承诺增强文件处理能力,预示着将转向稳健的文件交互未来标准,该项目已在 GitHub 上展示。

Mojo 合并狂热:关于模型合并和 Mojo 中条件一致性(conditional conformance)的创新想法使用了 @conditional 注解来实现可选的 trait,而 Mojo 主题毛绒玩具等周边创意也激发了社区的热情。讨论了内存管理优化,检查了 Mojo 标准库 nightly 版本中 Optional 返回值的潜在变化。

Modular 更新大礼包:Max⚡ 和 Mojo🔥 24.2 版本发布 带来了开源的标准库和支持社区贡献的 nightly 构建版本。解决了 24.3 版本中的 Docker 构建问题,同时持续的开发讨论建议将条件一致性和错误处理策略纳入未来的路线图考虑。

LM Studio Discord

ROCm 带来的强力提升:AMD 硬件在使用 ROCm preview 进行工程优化后,速度从 13 tokens/second 大幅提升至 65 tokens/second,凸显了合适的软件接口对 AMD GPU 的巨大潜力。

Mixtral 并非 Mistral 的失误:Mixtral 作为一种 MOE 模型,其独特的身份是将 8 个 7B 模型的实力结合成一个 56B 的强大模型,这反映了与标准 Mistral 7B 不同的战略方法。同时,在拥有 24GB VRAM 的 NVIDIA 3090 GPU 上运行 Mixtral 8x7b 可能会遇到速度瓶颈,但这仍是一个可行的尝试。

LM Studio 0.2.19 引入 Embeddings:实验室刚推出的 LM Studio version 0.2.19 Preview 1 现在支持本地 embedding models,为 AI 从业者开辟了新的可能性。尽管目前的预览版缺乏 ROCm support,但 Windows、Linux 和 Mac 用户可以从提供的链接获取各自的构建版本。

工程师解决模型异常行为:关于 AI 模型给出奇怪且与任务无关的响应的讨论揭示了模型训练中潜在的失误,这标志着一个需要调试能力的编程困境。

CrewAI 遭遇 JSONDecodeError:在使用 CrewAI 时遇到 JSONDecodeError 表明 JSON 格式可能存在错误,这是 AI 工程师必须正确处理的难题,以避免危及数据解析过程。

Eleuther Discord

Transformers 席卷斯坦福:斯坦福 CS25 关于 Transformers 的研讨会向公众开放实时旁听和录播,由行业专家主导关于 LLM 架构和应用的讨论。感兴趣的人士可以通过 Zoom 参与,访问课程网站,或在 YouTube 上观看录像。

对效率声明持怀疑态度:社区对 期刊发表 中提到的 Free-pipeline Fast Inner Product (FFIP) 算法的性能声明表示怀疑,该算法承诺通过在 AI 硬件架构中减少一半的乘法运算来提高效率。

CUDA 难题与代码冲突:一名成员在 H100 GPU 上使用 LM eval harness 排除 RuntimeError with CUDA 故障时,发现 apex 是问题所在,建议升级到 CUDA 11.8 并进行其他调整以保证稳定性。

下一代 AI 训练技术备受推崇:一篇 arXiv 论文 介绍了 Transformers 中的动态 FLOP 分配,可能通过偏离均匀分布来优化性能。此外,AWS 和 Azure 等云服务支持高级训练方案,其中明确提到了 AWS 的 Gemini。

弹性与容错指南:分享了使用 PyTorch 建立容错和弹性任务启动的详细信息,文档可在 PyTorch elastic training 快速入门指南 中找到。

LAION Discord

- 代码中的 AI 伦理:一个名为 ConstitutionalAiTuning 的工具允许对语言模型进行微调以反映伦理原则,利用 JSON 文件输入原则,旨在让伦理 AI 更加普及。

- JAX 中的类型博弈:JAX 的类型提升(type promotion)语义根据操作顺序显示出不同的结果,正如 numpy 和 Jupyter 数组类型所演示的那样——将

np.int16(1)和jnp.int16(2)与3相加,会根据操作序列产生int16或int32。 - 模型训练的困惑:一场讨论研究了模型的最佳文本输入配置,辩论了在 SD3 模型领域中序列拼接(sequence concatenation)、T5 token 扩展和微调技术的优劣。

- 法律节奏与 AI:使用受版权保护的材料来训练 AI(例如 Suno 音乐 AI 平台)引发了对随之而来的法律风险和内容所有者潜在诉讼的担忧。

- AI 创新者的财务动荡:Stability AI 面临财务逆风,正在应对巨额的云服务支出,据 Forbes 文章 详细报道,这些支出可能会超过其营收能力。

在研究领域:

- 对于 LDM 而言,尺寸并不总是最重要的:一项发表在 arXiv 论文 中的研究揭示,当推理预算保持不变时,大型潜扩散模型(LDMs)并不总是优于小型模型。

- 新型优化器即将问世:一条 Twitter 预热 暗示 AI 社区应该密切关注一种新型优化器。

- VAR 模型革新图像生成:根据一篇 arXiv 论文,新提出的视觉自回归(VAR)模型在图像生成方面表现出优于 Diffusion Transformers 的效能,在质量和速度上都有所提升。

OpenAccess AI Collective (axolotl) Discord

完美补丁:OpenAccess AI Collective 的 axolotl 仓库中一个值得注意的 GitHub bug 被迅速消除,提交历史可通过 GitHub Commit 5760099 查看。同时,一个 README 目录不匹配的问题被标记并促成了清理工作。

数据集与模型对话:关于训练 Mistral 7B 模型最佳数据集的咨询引向了对 OpenOrca 数据集的推荐,而关于微调实践的辩论则倾向于优先处理“补全(completion)”而非“指令(instructions)”的策略。讨论强调了在拥有高质量指令样本时,简单微调(SFT)相较于持续预训练(CPT)的效力。

机器人服务中断:Axolotl 帮助机器人遇到障碍并下线,引发了成员们的一阵调侃,但事件背后的具体细节尚未披露。该机器人此前一直在提供关于 Qwen2 与 Qlora 集成的指导,并解决与 Docker 环境中数据集流式传输和多节点微调相关的挑战。

AI 对话:该集体的 general 频道充满了技术讨论——从 Chaiverse 等快速模型反馈服务,到在 transformer-heads GitHub 仓库 中发现的为 Transformer 模型添加 Head 的新资源。CohereForAI 发布了一个拥有 1040 亿参数的巨型 C4AI Command R+ 模型,其专业能力已在 Hugging Face 上揭晓,引发了关于运行超大模型的财务影响的对话。

基础设施创新:SaladCloud 最近推出的针对 AI/ML 工作负载的全托管容器服务被认为是一个显著的切入点,为开发者在应对高昂的云成本和 GPU 短缺方面提供了优势,并为大规模推理提供了实惠的价格。

LlamaIndex Discord

AI 拼写检查变得触手可及:一位成员分享了使用 LlamaIndex Ollama 软件包纠正拼写错误的 Node.js 代码,展示了名为 ‘mistral’ 的 AI 模型如何修复用户错误(例如将 “bkie” 修正为 “bike”),该模型可以在本地通过 localhost:11434 运行,无需第三方服务。

Llama 的烹饪代码食谱:为 AI 爱好者推出了一系列全新的烹饪主题指南,演示了如何使用 MistralAI 构建 RAG、agentic RAG 和基于 Agent 的系统,包括 routing 和 query decomposition。点击此处获取你的 AI 食谱。

LlamaIndex 中的探索与困惑:社区讨论提出了对缺乏 knowledgegraphs 流水线支持、不清晰的 graphindex 和 graphdb 集成等问题的担忧,多位成员在查询 OpenSearch 和在 llama_index 中实现 ReAct agents 时遇到困难。

AI 讨论演进至文本之外:关于利用 Reading and Asking Generative (RAG) 技术增强图像处理潜力的讨论引起了关注,讨论的应用范围从 CAPTCHA 解决方案到确保漫画等视觉叙事的连续性。

扩展 AI 部署变得便捷:Koyeb 平台因其能够轻松扩展 LLM 应用而受到关注,它可以直接连接你的 GitHub 仓库,在全球范围内部署 serverless 应用,无需管理基础设施。点击此处查看该服务。

HuggingFace Discord

仓库可见性选择:HuggingFace 引入了默认仓库可见性设置,为企业提供 public、private 或 private-by-default 选项。Julien Chaumond 在这条推文中描述了该功能。

自定义 Quarto 发布:HuggingFace 现在支持使用 Quarto 发布,详见 Gordon Shotwell 的推文,更多信息可在 LinkedIn 上找到。

摘要难题与策略:各频道的用户讨论了使用 GPT-2 和 Hugging Face pipeline 进行摘要时的挑战,包括无效的 length penalties 以及寻找能最大化效率和结果质量的 prompt crafting 方法,即使在 CPU-only 环境下也是如此。

AI 圈的创新与互动:社区对包括 Octopus 2(一个支持 function calls 的模型)以及 Salt 推出的新 multi-subject image node pack 在图像处理方面的进展感到兴奋。社区还强调了学术讨论和资源,例如 RAG for interviews 的潜力和生产环境 prompt 中的 latency-reasoning 权衡,分享于 Siddish 的推文。

扩散模型对话探讨深度:AI 工程师探索了 diffusion models 的创意实现,讨论了用于各种数据条件的带有 cross-attention 的 DiT,并考虑将 Stable Diffusion 修改用于立体图到深度图转换等任务,参考了 DiT 论文 以及 Dino v2 GitHub 和 SD-Forge-LayerDiffuse GitHub 等资源。

tinygrad (George Hotz) Discord

寻求赞美还是功能改进?:Discord 从搞怪的鱼形 logo 切换到更精致的设计引发了成员之间的辩论,并导致了关于将横幅与新审美相匹配的讨论。George Hotz 对 logo 的更改似乎让一些人对旧版感到怀念。

深度分片优化:George Hotz 和社区成员探讨了 优化技术和跨 GPU 通信,面临着启动延迟和数据传输方面的挑战。他们研究了 cudagraphs 的使用、peer-to-peer 限制以及 NV 驱动程序的作用。

Tinygrad 性能里程碑:在分享的性能基准测试中,透露出 Tinygrad 在 单块 4090 GPU 上达到了每秒 53.4 个 tokens,与 gpt-fast 相比达到了 83% 的效率。George Hotz 表示目标是进一步提升 Tinygrad 的性能。

Intel 硬件指日可待:关于 Intel GPU 和 NPU 内核驱动程序 的讨论审视了各种可用驱动程序,如 ‘gpu/drm/i915’ 和 ‘gpu/drm/xe’,并期待 NPU 与 CPU 搭配时可能带来的性能和能效提升。

有益的神经网络教育热潮:社区发现 Tinygrad 教程 是神经网络新手的宝贵起点,并推荐了 JAX Autodidax 教程,其中包含一个 动手实践的 Colab notebook。将 ColabFold 或 OmegaFold 适配到 Tinygrad 的兴趣激增,同时也在学习 PyTorch 权重迁移方法。

OpenRouter (Alex Atallah) Discord

-

OpenRouter 采用 JSON 对象支持:已确认 OpenAI 和 Fireworks 等模型支持 ‘json_object’ 响应格式,可以通过 OpenRouter 模型页面 上的提供商参数进行验证。

-

使用 Claude 3 Haiku 寻找合适的语调:虽然 Claude 3 Haiku 模型在角色扮演中表现参差不齐,但建议提供多个示例可能会获得更好的结果。然而,使用 jailbreak (jb) 调整 对于显著改善输出是明智的。

-

Claude 越狱的小众服务器:寻找包含 NSFW 提示词的 Claude 模型 越狱方法的模型用户讨论了相关资源,指出 SillyTavern 和 Chub 的 Discord 服务器是首选之地,并提供了如何使用 pancatstack jb 等工具进行导航的指导。

-

仪表板更新展示 OpenRouter 额度:OpenRouter 仪表板 的最新更新包括一个新的指定额度显示位置,可通过

/credits端点访问。然而,特定模型(如 DBRX 和 Midnight Rose)的功能问题引发了对其支持兼容性的担忧。 -

审核纠纷影响 OpenRouter API 的拒绝率:报告强调了自我审核版本的 Claude 模型 拒绝率很高,这可能与过度保护的“安全”提示词有关。还提到了整合更好的提供商,以帮助提高 Midnight Rose 等模型服务的稳定性。

OpenInterpreter Discord

-

安装成功庆典与跨平台明确性:一位工程师为在 Windows 机器上运行该 软件 感到欣慰,并确认该软件在 PC 和 Mac 平台上均可运行。详细的安装说明和指南可以在项目的文档中找到。

-

持续存在的 Termux 困境:讨论指出在安装过程中

chroma-hnswlib存在反复出现的问题,尽管有报告称其已被移除。成员们被建议将详细的技术支持咨询迁移到指定的支持频道。 -

讨论 Hermes-2-Pro 的 Prompt 实践:活跃的对话强调了根据 Hermes-2-Pro 模型卡片的建议调整系统提示词(system prompts)的必要性。这对于优化模型性能和解决某些用户认为负担沉重的冗长输出至关重要。

-

特定平台的怪癖:多位成员遇到并分享了在不同操作系统上运行 01 软件的挑战解决方案——从 Ollama 中的快捷命令、Linux 中的包依赖,到 Windows 11 上的

poetry问题。 -

Cardputer 开发进行中:技术讨论集中在将 M5 Cardputer 实现并推进到 open-interpreter 项目中。链接了 GitHub 仓库和各种工具,如用于安全隧道的 ngrok 和用于神经 TTS 系统的 rhasspy/piper 以供参考。

Interconnects (Nathan Lambert) Discord

-

Command R+ 凭借 128k Token 上下文引起轰动:一款名为 Command R+ 的新型可扩展 LLM 因其高达 128k 的 Token 上下文窗口以及通过精细化 RAG 承诺减少幻觉而备受关注。尽管由于缺乏对比数据,人们对其与其他模型的性能对比仍持好奇态度,但爱好者可以通过 实时演示 测试其能力。

-

类 ChatGPT 商业模型面临审查:对于 ChatGPT 及其类似模型能否满足企业需求,人们持怀疑态度,讨论指向可能需要定制化开发的解决方案才能真正满足业务需求。

-

学术界为高性价比的 JetMoE-8B 欢呼:JetMoE-8B 的发布在学术界受到称赞,因为它成本低廉(低于 10 万美元),且仅使用 2.2B 激活参数就实现了令人印象深刻的性能。更多详情可在其 项目页面 查看。

-

Snorkel 与模型效能辩论升温:Nathan Lambert 发布了一条具有暗示性的 推文,预告了对当前 AI 模型(如使用 RLHF 的模型)有效性的分析,从而引发了围绕备受争议的 Snorkel 框架的讨论。

-

斯坦福 CS25 吸引 Transformer 爱好者:AI 工程师对斯坦福大学的 CS25 课程表现出浓厚兴趣,该课程重点讨论了 Transformer 研究专家的见解,课程表可在 此处 获取,并有机会通过该课程的 YouTube 频道获取深度见解。

Mozilla AI Discord

- 矩阵大小至关重要:一名成员通过为大矩阵优化 matmul kernel 取得了进展,解决了处理 1024x1024 以上尺寸时遇到的 CPU 缓存挑战。

- 攻克编译器难题:编译器的增强令成员们欢欣鼓舞,这预示着代码性能将有显著提升。

- ROCm 的硬性要求:为了在 Windows 上成功部署 llamafile-0.7,成员们确认需要 ROCm 5.7+ 版本。

- 动态 SYCL 讨论:关于在 llamafile 中处理 SYCL 代码的辩论产生了一个由社区驱动的解决方案,涉及条件编译,但指出其与 MacOS 不兼容。

- Windows 上的性能困惑:在 Windows 上构建 llamafile 的尝试遇到了涉及 Cosmopolitan 编译器的复杂问题,同时还讨论了需要一个

llamafile-bench程序来衡量每秒 Token 数(tokens per second)以及 RAM 对性能的潜在影响。感兴趣的各方被引导至 The Register 上的一篇文章,该文章强调了性能提升,以及 GitHub 上关于 Cosmopolitan 的讨论。

LangChain AI Discord

加密货币聊天机器人热潮招募开发者:有人正在寻找具有 LLM 训练经验的开发者,以创建一个模拟人类对话的聊天机器人,并利用实时加密货币市场数据。目标是实现能够反映最新市场变化的细微讨论。

无需 MathpixPDFLoader 的数学符号提取:用户正在寻求从 PDF 中提取数学符号的 MathpixPDFLoader 替代方案,以寻找有效处理这一特定任务的新方法。

| LangChain LCEL 逻辑课程:一次讨论澄清了 LangChain 表达式语言 (LCEL) 中 ‘ | ’ 运算符的使用,该运算符将 Prompt 和 LLM 输出等组件链接成复杂的序列。更多细节可在 LCEL 入门指南 中进一步探索。 |

语音应用展现 AI 能力:新推出的语音应用(如 CallStar)引发了关于其交互性和设置的讨论,这些应用由 RetellAI 等技术驱动,并获得来自 Product Hunt 和 Reddit 平台的社区支持。

LangChain 快速入门演练困扰:在分享 LangChain 快速入门指南 时,一名用户提供了将 LangChain 与 OpenAI 集成的示例代码,但遇到了表示资源缺失的 NotFoundError。请求社区的技术专家协助排查此问题。

CUDA MODE Discord

- 积微成著,效率尽显:引用了 BitMat GitHub 仓库,该项目推广了 1-bit Large Language Models (LLMs) 的高效实现,与《The Era of 1-bit LLMs》中提出的方法保持一致。

- Triton 与 Torch 的新地平线:提议建立一个新频道用于贡献 Triton visualizer,以促进协作。Torch 团队正在调整 autotune 设置,转向 max-autotuning,并解决包括 Tensor Core 利用率和计时方法在内的 benchmarking 痛点——他们的工作记录在 keras-benchmarks 中。

- CUDA 内容与课程:针对热衷于学习 CUDA 编程的工程师,推荐了 CUDA MODE YouTube channel,该频道拥有丰富的讲座和支持性社区,旨在降低 CUDA 学习曲线。

- 模型集成的飞跃:新成员 mobicham 和 zhxchen17 发起了关于将 HQQ 与 gpt-fast 集成的讨论,重点关注 Llama2-7B (base),并深入研究了使用 Mixtral-8x7B-Instruct-v0.1 等模型进行 4/3 bit 量化。

- Triton 的可视化增强:在关于 Triton visualizations 的讨论中,出现了增加方向箭头、将操作细节整合到视觉效果中,以及可能将项目移植到 JavaScript 以增强交互性的建议,尽管也有人对这些功能的实际效用表示担忧。

Datasette - LLM (@SimonW) Discord

AI 对话的新方法:在反思对话式 AI 术语时,一位成员建议使用 “turns” 而不是 “responses” 来描述对话中的初始消息,这一决定源于对 logs.db 数据库的探索,并意外地与术语 database ‘turns’ 形成了双关。

AI 产品评估获得认可:成员们一致认为 Hamel Husain 关于 AI 评估的文章 非常重要,该文章概述了为 AI 创建特定领域评估系统的策略,被认为对初创企业具有开创性意义。

SQL 查询助手插件寻求透明度与控制:有人提议让 Datasette SQL 查询助手插件的评估过程可见且可编辑,旨在增强用户交互以及对评估过程的控制。

研读 Prompt 管理的未来:关于 AI Prompt 管理的最佳实践正在引发辩论,潜在模式包括本地化、中间件和微服务,这暗示了将 AI 集成到大型系统中的不同方法。

高分辨率 API 细节示例:Cohere LLM 搜索 API 的详细 JSON 响应受到关注,提供了一个可以使 AI 开发者受益的细粒度示例,正如在分享的 GitHub comment 中所展示的那样。

DiscoResearch Discord

-

情感智能基准测试 (Benchmarking Emotional Smarts):新推出的 Creative Writing EQ-Bench 和 Judgemark 基准测试旨在评估语言模型的情感智能,其中 Judgemark 通过相关性指标提出了严苛的测试。利用评分的标准差来区分模型如何使用 0-10 评分量表(相比 0-5 评分系统)来指示更细微的判断差异。

-

创意写作的评测日 (Judgment Day for Creative Writing):Creative Writing 基准测试的有效性归功于其 36 个具体的评审标准,强调了细化参数对模型评估的重要性。提供的详尽文档回答了关于这些基准测试标准的问题,展示了透明度并允许更好的模型评估。

-

衡量情感与质量 (Sizing Up Sentiment and Quality):关于最佳量表的讨论表明,情感分析最适合 -1 到 1 的范围,而质量评估则更倾向于 0-5 或 0-10 的更宽量表,这有助于模型传达更细微的观点。这些见解强调了针对特定判断领域定制评估指标的必要性。

-

COMET 在测试中表现出色 (COMET Blazes Through Testing):COMET 评估分数显示 Facebook WMT21 模型表现优异,其无参考(reference-free)评分采用了 wmt22-cometkiwi-da 方法,相关的实用脚本可在 llm_translation GitHub repository 获取。尽管如此,由于可能存在不准确性,建议保持谨慎,强调了在评估模型输出时需要持续警惕。

-

攀登无参考评估的高峰 (Scaling the Peaks of Reference-Free Evaluation):对模型准确性的呼吁强调了 COMET 评分结果并非绝对,并邀请标记显著的差异——这种做法承认了模型优化和验证的迭代本质。记录到的最高 COMET 分数为 0.848375,展示了当前语言模型在翻译任务中的先进能力。

Skunkworks AI Discord

-

AI 爱好者关注医疗保健 (AI Enthusiasts Eye Healthcare):社区对医疗保健领域 AI 的参与度正在上升,标志着 AI 技术跨学科应用的增加。

-

利用 Mixture-of-Depths (MoD) 方法演进 LLM:Mixture-of-Depths (MoD) 技术的引入被强调为一种允许语言模型动态分配计算资源的方式,有可能提高效率。该方法及其功能在 arXiv 上的一篇论文中有详细介绍。

-

彻底改变 AI 处理数学的方法 (Revolutionizing AI’s Approach to Math):在讨论改进 AI 解决数学问题的策略时,有人建议训练 AI 将应用题转换为可解方程比直接计算更有效。这种方法利用了 Python 和 Wolfram Alpha 等成熟工具的强大功能来进行实际计算。

-

论文库再添新成员 (Another Paper Added to the Trove):社区正在分享更多资源,一篇新论文 已添加到社区知识库中,但尚未提供进一步的背景信息。

PART 2: 渠道详细摘要与链接

Stability.ai (Stable Diffusion) ▷ #general-chat (910 messages🔥🔥🔥):

-

Stable Diffusion 模型与放大 (Upscaling):用户讨论了创建逼真高分辨率图像的最佳实践,建议使用较低的步数(steps)、latent upscaling 以及使用 hi-res fix 以避免图像失真。建议的设置包括使用 dpmpp ancestral Karras 或 exponential 采样器的 35 步,并配合 control nets。2k 等更高分辨率具有挑战性,通常会导致生成时间延长和潜在的图像畸变(相关讨论)。

-

AI 的未来与内容创作 (The Future of AI and Content Creation):关于 AI 对各种创意产业影响的辩论非常激烈,推测了 AI 取代好莱坞和电子游戏行业传统角色的潜力。参与者讨论了像 SDXL 这样的 AI 模型是否会让某些艺术家职位变得多余,以及不断发展的技术如何可能提高技能下限(skill floor),从而需要更少的努力来生成高质量内容。

-

针对特定物品的 Lora 训练 (Lora Training for Specific Items):一位用户询问了关于训练 Lora 以生成穿着特定物品(如紧身胸衣)的人物图像。给出的建议包括使用该物品不同角度的图像,理想情况下移除背景和面部,以防止 AI 在生成的图像中包含非预期的元素。

-

经济考量与 AI:参与者讨论了 Stability AI 面临的挑战,例如说服投资者以及专注于数据集与开发新模型之间的权衡。对话涵盖了将数据集面向企业变现的潜力,以应对感知到的对研究模型兴趣下降的问题,以及高昂算力成本的影响。

-

杂项聊天:互动包括涉及文化话题的轻松交流、普通的问候、对问候的回应,以及与讨论主旨无关的随机陈述。还有一位用户分享了一个无关的恶搞歌曲链接。

- Visual Autoregressive Modeling: Scalable Image Generation via Next-Scale Prediction:我们提出了视觉自回归建模(VAR),这是一种新的生成范式,它将图像上的自回归学习重新定义为从粗到细的“下一尺度预测”或“下一分辨率预测”...

- Juggernaut-XL_v9_RunDiffusionPhoto_v2.safetensors · RunDiffusion/Juggernaut-XL-v9 at main:未找到描述

- SDXL – A settings guide by Replicate:或者我是如何学会制作奇怪的猫的

- Remix:创建、分享和重混 AI 图像与视频。

- Home v2:利用我们的 AI 图像生成器改变您的项目。以无与伦比的速度和风格生成高质量的 AI 图像,提升您的创意愿景

- Reddit - Dive into anything:未找到描述

- Stable Radio 24/7:Stable Radio,一个 24/7 全天候直播流,专门播放由 Stable Audio 生成的曲目。在 stableaudio.com 上探索模型并开始免费创作

- Optimizations:Stable Diffusion web UI。通过在 GitHub 上创建账户,为 AUTOMATIC1111/stable-diffusion-webui 的开发做出贡献。

- sd-webui-animatediff/docs/features.md at master · continue-revolution/sd-webui-animatediff:适用于 AUTOMATIC1111 Stable Diffusion WebUI 的 AnimateDiff - continue-revolution/sd-webui-animatediff

- GitHub - comfyanonymous/ComfyUI: The most powerful and modular stable diffusion GUI, api and backend with a graph/nodes interface.:最强大且模块化的 Stable Diffusion GUI、API 和后端,具有图表/节点界面。 - comfyanonymous/ComfyUI

- Survey Form - 5day.io:作为一名刚入职几年的年轻专业人士,对于证明自己和寻找每个人都在谈论的神秘工作与生活平衡,总有一种隐约的焦虑。有时...

- Reddit - Dive into anything:未找到描述

- Juggernaut XL - V9 + RunDiffusionPhoto 2 | Stable Diffusion Checkpoint | Civitai:有关业务咨询、商业许可、定制模型和咨询,请通过 juggernaut@rundiffusion.com 联系我。Juggernaut 已上线...

- GitHub - ZHO-ZHO-ZHO/ComfyUI-SegMoE: Unofficial implementation of SegMoE for ComfyUI:SegMoE 的非官方 ComfyUI 实现。通过在 GitHub 上创建账户,为 ZHO-ZHO-ZHO/ComfyUI-SegMoE 的开发做出贡献。

- Never Gonna Give You Up - Rick Astley [Minions Ver.]:在桌面和移动设备上流式传输 Pelusita,la chica fideo 制作的 Never Gonna Give You Up - Rick Astley [小黄人版]。在 SoundCloud 上免费播放超过 3.2 亿首曲目。

Perplexity AI ▷ #general (756 条消息🔥🔥🔥):

- API 使用详解:用户对 Perplexity API 的功能和相关成本感到好奇。会议澄清了 API 在自动化任务方面非常强大,对于希望将特定服务集成到其应用程序中的开发人员来说至关重要。成本效益和使用情况取决于项目的范围和处理的数据量。

- Pro 订阅与 API 的优劣对比:关于每月支付 20 美元订阅 Perplexity 还是使用按需付费(pay-as-you-go)的 API 更有利,存在一番争论。对于创意生成和初创业务,由于易用性和成本管理,建议倾向于选择订阅模式。

- 模型偏好讨论:在涉及使用体验时,用户更倾向于拥有更多的消息条数和体面的 Context Window(上下文窗口),而不是较少的次数配上更大的上下文。Perplexity 的 AI 能力正被用于一系列任务,并具有绕过限制的灵活性。

- 通知与新 UI 元素更新:有人提到新闻通知不够直观或沟通不力,建议公司更具战略性地使用 Discord 的公告频道。一些用户对 Android 应用缺乏更新表示担忧。

- 集成限制与模型能力:讨论了在使用 Rust 等复杂语言与 AI 协作时的局限性,强调包括 Opus 在内的 AI 模型在创建可编译代码方面仍有困难。一些用户正在应用变通方法,例如开启新对话(new threads)来管理大型对话,以便更好地进行上下文管理。

- Perplexity 将在其 AI 搜索平台上尝试广告形式:Perplexity 的首席商务官 Dmitry Shevelenko 告诉 Adweek,公司正在考虑在其平台中添加赞助商建议问题。如果用户继续搜索更多信息...

- Perplexity 将在其 AI 搜索平台上尝试广告形式:Perplexity 的首席商务官 Dmitry Shevelenko 告诉 Adweek,公司正在考虑在其平台中添加赞助商建议问题。如果用户继续搜索更多信息...

- pplx-api 入门指南:未找到描述

- Brain Circuit 经典细体图标 | Font Awesome:细体风格的 Brain Circuit 图标。使用最新的超轻设计为您的项目增色。现已在 Font Awesome 6 中推出。

- Image 经典常规图标 | Font Awesome:常规风格的 Image 图标。使用随和、易读的图标使您的设计更平滑。现已在 Font Awesome 6 中推出。

- 苹果发布 ReALM —— 新 AI 模型可能让 Siri 变得更快更智能:ReALM 可能是 Siri 2.0 的一部分

- Chat Completions:未找到描述

- Ralph Wiggum Simpsons GIF - Ralph Wiggum Simpsons Hi - 发现并分享 GIF:点击查看 GIF

- Reddit - 深入探索:未找到描述

- 来自 Aravind Srinivas (@AravSrinivas) 的推文:很有趣。

- Reddit - 深入探索:未找到描述

- 1111Hz 与宇宙连接 - 接收宇宙指引 - 吸引魔法与治愈能量 #2:1111Hz 与宇宙连接 - 接收宇宙指引 - 吸引魔法与治愈能量 #2 这个频道致力于治愈您的心灵、灵魂、身体...

- Perplexity 模型选择用户脚本:Perplexity 模型选择用户脚本。GitHub Gist:即时分享代码、笔记和片段。

Perplexity AI ▷ #sharing (15 条消息🔥):

-

探索 Fritz Haber 的影响:一位成员强调了 Fritz Haber 的贡献,例如通过 Haber-Bosch 过程 实现了粮食产量的增加。他复杂的遗产包括诺贝尔奖、参与化学战、个人悲剧以及反纳粹情绪。阅读关于 Fritz Haber 的遗产。

-

LLM Leaderboard 的奥秘:一位用户研究了 LLM Leaderboard,讨论了模型指标和排名,并发现了 “95% CI” 的含义,尽管遇到了一些有趣的模名错误。探索 LLM Leaderboard 评论。

-

通过 AI 理解美:多位成员分享了他们对美这一概念的好奇心,并使用 Perplexity AI 获取有关该主题的见解。深入探讨美的本质。

-

发起关于独裁统治的讨论:一个聊天引导用户使用 Perplexity AI 查询独裁统治是如何自然产生的,引发了对威权政体起源的智力探索。调查独裁统治的出现。

-

可共享内容的提醒:一位成员被提醒在从 Discord 频道发布链接时,要确保其 thread 设置为可共享。这可以确保其他人能够查看并参与分享的内容。使 Discord threads 可共享。

Perplexity AI ▷ #pplx-api (42 messages🔥):

- 关于 Perplexity API Sonar 模型来源链接的困惑:一位用户询问 sonar-medium-online 模型何时能够随数据返回来源链接,但未收到关于该功能何时上线的明确时间表。

- 额度难题:Perplexity 中的待处理支付:一位成员报告了购买 API 额度时的问题;交易显示为“Pending(待处理)”,且未反映在账户余额中。另一位成员要求其发送账户详情以便解决,这表明采用的是逐案排查的方法。

- Realms, ReALM 与 Apple 的困扰:用户发现当询问 Apple 的 ReALM 时,机器人会感到困惑,有人建议简化 system prompt 可能会获得更好的性能,因为复杂性似乎会导致混乱。

- 用于组织输出的自定义 GPT “metaprompt”:一位用户分享了他们创建自定义 GPT 的实验,该 GPT 利用 “metaprompt” 旨在高效地构建响应,主要侧重于提供带有清晰引用的准确信息。

- Search API 定价困惑:一位成员质疑了 Search API 相对于语言模型的定价,讨论了 1000 次在线模型请求的成本效益,另一位成员澄清说,这并不等同于 1000 次单独搜索,而是每次请求可以包含多次搜索。

- <a href="https://....)"">未找到标题</a>:未找到描述

- 我们在同一条船上 Mickey Haller GIF - 我们在同一条船上 Mickey haller Lincoln lawyer - 发现并分享 GIF:点击查看 GIF

OpenAI ▷ #annnouncements (2 messages):

- DALL·E 获得编辑套件:成员们获悉,现在可以在网页端、iOS 和 Android 的 ChatGPT 中编辑 DALL·E 图像,并在 DALL·E GPT 中创建图像时获得风格灵感。

- Fine-tuning API 升级:Fine-tuning API 引入了新的仪表板、指标和集成。开发者现在在与 OpenAI 构建自定义模型时拥有更多控制权和新选项,详情见最近的博客文章:Fine-tuning API 和自定义模型计划。

提到的链接:介绍 Fine-tuning API 的改进并扩展我们的自定义模型计划:我们正在添加新功能,以帮助开发者更好地控制微调,并宣布与 OpenAI 构建自定义模型的新方法。

OpenAI ▷ #ai-discussions (494 条消息🔥🔥🔥):

-

理解 AI 与意识:讨论围绕 AI 的认知过程与人类思维的本质区别展开,辩论 LLM 等 AI 是否具备“思考”能力,还是仅仅是执行复杂数据模式的高级算法。多位参与者认为 AI 缺乏意识,而是一种对类人行为的模拟。

-

定义感知力的复杂性:感知力(Sentience)和意识是热门话题,探讨了神经活动研究揭示的动物主观体验。对话指出,辨别不同生命形式的感知力存在困难,且仅基于类人行为来定义意识具有挑战性。

-

AI 误区与预期:部分讨论强调了公众对 AI 的误解,即许多人将所有形式的 AI 等同于科幻小说中经常描绘的 AGI(通用人工智能)概念。讨论强调需要明确区分各种形式的 AI 与当前技术的现实。

-

实时讨论动态:关于 AI 的辩论经常导致参与者之间的摩擦,展示了关于 AI 能力、意识和伦理考量的广泛观点和意见。一些人推荐了 YouTube 视频等额外资源来强化自己的观点。

-

潜在的 AI 用途与开发思路:一位用户建议使用面向目标的序列(如

success <doing-business> success)来训练语言模型,用于包括下棋或制定商业策略在内的各种应用,并推论了在推理过程中提供新信息时的交互可能性。

- China brain - Wikipedia: 未找到描述

- How AIs, like ChatGPT, Learn: 我们身边的所有算法(如 ChatGPT)是如何学习并完成工作的?脚注:https://www.youtube.com/watch?v=wvWpdrfoEv0 感谢我的支持者...

- ASCII Art Bananas - asciiart.eu: 一个包含香蕉及其他相关食物和饮料的 ASCII 艺术画作的大型集合。

- Simulators — LessWrong: 感谢 Chris Scammell, Adam Shimi, Lee Sharkey, Evan Hubinger, Nicholas Dupuis, Leo Gao, Johannes Treutlein, 和 Jonathan Low 对草案的反馈...

OpenAI ▷ #gpt-4-discussions (46 条消息🔥):

-

Custom GPT vs. 基础模型:频道成员正在讨论使用 Custom GPT 相比基础 ChatGPT 模型的优势。虽然有些人更喜欢使用 Custom GPT 构建复杂提示词的便利性,但其他人认为基础 ChatGPT 模型已足以满足需求,并质疑在仅靠 Prompt Engineering 就能奏效的情况下使用 Custom GPT 的必要性。

-

DALL·E 获得新功能:DALL·E 已更新,增加了风格建议和图像局部重绘(Inpainting)功能,允许用户编辑 DALL·E 生成图像的特定部分。对于希望利用这些功能的 Plus 计划用户来说,这些信息可能特别有用。

-

模型性能比较:成员们就各种 GPT 模型和系统的性能进行了交流,一些成员注意到在特定领域,某些模型可能优于其他模型。对话显示出一种细致的理解,即模型性能会根据用例和个人测试而有很大差异。

-

利用 AI 处理 Wiki 数据:一位成员正在寻求建议,关于如何让 GPT 解释并回答来自包含 Wiki 数据库转储的 XML 文件中的问题。他们表示 GPT 很难根据 XML 文件中的数据提供准确的回答。

-

数据保留问题:用户询问了 OpenAI 的数据保留政策,特别是删除对话后的情况。回复指出,OpenAI 上删除的对话通常会保留约一个月,尽管删除后用户会立即看不到这些对话。

OpenAI ▷ #prompt-engineering (27 条消息🔥):

-

翻译困扰:一名成员在将 Markdown 内容翻译成多种语言(尤其是阿拉伯语)时遇到不一致的问题。尽管尝试调整 Prompt,例如添加“仅返回带有 Markup 的翻译文本,不要原始文本”,但结果参差不齐,部分回复仍未翻译。

-

寻找 Prompt Library:一位成员询问 Prompt Library 的位置,另一位成员迅速通过 Channel ID 将其引导至重命名后的频道。

-

完善 Apple Watch 专家 Prompt:一位用户寻求建议,希望改进 Prompt 以便在以 Apple Watch 专家身份提问时从 Bot 获得更好的回复。另一位成员建议尝试不同版本的 Prompt,甚至可以使用模型来评估 Prompt 的清晰度以及是否存在潜在的 Hallucinations。

-

Dalle-3 Prompt Engineering 位置查询:一位用户询问应在何处进行 Dalle-3 Prompt Engineering,是在通用的 Prompt-Engineering 频道还是特定的 Dalle 线程中。一名成员建议这取决于个人选择,但在 Dalle 专用频道可能会获得更集中的帮助。

-

延长文本回复:一名成员对“使文本更长”的命令不再有效感到沮丧。另一名成员推荐了一种解决方法,包括复制之前的 GPT 回复,开启新的 Chat,然后使用“继续”作为 Prompt。

-

LLM 草拟文档问题:一名成员就 LLM 在根据 Template 草拟文档时无法返回某些章节的问题寻求帮助,即使这些章节已经过修改。他们正在寻找一种解决方案,以确保所有修改过的章节都能包含在输出中。

OpenAI ▷ #api-discussions (27 messages🔥):

-

带有 Markup 的翻译困扰:一名成员尝试了各种 Prompt 公式,以保留 Markdown Markup 并正确翻译内容(包括专有名词和链接)。尽管优化了 Prompt,但仍面临维持 Markdown 格式和收到未翻译文本的问题,并对翻译的不一致性表示沮丧。

-

寻找 Prompt Library:当被问及在哪里可以找到 Prompt Library 时,一名成员被引导至重命名为 #1019652163640762428 的频道,指明了资源所在位置。

-

提高 AI 角色扮演的 Prompt 效能:在关于提升专家角色扮演 Prompt 质量的讨论中,一名成员建议让 AI 评估 Prompt 的清晰度和一致性。他们讨论了除了“Roleplay”之类的单个关键词外,整个 Prompt 上下文对影响 AI 回复风格的重要性。

-

Dalle-3 Prompt Engineering 讨论位置:一名成员询问应在何处讨论 Dalle-3 Prompt Engineering——是在 api-discussions 频道还是 Dalle 专用线程。他们被告知可以自行选择,不过在专门的 Dalle 线程中可能会得到更专注的回复。

-

扩展迭代文本生成:在遇到“使文本更长”命令未按预期生成新内容的问题后,另一名成员建议复制 AI 的回复,启动新的 Chat,然后使用“继续”一词来扩展对话。

Unsloth AI (Daniel Han) ▷ #general (306 messages🔥🔥):

-

CmdR 支持即将到来:讨论表明,在修复 Inference 问题后,为 Unsloth 添加 CmdR 支持的工作正在进行中。大家对进展感到兴奋,讨论暗示在当前任务完成后将有一个完成时间表。

-

对自动优化器的期待:Unsloth 计划推出一项对 GPU poor 群体非常重要的全新开源功能,即将正式发布,并于 4 月 22 日发布新版本和公告。该功能旨在通过 CPU 优化来改善 AI 的可访问性,支持更广泛的模型,如 Command R, Mixtral 等。

-

性能问题解答:用户参与了关于内存优化、使用 Unsloth 节省 70% VRAM 以及 Inplace Kernel 执行的技术讨论。对话重点关注了不同模型上的 Data Layout 结果以及 Unsloth In-place 操作在减少内存占用方面的有效性。

-

关于 Gemma 2B 模型的讨论与解惑:支持在 Notebooks 中根据提供的说明更改为 Gemma 2B 模型,并澄清了下载 4-bit 与 16-bit 模型的区别,保证精度损失通常在 0.1-0.5% 之间。

-

职位发布与招聘伦理讨论:关于开设求职频道的请求引发了关于无薪实习伦理以及对实习生技能期望的辩论。共识强调了为任何工作提供经济报酬的重要性。

- Google Colaboratory:未找到描述

- Google Colaboratory:未找到描述

- Google Colaboratory:未找到描述

- Google Colaboratory:未找到描述

- unsloth (Unsloth):未找到描述

- Home:2-5倍速,减少70%显存的 QLoRA 和 LoRA 微调 - unslothai/unsloth

- GitHub - myshell-ai/JetMoE: Reaching LLaMA2 Performance with 0.1M Dollars:用10万美元达到 LLaMA2 性能。通过在 GitHub 上创建账号为 myshell-ai/JetMoE 的开发做出贡献。

- GitHub - OpenNLPLab/LASP: Linear Attention Sequence Parallelism (LASP):Linear Attention Sequence Parallelism (LASP)。通过在 GitHub 上创建账号为 OpenNLPLab/LASP 的开发做出贡献。

- sloth/sftune.py at master · toranb/sloth:使用 unsloth 的 python sftune, qmerge 和 dpo 脚本 - toranb/sloth

- Reddit - Dive into anything:未找到描述

- GitHub - ggerganov/llama.cpp: LLM inference in C/C++:C/C++ 环境下的 LLM 推理。通过在 GitHub 上创建账号为 ggerganov/llama.cpp 的开发做出贡献。

- GaLore and fused kernel prototypes by jeromeku · Pull Request #95 · pytorch-labs/ao:内核与工具原型。当前:GaLore。GaLore 内存高效训练的融合内核(fused kernels)初始实现。TODO:triton。用于量化训练的可组合 triton 内核...

Unsloth AI (Daniel Han) ▷ #random (5 messages):

-

Unsloth Studio 重构进行中:由于持续存在的 Bug,Unsloth AI 团队推迟了新版本 Unsloth Studio 的发布。初步版本可能在下月中旬提供,现有的 Unsloth 软件包将保持与 Colab 的兼容。

-

新 Tab 自动补全功能进入预发布阶段:VS Code 和 JetBrains 的 Continue 扩展现已提供 Tab 自动补全 的预发布实验性功能。Continue 的开源 autopilot 允许通过询问有关突出显示代码的问题并内联引用上下文,从而更轻松地使用任何 LLM 进行编码,其文档中通过动画 GIF 进行了展示。

提到的链接:Continue - Claude, CodeLlama, GPT-4, and more - Visual Studio Marketplace:Visual Studio Code 扩展 - 用于软件开发的开源 autopilot - 将 ChatGPT 的功能带入你的 IDE

Unsloth AI (Daniel Han) ▷ #help (248 messages🔥🔥):

-

Tokenizer 问题:用户遇到的错误是由于 Tokenizer 中模型命名不正确,导致无法正确写入,进而引发执行问题。他们已自行解决该问题。

-

成功的模型保存与 Huggingface 推送:用户讨论了使用

model.save_pretrained_merged()和model.push_to_hub_merged()保存模型,重点是正确设置模型保存和 Huggingface 推送的命名参数。相关建议包括将占位符替换为 Huggingface 用户名/模型名,并从 Huggingface 设置中获取 Write 令牌(token)。 -

Gemma 上的推理问题:一位用户遇到了与

GemmaForCausalLM对象缺少layers属性相关的AttributeError,该问题已通过 Unsloth 的更新修复,要求用户在个人机器上重新安装该软件包。 -

GGUF 转换与 Docker 环境的挑战:用户分享了将模型转换为 GGUF 格式时遇到的问题,以及一个 Docker 环境产生错误的案例,该错误通过安装

python3.10-dev得到了解决。 -

微调挑战与解决方案:讨论内容包括在 Colab 中微调 Gemma 模型、在 Sagemaker 上使用 24GB GPU 时遇到

OutOfMemoryError的补救措施、转换后 GGUF 单词拼写的奇特现象,以及关于使用修改后的参数恢复训练的见解。

- Hugging Face – 构建未来的 AI 社区。:未找到描述

- 在训练期间添加 accuracy, precision, recall 和 f1 score 指标:嗨,你可以定义自己的计算指标函数并将其传递给 trainer。这是一个计算指标的示例。从 sklearn.metrics 导入 accuracy_score 定义 accuracy 指标函数...

- TinyLlama/TinyLlama-1.1B-Chat-v1.0 · Hugging Face:未找到描述

- deepseek-ai/deepseek-vl-7b-chat · Hugging Face:未找到描述

- qwp4w3hyb/deepseek-coder-7b-instruct-v1.5-iMat-GGUF · Hugging Face:未找到描述

- danielhanchen/model_21032024 · Hugging Face:未找到描述

- TheBloke/deepseek-coder-6.7B-instruct-GGUF · Hugging Face:未找到描述

- Hugging Face Transformers | Weights & Biases 文档:Hugging Face Transformers 库使 BERT 等最先进的 NLP 模型以及 mixed precision 和 gradient checkpointing 等训练技术变得易于使用。W&B 集成增加了丰富的...

- Supervised Fine-tuning Trainer:未找到描述

- 主页:快 2-5 倍,减少 70% 显存,QLoRA & LoRA 微调 - unslothai/unsloth

- 主页:快 2-5 倍,减少 70% 显存,QLoRA & LoRA 微调 - unslothai/unsloth

- GitHub - oobabooga/text-generation-webui: 一个用于 Large Language Models 的 Gradio Web UI。支持 transformers, GPTQ, AWQ, EXL2, llama.cpp (GGUF), Llama 模型。:一个用于 Large Language Models 的 Gradio Web UI。支持 transformers, GPTQ, AWQ, EXL2, llama.cpp (GGUF), Llama 模型。- oobabooga/text-generation-webui

- 由 eabdullin 修复 GemmaModel_fast_forward_inference · Pull Request #300 · unslothai/unsloth:在快速推理时,Gemma 模型报错 'GemmaCausalLM' has no attribute 'layers'。对此的快速修复。

- GitHub - abetlen/llama-cpp-python: llama.cpp 的 Python 绑定:llama.cpp 的 Python 绑定。通过在 GitHub 上创建一个账号来为 abetlen/llama-cpp-python 做出贡献。

- GitHub - unslothai/unsloth: 快 2-5 倍,减少 70% 显存,QLoRA & LoRA 微调:快 2-5 倍,减少 70% 显存,QLoRA & LoRA 微调 - unslothai/unsloth

Latent Space ▷ #ai-general-chat (86 条消息🔥🔥):

-

Stable Audio 2.0 发布:Stability AI 推出了 Stable Audio 2.0,能够根据单个提示词生成长达三分钟、采样率为 44.1 kHz 立体声、具有连贯音乐结构的高质量完整曲目。用户可以在 stableaudio.com 免费体验该模型,并在此处阅读博客文章 here。

-

AssemblyAI 的新语音模型超越 Whisper-3:AssemblyAI 发布了 Universal-1,该模型声称比 Whisper-3 准确率高 13.5%,且 hallucinations 减少多达 30%,能够在 38 秒内处理 60 分钟的音频,尽管它目前仅支持 20 种语言。可以在 assemblyai.com 的免费游乐场中进行测试。

-

在 ChatGPT Plus 中编辑 DALL-E 图像:ChatGPT Plus 现在允许用户在 Web 端和 iOS 应用上编辑 DALL-E 图像及其对话提示词。说明和用户界面详情可以在此处找到。

-

slono 发起的 AI 框架讨论:Slono 分享了关于将 AI Agent 构建为微服务/事件驱动架构以实现更好可扩展性的想法,引用了类似于 Actor Model of Computation 的理念,并为其 Golang 框架寻求反馈或帮助。

-

Opera 支持下载并运行本地 LLM:Opera 现在允许用户在本地下载并运行大语言模型 (LLM),首先面向拥有开发者流更新的 Opera One 用户开放。该浏览器正在使用开源的 Ollama 框架,并计划从各种来源添加更多模型供用户选择。

- 未找到标题: 未找到描述

- 来自 horseboat (@horseracedpast) 的推文: Bengio 真的在 2013 年就写过这个了 ↘️ 引用 AK (@_akhaliq) Google 发布 Mixture-of-Depths 在基于 Transformer 的语言模型中动态分配计算 基于 Transformer 的语言模型...

- React App: 未找到描述

- 来自 Hassan Hayat 🔥 (@TheSeaMouse) 的推文: @fouriergalois @GoogleDeepMind 兄弟,带早期退出的 MoE。整个图都下移了,这相当于节省了 10 倍的计算量... 兄弟们

- 介绍 Fine-tuning API 的改进并扩展我们的自定义模型计划: 我们正在添加新功能,以帮助开发者更好地控制 Fine-tuning,并宣布与 OpenAI 一起构建自定义模型的新方法。

- 孩子们还需要学习编程吗?(Practical AI #263) — Changelog Master Feed — Overcast: 未找到描述

- 来自 Hassan Hayat 🔥 (@TheSeaMouse) 的推文: 为什么 Google DeepMind 的 Mixture-of-Depths 论文以及更广泛的动态计算方法很重要:大部分计算都被浪费了,因为并非所有 Token 的预测难度都相同

- Opera 允许用户在本地下载并使用 LLM | TechCrunch: Opera 今天表示,现在将允许用户在桌面上本地下载并使用大语言模型 (LLM)。

- 与来自 LangChain 的 Harrison Chase 探讨开源 AI 应用开发 — No Priors: Artificial Intelligence | Machine Learning | Technology | Startups — Overcast: 未找到描述

- 来自 Stability AI (@StabilityAI) 的推文: 推出 Stable Audio 2.0 —— 一个能够从单个提示词生成长达三分钟、具有连贯音乐结构的高质量完整曲目(44.1 kHz 立体声)的新模型。探索...

- 来自 Nick Dobos (@NickADobos) 的推文: 新版 DALL-E 太棒了,我的天。比我尝试过的任何其他东西都更具可控性。我用 3 个提示词做了一个应用原型。哇!!甚至还搞定了标签栏和布局

- 来自 cohere (@cohere) 的推文: 今天,我们推出 Command R+:一款最先进的、针对 RAG 优化的 LLM,旨在处理企业级工作负载并支持全球商业语言。我们的 R 系列模型家族现已推出...

- 来自 Sherjil Ozair (@sherjilozair) 的推文: 这怎么发表的?🤔 ↘️ 引用 AK (@_akhaliq) Google 发布 Mixture-of-Depths 在基于 Transformer 的语言模型中动态分配计算 基于 Transformer 的语言模型...

- 来自 Ben (e/sqlite) (@andersonbcdefg) 的推文: 太神奇了。“你喜欢 MoE?如果我们把其中一个专家设为恒等函数会怎样。” 砰的一声,节省了 50% 的 FLOPs 🤦♂️ ↘️ 引用 Aran Komatsuzaki (@arankomatsuzaki) Google 发布 Mixture-of-Depths...

- 来自 Blaze (Balázs Galambosi) (@gblazex) 的推文: 哇。当 OpenAI API 还停留在 Whisper-2 时,@AssemblyAI 发布了甚至超越 Whisper-3 的产品:比 Whisper-3 准确率高 13.5% + 幻觉减少多达 30% + 处理 60 秒音频仅需 38 秒...

- 加入我们的云高清视频会议: Zoom 是现代企业视频通信的领导者,拥有简单、可靠的云平台,可跨移动端、桌面端和会议室系统进行视频和音频会议、聊天及网络研讨会。Zoom ...

- Reddit - 深入探索: 未找到描述

- SDxPaperClub · Luma: SDx 论文俱乐部。将要展示的论文是 [待定],作者 [待定] Twitter | Discord | LinkedIn

- Representation Engineering Engineering and Control Vectors - Neuroscience for LLMs</a>: tl;dr 最近的一篇论文以类似于神经科学的方式研究了大型语言模型 (LLM) 对刺激的反应,揭示了一种用于控制和理解 LLM 的诱人工具。我在这里写道...

- GitHub - Paitesanshi/LLM-Agent-Survey: 通过在 GitHub 上创建账户,为 Paitesanshi/LLM-Agent-Survey 的开发做出贡献。

- Notion – 笔记、任务、维基和数据库的一体化工作空间。: 一款将日常工作应用融合在一起的新工具。它是为您和您的团队打造的一体化工作空间。

- Multimodal AI: Antonio Torralba: Antonio Torralba,MIT 电气工程与计算机科学系及 CSAIL 教授,谈论视觉感知和语言模型。Torralba 的演讲是...的一部分

- 未找到标题: 未找到描述

- eReader: 未找到描述 </ul> </div> --- **Latent Space ▷ #[llm-paper-club-west](https://discord.com/channels/822583790773862470/1197350122112168006/1225158181316067422)** (356 条消息🔥🔥): - **详细总结入门**:成员们讨论了使用 **DSPy** 优化基础模型 Prompt 的细节,重点关注其在模型迁移和针对任意指标进行优化方面的功效。Eric 分享了他的演示,参与者们以掌声对他的见解表示认可。 - **Devin 引起关注**:对话转向了 **Devin** 的多重影响,成员们分享了可以使用这一备受瞩目的 AI 模型尝试的各种项目想法。 - **关于优化调用的热点话题**:俱乐部识别了 **DSPy** 的优化技术,并对 **.compile()** 函数调用期间由于 **DSPy** 发起的大量调用而导致的 API 速率限制 (rate limits) 表示担忧。 - **务实的编程考量**:关于 **DSPy** 与其他方法/框架的实际用例、其在不同语境下的优势,以及如何减轻模型迁移过程中的 Prompt 债务 (prompt debt) 等问题被提出。 - **技术和任务推测**:使用 **Devin** 的潜在应用建议从集成语音 API 的 iOS 应用到 **DSPy** 文档重写不等,展示了社区将 AI 应用于各种挑战的广泛兴趣。

- 加入 Slido:输入 #code 进行投票和提问:参与实时投票、测验或问答。无需登录。

- Google Colaboratory:未找到描述

- 加入 Slido:输入 #code 进行投票和提问:参与实时投票、测验或问答。无需登录。

- 1-bit LLM 时代:所有大语言模型都是 1.58 Bits:最近的研究(如 BitNet)正在为 1-bit 大语言模型 (LLM) 的新时代铺平道路。在这项工作中,我们引入了一个 1-bit LLM 变体,即 BitNet b1.58,其中每一个参数...

- 生成式摘要的评估与幻觉检测:基于参考、上下文和偏好的指标,自一致性以及捕捉幻觉。

- DSPy:将声明式语言模型调用编译为自改进流水线:ML 社区正在迅速探索提示语言模型 (LM) 并将其堆叠到解决复杂任务的流水线中的技术。不幸的是,现有的 LM 流水线通常是...

- 有效与无效的 LLM 特定任务评估:用于分类、摘要、翻译、版权重复和毒性的评估。

- 你是人类吗?:未找到描述

- 有效与无效的 LLM 特定任务评估:用于分类、摘要、翻译、版权重复和毒性的评估。

- - 去你的,给我看 Prompt。:通过拦截 API 调用快速理解难以捉摸的 LLM 框架。

- stanfordnlp/dspy 项目 main 分支下的 dspy/examples/knn.ipynb:DSPy:用于编程(而非提示)基础模型的框架 - stanfordnlp/dspy

- GitHub - seanchatmangpt/dspygen:一个为 DSPy (Demonstrate, Search, Predict) 项目提供的 Ruby on Rails 风格框架,适用于 GPT、BERT 和 LLama 等语言模型。:一个为 DSPy (Demonstrate, Search, Predict) 项目提供的 Ruby on Rails 风格框架,适用于 GPT、BERT 和 LLama 等语言模型。 - seanchatmangpt/dspygen

- GitHub - stanfordnlp/dspy:DSPy:用于编程(而非提示)基础模型的框架:DSPy:用于编程(而非提示)基础模型的框架 - stanfordnlp/dspy

- 来自 Hamel Husain (@HamelHusain) 的推文:@swyx 一个人 + 一小群狂热粉丝

- 中国芯片制造商推出 14nm AI 处理器,比 GPU 便宜 90% —— 140 美元的芯片采用旧工艺规避美国制裁:如果有办法规避制裁,你知道中国一定会这么做。

- GPT-4 微调:未找到描述

- ISO 8601 - 维基百科:未找到描述

- 来自 Cohere For AI (@CohereForAI) 的推文:宣布 C4AI Command R+ 开源权重,这是一个具有 RAG、工具使用和 10 种语言多语言能力的尖端 104B LLM。此版本基于我们的 35B 模型构建,是我们致力于让 AI 普及的一部分...

- 安装并释放 Ollama Server 上 lollms 的力量:一个有趣的技术教程 🚀:🌟 嘿 YouTube 的家人们!🤓 我非常激动地向大家展示我的最新视频!在这个启发性的教程中,我将带你完成安装过程...

- GitHub - huggingface/chug:用于多模态文档、图像和文本数据集的最小化分片数据集加载器、解码器和工具。:用于多模态文档、图像和文本数据集的最小化分片数据集加载器、解码器和工具。 - huggingface/chug

- Introducing Command R+: A Scalable LLM Built for Business: 介绍 Command R+:专为业务构建的可扩展 LLM。Command R+ 是一款最先进的、针对 RAG 优化的模型,旨在处理企业级工作负载,并首先在 Microsoft Azure 上可用。今天,我们推出 Command R+,我们最强大的...

- Cross-Architecture Transfer Learning for Linear-Cost Inference Transformers: 线性成本推理 Transformer 的跨架构迁移学习:最近,提出了多种架构,通过改变 self-attention 块的设计来实现线性成本推理,从而提高 Transformer 语言模型的效率...

- Inter-GPS: 未找到描述

- Mixture-of-Depths: Dynamically allocating compute in transformer-based language models: Mixture-of-Depths:在基于 Transformer 的语言模型中动态分配计算。基于 Transformer 的语言模型在输入序列中均匀分布 FLOPs。在这项工作中,我们证明了 Transformer 可以学会动态地将 FLOPs(或计算)分配给特定的...

- The Unreasonable Ineffectiveness of the Deeper Layers: 深层网络不合理的无效性:我们对流行的开源预训练 LLM 系列进行了一种简单的层剪枝策略的实证研究,发现在不同的问答基准测试中,性能几乎没有下降,直到...

- ChatGLM-Math: Improving Math Problem-Solving in Large Language Models with a Self-Critique Pipeline: ChatGLM-Math:通过自我批判流水线提高大语言模型的数学解题能力。大语言模型(LLMs)已表现出对人类语言的卓越掌握,但在需要数学解题的现实应用中仍然面临困难。虽然许多策略和数据集...

- danielus/MermaidSolar-Q4_K_S-GGUF · Hugging Face: 未找到描述

- Advancing LLM Reasoning Generalists with Preference Trees: 利用偏好树推进 LLM 推理通用模型:我们推出了 Eurus,这是一套针对推理优化的语言大模型(LLMs)。Eurus 模型基于 Mistral-7B 和 CodeLlama-70B 进行微调,在开源模型中取得了最先进的结果...

- Mixture-of-Depths: Dynamically allocating compute in transformer-based language models: 未找到描述

- Hugging Face - Learn: 未找到描述

- Practical Deep Learning for Coders - Practical Deep Learning: 程序员实用深度学习 - 实用深度学习:一门为有一定编程经验、想学习如何将深度学习和机器学习应用于实际问题的人设计的免费课程。

- CohereForAI/c4ai-command-r-plus · Hugging Face: 未找到描述

- GitHub - neurallambda/neurallambda: Reasoning Computers. Lambda Calculus, Fully Differentiable. Also Neural Stacks, Queues, Arrays, Lists, Trees, and Latches.: 推理计算机。Lambda 演算,完全可微。还包括神经栈、队列、数组、列表、树和锁存器。 - neurallambda/neurallambda

- glaiveai/glaive-code-assistant-v3 · Datasets at Hugging Face: 未找到描述

- GitHub - e-p-armstrong/augmentoolkit: Convert Compute And Books Into Instruct-Tuning Datasets: 将计算和书籍转换为指令微调数据集 - e-p-armstrong/augmentoolkit

- Reddit - Dive into anything: 未找到描述

- TroyDoesAI/MermaidMistral · Hugging Face: 未找到描述

- But what is a neural network? | Chapter 1, Deep learning: 神经网络究竟是什么? | 第一章,深度学习。什么是神经元,为什么会有层,其背后的数学原理是什么?资助未来的项目:https://www.patreon.com/3blue1brown 编写/互动...

- But what is a GPT? Visual intro to Transformers | Chapter 5, Deep Learning: GPT 究竟是什么?Transformer 的视觉入门 | 第五章,深度学习。Transformer 及其先决条件介绍。赞助者可提前观看下一章:https://3b1b.co/early-attention 特别感谢这些支持...

- Vectors | Chapter 1, Essence of linear algebra: 向量 | 第一章,线性代数的本质。从基础开始线性代数系列。资助未来的项目:https://www.patreon.com/3blue1brown 同样有价值的支持方式是...

- openbmb/Eurus-7b-kto · Hugging Face: no description found

- NousResearch/Genstruct-7B · Hugging Face: no description found

- This Repo needs some refactoring for the function calling to work properly · Issue #14 · NousResearch/Hermes-Function-Calling: Guys i think there is some issue with the way things are implemented currently in this repo biggest of which is regarding coding standard currently you guys use convert_to_openai_tool from langchai...

- Soaring from 4K to 400K: Extending LLM's Context with Activation Beacon: The utilization of long contexts poses a big challenge for LLMs due to their limited context window size. Although the context window can be extended through fine-tuning, it will result in a considera...

- 来自 LangChain (@LangChainAI) 的推文:结合 Cohere 新型 Command-R+ 的 Adaptive RAG。Adaptive-RAG(SoyeongJeong97 等人)是最近的一篇论文,它结合了 (1) 查询分析和 (2) 迭代式答案构建,以无缝处理查询...

- 检索增强生成 (RAG) - Cohere 文档:未找到描述

- C4AI 可接受使用政策:未找到描述

- RAG/长上下文推理数据集:未找到描述

- glaiveai/rag_sample · Hugging Face 数据集:未找到描述

- mephisto 🤡7 (@karan4d) 的推文:我正在开源 worldsim,当然,我提供了 worldsim 的 sysprompt 和初始化对话:sysprompt:<sys>助手今天处于 CLI 模式。人类正在直接与模拟器交互...

- Notion – 集笔记、任务、维基和数据库于一体的一站式工作空间。:一款将日常工作应用融为一体的新工具。它是为您和您的团队打造的一站式工作空间。

- Notion – 集笔记、任务、维基和数据库于一体的一站式工作空间。:一款将日常工作应用融为一体的新工具。它是为您和您的团队打造的一站式工作空间。

- 《老友记》Ross Geller GIF - Friends Ross Geller David Schwimmer - 发现并分享 GIF:点击查看 GIF

- Feel Me Think About It GIF - Feel Me Think About It 迷因 - 发现并分享 GIF:点击查看 GIF

- 起立鼓掌 GIF - 奥斯卡起立鼓掌 - 发现并分享 GIF:点击查看 GIF

- WorldSim 超级英雄宇宙扩展命令集 - Pastebin.com:Pastebin.com 自 2002 年以来一直是排名第一的文本粘贴工具。Pastebin 是一个可以在线存储文本一段时间的网站。

- WorldSim 叙事创作扩展命令集 - Pastebin.com:Pastebin.com 自 2002 年以来一直是排名第一的文本粘贴工具。Pastebin 是一个可以在线存储文本一段时间的网站。

- Karan4D 的 WorldSim System Prompt 开源 - Pastebin.com:Pastebin.com 自 2002 年以来一直是排名第一的文本粘贴工具。Pastebin 是一个可以在线存储文本一段时间的网站。

- Mojo🔥 路线图与已知局限 | Modular 文档:Mojo 计划摘要,包括即将推出的功能和需要修复的问题。

- Modular 社区直播 - MAX 24.2 新特性:MAX 24.2 现已发布!加入我们即将举行的直播,我们将讨论 MAX 的所有新特性——开源 Mojo 标准库、MAX Engine 支持...

- variant | Modular 文档:定义了一个 Variant 类型。

- 一个可以是所有权 List 或与 Buffer 配合使用的 Bytes 类型:一个可以是所有权 `List` 或与 `Buffer` 配合使用的 `Bytes` 类型 - bytes_ref_or_owned.mojo

- playground.mojo:GitHub Gist:即时分享代码、笔记和代码片段。

- playground.mojo:GitHub Gist:即时分享代码、笔记和代码片段。

- mojo/stdlib/src/utils/variant.mojo at main · modularml/mojo:Mojo 编程语言。通过在 GitHub 上创建账户为 modularml/mojo 开发做出贡献。

- [BUG] 在装饰器中使用 inout 错误地导致了奇怪的编译器错误 · Issue #2152 · modularml/mojo:Bug 描述 MRE:# 正确的实现应该是 "fn decorator(borrowed func: fn() -> None) -> fn() escaping -> None:" fn decorator(inout func: fn() -> None) -> fn() es...

- [BUG] 最新 nightly 分支上测试失败 · Issue #2144 · modularml/mojo:Bug 描述 我获取了 upstream/nightly 分支的最新更新并运行了测试,因为我想解决 1 个问题,但该分支上有 2 个测试失败。这是输出:Successfully crea...

- mojo/stdlib/src/collections/optional.mojo at nightly · modularml/mojo:Mojo 编程语言。通过在 GitHub 上创建账号为 modularml/mojo 的开发做出贡献。

- mojo/stdlib/src/collections/optional.mojo at nightly · modularml/mojo:Mojo 编程语言。通过在 GitHub 上创建账号为 modularml/mojo 的开发做出贡献。

- LMSys Chatbot Arena Leaderboard - a Hugging Face Space by lmsys:未找到描述

- AnythingLLM | 终极 AI 商业智能工具:AnythingLLM 是专为组织打造的终极企业级商业智能工具。为您的 LLM 提供无限控制、多用户支持、内外向工具等...

- openbmb/Eurus-7b-kto · Hugging Face:未找到描述

- Reddit - 深入探索一切:未找到描述

- CohereForAI/c4ai-command-r-plus · Hugging Face:未找到描述

- 直接偏好优化 (DPO):一种微调大型语言模型的简化方法:未找到描述

- christopherthompson81/quant_exploration · Hugging Face 数据集:未找到描述

- 由 Carolinabanana 添加 Command R Plus 支持 · Pull Request #6491 · ggerganov/llama.cpp:更新了张量映射,为 GGUF 转换添加了 Command R Plus 支持。

- Bloomberg - Are you a robot?: 未找到描述

- Reddit - Dive into anything: 未找到描述

- nomic-ai/nomic-embed-text-v1.5-GGUF at main: 未找到描述

- Welcome | LM Studio: LM Studio 是一款用于在电脑上运行本地 LLM 的桌面应用程序。

- Introducing Nomic Embed: A Truly Open Embedding Model: Nomic 发布了一款序列长度为 8192 的文本嵌入器(Text Embedder),其性能优于 OpenAI 的 text-embedding-ada-002 和 text-embedding-v3-small。

- nomic-ai/nomic-embed-text-v1 · Hugging Face: 未找到描述

- no title found: 未找到描述

- no title found: 未找到描述

- Yi-34B, Llama 2, and common practices in LLM training: a fact check of the New York Times:关于 Yi-34B 和 Llama 2 的澄清。

- Infinite Go:未找到描述

- Dan Hendrycks (@DanHendrycks) 的推文:https://x.ai/blog/grok-os Grok-1 已开源。发布 Grok-1 增加了 LLM 在社会中的扩散速度。民主化访问有助于我们更好地应对该技术的影响...

- Regulations.gov:未找到描述

- Regulations.gov:未找到描述

- Legal Contracts · Issue #75 · EleutherAI/the-pile:这里是从证券交易委员会收集的法律合同。https://drive.google.com/file/d/1of37X0hAhECQ3BN_004D8gm6V88tgZaB/view?usp=sharing 原始大小约为 38 GB,包含...

- 加入我们的云高清视频会议:Zoom 是现代企业视频通信的领导者,拥有易于使用、可靠的云平台,可用于跨移动设备、桌面和会议室系统的视频和音频会议、聊天和网络研讨会。

- Stanford CS25: V2 I Introduction to Transformers w/ Andrej Karpathy:2023 年 1 月 10 日,Transformers 简介。Andrej Karpathy:https://karpathy.ai/。自 2017 年推出以来,Transformers 彻底改变了自然语言处理...

- Discord | 你的聊天与聚会场所:Discord 是通过语音、视频和文本进行交流的最简单方式。在这里交谈、聊天、聚会,并与你的朋友和社区保持联系。

- Visual Autoregressive Modeling: Scalable Image Generation via Next-Scale Prediction:我们提出了视觉自回归建模 (VAR),这是一种新的生成范式,它将图像上的自回归学习重新定义为从粗到细的“次尺度预测”或“次分辨率预测”...

- Mixture-of-Depths: Dynamically allocating compute in transformer-based language models:基于 Transformer 的语言模型在输入序列上均匀分布 FLOPs。在这项工作中,我们证明了 Transformer 可以学会动态地将 FLOPs(或计算资源)分配给特定的...

- Are large language models superhuman chemists?:大语言模型 (LLM) 因其处理人类语言和执行未经显式训练的任务的能力而受到广泛关注。这与化学领域相关...

- Cem Anil (@cem__anil) 的推文:我们最清晰的发现之一是,上下文学习 (in-context learning) 通常遵循作为演示次数函数的简单幂律。我们很惊讶没有发现这一点被明确阐述...

- Fast Inner-Product Algorithms and Architectures for Deep Neural Network Accelerators:我们引入了一种名为自由流水线快速内积 (FFIP) 的新算法及其硬件架构,改进了 Winograd 提出的一种尚未被充分探索的快速内积算法 (FIP)...

- Louis Castricato - RLAIF, User Autonomy, and Controllability (Eleuther / Synthlabs):来自康奈尔科技学院开源生成式 AI 研讨会的演讲。网站:https://www.louiscastricato.com/ 幻灯片:https://drive.google.com/file/d/14Qldg0E1c...

- GitHub - HaozheLiu-ST/T-GATE: T-GATE: Cross-Attention Makes Inference Cumbersome in Text-to-Image Diffusion Models:T-GATE:交叉注意力使文本到图像扩散模型中的推理变得繁琐 - HaozheLiu-ST/T-GATE

- GitHub - trevorpogue/algebraic-nnhw: AI acceleration using matrix multiplication with half the multiplications:通过乘法次数减半的矩阵乘法实现 AI 加速 - trevorpogue/algebraic-nnhw

- Neel Nanda MATS Stream - 录取程序 + FAQ:未找到描述

- GitHub - koayon/atp_star: AtP* 的 PyTorch 和 NNsight 实现 (Kramar et al 2024, DeepMind):AtP* 的 PyTorch 和 NNsight 实现 (Kramar et al 2024, DeepMind) - koayon/atp_star

- Measuring Style Similarity in Diffusion Models: 生成模型现在被图形设计师和艺术家广泛使用。之前的研究表明,这些模型在生成过程中会记住并经常复制其训练数据中的内容。因此……

- Introducing Weco AIDE: 您的机器学习 AI Agent

- ‘Lavender’: The AI machine directing Israel’s bombing spree in Gaza: 以色列军队利用一个几乎没有人类监督且对伤亡政策宽松的 AI 目标系统,将数万名加沙人标记为暗杀嫌疑人,+972 和 Local C...

- Stability AI reportedly ran out of cash to pay its AWS bills: 据报道,这家生成式 AI 宠儿正面临支付 9900 万美元计算费用却仅产生 1100 万美元收入的局面

- Ian Malcolm GIF - Ian Malcolm Jurassic - Discover & Share GIFs: 点击查看 GIF

- Galileo: 未找到描述

- Editing DALL·E Images in ChatGPT: 您现在可以在网页端、iOS 和 Android 端的 ChatGPT 中编辑 DALL·E 图像。

- Suno is a music AI company aiming to generate $120 billion per year. But is it trained on copyrighted recordings? - Music Business Worldwide: Ed Newton-Rex 发现 Suno 创作的音乐与经典版权作品有着惊人的相似之处……

- Axis of Awesome - 4 Four Chord Song (with song titles): 澳大利亚喜剧团体 'Axis Of Awesome' 在 2009 年墨尔本国际喜剧节上表演的一段短剧。视频由 Network Ten Australia 提供。...

- GitHub - steffen74/ConstitutionalAiTuning: A Python library for fine-tuning LLMs with self-defined ethical or contextual alignment, leveraging constitutional AI principles as proposed by Anthropic. Streamlines the process of prompt generation, model interaction, and fine-tuning for more responsible AI development.: 一个用于微调 LLMs 的 Python 库,具有自定义的伦理或上下文对齐功能,利用了 Anthropic 提出的 Constitutional AI 原则。简化了 Prompt 生成、模型交互和微调的过程,以实现更负责任的 AI 开发。

- Visual Autoregressive Modeling: Scalable Image Generation via Next-Scale Prediction: 我们提出了视觉自回归建模 (VAR),这是一种新的生成范式,它将图像上的自回归学习重新定义为从粗到细的“下一尺度预测”或“下一分辨率...”

- Bigger is not Always Better: Scaling Properties of Latent Diffusion Models: 我们研究了潜在扩散模型 (LDMs) 的缩放特性,重点关注其采样效率。虽然改进的网络架构和推理算法已被证明能有效...

- Discord Mod Moderation Ban GIF - Discord mod Moderation ban Mod ban - Discover & Share GIFs: 点击查看 GIF

- CohereForAI/c4ai-command-r-plus · Hugging Face: 暂无描述

- Salad - GPU Cloud | 10k+ GPUs for Generative AI: 节省高达 90% 的云账单。轻松部署 AI/ML 生产模型。每美元可获得多出 600% 的图像和 10 倍的推理。立即免费试用 SaladCloud。

- GitHub - center-for-humans-and-machines/transformer-heads: Toolkit for attaching, training, saving and loading of new heads for transformer models: 用于为 Transformer 模型附加、训练、保存和加载新 Head 的工具包 - center-for-humans-and-machines/transformer-heads

- GitHub - OpenNLPLab/LASP: Linear Attention Sequence Parallelism (LASP): 线性注意力序列并行 (LASP)。通过在 GitHub 上创建账号为 OpenNLPLab/LASP 开发做出贡献。

- Patrickpain Patricksomuchpain GIF - Patrickpain Patricksomuchpain Patrickfleas - 发现并分享 GIF: 点击查看 GIF

- OpenAccess-AI-Collective/axolotl | Phorm AI Code Search: 更快地理解代码。

- OpenAccess-AI-Collective/axolotl | Phorm AI Code Search: 更快地理解代码。

- GitHub - OpenAccess-AI-Collective/axolotl: Go ahead and axolotl questions: 尽管提问(axolotl questions)。通过在 GitHub 上创建账号,为 OpenAccess-AI-Collective/axolotl 的开发做出贡献。

- OpenAccess-AI-Collective/axolotl | Phorm AI Code Search: 更快地理解代码。

- OpenAccess-AI-Collective/axolotl | Phorm AI Code Search: 更快地理解代码。

- OpenAccess-AI-Collective/axolotl | Phorm AI Code Search: 更快地理解代码。

- OpenAccess-AI-Collective/axolotl | Phorm AI Code Search: 更快地理解代码。

- OpenAccess-AI-Collective/axolotl | Phorm AI Code Search: 更快地理解代码。

- OpenAccess-AI-Collective/axolotl | Phorm AI Code Search: 更快地理解代码。

- 未找到标题:未找到描述

- Llama Hub:未找到描述

- 介绍 Llama Datasets 🦙📝 — LlamaIndex,LLM 应用的数据框架:LlamaIndex 是一个简单、灵活的数据框架,用于将自定义数据源连接到大语言模型(LLMs)。

- 向 LlamaHub 贡献 LlamaDataset - LlamaIndex:未找到描述

- 节点后处理器模块 - LlamaIndex:未找到描述

- Text-to-SQL 指南(查询引擎 + 检索器) - LlamaIndex:未找到描述

- 数据集生成 - LlamaIndex:未找到描述

- 简单目录读取器 - LlamaIndex:未找到描述

- 创建可信 AI 的工作流与工具 | 与 Clara Shih 一起向 AI 提问更多:Clara 与三家最热门 AI 公司的创始人/CEO 坐下来交谈——Aravind Srinivas (Perplexity AI)、Jerry Liu (LlamaIndex) 和 Harrison Chase (LangChain)...

- run-llama/llama_index 中的 llama_index/llama-index-legacy/llama_index/legacy/agent/react/prompts.py:LlamaIndex 是适用于你 LLM 应用的数据框架 - run-llama/llama_index

- 我在哪里定义向量库相似度搜索返回的 top_k 文档? · Issue #905 · run-llama/llama_index:调用查询函数时,如何指定我希望检索器传递给 LLM 的 k 值是多少?或者我需要在调用查询函数之前指定它吗?llm_predictor = LLMPredictor(llm=ChatOp...

- GitHub - run-llama/llama-hub: 由社区制作的 LLM 数据加载器库 —— 配合 LlamaIndex 和/或 LangChain 使用:由社区制作的 LLM 数据加载器库 —— 配合 LlamaIndex 和/或 LangChain 使用 - run-llama/llama-hub

- JTT FOX OFFICIAL:您可以立即联系 @Jttfoxoffcial1。

- Text generation strategies:未找到描述

- GitHub - huggingface/cookbook: Open-source AI cookbook:开源 AI 食谱。通过在 GitHub 上创建账号,为 huggingface/cookbook 的开发做出贡献。

- GitHub - unslothai/unsloth: 2-5X faster 70% less memory QLoRA & LoRA finetuning:速度快 2-5 倍,显存占用减少 70% 的 QLoRA 和 LoRA 微调 - unslothai/unsloth

- Visual Autoregressive Modeling: Scalable Image Generation via Next-Scale Prediction:我们提出了 Visual AutoRegressive modeling (VAR),这是一种新的生成范式,它将图像上的自回归学习重新定义为从粗到细的“下一尺度预测”或“下一分辨率...”

- Chain-of-Thought Prompting Elicits Reasoning in Large Language Models:我们探讨了生成思维链(一系列中间推理步骤)如何显著提高 LLM 执行复杂推理的能力。特别是,我们...

- Metaforms AI - OpenAI + Typeform = 用于反馈、调查和研究的 AI | Product Hunt: Metaforms 是 Typeform 的 AI 继任者。构建全球最强大的反馈、调查和用户研究表单,通过生成式 AI 收集关于用户的改变生活的见解。训练于...

- Octopus - Tonic 创建的 Hugging Face Space: 未找到描述

- Int Bot: 你可以立即联系 @int_gem_bot。

- GitHub - getSaltAi/SaltAI_Multisubject: 通过在 GitHub 上创建账户来为 getSaltAi/SaltAI_Multisubject 的开发做出贡献。

- 没人写过的歌 #music #newmusic #song #timelapse #photography #musicvideo #viral #art: 未找到描述

- feat: 由 SauravMaheshkar 添加 `CornellTemporalHyperGraphDatasets` · Pull Request #9090 · pyg-team/pytorch_geometric: 参考: #8501 #7312 评审请求: @rusty1s @wsad1 此 PR 旨在添加由带时间戳的单纯形组成的超图数据集,其中每个单纯形是一组节点。随论文发布 ...

- tinygrad/docs/env_vars.md at master · tinygrad/tinygrad:你喜欢 pytorch?你喜欢 micrograd?你会爱上 tinygrad!❤️ - tinygrad/tinygrad

- GitHub - tinygrad/tinygrad: You like pytorch? You like micrograd? You love tinygrad! ❤️:你喜欢 pytorch?你喜欢 micrograd?你会爱上 tinygrad!❤️ - GitHub - tinygrad/tinygrad: You like pytorch? You like micrograd? You love tinygrad! ❤️

- 提问的智慧 (How To Ask Questions The Smart Way):暂无描述

- tinygrad-notes/profiling.md at main · mesozoic-egg/tinygrad-notes:tinygrad 教程。通过在 GitHub 上创建一个账户来为 mesozoic-egg/tinygrad-notes 的开发做出贡献。

- Autodidax: 从零开始实现 JAX 核心 — JAX 文档:暂无描述

- 未找到标题:未找到描述

- Screenshot:使用 Lightshot 捕获

- SillyTavern - 面向高级用户的 LLM 前端:未找到描述

- Discord - 与好友和社区聊天的新方式:Discord 是通过语音、视频和文字进行交流的最简单方式。聊天、聚会,并与你的好友和社区保持紧密联系。

- 未找到标题:未找到描述

- Ubuntu 21+ is not supported [wayland] · Issue #219 · OpenInterpreter/01: 一些依赖项使用 x11,与 wayland 不兼容 https://github.com/Kalmat/PyWinCtl?tab=readme-ov-file#linux-notice https://github.com/asweigart/pyautogui/issues?q=is%3Aissue+is%3Aopen...

- GitHub - Clinteastman/c0mputer: Porting open-interpreter to the M5 Cardputer: 将 open-interpreter 移植到 M5 Cardputer。通过在 GitHub 上创建账号来为 Clinteastman/c0mputer 的开发做出贡献。

- GitHub - m5stack/M5Unified at develop: M5Stack 系列的统一库。通过在 GitHub 上创建账号来为 m5stack/M5Unified 的开发做出贡献。

- Quickstart | ngrok documentation: 本快速入门将使用 ngrok agent 来部署您的应用程序

- GitHub - rhasspy/piper: A fast, local neural text to speech system: 一个快速、本地的神经文本转语音系统。通过在 GitHub 上创建账号来为 rhasspy/piper 的开发做出贡献。

- ngrok - Online in One Line: 未找到描述

- JetMoE: 未找到描述

- Introducing Command R+: A Scalable LLM Built for Business: Command R+ 是一款最先进的 RAG 优化模型,旨在处理企业级工作负载,并首先在 Microsoft Azure 上可用。今天,我们推出了 Command R+,我们最强大的...

- CohereForAI/c4ai-command-r-plus · Hugging Face: 未找到描述

- jetmoe/jetmoe-8b · Hugging Face: 未找到描述

- OpenAI partners with Scale to provide support for enterprises fine-tuning models: OpenAI 的客户可以利用 Scale 的 AI 专业知识来定制我们最先进的模型。

- Tweet from Aidan Gomez (@aidangomez): ⌘R+ 欢迎 Command R+,我们专注于可扩展性、RAG 和 Tool Use 的最新模型。与上次一样,我们将发布研究用途的权重,希望它们对大家有用!https:/...

- 来自 Marc Andreessen 🇺🇸 (@pmarca) 的推文:请观看并享受!Ben @bhorowitz 和我花了两个小时讨论华盛顿特区及其他地区的技术政治和政策。回答了许多 X 上的问题并阐述了观点。🇺🇸🚀💪

- CS25: Tranformers United!:讨论 Transformer 在不同领域的最新突破

- 谷歌考虑对 AI 驱动的搜索收费,这是商业模式的重大转变:未找到描述

- Llamafile LLM 驱动程序项目提升了 CPU 核心性能:狠狠地压榨 LLaMA 的性能

- 安装 HIP SDK — HIP SDK Windows 安装:未找到描述

- Models - Hugging Face:未找到描述

- execve() 应该在 Windows 上对 #! 进行 polyfill · Issue #1010 · jart/cosmopolitan:复制自 bellard/quickjs#197:#!/bin/qjs console.log("Hello"); 当从 bash 作为脚本调用时不起作用:$ ./test.qjs ./test.qjs: line 2: syntax error near unexpected token `&...

- 入门 | 🦜️🔗 Langchain:LCEL 使得从基础组件构建复杂链变得容易,并且

- 贡献集成 | 🦜️🔗 Langchain:开始之前,请确保你已具备贡献代码指南中列出的所有依赖项。

- 何时使用 Outputparsers、tools 和/或 LangSmith Evaluators 来测试 LLM 输出? · langchain-ai/langchain · Discussion #19957:我正在为一个简单的任务开发一个简单的 LCEL 链,脑海中浮现了这个问题。想象一下我有一个包含 2 个 Prompt 和 2 个 Output Parser 的简单 LCEL 链,用于“强制”...

- GitHub - brianc/node-postgres: 适用于 node.js 的 PostgreSQL 客户端。:适用于 node.js 的 PostgreSQL 客户端。通过创建账户为 brianc/node-postgres 的开发做出贡献。

- GitHub - sequelize/sequelize 在 9e141880230a7f2a9a8c1e66a31f29fea7b5a65a 版本:适用于现代 Node.js 和 TypeScript 的功能丰富的 ORM,支持 PostgreSQL(支持 JSON 和 JSONB)、MySQL、MariaDB、SQLite、MS SQL Server、Snowflake、Oracle DB (v6)、DB2 以及 DB2 for IBM i。 - ...

- 全新的 Langserve Chat Playground 与 Agents | 编程演示:在这次技术深度解析中,我们将带你领略 LangChain 和 LangServe 框架的精彩世界。在 17 分钟内,我们将为你呈现一个全面的...

- WIP: 如果 APIrouters 相互嵌套,则从正确的路由提供 playground,由 StreetLamb 提交 · Pull Request #580 · langchain-ai/langserve:更新 playground 测试,以检查 index.html 中正确的 playground 资源路径。#578

- Galaxy AI - Swagger UI:未找到描述

- CallStar:与角色和名人的 AI 语音通话

- AllMind AI:未找到描述

- AllMind AI - 产品信息、最新更新和 2024 年评论 | Product Hunt:AllMind AI 是一款专为金融分析和研究设计的新型大语言模型。该 LLM 通过为用户提供洞察和实时... 彻底改变了金融研究。

- Call Jesus:与耶稣进行真实的 AI 语音聊天

- CallPDF:通话任何 PDF - 真实的 AI 语音聊天

- CallTube:通话任何 YouTube 视频 - 真实的 AI 语音聊天

- Call Website:通话任何网站 - 真实的 AI 语音聊天

- Call Hacker News:Hacker News 的 AI 语音界面

- CallStar - 与角色、YouTube 视频和 PDF 进行真实的 AI 语音通话 | Product Hunt:下一代 AI 语音通话!与名人聊天,通过语音理解你的文档,并探索灵性。使用一流的 AI 语音让 AI 对话感觉真实且个性化。通话 PDF、YouTube...

- Reddit - 深入了解任何事物:未找到描述

- 未找到标题:未找到描述

- LASP/lasp/lightning_attention.py at main · OpenNLPLab/LASP:Linear Attention Sequence Parallelism (LASP)。通过在 GitHub 上创建账号来为 OpenNLPLab/LASP 的开发做出贡献。

- GitHub - astramind-ai/BitMat: An efficent implementation of the method proposed in "The Era of 1-bit LLMs":"The Era of 1-bit LLMs" 中所提方法的高效实现 - astramind-ai/BitMat

- mobiuslabsgmbh/Mixtral-8x7B-Instruct-v0.1-hf-attn-4bit-moe-3bit-metaoffload-HQQ · Hugging Face: 未找到描述

- pytorch/aten/src/ATen/native/cuda/int4mm.cu at main · pytorch/pytorch: Python 中具有强 GPU 加速的 Tensors 和动态神经网络 - pytorch/pytorch

- GitHub - meta-llama/llama: Inference code for Llama models: Llama 模型的推理代码。通过在 GitHub 上创建账号,为 meta-llama/llama 的开发做出贡献。

- - Your AI Product Needs Evals:如何构建特定领域的 LLM 评估系统。

- Support for the web search connector · Issue #2 · simonw/llm-command-r:如果你在 API 调用中添加这个:diff --git a/llm_command_r.py b/llm_command_r.py index 7a334cd..e49c599 100644 --- a/llm_command_r.py +++ b/llm_command_r.py @@ -43,6 +43,8 @@ class CohereMessages(...

- cstr/wmt21-dense-24-wide-en-x-st · Hugging Face:未找到描述

- Hugging Face – 构建未来的 AI 社区。:未找到描述

- GitHub - CrispStrobe/llm_translation:通过在 GitHub 上创建账号来为 CrispStrobe/llm_translation 的开发做出贡献。