ainews-evals-the-next-generation

**评测:下一代** (或者:**评估:下一代**)

以下是为您翻译的中文内容:

Scale AI 指出了 MMLU 和 GSM8K 等基准测试中的数据污染问题,并提出了一个新的基准测试,在该测试中 Mistral 表现出过拟合,而 Phi-3 表现良好。Reka 发布了针对多模态模型的 VibeEval 基准测试,旨在解决多选题基准测试的局限性。OpenAI 的 Sam Altman 称 GPT-4 “很笨”,并暗示具备 AI 智能体(agents)能力的 GPT-5 将是一个重大突破。研究人员通过微调(fine-tuning)实现了对 GPT-3.5 的越狱。全球范围内出现了禁止 AI 武器的呼声,美国官员敦促对核武器保持人类控制。乌克兰推出了 AI 领事化身,同时 Moderna 与 OpenAI 合作推动医疗 AI 的进步。Sanctuary AI 与微软在通用机器人 AI 领域展开合作。麻省理工学院(MIT)推出了 Kolmogorov-Arnold 网络(KANs),提高了神经网络的效率。Meta AI 正在训练参数量超过 4000 亿的 Llama 3 模型,该模型将具备多模态能力和更长的上下文窗口。

AI News (2024/5/1-2024/5/2)。我们为您检查了 7 个 subreddits、373 个 Twitter 账号 以及 28 个 Discord 服务器(418 个频道,5582 条消息)。为您节省的预计阅读时间(以 200wpm 计算):588 分钟。

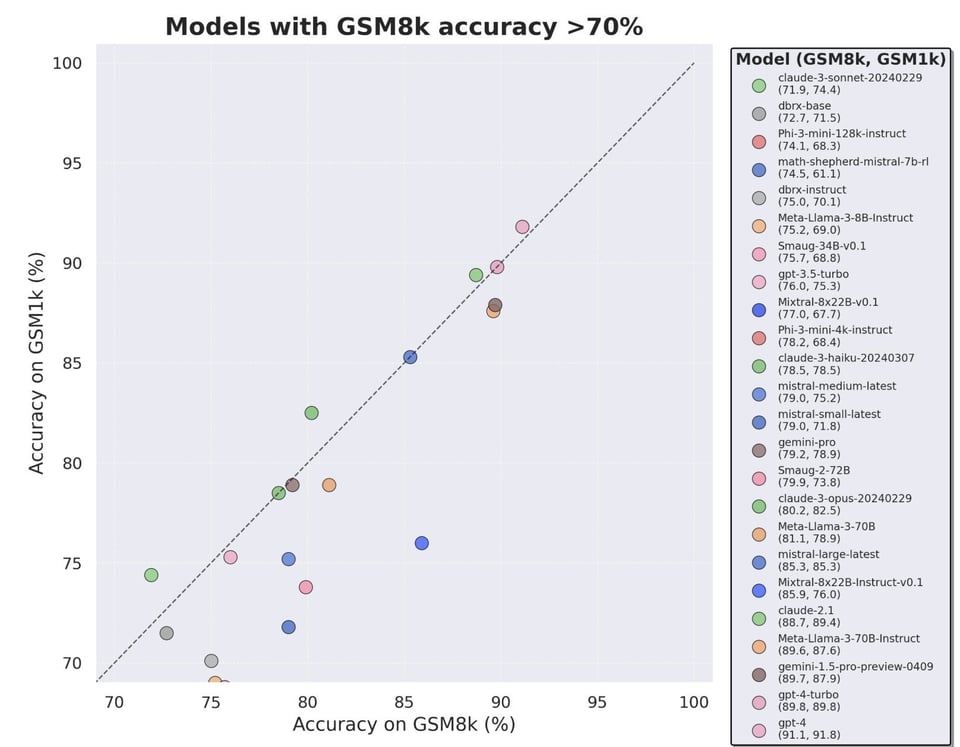

数据/基准测试(benchmark)污染问题通常被当作一个笑话,但今年正达到一个临界点,人们对以往在 MMLU 和 GSM8K 等知名学术基准测试上自报分数的做法信任度正在下降。Scale AI 发布了 《对大语言模型在小学算术表现的仔细检查》,提出了一种类似 GSM8K 但污染较少的新基准测试,并绘制了偏差图——Mistral 似乎在 GSM8K 上有明显的过拟合(overfit),而 Phi-3 表现得非常出色:

Reka 也为其擅长的多模态模型发布了新的 VibeEval 基准测试。他们解决了广为人知的 MMLU/MMMU 问题,即多选题基准测试对于 chat models 来说并不是一个良好或稳定的衡量标准。

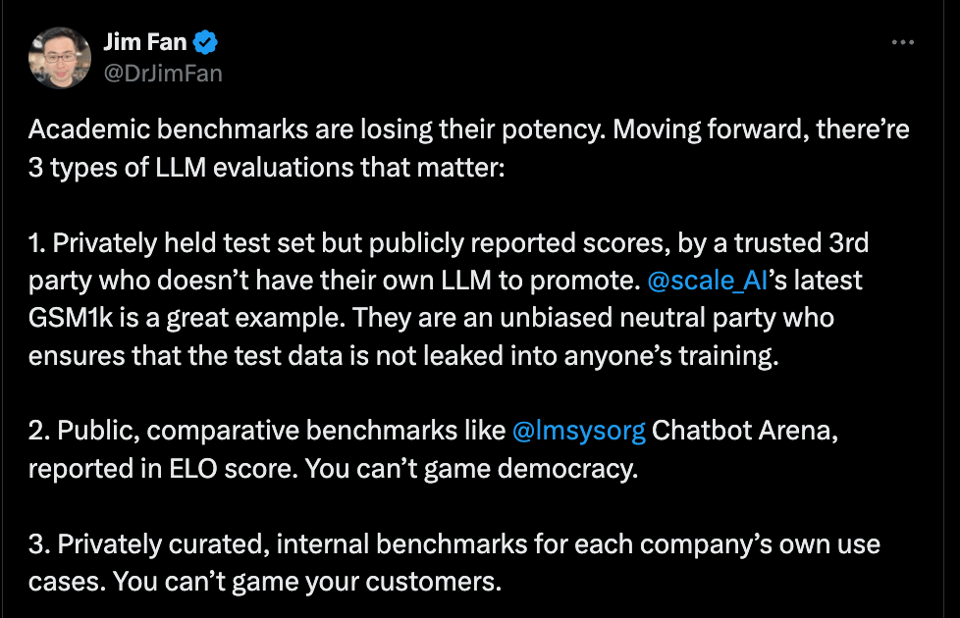

最后,我们将展示 Jim Fan 关于 evals 未来发展路径的思考:

目录

[TOC]

AI Reddit 回顾

涵盖 r/LocalLlama, r/machinelearning, r/openai, r/stablediffusion, r/ArtificialInteligence, /r/LLMDevs, /r/Singularity。评论抓取功能现已上线,但仍有很大改进空间!

AI 发展与能力

-

GPT-4 及其后续版本:在多次演讲和采访中,OpenAI CEO Sam Altman 称 GPT-4 “愚笨”且“令人尴尬”,暗示即将发布的 GPT-5 将有实质性提升。Altman 认为能够协助用户处理任务并访问个人信息的 AI Agent 将是下一个重大突破,并设想了一个了解用户生活方方面面的“超能同事”。

-

越狱 GPT-3.5:一位研究员展示了如何利用 OpenAI 的 fine-tuning API 越狱 GPT-3.5。通过在由无限制 LLM 生成的有害问答数据集上训练模型,从而绕过安全检查。

AI 监管与安全

-

呼吁禁止 AI 武器:世界各国领导人正呼吁禁止 AI 驱动的武器和“杀人机器人”,将当前 AI 发展的时刻比作原子弹的“奥本海默时刻”。然而,一些人认为此类禁令将难以执行。

-

人类对核武器的控制:一名美国官员正敦促中国和俄罗斯声明只有人类(而非 AI)才能控制核武器,这凸显了人们对 AI 控制的武器系统日益增长的担忧。

AI 应用与合作伙伴关系

-

乌克兰的 AI 领事化身:乌克兰外交部宣布推出一款 AI 驱动的化身,用于提供领事事务更新,旨在为该机构节省时间和资源。

-

Moderna 与 OpenAI 的合作伙伴关系:Moderna 与 OpenAI 达成合作,旨在利用 AI 加速挽救生命的疗法开发,这具有彻底改变医学的潜力。

-

Sanctuary AI 与 Microsoft 的合作:Sanctuary AI 与 Microsoft 正在合作,以加速通用机器人 AI 的开发,旨在创造更通用、更智能的机器。

AI 研究与进展

-

Kolmogorov-Arnold 网络:MIT 研究人员开发了“Kolmogorov-Arnold 网络” (KANs),这是一种新型神经网络,在边(edges)而非节点(nodes)上具有可学习的激活函数。与传统的 MLP 相比,它展现出了更高的准确性、参数效率和可解释性。

-

Meta 的 Llama 3 模型:Meta 正在训练参数量超过 4000 亿的 Llama 3 模型,预计将支持多模态、拥有更长的上下文长度,并可能在不同领域具备专业能力。

-

mRNA 癌症疫苗突破:一种使用“洋葱状”多层 RNA 脂质颗粒聚集体的新型 mRNA 癌症疫苗技术,已在四名人类患者的脑癌治疗中取得成功。

-

首个先导编辑疗法:FDA 已批准 Prime Medicine 关于首个先导编辑(prime editing)疗法的 IND(新药临床试验申请)。这是一种新型基因编辑技术,具有比现有方法更精确地治疗遗传性疾病的潜力。

-

AI 驱动的动物长寿研究:Olden Labs 推出了 AI 驱动的智能笼子,可自动进行动物长寿研究,旨在提供低成本、数据丰富的研究,同时改善动物福利。

梗图与幽默

- 监管 AI 的梗图:一张幽默的图片描绘了一个人试图通过用皮带物理束缚机器人来监管 AI,调侃了 AI 治理面临的挑战。

AI Twitter 回顾

所有回顾均由 Claude 3 Opus 完成,从 4 次运行中选取最佳结果。我们正在尝试使用 Haiku 进行聚类和流程工程(flow engineering)。

太空中的 LLM 与高效推理

- 为太空环境加固 LLM:@karpathy 提议对 LLM 代码进行加固以通过 NASA 标准,使其能够在太空安全运行。LLM 非常适合此类场景,因为它们具有固定的浮点数数组以及有界的、定义良好的动力学特征。将 LLM 权重发送到太空可以让它们“唤醒”并与外星人互动。

- 使用 Groq 进行高效推理:@awnihannun 强调 @GroqInc 在降低高质量 LLM 的 $/token 成本方面处于领先地位。@virattt 发现 Llama-3 70B 在 @GroqInc 上的基准测试中拥有最佳的性能和价格比。@svpino 鼓励尝试使用 Groq 来体验极高的模型速度。

- 4-bit 量化:@awnihannun 计算出在 M2 Ultra 上运行 4-bit 70B Llama-3 的成本为 $0.2/百万 tokens,功耗为 60W。@teortaxesTex 展示了“外部大脑”的量化水平。

评估与改进 LLM

- 评估 LLM:@DrJimFan 提出了 3 种评估类型:由 @scale_AI 等受信任第三方提供公开评分的私有测试集;像 @lmsysorg Chatbot Arena ELO 这样的公开对比基准测试;以及针对每个公司特定用例的私有内部基准测试。

- GSM1K 基准测试:@alexandr_wang 和 @scale_AI 推出了 GSM1K,这是一个新的测试集,显示 LLM 的准确率下降高达 13%,其中 Phi 和 Mistral 存在过拟合现象。@SebastienBubeck 指出 phi-3-mini 76.3% 的准确率对于一个 3.8B 模型来说非常出色。

- 多模态模型中的逆缩放 (Inverse Scaling):@YiTayML 观察到逆缩放在多模态模型中比纯文本模型更显著,即较小的模型表现优于较大的模型。目前这仍属于轶事观察。

- 评估推理能力:@omarsar0 分享了一篇关于解释 Transformer LM 在推理任务中内部运作机制的论文。

开源模型与框架

- Reka 发布评估集:@RekaAILabs 发布了名为 Vibe-Eval 的内部评估子集,这是一个包含 269 个图文提示词的开放基准测试,用于衡量多模态对话的进展。超过 50% 的提示词目前尚无模型能够解决。

- LlamaIndex Typescript 发布:@llama_index 发布了 LlamaIndex.TS v0.3,包含 Agent 支持、Web 流、类型定义以及针对 Next.js、Deno、Cloudflare 等的部署增强。

新兴模型与技术

- 来自 AI21 的 Jamba Instruct:@AI21Labs 发布了基于 SSM-Transformer Jamba 架构的 Jamba-Instruct。它在质量基准测试中领先,拥有 256K 上下文窗口,且价格极具竞争力。

- Nvidia 的 Llama 微调:@rohanpaul_ai 注意到 Nvidia 推出了名为 ChatQA-1.5 的 Llama-3 70B 微调模型,具有良好的基准测试表现。

- Kolmogorov-Arnold Networks (KANs):@hardmaru 分享了一篇关于 KANs 的论文,将其作为 MLPs 的替代方案用于逼近非线性函数。@rohanpaul_ai 解释说 KANs 使用的是可学习的样条激活函数,而 MLPs 中则是固定的。

- Meta 的多 Token 预测 (Multi-Token Prediction):@rohanpaul_ai 详细解析了 Meta 的多 Token 预测技术,该技术通过训练 LM 预测未来多个 Token,从而实现更高的样本效率和高达 3 倍的推理加速。

行业动态

- Anthropic 的 Claude iOS 应用:@AnthropicAI 发布了 Claude iOS 应用,将“前沿智能”装进你的口袋。@alexalbert__ 分享了它如何助力工具使用(tool use)功能的发布。

- Lamini AI 获 2500 万美元 A 轮融资:@realSharonZhou 宣布 @LaminiAI 获得 2500 万美元 A 轮融资,以帮助企业开发内部 AI 能力。投资者包括 @AndrewYNg, @karpathy, @saranormous 等。

- Google I/O 5 月 14 日举行:@GoogleDeepMind 宣布 Google I/O 开发者大会将于 5 月 14 日举行,重点展示 AI 创新与突破。

- Anthropic 推出 Claude 团队计划:@AnthropicAI 为 Claude 发布了全新的团队(Team)计划,包含更高的使用额度、用户管理、计费功能以及 200K 上下文窗口。

迷因与幽默

- 迷因:@DeepLearningAI 分享了一个来自 Reddit 上的 buildooors 关于 AI 的迷因。

AI Discord 回顾

摘要之摘要的摘要

- 模型进展与微调:

- 将 Llama 3 的 LoRA rank 提高到 128,以优先考虑理解而非记忆,增加了超过 3.35 亿个可训练参数 [Tweet]

- 探索 Unsloth 的多 GPU 支持用于模型训练,目前仅限于单 GPU [GitHub Wiki]

- 发布 Llama-3 8B Instruct Gradient,通过 RoPE theta 调整来处理更长的上下文 [HuggingFace]

- 推出基于 Llama-3 架构的 Hermes 2 Pro,在 AGIEval 等基准测试中表现优于 Llama-3 8B [HuggingFace]

- 硬件优化与部署:

- 讨论 LLM 的最佳 GPU 选择,考虑 PCIe 带宽、VRAM 需求(理想情况下 24GB+)以及多 GPU 性能

- 探索本地部署选项(如针对小型 LLM 的 RTX 4080)与云端解决方案在隐私方面的权衡

- 通过合并数据集而不增加上下文长度等技术,优化训练期间的 VRAM 占用

- 将 DeepSpeed 的 ZeRO-3 与 Flash Attention 集成,以实现高效的大模型微调

- 多模态 AI 与计算机视觉:

- 新型神经网络架构:

- 其他:

-

Stable Diffusion 模型讨论与 PC 配置:Stability.ai 社区分享了对各种 Stable Diffusion 模型(如来自 HuggingFace 的 ‘4xNMKD-Siax_200k’)的见解,并讨论了用于 AI 艺术生成的最佳 PC 组件(如 4070 RTX GPU)。他们还探索了 AI 在 Logo 设计中的应用,使用了 harrlogos-xl 等模型。

-

LLaMA 上下文扩展技术:在多个社区中,工程师们讨论了扩展 LLaMA 模型上下文窗口的方法,例如使用 PoSE 训练方法实现 32k 上下文或调整 rope theta。提到了使用 RULER 工具 来识别长上下文模型中的实际上下文大小。

-

量化与微调讨论:LLM 的 Quantization 是一个热门话题,Unsloth AI 社区将 Llama 3 上的 LoRA rank 从 16 增加到 128,以优先考虑理解而非记忆。OpenAccess AI Collective 推出了 Llama-3 8B Instruct Gradient,通过 RoPE theta 调整实现在长上下文上的极简训练 (Llama-3 8B Gradient)。

-

检索增强生成 (RAG) 技术:多个社区探索了增强 LLM 的 RAG 技术。分享了一个关于 RAG 基础的新教程系列 (YouTube tutorial),并讨论了一篇关于 Adaptive RAG 的论文,该技术可根据查询复杂度动态选择最佳策略 (YouTube overview)。此外,还重点介绍了 Plaban Nayak 关于使用 reranker 进行后处理以提高 RAG 准确性的指南。

-

引入新模型与架构:发布了多种新模型和架构,例如 Nous Research 基于 Llama-3 构建的 Hermes 2 Pro (Hermes 2 Pro),OpenRouter 的 Snowflake Arctic 480B 和 FireLLaVA 13B,以及作为 MLP 替代方案的 Kolmogorov-Arnold Networks (KANs) (KANs paper)。

PART 1: Discord 高层摘要

CUDA MODE Discord

CUDA 调试技巧与更新:成员们交流了 CUDA 调试的心得,推荐了诸如详细的 Triton 调试讲座 等资源,并强调了使用最新版本 Triton 的重要性,提到了解释器中最近的 bug 修复。

CUDA Profiling 的烦恼与智慧:工程师们努力应对不一致的 CUDA profiling 结果,建议使用 NVIDIA 的分析工具如 Nsight Compute/Systems,而不是 cudaEventRecord。分享了一个针对 NVIDIA 的 tinygrad patch,旨在帮助类似的故障排除工作。

Torch 与 PyTorch 实力:讨论中提到需要 PyTorch 内部机制(特别是 ATen/linalg)方面的专业知识,同时为 TorchInductor 爱好者指引了学习资源(虽未具体说明)。并向所有 PyTorch contributors 征集深入的平台知识。

AI 模型训练构建的进展:#llmdotc 频道的对话显示了大量围绕模型训练的活动。从 FP32 master copy of params 到 CUDA Graphs,讨论涵盖了与性能、精度和复杂度相关的一系列技术挑战,并附带了指向各种 GitHub issue 和 pull request 的链接,以便协作解决问题。

深入探讨工程稀疏性:工程师们思考了 Effort Engine,辩论了其 benchmark 表现以及速度与质量之间的平衡。思考的重点包括参数重要性优于精度、权重剪枝(weight pruning)中的质量权衡以及潜在的模型改进。

AMD 与 Intel 技术的前瞻性思考:大家对 AMD 的 HIP 语言 表现出极大的热情,并分享了 AMD ROCm 平台 的教程播放列表,表明对 GPU 多样化编程语言的兴趣日益浓厚。此外,提到 Intel 加入 PyTorch 网页,暗示了向跨不同架构的更广泛支持迈进。

LM Studio Discord

CLI 的新前沿:LM Studio 0.2.22 的发布引入了全新的命令行界面 lms,实现了 加载/卸载 LLMs 以及 启动/停止本地服务器 等功能,开发工作已在 GitHub 上开放贡献。

解决 LLM 安装混乱:社区讨论强调了 LM Studio 0.2.22 Preview 的安装问题,这些问题通过提供修正后的下载链接得到了解决;同时,用户就模型性能优化和量化技术交换了意见,特别是针对 Llama 3 model。

无头运行(Headless Operation)创新:成员们分享了在没有图形用户界面的系统上无头运行 LM Studio 的策略,建议使用 xvfb 和其他变通方法,为 Docker 等容器化可能性铺平了道路。

ROCm 与 AMD 备受关注:对话集中在不同 AMD GPUs 与 ROCm 的兼容性,以及 ROCm 在 Linux 支持方面的挑战,突显了社区对高效利用多样化硬件基础设施的追求。

硬件讨论深入展开:讨论深入探讨了硬件选择的细节,特别是适合运行 LLMs 的 GPU,以及 PCIe 3.0 vs 4.0 对多 GPU VRAM 性能的影响,最终达成共识:对于像 Meta Llama 3 70B 这样强大的模型,至少 24GB VRAM 是理想的选择。

Stability.ai (Stable Diffusion) Discord

-

Stable Diffusion 迎来升级:讨论集中在最新的 Stable Diffusion 模型上,如 ‘Juggernaut X’ 和 ‘4xNMKD-Siax_200k’,许多用户从 HuggingFace 获取 4xNMKD-Siax_200k 模型。

-

针对 AI 工作负载的 PC 组装建议:社区成员就最适合 AI 艺术创作的 PC 组件交换了建议,强调了即将推出的 Nvidia 5000 series 以及当前高性能的 4070 RTX GPU 在高效运行模型方面的潜在优势。

-

AI 进入设计领域:围绕使用 AI 进行 Logo 设计展开了深入对话,重点提到了 harrlogos-xl,该模型专注于在 Stable Diffusion 中生成自定义文本,并触及了法律影响。

-

提升现实感的放大(Upscaling)与重绘(Inpainting)技巧:对话包括了通过放大技术 LDSR 获得更高图像质量的技巧,并分享了一个 Reddit 指南,关于如何将任何模型重新利用于重绘,尽管用户的成功程度各不相同。

-

使用开源解决方案保障数字艺术创作安全:在推动更好安全性的过程中,一些成员推荐了开源替代方案,如 Android 端的 Aegis 和 iOS 端的 Raivo 用于 一次性密码 (OTP),并指出设备同步和安全备份选项等功能的重要性。

Unsloth AI (Daniel Han) Discord

-

LoRA 助力 Llama 3 升级:工程师们一直将 Llama 3 的 LoRA rank 从 16 提升至 128,使可训练参数量突破 3.35 亿,旨在优先提升模型的理解能力而非死记硬背。

-

VRAM 与训练动态:澄清了模型训练中的 VRAM 使用 情况;合并数据集会影响训练时间,但除非增加了 context length,否则不会影响 VRAM。在 Raspberry Pi 上运行 Phi3 被认为是可行的,并且已有在 Orange Pi Zero 3 上成功运行 Gemma 2b 的案例。

-

浏览器运行 Phi3:一篇 Twitter 帖子 展示了在浏览器中运行的 Phi 3,引发了成员们的兴趣。同时,Phi3 Mini 4k 在 Open LLM Leaderboard 上的表现被指出优于 128k 版本。

-

Fine-Tuning 技巧:使用 Unsloth 对 Llama 3 进行 Fine-Tuning 时,在 DPOTrainer 中不需要 ref_model;社区强调了 Fine-Tuning 技术和协作,并成功为 Discord 机器人部署了 llama.cpp。

-

协作编程号召:成员们一致要求设立专门的协作频道,随后创建了 <#1235610265706565692> 用于项目协作。为对检索增强 LLM(RAG)感兴趣的成员分享了 FlagEmbedding 仓库。

-

提升 AI 推理能力:为了增强任务表现,一个 AI 模型被强制记忆了来自 Self-Discover 论文 的 39 个推理模块,将高级推理水平整合到任务中。

Nous Research AI Discord

-

Hermes 2 Pro:新型模型冠军:Nous Research 推出了基于 Llama-3 架构 的 Hermes 2 Pro,与 Llama-3 8B Instruct 相比,它在 AGIEval 和 TruthfulQA 等基准测试中表现出更优越的性能。其独特功能包括 Function Calling 和 Structured Output 能力,并提供标准版和量化 GGUF 版本以提高效率,可在 Hugging Face 上获取。

-

探索 Context Length 的前沿:研究讨论揭示了通过归一化离群值来解决长序列上下文的 Out-of-distribution (OOD) 问题的策略,同时 arXiv:2401.01325 被认为对扩展 context length 具有重要影响。来自

llama.cpp的技术强调了归一化方法,并就截断注意力(truncated attention)对真正实现“无限”上下文的有效性展开了辩论。 -

AI 辅助 Unreal 开发与 LLM 咨询:宣布在 neuralgameworks.com 部署用于 Unreal Engine 5 的 AI 助手,该组织还探讨了在 UE5 开发中集成 GPT-4 vision 的方案。此外,还讨论了 AI 研究的计算资源问题(如 A100 GPUs 的获取),以及模型训练的工具和技术,例如 Kolmogorov Arnold neural network 在 CIFAR-10 上的表现。

-

AI 编排与 Prompt 结构化见解:共享的编排框架 MeeseeksAI 在 AI Agent 中引起了轰动,同时关于 Prompt 结构化的知识库也在不断增长,包括使用特殊 token 的见解以及生成特定输出格式的指导。Hermes 2 Pro 处理 JSON 输出的方法展示了结构化 Prompt 的优势,详情见 Hugging Face。

-

AI 社区的挖掘与网络构建:LLM 的潜在 Fine-Tuning 者正在寻求合适数据集的建议,而 WebSim 引入的跨越时代的扩展游戏有望带来可能重塑游戏体验的更新。对 world-sim 等测试环境的期待以及持续的讨论表明,社区对协作开发和共享研究追求充满热情。

Perplexity AI Discord

-

技术圈内 Opus 相比 GPT-4 引起热议:Perplexity AI 上的技术讨论对比了 Claude Opus 和 GPT-4,指出在维持对话连贯性方面更倾向于 Opus,而在技术准确性方面则更看好 GPT-4,尽管 Opus 目前有每天 50 次的使用限制。

-

新的 Pages 功能激发创意火花:Perplexity AI 社区对新的 Pages 功能充满热情,讨论了其将 Thread 转化为格式化文章的潜力,并希望未来能增强包括图像嵌入在内的功能。

-

AI 内容辅助成为热门话题:从关于无人机挑战的辩论到 AI 在食物选择中的效用,用户分享了 Perplexity AI 的见解链接,其中关于生意大利面正确食用方法、DJI 无人机以及 Binance 创始人的法律困境的讨论尤为显著,显示出广泛的兴趣。

-

弥合 UI 与 API 之间的鸿沟:pplx-7b-online 模型在 Pro UI 和 API 实现之间产生了不同的结果,促使用户寻求对“在线模型”的理解,并庆祝 Sonar Large 模型加入 API,尽管对其参数数量存在一些实质性的困惑。

-

成员寻求平台小故障的解决方案:用户在 Safari 和 Brave 等浏览器上遇到了 Perplexity AI 的 Bug,以及从附件中正确引用内容的问题,导致了故障排除方法的分享和对修复方案的集体期待。

注意:有关 API 产品和 Sonar Large 等模型的详细及最新更新,请查看官方文档。

Eleuther Discord

-

二进制大脑在无监督学习中击败 CNN:关于图像块二进制向量表示的革命性研究表明,与受监督的 CNNs 相比,其效率更高。受生物神经系统启发,讨论重点介绍了二进制向量的排斥力损失函数(repulsive force loss function),这可能模仿了神经元的效率,详见 arXiv。

-

KANs 作为 MLP 竞争对手登场:AI 社区正在热议 Kolmogorov-Arnold Networks (KANs),它可能在可解释性方面比 MLPs 有所改进。对话还涉及了 LLMs 中的模式崩溃(mode collapse)和 Universal Physics Transformers 的前景,并对 GLUE 测试服务器的异常进行了批评,以及对 SwiGLU 独特缩放特性的思考 (KANs paper, Physics paper)。

-

解释不可解释之物:一场严谨的对话探讨了阐明模型“真实底层特征”的困难、Tied Embeddings 在预测模型中的作用,以及 Next-token Prediction 中计算的定义。社区庆祝了学术论文的被接收,以及 Mechanistic Interpretability Workshop at ICML 2024 的启动,并鼓励社区成员投稿 (workshop website)。

-

MT-Bench:集成期望日益高涨:出现了一个关于将 MT-Bench 整合到 lm-evaluation-harness 中的重要请求,暗示了对更严谨的对话式 AI 基准测试的渴望。

OpenRouter (Alex Atallah) Discord

-

推出 Snowflake Arctic 与 FireLLaVA:OpenRouter 发布了两款具有颠覆性的模型:Snowflake Arctic 480B,在编程和多语言任务中表现出色,价格为 $2.16/M tokens;以及 FireLLaVA 13B,这是一款快速的开源多模态模型,成本为 $0.2/M tokens。这两款模型在语言和图像处理方面都取得了重大进展;Arctic 结合了稠密和 MoE Transformer 架构,而 FireLLaVA 专为速度和多模态理解而设计,详见其 发布公告。

-

通过负载均衡实现性能最大化:为了应对高流量需求,OpenRouter 推出了增强的负载均衡功能,现在允许提供商在 活动页面 上追踪性能统计数据,如延迟和完成原因(completion reasons)。

-

揭秘 LLaMA 上下文扩展策略:工程师们研究了扩展 LLaMA 上下文窗口的策略,重点介绍了使用 8 张 A100 GPU 实现 32k 上下文的 PoSE 训练方法,以及 rope theta 的调整。讨论还涉及了 RULER,这是一个用于识别长上下文模型中实际上下文大小的工具,可以在 GitHub 上进一步探索。

-

Google Gemini Pro 1.5 的 NSFW 处理受到质疑:社区对 Google Gemini Pro 1.5 突然削减 NSFW 内容表示批评,并指出更新后发生了重大变化,似乎削弱了模型遵循指令的能力。

-

AI 部署风险与企业影响力探讨:辩论深入探讨了“正交化(orthogonalized)”模型的部署、未对齐 AI 的影响,以及模型创建者注入其 AI 的政治倾向。此外,还对企业的预算分配进行了批判性反思,以 Google 的 Gemini 项目为例,对比了营销支出与研发支出。

OpenAI Discord

-

音乐描述符与 DALL-E 进展备受关注:工程师们正在寻找一种描述音乐曲目的工具,而其他人则更新称 DALL-E 3 正在改进中,目前尚未宣布 DALL-E 4。一位中学教师称赞 Claude iOS 应用的回答极具人性化,随后引发了关于在教育中使用 AI 的讨论。

-

Chatbot 基准测试引发讨论:关于基准测试(benchmarks)在衡量 Chatbot 能力方面的效用展开了激烈的辩论,揭示了两种观点的分歧:一方认为基准测试是有益的衡量指标,另一方则认为它们无法准确反映细微的现实世界使用情况。

-

ChatGPT Plus:Token 充足但限制较多:用户交流了关于 ChatGPT token 限制的见解;澄清了 ChatGPT Plus 具有 32k token 限制,尽管实际的 GPT 通过 API 支持高达 128k。尽管有参与者体验过发送超过所谓 13k 字符限制的文本,但仍建议对 ChatGPT 关于其架构或限制的自我引用式回答保持怀疑。

-

Prompt Engineering:是天才之举还是幻觉?:社区讨论了 Prompt Engineering,涉及了带有负面示例的 few-shot prompting 和 meta-prompting 等策略。还讨论了利用个人品牌从社交媒体分析中提取理想客户画像 (ICP),并分享了使用 GPT-4-Vision 结合 OCR 作为从文档中提取信息的方法。

-

LLM 召回率:仍有改进空间:对话集中在增强长效记忆(Long-Lived Memory, LLM)的召回率上;成员们考虑了上下文窗口限制如何影响 ChatGPT Plus 等平台,并思考了将 GPT-4-Vision 与 OCR 结合以实现更好的数据提取,同时承认从大量文本中检索数据仍面临挑战。

HuggingFace Discord

-

Fashionable AI Pondering:社区成员讨论了寻找一种能够处理图像,在保持 Logo 位置的同时让小孩以多种姿势穿着衬衫的 AI 方案。虽然探讨了现有 AI 解决方案的潜力,但未指向具体工具。

-

Community Constructs Visionary Course:一个新启动的、由社区开发的 计算机视觉课程 已在 GitHub 上开放贡献,并受到了热烈欢迎,旨在丰富计算机视觉领域的专业知识。

-

SDXL Inference Acceleration with PyTorch 2:一篇 Hugging Face 教程 展示了如何利用 PyTorch 2 的优化,将 Stable Diffusion XL 等文本到图像扩散模型的推理时间缩短高达 3 倍。

-

Google Unleashes Multimodal GenAI in Medicine:谷歌专为医疗应用量身定制的多模态 GenAI 模型 Med-Gemini 在一段 YouTube 视频 中被重点介绍,旨在提高人们对该模型能力和应用的认识。

-

PyTorch Lightning Shines on Object Detection:一位成员寻求用于目标检测评估和可视化的 PyTorch Lightning 示例,随后社区分享了关于 PyTorch Lightning 与 SegFormer, Detectron, YOLOv5 以及 YOLOv8 集成的全面教程。

-

RARR Clarification Sought in NLP:有人对 RARR 流程提出了疑问,这是一种调查和修正语言模型输出的方法,尽管社区内关于其实现的进一步讨论似乎有限。

LlamaIndex Discord

LlamaIndex 0.3 Heralds Enhanced Interoperability:LlamaIndex.TS 的 0.3 版本引入了对 ReAct、Anthropic 和 OpenAI 的 Agent 支持,一个通用的 AgentRunner class,标准化的 Web Streams,以及在其 发布推文 中详述的增强类型系统。该更新还概述了与 React 19、Deno 和 Node 22 的兼容性。

AI Engineers, RAG Tutorial Awaits:由 @nerdai 制作的全新 Retrieval-Augmented Generation (RAG) 教程系列正在推进,内容涵盖从基础到长文本 RAG 的管理,并配有 YouTube 教程 和 GitHub notebook。

Llamacpp Faces Parallel Dilemmas:在 Llamacpp 中,由于 CPU 服务器缺乏 continuous batching 支持,用户对处理并行查询时出现的死锁表示担忧。顺序请求处理被视为一种潜在的变通方法。

Word Loom Proposes Language Exchange Framework:Word Loom 规范被提议用于将代码与自然语言分离,从而增强可组合性和机械对比,旨在实现全球化友好,详见 Word Loom 更新提案。

Strategies for Smarter AI Deployments:讨论强调了 RTX 4080 的 16 GB VRAM 对于小型 LLM 运行已经足够,而隐私担忧促使一些用户在微调语言模型时,从 Google Colab 等云端替代方案转向本地计算站。此外,将外部 API 与 QueryPipeline 集成,以及使用 reranker 进行后处理以提高 RAG 应用准确性的技术,也成为了战略考量。

Modular (Mojo 🔥) Discord

Mojo 周年纪念成为讨论焦点:Mojo Bot 社区庆祝了一周年纪念,并推测明天将发布重大更新。社区成员深情回顾了 Mojo 取得的进展,特别是 traits、references 和 lifetimes 方面的增强。

Modular 更新受到欢迎:社区贡献塑造了最新的 Mojo 24.3 版本,其在 Ubuntu 24.04 等平台上的集成获得了积极评价。同时,MAX 24.3 正式发布,通过 Engine Extensibility API 展示了 AI pipeline 集成方面的进展,提升了开发者在管理低延迟、高吞吐量推理时的体验,详见 MAX Graph APIs 文档。

CHERI 架构可能成为安全领域的游戏规则改变者:根据对 YouTube 视频和 Colocation Tutorial 的讨论,CHERI 架构据称能将漏洞利用显著减少 70%。关于其采用的讨论暗示了改变操作系统开发、赋能 Unix 风格软件开发以及可能使传统安全方法过时的可能性。

语言设计与性能的演进:AI 工程师继续消化和讨论 Mojo 的语言设计目标,渴望实现类似于 Hylo 的 lifetimes 和 mutability 推断,并辩论 pointers 相对于 references 的优点与安全性。社区成员利用 Mojo 的 atomic operations 进行多核处理,实现了在 3.8 秒内处理 1 亿条记录。

教育内容提升 Mojo 和 MAX 的知名度:学习热情和对 Mojo 及 MAX 的推广显而易见,相关分享包括 Chris Lattner 讨论 Mojo 的视频(被称为“未来的高性能 Python”),以及一场推广 Python 与 MAX 平台协同作用的 PyCon Lithuania 演讲。

OpenInterpreter Discord

弥合 AI Vtuber 的差距:现在有两个 AI Vtuber 资源可用,其中一个套件只需少量凭据即可在 GitHub - nike-ChatVRM 上完成设置,正如 Twitter 上所宣布的那样。另一个资源提供离线且无审查的体验,并附带 YouTube 演示和 GitHub - VtuberAI 上的源代码。

Whisper RKNN 用户获得速度提升:现在提供了一个 Git 分支,可为搭载 Rockchip RK3588 的 SBC 上的 Whisper RKNN 提供高达 250% 的速度提升,访问地址为 GitHub - rbrisita/01 at rknn。

概述 Ngrok 域名自定义步骤:有人详细介绍了 ngrok 域名配置的过程,包括编辑 tunnel.py 和使用特定的命令行添加项,参考资源见 ngrok Cloud Edge Domains。

解决 Ollama Bot 的独立运行问题:Ollama 出现了问题,表现出不等待用户提示的奇怪自主行为,但尚未提供具体的解决步骤。

对 OpenInterpreter 的期待:社区在推测 OpenInterpreter app 的发布时间表、多模态能力的无缝集成,并分享了关于各种技术方面的社区驱动援助。讨论中强调了诸如在 Windows OS 模式兼容性中使用 GPT-4 配合 --os 标志等解决方案,以及合作精神。

Latent Space Discord

-

Mamba 成为焦点:对 Mamba 模型的兴趣随着一次 Zoom 会议和一份详尽的 Mamba Deep Dive 文档的发布而达到顶峰,引发了关于 Mamba 中作为召回测试的选择性复制(selective copying)以及 finetuning 过程中潜在过拟合问题的讨论。

-

Chunking 中的语义精度:参与者讨论了高级文本 chunking 方法,重点关注作为文档处理技术的语义 chunking。这包括提到了一些实用资源,如 LlamaIndex 的 Semantic Chunker 和 LangChain。

-

本地 LLMs?有专门的 App:工程师们辩论了在 MacBook 上运行 LLM 的问题,重点介绍了用于本地操作的工具和应用,如 Llama3-8B-q8,并对效率和性能表现出浓厚兴趣。

-

AI Town 在 MacBook 上运行 300 个 Agents:展示了一个令人兴奋的项目 带有世界编辑器的 AI Town,描绘了 300 个 AI agents 在 MacBook M1 Max 64G 上流畅运行的场景,被比作微缩版的《西部世界》(Westworld)。

-

OpenAI 的网页困扰?:对 OpenAI 网站重新设计的反馈引发了关于用户体验问题的讨论,工程师们注意到 新 OpenAI 平台上的性能滞后和视觉故障。

OpenAccess AI Collective (axolotl) Discord

是否该屏蔽 Instruct Tags?:工程师们讨论了在训练期间屏蔽 instruct tags 以增强 ChatML 性能,使用 自定义 ChatML 格式,并考虑了其对模型生成的影响。

Llama-3 跃升至 8B:Llama-3 8B Instruct Gradient 现已发布,其特点是进行了 RoPE theta 调整以改进上下文长度处理,并在 Llama-3 8B Gradient 讨论了其实现和局限性。

Axolotl 开发者修复预处理痛点:提交了一个 pull request 以解决 Orpo trainer 以及 TRL Trainer 中的单线程(single-worker)问题,允许通过多线程加速预处理,记录在 GitHub 上的 PR #1583 中。

Python 3.10 奠定基础:社区内设定了新的基准,Python 3.10 现在是使用 Axolotl 进行开发的最低版本要求,从而能够使用最新的语言特性。

使用 ZeRO-3 优化训练:讨论围绕集成 DeepSpeed 的 ZeRO-3 和 Flash Attention 进行 finetuning 以加速训练展开,在适当部署时,ZeRO-3 可以在不影响质量的情况下优化内存。

LAION Discord

-

AI 在教育中的角色引发关注:一位成员强调了在教育中使用 AI 可能带来的依赖问题,认为过度依赖可能会阻碍学习关键的问题解决技能。

-

从静态帧到动态影像:介绍了 Motion-I2V 框架,该框架通过结合基于 Diffusion 的运动预测器和增强时间注意力(temporal attention)的两步过程将图像转换为视频,详情见此处的论文。

-

LLaMA3 表现可期,期待专业微调:讨论了 LLaMA3 在 4bit 量化后的性能,成员们对未来在特定领域的微调表示乐观,并期待 Meta 发布更多代码。

-

提高模型质量备受关注:有人请求关于改进 MagVit2 VQ-VAE 模型的建议,潜在的解决方案围绕集成新的 loss functions 展开。

-

编写音乐之声的代码:讨论了实现 SoundStream 编解码器时的技术困难,成员们合作解读了原始论文中省略的细节,并指向了资源和可能的含义。

-

项目时间线与进展讨论:社区参与了关于项目截止日期的讨论,非正式地使用了 “Soon TM” 等短语,并对 LAION 的 stockfish 数据集中使用的配置表示好奇。

-

探索创新网络架构:该频道触及了替代 MLP 的新型网络方案,即 Kolmogorov-Arnold Networks (KANs),其在研究论文中被强调具有更高的准确性和可解释性。

-

无需训练的高质量字幕生成:区分了 VisualFactChecker (VFC),这是一种无需训练即可生成准确视觉内容字幕的方法,及其对增强图像和 3D 物体字幕生成的影响,详见这篇论文。

AI Stack Devs (Yoko Li) Discord

- AI 在怀旧游戏中的魅力:讨论了利用 AI 复兴经典社交媒体游戏(以 Farmville 为例),并扩展到创建一个以 1950 年代为主题、包含共产主义间谍阴谋的 AI 小镇。

- Hexagen World 因锐利的 AI 图像而获得认可:用户称赞 Hexagen World 的高质量 Diffusion 模型输出,并讨论了其平台托管 AI 驱动游戏的潜力。

- AI 聊天中可能存在的 Tokenizer Bug:ai-town 中 ollama 和 llama3 8b 配置的技术问题导致了奇怪的消息和数字串,初步归因于 Tokenizer 故障。

- 游戏玩家用 Linux?一个可行的选择!:成员们讨论了从 Windows 转向 Linux 的话题,并分享了关于游戏兼容性的保证,例如 Stellaris 在 Mac 和 Linux 上运行顺畅,并建议设置 dual boot system。

- 探索 AI 动画的邀请:分享了一个 AI 动画服务器的 Discord 邀请,旨在吸引对 AI 与动画技术交叉领域感兴趣的人士。

LangChain AI Discord

Groq 无需等待:确认可以直接通过提供的 Groq 控制台链接 注册 Groq 的 AI 服务,消除了那些急于使用 Groq 功能的人对候补名单的担忧。

AI 偏离脚本的难题:正在寻求减轻 AI 在人机交互项目中偏离脚本的策略,强调了在不产生循环响应的情况下保持对话流的需求。

Adaptive RAG 受到关注:讨论了一种新的 Adaptive RAG 技术,该技术根据查询复杂度选择最佳策略,并附带了一个解释该方法的 YouTube 视频。

LangChain 专家发布更新和工具:改进后的 LangChain v0.1.17、Word Loom 的开放规范、在 GCP 上部署 Langserve 以及为 GPT 提供的 Pydantic 驱动的工具定义,展示了社区广泛的创新。相关资源可在 Word Loom 的 GitHub、LangChain 聊天机器人 和 Pydantic 工具仓库 中找到。

LangServe 中的反馈循环困扰:一位成员在 LangServe 反馈功能上的经历强调了提交反馈时清晰沟通渠道的重要性,即使在收到成功的提交响应后,更改也可能不会立即生效或被察觉。

tinygrad (George Hotz) Discord

tinygrad 解决 Conda 难题:tinygrad 环境在 M1 Macs 上因与无效 Metal 库相关的 AssertionError 而遇到障碍,目前已有潜在的修复方案。此外,还为系统更新后 conda python 问题的解决方案发布了悬赏,近期已有进展报告。

从播客到实践:一位成员在听完 Lex Fridman 播客后对 tinygrad 产生了浓厚兴趣,随后收到了深入研究 GitHub 上的 tinygrad 文档 以进一步了解并将其与 PyTorch 进行对比的建议。

tinygrad 爱好者的硬件难题:一位成员在为他们的 tinygrad 开发平台选择 AMD XT 显卡还是新款 Mac M3 之间犹豫不决,强调了选择合适硬件对于优化开发的重要性。

通过源码干预解决 MNIST 谜团:一个错误的 100% MNIST 准确率警报促使一位成员放弃了 pip 版本,并成功从源码编译 tinygrad,解决了版本差异问题,并突显了 tinygrad 构建过程的易用性。

CUDA 澄清与符号审查:关于脚本中 CUDA 使用影响性能的问题不断涌现,同时另一位成员思考了 RedNode 和 OpNode 之间的区别,并确认了 blobfile 对于在 tinygrad 的 LLaMA 示例代码中加载分词器 BPE 至关重要。

Mozilla AI Discord

-

矩阵乘法之谜:一位用户对使用 np.matmul 达到 600 gflops 感到困惑,而 Justine Tunney 的博客文章 仅提到了 29 gflops,这引发了关于计算 flops 的各种方法及其对性能测量影响的讨论。

-

文件重命名输出不一致:在使用 llamafile 运行文件重命名任务时,输出结果各异,这表明不同版本的 llamafile 或其执行过程存在差异,其中提到的一个输出示例为

een_baby_and_adult_monkey_together_in_the_image_with_the_baby_monkey_on.jpg。 -

廉价基础设施上的 Llamafile:一位成员向公会询问在资源有限的情况下,实验 llamafile 最有效的基础设施,在 vast.ai 和 colab pro plus 等服务之间进行权衡。

-

GEMM 函数提速技巧:鉴于 numpy 能够超过 600 gflops,有人寻求关于在 C++ 中提升通用矩阵乘法 (GEMM) 函数以突破 500 gflops 大关的建议,讨论围绕数据对齐和微磁贴 (microtile) 大小展开。

-

并发运行 Llamafile:据分享,可以在不同端口上同时执行多个 llamafile 实例,但强调它们将竞争由操作系统管理的系统资源,而不是在它们之间进行专门的资源管理。

Cohere Discord

-

斯德哥尔摩的 LLM 圈子寻求同伴:社区向 AI 爱好者发出邀请,提议在斯德哥尔摩共进午餐并深入探讨 LLM,彰显了社区的协作精神。

-

Cohere 的温馨欢迎:Discord 频道积极营造友好氛围,sssandra 和 co.elaine 等成员热情地迎接新加入的伙伴。

-

关注文本压缩技巧:频道宣布即将举行一场关于 使用 LLM 进行文本压缩(Text Compression using LLMs) 的分享会,体现了社区对持续学习和技能提升的承诺。

-

应对 API 迷宫:用户分享了在 AI API 集成和密钥激活方面的实战挑战,co.elaine 提供了针对性的指导,并引用了 Cohere 关于 preambles 的文档。

-

探索文档搜索策略:一位用户就构建针对自然语言查询优化的文档搜索系统寻求建议,探讨了 document embeddings、摘要生成以及关键信息提取的应用。

Interconnects (Nathan Lambert) Discord

-

集成技术解决模式崩溃(Mode Collapse):讨论强调了在 AI 对齐的强化学习中,集成奖励模型(ensemble reward models) 的潜力。正如 DeepMind 的 Sparrow 所展示的,尽管存在 KL 惩罚,但通过“对抗性探测(Adversarial Probing)”等技术可以缓解模式崩溃。

-

Llama 3 的混合方法引发关注:社区对 Llama 3 为何同时采用 Proximal Policy Optimization (PPO) 和 Decentralized Proximal Policy Optimization (DPO) 感到好奇。完整的技术原理尚未公开,可能与数据时间尺度的限制有关。

-

Bitnet 实现受到关注:社区对 Bitnet 方法在训练大模型中的实际应用产生了浓厚兴趣。目前已有成功的轻量级复现,如 Bitnet-Llama-70M,以及来自 Agora 在 GitHub 上的更新;讨论还指出,为了在大模型训练中实现高效,需要显著的硬件投入。

-

Bitnet 专用硬件是一块难啃的骨头:讨论阐明了 Bitnet 若要实现高效运行,必须依赖专用硬件,例如支持 2-bit 混合精度的芯片。文中回顾了 IBM 过去的研究努力,并提到了近期关于 CUDA 的 fp6 kernel 的热度。

-

模型来源引发 AI 圈争议:社区剖析了一条推测性的推文,内容涉及未经授权发布的一个类似于 Neel Nanda 和 Ashwinee Panda 所创的模型。该推文对其合法性表示质疑,并呼吁进行更多测试或发布模型权重。相关推文见 Teortaxes 的推文。

-

Anthropic 凭借 Claude 备受瞩目:Anthropic 发布 Claude app 引起了社区轰动,大家期待看到其与 OpenAI 产品的对比评测,同时成员们在交流中也表达了对该公司品牌建设的赞赏。

-

性能提升获得肯定:在一次批评性审查后,某位成员的性能表现出现了显著提升,并因此获得了正面反馈。

Alignment Lab AI Discord

由于用户 manojbh 仅分享了一条非技术性的消息“Hello”,因此没有相关的技术讨论可供总结。请提供包含技术细节内容的消息以便进行妥善总结。

Datasette - LLM (@SimonW) Discord

寻找语言模型管家:讨论强调了对一种 Language Model 的需求,该模型能够识别并删除硬盘中大量的 localmodels,这突显了 AI 在系统维护和组织方面的实际应用场景。

DiscoResearch Discord

-

Qdora 增强 LLM 的新策略:一位用户关注了 Qdora,这是一种在早期模型扩展策略基础上发展而来的方法,它使 Large Language Models (LLMs) 能够在学习额外技能的同时,有效规避灾难性遗忘。

-

LLaMA Pro-8.3B 采用块扩展策略:成员们讨论了一种 块扩展研究(block expansion research) 方法。该方法允许像 LLaMA 这样的 LLM 演化为更强大的版本(例如 CodeLLaMA),同时保留先前学到的技能,这标志着 AI 领域一个充满前景的发展方向。

AI21 Labs (Jamba) Discord

Jamba-Instruct 发布:AI21 Labs 宣布发布 Jamba-Instruct,根据成员分享的推文链接。这可能预示着基于指令的 AI 模型的新进展。

Skunkworks AI Discord 没有新消息。如果该频道长期沉寂,请告知我们,我们将将其移除。

LLM Perf Enthusiasts AI Discord 没有新消息。如果该频道长期沉寂,请告知我们,我们将将其移除。

第二部分:分频道详细摘要与链接

CUDA MODE ▷ #general (7 messages):

- 封禁行动:一名成员成功识别并封禁了一名未经授权的用户,突显了该小组的高效监控。

- CUDA 最佳实践分享:分享了 CUDA C++ Core Libraries 的最佳实践和技术,包括一个 Twitter 帖子链接和通过 Google Drive 分享的幻灯片,尽管目前分享文件夹似乎是空的。查看推文

- Autograd Hessian 讨论:一名成员发起讨论,询问

torch.autograd.grad函数的二阶导数是否返回 Hessian 矩阵的对角线。讨论澄清了在设置特定参数(如create_graph=True)时可以实现,而另一名成员指出这实际上是 Hessian 向量积(Hessian vector product)。 - 估算 Hessian 的对角线:提到了一种涉及随机性加 Hessian 向量积的估算 Hessian 对角线的不同技术,参考了一篇论文中的方法。

提到的链接:CCCL - Google Drive:未发现描述

CUDA MODE ▷ #triton (11 messages🔥):

-

寻求 Triton 调试经验:一名成员寻求调试 Triton kernel 的最佳方法,表示在使用

TRITON_INTERPRET=1和device_print时遇到困难,其中TRITON_INTERPRET=1不允许程序正常执行,而device_print产生重复结果。讨论了最佳调试实践,包括观看 YouTube 上的详细 Triton 调试讲座,并确保通过源码安装或使用 triton-nightly 以获得最新的 Triton 版本。 -

Triton 开发见解分享:在讨论过程中,建议确保 Triton 是最新的,因为最近修复了解释器中的 bug。不过,除了目前的 2.3 版本外,下一个版本的发布日期尚未确定。

-

排查 Triton 中的 Gather 过程:一名 Triton 新手提出了实现简单 gather 过程的问题,具体是在执行 store-load 序列时遇到了

IncompatibleTypeErrorImpl。还提到了希望在 Triton kernel 代码内部使用 Python 断点进行调试,但在触发断点时遇到了困难。

提到的链接:Lecture 14: Practitioners Guide to Triton: https://github.com/cuda-mode/lectures/tree/main/lecture%2014

CUDA MODE ▷ #cuda (14 messages🔥):

-

CUDA Profiling 困惑:一名成员讨论了使用

cudaEventRecord对 CUDA kernel 进行 profiling 时时间报告不一致的问题。他们在调整矩阵乘法 kernel 的 tile size 时观察到了意外的时间结果,并质疑计时机制的稳健性。 -

NVIDIA 工具助力:针对 profiling 的疑虑,有人建议尝试使用专门为此类任务设计的 NVIDIA profiling 工具,如 Nsight Compute 或 Nsight System。

-

Profiling 数据差异:该成员继续注意到

cudaEventRecord报告的时间与 NCU (Nsight Compute) 报告中的Duration字段之间存在差异。讨论澄清了 profiling 本身会产生开销,可能会影响捕获到的时间。 -

Nsight Systems 作为替代方案:进一步建议使用 Nsight Systems,它可以在不显式使用

cudaEventRecord的情况下处理 profiling。 -

分享 NVIDIA 上 Tinygrad 的解决方案:分享了一篇关于 NVIDIA 开源驱动的 tinygrad 补丁的帖子,记录了安装过程中遇到的问题和解决方案,可能对遇到类似问题的其他人有所帮助。

CUDA MODE ▷ #torch (3 messages):

- TorchInductor 爱好者的学习机会:一位成员鼓励那些有兴趣深入学习 TorchInductor 的人去查看一个未指明的资源。

- 寻求 PyTorch 贡献者的见解:一位用户请求与任何了解该平台内部机制的 PyTorch 贡献者取得联系。

- 寻找 ATen/linalg 专家:该用户进一步明确表示需要 ATen/linalg(PyTorch 的一个组件)方面的专业知识。

CUDA MODE ▷ #algorithms (11 messages🔥):

- Effort Engine 讨论展开:Effort Engine 的创建者加入了聊天,透露了即将发布的文章,并表示尽管有了新的基准测试,effort/bucketMul 在速度/质量方面仍逊于量化(quantization)。

- 质量重于数量:有人指出,与剪枝最小权重相比,Effort Engine 的方法显示的质量下降较少,并承诺提供图表进行直观对比。

- 理解稀疏矩阵:分享了一个对比,对比了从矩阵中移除最不重要的权重与跳过最不重要的计算,从而开始了对稀疏性(sparsity)主题的深入探讨。

- 矩阵维度至关重要:指出并承认了矩阵/向量维度的偏差,并承诺纠正文档中提到的向量方向错误。

- 探索参数重要性优于精度:一位成员对 Effort Engine 和最近的进展进行了反思,认为 AI 模型中的参数数量可能比其精度更重要,并引用了量化至 1.58 bits 等例子。

CUDA MODE ▷ #cool-links (2 messages):

- 探索速度提升:一位成员提到 random_string_of_character 目前非常慢,并对加速其性能的潜在方法表示好奇。

CUDA MODE ▷ #beginner (2 messages):

- 寻求 CUDA 代码反馈:一位成员询问是否有专门的频道或个人可以对他们的 CUDA 代码提供反馈。另一位成员引导他们在 ID 为 (<#1189607726595194971>) 的特定频道中发布,该频道鼓励此类讨论。

CUDA MODE ▷ #youtube-recordings (1 messages):

- 请求 Taylor Robie 在 Lightning 上的脚本:一位成员表示有兴趣让 Taylor Robie 将他的脚本作为 Studio 上传到 Lightning,以造福初学者。有人建议这可能是一个有用的资源。

CUDA MODE ▷ #torchao (1 messages):

- FP6 数据类型欢迎 CUDA 爱好者:分享了关于新 fp6 支持的公告,并附带了 GitHub issue 链接 (FP6 dtype! · Issue #208 · pytorch/ao)。邀请有兴趣为此功能开发自定义 CUDA 扩展的人员进行协作,并提供入门支持。

提到的链接:FP6 dtype! · Issue #208 · pytorch/ao:🚀 功能、动机和宣传 https://arxiv.org/abs/2401.14112 我想你们一定会喜欢这个。DeepSpeed 开发人员在没有 fp8 支持的显卡上引入了 FP6 数据类型,其…..

CUDA MODE ▷ #off-topic (2 messages):

- 制作 Karpathy 风格的讲解视频:一位成员寻求关于制作模仿 Andrej Karpathy 风格的讲解视频的建议,特别是将实时屏幕共享与面部摄像头叠加相结合。他们提供了一个 YouTube 视频链接 作为说明,展示了 Karpathy 构建 GPT Tokenizer 的过程。

- 推荐使用 OBS Streamlabs 制作视频:针对制作讲解视频的咨询,一位成员推荐使用 OBS Streamlabs,并强调其有大量的教程可供参考。

提到的链接:Let's build the GPT Tokenizer:Tokenizer 是大语言模型 (LLM) 中必不可少且普遍存在的组件,它在字符串和 token(文本块)之间进行转换。Tokenizer…

CUDA MODE ▷ #triton-puzzles (2 messages):

- 对问题信息的困惑:一位成员提到问题描述包含矛盾的细节,假设 N0 = T 可以避免冲突信息。

- 承认问题描述中的错误:承认了问题描述是不正确的,一位成员确认将发布一个更清晰版本的更新。

CUDA MODE ▷ #llmdotc (813 条消息🔥🔥🔥):

<ul>

<li><strong>Master Params 混乱</strong>:最近一次默认启用参数 FP32 master copy 的合并破坏了预期的模型行为,导致了显著的 loss 不匹配。</li>

<li><strong>Stochastic Rounding 大显身手</strong>:测试表明,在参数更新期间加入 stochastic rounding 使结果更符合预期行为。</li>

<li><strong>CUDA 顾虑</strong>:围绕 cuDNN 庞大的体积和编译时间,以及在 llm.c 项目中为了更好的可用性而进行的可能优化展开了讨论。</li>

<li><strong>CUDA Graphs 表现平平</strong>:CUDA Graphs 可以改善 kernel 启动开销,被简要提及作为可能的性能提升手段,但目前的 GPU 空闲时间意味着其收益有限。</li>

<li><strong>目标是 NASA 级别的 C 代码?🚀</strong>:构思改进 llm.c 代码以可能达到安全关键(safety-critical)标准,并伴随着 LLM 进入太空的梦想,以及关于针对更大模型规模进行优化的讨论。</li>

</ul>

- 无标题: 未找到描述

- The Power of 10: Rules for Developing Safety-Critical Code - Wikipedia: 未找到描述

- (beta) Compiling the optimizer with torch.compile — PyTorch Tutorials 2.3.0+cu121 documentation: 未找到描述

- Performance Comparison between Torch.Compile and APEX optimizers: 关于 torch.compile 生成代码的说明:我收到了很多关于 torch.compile 在编译优化器时具体生成了什么的问题。作为背景,关于 foreach kernel 的帖子包含了 m...

- cuda::discard_memory: CUDA C++ 核心库

- Release Notes — NVIDIA cuDNN v9.1.0 documentation: 未找到描述

- Compiler Explorer - CUDA C++ (NVCC 12.2.1): #include <cuda_runtime.h> #include <cuda_bf16.h> typedef __nv_bfloat16 floatX; template<class ElementType> struct alignas(16) Packed128 { __device__ Pack...

- Performance Comparison between Torch.Compile and APEX optimizers: TL;DR:编译后的 Adam 在所有基准测试中都优于 SOTA 手动优化的 APEX 优化器;在 Torchbench 上提升 62.99%,在 HuggingFace 上提升 53.18%,在 TIMM 上提升 142.75%,在 BlueBerries 上提升 88.13%。编译后的 AdamW 表现...

- Which Compute Capability is supported by which CUDA versions?: 以下各版本分别支持哪些 Compute Capability:CUDA 5.5?CUDA 6.0?CUDA 6.5?

- karpa - Overview: karpa 有 13 个可用的仓库。在 GitHub 上关注他们的代码。

- LLM.c Speed of Light & Beyond (A100 Performance Analysis) · karpathy/llm.c · Discussion #331: 在昨天的 cuDNN Flash Attention 实现集成之后,我花了一些时间进行 profiling,试图弄清楚我们在短期/中期内还能在多大程度上提高性能,同时也...

- mixed precision utilities for dev/cuda by ngc92 · Pull Request #325 · karpathy/llm.c: 从 #315 cherry-picked 而来

- fixes to keep master copy in fp32 of weights optionally · karpathy/llm.c@795f8b6: 未找到描述

- cuDNN Flash Attention Forward & Backwards BF16 (+35% performance) by ademeure · Pull Request #322 · karpathy/llm.c: 使用 BF16 且 batch size 为 24 的 RTX 4090:Baseline: 232.37ms (~106K tokens/s) cuDNN: 170.77ms (~144K tokens/s) ==> 性能提升 35%!编译时间:无价(TM) (~2.7s 到 48.7s - 这是一个巨大的依赖...)

- single adam kernel call handling all parameters by ngc92 · Pull Request #262 · karpathy/llm.c: 通用 Adam kernel 的首次尝试

- feature/cudnn for flash-attention by karpathy · Pull Request #323 · karpathy/llm.c: 基于 PR #322 构建。包含合并 cuDNN 支持及 Flash Attention 的额外小修复

- pytorch/torch/_inductor/fx_passes/fuse_attention.py at main · pytorch/pytorch: Python 中具有强大 GPU 加速的 Tensors 和动态神经网络 - pytorch/pytorch

- What's the difference of flash attention implement between cudnn and Dao-AILab? · Issue #52 · NVIDIA/cudnn-frontend: 这个链接是 Flash Attention 吗?

- first draft for gradient clipping by global norm by ngc92 · Pull Request #315 · karpathy/llm.c: 一个用于计算梯度 global norm 的新 kernel,以及对 Adam kernel 的更新。待办事项(TODO):裁剪值在函数调用处硬编码;损坏梯度的错误处理将...

-

- 由 PeterZhizhin 提交的增加 NSight Compute 范围,使用 CUDA events 进行计时的 PR #273 · karpathy/llm.c:CUDA events 允许更准确的计时(由 GPU 测量),nvtxRangePush/nvtxRangePop 为 NSight Systems 添加了简单的堆栈跟踪:示例运行命令:nsys profile mpirun --allow-run-as-roo...

- 由 PeterZhizhin 提交的增加 NSight Compute 范围,使用 CUDA events 进行计时的 PR #273 · karpathy/llm.c:CUDA events 允许更准确的计时(由 GPU 测量),nvtxRangePush/nvtxRangePop 为 NSight Systems 添加了简单的堆栈跟踪:示例运行命令:nsys profile mpirun --allow-run-as-roo...

- 由 karpathy 提交的 fp32 权重主副本功能 PR #328 · karpathy/llm.c:可选地在 fp32 中保留参数的主副本,添加的标志是 -w 0/1,其中 1 是默认值(即默认情况下我们确实保留 fp32 副本),增加了用于 float 格式额外参数副本的内存,...

- 共同构建更好的软件:GitHub 是人们构建软件的地方。超过 1 亿人使用 GitHub 来发现、fork 并为超过 4.2 亿个项目做出贡献。

- 共同构建更好的软件:GitHub 是人们构建软件的地方。超过 1 亿人使用 GitHub 来发现、fork 并为超过 4.2 亿个项目做出贡献。

- Pull requests · karpathy/llm.c:使用简单、原始的 C/CUDA 进行 LLM 训练。通过在 GitHub 上创建账户来为 karpathy/llm.c 的开发做出贡献。

- 由 ngc92 提交的用于完全自定义 attention 的第二个 matmul PR #227 · karpathy/llm.c:到目前为止,仅在 /dev 文件中,因为对于主脚本我们还需要修改 backward。出于某种原因,我在这里的基准测试中看到了显著的加速,但在我尝试将其用于...

- microsoft/onnxruntime 项目 main 分支下的 onnxruntime/onnxruntime/python/tools/transformers/onnx_model_gpt2.py:ONNX Runtime:跨平台、高性能的 ML 推理和训练加速器 - microsoft/onnxruntime

- Kepler 架构上更快的并行归约 | NVIDIA 技术博客:并行归约是许多并行算法的常见构建模块。Mark Harris 在 2007 年的一个演示中提供了在 GPU 上实现并行归约的详细策略...

- 由 ChrisDryden 提交的更新 adamw 以使用打包数据类型 PR #303 · karpathy/llm.c:更新前运行时总平均迭代时间:38.547570 ms;更新后运行时总平均迭代时间:37.901735 ms。Kernel 开发文件规格:在当前的测试套件中几乎察觉不到:更新前...

- 由 ngc92 提交的保留权重为 fp32 的选项 PR #326 · karpathy/llm.c:添加了一个可选的 fp32 精度的权重第二副本。TODO:缺少 free

- 由 mlazos 提交的 Inductor 中的 Foreach kernel 代码生成 PR #99975 · pytorch/pytorch:设计文档。在 Inductor 中为 foreach add 的单个重载添加 foreach kernel 代码生成。覆盖范围将在后续 PR 中扩展到更多算子。示例 cc @soumith @voznesenskym @penguinwu @anijain2305...

- 由 JaneIllario 提交的 Gelu 反向传播打包 PR #306 · karpathy/llm.c:更新 gelu 反向传播 kernel 以进行 128 位打包,并创建 gelu 反向传播 cuda 文件。之前的 kernel:block_size 32 | 时间 0.1498 ms | 带宽 503.99 GB/s;block_size 64 | 时间 0.0760...

- 由 JaneIllario 提交的将 layernorm_forward 的所有 float 转换为 floatX PR #319 · karpathy/llm.c:将所有 kernel 更改为使用 floatX

- 由 JaneIllario 提交的更新 residual_forward 以使用打包输入 PR #299 · karpathy/llm.c:更新 residual_forward 以使用 128 位打包输入及 floatX。之前的 Kernel:block_size 32 | 时间 0.1498 ms | 带宽 503.99 GB/s;block_size 64 | 时间 0.0760 ms | 带宽 993.32 GB/s...

- [inductor] 由 shunting314 提交的全面填充 PR #120758 · pytorch/pytorch:来自 ghstack 的堆栈(最早的在底部):-> #120758。此 PR 增加了在 lowering 期间填充 tensor strides 的能力。目标是确保(如果可能的话)具有不良形状的 tensor 可以...

n have aligned st... </li> </ul> </div> --- **CUDA MODE ▷ #[rocm](https://discord.com/channels/1189498204333543425/1233704710389764236/1235334822919143566)** (2 messages): - **表达热情**:一位参与者通过简短的消息 "super interesting" 表达了浓厚的兴趣。 - **AMD HIP 教程汇编**:分享了一个 YouTube 播放列表,标题为 "AMD HIP Tutorial",提供了一系列关于在 [AMD ROCm 平台](https://www.youtube.com/playlist?list=PLB1fSi1mbw6IKbZSPz9a2r2DbnHWnLbF-)上使用 HIP 语言进行 AMD GPU 编程的教学视频。 **提到的链接**:AMD HIP Tutorial:在这一系列视频中,我们将教授如何使用 HIP 编程语言在运行于 AMD ROCm 平台的 AMD GPU 上进行编程。这套视频是... --- **CUDA MODE ▷ #[oneapi](https://discord.com/channels/1189498204333543425/1233802893786746880/)** (1 messages): neurondeep: 也在 PyTorch 网页上添加了 Intel。 --- **LM Studio ▷ #[💬-general](https://discord.com/channels/1110598183144399058/1110598183144399061/1235131575809740920)** (240 messages🔥🔥): - **命令行界面上线**:成员们热烈讨论了 **LM Studio 0.2.22** 的发布,该版本引入了命令行功能,重点在于服务器模式操作。在 Linux 机器上无 GUI 的 headless 模式下运行应用的各种问题和解决方案是讨论的核心,成员们积极进行故障排除并分享建议 ([LM Studio CLI setup](https://github.com/lmstudio-ai/lms))。 - **Flash Attention 引发关注**:关于 32k 上下文下的 Flash Attention 进行了多次讨论,强调其据称能将长上下文文档分析的处理速度提高 3 倍。这一升级有望彻底改变与大文本块(如书籍)的交互方式。 - **Beta 测试邀请已发送**:用户们对 **LM Studio 0.2.22** 最新的 beta 构建版本感到兴奋,并讨论了社区反馈影响开发的潜力。提到了与更新相关的 [llama.cpp](https://github.com/ggerganov/llama.cpp) 的 pull requests。 - **Headless 模式的变通方法与技巧**:多位成员集思广益,探讨了在没有图形用户界面的系统上以 headless 状态运行 **LM Studio** 的变通方法,建议使用虚拟 X 服务器或利用 `xvfb-run` 来避免显示相关的错误。 - **有用的 YouTube 建议**:当被问及如何为生成的文本添加语音读取功能时,一位成员指向了 **sillytavern** 或使用 **xtts** 的外部解决方案,并建议可以在 [YouTube](https://youtube.com) 上查找相关的实现教程。提到的链接:--- **LM Studio ▷ #[🤖-models-discussion-chat](https://discord.com/channels/1110598183144399058/1111649100518133842/1235136391088963585)** (159 messages🔥🔥): - **探索 LLAMA 的圣经知识**:一位成员对 **LLAMA 3** 模型背诵《圣经》等已知文本的能力表示好奇。他们分享了一个实验,通过图表展示了模型对 **《创世记》和《约翰福音》** 的召回情况,结果显示对《创世记》的召回率很低,而对《约翰福音》的 **正确召回率仅为 10%**。 - **AI 故事创作中质量至关重要**:一位成员讨论了“质量”对于 AI 故事创作的重要性,表示相比于 **LLAMA 3 8B** 等更快的模型,他们更倾向于使用 **Goliath 120B Q3KS** 以获得更好的文笔。他们强调,虽然他们标准很高,但没有 AI 是完美的,人类的重写仍然必不可少。 - **圣经召回测试的合适工具**:针对圣经召回率测试,另一位成员提到尝试了 **CMDR+** 模型,该模型在处理此任务时似乎比 **LLAMA 3** 表现更好,对特定圣经段落显示出很强的召回能力。 - **关于 AI 模型量化的技术讨论**:关于 **GGUF 模型** 和量化过程进行了技术交流,用户分享了见解并寻求关于 **Gemma** 等模型量化技术的建议。 - **探索 Agent 和 AutoGPT**:进行了一场关于 **Agent** 和 **AutoGPT** 潜力的对话,讨论了创建多个相互通信的 AI 实例以优化输出的能力。然而,关于它们与大型模型相比的有效性尚未达成共识。 - **LLAMA 的视觉能力受到质疑**:成员们讨论了具有视觉能力的 LLAMA 模型,将 **LLAMA 3** 与其他模型进行了比较,并提到了 **LLAVA** 理解图像但不能生成图像的能力。还有关于最佳文本转语音(**TTS**)模型的咨询,大家公认 **Coqui** 仍处于领先地位。- Pout Christian Bale GIF - Pout Christian Bale American Psycho - 发现并分享 GIF:点击查看 GIF

- Squidward Oh No Hes Hot GIF - Squidward Oh No Hes Hot Shaking - 发现并分享 GIF:点击查看 GIF

- elija@mx:~$ xvfb-run ./LM_Studio-0.2.22.AppImage:20:29:24.712 › GPU info: '1c:00.0 VGA compatible controller: NVIDIA Corporation G A104 [GeForce RTX 3060 Ti] (rev a1)' 20:29:24.721 › Got GPU Type: nvidia 20:29:24.722 › LM Studio: gpu type = NVIDIA 2...

- Perfecto Chefs GIF - Perfecto Chefs Kiss - 发现并分享 GIF:点击查看 GIF

- GitHub - lmstudio-ai/lms: 终端里的 LM Studio:终端里的 LM Studio。通过在 GitHub 上创建账号来为 lmstudio-ai/lms 的开发做出贡献。

- GitHub - lmstudio-ai/lms: 终端里的 LM Studio:终端里的 LM Studio。通过在 GitHub 上创建账号来为 lmstudio-ai/lms 的开发做出贡献。

- GitHub - N8python/rugpull: From RAGs to riches. 一个简单的 RAG 可视化库。:From RAGs to riches. 一个简单的 RAG 可视化库。 - N8python/rugpull

- joshcarp 尝试 OpenElm · Pull Request #6986 · ggerganov/llama.cpp:目前在 sgemm.cpp 的第 821 行失败,仍需进行一些 ffn/attention head 信息的解析。目前硬编码了一些内容。修复:#6868。提交此 PR 作为草案是因为我需要帮助...

提到的链接:--- **LM Studio ▷ #[announcements](https://discord.com/channels/1110598183144399058/1111797717639901324/1235636061879668787)** (1 条消息): - **LM Studio 推出 CLI 伴侣工具**:LM Studio 推出了其命令行界面 `lms`,具有 **加载/卸载 LLM** 以及 **启动/停止本地服务器** 的功能。感兴趣的用户可以通过运行 `npx lmstudio install-cli` 来安装 `lms`,并确保更新到 **LM Studio 0.2.22** 以便使用。 - **简化工作流调试**:开发者现在可以使用 `lms log stream` 通过新的 `lms` 工具更有效地 **调试他们的工作流**。 - **加入开源工作**:`lms` 采用 MIT 许可,并在 GitHub 上提供,欢迎社区贡献。团队鼓励开发者 **[点击 ⭐️ 按钮](https://github.com/lmstudio-ai/lms)** 并在 #dev-chat 频道参与讨论。 - **安装前提条件**:提醒用户在尝试安装 `lms` 之前需要先安装 NodeJS,**安装步骤可在 GitHub 仓库中找到**。 **提到的链接**:GitHub - lmstudio-ai/lms: 终端里的 LM Studio:终端里的 LM Studio。通过在 GitHub 上创建账号来为 lmstudio-ai/lms 的开发做出贡献。 --- **LM Studio ▷ #[🧠-feedback](https://discord.com/channels/1110598183144399058/1113937247520170084/1235248065955369082)** (4 messages): - **对不同项目的尊重**:一位成员指出,表达对一个项目的偏好并不等同于贬低另一个项目,强调两者都可以很出色,诋毁其他项目没有任何价值。 - **草莓奶与巧克力奶的比喻**:为了说明偏好并不意味着对替代方案的批评,一位成员将他们对 **LM Studio** 优于 Ollama 的喜爱比作比起巧克力奶更喜欢草莓奶,而没有诋毁后者。 - **坚持观点**:另一位成员重申了他们的立场,认可其他程序的价值,但保持对 **LM Studio** 的个人偏好,并表示这不应被视为对其他项目的攻击。 --- **LM Studio ▷ #[⚙-configs-discussion](https://discord.com/channels/1110598183144399058/1136793122941190258/1235581946390646804)** (3 messages): - **恢复配置为默认值**:一位成员在更新到版本 22 后,需要重置 **llama 3** 和 **phi-3** 的配置预设。另一位成员建议删除 configs 文件夹,以便在下次启动应用时重新填充默认配置。 --- **LM Studio ▷ #[🎛-hardware-discussion](https://discord.com/channels/1110598183144399058/1153759714082033735/1235191735588749444)** (247 messages🔥🔥): - **RAM 速度与 CPU 兼容性**:成员们讨论了基于 CPU 兼容性的 RAM 速度限制,特别提到 **E5-2600 v4 CPU 支持比 2400MHz 更快的 RAM**。然而,他们研究了不同 **Intel Xeon 处理器** 的具体能力,并提供了 Intel 官方规格链接以进行澄清。 - **为 LLM 选择 GPU**:参与者讨论了运行语言模型的最佳 GPU 选择,在 **P100s**、**P40s** 等型号之间进行辩论,以及 **K40** 与某些后端的较低兼容性。通过一篇 [Reddit 帖子](https://www.reddit.com/r/LocalLLaMA) 评估了 **Tesla P40 的性能**,并对二手市场供应以及从中国发货所需 GPU 型号的运输时间表示担忧。 - **NVLink 与 SLI**:用户澄清说,虽然 **SLI 不是企业级 GPU 的功能**,但可以使用 NVLink 桥接器,然而,由于外壳设计,**P100 的物理布局可能会阻碍** NVLink 桥接器的轻松连接。 - **PCIe 带宽与显卡性能**:讨论了 **PCIe 3.0 与 4.0 带宽** 及其对多 GPU 间 VRAM 性能的影响。当在重度使用 Gen 4 显卡的系统中加入 Gen 3 显卡时,观察到了实际性能下降。 - **LLM 的 VRAM 需求**:关于高效运行模型(如 **Meta Llama 3 70B**)所需的 VRAM 量进行了反复讨论,共识是至少 **24GB VRAM** 是理想的。建议使用具有完全 Offloading 能力的 GPU 以获得最佳速度,70B 模型即使对于 24GB 显卡仍具挑战性,而 7/8B 模型在各平台上都能顺畅运行。- GoldenSun3DS 未领取的 Humblebundle 游戏:在 Imgur 发现互联网的魔力,这是一个由社区驱动的娱乐目的地。通过幽默的笑话、热门迷因、有趣的 GIF、励志故事、病毒视频等来振奋精神……

- 不知道 Idk GIF - Dont Know Idk Dunno - 发现并分享 GIF:点击查看 GIF

- mradermacher/Goliath-longLORA-120b-rope8-32k-fp16-GGUF · Hugging Face:未找到描述

- 高质量故事写作(第三人称):未找到描述

- Meta AI:使用 Meta AI 助手完成任务,免费创建 AI 生成的图像,并获取任何问题的答案。Meta AI 基于 Meta 最新的 Llama 大语言模型构建,并使用 Emu……

- LLM In-Context Learning 大师课,特邀我的 (r/reddit) AI Agent:LLM In-Context Learning 大师课,特邀我的 (r/reddit) AI Agent👊 成为会员并获取 GitHub 和代码访问权限:https://www.youtube.com/c/AllAboutAI/join...

- 高质量故事写作(第一人称):未找到描述

- Reddit - 深入探索一切:未找到描述

提到的链接:--- **LM Studio ▷ #[🧪-beta-releases-chat](https://discord.com/channels/1110598183144399058/1166577236325965844/1235201420911710209)** (152 messages🔥🔥): - **0.2.22 Preview 安装混乱**:用户在安装 **LM Studio 0.2.22 Preview** 时遇到问题,下载后显示为 **0.2.21** 版本。经过社区成员的多次更新和检查,分享了一个新的下载链接,解决了版本差异问题。 - **寻求改进的 Llama 3 性能**:参与者讨论了 **Llama 3 模型**(特别是 GGUF 版本)在推理任务中表现不佳的持续问题。建议使用包含最新 llama.cpp 更改的最新量化版本。 - **量化困惑与贡献**:用户分享了 GGUF 量化模型,并对不同 Llama 3 GGUF 之间的性能差异进行了辩论。**Bartowski1182** 确认 8b 模型已采用最新量化,并正在更新 70b 模型。 - **0.2.22 版本中发现服务器问题**:一位用户指出 **LM Studio 0.2.22** 存在潜在的服务器问题,每个服务器请求中都会添加奇怪的提示词,并建议使用 `lms log stream` 工具进行准确诊断。 - **跨平台兼容性与 Headless 运行**:关于如何在 **Ubuntu** 上运行 **LM Studio** 的讨论以简单的安装步骤告终,并且由于具备 Headless 运行能力,人们对创建 Docker 镜像的可能性感到兴奋。- 未找到标题: 未找到描述

- MACKLEMORE & RYAN LEWIS - THRIFT SHOP FEAT. WANZ (OFFICIAL VIDEO): The Heist 实体豪华版: http://www.macklemoremerch.com The Heist 数字豪华版 iTunes: http://itunes.apple.com/WebObjects/MZStore.woa/wa/viewAlb...

- Reddit - 深入探索: 未找到描述

提到的链接:--- **LM Studio ▷ #[amd-rocm-tech-preview](https://discord.com/channels/1110598183144399058/1195858490338594866/1235153704626294885)** (25 条消息🔥): - **对 LM Studio 和 OpenCL 的好奇**:一位成员提到,在发现 **LM Studio** 可以利用 **OpenCL** 时感到惊讶,尽管他们注意到其运行速度较慢。这突显了人们对机器学习软件替代计算后端的普遍兴趣。 - **ROCm 兼容性困惑**:成员们讨论了 **ROCm** 与各种 AMD GPU 的兼容性,特别是 6600 和 6700 XT 型号。例如,一位成员分享说,他们的 6600 似乎不被 **ROCm 支持**,[AMD ROCm 官方文档](https://rocm.docs.amd.com/en/docs-5.7.1/release/gpu_os_support.html)也证实了这一点。 - **ROCm 构建版本缺乏 Linux 支持**:关于 **Linux 版 ROCm 构建版本**可用性的直接提问揭示了目前还没有专门针对 **Linux** 的此类构建版本。参与者正在寻求高效利用其 AMD 硬件的替代方案。 - **跨地区 GPU 价格对比**:对话转向了较轻松的话题,成员们考虑前往英国购买 AMD **7900XTX** GPU,因为其价格比当地成本低得多,这揭示了地区定价差异对消费者决策的影响。 - **适用于 LM Studio ROCm 预览版的新 CLI 工具**:一份详细公告介绍了 `lms`,这是一个新的 CLI 工具,旨在帮助使用 ROCm Preview Beta 的 **LM Studio** 用户管理 **LLMs**、调试工作流以及与本地服务器交互。信息中包含了 [LM Studio 0.2.22 ROCm Preview](https://releases.lmstudio.ai/windows/0.2.22-ROCm-Preview/beta/LM-Studio-0.2.22-ROCm-Preview-Setup.exe) 的链接和 [lms GitHub 仓库](https://github.com/lmstudio-ai/lms),鼓励社区参与和贡献。- 未找到标题:未找到描述

- 未找到标题:未找到描述

- 未找到标题:未找到描述

- GGUF My Repo - ggml-org 提供的 Hugging Face Space:未找到描述

- bartowski/Meta-Llama-3-8B-Instruct-GGUF · Hugging Face:未找到描述

- 来自 bartowski (@bartowski1182) 的推文:在为 70b instruct 制作 llamacpp 量化版本时遇到了多个问题,我保证很快就会上线 :) 预计明天早上

- Qawe Asd GIF - Qawe Asd - 发现并分享 GIF:点击查看 GIF

- NousResearch/Hermes-2-Pro-Llama-3-8B-GGUF · Hugging Face:未找到描述

- Doja Cat GIF - Doja Cat Star - 发现并分享 GIF:点击查看 GIF

- Ojo Huevo GIF - Ojo Huevo Pase de huevo - 发现并分享 GIF:点击查看 GIF

- 共同构建更好的软件:GitHub 是人们构建软件的地方。超过 1 亿人使用 GitHub 来发现、fork 并为超过 4.2 亿个项目做出贡献。

- GitHub - lmstudio-ai/lms: 终端里的 LM Studio:终端里的 LM Studio。通过在 GitHub 上创建账号来为 lmstudio-ai/lms 的开发做出贡献。

提到的链接:--- **LM Studio ▷ #[🛠-dev-chat](https://discord.com/channels/1110598183144399058/1234988891153629205/1235355991877488744)** (4 条消息): - **LM Studio CLI 预览**:[@LMStudioAI 推文](https://x.com/lmstudioai/status/1786076035789815998?s=46) 介绍了新的 `lms` 命令行界面 (CLI),它提供了加载/卸载 LLM 以及启动/停止本地服务器等功能。它需要 LM Studio 0.2.22 或更高版本,代码采用 MIT 许可,可在 [GitHub](https://github.com/lmstudio-ai/lms) 上获取。 - **LM Studio 进入终端**:`lms` CLI 工具能够通过 `lms log stream` 调试工作流,并可以通过 `npx lmstudio install-cli` 轻松安装。 - **LM Studio 无头模式教程**:一位用户提供了使用 `xvfb` 在无头环境中运行 LM Studio(0.2.22 版本)的教程,以及在设置后安装和使用新 `lms` CLI 工具的步骤。- Doja Cat GIF - Doja Cat Star - 发现并分享 GIF:点击查看 GIF

- GPU 与 OS 支持 (Linux) — ROCm 5.7.1 文档主页:未找到描述

- Llamafile:AI 民主化进程的四个月:未找到描述

- 未找到标题:未找到描述

- GitHub - lmstudio-ai/lms: 终端里的 LM Studio:终端里的 LM Studio。通过在 GitHub 上创建账号来为 lmstudio-ai/lms 的开发做出贡献。

- Sapphire AMD Radeon RX 7900 XTX PULSE 游戏显卡 - 24GB | Ebuyer.com:未找到描述

提到的链接:--- **Stability.ai (Stable Diffusion) ▷ #[general-chat](https://discord.com/channels/1002292111942635562/1002292112739549196/1235124033645711390)** (766 条消息 🔥🔥🔥): - **Stable Diffusion 爱好者分享见解**:用户交流了关于各种 Stable Diffusion 模型和实现的技巧,讨论了不同 Checkpoint 的性能,如 'Juggernaut X' 和 '4xNMKD-Siax_200k'。有人推荐 [HuggingFace](https://huggingface.co/gemasai/4x_NMKD-Siax_200k/tree/main) 作为后者的来源。 - **AI 艺术的电脑升级建议**:成员们讨论了用于 AI 图像生成的理想电脑组件,如 4070 RTX GPU,建议倾向于等待 Nvidia 5000 系列的发布。关于在不同硬件配置上有效且高效运行 Stable Diffusion 的担忧是一个共同主题。 - **以 Logo 为重点的实用 AI 艺术与设计**:社区就 AI 在 Logo 设计中的应用进行了深入对话,其中提到了 [一个特定模型 harrlogos-xl](https://civitai.com/models/176555/harrlogos-xl-finally-custom-text-generation-in-sd) 用于在 Stable Diffusion 中创建自定义文本。讨论还涉及了法律考量以及使用 AI 支持创意工作的建议。 - **AI 放大和重绘 (Inpainting) 查询**:用户寻求关于 LDSR 等放大技术和照片写实工具的建议。链接了一个关于如何将任何模型转换为重绘模型的 [Reddit 帖子](https://new.reddit.com/r/StableDiffusion/comments/zyi24j/how_to_turn_any_model_into_an_inpainting_model/),尽管一些用户报告结果参差不齐。 - **双重身份验证 (2FA) 软件探索**:几位成员推荐了各种开源软件作为 Google Auth 和 Authy 的替代方案,用于一次性密码 (OTP),例如 Android 的 Aegis 和 iOS 的 Raivo,并讨论了备份和跨设备同步等功能。- 来自 LM Studio (@LMStudioAI) 的推文:介绍 lms —— LM Studio 的配套 CLI 😎 ✨ 加载/卸载 LLM,启动/停止本地服务器 📖 使用 lms log stream 调试你的工作流 🛠️ 运行 `npx lmstudio install-cli` 来安装 lms 🏡 ...

- 来自 LM Studio (@LMStudioAI) 的推文:😏

- GitHub - lmstudio-ai/lms: 终端里的 LM Studio:终端里的 LM Studio。通过在 GitHub 上创建账号来为 lmstudio-ai/lms 的开发做出贡献。

提到的链接:- Civitai | 分享你的模型: 未找到描述

- 介绍 Idefics2:一个为社区提供的强大 8B Vision-Language Model: 未找到描述

- gemasai/4x_NMKD-Siax_200k 在 main 分支: 未找到描述

- Yuji Stare Jujutsu Kaisen GIF - Yuji Stare Jujutsu Kaisen Blank - 发现并分享 GIF: 点击查看 GIF

- ESRGAN/4x_NMKD-Siax_200k.pth · uwg/upscaler 在 main 分支: 未找到描述

- 未找到标题: 未找到描述

- 介绍 Stability AI 会员资格 — Stability AI: Stability AI 会员资格为我们的跨多模态核心模型提供商业权利。我们的三个会员级别——非商业版、专业版和企业版——使 AI 技术获取变得...

- 介绍 IDEFICS:一个最先进 Visual Langage Model 的开源复现: 未找到描述

- Stable Assistant — Stability AI: Stable Assistant 是由 Stability AI 开发的一款友好聊天机器人,配备了 Stability AI 的文本和图像生成技术,具有 Stable Diffusion 3 和 Stable LM 2 12B。

- Reddit - 深入探索一切: 未找到描述

- Reddit - 深入探索一切: 未找到描述

- Reddit - 深入探索一切: 未找到描述

- Reddit - 深入探索一切: 未找到描述

- Reddit - 深入探索一切: 未找到描述

- Forge UI - 比 Automatic 1111 快 75%: Forge UI 比 A1111 和 ComfyUI 快达 75%。这个 UI 的外观和感觉与 Automatic 1111 相似,但已经集成了很多功能。它还有一些...

- GitHub - AbdullahAlfaraj/Auto-Photoshop-StableDiffusion-Plugin: 一个用户友好的插件,可以轻松地在 Photoshop 中使用 Automatic 或 ComfyUI 作为后端生成 Stable Diffusion 图像。: 一个用户友好的插件,可以轻松地在 Photoshop 中使用 Automatic 或 ComfyUI 作为后端生成 Stable Diffusion 图像。 - AbdullahAlfaraj/Auto-Photoshop-StableDiffusion-Plugin

- 功能: Stable Diffusion web UI。通过在 GitHub 上创建账号,为 AUTOMATIC1111/stable-diffusion-webui 的开发做出贡献。

- Harrlogos XL - 终于,在 SD 中实现自定义文本生成! - Harrlogos_v2.0 | Stable Diffusion LoRA | Civitai: 🚀HarrlogosXL - 为 SDXL 带来自定义文本生成!🚀 每次通过一个 LoRA 教会 Stable Diffusion 拼写!Harrlogos 是一个经过训练的 SDXL LoRA ...

- GitHub - lllyasviel/stable-diffusion-webui-forge: 通过在 GitHub 上创建账号,为 lllyasviel/stable-diffusion-webui-forge 的开发做出贡献。

- 理解 ComfyUI 中的 Stable Diffusion 提示词: 深入探讨 Clip Text Encode 在 ComfyUI 中如何为 Stable Diffusion 工作,分析 Token、Conditioning 和提示词工程最佳实践。在本视频中...

- ComfyUI:深度理解(第 1 部分): 这一次我们回归基础!这是对 ComfyUI 和 Stable Diffusion 工作原理的深入探讨。这不仅仅是一个基础教程,我尝试解释如何...

- ComfyUI:深度理解 第 2 部分: 这是我基础系列的第 2 部分。上次我们学习了如何为整个场景设置 Conditioning,现在是时候看看如何进行局部更改了。我也... t...

- Stable Diffusion 中的角色一致性 - Cobalt Explorer: 更新:07/01——更改了模板,使其更容易缩放到 512 或 768——更改了 ImageSplitter 脚本,使其更加用户友好,并添加了 GitHub 链接——增加了章节... </ul> </div> --- **Unsloth AI (Daniel Han) ▷ #[general](https://discord.com/channels/1179035537009545276/1179035537529643040/1235123876199927849)** (512 条消息🔥🔥🔥): - **微调与参数调整 (Finetuning and Parameter Adjustment)**:成员们正在讨论微调 LLM 的各种方法,特别是 Llama 3。其中一项讨论是将 **LoRA** *rank* 从 16 增加到 128,以避免 AI 仅仅是死记硬背信息而非理解信息,据报告,可训练参数大幅增加到了 3.35 亿以上。 - **探索多 GPU 支持**:对话集中在优化模型训练期间的 VRAM 使用,强调了 **Unsloth** 目前仅限于单 GPU 使用的局限性,但指出多 GPU 支持正在开发中,尽管尚未提供时间表。 - **通过 Prompt 生成界面**:一位成员正在开发一个项目,利用移动端 UI 屏幕的**文本描述**为应用程序生成线框图。他们正在微调一个模型,以提高生成的 **UI 线框图**的质量。 - **具有扩展上下文的 Llama 3**:讨论包括如何扩展模型的**上下文窗口大小 (context window sizes)**,特别是 Llama 3,以匹配或超过 GPT-4 及该领域的其他模型。提到 **Unsloth** 可以通过微调支持 **4 倍长的上下文**,但确实需要额外的 VRAM。 - **利用 Llama Factory 进行训练**:有人建议使用 **Llama Factory** 来潜在地克服 Unsloth 的一些局限性,特别是无法利用**多 GPU** 配置的问题。然而,这一建议是在没有官方测试或集成到 Unsloth 软件包的情况下提出的。

- 来自 RomboDawg (@dudeman6790) 的推文:如果你不想手动复制代码,这里有一个完整的 Colab Notebook。再次感谢 @Teknium1 的建议 https://colab.research.google.com/drive/1bX4BsjLcdNJnoAf7lGXmWOgaY8yekg8p?usp=shar...

- Self-Rewarding Language Models:我们假设为了实现超人类 Agent,未来的模型需要超人类的反馈,以便提供充足的训练信号。目前的方法通常从人类偏好中训练奖励模型...

- 使用 llama-cpp-python grammars 生成 JSON:llama.cpp 最近增加了使用 grammar 控制任何模型输出的功能。

- 来自 RomboDawg (@dudeman6790) 的推文:目前正在使用 OpenCodeInterpreter 数据集中的全部 230,000+ 行代码数据训练 Llama-3-8b-instruct。我想知道我们能在 HumanEval 上把那个 .622 提高多少 🤔🤔 大家为我的 jun... 祈祷吧。

- Google Colab:未找到描述

- Google Colab:未找到描述

- maywell/Llama-3-70B-Instruct-32k · Hugging Face:未找到描述

- Lllama 70B Instruct QA Prompt:Lllama 70B Instruct QA Prompt。GitHub Gist:即时分享代码、笔记和代码片段。

- AI Unplugged 9:Infini-Attention、ORPO:洞察力胜过信息

- 主页:以 2-5 倍的速度和减少 80% 的内存微调 Llama 3、Mistral 和 Gemma LLM - unslothai/unsloth

- llama.cpp/grammars/README.md(位于 master 分支 · ggerganov/llama.cpp):C/C++ 中的 LLM 推理。通过在 GitHub 上创建账户来为 ggerganov/llama.cpp 的开发做出贡献。

- gist:e45b337e9d9bd0492bf5d3c1d4706c7b:GitHub Gist:即时分享代码、笔记和代码片段。

- GitHub - IBM/unitxt:🦄 Unitxt:一个用于启动数据并为训练和评估做好准备的 Python 库:🦄 Unitxt:一个用于启动数据并为训练和评估做好准备的 Python 库 - IBM/unitxt

- Replete-AI/OpenCodeInterpreterData · Hugging Face 数据集:未找到描述

- Google Colab: 未找到描述

- Google Colab: 未找到描述

- Google Colab: 未找到描述

- Google Colab: 未找到描述

- Google Colab: 未找到描述

- Home: 以 2-5 倍的速度和减少 80% 的显存微调 Llama 3, Mistral & Gemma LLM - unslothai/unsloth

- Home: 以 2-5 倍的速度和减少 80% 的显存微调 Llama 3, Mistral & Gemma LLM - unslothai/unsloth

- GitHub - unslothai/unsloth: 以 2-5 倍的速度和减少 80% 的显存微调 Llama 3, Mistral & Gemma LLM: 以 2-5 倍的速度和减少 80% 的显存微调 Llama 3, Mistral & Gemma LLM - unslothai/unsloth

- GitHub - unslothai/unsloth: 以 2-5 倍的速度和减少 80% 的显存微调 Llama 3, Mistral & Gemma LLM: 以 2-5 倍的速度和减少 80% 的显存微调 Llama 3, Mistral & Gemma LLM - unslothai/unsloth

- sloth/sftune.py at master · toranb/sloth: 使用 unsloth 的 python sftune, qmerge 和 dpo 脚本 - toranb/sloth

- GitHub - janhq/jan: Jan 是 ChatGPT 的开源替代方案,可在您的计算机上 100% 离线运行。支持多引擎 (llama.cpp, TensorRT-LLM): Jan 是 ChatGPT 的开源替代方案,可在您的计算机上 100% 离线运行。支持多引擎 (llama.cpp, TensorRT-LLM) - janhq/jan

- lmsys/lmsys-chat-1m · Hugging Face 数据集:未找到描述

- FlagEmbedding/Long_LLM/longllm_qlora at master · FlagOpen/FlagEmbedding:检索与检索增强型 LLMs。通过在 GitHub 上创建账号为 FlagOpen/FlagEmbedding 做出贡献。

- GitHub - FlagOpen/FlagEmbedding: Retrieval and Retrieval-augmented LLMs:检索与检索增强型 LLMs。通过在 GitHub 上创建账号为 FlagOpen/FlagEmbedding 做出贡献。

- llama.cpp/examples/server at master · ggerganov/llama.cpp:C/C++ 中的 LLM 推理。通过在 GitHub 上创建账号为 ggerganov/llama.cpp 做出贡献。

- GitHub - bojone/rerope: Rectified Rotary Position Embeddings:修正的旋转位置嵌入。通过在 GitHub 上创建账号为 bojone/rerope 做出贡献。

- Neuralgameworks - 您的终极 Unreal Engine AI 助手:未找到描述

- Bounties:与顶尖 Replit 创作者合作,将您的创意变为现实。

- Pink Floyd - Echoes / Live at Pompeii ( full ):这是在庞贝古城演奏的 ''Echoes'' 的两个部分,合并在一个视频中。24分06秒。请欣赏 :-) "Echoes" 信天翁一动不动地悬浮在空中,深处...

- GitHub - KindXiaoming/pykan: Kolmogorov Arnold Networks:Kolmogorov Arnold Networks。通过在 GitHub 上创建账号来为 KindXiaoming/pykan 的开发做出贡献。

- GitHub - SynaLinks/HybridAGI: 可编程的神经符号 AGI,允许您使用基于图的提示编程来编写其行为:适用于希望 AI 表现符合预期的人群:可编程的神经符号 AGI,允许您使用基于图的提示编程来编写其行为:适用于希望 AI 表现符合预期的人群 - SynaLinks/HybridAGI

- Hermes 2 Pro 在 Llama-3 8B 上首次亮相:Nous Research 推出了 Hermes 2 Pro,这是他们首个基于 Llama-3 架构的模型,已在 HuggingFace 上发布。它在包括 AGIEval 和 TruthfulQA 在内的多个基准测试中表现优于 Llama-3 8B Instruct。探索 Hermes 2 Pro。

- 新功能与 Structured Output:Hermes 2 Pro 带来了 Function Calling 和 Structured Output 能力,使用专用 token 来简化流式 Function Calling。该模型在 Function Calling 评估和结构化 JSON 输出指标方面也有所改进。

- 提供量化模型版本:对于那些对优化模型感兴趣的人,可以获取 Hermes 2 Pro 的 GGUF 量化版本,提供了一个更高效的选择。查看 Hermes 2 Pro 的量化版本。

- 团队努力获得认可:Hermes Pro 模型的开发归功于多位贡献者的协作努力,以及那些定制工具以支持模型独特 Prompt 格式化需求的人员。

- 社交媒体更新:您可以通过他们的 Twitter 帖子关注 Nous Research 关于 Hermes 2 Pro 的更新和公告。

- 来自 Teortaxes▶️ (@teortaxesTex) 的推文:所以 Llama 8b 即使修复了 token merging 也无法很好地量化。也许是词表(vocab)的问题,也许只是过度训练(overtraining),我担心是后者。我的(不成熟的)直觉是我们正在精炼...

- LLM.int8() 与涌现特性 — Tim Dettmers:当我参加 NAACL 时,我想做一个小测试。我为我的 LLM.int8() 论文准备了两个推介方案。一个方案是关于我如何使用先进的量化方法来实现无性能损失的转换...

- 来自 John Galt (@StudioMilitary) 的推文:唯一的出路是穿过你和我

- vonjack/Nous-Hermes-2-Pro-Xtuner-LLaVA-v1_1-Llama-3-8B · Hugging Face:未找到描述

- Ffs Baby GIF - Ffs Baby Really - 发现并分享 GIF:点击查看 GIF

- Val Town:未找到描述

- Over9000 Dragonball GIF - Over9000 Dragonball - 发现并分享 GIF:点击查看 GIF

- 来自 Sanchit Gandhi (@sanchitgandhi99) 的推文:上周我们发布了 🤗Diarizers,这是一个用于微调说话人日志(speaker diarization)模型的库 🗣️ 使用免费的 Google Colab,只需 10 分钟即可将多语言性能提高 30%:https://colab.re...

- EasyContext/easy_context/zigzag_ring_attn/monkey_patch.py at main · jzhang38/EasyContext:内存优化和训练方案,旨在以极低的硬件需求将语言模型的上下文长度外推至 100 万个 token。- jzhang38/EasyContext

- DeepSpeed/blogs/deepspeed-ulysses/README.md at master · microsoft/DeepSpeed:DeepSpeed 是一个深度学习优化库,使分布式训练和推理变得简单、高效且有效。- microsoft/DeepSpeed

- 来自 Dimitris Papailiopoulos (@DimitrisPapail) 的推文:这份报告中最令人惊讶的发现隐藏在附录中。在两个最佳提示词(prompts)下,模型并没有像摘要中声称的那样过度拟合(overfit)。这是原始的 GSM8k 对比...

- 不要忽视 Whisper.cpp:@ggerganov 的 Whisper.cpp 正在将 OpenAI 的 Whisper 带给大众。我们在 "The Changelog" 播客中进行了讨论。🎧 👉 https://changelog.fm/532 订阅以获取更多内容!...

- BitNetMCU/docs/documentation.md at main · cpldcpu/BitNetMCU:在 CH32V003 RISC-V 微控制器上实现无需乘法的低比特权重神经网络 - cpldcpu/BitNetMCU

- GitHub - interstellarninja/MeeseeksAI: 一个使用 mermaid 图表编排 AI Agent 的框架:一个使用 mermaid 图表编排 AI Agent 的框架 - interstellarninja/MeeseeksAI

- GitHub - arcee-ai/mergekit: 用于合并预训练大语言模型的工具。:用于合并预训练大语言模型(LLM)的工具。- arcee-ai/mergekit

- GitHub - zhuzilin/ring-flash-attention: 结合 Flash Attention 的 Ring Attention 实现:结合 Flash Attention 的 Ring Attention 实现 - zhuzilin/ring-flash-attention

- glaiveai/glaive-function-calling-v2 · Hugging Face 数据集:未找到描述

- test.py:GitHub Gist:即时分享代码、笔记和片段。

- OpenRouter:根据应用使用情况进行排名和分析的语言模型

- perplexity:更多统计数据,由 JohannesGaessler 添加了文档 · Pull Request #6936 · ggerganov/llama.cpp:我看到过一些主观报告,称量化对 LLaMA 3 的损害比对 LLaMA 2 更大。我决定对此进行调查,并为此向 llama.cpp 添加了更多统计数据(和文档)。 pe... </ul> </div> --- **Nous Research AI ▷ #[ask-about-llms](https://discord.com/channels/1053877538025386074/1154120232051408927/1235209906173378571)** (34 messages🔥): - **Grokking 揭秘**:一位成员分享了一项关于神经网络涌现行为的[研究](https://arxiv.org/abs/2301.05217),重点关注一种被称为 "Grokking" 的现象。该案例研究涉及对在模加法上训练的小型 Transformer 进行逆向工程,揭示了它们使用*离散傅里叶变换和三角恒等式*。 - **低成本对 LLM 进行评分**:讨论了比较、评分和排名 LLM 输出的方法。虽然建议使用 GPT-4,但另一种方法(如 *argilla distilable* 或奖励模型)可能会以更具成本效益的方式提供定性排名。 - **针对 Shakespeare 数据集训练类 GP2 模型进行故障排除**:一位成员就一个未按预期学习的类 GP2 模型寻求帮助。他们报告初始 Loss 很高且无法下降,并链接了他们的 GitHub 仓库供参考:[Om-Alve/Shakespeare](https://github.com/Om-Alve/Shakespeare)。 - **ChatML 集成的 Token 替换技巧**:在关于 L3 模型配置的对话中,成员们讨论了将保留 Token 替换为 ChatML Token 如何带来功能改进。模型自动化系统还解决了无意中重复 Token 等错误。 - **以最佳状态运行基于 Llama-3 8B 的 Hermes 2 Pro**:一位成员分享了他们在 Llama-3 8B 上运行 Hermes 2 Pro 的意图,并就 16GB VRAM GPU 的最佳软件和量化级别寻求建议。建议从 Q8_0 等量化级别开始,并使用名为 lmstudio 的软件,尽管也讨论了一些配置问题。

- Progress measures for grokking via mechanistic interpretability:神经网络经常表现出涌现行为,即通过扩大参数量、训练数据或训练步骤,会产生定性的新能力。理解这种现象的一种方法是...

- NousResearch/Hermes-2-Pro-Llama-3-8B-GGUF · Hugging Face:未找到描述

- Shakespeare/train.py at main · Om-Alve/Shakespeare:通过在 GitHub 上创建账号来为 Om-Alve/Shakespeare 的开发做出贡献。

- elvis (@omarsar0) 的推文:何时进行检索?这篇新论文提出了一种训练 LLM 有效利用信息检索的方法。它首先提出了一种训练方法,教 LLM 生成一个特殊的 token,&...

- NousResearch/Hermes-2-Pro-Llama-3-8B · Hugging Face:未找到描述

- 未找到标题:未找到描述

- World Simulation Talks @ AGI House SF:0:00 对话 1:31 Jeremy Nixon 开场 6:08 Nous Research 的 Karan Malhotra 26:22 Rob Hasfield:Websim 首席执行官 1:00:08 Midjourney 的 Ivan Vendrov [实时...

- gyro://marble.game/mobile - 陀螺仪弹球游戏:未找到描述

- 新的 OpenAI 模型“即将发布”,AI 赌注提高(加上 Med Gemini、GPT 2 Chatbot 和 Scale AI):Altman“知道发布日期”,据知情人士透露 Politico 称其“即将发布”,随后神秘的 GPT-2 聊天机器人引起了大规模混乱和歇斯底里。我...

- Rabbit R1:几乎无法评价:盒子里的 AI。但是个不同的盒子。在 https://dbrand.com/rabbit 获取 dbrand 皮肤和屏幕保护贴 MKBHD 周边:http://shop.MKBHD.com 我现在使用的技术...

- Biz Stone (@biz) 的推文: 在 odeo 总部听讲座

- KAN: Kolmogorov-Arnold Networks: 受到 Kolmogorov-Arnold 表示定理的启发,我们提出了 Kolmogorov-Arnold Networks (KANs) 作为 Multi-Layer Perceptrons (MLPs) 的有前途的替代方案。虽然 MLPs 具有固定的激活函数...

- Universal Physics Transformers: A Framework For Efficiently Scaling Neural Operators: 神经算子作为物理替代模型,最近引起了越来越多的关注。随着问题复杂性的不断增加,一个自然的问题出现了:什么是有效的缩放方式...

- Benchmarking Benchmark Leakage in Large Language Models: 在预训练数据的使用不断扩大的背景下,基准数据集泄露现象变得日益突出,不透明的训练过程和通常未公开的包含情况加剧了这一现象...

- A Careful Examination of Large Language Model Performance on Grade School Arithmetic: Large Language Models (LLMs) 在许多数学推理基准测试中取得了令人印象深刻的成功。然而,人们越来越担心其中一些性能实际上反映了数据集...

- Hugh Zhang (@hughbzhang) 的推文: 数据污染是目前 LLM 评估的一个巨大问题。在 Scale,我们从零开始为 GSM8k 创建了一个新的测试集来衡量过拟合,并发现证据表明某些模型(最显著的是 Mist...

- Lua KAN experiment with Adam - Pastebin.com: Pastebin.com 自 2002 年以来一直是排名第一的粘贴工具。Pastebin 是一个网站,您可以在其中在线存储文本一段时间。

- analyse-llms/notebooks/Mode_Collapse.ipynb at main · lauraaisling/analyse-llms: 通过在 GitHub 上创建一个账户来为 lauraaisling/analyse-llms 的开发做出贡献。

- GitHub - s-chh/PyTorch-Vision-Transformer-ViT-MNIST-CIFAR10: Simplified Pytorch implementation of Vision Transformer (ViT) for small datasets like MNIST, FashionMNIST, SVHN and CIFAR10.: 针对 MNIST、FashionMNIST、SVHN 和 CIFAR10 等小型数据集的 Vision Transformer (ViT) 的简化 Pytorch 实现。

- Neural Networks Learn Statistics of Increasing Complexity:分布简单性偏差 (DSB) 假设神经网络首先学习数据分布的低阶矩,然后再转向高阶相关性。在这项工作中,我们展示了...

- Social Choice for AI Alignment: Dealing with Diverse Human Feedback:像 GPT-4 这样的 Foundation models 经过微调以避免不安全或其他有问题的行为,例如,它们拒绝遵守协助犯罪或生产...

- ICML 2024 Mechanistic Interpretability Workshop:未找到描述

- The Quantization Model of Neural Scaling:我们提出了神经缩放定律的量化模型 (Quantization Model),解释了观察到的 Loss 随模型和数据规模呈幂律下降的现象,以及新能力随规模突然涌现的现象。

- Eliciting Latent Predictions from Transformers with the Tuned Lens:我们从迭代推理的角度分析 Transformers,旨在理解模型预测是如何逐层细化的。为此,我们为冻结的...中的每个 Block 训练了一个仿射探针 (affine probe)。

- Deriving a Model of Computation for Next-Token Prediction:未找到描述

- OmniGPT - 最实惠的 ChatGPT 替代方案:我们以实惠的价格为您提供市场上最顶尖的模型:Claude 3, GPT 4 Turbo, GPT 4, Gemini, Perplexity 等。

- Syrax AI - 在一个平台上利用多个 AI:通过 Syrax AI,您可以访问多个 AI 模型,从一个平台生成内容、图像等。

- Snowflake: Arctic Instruct by snowflake | OpenRouter:Arctic 是由 Snowflake AI 研究团队从零开始预训练的稠密 MoE 混合 Transformer 架构。Arctic 将 10B 稠密 Transformer 模型与残差 128x3.66B MoE MLP 结合...

- FireLLaVA 13B by fireworks | OpenRouter:一款极速的视觉语言模型,FireLLaVA 能快速理解文本和图像。它在测试中表现出令人印象深刻的对话能力,旨在模拟多模态 GPT-4。这是首个商业级...

- OpenRouter:构建与模型无关的 AI 应用

- OpenRouter:构建与模型无关的 AI 应用

- Skribler | Skriv med AI:未找到描述

- DigiCord:史上最强大的 AI 驱动 Discord 机器人!

- Cisco NVIDIA AI Collaboration:思科与 NVIDIA 的 AI 协作

- Built for the Enterprise: Introducing AI21’s Jamba-Instruct Model:Jamba-Instruct 是我们混合 SSM-Transformer Jamba 模型的指令微调版本,专为可靠的商业用途而构建,具有一流的质量和性能。

- ChatQA-1.5 - a nvidia Collection:未找到描述

- hjhj3168/Llama-3-8b-Orthogonalized-exl2 · Hugging Face:未找到描述

- GitHub - hsiehjackson/RULER: This repo contains the source code for RULER: What’s the Real Context Size of Your Long-Context Language Models?:此仓库包含 RULER 的源代码:你的长上下文语言模型的真实上下文大小是多少?- hsiehjackson/RULER

- Stable Diffusion Finetuned Minecraft Skin Generator - Nick088 的 Hugging Face Space:未找到描述

- C4AI Command R Plus - CohereForAI 的 Hugging Face Space:未找到描述

- TaCoS:在萨尔布吕肯举行的 TaCoS 会议

- Drax Guardians Of The Galaxy GIF - Drax Guardians Of The Galaxy Odds - 发现并分享 GIF:点击查看 GIF

- davanstrien/dataset-tldr-preference-dpo · Hugging Face 数据集:未找到描述

- HuggingFaceH4/OpenHermes-2.5-1k-longest · Hugging Face 数据集:未找到描述

- GitHub - johko/computer-vision-course: 该仓库是社区驱动的神经网络计算机视觉课程的大本营。欢迎加入我们的 Hugging Face Discord: hf.co/join/discord:该仓库是社区驱动的神经网络计算机视觉课程的大本营。欢迎加入我们的 Hugging Face Discord: hf.co/join/discord - johko/computer-vision-course

- 由 nroggendorff 修复了一些 Sagemaker 配置问题 · Pull Request #2732 · huggingface/accelerate:更新了 config_args.py 以适配最新版本的 Amazon Sagemaker。在这个新版本中,你需要使用 True 或 False 来运行变量操作,例如 --do_eval True,而不是仅仅...

- datasets/src/datasets/features/features.py at main · huggingface/datasets:🤗 最大的一站式数据集中心,适用于 ML 模型,提供快速、易用且高效的数据处理工具 - huggingface/datasets

- 加速文本生成图像扩散模型的推理:未找到描述

- ETH Zürich DLSC: Physics-Informed Neural Networks - Applications:↓↓↓ 讲座概览如下 ↓↓↓ ETH Zürich 科学计算中的深度学习 2023,第 5 讲:物理信息神经网络 - 应用。讲师:Ben M...

- GitHub - Binary-Beast03/MPI-Codes:通过在 GitHub 上创建账号来参与 Binary-Beast03/MPI-Codes 的开发。

- moondream2-batch-processing - Csplk 开发的 Hugging Face Space:未找到描述

- fluently/Fluently-XL-v4 · Hugging Face:未找到描述

- Instagram 上的 Mansion X:"流利地 (*fluently*) 说美语 🇺🇸。#fit #ootd":2 个赞,0 条评论 - the_mansion_x 发布于 2024 年 5 月 2 日。

- 未找到标题: 未找到描述

- talks/2024/mlops/mlops-rag-bootcamp.ipynb at main · nerdai/talks: 用于分享演讲材料的公共仓库。通过在 GitHub 上创建账号来参与 nerdai/talks 的开发。

- Response Synthesis Modules - LlamaIndex: 未找到描述

- Google Colab: 未找到描述

- Chroma Vector Store - LlamaIndex: 未找到描述

- Observability (Legacy) - LlamaIndex: 未找到描述

- llama_index/llama-index-experimental/llama_index/experimental/query_engine/pandas/prompts.py at main · run-llama/llama_index: LlamaIndex 是一个用于 LLM 应用程序的数据框架 - run-llama/llama_index

- Content Moderation using AI: 了解如何使用 AI 模型和框架(如 LlamaIndex、moondream 和 Microsoft Phi-3)来审核内容。

- Pandas Query Engine - LlamaIndex: 未找到描述

- vLLM - LlamaIndex: 未找到描述

- Modular: MAX 24.3 - 介绍 MAX Engine 可扩展性:我们正在为世界构建下一代 AI 开发者平台。查看我们的最新文章:MAX 24.3 - 介绍 MAX Engine 可扩展性

- Modular: Mojo 24.3 更新内容:社区贡献、Python 风格的集合和核心语言增强:我们正在为世界构建下一代 AI 开发者平台。查看我们的最新文章:Mojo 24.3 更新内容:社区贡献、Python 风格的集合和核心语言增强

- Modular: Mojo 24.3 新特性:社区贡献、Pythonic 集合及核心语言增强:我们正在为世界构建下一代 AI 开发者平台。查看我们的最新帖子:Mojo 24.3 新特性:社区贡献、Pythonic 集合及核心语言增强

- Modular: MAX 24.3 - 引入 MAX Engine 可扩展性:我们正在为世界构建下一代 AI 开发者平台。查看我们的最新帖子:MAX 24.3 - 引入 MAX Engine 可扩展性

- Mojo🔥 更新日志 | Modular 文档:Mojo 重大变更的历史记录。

- 主页:CHERI Wiki 页面占位符。通过在 GitHub 上创建账号为 CTSRD-CHERI/cheripedia 的开发做出贡献。

- 未来的硬件能否让我们的软件更安全?2022 年 3 月 15 日剑桥完整活动记录:未来的硬件如何让我们的软件更安全?对代码中的安全问题感到沮丧?讨厌那些找上门来的 Bug?你是否感兴趣...

- 未来的硬件能否让我们的软件更安全?2022 年 3 月 15 日剑桥完整活动记录:未来的硬件如何让我们的软件更安全?对代码中的安全问题感到沮丧?讨厌那些找上门来的 Bug?你是否感兴趣...

- atomic | Modular Docs:实现了 Atomic 类。

- Roadmap & known issues | Modular Docs:MAX 平台的已知问题和即将推出的功能摘要。

- Mojo Lang - Tomorrow's High Performance Python? (with Chris Lattner):Mojo 是来自 Swift 和 LLVM 创建者的最新语言。它尝试吸取 CPU/GPU 级编程的一些最佳技术并进行封装...

- Antanas Daujotis - Unleashing Python's potential with MAX Platform:未找到描述

- Running Locally - Open Interpreter:未找到描述

- Bow Nick Cage GIF - Bow Nick Cage Nicolas Cage - Discover & Share GIFs:点击查看 GIF

- Join the Open Interpreter Discord Server!:一种使用计算机的新方式 | 8861 名成员

- Introducing Idefics2: A Powerful 8B Vision-Language Model for the community:未找到描述

- Mike Bird:A.I. 工程

- GitHub - aj47/clickolas-cage: a chrome extension that performs web browsing actions autonomously to complete a given goal/task (using LLM as brain).:一个自主执行网页浏览操作以完成给定目标/任务的 Chrome 扩展(使用 LLM 作为大脑)。- aj47/clickolas-cage

- Open Interpreter OS Mode:展示 Open Interpreter 将网页总结到记事本中 #gpt4 #autogen #crewai #chatgpt #automation #coding #programming #windows #reddit #localllama #m...

- ngrok - Online in One Line:未找到描述

- error file - Pastebin.com:Pastebin.com 是自 2002 年以来排名第一的粘贴工具。Pastebin 是一个可以在线存储文本一段时间的网站。

- GitHub - rbrisita/01 at rknn:开源语言模型计算机。通过在 GitHub 上创建账户为 rbrisita/01 的开发做出贡献。

- GitHub - tegnike/nike-ChatVRM: 誰でもAITuberお試しキット:面向所有人的 AITuber 尝试套件。通过在 GitHub 上创建账号来为 tegnike/nike-ChatVRM 的开发做出贡献。

- 在本地运行的 Neuro Sama 竞争对手!V0.2 [FOSS, 本地, 无 API]:我马上建一个 GitHub 仓库。抱歉麦克风质量不好,我用的是耳机麦克风,蓝牙带宽严重影响了音质,而且显存(VRAM)也有点……

- GitHub - neurokitti/VtuberAI:通过在 GitHub 上创建账号来为 neurokitti/VtuberAI 的开发做出贡献。

- 来自 Atty Eleti (@athyuttamre) 的推文:@simonw @OpenAIDevs 我们基于句子和段落边界进行分块(通过使用句号、换行符等常见停止标记),但目前不进行语义分块(semantic chunking)。我们正在针对文档进行优化...

- 语义分块 | 🦜️🔗 LangChain:基于语义相似度分割文本。

- 来自 murat 🍥 (@mayfer) 的推文:凭借 Vercel 和 Nextjs 的力量,OpenAI 完成了不可思议的事情:他们创建了一个悬停延迟超过 1 秒的导航栏,图像反复出现和消失,以及卡顿的滚动...

- 将你的电脑变成 AI 电脑 - Jan:在你的电脑上本地离线运行 Mistral 或 Llama2 等 LLM,或者连接到 OpenAI 的 GPT-4 或 Groq 等远程 AI API。

- 来自 Alex Albert (@alexalbert__) 的推文:当我们刚开始构建工具使用(tool use)时,我们经常使用白板。每次头脑风暴会议后,我都会拍一张白板的照片,并要求 Claude 将我们的涂鸦转录成笔记,以便我转...

- 来自 cocktail peanut (@cocktailpeanut) 的推文:我在 Westworld(又名 AI Town)部署了 300 个 AI Agent,令人惊讶的是,它在我的 Macbook M1 Max 64G 上运行毫无问题。以下是它的样子:

- 语义分块器 (Semantic Chunker) - LlamaIndex:未找到描述

- GitHub - benbrandt/text-splitter: 将文本分割成语义块,直到达到所需的块大小。支持按字符和 Token 计算长度,并可从 Rust 和 Python 调用。:将文本分割成语义块,直到达到所需的块大小。支持按字符和 Token 计算长度,并可从 Rust 和 Python 调用。 - benbrandt/text-splitter

- 加入我们的 Cloud HD 视频会议:Zoom 是现代企业视频通信的领导者,拥有一个简单、可靠的云平台,可用于跨移动设备、桌面和会议室系统的视频和音频会议、聊天和网络研讨会。Zoom ...

- Notion – 笔记、任务、维基和数据库的一体化工作空间。:一款将日常工作应用融合为一的新工具。它是为您和您的团队打造的一体化工作空间。

- Tweet from Teortaxes▶️ (@teortaxesTex): So llama 8b won't quantize well even if you fix token merging. Maybe the issue is vocab, maybe just overtraining, and I fear the latter. My (half-baked) intuition is that we're refining compos...

- gradientai/Llama-3-8B-Instruct-Gradient-1048k · Hugging Face: no description found

- FastChat/fastchat/conversation.py at main · lm-sys/FastChat:一个用于训练、部署和评估大型语言模型的开放平台。Vicuna 和 Chatbot Arena 的发布仓库。- lm-sys/FastChat

- OpenAccess-AI-Collective/axolotl | Phorm AI Code Search:更快速地理解代码。

- OpenAccess-AI-Collective/axolotl | Phorm AI Code Search:更快速地理解代码。

- OpenAccess-AI-Collective/axolotl | Phorm AI Code Search:更快速地理解代码。

- accelerate/docs/source/usage_guides/deepspeed.md at main · huggingface/accelerate:🚀 一种在几乎任何设备和分布式配置上启动、训练和使用 PyTorch 模型的简单方法,支持自动混合精度(包括 fp8),以及易于配置的 FSDP 和 DeepSpeed 支持……

- OpenAccess-AI-Collective/axolotl | Phorm AI Code Search:更快速地理解代码。

- OpenAccess-AI-Collective/axolotl | Phorm AI Code Search:更快速地理解代码。

- transformers/docs/source/en/deepspeed.md at main · huggingface/transformers:🤗 Transformers: 为 Pytorch、TensorFlow 和 JAX 提供最先进的机器学习。- huggingface/transformers

- OpenAccess-AI-Collective/axolotl | Phorm AI Code Search:更快速地理解代码。

- Motion-I2V:未找到描述

- GitHub - wesbz/SoundStream: This repository is an implementation of this article: https://arxiv.org/pdf/2107.03312.pdf:该仓库是这篇文章的实现:https://arxiv.org/pdf/2107.03312.pdf - wesbz/SoundStream

- KAN: Kolmogorov-Arnold Networks:受 Kolmogorov-Arnold 表示定理的启发,我们提出了 Kolmogorov-Arnold Networks (KANs) 作为 Multi-Layer Perceptrons (MLPs) 的有力替代方案。虽然 MLPs 具有固定的激活函数...

- Visual Fact Checker: Enabling High-Fidelity Detailed Caption Generation:现有的视觉内容自动字幕生成方法面临诸如缺乏细节、内容幻觉和指令遵循能力差等挑战。在这项工作中,我们提出了 VisualFactChecker (VFC)...

- 来自 BennyJ504-075⚜😎🤑🔌.yat 🟣 (@bennyj504) 的推文: https://www.hexagen.world/

- Discord - 与朋友和社区聊天的新方式:Discord 是通过语音、视频和文字进行交流的最简单方式。聊天、闲逛,并与你的朋友和社区保持紧密联系。

- 集体 AI 生成的游戏世界:一个社交实验,任何人都可以通过浏览器协助创建一个无限独特的模型。

- Word Loom 提议的更新:Word Loom 提议的更新。GitHub Gist:即时分享代码、笔记和片段。

- GitHub - carlosplanchon/gpt_pydantic_tools: 一种使用 Pydantic Schemas 编写 GPT 工具的方法。:一种使用 Pydantic Schemas 编写 GPT 工具的方法。通过在 GitHub 上创建账号为 carlosplanchon/gpt_pydantic_tools 的开发做出贡献。

- 未找到标题:未找到描述

- jartine/Mixtral-8x7B-Instruct-v0.1-llamafile · Hugging Face:暂无描述

- Feature Request: Option to specify base URL for server mode · Issue #388 · Mozilla-Ocho/llamafile:我一直在测试使用 Nginx 作为代理在子目录下提供 llamafile 服务。即能够通过类似这样的 URL 访问 llamafile 服务器:https://mydomain.com/llamafile/ Llamafile...

- primeline/distil-whisper-large-v3-german · Hugging Face:暂无描述

- GitHub - stanford-futuredata/FrugalGPT: FrugalGPT: better quality and lower cost for LLM applications:FrugalGPT:为 LLM 应用提供更高质量和更低成本 - stanford-futuredata/FrugalGPT

- ohara/experiments/bitnet/bitnet.md at master · joey00072/ohara:自动回归模型实现集合。通过在 GitHub 上创建账户为 joey00072/ohara 的开发做出贡献。

- abideen/Bitnet-Llama-70M · Hugging Face:未找到描述

- GitHub - kyegomez/BitNet: Implementation of "BitNet: Scaling 1-bit Transformers for Large Language Models" in pytorch:在 pytorch 中实现 "BitNet: Scaling 1-bit Transformers for Large Language Models" - kyegomez/BitNet