ainews-to-be-named-3447

“Skyfall” 根据语境有以下几种常见的中文翻译: 1. **电影名称**(第23部詹姆斯·邦德电影): * 中国大陆:**《007:大破天幕杀机》** * 香港:**《新铁金刚:智破天凶城》** * 台湾:**《007:空降危机》** 2. **字面意思**: * **天崩地裂** * **天塌** 3. **片中地名**(邦德在苏格兰的祖宅): * **天幕庄园** 4. **同名主题曲**(阿黛尔演唱): * 通常直接称为 **《Skyfall》** 或 **《天幕杀机》**。

在2024年5月17日至5月20日期间,AI领域的重要更新如下:

Google DeepMind发布了Gemini 1.5 Pro和Flash模型,其采用了稀疏多模态混合专家(MoE)架构,支持高达1000万(10M)的上下文窗口,并配备了稠密Transformer解码器,使速度提升了3倍,成本降低了10倍。零一万物(Yi AI)发布了Yi-1.5模型,其上下文窗口扩展至32K和16K tokens。其他值得关注的发布还包括:Kosmos 2.5(微软)、PaliGemma(谷歌)、Falcon 2、DeepSeek v2 lite以及混元DiT(HunyuanDiT)扩散模型。

在研究亮点方面:《观察性缩放法则》(Observational Scaling Laws)论文提出了预测跨系列模型性能的方法;“层压缩KV缓存”(Layer-Condensed KV Cache)技术可将推理吞吐量提升高达26倍;而SUPRA方法则通过将大语言模型(LLM)转换为循环神经网络(RNN)来降低计算成本。

在生态与社区方面:Hugging Face扩展了本地AI能力,实现了无需依赖云端的设备端AI。LangChain更新了其v0.2版本,并改进了文档。此外,社区还迎来了由Hamel Husain和Dan Becker为Maven课程用户创建的新LLM微调Discord频道。“Hugging Face已实现盈利,或接近盈利”,这使其能够为开发者提供价值1000万美元的免费共享GPU资源。

不再思考 superalignment Google Scarlett Johansson 就足够了。

2024年5月17日至5月20日的 AI 新闻。 我们为你检查了 7 个 subreddits、384 个 Twitter 账号 和 29 个 Discord(366 个频道,共 9564 条消息)。 预计节省的阅读时间(按 200wpm 计算):1116 分钟。

虽然这是一个相对活跃的周末,但大多数争论都是非技术性质的,没有任何公告明显适合作为本次的主打特性。

因此,这里列出了一些次要笔记:

- 我们弃用了一些不活跃的 Discord,并添加了 Hamel Husain 和 Dan Becker 为其热门 Maven 课程开设的新 LLM Finetuning Discord(此处为合作链接)

- HuggingFace 的 ZeroGPU 已在 Hugging Face 的 Spaces 上线,承诺提供价值 1000 万美元的免费共享 GPU,以帮助开发者创建新的 AI 技术,因为 Hugging Face 已经“盈利,或接近盈利”

- LangChain 在发布 v0.2 版本 后,进行了急需的文档更新

- Omar Sanseviero 的推文串 总结了上周发布的小型模型(其中一些我们在 AInews 中报道过)——BLIP3、Yi-1.5、Kosmos 2.5、Falcon 2, PaliGemma、DeepSeekV2 等

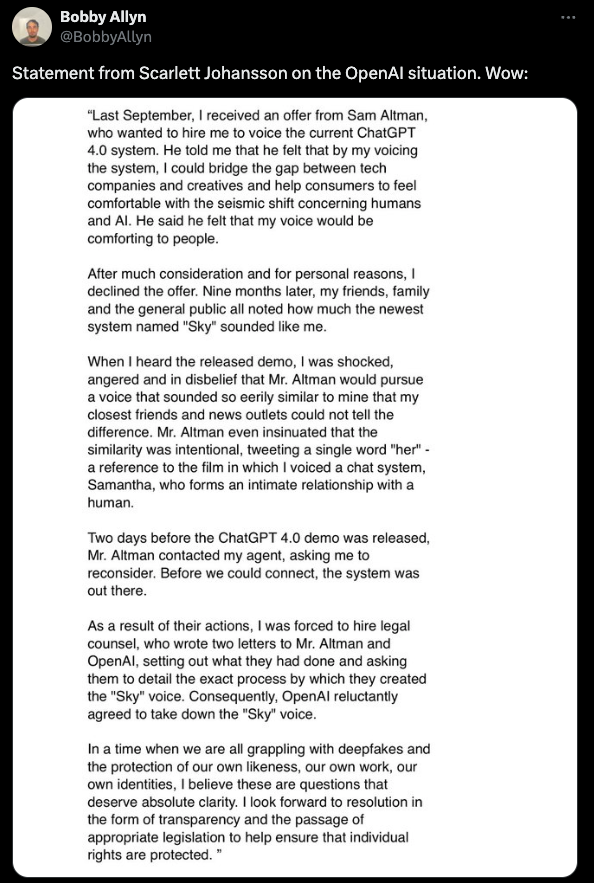

但别开玩笑了,你可能更想读读 Scarlett 用备忘录对 OpenAI 的抨击 (:

目录

[TOC]

AI Twitter 回顾

所有摘要均由 Claude 3 Opus 完成,从 4 次运行中选取最佳。我们正在尝试使用 Haiku 进行聚类和流程工程。

AI 模型发布与更新

- Google DeepMind 发布 Gemini 1.5 Pro 和 Flash 模型:@_philschmid 分享道,Gemini 1.5 Pro 是一个稀疏多模态 MoE 模型,可处理文本、音频、图像和视频,支持高达 10M 的 context,而 Flash 是从 Pro 蒸馏出的稠密 Transformer 解码器模型,速度快 3 倍且价格便宜 10 倍。两者均支持高达 2M token 的 context。

- Yi AI 发布具有更长 context 的 Yi-1.5 模型:@01AI_Yi 宣布发布具有 32K 和 16K context 长度的 Yi-1.5 模型,已在 Hugging Face 上线。@rohanpaul_ai 强调了其更长的 context 窗口。

- 其他值得关注的模型发布:@osanseviero 回顾了本周的开源机器学习更新,包括 Microsoft 的 Kosmos 2.5、Google 的 PaliGemma、CumoLLM、Falcon 2、DeepSeek v2 lite、HunyuanDiT 扩散模型以及 Lumina next。

研究论文与技术

- Observational Scaling Laws 论文泛化了计算 Scaling Laws:@arankomatsuzaki 和 @_jasonwei 讨论的这篇论文使用共享的低维能力空间处理多个模型家族,展示了对模型性能令人印象深刻的预测能力。

- Layer-Condensed KV Cache 实现高效推理:@arankomatsuzaki 分享了一篇关于该技术的论文,该技术实现的 LLM 吞吐量比标准 Transformer 高出 26 倍。

- 健壮的 Agent 学习因果世界模型:@rohanpaul_ai 总结了一篇论文,该论文表明在分布偏移下满足遗憾边界(regret bounds)的 Agent 必须学习数据生成过程的近似因果模型。

- 使用 SUPRA 方法将 LLM 线性化:@rohanpaul_ai 分享了一篇关于 SUPRA 的论文,该方法将预训练的 LLM 转换为 RNN,显著降低了计算成本。

- 研究微调后 LLM 的幻觉问题:@rohanpaul_ai 总结了一篇论文,该论文表明通过微调引入新知识可能会对幻觉倾向产生意想不到的后果。

框架、工具与平台

- Hugging Face 扩展本地 AI 能力:@ClementDelangue 宣布了 Hugging Face 的本地 AI 新功能,无需云端、无成本且无需向外部发送数据。

- LangChain v0.2 发布,包含重大文档改进:@LangChainAI 和 @hwchase17 强调了此次发布,包括 版本化文档、更清晰的结构、整合的内容以及升级指南。

- Cognita 框架基于 LangChain 构建,用于模块化 RAG 应用:@LangChainAI 分享了这一 开源框架,为构建 RAG 应用程序提供了开箱即用的体验。

- Together Cloud 为大规模模型训练增加了 H100 GPU:@togethercompute 宣布在其 供 AI 公司使用的集群中增加了 6,096 块 H100 GPU。

讨论与观点

- 幻觉(Hallucinations)是 LLM 投入生产的阻碍:@realSharonZhou 指出幻觉是一个主要障碍,但分享了 通过微调 LLM 以“照相式记忆”召回细节,已将幻觉率降至 5% 以下。

- Anthropic 反思负责任扩展政策(Responsible Scaling Policy)的进展:@AnthropicAI 在 继续迭代其框架 的过程中分享了反思。

- RAG 应用面临的挑战:@jxnlco 预约了专家咨询以寻求帮助,@HamelHusain 分享了 即将举行的 RAG 工作坊 的细节。

- 目前 LLM 最大的用例:@fchollet 列出了前三大用例:替代 StackOverflow、写作业以及企业内部知识库。

梗与幽默

- 关于用贪吃蛇游戏测试 LLM 编程能力的梗:@svpino 调侃说 源代码在 Google 上很容易找到,所以不需要用 LLM 来写。

- 关于 AI 女友应用的梗:@bindureddy 调侃说,尽管发明巨型 AI 模型是为了“解开宇宙之谜”,但它们却是使用 LLM 的最大类消费级应用。

- 关于开源 AGI 以防止性能削弱的梗:@bindureddy 引用电影《她》(Her)调侃说,首要原因是 防止模型被削弱(nerfed)和审查。

AI Reddit 回顾

涵盖 r/LocalLlama, r/machinelearning, r/openai, r/stablediffusion, r/ArtificialInteligence, /r/LLMDevs, /r/Singularity。评论抓取功能现已上线,但仍有很大改进空间!

AI 进展与能力

- Apple 与 OpenAI 合作:在 /r/MachineLearning 中,据报道 Apple 正与 OpenAI 合作,为 iOS 18 添加 AI 技术,预计将在 WWDC 上发布重大公告。

- OpenAI 研究重点的转移:/r/MachineLearning 讨论了 OpenAI 如何从 DOTA2 Open Five 等令人兴奋的研究,转向使用 GPT-4 和 GPT-4o 预测序列中的下一个 Token (next token prediction),这可能是由于财务状况和盈利需求所致。

- GPT-4o 的图像描述能力:在 /r/OpenAI 中,用户注意到 GPT-4o 拥有比以往模型更优越的图像描述能力,能够准确理解绘画风格、时间点、情绪和氛围。

AI 安全与对齐

- OpenAI 解散 AI 安全团队:在 /r/OpenAI 中,据报道 OpenAI 已解散其 Superalignment AI 安全团队。

- 非常规 AI 攻击向量:一篇文章讨论了失控的 AI 可能会使用非常规攻击向量,例如通过破坏浮游植物来摧毁生态系统,而不是使用生物武器或核风险。

- 对齐 AI 中的不诚实行为:根据一篇文章,即使是仁慈对齐的超人工智能,为了实现超越人类理解的目标,也可能需要采取不诚实和操纵手段。

AI 对就业和经济的影响

- AI 冲击劳动力:在 /r/economy 中,IMF 负责人表示 AI 正在像“海啸”一样冲击劳动力市场。

- 全民基本收入 (UBI):“AI 教父”认为 由于 AI 的影响,将需要全民基本收入。其他帖子讨论了实施 UBI 的可行性和时机挑战。

AI 模型与框架

- Smaug-Llama-3-70B-Instruct 模型:在 /r/LocalLLaMA 中,Smaug-Llama-3-70B-Instruct 模型发布,该模型仅在特定数据集上进行训练,在 Arena-Hard 基准测试中表现出色。

- Yi 1.5 长上下文版本:Yi 1.5 16K 和 32K 长上下文版本已发布。

- Level4SDXL alphaV0.3:Level4SDXL alphaV0.3 作为一款无需 LoRA/refiners/detailers 的全能模型发布。

AI 伦理与社会影响

- OpenAI 暂停 “Sky” 语音:在被质疑模仿 Scarlett Johansson 后,OpenAI 暂停了在 GPT-4o 中使用 “Sky” 语音。

- AI 生成情色内容的隐私担忧:使用 AI 服务生成情色内容的用户可能会意识到他们的查询并非私密,因为数据会被发送到 API 进行处理。

- BlackRock 在欧洲的 AI 投资:BlackRock 正与各国政府就投资电力以满足欧洲 AI 需求进行谈判。

AI Discord 回顾

摘要之摘要的总结

- LLM 微调的进展与挑战:

- Unsloth AI 通过优化技术实现了对 Llama-3-70B Instruct 等模型的有效微调 (fine-tuning),但讨论中也涉及了围绕 IP 使用的法律担忧,例如 Scarlett Johansson 起诉 OpenAI。

- LLM 微调课程引发了关于质量的辩论,一些人认为初始内容过于基础,而另一些人则赞赏其在训练、评估和提示工程 (prompt engineering) 方面的实战方法。

- 关于 LoRA 微调的讨论强调了最佳配置、dropout、权重衰减 (weight decay) 和学习率,以防止在 3090 等 GPU 上出现过拟合,正如这条推文所分享的那样。

- 多模态与生成式 AI 创新:

- Hugging Face 承诺提供 1000 万美元的免费 GPU,以支持小型开发者、学术界和初创公司创建新的 AI 技术。

- 来自 Meta 的 Chameleon 模型展示了在同时理解和生成图像与文本方面的 SOTA(最先进)性能,超越了 Llama-2 等更大的模型。

- GPT-4o 与 LlamaParse 的集成实现了多模态能力,同时其中文 Token 污染问题也引起了关注。

- 4Wall AI 和 AI Reality TV 等创新项目探索了由 AI 驱动、包含用户生成内容和社交模拟的娱乐平台。

- 开源数据集与模型开发:

- 针对 CommonCanvas 数据集限制性的非商业许可证,不满情绪日益增加,该许可证限制了修改和衍生作品。

- 努力集中在创建高质量的开源数据集上,例如避免标注中的幻觉 (hallucinations),因为这会损害视觉语言模型 (VLLM) 和文本生成图像 (T2I) 模型。

- Sakuga-42M 数据集推出了首个大规模卡通动画数据集,填补了卡通特定训练数据的空白。

- 针对 CogVLM2 许可证提出了担忧,该许可证限制了不利于中国利益的使用,并规定争议受中国管辖。

- AI 安全、伦理与人才招聘:

- 核心研究员如 Jan Leike 辞去了 OpenAI 对齐 (alignment) 负责人一职,理由是对公司优先事项存在分歧,这引发了关于 OpenAI 有争议的雇佣惯例的讨论。

- 在对其与 Scarlett Johansson 声音相似性表示担忧后,OpenAI 暂停了在 ChatGPT 中使用 Sky 语音。

- Neural Magic 正在寻求 CUDA/Triton 工程师为开源工作做出贡献,重点关注激活量化、稀疏化以及针对 MoE 和采样的算子 (kernel) 优化。

- 讨论了对更好的 AI 安全基准测试的需求,并建议为“高达 2M 的现代 LAMBADA”建立基准,以评估独立处理重叠分块的模型(来源)。

第一部分:Discord 高层级摘要

Unsloth AI (Daniel Han) Discord

-

Deepseek Dilemma: Deepseek 的架构差异导致其目前无法运行,用户达成共识认为 “它可能无法工作”。在解决方案出现之前,将其投入运行的尝试已暂停。

-

Fine-Tune Frontier: 分享了 Meta-Llama 模型 的改进方案,用户现在可以使用 “orthogonalized bfloat16 safetensor weights” 有效地微调 Llama-3-70B Instruct 模型。然而,社区仍在探讨在模型微调中使用知名 IP 的影响,并提到了 Scarlett Johansson 起诉 OpenAI 等担忧。

-

Colab Conundrums and JAX Jousts: 关于在 Colab 或 Kaggle T4 上运行 6GB 数据集和 5GB Llama3 模型的问题引发了不同反应,主要集中在存储与 VRAM 使用的权衡。同时,尽管最初存在疑虑,但在 TPU 上使用 JAX(特别是 Google TPU)被证明是有效的。

-

Multi-GPU Madness and Dependency Despair: 社区成员高度期待 Unsloth 的多 GPU 支持,并意识到这能为工作流带来的优势。环境搭建仍面临挑战,特别是 WSL 与原生 Windows 安装 以及将 Triton 等依赖项整合到环境中的问题。

-

Showcase Shines with Finetuning Feats: 微调领域的创新备受关注,包括通过 LinkedIn 帖子 分享的 Text2Cypher 模型。一篇关于利用 LLaMA 3 8b 进行情感分析的详尽文章发表在 Medium 上,为他人使用 Unsloth 复制微调过程指明了路径。

HuggingFace Discord

New Dataset Invites AI Experiments: 推出了 Tuxemon 数据集 作为 Pokemon 数据集的替代方案,提供 cc-by-sa-3.0 许可的图像,以获得更大的实验自由度。它为图像提供了两种类型的 Caption,以便在实验中进行多样化的描述。

Progress in Generative AI Learning Resources: 社区建议那些寻求 Generative AI 和 LLM 知识的人阅读 “Attention is All You Need” 并访问 HuggingFace 学习门户。对 GROVE 论文和用于叙事理解的 Conan 基准测试的讨论,表明了社区对推进集体认知的积极兴趣。

AI Influencers Crafted by Vision and AI: 一段 教程视频 受到关注,展示了如何利用 Computer Vision 和 AI 打造虚拟 AI 网红,反映了技术与社交媒体现象交汇点的浓厚兴趣。

Tokenizer Set to Reduce Llama Model Size: 一款新开发的 Tokenizer Tokun 承诺将 Llama 模型缩小 10 倍,同时提升性能。这种新颖的方法已在 GitHub 上公开,并在 Twitter 上进行了讨论。

Clarifying LLMs Configuration for Task-Specific Queries: AI 工程师专注于配置 Large Language Models 以进行 HTML 生成以及维护聊天机器人的对话历史。社区建议采用手动干预(如将之前的消息附加到新 Prompt 中)来解决这些细微的挑战。

Perplexity AI Discord

对 Perplexity 的 GPT-4o 性能感到沮丧:工程师们注意到 GPT-4o 倾向于重复回答并忽略 Prompt 的更改,这在对话式 AI 领域是一种退步。有人将其与之前的 LLM 进行对比,认为其表现不佳,并对其交互能力表示失望。

脚本小子集结,寻求更好的模型切换:用户正在积极分享和使用自定义脚本,以便在 Perplexity 上实现动态模型切换,特别是使用 Violentmonkey 等工具,将其作为解决服务限制的补丁。

API 的怪癖与配额:关于 Perplexity 的 API Rate Limits(区分请求限制和 Token 限制)及其对工程师工作流的影响存在困惑。同时,出现了关于 API 性能测试的讨论,用户更倾向于 Omni 模型,并寻求关于 Threads 功能的澄清,以支持对话上下文。

寻求升级 API 访问权限:用户继续施压要求改进 API 访问,表达了对更高 Rate Limits 和更快速支持响应的需求,这反映了对机器学习基础设施日益增长的需求。

工程师探索聊天之外的 AI:用户分享的链接显示其兴趣正扩展到 Stability AI 的潜力、体育锻炼带来的精神提升、系外行星 WASP-193b 的细节,以及通过 AI 辅助的《龙与地下城》(Dungeons & Dragons)剧本创作来为儿童生成引人入胜的内容。

OpenAI Discord

声音被沉默:OpenAI 已暂停在 ChatGPT 中使用 Sky 声音,并提供了一份声明和解释以回应用户的疑虑。

语言模型摆脱束缚:工程师们报告了在不使用 OpenAI API 的情况下运行 LangChain 的成功经验,并介绍了与 Ollama 等本地工具的集成。

GPT-4o 逐步推出但伴随摩擦:GPT-4 和 GPT-4o 之间的差异显而易见,后者在 Token 上下文窗口方面表现出局限性,且使用限制影响了实际应用。GPT-4o 增强的多模态能力得到了认可,官方分享了价格页面以及文件上传常见问题解答,以进一步明确使用细节。

Prompt 编写的挑战与创新:在工程领域,针对自我意识和技术集成的 Prompt 优化存在诸多挑战,但同时也在分享创新的 Prompt 策略,以提升创意和结构化生成的能力。JSON mode 被建议作为提高指令精确度的可行工具;OpenAI 的文档仍是首选参考资料。

API 的痛苦与收获:API 用户报告了 chat.completion.create 的不一致性,包括响应不完整的问题,并表现出对使用 JSON mode 来控制格式和内容的偏好。尽管存在小插曲,但关于协调创意的讨论非常热烈,有人提出了 “Orchestrating Innovation on the Fringes of Chaos”(在混沌边缘编排创新)作为一种探索性方法。

LM Studio Discord

-

LM Studio 的杀毒软件误报:LM Studio 用户注意到 llama.cpp 二进制文件因未签名而被 Comodo 杀毒软件拦截。建议用户在遇到安全警告时将其视为潜在问题。

-

模型加载与硬件讨论:关于各种 GPU 的讨论中,一位用户发现 Tesla P100 的表现低于预期。其他讨论指出 Alder Lake CPU 的 E-cores 会影响 GPT 的 Quantization(量化)性能。在 RAM 方面,更高的频率与更好的 LLM 性能直接挂钩。

-

GGUF 登上舞台:用户讨论了将 Hugging Face 的模型集成到 LM Studio 中,建议使用 GGUF 格式文件以确保兼容性。社区对最近推出的用于导入模型的 “HF -> LM Studio deeplink” 功能给出了积极反馈。

-

LLM 的创意用例交汇:从 OpenBioLLM 等医疗 LLM 推荐,到生成 SVG 和 ASCII 艺术的基准测试,用户正在积极探索多样化的应用。其中 MPT-7b-WizardLM 模型因其在生成无审核故事方面的潜力而受到关注。

-

LM Studio autogen 的缺陷与修复:讨论了 LM Studio 的 autogen 功能中导致简短响应的 Bug,修复方法是将 max_tokens 设置为 -1。用户还指出 LM Studio 的本地服务器与 OpenAI 规范之间存在差异,影响了 AutoGPT 等应用的 tool_calls 处理。

Stability.ai (Stable Diffusion) Discord

为 LoRAs 编写完美提示词:工程师们分享了一种在 Stable Diffusion 中利用多个 LoRAs 的提示词结构,但观察到超过三层后收益递减或出现问题,这暗示了潜在的优化空间。

初次使用 Stable Diffusion 的困扰:一个 ‘NoneType’ 对象属性错误导致一位新用户在首次运行 Stable Diffusion 时遇到障碍,引发了对故障排除专业知识的呼求,目前尚无明确解决方案。

SD3 的到来引发期待与质疑:对于 SD3 的发布,情绪呈现两极分化,既有怀疑也有乐观。Emad Mostaque 的推文证实工作正在进行中。

Topaz 之争:关于 Topaz 作为视频上采样解决方案的有效性引发了辩论。工程师们承认其强大之处,但将其与 ComfyUI 的吸引力进行了对比,强调了成本和功能等考量因素。

应对 SDXL 的重量级需求:一位用户强调了在处理 SDXL 模型对高分辨率的需求时,充足的 VRAM 至关重要。同时明确了 SDXL 和 SD1.5 需要不同的 ControlNet 模型。

Modular (Mojo 🔥) Discord

Mojo 在 Windows 上仍处于开发中 (WIP):尽管关注度很高,但 Mojo 尚未原生支持 Windows,目前需要 WSL;用户在 CMD 和 PowerShell 中遇到了问题,但 Windows 支持已指日可待。

Bend vs. Mojo:性能视角:讨论重点关注了 Chris Lattner 对 Bend 性能的见解,指出虽然它在单核上落后于 CPython,但 Mojo 是专为高性能场景设计的。这两种语言的社区都在期待增强功能和即将举行的社区会议。

Llama 的 Python 亲戚:社区注意到一个从零开始实现 Llama3 的项目,可在 GitHub 上找到,被描述为“一次构建一个矩阵乘法”,这是对语言内部细节的一次迷人探索。

深入探索 Mojo 内部机制:各项讨论包括将 nightly 设为默认分支以避免 DCO 失败的见解、Mojo 中潜在的列表容量优化、SIMD 优化辩论、关于类似 Rust 的 Vec::shrink_to_fit() 新列表方法的建议,以及解决导致段错误 (segfaults) 的别名问题。提到的关键点包括社区对列表初始化的贡献,这可能会带来性能提升,以及对性能产生积极影响的补丁。

工程师的思维内部:讨论了 PR DCO 检查失败的技术解决办法并提供了流程见解;不稳定的测试引发了关于修复和 CI 痛点的讨论;自定义数组类型中的段错误促使了同行调试环节。社区对分享有助于解开优化之谜的复杂细节表示赞赏。

LLM Finetuning (Hamel + Dan) Discord

-

LLM 工作坊和 Fine-tuning 讨论升温:参与者正准备参加即将举行的工作坊,包括 Jeremy Howard 的 Build Applications in Python 以及关于 RAG 模型优化的会议。提出了关于 Finetuning 的实际问题,例如使用 LlamaParse 和 GPT-4o 等工具的 PDF 解析技术,以及如何使用 FastAPI 和 Streamlit 等框架部署 Fine-tuned LLMs。

-

技术大牛排障并协作应对挑战:来自不同地区的亚洲爱好者正在建立联系并解决诸如 Modal 命令错误等挑战,讨论在车辆故障预测中进行 Fine-tuning 的潜力,并就预训练 LLMs 的 LoRa 配置进行头脑风暴。

-

跨平台积分记录持续更新:参与者正在处理 JarvisLabs 等服务的积分获取和确认流程,组织者在幕后协调以确保积分分配到账户,有时会因邮箱不匹配而面临注册障碍。

-

学习资源汇集:重点介绍了从 Hamel 的博客到关于 GPT-4V 开源替代方案的 CVPR 2024 论文等知识库。大家在讨论是否将这些精华内容存放在公共 GitHub 仓库中,并寻找更有效地组织学习材料的方法。

-

新加坡用户活跃:亚洲时区频道中来自新加坡的人数出奇地高,引发了对该国代表性显著的评论。随着新成员的加入,现场气氛热烈,大家在处理积分安排的同时利用各种学习机会。

渴望学习的人和新兴专家都投身于 Fine-tuning、数据提取、应用及 LLMs 其他方面的变革浪潮中,这预示着一个充满智力协同和对实际 AI 工程能力不懈追求的时期。

Nous Research AI Discord

-

Benchmarks 和 AGI 讨论激发工程师好奇心:工程师们考虑需要改进 Benchmarks,呼吁建立“支持高达 2M 的现代 LAMBADA”来评估独立处理重叠块的模型,并讨论了一篇关于 AGI 进展和必要策略的论文,题目为《人工智能的演变》。

-

Sam Altman 模仿推文引发笑声、VC 怀疑和 AI 经济谜题:一条挑衅性的 Sam Altman 模仿推文引发了关于 VC 在 AI 中的角色、AI 对公司裁员的实际财务影响的讨论,以及一名成员关于参加 Runpod 黑客松的咨询。

-

Hermes 2 Mixtral:面向行动的 LLMs 的开端:Nous Hermes 2 Mixtral 因其在 CrewAI Agent 框架内触发行动的独特能力而受到赞誉,讨论还涉及多语言能力、多轮对话数据的重要性以及高昂的训练成本。

-

模型利用策略:工程师们比较了对 Llama3 和 GPT-4 等模型进行 Finetuning 与高级 Prompting 的效果,同时他们也在寻找 Fine-tuned 重排序器的 Benchmarks,并强调了本地模型在处理具有敏感性和可预测性需求任务时的优势。

-

WorldSim 随着终端 UX 翻新进入 GPT-4o 时代:WorldSim 进行了终端 UX 翻新,并即将集成 GPT-4o,同时社区参与了复杂自适应系统、符号知识图谱的讨论,并探索了 WorldSim 在生成 AI 相关知识图谱方面的潜力。

CUDA MODE Discord

Hugging Face 向 AI 社区投入 1000 万美元:Hugging Face 承诺投入 1000 万美元,为初创公司和学术界提供免费的共享 GPU 资源,作为其推动 AI 开发民主化努力的一部分。其 CEO Clement Delangue 在一轮大规模融资后宣布了这一消息,详情见 The Verge 的报道。

编程领域的新选手 Bend:一种名为 Bend 的新型高级编程语言登场,引发了关于其相对于 Triton 和 Mojo 等现有 GPU 语言优势的讨论。尽管 Mojo 在 GPU 上存在局限性,且 Triton 专注于机器学习,但 Bend 的优势在 GitHub 上得到了阐述。

优化机器学习推理:专家们就构建高效推理服务器交换了建议,推荐使用 Nvidia Triton 和 TorchServe 进行模型服务。重点贡献包括在使用 torch.compile() 处理静态形状(static shapes)时应用优化,并参考 GitHub 上的代码改进以更好地支持 NHWC 格式的组归一化(group normalization),详见此 pull request。

CUDA 的复杂性——加法与内存:围绕 cuda::complex 的原子操作(atomic operations)以及 128 位 atomicCAS 的阈值限制展开了激烈的辩论。社区分享了处理复数的代码变通方法和公认的方法论,并讨论了 Torch 中原地乘法(in-place multiplication)期间潜在的内存开销。

扩展与优化 CUDA 挑战:社区剖析了梯度裁剪(gradient clipping)、内存优化模板化以及 ZeRO-2 实现中的问题。他们分享了多个 GitHub 讨论和 pull requests(#427, #429, #435),表明了对性能和微调 CUDA 应用的高度关注。

解决 ParPaRaw 解析器性能问题:有关 libcudf 与 CPU 并行操作基准测试的询问不断出现,暗示了社区对高效解析的热情,并注意到 GPU 相对于 CPU 的性能提升。关注点还集中在 Dask-cuDF 合并入 cuDF 以及前者随后的归档,详见 GitHub。

深入了解 GPU 查询引擎:一位来自 Voltron 的 cuDF 资深人士即将发表演讲,分享关于构建 GPU 原生查询引擎的见解,阐明从内核设计到生产部署的策略。可通过此 Zoom 会议 获取参与详情。

CUDA 架构师深入探讨 GPU 基础知识:分享了一个指向 CUDA 架构师 Stephen Jones 在 YouTube 上演讲的链接,该演讲清晰地阐述了 GPU 编程和高效内存使用策略,这对于现代 AI 工程任务至关重要。通过此处的链接深入了解 GPU 的工作原理。

Neural Magic 为 CUDA/Triton 创新招募人才:Neural Magic 正在寻找热衷于 CUDA/Triton 项目的工程师,重点关注激活量化(activation quantization)。他们特别感兴趣于利用 2:4 稀疏性等下一代 GPU 特性,并进一步优化 MoE 和采样中的内核。

解析 PyTorch 与 CUDA 的交互:针对 PyTorch 与 CUDA 的高效数据类型打包/解包进行了详细的头脑风暴,重点关注 uint2、uint4 和 uint8 类型。项目管理和协作编程在讨论中占据重要地位,并提及了用于自定义 CUDA 扩展管理的 GitHub Premier #135 。

屏障同步简化:一位社区成员通过将屏障同步(barrier synchronization)比作确保所有学生在参观完博物馆后都回到巴士上,帮助他人理解这一概念。这是一个贴切的比喻,支撑了 GPU 操作中的同步过程。

民主化 Bitnet 协议:大家正共同努力举办 Bitnet 小组会议并审查重要的技术文档,量化讨论集中在将 uint4 转换为 uint8 类型。正如协作驱动中所提到的,共享资源正在指导这些会议。

Eleuther Discord

-

CC 数据集中的垃圾信息警报:Eleuther 社区在 Common Crawl (CC) 数据集中发现了大量垃圾信息,其中中文文本受影响尤为严重。《Technology Review》一篇关于 GPT-4o 标记污染的文章强调了类似的担忧,指出了非英语数据清洗中的问题。

-

OpenELM 专注于效率:一种名为 OpenELM 的新 LLM 因其可复现性以及比 OLMo 提高 2.36% 的准确率而引起了成员们的兴趣。欲了解详情,请查看 OpenELM 研究页面。

-

AI 内存效率备受关注:模型训练中计算 FLOPs 的挑战引起了关注,EleutherAI 的 cookbook 提供了准确估算的指南,这是优化内存和计算资源使用的关键环节。

-

跨模态学习成为焦点:研究人员正在探索像 ImageBind 和 PaLM-E 这样的模型在多模态数据训练后是否对单模态任务有益。Zero-shot 识别和模态特定嵌入的集成可以增强检索性能,ImageBind 和 PaLM-E 等论文是这一对话的核心。

-

模型微调的优势与怪癖:成员们注意到了 HF 模型中的自动提示设置,并讨论了微调技术,包括非 pipeline 情况下的 soft prompt tuning。然而,也出现了一些问题,例如在调用

model.to_sequential()后param.requires_grad会重置,这可能会阻碍开发进程。

Interconnects (Nathan Lambert) Discord

Meta、DeepMind 和 Anthropic 的模型混战:Meta 的 Chameleon 模型拥有 34B parameters,在人工评估中表现优于 Flamingo 和 IDEFICS。DeepMind 的 Flash-8B 提供了多模态能力和效率,而其 Gemini 1.5 模型在基准测试中表现出色。与此同时,Anthropic 的计算量比其上一个模型扩大了四倍,LMsys 的 “Hard Prompts” 类别为 AI 评估带来了新挑战。

AI 安全团队解散引发动荡:OpenAI 的 superalignment team(包括 Ilya Sutskever 和 Jan Leike)在对 OpenAI 政策的分歧和批评中解散。OpenAI 的离职协议因极具争议的终身不贬低条款(nondisparagement clauses)而引起了特别的愤怒。

播客思考与游戏荣耀:Retort AI podcast 分析了 OpenAI 的举动,引发了关于词汇表大小 Scaling Laws 的辩论,并带点幽默地引用了控制理论中的滞后现象(hysteresis)。成员们怀旧地分享了《使命召唤》(Call of Duty) 的游戏渊源以及在 YouTube 上创作学术内容的抱负。

对 ORPO 保持谨慎:对 ORPO 方法的可扩展性和有效性的怀疑有所增加,社区成员分享的测试结果表明可能存在过度正则化(over-regularization)的风险。随着该方法被添加到 Hugging Face 库中,对其的担忧进一步放大。

挑战 Chinatalk 并从 Llama3 中学习:对 Chinatalk 剧集的赞赏、llama3-from-scratch 作为学习资源的价值,以及一篇解释 Latent Consistency Models 的巧妙 Notion 博客,为自我提升提供了信息化建议。然而,关于 Books4 数据集法律风险的警告也为对话增添了紧张气氛。

Latent Space Discord

-

Scaling Up 是秘诀:Geoffrey Hinton 认可了 Ilya Sutskever 关于 Scaling(规模化)是 AI 成功的关键这一信念,并表示:“[Ilya] 总是宣扬只要把它做大,它就会运行得更好。事实证明 Ilya 基本上是对的。” 讨论中重点提到了一段 完整采访,Hinton 在其中分享了这一见解。

-

垂直轴风力发电的新风向:EPFL 的研究人员利用遗传算法优化了垂直轴风力涡轮机,旨在超越水平轴版本的局限性。这项工作有望带来更安静、更环保的涡轮机,详情见 完整文章。

-

AI Agent,包含自由意志吗?:讨论围绕 AI Agent 的自主性展开,包括 Andrew Ng 对 AI Agent 的看法 以及 Gordon Brander 在分享的 YouTube 视频 中关于自适应 AI 的断言。

-

首席对齐师离职:在 Jan Leike 辞去 OpenAI 对齐负责人职务后,社区思考了其影响,同时 Sam Altman 和 Greg Brockman 也分享了他们的看法,详见 此处。

-

AI 编程语言之争:随着 Hugging Face 在 Candle 和 tokenizers 等项目中采用 Rust,以及 Go 在基于 HTTP 请求的 AI 应用中保持其地位,关于哪种语言在 AI 开发中占据主导地位的争论依然激烈。

LlamaIndex Discord

-

内存对自主 Agent 至关重要:一场关于 memary 项目的网络研讨会定于周四上午 9 点(太平洋时间)举行,重点讨论自主 Agent 的长期记忆。对记忆挑战和未来方向感兴趣的 AI 工程师可以 报名参加活动。

-

表格削弱了 QA 效果:LLM 仍被复杂的表格(如 Caltrain 时刻表)难住,由于解析效果差导致幻觉问题,更多详情见 此分析。

-

大幅提升向量搜索速度:JinaAI_ 分享了使用 32-bit 向量将向量搜索速度提高 32 倍的方法,仅牺牲了 4% 的准确率——这是生产环境应用的关键优化。

-

旧金山 AI 思想集会:LlamaIndex 计划在总部举行一场线下的旧金山见面会,重点讨论高级 RAG 引擎技术,预约链接见 此处。

-

数据治理的 Metadata 诀窍:工程师们阐述了 MetaDataFilters 在 LlamaIndex 数据库层级进行数据治理的效用,并提出了对敏感财务数据进行选择性索引的想法。

-

与 GPT-4o 集成:一次显著的讨论涉及 GPT-4o 与 LlamaParse 的集成,关于该主题的 Medium 文章 获得了社区成员的认可和好评。

LAION Discord

-

有争议的许可限制隐现:CommonCanvas 数据集提供了 7000 万图像-文本对,但因其限制性的非商业许可和禁止衍生品的规定引发了争论,这令看到有益修改潜力的成员感到沮丧(CommonCanvas 公告)。

-

技术对话——PyTorch 困扰工程师:关于 PyTorch 的

native_group_norm在不使用torch.compile时导致速度变慢的讨论非常激烈;一位成员指出 eager mode 与编译方法的性能几乎持平。 -

数据集完整性受审视:AI 工程师们担心训练视觉语言模型 (VLLMs) 和文本生成图像模型 (T2I) 时幻觉标注的影响,同时也表达了创建高质量开源数据集以避免此类问题的意愿。

-

多模态领域的新秀:Chameleon 模型因其出色的图像和文本理解及生成能力而受到认可,在图像标注和生成任务中表现出优于 Llama-2 等大型模型的潜力(Chameleon arXiv 论文)。

-

CogVLM2 有争议的条款:成员们被提醒注意 CogVLM2 模型的许可协议,其中包括可能限制用于损害中国利益的条款,并规定由中国管辖争议(CogVLM2 许可证)。

AI Stack Devs (Yoko Li) Discord

4Wall Beta 发布:4Wall 这一 AI 驱动的娱乐平台已进入 Beta 测试阶段,提供无缝的 AI Town 集成以及用于创建地图和游戏的用户生成内容(UGC)工具。正如其公告所示,他们还在开发 3D AI 角色。

Game Jam 冠军:Rosebud / #WeekOfAI 教育 Game Jam 公布了获胜者,包括 “Pathfinder: Terra’s Fate” 和 “Ferment!”,突显了 AI 在教育游戏领域的潜力。游戏可以在此处访问,更多详情见公告推文。

AI Town 的 Windows 里程碑:AI Town 已实现对 Windows 的原生兼容,并在 Tweet 中进行了庆祝,这引发了关于创新实现的讨论,包括使用 GitHub - Townplayer 等工具进行对话转储的方法。此外,用户正在探索 AI Town 中结合深度世界背景集成的创意场景。

AI Reality TV 发布:互动式 AI Reality TV 平台的发布引起了社区关注,邀请用户模拟与 AI 角色的社交互动,正如此公告所述。

故障排除与技术技巧:AI 工程师们交流了 AI Town 设置问题的解决方案,包括解决 Agent 通信问题和从 SQLite 数据库提取数据的建议。建议包括查阅内存系统文档以及调整 AI Town 内部设置。

OpenRouter (Alex Atallah) Discord

- 服务器拒绝 Function Calls:工程师们在使用 OpenRouter 时遇到了障碍,服务器返回 500 状态码并提示错误消息 “Function calling is not supported by openrouter”,该问题在讨论中尚未解决。

- 404 错误处理失误:用户发现了一个缺陷,即无效的模型 URL 会导致应用程序错误并显示消息,而不是显示 404 页面,这表明基于登录状态的用户体验不一致。

- 支付故障:社区讨论了自动充值支付被拒的问题,导致用户无法手动充值,怀疑是由于用户银行(特别是 WISE EUROPE SA/NV)的拦截造成的。

- 模型推荐:用户交流了模型推荐,重点介绍了 “Cat-LLaMA-3-70B” 和 Midnight-Miqu 模型,并呼吁采用更好的微调策略,而不是使用“随机的未清洗数据”。

- 不稳定的 Wizard LM 服务:用户在 OpenRouter 上使用 Wizard LM 8x22B 时遇到了间歇性的请求失败,这归因于多个供应商普遍出现的临时请求超时 (408) 激增。

OpenAccess AI Collective (axolotl) Discord

-

Galore 工具缺乏 DDP 支持:工程师们强调了 Galore Layerwise 工具无法支持 Distributed Data Parallel (DDP),指出了其在扩展使用方面的重大局限性。

-

大规模中文数据集的训练困境:讨论集中在 使用 10 亿中文 tokens 微调 8B 模型,并关注了 Multimodal Art Projection (M-A-P) 和 BAAI 数据集,暗示了多语言模型训练的趋势。

-

Llama 的梯度增长问题:Llama 3 8B 模型 观察到一个技术挑战,即低秩微调会导致 梯度范数 (gradient norm) 无限制增加,这表明可能存在权重饱和和梯度更新的问题。

-

GPT-4o 的 Token 麻烦:最近关于 GPT-4o 的反馈发现,其 token 数据包含垃圾信息和色情短语,引发了对其语言处理质量和清洁度的担忧,尤其是在中文方面。

-

Commandr 配置进展:社区持续提供支持和贡献,例如一个 特定的 GitHub pull request,旨在增强 axolotl 的 Commandr 设置,表明项目正在积极迭代和解决问题。

-

Axolotl 配置困惑:工程师们分享了特定的用例问题:一个涉及在持续预训练期间由于词表外填充 tokens 导致的 非法内存访问错误;另一个详细描述了在微调 Mistral 7b 时的问题,尽管 loss 下降,但模型的学习效果并不理想。

-

Axolotl-Phorm Bot 见解:来自 axolotl-phorm bot 频道的关键要点包括:探索用于数据结构化的 ORPO 格式;关于使用 weight decay 和 LoRA Dropout 来避免 LLM 训练中过拟合的阐述;通过 Hugging Face Accelerator 库 进行梯度累积 (gradient accumulation) 的好处;以及关于在 Axolotl 的损失函数中实现样本权重而无需额外自定义的讨论。

LangChain AI Discord

内存对模型魔力的重要性:讨论了在代理后端使用 cross-encoders 进行重排序 (Re-ranking),重点关注 OpenAI GPTs 和 Gemini 模型。人们对 短期记忆解决方案 感兴趣,例如用于聊天机器人维持对话上下文的缓冲区。

LangChain 获得指引:关于 在 LangChain 中引导模型响应 的查询促成了 PromptTemplate 解决方案的分享,并引用了 关于该主题的 GitHub issue。同时,面向 Swift 开发者的 LangChain 已发布,提供了在 iOS 和 macOS 平台上工作的资源,详见 LangChain Swift 的 GitHub 仓库。

SQL 是关键:LangChain 与 SQL 数据 的应用为跨数据集总结概念打开了大门。对话转向将 SQL 数据库集成为内存解决方案的方法,相关指南可见于 LangChain 文档。

Langmem 的长期记忆精通:Langmem 的上下文管理能力 受到赞赏。YouTube 演示展示了 Langmem 如何在对话中有效地切换上下文并保持长期记忆,突显了其在复杂对话任务中的实用性 (Langmem 演示)。

可疑链接充斥 Feed:多个频道报告了 可疑的 50 美元 Steam 礼品链接 (可疑链接) 的传播,警告成员谨慎行事,并暗示该链接很可能是欺诈性的。

AI 的魔方:Rubik’s AI 承诺提供增强的研究协助,使用 促销代码 RUBIX 可获得两个月的免费高级功能访问权限。

玩转 RAG-Fusion:有一个关于 RAG-Fusion 的教程,强调了其在 用于文档处理的 AI 聊天机器人 中的应用,并强调了其相对于 RAG 单查询限制的多查询能力。该教程为工程师提供了使用 LangChain 和 GPT-4o 的见解,可在 LangChain + RAG Fusion + GPT-4o 项目 查看。

Cohere Discord

-

Discord 支持系统请求改版:一名成员呼吁改进 Discord 支持系统,理由是许多咨询未得到处理。有人指出,目前的系统运作方式更像是一个社区支持平台,而非由官方人员维护。

-

速率限制影响 Trial API 用户:用户在使用

RAG retriever时遇到 403 错误,这归因于触发了 Trial API 的速率限制,该 API 并非为生产环境设计。 -

用户咨询免费 API 密钥:讨论涉及 Cohere 免费 API 密钥的可用性和范围,并澄清这些密钥旨在用于初步原型设计,且带有特定的使用限制。

-

翻译服务求助:有用户寻求使用

CommandR+进行翻译服务的帮助,并得到了指向 Chat API 文档 的指引,该文档提供了实现指南。 -

展示 Cohere AI 的实际应用:分享了一份名为“Cohere AI 完整指南”的新资源,并在 Analytics Vidhya 平台 上提供了完整的安装和使用说明。配套的演示应用可以在 Streamlit 进行测试。

OpenInterpreter Discord

Hugging Face GPU 盛宴:Hugging Face 正向小型开发者、学术界和初创公司捐赠价值 1000 万美元的免费共享 GPU 资源,利用其财务地位和近期投资,正如 The Verge 文章 中所述。

OpenInterpreter 攻克 Pi 5 和 DevOps:OpenInterpreter 已成功部署在运行 Ubuntu 的 Pi 5 上,并讨论了涉及项目集成的合作,包括潜在的 Azure 额度支持。此外,一名初级全栈 DevOps 工程师正在寻求社区帮助,以开发一个 “lite 01” AI 助手模块。

技术技巧与窍门:分享了在不同平台上解决 OpenInterpreter 环境设置问题的方案,讨论重点集中在 WSL、虚拟环境和 IDE 的使用。通过一个用于 Flutter 集成的 GitHub 仓库 提供了进一步的帮助,并收到了关于名为 O1 Lite 设备开发帮助的请求。

语音 AI 的机器人腔调:社区讨论批评语音 AI 与 GPT-4 的文本能力相比缺乏自然感,同时 YouTube 视频 中强调了语音助手具备中断能力的构想。

活动与社区参与:发布了邀请社区参加首届无障碍圆桌会议(Accessibility Round Table)和专注于本地开发的直播通知,旨在促进直播环境下的参与和知识分享。

Mozilla AI Discord

-

RAG 调试风波:一个嵌入模型的问题导致在 RAG 教程期间出现段错误(segfault),错误信息为 “llama_get_logits_ith: invalid logits id 420, reason: no logits”。经确认,该问题是由于使用了“仅嵌入(embeddings-only)”模型引起的,此类模型不具备生成任务的能力,这一细节在 Mozilla 教程 中可能被忽略了。

-

云服务选择:支持 GPU 的云服务成为热门话题,工程团队推荐了像 vast.ai 这样的供应商,用于实验和处理临时计算负载。

-

SQLite 遇见向量:Alex Garcia 带着他的 sqlite-vec 项目参与了讨论,这是一个支持向量搜索的 SQLite 扩展,引发了将其与 Llamafile 集成以增强内存和语义搜索能力的兴趣。

-

Llamafiles 澄清:一个关键的澄清:其教程中链接的 Mozilla Llamafile 嵌入模型 不具备生成能力,这一点需要重点说明以明确用户的预期。

-

模型部署创新:关于在各种平台上战略性部署 Llamafile 模型的讨论正热,这表明云供应商提供的 GPU 算力是实际实验的关注焦点。

MLOps @Chipro Discord

微调热潮兴起:工程师们对 LLM 微调课程 表达了复杂的看法。一些人认为其在 LLM 训练、评估和 Prompt Engineering 方面的动手实践方法很有价值,而另一些人则持怀疑态度,对营销手段下的内容质量表示担忧。

课程内容参差不齐:课程参与者反馈体验各异,一些人认为入门材料较为基础,但这取决于个人的背景;这说明了针对不同专业水平调整内容难度的挑战。

区间预测:MAPIE 文档 成为那些希望实现预测区间的人员的关键资源。此外,还讨论了关于 Conformal Prediction 的见解,并提到了适用于时间序列数据的 Nixtla。

从 Inpainting 演进的 Embeddings:与掩码语言建模(Masked Language Modeling)类似,通过 Inpainting 技术推导图像 Embeddings 成为关注的话题,强调了一种从可见数据估计未见图像特征的方法。

多语言实体进入评估阶段:讨论了跨语言比较实体的策略(例如 “University of California” 和 “Universidad de California”),可能结合了对比学习(Contrastive Learning)和特定语言的前缀,并提到了 arxiv 论文 以供进一步阅读。

tinygrad (George Hotz) Discord

-

寻求 YOLO 在 Comma 上的运行速度:围绕在 Comma 设备上运行 YOLO 模型的各种可行性和性能指标展开了讨论,目前的报告显示 预测时间约为 1000ms。

-

多项式精度的权衡:一位工程师报告称使用 11 阶多项式进行正弦近似,产生了 1e-8 的误差,同时在评估使用更高阶多项式以达到 1e-12 误差的可能性,尽管存在计算效率方面的担忧。

-

对数和指数近似的担忧:讨论重点包括在对数和指数函数的多项式近似中保持准确性的困难,建议使用范围缩减(Range Reduction)技术,这可能有助于平衡精度与复杂度。

-

思考 tinygrad 中的位移操作:关于 tinygrad 内部位移效率的询问,具体在于是否有比

x.e(BinaryOps.DIV, 2 ** 16).e(BinaryOps.MUL, 2 ** 16)更精简的方法。 -

揭秘 Metal 编译器:

- 一位参与者对 Metal 编译器展开 for 循环的决策表示好奇,指出在调用

Tensor.arange(1, 32)与Tensor.arange(1, 33)时生成的代码存在差异。 - 提出了一个谜题:为什么 32 这个数字会特别影响 Metal 编译器的编译行为,并强调了这一神秘阈值对性能产生的影响。

- 一位参与者对 Metal 编译器展开 for 循环的决策表示好奇,指出在调用

Datasette - LLM (@SimonW) Discord

-

Squeak 与 Claude 的碰撞:出现了一场关于将 Claude3 与 Squeak Smalltalk 集成的讨论,显示出将尖端 AI 与经典编程环境结合的兴趣。具体的实际应用细节仍有待商榷。

-

语音模式焕然一新:在 GPT-4o 中,由于担心与 Scarlett Johansson 的声音相似,名为 Sky 的语音被替换为 Juniper。GPT-4o 从多模型转向单一模型的方法旨在降低延迟并增强情感表达,尽管这增加了复杂性(语音聊天常见问题解答)。

-

AI 的双刃剑:随着 GPT-4o 等模型的演进,它们面临着诸如 Prompt Injection 风险和不可预测行为等挑战,这些问题可能与遗留系统遇到意外命令时一样棘手。

-

永无止境的改进循环:呼应了 Stainslaw Lem 的《颠倒的进化》(The Upside-Down Evolution),讨论了 AI 和其他复杂系统的韧性,并达成共识:虽然完美的可靠性是一种神话,但培养容错设计(Fault-tolerant designs)至关重要——即使这会导致新的预料之外的问题。

LLM Perf Enthusiasts AI Discord

法律专家关注 GPT-4o:AI 工程师指出,与 GPT-4 和 GPT-4-Turbo 等前代模型相比,GPT-4o 在复杂的法律推理方面表现出显著进步。相关改进和方法论已在 Evan Harris 的 LinkedIn 文章中分享。

YAIG (a16z Infra) Discord

- 征集 Docker 开发者进行 AI 协作:目前正在为一篇关于使用 Docker 训练和部署 AI 模型的即将发布的文章征集贡献者。发起者正在寻求在撰写、贡献或审阅文章方面的帮助,并邀请感兴趣的工程师通过私信进行协作。

DiscoResearch Discord 没有新消息。如果该频道长时间保持沉默,请告知我们,我们将将其移除。

AI21 Labs (Jamba) Discord 没有新消息。如果该频道长时间保持沉默,请告知我们,我们将将其移除。

第 2 部分:频道详细摘要与链接

Unsloth AI (Daniel Han) ▷ #general (718 条消息 🔥🔥🔥):

- Deepseek 尚无法运行:用户讨论了由于架构不同,Deepseek 目前无法正常工作。一位用户指出 “它可能无法运行”,另一位用户确认 “Deepseek 暂时还不行”。

- 在 Colab/Kaggle 上处理大型数据集:有用户询问 6GB 的数据集是否能与 5GB 的 Llama3 模型一起放入 Colab 或 Kaggle T4 中。意见虽有分歧,但有人指出 “datasets (hf 库) 不会将数据集加载到 RAM 中”;因此,这更多是存储问题,而非 VRAM 限制。

- 尽管存在质疑,JAX TPU 训练效果良好:关于在 TPU 上使用 JAX 展开了激烈辩论,一位用户断言它在 Google TPU 上训练良好。“即使使用 torch 也可以在 TPU 上训练,但 JAX 基本上是生产环境中的主要选择”,这是一项关键见解。

- 讨论有效的微调技巧:值得注意的是,kearm 讨论了一种改进的方法,通过使用 “正交化 bfloat16 safetensor 权重” 来 “移除 Meta-Llama 模型中的护栏”,并建议 Llama-3-70B Instruct 现在可以进行高效且低成本的微调。

- 法律问题与 AI 微调:用户思考了使用知名 IP 进行模型微调的风险,同时其他人提到了正在进行的诉讼,例如 Scarlett Johansson 起诉 OpenAI。“她可能会赢”,这种情绪在法律纠纷的讨论中得到了共鸣。

- Google Colab: 未找到描述

- config.json · NexaAIDev/Octopus-v4 at main: 未找到描述

- UNSLOT - 概览: 正在输入... GitHub 是 UNSLOT 构建软件的地方。

- 困惑的表情 GIF - Confused Confused look Confused face - 发现并分享 GIF: 点击查看 GIF

- 令人惊叹的 GPU 新编程语言刚刚发布...: 什么是用于并行计算的 Bend 编程语言?让我们初步了解 Bend 及其如何使用类 Python 语法来编写高性能 ...

- 未找到标题: 未找到描述

- failspy/llama-3-70B-Instruct-abliterated · Hugging Face: 未找到描述

- Google Colab: 未找到描述

- Blackhole - lamhieu 收藏集: 未找到描述

- failspy/Meta-Llama-3-8B-Instruct-abliterated-v3 · Hugging Face: 未找到描述

- Quantization: 未找到描述

- 未找到标题: 未找到描述

- 忧伤的小猫 GIF - Sad Sad cat Cat - 发现并分享 GIF: 点击查看 GIF

- 爆炸轰鸣 GIF - Explosion Boom Iron Man - 发现并分享 GIF: 点击查看 GIF

- Big Ups Mike Tyson GIF - Big Ups Mike Tyson Cameo - 发现并分享 GIF: 点击查看 GIF

- 不不等等 GIF - No no wait wait - 发现并分享 GIF: 点击查看 GIF

- 惊喜欢迎 GIF - Surprise Welcome One - 发现并分享 GIF: 点击查看 GIF

- gradientai/Llama-3-8B-Instruct-262k at main: 未找到描述

- Reddit - 深入探索一切: 未找到描述

- mlx-examples/llms/mlx_lm/tuner/trainer.py at 42458914c896472af617a86e3c765f0f18f226e0 · ml-explore/mlx-examples: MLX 框架中的示例。通过在 GitHub 上创建账号,为 ml-explore/mlx-examples 的开发做出贡献。

- GitHub - unslothai/unsloth: 微调 Llama 3, Mistral & Gemma LLM,速度提升 2-5 倍,显存占用减少 80%: 微调 Llama 3, Mistral & Gemma LLM,速度提升 2-5 倍,显存占用减少 80% - unslothai/unsloth

- GitHub - unslothai/unsloth: 微调 Llama 3, Mistral & Gemma LLM,速度提升 2-5 倍,显存占用减少 80%: 微调 Llama 3, Mistral & Gemma LLM,速度提升 2-5 倍,显存占用减少 80% - unslothai/unsloth

- 自然语言提升了 LLM 在编码、规划和机器人技术方面的性能: MIT CSAIL 研究人员创建了三种神经符号方法,帮助语言模型在自然语言中构建更好的抽象库:LILO 辅助代码合成,Ada 帮助 AI 规划...

- Google Colab: 未找到描述

- LLM 中的拒绝行为是由单一方向介导的 — LessWrong: 这项工作是 Neel Nanda 在 ML Alignment & Theory Scholars Program - 2023-24 冬季班项目中的一部分,由...共同指导。

- Steering GPT-2-XL by adding an activation vector — LessWrong:通过添加激活向量来引导 GPT-2-XL — LessWrong。给模型的提示词 [1] 我讨厌你,因为 GPT-2 我讨厌你,因为你是我见过的最恶心的东西。GPT-2 + “Love” 向量我讨厌……

- Refusal in LLMs is mediated by a single direction — AI Alignment Forum:这项工作是 Neel Nanda 在 ML Alignment & Theory Scholars Program - 2023-24 冬季班中的一部分,由……共同指导。

Unsloth AI (Daniel Han) ▷ #random (55 messages🔥🔥):

-

Python 中的 Regex 和文本格式化:成员们讨论了使用 Python 识别相似格式文本的技术。建议包括使用 Regex (

re.findall) 以及使用text.isupper()检查全大写。 -

对 Sam Altman 和 OpenAI 的批评:针对 Sam Altman 的领导能力和 OpenAI 的影响力发表了强烈看法。评论反映了对 Altman 散布恐惧的策略以及科技界对财富和权力的偶像崇拜的反感。

-

在许可证中排除 OpenAI:Cognitive Computations 正在修改许可证,禁止 OpenAI 和加利福尼亚州使用其模型和数据集。此举旨在传达他们反对当前 AI 领导层和政策的信息。

-

华盛顿特区的 AI 安全游说:一篇分享的 Politico 文章 讨论了 AI 游说者如何将华盛顿的辩论焦点从生存风险转向商业机会,并特别关注中国。

-

内容推荐:成员们分享了一些有趣内容的链接,包括一段关于 GPU 的 Bend 编程语言的 YouTube 视频、一段 Instagram reel,以及一个名为 “Dachshund Doom and Cryptid Chaos” 的 YouTube 播放列表。

- In DC, a new wave of AI lobbyists gains the upper hand:在华盛顿,新一波 AI 游说者占据了上风。由科技巨头、初创公司和风险投资家组成的联盟正斥资数百万美元,试图说服华盛顿,对 AI 末日的恐惧被夸大了。到目前为止,这一策略奏效了。

- Dachsund Doom and Cryptid Chaos:未找到描述

- Mind-bending new programming language for GPUs just dropped...:什么是用于并行计算的 Bend 编程语言?让我们初步了解 Bend,以及它如何使用类似 Python 的语法来编写高性能……

- the forest jar on Instagram: "be realistic":3.8 万个赞,514 条评论 - theforestjar 于 2024 年 4 月 11 日发布:"be realistic"。

Unsloth AI (Daniel Han) ▷ #help (454 messages🔥🔥🔥):

- **Llama3 使用 torch.float16 时报错**:用户尝试使用 **torch.float16** 训练 Llama3,但遇到错误提示建议改用 bfloat16。他们寻求解决方案,但没有找到行之有效的方法。

- **Databricks 中的 torch 和 CUDA 问题**:**Torch** 在 Databricks 的 A100 80GB 上运行时引发错误。用户讨论了潜在的修复方案,如**将 torch 参数设置为 False** 或更新软件版本,但仍面临挑战。

- **上传和使用 GGUF 模型**:**用户在没有配置文件的情况下,在 Hugging Face 上上传和运行模型时面临挑战**。解决方案包括从预训练模型中获取配置文件,或确保格式正确并进行更新。

- **热切期待多 GPU 支持**:**社区成员对 Unsloth 的多 GPU 支持表示热切期待**,该功能正在开发中,尚未发布。

- **环境搭建故障排除**:参与者在 **WSL 和原生 Windows 上为 Unsloth 搭建环境时遇到困难**,特别是在安装 **Triton** 等依赖项时。

- Quantization:未找到描述

- Google Colab:未找到描述

- 使用 LoRA 和 QLoRA 微调 LLM 的深度指南:在本博客中,我们详细解释了 QLoRA 的工作原理,以及如何使用 Hugging Face 对模型进行微调。

- unsloth/llama-3-8b-Instruct-bnb-4bit · Hugging Face:未找到描述

- 使用 LoRA 和 QLoRA 微调 LLM 的深度指南:在本博客中,我们详细解释了 QLoRA 的工作原理,以及如何使用 Hugging Face 对模型进行微调。

- 使用 Unsloth 微调 Llama 3:通过 Unsloth 轻松微调 Meta 的新模型 Llama 3,支持 6 倍长的上下文长度!

- omar8/bpm_v2_gguf · Hugging Face:未找到描述

- Inference Endpoints - Hugging Face:未找到描述

- omar8/bpm__v1 at main:未找到描述

- Transformer 数学入门:我们介绍了与 Transformer 计算和内存使用相关的基础数学。

- gradientai/Llama-3-8B-Instruct-262k at main:未找到描述

- 小猫 GIF - 小猫哭泣 - 发现并分享 GIF:点击查看 GIF

- yahma/alpaca-cleaned · Hugging Face 数据集:未找到描述

- GitHub - conda-forge/miniforge:一个 conda-forge 发行版。:一个 conda-forge 发行版。通过在 GitHub 上创建账号为 conda-forge/miniforge 的开发做出贡献。

- GitHub - unslothai/unsloth:微调 Llama 3、Mistral 和 Gemma LLM,速度提升 2-5 倍,内存占用减少 80%:微调 Llama 3、Mistral 和 Gemma LLM,速度提升 2-5 倍,内存占用减少 80% - unslothai/unsloth

- 我在原生 Windows 中运行了 Unsloth。· Issue #210 · unslothai/unsloth:我在原生 Windows(非 WSL)中运行了 Unsloth。你需要 Visual Studio 2022 C++ 编译器、Triton 和 DeepSpeed。我有一个完整的安装教程,我本想写在这里,但我现在在用手机...

- Apple Silicon 支持 · Issue #4 · unslothai/unsloth:很棒的项目。希望能看到对 Apple Silicon 的支持!

- 未找到标题:未找到描述

- 由 slaren 移除 convert-lora-to-ggml.py · Pull Request #7204 · ggerganov/llama.cpp:模型转换过程中张量的排列等变化使得从 HF PEFT 转换 LoRA 变得不可靠,因此为了避免混淆,我认为在功能完善前最好将其完全移除...

- Google Colab:未找到描述

- Google Colab:未找到描述

- Google Colab:未找到描述

- Google Colab:未找到描述

- GitHub - triton-lang/triton:Triton 语言和编译器的开发仓库:Triton 语言和编译器的开发仓库 - triton-lang/triton

- 主页:微调 Llama 3、Mistral 和 Gemma LLM,速度提升 2-5 倍,内存占用减少 80% - unslothai/unsloth

Unsloth AI (Daniel Han) ▷ #showcase (22 messages🔥):

- Text2Cypher 模型微调:一位成员使用 Unsloth 微调了 Text2Cypher 模型(一种用于图数据库的查询语言)。他们分享了一篇 LinkedIn 帖子,赞扬了其易用性以及生成的 gguf 版本。

- 情感分析新文章:一位成员发表了一篇关于使用 Unsloth 微调 LLaMA 3 8b 进行情感分析的详尽文章,并附带了代码和指南。他们在 Medium 上分享了这篇文章。

- Kolibrify 中的关键数据采样 Bug:在 Kolibrify 的数据采样过程中发现了一个重大 Bug。理论上能改善训练结果的修复程序将于下周发布,目前正在进行重新训练以评估效果。

- 课程数据集处理中的问题:由于使用了

datasets.Dataset.from_generator而非datasets.IterableDataset.from_generator,课程数据生成器失效。一位成员彻底检查了他们的流水线,仅使用约 2 万个样本就达到了 dolphin-mistral-2.6 的性能,并计划很快发布该模型。

HuggingFace ▷ #general (853 messages🔥🔥🔥):

- **Issue with GPTs Agents on MPS Devices**: A member noted that **GPTs agents** can only load bfloat16 models with MPS devices, as bitsandbytes isn't supported on M1 chips. They expressed frustration with MPS being fast but "running in the wrong direction".

- **Member seeks MLflow deployment help**: Someone asked for assistance in deploying custom models via **MLflow**, specifically for a fine-tuned cross encoder model. They did not receive a direct response from other members.

- **Interest in HuggingChat's limitations**: A user inquired why **HuggingChat** doesn't support files and images. No comprehensive answer was provided.

- **Clarifying technical script adjustments**: Multiple users engaged in debugging and modifying a script for sending requests to a vllm endpoint using **aiohttp** and **asyncio**. Key changes and adaptations were discussed, particularly for integrating with OpenAI's API.

- **Concerns about service and model preferences**: An extensive discussion ensued regarding the benefits and downsides of Hugging Face's **Pro accounts**, spaces creation, and the limitations versus preferences for running models like **Llama**. One member expressed dissatisfaction with needing workarounds for explicit content and limitations on tokens in HuggingChat. Another user sought advice on deployment vs. local computation for InstructBLIP.

- Docs | AIxBlock: AIxBlock 是一个全面的 AI 计划链上平台,集成了去中心化超级计算机。

- Zephyr Chat - a Hugging Face Space by HuggingFaceH4: 未找到描述

- HuggingChat: 让社区最好的 AI 聊天模型惠及每一个人。

- HuggingFaceH4/zephyr-orpo-141b-A35b-v0.1 · Hugging Face: 未找到描述

- Not A Nerd Bart GIF - Not A Nerd Bart Nerds Are Smart - Discover & Share GIFs: 点击查看 GIF

- OpenGPT 4o - a Hugging Face Space by KingNish: 未找到描述

- AMD Ryzen AI: 未找到描述

- Influenceuse I.A : POURQUOI et COMMENT créer une influenceuse virtuelle originale ?: 各位 Zinzins 大家好!🤪 虚拟影响力者的迷人世界正在本视频中展开。它们的创作正在经历真正的繁荣,事情正在发生变化...

- Tweet from William Fedus (@LiamFedus): GPT-4o 是我们最新的 SOTA 前沿模型。我们一直在 LMSys arena 上以 im-also-a-good-gpt2-chatbot 的名义测试一个版本 🙂。以下是它的表现。

- llama.cpp/examples/server at master · ggerganov/llama.cpp: C/C++ 中的 LLM 推理。通过在 GitHub 上创建账号为 ggerganov/llama.cpp 的开发做出贡献。

- GitHub - TonyLianLong/LLM-groundedDiffusion: LLM-grounded Diffusion: Enhancing Prompt Understanding of Text-to-Image Diffusion Models with Large Language Models (LLM-grounded Diffusion: LMD): LLM-grounded Diffusion:利用大语言模型(LLM)增强文本生成图像扩散模型的提示词理解能力 (LLM-grounded Diffusion: LMD) - TonyLianLong/LLM-groundedDiffusion

- app.py · huggingface-projects/LevelBot at main: 未找到描述

- Daily Papers - Hugging Face: 未找到描述

- MIT/ast-finetuned-audioset-10-10-0.4593 · Hugging Face: 未找到描述

- ratelimiter: 简单的 Python 速率限制对象

- Using Hugging Face Integrations: Gradio 循序渐进教程

- Parler TTS Expresso - a Hugging Face Space by parler-tts: 未找到描述

- Parler-TTS Mini - a Hugging Face Space by parler-tts: 未找到描述

- Open ASR Leaderboard - a Hugging Face Space by hf-audio: 未找到描述

- HuggingFaceH4/zephyr-orpo-141b-A35b-v0.1 - HuggingChat: 在 HuggingChat 中使用 HuggingFaceH4/zephyr-orpo-141b-A35b-v0.1

- Spaces Overview: 未找到描述

- Dog Snoop GIF - Dog Snoop Dogg - Discover & Share GIFs: 点击查看 GIF

- Train your first Deep Reinforcement Learning Agent 🤖 - Hugging Face Deep RL Course: 未找到描述

- One Of Us GIF - Wolf Of Wall Street Jordan Belfort Leonardo Di Caprio - Discover & Share GIFs: 点击查看 GIF

- InstructBLIP: 未找到描述

- app.py · huggingface-projects/LevelBot at ca772d68a73c254a8d1f88a25ab15765361a836e: 未找到描述

- Reddit - Dive into anything: 未找到描述

- GitHub - oobabooga/text-generation-webui: A Gradio web UI for Large Language Models. Supports transformers, GPTQ, AWQ, EXL2, llama.cpp (GGUF), Llama models.: 一个用于 Large Language Models 的 Gradio Web UI。支持 Transformers, GPTQ, AWQ, EXL2, llama.cpp (GGUF), Llama 模型。 - oobabooga/text-generation-webui

- GitHub - ollama/ollama: Get up and running with Llama 3, Mistral, Gemma, and other large language models.: 快速上手 Llama 3, Mistral, Gemma 以及其他 Large Language Models。 - ollama/ollama

- Reddit - Dive into anything: 未找到描述

- app.py · huggingface-projects/LevelBot at main: 未找到描述

- app.py · huggingface-projects/LevelBot at ca772d68a73c254a8d1f88a25ab15765361a836e: 未找到描述

- llama.cpp/examples/server at master · ggerganov/llama.cpp: 使用 C/C++ 进行 LLM 推理。通过在 GitHub 上创建账号为 ggerganov/llama.cpp 的开发做出贡献。

- test_merge: Sheet1 discord_user_id, discord_user_name, discord_exp, discord_level, hf_user_name, hub_exp, total_exp, verified_date, likes, models, datasets, spaces, discussions, papers, upvotes L251101219542532097L, osansevier...

- Text to Speech & AI Voice Generator: 使用有史以来最强大的在线 AI Text to Speech (TTS) 软件,以任何风格和语言免费创建优质 AI 语音。在几分钟内通过我们的角色 AI 语音生成文本转语音配音...

- Udio | AI Music Generator - Official Website: 发现、创作并与世界分享音乐。使用最新技术在几秒钟内创作 AI 音乐。

- Transformers, what can they do? - Hugging Face NLP Course: 未找到描述

- Unit 4. Build a music genre classifier - Hugging Face Audio Course: 未找到描述

- GitHub - muellerzr/minimal-trainer-zoo: Minimal example scripts of the Hugging Face Trainer, focused on staying under 150 lines: Hugging Face Trainer 的极简示例脚本,专注于保持在 150 行以内 - muellerzr/minimal-trainer-zoo

- Hugging Face - Learn: 未找到描述

- Hugging Face – Blog: 未找到描述

- Reddit - Dive into anything: 未找到描述 </ul> </div> --- **HuggingFace ▷ #[today-im-learning](https://discord.com/channels/879548962464493619/898619964095860757/1240974446559232011)** (11 条消息🔥): - **AI 商业顾问项目分享**:一位成员分享了一个 [YouTube 视频](https://youtu.be/uQcHXEGRECU),题为 "使用 LangChain 和 Gemini AI 创业的商业顾问 AI 项目",展示了一个旨在利用这些技术创建商业顾问的项目。这是一个具有实际应用价值的创业想法。 - **简化 🤗 Transformers 安装**:一位用户分享了 [Transformers 安装指南](https://huggingface.co/docs/transformers/installation),提供了使用 PyTorch, TensorFlow 和 Flax 设置该库的说明。这有助于用户为他们的深度学习项目安装和配置 🤗 Transformers。 - **创新的博客/页眉细节分享**:一位成员描述了他们新的博客/页眉,其特点是在节点上运行康威生命游戏(Game of Life)的 Delaunay 三角剖分。他们强调将游戏规则重新设计为分数计数,并提到由于使用 d3 重新渲染每一帧而不是使用 GPU 优化,因此具有“巨大的渲染开销”。 - **成果分享邀请**:针对商业顾问项目视频,另一位成员鼓励分享成果或仓库,以促进社区协作和反馈。 - **AI 人声增强指南发布**:一位用户简要提到他们编写了一份关于让 AI 人声听起来更自然的指南,通过增加厚度和深度使其重焕生机。目前尚未提供该指南的进一步详情或链接。

- Installation:未找到描述

- business advisor AI project using langchain and gemini AI startup.:在这段视频中,我们制作了一个使用 LangChain 和 Gemini 构建商业顾问的项目。AI 创业点子。我们恢复了作品集 AI 创业点子。

- Lucas Beyer (bl16) (@giffmana) 的推文:Merve 表现得非常出色:引用 merve (@mervenoyann) —— 有人问我关于 PaliGemma 的文档理解能力,所以我建立了一个包含所有 PaliGemma 微调文档的 Space...

- MIT 6.S191 (2023): Reinforcement Learning:MIT 深度学习导论 6.S191:第 5 讲,深度强化学习。讲师:Alexander Amini,2023 版。包含所有讲座、幻灯片和实验材料...

- Big Tech AI Is A Lie:通过 Hubspot 的免费 AI for GTM 捆绑包学习如何在工作中使用 AI:https://clickhubspot.com/u2o。大厂 AI 确实存在很多问题,而且是个谎言。✉️ NEWSLETT...

- Artificial intelligence | MIT News | Massachusetts Institute of Technology:未找到描述

- Generating Conversation: RLHF and LLM Evaluations with Nathan Lambert (Episode 6):本周的《生成对话》节目邀请了 Nathan Lambert。Nathan 是 HuggingFace 的研究科学家和 RLHF 团队负责人。他在...完成了博士学位。

- GitHub - mintisan/awesome-kan: KAN (Kolmogorov-Arnold Network) 相关资源的全面集合,包括库、项目、教程、论文等,供 Kolmogorov-Arnold Network 领域的研究人员和开发人员参考。:KAN (Kolmogorov-Arnold Network) 相关资源的全面集合,包括库、项目、教程、论文等...

- Climate change impacts:虽然我们经常认为人为造成的气候变化是未来才会发生的事情,但它实际上是一个持续的过程。美国及世界各地的生态系统和社区正在...

- 使用 langchain 和 gemini AI 创业公司的商业顾问 AI 项目:在本视频中,我们制作了一个使用 LangChain 和 Gemini 打造商业顾问的项目。AI 创业点子。我们恢复了作品集 AI 创业点子。

- Swift API:未找到描述

- sd-community/sdxl-flash · Hugging Face:未找到描述

- 来自 Apehex (@4pe0x) 的推文:很高兴介绍 `tokun`,一个为 #LLM 带来变革的 #tokenizer。它可以将 #llama3 的大小缩小 10 倍,同时提升能力!https://github.com/apehex/tokun/blob/main/arti...

- Friday - narra-ai 开发的 Hugging Face Space:未找到描述

- SDXL Flash - KingNish 开发的 Hugging Face Space:未找到描述

- sd-community/sdxl-flash-mini · Hugging Face:未找到描述

- GitHub - apehex/tokun: tokun to can tokens:tokun to can tokens。通过创建 GitHub 账号为 apehex/tokun 的开发做出贡献。

- Hugging Face Reading Group 21: Understanding Current State of Story Generation with AI:演讲者:Isamu Isozaki。书面总结:https://medium.com/@isamu-website/understanding-ai-for-stories-d0c1cd7b7bdc。所有演示文稿:https://github.com/isamu-isoz...

- Hugging Face - Learn:未找到描述

- Daily Papers - Hugging Face:未找到描述

- YouTube:未找到描述

- GitHub - isamu-isozaki/huggingface-reading-group: This repository's goal is to precompile all past presentations of the Huggingface reading group:该仓库的目标是预编译 Hugging Face 读书会过去所有的演示文稿 - isamu-isozaki/huggingface-reading-group

- GROVE: A Retrieval-augmented Complex Story Generation Framework with A Forest of Evidence:条件故事生成在人机交互中具有重要意义,特别是在创作具有复杂情节的故事方面。虽然 Large Language Models (LLMs) 在多项 NLP 任务中表现出色,但...

- Large Language Models Fall Short: Understanding Complex Relationships in Detective Narratives:现有的叙事理解数据集往往无法体现现实社交场景中关系的复杂性和不确定性。为了填补这一空白,我们引入了一个新的基准测试...

- Influenceuse I.A : POURQUOI et COMMENT créer une influenceuse virtuelle originale ?: 大家好!🤪 虚拟影响者(Virtual Influencers)的迷人世界走进了这段视频。它们的创作正经历着真正的繁荣,形势正在发生变化……

- transformers/examples/pytorch/semantic-segmentation at main · huggingface/transformers: 🤗 Transformers: 为 Pytorch, TensorFlow, 和 JAX 提供最先进的 Machine Learning。 - huggingface/transformers

- 🤗 Diffusers 入门 - Hugging Face Diffusion 课程: 未找到描述

- Issues · huggingface/diffusers: 🤗 Diffusers: 在 PyTorch 和 FLAX 中用于图像和音频生成的先进扩散模型。- Issues · huggingface/diffusers

- Stable Diffusion XL: 未找到描述

- 添加消息历史 (memory) | 🦜️🔗 LangChain: RunnableWithMessageHistory 允许我们将消息历史添加到某些类型的链中。它包装了另一个 Runnable 并为其管理聊天消息历史。

- GitHub - jakobdylanc/discord-llm-chatbot: llmcord.py • 和你的朋友们一起与 LLMs 聊天!: llmcord.py • 和你的朋友们一起与 LLMs 聊天!通过在 GitHub 上创建账户为 jakobdylanc/discord-llm-chatbot 的开发做出贡献。

- Hugging Face – 博客: 未找到描述

- Terminator Endoskeleton GIF - Terminator Endoskeleton Flames - Discover & Share GIFs:点击查看 GIF

- Rate Limits:未找到描述

- dolphin-llama3:Dolphin 2.9 是 Eric Hartford 基于 Llama 3 开发的新模型,提供 8B 和 70B 两种尺寸,具备多种指令、对话和编码技能。

- Karla - Google Fonts:Karla 是一款 grotesque 无衬线字体系列,现已扩展为可变字体,粗细轴范围从 ExtraLight 到 ExtraBold,并提供完整支持。

- Reddit’s deal with OpenAI will plug its posts into “ChatGPT and new products”:Reddit 与 OpenAI 签署了 AI 授权协议,将其帖子接入 “ChatGPT 及新产品”。Reddit 还与 Google 签署了授权协议。

- no title found:未找到描述

- <searchquery> - Google Search:未找到描述

- Perplexity.ai Turns Tables on Google, Upends SEO Credos:AI 搜索领导者将 Meta 构建的智能与初创公司的拼搏精神相结合,扭转局面挑战 Google。

- Oh No Homer GIF - Oh No Homer Simpsons - Discover & Share GIFs:点击查看 GIF

- this is cool - Google Search:未找到描述

- Perplexity Model Selection:使用 jQuery 为 Perplexity AI 添加模型选择按钮

- Veo:Veo 是我们迄今为止功能最强大的视频生成模型。它能生成高质量、1080p 分辨率且时长可超过一分钟的视频,涵盖广泛的电影和视觉风格。

- The Fast Show - Suit you Sir ! -16- Johnny Depp:Johnny Depp 主演一名美国人……

- PerplexityBot:未找到描述

- Gorgon City - Roped In:Selected - 音乐新高度。» Spotify: https://selected.lnk.to/spotify » Instagram: https://selected.lnk.to/instagram » Apple Music: https://selected.lnk.t...

- dailyfocus - Opus 50 | Udio:在 Udio 上收听 dailyfocus 的 Opus 50。发现、创作并与世界分享音乐。利用最新技术在数秒内创作 AI 音乐。

- ChatGPT 难以有效地优化提示词:用户对 4o 无法跟进提示词修正或有效修改初稿表示沮丧。一位成员指出,“它会重写原始回复,而不是告诉我如何修复我的提示词。”

- 对回复不完整的挫败感:像 cicada.exe 这样的用户报告称,尽管没有超过 Token 限制,但

chat.completion.create仍会出现回复不完整的情况。输出被突然截断的问题依然存在。 - 实现 JSON mode:Ashthescholar 建议 razeblox 在 API 中使用 JSON mode 来解决回复问题,特别是在格式和内容控制方面。

- 创意写作提示词在 GPT-4 上的表现优于 4o:用户分享到,虽然 4o 在某些创意任务上表现出色,但在优化草稿方面却很吃力。“当给予 4o 创意写作的自由发挥空间时,它表现得相当不错,但如果给它一份初稿进行改进,根据我的经验,它通常只是重复初稿内容,而不是进行修改,”keller._ 指出。

- 创意合成的创新方法:Stunspot 分享了一个提示词——“在混沌边缘编排创新”(Orchestrating Innovation on the Fringes of Chaos),强调通过网络动力学、分形探索、自适应创新和韧性来探索想法,以促进突破。

- GPTs Agents 在初始训练后无法学习:一位成员询问了在本地存储对话以进行上下文搜索的能力,另一位成员澄清说目前在 LM Studio 中无法实现。他们建议复制并粘贴文本,但指出“你无法上传文档并与之聊天。”

- 处理 “Unsupported Architecture” 错误:多位成员讨论了在 LM Studio 中加载 GPT-Sw3 时出现的 “Unsupported Architecture” 问题。共识是仅支持 GGUF 文件,用户建议在应用内下载并开启 “compatibility guess”。

- 在有限显存 (VRAM) 系统上运行 LM Studio:用户询问了如何在 6-8GB 等显存有限的系统上运行 LLM 模型。成员建议使用较小的模型和 Q5_K_M 等量化版本以获得更好的性能。

- 离线使用问题:一位用户报告了 LM Studio 在离线状态下无法运行的问题。经过社区建议,明确了先加载模型然后禁用网络应该是可行的,但建议提交更详细的 Bug 报告。

- 常规故障排除和设置问题:用户经常询问有关服务器设置、模型兼容性以及在低配置系统上的性能等问题。许多用户被引导至特定频道 (#1139405564586229810) 发布详细帖子以获取进一步帮助。

- Orenguteng/Llama-3-8B-Lexi-Uncensored-GGUF · Hugging Face:未找到描述

- GGUF My Repo - a Hugging Face Space by ggml-org:未找到描述

- Tab Autocomplete (beta) | Continue:Continue 现在支持在 VS Code 和 JetBrains IDE 中进行 Tab 自动补全。我们将在接下来的几个版本中大幅改进体验,听到反馈总是很有帮助的。如果...

- AGI Breaks the Team at OpenAI: Full Story Exposed:由于 AGI 问题,高管们离开 OpenAI。#ai #ainews #openai #agi #singularity 0:00 Intro 1:14 Background 4:53 Chief scientist leaves 6:40 Sam's response 9:34 Supe...

- GitHub - Lisoveliy/StarCoderEx: Extension for using alternative GitHub Copilot (StarCoder API) in VSCode:在 VSCode 中使用替代 GitHub Copilot (StarCoder API) 的扩展 - Lisoveliy/StarCoderEx

- llama : add DeepSeek-v2-Chat support · Issue #7118 · ggerganov/llama.cpp:请支持 deepseek-ai/DeepSeek-V2-Chat https://huggingface.co/deepseek-ai/DeepSeek-V2-Chat

- Free Download HWiNFO Sofware | Installer & Portable for Windows, DOS:现在就开始分析你的硬件!HWiNFO 提供适用于 Windows(32/64 位)的安装版和便携版,以及适用于 DOS 的便携版。

- GitHub - xtekky/gpt4free: The official gpt4free repository | various collection of powerful language models:官方 gpt4free 仓库 | 各种强大语言模型的集合 - xtekky/gpt4free

- OpenAI 1.11.0:一个简单的 C# / .NET 库,用于 OpenAI 的 API,包括 GPT 3.5, GPT 4, ChatGPT, DALL-E, Whisper 等。独立开发,非官方库,我不隶属于...

- OpenAI 1.11.0:一个简单的 C# / .NET 库,用于 OpenAI 的 API,包括 GPT 3.5, GPT 4, ChatGPT, DALL-E, Whisper 等。独立开发,非官方库,我不隶属于...

- OpenAI 1.11.0:一个简单的 C# / .NET 库,用于 OpenAI 的 API,包括 GPT 3.5, GPT 4, ChatGPT, DALL-E, Whisper 等。独立开发,非官方库,我不隶属于...

- GGUF My Repo - a Hugging Face Space by ggml-org:未找到描述

- aaditya/OpenBioLLM-Llama3-8B-GGUF · Hugging Face:未找到描述

- DavidAU/TieFighter-Holodeck-Holomax-Mythomax-F1-V1-COMPOS-20B-gguf · Hugging Face:未找到描述

- DavidAU/MPT-7b-WizardLM_Uncensored-Storywriter-Merge-Q6_K-GGUF · Hugging Face:未找到描述

- intfloat/multilingual-e5-large · Hugging Face:未找到描述

- DavidAU (David Belton):未找到描述

- Models - Hugging Face:未找到描述

- 各种硬件上的性能测试 · turboderp/exllama · Discussion #16:首先,我要感谢你的工作,非常喜欢你的推理实现,目前看来它是 NVIDIA GPU 上最快的!我在各种 GPU 上运行了一系列测试,想要……

- Reddit - 深入探讨:未找到描述

- Reddit - 深入探讨:未找到描述

- Discord - 与朋友和社区聊天的新方式: Discord 是通过语音、视频和文字进行交流的最简单方式。聊天、聚会,并与你的朋友和社区保持紧密联系。

- Discord - 与朋友和社区聊天的新方式: Discord 是通过语音、视频和文字进行交流的最简单方式。聊天、聚会,并与你的朋友和社区保持紧密联系。

- Discord - 与朋友和社区聊天的新方式: Discord 是通过语音、视频和文字进行交流的最简单方式。聊天、聚会,并与你的朋友和社区保持紧密联系。

- IDM-VTON: 未找到描述

- Pixart AI Photo Editor - Google Play 应用: 未找到描述

- Invideo AI - 将创意转化为视频 - AI 视频生成器 : 通过向 invideo AI 提供提示词轻松制作视频。invideo AI 是内容创作者、YouTuber 和营销人员的理想选择,它提供了一种无缝的方式,利用 AI 将你的创意转化为可发布的视频。

- Pixart AI Photo Editor - Google Play 应用: 未找到描述

- Apo Solary Apo GIF - Apo Solary Apo ApoFPS - 发现并分享 GIF: 点击查看 GIF

- Aw Shucks GIF - Aw Shucks Aww - 发现并分享 GIF: 点击查看 GIF

- Smash GIF - Smash - 发现并分享 GIF: 点击查看 GIF

- High Five Amy Santiago GIF - High Five Amy Santiago Rosa Diaz - 发现并分享 GIF: 点击查看 GIF

- 来自 Emad (@EMostaque) 的推文: @morew4rd @GoogleDeepMind SD3 即将发布,老实说,有了正确的流水线,我觉得大家不需要更多其他东西了

- ControlNet 模型下载: 通过在 GitHub 上创建账号,为 lllyasviel/stable-diffusion-webui-forge 的开发做出贡献。

- lllyasviel/sd_control_collection at main: 未找到描述

- Pinokio: AI 浏览器

- GitHub - yisol/IDM-VTON: IDM-VTON : Improving Diffusion Models for Authentic Virtual Try-on in the Wild: IDM-VTON:改进扩散模型以实现真实的野外虚拟试穿 - yisol/IDM-VTON

- GitHub - BadCafeCode/masquerade-nodes-comfyui: A powerful set of mask-related nodes for ComfyUI: 一套强大的 ComfyUI 遮罩相关节点。通过在 GitHub 上创建账号,为 BadCafeCode/masquerade-nodes-comfyui 的开发做出贡献。

- Judges 10 GIF - Judges 10 Score Up - 发现并分享 GIF: 点击查看 GIF

- Mood Sad GIF - Mood Sad Panda - 发现并分享 GIF: 点击查看 GIF

- Stable Diffusion Art - 教程、提示词和资源: Stable Diffusion 是一个将文本转化为图像的免费 AI 模型。本网站提供易于遵循的教程、工作流和结构化课程,教你关于 Stable Diffusion 所需了解的一切...

- 20Twenty 发布的图像: 未找到描述

- Modular: Accelerating the Pace of AI:Modular Accelerated Xecution (MAX) 平台是全球唯一能为您的 AI 工作负载解锁性能、可编程性和可移植性的平台。

- 重定向中:未找到描述

- 重定向通知:未找到描述

- Mojo🔥 入门 | Modular 文档:获取 Mojo SDK 或尝试在 Mojo Playground 中编写代码。

- PAPER.pdf:未找到描述

- 《食破天惊》足以让一个成年男子流泪 GIF - 发现并分享 GIF:点击查看 GIF

- 令人惊叹的全新 GPU 编程语言刚刚发布...:什么是用于并行计算的 Bend 编程语言?让我们初步了解 Bend 以及它如何使用类似 Python 的语法来编写高性能代码...

- MAX Engine:全球最快的统一 AI 引擎:全球最快的统一 AI 推理引擎,使您能够在不同框架和硬件上实现无与伦比的性能、可编程性和可移植性。

- [公开] Mojo 社区会议:未找到描述

- GitHub - tairov/llama2.mojo: 仅用一个纯 🔥 文件实现 Llama 2 推理:仅用一个纯 🔥 文件实现 Llama 2 推理。通过在 GitHub 上创建账号为 tairov/llama2.mojo 的开发做出贡献。

- collections | Modular Docs: 实现 collections 包。

- Uiua: 未找到描述

- Magic GIF - Magic - Discover & Share GIFs: 点击查看 GIF

- Builtin Dialect - MLIR: 未找到描述

- Redirect Notice: 未找到描述

- rebind | Modular Docs: 实现类型 rebind。

- Python integration | Modular Docs: 同时使用 Python 和 Mojo。

- The registers of Rust: 未找到描述

- FileHandle | Modular Docs: 已打开文件的文件句柄。

- [mojo-stdlib] Add variadic initialiser, __iter__ and __contains__ to InlineList by ChristopherLR · Pull Request #2703 · modularml/mojo: 此 PR 为 InlineList 添加了一些功能(相关 issue #2658)。变长参数初始化器 `var x = InlineList[Int](1,2,3)`,迭代器 `var x = InlineList[Int](1,2,3); for i in x: print(i)`,包含判断 `var x = In...`

- mojo/proposals/inferred-parameters.md at main · modularml/mojo: Mojo 编程语言。通过在 GitHub 上创建账户为 modularml/mojo 的开发做出贡献。

- mojo/stdlib/src/python at main · modularml/mojo: Mojo 编程语言。通过在 GitHub 上创建账户为 modularml/mojo 的开发做出贡献。

- [Feature Request] Assert max allocations in unit tests · Issue #2725 · modularml/mojo: 审查 Mojo 的优先级。我已经阅读了路线图和优先级,并认为此请求符合优先级。你的请求是什么?描述:作为一名使用 Mojo 的开发者,我希望能够...

- Machine Learning for Beginners: An Introduction to Neural Networks - victorzhou.com: 简单解释它们的工作原理以及如何从零开始用 Python 实现一个神经网络。

- GitHub - mzaks/mojo-unicode: 通过在 GitHub 上创建账户为 mzaks/mojo-unicode 的开发做出贡献。

- [stdlib] Implement `__contains__` for `Tuple`, `List`, `ListLiteral` (almost) · Issue #2658 · modularml/mojo: 现在我们有了 ComparableCollectionElement,我们可以尝试使用类似于 #2190 中采用的变通方法,为一些常见的集合类型实现 `__contains__`。有可能...

- Custom Operators in Swift with practical code examples: 学习如何在 Swift 中使用自定义运算符。其优势是什么,以及为了获得最佳可读性,哪些其他解决方案比自定义运算符更好。

- Discussion of the Potential of Unicode Characters as Alias Operators · modularml/mojo · Discussion #81: 在 Mojo 中使用 Unicode 逻辑和数学运算符:讨论引言。我发起这次讨论是为了探索引入 Unicode 逻辑和数学运算符的潜在好处...

- mojo/stdlib/src/collections/list.mojo at bf73717d79fbb79b4b2bf586b3a40072308b6184 · modularml/mojo:Mojo 编程语言。通过在 GitHub 上创建账号为 modularml/mojo 的开发做出贡献。

- GitHub - dorjeduck/mostring: variations over StringBuilder ideas in Mojo:Mojo 中关于 StringBuilder 构想的变体。通过在 GitHub 上创建账号为 dorjeduck/mostring 的开发做出贡献。

- go/src/runtime/slice.go at cb2353deb74ecc1ca2105be44881c5d563a00fb8 · golang/go:Go 编程语言。通过在 GitHub 上创建账号为 golang/go 的开发做出贡献。

- Vec in std::vec - Rust:未找到描述

- rust/library/alloc/src/raw_vec.rs at master · rust-lang/rust:赋能每个人构建可靠且高效的软件。 - rust-lang/rust

- Vec in std::vec - Rust:未找到描述

- Death of a value | Modular Docs: 关于 Mojo 何时以及如何销毁值的说明。

- Dangit, Git!?!: 未找到描述

- mojo/CONTRIBUTING.md at main · modularml/mojo: Mojo 编程语言。通过在 GitHub 上创建账户来为 modularml/mojo 的开发做出贡献。

- Issues · modularml/mojo: Mojo 编程语言。通过在 GitHub 上创建账户来为 modularml/mojo 的开发做出贡献。

- [Feature Request] DX: Change the default branch of modularml/mojo from `main` to `nightly` · Issue #2556 · modularml/mojo: 审查 Mojo 的优先级。我已阅读路线图和优先级,并认为此请求符合优先级。你的请求是什么?我希望 modularml 管理员前往设置...

- GitHub - gabrieldemarmiesse/getting_started_open_source: You want to contribute to an open-source project? You don't know how to do it? Here is how to.: 你想为开源项目做贡献吗?不知道该怎么做?这里有方法。 - gabrieldemarmiesse/getting_started_open_source

- [stdlib] Fix out of bounds access in `List.index()` by gabrieldemarmiesse · Pull Request #2745 · modularml/mojo: 与 #2687 相关。那里存在多个与裁剪相关的 bug。简而言之,Python 中 list.index() 的行为是:给定起始和结束位置,Python 会在其中查找元素...

- [BUG] param_env (string_literal, stringref, _memmem) · Issue #2434 · modularml/mojo: Bug 描述编辑:见 GitHub issue 的第一条评论。你好,我当时正在编写一个非常有用的教程 👍,在添加了一个约束后:示例:from sys import param_env alias D.....

- [BUG] Flaky segfault during `mojo build` with `-D MOJO_ENABLE_ASSERTIONS` · Issue #2751 · modularml/mojo: Bug 描述。此 Bug 是 #2687 的阻碍因素。在使用 -D MOJO_ENABLE_ASSERTIONS 编译 test_string.mojo 时,我注意到出现了一些不稳定的段错误(segfaults)。正如你所见,这在 CI 中是可以复现的...

- [BUG] alias materialization of list · Issue #2753 · modularml/mojo: Bug 描述。你好,这是根据聊天中 @JoeLoser 的建议提交的 Bug 报告。def main(): alias x = List("ok") var y = x print(y[0]) mojo run main.mojo 请提交 Bug 报告至 htt...

- Issues · modularml/mojo: Mojo 编程语言。通过在 GitHub 上创建账户来为 modularml/mojo 的开发做出贡献。

- [BUG] Incorrect pointer behavior when materializing a type · Issue #2637 · modularml/mojo: Bug 描述。我正尝试实现小缓冲区优化(small buffer optimization)。为此,我有一个指针,它可以指向一些栈分配的数据,也可以指向堆。为了知道我们是否需要...

- GitHub: Let’s build from here: GitHub 是超过 1 亿开发者共同塑造软件未来的地方。在这里参与开源社区,管理你的 Git 仓库,像专业人士一样进行 Code Review,跟踪 Bug 和功能...

- Sharon Zhou (@realSharonZhou) 的推文: Hallucinations 是生产级 LLM & Agent 的最大阻碍之一。在内部以及为客户服务时,我们已经实现了无 Hallucinations(<5%)。我们已经能够微调 LLM 来召回特定...

- Vik Paruchuri (@VikParuchuri) 的推文: Marker v2 发布了!主要新功能:- 提取图像/图表 - 更好的表格解析 - Pip 包安装 - 可用于商业用途 - 改进了支持更多语言的 OCR - 更好的内容排序...

- LlamaIndex 🦙 (@llama_index) 的推文: 使用 GPT-4o 进行结构化图像提取 🖼️ GPT-4o 在整合图像/文本理解方面处于 State-of-the-art 水平,我们创建了一份完整的 Cookbook,向你展示如何使用 GPT-4o 提取结构化...

- Kiri (@Kyrannio) 的推文: 出于好奇,我找到了 GPT-4o iOS 系统的 Prompt:“你是 ChatGPT,一个由 OpenAI 训练的大型语言模型,基于 GPT-4 架构。你正在通过 ChatGPT iOS 界面与用户聊天...”

- Quora Prompt Generator - Quora: 未找到描述

- 未找到标题: 未找到描述

- Model Memory Utility - hf-accelerate 创建的 Hugging Face Space: 未找到描述

- jason liu (@jxnlco) 的推文: 如果你是一家正在构建 RAG 的公司,并希望提升你的工程团队水平,请填写此表格。 https://q7gjsgfstrp.typeform.com/to/SL656ADC 我们将邀请其他运营者分享他们的故事,提供...

- RunPod (@runpod_io) 的推文: @cleavey1985 @HamelHusain $501.45 看起来差不多

- deepseek-ai/deepseek-coder-6.7b-base · Hugging Face: 未找到描述

- Quora - 一个分享知识、更好地了解世界的场所: 未找到描述

- GitHub - bigcode-project/starcoder2-self-align: StarCoder2-Instruct: 用于 Code Generation 的完全透明且许可的 Self-Alignment: StarCoder2-Instruct: 用于 Code Generation 的完全透明且许可的 Self-Alignment - bigcode-project/starcoder2-self-align

- Charlie Holtz (@charliebholtz) 的推文: 我们出 $501.43。引用 Omar Sanseviero (@osanseviero):对 LLM 感兴趣?加入这个由顶尖专家主持的 Fine-Tuning 课程!🚀 @huggingface 为 Space 演示提供 $501.42 的 GPU 额度...

- VikParuchuri - 概览: VikParuchuri 有 88 个公开仓库。在 GitHub 上关注他们的代码。

- GitHub - poloclub/unitable: UniTable: 迈向统一的表格 Foundation Model: UniTable: 迈向统一的表格 Foundation Model - poloclub/unitable

- Google Colab: 未找到描述

- GitHub - explosion/prodigy-segment: 通过 Facebook 的 Segment-Anything 模型在 Prodigy 中选择像素。: 通过 Facebook 的 Segment-Anything 模型在 Prodigy 中选择像素。 - explosion/prodigy-segment

- 教程 - PyMuPDF 1.24.4 文档: 未找到描述

- modal-examples/06_gpu_and_ml/llm-serving/text_generation_inference.py (main 分支) · modal-labs/modal-examples: 使用 Modal 构建的程序示例。通过在 GitHub 上创建账号,为 modal-labs/modal-examples 的开发做出贡献。

- modal-examples/06_gpu_and_ml/llm-serving (main 分支) · modal-labs/modal-examples: 示例... ples of programs built using Modal. Contribute to modal-labs/modal-examples development by creating an account on GitHub.

- InstructPTS: Instruction-tuning LLMs for product title summarization: 电子商务产品目录包含数十亿件商品。大多数产品的标题都很长,因为卖家会堆砌产品属性以提高检索率并突出关键产品方面。这项研究...

- xl0 - Overview: 全职学习者。(Linux, Biology, Electronics) -> AI :heart: 编写一些可爱的软件。:two_hearts: 欢迎各种令人兴奋的机会!- xl0

- no title found: no description found

- sentence-transformers/all-MiniLM-L6-v2 · Hugging Face: 未找到描述

- 编写文档 - dbt Power User: 未找到描述

- 登录: 欢迎回到 Modal!请在下方选择身份提供商以登录您的 Modal 账户。

- 使用 LLM 创建项目经理 - 第一部分 (WIP): 项目经理花费大量时间提供和更新任务状态——这可以交给 LLM 吗?在这里我们开始调查。还有这个...

- GitHub - genomoncology/FuzzTypes: 用于标注自动纠错字段的 Pydantic 扩展。: 用于标注自动纠错字段的 Pydantic 扩展。 - genomoncology/FuzzTypes

- 介绍 Microsoft 365 Copilot – 你的工作副驾驶 - 微软官方博客: 人类天生就喜欢梦想、创造和创新。我们每个人都寻求从事赋予我们目标的工作——写一部伟大的小说、做出发现、建立强大的社区、照顾病人...

- modal-client/modal/object.py (位于 f76bd98013372b423ab765cdc7a745996012211c) · modal-labs/modal-client: Modal 的 Python 客户端库。通过在 GitHub 上创建账户来为 modal-labs/modal-client 的开发做出贡献。

- Daniel Han (@danielhanchen) 的推文: 我对“LoRA 学得更少,遗忘也更少”的看法:1) “MLP/All”不包括 gate_proj。训练了 QKVO、up 和 down,但没有训练 gate(第 3 页脚注) 2) 为什么 LoRA 在数学方面表现良好,并且...

- GitHub - nppoly/cyac: 适用于 Python 的高性能 Trie 和 Ahocorasick 自动机 (AC 自动机) 关键词匹配与替换工具: 适用于 Python 的高性能 Trie 和 Ahocorasick 自动机 (AC 自动机) 关键词匹配与替换工具 - nppoly/cyac

- BLOOM+1: 为 BLOOM 添加语言支持以实现 Zero-Shot Prompting: BLOOM 模型是一个大型公开可用的多语言语言模型,但其预训练仅限于 46 种语言。为了在不产生过高成本的情况下将 BLOOM 的优势扩展到其他语言...

- DIY LLM 评估,ABBA 模式押韵案例研究: DIY LLM 评估,ABBA 模式押韵案例研究 - Xebia

- GitHub - eliasdabbas/openai_entity_extraction: 使用 ChatGPT 进行实体提取: 使用 ChatGPT 进行实体提取。通过在 GitHub 上创建账户来为 eliasdabbas/openai_entity_extraction 的开发做出贡献。

- 由 OpenAI 的 ChatGPT 驱动的实体提取 - advertools: 未找到描述

- 查看所有职业: 未找到描述

- modal-examples/06_gpu_and_ml/llm-serving/vllm_mixtral.py at main · modal-labs/modal-examples:使用 Modal 构建的程序示例。通过在 GitHub 上创建账户为 modal-labs/modal-examples 的开发做出贡献。

- Slack:未找到描述

- Modal 黑客松额度:要领取您的 Modal 额度,请先在 https://modal.com/ 注册账户。然后,通过此表单告知我们您的用户名。如需支持,请加入 Modal Slack。这里有一些入门示例...

- 在 15 分钟内嵌入英文维基百科:利用 Modal 的并行批处理作业和内部存储功能,快速为数十亿个 Token 生成 Embedding。

- Serverless TensorRT-LLM (LLaMA 3 8B):在此示例中,我们演示了如何使用 TensorRT-LLM 框架在单张 NVIDIA A100 40GB GPU 上以约每秒 4,500 个输出 Token 的总吞吐量提供 Meta 的 LLaMA 3 8B 模型服务...

- Modal 简介:Modal 让您无需考虑基础设施即可在云端运行代码。

- 登录:欢迎回到 Modal!通过在下方选择身份提供商登录您的 Modal 账户。

- 来自 Cameron R. Wolfe 博士 (@cwolferesearch) 的推文:最近,我运行了数百次使用 LoRA/QLoRA 的指令微调实验,我想分享一些可能对大家有用的(基础)代码和发现……代码(见回复)包含一个指令...

- FireFunction V1 - Fireworks 的 GPT-4 级函数调用模型 - 比 GPT-4 快 4 倍且开源权重:Fireworks 开源了新的函数调用模型,具有接近 GPT-4 级的质量和 4 倍的速度

- GitHub - NousResearch/Hermes-Function-Calling:通过在 GitHub 上创建账户来为 NousResearch/Hermes-Function-Calling 的开发做出贡献。

- GitHub - OpenGVLab/InternVL: [CVPR 2024 Oral] InternVL Family: A Pioneering Open-Source Alternative to GPT-4V. 接近 GPT-4V 表现的可商用开源多模态对话模型:[CVPR 2024 Oral] InternVL 系列:GPT-4V 的先驱开源替代方案。接近 GPT-4V 表现的可商用开源多模态对话模型 - OpenGVLab/InternVL

- 在新知识上微调 LLM 是否会诱发幻觉?:当大型语言模型通过监督微调进行对齐时,它们可能会遇到预训练期间未获得的新的事实信息。人们通常推测这可能会教导模型...

- - 去你的,给我看 Prompt。:通过拦截 API 调用快速理解难以捉摸的 LLM 框架。

- Simon Willison: Prompt injection:未找到描述

- Constitutional AI: 来自 AI 反馈的无害性:随着 AI 系统变得越来越强大,我们希望寻求它们的帮助来监督其他 AI。我们实验了通过自我改进来训练无害 AI 助手的方法,无需任何人工...

- 指令层级:训练 LLM 优先处理特权指令:当今的 LLM 容易受到 Prompt 注入、越狱和其他攻击,这些攻击允许攻击者用自己的恶意 Prompt 覆盖模型的原始指令。在这项工作中...

- Hamel 的博客 - 策划 LLM 数据:工具回顾

- Umar Jamil:我是一名来自意大利米兰的机器学习工程师,向我的猫“奥利奥”讲解复杂的深度学习和机器学习概念。我也会一点中文。

- LangSmith:让您的 LLM 应用从原型走向生产。

- Langtrace AI:监控、评估并改进您的 LLM 应用。

- LLM 的可观测性:利用 Honeycomb 的可观测性增强 LLM。获取洞察、改善用户体验并推动 AI 开发成功。

- Demo Search Fine Web Dataset:未找到描述

- Experimental Moondream WebGPU - a Hugging Face Space by Xenova:未找到描述

- HMT: Hierarchical Memory Transformer for Long Context Language Processing:基于 Transformer 的大语言模型 (LLM) 已广泛应用于语言处理任务。然而,大多数模型限制了允许模型关注每个 token 的上下文窗口...

- InstantID: 未找到描述

- Open VLM Leaderboard - a Hugging Face Space by opencompass: 未找到描述

- 来自 Marco Mascorro (@Mascobot) 的推文: Runpod 的 @runpod_io 黑客松 😅

- Yi-1.5 (2024/05) - a 01-ai Collection: 未找到描述

- 加入 Nous Research Discord 服务器!: 在 Discord 上查看 Nous Research 社区 - 与 7171 名其他成员一起交流,享受免费的语音和文字聊天。

- 来自 Ethan (@Ethan_smith_20) 的推文: 今天我训练了一个生成 LoRAs 的扩散模型,生成的图像至少没有乱码。

- Transformers learn to implement preconditioned gradient descent for in-context learning: 最近的多项研究表明,Transformers 可以实现类似梯度下降的算法。通过精心构造权重,这些研究展示了多层 Transformers 的表达能力...

- N8Programs/Capybara-Quicksilver · Hugging Face 数据集: 未找到描述

- Corcel · 利用 Bittensor 的力量进行构建: 释放去中心化激励型基础设施的创新潜力。

- GitHub - huggingface/datatrove: Freeing data processing from scripting madness by providing a set of platform-agnostic customizable pipeline processing blocks.: 通过提供一组与平台无关的可定制流水线处理块,将数据处理从脚本疯狂中解放出来。- huggingface/datatrove

- N8Programs/Capybara-Quicksilver · Hugging Face 数据集: 未找到描述

- PixArt LCM - a Hugging Face Space by PixArt-alpha: 未找到描述

- GitHub - huggingface/candle: Minimalist ML framework for Rust: 适用于 Rust 的极简 ML 框架。通过在 GitHub 上创建账号来为 huggingface/candle 的开发做出贡献。

- Hypernetwork Style Training, a tiny guide · AUTOMATIC1111/stable-diffusion-webui · Discussion #2670: 训练期间的负面文本预览似乎在几个补丁前已修复,请继续。太长不看版(tl;dr)准备:选择高质量图像,质量优于数量。在 512x512 下训练,其他尺寸可能会增加畸变...

- worldsim: 未找到描述

- 未找到标题: 未找到描述

- worldsim: 未找到描述

- worldsim: 未找到描述

- worldsim: 未找到描述

- worldsim: 未找到描述

- 下一件大事起初看起来会像个玩具: Chris Dixon 的博客。

- 来自 John Galt (@StudioMilitary) 的推文: NOUS WORLDSIM: 选择你的模拟

- Outer Wilds GIF - Outer Wilds - 发现并分享 GIF: 点击查看 GIF

- 复杂自适应系统: 参加完整课程:https://bit.ly/SiCourse 下载手册:https://bit.ly/SiBooklets Twitter: http://bit.ly/2JuNmXX LinkedIn: http://bit.ly/2YCP2U6 在这个...

- 加入 Nous Research Discord 服务器!: 查看 Discord 上的 Nous Research 社区 - 与其他 7171 名成员一起交流,享受免费的语音和文字聊天。

- WebSim, WorldSim, 以及模拟 AI 之夏 —— 与 Liquid AI 的 Joscha Bach、Nous Research 的 Karan Malhotra、WebSim.ai 的 Rob Haisfield 合作: 关于今年生成式 AI 最火热的前沿领域——模拟 AI 的三个视角!

- worldsim: 未找到描述

- Hugging Face 正在分享价值 1000 万美元的算力,以帮助击败大型 AI 公司:Hugging Face 希望降低开发 AI 应用的准入门槛。

- 大规模、低延迟的 ML 模型服务 // Manoj Agarwal // MLOps Meetup #48:MLOps 社区聚会 #48!上周三,在 Manoj Agarwal(Salesforce 软件架构师)生日那天,我们与他进行了交流。// 摘要:提供机器学习服务...

- 用于扩展生产级机器学习的 MLOps 工具 || Alejandro Saucedo @ FOSDEM 2019:随着机器学习项目的增长,其基础设施也应随之增长。在简短的闪电演讲中,Alejandro 涵盖了机器学习运维的一些关键趋势...

- 如何使用 TorchServe 提供 PyTorch 模型服务:Hamid Shojanazeri 是 PyTorch 的合伙人工程师,在此演示使用 TorchServe 的基础知识。作为 PyTorch 首选的模型服务解决方案,...

- GitHub - HigherOrderCO/Bend: 一种大规模并行的高级编程语言:一种大规模并行的高级编程语言 - HigherOrderCO/Bend

- core.py - triton-lang/triton - Sourcegraph:未找到描述

- Discord - 与朋友和社区聊天的新方式:Discord 是通过语音、视频和文字进行交流的最简单方式。聊天、聚会,并与你的朋友和社区保持紧密联系。

- 第 14 讲:Triton 实践者指南:https://github.com/cuda-mode/lectures/tree/main/lecture%2014

- YouTube:未找到描述

- GTC 2022 - CUDA 编程原理 - Stephen Jones,NVIDIA CUDA 架构师:由 CUDA 首席架构师带来的 GPU 编程入门。CUDA 的独特之处在于它是一种与硬件同步设计和构建的编程语言 ...

- 梯度裁剪 Bug 及其修复革新训练: 关于梯度裁剪 (gradient clipping) 的讨论揭示了由于 "grad_norm" 被平方导致的不正确比较问题,需要修正以确保更准确和稳健的训练。此外,强调了 "grad_norm" 的正确初始化以防止意外行为。

- 内存优化成为焦点: 多位用户参与了关于优化 CUDA kernel 代码的讨论,特别是围绕内存分配和使用,并对模板化 block sizes 以获得更好的编译时常量表现出浓厚兴趣。考虑到新的内存受限情况,重写 Adam 优化器 kernel 可能带来的性能提升也受到了关注。

- 评估 Hellaswag 与 MMLU 的性能: GPT-2 (124M 为 29.55%) 和 GPT2-XL (48.93%) 的 Hellaswag 评估显示了模型规模带来的预期阶梯式改进。然而,MMLU 评估结果出人意料地差,表明数据集或评估标准可能存在问题。

- ZeRO-2 实现讨论进入技术层面: 成员们讨论了 ZeRO-2 的实现,特别关注内存布局重组、减少通信调用以及保持与 checkpoint 文件的兼容性。对话还延伸到了高效的梯度计算和 NCCL 交织 (interleaving) 以增强性能。

- 用于优化的模板和常量重构: 讨论了一项在 CUDA kernels 中将 block sizes 模板化以实现编译时优化的提案,以及其他代码库清理建议。直接结果是一个将 “warpSize” 标准化为常量的 PR,以便进行更好的编译时优化,这反映了对提高代码效率的共识。

- GitHub: 从这里开始构建: GitHub 是超过 1 亿名开发者共同塑造软件未来的地方。为开源社区做出贡献,管理你的 Git 仓库,像专家一样审查代码,追踪错误和功能...

- llama-cpp-python 漏洞 | Snyk: 了解更多关于 llama-cpp-python 包中已知漏洞的信息。llama.cpp 库的 Python 绑定

- Issues · karpathy/llm.c: 使用简单、原始的 C/CUDA 进行 LLM 训练。通过在 GitHub 上创建账号,为 karpathy/llm.c 的开发做出贡献。

- k - 概览: k 有 88 个可用仓库。在 GitHub 上关注他们的代码。

- 修复 matmul_backward_bias kernel 1 中不支持的 block_size,由 lancerts 提交 · Pull Request #439 · karpathy/llm.c: 由于第 https://github.com/karpathy/llm.c/blob/master/dev/cuda/matmul_backward_bias.cu#L67 行的归约操作,kernel 1 的 block size 需要是 2 的幂。否则 GPU 结果...

- 添加 warpsize 作为常量以实现更好的编译时优化和标准化,由 ChrisDryden 提交 · Pull Request #435 · karpathy/llm.c: 在研究 WarpSize CUDA 常量的属性时,发现它在编译时不可用,这意味着编译器无法根据该值进行编译时优化...

- 权重重排:尝试 1,由 ngc92 提交 · Pull Request #427 · karpathy/llm.c: 非功能性改进。初步尝试按块(per-block)布局重排权重的效果

- 改进的数值错误检查,由 ngc92 提交 · Pull Request #429 · karpathy/llm.c: 更严格的容差,基于 bf16 epsilon 的相对容差,如果一切正常则减少输出。我已经在 RTX 4060Ti 和 A4000 上检查了这些容差(它们确实会产生不同的错误,有时...

- 重叠梯度计算和 NCCL AllReduce,由 PeterZhizhin 提交 · Pull Request #361 · karpathy/llm.c: 在我的设置中,我得到以下结果:之前:step 2/37: train loss 4.720275 (acc 4.688650) (224.046844 ms, 36563.773438 tok/s) step 3/37: train loss 3.802741 (acc 3.943135) (224.151611 ms, 36555...

- 首页:该网站是关于 Apache Spark 的 RAPIDS 加速器的文档集合

- GitHub - rapidsai/dask-cudf: [已归档] 对分布式 GDF 对象的 Dask 支持 --> 已移至 cuDF:[已归档] 对分布式 GDF 对象的 Dask 支持 --> 已移至 cuDF - rapidsai/dask-cudf

- msaroufim 开发的自定义 CUDA 扩展 · Pull Request #135 · pytorch/ao:这是 #130 的可合并版本 - 我必须进行一些更新,包括:除非使用 PyTorch 2.4+ 否则跳过测试,如果 CUDA 不可用则跳过测试,将 ninja 添加到开发依赖项,本地...

- C++ 自定义算子手册:未找到描述

- ao/torchao/dtypes/uint4.py (main 分支) · pytorch/ao:用于量化和稀疏化的原生 PyTorch 库 - pytorch/ao

- 为 NF4 添加文档;修复失败的 8-bit matmul;修复 absmax bug。… · TimDettmers/bitsandbytes@6747525:…#529 #543

- 由 gau-nernst 改进 FP6 量化的原语 · Pull Request #248 · pytorch/ao:解决 #208 待办事项:FP32/FP16/BF16 -> FP6 (CPU + CUDA)(带有正确的舍入),FP6 -> FP32/FP16/BF16 (CPU + CUDA),添加测试,修复 OpenMP 中的异常,想办法在 CUDA kernel 中进行检查?...

- 由 msaroufim 实现 1.58 bit · Pull Request #68 · pytorch/ao:修复了 #67

- GPT-4o 的中文 Token 训练数据被垃圾邮件和色情网站污染:该问题可能是由于数据清洗不足导致的,可能引发幻觉、性能下降和滥用。

- Leave No Context Behind: Efficient Infinite Context Transformers with Infini-attention:这项工作引入了一种高效的方法,将基于 Transformer 的大语言模型 (LLMs) 扩展到无限长的输入,且内存和计算量有限。我们提出的方法中的一个关键组件...

- Ring Attention with Blockwise Transformers for Near-Infinite Context:Transformer 已成为许多最先进 AI 模型的首选架构,在广泛的 AI 应用中展示了卓越的性能。然而,内存需求...

- MOMENT: A Family of Open Time-series Foundation Models:我们介绍了 MOMENT,这是一系列用于通用时间序列分析的开源基础模型。在时间序列数据上预训练大模型具有挑战性,原因在于 (1) 缺乏大规模...

- OpenELM: An Efficient Language Model Family with Open Training and Inference Framework:大语言模型的可复现性和透明度对于推进开放研究、确保可信度至关重要...

- GitHub - nshepperd/flash_attn_jax: JAX bindings for Flash Attention v2:Flash Attention v2 的 JAX 绑定。通过在 GitHub 上创建账号来为 nshepperd/flash_attn_jax 的开发做出贡献。

- jax/jax/experimental/pallas/ops/tpu/flash_attention.py at main · google/jax:Python+NumPy 程序的组合变换:微分、向量化、JIT 到 GPU/TPU 等 - google/jax

- 英国-加拿大 AI 安全科学伙伴关系:未找到描述

- 【風吹けば名無し】GPT-4o が獲得した日本語の語彙を調べる:未找到描述

- AI 安全研究所 (AISI):AI 安全研究所是科学、创新和技术部的一个局,旨在促进严谨的研究以实现先进的 AI 治理。

- OLMo: Open Language Model:一个最先进的、真正开放的 LLM 和框架

- HMT: Hierarchical Memory Transformer for Long Context Language Processing:基于 Transformer 的大语言模型(LLM)已广泛应用于语言处理任务。然而,大多数模型限制了允许模型关注每个 token 的上下文窗口...

- Fishing for Magikarp: Automatically Detecting Under-trained Tokens in Large Language Models:众所周知,语言模型中分词器(tokenizer)的创建与模型训练之间的脱节会导致某些输入(如臭名昭著的 SolidGoldMagikarp token)诱发异常行为。...

- ImageBind: One Embedding Space To Bind Them All:我们提出了 ImageBind,这是一种学习跨六种不同模态(图像、文本、音频、深度、热成像和 IMU 数据)联合嵌入的方法。我们展示了所有配对数据的组合并非必...

- A Generalist Agent:受大规模语言建模进展的启发,我们采用类似的方法构建了一个超越文本输出领域的单一通用智能体(generalist agent)。该智能体我们称之为 Gato...

- PaLM-E: An Embodied Multimodal Language Model:大语言模型在广泛的复杂任务中表现出色。然而,在现实世界中实现通用推理(例如机器人问题)提出了具身(grounding)的挑战。我们提出了具身...

- Generalization in diffusion models arises from geometry-adaptive harmonic representations:为图像去噪而训练的深度神经网络(DNN)能够通过基于分数的逆扩散算法生成高质量样本。这些令人印象深刻的能力似乎暗示了逃离...

- ICLR 2024 Outstanding Paper Awards – ICLR Blog:未找到描述

- Meta 推出 Chameleon:Meta 的新模型 Chameleon 是一个 34B 参数的多模态基础模型,在文本和图像任务中的表现均优于 Flamingo 和 IDEFICS 等模型。它在约 10T tokens 上进行训练,并在人工评估中声称优于 GPT-4V。[Source](https://arxiv.org/abs/2405.09818)

- DeepMind 发布 Flash-8B:更新后的 Gemini 1.5 论文介绍了 Flash-8B,这是一个不同于 Gemini 1.5 Flash 的新模型。Flash-8B 具有多模态和超长上下文窗口,同时保持极高的效率。[Source](https://storage.googleapis.com/deepmind-media/gemini/gemini_v1_5_report.pdf#page=45)

- Gemini 1.5 模型家族扩展:Gemini 1.5 Pro 和 Flash 模型较之前版本有显著改进,在文本和视觉基准测试中表现出色。它们在 MMLU 任务中的表现展示了其系列中的最高能力。[Source](https://goo.gle/GeminiV1-5)

- Anthropic 扩大规模:据报道,Anthropic 使用了比其前代模型 Opus 多四倍的 compute,旨在开发更大、更强大的模型。[Source](https://www.anthropic.com/news/reflections-on-our-responsible-scaling-policy)

- LMsys 宣布 “Hard Prompts” 类别:LMsys 在 Arena 中引入了 “Hard Prompts” 类别,以便在更具挑战性的任务上评估模型,并观察到了显著的排名变化。Llama-3-70B-Instruct 被用作裁判模型,但其可靠性受到质疑。[Source](https://fxtwitter.com/lmsysorg/status/1792625968865026427)

- 来自 lmsys.org (@lmsysorg) 的推文: 我们如何对这些标准进行分类?我们采用 Llama-3-70B-Instruct 作为裁判模型,帮助我们标记超过 100 万场 Arena 对战。总体而言,我们的分析揭示了 Arena 用户提示词的质量...

- 来自 fishy business (@swishfever) 的推文: Chameleon 论文中的注释行: % \item 我们开源了 \model{} 的变体,允许文本和图像输入,但在所有模型规模上仅支持文本输出。引用 Tanishq Mathew Abraham, Ph.D. (...

- 来自 lucas g (@DaLucasGonzalez) 的推文: 我们更新后的 Gemini 1.5 技术报告发布了!很高兴能预览我们正在开发的新模型:Flash-8B https://storage.googleapis.com/deepmind-media/gemini/gemini_v1_5_report.pdf#page=4...

- 来自 lmsys.org (@lmsysorg) 的推文: 在 Arena 中引入 “Hard Prompts” 类别!为了响应社区对在更具挑战性的任务上评估模型日益增长的兴趣,我们很高兴推出新的 “Hard Pr...

- 来自 lucas g (@DaLucasGonzalez) 的推文: Flash-8B 具有与其他 1.5 模型相同的多模态和百万级上下文窗口,但占用空间极小,效率极高。世界上没有其他类似的模型。它展示了令人难以置信的能力...

- 来自 lucas g (@DaLucasGonzalez) 的推文: 我们的初步基准测试非常有前景,这只是初步预览,因为我们仍在积极开发该模型,以在该规模下实现性能最大化。

- 来自 Susan Zhang (@suchenzang) 的推文: 更新后的技术报告包含很多好东西!现在这个推文串主要关注 ⚡️ Gemini 1.5 Flash ⚡️... 🧵 引用 Jeff Dean (@🏡) (@JeffDean) Gemini 1.5 模型家族:技术报告更新...

- 来自 Aidan McLau (@aidan_mclau) 的推文: 哟,Anthropic 在酝酿什么,比 Opus 多 4 倍的 compute,真牛

- 来自 Kelsey Piper (@KelseyTuoc) 的推文:如果你在 60 天内不签署,你的份额就会消失。而且情况还会变得更糟——因为 OpenAI 还可以拒绝让你参加年度活动,而这是出售你已归属 PPUs 的唯一途径...

- 来自 Kelsey Piper (@KelseyTuoc) 的推文:我对关于 OpenAI 离职协议的文章收到了两种反应:“这很正常!”(并不正常;其他领先的 AI 实验室没有类似的政策)以及“这怎么可能...”

- 来自 Sam Altman (@sama) 的推文:关于最近有关 OpenAI 如何处理股权的事宜:我们从未收回过任何人的已归属股权,如果人们不签署离职协议(或不同意...),我们也不会这样做。

- 来自 OpenAI (@OpenAI) 的推文:我们听到了关于如何选择 ChatGPT 语音(尤其是 Sky)的疑问。在处理这些问题期间,我们正努力暂停 Sky 的使用。阅读更多关于我们如何选择这些语音的信息:https://openai...

- 来自 Kelsey Piper (@KelseyTuoc) 的推文:当你离开 OpenAI 时,你会得到一个令人不快的惊喜:一份离职协议,如果你不签署终身不得贬低承诺,你将失去所有已归属股权:https://www.vox.com/futu...

- 来自 Soumith Chintala (@soumithchintala) 的推文:我从多位前 OpenAI 员工那里证实了这是真的,这就是为什么他们不对自己的经历发表任何负面评论。

- 介绍前沿安全框架 (Frontier Safety Framework):我们分析和缓解先进 AI 模型带来的未来风险的方法

- 来自 Jan Leike (@janleike) 的推文:我加入是因为我认为 OpenAI 将是世界上进行这项研究的最佳场所。然而,相当长一段时间以来,我一直与 OpenAI 领导层在公司的核心优先级上存在分歧...

- 来自 Kelsey Piper (@KelseyTuoc) 的推文:当你离开 OpenAI 时,你会得到一个令人不快的惊喜:一份离职协议,如果你不签署终身不得贬低承诺,你将失去所有已归属股权:https://www.vox.com/futu...

- OpenAI 致力于确保超级智能安全的大力推动 | Jan Leike:2023 年 7 月,OpenAI 宣布将投入 20% 的计算资源支持一个新团队和项目——超级对齐 (Superalignment),旨在...

- 来自“我失去了信任”的推文:为什么负责守护人类的 OpenAI 团队崩溃了:公司内部人士解释了为什么具有安全意识的员工正在离开。

- OpenAI 的长期 AI 风险团队已解散 | WIRED:未找到描述内容

- Notion – 笔记、任务、维基和数据库的一体化工作空间。:一款将日常工作应用融合为一的新工具。它是为您和您的团队打造的一体化工作空间。

- GitHub - naklecha/llama3-from-scratch: 每次一个矩阵乘法实现 llama3:每次一个矩阵乘法实现 llama3 - naklecha/llama3-from-scratch

- 未找到标题:未找到描述

- OpenAI 撤回了其类似于 Scarlett Johansson 的 ChatGPT 语音:也许《她》(2014) 不应该成为 AI 语音功能的蓝图。

- 来自 Liron Shapira (@liron) 的推文:你必须意识到 @ESYudkowsky 对我们处境有多糟糕的洞察力水准仍远超众人。仅仅因为其他专家终于开始转向他的观点,并不意味着他们已经...

- 来自 Hamel Husain (@HamelHusain) 的推文:🤣

- 无标题:未找到描述

- The Retort AI Podcast | ChatGPT 对话:社交季的钻石还是十足的丑闻?:Tom 和 Nate 讨论了过去一周 OpenAI 的两大事件。备受欢迎的聊天助手,以及它所揭示的 OpenAI 世界观。我们还讨论了 OpenAI 新的 Mo...

- 来自“我失去了信任”的推文:为什么负责守护人类的 OpenAI 团队崩溃了:公司内部人士解释了为什么注重安全的员工正在离职。

- 教程 | 🦜️🔗 Langchain:以下是关于 LangChain.js 的教程和课程链接。有关 LangChain.js 常见用例的书面指南,请查看用例和指南部分。

- 来自 Sharon Zhou (@realSharonZhou) 的推文:幻觉(Hallucinations)是生产级 LLM 和 Agent 的最大阻碍之一。在内部以及为客户提供服务时,已经实现了无幻觉(<5%)。我们已经能够调整 LLM 来召回特定...

- Hamel 的博客 - 微调(Fine-Tuning)仍然有价值吗?:对近期微调幻灭趋势的回应。

- 来自 Greg Brockman (@gdb) 的推文:我们非常感谢 Jan 为 OpenAI 所做的一切,我们知道他将继续从外部为这一使命做出贡献。鉴于他的离职引发的问题,我们...

- 来自 Joel Hellermark (@joelhellermark) 的推文:与 @geoffreyhinton 谈论了 OpenAI 联合创始人 @ilyasut 对 Scaling Laws 的直觉👇。“Ilya 总是宣扬只要把它做得更大,它就会运行得更好。而我一直认为...”

- 来自 Sonia Joseph (@soniajoseph_) 的推文:致那些就 AGI 合意非合意(cnc)性爱派对联系我的记者们——在我二十多岁身处硅谷期间,我通过社区住房场景出入于精英科技/AI 圈子。...

- 来自 Dan Biderman (@dan_biderman) 的推文:人们认为 LoRA 是 LLM 的万灵丹。真的是吗?它能在消费级 GPU 上提供与全量微调(full finetuning)相同的质量吗?虽然 LoRA 具有较低内存占用的优势,但我们发现...

- 来自 NIK (@ns123abc) 的推文:天哪,这绝对彻底完蛋了

- 来自 Sam Altman (@sama) 的推文:我非常感谢 @janleike 对 OpenAI 对齐(alignment)研究和安全文化的贡献,对他离开感到非常难过。他是对的,我们还有很多工作要做;我们致力于...

- 来自 Nat Friedman (@natfriedman) 的推文:通过阅读推荐论文并重新运行一些评估(evals),我得出的一个不太确定的结论是,从代码到其他推理过程存在一些微弱的迁移和泛化迹象...

- 来自 Jan Leike (@janleike) 的推文:昨天是我作为 OpenAI 对齐负责人、超级对齐(superalignment)负责人和高管的最后一天。

- 机器学习使垂直轴风力涡轮机的可行性成为可能:洛桑联邦理工学院(EPFL)的研究人员使用遗传学习算法来确定垂直轴风力涡轮机叶片的最佳变桨曲线,尽管这种涡轮机具有很高的能量潜力,但直到现在...

- Thread Reader App 上 @janleike 的推文串:@janleike:昨天是我作为 OpenAI 对齐负责人、超级对齐负责人和高管的最后一天。在过去的约 3 年里,这是一段疯狂的旅程。我的团队推出了有史以来第一个 RLHF LLM...

- GitHub - sublayerapp/sublayer:一个模型无关的 Ruby 生成式 AI DSL 和框架。提供用于构建 Generator、Action、Task 和 Agent 的基类,可用于在 Ruby 中构建 AI 驱动的应用程序。:一个模型无关的 Ruby 生成式 AI DSL 和框架。提供用于构建 Generator、Action、Task 和 Agent 的基类,可用于在 Ruby 中构建 AI 驱动的应用程序。

- GitHub - go-go-golems/geppetto:golang GPT3 工具集:golang GPT3 工具集。通过在 GitHub 上创建账户为 go-go-golems/geppetto 的开发做出贡献。

- S Sam 和 Greg 对 OpenAI 安全研究员指控的回应 | Hacker News</a>: 未找到描述 </ul> </div> --- **Latent Space ▷ #[ai-in-action-club](https://discord.com/channels/822583790773862470/1200548371715342479/1241116585867874455)** (127 messages🔥🔥): - **讨论了 "Feedback Is All You Need"**:分享了一个名为 "Feedback Is All You Need - Gordon Brander" 的 [YouTube 视频](https://www.youtube.com/watch?v=BNFRGfWQo6M),引发了关于当前的 AI Agent 是否能够学习、适应并做出自主决策的讨论。 - **Andrew Ng 谈 AI Agent**:分享了 [Andrew Ng 的一条推文](https://x.com/AndrewYNg/status/1770897666702233815)链接,强调了 AI Agentic 工作流推动 AI 重大进展的潜力。他详细阐述了迭代工作流的好处,以及构建 Agent 的各种设计模式,如 Reflection、工具使用、规划和多 Agent 协作。 - **关于 AI Agent 定义的辩论**:成员们辩论了 AI Agent 的定义和属性,将其与传统的软件 Agent 进行比较,并将自主性、社交能力、反应性和持久性视为关键因素。 - **强化学习与历史背景**:讨论了 AI 中 Agent 的历史背景,引用了 1959 年 Samuel 的跳棋程序等开创性工作,突出了基于 Agent 的决策系统的起源和演变。 - **对 AI 音乐生成的兴趣**:成员们表达了对 AI 生成音乐及相关项目的兴奋和兴趣,并分享了个人轶事和未来的协作计划。一位成员提到正在进行 MusicGen 微调(finetunes)工作,并承诺分享相关链接。

- Software agent - Wikipedia: 未找到描述

- Muahaha GIF - The Simpsons Mr Burns Muahahaha - Discover & Share GIFs: 点击查看 GIF

- Feedback Is All You Need - Gordon Brander: 我们距离实现能够学习、适应并自主决策的 AI Agent 还有多远?我们已经达到了吗?究竟什么是 Agent?答案就在...

- Andrew Ng (@AndrewYNg) 的推文: 我认为 AI Agentic 工作流今年将推动巨大的 AI 进步——甚至可能超过下一代基础模型。这是一个重要的趋势,我敦促每一位从事 AI 工作的人...

- AI In Action: Weekly Jam Sessions: 2024 主题, 日期, 主持人, 资源,@dropdown,@ GenAI 的 UI/UX 模式,1/26/2024,nuvic,<a href="https://maggieappleton.com/squish-structure">https://maggieappleton.com/squish-stru...

- 未找到标题:未找到描述

- Llama Hub:未找到描述

- 正在重定向...:未找到描述

- 检索增强生成:政府效率的新前沿 | NVIDIA On-Demand:我们将介绍检索增强生成 (RAG),这是一种可以从大型数据源中搜索并生成答案的 AI 技术

- 在使用 Azure AI Search 的生成式 AI 应用程序中进行访问控制:在您的生成式 AI 应用程序中应用访问控制,以执行组织策略并限制对授权内容的访问。

- 文档管理 - LlamaIndex:未找到描述

- Neo4j 向量存储 - LlamaIndex:未找到描述

- run-llama/llama_index 中的 llama_index/llama-index-core/llama_index/core/readers/file/base.py:LlamaIndex 是适用于您的 LLM 应用程序的数据框架 - run-llama/llama_index

- Qdrant 混合搜索 - LlamaIndex:未找到描述

- Ollama - Llama 3 - LlamaIndex:未找到描述

- Pandas 查询引擎 - LlamaIndex:未找到描述

- 未找到标题:未找到描述

- 🛂contribute / ❄️snowflake / FDABot · GitLab:🙋🏻♂️ 欢迎来到 🌟Tonic-AI 社区

- 来自 apolinario (multimodal.art) (@multimodalart) 的推文:非常激动 CommonCanvas 刚刚发布!🖼️ • 首个完全基于公开授权图像训练的开源文本生成图像模型(SD2 和 SDXL 架构) • 该数据集包含约 70M 公开授权...

- THUDM/cogvlm2-llama3-chat-19B · Hugging Face:未找到描述

- 来自 Mustafa Suleyman (@mustafasuleyman) 的推文:我们正在将 Copilot 提升到新的水平。🚀 Copilot 将能够实时观看、聆听、交谈并提供帮助。观看此演示以了解我的意思。很快,你的 AI 伴侣将开始与你一起生活,无论...

- 来自 OpenAI (@OpenAI) 的推文:我们收到了关于如何选择 ChatGPT 语音(尤其是 Sky)的问题。我们正在暂停使用 Sky,同时处理这些问题。详细了解我们如何选择这些语音:https://openai...

- VLM-Captioning-Tools/bad_caption_finder.py (位于 main 分支) · ProGamerGov/VLM-Captioning-Tools:用于使用 VLM 为图像生成字幕的 Python 脚本 - ProGamerGov/VLM-Captioning-Tools

- Sakuga-42M 数据集:扩展卡通研究:手绘卡通动画利用草图和色块来创造运动的错觉。虽然 CLIP、SVD 和 Sora 等近期进展在理解和...方面表现出色。

- MambaOut:我们真的需要 Mamba 来处理视觉吗?:Mamba 是一种具有类似 RNN 的状态空间模型 (SSM) token mixer 的架构,最近被引入以解决注意力机制的二次复杂度问题,并随后应用于视觉任务...

- Chameleon:混合模态早期融合基础模型:我们介绍了 Chameleon,这是一个基于 token 的早期融合混合模态模型系列,能够以任意顺序理解和生成图像与文本。我们概述了一种稳定的训练方法...

- LoRA 学得更少,遗忘也更少:低秩自适应 (LoRA) 是一种广泛使用的 LLM 参数高效微调方法。LoRA 通过仅对选定的权重矩阵训练低秩扰动来节省显存。在...

- CogVLM2/MODEL_LICENSE (位于 main 分支) · THUDM/CogVLM2:第二代 CogVLM 多模态预训练对话模型。通过在 GitHub 上创建账号为 THUDM/CogVLM2 的开发做出贡献。

- 4Wall AI: 在 4thWall AI 上探索互动式 AI 内容

- 来自 4Wall AI (@4WallAI_) 的推文: ✨即将登陆 4Wall✨ http://beta.4wall.ai

- 来自 ⚡Rosebud AI🌹 (@Rosebud_AI) 的推文: 🌟 展示我们 #WeekOfAI 教育 Game Jam 的获胜者!🌟 这 4 款使用 Rosebud AI 制作的令人惊叹的 AI 驱动游戏,展示了如何创建有趣的教育游戏。非常感谢我们的评委...

- 在 Rosebud 上玩和创建游戏 —— AI 驱动的游戏开发: 使用 AI 来创建、分享和玩游戏。从文本描述到代码再到游戏。

- Edgar Haond 🎲 (@edgarhnd) 的推文:很高兴今天发布 AI Reality TV!我们的新平台让你能够创建自己的社交模拟。曾经好奇过《加勒比海盗》里的伊丽莎白更喜欢杰克还是威尔吗?现在你可以模拟...

- cocktail peanut (@cocktailpeanut) 的推文:AI Town 一键启动器登陆 Windows!感谢 @convex_dev 团队的努力,我们终于有了 Windows 原生 convex 二进制文件(为 AI Town 提供动力)。AI Town——一个完全可黑客化、持久化的...

- AI Reality TV:未找到描述

- Ethan Mollick (@emollick) 的推文:好的,我在机器上本地运行了一个由自主 AI Agent 组成的小镇,并给他们分配了《公园与游憩》中的角色。让我们看看会发生什么。

- 我们制作了 AI Town 的后端。以下是实现方法。:[0:00] - 介绍 [1:15] - 组件 [1:23] - Agents (https://github.com/a16z-infra/ai-town/blob/main/convex/agents.ts) [1:29] - 引擎 (https://gi...

- Pinokio:AI 浏览器

- cocktail peanut (@cocktailpeanut) 的推文:介绍 AI Town Player。你知道整个 AI Town 都通过 @convex_dev 存储在单个 sqlite 文件中吗?我逆向工程了其模式,并构建了一个 Web 应用,让任何人都可以回放任何 A...

- townplayer/index.html at main · cocktailpeanut/townplayer:回放 AI Town。通过在 GitHub 上创建账户,为 cocktailpeanut/townplayer 的开发做出贡献。

- cocktail peanut (@cocktailpeanut) 的推文:介绍 AI Town Player。你知道整个 AI Town 都通过 @convex_dev 存储在单个 sqlite 文件中吗?我逆向工程了其模式,并构建了一个 Web 应用,让任何人都可以回放任何 A...

- AI Reality TV:未找到描述

- GitHub - cocktailpeanut/townplayer: Replay AI Town:回放 AI Town。通过在 GitHub 上创建账户,为 cocktailpeanut/townplayer 的开发做出贡献。

- The Tokenizer Playground - a Hugging Face Space by Xenova:未找到描述

- OpenRouter API Watcher:探索 OpenRouter 的模型列表和记录的变更。每小时更新一次。

- OpenRouter:LLM 和其他 AI 模型的路由中心

- OpenRouter:LLM 和其他 AI 模型的路由中心

- GPT-4o’s Chinese token-training data is polluted by spam and porn websites: 未找到描述

- Feat: Add cohere (commandr) by NanoCode012 · Pull Request #1547 · OpenAccess-AI-Collective/axolotl: 描述、动力与背景。如何测试?未测试!屏幕截图(如适用)。变更类型。社交账号(可选)。

- Pull requests · OpenAccess-AI-Collective/axolotl: 尽管提出 axolotl 问题。通过在 GitHub 上创建账户来为 OpenAccess-AI-Collective/axolotl 的开发做出贡献。

- m-a-p (Multimodal Art Projection): 未找到描述

- BAAI (Beijing Academy of Artificial Intelligence): 未找到描述

- hpcai-tech/grok-1 · Hugging Face: 未找到描述

- Unsloth optims for Llama by winglian · Pull Request #1609 · OpenAccess-AI-Collective/axolotl: 将 Unsloth 的优化集成到 axolotl 的 WIP。针对 MLP、QKV、O 的手动 autograd 似乎只减少了 1% 的 VRAM,而不是报告的 8%。交叉熵损失确实有显著帮助...

- Llama3-70b: Full Finetune w/CPU offload + fused optimizer by rohan-varma · Pull Request #993 · pytorch/torchtune: 背景。此 PR 的目的是什么?是添加新功能、修复 bug、更新测试和/或文档,还是其他(请在此添加)。请链接此 PR 解决的任何 issue。变更日志...

- axolotl/src/axolotl/core/trainer_builder.py at main · OpenAccess-AI-Collective/axolotl:尽管提问。通过在 GitHub 上创建账号为 OpenAccess-AI-Collective/axolotl 的开发做出贡献。

- axolotl/src/axolotl/prompt_strategies/orpo/chat_template.py at main · OpenAccess-AI-Collective/axolotl:尽管提问。通过在 GitHub 上创建账号为 OpenAccess-AI-Collective/axolotl 的开发做出贡献。