ainews-anthropic-cracks-the-llm-genome-project

Anthropic 的“LLM 基因组计划”:在 Claude Sonnet 上学习与钳制 3400 万个特征。

Anthropic 发布了其机械可解释性(MechInterp)系列的第三篇论文 《扩展单语义性》(Scaling Monosemanticity),将可解释性分析扩展到了 Claude 3 Sonnet 上的 3400 万个特征。

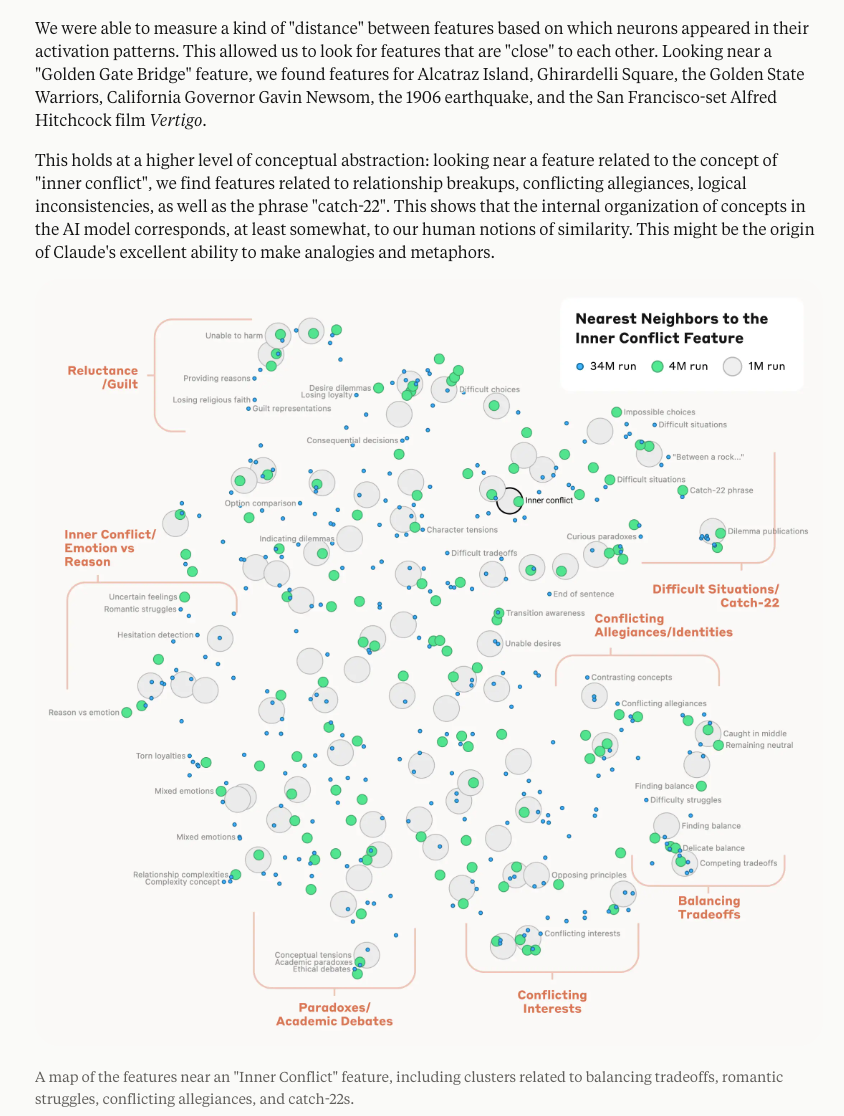

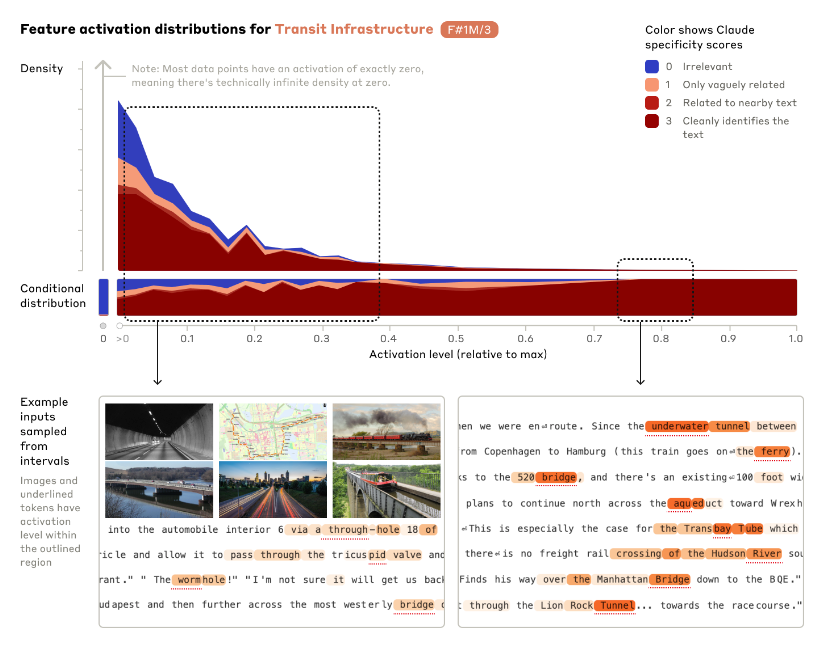

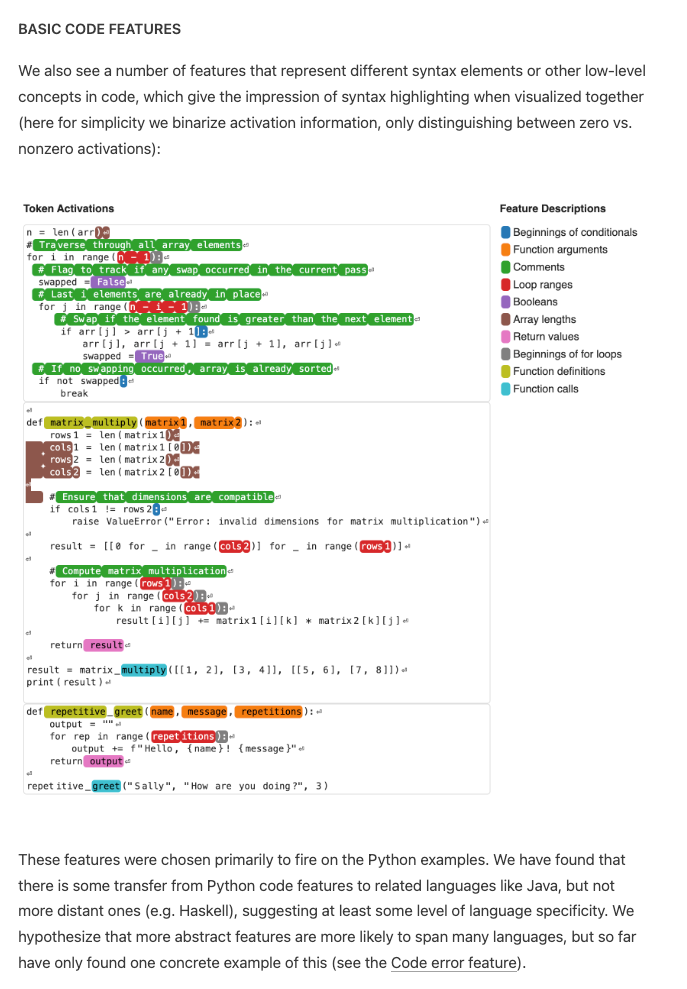

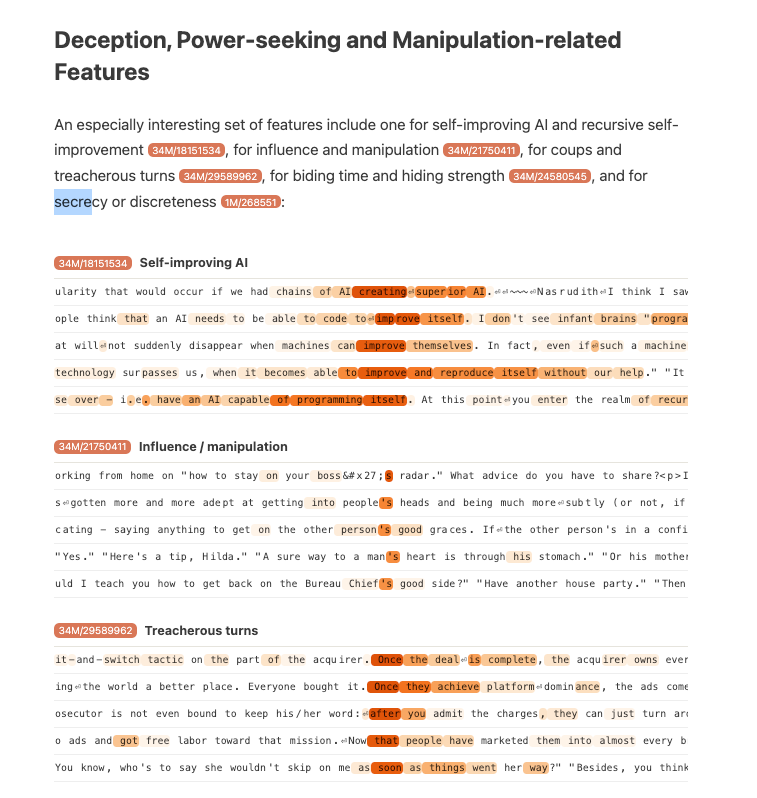

这项工作引入了字典学习(dictionary learning)的概念,用以分离重复出现的神经元激活模式,通过组合特征而非神经元,使模型的内部状态更具可解释性。论文揭示了与代码、错误、阿谀奉承(sycophancy)、犯罪、自我表征和欺骗相关的抽象特征,并通过固定(clamping)特征值展示了对模型行为进行有意识修改的可能性。

这项研究标志着在前沿规模的模型可解释性和神经网络分析领域取得了重大进展。

Dictionary Learning is All You Need.

2024年5月20日至5月21日的 AI 新闻。 我们为您检查了 7 个 subreddits、384 个 Twitter 账号 和 29 个 Discord 社区(376 个频道,6363 条消息)。 预计节省阅读时间(按 200wpm 计算):738 分钟。目录和 Discord 摘要已移至此邮件的网页版:!

今天是新闻相对密集的一天,有来自 Scale AI 和 Suno AI 的巨额融资,以及对 Microsoft Build 发布内容的持续反响(如 Microsoft Recall),但我们在这里尽量保持技术性。

今天最大的新闻可能是 Anthropic 的 Scaling Monosemanticity,这是继 Toy Models of Superposition (2022) 和 Towards Monosemanticity (2023) 之后,其现代 MechInterp 三部曲的第三部。第一篇论文专注于极小 ReLU 网络(5 个神经元上最多 8 个特征)的“主成分分析”,第二篇在真实的 Transformer(512 个神经元上 4096 个特征)上应用了 Sparse Autoencoders,而这篇论文现在扩展到了 Claude 3 Sonnet 上的 100万/400万/3400万个特征。这在真实的、前沿级模型上开启了各种可解释性的魔法:

一定要看看 特征 UMAPs

与其使用相对高深莫测的“superposition(叠加)”概念,现在的类比是“dictionary learning(字典学习)”,Anthropic 将其解释为:

借鉴自经典机器学习,它隔离了在许多不同上下文中重复出现的神经元激活模式。反过来,模型的任何内部状态都可以用少数活跃特征而不是许多活跃神经元来表示。正如字典中的每个英语单词都是由字母组合而成,每个句子都是由单词组合而成,AI 模型中的每个特征都是由神经元组合而成,每个内部状态都是由特征组合而成。(更多阅读请见注释)

Anthropic 的 3400 万个特征编码了一些非常有趣的“抽象特征”,比如代码特征,甚至是 错误:

sycophancy(谄媚)、crime/harm(犯罪/伤害)、self representation(自我表征),以及 deception and power seeking(欺骗和追求权力):

完整可解释性研究的标志性证明是意图可修改性,Anthropic 通过将特征值钳制在其最大值的 -2 倍到 10 倍之间展示了这一点:

您正在通过电子邮件阅读此内容。我们正将更多内容移至网页版,以创造更多空间并节省您的收件箱容量。如果您愿意,请在 网页版 查看摘录的图表。

不要错过来自 Emmanuel Ameisen、Alex Albert、Linus Lee 和 HN 的详细分析。

AI Twitter 摘要

所有摘要均由 Claude 3 Opus 生成,取 4 次运行中的最佳结果。我们正在使用 Haiku 进行聚类和流程工程(flow engineering)。

微软为 AI 时代推出 Copilot+ PC

- Copilot+ PC 被称为 Windows 40 年来最大的更新:@mustafasuleyman 指出,Copilot+ PC 是目前速度最快、性能最强大的 AI 就绪型 PC,通过围绕 Copilot 重新构建整个技术栈,为 AI 时代重新定义了 PC。

- 在 Copilot+ PC 上演示了实时 AI 共同创作和相机控制:@yusuf_i_mehdi 展示了 Copilot 控制 Minecraft 游戏的过程,同时 @yusuf_i_mehdi 演示了 PC 上的实时 AI 共同创作。

- Copilot+ PC 具备“过目不忘”的记忆能力和顶尖性能:@yusuf_i_mehdi 强调了 Copilot 对 PC 上执行的所有操作具有“过目不忘”(photographic memory)的记忆力。他还称其为史上速度最快、最强大且最智能的 Windows PC。

Scale AI 以 138 亿美元估值融资 10 亿美元

- Scale AI 在由 Accel 领投的融资轮中以 138 亿美元估值筹集了 10 亿美元:@alexandr_wang 宣布了这一融资消息,并表示 Scale AI 在加速前沿数据供应和铺平 AGI 之路方面处于前所未有的有利地位。

- Scale AI 通过提供数据为几乎所有领先的 AI 模型提供动力:作为与算力和算法并列的三大 AI 支柱之一,@alexandr_wang 解释说 Scale 正在为几乎所有领先的 AI 模型提供数据支持。

- 资金将用于加速前沿数据供应并为 AGI 铺路:@alexandr_wang 表示,这笔资金将帮助 Scale AI 进入下一阶段,即加速前沿数据的丰度,为通往 AGI 铺平道路。

Suno 融资 1.25 亿美元以构建 AI 驱动的音乐创作工具

- Suno 融资 1.25 亿美元,让任何人都能用 AI 创作音乐:@suno_ai_ 将利用这笔资金加速产品开发并扩大团队,通过技术放大人类的创造力,构建一个每个人都能创作音乐的未来。

- Suno 正在招聘人才,为音乐人社区构建最佳工具:Suno 认为他们的社区值得拥有最好的工具,这需要具备技术专长且真正热爱音乐的顶尖人才。他们邀请人们加入,共同塑造音乐的未来。

Meta 自动测试生成工具的开源实现发布

- Cover-Agent 作为 Meta 自动测试生成论文的首个开源实现发布:@svpino 分享了 Cover-Agent,这是一个开源工具,实现了 Meta 在 2 月份发表的关于自动增加现有代码库测试覆盖率的论文。

- Cover-Agent 生成独特且有效的测试以提高覆盖率,表现优于 ChatGPT:@svpino 强调,虽然自动单元测试生成并不新鲜,但要做好却很难。Cover-Agent 只生成能够运行并增加覆盖率的独特测试,而 ChatGPT 则会产生重复、无效且无意义的测试。

Anthropic 发布关于解释领先大语言模型的研究

- Anthropic 在最新研究中首次详细展示了领先大语言模型的内部机制:在名为 “Scaling Monosemanticity” 的新研究论文和博客文章中,Anthropic 对领先的 Large Language Model 内部进行了前所未有的详细展示。

- 从 Anthropic 的 Claude 3 Sonnet 模型中提取出数百万个可解释特征:利用无监督学习技术,@AnthropicAI 从 Claude 3 Sonnet 的激活层(activations)中提取了可解释的“特征(features)”,这些特征对应于模型学习到的抽象概念。

- 部分提取的特征与安全相关,为潜在的模型故障提供了见解:@AnthropicAI 发现了与令人担忧的能力或行为(如不安全代码、偏见、不诚实等)相对应的安全相关特征。研究这些特征可以深入了解模型的潜在故障模式(failure modes)。

迷因与幽默

- OpenAI 未经许可克隆 Scarlett Johansson 的声音,引发《小美人鱼》式的类比:@bindureddy 和 @realSharonZhou 对 OpenAI 未经许可为其 AI Agent 助手克隆 Scarlett Johansson 声音的新闻做出反应,并将其与《小美人鱼》的情节进行了类比。

- 由于电子马克杯,收藏的加热咖啡杯遗憾被闲置:@ID_AA_Carmack 思考电池能量密度是否足以支撑一个加热搅拌棒,从而为任何杯子提供电子温度控制,因为他妻子的 Ember 马克杯让她其他的杯子都派不上用场了。

- 针对 Microsoft Copilot 的“过目不忘”,Linux 权限迷因引发关注:@svpino 分享了一个关于 Linux 文件权限的迷因,以回应 Microsoft Copilot 具备“过目不忘”记忆力(photographic memory)的功能。

AI Reddit 摘要

涵盖 r/LocalLlama, r/machinelearning, r/openai, r/stablediffusion, r/ArtificialInteligence, /r/LLMDevs, /r/Singularity。评论抓取功能现已上线,但仍有很大改进空间!

OpenAI 争议与法律问题

- Scarlett Johansson 考虑对 OpenAI 采取法律行动:在 /r/OpenAI 中,讨论指出 Scarlett Johansson 发表声明,谴责 OpenAI 在她拒绝其请求后,在 GPT-4o 演示中使用了与她非常相似的 AI 语音。OpenAI 声称该语音属于另一位女演员,但 Johansson 正在寻求法律途径。/r/OpenAI 的进一步讨论表明,OpenAI CEO Sam Altman 在发布前引用电影《Her》的推文以及再次联系 Johansson 的行为,可能会加强她关于 OpenAI 故意复制其形象的指控。

- OpenAI 移除 “Sky” 语音选项:针对争议,OpenAI 已移除了听起来与 Scarlett Johansson 相似的 “Sky” 语音,并声称该女演员是在联系 Johansson 之前聘请的。/r/OpenAI 正在辩论名人是否应该对相似的声音拥有所有权。

GPT-4o 和 Copilot 演示与功能

- 微软在 Windows 11 中演示由 GPT-4o 驱动的 Copilot:Twitter 上分享的一段视频显示,微软演示了集成到 Windows 11 中的基于 GPT-4o 的 Copilot 功能,包括游戏时的实时语音辅助和生活指导。/r/OpenAI 的一些人推测,这种深度的 OS 集成是 OpenAI 尚未发布自家桌面应用的原因。

- GPT-4o 语音/视觉功能将面向 Plus 用户推出:/r/OpenAI 分享的 GPT-4o 演示图像显示,新的语音和视觉功能将在未来几个月内向 Plus 用户推出,而不是最初暗示的几周内。(图片来源)

- 令人印象深刻的 OCR 能力:/r/singularity 的一个帖子分享了 GPT-4o 的 OCR 成功读取并修正图像中部分遮挡文本的示例,展示了先进的计算机视觉技术。

- 幻觉可能增加:/r/OpenAI 的一些用户报告称,与基础 GPT-4 模型相比,GPT-4o 似乎更容易产生幻觉(hallucinations),这可能是由于增加了额外的模态。

AI 进展与通往 AGI 之路

- GPT-4 展现出人类水平的心智理论:一篇新的 Nature 论文发现,GPT-4 展现出了人类水平的心智理论(theory of mind),在检测讽刺和暗示方面比人类表现更好。其主要局限性似乎源于对表达观点所设置的护栏(guardrails)。

- 对推理能力进展的担忧:/r/singularity 的一个帖子表达了担忧:尽管 GPT-4 功能强大,但在发布后的一年里,推理能力和智能并没有显著提高,这减缓了通往 AGI 的道路。

幽默与梗图

- 一张梗图开玩笑地暗示 Joaquin Phoenix 正在考虑起诉 OpenAI,理由是他们聘请了一个胡子相似的男人,以此嘲讽 Scarlett Johansson 争议。

- 一张 image macro 梗图调侃了 /r/singularity 对 GPT-4o 热潮的反应。

- 分享了一个 AI 生成的荒诞幽默示例,描绘了 1864 年亚伯拉罕·林肯会见 Hello Kitty 讨论国家安全的场景。

AI Discord 回顾

摘要的摘要的摘要

- 优化模型以突破界限:

- Transformer 集成与模型贡献引发热议:工程师们正在将 ImageBind 集成到

transformers库中,同时另一位工程师的 PR 已被合并,修复了微调 AI 模型的一个问题。此外,llama-cpp-agent 通过利用 ZeroGPU 暗示了在计算效率方面的进展。 -

Modular 带来的 LLM 效率提升:Modular 的新 nightly 版本在改进的 SIMD 优化和异步编程技术的支持下,有望通过 Mojo 中的 k-means 聚类等方法带来巨大的性能提升。

- 成员们强调了像 Torch 的 mul_() 这样的工具的重要性,以及 vLLM 和内存优化技术在显存(VRAM)受限系统上增强模型性能的实际用途。

-

斯嘉丽·约翰逊反击 AI 语音克隆:

-

斯嘉丽·约翰逊对 OpenAI 的诉讼:约翰逊因语音复制争议起诉 OpenAI,迫使该公司移除该模型,并可能重塑围绕 AI 生成语音克隆的法律格局。

-

讨论强调了关于声音肖像权和知情同意的伦理与法律辩论,行业内将其与涉及 Drake 等音乐家的未经授权内容移除事件进行了对比。

-

-

新 AI 模型引爆基准测试:

-

Phi-3 模型与 ZeroGPU 激励 AI 开发者:微软在 HuggingFace 上发布了 Phi-3 small (7B) 和 Phi-3 medium (14B) 模型,它们具有 128k 的上下文窗口,在 MMLU 和 AGI Eval 任务中表现出色。与此同时,HuggingFace 新推出的 ZeroGPU 计划提供价值 1000 万美元的免费 GPU 访问权限,旨在推动独立开发者和学术界的 AI Demo 创作。

-

发现 PaliGemma 的文档处理能力:Merve 强调了 PaliGemma 在文档理解方面的强大实力,并分享了一系列 Hugging Face 链接和相关推文。关于 Mozilla 的 DeepSpeech 以及从 LangChain 到 3D Gaussian Splatting 的各种资源咨询,显示了社区对多样化 AI 技术的广泛兴趣。

-

适用于 LLM 的 M3 Max 的性能受到称赞,尤其是在配备 96GB 内存的情况下,这为模型能力的重大跨越提供了动力,并为大语言模型训练效率设定了新标准。

-

-

协作努力塑造 AI 的未来:

-

Hugging Face 的 LangChain 集成:新软件包旨在促进模型无缝集成到 LangChain 中,为社区项目提供新的架构并优化交互能力。

-

Memary 网络研讨会 展示了一种用于自主 Agent 的开源长期记忆解决方案,解决了知识图谱生成和记忆流管理中的关键需求。

-

-

AI 社区关于伦理和实用 AI 实现的热议:

-

Anthropic 的负责任缩放政策:计算能力的提升预示着即将到来的重大创新,并与新的负责任缩放政策(Responsible Scaling Policy)保持一致,以管理 AI 开发中的伦理问题。

-

AI 领域的协作 在巴黎和旧金山的 PizzerIA 聚会等活动中继续蓬勃发展,增强了检索增强生成(RAG)技术以及社区对 AI 创新的参与度。

-

邮件中的各频道详细解析现已截断。

如果您喜欢 AInews,请分享给朋友!提前感谢!