ainews-sonic-a-low-latency-voice-model-for

1万亿 token 上下文,实时,端侧运行?

专注于状态空间模型 (SSM) 的初创公司 Cartesia 发布了一款低延迟语音模型。该模型的表现优于基于 Transformer 的模型,其困惑度(perplexity)降低了 20%,词错率降低了 2 倍,且 NISQA 质量评分高出 1 分。这一突破凸显了此类模型的潜力,即能够在设备端利用万亿级 Token 的上下文窗口,对大规模多模态数据流(文本、音频、视频)进行持续处理和推理。

此外,新闻还涵盖了近期 AI 领域的一系列进展,包括 Mistral 发布 Codestral 权重、Schedule Free 优化器论文发布,以及 Scale AI 推出的全新 Elo 风格评估排行榜。同时,文中还提到了 杨立昆 (Yann LeCun) 与 埃隆·马斯克 (Elon Musk) 之间关于“发表 AI 研究”与“工程成就”孰轻孰重的辩论。最后,Gemini 1.5 Pro/Advanced 模型也因其强劲的表现被提及。

SSMs 是你所需的一切。

2024年5月28日至5月29日的 AI 新闻。 我们为你查看了 7 个 subreddits、384 个 Twitter 账号 和 29 个 Discord 服务(389 个频道,5432 条消息)。 预计节省阅读时间(以 200wpm 计):553 分钟。

我们今日头条故事的候选名单:

- 祝 GPT3 四岁生日快乐!

- 你好 Codestral。权重已根据 Mistral 非商业许可证发布,评测表现不错,支持 80 种语言,但进一步细节较少。

- Schedule Free 优化器来了!我们在 2 个月前报道过这些,现在论文已经发布——评判团正在评估,但目前看来情况良好——如果能够扩展,这可能是学习率优化领域的一篇具有变革意义的论文。

- Scale AI 推出了自己的 Elo 风格评测排行榜,包含私有、持续更新的领域专家评测,涵盖编程、数学、指令遵循和多语言(西班牙语),延续了他们在 GSM1k 上的类似工作。

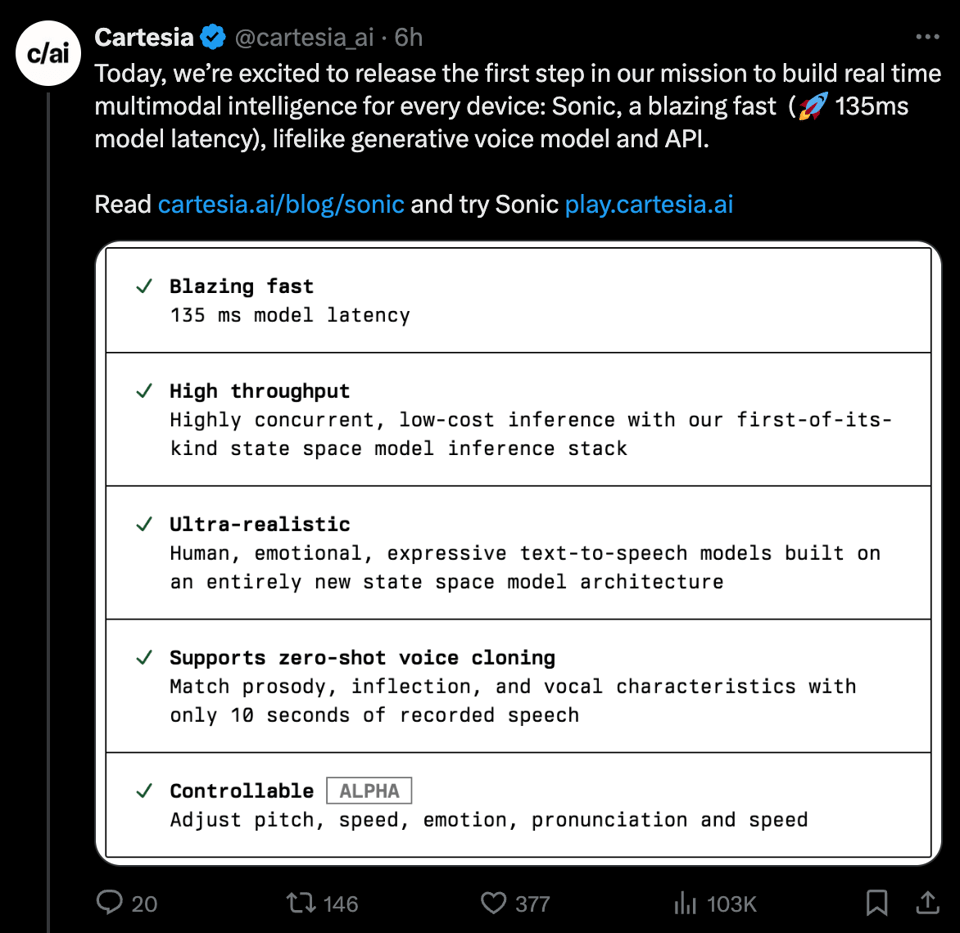

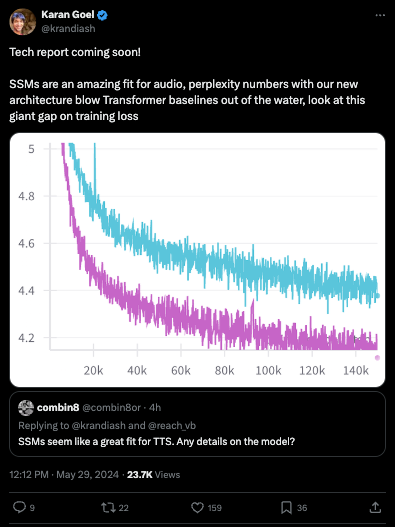

但今天我们将胜利(W)授予 Cartesia,这是一家由另一位 Mamba 共同作者创立的 State Space Models 初创公司。他们今天发布了传闻已久的 低延迟语音模型,轻松击败了对应的 Transformer 模型(困惑度降低 20%,词错误率降低 2 倍,NISQA 质量提高 1 分):

Loss 图表中巨大的差距证明了这一点:

这是日益增多的可用 State Space Models 中最新的一款,发布公告讨论了极高效实时模型所开启的愿景:

即使是最好的模型也无法持续处理和推理长达一年的音频、视频和文本流:10 亿文本 token、100 亿音频 token 和 1 万亿视频 token——更不用说在设备端(on-device)运行了。难道不应该让每个人都能获得不需要调度数据中心的廉价智能吗?

看到可用的 SSMs 现身并能切实挑战 SOTA 令人备受鼓舞(我们尚未看到与 ElevenLabs 等的对比,但作为 ElevenLabs 的资深用户,我们在 Cartesia Playground 上的抽查结果非常具有说服力)。

但将 SSMs 与当前的 SOTA 进行比较,忽略了上述引用文字中所表达的宏大野心:如果你知道我们很快就能拥有可以持续处理和推理文本/音频/视频,且拥有“万亿级” token “上下文窗口”的模型,你会做出什么不同的选择?而且是在设备端?

AI Twitter 摘要回顾

所有摘要均由 Claude 3 Opus 完成,取 4 次运行中的最佳结果。我们正在尝试使用 Haiku 进行聚类和流程工程(flow engineering)。

Yann LeCun 与 Elon Musk 关于 AI 研究与工程的辩论

- 发表研究的重要性:@ylecun 认为,研究要被称为科学,必须发表并提供足够的细节以供复现,强调了同行评审和共享科学信息对技术进步的重要性。

- 基于已发表科学成果的工程壮举:有人认为 Elon Musk 和 SpaceX 等公司正在通过工程推动技术进步,而并不总是发表论文。@ylecun 反驳称,这些工程壮举在很大程度上是基于已发表的科学突破。

- 科学与工程的区别:讨论引发了关于科学与工程之间差异及其互补性的辩论。@ylecun 阐明了这两个领域在课题、方法论、出版物和影响力方面的区别。

大语言模型 (LLMs) 与 AI 能力的进展

- Gemini 1.5 模型的强劲表现:@lmsysorg 报告称,Gemini 1.5 Pro/Advanced 在其排行榜上排名第 2,几乎追平 GPT-4,而 Gemini 1.5 Flash 排名第 9,超越了 Llama-3-70b 和 GPT-4-0125。

- Codestral-22B 代码模型发布:@GuillaumeLample 宣布发布 Codestral-22B,该模型在 80 多种编程语言上进行了训练,性能优于以往的代码模型,并可通过 API 获取。

- 用于图像生成视频的 Veo 模型:@GoogleDeepMind 推出了 Veo,它可以根据单张参考图像并遵循文本提示指令创建视频片段。

- 用于前沿模型评估的 SEAL 排行榜:@alexandr_wang 推出了针对前沿模型的私人专家评估,重点关注不可利用且持续更新的基准测试。

- GPT-3 发布 4 年后的 Scaling 洞察:@alexandr_wang 反思了自 GPT-3 论文以来的进展,指出未来 4 年将是算力和数据的指数级 Scaling,这代表了我们时代最大规模的基础设施项目。

研究论文与技术

- 用于训练 Transformers 的 Schedule-Free 平均法:@aaron_defazio 及其合作者发表了一篇论文,介绍了用于训练 Transformers 的 Schedule-Free 平均法,与标准的学习率调度(learning rate schedules)相比,显示出强劲的结果。

- 用于显存高效 LLM 训练的 VeLoRA:一篇新论文提出了 VeLoRA,这是一种使用 rank-1 sub-token 投影进行 LLM 微调和预训练的显存高效算法。(https://twitter.com/_akhaliq/status/1795651536497864831)

- 在线与离线对齐算法之间的性能差距:Google 的一篇论文研究了为什么用于对齐 LLM 的在线 RL 算法优于离线算法,结论是在线策略采样(on-policy sampling)起到了关键作用。(https://twitter.com/rohanpaul_ai/status/1795432640050340215)

- Transformers 通过特殊嵌入学习算术:@tomgoldsteincs 展示了 Transformers 可以通过使用特殊的编码位置嵌入(positional embeddings)来学习加法和乘法等算术运算。

梗与幽默

AI Reddit 摘要

涵盖 r/LocalLlama, r/machinelearning, r/openai, r/stablediffusion, r/ArtificialInteligence, /r/LLMDevs, /r/Singularity。评论抓取功能现已上线,但仍有很大改进空间!

AI 模型开发

- Gemini 1.5 Pro 表现优于大多数 GPT-4 实例:在 LMSYS Chatbot Arena 排行榜上,Gemini 1.5 Pro 击败了除 4o 以外的所有 GPT-4 实例。这突显了开源 AI 模型的快速进步。

- Abliterated-v3 模型发布:Phi 模型的去审查版本,包括 Phi-3-mini-128k 和 Phi-3-vision-128k 已发布,扩大了获取强大 AI 能力的途径。

- Llama3 8B Vision 模型媲美 GPT-4:一款新的多模态模型 Llama3 8B Vision 模型已发布,其视觉理解能力与 GPT4V 和 GPT4o 持平。

- Gemini Flash 和更新后的 Gemini 1.5 Pro 加入排行榜:LMSYS Chatbot Arena 排行榜已 更新,加入了 Gemini Flash 和改进版的 Gemini 1.5 Pro,展示了持续的迭代。

AI 安全与伦理

- 公众对 AI 伦理的担忧:一项民意调查显示,超过半数的美国人认为 AI 公司在开发技术时没有充分考虑伦理,且近 90% 的人支持政府监管。这凸显了公众对负责任 AI 开发日益增长的担忧。

AI 工具与应用

- HuggingChat 增加工具支持:HuggingChat 现在集成了 PDF 解析、图像生成、网页搜索等工具,扩展了其作为 AI 助手的职能。

- CopilotKit v0.9.0 发布:一个 用于构建应用内 AI Agent 的开源框架,CopilotKit v0.9.0 支持 GPT-4o、原生语音和 Gemini 集成,使 AI 驱动的应用开发更加简便。

- WebLLM Chat 实现浏览器内模型推理:WebLLM Chat 允许在 Web 浏览器中本地运行 Llama, Mistral, Hermes, Gemma, RedPajama, Phi 和 TinyLlama 等开源 LLM,使模型访问更加便捷。

- LMDeploy v0.4.2 支持视觉语言模型:最新版本的 LMDeploy 支持 llava, internvl, internlm-xcomposer2, qwen-vl, deepseek-vl, minigemini 和 yi-vl 等 VL 模型的 4-bit 量化和部署,促进了高效的多模态 AI 开发。

AI 硬件

- 在改装的 2080ti GPU 上运行 Llama3 70B:通过 将 2 张 2080ti GPU 改装为每张 22GB VRAM,可以在此配置上运行 Llama3 70B 模型,展示了大模型推理的创意解决方案。

- 4x GTX Titan X Pascal 12GB 配置运行 Llama3:利用 4 张 GTX Titan X Pascal 12GB GPU 提供的总计 48GB VRAM,可以使用 Q3KM 量化运行 Llama3 70B,展示了旧硬件的潜力。

- SambaNova 的 Samba-1 Turbo 运行 Llama-3 8B:SambaNova 展示了其 Samba-1 Turbo AI 硬件运行 Llama-3 8B 模型,突显了高效推理的专业化解决方案。

AI 争议与八卦

- Sam Altman 过去的争议:据透露,Sam Altman 曾被 Y Combinator 解雇,其初创公司 Loopt 的员工曾因其混乱且具有欺骗性的行为要求董事会解雇他 (图片),揭示了这位 OpenAI CEO 的过往。

- Yann LeCun 与 Elon Musk 的交锋:在一次公开讨论中,Elon Musk 对 Yann LeCun 的科学成就给出了无力的反驳,凸显了 AI 先驱之间的紧张关系。

梗图与幽默

AI Discord 摘要

摘要之摘要的摘要

-

LLM 性能与实际应用:

- 来自 Google 的 Gemini 1.5 Pro/Advanced 模型 以顶尖的排行榜名次令人印象深刻,表现优于 Llama-3-70b 等模型;而来自 MistralAI 的 Codestral 22B 支持 80 多种编程语言,目标受众为 AI 工程师。

- Mistral AI 的新 Codestral 模型 是一款采用非商业许可证的权重开放模型,引发了关于开源可访问性与商业可行性之间平衡的讨论。Codestral 在 80 多种编程语言上进行了训练,其简化编程任务的潜力激发了人们的热情。

-

Scale AI 推出的 SEAL 排行榜 等项目因设定了 AI 评估的新标准而受到关注,尽管也有人对由于供应商关联可能导致的评估者偏见表示担忧。

-

普林斯顿大学的 SWE-agent 因其卓越的性能和开源特性引起了兴趣,而 Llama3-V 作为一个较小的模型,因挑战 GPT4-V 而备受关注。

- 检索增强生成 (RAG) 模型正在不断演进,出现了如 PropertyGraphIndex 这样用于构建丰富知识图谱的工具,同时 Iderkity 支持 高效的翻译任务。

- 微调、提示工程与模型优化:

-

工程师们讨论了 梯度累积 (Gradient Accumulation) 和 DPO 训练 方法,强调了

ref_model在微调期间保持一致性的作用,并探讨了用于不同系统高效使用的 量化库。 -

分享了解决 提示工程 (Prompt Engineering) 挑战的技术,例如使用 try/except 结构处理 “RateLimit” 错误,以及针对特定领域微调模型,并强调了实际解决方案(示例)。

-

成员们辩论了 Transformer 与 MLP 的使用,强调了相关发现,即 MLP 在处理某些任务时可能表现更好,并讨论了在持续微调工作中的模型特定问题,如上下文长度和优化器配置。

- 开源贡献与 AI 社区协作:

-

OpenAccess AI Collective 处理了垃圾信息问题,提议更新 Unsloth 中的梯度检查点 (gradient checkpointing),并见证了社区主导的关于微调 LLM 以进行图像和视频内容理解的倡议。

-

LlamaIndex 通过合并到 Neo4j 生态系统为开源做出了贡献,重点是集成 PropertyGraphIndex 等工具,以提供强大的知识图谱解决方案。

-

讨论强调了围绕 Llama3 模型训练 的社区努力,以及在 GitHub 上为 axolotl 和 torchao 等库提交的协作 issue,这表明了持续的发展和共同的问题解决。

- 模型部署与基础设施问题:

-

工程师们努力解决 Google Colab 断连、部署中的 Docker 配置问题,以及在 NVIDIA A6000 GPU 上使用 Triton 内核的 性能优势。

-

推荐使用 Lighting AI Studio 以获取免费 GPU 时长,同时关于为大型模型生产力分配 GPU 资源 以及应对硬件瓶颈的讨论凸显了用户的挑战。

-

讨论了 ROC 与 NVIDIA 的兼容性障碍,并提出了克服这些障碍的实用建议,例如寻求 7900 XT 的交易以扩展 VRAM 配置,从而支持更大的模型以及从 macOS x86 到 M1 的迁移。

- AI 领域的挑战、反应与创新:

-

Helen Toner 对 OpenAI 管理层的爆料 引发了关于透明度的辩论,引发了对内部政治和伦理 AI 开发的担忧(播客链接)。

-

Elon Musk 的 xAI 获得 60 亿美元融资,引发了关于 AI 竞争力和基础设施投资影响的讨论,同时社区成员辩论了模型定价策略及其对技术长期投资的潜在影响。

-

Cohere API 引发了关于如何有效进行有据生成 (grounded generation) 并确保强制引用显示的讨论,展示了社区在利用新模型处理实际用例方面的积极参与。

第 1 部分:Discord 高层摘要

_

Perplexity AI Discord

-

网页抓取心得:讨论强调了高效提取网页内容的方法,包括 Python requests、Playwright,以及针对重 JavaScript 网站的 Gemini 1.5 Flash。

-

Perplexity API 的困扰与收获:工程师们对 Perplexity API 响应与 Web 应用准确性之间的一致性表示担忧,并考虑选择不同的模型(如 llama-3-sonar-small-32k-online)来潜在地提升性能。

-

构建 Perplexity 的竞争对手:提出了一个模仿 Perplexity 多模型查询 的详细项目,但在扩展和后端开发方面面临挑战。

-

深入 Go 语言:对 Go 编程语言 的深入探讨展示了其有效性,特别是在网页抓取应用中,强调了其可扩展性和并发优势。

-

优势分析:用户分享了 Perplexity AI 搜索链接,内容涵盖潜在的 AI 生成内容、查询合理性的澄清以及全面的优缺点评估。

HuggingFace Discord

-

BERT 的 Token 限制促使用户寻求解决方案:用户正在评估处理超出 BERT (512 tokens) 和 基于解码器的模型 (1,024 tokens) 限制的文档的方法。他们的目标是绕过文档切片和位置嵌入(positional embedding)调整,且不求助于昂贵的新预训练。

-

Diffusers 庆祝 GPT-2 情感分析取得成功:Hugging Face 社区庆祝 Diffusers 项目成立两周年,同时发布了一个用于情感分析的新 FineTuned GPT-2 模型,其准确率和 F1 分数达到了 0.9680。该模型针对 Amazon 评论进行了优化,可在 Hugging Face 上获取。

-

读书会期待 C4AI 的见解:新的论文研读小组已准备就绪,渴望加入来自 C4AI 社区的演讲,重点是揭穿低资源语言中的虚假信息。下一次活动见此处。

-

图像处理咨询引导用户获取资源:讨论涵盖了使用 YOLO 等模型以及 convNext 和 DINOv2 等较新替代方案处理大图像的最佳实践。一个关于 Hugging Face 图像处理教程的 GitHub 仓库被重点提及 (Transformers-Tutorials)。

-

医学影像寻求 AI 辅助:社区成员就创建一个用于分析无标签 MRI 和 CT 扫描的自监督学习框架交换了意见。讨论包括利用预训练模型提取的特征进行特定类别的分割任务。

Unsloth AI (Daniel Han) Discord

-

Lightning AI 与 L4 的火花:用户推荐使用 Lightning AI Studio,因为它提供“每月约 20 小时的免费时长”,且 L4 的性能优于 Colab 的 T4 GPU。提议与 Lightning AI 进行潜在合作以造福社区。

-

Phi3 与 Llama3 的性能难题:讨论显示了对 Phi3 模型的褒贬不一,一些人认为

phi-3-medium不如 llama3-8b。一位用户强调,在超过 2048 tokens 的上下文长度后,Phi3 的表现逊于 Llama3。 -

激烈的模型部署讨论:社区交流了利用 Runpods 和 Docker 部署模型的想法,部分成员遇到了服务商的问题。虽然未提供具体的 Dockerfiles,但建议在服务器中搜索相关内容。

-

Colab 付费版未达预期:Google Colab 的 Premium 服务因持续的断连问题受到批评。成员建议转向 Kaggle 和 Lightning AI 等其他平台作为可行的免费替代方案。

-

Unsloth 本地开发实战:用户开始使用 Unsloth 进行监督微调(SFT),讨论了在本地运行模型,特别是在 VSCode 中执行简历要点生成等任务。分享了使用 Unsloth 进行无监督微调的 Colab 笔记本和 GitHub 资源链接,例如此微调指南和 Colab 示例。

LLM Finetuning (Hamel + Dan) Discord

Fine-Tuning 的挫败感与市场沉思:工程师们讨论了 fine-tuning 的挑战,包括对 Google Gemini 1.5 API 价格上涨的担忧,以及在生产环境中提供 fine-tuned 模型的困难。有人提议设立一个专门针对 LLM 相关工作机会的 channel,并强调了对强大的 JSON/Parquet 文件处理工具的需求。

技术研讨会的内幕:参与者交流了关于 LLM fine-tuning 策略的见解,重点在于个性化销售邮件和法律文档摘要。会议还辩论了 multi-agent LLM 协作的实用性以及针对 Stable Diffusion 的 prompt 优化。

探索 AI 生态系统:社区深入探讨了各种 AI 话题,指出 Braintrust 是评估非确定性系统的便捷工具,并分享了 O’Reilly Radar 关于构建 LLM 复杂性的见解。讨论还强调了 Autoevals 在 SQL 查询评估方面的潜力。

LLM 工作工具箱:工程师们解决了诸如 Modal 的不透明故障和 Axolotl 预处理 GPU 支持等实际问题。分享了关于在 Jarvislabs 上使用共享存储的疑问,以及对 Wing Axolotl 模型量化的见解,讨论中穿插了许多有用的资源和技巧。

代码、工艺与社区:社区氛围活跃,讨论了 LLM evaluator models(评估器模型)、Gradio UI 优于 Streamlit 的吸引力,以及从圣迭戈到纽约的聚会。这些充满活力的交流不仅涵盖了技术领域,还培育了 AI 工程界的社交纽带。

CUDA MODE Discord

GPGPU 编程拥抱 lighting.ai:工程师们讨论了将 lighting.ai 作为 GPGPU 编程的一个值得推荐的选择,特别是对于那些无法使用通常用于 CUDA 和 SYCL 开发的 NVIDIA 硬件的人。

简化 Triton 开发:开发者们发现 triton_util(一个简化 Triton kernel 编写的工具包)在抽象重复性任务方面非常有用,提升了直观体验。观察到在 NVIDIA A6000 GPU 上使用 Triton 带来的性能飞跃,同时在处理超过 65GB 的大型 tensor 时,解决 bug 成为了关注焦点。

Nightly 版 Torch 支持 Python 3.12:PyTorch 社区强调了 torch.compile 在 Python 3.12 上的问题,nightly 构建版本提供了一些解决方案。同时,Torch 2.3 中弃用 macOS x86 构建引发了关于向 M1 芯片或 Linux 迁移的讨论。

Tom Yeh 强化 AI 基础: Prof Tom Yeh 通过分享 AI 概念的手算练习获得了关注。他的系列作品包括 Dot Product(点积)、Matrix Multiplication(矩阵乘法)、Linear Layer(线性层)和 Activation(激活函数)工作簿。

量化领域的飞跃:工程师们正积极讨论并使用 bitsandbytes 和 fbgemm_gpu 等库改进量化过程,并参加 NeurIPS 等竞赛。分享了在 Llama2-7B 上的工作和 FP6-LLM 仓库的更新,同时也对 torchao 社区的互助精神表示赞赏。

CUDA 调试技能提升:分享了一个关于调试 SYCL 代码的询问,强调了对改进 kernel 代码分析工具的需求,并可能深入到调试过程中。

通过 bitnet PR 加速开发:

bitnet channel 解决了各种技术问题,包括与 PyTorch/dev 版本和 CUDA 不匹配相关的 ImportError 挑战,以及通过升级 gcc 12.1 解决了大学服务器上的编译难题。讨论了关于位打包(bit packing)和 CI 改进的协作 PR 工作,并提供了位级操作和错误解决的资源(GitHub 上的 BitBlas,ao GitHub issue)。

柏林与西雅图的社交与科技故事:在 off-topic 频道的对话对比了西雅图和柏林的社交与天气景观。柏林因其 techno 音乐场景和创业友好性而受到推崇,尽管也有其阴郁的天气。

Tokenizer 故事与训练讨论:随后进行了关于自主实现 tokenizer 和数据集处理的广泛对话,考虑了压缩和云存储选项。在 H100 GPU 上进行大规模训练的成本仍然高昂,而关于 GPU 规格的细粒度讨论为模型优化提供了参考。训练实验正在迅速进行,其中一个实验的强度堪比 GPT-3。

Nous Research AI Discord

玩转长上下文 (Big Contexts):一位工程师建议训练一个具有极长上下文窗口 (context window) 的 Large Language Model (LLM),其理念是只要有足够的上下文,即使数据集较小,LLM 也能做出更好的预测。

无偏评估的困境:人们对 Scale 的参与(既提供数据又评估机器学习模型)表示担忧,强调了潜在的利益冲突可能会影响模型评估的公正性。

深入理解 RAG 基础之外的内容:技术讨论阐明了 Retrieval-Augmented Generation (RAG) 系统的复杂性,强调它不仅仅是向量相似度匹配,还涉及一系列其他过程,如重排序 (re-ranking) 和全文搜索,正如 RAGAS 等讨论和资源所强调的那样。

价格翻倍,担忧也翻倍:Google 决定提高 Gemini 1.5 Flash 输出价格的举动引发了激烈辩论,工程师们指责这种定价策略不可持续,并对 API 成本结构的可靠性提出质疑。

梯度累积 (Gradient Accumulation) 审查:讨论中出现了一个关于在模型训练中避免梯度累积的话题,工程师们参考了 Google 的调优手册 (tuning playbook) 以获取见解,同时还根据 Hugging Face 的文档讨论了 DPO 训练中 ref_model 的概念。

LM Studio Discord

-

开源还是闭源?LM Studio 的二分法:LM Studio 的主应用程序被确认为闭源,而 LMS Client (CLI) 和 lmstudio.js (新 SDK) 等工具是开源的。LM Studio 内的模型无法直接访问本地 PC 文件。

-

翻译模型热议:Aya 日译英模型被推荐用于翻译任务,而支持 80 多种编程语言的 Codestral 引发了将其集成到 LM Studio 的讨论。

-

GPU 选择与性能讨论:关于多 GPU 配置与单个强力 GPU 优势的辩论浮出水面,特别是对 Nvidia 股票的价值和改装 GPU (modded GPUs) 实用性的质疑。一位 Goldensun3ds 用户升级到了 44GB VRAM,展示了该配置的优势。

-

服务器模式拖慢进度:用户注意到,在预设相同的情况下,对话模式 (chat mode) 比服务器模式 (server mode) 获得结果的速度更快,这引发了对 GPU 利用率以及服务器模式操作中 GPU 选择必要性的关注。

-

AMD GPU 用户面临 ROCm 障碍:用户注意到了 LM Studio 与 Radeon GPU 的版本兼容问题,包括尝试使用 iGPU 和在 ROCm 模式下进行多 GPU 配置的失败尝试。社区分享了 7900 XT 的优惠信息,作为扩展 VRAM 的可能方案。

-

一个 AI 能身兼两职吗?:一个模型同时执行审核 (moderation) 和问答 (Q&A) 的可行性受到质疑,建议指向使用两个独立的模型,或利用服务器模式以获得更好的上下文处理能力。

-

Codestral 可用性公布:Mistral 新推出的 22B 编程模型 Codestral 已经发布,目标用户是寻求强大编程助手的拥有大显存 GPU 的用户。该模型可在 Hugging Face 下载。

Modular (Mojo 🔥) Discord

Mojo 的内存管理之路:一篇博客文章阐述了 Mojo 以 所有权 (ownership) 为核心的内存管理方法,倡导一种既安全又高性能的编程模型。Chris Lattner 的视频 被推荐为深入研究 Mojo 编译器系统中所有权概念的资源。更多内容请参阅其 博客文章。

对齐的优势:工程师们强调了表中 64 字节对齐 (64-byte alignment) 的重要性,以充分发挥 AVX512 指令的效能并提高缓存效率。他们还强调了对齐对于触发预取器 (prefetcher) 最佳性能的必要性,以及多线程环境中的 伪共享 (false sharing) 问题。

Mojo 中的 Optional 困境与 Dict 难题:在 nightly 分支的对话中,Optional 与 ref API 的结合使用引发了广泛讨论,参与者将 Rust 的 ? 运算符作为建设性的参考。相关的 GitHub issue 也关注了一个关于 InlineArray 无法调用其元素析构函数 (destructors) 的 bug。

提案与编译的详述:关于自动解引用 (auto-dereferenced) 引用中的命名规范进行了严格辩论,有人提议将 Reference 重命名为 TrackedPointer,将 Pointer 重命名为 UntrackedPointer。此外,最新的 nightly Mojo 编译器版本 2024.5.2912 带来了诸如异步函数借用限制 (async function borrow restrictions) 等更新,并提供了详细的 更新日志 (changelog)。

AI 拓展开放世界游戏视野:有人断言,如果 AI 能够根据用户交互,从广泛的在线模型中动态构建世界,开放世界游戏将达到新的巅峰。这一想法暗示了 AI 在推动游戏进步方面的重大机遇。

Eleuther Discord

-

AI 新手的帮手:EleutherAI 的新人(包括一名即将毕业的计算机科学系学生)获得了入门级的研究课题,以及诸如 GitHub gist 之类的资源。由于缺乏基础 AI 问答平台,引发了关于 AI 知识对初学者可及性的讨论。

-

过早发表论文令同行困惑:一篇因在缺乏实验支持的情况下提出大胆主张而引起社区关注的论文引发了讨论。人们对其在 arXiv 上的录用表示质疑,与之相对的是对 Yann LeCun 富有影响力的指导及其专题 讲座 的认可,该讲座强调了工程学与基础科学之间的区别。

-

MLP 与 Transformer —— 趋势的转变:关于最近发现 MLP 在上下文学习 (in-context learning) 方面可以与 Transformer 媲美的争论升温。虽然对 MLP 的潜力很感兴趣,但对其优化和通用性仍普遍存在怀疑,成员们引用了诸如 MLPs Learn In-Context 等资源,讨论也反思了 AI 架构演进中的“苦涩的教训” (Bitter Lesson)。

-

AMD 回溯在内存计算时出错:一位成员在尝试计算 AMD 系统上的最大内存时遇到回溯错误 (traceback error),并通过 GitHub Gist 分享了该问题;而另一位成员则在寻求关于使用 “lm-evaluation-harness” 进行并发查询和基于 logits 测试的建议。

-

扩展讨论转向支持 MLP:对话显示,优化技巧可能会掩盖性能不足,同时突出了一个观察结果:扩展性 (scaling) 和适应性可能掩盖 MLP 的结构缺陷。分享的链接包括一项 比较 CNN、Transformer 和 MLP 网络的实证研究 以及一项关于 扩展 MLP (scaling MLPs) 的调查。

OpenAI Discord

-

免费用户喜迎新功能!:ChatGPT 的免费用户现在可以享受更多功能,包括 browse、vision、data analysis、file uploads 以及访问各种 GPTs。

-

ImaGen3 引发复杂情绪:围绕 Google 即将发布的 ImaGen3 讨论纷纷,主要集中在对媒体操纵和信任度的怀疑。同时,Google 还因历史图像生成中的准确性失误而面临指责。

-

GPT-4 的记忆问题亟待解决:工程师们对 GPT-4 断断续续的“失忆症”表示不满,希望能有更透明的记忆机制,并建议增加一个用于长期记忆保存的 backup button。

-

RAM 占用上升:用户呼吁优化:对内存消耗过高的担忧激增,特别是在 Brave 等浏览器上使用 ChatGPT 时;建议的替代方案包括使用 Safari 或桌面应用以获得更流畅的体验。

-

共享 Prompt 的中心枢纽:对于那些寻找“神奇 Prompt”资源库的用户,请关注 Discord 社区中专门为此设立的频道。

Interconnects (Nathan Lambert) Discord

-

Codestral 进军编程领域:Codestral 是来自 Mistral 的新款 22B 模型,精通 80 多种编程语言,现已发布并在 8 周测试期内可在 HuggingFace 上访问。与此同时,Scale AI 推出的基于私有数据的 LLM leaderboard 引发了关于模型评估潜在偏见的讨论,原因在于该公司的营收模式及其对固定众包人员的依赖。

-

价格上涨给 Gemini 1.5 Flash 的欢呼泼了冷水:Google 的 Gemini 1.5 Flash 输出价格在发布并获得好评后突然上调——从 $0.53/1M 增加到 $1.05/1M——引发了对 API 稳定性和信任度的争论。

-

OpenAI 董事会的尴尬博弈:根据前董事会成员 Helen Toner 的爆料,OpenAI 董事会是在 Twitter 上才得知 ChatGPT 发布的消息。这一事件揭示了 OpenAI 内部更广泛的透明度问题,而 Sam Altman 被解雇时缺乏明确理由(董事会称其为“沟通不始终坦诚”)使这一问题更加复杂。

-

Toner 的爆料与 OpenAI 的不透明性主导讨论:Toner 关于 Sam Altman 领导下频繁出现不诚实行为的指控引发了对其披露时机的辩论,有人猜测存在法律限制,并承认内部政治和压力可能塑造了董事会的叙事。

-

DL 社区的知识盛宴:智力交流活动热度激增,如组建“小型期刊俱乐部”以及对 Cohere 教育视频系列 的赞赏,同时 TalkRL podcast 被认为价值被低估。尽管 Schulman 在 Dwarkesh 的播客节目中对 AI safety 的务实看法评价褒贬不一,但 Andrew Carr 的推文 中强调的旨在减轻 AI 错误行为的变革性分层模型正引起关注。

-

对 FMTI 文件格式问题的沮丧:由于 FMTI GitHub 仓库选择使用 CSV 而非 Markdown,导致工程师难以轻松获取论文评分,社区对此表示不满。

-

SnailBot 即将发布:SnailBot News 更新即将到来,已通过标签进行预热,Nate Lambert 也引起了大家对即将推出的贴纸的好奇。

Stability.ai (Stable Diffusion) Discord

-

Colab 和 Kaggle 加速图像生成:工程师建议使用 Kaggle 或 Colab 来加快 Stable Diffusion 的图像生成速度;有报告称在 Colab 上使用 16GB VRAM 生成每张图像需要 1.5 到 2 分钟。

-

训练 SDXL LoRA 模型的技巧:技术爱好者讨论了训练 Stable Diffusion XL LoRA 模型的心得,强调 2-3 个 epoch 即可获得良好效果,并建议触发词(trigger words)越简洁,训练效果越好。

-

配置 ComfyUI 模型路径与 API 集成:社区成员正在解决 ComfyUI 多个模型目录的配置问题,并讨论如何在本地 Stable Diffusion API 中集成 ADetailer。

-

HUG 与 Stability AI 课程方案:有消息称 HUG 和 Stability AI 合作提供创意 AI 课程,课程环节将被录制以便后续访问——填写完反馈表后将退还参与者的押金。

-

3D 模型生成仍处于孵化阶段:对话转向 AI 在创建适用于打印的 3D 模型 中的作用,成员们一致认为当前 AI 生成此类模型的能力尚未达到预期潜力。

LlamaIndex Discord

-

绘制 LLM 知识图谱蓝图:LlamaIndex 发布了 PropertyGraphIndex,这是与 Neo4j 的合作成果,允许构建更丰富的由 LLM 支持的知识图谱。该工具提供图提取和查询功能,支持自定义提取器以及向量/图联合搜索功能——用户可以参考 PropertyGraphIndex 文档 获取指南。

-

优化知识检索:讨论集中在通过实验文本分块(chunk)大小来优化 RAG 模型,并参考 SemanticDocumentParser 生成高质量分块。此外,还分享了最大化向量存储潜力的策略,例如提到的

QueryFusionRetriever,以及非英语 Embedding 的最佳实践,并引用了 asafaya/bert-base-arabic 等资源。 -

Codestral 时代的创新:LlamaIndex 支持来自 MistralAI 的新模型 Codestral,该模型涵盖 80 多种编程语言,并可通过 Ollama 等工具进行本地运行增强。此外,FinTextQA 数据集 为基于金融文档的查询提供了广泛的问答对。

-

使用 Document Stores 进行存储与定制:社区讨论了在 LlamaIndex 中管理文档节点和存储,涉及

docstore.persist()的功能以及不同文档后端的使用,并参考了 Document Stores - LlamaIndex。交流中还提到了 Simple Fusion Retriever 作为管理向量存储索引的解决方案。 -

跨越边界的查询:新发布的 Property Graph Index 强调了 LlamaIndex 扩展知识图谱查询能力的承诺,集成了处理节点和关系的标签(labels)及属性(properties)的功能。LlamaIndex 博客 阐明了这些进展及其对 AI 工程领域的潜在影响。

Latent Space Discord

-

Gemini 1.5 证明了其实力:根据 LMSysOrg 的 Twitter 分享的结果,Gemini 1.5 Pro/Advanced 目前位居第二,紧随 GPT-4o 之后;Gemini 1.5 Flash 位列第九,超越了 Llama-3-70b 等模型。

-

SWE-agent 引起广泛关注:普林斯顿大学的 SWE-agent 因其声称的卓越性能和开源状态而引发热议,详细信息可见 Gergely Orosz 的 Twitter 和 SWE-agent GitHub。

-

Llama3-V 加入竞争:新的开源模型 Llama3-V 尽管体积较小,但能与 GPT4-V 展开竞争,Sidd Rsh 的 Twitter 详细介绍了这一备受关注的进展。

-

LLM 实战经验谈:文章 “What We Learned from a Year of Building with LLMs” 探讨了一年来使用 LLM 的见解和经验,重点关注构建 AI 产品过程中的演进与挑战。

-

SCALE 通过 SEAL Leaderboards 设定 LLM 基准测试标准:Scale 的 SEAL Leaderboards 已发布,用于进行稳健的 LLM 评估,并获得了 Alexandr Wang 和 Andrej Karpathy 等行业人士的认可。

-

预留 Latent Space 虚拟席位:今天将举行一场探讨 AI Agent 架构与 Kolmogorov Arnold Networks 的技术活动,点击此处注册。

OpenRouter (Alex Atallah) Discord

-

OpenAI 临时宕机已解决:OpenAI 遭遇了短暂的服务中断,但在快速修复后已恢复正常运行。Alex Atallah 指出 Azure 服务在整个事件期间保持运行。

-

告别 Cinematika:由于使用率较低,Cinematika 模型 即将弃用;建议用户尽快切换到替代模型。

-

资金上限困扰已修复:在 OpenAI 模型因意外触发支出限制而无法访问后,官方已实施解决方案并恢复正常服务,同时推出了额外的安全防护措施。

-

GPT-4o 上下文容量确认:针对 Token 限制的误解,Alex Atallah 表示 GPT-4o 保持 128k Token 的上下文限制,以及 4096 的独立输出 Token 上限。

-

对 GPT-4o 图像提示词性能的担忧:用户反映使用

openai/gpt-4o处理image-url输入时速度较慢,这暗示可能存在性能瓶颈,可能需要进一步调查和优化。

LAION Discord

-

AI 影响力人物成为焦点:Helen Toner 关于在 Twitter 上发现 ChatGPT 的言论引发了对话;而 Yann LeCun 在卸任 Facebook VP 后的研究活动也引起了兴趣,标志着 AI 领袖在塑造社区舆论方面的持续影响力。相比之下,Elon Musk 仅在 AI 模型失去竞争优势时才将其公开的做法,引发了关于 AI 开发中开源模型策略的讨论。

-

Mistral 的许可协议利用开放权重:在讨论中,Mistral AI 的许可策略因其在非商业框架下结合开放权重的模式而受到关注,强调了 AI 模型共享与商业化之间的复杂格局。

-

模型生成复杂性:在模型生成中,即使是像“一个女人在看书”这样看似简单的提示词也会出现困难,用户报告在合成 Caption 生成中存在负面影响,暗示了生成式 AI 领域持久的挑战。

-

关于判别器有效性的探讨:社区剖析了研究资料,特别注意到 Dinov2 作为判别器(Discriminator)的使用,但更倾向于使用修改后的预训练 UNet,这让人联想到类似于 Kandinsky 的策略(即减半的 UNet 可提高性能),揭示了 AI 研究中判别器技术的演进。

-

社区对评分激励机制的怀疑:关于 Horde AI 社区对 SD 图像评分的激励系统引发了质疑,有观点认为此类计划可能会降低数据质量,突显了社区参与度与数据完整性之间常见的张力。

LangChain AI Discord

- LangChain v2.0 Agent 查找问题已解决:用户最初在 LangChain v2.0 中查找 Agent 时遇到困难,随后通过讨论成功定位并实现了这些 Agent。

- 关于 AI 与创造力的见解引发讨论:一条推文建议 AI 应超越重复,迈向真正的创造力,这引发了关于 AI 在创意领域潜力的技术讨论。

- 解决 LangChain 中的 ‘RateLimit’ 错误:社区分享了处理 LangChain 应用中 “RateLimit” 错误的解决方案,提倡使用 Python 的 try/except 结构 进行稳健的错误管理。

- 优化对话式数据检索:成员在处理多个 Vector Store 时面临 ConversationalRetrievalChain 的挑战,寻求关于有效合并数据以实现完整内容检索的建议。

- 持久化聊天功能的实际演示:一位频道成员测试了 langserve 的持久化聊天历史功能,参考了仓库中的示例,并询问如何将 “chat_history” 整合到 FastAPI 请求体中,相关文档见 此处。

关于使用 LangChain 在 Agent 流中实现路由逻辑的教学内容已通过 YouTube 教程 发布,帮助社区成员增强其自动化 Agent 的决策路径。

OpenInterpreter Discord

-

训练工作流中定制化为王:工程师们对 个性化训练工作流 表现出兴趣,讨论集中在针对个人用例增强 Open Interpreter,表明 AI 工具对定制化有显著需求。

-

用户分享 Open Interpreter 应用:Open Interpreter 的各种用例引发了讨论,成员们交流了如何利用其功能进行不同技术应用的想法。

-

寻找开源替代方案:工程师之间的对话强调了对 Rewind 替代方案的持续探索,其中 Rem 和 Cohere API 被提及为处理 Vector DB 的值得关注的选择。

-

Rewind 的连接性获得认可:一位用户证实了 Rewind 的效率,称其为“生活黑客技巧”,尽管它在隐藏敏感数据方面存在不足,这反映了技术用户普遍持正面态度。

-

消除 OI 中的确认步骤:为了提高效率,一位成员提供了运行 Open Interpreter 时无需确认步骤的解决方案,即使用

--auto_run功能,详见 官方文档。 -

M5 屏幕问题:一位用户报告其 M5 在刷机后显示白屏,引发了故障排除讨论,包括建议更改 Arduino studio 设置以在刷机期间执行全内存擦除。

-

未说明的 YouTube 链接:一位成员分享了一个孤立的 YouTube 视频 链接,未提供上下文,可能错失了讨论或提供有价值见解的机会。

OpenAccess AI Collective (axolotl) Discord

“NSFW”垃圾信息清理:OpenAccess AI Collective (axolotl) 的管理员迅速响应了关于 NSFW Discord 邀请链接 在各频道被滥发的警报,垃圾信息已得到及时处理。

探索多媒体模型掌握:在 general 频道中有人询问如何微调 LLM(如 LLava 模型)以实现图像和视频理解,但该问题目前尚未得到解答。

为 MoE 提供 Gradient Checkpointing:axolotl-dev 频道的一位成员提议更新 Unsloth 的 Gradient Checkpointing 以支持 MoE 架构,验证后将提交 Pull Request (PR)。

Bin Packing 算法排错:一项开发更新指向了 改进的 Bin Packing 算法,但指出在评估后训练停滞的问题,可能与新 Sampler 缺失 _len_est 实现有关。

Sampler 回退引起关注:通过分享一个 回退 multipack batch sampler 更改的 PR 指出了代码回退,原因是损失计算存在缺陷,这表明在模型训练中精确指标评估的重要性。

Cohere Discord

利用 RAG 重新思考 PDF 微调:一位成员提议将 Retrieval Augmented Generation (RAG) 作为处理 PDF 时替代传统 JSONL 微调的更明智选择,声称它可以完全消除微调步骤。

特定 API 的 Grounded Generation 见解:引用了 API 文档来展示如何在 grounded generation framework 中使用 response.citations 功能,并提供了一个 Hugging Face 链接 作为参考。

本地 R+ 创新与强制引用显示:一位工程师分享了在本地 Command R+ 设置中集成 具有强制引用显示的 RAG 流水线 的实践成果,展示了维持源归属的可靠方法。

Cohere Discord 机器人使用强调了分段讨论:围绕由 Cohere 驱动的 Discord 机器人的热情引发了一个提醒,即应将项目讨论保持在专用频道内,以维持社区讨论的秩序和重点。

频道规范鼓励项目隔离:在对社区构建的 Discord 机器人表示认可后,给出了将详细讨论移至指定项目频道的指导,以确保遵守服务器的组织规范。

tinygrad (George Hotz) Discord

xAI 获得高达 60 亿美元融资:Elon Musk 的 xAI 已成功 筹集了 60 亿美元,知名投资者包括 Andreessen Horowitz 和 Sequoia Capital。这笔资金旨在用于首批产品的市场推广、大规模基础设施建设以及推进未来技术的研发。

对未具名分析工具的质疑:一位成员对某些分析工具表示怀疑,认为它们的“实用性微乎其微”,但并未指明具体是哪些工具。

新语言 Bend 引起关注:Bend 编程语言因其“无需任何代码即可自动多线程”的能力而受到赞誉,这一特性与 tinygrad 的 lazy execution 策略相得益彰,正如 Fireship 视频 中所示。

tinybox 电源供应查询:有人提出了关于 tinybox 电源要求的问题,询问它是使用“两个消费级电源还是两个带有配电板的服务器级电源”,但尚未得到解决。

链接关注:The Verge 关于 xAI 融资的一篇文章特别询问了这笔资金中会有多少比例用于购买 GPU,这是 AI 工程师对计算基础设施的一个关键关注点。

DiscoResearch Discord

-

Goliath 需要“辅助轮”:在进行额外的 pretraining 之前,Goliath 经历了显著的性能下滑,引发了社区成员之间的协作分析和应对。

-

经济高效地复现 GPT-2 里程碑:工程师们讨论了在 GitHub 上仅用 20 美元就以 C 语言实现了 GPT-2 (124M) 的复现,并指出其 HellaSwag 准确率为 29.9,超过了 GPT-2 原始的 29.4 分。

-

Codestral-22B:多语言巨兽:Mistral AI 发布了 Codestral-22B,这是一个在 80 多种编程语言上训练的庞然大物,据 Guillaume Lample 的公告 称,它比前代产品更精通编程。

-

号召贡献者参与开源 GPT-4-Omni:LAION AI 正在号召社区参与 GPT-4-Omni 的开源开发,并发布了一篇博文,重点介绍了数据集和教程,可在此处访问 此处。

Mozilla AI Discord

Windows 下 Llamafile 的困扰:一位工程师在 Windows 上 编译 llamafile 时遇到了问题,指出 cosmoc++ 存在一个问题,即由于可执行文件在没有 .exe 后缀的情况下无法启动而导致构建失败。尽管系统报告文件缺失,但工程师确认该文件存在于目录 .cosmocc/3.3.8/bin 中,并且在使用 cosmo bash 时也遇到了同样的问题。

Datasette - LLM (@SimonW) Discord

- RAG 拯救 LLM 幻觉问题:一位工程师建议使用 Retrieval Augmented Generation (RAG) 来解决 Language Models (LLMs) 在回答文档查询时的幻觉问题。他们提议对

llm命令进行扩展,以递归地为给定 URL 创建 embeddings,利用文档数据集和 embedding 存储来提高准确性。

MLOps @Chipro Discord

技术交流一瞥:一位用户简要提到发现了一篇与其兴趣相关的论文,感谢了另一位用户的分享,并表示打算进行研读。然而,并未提供关于该论文内容、标题或研究领域的具体细节。

LLM Perf Enthusiasts AI Discord 没有新消息。如果该社区沉寂时间过长,请告知我们,我们将将其移除。

AI Stack Devs (Yoko Li) Discord 没有新消息。如果该社区沉寂时间过长,请告知我们,我们将将其移除。

AI21 Labs (Jamba) Discord 没有新消息。如果该社区沉寂时间过长,请告知我们,我们将将其移除。

YAIG (a16z Infra) Discord 没有新消息。如果该社区沉寂时间过长,请告知我们,我们将将其移除。

完整的逐频道分析已针对邮件进行了截断。

如果您喜欢 AInews,请分享给朋友!预先感谢!