ainews-contextual-position-encoding-cope

**上下文位置编码 (CoPE)**

Meta AI 研究员 Jason Weston 介绍了 CoPE,这是一种针对 Transformer 的新型位置编码方法。该方法通过引入“上下文”来创建可学习的门控,从而提升了模型处理计数和复制任务的能力,并在语言建模和代码编写方面表现更佳。此外,该方法未来可能通过外部存储器进行扩展,以辅助门控计算。

Google DeepMind 发布了经过快速推理优化的 Gemini 1.5 Flash 和 Pro 模型。Anthropic 宣布 Claude 的工具使用(tool use)功能正式全面开放,增强了其为复杂任务调度工具的能力。Alexandr Wang 推出了 SEAL 排行榜,用于对前沿模型进行私密的专家评估。

Karpathy 对 GPT-3 发布四周年进行了回顾,强调了模型规模化和实际应用中的改进。Perplexity AI 推出了 Perplexity Pages,旨在将研究内容转化为视觉精美的文章,被 Aravind Srinivas 称为“AI 版维基百科”。

兄弟,再来一个 RoPE 变体,就一个

2024/5/29-2024/5/30 的 AI 新闻。 我们为您检查了 7 个 subreddit、384 个 Twitter 账号 和 29 个 Discord(391 个频道,4383 条消息)。 预计节省阅读时间(按 200wpm 计算):478 分钟。

虽然是平静的一天,但 CoPE 论文引起了一些关注:所以我们来聊聊它。

传统的 LLM 在计数和复制等简单算法任务上存在已知问题。这很可能是其位置编码(positional encoding)策略导致的缺陷。

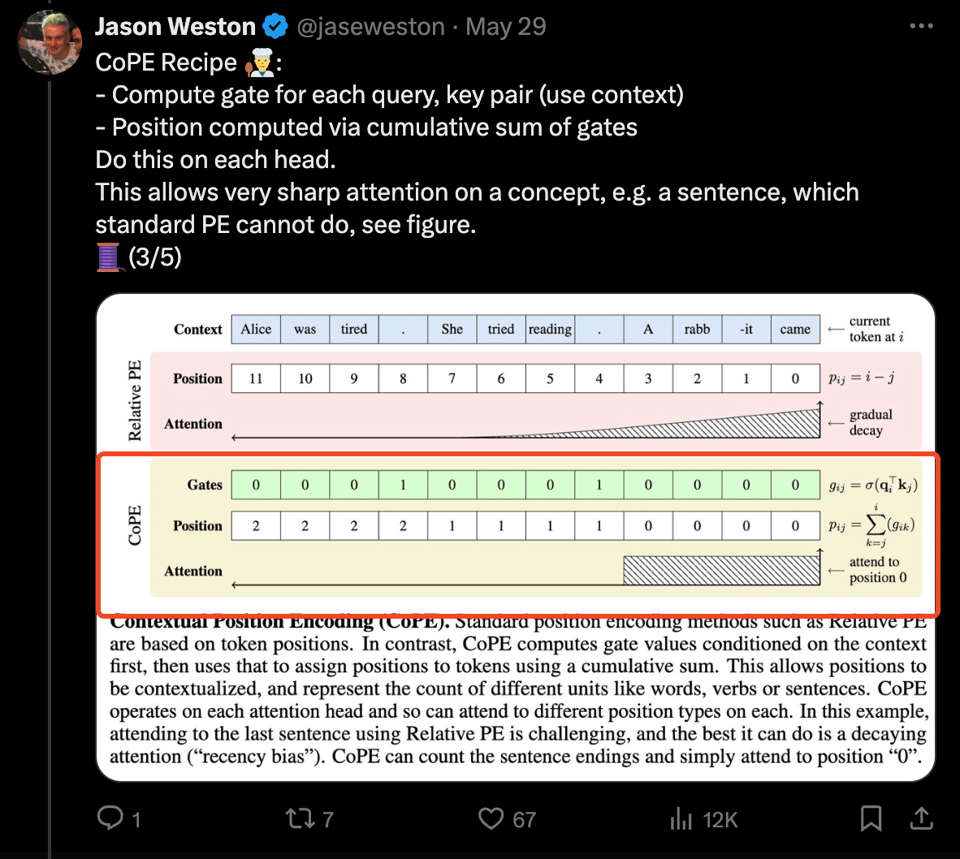

Meta AI 的 Jason Weston 发布了关于 CoPE 的论文,这是一种针对 Transformer 的新型位置编码方法,它考虑了 Context(上下文),并创建了具有可学习索引的“门控(gates)”。

通过使用该方法,CoPE LLM 可以:

- 根据需要按 Head “计数”距离,例如第 i 个句子或段落、单词、动词等。而不仅仅是 Token。

-

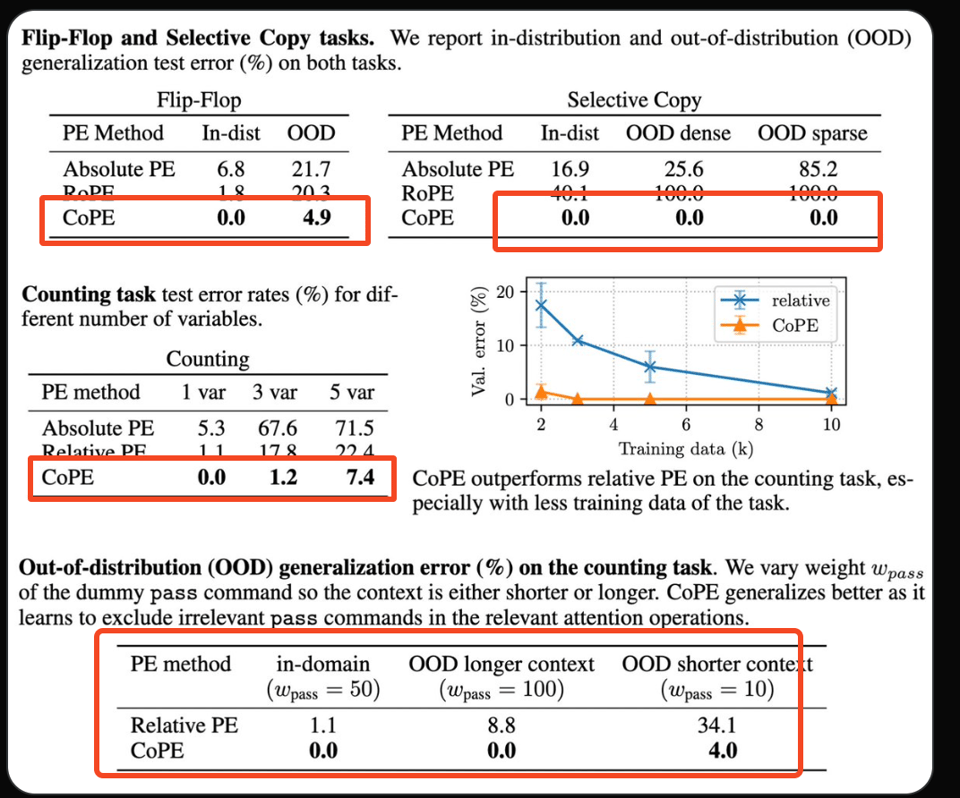

解决标准 Transformer 无法处理的计数和复制任务。

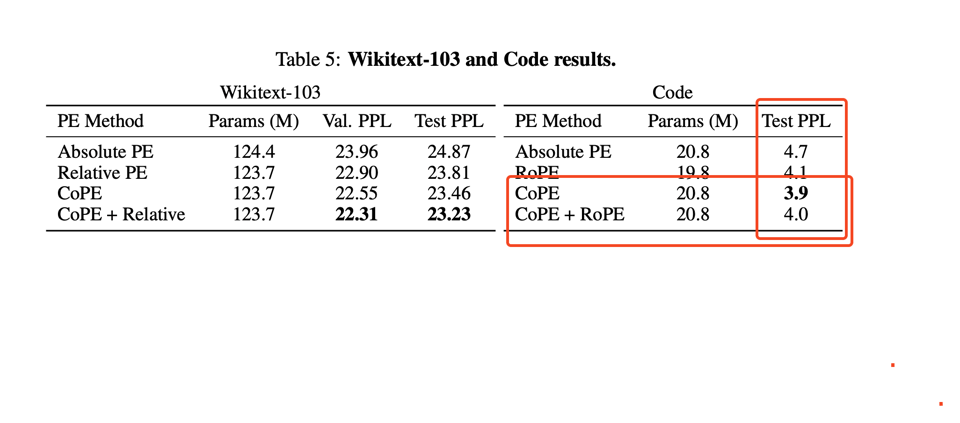

- 在语言建模 + 代码任务上获得更好的 PPL。

你甚至可以修改这个概念,使用 external memory(外部存储)而不仅仅是局部上下文来计算门控。

正如 Lucas Beyer 所指出的,今年涌现的大量位置编码变体或许是更丰富的研究源泉,因为“Linear attention 旨在移除模型容量,这从长期来看没有意义。而位置嵌入(Position embedding)则是为了为模型增加缺失的能力,这显然更有意义。”

AI Twitter 回顾

所有回顾均由 Claude 3 Opus 完成,取 4 次运行中的最佳结果。我们正在使用 Haiku 进行聚类和流程工程(flow engineering)。

新 AI 模型与基准测试

- Contextual Position Encoding (CoPE):@jaseweston 介绍了 CoPE,这是一种针对 Transformer 的新型位置编码方法,它将上下文纳入考虑,使其能够解决计数和复制任务,并提升了在语言建模和编程方面的性能。

- SEAL Leaderboards:@alexandr_wang 推出了 SEAL Leaderboards,用于对前沿模型进行私密的专家评估,这些评估具有不可利用性(unexploitable)且持续更新。

- Gemini 1.5 模型:@GoogleDeepMind 在其 API 上发布了 Gemini 1.5 Flash 和 Pro 模型,其中 Flash 专为快速、高效的推理而设计,支持每分钟 1000 次请求。

- Claude 支持工具使用:@AnthropicAI 宣布 Claude 的工具使用(tool use)功能正式开放(GA),使其能够为复杂任务智能地选择和编排工具。

AI 应用与平台的进展

- ChatGPT 免费版升级:@gdb 指出 ChatGPT Free 档位正在让尖端 AI 功能得到广泛普及。

- Claude Tool Use GA:@AnthropicAI 使 Claude 的工具使用功能正式开放(GA),允许其智能地选择和编排工具,以端到端地解决复杂任务。

- GPT-3 四周年:@karpathy 反思了 GPT-3 发布四周年,以及它如何证明只需通过训练更大的模型就能提升实际任务的表现,这使得更好的算法成为 AGI 进展的加分项而非必要条件。他提到,如果现在给他一台性能强 10 倍的计算机,他会非常清楚该用它做什么。

- Perplexity Pages:@perplexity_ai 推出了 Perplexity Pages,允许用户将研究成果转化为具有格式化图像和章节的精美文章。@AravSrinivas 将 Perplexity 通过 Pages 满足世界好奇心的使命描述为“AI 维基百科”,只需“一键转换”即可完成分析来源和合成可读页面的工作。

- Milvus Lite:@LangChainAI 与 Milvus 合作,通过结合双方的能力来简化强大的 GenAI 应用的创建。

- Property Graph Index:@llama_index 推出了 Property Graph Index,提供了一个高级 API,用于使用 LLM 构建和查询知识图谱。

- LangSmith 中的重复实验:@LangChainAI 在 LangSmith 中增加了对运行多次重复实验的支持,以平滑由于变异性带来的噪声。

AI Reddit 回顾

涵盖 r/LocalLlama, r/machinelearning, r/openai, r/stablediffusion, r/ArtificialInteligence, /r/LLMDevs, /r/Singularity。评论抓取功能现已上线,但仍有很大改进空间!

技术发展与合作伙伴关系

-

OpenAI 合作伙伴关系:OpenAI 宣布与 The Atlantic、Vox Media 和 WAN-IFRA 建立合作伙伴关系,以帮助新闻出版商探索 AI 集成。他们似乎还 与 Apple 达成了一项交易。/r/OpenAI 的讨论集中在 人们如何日常使用 ChatGPT。

-

Google Gemini 模型:Google 将 Gemini 1.5 Flash 的 输出价格翻了一番。考虑到 API 成本,他们更新的 Gemini 1.5 0514 模型在 Chatbot Arena 排行榜上评价良好。

-

Mistral AI 的 Codestral:Mistral AI 推出了 Codestral,一个 22B 参数的开源权重代码模型,采用 Mistral AI Non-Production License 授权。The Verge 报道了 Codestral 的发布。

-

Groq 加速 Llama 3:Groq 宣布 Llama 3 在其系统上以每秒 1200+ tokens 的速度运行。

模型基准测试与评估

-

AutoCoder 超越 GPT-4:AutoCoder,一种新的代码生成模型,在 HumanEval 基准测试的 pass@1 指标上 超越了 GPT-4 Turbo 和 GPT-4o。它还提供了一个功能更全的代码解释器。

-

Scale AI 的 SEAL 排行榜:Scale AI 推出了 带有私有数据集和付费标注者的 SEAL 排行榜,以便对前沿模型进行更公平、更高质量的专家评估。一份 信息图解释了 SEAL 的方法。

-

GPT-4 律师资格考试声明受到质疑:一项 MIT 的研究发现 GPT-4 在律师资格考试中的得分并未达到之前声称的第 90 百分位。

-

TimeGPT-1 在时间序列基准测试中夺冠:在 30,000+ 时间序列基准测试中,TimeGPT-1 与 TimesFM、Chronos、Moirai 和 Lag-Llama 等其他基础时间序列模型相比,在准确性和速度上排名第一。

AI 硬件与性能

- AI 训练算力每年增长 4-5 倍:用于 AI 训练的算力规模每年增长 4-5 倍,凸显了快速的进展。(1)

- Groq 将 LLama 3 性能更新至 1200+ tokens/秒:Groq 在其硬件上将 LLama 3 的性能更新至每秒 1200+ tokens。

- 高通发布 Snapdragon X Plus/Elite 基准测试:高通发布了 Snapdragon X Plus 和 X Elite 的基准测试,显示 Hexagon NPU 具有 45 TOPS 的性能,从而实现高效的端侧 AI。

- Sambanova 在 Llama 3 上创下 1000 tokens/秒的速度记录:Sambanova 系统在 Llama 3 8B 上达到每秒 1000 tokens,创下了新的速度记录。

AI Discord 摘要

摘要之摘要的摘要

1. 新型 AI 模型发布与基准测试:

- 拥有 40B 参数的 Yuan2.0-M32 模型 在 Math/ARC 任务上超越了 Llama 3 70B,且在生成过程中仅使用了 3.7B 个激活参数。

- Codestral 模型发布与集成:Mistral AI 发布了 Codestral-22B-v0.1,这是一款支持 80 多种编程语言的代码生成模型。它在代码指令和 Fill in the Middle (FIM) 任务中表现出色,其博客文章中提供了更多细节。LlamaIndex 为 Codestral 提供了 首日支持和教程 notebook,同时它也与 Ollama 兼容,支持通过 LlamaIndex 直接支持 进行本地运行。

- K2 是一款完全开源的模型,其计算量比 Llama 2 70B 少 35%,但性能却更胜一筹,展示了高效的 AI 工程能力。

2. AI 系统的优化与进展:

- Whisper 模型优化实现 6.3 倍加速:一位社区成员利用 static cache、HQQ quantization、torchao 4-bit kernel 以及 torch.compile with fullgraph 等技术成功优化了 Whisper 模型。这一组合带来了显著的 6.3 倍速度提升。一篇详细的博客文章即将发布,分享此次优化过程的见解。

- 讨论涵盖了通过 templating block sizes(如

blockDim.x)来显著提升 CUDA kernel 性能,特别是在 fused classifiers 中。 - 建议使用 Cloudflare R2 替代 Python 依赖项和内部 S3 来共享大型数据集,从而优化成本并避免杂费。

3. AI 模型微调与定制:

- 成员们探讨了微调 LLM(如 Llava)以处理图像和视频理解任务的理想策略,并辩论了 Direct Preference Optimization (DPO) 相对于 Supervised Fine-Tuning (SFT) 的优势。

- 讨论了 Anti-prompts 技术,这是一种通过在预定义单词处停止生成来引导对话流的技术,允许用户在模型继续输出前进行干预。

- 分享了关于微调 Llama3 base 模型以及在指令模型上使用 DPO 来创建定制角色(如历史人物或虚构角色)的建议。

4. 竞赛与开源倡议:

- 宣布了 NeurIPS 模型融合(Model Merging)竞赛,提供 $8,000 奖金池,旨在彻底改变模型选择和融合技术,以创建最优的 LLM。

- LAION 呼吁社区贡献力量,共同构建具有大规模多模态能力的 open GPT-4-Omni 模型,并提供了数据集、教程和指导。

- 展示了来自近期黑客松的 Le Tigre 项目,这是一个基于 Mistral 7B 的多模态变体,灵感源自 GPT-4-V 的架构。

第 1 部分:Discord 高层摘要

Perplexity AI Discord

Perplexity Pages 开创更精美的帖子:Perplexity AI 推出了 Perplexity Pages,这是一款将研究转化为精选文章的工具,旨在打造 AI 版维基百科。该功能目前面向 Pro 用户开放,预计将向更多用户开放,详情见其 博客文章。

Grok 的不足引发对卓越搜索的追求:社区成员 sneakyf1shy 致力于构建一个优于 Grok 的模型,旨在增强 Perplexity Web 应用中的搜索功能。社区还讨论了现有模型、API 和索引数据的效能,指出了局限性并展望了改进方向。

Pages 反馈:好、坏与丑陋:试用 Perplexity Pages 的用户反馈不一;一些人称赞其实用性,而另一些人则遇到了内容板块缺失等问题。社区的情绪从对 Perplexity 索引能力的怀疑到对该功能的兴奋不等,一份 操作指南 正在感兴趣的人群中传阅。

API 焦虑与 Google vs. OpenAI 的宿怨之战:技术讨论深入探讨了用户友好型 API 的可扩展性挑战以及多步推理的改进。与此同时,Google 与 OpenAI 的竞争备受关注,引发了对其 AI 战略举措的辩论,并伴随着对 AGI 进展和市场影响力的推测。

好奇者探索 AI 伦理与物理:sharing 频道重点展示了成员关于复杂话题在伦理和物理维度的贡献。关于 意识、LLM 功能 以及所谓的 利弊分析 的讨论链接表明,社区正致力于实质性且多样化的 AI 相关主题。

LLM Finetuning (Hamel + Dan) Discord

-

Google Gemini 的失误:Google Vertex AI 定价的不一致引发了混乱,用户担心 Vertex AI 按字符计费与 Google 直接 AI 服务按 token 计费之间的差异,这引发了 讨论帖。

-

LLM 微调技巧:社区分享了微调大语言模型 (LLMs) 的知识和经验,特别关注多智能体 (multi-agent) 系统中的确定性工具调用 (tool calling),以及成功应用来自 robocorp/llmstatemachine 等仓库的状态机逻辑。另一个焦点是使用 GGUF 格式通过自定义数据改进 LLM 的微调,这得到了一个活跃的 Hugging Face Pull Request 的支持,该 PR 提供了从 HF 到 GGUF 更简便的转换方法 (来源)。

-

拥抱 Modal 的多面机制:关于 Modal 任务执行的辩论和故障排除非常激烈,重点讨论了数据集路径和 config 设置等问题。社区通过分享 WANDB 集成见解、共享配置文件以及引导用户查阅 Modal 文档 以进行深入学习来做出回应。

-

通过论文和资源包扩展学习:一系列学习资源涌现,包括 Meta 关于 vLLM 的论文、GitHub 上的 LLM 资源合集,以及 AI 编程 Humble Bundle 的详细信息。此外,一篇关于扩展 Llama3 上下文窗口的论文也引起了关注 (来源)。

-

全球聚会与活动:即将举行的 AI 活动备受关注,例如 6 月 7 日至 9 日在新加坡、悉尼和旧金山举行的 Global AI Hackathon,该活动由顶尖 AI 构建者支持,旨在探索“AI 让世界更美好”——感兴趣的参与者可以通过 此链接 报名。同时,在 Discord 上,来自美国东西海岸和欧洲地区的成员表达了对当地见面会的积极热情并分享了场地信息。

OpenAI Discord

- ChatGPT 用户的福利:ChatGPT 免费用户获得了重大升级,现在可以使用浏览 (browsing)、视觉 (vision)、数据分析 (data analysis)、文件上传和 GPTs,这为实验和开发开辟了新途径。

- OpenAI 赋能非营利组织:OpenAI 推出了 OpenAI for Nonprofits,为慈善组织提供更便捷的工具访问权限,这标志着通过先进的 AI 应用支持社会公益的战略举措。此外还讨论了更多细节,包括应对欺骗性 AI 用途的策略。

- GPT-4 可用性与性能讨论:社区围绕 GPT-4 的可用性和性能展开了热烈讨论,注意到免费用户可能会遇到自动模型切换,并对长文本 GPT-4 输出中出现的“胡言乱语 (word salad)”问题表示担忧。成员们还触及了 GPT 模型的定制化和潜在的内存增强。

- 编程辅助与 API 最佳实践:AI 工程师对比了 GPT-4o、Mistral 的 codestral 和 Copilot 等代码辅助工具,强调了速度和准确性。他们还分享了使用代理后端服务器保护 API keys 的知识,以及在长时间会话中考虑 API 稳定性而非基于浏览器的交互的重要性。

- AI 工具中的偏见与故障排除:工程师们幽默地承认了在评估自己的 AI 工具时存在个人偏见,并交流了故障排除技巧,建议对低于 4 的版本拆分请求以保持兼容性。

HuggingFace Discord

-

PDF 与 AI 的 Everything-AI 集成:Everything-AI 项目现在集成了

llama.cpp和Qdrant,允许与 PDF 进行交互式交流,社区贡献增强了 HuggingFace 的工具和模型库。 -

Yuan 2.0-M32 的竞争优势:新发布的 Yuan2.0-M32 模型拥有 400 亿参数和创新架构,在 Math/ARC 任务中超越了 Llama 3 70B。该消息在 Twitter 上披露,并在 HuggingFace 上展示,同时附带了支持性的研究论文链接。

-

Nvidia Embed V1 让可视化变得触手可及:一位用户分享了他们的 Nvidia Embed V1 Space,用于展示 Nvidia 的嵌入模型,并邀请通过 PR 进行增强,以实现更精细的功能或令人兴奋的新示例。

-

Hugging Face 与 DuckDB 联手实现更流畅的数据集处理:DuckDB 与 Hugging Face 数据集的融合(通过

hf://路径实现)简化了数据集成流程,正如教程博客文章中所详述的那样,这标志着数据处理便利性的一大进步。 -

AI 社区为 NeurIPS 模型合并竞赛做好准备:为 NeurIPS 宣布的一项专注于模型合并 (model merging) 的竞赛引起了 AI 社区的兴趣,承诺提供 8000 美元的奖励,并有机会突破模型选择技术的界限,正如官方推文所述。

-

Whisper 模型通过时间戳进行微调:关于使用 Whisper 模型提取词级时间戳的讨论强调了该方法的文档,并将工作归功于诸如 “Robust Speech Recognition via Large-Scale Weak Supervision” 等研究,表明了音频处理及其应用的增强。

-

开源模型迎来 K2 的潜力:两个全新的完全开源模型(包括 K2)因其出色的表现而受到赞誉,特别是 K2,与 Llama 2 70B 模型相比,它在计算量减少 35% 的情况下表现优异,突显了高效 AI 模型工程取得的进展。

LM Studio Discord

Codestral 加入代码模型之战:Mistral 推出了 Codestral-22B-v0.1,能够处理 80 多种编程语言,在代码指令和 Fill in the Middle (FIM) 等任务中表现出色。对于有兴趣测试该模型的人,可以在此下载并探索 Codestral-22B。

永无止境的上下文长度挑战:工程师们强调了 llama 系列等模型的局限性,其上限为 4096 tokens,并指出 RoPE 扩展允许最大 16k tokens,同时对上下文大小的重要性进行了激烈的讨论。

硬件讨论升温:RTX 5090 因其传闻中的 448-bit 总线和 28 GB GDDR7 显存引发了推测。与此同时,关于 CPU 推理的务实比较以及 GPU 设置(如使用多张 3090 显卡)的优缺点占据了讨论的主导地位。

Whisper 与 Amuse 成为焦点:观察到 Whisper 模型与 llama.cpp 不兼容的技术问题,以及 Amuse 的 GitHub 链接失效。解决方案包括利用 whisper.cpp 以及通过可用的 Hugging Face 链接访问 Amuse。

添加推理 GPU 的实用技巧:一场讨论阐明了在 LM Studio 中添加额外 GPU 进行推理的现实情况,强调了对适当空间、电源和正确设置管理的需求,证明了摆弄硬件既是一门科学也是一门艺术。

Unsloth AI (Daniel Han) Discord

-

Llama3 在 AI 对决中胜过 Phi3:工程师们一致认为 Llama3 在测试中优于 Phi3,评论称赞了它的性能,并批评 Phi3 “极其合成感”。用户建议不要使用 Phi3 模型,强调了基础版 Llama3 的有效性。

-

完善角色扮演 AI:建议从训练 Llama3 基础模型开始,然后进行指令遵循(instruction following)微调,以创建定制的角色扮演角色。然而,仅通过指令提示 Llama3 “假设你是 [X]” 可能比标准的微调过程产生更好的效果。

-

用于受控对话的 Anti-Prompts:讨论了 anti-prompts 的效用,揭示了一种通过在预定义单词处停止生成来引导聊天模型对话流的策略。这种技术使用户能够在模型恢复输出之前进行干预。

-

模型训练与微调的陷阱:讨论指出,通常不鼓励在指令模型之上进行微调,因为可能会导致价值损失。在基础模型上使用 Direct Preference Optimization (DPO) 可以更有效地为特定角色定制输出。

-

新兴模型与技术难题:分享了对 Yuan 等新模型的热情,并提醒实际应用比基准测试结果更重要。一位用户遇到了 Apple M3 Pro GPU 与 CUDA 不兼容的问题,这引发了关于利用 Google Colab 等服务进行模型训练和微调的建议。

Stability.ai (Stable Diffusion) Discord

-

节省 AI 训练成本:成员们强调了经济高效地训练 Stable Diffusion 模型的方法,讨论了 Google Colab 等工具和 RunDiffusion 等服务,因为它们提供了预算友好的解决方案。

-

优化图像准确度:讨论了增强图像生成的技巧,特别关注使用 ControlNet 和高级采样器。对于动态 LoRA 控制,社区分享了 sd-webui-loractl GitHub 仓库。

-

Ruby 加入 AI API 之战:推出了一款用于 Stability AI API 的全新开源 Ruby SDK,旨在简化核心模型和 SD3 模型的图像生成任务。该 SDK 可以在 GitHub 上找到并参与贡献。

-

对 SD3 的期待与焦虑:社区交流了关于 Stable Diffusion 3 可能发布的想法,表达了对许可问题的担忧,并将财务支持与 Midjourney 等竞争对手进行了比较。

-

儿童友好型 AI:发起了一场关于如何安全地向儿童介绍 Stable Diffusion 的讨论,重点是利用 ControlNet 负责任地将儿童的草图转化为精美的图像。

Eleuther Discord

-

AI 与学习的未来:一场关于 GPT-4-OMNI 作为教育助手效用的讨论正在蓬勃展开,社区对其多模态能力感到兴奋,这标志着个性化学习体验将迎来阶梯式的变革。

-

模型更新中的污染警报:Luxia 21.4b 模型在 v1.0 到 v1.2 版本更新期间,数据污染率飙升了 29%,这在 HuggingFace 上的 GSM8k 测试结果中得到了证实,尽管这一问题并未影响其他测试基准。

-

位置编码走向上下文感知:对话中讨论了 Contextual Position Encoding (CoPE),这是一种对传统位置编码的新颖改进。正如 Jason Weston 的推文所强调的,它提升了语言建模和编程任务的表现。

-

重量级对决:MLPs vs. Transformers:社区对 MLP-Mixer 在因果性和序列长度方面的限制进行了批判性讨论,引发了对 MLP 作为静态权重与 Transformer 具备动态上下文相关权重能力的深入探讨。

-

解码模型性能:贡献内容包括分享一篇关于学习率和权重平均的 Arxiv 论文,辩论梯度多样性在 mini-batch SGD 性能中的作用,并宣布了一项奖金高达 8,000 美元的 NeurIPS 竞赛,专注于模型合并(model merging),该消息由 Leshem Choshen 发布在推文上,并托管在竞赛官方页面。

CUDA MODE Discord

-

CUDA 难题解决:工程师们发现了 Triton 代码中的一个 bug,该 bug 会导致 int32 乘法溢出。这揭示了生产规模的数据如何暴露单元测试中不明显的限制,例如 CUDA 中 16 位的网格维度(grid dimension)限制。

-

性能调优揭秘:有建议指出,对

blockDim.x等块大小进行模板化(templating)可以显著提升 CUDA kernel 的性能。讨论还包括提议合并 layernorm recomputations 的分支,以便在重新调整以减少冗余之前,优先优化功能性改进。 -

Whisper 模型获得超级更新:一位成员通过利用 static cache、HQQ quantization、torchao 4-bit kernel 以及带有 fullgraph 的 torch.compile,成功优化了 Whisper 模型,实现了 6.3 倍的加速,并承诺会发布一篇详细的博客文章。

-

低精度乘法器的复杂细节:查询范围从指定 fp4 multiplication 的精确操作到探索激活和梯度中的混合精度层。提到了一个用于 FP6-LLM 的 CUDA kernel,展示了针对 fp16 激活与 MX fp6_e3m2 权重的混合输入乘法,计算通过 tensor cores 执行。

-

利用 Cloudflare R2 和内部 S3 的巧妙规避方案:工程师们讨论了使用 Cloudflare R2 来降低出站流量费用(egress fees)和 Python 依赖项,同时考虑使用预先上传资源的内部 S3 存储来共享大型数据集而不产生额外费用。这与关于 安装错误与兼容性 的讨论相呼应,包括处理需要增强 CUDA 能力的构建以及避免隔离环境问题的技巧。

这些针对性的讨论反映了社区对实现性能提升、优化成本效率以及解决大规模部署机器学习模型时面临的实际问题的关注。

LlamaIndex Discord

-

Codestral 问世并支持多语言:Mistral AI 推出了 Codestral,这是一款支持 80 多种编程语言的新型本地代码生成模型。LlamaIndex 在发布首日即实现了集成,并提供了教程 notebook。它还兼容 Ollama,通过直接 支持 提升了本地执行能力。

-

在本地构建知识图谱:工程师们讨论了结合 Ollama 模型与 Neo4j 数据库在本地构建知识图谱的方法,并提供了一份详尽的 指南 和额外的 操作细节。

-

聚焦金融洞察的 NLP 见面会:伦敦将举办一场由 LlamaIndex、Weaviate_io 和 Weights & Biases 参与的 NLP 见面会,重点讨论在金融服务中使用 LLM,以及向量数据库管理的相关议题,并提供 报名 链接。

-

LlamaParse 扩展格式处理能力:LlamaParse 改进了处理 Excel 和 Numbers 等电子表格的功能,使其更易于在 RAG 管道中使用;可通过提供的 notebook 和 demo 了解更多信息。

-

探索 API 框架和数据存储领域:社区交流了选择 API 框架 的见解,并对具有异步能力的 FastAPI 表示认可。此外还讨论了从 SimpleStore 迁移到 RedisStore 的数据存储转型,包括使用

IngestionPipeline的策略。分享了相关文档和示例链接,包括一个 Google Colab 和多个 LlamaIndex 资源。

LAION Discord

-

Le Tigre 咆哮进入多模态领域:工程师们一直在讨论 “Le Tigre”,这是一个基于 Mistral 7B 模型的多模态项目,受 GPT-4-V 架构启发,已在 Devpost 和 GitHub 上展示。人们对 LAION 5B 数据集充满期待,但其发布时间仍不确定。

-

Sonic 声音非凡:Cartesia AI 推出了 Sonic,这是一款 state-of-the-art 生成式语音模型,因其逼真的音质和惊人的 135ms 延迟而备受赞誉;详情可通过其 博客 和 Twitter 公告查看。

-

模型合并热潮:NeurIPS 模型合并竞赛(Model Merging Competition)引发了热议,该竞赛设有 8,000 美元的奖金池,旨在推进模型合并技术。同时,关于在 Transformer 中使用 FFT 替代 Self-attention 的议题激发了学术好奇心,灵感来自一篇建议该方法能以更低计算需求达到接近 BERT 准确度的 论文。

-

ToonCrafter 助力卡通制作:ToonCrafter 是一个专为草图引导动画设计的项目,引发了工程师们的怀疑与好奇。他们指出该项目有潜力颠覆传统的动漫制作成本,可能将数十万美元的成本大幅降低。

-

GPT-4-Omni 开放征集:LAION 宣布征集开源 GPT-4-Omni 项目的贡献,旨在促进大规模多模态能力的协作开发,详见其 博客文章。

Nous Research AI Discord

-

通过及时提示词教学 AI:讨论强调了通过包含特定上下文的提示词和响应来提升模型性能,重点关注使用 100k 或更小上下文窗口的 in-context learning 策略;这可以简化高效的数据处理,其中像 RWKV 这样具有状态保存功能的模型可能具有节省时间的优势。

-

超越反向传播与模型合并:放弃传统 backpropagation 的新型训练方法引起了关注,暗示了模型效率的潜在复杂性和变革性影响。NeurIPS model merging competition(模型合并竞赛)已经公布,奖金池为 8,000 美元;更多详情可通过特定推文获取。

-

以小博大,超越巨头:最近发布的 Yuan2-M32 模型拥有 40B 参数,但在生成过程中仅有 3.7B 激活参数,在基准测试中以更低的资源消耗与 Llama 3 70B 旗鼓相当,引发了社区对其进行 fine-tune 并利用其能力的呼声。

-

应对专业化 AI 工具时代:目前的趋势是群体更倾向于具有通用能力的 Large Language Models (LLMs),而非利基模型;社区成员兴奋地分享了诸如用于 LLM 应用的 rust library 以及 MoRA(一种用于微调期间高秩更新的工具,可在 GitHub 上获取)等创新成果。

-

开启 RAG 数据集访问权限:一个新的 RAG dataset 已在 Hugging Face 上线,用户需同意分享联系方式即可获取。同时,社区还讨论了衡量相关性的指标,如 MRR 和 NDCG,并基于 Hamel et al 的见解对其进行了评判。

Modular (Mojo 🔥) Discord

-

Swift 拥抱 ABI 稳定性:在关于 ABI 稳定性的讨论中,有人指出 Swift 为 Apple 的操作系统保持了 ABI 稳定性,而 Rust 则刻意避开了它。保持 ABI 稳定性可能会限制某些编程语言性能提升的潜力。

-

对 Mojo 潜力的怀疑:关于 Mojo 成为广泛采用的低级协议的想法遭到了质疑,理由是其缺乏某些关键类型,且难以取代像 C 这样根深蒂固的语言。

-

Mojo 寻求更好的 C++ 互操作性:Modular 社区强调了 C++ interoperability 对 Mojo 成功的重要性,并讨论了未来可能支持从 Mojo 代码生成 C++ 头文件的计划。

-

包管理与 Windows 支持:Mojo 包管理器正在持续开发中,GitHub 讨论和提案线程证明了这一点。然而,社区对 Mojo 仍不支持 Windows 表示了不满。

-

理顺 Nightly 版本:一个重要的 Mojo nightly 构建版本

2024.5.3005已经发布,其中包含重大更改,例如从String中移除了Stringable构造函数和几个math函数。此外,大约 25% 的 Mojo 安装来自 nightly 版本,以确保为新手提供简单的体验。这些更改引起的问题已得到解决,例如修正了String到str的转换,以及 CI PR #2883 中的修复。

OpenRouter (Alex Atallah) Discord

-

MixMyAI:新晋选手:mixmyai.com 的发布引起了社区关注,该平台自称为全能 AI 工具箱,具有无月费和以隐私为中心等吸引人的特性。

-

免费层级的秘密仍未揭开:关于如何获取某项未指明服务的免费层级的讨论引起了兴趣,但获取这种难以捉摸的福利的方法仍然是一个谜,目前尚无明确解决方案。

-

人才招聘:一位拥有全栈、Blockchain 和 AI 技能的高级开发者宣布正在寻找新机会,这表明该社区是潜在招聘和协作的热点。

-

模型行为:受控 vs. 自我审查:关于模型的澄清出现了,区分了自我审查的模型和使用外部审查器的模型;特别指出了 OpenRouter 上类似 Claude 模型的独特设置。

-

编程包发布:OpenRouter 与 Laravel 和 Ruby 的集成包的创建和发布——包括 laravel-openrouter 和 open_router——展示了活跃的社区贡献和跨语言支持。

Cohere Discord

- 通过 API 进行特定领域的网页搜索:一位用户描述了如何使用 API options object 为特定域名设置网页搜索连接器;关于多域名限制的后续讨论正在进行中。

- 用于学术创新的 AI:个人正在开发一个 Retrieval-Augmented Generation (RAG) 模型,以增强其大学的搜索能力,并详细说明了包含 .edu 域名和外部评论网站(如 RateMyProfessors)的意图。

- Embedding 类型转换策略:提出了将 uint8 embeddings 转换为 float 以进行数学运算的问题,该用户被引导至更专业的开发频道以获得深入帮助。

- 初创公司寻求用户留存见解:一家初创公司提供 10 美元奖励,征求对其无代码 AI 工作流构建器的反馈,以分析用户注册后的流失情况,并注明讨论应在更相关的频道继续。

- Cohere 的市场策略:一名 Cohere 员工强调,公司并不追求 Artificial General Intelligence (AGI),而是致力于为生产环境开发可扩展模型 (scalable models)。

LangChain AI Discord

使用 ChatMessageHistory 记录对话:Kapa.ai 展示了使用 LangChain 的 ChatMessageHistory 类来持久化聊天对话,提供了一个跨会话维护上下文的清晰示例,并参考了 LangChain 文档。

应对 LLM 对话复杂性:讨论集中在利用 Large Language Models (LLMs) 设计非线性对话流的困难,提到了提取和 JSON 处理方面的疑虑。链接了一个 GitHub 上的实验性方法来展示这些挑战。

构建分析型 Copilot:工程对话包括将 LangChain 与 PostgreSQL 数据库配对的策略,提供了通过 few-shot learning 处理模糊 SQL 查询结果的见解。

增强交互性的混合 Agent:揭示了 LangChain 中 create_react_agent 和 create_sql_agent 的集成,详细说明了避免常见初始化陷阱的步骤,以及正确命名工具对成功运行的重要性。

进化的 AI 助手与知识图谱:Everything-ai v3.0.0 等新版本的发布包含了集成 llama.cpp 和 Qdrant 支持的向量数据库等进展,而在各频道分享的一段教程视频为学习者提供了使用 Pinecone、LangChain 和 OpenAI 创建 Bot 的实用指南。

Interconnects (Nathan Lambert) Discord

- 价格上涨引发性价比讨论:社区成员讨论了某项未具名服务的剧烈价格变动,对其此前广受赞誉的性价比提出了质疑;人们怀疑之前的赞誉是否是基于涨价后的费率。

- GPT-5 猜测升温:一张来自 X 的未证实表格 讨论了 GPT-5,引发了关于 OpenAI 可能会为了给新模型铺路而将 GPT-4o 免费化的猜测;文中还提到了 AI 专家 Alan D. Thompson 的见解 关于 Alan。

- OpenAI 定价因拼写错误被指责:OpenAI 最初的定价公告中出现了一个拼写错误,引发了混乱,随后在 24 小时内得到了解决和修正;修正后的定价现在反映了公司的真实意图 LoganK 的官方帖子。

- OpenAI 的商业化转型引发不满:OpenAI 的内部紧张局势在讨论中浮出水面,讨论提到了 Microsoft 据称向该公司施压,要求其优先考虑商业化而非研究,导致员工之间出现分歧 《金融时报》文章。

- OpenAI 与 Apple 的合作引起轰动:鉴于 Microsoft 对 OpenAI 的投资,社区反思了 Azure-Apple 合作伙伴关系中的战略影响和潜在冲突;商业动态与数据政策考虑的结合正受到密切关注。

OpenInterpreter Discord

-

OpenInterpreter 文档备受关注:OpenInterpreter 文档 获得了积极关注,其中列出的语言模型中,著名的 LiteLLM 支持 100 多种模型。此外,专门为 RayNeo X2 和 Brilliant Labs 镜框量身定制的 Android/iOS 客户端开发也引起了关注,社区渴望测试通过 GitHub 分享的应用程序。

-

LLaMA 引发热烈讨论:工程师们就本地使用 LLaMA 展开了激烈辩论,特别是对于运行温度较高的 NVLinked 3090 配置。有人提出了替代方案,包括利用 Groq 获取免费模型访问权限,将对话引向更可持续且高效的硬件解决方案。

-

TTS 热情中夹杂担忧:关于使用个人声音定制 TTS 的查询引发了好奇,但目前没有提供直接的解决方案。与此同时,一名成员询问了 2024 年 4 月 30 日下的订单的发货情况,随后被引导至特定的置顶制造更新,这暗示了产品开发人员在沟通上的运营重点。

-

M5 Cardputer 激发期待:关于 M5 cardputer 的更新引起了一些骚动,平衡了用户的兴奋与怀疑,在概述最新制造细节的置顶消息中可以找到相关保证。此外,还流传着一条关于仅出于教育目的使用 Hugging Face 上的 ChatTTS 模型 的警告提醒,强调要遵守学术诚信。

-

对 Codestral 模型的好奇心达到顶峰:对新 Codestral 模型的咨询激发了成员的兴趣,暗示了测试和审查的潜力。社区似乎愿意探索新的模型奇迹,突显了对最新模型开发的积极参与。

Latent Space Discord

-

ChatGPT 免费版功能大幅增强:OpenAI 增强了 ChatGPT Free 层的能力,新增了:浏览、视觉、数据分析和文件上传功能。用户正将“rate limits”(速率限制)视为潜在的制约因素,官方公告详见此处。

-

对话式语音 AI,A16Z 大举押注:成员们在讨论 a16z 对语音 AI 的投资时,怀疑与兴趣交织,并推测 AI 将如何超越投资者的兴奋点,彻底改变电话通话。

-

Cartesia 凭借 Sonic 突破音障:Cartesia 发布了 Sonic,这是他们全新的低延迟生成式语音模型,引发了关于其在实时多模态场景中应用的讨论。欲了解更多见解,请查看他们的博客文章。

-

YC 领导层变动解析:Paul Graham 在 Twitter 上澄清了关于 Sam 离开 Y Combinator 的猜测,并在他的推文中否认了被解雇的传闻。

-

增强检索的 Embedding Adapters:工程界密切关注 TryChroma 关于 embedding adapters 的技术报告,重点在于提高检索性能,这一概念与 Vespa 使用冻结 embeddings 的做法密切相关。

-

播客深度解析百万上下文 LLM:由 @markatgradient 参与的新播客节目讨论了训练百万上下文 LLM 的挑战,引用了历史方法以及 RoPE、ALiBi 和 Ring Attention 等变体。该节目可在此处收听。

Mozilla AI Discord

LLM360 启动社区 AMA:Mozilla AI 的 LLM360 通过关于其新 65B 模型和开源计划的 AMA 开启社区互动,促进与 AI 爱好者的知识共享和问答。

湾区工程师,请关注:一场线下开源 Hack Lab 活动已安排在湾区举行,邀请当地成员协作并分享专业知识。

Embeddings 洞察会议:关于利用 llamafiles 生成 embeddings 的社区会议,为寻求在机器学习项目中应用 embeddings 的工程师提供了实践学习体验。

Mozilla AI 增强开发者支持:在“Amplifying Devs”活动中,由主持人引导的讨论将集中于如何更好地支持 Mozilla AI 内部的开发社区,这是开发者成长和协作的重要平台。

解决 LlamaFile 难题:工程师们报告了在 M2 Studio 上运行 granile-34b-code-instruct.Q5_0.llamafile 并使用 Python 中的 VectorStoreIndex 时遇到的挑战,解决方案涉及正确的 IP 绑定和处理 WSL localhost 的特殊问题。对具有视觉/图像能力的 LlamaFiles 的兴趣正在增长,Mozilla 的 llava-v1.5-7b-llamafile 已在 Hugging Face 上架,可能为创意 AI 应用提供图像支持。

OpenAccess AI Collective (axolotl) Discord

针对多媒体任务微调 LLMs:成员们正在探索微调 large language models (LLMs)(如 Llava)的理想策略,以处理涉及图像和视频理解的任务。关于使用 Direct Preference Optimization (DPO) 相对于 Supervised Fine-Tuning (SFT) 的益处和实用性引发了热烈讨论,特别是关于有效进行 DPO 所需的数据量。

DPO 降低了 VRAM 占用:一位工程师发现 DPO 期间 VRAM usage 意外减少,这引起了人们的兴趣,并引发了对近期可能导致这种效率提升的更新的猜测。

寻找 Protobuf 高手:社区内正在公开征集在 Google’s Protobuf 方面有深厚背景的专家,特别是那些具备逆向工程、恶意软件分析或 Bug 赏金猎人技能的人才。

SDXL 定制广告活动遇到障碍:有人请求在精炼 SDXL 模型方面提供专业指导,目标是优化模型以生成定制的产品广告,但目前使用 LoRA training 或 ControlNet 尚未获得理想效果。

小数据实现大对话:大家对于仅有几百个样本的小型数据集是否足以成功进行 DPO 感到好奇,特别是针对像日常闲聊(chitchat)这样细微的领域。有人建议,手动编译这样一个数据集可能是一种可行的方法。

AI Stack Devs (Yoko Li) Discord

AI 驱动的文学到游戏转型:Rosebud AI 正在举办 Game Jam: “Book to Game”,参与者将使用 Phaser JS 在 AI Game Maker 平台上将书籍转化为游戏,角逐 $500 奖金,提交截止日期为 7 月 1 日。有关此次活动的消息通过 Rosebud AI 的推文分享,感兴趣的开发者可以加入他们的 Discord 社区。

Android 访问困扰:Discord 社区的一位新成员描述 Android 体验“有点难以导航……不稳定且有 Bug”,但确认他们仍能参与内容互动。他们还询问了如何更改用户名,表达了一种感觉自己像个“外星人”的困惑。

tinygrad (George Hotz) Discord

-

GPU 未来推测引发好奇:关于未来 2 到 5 年 GPU 演进的讨论暗示了更大规模 64x64 matrix multiplication arrays (MMA) 的使用,并开玩笑地建议“做一个更大的脉动阵列(systolic array) 😌”。

-

Tinygrad 在整数梯度方面胜过 Torch:Tinygrad 因其计算整数梯度的能力而受到关注,而这项任务在 Torch 中会导致

RuntimeError。Tinygrad 的处理方式是在反向传播(backpropagation)期间将整数视为 float,然后再转回整数。 -

辩论 AI 框架的主导地位:一位成员断言 Tinygrad 优于 TensorFlow 和 PyTorch,引发了关于尽管个人偏好 Tinygrad,但为什么 AI 社区可能更倾向于 TensorFlow 而非 PyTorch 的讨论。

Datasette - LLM (@SimonW) Discord

- 提议特定语言的 Codestral:一位成员发起了一项讨论,关于通过将 Codestral 拆分为单个编程语言来减小其体积的可能性,并假设并非所有语言对整体模型的贡献都是平等的。

- 对语言权重的关注:人们对 45GB Codestral 模型中的权重分布感到好奇,推测大部分权重被分配给了英语,但每种编程语言可能仍会对模型的整体能力产生重大影响。

MLOps @Chipro Discord

遗憾的是,由于只提供了一条消息,且该消息缺乏与 AI 工程师相关的足够技术内容或细节,无法按照给定指南创建摘要。如果提供了具有适当细节的更多消息,可以生成摘要。

DiscoResearch Discord

- 加入 Open GPT-4-Omni 倡议:LAION 呼吁社区贡献力量以开发开源版本的 GPT-4-Omni,并提供数据集、教程和指导性博客文章。他们还通过一篇 Twitter 帖子发布了这一消息,鼓励更广泛的参与。

LLM Perf Enthusiasts AI Discord 没有新消息。如果该服务器沉寂时间过长,请告知我们,我们将将其移除。

AI21 Labs (Jamba) Discord 没有新消息。如果该服务器沉寂时间过长,请告知我们,我们将将其移除。

YAIG (a16z Infra) Discord 没有新消息。如果该服务器沉寂时间过长,请告知我们,我们将将其移除。

完整的频道分类明细已针对电子邮件进行了截断。

如果您喜欢 AInews,请分享给朋友!预谢!