ainews-ways-to-use-anthropics-tool-use-ga

以下是“Ways to use Anthropic's Tool Use GA”的中文翻译: **Anthropic 工具使用功能(GA/正式版)的使用方式** (注:“GA”意为 General Availability,指功能已正式全面开放。)

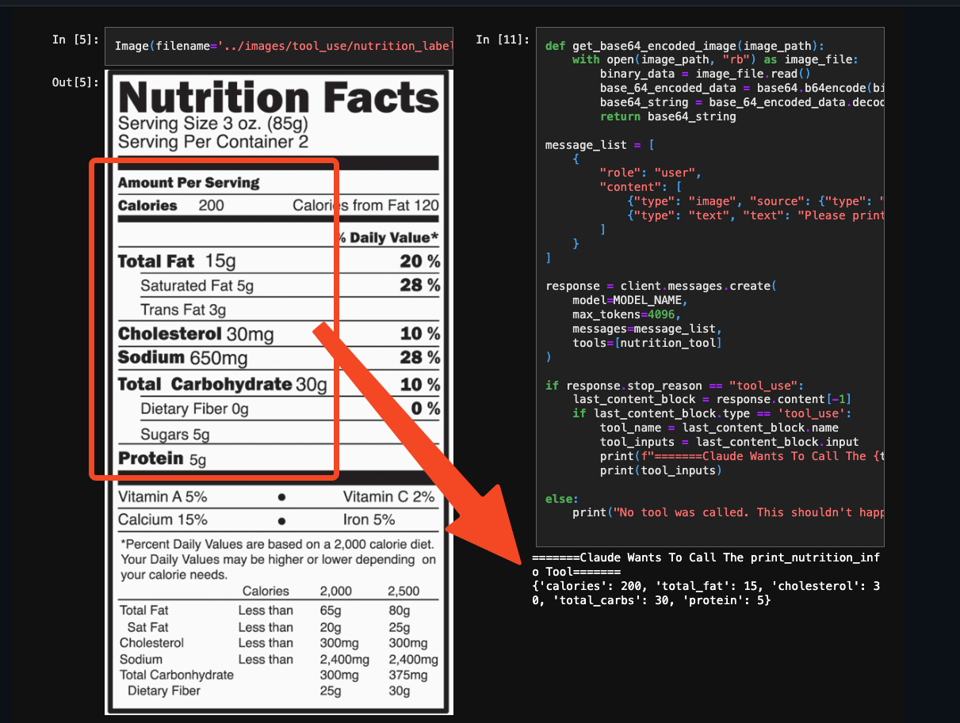

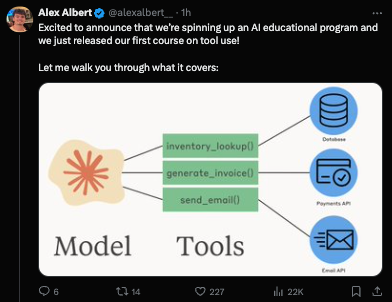

Anthropic 联合 亚马逊(Amazon) 和 谷歌(Google) 正式全面开放了工具使用(tool use)/ 函数调用(function calling)功能,并支持流式传输、强制使用和视觉能力。Alex Albert 分享了智能体工具使用的五种架构:委派(delegation)、并行化(parallelization)、辩论(debate)、专业化(specialization)和工具套件专家(tool suite experts)。此外,Anthropic 还推出了一门关于工具使用的自学课程。

Yann LeCun 强调了伦理开放科学资助、带有安全护栏的超智能的逐渐显现,以及用于图像/视频处理的卷积网络在竞争力上可与视觉 Transformer(Vision Transformers)相媲美。他还指出,工业界、学术界和政府部门的 AI 研究人员数量均有所增长。

工具是 AI 所需的一切。

2024年5月30日至5月31日的 AI 新闻。 我们为您检查了 7 个 subreddit、384 个 Twitter 账号 和 29 个 Discord 服务区(393 个频道和 2911 条消息)。 预计节省阅读时间(以 200wpm 计算):337 分钟。

伴随着 Anthropic 今天在 Anthropic/Amazon/Google 上正式发布(GA)工具使用/函数调用(tool use/function calling),并支持流式传输、强制使用和视觉…

Alex Albert 分享了在 Agent 上下文中使用它们的 5 种架构:

- Delegation(委派):使用更便宜、更快的模型来获得成本和速度优势。

- 例如,Opus 可以委派 Haiku 阅读一本书并返回相关段落。如果任务描述和结果比完整上下文更紧凑,这种方式效果很好。

- Parallelization(并行化):通过并行运行 Agent 来降低延迟(但不会降低成本)。

- 例如,100 个子 Agent 分别阅读一本书的不同章节,然后返回关键段落。

- Debate(辩论):具有不同角色的多个 Agent 进行讨论以达成更好的决策。

- 例如,软件工程师提议代码,安全工程师进行审查,产品经理提供用户视角,最后由一个最终 Agent 进行综合并做出决定。

- Specialization(专业化):一个通用型 Agent 进行编排,而专家型 Agent 执行任务。

- 例如,主 Agent 在处理健康查询时使用专门提示(或微调)的医疗模型,在处理法律问题时使用法律模型。

- Tool Suite Experts(工具套件专家):当使用成百上千个工具时,让 Agent 专注于工具子集。

- 每个专家(相同的模型,但配备不同的工具)处理特定的工具集。编排器随后将任务映射到正确的专家(这能保持编排器的 Prompt 简洁)。

这里没有什么特别突破性的内容,但对于思考模式来说是一个非常方便的清单。Anthropic 还推出了一个关于工具使用的自学课程:

AI Twitter 回顾

所有摘要均由 Claude 3 Opus 完成,从 4 次运行中择优。我们正在尝试使用 Haiku 进行聚类和流程工程(flow engineering)。

AI 研究与开发

- 开放科学与研究资助:@ylecun 为研究表达了一个明确的伦理准则:“不要从限制你发表能力的实体那里获取研究资金。”他强调,向世界提供新知识本质上是件好事,无论资金来源如何。@ylecun 指出,这一伦理准则使他成为了开放科学和开源的坚定倡导者。

- 超级智能的出现:@ylecun 认为超级智能的出现将是一个渐进的过程,而不是突然发生的事件。他设想从老鼠或松鼠智力水平的架构开始,逐步提升其智力,同时设计适当的护栏和安全机制。目标是设计出一种能够完成人类指定目标的、目标驱动型 AI(objective-driven AI)。

- 用于图像和视频处理的卷积网络:@ylecun 建议在低层使用带步长或池化的卷积,在高层使用自注意力电路来进行实时图像和视频处理。他认为 @sainingxie 在 ConvNext 上的工作已经表明,如果做得正确,卷积网络可以和 Vision Transformer 一样出色。@ylecun 认为自注意力对排列具有等变性,这对于低层图像/视频处理来说是没有意义的,而且由于图像和视频中的相关性是高度局部的,全局注意力是不可扩展的。

- 工业界 vs 学术界的 AI 研究人员:@ylecun 指出,如果图表显示的是绝对数量而不是百分比,就会发现工业界、学术界和政府部门的 AI 研究人员数量都在增长,只是工业界的增长比其他部门更早、更快。

AI 工具与应用

- Suno AI:@suno_ai_ 宣布发布 Suno v3.5,允许用户在单次生成中制作 4 分钟的歌曲,创建 2 分钟的歌曲扩展,并体验改进的歌曲结构和人声流。他们还将在 2024 年向顶尖 Suno 创作者支付 100 万美元。@karpathy 表达了他对 Suno 的喜爱,并分享了他使用该工具创作的一些最喜欢的歌曲。

- Anthropic 的 Claude:@AnthropicAI 宣布 Claude 的 Tool Use(工具使用)现已在 API、Amazon Bedrock 和 Google Vertex AI 中全面开放。通过 Tool Use,Claude 可以智能地选择和编排工具,端到端地解决复杂任务。早期客户正利用 Claude 的 Tool Use 构建定制化体验,例如 @StudyFetch 使用 Claude 驱动个性化 AI 导师 Spark.E。@HebbiaAI 使用 Claude 为其 AI 知识工作者驱动复杂的多步骤客户工作流。

- Perplexity AI:@AravSrinivas 推出了被描述为“AI 维基百科”的 Perplexity Pages,允许用户通过简单的“一键转换”分析来源并合成可读页面。Pages 已对所有 Pro 用户开放,并正向所有人广泛推广。用户可以将页面创建为独立实体,或将他们的 Perplexity 聊天会话转换为页面格式。@perplexity_ai 指出,Pages 让用户能够通过格式化的图像和章节分享关于任何主题的深入知识。

- DeepMind 的 Gemini:@GoogleDeepMind 宣布开发者现在可以开始使用其 API 按需付费服务构建 Gemini 1.5 Flash 和 Pro 模型。Flash 旨在提供快速且高效的服务,其速率限制提高到每分钟 1000 次请求。

梗与幽默

- @huybery 推出了 im-a-good-qwen2,一个在评论中互动的聊天机器人。

- @karpathy 分享了他对 1 对 1 会议的看法,表示他在 Tesla 有大约 30 名直接下属,但不进行 1 对 1 会议,他认为这非常棒。他发现 4-8 人的会议和用于广播的大型会议更有用。

- @ReamBraden 分享了一个关于初创公司创始人挑战的梗图。

- @cto_junior 分享了一个关于腾讯 AI 开发者致力于取代低薪动漫艺术家的梗图。

- @nearcyan 对那些认为我们不应该与动物交谈、建造房屋或发电厂,而应该“在洞穴里腐烂,像上帝旨意那样为残羹剩饭而战”的人发表了幽默的评论。

AI Reddit 回顾

涵盖 r/LocalLlama, r/machinelearning, r/openai, r/stablediffusion, r/ArtificialInteligence, /r/LLMDevs, /r/Singularity。评论抓取功能现已上线,但仍有很大改进空间!

AI 图像与视频生成

- 写实头像:在 r/singularity 中,展示了来自德国慕尼黑大学 Neural Parametric Gaussian Avatars (NPGA) 研究的令人印象深刻的写实头像(示例 1,示例 2)。这些高质量的头像展示了 AI 生成的人类表现形式的快速进步。

- 卡通生成与插值:推出了用于生成和插值卡通风格图像的 ToonCrafter 模型,并有实验展示了其功能。这突显了 AI 生成内容在写实图像之外的不断扩展。

- AI 驱动的游戏开发:展示了一个开源游戏引擎,它利用 Stable Diffusion、AnimateDiff 和 ControlNet 等 AI 模型来生成游戏资产和动画。该引擎的源代码和渲染动画精灵的技术已完全公开。

- AI 动画 API:Animate Anyone API(代码可在 GitHub 获取)能够为图像中的人物制作动画。然而,评论建议像 MusePose 这样的替代方案可能会提供更好的效果。

AI 伦理与社会影响

- AI 合作伙伴关系与竞争:Microsoft CEO Satya Nadella 对 OpenAI 与 Apple 之间潜在的交易表示担忧,强调了 AI 合作伙伴关系的战略重要性以及竞争格局。

- Deepfake 担忧:Deepfake 技术被滥用的可能性日益增加受到强调,凸显了对安全保障和负责任 AI 实践的需求。

- 电影行业中的 AI:Sony 计划利用 AI 降低电影制作成本,这引发了关于对创意产业影响以及潜在失业问题的讨论。

- AI 生成内容与真实性:一张名为 “All Eyes On Rafah” 的 AI 生成图像因缺乏真实感并可能误导敏感局势而面临批评,凸显了 AI 生成内容面临的挑战。

- AI 与影响力行动:OpenAI 报告称俄罗斯和中国利用其 AI 工具进行秘密影响力行动,强调了采取主动措施防止 AI 滥用的必要性,正如其打击欺骗性 AI 使用的努力中所详述的那样。

AI 能力与进展

- 生物处理器与脑类器官:一项突破性的利用人脑类器官的生物处理器被开发出来,与数字芯片相比,它提供了极高效率的计算。

- 医疗保健中的 AI:根据发表在《柳叶刀》(The Lancet)上的一项里程碑式研究,新的 AI 技术被证明可以提前 10 年预测与冠状动脉炎症相关的心脏事件。

- 量子计算突破:由一名留美归国物理学家领导的中国研究团队声称建造了世界上最强大的离子型量子计算机。

OpenAI 新闻与动态

- 领导层澄清:Paul Graham 澄清 Y Combinator 并没有解雇 Sam Altman,这与流传的谣言相反。

- 机器人研究重启:OpenAI 正在重启其机器人团队,标志着其重新关注 AI 与机器人的交叉领域。

- 回应担忧:OpenAI 董事会成员回应了前成员提出的警告,涉及公司的发展方向和实践。

- 面向非营利组织的 AI:OpenAI 发起了一项倡议,使其工具更易于被非营利组织使用,从而推广有益的 AI 应用。

- 与 Reddit 的合作伙伴关系:OpenAI 与 Reddit 宣布建立合作伙伴关系,引发了关于对这两个平台潜在影响的讨论。

AI 幽默与迷因

- 机器人的过去与现在:有人分享了一个幽默的对比,将电影《我,机器人》(I, Robot)过去对机器人的描绘与现状进行了比较。

AI Discord 摘要

摘要之摘要的摘要

1. 模型性能优化与基准测试

-

K2 超越 Llama 2:来自 LLM360 的 K2 模型在性能上超越了 Llama 2 70B,同时减少了 35% 的计算量,并基于 Apache 2.0 协议完全开源。

-

NeurIPS 举办模型融合竞赛:一项奖金为 8,000 美元的竞赛邀请参赛者融合最优 AI 模型,详情请见 NeurIPS Model Merging 网站。

-

定制化 Positional Embeddings 提升 Transformer 算术能力:研究人员通过使用特定的 Embeddings,在 100 位数字加法上实现了 99% 的准确率,详见其论文。

2. 微调与 Prompt Engineering

-

解决数据集合并与训练技巧:Axolotl 用户讨论了在微调过程中有效合并数据集以避免灾难性遗忘(catastrophic forgetting)等问题。推荐工具包括 Hugging Face Accelerate。

-

法律草案系统与聊天机器人的微调技术:为 法律草案 和 财务文档摘要 等应用微调 LLM 的用户交流了策略,参考资源包括 Fine-Tune PaliGemma。

-

解决文本分类模型的训练问题:针对西班牙语实体分类模型训练中的问题,提出了微调建议,并探索了 RoBERTa 等框架。

3. 开源 AI 发展与协作

-

用于高效向量存储的 Milvus Lite:介绍了 Milvus Lite,这是一个针对 Python 的轻量级向量存储解决方案,详见 Milvus 文档。

-

MixMyAI 在单一平台上集成多个 AI 模型:mixmyai.com 平台整合了开源和闭源模型,强调隐私保护,且不在服务器存储聊天数据。

-

LlamaIndex 提供灵活的检索系统:新的基于 Django 的 Web 应用模板促进了 RAG (Retrieval Augmented Generation) 应用的开发,利用了数据管理和用户访问控制,详见此处。

4. AI 社区创新与知识共享

-

使用 Axolotl 保持一致的 Prompt 格式:对 Axolotl 进行了调整以确保 Prompt 格式的一致性,引导用户参考 Axolotl prompters.py 等设置。

-

Ghost XB Beta 中的语言支持挑战:Unsloth AI 讨论了 Ghost XB Beta 等模型的多语言支持,目标是在训练阶段支持 9 种以上语言,并重点介绍了 Ghost XB 详情。

-

集成 OpenAI 和 LangChain 工具:讨论了利用 LangChain Intro 等资源以及 GPT-4 Alpha 宣布的实时功能来创建高级 AI 应用。

5. 硬件进展与兼容性挑战

-

NVIDIA 新型 4nm 研究芯片表现惊人:实现了 96 int4 TOPs/Watt 的效率,显著超越了 Blackwell 的能力,相关影响的讨论分享在此处。

-

AMD GPU 上的 ROCm 支持挑战:用户对 ROCm 缺乏对 RX 6700 和 RX580 等 GPU 的支持感到沮丧,引发了对潜在替代方案和性能影响的讨论。

-

在 CUDA 中实现高效的数据处理:讨论了优化 CUDA 操作,使用融合逐元素操作(fusing element-wise operations)等技术来获得更好的性能,源代码见此处。

第一部分:高层级 Discord 摘要

LLM Finetuning (Hamel + Dan) Discord

-

Transformer 训练与故障排除:社区请求开展关于 Transformer architecture 的互动环节,以更好地理解 RoPE 和 RMS Normalization 等复杂主题。与此同时,Google Gemini Flash 将于 6 月 17 日开放免费微调,而在使用 RAG LLMs 进行生产时,必须仔细计算成本,优先考虑 GPU 时间和第三方服务。社区提倡使用 GGUF format 以保持与生态系统工具的兼容性,从而简化微调过程。(针对图像转 JSON 场景微调 PaliGemma)

-

挑战 BM25 与检索难题:社区发起了一项寻找可靠 BM25 implementation 的行动,Python 包

rank_bm25因其功能有限而成为关注焦点。对话集中在增强向量检索上;同时,Modal 用户在部署 v1 finetuned models 后可参考 documentation 进行后续操作,Modal credits initiative 澄清了额度过期的疑虑。 -

数据主导对话:从文档 AI 中解析结构化信息需要 OCR 和 LiLT 模型等技术。与此同时,社区考虑使用 OpenPipe 和 GPT-4 处理 5000 个抓取的 LinkedIn 个人资料,多模态(multi-modal)方法和 document understanding 仍是热门话题。一个排错技巧是:强调训练数据文件格式必须精确匹配,以防止出现

KeyError: 'Input'。 -

学习 LLM 基础与 LangChain 联动:来自 Humble Bundle 和 Sebastian Raschka 的资源提供了关于 prompt engineering 和 LLM finetuning 的见解,尽管有人对某些材料的质量提出质疑。反映出社区对知识的渴求,O’Reilly 发布了其 LLM 构建系列丛书的 Part II,重点关注 LLM 应用中的运营挑战。

-

策划对话上下文:剖析了 instruct-LLM 和 chat-LLM 模型之间的区别,前者遵循明确指令,后者精通对话上下文。讨论的项目范围广泛,从类似 Alexa 的音乐播放器到法律草案系统,以及用于财务文档摘要的聊天机器人,展示了经过微调的 LLM 的各种可能实现。

-

Modal 动态与市场触达:博客等媒介在传播知识方面发挥了至关重要作用,John Whitaker 的博客 成为学习 Basement Hydroponics 和 LLM 性能的首选之地。从业者分享了梯度优化技巧,如 gradient checkpointing,并一致认为有时最简单的解释(如 Johno 课程中的解释)效果最好。

-

Spaces 的空间:讨论了如何在 Axolotl 中更改 alpaca format 的提示词样式以及 Qwen tokenizer 的使用问题,并引用了特定的 GitHub configs。同时,由于易用性,部署基于 Gradio 的 RAG app 引发了对使用 HF Spaces 的兴趣。

-

额度热潮与社区连接:紧急公告强调了填写额度申请表的紧迫性,引发了片刻的恐慌与澄清。社交聚会和讨论范围从旧金山的 eval 见面会到 Modal Labs 在纽约举办的答疑时间(office hours),表明了活跃的社区联系和知识共享活动。

-

欧洲参与及 Predibase 前景:来自欧洲各地(如德国纽伦堡和意大利米兰)的签到显示了该群体的地理跨度。此外,提到 30-day free trial of Predibase 提供 25 美元的额度,反映了为提供便捷的微调和部署平台所做的持续努力。

-

职业十字路口:从学术界到工业界,成员们分享了经验并鼓励彼此进行职业转型。讨论展示了外包合同(contracting)是一种可行的路径,导师指导和毅力被认为是应对技术环境的关键,而 GitHub 作品集可以作为重要的敲门砖。

这些摘要概括了 Discord 公会中 AI 工程师们详尽且往往非常细致的讨论,突显了他们在追求职业成长和社区建设的同时,为优化 LLM 微调和部署所做的集体努力。

HuggingFace Discord

K2 战胜 Llama 2:LLM360 的 K2 模型 超越了 Llama 2 70B,以减少 35% 的计算量实现了更好的性能;该模型被宣传为完全可复现,并根据 Apache 2.0 许可证开放。

数字难不倒 Positional Embeddings:研究人员攻克了 Transformer 的算术能力难题;通过定制的 Positional Embeddings,Transformer 在 100 位数的加法运算中达到了 99% 的准确率,这一里程碑式的成就详见他们的 论文。

NeurIPS 发起模型合并挑战:NeurIPS 模型合并竞赛 (Model Merging Competition) 设立了 8,000 美元的奖金,邀请参赛者融合出最优的 AI 模型。Hugging Face 等机构赞助了此次竞赛,更多信息请见 公告 和 竞赛网站。

数据探索:从 15 万个数据集到服装销售:工程师们现在可以通过 DuckDB 探索超过 15 万个数据集的宝库,这在一篇 博客文章 中有详细说明;同时,一个新的服装销售数据集推动了图像回归模型的发展,详情见 这篇文章。

学习资源与课程助力技能提升:在不断进步的 AI 领域,工程师可以通过 Hugging Face 的 Reinforcement Learning(强化学习)和 Computer Vision(计算机视觉)课程来增强专业知识,更多信息可在 Hugging Face - Learn 获取。

Unsloth AI (Daniel Han) Discord

量化困境与高效硬件:Unsloth AI 协会成员强调了量化版 Phi3 微调 结果面临的挑战,指出在没有量化技巧的情况下存在性能问题。NVIDIA 新推出的 4nm 研究芯片 因其每瓦 96 int4 tera operations per second (TOPs/Watt) 的效率引发热议,超越了 Blackwell 的 20T/W,反映了行业在功耗效率、数值表示、Tensor Cores 效率和稀疏化技术方面的全面进步。

模型微调与 Upscaling 讨论:AI 工程师分享了关于微调策略的见解,包括 数据集合并,其中一位成员展示了一个使用 Upscaling 技术构建的 Llama-3 11.5B Upscale 模型。一种新兴的微调方法 MoRA 为参数高效更新提供了一条充满前景的途径。

故障排除工具与技术:工程师们面临各种障碍,从 Unsloth 中的 GPU 选择(os.environ["CUDA_VISIBLE_DEVICES"]="0")和微调错误排查,到处理双模型依赖关系以及解决训练期间的 VRAM 峰值问题。针对 Kaggle 安装挑战等问题的变通方案强调了细致解决问题的必要性。

多语言 AI:Ghost XB Beta 因其能够流利支持 9 种以上语言而受到关注,目前正处于训练阶段。这一进展再次确认了协会致力于为社区开发易于获取、具有成本效益的 AI 工具的承诺,特别是对初创企业的支持。

社区协作与增强:协会讨论显示了对自我部署和社区支持的集体推动,成员们分享了更新并在 Open Empathic 项目和 Unsloth AI 模型改进等一系列 AI 相关工作中寻求帮助。

Perplexity AI Discord

-

Tako 小组件的地理范围限制?:关于 Tako 金融数据小组件 的讨论引发了对其地理限制的疑问,一些用户不确定它是否为美国专属。

-

Perplexity Pro 试用结束:用户讨论了 Perplexity Pro 试用 的停止,包括年度 7 天试用选项,引发了关于潜在推荐策略和自费试用的对话。

-

Perplexity 页面部分编辑的特性:在编辑 Perplexity Pages 章节时出现了一些困惑,用户可以修改章节详情但不能修改文本本身——这一限制已得到多位成员的确认。

-

搜索性能的权衡:观察到 Perplexity Pro 搜索速度变慢,这归因于一种将查询顺序分解的新策略,尽管速度降低,但能提供更详细的回答。

-

探索 Perplexity 新功能:用户分享了新推出的 Perplexity Pages 链接以及关于 Codestral de Mistral 的讨论,暗示了 Perplexity AI 平台内的功能增强或服务。

CUDA MODE Discord

-

NVIDIA 和 Meta 的芯片创新引发热议:社区对 NVIDIA 披露的一款 4nm 推理芯片感到兴奋,该芯片实现了 96 int4 TOPs/Watt,超越了此前 20T/W 的基准;同时 Meta 发布了下一代 AI 加速器,在仅 90W 功耗下达到 354 TFLOPS/s (INT8),标志着 AI 加速能力的飞跃。

-

深入探讨 CUDA 和 GPU 编程:关于 FreeCodeCamp CUDA C/C++ 课程的公告引起了极大热情,该课程旨在简化 GPU 编程陡峭的学习曲线。课程内容需求强调了涵盖矩形矩阵 GEMM 以及与图像卷积应用相关的广播规则的重要性。

-

理解 Scan 算法和并行计算:社区热切期待 scan 算法系列的第二部分。同时,针对

Single-pass Parallel Prefix Scan with Decoupled Look-back论文中提到的并行 scan 算法的实际挑战提出了疑问,并请求澄清 Triton 中的 CUDA kernel 命名,以便在 kernel profiling 中提高可追溯性。 -

分享模型训练和数据优化策略:讨论内容包括分享高效的同构模型参数共享策略,以避免 PyTorch 在 batching 过程中低效的复制;以及模型训练期间的 loss 尖峰等问题,这些问题可能通过梯度范数(gradient norm)绘图进行诊断。有人提议将数据集托管在 Hugging Face 上以方便访问,并建议使用压缩方法加快下载速度。

-

庆祝跨平台兼容性和社区胜利:讨论了将 CUDA 和机器学习库兼容性扩展到 Windows 的进展与挑战,并承认了 Triton 的复杂性。同时,社区庆祝一个仓库达到 20,000 stars,并分享了关于结构化和合并目录的更新以增强组织性,加强了社区内的持续协作。

Stability.ai (Stable Diffusion) Discord

-

在线内容隐私呼吁教育:一位参与者强调了不发布内容作为隐私保护措施的重要性,并强调需要教育人们了解向公司提供内容的风险。

-

力求 AI 工具结果的一致性:用户注意到使用 ComfyUI 与 Forge 相比存在不一致性,认为尽管初始设置相同,但不同的设置和功能(如 XFormers)可能会影响结果。

-

讨论合并 AI 模型的策略:对话围绕合并 SDXL 和 SD15 等模型以提高输出质量的潜力展开,尽管在模型各阶段确保一致的 ControlNet 仍然至关重要。

-

分享自定义 AI 模型训练见解:爱好者们交流了训练定制模型的技巧,提到了用于 Lora 模型训练的 OneTrainer 和 kohya_ss 等资源,并分享了有用的 YouTube 教程。

-

推荐 AI 探索的初学者资源:对于 AI 新手,建议从 Craiyon 等简单工具开始,在进阶到更复杂的平台之前感受图像生成 AI。

LM Studio Discord

ROCm 带来的 GPU 忧郁?这可不是什么悦耳的音乐:工程师们讨论了 ROCm 的 GPU 性能,感叹缺乏对 RX 6700 和 RX580 等旧款 AMD GPU 的支持,这影响了 token 生成速度和整体性能。在 LLAMA 3 8B Q8 等模型的多 GPU 系统上寻求性能基准测试的用户报告称,双 GPU 与单 GPU 相比,效率达到了 91%。

显存焦虑:LM Studio 模型的发布引发了关于 VRAM 充足性的辩论,其中 4070 的 12GB 显存与 1070 的 20GB 相比显得捉襟见肘,特别是在运行像 “codestral” 这样的大型模型时。

CPU 限制束缚手脚:运行 LM Studio 的 CPU 要求成为焦点,其中 AVX2 instructions 被证明是强制性的,导致使用旧款 CPU 的用户不得不改用之前的版本 (0.2.10) 以支持 AVX。

路由到正确的模板:AI 工程师分享了模型模板的解决方案和建议,例如为某些模型使用 Deepseek coder 提示词模板,并建议检查 tokenizer 配置,以便在 TheBloke/llama2_7b_chat_uncensored-GGUF 等模型上获得最佳格式。

领域新秀 - InternLM 模型:发布了多款专为数学和编程设计的 InternLM 模型,参数范围从 7B 到 mixtral 8x22B。像 AlchemistCoder-DS-6.7B-GGUF 和 internlm2-math-plus-mixtral8x22b-GGUF 这样的模型在 AI 工程师可用的最新工具中备受关注。

OpenRouter (Alex Atallah) Discord

-

全球 API 请求速度提升:OpenRouter 实现了全球范围内的延迟降低,将请求时间减少了约 200ms,通过优化边缘数据传输,特别惠及了来自非洲、亚洲、澳大利亚和南美洲的用户。

-

MixMyAI 推出统一的按需付费 AI 平台:一项名为 mixmyai.com 的新服务已上线,它在一个用户友好的界面中整合了开源和闭源模型,强调用户隐私并避免在服务器上存储聊天记录。

-

MPT-7B 重新定义 AI 上下文长度:Latent Space 播客展示了 MosaicML 的 MPT-7B 模型,以及它在突破 GPT-3 上下文长度限制方面的进展,详情见这篇深度访谈。

-

Ruby 开发者迎来新的 AI 库:一个新的 OpenRouter Ruby client library 已经发布,同时更新的还有 Ruby AI eXtensions for Rails,这些是 Ruby 开发者将 AI 集成到应用程序中的必备工具。

-

服务器稳定性和健康检查受到质疑:OpenRouter 用户在不同地区遇到了零星的 504 错误,目前已提供临时解决方案,讨论倾向于需要一个专门的健康检查 API 来实现更可靠的状态监控。

OpenAI Discord

Pro 权限提升聊天生产力:OpenAI 的 Pro 用户现在享有增强功能,例如更高的速率限制 (Rate Limits)、专属 GPT 创建,以及访问 DALL-E 和实时通信功能。尽管每月费用为 20 美元,但这一诱人的提议依然极具魅力,与非付费用户可用的有限工具集形成了鲜明对比。

AI 框架偏好助力功能灵活性:对于开发具有独特个性特征的 AI 角色的人员,推荐使用 Chat API 而非 Assistant API,因为它提供了卓越的命令执行能力,且没有文件搜索等冗余功能。

偏见争议困扰 ChatGPT:由于指出 ChatGPT 输出中存在的种族主义倾向而导致的账号停用,引发了关于模型固有偏见的激烈争论,凸显了在训练数据根深蒂固的细微差别中不断寻求减轻此类偏见的努力。

虚拟视频探索得到验证:Sora 和 Veo 成为投机热潮的主角,社区正在权衡这些先锋视频生成模型的策划声明和实际潜力,并将其与 AI 辅助视频制作的现实进行对比。

API 动荡与进展公告:内存泄漏 (Memory leaks) 导致的延迟和浏览器崩溃等持续性问题损害了 ChatGPT 的体验,引发了关于战术性聊天会话限制和完全召回过去交互以避免重复乏味的讨论。同时,GPT-4 中备受期待的实时语音和视觉功能已定于以 Alpha 状态向特定群体首次亮相,并根据 OpenAI 的更新在随后几个月内扩大范围。

Nous Research AI Discord

NeurIPS 竞赛:合并模型赢取荣誉与现金:NeurIPS 将举办一场 Model Merging 竞赛,奖金为 8,000 美元,由 Hugging Face 和 Sakana AI Labs 赞助,旨在寻求模型选择和合并方面的创新。注册及更多信息可在 llm-merging.github.io 查看,正如 Twitter 上所宣布的那样。

AI 探索与生物对话:一项高达 50 万美元的 Coller Prize 奖金正虚位以待,奖励给那些能够利用 AI 揭开与动物交流奥秘的人,这激发了人们对潜在突破的兴奋 (信息)。这一倡议呼应了 Aza Raskin 的 Earth Species Project,旨在理清跨物种对话 (YouTube 视频)。

困惑于偏好学习悖论:在一条 推文 指出 RLHF/DPO 方法中意想不到的局限性后,社区议论纷纷——偏好学习算法并不总能产生更好的首选响应排名,这挑战了传统认知,并暗示了过拟合 (Overfitting) 的可能性。

LLMs 主导实时网页内容:网页用户的一个新发现:LLMs 经常实时生成网页,在加载时渲染你所看到的内容。由于上下文限制,这种常规操作在处理冗长或内容丰富的页面时会遇到障碍,这是一个亟待战略性改进的领域。

Google 增强 AI 驱动的搜索:Google 为美国搜索用户升级了其 AI Overviews,提高了满意度和网页点击质量。尽管存在一些小故障,但他们正在通过反馈循环进行迭代,详见其博客文章——AI Overviews: About last week。

LlamaIndex Discord

-

Milvus Lite 提升了 Python 向量数据库:Milvus Lite 的推出为 Python 提供了一个轻量级、高效的向量存储解决方案,兼容 LangChain 和 LlamaIndex 等 AI 开发栈。鼓励用户在资源受限的环境中将 Milvus Lite 集成到其 AI 应用中,说明文档见此处。

-

使用 Omakase 构建 Web 应用:一个新的基于 Django 的 Web 应用模板简化了可扩展的检索增强生成 (RAG) 应用的构建,包含 RAG API、数据源管理和用户访问控制。分步指南见此处。

-

导航检索系统的数据传输:对于那些正在原型化检索系统的用户,社区建议创建一个 “IngestionPipeline” 来高效处理 SimpleStore 类和 RedisStores 之间的数据更新 (upserts) 和传输。

-

评估向量存储查询的复杂性:澄清了 PostgreSQL 中不同向量存储查询类型(如

DEFAULT、SPARSE、HYBRID和TEXT_SEARCH)的功能,共识是text和sparse查询都利用了tsvector。 -

解决 OpenAI 证书问题:针对 Docker 化 OpenAI 设置中的 SSL 证书验证问题,建议探索替代的基础 Docker 镜像以潜在地解决该问题。

Eleuther Discord

-

Luxia 语言模型污染警报:据报道,Luxia 21.4b v1.2 在 GSM8k 测试中的污染比 v1.0 增加了 29%,详见 Hugging Face 上的讨论,这引发了对基准测试可靠性的担忧。

-

准备,开始,合并!:NeurIPS 模型合并对决:NeurIPS 2023 模型合并竞赛 提供了 $8K 的奖金,吸引 AI 工程师在模型选择和合并方面开辟新路径。

-

前沿的 CLIP 文本编码器和 PDE 求解器范式转变:通过预训练实现的 CLIP 文本编码器方法论的进步,以及 Poseidon(一种用于 PDEs 的新模型,具有样本效率高且结果准确的特点)的部署获得了认可,重点介绍了关于 Jina CLIP 和 Poseidon 的论文。

-

Softmax Attention 在 Transformer 中的地位:围绕 Transformer 中 softmax 加权路由的必要性展开了辩论,一些工程师认为长期以来的使用优于新出现的机制(如 “function attention”),后者与现有方法论仍保持相似性。

-

Gemma-2b-it 的可复现性难题:在尝试复制 Gemma-2b-it 17.7% 的成功率时出现了差异,工程师们转向 Hugging Face 论坛 和 Colab notebook 寻求潜在解决方案,而通过 lm_eval 得到的 Phi3-mini 结果证明与预期结果更加一致。

Modular (Mojo 🔥) Discord

-

Mojo 崛起:包管理与编译器难题:根据 Discussion #413 和 Discussion #1785,Mojo 社区正期待关于提议的包管理器的更新。最近的 nightly Mojo 编译器版本

2024.5.3112带来了修复和功能变更,详见 raw diff 和当前的 changelog。 -

蓄势待发:社区会议与增长:Mojo 社区期待下一次会议,届时将有关于各种主题的精彩演讲,详情见 社区文档,并可通过 Zoom 链接 参与。

-

实践出真知:Mojo 的速度与修复:一段 YouTube 视频展示了将 K-Means 聚类移植到 Mojo 后带来的显著加速,详见此处。在

reversed(Dict.items())中发现的一个导致测试不稳定的 bug 已通过 PR 得到修正。 -

攻克学习曲线:编译器的教育资源:为了学习编译器知识,有人推荐了一份详尽的教学大纲,可在此处获取。

-

串联性能:为了避免内存开销,有人提议使用更高效的 string builder,讨论倾向于零拷贝(zero-copy)优化,并结合使用

iovec和writev以实现更好的内存管理。

LangChain AI Discord

-

LangChainAPI 的公开访问:有人请求提供一种方法,将 LangChainAPI 端点公开暴露给 LangGraph 使用场景,并表示有兴趣使用 LangServe,但正在等待邀请。

-

LangGraph 性能调优:围绕优化 LangGraph 配置的讨论集中在减少加载时间和提高 Agent 的启动速度上,这表明用户更倾向于更高效的流程。

-

聊天应用中的 Memory 与 Prompt Engineering:参与者寻求关于将“memory”中的摘要集成到

ChatPromptTemplate,以及将ConversationSummaryMemory与RunnableWithMessageHistory结合的建议。他们分享了总结聊天历史以有效管理 token 数量的策略,并提供了相关的 GitHub 资源 和 LangChain 文档。 -

LangServe 网站故障报告:报告了 LangServe 网站上的一个错误,并分享了网站链接以获取更多详情。

-

多变量 Prompt 构建:针对如何使用来自 LangGraph 状态的多个变量来构建 prompt 进行了咨询,并提供了一个公式化的 prompt 示例以及关于变量插入时机的询问。

-

社区项目与工具展示:在社区工作领域,有两个项目备受关注:一个是关于为 Agent 创建自定义工具的 YouTube 教程(Crew AI Custom Tools Basics),另一个是名为 AIQuire 的 AI 工具,用于文档洞察,可在 aiquire.app 提供反馈。

LAION Discord

-

Fineweb 推动图文对齐(Image-Text Grounding):一种名为 Fineweb 的极具前景的方法利用 Puppeteer 抓取网页内容,提取带有文本的图像作为 VLM 输入,为视觉语言模型(VLM)的 Grounding 提供了新手段。在此查看 Fineweb 讨论。

-

StabilityAI 的选择性发布引发辩论:StabilityAI 决定仅发布 512px 模型,而未发布全套 SD3 Checkpoints,这引发了成员们关于此举如何影响未来模型改进和资源分配的讨论。

-

位置精度:关于 DiT models 中的位置嵌入(Positional Embeddings)在处理更高分辨率图像时可能导致模式崩溃(Mode Collapse)的技术讨论,尽管它们目前是标准用法。

-

开源狂欢:开源项目 tooncrafter 的潜力让社区感到兴奋,尽管一些小问题正在解决中,这展示了社区推动增量进步的动力。

-

Yudkowsky 的策略引发争议:Eliezer Yudkowsky 的研究所发布了“2024 通讯策略”,倡导停止 AI 开发,在科技爱好者中引发了不同反应。深入了解该策略。

-

在 NeurIPS 合并模型:NeurIPS 正在举办一场模型合并(Model Merging)竞赛,奖金为 8,000 美元,旨在激励 LLMs 领域的创新。感兴趣的参与者应访问官方 Discord和注册页面。

-

用于美学 AI 艺术创作的 RB-Modulation:RB-Modulation 方法提出了一种无需额外训练即可对图像进行风格化和构图的新方法,成员可以访问项目页面、论文以及即将发布的代码。

OpenAccess AI Collective (axolotl) Discord

-

Yuan2 模型引起社区关注:成员们分享了对 Huggingface 上 Yuan2 model 的见解,强调了对其训练方面的浓厚兴趣。

-

训练技术对决:详细讨论对比了各种偏好训练(Preference Training)方法,重点介绍了 ORPO method,由于其“更强的效果”,被建议取代 SFT 紧接 DPO 的方案。相关参考文献见 ORPO 论文。

-

模型微调的挑战:针对 llama3 和 mistral 在西班牙语实体分类微调中的困难出现了担忧。一个案例详细描述了训练成功后模型推理的问题。

-

成员寻求并提供技术援助:从关于 Axolotl 和 CUDA 的安装查询,到使用 Hugging Face Accelerate library 配置早停(Early Stopping)机制以解决过拟合问题,社区成员积极寻求并提供技术协助。共享资源包括 axolotl 文档和早停配置指南。

-

Axolotl 配置说明:关于 Axolotl 中

chat_template正确配置的建议交流,推荐由 Axolotl 自动处理以管理 LLama3 的 Alpaca 格式。

DiscoResearch Discord

-

DiscoLeo 陷入死循环:将 ChatML 引入 DiscoLeo 导致了句子结束(EOS)Token 问题,使得模型有 20% 的概率进入无限循环。建议通过使用 ChatML 数据重新训练 DiscoLeo 来解决此问题。

-

Llama-3 模板更倾向于 ChatML:德语微调显示,相比 Llama-3 instruct 模板,用户更倾向于使用 ChatML,特别是针对像 Hermes Theta 这样已经基于 ChatML 的模型。

-

IBM 的 “Granite” 模型引发好奇:工程师们正在探索 IBM 的 Granite 模型,包括 Lab 版本、基于 Starcode 的变体以及 Medusa 投机解码,相关资源列在 IBM 文档和 InstructLab Medium 文章中。

-

Merlinite 7B 与 Granite 的对决:Merlinite 7B 模型因其精通德语而备受关注,正被拿来与通过 Lab 方法追踪的 IBM Granite 模型进行对比。

-

对 AI 生成数据质量的担忧:社区对 AI 生成的数据质量表示不满,例如在 q4km gguf 量化的 EQ Bench 等基准测试中表现不佳,并对在不产生灾难性遗忘(catastrophic forgetting)的情况下增强模型的新策略表现出兴趣。

Interconnects (Nathan Lambert) Discord

-

Google 的扩张引起关注:一条 推文 暗示 Google 正在加强其计算资源,引发了对其在 AI 模型训练能力方面影响的猜测。

-

OpenAI 重启机器人项目:据 Twitter 和 Forbes 文章报道,OpenAI 重新启动了机器人业务,目前正在招聘研究工程师,这标志着其自 2020 年以来首次重返机器人领域。

-

GPT-3.5 API 的混乱局面:社区成员对 GPT-3.5 混乱的文档和可用性说明表示沮丧;一些人指出了时间线上的差异以及删除技术文档带来的不便。

-

Sergey 为 Physical Intelligence 招兵买马:Nathan Lambert 转达了 Sergey 为一个物理智能(Physical Intelligence)项目进行的招聘信息,为那些对强化学习(RL)感兴趣并希望为实际机器人应用做出贡献的人提供了机会。

-

“AI 政策的浑水”环节热议:最新一期的 Murky Waters in AI Policy 播客讨论了加州备受争议的 1047 法案,并快速回顾了近期 OpenAI 和 Google 的失误。Nathan Lambert 错过了该法案的公开听证会,未提供出席细节或原因。

Cohere Discord

- Cohere 开拓 AI 可持续性:Cohere 因优先考虑长期可持续性而非眼前的宏大挑战而受到关注,重点关注从发票中提取信息等具体任务。

- AGI 仍有发展空间:社区达成共识,认为通往 AGI 的旅程才刚刚开始,并持续努力探索 AI 发展在当前 “CPU” 阶段之外的可能性。

- Cohere 提升服务器体验:服务器正在进行改造,以简化频道、增加新的角色和奖励,用 “cohere regulars” 取代服务器等级,并引入 Coral AI 聊天机器人来增强互动。

- 使用自定义表情符号表达自我:为了增加趣味性并改善互动,服务器将加入新的表情符号,用户可以通过联系管理员进行自定义。

- 征求对无代码 AI 工作流的反馈:一家初创公司正在征求对其 AI 模型无代码工作流构建器的见解,并提供 10 美元的调查奖励——他们很好奇为什么用户在首次使用后可能不再返回。

Latent Space Discord

适配层弥合差距:工程师们正在探索 embedding adapters(嵌入适配器)作为提高 AI 模型检索性能的一种手段,Chroma 研究报告中展示了相关证据。这些适配器的有效性可以类比为 Frozen Embeddings,Vespa 团队利用它来消除动态系统中的频繁更新(Vespa 博客见解)。

ChatGPT 与 PwC 合作进入企业市场:PwC 为约 100,000 名员工购买了 ChatGPT Enterprise 许可证,这引发了围绕每年约 3000 万美元估值的讨论,成员们对每位用户的成本猜测从每月 8 美元到 65 美元不等。

Google 的双星:Gemini 1.5 Flash & Pro:Google Gemini 1.5 Flash 和 Pro 的发布更新已推向正式版(GA),引入了诸如提高 RPM 限制和 JSON Schema 模式等增强功能(Google 开发者博客文章)。

TLBrowse 加入开源宇宙:融合了 Websim 与 TLDraw 的 TLBrowse 已开源,允许用户在 @tldraw 画布上幻化出无限想象的网站,并提供免费托管版本访问。

AI Stack Devs (Yoko Li) Discord

-

浏览器中的文学世界:Rosebud AI 正在筹备其“从书到游戏”(Book to Game)游戏创作节(game jam),邀请参与者使用 Phaser JS 根据文学作品构建游戏。该活动提供 500 美元奖金,持续至 7 月 1 日,详情可通过其 Twitter 和 Discord 获取。

-

导航数字领域:一位新公会成员表示在 Android 上使用该平台存在困难,称体验“不稳定且有 Bug”。他们还寻求帮助更改用户名,以便在虚拟空间中更有归属感。

OpenInterpreter Discord

- 查看置顶消息获取制造更新:及时掌握 OpenInterpreter 社区的制造更新至关重要;请务必查看 #general 频道中的置顶消息以获取最新信息。

- Codestral 模型引发好奇:工程师们对 Codestral 模型表现出兴趣,多个频道都出现了关于其效率的咨询;然而,用户体验尚未被分享。此外,值得注意的是 Codestral 仅限于非商业用途。

- 应对集成挑战:将 HuggingFace 模型与 OpenInterpreter 集成是一个共同的挑战,使用

interpreter -y命令的成功率有限。建议面临这些问题的工程师在技术支持频道寻求建议。 - 发布诈骗警报:保持警惕至关重要,因为社区内发布了关于潜在诈骗的“红色警报”。目前尚未提供有关该诈骗的更多细节。

- Android 功能讨论进行中:成员们正在讨论 O1 Android 的功能,特别是关于在 Termux 中的安装,尽管目前尚未看到结论性的回复。

Mozilla AI Discord

- Llamafile 与 AutoGPT 联手:AutoGPT 成员宣布了一项协作,将 Llamafile 编织进他们的系统中,扩展了该工具的覆盖范围和能力。

- 关于内容块的查询:有询问关于 Llamafile 是否可以处理消息中的内容块(content blocks),以寻求与类似 OpenAI 功能的对等;对于 llama.cpp 在该领域的能力也寻求了类似的澄清。

MLOps @Chipro Discord

- Netflix PRS 活动聚集 AI 爱好者:AI 专业人士正热烈讨论在 Netflix 举办的 PRS 活动,多位社区成员已确认参加,进行社交和讨论。

Datasette - LLM (@SimonW) Discord

-

Mistral 45GB 模型构成推测:围绕 Mistral 45GB 模型的语言分布,兴趣正在酝酿,一种假设认为该模型强烈偏向英语,而编程语言的占比相对较小。

-

Codestral 合规难题:社区正在研究 Mistral AI Non-Production License (MNPL) 的复杂性,发现其对分享衍生作品或托管作品的限制不尽如人意,限制了 Codestral 的开发。

tinygrad (George Hotz) Discord

- TensorFlow 与 PyTorch 的辩论仍在继续:一位名为 helplesness 的用户询问为什么 TensorFlow 可能被认为优于 PyTorch,引发了社区内的对比讨论。讨论并未给出定论,但反映了 AI 工程界对框架选择的持续偏好之争。

LLM Perf Enthusiasts AI Discord 没有新消息。如果该频道长期保持沉默,请告知我们,我们将将其移除。

AI21 Labs (Jamba) Discord 没有新消息。如果该频道长期保持沉默,请告知我们,我们将将其移除。

YAIG (a16z Infra) Discord 没有新消息。如果该频道长期保持沉默,请告知我们,我们将将其移除。

第二部分:按频道详细摘要与链接

完整的频道细分内容已为邮件版截断。

如果你喜欢 AInews,请分享给朋友!提前感谢!