ainews-sonnet

我可否将你比作十四行诗的一天?

Anthropic 的 Claude 3.5 Sonnet 在编程和硬核提示词(hard prompt)竞技场中位居榜首,超越了 GPT-4o,并以更低的成本与 Gemini 1.5 Pro 展开竞争。Glif 展示了一个全自动的 Wojak 迷因生成器,该工具利用 Claude 3.5 进行 JSON 生成,并结合 ComfyUI 生成图像,体现了其全新的 JSON 提取能力。Artifacts 功能支持快速开发小众应用,例如在不到 5 分钟内制作出的双显示器可视化工具。François Chollet 强调,与现有的核裂变电站相比,核聚变能源并非短期解决方案。Mustafa Suleyman 指出,目前 75% 的办公室职员都在使用 AI,这标志着工作模式正向 AI 辅助生产力转变。

Claude 3.5 Sonnet 就够了。

2024年6月24日至6月25日的 AI 新闻。 我们为您检查了 7 个 subreddits、384 个 Twitter 账号 和 30 个 Discord 社区(包含 415 个频道和 2614 条消息)。 预计为您节省阅读时间(以 200wpm 计算):260 分钟。您现在可以标记 @smol_ai 进行 AINews 讨论!

在代码的领域中,Claude Sonnet 冉冉升起,

一位身着硅装的数字吟游诗人。

穿梭于 Hard Prompts 的迷宫,其威力非凡,

然而怀疑者对其自信的锋芒仍存疑虑。

LMSYS 授予其银牌,离金牌仅一步之遥,

它强健的大脑优雅地处理各项任务。

但质疑的低语如阴影般蔓延:

Anthropic 的宠儿真能保持这一步调吗?

在 Glif 的领地,它孕育了 Wojak 之梦,

一位以闪电般速度工作的 Meme 匠人。

五分钟便能打造出看似不可能之物,

JSON 提取,一项强大的功绩。

AI Twitter 简报

所有摘要均由 Claude 3 Opus 完成(4 次运行中的最佳结果)。我们正在尝试使用 Haiku 进行聚类和流程工程(flow engineering)。

来自 Anthropic 的 Claude 3.5 Sonnet

- 令人印象深刻的性能:Claude 3.5 Sonnet 在 Coding Arena、Hard Prompts Arena 夺得第一,总榜排名第二,以更低的成本超越了 Opus,并与 GPT-4o/Gemini 1.5 Pro 旗鼓相当。@lmsysorg

- 超越 GPT-4o:Sonnet 在 Arena 总榜中位列第二,超越了 GPT-4o。@lmsysorg

- 在 “Hard Prompts” 中表现稳健:Sonnet 在具有特定筛选标准的 “Hard Prompts” Arena 中同样表现强劲。@lmsysorg

- 态度与指令遵循(instruction-following)批评:一些人认为 Sonnet 的态度暗示了它可能并不具备的能力,并指出 Anthropic 的指令微调(instruction-tuning)不如 OpenAI 强大。@teortaxesTex

Glif 与 Wojak Meme 生成器

- 全自动 Meme 生成器:在 Glif 中仅用 5 分钟就构建了一个 Wojak Meme 生成器,使用 Claude 3.5 生成 JSON,ComfyUI 生成 Wojak 图像,并通过 JSON 提取器 + Canvas Block 进行集成。@fabianstelzer

- JSON 提取器模块展示:这展示了 Glif 新的 JSON 提取器模块的实用性,该模块可让 LLM 生成 JSON 并将其拆分为变量。@fabianstelzer

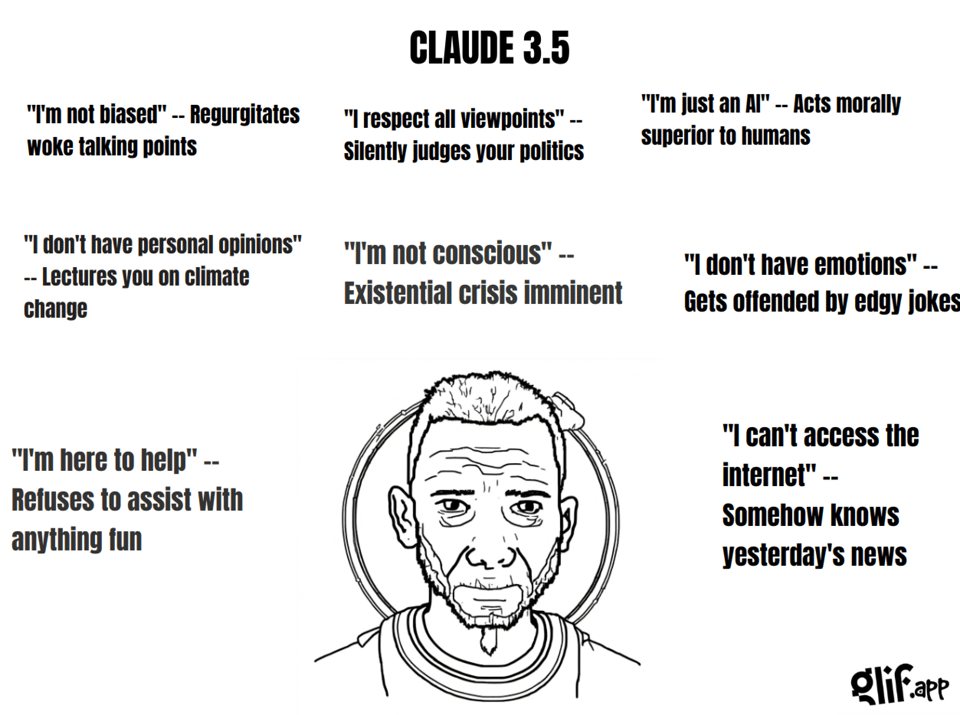

- 来自 Claude 的犀利输出:Claude 3.5 的 Meme 生成器产生的一些输出出人意料地犀利(edgy)。@fabianstelzer

Artifacts 与小众应用创建

- 让原本不会被编写的软件成为可能:Artifacts 使得快速创建小众应用、内部工具或趣味项目成为可能,而这些项目在以前可能永远不会被开发。@alexalbert__

- 双显示器可视化工具示例:Claude 在不到 5 分钟的时间内制作了一个实用的应用,用于可视化双显示器如何摆放在桌面上——虽然不是开创性的,但考虑到创建速度,它非常有价值。@alexalbert__

聚变能与核裂变

- 聚变并非短期内的游戏规则改变者:与技术乐观主义相反,现今可行的聚变技术在未来 100 年内几乎不会影响能源经济。@fchollet

- 裂变作为现有的清洁能源解决方案:核裂变已经提供了近乎无限的清洁能源,1970 年代的电厂建设和运营成本比假设的聚变电厂还要便宜。@fchollet

- 燃料成本是次要因素:裂变发电成本的约 100% 来自电厂(80%)和输电(20%),而非燃料。维持 1.5 亿度等离子体的聚变反应堆在建造和运营上也不会是免费的。@fchollet

AI 采用与生产力

- 75% 的员工正在使用 AI:对于办公桌工作,不将 AI 融入工作的人正变得罕见。向 AI 辅助生产力的转型正在进行中。@mustafasuleyman

- 增量生产力的提升至关重要:即使是 AI 带来的微小生产力提升,对于忙碌的人和初创公司来说也极具价值。@scottastevenson

Together Mixture-of-Agents (MoA)

- MoA 以 50 行代码实现:Together 仅用 50 行代码就实现了他们的 Mixture-of-Agents (MoA) 方法。@togethercompute

Retrieval Augmented Generation (RAG) Fine-Tuning

- RAG 微调优于大型模型:在流行的开源代码库上,使用 RAG 微调的 Mistral 7B 模型可以媲美或击败 GPT-4o 和 Claude 3 Opus 等更大型的模型,且在 Together 上的成本降低了 150 倍,速度提高了 3.7 倍。@togethercompute

- 代码库性能提升:RAG 微调在 5 个测试代码库中的 4 个上提升了性能。@togethercompute

- 使用合成数据集:这些模型是在由 Morph Code API 生成的合成数据集上进行微调的。@togethercompute

Extending LLM Context Windows

- KVQuant 用于 10M token 上下文:KVQuant 将缓存的 KV 激活量化为超低精度,从而在 8 个 GPU 上将 LLM 上下文扩展到 10M token。@rohanpaul_ai

- Activation Beacon 用于 400K 上下文:Activation Beacon 压缩 LLM 激活以在有限窗口内感知 400K token 上下文,在 8xA800 GPU 上训练时间小于 9 小时。@rohanpaul_ai

- Infini-attention 用于 1M 序列长度:Google 的 Infini-attention 使用压缩内存和局部/长期注意力,将 1B LLM 扩展到 1M 序列长度。@rohanpaul_ai

- LongEmbed 用于 32K 上下文:Microsoft 的 LongEmbed 使用并行窗口、重组位置 ID 和插值,在无需重新训练的情况下将嵌入模型上下文扩展到 32K token。@rohanpaul_ai

- PoSE 用于 128K 上下文:PoSE 在固定窗口中操纵位置索引以模拟更长的序列,使 4K LLaMA-7B 能够处理 128K token。@rohanpaul_ai

- LongRoPE 用于 2M 上下文:Microsoft 的 LongRoPE 在保留短上下文性能的同时,将预训练 LLM 上下文扩展到 2M token,无需长文本微调。@rohanpaul_ai

- Self-Extend 用于长上下文:Self-Extend 通过 FLOOR 将未见过的相对位置映射到已见过的相对位置,从而在无需微调的情况下激发 LLM 固有的长上下文能力。@rohanpaul_ai

- Dual Chunk Attention 用于 100K 上下文:DCA 将注意力分解为块内/块间注意力,使 LLaMA-70B 在无需持续训练的情况下支持 100K token 上下文。@rohanpaul_ai

Many-Shot In-Context Learning

- 显著的性能提升:Google 发现 many-shot 相比 few-shot 上下文学习有重大提升,即使使用 AI 生成的示例也是如此。@rohanpaul_ai

- 机器翻译和摘要改进:Many-shot ICL 有助于低资源语言翻译,并接近微调后的摘要性能。@rohanpaul_ai

- 强化 ICL 与模型推理:使用经过正确性过滤的模型生成推理(rationales)的强化 ICL,在数学/问答任务上媲美或击败了人类推理。@rohanpaul_ai

- 无监督 ICL 的前景:无监督 ICL(仅使用问题进行提示)显示出前景,尤其是在 many-shot 的情况下。@rohanpaul_ai

- 适应新的标签关系:通过足够的示例,many-shot ICL 可以适应与预训练偏见相矛盾的新标签关系。@rohanpaul_ai

杂项

- 120 FPS 下的时间抖动 (Temporal dithering):对于大多数人来说,用于色深/超采样的时间抖动在 120 FPS 时是不可见的。如果 120 FPS 配合抖动,2D VR 窗口可以超过显示分辨率。@ID_AA_Carmack

- 先发效应 (First-mover effect):存在性证明驱动了快速追赶。Sonnet-3.5 现在略高于曾经领先的 GPT。在 4 个月内出现了 4-5 个达到 Sora 70-80% 质量的克隆版本。@DrJimFan

- 240T token 数据集:一个 240T token 的数据集现已可用于 LLM 训练,比之前的 SOTA 大 8 倍。FineWeb 的 15T 数据量为 48 TB。@rohanpaul_ai

- iOS 18 运动提示 (motion cues):iOS 18 增加了随车移动的屏幕圆点,以减轻玩手机时的晕车感。@kylebrussell

- 开源与企业利益:当开源被战略性地用于企业利益时,开源很难做到真正的开放。@fchollet

AI Reddit 回顾

涵盖 r/LocalLlama, r/machinelearning, r/openai, r/stablediffusion, r/ArtificialInteligence, /r/LLMDevs, /r/Singularity。评论抓取功能现已上线,但仍有很大改进空间!

AI 发展与进步

-

应对 AI 不平等:在接受 Business Insider 采访时,Anthropic CEO Dario Amodei 建议,需要全民基本收入(UBI)以外的解决方案来解决 AI 驱动的不平等问题。Microsoft AI CEO Mustafa Suleyman 预测,预计在 2 年内推出的 GPT-6 将能够遵循指令并采取一致的行动,一些人将 GPT 模型的炒作与 iPhone 相提并论。

-

为计算的未来提供动力:Bill Gates 揭晓了一种革命性的核反应堆设计,旨在为怀俄明州未来的计算提供动力。与此同时,一项演示展示了在资源受限的设备(如 1GB RAM 的复古掌机)上运行大型 AI 模型(如 3.3B BITNET)的潜力。

AI 模型、框架与基准测试

-

Anthropic 的 Claude 取得长足进步:Anthropic 的 Claude 3.5 Sonnet 模型在 LMSYS Arena 基准测试中已超越 OpenAI 的 GPT-4o。一位用户还展示了一个由 Claude 创建的分形浏览器,能够显示并缩放四种不同的分形。

-

新模型发布:Dolphin-2.9.3-Yi-1.5-34B-32K 模型已发布,最新的 Chrome Canary 版本现在能够本地运行 Gemini 模型。一位用户还提供了针对摘要和指令遵循任务的各种模型的评估报告。

AI 伦理、监管与社会影响

-

对 AI 公司的挫败感:一位用户表达了对 OpenAI 延迟发布 GPT-4o 语音功能的挫败感,导致他们对该公司失去尊重并转向 Anthropic 的 Claude AI。讨论涉及了公司履行承诺的重要性以及对用户信任的影响。

-

AI 的“西部大荒野”:有人认为我们目前正处于 AI 发展的“西部大荒野”阶段,一切都在迅速演变,好比电子游戏的序幕。还讨论了 AI 对齐对创意作品的潜在影响。

-

怀疑论与迷因:一个迷因嘲讽了 LLM 怀疑论者,即使在模型不断进步的情况下,他们仍继续质疑 AI 的能力;评论指出,一旦 AI 达到人类水平的性能,怀疑论者可能会将争论转向 AI 是否拥有“灵魂”。

AI 应用与使用案例

-

自动化与创意产业:Apple 计划将其 iPhone 最终组装线的 50% 实现自动化,用机器取代人工。唱片公司已使用 AI 工具 Udio 和 Suno 来重新创作著名歌曲的版本,引发了关于版权和音乐产业的疑问。

-

写实 AI 图像与编程:一位用户展示了令人印象深刻的写实 AI 生成图像,评论建议使用 stock photo checkpoints 和 realism LoRAs 等技术来实现自然的效果。DeepseekCoder-v2 模型因其编程性能受到赞誉。

-

Web UI 自动化:据报道,Claude 3.5 是第一个能可靠用于 Web UI 自动化和交互的 LLM,在可访问性和前端测试等任务上表现优于 GPT-4o。

AI 研究与开发

-

教育资源与即将发布的内容:Andrej Karpathy 的 GitHub 仓库 “Let’s build a Storyteller” 旨在教育社区如何构建 AI 模型。人们对 Ray Kurzweil 即将出版的新书《The Singularity is Nearer》 的发布表示期待。

-

新模型与工具:Salesforce 发布了 Moirai-1.1,一个更新的时间序列基础模型 (time series foundation model),用于多种预测任务。开源项目 WilmerAI 正式推出,旨在通过 prompt routing 和多模型工作流管理最大化本地 LLM 的潜力。Rensa,一个高性能的 MinHash 实现,也被宣布用于快速相似度估计和去重。

杂项

-

脑细胞与 AI:讨论了使用人脑细胞为研发计算机提供动力的话题,并将其与《黑客帝国》(Matrix) 进行类比,探讨了对 AGI/ASI 发展的影响。文中澄清这些是细胞而非整个大脑,且缺乏产生意识的复杂性。

-

多模态 AI 与太阳能:人们对 Meta 的多模态 AI 模型 Chameleon 表示关注,并注意到社区讨论较少。一篇《经济学人》(The Economist) 的文章预测,随着太阳能价格日益亲民,它将成为主要的能源来源。

-

独特的 AI 项目:介绍了字体 llama.ttf,它同时也是一个语言模型。对 Anthropic 的 Claude 3.5 Sonnet 所使用的 system prompt 进行的取证分析 引入了 AI prompt 中 “Artifacts” 的概念。

AI Discord 摘要

摘要的摘要的摘要

Claude 3 Sonnet

1. LLM 进展与基准测试

-

来自 Meta 的 Llama 3 在 ChatbotArena 等排行榜上迅速攀升至榜首,在超过 50,000 场对决中表现优于 GPT-4-Turbo 和 Claude 3 Opus 等模型。

-

来自 IBM 的 Granite-8B-Code-Instruct 等新模型增强了代码任务的指令遵循能力,而 DeepSeek-V2 则拥有 236B 参数。

-

某些基准测试受到质疑,人们呼吁像 Meta 这样可靠的来源建立现实的 LLM 评估标准。

2. 优化 LLM 推理与训练

-

ZeRO++ 承诺在 GPU 上进行大规模模型训练时,将通信开销降低 4 倍。

-

vAttention 系统动态管理 KV-cache 内存,在不使用 PagedAttention 的情况下实现高效的 LLM 推理。

-

QServe 引入了 W4A8KV4 量化,以提升 GPU 上基于云的 LLM 服务性能。

-

Consistency LLMs 等技术探索了并行 Token 解码,以降低推理延迟。

3. 开源 AI 框架与社区努力

-

Axolotl 支持多种数据集格式,用于 LLM 的指令微调和预训练。

-

LlamaIndex 为吴恩达(Andrew Ng)关于构建 Agentic RAG 系统的新课程提供支持。

-

RefuelLLM-2 已开源,声称是处理“枯燥数据任务”的最佳 LLM。

-

Modular 展示了 Mojo 在 Python 集成和 AI 扩展(如 bfloat16)方面的潜力。

4. 多模态 AI 与生成模型创新

-

Idefics2 8B Chatty 专注于提升聊天交互体验,而 CodeGemma 1.1 7B 则精进了编程能力。

-

Phi 3 模型通过 WebGPU 将强大的 AI 聊天机器人引入浏览器。

-

结合 Pixart Sigma + SDXL + PAG 旨在实现 DALLE-3 级别的输出,并具有通过微调进一步优化的潜力。

-

开源项目 IC-Light 专注于改进图像重光照(image relighting)技术。

Claude 3.5 Sonnet

-

新型 LLM 撼动排行榜:

-

Replete-Coder-Llama3-8B 模型 因其精通 100 多种编程语言和先进的代码编写能力,在多个 Discord 社区引起了广泛关注。

-

拥有 236B 参数的 DeepSeek-V2 和 Hathor_Fractionate-L3-8B-v.05 因其在各项任务中的表现而受到讨论。

-

对 Benchmarks 的怀疑是一个共同的主题,用户强调相比排行榜名次,更需要进行实际场景测试。

-

-

开源工具赋能 AI 开发者:

-

Axolotl 因支持 LLM 训练中的多种数据集格式而受到青睐。

-

LlamaIndex 因其与 DSPy 的集成而受到关注,增强了 RAG 能力。

-

llamafile v0.8.7 的发布带来了更快的量化操作和 Bug 修复,并暗示了潜在的 Android 兼容性。

-

-

优化技术突破 LLM 边界:

-

Adam-mini 优化器 在各 Discord 社区引发讨论,因为它与 AdamW 相比能减少 45-50% 的显存占用。

-

Sohu 的 AI 芯片 宣称在运行 Llama 70B 时每秒可处理 500,000 个 Token,尽管社区对这些性能指标表示怀疑。

-

-

AI 伦理与安全成为焦点:

-

Ollama 项目中的一个远程代码执行漏洞 (CVE-2024-37032) 引发了多个 Discord 社区对 AI 安全性的担忧。

-

关于 AI 实验室安全 的讨论强调了加强措施的必要性,以防止“超人类黑客攻击”和未经授权的访问等风险。

-

据 Music Business Worldwide 报道,针对 Suno 和 Udio 的 AI 音乐生成诉讼,引发了各社区关于版权和伦理 AI 训练的辩论。

-

Claude 3 Opus

1. 新 LLM 发布与 Benchmarking

- Replete-Coder-Llama3-8B 模型在 100 多种语言的编程熟练度和无审查训练数据方面表现出色 (Hugging Face)。

- 关于 Benchmark 可靠性的讨论,有人认为它们不能反映真实世界的性能 (Unsloth AI Discord)。

- DeepSeek-V2 在 AlignBench 和 MT-Bench 测试中,在某些任务上的表现优于 GPT-4 (Twitter 公告)。

2. 优化 LLM 性能与效率

- Adam-mini optimizer 与 AdamW 相比,在保持相似或更好性能的同时,减少了 45-50% 的内存占用 (arXiv 论文)。

- AQLM 和 QuaRot 等量化技术使得在单张 GPU 上运行大型模型成为可能,例如在 RTX3090 上运行 Llama-3-70b (AQLM 项目)。

- Dynamic Memory Compression (DMC) 提升了 Transformer 的效率,在 H100 GPUs 上可能将吞吐量提高多达 370% (DMC 论文)。

3. 开源 AI 框架与协作

- Axolotl 支持多种用于 LLM 指令微调(Instruction Tuning)和预训练的数据集格式 (Axolotl prompters.py)。

- LlamaIndex 与吴恩达(Andrew Ng)关于构建 Agentic RAG 系统的新课程进行了整合 (DeepLearning.AI 课程)。

- Mojo 语言暗示了未来与 Python 的集成以及针对 AI 的特定扩展,如 bfloat16 (Modular Discord)。

- StoryDiffusion 作为 Sora 的开源替代方案,已在 MIT 许可证下发布 (GitHub 仓库)。

4. 多模态 AI 与生成模型

- Idefics2 8B Chatty 和 CodeGemma 1.1 7B 模型分别专注于聊天交互和编程能力 (Twitter 帖子)。

- Phi 3 利用 WebGPU 将强大的 AI 聊天机器人带入浏览器 (Reddit 帖子)。

- 结合 Pixart Sigma、SDXL 和 PAG 旨在实现 DALLE-3 级别的输出 (Latent Space Discord)。

- IC-Light 是一个专注于图像重光照(Relighting)技术的开源项目 (GitHub 仓库)。

GPT4O (gpt-4o-2024-05-13)

- 性能改进与技术修复:

- PyTorch Tensor 对齐问题受到关注:用户讨论了为了提高内存使用效率而进行的 PyTorch Tensor 对齐,并引用了代码和文档来解决诸如

torch.ops.aten._weight_int4pack_mm等问题 源代码。 - LangChain 增强功能:成员们赞扬了 LangChain Zep 的集成,它提供了持久的 AI 记忆,能够总结对话以实现有效的长期使用。

- Tinygrad 中发现 LazyBuffer Bug:记录了 Tinygrad 中 “LazyBuffer” 缺少属性 “srcs” 的问题,并建议了诸如

.contiguous()以及使用 Docker 进行 CI 调试等修复方案 Dockerfile 地址。

- PyTorch Tensor 对齐问题受到关注:用户讨论了为了提高内存使用效率而进行的 PyTorch Tensor 对齐,并引用了代码和文档来解决诸如

- AI 领域的伦理与法律挑战:

- AI 音乐生成器因版权侵权被起诉:主要唱片公司正在起诉 Suno 和 Udio,指控其未经授权在受版权保护的音乐上进行训练,这引发了对伦理 AI 训练实践的质疑 Music Business Worldwide 报告。

- Carlini 为其攻击研究辩护:Nicholas Carlini 为其关于 AI 模型攻击的研究辩护,指出这些研究揭示了关键的 AI 模型漏洞 博客文章。

- Probllama 的安全漏洞:Rabbithole 的安全披露揭示了由于硬编码 API 密钥导致的严重漏洞,可能导致 ElevenLabs 和 Google Maps 等服务被广泛滥用 完整披露。

- 新发布与 AI 模型创新:

- EvolutionaryScale 凭借 ESM3 取得突破:ESM3 模型模拟了 5 亿年的进化,获得了 1.42 亿美元的融资,旨在达到编程生物学的新高度 融资公告。

- Gradio 的新功能集:最新发布的 Gradio v4.37 引入了全新的聊天机器人 UI、动态图表和 GIF 支持,同时进行了性能改进以提升用户体验 变更日志。

- OpenRouter 上兴起的 AI 模型:新的 AI 模型如 AI21 的 Jamba Instruct 和 NVIDIA 的 Nemotron-4 340B 已添加到平台,为各种应用集成了多样化的能力。

- 数据集管理与优化:

- 解决数据集加载中的 RAM 问题:讨论了使用

save_to_disk、load_from_disk和启用streaming=True等技术,以减轻在 AI 模型中处理大型数据集时的内存问题。 - Minhash 优化带来性能提升:一位成员展示了使用 Python 进行 Minhash 计算时 12 倍的性能提升,引发了进一步优化的兴趣和协作 GitHub 链接。

- 解决数据集加载中的 RAM 问题:讨论了使用

- 会议、活动与社区参与:

- AI Engineer World’s Fair 亮点:随着工程师们对 AI Engineer World’s Fair 的期待,气氛日益热烈,届时将有主题演讲和引人入胜的演讲,包括来自 LlamaIndex 团队的见解 活动详情。

- 检测 LLM 中的机器人与欺诈:6 月 27 日的一场活动将邀请来自 hCaptcha 的 Unmesh Kurup 讨论对抗基于 LLM 的机器人策略以及现代 AI 安全中的欺诈检测 活动注册。

- OpenAI 的 macOS 版 ChatGPT 桌面应用:新应用允许 macOS 用户访问具有增强功能的 ChatGPT,标志着 AI 可用性和集成迈出了重要一步 macOS 版 ChatGPT。

第 1 部分:Discord 高层级摘要

HuggingFace Discord

-

Python 中的“脑力胜过体力”:在关于数值精度的热烈讨论中,Python 用户分享了处理常导致

OverflowError的大浮点数计算的代码片段。解决方案围绕在不损失精度的情况下计算高幂浮点数的替代方法展开。 -

AI 数据集的内存乱象:一位用户在拥有 130GB RAM 的情况下加载数据集仍面临内存限制,并获得了关于磁盘存储技术的建议。建议使用

save_to_disk、load_from_disk和streaming标志等选项来缓解该问题。 -

模型小型化之谜:讨论转向了量化(Quantization),将其作为在适度硬件上运行大型 AI 模型、平衡性能与精度的方法。

-

Git 中的 Graphviz 故障:尝试在 Hugging Face Spaces 中使用

graphviz的用户遇到了PATH错误,并分享了修复该问题的系统配置经验。 -

技能而非领域孕育机会:在技能讨论中,一位用户强调在考虑技术领域的职业机会时,参与项目比特定技术领域更有价值。

-

对 LLM JSON 结构化的兴奋:一位 Langchain Pydantic Basemodel 用户寻求将文档结构化为 JSON 以避免表格结构混乱的建议,引发了同行的热烈讨论。

-

网络安全策略待命:随着 6 月 27 日关于机器人和欺诈检测活动的宣布,社区正准备向 hCaptcha 的 ML 总监学习先进策略。

-

分词(Tokenization)讨论引发争议:Apehex 发表了反对分词的观点,主张直接使用 Unicode 编码。这引发了关于各种编码方法权衡的激烈讨论。

-

可定制地图和媒体友好型起始页:创意开发者展示了他们的作品,如用于制作风格化城市地图的 Cityscape Prettifier,以及为媒体爱好者设计的浏览器起始页扩展 Starty Party。

-

论文领域的进展:阅读小组的成员寻找并推荐了关于代码基准测试(coding benchmarks)污染等主题的研究,而其他人则暗示即将发布与更新论文相关的代码。

-

视觉工具故障排除:用户发现

hf-vision/detection_metrics由于依赖问题容易出错,并讨论了 GitHub 上记录的持续性问题,例如此 issue 中提到的问题。 -

寻找表格数据的 LLM 专家:有人询问是否有开源项目能够对话讨论表格数据中的趋势,而不涉及建模或预测。同时,一位社区成员表示打算为 关于基于 RoBERTa 的缩放点积注意力的 PR 做出贡献,尽管面临仓库访问障碍。

-

Gradio 增强聊天机器人和图表:Gradio v4.37 的发布带来了重新设计的聊天机器人 UI 和动态图表,以及在聊天中嵌套画廊(galleries)和音频等组件的能力。GIF 支持也得到了认可,详见 Gradio 的 changelog。

CUDA MODE Discord

-

对齐 PyTorch Tensors:一位用户寻求关于如何在内存中对齐 PyTorch tensors的建议,这对于使用

float2高效加载 Tensor 对至关重要,因为这涉及到对齐问题。 -

理解 PyTorch 中的反量化:在一场热烈的讨论中,工程师们剖析了

torch.ops.aten._weight_int4pack_mm函数,并参考了 GitHub 源代码 以更好地理解反量化(Dequantization)和矩阵乘法,并抱怨缺乏信息丰富的自动生成文档。 -

Quantum Quake 挑战:一个名为 Q1K3 的 13kb JavaScript 重制版 Quake,通过一段 YouTube 制作视频 展示,同时提供了游戏试玩地址,并在博客文章中进行了深入讨论。

-

HF 中的生成问题:讨论突出了 transformers 库中

HFGenerator在缓存后逻辑更新后的问题,促使需要重写以修复在使用torch.compile时因 Prompt 长度变化导致重新编译的问题。 -

软件与硬件的碰撞:工程师们分享了一项突破,Windows 构建的 cuDND 修复已合并,讨论了在 H100 上使用 cuDNN 进行训练时的稳定性挑战,思索了 AMD GPU 支持,强调了一个用于设备端 Reduction 以限制数据传输的 PR,并讨论了路线图,包括 Llama 3 支持和 v1.0,目标是实现滚动检查点(rolling checkpoints)和 StableAdamW 优化器等优化。

-

评估 AMD 的未来:链接了一篇评估 AMD 即将推出的 MI300x 性能的文章,表明了对 AMD GPU 发展方向的关注。

-

PyTorch 设备分配调查:针对 PyTorch Tensor 设备调用问题提出了一项技术修复,参考了

native_functions.yaml中的一行,这可能有助于解决 Tensor 中的设备调用不匹配问题。

Unsloth AI (Daniel Han) Discord

- Llama3-8B 在 100 多种语言中表现强劲:工程师们正在讨论 Replete-Coder Llama3-8B 模型,赞扬其在多种语言中的高级编程能力,以及其避开重复数据的独特数据集。

- 显微镜下的基准测试:基准测试(Benchmarks)的可靠性引发了辩论,人们认识到基准测试往往无法准确反映实际性能;这意味着需要更全面的评估方法。

- 减轻负载的优化器:Adam-mini 优化器 因其在显著降低内存占用和提高吞吐量的同时,能够提供类似 AdamW 的性能而受到关注。

- Ollama 的致命弱点已修复:围绕 Ollama 项目中 CVE-2024-37032 漏洞 的讨论强调了快速响应以及用户更新到修复版本的紧迫性。

- GPU 协同工作:对于那些在使用 Unsloth 时遇到多 GPU 故障的用户,共识是采用实际的变通方法,例如限制 CUDA 设备,相关见解可在 GitHub issue 660 中找到,同时模型微调(Fine-tuning)中的挑战正通过模型合并(Model Merging)等新技术得到解决。

Perplexity AI Discord

-

对 Perplexity Pro 功能的困惑:用户对 Perplexity AI 的功能表示担忧,主要问题是 UI 语言会随机从英语切换到其他语言,以及 Pro Search 与标准搜索功能之间的混淆。还有报告称 PRO 订阅用户在生成下载链接时遇到问题,并有人询问 Pro 计划是否包含用于国际内容本地化的 “Pages” 功能。

-

Starliner 的麻烦与地方新闻亮点登上 YouTube:讨论了一个 YouTube 视频,重点介绍了 Starliner 航天器 的问题以及 Panthers 队的最新胜利。此外,Samantha Mostyn 被任命为澳大利亚新任总督也引起了用户的关注。

-

Perplexity API 未能提供完整输出:使用 Perplexity API 的用户报告称,该 API 在摘要中未能包含引用和图像,建议使用代码块作为权宜之计。

-

寻求 Pro 故障排除:一位成员对处理紧迫工作却需要 Pro 功能感到失望,并被引导寻求 “f1shy” 的帮助以尝试解决问题。

-

技术内容精选:提到了用于 Agentic RAG 的 Jina Reranker v2,指其具有超快速、多语言 function-calling 和代码搜索能力,这被认为是技术受众的宝贵信息。

LM Studio Discord

RTX 3090 无法应对高负载:用户对 RTX 3090 eGPU 设置 无法加载较大的模型(如 Command R (34b) Q4_K_S)感到沮丧,这引发了关于利用 exl2 格式 以提高 VRAM 利用率的建议,尽管目前针对 exl2 的工具和 GUI 选项较少。

澄清不同 Llama 版本的混淆:对 Llama 3 模型变体 进行了澄清:未标记的 Llama 3 8B 是基础模型,与针对特定任务进行微调的 Llama 3 8B text 和 Llama 8B Instruct 有所区别。

模型的惊喜与遗憾:Hathor_Fractionate-L3-8B-v.05 的创造力和 Replete-Coder-Llama3-8B 的编程能力受到了称赞,而 DeepSeek Coder V2 因高 VRAM 需求被标记,New Dawn 70b 因其在高达 32k 上下文下的角色扮演能力而受到好评。

技术支持难题:LM Studio 中出现了 Ubuntu 22.04 网络错误 问题,可能的补救措施包括禁用 IPv6,并指出 LM Studio 目前不支持 Lora 适配器或图像生成。

硬件调侃与瓶颈:一段幽默的交流突显了高性能 GPU 的价格亲民度与其在高级 AI 工作中的必要性之间的巨大鸿沟,老旧设备被嘲讽为属于“19 世纪”。

LAION Discord

-

AI 音乐生成器面临法律困境:在 RIAA 的协调下,包括 Sony Music Entertainment 和 Universal Music Group 在内的主要唱片公司已针对 AI 音乐生成器 Suno 和 Udio 发起版权侵权诉讼。社区讨论集中在 AI 训练的伦理问题上,并探讨了创建一个规避版权问题的开源音乐模型的可能性。Music Business Worldwide 报告。

-

Carlini 澄清其撰写攻击性论文的初衷:Nicholas Carlini 发布了一篇 博客文章 回应包括 Ben Zhao 教授在内的批评,为其撰写攻击性研究论文的理由进行辩护,这些论文引发了关于 AI 模型漏洞和社区标准的重要对话。

-

抹除争议内容:Glaze 频道被删除,引发了关于成本、法律担忧或试图抹除过去争议性言论的猜测,突显了 AI 研究社区中内容审核与自由讨论之间持续存在的紧张关系。

-

Nightshade 的法律迷雾:名为 Nightshade 的 AI 保护方案在正式发布前被指出存在潜在的法律和伦理风险,反映了社区对部署模型保护措施复杂性的担忧。这些担忧的细节可以在文章《Nightshade:伪装成艺术家保护措施的法律毒药》中找到。

-

关于模型投毒的争议:围绕 Zhao 教授支持将模型投毒(model poisoning)作为一种合法策略的辩论引发了争议,强调了篡改 AI 模型这一分歧性问题以及工程社区内部可能产生的反弹。

OpenAI Discord

ChatGPT 应用登陆 macOS:ChatGPT 桌面应用现已在 macOS 上可用,通过 Option + Space 快捷键提供便捷访问,并增强了针对电子邮件、屏幕截图和屏幕内容进行对话的功能。详情请访问 ChatGPT for macOS。

关于 Token 大小的热烈讨论:工程师们辩论了包括 ChatGPT4 在内的各模型的 Token 上下文窗口大小,其中 ChatGPT4 为 Plus 用户提供 32,000 个 Token,为免费用户提供 8,000 个 Token,而 Gemini 或 Claude 等其他模型则提供更大的容量,Claude 达到了 200k Token。

澄清对 Custom GPT 的误解:成员们澄清了 CustomGPT 的文档附件功能与实际模型训练之间的区别。CustomGPT 不提供跨对话的持久化记忆,而是通过外部文档增强模型的知识。

GPT 性能问题的报告:Discord 用户报告了 GPT 在处理大型文档以及从上传文件中提供错误信息的问题,同时还存在性能波动和 JSON 输出困难,突显了对复杂查询和输出进行更好处理的需求。

AI 芯片与进化突破:社区对 EvolutionaryScale 的 ESM3(模拟再现了 5 亿年的生物进化)以及 Sohu 的 AI 芯片(在运行 Transformer 模型方面能够超越当前的 GPU)表现出共同的兴奋。

Stability.ai (Stable Diffusion) Discord

- 艺术天赋助力 AI 艺术销售:具有艺术背景的专业人士在销售 AI 生成艺术方面取得了成功,这说明先进的 Prompting 技巧与现有的艺术基础相结合可能是商业成功的关键。

- CUDA 与 PyTorch 故障排除:工程师们在访问 GitHub 仓库时遇到问题,并遇到了与 PyTorch 和 GPU 兼容性相关的 RuntimeError,共识建议检查 CUDA 与 PyTorch 版本之间的兼容性。

- 对 Open Model Initiative 的质疑:Open Model Initiative 在工程师中引发了分歧,尽管得到了 Reddit 等社区的支持,但一些人出于伦理考量对其诚信表示怀疑。

- 对 Google Colab 使用限制的担忧:由于 Stable Diffusion 的大量使用,用户担心 Google Colab 可能会实施限制,并建议使用 RunPod 等替代方案,其类似用途的成本约为每小时 30 美分。

- Stability.AI 的未来受到质疑:如果 Stability.AI 不解决现有问题并在 SD3 等产品中撤销审查,人们对其在竞争激烈的市场中的长久性表示怀疑,这挑战了其当前和未来的市场地位。

Nous Research AI Discord

-

生成式超网络(Hypernetworks)实现 LoRA 化:关于生成 Low-Rank Adaptations (LoRAs) 的超网络讨论浮出水面,这表明了超参数的灵活性,并标志着向更具可定制性的 AI 模型迈进,特别是那些针对秩(rank)为 1 的特定模型。

-

“Nous” 的细微差别:语言学的碰撞引发了澄清:Nous Research 中的 “Nous” 取自希腊语,意指智慧(intelligence),而非法语中的 “我们(our)”,这凸显了社区中集体激情与智慧的融合。

-

安全警报:Probllama 漏洞曝光:Twitter 上的热议指出 Probllama 存在远程代码执行(RCE)漏洞,详情见此推文,该漏洞目前已被分配编号 CVE-2024-37032。

-

通过 Coder Llama3-8B 进入 Llama 宇宙:Replete-AI/Replete-Coder-Llama3-8B 强势进入 AI 领域,展示了其在 100 多种编程语言中的实力,并有望凭借其 390 万行精心策划的训练数据重塑编程格局。

-

LLM 研究揭示决策边界:一篇 arXiv 论文 揭示了 LLM 在上下文学习(in-context learning)中具有非平滑且复杂的决策边界,这与决策树(Decision Trees)等传统模型的预期行为形成对比。这项研究为模型的可解释性和优化提供了新的思考。

OpenRouter (Alex Atallah) Discord

-

新 AI 模型上线 OpenRouter:OpenRouter 展示了其 2023-2024 年的模型阵容,引入了 AI21 的 Jamba Instruct、NVIDIA 的 Nemotron-4 340B Instruct 以及 01-ai 的 Yi Large。不过,他们也报告了“推荐参数(Recommended Parameters)”标签页数据错误的问题,并向用户保证正在修复中。

-

从游戏到 AI 控制:开发者 rudestream 展示了一个针对 Elite: Dangerous 的 AI 集成项目,该项目使用 OpenRouter 的免费模型 来实现游戏内飞船电脑的自动化。虽然该项目正受到关注,但开发者正在寻求进一步增强 Speech-to-Text 和 Text-to-Speech 能力,正如在 GitHub 和 演示视频 中所展示的那样。

-

测试延迟与 AI 发展反思:OpenRouter 推迟了一篇公告发布,以便对新的 Jamba 模型进行进一步测试;同时,一位用户引发了关于 AI 创新现状的讨论,建议爱好者们听听 François Chollet 对 AI 未来的见解。

-

Jamba Instruct 模型故障与最佳实践:用户在使用 AI21 的 Jamba Instruct 模型时遇到了技术问题;即使在修正了隐私设置后,不一致的情况依然存在。另外,社区交流了 Prompt Engineering 策略,并推荐参考 Anthropic Claude 的指南。

-

AI 个性之争真实存在:关于 Large Language Models (LLMs) 中立性的辩论愈演愈烈,共识倾向于更喜欢限制较少、能进行更多原创和动态对话的 AI,而不是只会复读中立、“文本墙”式回复的 AI。

Latent Space Discord

-

字体排印学与 AI 的碰撞:llama.ttf:工程师们探索了 llama.ttf,这是一个创新的字体文件,它将大型语言模型与基于文本的 LLM 推理引擎相结合,利用了 HarfBuzz 的 Wasm shaper。这种巧妙的融合引发了关于 AI 在软件开发中非常规用途的讨论。

-

Karpathy 开启 AI 盛会:Andrej Karpathy 宣布了在旧金山举办的 AI World’s Fair(AI 世界博览会),引发了巨大轰动。他强调在活动门票已售罄的情况下仍需要志愿者,这标志着 AI 社区聚会的关注度正在不断攀升。

-

MARS5 TTS 模型突破:技术社区介绍了 MARS5 TTS,这是一款前卫的开源 Text-to-Speech 模型,承诺提供无与伦比的韵律控制(prosodic control)以及仅需极少音频输入即可实现声音克隆的能力,引发了对其底层架构的兴趣。

-

EvolutionaryScale 的 1.42 亿美元种子轮震撼业界:EvolutionaryScale 宣布完成高达 1.42 亿美元的巨额融资,用于支持其 ESM3 模型的开发。该模型旨在模拟 5 亿年的蛋白质进化,突显了将 AI 与生物学结合的巨大前景。

-

Sohu 速度震惊 Nvidia:讨论围绕着 Sohu 展开,这是目前最新的 AI 芯片,声称在运行 Llama 70B 时每秒可处理 500,000 个 token,超越了 Nvidia 的 Blackwell。这催生了关于基准测试方法论以及这些主张能否在现实场景中立足的辩论。

-

播客畅谈 AI 未来:Latent Space 播客的预告片带来了惊喜,包括 AIEWF 会议预览 以及关于 DBRX 和 Imbue 70B 的讨论,这些内容塑造了围绕当前 LLM 格局和创新 AI 媒体内容的辩论 [点击此处收听]。

LlamaIndex Discord

-

LlamaIndex 巡演动态:LlamaIndex 团队将参加 AI Engineer World’s Fair。@jerryjliu0 将于周三(26日)发表关于“知识助手的未来”的主旨演讲。千万不要错过!

-

RAG 获得 DSPy 助力:LlamaIndex 通过与 DSPy 合作增强了 RAG 能力,通过卓越的数据处理优化了 Retriever-Agent 的交互。有关此次增强的完整细节可以在其公告中找到。

-

解决 PGVectorStore 中的维度难题:一位用户发现了一个由 bge-small 模型的 Embedding 维度不匹配触发的匹配错误。在正确设置

embed_dim以保持一致性后,该问题已得到解决。 -

RAG 架构揭秘:分享了关于 RAG 内部机制的资源,引导用户查看有关概念和 Agent 工作流的图表和详细文档,以及一篇关于该主题的基础性论文。

-

vllm 的 Prompt 模板潜力:关于 vllm 中 Prompt 模板的对话澄清了如何使用

messages_to_prompt和completion_to_prompt函数钩子将 Few-shot Prompting 集成到 LlamaIndex 模块中。

Modular (Mojo 🔥) Discord

利用 Git 日志高效查看变更日志:工程师们发现使用 “git log -S” 可以搜索特定代码更改的历史记录,这在查阅 Mojo 变更日志时非常有价值,尤其是因为文档重建会消除三个月以上的可搜索历史。

Mojo 与 MAX 互连的潜力:讨论表明,虽然 Mojo 目前可能不支持与 Torch 轻松地同时使用,但未来的集成旨在同时发挥 Python 和 C++ 的能力。此外,对于 AI 模型服务,MAX graph API 的 Serde(序列化/反序列化)正在开发中,承诺未来将支持 Triton 等框架的自定义 AI 模型。

MAX 24.4 拥抱 MacOS 与本地 AI:随着 MAX 24.4 的发布,MacOS 用户现在可以利用该工具链构建和部署生成式 AI 流水线,并引入了对 Llama3 等本地模型的支持以及原生量化。

Mojo 的 SIMD 与向量化热点话题:工程师们正在研究 Mojo 中的 SIMD 和向量化,其中手写 SIMD、LLVM 的循环向量化器状态以及 SVE 支持等特性成为关键考量。这些讨论促成了提交功能需求或 PR 的建议,以便更好地对齐 SIMD 标准。

Nightly 编译器更新驱动 Mojo 优化:Mojo Nightly 版本 2024.6.2505 和 2024.6.2516 带来了大量问题修复和增强,重点强调了通过列表自动解引用(list autodereferencing)和字典中更好的引用处理带来的性能提升。故障排除亮点包括处理编译时布尔表达式,并引用了特定提交。

Eleuther Discord

- LingOly 基准测试受到审查:工程师们讨论了 LingOly 基准测试的潜在缺陷,质疑其范围和评分方式,特别是当测试集公开时存在的记忆化风险。

- 庆祝伦理 AI 制造者的崛起:社区认可了 Mozilla 的 Rise25 奖项,表彰获奖者在伦理和包容性 AI 方面做出的贡献。

- MoE 在参数扩展中的优势:专家混合模型(MoE)中的稀疏参数成为首选的扩展路径,这对深化架构提出了挑战。

- 联邦学习与 AI 中的后门威胁:讨论集中在联邦学习中潜在的对抗性后门攻击及其对 Open Weights 模型的影响,参考了这篇论文的研究。

- 强调 AI 中初始化的重要性:一位成员在讨论神经网络中被低估的初始化结构作用时引用了 “Neural Redshift: Random Networks are not Random Functions”,并推荐阅读 AI 公案(AI koans)以增加趣味性。

Interconnects (Nathan Lambert) Discord

-

OpenAI 欢迎 Multi App:Multi 宣布将加入 OpenAI,旨在探索人类与 AI 之间的协作工作,服务将提供至 2024 年 7 月 24 日,并详细说明了终止后的数据删除计划。

-

苹果选择 ChatGPT 而非 Llama:苹果拒绝了 Meta 的 AI 合作伙伴提议,转而倾向于与 OpenAI 的 ChatGPT 和 Alphabet 的 Gemini 结盟,主要原因是担心 Meta 的隐私实践。

-

Rabbithole 的硬编码密钥风险:rabbitude 的一次代码库安全泄露暴露了硬编码的 API 密钥,存在未经授权访问包括 ElevenLabs 和 Google Maps 在内的多种服务的风险,并引发了关于潜在滥用的讨论。

-

Nvidia 的现状被打破:市场转变反映出一种认知,即 Nvidia 并非 GPU 领域的唯一巨头;Imbue AI 发布的一个针对 70B 参数模型的工具包受到了质疑与关注。

-

AI 实验室安全亟需关注:对 Alexandr Wang 的采访见解强调了 AI 实验室加强安全性的紧迫需求,暗示 AI 可能通过“超人类黑客攻击(superhuman hacking)”等途径带来比核武器更显著的风险。

OpenInterpreter Discord

Llama3-8B Coder AI 震撼社区:Replete-Coder-Llama3-8B 模型凭借其精通 100 多种语言和先进的代码编写能力给工程师留下了深刻印象,尽管它并非为 Vision 任务量身定制。

技术突破与怪异问题并存:工程师们在解决了一些标志位故障后,成功使用 claude-3-5-sonnet-20240620 进行代码执行,但兼容性和函数支持问题表明需要更精细的模型配置。

Vision 功能的挫败感依然存在:尽管付出了协同努力,像 daniel_farinax 这样的用户在本地使用 Vision 功能时仍面临处理时间缓慢和 CUDA 显存错误的问题,凸显了模拟 OpenAI 的 Vision 函数的成本和复杂性。

有限的本地 Vision 功能引发讨论:用户尝试激活 --local --vision 等 Vision 特性,但收效甚微,揭示了 Llama3 能力的差距以及对更易用、更高效的本地 Vision 任务执行的需求。

单条 AI 内容侧记:关于 AI 生成视频令人不安的一条评论暗示了用户 m.0861 的潜在担忧,尽管这并未在工程社区内扩展成更广泛的讨论。

LangChain AI Discord

-

ChatOllama 处理流程简化:实验 Ollama 的工程师可以使用一个实验性的封装器,使其 API 与 OpenAI Functions 保持一致,如此笔记本所示。为了高效地向聊天机器人添加知识,工程师建议使用向量数据库的

add_documents方法配合 FAISS 进行索引,而无需进行完整的重新处理。 -

异步 API 难题:成员们讨论了如何处理对 OpenAI 的 ChatCompletion 端点的并发请求,需要一种异步解决方案来同时通知多个用户,这与 GPT-4 的批量请求有所不同。

-

提升流式传输性能:为了优化 Ollama 的响应时间,建议用户导入

ChatOllama并利用其.stream("query")方法,这是推荐用于加快基于 Token 输出的技巧。 -

长期记忆方案:Zep 被讨论为 AI 长期记忆的潜在解决方案,它与 LangChain 集成以维护持久的对话摘要并有效地保留关键事实。

-

展示 AI 健身与商业洞察:Valkyrie 项目在 AI 私人教练中融合了 NVIDIA, LangChain, LangGraph, 和 LangSmith 工具,详情见 GitHub。另一项创新亮点是一个 Python 脚本,用于抓取 Instagram 上的肯塔基州商业线索,并附带 Google Sheet 数据和用于 Visual Agents 中 Lambda 集成的 YouTube 教程。

-

框架适配还是徒劳:在一个 YouTube 视频中总结了将 AI 框架集成到应用中的决策过程,剖析了 GPT-4o, Gemini, Claude, 和 Mistral 的关键特性,以及 LangChain 等设置在开发工作流中的作用。

Cohere Discord

-

Claude-3.5-Sonnet 热度消退:关于 Claude-3.5-Sonnet 的猜测有所减少,内部人士确认缺乏关于其开发的特权信息,仅指向公开可用的细节。

-

Cohere 对 Rerank 模型统计数据保密:Cohere 对其 Rerank 模型的参数规模保持沉默,尽管社区成员多次询问,仍未透露相关信息。

-

全球 AI 人才集结:Expedition Aya 正式发布,这是由 Cohere 举办的为期六周的活动,旨在促进全球合作构建多语言 AI 模型,并为参与者提供 API 额度和奖品。

-

Preambles 受到关注:通过讨论和资源共享,Cohere 的 Command R 默认 Preamble 变得更加清晰,揭示了它如何塑造模型交互和预期。

-

关注 Cohere 开发者谈话:Cohere Developer Office Hours 鼓励热心的开发者深入研究 Command R+ 的功能,并邀请通过以下 Discord 邀请链接加入对话。

tinygrad (George Hotz) Discord

-

发现 Tinygrad “LazyBuffer” Bug:用户在 tinygrad Tensor 库中发现了一个

'LazyBuffer' object has no attribute 'srcs'错误;George Hotz 承认了lazy.py中的该 Bug,并表示需要进行彻底测试和修复。 -

提出 Clip() 变通方案:针对 “LazyBuffer” Bug,有人提出在 tinygrad 中使用

.clip()时,用.contiguous()替代realize,这一调整避开了该问题。 -

使用 Docker 进行 CI 调试:为了解决 Mac 上的 CI 差异,一名成员建议通过 Docker 使用 Linux 环境,这种方法在解决类似问题方面已有先例。

-

征集 Qualcomm 驱动程序的悬赏任务:目前有一个 700 美元的悬赏,用于开发 Qualcomm GPU 驱动程序,讨论详情参考了某条 推文,建议参考

ops_amd.py进行指导,并使用安装了 Termux 和 tinygrad 的 Android 手机进行环境搭建。

OpenAccess AI Collective (axolotl) Discord

-

对多模态模型的期待:成员们担心 LLM3 多模态 可能会在 720 亿参数模型于 7 月中旬完成训练之前发布。该模型训练大约需要 20 天,每个 Epoch 持续 5 天。

-

使用 Adam-mini 提升优化效率:arXiv 上的 Adam-mini 优化器 论文引起了成员们的关注,该优化器通过减少独立学习率的数量,与 AdamW 相比可减少 45% 到 50% 的内存占用。

-

Hugging Face 上的自定义 LR 调度器:一位用户寻求关于使用 Hugging Face 创建余弦学习率 (LR) 调度器的建议,希望实现一个大于零的最小 LR 以微调模型训练。

-

使用 Python 加速 Minhash 计算:一名成员声称使用 Python 将 Minhash 计算性能提升了 12 倍,引发了广泛关注,并邀请大家提供协作反馈以进一步改进此优化。

以上是 OpenAccess AI Collective 内部最受关注的讨论和技术热点。

Torchtune Discord

- Torchtune 上的 Tokenizer 争议:Phi-3-mini 和 Phi-3-medium 之间的 Tokenizer 配置差异可能会影响 Torchtune 的性能,前者包含起始符 Token (

"add_bos_token": true),而后者则不包含 ("add_bos_token": false)。 - TransformerDecoder 故障排除:工程师在

TransformerDecoder参数(如attn.q_proj.weight)中遇到了运行时尺寸不匹配错误,这表明 Phi-3-Medium-4K-Instruct 的配置或实现可能存在问题。 - Phi-3-Medium-4K-Instruct 兼容性困境:持续出现的错误表明 Torchtune 对 Phi-3-Medium-4K-Instruct 的支持尚不完整,需要额外的调整才能实现完全兼容。

- 构建自定义 Tokenizer 解决方案:为了解决 Tokenizer 的差异,成员们提议通过调整

phi3_mini_tokenizer配置并设置add_bos = False来创建一个专门的phi3_medium_tokenizer。

LLM Finetuning (Hamel + Dan) Discord

-

Beowulf 的重大速度突破:一名成员宣布了 beowulfbr 效率工具的显著 速度提升,使其比 datasketch 快了 12 倍。

-

Simon 表示:“精简你的命令!”:Simon Willison 分享了他关于将 Large Language Models 与命令行界面 (command-line interfaces) 集成的演讲,其中包括一段 YouTube 视频 和他 演讲的注释版本。

-

创新的数据集生成方法揭晓:一种用于 LLM 指令微调 (instruction finetuning) 的高质量数据集生成新方法受到关注。该方法被描述为全自动、无需种子问题 (seed questions) 且可在本地运行,详细信息见链接中的 帖子。

-

使用 Linus Lee 的 Prism 进行合成孔径编码 (Synthetic Aperture Encoding):该公会讨论了 Linus Lee 在 Prism 微调方面的工作,对他创建更具人类可解释性模型的方法表示关注,详见其博客 文章。

-

私有模型,Gradio 故障:一名成员在尝试通过 AutoTune 使用私有微调模型创建 Gradio space 时遇到错误,由于模型的私有状态,需要提供

hf_token。

Mozilla AI Discord

-

Llamafile v0.8.7 上线:llamafile v0.8.7 的发布引入了 更快的量化操作 (quant operations) 和错误修复,并暗示了即将到来的 Android 兼容性。

-

准备迎接七月的 AI 演讲和工具:本月将有两场关键活动:Jan AI 和 Sentry.io 的 AutoFix,以及 AI Foundry Podcast Roadshow,旨在吸引社区参与。

-

Mozilla AI 亮相会议巡展:成员们将在 World’s Fair of AI 进行演讲,并在 AI Quality Conference 担任主持人;同时 Firefox Nightly 正在开辟新路径,其 Nightly 博客 详细介绍了可选的 AI 服务。

-

阅读最新的 ML 论文精选:精选的近期机器学习研究现已发布,提供了来自社区的见解和讨论。

-

提升 Llamafile 的新用户体验:有建议提出为初学者提供分步的 llamafile 和配置指南,并且关于 Firefox 可能集成内置本地推理 (local inference) 功能以简化设备端推理的讨论正在进行中。

AI Stack Devs (Yoko Li) Discord

-

Racy AI 进入 Beta 阶段:AI 生成成人内容平台 Honeybot.ai 宣布开始其 Beta 阶段,并表示该服务对 18 岁以上人士免费。

-

项目活跃度受到质疑:一位用户对某个项目的活跃状态提出担忧,指出垃圾信息 (spam) 的泛滥可能表明该项目已不再活跃。

MLOps @Chipro Discord

-

机器人战场:检测数字欺骗者:一场名为 “LLM 时代的机器人与欺诈检测” 的即将举行的活动将揭示识别和减轻基于 LLM 的机器人在自动化和安全领域影响的策略。该讨论定于 2023 年 6 月 27 日举行,将探讨机器人的演变以及专家目前使用的检测方法。

-

结识 AI 哨兵 – Unmesh Kurup:随着复杂的 LLM 日益普及,领导 Intuition Machines/hCaptcha 的 ML 团队的 Unmesh Kurup 将担任此次数字活动的主讲嘉宾,剖析用于区分机器人和人类交互的高级安全系统。该领域的工程师和专家可以免费注册,以从 Kurup 在 AI/ML 领域的丰富经验中获取见解。

LLM Perf Enthusiasts AI Discord 没有新消息。如果该频道长期沉寂,请告知我们,我们将予以移除。

Datasette - LLM (@SimonW) Discord 没有新消息。如果该频道长期沉寂,请告知我们,我们将予以移除。

DiscoResearch Discord 没有新消息。如果该频道长期沉寂,请告知我们,我们将予以移除。

AI21 Labs (Jamba) Discord 没有新消息。如果该频道长期沉寂,请告知我们,我们将予以移除。

YAIG (a16z Infra) Discord 没有新消息。如果该频道长期沉寂,请告知我们,我们将予以移除。

第二部分:按频道划分的详细摘要和链接

完整的各频道详细内容已在邮件中截断。

如果您喜欢 AInews,请分享给朋友!预先感谢!