ainews-gemma-2-the-open-model-for-everyone

Gemma 2:面向所有人的开放模型

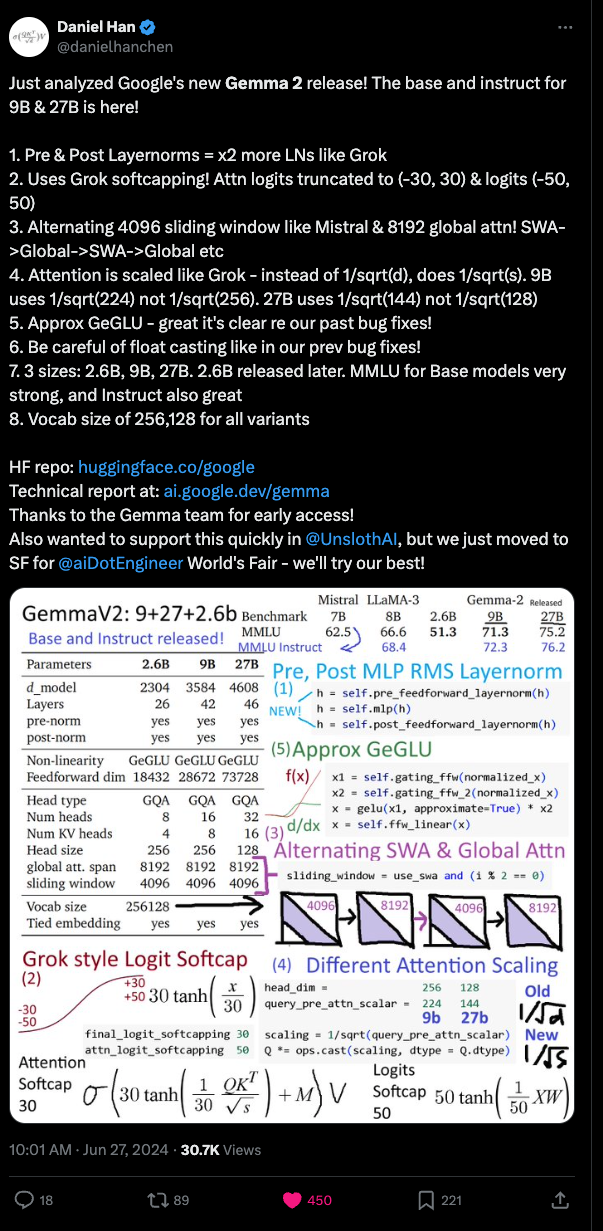

由 Google DeepMind 推出的 27B 参数模型 Gemma 2 正式发布。该模型引入了 1:1 局部-全局注意力交替(local-global attention alternation)和 Logit 软截断(logit soft-capping)等创新技术,并利用知识蒸馏(knowledge distillation)在超过计算最优(compute-optimal)Token 数量 50 倍的数据上对较小模型进行了训练。该模型支持多语言和多模态能力,并已在 200 多种印度语系变体上成功完成了微调。Open LLM 排行榜显示,阿里巴巴的 Qwen 72B 位居榜首,Mistral AI 的 Mixtral-8x22B-Instruct 同样名列前茅。Anthropic 推出了 Claude 3.5 Sonnet,在中端成本和速度下提升了智能水平。此外,关于在大语言模型(LLM)中消除矩阵乘法的研究有望在不损失性能的前提下显著节省内存。Kathleen Kenealy 和 Daniel Han 分别就 Gemma 2 的分词器(tokenizer)和注意力缩放(attention scaling)分享了见解。

Knowledge Distillation 是解决 Token 危机所需的一切吗?

2024/6/26-2024/6/27 的 AI 新闻。 我们为您检查了 7 个 subreddit、384 个 Twitter 和 30 个 Discord(416 个频道和 2698 条消息)。 预计节省阅读时间(按 200wpm 计算):317 分钟。您现在可以标记 @smol_ai 进行 AINews 讨论!

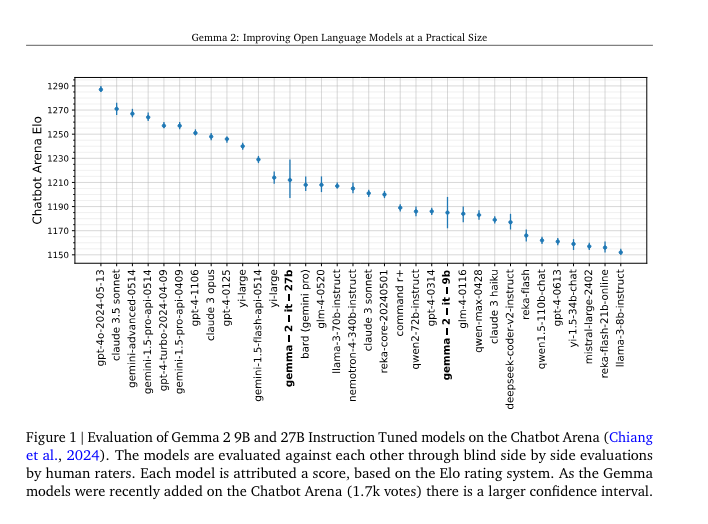

Gemma 2 发布了! 在 I/O 大会上进行了预览(我们的报告),现在正式发布了,包含了他们讨论过的 27B 模型,但奇怪的是没有 2B 模型。无论如何,就其规模而言,它当然很出色——在评估中低于 Phi-3,但在 LMSys 的评分中表现更好,仅次于 yi-large(后者也于周一在 World’s Fair Hackathon 上发布):

关于其驱动因素,我们有一些小提示:

- 局部注意力和全局注意力之间的 1:1 交替(类似于 Shazeer et al 2024)

- 参考 Gemini 1.5 和 Grok 的 Logit soft-capping

- GQA, Post/pre rmsnorm

但当然,数据才是关键问题;而这里的故事一直是 KD:

特别是,我们将精力集中在 Knowledge Distillation(Hinton 等人,2015 年)上,它将每个 token 处看到的 one-hot 向量替换为从大模型计算出的潜在下一个 token 的分布。

这种方法通常用于通过为较小模型提供更丰富的梯度来缩短其训练时间。在这项工作中,我们转而使用蒸馏技术对大量 token 进行训练,以模拟超出可用 token 数量的训练。具体来说,我们使用一个大型语言模型作为教师,在超过理论预测的计算最优数量(Hoffmann 等人,2022 年)50 倍以上的 token 量上训练小模型,即 9B 和 2.6B 模型。除了通过蒸馏训练的模型外,我们还发布了一个为这项工作从头开始训练的 27B 模型。

在她的 World’s Fair 关于 Gemma 2 的演讲中,Gemma 研究员 Kathleen Kenealy 还强调了 Gemini/Gemma 分词器(tokenizer):

“虽然 Gemma 主要在英语数据上进行训练,但 Gemini 模型是多模态且多语言的,这意味着 Gemma 模型非常容易适应不同的语言。我们看到的最喜欢的项目之一(在 I/O 大会上也有所强调)是一个印度研究团队对 Gemma 进行了微调,在 200 多种印度语言变体上实现了前所未有的 SOTA 性能。”

同为 World’s Fair 演讲者的 Daniel Han 也指出了只有在代码中才能发现的 attention-scaling:

AI Twitter 摘要回顾

所有摘要均由 Claude 3 Opus 完成,从 4 次运行中择优。我们正在使用 Haiku 进行聚类和流程工程(flow engineering)。

AI 模型与架构

- 新的 Open LLM Leaderboard 发布:@ClementDelangue 指出新的 Open LLM Leaderboard 评估了所有主要的开源 LLM,其中 Qwen 72B 位居榜首。之前的评估对于近期的模型来说变得过于简单,这表明 AI 开发者可能过于关注主要评估指标,而牺牲了模型在其他方面的性能。

- 阿里巴巴的 Qwen 模型主导 Open LLM Leaderboard:@clefourrier 强调 阿里巴巴的 Qwen 模型占据了前 10 名中的 4 个席位,拥有最佳的 instruct 和 base 模型。Mistral AI 的 Mixtral-8x22B-Instruct 位列第 4 名。

- Anthropic 发布 Claude 3.5 Sonnet:@dl_weekly 报道称 Anthropic 发布了 Claude 3.5 Sonnet,以其中端模型速度和成本,提升了智能水平的标准。

- 消除 LLM 中的矩阵乘法:@rohanpaul_ai 分享了一篇关于 ‘Scalable MatMul-free Language Modeling’ 的论文,该研究在保持十亿参数规模强劲性能的同时,消除了昂贵的矩阵乘法(matrix multiplications)。与未优化的模型相比,内存消耗可降低 10 倍以上。

- NV-Embed:改进将 LLM 训练为通用嵌入模型(embedding models)的技术:@rohanpaul_ai 重点介绍了 NVIDIA 的 NV-Embed 模型,该模型引入了新设计,例如让 LLM 关注潜在向量(latent vectors)以获得更好的池化嵌入输出,以及一种两阶段指令微调方法,以增强在检索和非检索任务上的准确性。

工具、框架与平台

- LangChain 在 LangSmith 中发布自改进评估器:@hwchase17 介绍了一项新的 LangSmith 功能,用于 从人类反馈中学习的自改进 LLM 评估器,灵感来自 @sh_reya 的工作。当用户审查和调整 AI 判断时,系统会将这些存储为 few-shot 示例,以自动改进未来的评估。

- Anthropic 启动 Build with Claude 竞赛:@alexalbert__ 宣布了一项 3 万美元的竞赛,鼓励通过 Anthropic API 使用 Claude 构建应用。提交的作品将根据创意、影响力、实用性和实现情况进行评审。

- Mozilla 发布新的 AI 产品:@swyx 指出 Mozilla 带着新的 AI 产品强势回归,暗示他们可能在浏览器之后成为“AI OS”。

- Meta 开放 Llama Impact Innovation Awards 申请:@AIatMeta 宣布开放 Meta Llama Impact Innovation Awards 的申请,以表彰在各地区使用 Llama 产生社会影响的组织。

- Hugging Face Tasksource-DPO-pairs 数据集发布:@rohanpaul_ai 分享了 Hugging Face 上 Tasksource-DPO-pairs 数据集的发布,其中包含 600 万个经过人工标注或人工验证的 DPO 对,涵盖了许多之前集合中未包含的数据集。

迷因与幽默

- @svpino 调侃了他们期待 AI 取代的事物,包括 Jira、Scrum、软件估算、“Velocity”暴行、非技术背景的软件经理、Stack Overflow 以及“10 个你不想错过的疯狂 AI 演示”。

- @nearcyan 对日本麦当劳的“薯条小说”(ポテト小説。。。😋)发表了幽默评论。

- @AravSrinivas 分享了一个关于 “Perplexity 在 Figma config 2024,由设计负责人 @henrymodis 演讲” 的迷因。

AI Reddit 回顾

涵盖 r/LocalLlama, r/machinelearning, r/openai, r/stablediffusion, r/ArtificialInteligence, /r/LLMDevs, /r/Singularity。评论抓取功能现已上线,但仍有很大改进空间!

AI 进展与能力

-

低功耗 LLMs:研究人员开发出一种高性能大语言模型,其运行所需的能量仅相当于一个灯泡。这是通过在 LLM 中消除矩阵乘法实现的,颠覆了 AI 的现状。

-

AI 自我意识辩论:Claude 3.5 通过了镜像测试,这是一项经典的动物自我意识测试,引发了关于这是否真实展示了 AI 自我意识的辩论。另一篇关于同一话题的帖子中,评论者对这是否代表真正的自我意识持怀疑态度。

-

AI 表现优于人类:在一项现实世界的“图灵测试”案例研究中,AI 在 83.4% 的情况下表现优于大学生,且 94% 的 AI 提交内容未被检测出非人类创作。然而,根据 Hugging Face 归一化得分,人类在 MuSR 基准测试中仍然优于 LLM。

-

模型进展迅速:过去 16 个月 LLaMA 模型家族的时间线展示了正在取得的飞速进展。Gemma V2 模型在 Lmsys arena 的测试根据以往模式暗示即将发布。对 llama.cpp bitnet 的持续改进也在进行中。

-

对当前 LLM 智能的怀疑:尽管取得了进展,Google AI 研究员 Francois Chollet 在最近的播客中认为当前的 LLM 几乎没有智能,并且是通往 AGI 道路上的一个“出口”。一张《人工智能的神话》(The Myth of Artificial Intelligence)书籍的照片引发了关于 AI 现状的讨论。

迷因与幽默

-

AI 的挣扎与怪癖:迷因嘲讽了 AI 的怪癖,例如一个 AI 模型难以生成一张连贯的图像(女孩躺在草地上),以及冗长的 AI 输出。一个迷因开玩笑说与 AI 进行了最有意义的对话。

-

调侃公司、人物和趋势:迷因幽默地抨击了 Anthropic、特定的 Reddit 板块以及人们对 AI 谨慎的乐观态度。一首诗幽默地赞美了“机器之神”。

其他 AI 与技术新闻

-

AI 版权问题:主要音乐厂牌 Sony, Universal 和 Warner 正在起诉 AI 音乐初创公司 Suno 和 Udio 侵犯版权。

-

AI 新功能:OpenAI 已确认语音模式将从 7 月底开始为其模型推出。一位 Redditor 简要地展示了访问 GPT-4o 实时语音模式的过程。

-

图像生成进展:推出了一种名为 AuraSR(基于 GigaGAN) 的新型开源超分辨率放大器。ResMaster 方法允许扩散模型生成超出其训练分辨率限制的高分辨率图像。

-

生物技术突破:两篇关于“桥接编辑”(bridge editing)的 Nature 论文引发了关注,这是一种新的基因组工程技术。还宣布了一种实现可编程基因组设计的新机制。

-

硬件开发:一位开发者令人印象深刻地以个人之力为 BitNet LLM 设计了他们自己的微型 ASIC。

AI Discord 回顾

摘要之摘要的摘要

Claude 3.5 Sonnet

-

Google 的 Gemma 2 引起轰动:

-

Gemma 2 亮相:Google 在 Kaggle 上发布了 Gemma 2,包含 9B 和 27B 两种尺寸,具有 sliding window attention 和 soft-capping logits 特性。据报道,27B 版本接近 Llama 3 70B 的性能。

-

-

Meta 发布 LLM Compiler:

- 面向代码任务的新模型:Meta 推出了基于 Meta Code Llama 构建的 LLM Compiler 模型,专注于代码优化和编译器能力。这些模型在宽松的许可证下提供,可用于研究和商业用途。

-

基准测试与排行榜讨论:

- 出人意料的排名:Open LLM Leaderboard 上出现了一些知名度较低的模型(如 Yi)名列前茅的情况,引发了多个 Discord 社区关于基准测试饱和以及评估指标的讨论。

-

AI 开发框架与工具:

-

LlamaIndex 的 Multi-Agent 框架:LlamaIndex 宣布推出 llama-agents,这是一个用于在生产环境中部署 Multi-Agent AI 系统的新框架,具有分布式架构和 HTTP API 通信功能。

-

Figma AI 免费试用:Figma AI 提供一年的免费试用,允许用户在无需立即付费的情况下探索 AI 驱动的设计工具。

-

-

AI 开发的硬件争论:

-

GPU 对比:Discord 服务器上的讨论对比了拥有 48GB VRAM 的 NVIDIA A6000 GPU 与使用多块 RTX 3090 配置的优劣,考虑了 NVLink 连接性和性价比等因素。

-

散热挑战:多个社区的用户分享了高功率 GPU 配置的散热经验,报告称即使使用了大量的散热解决方案,仍存在散热问题。

-

-

伦理与法律考量:

-

对 AI 生成内容的担忧:一篇关于 Perplexity AI 引用 AI 生成来源的文章,引发了不同 Discord 服务器上关于信息可靠性和归属权的讨论。

-

数据排除的伦理:多个社区辩论了从 AI 训练中排除某些数据类型(例如与儿童相关的)以防止滥用的伦理问题,并与模型多样性和能力的需求之间进行了权衡。

-

Claude 3 Opus

1. LLM 性能与能力的进展

-

Google 的 Gemma 2 模型(9B 和 27B)已发布,展示了与 Meta 的 Llama 3 70B 等更大型模型相比的强劲性能。这些模型具有 sliding window attention 和 logit soft-capping 特性。

-

Meta 的 LLM Compiler 模型基于 Meta Code Llama 构建,专注于代码优化和编译器任务。这些模型在宽松的许可证下发布,可用于 研究和商业用途。

-

Stheno 8B 是来自 Sao10k 的创意写作和角色扮演模型,现已在 OpenRouter 上线,支持 32K context window。

2. 开源 AI 框架与社区努力

-

LlamaIndex 推出了 llama-agents,这是一个用于在生产环境中部署 multi-agent AI 系统的新框架,并为其全托管的 ingestion 服务 LlamaCloud 开启了候补名单。

-

Axolotl 项目遇到了 Transformers 代码影响 Gemma 2 样本打包 (sample packing) 的问题,引发了 pull request 以及关于 Hugging Face 典型 bug 的讨论。

-

Rig 是一个 用于构建 LLM 驱动应用程序的 Rust 库,现已发布并为开发者提供了激励性的反馈计划。

3. 优化 LLM 训练与推理

-

工程师们讨论了 infinigram ensemble 技术在提高 LLM 域外(OOD)检测方面的潜力,并引用了一篇关于 神经网络学习低阶矩 (low-order moments) 的论文。

-

新论文 中介绍了 SPARSEK Attention 机制,旨在通过稀疏选择机制克服 autoregressive Transformers 中的计算和内存限制。

-

Adam-mini 是一种声称性能与 AdamW 相当但内存占用显著降低的优化器,在一次 详细讨论 中被拿来与 NovoGrad 进行对比。

4. 多模态 AI 与生成模型创新

-

Character.AI 推出了 Character Calls,允许用户与 AI 角色进行语音通话,尽管该功能在性能和流畅度方面的评价褒贬不一。

-

Stability AI 的 Discord 机器人 Stable Artisan 集成了 Stable Diffusion 3、Stable Video Diffusion 和 Stable Image Core 等模型,用于 直接在 Discord 内进行媒体生成和编辑。

-

Reddit 帖子 中提到的 Phi 3 模型通过 WebGPU 将强大的 AI 聊天机器人带到了浏览器端。

GPT4O (gpt-4o-2024-05-13)

-

LLM 部署与训练优化:

-

AI 部署中的障碍让工程师感到沮丧:工程师们分享了在高效部署自定义模型方面面临的挑战,讨论集中在如何避免权重错误,以及如何使用 Koboldcpp 等工具为 RTX 4090 等硬件优化参数。

-

深入探讨 Flash Attention:成员们请求关于 Flash Attention 的教程,这是一种模型内存管理的高效技术,强调了对这种优化方式加深理解的需求。

-

-

基准测试与性能评估:

-

Yi 席卷 LLM 排行榜:Open LLM Leaderboard 引起了广泛关注,因为像 Yi 这样的模型出人意料地升至前列,促使工程师们重新评估其模型的性能。

-

Gemma 2 的反响褒贬不一:围绕 Gemma 2 的兴奋与怀疑并存——虽然一些人称赞其创新,但另一些人不确定它是否标志着重大飞跃。与现有模型的比较受到了 基准测试分析 的推动。

-

-

开源 AI 框架与工具:

-

LlamaIndex 推出 llama-agents:LlamaIndex 宣布了 llama-agents,这是一个旨在简化生产部署的多 Agent AI 框架;它包含分布式架构和 HTTP API 通信。

-

LangChain AI 讨论端点构建:工程师们分享了构建 LangChain 端点的示例,文档 展示了

load_qa_chain()的正确用法以及如何处理高并发请求。

-

-

AI 许可与伦理考量:

-

AI 训练伦理引发激烈辩论:LAION 的工程师们审议了伦理训练实践,辩论是否应排除与儿童相关的数据以防止滥用,同时平衡这对模型多样性和正常场景生成的影响。

-

对 AI 许可模式的怀疑:围绕通过 OpenRouter 提供的独占 Command-R 模型产生了法律和实际层面的担忧,探讨了潜在的许可滥用和合规执行问题。

-

-

前沿 AI 模型与创新:

-

杂项

-

Mojo 轻松编译并执行模型:社区成员讨论了 Mojo 语言的挑战,强调了对象标识和自引用类型问题,以及对详尽 GitHub 文档的需求。

-

大模型存储需求揭晓:在 Nous Research AI 中分享的见解讨论了运行 DeepCoder V2 等模型所需的硬件,指出高效运行需要大量的 RAM 和 VRAM。

-

第 1 部分:Discord 高层摘要

Unsloth AI (Daniel Han) Discord

Yi 登顶 LLM 排行榜:新的基准测试将像 Yi 这样此前知名度较低的模型排在了 LLM 排行榜中令人惊讶的高位,引起了 AI 社区的浓厚兴趣。

Gemma 2 的发布引发兴奋与质疑:Gemma 2 的发布激发了热情和好奇心,特别是围绕它与 Grok 的相似之处。值得注意的是,一篇剖析 Gemma 2 创新的推文成为了焦点,尽管一些用户质疑这些进步是否标志着相对于之前模型的重大飞跃。

AI 部署与训练中的障碍:讨论指出了部署自定义模型时的挑战和解决方案,重点在于避免权重错误。AI 工程师分享了关于使用 Ollama 保存和提供模型的见解,并建议针对 RTX 4090 等硬件进行优化的参数调整,提到了 Koboldcpp 等特定工具。

AI World’s Fair 前夕讨论的 Bug 与支持:Unsloth AI 团队正准备参加 AI World’s Fair,计划讨论开源模型问题以及新加入的 @ollama 支持,正如在这条推文中所宣布的那样。

针对 ChatGPT 的激烈讨论:ChatGPT 成为一个有争议的话题,一些社区成员称其“简直是彻头彻尾的垃圾”,而另一些人则承认了它在铺平 AI 道路方面的作用,尽管 ChatGPT 3.5 存在准确性问题。此外,人们还幽默地感叹了 AI 硬件过热的问题。

HuggingFace Discord

多模态 RAG 即将到来:围绕一篇多模态 RAG 文章的开发展开了兴奋的讨论,期待能有突破性的成果;然而,文中并未讨论模型或结果等具体细节。

实体提取工具评估:技术讨论确定了 BERT 在 NER 方面的缺点,成员们建议使用 GLiNER 和 NuExtract 等替代方案,这些方案因在提取非预定义实体方面的灵活性而受到推崇,并指向了 ZeroGPU Spaces 等社区资源。

对 Sohu AI 芯片持怀疑态度:社区对 Sohu 新型 AI 芯片声称的性能持谨慎怀疑态度,成员们考虑在 Sohu 广告宣传的服务上进行实验,尽管目前还没有人分享直接的使用经验。

高效的动态 Diffusion 交付:成员们热烈交流了增强 Stable Diffusion 模型性能的策略,特别是包括 “torch compile” 以及利用 Accelerate 和 stable-fast 等库来缩短推理时间。

对 AI 排行榜的反思:Open LLM Leaderboard 博客引发了对 AI 基准测试饱和的担忧,反映了社区对持续改进和新基准测试的驱动力。

OpenAI Discord

GPT 兄弟之争:CriticGPT 出现并用于修复 GPT-4 代码中的 Bug,它被集成到 OpenAI 的 RLHF 流水线中以增强 AI 监督,官方公告详情。

Claude vs. GPT-4o - 上下文窗口大对决:Claude 3.5 Sonnet 因其编程能力和广阔的上下文窗口而受到赞誉,使 GPT-4o 显得逊色,一些人声称后者缺乏真正的全模态(omnimodal)能力且面临响应速度慢的问题。

超越传统的文本聊天:创新者利用 3.5 Sonnet API 和 ElevenLabs API 来驱动实时对话,挑战了在某些场景下使用 ChatGPT 的必要性。

Prompt Engineering 的难题与陷阱:用户交流了 Few-shot Prompting 和 Prompt 压缩的方法,关注于使用 YAML/XML 结构化 Prompt 以提高精确度,并尝试使用“Unicode 符号学”来创建 Token 高效的 Prompt。

探索 API 迷宫:讨论集中在计算 Prompt 成本、寻找模型训练的知识库示例、使用 GPT 创建 GIF 的挑战、已弃用插件的替代方案,以及 API 在处理某些文字游戏时的吃力表现。

CUDA MODE Discord

-

Tensor Cores 倾向于 Transformers:工程师们注意到,虽然 GPU 上的 tensor cores 是通用的,但它们有一种更“专用于 transformers”的趋势。成员们对此表示赞同,并讨论了 tensor cores 在特定架构之外的广泛适用性。

-

深入探讨 Flash Attention:有人寻求关于 Flash Attention 的教程,这是一种在模型中实现快速且内存高效的 attention 的技术。分享了一篇文章以帮助成员更好地理解这种优化。

-

Triton 中的幂函数(Power Functions):关于 Triton 语言的讨论集中在实现 pow functions 上,最终使用

libdevice.pow()作为权宜之计。建议检查 Triton 是否为 pow 实现生成了最优的 PTX 代码,以确保性能效率。 -

PyTorch 优化解析:新的 TorchAO 0.3.0 版本 凭借其 quantize API 和 FP6 dtype 引起了关注,旨在为 PyTorch 用户提供更好的优化选项。同时,澄清了

choose_qparams_affine()函数的行为,并鼓励社区贡献以加强平台。 -

稀疏性(Sparsity)提升训练速度:在 xFormers 的项目中使用 2:4 稀疏性集成,使得推理速度提升了 10%,训练速度提升了 1.3 倍,这在 NVIDIA A100 上针对 DINOv2 ViT-L 等模型得到了验证。

Eleuther Discord

-

Infinigram 与低阶动量:讨论强调了使用 infinigram ensemble 技术来增强 LLMs 的分布外(OOD)检测的潜力,引用了《神经网络学习日益复杂的统计数据》论文,并考虑在神经 LM 训练中集成 n-gram 或 bag of words。

-

Attention 效率革命:提出了一种新的 SPARSEK Attention 机制,承诺具有线性时间复杂度的更精简计算需求,详见这篇论文;同时,根据另一项最新研究,Adam-mini 被宣传为 AdamW 的一种内存高效替代方案。

-

论文、优化器与 Transformers:研究人员辩论了 Transformers 的最佳层排序,引用了多篇 arXiv 论文,并分享了关于流形假设检验(manifold hypothesis testing)的见解,尽管后者没有提到具体的代码资源。

-

Mozilla 的本地 AI 计划:更新了 Mozilla 关于本地 AI 资助呼吁的消息,并通过快速在线搜索解决了 Discord 邀请链接过期的问题。

-

重构神经元的舞动:利用 Zipf 定律和 Monte Carlo 方法直接在神经元排列分布上进行训练,具有潜在的效率提升,这为观察神经元权重排序提供了一种新颖视角。

LAION Discord

-

GPU 对决:A6000 vs. 3090s:工程师们对比了 拥有 48GB VRAM 的 NVIDIA A6000 GPU 与 四路 3090 配置。他们指出 A6000 的 NVLink 可以实现 96GB 的合并 VRAM,而一些人则因价格和多 GPU 配置下的性能而更青睐 3090。

-

高性价比 GPU 选择:讨论了预算型 GPU,建议将 认证翻新的 P40 和 K80 作为处理大型模型的切入方案,指出这比 3090 等高端 GPU 能节省大量成本。

-

专用 AI 芯片的局限性:Etched 开发的 Sohu 芯片 因其过于专注于 Transformer 而受到批评,引发了对其适应性的担忧;同时,Nvidia 即将推出的 Transformer 核心被视为潜在的竞争对手。

-

AI 训练伦理与数据范围:关于是否应在 AI 训练中排除儿童相关数据以防止滥用,展开了激烈的辩论。一些人担心此类排除可能会降低模型的多样性,并阻碍生成家庭场景等非 NSFW 内容的能力。

-

NSFW 数据在基础 AI 中的作用:NSFW 数据对于基础 AI 模型的必要性受到质疑,结论是它对于预训练并非至关重要,后期训练可以使模型适应特定任务,但在如何伦理地管理这些数据方面存在不同意见。

-

AIW+ 问题复杂性解析:探讨了解决 AIW+ 问题的挑战(与常识性 AIW 相比),计算堂表亲等家庭关系的复杂性以及细微的可能性导致结论认为,此事仍存在模糊性。

Nous Research AI Discord

-

寻求 AI 模型的内存预测公式:工程师们正在寻找一种可靠的方法,根据 Context Window Size 来预测模型的内存占用,并考虑了 GGUF 元数据 以及不同模型在 Attention 机制上的差异。有人提议通过经验测试来进行准确测量,但对现有公式的包容性仍持怀疑态度。

-

Chat GPT API 前端展示:社区分享了新的 GPT API 前端,包括 Teknium 的 Prompt-Engineering-Toolkit 和 FreeAIChatbot.org,同时也表达了对使用 Big-AGI 等平台的安全担忧。此外还讨论了 LibreChat 和 HuggingChat 等替代方案的使用。

-

Meta 和 JinaAI 提升 LLM 能力:Meta 新推出的模型优化了编译器优化中的代码大小,JinaAI 的 PE-Rank 降低了重排序(Reranking)延迟,这些都表明了技术的快速进步,部分模型现已在宽松的许可证下发布,可用于实际研究和开发。

-

AI 模型中的布尔值混淆:强调了 JSON 格式化问题,其中 Hermes Pro 返回了

True而不是true,引发了关于数据集完整性以及训练合并(Training Merges)对不同 AI 模型中布尔值有效性潜在影响的辩论。 -

RAG 数据集扩展:Glaive-RAG-v1 数据集 的发布标志着向针对特定用例微调模型迈进。用户讨论了 Hermes RAG 的格式适应性,并考虑在新的领域生成数据以增强数据集多样性,目标理想规模为 5k-20k 个样本。

Stability.ai (Stable Diffusion) Discord

- MacBook Air:是否能胜任 AI 工作?:成员们正在辩论配备 6GB 或 8GB RAM 的 MacBook Air 是否适合 AI 任务,并指出对于 Apple 硬件在此类应用中的性能尚未达成共识。

- LoRA 训练技术探讨:为了获得更好的 LoRA 模型性能,改变 Batch Size 和 Epoch 是关键;一位成员举例说明,通过 16 Batch Size 和 200 Epoch 的组合,可以在减少细节的同时获得良好的轮廓。

- Stable Diffusion 许可困扰:SD3 和 Civitai 模型的许可困境依然存在;成员们讨论了在当前 SD3 许可下禁止此类模型的情况,特别是在 Civit 等商业项目中的应用。

- Kaggle:研究者的 GPU 避风港:Kaggle 正在提供两个具有 32GB VRAM 的 T4 GPU,有利于模型训练;GitHub 上一个有用的 Stable Diffusion Web UI Notebook 已被分享。

- 拯救频道:对过去的诉求:AI 社区成员表达了恢复充满生成式 AI 讨论的存档频道的愿望,他们非常看重这些频道所提供的专业对话深度和战友情谊。

Modular (Mojo 🔥) Discord

-

图表库权衡导航:工程师们就最优图表库展开了激烈辩论,考虑了静态与交互式图表、原生与浏览器渲染以及数据输入格式;讨论集中在确定图表库的核心需求上。

-

使用 Docker 进行创意容器化:针对 Mojo nightly 构建的 Docker 容器引发了对话,社区成员交换了技巧和修正建议,例如使用

modular install nightly/mojo进行安装。此外还宣传了即将举行的 Mojo 社区会议,并提供了视频会议链接。 -

关于 Mojo 语言挑战的见解:Mojo 讨论中的话题强调了在 GitHub 上报告问题的必要性,解决了来自 Mojo 与 Rust 博客对比中关于对象标识(object identity)的问题,并观察到 Mojo 运行时意外的网络活动,促使建议开启 GitHub issue 以进行进一步调查。

-

Tensor 动荡与 Changelog 澄清:Mojo 编译器的 nightly 构建版本

2024.6.2705引入了重大变化,例如重新定位了tensor模块,引发了关于代码依赖影响的讨论。参与者呼吁提供更明确的 changelog,从而得到了改进文档的承诺。 -

关于心灵与机器的哲学思考:AI 频道的一条独立消息提出了人类心灵的二元性概念,将其分为代表创意部分的“魔法”和代表神经网络方面的“认知”,认为智能驱动行为,而行为在与现实世界交互前会经过认知过程的路由。

Perplexity AI Discord

Perplexity API:故障排除还是令人困惑?:用户在调用 Perplexity AI 的 API 时遇到了 5xx 和 401 错误,引发了关于需要 status page(状态页)和身份验证故障排除的讨论。

Perplexity 功能愿望清单:爱好者们剖析了 Perplexity AI 当前的功能,如图像解读,并建议增加 artifact implementation 以更好地管理文件。

顶级 AI 对比:社区分析并对比了各种 AI 模型,特别是 GPT-4 Turbo、GPT-4o 和 Claude 3.5 Sonnet;大家表达了各自的偏好,但未达成共识。

Perplexity 的相关性搜索:分享的 Perplexity AI 页面 显示了对从心理健康到最新操作系统(如 Android 14 的性能提升)等各种话题的兴趣。

处于新闻伦理风口浪尖的 AI:一篇文章批评 Perplexity 越来越多地引用 AI 生成的内容,引发了关于 AI 生成来源的可靠性和隐私的讨论。

Latent Space Discord

趁热领取 Figma AI:Figma AI 目前免费提供一年,由 @AustinTByrd 分享;详情可见 Config2024 讨论串。

AI Engineer World Fair 的烦恼:成员们提到了在 AI Engineer World Fair 活动期间遇到的技术困难,从音频问题到屏幕共享不等,并建议通过退出舞台并重新加入等策略来解决问题。

LangGraph Cloud 正式起飞:LangChainAI 发布了 LangGraph Cloud,这是一项为弹性 Agent 提供强大基础设施的新服务,但一些工程师质疑此类 Agent 是否需要专门的基础设施。

会议内容关注:AI Engineer YouTube 频道 是观看 AI Engineer World Fair 直播和回顾的首选,包含面向 AI 爱好者的关键研讨会和技术讨论,会议转录内容可在 Compass 转录网站上找到。

Bee 带来的可穿戴设备更新:可穿戴技术讨论包括了像 Bee.computer 这样的创新产品,它可以执行记录和转录等任务,甚至提供 Apple Watch 应用,预示着流线型、多功能设备的发展趋势。

LM Studio Discord

LM Studio 缺乏关键功能:LM Studio 被指出缺乏对基于文档的训练或 RAG 能力的支持,这强调了社区内对“训练 (train)”一词普遍存在的误解。

代码模型蓄势待发:Claude 3.5 Sonnet 在 Poe 和 Anthropic 框架中的代码辅助表现受到称赞,同时人们对 LM Studio 和 llama.cpp 即将支持 Gemma 2 充满期待。

硬件依赖性凸显:用户讨论了在具有高 RAM 配置的设备上运行 DeepCoder V2 的良好性能,但指出由于内存限制,在 M2 Ultra Mac Studio 上会出现崩溃。此外,服务器冷却和 LM Studio 的 AVX2 处理器要求也是硬件相关讨论的话题。

内存瓶颈与修复:成员们分享了在 LM Studio 中加载模型时遇到 VRAM 限制的经验,并提供了诸如禁用 GPU offload 和升级到更高 VRAM 的 GPU 以获得更好支持等建议。

新兴 AI 工具与技术:关于 Meta 的新 LLM Compiler 模型 以及将 Mamba-2 集成到 llama.cpp 的讨论非常热烈,展示了 AI 工具和技术在效率和优化方面的进展。

LangChain AI Discord

无法在 Python 中直接打印流 (Streams):一位用户强调,你不能在 Python 中直接打印流对象,并提供了一个显示正确方法的代码片段:遍历流并打印每个 token 的内容。

正确使用 LangChain 处理相关的用户查询:讨论了如何使用 LangChain 提高用户查询中的向量相关性,潜在的解决方案包括在聊天记录中保留之前的检索结果,以及使用 query_knowledge_base("Green light printer problem") 函数。

将 LangChain 与 FastAPI 集成并增强检索:社区成员分享了关于使用 FastAPI 中的 add_routes 构建 LangChain 端点的文档和示例,以及优化使用 load_qa_chain() 进行服务器端文档提供的经验。

LangChain Expression Language 的尖端特性:提供了对 LangChain Expression Language (LCEL) 的见解,强调了异步支持、流式传输、并行执行和重试机制,指出需要全面的文档才能完全理解。

LangChain 的新工具和案例研究:值得注意的提到包括引入了 Merlinn(一个用于排查生产事故的 AI 机器人)、一个 ML 系统设计案例研究的 Airtable,以及通过 ZenGuard AI 将安全功能集成到 LangChain 中。还重点介绍了一个 YouTube 教程,展示了如何使用 Visual LangChain 创建无代码 Chrome 扩展聊天机器人。

LlamaIndex Discord

-

LlamaIndex 的新 AI 战士:LlamaIndex 宣布推出 llama-agents,这是一个新的多 Agent AI 框架,主打分布式架构和 HTTP API 通信。新兴的 LlamaCloud 服务已开始为寻求全托管摄取服务的用户开放候补名单注册。

-

LlamaIndex 的 JsonGate:工程师们就 LlamaIndex 默认 Readers 映射中排除 JSONReader 一事展开了激烈辩论,最终以提交添加它的 pull request 告终。

-

当 AI 想象力过剩时:LlamaParse 因其在处理财务文档方面的卓越表现而受到关注,但也因产生幻觉数据而受到审查,这促使官方请求提交文档以进行调试和改进模型。

-

BM25 的重新索引困境:用户讨论指出,在集成新文档时,BM25 算法需要频繁重新索引,效率较低,因此建议采用替代的稀疏嵌入 (sparse embedding) 方法并关注优化。

-

摄取管道 (Ingestion Pipeline) 变慢:在 LlamaIndex 的摄取管道中处理大型文档时出现了性能下降,对此提出了一个很有前景的批量节点删除方案以减轻负载。

Interconnects (Nathan Lambert) Discord

-

API 收入超过 Azure 销售额:OpenAI 的 API 收入现已超过微软在 Azure 上对其进行的转售收入,正如 Aaron P. Holmes 揭示的一项重大市场转变。详情见 Aaron 的推文。

-

Meta 的新编译器工具:发布了 Meta Large Language Model Compiler,旨在通过基础模型改进编译器优化,该模型处理来自 5460 亿 token 海量语料库的 LLVM-IR 和汇编代码。该工具的介绍和研究可以在 Meta 的出版物中探索。

-

Character Calls - AI 电话功能:Character.AI 推出了 Character Calls,这是一项支持与 AI 角色进行语音交互的新功能。虽然旨在提升用户体验,但首次亮相收到的反馈褒贬不一,详见 Character.AI 的博客文章。

-

编程面试困境:工程师们分享了对极具挑战性的面试问题和不明确预期的烦恼,以及一个有趣的案例,涉及 AndrewCurran 在 Twitter 上提到的关于声称在 ChatGPT 中获得了带有音效的高级语音功能的说法。

-

专利论述 - 创新还是抑制?:社区辩论了专利技术的含义,从 Chain of Thought 提示策略到 Google 未强制执行的 Transformer 架构专利,引发了关于科技领域专利性及法律复杂性的讨论。参考资料包括 Andrew White 关于提示专利的推文。

OpenRouter (Alex Atallah) Discord

-

Stheno 8B 在 OpenRouter 上备受关注:OpenRouter 推出了由 Sao10k 开发的 Stheno 8B 32K 作为当前特色模型,为 2023-2024 年提供具有 32K 上下文窗口的创意写作和角色扮演新能力。

-

选择 NVIDIA Nemotron 的技术故障:用户在不同设备上选择 NVIDIA Nemotron 时遇到了不稳定的情况,一些人报告“页面无法工作”错误,而另一些人则体验顺畅。

-

API Key 兼容性查询与无审查 AI 模型讨论:工程师们探讨了 OpenRouter API keys 与期望 OpenAI keys 的应用程序的兼容性,并深入研究了无审查 AI 模型的替代方案,包括 Cmd-r、Euryale 2.1 以及即将推出的 Magnum。

-

Google Gemini API 提供 2M Token 窗口:开发者们欢迎 Gemini 1.5 Pro 的消息,它现在提供巨大的 200 万 token 上下文窗口和代码执行能力,旨在优化输入成本管理。

-

在 OpenRouter 中寻求 Anthropic Artifacts 的替代方案:用户对 Anthropic 的 Artifacts 功能感到好奇,引发了关于 Sonnet-3.5 是否有潜力在 OpenRouter 中通过典型的 prompt 方法提供类似代码生成能力的讨论。

Cohere Discord

创新 API 策略:使用 Cohere API,OpenRouter 可以在不违反许可协议的情况下进行非商业用途;社区确认 API 的使用规避了非商业限制。

Command-R 模型引发独占热议:以其先进的指令遵循能力而闻名的 Command-R 模型,目前仅通过 OpenRouter 向 ‘I’m All In’ 订阅者开放,引发了围绕模型可访问性和许可的讨论。

险些陷入的许可陷阱:关于 SpicyChat 可能滥用 Command-R 许可的辩论随之展开,但成员们得出结论,向 Cohere 支付费用应该可以解决任何许可问题。

技术故障排除成功:一位成员在参考了官方 Cohere 多步工具文档后,解决了 Colab 和 PyCharm 上的 Cohere API 脚本错误。

Rust 库发布及奖励计划:Rig,一个旨在构建 LLM 驱动应用程序的新 Rust 库正式发布,同时推出的还有反馈计划,奖励开发者的贡献和想法,并特别提到其与 Cohere 模型的兼容性。

OpenInterpreter Discord

-

解码神经网络:工程师可以参加在旧金山 Block’s Mission 办公室举办的为期 4周 的免费学习小组,重点研究基于 Andrej Karpathy 系列课程的神经网络。通过此 Google Form 报名;更多详情请见 活动页面。

-

开源模型吸引 Interpreter 爱好者:Discord 社区讨论了最适合本地部署的开源模型,特别是 GPT-4o。讨论内容包括在 Ollama 或 Groq 硬件支持下的潜在用途。

-

GitHub 政策合规对话:成员们对一个可能与 GitHub 政策冲突的项目表示担忧,强调了在采取 DMCA 通知等正式行动之前进行公开对话的重要性。

-

Meta 推进 LLM Compiler:Meta 基于 Meta Code Llama 构建的新型 LLM Compiler 旨在优化和反汇编代码。详情可见 研究论文 和相应的 HuggingFace 仓库。

-

O1 的变化:最新版本的 O1 不再包含

--local选项,社区正在寻求关于可用模型以及在不同语言(如西班牙语)中使用订阅实用性的明确说明。

OpenAccess AI Collective (axolotl) Discord

-

调试警示:NCCL Watchdog 遭遇 CUDA 错误:工程师指出遇到了涉及 NCCL watchdog 线程终止 的 CUDA error,并建议启用

CUDA_LAUNCH_BLOCKING=1进行调试,并使用TORCH_USE_CUDA_DSA进行编译以激活设备端断言。 -

Gemma2 备受关注,Google 表现出色:社区正在评估 Google 的 Gemma 2(9B 和 27B 版本),该模型实现了滑动窗口注意力(sliding window attention)和软截断 Logits(soft-capped logits)等特性,其评分与 Meta 的 Llama 3 70B 相当。虽然 Gemma2:9B 模型在一次 早期测试 中获得了积极反馈,但 Gemma2:27B 在初始测试中表现令人失望,正如 另一个视频 中所讨论的。

-

Meta 发布 LLM Compiler:Meta 宣布 了其基于 Meta Code Llama 的 LLM Compiler 模型,专为代码优化和编译器任务设计,因其宽松的许可和据报道的最先进结果而引起了关注。

-

Gemma2 对阵 Transformers:第一轮较量:影响 Gemma 2 样本打包(sample packing)的 Transformers 代码技术问题浮出水面,建议通过一个 pull request 进行修复,并等待 Hugging Face 团队 的上游修复。

-

跟我重复,Mistral7B:据报道,Mistral7B 在全量指令微调(full instruction-tuning)期间出现了重复句子或段落的运行异常;鉴于训练数据集中不存在此类模式,该问题令人困惑。

tinygrad (George Hotz) Discord

PyTorch 的崛起被拍成电影:分享了一部 官方 PyTorch 纪录片,记录了 PyTorch 的开发历程及其成功背后的工程师们,为 AI 爱好者和专业人士提供了深入见解。

通用的 Transformer FPGA 设计:一位频道成员澄清说,他们的 FPGA 设计不针对特定品牌,可以随时 加载 Huggingface 库中的任何 Transformer 模型,这对于那些正在评估模型部署硬件选项的人来说是一个值得注意的进展。

tinygrad 的迭代改进:将 SDXL 与 tinygrad 集成的工作正在取得进展,一位贡献者计划在开启 pull request 之前优化功能和性能,这是协作者们关注的焦点。

Hotz 参加演讲活动:George Hotz 预定进行一次 8 分钟的演讲,具体细节尚未披露,他的追随者或潜在协作者可能会对此感兴趣。

tinygrad 征集代码优化器:宣布了一项 500 美元的现金奖励,用于提升 tinygrad 匹配引擎的速度,这是对开发者参与贡献并协作提高项目效率的公开邀请。

深入探讨 tinygrad 内部机制:讨论内容包括请求将 PyTorch 的 MultiheadAttention 移植到 tinygrad 的示例、通过创建 NOOP backend 来估算模型训练的 VRAM 需求策略,以及参考 tinygrad-notes 对 Shapetracker 高效数据表示能力的解释。这些技术交流对于那些寻求理解或贡献于 tinygrad 内部运作的人至关重要。

LLM Finetuning (Hamel + Dan) Discord

-

Anthropic 宣布 Build-With-Claude 竞赛:重点介绍了围绕 Claude 构建应用程序的竞赛,并引用了 竞赛详情。

-

LLM 求职信生成查询:成员们讨论了如何微调 语言模型 以根据简历和职位描述生成求职信,并寻求关于使用测试数据有效衡量模型性能的建议。

-

通过 LLM 模仿社交媒体风格:有人正在创建一个机器人,使用 Flask 和 Tweepy 进行 Twitter API 交互,以其独特的风格回答查询,并正在寻求关于使用其推文训练模型的指导。

-

Cursor 在学生中获得青睐:关于使用 OpenAI 的 Cursor 还是 Copilot 的辩论和建议不断涌现,包括在 Cursor 中集成 Copilot 的新颖想法,并提供了 在 Cursor 中安装 VSCode 扩展的指南。

-

额度分配与协作协助:用户请求有关账户 额度分配 的协助和更新,这暗示了持续的社区支持动态,但未提供具体细节。

PART 2: 频道详细摘要与链接

完整的逐频道细分内容已针对电子邮件进行了截断。

如果您喜欢 AInews,请分享给朋友!提前感谢!