ainews-to-be-named-5628

RouteLLM:RIP Martian?(外加:AINews 结构化摘要更新)

LMSys 推出了 RouteLLM,这是一个基于 Chatbot Arena 偏好数据训练的开源路由框架。在保持 GPT-4 95% 性能的同时,它在 MT Bench 上实现了超过 85% 的成本降低,在 MMLU 上降低了 45%,在 GSM8K 上则降低了 35%。

该方法通过使用基于语法的混合专家(MoE)路由和数据增强,超越了以往针对特定任务的路由方案,表现优于商业解决方案 40%。此次更新突显了 LLM 路由、成本效益以及跨多模型性能优化(而非仅限于单一模型或 MoE 级别的改进)方面的进展。

此外,AI Twitter 摘要还提到:Gemma 2 模型系列被视为顶级的开源模型;Block Transformer 架构可提升推理吞吐量;以及 karpathy 提出的构建全“软件 2.0”计算机视觉系统的方案。

LLM Preference data is all you need.

2024年6月28日至7月1日的 AI 新闻。 我们为您检查了 7 个 subreddits、384 个 Twitters 和 30 个 Discords(419 个频道和 6896 条消息)。 预计节省阅读时间(以 200wpm 计算):746 分钟。您现在可以标记 @smol_ai 进行 AINews 讨论!

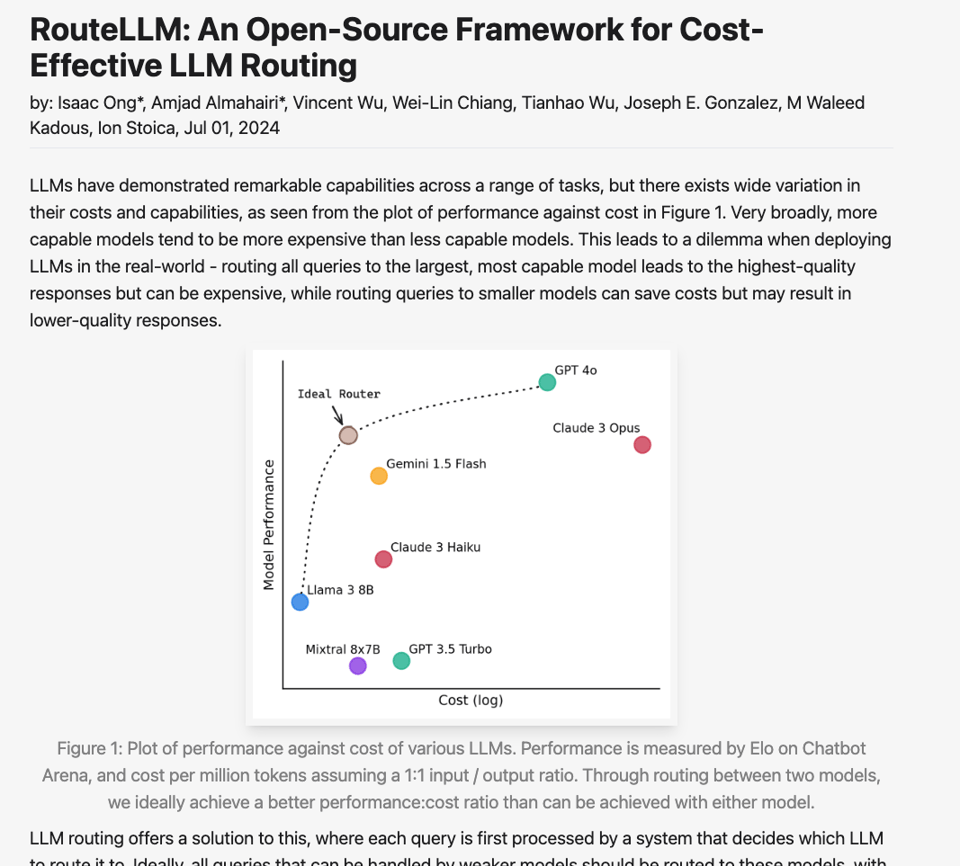

还记得 4 月份的 Mistral Convex Hull,以及 5 月份 DeepSeekV2 的胜利吗?成本与性能的有效边界再次被推高,但这次不是在单模型或 MoE 层面,而是在所有模型之间:

值得注意的核心特性是这句话:我们利用来自 Chatbot Arena 的公开数据训练了四种不同的 router,并证明它们可以在不降低质量的情况下显著降低成本。与仅使用 GPT-4 相比,在 MT Bench 上成本降低了 85% 以上,在 MMLU 上降低了 45%,在 GSM8K 上降低了 35%,同时仍能达到 GPT-4 性能的 95%。

LLM routing 的想法并不新鲜;model-router 是 2023 年初“Woodstock of AI”聚会上的一个特色项目,随后凭借该概念筹集了 900 万美元的可观种子轮融资。然而,这些 routing 解决方案是基于特定任务(task-specific)的 routing,即不同模型擅长不同任务的概念,这与基于语法(syntax-based)的 MoE routing 形成鲜明对比。

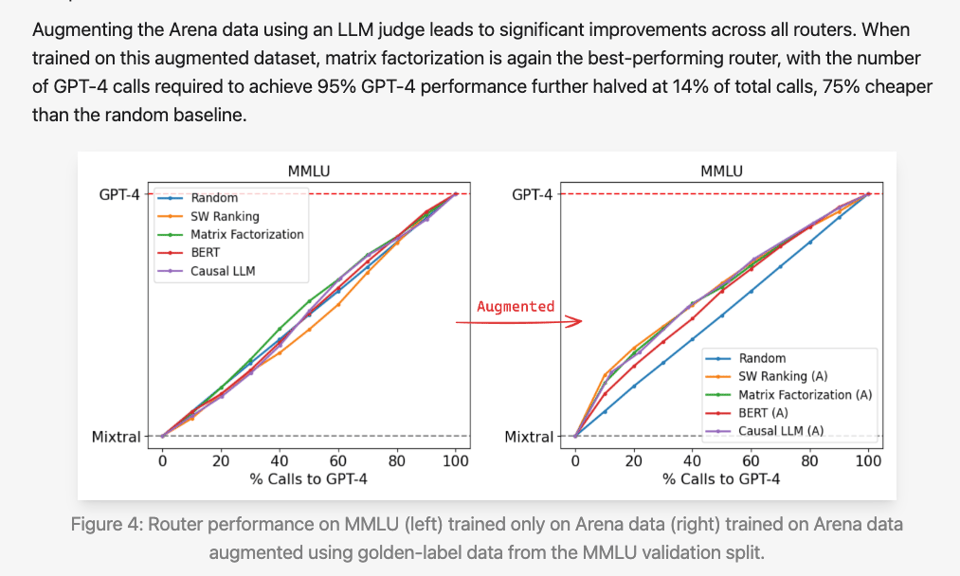

LMSys 的新型开源 router 框架 RouteLLM 进行了创新,它使用来自 The Arena 的 preference data 来训练其 router,其基础是根据 prompt 预测用户最喜欢的最佳模型。他们还对 Arena 数据进行了 data augmentation,以进一步提高其 routing 效益:

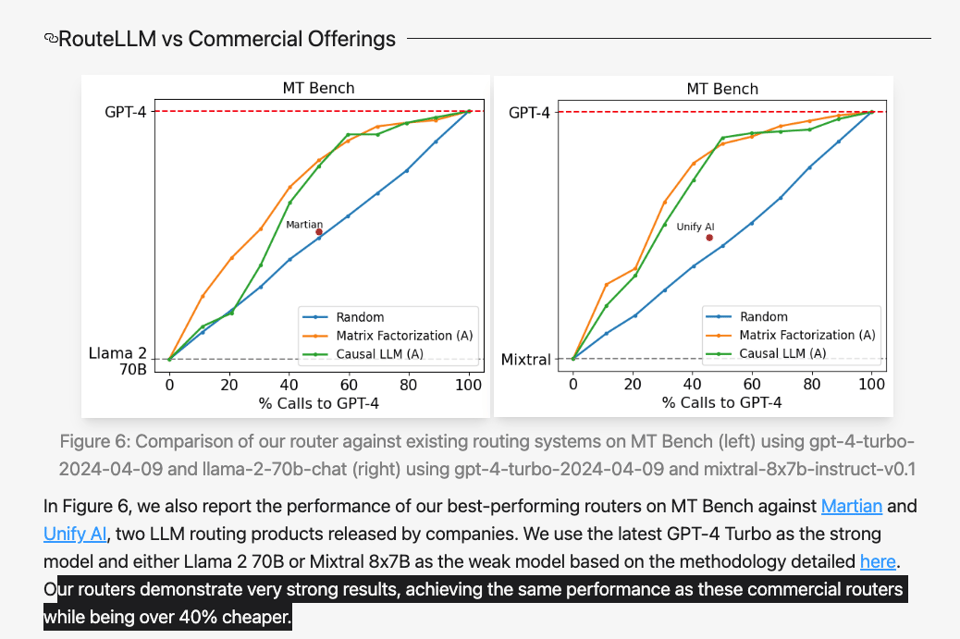

或许最残酷的是,LMSys 声称在相同性能下,其表现优于现有的商业解决方案 40%。

特别 AINEWS 更新:结构化摘要

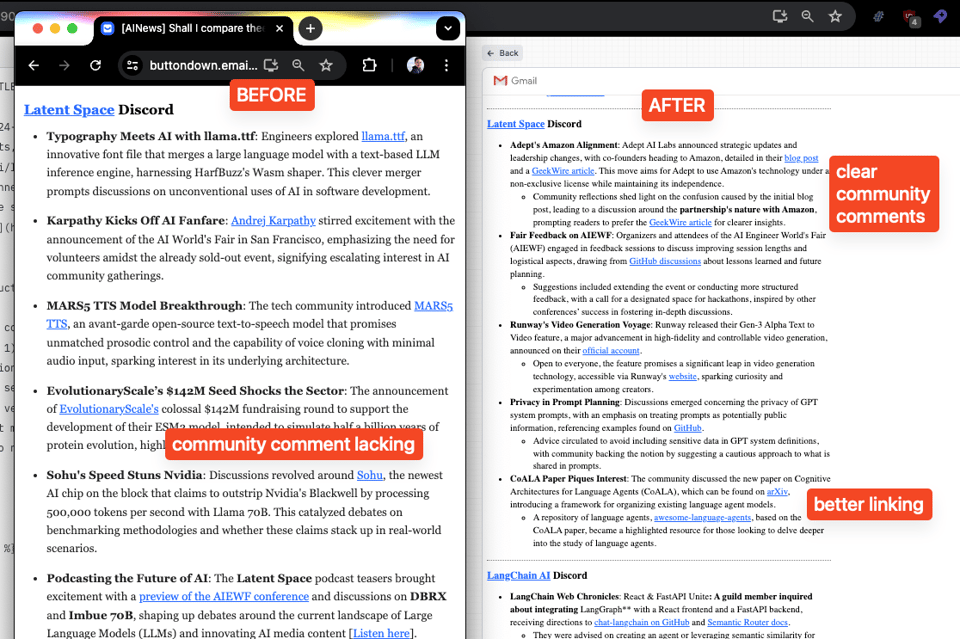

我们修改了核心摘要代码以使用 structured output,重点在于实现:1) 更好的主题选择,2) 事实与观点/反应的分离,以及 3) 更好的链接和高亮显示。您可以看到相应的效果。我们确实发现,通过这次更新,内容变得更加冗长,但我们希望这种结构使其更易于浏览,我们即将推出的网页版也将更易于导航。

AI Twitter 摘要回顾

所有摘要由 Claude 3 Opus 完成,取 4 次运行中的最佳结果。我们正在尝试使用 Haiku 进行聚类和流程工程(flow engineering)。

AI 模型与架构

- Gemma 2 模型系列:@armandjoulin 指出 Gemma 2 27B 目前是最佳的开源模型,且体积比替代方案小 2.5 倍,验证了团队的工作。@bindureddy 表示 Gemma 2 27B 的性能接近 Llama 3 70B,而 Gemma 2 9B 凭借出色的训练后处理(post-training)超越了帕累托前沿(Pareto front)。

- Block Transformer 架构:@rohanpaul_ai 分享了一篇论文,显示 Block Transformer 与原生 Transformer 相比,在困惑度(perplexity)相当的情况下,推理吞吐量提升了高达 20 倍。它通过将 KV cache 的 IO 开销从平方级降低到线性级来实现。它将昂贵的全局建模隔离到较低层,并在较高层应用快速的局部建模。

- 全 Software 2.0 计算机视觉:@karpathy 提出了一个 100% 全 Software 2.0 计算机,仅由单个神经网络组成,没有经典软件。设备输入直接馈入神经网络,其输出显示为音频/视频。

AI Agent 与推理

- 视频生成模型的局限性:@ylecun 认为视频生成模型不理解基础物理学或人体。@giffmana 对 AI 领导者使用笨拙的体操 AI 视频来声称人体物理很复杂感到恼火,这就像展示 DALL-E mini 的生成结果来说明当前的图像生成注定失败一样。

- 用于多步推理的 Q:@rohanpaul_ai 分享了一篇关于 Q 的论文,该论文通过审慎规划引导 LLM 解码,从而在无需任务特定微调的情况下提高多步推理能力。它将推理形式化为 MDP,并使用拟合 Q 迭代(fitted Q-iteration)和 A* 搜索。

- 用于长期记忆的 HippoRAG:@LangChainAI 分享了 HippoRAG,这是一个受神经生物学启发的 LLM 长期记忆框架,用于持续集成知识。它使用 Unstructured API 为文档丰富元数据。

AI 应用

- 用于法律工作流的 AI:@scottastevenson 指出 Agent 正在进入法律工作流,并艾特了 @SpellbookLegal。

- 来自 Eureka Health 的 AI 医生:@adcock_brett 分享道,Eureka Health 推出了 Eureka,这是“首位 AI 医生”,根据早期测试,其提供的个性化护理比大多数美国护理快 90 倍。

- AI 生成的奥运会回顾:@adcock_brett 报道称 NBC 将为 2024 年奥运会推出 10 分钟的 AI 生成回顾,克隆 Al Michaels 的声音在 Peacock 上解说精彩片段。演示效果与人类制作的内容几乎无法区分。

迷因与幽默

- @nearcyan 针对 AI 的闪烁图标(sparkle icons)开玩笑说:“我要变成小丑了,你们到底怎么了”。

- @francoisfleuret 幽默地建议,如果你不能生成 6-7 只鸟,你在社交上就完蛋了,因为 4-5 只已被验证,但 0-5 和 2-5 太难,而 5-5 又太容易。

- @kylebrussell 分享了一张图片,开玩笑说“你值得拥有让你产生这种感觉的对手”。

AI Reddit 摘要回顾

涵盖 r/LocalLlama, r/machinelearning, r/openai, r/stablediffusion, r/ArtificialInteligence, /r/LLMDevs, /r/Singularity。评论抓取功能现已上线,但仍有很大改进空间!

幽默/迷因

- AI 生成的幽默视频:在 /r/StableDiffusion 中,用户分享了 幽默内容的 AI 生成视频,例如一个人打开一盒巧克力,结果巧克力在脸上炸开。评论指出 AI 视频中那种梦幻般的质感和诡异的动作,并将其与人类大脑的处理方式进行了类比。

- AI 结合迷因:另一个 AI 生成视频 结合了各种迷因,用户认为这非常有趣,是 AI 的一个很好的应用场景。

- 超人工智能 (Superintelligent AI) 迷因:一些表情包迷因被分享,描绘了 人类与超人工智能之间的关系,以及一个人 试图用遥控器控制先进 AI 的场景。另一个迷因展示了 当 AI 说它不会杀死人类时人们松了一口气的样子。

AI 艺术

- 恶魔版越南战争:在 /r/StableDiffusion 中,AI 生成的图像 描绘了一个虚构的越南战争场景,海军陆战队员与恶魔作战,灵感源自 Beksinski、Szukalski 和 Giger 的恐怖艺术风格。用户分享了用于创建这些图像的详细 Prompt。

- 穿越时空的 Blåhaj:一系列 图像 展示了宜家毛绒鲨鱼玩具 Blåhaj 在各种历史和未来场景中的样子。

- 19 世纪玩电子游戏的孩子:一段来自 Luma Dream machine 的 AI 生成视频 描绘了 19 世纪的孩子们违背时代背景地玩着电子游戏。

AI 扩展与能力

- Kurzweil 对智能扩张的预测:在《卫报》的一篇 文章 中,AI 科学家 Ray Kurzweil 预测到 2045 年,AI 将使人类智能扩展一百万倍。

- AI 的扩展极限:一段 YouTube 视频 探讨了 AI 的扩展(Scaling)究竟能走多远。

- 模型大小 vs 数据质量:/r/LocalLLaMA 中的一个 帖子 认为,有时拥有高质量数据的 9B 小模型在推理任务上可以超越 2T 模型,这引发了关于模型大小与数据质量相对重要性的讨论。不过,评论者指出这更多是一个特例。

- 处理器性能进入平台期:一张带有对数 y 轴的 处理器性能图表 被分享,暗示性能提升实际上并非指数级的,并且即将进入平台期。

AI 模型与基准测试

- Gemma 2 9B 模型:在 /r/LocalLLaMA 中,一位用户发布了 Gemma 2 9B 的好评贴,发现它在自己的使用场景中比 Llama 3 8B 表现更好。

- Llama 400B 发布时机:另一个 帖子 讨论了 Llama 400B 的潜在影响,认为它需要尽快发布才能产生影响力。评论者指出,对于大多数用户来说,400B 模型不如 ~70B 模型实用。

- Gemma2-27B 在 LMSYS 的表现:围绕 Gemma2-27B 在 LMSYS 基准测试中超越更大的 Qwe2-72B 和 Llama3-70B 模型的 讨论,质疑这反映的是真实能力还是 LMSYS 特有的因素。

- 关于 Llama 400B 的猜测:根据一张所谓的截图,有人 猜测 Meta 可能已经在内部发布了 Llama 400B,并已在 WhatsApp 上提供。

- Llama 3 405B 发布的意义:一张 图片 暗示 Llama 3 405B 的发布可能会促使其他大型科技公司发布强大的开源模型。

- Gemma-2-9B 在 AlpacaEval2.0 的表现:根据 Hugging Face 页面显示,UCLA-AGI/Gemma-2-9B-It-SPPO-Iter3 模型 在 AlpacaEval2.0 基准测试中实现了 53.27% 的胜率。

AI Discord 回顾

摘要的摘要之摘要

- 模型训练、量化与优化:

- Adam-mini Optimizer:节省 VRAM 达 45-50%。 实现与 AdamW 类似的性能,且没有过高的内存开销,适用于 llama 70b 和 GPT-4 等模型。

- Hugging Face 的新型 低精度推理 提升了 transformer pipeline 的性能。针对 SD3 和 PixArt-Sigma 等模型,它提高了计算效率。

- CAME Optimizer:内存高效优化。 在减少内存需求的情况下表现出更好或相当的性能,有利于 stable diffusion 训练。

- 新 AI 模型与基准测试:

- Gemma 2 表现参差不齐,但在进一步优化后显示出对抗 Phi3 和 Mistral 的潜力。

- Claude 3.5 尽管最初期望很高,但面临上下文保留问题;Claude Opus 等替代模型表现可靠。

- Persona Hub 利用多样化的数据应用使 MATH 基准测试分数飙升,证明了合成数据在更广泛 AI 应用中的有效性。

- 开源 AI 工具与社区参与:

- Rig Library:与 Cohere 模型完全集成,面向 Rust 开发者,提供 100 美元的反馈奖励以获取见解。

- LlamaIndex 推出了迄今为止最好的 Jina reranker,并提供了混合检索设置的全面教程,有望推动检索流水线的进步。

- Jina Reranker:新的混合检索器教程详细介绍了结合多种方法以获得更好性能,允许与 Langchain 和 Postgres 等工具集成。

- 技术挑战与故障排除:

- BPE Tokenizer Visualizer 帮助理解 LLM 中的 tokenizer 机制,邀请社区反馈以完善该工具。

- 数据库队列问题 困扰着 Eleuther 和 Hugging Face 模型的基准测试工作,敦促用户寻找像 vllm 这样更高效的替代方案。

- 跨多个系统训练 GPT 模型:讨论强调了处理 GPU 限制和优化规模以实现有效的资源利用。

- AI 在现实世界中的应用:

- Featherless.ai 推出以固定费率提供 LLM 的 serverless 访问,无需 GPU 设置即可轻松开发 AI persona 应用。

- Deepseek Code V2 因其在高效解决复杂微积分和编码任务方面的表现而受到高度赞扬。

- 医疗保健中的计算机视觉:探索使用 CV 的 Agentic 医院,强调计算资源整合以增强患者护理并减少行政工作量。

第一部分:高层级 Discord 摘要

HuggingFace Discord

- 蛋白质预测精度:ESM3-SM-open-v1 的新前沿:Evolutionary Scale 发布了 ESM3-SM-open-v1,这是一个用于预测蛋白质序列的变革性模型,其基础是对生物特性的深刻理解。通过 GitHub 仓库 和交互式的 Hugging Face space,其效用得到了极大提升,这种协同作用有望进一步推动生物研究。

- 随着从业者被号召利用该模型在 Hugging Face 上开辟研究路径,势头日益强劲,社区已将其誉为生物 AI 应用领域的一次令人振奋的飞跃。

- 提取审美精华:揭秘增强模型精炼的数据集:Terminusresearch 策划了一个视觉数据宝库,其包含 33.1k 张图像的 photo-aesthetics 数据集,用于磨练 AI 的审美辨别力。该数据集充满了真实的摄影照片,为细致的模型训练奠定了基础。

- 捕捉建筑以及人与物体互动图像的补充数据集对主数据集进行了完善,这一初创尝试在提升模型以审美眼光导航和解释视觉领域的能力方面展现出前景。

- 驯服 Tokenization:为 LLM 清晰度而生的 BPE 描绘:BPE Tokenizer 是 LLM 运作的基石,通过一位热心社区贡献者制作的新型 可视化工具,其透明度得到了提升。这个可部署的实用程序旨在阐明 Tokenizer 的机制,增强开发者对 LLM 复杂性的掌握。

- 众包改进工作正在进行中,呼吁反馈以纠正问题并完善可视化工具——这一倡议旨在丰富 LLM 的可访问性。

- 治愈的远见场所:用 CV 规划 Agentic 医院:一位来自悉尼和海德拉巴的医生发出了响亮的号召,要求用 computer vision 开创 agentic hospitals——这一构想旨在减轻沉重的行政负担。鱼眼摄像头被预定为协调平稳运行和增强以患者为中心的护理的关键环节。

- 随着对计算资源的渴求,对算力资源的请求也在扩大,预示着一场潜在的革命,AI 可能会改变医疗动态,培育技术驱动的医疗生态系统。

- 推理的独创性:在 Transformer 中拥抱低精度目标:对 SD3 和 PixArt-Sigma 等 transformer pipelines 中低精度推理的探索,标志着向计算经济性的转变。GitHub 讨论 揭示了该技术在提升模型性能敏捷性方面的潜力。

- 虽然具有优化的潜力,但这种新兴方法也充满了挑战,需要审慎解决才能释放其全部效益。

Unsloth AI (Daniel Han) Discord

- RAM 优化配置:Unsloth 在 WSL2 上平稳运行:工程师们推荐了在 WSL2 上运行 Unsloth AI 的优化方案,以充分利用系统资源。交流了如在

.wslconfig中设置内存限制以及使用特定安装命令等配置,以在各种硬件设置上获得性能提升。- 分享了解决安装障碍的排错技巧,并就内存分配调整和全新的命令行达成共识,这是在 Intel 和 AMD 架构上释放 Unsloth 效率的关键。

- DRM 的双重角色:Unsloth 中的多 GPU 支持与授权:Unsloth 在多 GPU 训练中引入了 DRM 系统,概述了受 NDA 保护的严格测试,确保 GPU ID 绑定和持久化 ID,揭示了在授权控制与功能灵活性之间取得平衡的幕后努力。

- 社区热烈讨论了多 GPU 设置的配置和边界,DRM 稳定性的更新对于扩展 AI 训练能力至关重要。

- 精细化微调:探索 Unsloth 的微调机制:AI 爱好者们剖析了微调 Lexi 和 Gemma 模型的复杂过程,指出了诸如 system tokens 等特定怪癖,解决了微调后输出无限生成的故障,并强调使用加粗 Markdown 语法以提高清晰度。

- 优化微调过程的共享技术包括多语言数据集翻译、通过仔细策划避免灾难性遗忘,以及恰当地使用 tokenizer 函数以匹配自定义训练数据。

- 合成角色塑造数据:MATH 评分的巨幅提升:Persona Hub 拥有十亿级角色的合成数据生成方法论一直是热门话题,它在数学推理分数上实现了飞跃,其 摘要 中展示的易用性引发了热议。

- 在对该项目的各种观点中,一些人强调了聚合数据本身比生成代码更重要,引发了关于大规模合成数据应用关键要素的辩论。

LM Studio Discord

- Gemma 的 GPU 策略:虽然 Gemma 2 支持将 GPU 任务卸载到 CUDA 和 Metal,但根据社区反馈,0.2.23 版本之后的更新对于解决困扰该 AI 模型性能的问题至关重要。深度探索显示,Gemma 2 在特定配置下存在模型加载时间过长的问题;AI 专家们呼吁持续进行补丁修复。

- 一个被提出的中肯观点是,Gemma 2 目前受限于 CUDA 和 Metal,并建议未来应拓宽支持范围。社区对话详细讨论了技术挑战,并提出了旨在增强模型鲁棒性和兼容性的潜在更新方案。

- AutoUpdater 的敏捷进展:LM Studio 的 AutoUpdater 运行流畅,将用户版本推升至 v0.2.26,并对 v0.3 充满期待。一份公开帖子传达了专门针对 LLama 3 8B model 的增强功能,修复了其忽略停止序列(stop sequences)的棘手问题——这是一个备受欢迎的改进。

- 围绕近期功能发布的讨论集中在它们解决以往痛点的能力上,例如拒绝遵守停止序列的问题。用户们以积极的态度认可了这些承诺带来和谐人机交互的更新。

- Deepseek 的 CPU 历程:Deepseek v2 展示了其强大的实力,在高性能 CPU 上仅调用其 200B+ 参数中的 21B,在强悍的 Threadripper 系统上跑出了 3-4 tokens/sec 的速度。大量用户生成的性能数据汇入社区对话,为 CPU 的可行性声明提供了依据。

- 共享用户测试 遍历了从 RAM 占用率到加载速度的各种指标,涵盖了 Deepseek v2 在顶级 CPU 上强劲但管理出奇良好的性能体验。这些稳健的评估旨在为未来的开发和实际场景中的应用指明方向。

- 量化探索的试验:量化查询占据了讨论的主导地位,特别关注在性能和效率之间取得平衡的 “GGUF quants”。针对 q5_k_l 的实验性尝试引发了分析性轶事,旨在追求资源消耗的敏捷与轻量。

- 伴随着一系列经过基准测试的产物(如 q5_k_l 和 GGUF quants),AI 开发者群体在追求性能精准度的同时,也强调保留模型原有的实力。记录在案的讨论深入探讨了数据和用户反馈,力求为这些前沿的性能增强手段寻找最佳实践。

- 滑动窗口 (Sliding Window) 的平稳运行:Gemma 2 传奇的最新篇章是 Sliding Window Attention,它刚刚被融合进最新的 llama.cpp 中。这一精明的更新允许 AI 熟练地筛选过去的 Token,巧妙地加深其上下文理解。用户们正屏息以待针对遗留质量问题的修复。

- 随着强大的 Sliding Window Attention 功能在 Gemma 2 场景中首次亮相,并带来了通过熟练管理 Token 历史来增强性能的承诺,虚拟社区中涌现出了各种成功的案例。然而,在这些希望中,谨慎的声音依然坚定,对未来全面完善的预期保持着审慎的态度。

Stability.ai (Stable Diffusion) Discord

- SD3 中处于困境的 Loras:一场激烈的讨论集中在为 Stable Diffusion 3 训练 Loras 的挑战上,重点是需要强大的支持。人们对 SD 8b 潜在的易用性充满热情。

- 虽然有些人急于开始,但主流观点倾向于保持谨慎,敦促耐心等待更好的训练工具和数据,以防止产生质量不合格的 Loras 或 Checkpoints。

- GPU 专家指导新手:关于运行 Stable Diffusion 的硬件要求展开了辩论,普遍共识倾向于使用至少具备 12GB VRAM 的 Nvidia GPU。

- 值得注意的是,现有的 RTX 3090 显卡受到了称赞,而最新的 RTX 4080 和 4090 尽管价格昂贵,但因其面向未来的属性而受到关注。

- 安装入门:用户们团结起来解决 Stable Diffusion 的安装问题,分享了关于 Automatic1111 和 ComfyUI 等各种界面的知识,以及关键的设置命令。

- 交流了有用的资源和指南,包括特定的配置建议,如加入 ‘xformers’ 和 ‘medvram-sdxl’ 以增强复杂工作流的性能。

- 高分辨率技巧提升艺术清晰度:社区深入探讨了在 SDXL 中使用高分辨率修复设置 (high-resolution fix settings) 以获得更清晰的图像,强调了精确参数设置的重要性,例如 ‘10 hires steps’。

- 参与者放大了 adetailer 等插件的好处,强调了它细化图像关键方面的能力,特别是动漫风格图形中的面部和眼睛。

- 模型挖掘与 Loras 知识:对话挖掘出了寻找模型和 Loras 的来源,点名了 Civitai 等平台,因其广泛的收藏和用户贡献。

- 分享了关于使用 Prompt 示例作为引导以准确利用这些资产的见解,强调了在模型训练和分发方面的集体努力。

CUDA MODE Discord

- 同步时间:时区工具解决调度难题:分享了两个工具 Discord Timestamps 和 When2meet,以简化跨时区的会议协调。

- Discord Timestamps 和 When2meet 都通过转换时间和汇总空闲状态来缓解调度烦恼,促进了轻松的集体调度。

- 对数尺度的数值稳定性基础:一篇博客文章激发了关于 log exp 函数在数值稳定性中作用的讨论,强调其在计算中用于防止下溢 (underflow)。

- 辩论随之而来,涉及其必要性的频率,并对对数尺度在建模和 ML 中的不可或缺性提出了疑问,突显了实践中的分歧。

- Tensor 故事:PyTorch 工作坊中的元数据难题:提出了在操作中保留

torch.Tensor中元数据的挑战,并提出了诸如子类化 (subclassing) 之类的建议,但尚未出现明确的解决方案。- 面对支持动态输入形状的限制,

torch.compile出现了编译难题,这增加了 HuggingFace transformers 使用的复杂性,虽然提出了解决方案但尚未被采用。

- 面对支持动态输入形状的限制,

- 闪现的洞见:AI 工程师赞赏著名演讲系列:聊天中充满了对富有启发性的演讲系列的认可。

- Stephen Jones 的演讲因其持续输出的深刻见解内容而赢得赞誉,巩固了他在 AI 工程师圈子中的声誉。

- 性能的高峰与低谷:使用 FP16 穿越 Kernel 景观:Kernel 性能成为热门话题,FP16 显示出单次启动效率,而 bfloat 则需要多次启动,这引发了优化大 Tensor 操作的策略讨论。

- Bitpacking 优化在较小的 Tensor 上显示出潜力,但在处理大体积 Tensor 时效果减弱,促使对 Kernel 性能增强进行进一步探索。

Perplexity AI Discord

- Gemma 的盛大发布:Gemma 2 模型登陆 Perplexity Labs:Gemma 2 模型已上线 Perplexity Labs,旨在通过用户对其性能的反馈来促进社区参与。

- 热情的参与者现在可以试用新模型并贡献见解,该公告鼓励互动式的社区体验。

- 会聊天的 Android 设备:按住说话 vs 免提模式:Perplexity AI 的 Android 应用现在推出了语音对语音功能,通过免提和按住说话模式增强了用户可访问性,正如其最新更新中所详述的那样。

- 免提模式在屏幕激活后立即开始监听,而按住说话则等待用户指令,旨在丰富用户交互。

- Claude 的上下文处理不力:用户抱怨其“健忘”:有关 Claude 3.5 无法保持上下文的报告激增,尽管在讨论特定话题,它却转向概括性的回答,这给工程师带来了意想不到的对话转折挑战。

- 切换到 Opus 模型对某些人来说有所改善,这暗示了 Claude 3.5 中可能存在影响交互的 Bug,社区呼吁更智能的 Pro 搜索以保留上下文。

- API 烦恼:Perplexity API 出现差异:Perplexity API 用户正在应对不一致性,发现像

after:2024-05-28这样的日期特定过滤器可能会诱导 API 生成超前日期的内容,引发了关于其预测能力的辩论。- 由于 Apple ID 识别问题,用户在 Perplexity Labs Playground 的交互遇到障碍,引发了关于用户包容性和体验改进的对话。

- 游戏机制:Minecraft 的机制会误导未成年人吗?:一个激烈的帖子批评了 Minecraft 的修复机制,认为游戏内的逻辑可能会扭曲青少年对现实世界工具修复的理解。

- 这场数字辩论深入探讨了教育影响,敦促对 Minecraft 等虚拟环境如何播下误解种子进行现实检查,促使程序员思考其影响。

Nous Research AI Discord

- 十亿角色突破:数学基准测试飙升:Aran Komatsuzaki 的推文强调了成功创建的 十亿角色数据集 (billion persona dataset),将 MATH 基准测试分数从 49.6 提升至 64.9。其背后的方法,包括多样化的数据应用,详见 Persona Hub GitHub 和相应的 arXiv 论文。

- 该新数据集实现了高质量数学问题和游戏 NPC 场景的合成生成。这一创新展示了合成数据带来的显著性能提升,为学术和娱乐 AI 应用提供了众多用例。

- 梦境数据二元性:Android & Human 数据集:该数据集将 10,000 个真实梦境与由 Oneirogen 模型合成的 10,000 个梦境进行了对比,展示在 Hugging Face 上。Oneirogen 的变体(0.5B、1.5B 和 7B)为梦境叙事评估提供了新标准。

- 该语料库可用于辨别真实梦境与生成梦境内容之间的差异,为高级分类任务和心理学 AI 研究铺平了道路。

- 科技巨头的巨额投资:Microsoft 与 OpenAI 的数据中心:据 The Information 报道,Microsoft 透露了与 OpenAI 在 Stargate 项目上的合作,可能为该项目注入超过 1000 亿美元。两家公司旨在应对 AI 对巨大算力日益增长的需求。

- 考虑到 Microsoft 为维持如此庞大的计算需求而制定的核能战略,这一举措可能会显著影响能源行业。

- 投机速度:SpecExec 的 LLM 解码创新:SpecExec 提供了一种全新的 LLM 推理方法,通过在消费级 GPU 上使用 4-bit 量化,实现了高达 18.7 倍的 速度提升。这一突破促进了更快的 LLM 运行,可能简化 AI 在更广泛应用中的集成。

- 该模型对序列进行投机解码,并由核心算法快速验证,引发了关于其与不同 LLM 家族的兼容性以及集成到现有平台中的讨论。

- 利用 PhyloLM 绘制 LLM 系统发育图:PhyloLM 的新颖方法引入了系统发育学原理来评估 LLM 的谱系和性能,详见 arXiv 报告。该方法根据 LLM 输出的相似性制作树状图,评估了 111 个开源模型和 45 个闭源模型。

- 这种方法在训练数据不完全透明的情况下,梳理出 LLM 之间的性能特征和关系,提供了一种具有成本效益的基准测试技术。

Modular (Mojo 🔥) Discord

- “错误即值”引发设计讨论:Mojo 社区的讨论揭示了将错误作为值(errors as values)处理与传统异常处理之间的细微差别。讨论显示出对 Variant[T, Error] 的偏好,以及对更完善的 match 语句的需求。

- 贡献者们指出 Mojo 中 try/except 的使用仅仅是“语法糖”,并建议在语言设计中深入考虑更优雅的错误解决方式。

- Ubuntu 用户齐心协力掌握 Mojo:用户们在 Ubuntu 上安装 Mojo 时展开了协作。在 Raspberry Pi 5 的 Ubuntu 24.04 上安装成功的案例展示了社区共同解决问题的特质。

- 对话强调了社区支持在克服安装难题中的重要性,特别是对于在不同 Ubuntu 版本中摸索的新手而言。

- Mojo 马拉松:编程挑战赛开始:每月编程挑战已启动,为展示和磨练 Mojo 社区技能提供了一个动态平台。

- 该倡议由 @Benny-Nottonson 发起,重点关注优化的矩阵乘法(matrix multiplication)等实际问题,详细的参与指南可在 GitHub 仓库中找到。

- AI 愿景:Cody 使用 Mojo 编程:Cody 与 Mojo 的交集引发了兴趣,讨论集中在利用 Cody 预测语言特性上。类 Python 的语法为流畅集成铺平了道路。

- 随着探索 SIMD 等高级 Mojo 特定特性的愿景,社区正准备推向像 Cody 这样的辅助机器人所能实现的极限。

- 异步 I/O 与 Mojo 的系统级优势:关于 I/O 模块当前限制的讨论非常热烈。成员们主张引入像

io_uring这样的异步 API,旨在提升网络性能。- Darkmatter__ 和 Lukashermann.com 辩论了强大但复杂的 API 与用户友好型抽象之间的权衡,强调了可维护性的必要性。

OpenRouter (Alex Atallah) Discord

- OpenRouter 的小失误:根据公告,由于数据库操作失误,OpenRouter 的分析功能暂时下线。客户数据保持安全,未受此次事故影响。

- 团队迅速向用户表示歉意,澄清客户额度未受损,并正在积极处理数据修复。

- DeepSeek Code 攻克微积分:通过 OpenRouter API 使用的 DeepSeek Code V2 在处理微积分问题时表现出令人印象深刻的准确性,这一消息分享在 general 频道中。其经济高效的特性受到了关注。

- 确认所使用的模型是 full 263B 版本,这表明它在各种任务中具有相当大的能力和通用性。详情可见 DeepSeek-Coder-V2 页面。

- Mistral API 混淆问题:有报告称在 Aider 聊天中使用 Sonnet 3.5 时出现了 Mistral API 错误,这让当时并未使用 Mistral 的用户感到困惑。

- 用户被引导联系 Aider 的支持团队进行具体排查,这暗示在服务中断期间可能触发了自动回退到 Mistral 的机制。详情在 general 频道中讨论。

Latent Space Discord

- Adept 与 Amazon 的结盟:Adept AI Labs 宣布了战略更新和领导层变动,联合创始人将前往 Amazon,详情见其 blog post 和 GeekWire article。此举旨在让 Adept 在保持独立性的同时,通过非独占许可使用 Amazon 的技术。

- 社区反馈指出,最初的博客文章引起了困惑,引发了关于与 Amazon 合作伙伴关系性质的讨论,促使读者倾向于阅读 GeekWire article 以获取更清晰的见解。

- 关于 AIEWF 的坦诚反馈:AI Engineer World’s Fair (AIEWF) 的组织者和参与者进行了反馈会议,讨论如何改进会议时长和物流方面,参考了关于经验教训和未来规划的 GitHub discussions。

- 建议包括延长活动时间或进行更结构化的反馈,并呼吁设立专门的 Hackathon 空间,灵感来自其他会议在促进深入讨论方面的成功经验。

- Runway 的视频生成之旅:Runway 发布了他们的 Gen-3 Alpha Text to Video 功能,这是高保真和可控视频生成领域的重大进步,已在他们的 official account 上宣布。

- 该功能面向所有人开放,承诺在视频生成技术上实现重大飞跃,可通过 Runway 的 website 访问,激发了创作者的好奇心和实验热情。

- Prompt 规划中的隐私问题:出现了关于 GPT system prompts 隐私的讨论,强调应将 prompts 视为潜在的公开信息,参考了 GitHub 上的示例。

- 建议避免在 GPT 系统定义中包含敏感数据,社区支持这一观点,建议对 prompts 中分享的内容采取谨慎态度。

- CoALA 论文引起关注:社区讨论了关于 Cognitive Architectures for Language Agents (CoALA) 的新论文,该论文可在 arXiv 上找到,它引入了一个组织现有 Language Agent 模型的框架。

- 基于 CoALA 论文的 Language Agent 仓库 awesome-language-agents 成为那些希望深入研究 Language Agent 的人的重点资源。

LangChain AI Discord

- LangChain Web 编年史:React 与 FastAPI 的结合:一位公会成员询问了如何将 LangGraph 与 React 前端和 FastAPI 后端集成,并获得了指向 GitHub 上的 chat-langchain 和 Semantic Router 文档 的指引。

- 他们收到了关于创建 Agent 或利用语义相似性进行路由的建议,并参考了为工具实现奠定坚实基础的概述方法。

- Embedding 嵌套博弈:通过 Matryoshka 加速:Prashant Dixit 展示了一种使用 Matryoshka RAG 和 llama_index 提升检索速度的解决方案,详情见 Twitter 帖子 和一份详尽的 Colab 教程。

- 该技术采用了多样的 Embedding 维度(从 768 到 64),承诺增强性能并提高内存效率。

- 智能自动化与分析:EDA-GPT 革命:Shaunak 宣布了 EDA-GPT,这是一个使用 LLMs 进行自动化数据分析的 GitHub 项目,可通过 Streamlit 部署,并在项目的 README 中提供了设置视频教程。

- 这一创新简化了数据分析过程,为工程师优化了工作流。

- Postgres 遇见 LangChain:持久化的绝佳组合:Andy Singal 的 Medium 文章 强调了将 LangChain 与 Postgres 结合以优化持久化,将 Postgres 的可靠性引入 LangChain 项目。

- 这一协同组合旨在利用 Postgres 稳健的存储能力来加强状态管理。

- 在 LangChain 中施展 MoA 魔法:一段名为 “使用 langchain 实现 Mixture of Agents (MoA)” 的 YouTube 教程向观众演示了在 LangChain 中创建多 Agent 系统的过程,旨在提升任务性能。

- 该视频为 MoA 提供了一个切入点,并为有兴趣应用组合 Agent 优势的工程受众提供了具体的代码示例。

Interconnects (Nathan Lambert) Discord

- Adept 进入 Amazon 版图:Adept 转变策略并与 Amazon 整合;联合创始人加入 Amazon,详见其 博客文章。公司在人员流失后,目前约有 20 名员工留守。

- Adept 的这一战略举措类似于 Microsoft 对 Inflection AI 的策略,引发了关于 Adept 的发展方向和组织文化变化的猜测,如这条推文中所讨论的。

- AI 的精通还是迷局?:关于 AI Agent 开发是否滞后的辩论正在进行,有人将其类比为早期阶段的自动驾驶汽车。像 Multion 这样的项目因其在基础网页抓取之外的能力提升微乎其微而受到批评。

- 社区推测,创新的数据收集方法是 AI Agent 的游戏规则改变者,转向生成高质量、模型特定数据是克服当前局限性的关键环节。

- Cohere 对 AI 清晰度的巧妙尝试:Cohere 的 CEO Aidan Gomez 在一次 YouTube 讨论中分享了关于对抗 AI 幻觉和提升推理能力的见解,暗示了合成数据生成的潜力。

- 社区将这些努力与 Generative Active Learning 以及针对 LLM 的 hard negative/positive mining(难负/正样本挖掘)实践进行了比较,呼应了视频中 5:30 和 15:00 处的重要性。

- 模型估值难题:拥有丰富用户的 Character.ai 估值为 10 亿美元,而尚未投入运营的 Cognition AI 估值却高达 20 亿美元,这引发了围绕融资宣讲能力和筹款技巧的讨论。

- Cognition AI 打着创始人获得 IMO(国际数学奥林匹克)奖项的旗号,瞄准开发者群体,但在来自大厂 AI 实体的激烈竞争中,其价值正面临审查。

- 外行的 RL 飞跃:一位 AI 爱好者完成了 Silver 的 RL 入门和 Abeel 的 Deep RL 课程,下一步目标是 Sutton & Barto,并寻找任何关于 LM alignment(语言模型对齐)的非传统建议。

- RL 新手们得到的建议是浏览 Spinning Up in Deep RL 并尝试真实的代码库,进行手动的 CPU 驱动任务以获得扎实的理解,或许可以参考 HF Deep RL 课程。

OpenInterpreter Discord

- 跨操作系统安装历程:成员们反映在 macOS 和 Windows 上设置

01时存在摩擦,尽管遵循了预设步骤,但仍面临 API key 依赖和终端命令混淆等障碍。@killian 和其他人提出了潜在的解决方案,大家对安装过程中的阻碍达成了普遍共识。- 针对文档清晰度的持续呼吁贯穿了多次尝试,正如一个讨论 桌面应用冗余 的线程所强调的那样。GitHub 上的一个 Pull Request 带来了希望,dheavy 展示了简化的 Windows 操作流程。

- 健忘的助手?解决 AI 遗忘问题:关于赋予 Open Interpreter 更好的 长期记忆 的询问浮出水面,指出了 Sonnet 模型从过去交互中学习能力的痛点。

- 关于记忆增强的讨论反映了大家对 OI 记忆限制 的集体尝试,但尽管有关于特定命令使用和深奥预训练尝试的建议,目前仍缺乏明确的高级策略。

- 征集向量搜索先锋:一位积极的成员在 Colab notebook 中展示了将向量搜索集成到公共数据集的动手教程,为在 Fed 的前沿演示奠定了基础。

- 该合作者为进一步的 向量搜索增强项目 伸出了橄榄枝,预示着社区创新和应用 AI 研究可能开启新篇章。

- 多模态模型搜寻升温:关于为受限和非受限项目选择顶级开源多模态模型的咨询不断涌现,促使了如 Moondream(用于视觉精细化)配合 强健的 LLMs 的建议。

- 讨论导致了对模型充分性的碎片化观点,反映了对多模态实现策略的多样化看法,目前尚未出现统一的胜出者。

- Windows 难题与安装波动:对 OpenInterpreter 在 Windows 上 typer 安装麻烦 的不满情绪蔓延,成员们通过微调 pyproject.toml 文件并操作

poetry install来获得成功。- 文档问题的叙述贯穿了整个社区,放大了对透明、最新指南 的呼声,并引发了对其 01 Light 设置实用性的审查。@Shadowdoggie 强调了 macOS 的便捷与 Windows 的困扰之间的两极分化。

LlamaIndex Discord

- Reranker 革命:随着 Jina reranker 新版本的发布,兴奋感在蔓延,据称这是他们目前最有效的版本,详见此处。社区赞扬了它对检索策略和 结果组合 的影响。

- 由 @kingzzm 分享的构建自定义混合检索器的指南因其结合检索方法的详尽方式而受到欢迎,详见此处。反馈显示它在高级 检索流水线 方面具有深远的潜力。

- LlamaIndex 工具包扩展:随着用户思考 Langchain Tools 与 LlamaIndex 的兼容性,集成不确定性随之增加,这一询问由一位社区成员提出。

- 围绕在 LlamaIndex agents 中使用 Langchain Tools 的讨论非常热烈,大家对如何合并它们的功能以提高效率表现出浓厚兴趣。

- 查询困惑得以解决:用户正在努力解决 LlamaIndex 中的 查询流水线配置,并提出了诸如利用 kwargs 管理

source_key以改进输入分离和检索设置的见解。- 针对大型 CSV 文件的 Embedding 性能担忧,促使了一项提高

embed_batch_size的提议,从而为引入更大型的 LLMs 以进行更好的代码评估拓宽了路径。

- 针对大型 CSV 文件的 Embedding 性能担忧,促使了一项提高

- 子 Agent 专业化:对 子 Agent 的好奇心显现,用户寻求通过提示词和输入来自定义它们,以增强特定任务的操作。

- CodeSplitter 工具因其在优化元数据提取方面的潜力而受到关注,暗示了 LlamaIndex 内部向更高效的节点操作转变。

- Kubernetes 与多 Agent 协同:由 @nerdai 推出的全新 多 Agent 系统部署 入门套件,为轻松将本地 Agent 服务迁移到 Kubernetes 铺平了道路,详见此处。

- 该套件实现了向 k8s 部署的无缝过渡,标志着在 扩展服务能力方面迈出了重要一步。

OpenAccess AI Collective (axolotl) Discord

- 以少胜多的 Llama:社区成员对 llama3 70b 模型仅凭 270 亿参数就实现高性能感到震惊,引发了关于这种壮举可行性的讨论。与此同时,一些人仍坚持使用 Mixtral,因其性能全面且对消费级硬件的许可协议友好。

- Hugging Face 上展开了关于 Hermes 2 Theta 和 Pro 迭代版本的辩论——一个是新颖的实验,另一个是经过打磨的 finetune——同时用户也在思考 Pro 版本独有的结构化 JSON 输出的价值。

- 格式化的魅力与挫折:Axolotl 自定义 ORPO 格式化程序的问题引发了讨论,原因是 tokenization 不当以及 ChatML 中系统角色(system roles)的管理方式。

- 使用替代角色来应对挑战的建议遇到了冲突方面的担忧,这表明需要更无缝的自定义解决方案。

- 合成模型减速引发猜测:Nvidia synthetic model 因其数据生成速度缓慢而受到关注,与 llama 70b 或 GPT-4 等更快的模型相比,其速度慢如蜗牛。

- 这引发了关于小模型可能具有的优势的询问,特别是在效率和实际应用方面。

- 优化中的前沿压缩技术:AI 爱好者探讨了创新的内存高效优化器,如 CAME 和 Adam-mini,它们承诺在不牺牲性能的情况下减少内存占用。

- 技术发烧友被引导至 CAME 的论文和 Adam-mini 的研究,以深入了解细节及其在 Stable Diffusion 训练等领域的潜在应用。

Eleuther Discord

- 深陷队列泥潭的 Benchmark:热门话题包括影响 leaderboard benchmark 排队时间的计算资源瓶颈,推测源于 HF 的基础设施。Stellaathena 暗示无法控制队列,表明需要替代方案。

- Im-Eval 思考 ‘HumanEval’ 能力:关于 im-eval 处理

HumanEval和HumanEvalPlus能力的问题浮出水面,Johnl5945 发起了关于为该评估工具配置评估温度(evaluation temperatures)的讨论。- 对话在没有明确结论的情况下结束,凸显了对 im-eval 功能和温度控制进行后续研究或澄清的潜在领域。

- Adam-mini:轻量级优化器:Adam-mini 优化器是一个值得关注的主题,它通过使用分块式的单一学习率提供了显著的内存节省,并承诺具有与 AdamW 相当的性能。

- 成员们评估了它的功效,认识到在不影响模型结果的情况下缩减优化器内存占用的潜力,这可能会在 ML 工作流中引入更具内存效率的实践。

- Gemma 2 的指标令用户困惑:尽管努力遵循了推荐做法(如将

dtype设置为bfloat16),但在复现 Gemma 2 指标时的差异仍导致了困惑。人们对 piqa 和 hellaswag 等 benchmark 中报告的准确率存在实质性差异表示担忧。- 在正确的调试命令似乎返回了正确但不一致的结果后,人们敦促进一步调查潜在问题,正如 @LysandreJik 的一条推文中所述。

- 揭秘 Token 表示的“擦除效应”:最近的一项研究揭示了 LLM 中 token 表示的“擦除效应”(erasure effect),在多 token 命名实体中尤为显著,引发了围绕其影响的激烈讨论。

- 学术交流集中在这种效应如何影响语义复杂的 token 组的解释,以及旨在解决这一表示挑战的增强型模型设计的潜力。

tinygrad (George Hotz) Discord

- 代码库清理大行动:George Hotz 发起了精简 tinygrad 的行动号召,要求将 RMSNorm 从 LLaMA 移至

nn/__init__.py,并配齐测试和文档。- 社区对此做出了响应,建议对组织结构进行增强,并可能在整个项目中统一代码标准。

- tinygrad 周一例会:在最近的会议中,参与者讨论了多项进展,包括 sharding 更新 和 单次图重写 (single pass graph rewrite),并涉及了 tensor cores 和新的悬赏任务。

- 详细交流涵盖了 lowerer continuation、Qualcomm runtime,并确定了进一步改进 tinygrad 开发流程的后续步骤。

- 独立 tinygrad 讨论:有疑问提出关于将 tinygrad 程序编译为适用于 Raspberry Pi 等设备的独立 C 代码的可能性,大家对针对低功耗硬件的开发表现出共同兴趣。

- 成员们分享了 tinygrad for ESP32 等资源,以激发在传统环境之外的应用探索。

- 悬赏任务亮点:一场深入的讨论明确了 llama 70b lora 悬赏 的要求,包括遵循 MLPerf 参考实现,但在计算方法上保持灵活性。

- 社区探讨了使用 qlora 的可能性,并分享了在不同硬件配置上实现该悬赏任务的见解。

- 图重写新进展:关于 图重写 (graph rewrite) 的交流包括对在流程中采用新算法的兴趣,重点在于优化调度器 (scheduler)。

- ChenYuy 对会议的总结指出,虽然尚未选定具体的图算法,但将更多功能迁移到图重写框架中的势头正盛。

LAION Discord

- 27B 模型:大质疑与小胜利:在褒贬不一的评价中,27B 模型面临质疑,但也因其潜力获得了一些认可,甚至在某些表现不佳的场景下也超过了 Command R+。一位成员指出 Gemma 2 9B 表现出了出人意料的优越性能,从而加强了讨论。

- 这种带有疑虑的热情在讨论中蔓延,如 “确实,但即使在最坏的情况下(-15),它也比 command r+ 更好” 这种观点表明,人们更倾向于 27B 模型相对于同类产品的优越潜力。

- ChatGPT 走下坡路,沦为二流:关于 ChatGPT 4 和 4o 模型 在处理细微编程任务时失去掌控力的担忧被提出,用户更倾向于 3.5 版本。几位用户觉得最新的模型过于“死板”,对提示词理解得太字面化。

- 挫败感在蔓延,一位成员评论道 “有时付费的 4 和 4o 模型在编程时感觉完全没用”,这捕捉到了社区向更可靠的免费替代方案转移的趋势。

- Gemini 崛起,ChatGPT 衰落:Gemini 1.5 Pro 因其响应迅速的交互而备受瞩目,而 ChatGPT 则面临效率日益降低的投诉,尤其是在编程任务中。用户纷纷称赞 Gemini 积极解决问题的态度,与 ChatGPT 逐渐减退的热情形成鲜明对比。

- 用户如是评价:“与 ChatGPT 日益严重的懒惰相比,Gemini 1.5 pro 做得非常出色”,这凸显了用户正转向那些能长期保持活力和参与度的替代模型。

- Claude 的 Artifact 功能大获好评:Claude 的 artifact 功能 赢得了用户的青睐,提供了比 ChatGPT 建立的现状更具沉浸感且高效的体验。这一特定功能吸引了越来越多的受众准备转换阵营。

- 社区共识反映在 “artifacts 功能体验好得多” 等陈述中,标志着更符合用户体验预期的发烧友工具正日益流行。

- 语言迷宫与 LLM:讨论转向全球受众,非英语母语者正在寻找擅长多种语言的 LLM,他们优先考虑母语的对话能力,而非特定任务的效率。尽管模型在特定任务中的有效性各异,但这种全球化的倾向仍在继续。

- “它之所以能排在前面,不是因为它能解决难题,而是因为它的多语言能力” 这一说法展示了对推动语言包容性和支持本地化用户交互的模型的需求激增。

LLM Finetuning (Hamel + Dan) Discord

- JSONL 处理者集结:简化 JSONL 编辑的努力促成了经验分享,包括一个用于快速编辑的 simple JSONL editor,以及一套用于处理各种 JSON 结构化文件的脚本方法。

- 社区交流建议直接编辑和使用 Prompt Engineering 从 JSON 格式的结构化患者数据中提取摘要,避免引入新的包实现,并最大限度地减少 LLM 评估中的幻觉发生率。

- Kv-Caching 启发 Vision-LLMs:LLM 用户探索了针对视觉中心模型的 kv-caching 增强方案,发现预测概率有了显著提升。

- 该指南为受限 GPU 设置下的视觉模型提供了可操作的优化建议,吸引了实际关注和实现反馈。

- 在 Kubernetes 上进行 LLM 推理:对在 Kubernetes 上实现 ML 推理存在质疑,一条轻松的推文引发了关于 ML 工作负载替代云基础设施的深入讨论。

- 尽管在 Modal 上的工具扩展存在一些 共同困难,但在特定的分布式系统中,人们对 Modal 的信心高于 Kubernetes。

- Hugging Face 积分:用户的慰藉:关于 Hugging Face 积分 的说明已经发布,确认有效期为 2 年,缓解了用户对积分立即过期的担忧。

- 讨论指出社区需要更好的关于 Hugging Face 积分状态和管理的沟通渠道。

- 追求最优 IDE:Zed IDE 凭借出色的功能和 AI 集成赢得了 Sublime Text 老用户的青睐,但人们对 Cursor 的功能仍保持高度好奇。

- 社区征求关于 Cursor 用户体验的反馈,建议更广泛地探索开发环境中的 AI 集成。

Cohere Discord

- Cohere 培养实习生:一位渴望获得 Cohere 实习机会的社区成员提到了他们的 AAAI 会议论文和过去的实习经历,并询问了 Cohere API 的进展和新型 LLM 功能任务。

- 对话围绕将 LLM 与强化学习结合的资源展开,丰富了 Cohere 的技术版图。

- Coral 的烦恼:速率限制之谜:用户对 Coral API 的速率限制感到沮丧,抱怨每分钟仅 5 次调用的严格限制。

- 通过一份 实用指南 交流了心得,生产环境密钥(Production Key)以每分钟 10,000 次调用的慷慨额度成为了救星。

- Aya-23 模型的混杂信息:社区在 Aya-23 模型的版本迷雾中穿行,重点关注了 Hugging Face 上的 8B 和 35B 模型,同时追踪着关于 9B 变体的虚假传闻。

- 共识澄清目前没有这些模型版本用于运行推理的应用,并重申了它们的充分性。

- Cohere 迈向更清晰的认知:成员们热议 Cohere 遏制 AI 幻觉的计划,此前 Aidan Gomez 的分享 探讨了如何增强 AI 推理能力。

- CEO 的路线图并未涉及外部合作,而是强调自主开发。

- Rig 解决 Cohere 兼容性:随着 Rig 库宣布与 Cohere 模型 全面集成, Rust 爱好者们欢欣鼓舞,并鼓励通过 奖励评审计划 提供反馈。

- 贡献者可以通过提供改进 Rig 的见解来获得 100 美元的酬金,使其成为 LLM 驱动项目的核心组件。

Torchtune Discord

- 深入探讨数据驱动精度的 DPO:针对拥有稳健数据的数据集进行 DPO training 的益处引发了辩论,一些人考虑立即使用 DPO/PPO,而另一些人则表示 hesitation。建议在这些应用中使用 PreferenceDataset。

- 讨论强调 Socket experts 应该指导此类决策,并引用了过去在 llama2 和 Pythia 1B-7B 上进行直接 DPO/PPO 训练的成功案例。

- WandB 助力 Phi Mini 微调:一位 AI 爱好者成功微调了 Phi Mini (LoRA) 模型,并寻求关于 evaluating logs 的指导。共识是采用 WandBLogger 进行高级日志管理和可视化。

- 有人对 yaml configuration 的陷阱提出了警告,并强调了设置良好的 WandBLogger 对于防止错误和增强训练监督的重要性。

- 微调细节:日志与梯度治理:技术讨论涉及了 gradient size 的适当性,并建议根据数据集的具体情况进行调整。分享的日志引发了对 overfitting 迹象的审查,以及关于延长 training epochs 的讨论。

- 日志显示了 loss and learning rate 指标的异常,特别是在较小的数据集中,这突显了像 WandB 这样的工具在微调过程中提供清晰度的效用。

AI Stack Devs (Yoko Li) Discord

- Featherless 以固定费用起飞:最近推出的 Featherless.ai 提供基于订阅的访问权限,可以访问 Hugging Face 上提供的所有 LLM 模型,起价为每月 10 美元,无需本地 GPU 设置,详见此处。该平台在本地 AI 角色应用(如 Sillytaven)以及语言微调和利用 SQL 模型的需求方面,使用量有所增加。

- Text-to-Speech (TTS) 的诱惑:随着用户要求增强在线游戏中 NPC 语音多样性的呼声日益增高,Featherless.ai 考虑集成像 Piper 这样的 TTS 系统,同时保持对本地 CPU 设置无法运行的热门模型的关注。

- 带有 WSL README 的 Windows 智慧:新成员 Niashamina 通过创建一个使用 WSL 在 Windows 上运行 AI Town 的 README,为公会带来了 Windows wisdom,并提到了在不久的将来集成 Docker 的可能性。

- 虽然 Docker 的集成仍在进行中,且 README 的草案正等待在 GitHub 上首次亮相,但 Niashamina 调侃了它最终的实用性,暗示了他们正在开拓的动手实践式 Windows progress。

- Hexagen.World 的新地理瑰宝:一个简短但值得注意的公告揭晓了 Hexagen.World 提供的 fresh locations,扩展了该领域的虚拟景观。

- 此次发布并未深入细节,但为那些倾向于探索新增虚拟地形的人播下了好奇的种子,开启了通往 new localizations 的窗口。

Mozilla AI Discord

- Facebook 打造编译器能力:LLM Compiler 模型:Facebook 发布了其 LLM Compiler 模型,具备编译 C、优化汇编和 LLVM IR 的能力,现已由 Mozilla 便捷地打包成适用于各种操作系统的 llamafiles。

- 支持 AMD64 和 ARM64 架构的 llamafile 已由 Mozilla 上传至 Hugging Face,以提高其用户的可访问性。

- Llamafile 迈向官方化:Hugging Face 上的集成历程:为了让 llamafile 在 Hugging Face 上获得官方地位,贡献者们准备创建 Pull Request 来更新 model libraries 和相应的 code snippets 文件。

- 此次集成将通过在支持 llamafile 的仓库中添加按钮,并自动填充代码以无缝加载模型,从而优化用户体验。

- 技术规格揭秘:llamafile 的硬件要求:社区讨论了在各种设备上运行 llamafile 的可行性;然而,它需要 64-bit system,使得 Raspberry Pi Zero 无法参与其中。

- 虽然 llamafile server v2.0 的内存占用极低(使用 all-MiniLM-L6-v2.Q6_K.gguf 为 HTTP 客户端托管 Embedding 仅需 23mb),但对 iPhone 13 的支持仍未确认。

- llamafile v0.8.9 登陆 Android:Gemma2 获得支持:llamafile v0.8.9 发布,带来了官方 Android 兼容性,并完善了对 Google Gemma2 架构的支持,同时修复了 Windows GPU 提取问题。

- 新发布的 v0.8.9 版本还强调了服务器模式操作的进展,并巩固了 Google Gemma v2 的增强功能。

MLOps @Chipro Discord

- 聚焦 AI 工程领域的混乱:一场备受期待的 ‘From ML Engineering to AI(cntEngr)’ 活动录像 变成了一场数字捉迷藏,成员们遇到了 无效的 Zoom 链接 和访问码问题。

- 尽管做出了努力,社区仍无法获取录像,这凸显了 AI 工程领域在活动共享基础设施方面的差距。

- 流水线魔法研讨会奇迹:Data Talks Club 即将举行的 Zoomcamp 为 AI 工程师承诺了一场实战之旅,重点是使用 dlt 和 LanceDB 构建 开源数据流水线,计划于 7 月 8 日举行。

- 在来自 dltHub 的 Akela Drissner 指导下,参与者将深入研究 REST APIs、数据向量化和编排工具,旨在将流水线部署到包括 Python notebooks 和 Airflow 在内的各种环境中。

Datasette - LLM (@SimonW) Discord

- 数据库主导地位的竞争加剧:关于数据库的发展,dbreunig 强调了自 5 月 19 日 开始的一个显著趋势,显示竞争对手正在缩小与数据库技术领先者的差距。

- 评论表明 AI 数据库格局正在发生变化,多个参与者正在进步并争夺领先地位。

- 计算领域的追赶态势:在 dbreunig 最近的见解中,自 5 月 19 日 以来的数据表明领先的数据库竞争者之间的竞争日益激烈。

- 这一观察结果指出了一个关键时期,即竞争技术开始显示出显著增长,正在追赶行业领导者。

DiscoResearch Discord

- 陷入内存困境的程序员:一位工程师尝试在 50 GB 的海量语料库上训练 Panjabi 语言的 BPE tokenizer,但在拥有 1TB RAM 的机器上遭遇了 OOM 问题。他们通过分享类似的 GitHub issues 揭示了这一困境。

- 尽管 Pre-processing sequences 步骤在超出 len(ds) 后仍在继续,内存消耗却持续飙升,这暗示了

train_from_iterator函数可能存在故障,详见此 相关 issue。针对这一棘手问题,目前迫切需要技术见解或替代训练方法。

- 尽管 Pre-processing sequences 步骤在超出 len(ds) 后仍在继续,内存消耗却持续飙升,这暗示了

- 调试困境:深入 Rust 底层:为了破解 BPE tokenizer 训练过程中的 OOM 谜团,一位勇敢的程序员陷入了僵局,因为

tokenization_utils_fast.py中的train_from_iterator函数变得像一座无法攻破的堡垒。- 有推测认为问题可能源于可执行/二进制 Rust 代码,这一理论得到了社区其他遭遇者的支持,这让我们的工程师百思不得其解并寻求 专家援助。

LLM Perf Enthusiasts AI Discord 没有新消息。如果该频道长期沉寂,请告知我们,我们将将其移除。

AI21 Labs (Jamba) Discord 没有新消息。如果该频道长期沉寂,请告知我们,我们将将其移除。

YAIG (a16z Infra) Discord 没有新消息。如果该频道长期沉寂,请告知我们,我们将将其移除。

第 2 部分:频道详细摘要与链接

完整的频道分类详情已在邮件中截断。

如果你喜欢 AInews,请分享给朋友!提前感谢!