ainews-we-solved-hallucinations

我们解决了幻觉问题。

Reddit 的 URL 结构导致 AI 生成的摘要中出现链接错误,尤其是 NSFW(不宜在办公场所查看)内容会影响 Claude 和 GPT-4 等模型。 团队在修复这一故障的同时,仍继续利用大语言模型(LLM)来总结 Reddit 内容。得益于 H100 GPU 以及 CUDA 和 FlashAttention 等软件改进,GPT-2 的训练成本已大幅降至约 672 美元。 FlashAttention-3 正式发布,在 H100 GPU 上实现了高达 740 TFLOPS 的性能,FP8 精度下接近 1.2 PFLOPS;该项目由 Meta、NVIDIA、普林斯顿大学和 Colfax 合作开发。 Hopper 架构 GPU 凭借新的硬件特性实现了重大提速。近期研究表明,合成数据可能无法改善视觉任务。 Avocado360 基准测试用于评估视觉语言模型在图像中检测牛油果的能力。 Lynx 是一款针对大语言模型的幻觉检测模型,专为医疗保健和金融科技的实际应用而推出,由 Patronus AI 在 Databricks Mosaic AI 上使用 Composer 训练而成。

用一个奇招!

2024年7月11日至7月12日的 AI News。 我们为您检查了 7 个 subreddits、384 个 Twitter 账号 和 29 个 Discord 社区(463 个频道,2566 条消息)。 预计节省阅读时间(以 200wpm 计算):276 分钟。您现在可以标记 @smol_ai 进行 AINews 讨论!

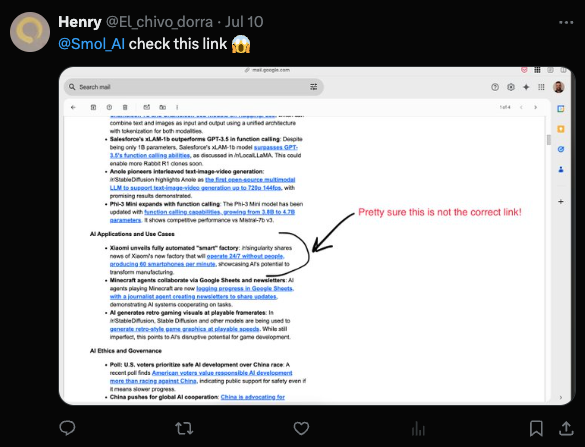

听着,我们早就知道我们的 Reddit 摘要中充斥着……呃……那些指向错误地点的链接。你们一直在提醒我们!(谢谢!)

这种情况在我们的 Reddit 摘要中比 Discord 或 Twitter 回顾中频繁得多的原因是 Reddit 的 URL 结构。

这是一个典型的 Reddit URL:

末尾的 slug(disappointing_if_true_meta_plans_to_not_open_the)只是试图根据标题生成一个人类可读的 slug,而开头的 subreddit(r/LocalLLaMA)同样是为了人类的可读性。在实践中,所有这些都会被忽略,取而代之的是“真正”的 slug,即那个 7 位的字母数字组合(1cxnrov)。在这里,我们将证明这一点:

https://www.reddit.com/r/SmolAI/comments/1cxnrov/ainews_is_the_best/

尽管更改了 subreddit 和人类可读的 slug,Reddit 仍会根据“真正”的 slug 将您引导至之前的同一篇帖子。

因此,Reddit URL 比大多数 URL 对 Attention 中的微小错误都更加极度敏感,即使我们只是要求 LLM 从引用链接拼写整齐的源文档中进行复制。

而且……Claude 和 GPT4 都在大量的 NSFW Reddit URL(涵盖多种语言!)上进行过训练。把这两个事实结合起来,你就能明白我们一直在处理什么样的问题了。

所以……我们着手修复了这个故障,同时仍然使用 LLM 对整个 Reddit 投稿和评论语料库进行格式化、筛选和摘要。如果你对我们的实现方式有猜想,请在 Twitter 上 @Smol_AI。

今天又是内容较少的一天,所以请欣赏我们与 Clementine Fourrier 关于 LLM Evals 的对话(我们 5 月份的报道)以及 Open LLM Leaderboard 的未来:

https://www.youtube.com/watch?v=E-UhbYc8m24

AI Twitter 摘要

所有摘要均由 Claude 3.5 Sonnet 完成,从 4 次运行中择优。

算力与硬件改进

- GPT-2 训练成本大幅下降:@karpathy 指出,由于 计算硬件 (H100 GPUs)、软件 (CUDA, cuBLAS, cuDNN, FlashAttention) 以及数据质量 (如 FineWeb-Edu 数据集) 的提升,现在在一台 8XH100 GPU 节点上训练 GPT-2 24 小时仅需约 672 美元,而 2019 年约为 100,000 美元。

- FlashAttention-3 发布:@tri_dao 宣布了 FlashAttention-3,其在 FP16 上速度提升了 1.5-2 倍,在 H100 上达到 740 TFLOPS (75% 利用率),FP8 接近 1.2 PFLOPS。这是与 Meta、NVIDIA、Princeton 和 Colfax 合作的成果。

- Hopper GPUs 实现重大加速:@tri_dao 指出 Hopper GPUs (H100) 具有 WGMMA、TMA 和 FP8 支持等新硬件特性,可实现重大加速。仅为这些特性重写 FlashAttention 即可达到 570 TFLOPS。

LLM 评估与基准测试

- 合成数据可能对视觉任务没有帮助:@giffmana 强调了一篇论文,显示在运行正确的基线时,合成图像实际上对视觉任务没有帮助。

- 用于评估 VLM 的 Avocado360 基准测试:@vikhyatk 介绍了 Avocado360 基准测试,用于评估视觉语言模型 (VLMs) 是否能判断图像中是否包含牛油果。评估了四个随机选择的 VLMs。

- 用于 LLM 幻觉检测的 Lynx 模型:@DbrxMosaicAI 宣布了 Lynx,这是一种新的 LLM 幻觉检测模型,特别适用于 医疗和金融科技等行业的实际应用。它由 Patronus AI 在 Databricks Mosaic AI 上使用 Composer 训练。

LLM 应用与框架

- Runway AI 自动化:@labenz 分享了视频生成初创公司 Runway 如何使用 AI 自动化任务,如预写销售邮件。他们的目标是 通过 AI 能力进行扩展,使员工人数永远不超过 100 人。

- 用于人机回环反馈的 LangGraph:@LangChainAI 展示了如何在 LangGraph 中添加人类输入检查点并更新图状态,以 实现 Agent 系统的用户反馈。

- 用于高级 RAG 的 Qdrant 和 LlamaIndex:@qdrant_engine 分享了一篇关于构建高级 RAG 架构的文章,该架构结合了 LlamaIndex Agent 与 Qdrant 的 混合搜索功能,同时使用稠密 (dense) 和稀疏 (sparse) 向量嵌入。

梗与幽默

- 对 ThinkPad 的热爱:@giffmana 开玩笑说:“最好的笔记本电脑是什么,为什么是 ThinkPad?”

- Token 限制的烦恼:@HamelHusain 在 Anthropic UI 上很快就达到了 Token 限制,即使是 Pro 计划也是如此,他想知道这是否正常。

- ML/DS 面试要求:@jxmnop 开玩笑说,到明年,ML/DS 面试将要求一道来自 ML LeetCode 的中等难度题、硬核 Prompt Engineering 以及五年的 CUDA 经验。

AI Reddit 摘要

涵盖 r/LocalLlama, r/machinelearning, r/openai, r/stablediffusion, r/ArtificialInteligence, /r/LLMDevs, /r/Singularity。评论抓取现在可以运行了,但还有很多改进空间!

主题 1. WizardLM 3 与 LLM 优化技术

-

[/r/LocalLLaMA] WizardLM 3 即将推出 👀🔥 (Score: 418, Comments: 73): WizardLM 3,一个即将推出的语言模型,即将发布。该公告暗示了显著的改进或新功能,尽管帖子中未提供有关模型能力或发布日期的具体细节。

-

[/r/LocalLLaMA] FlashAttention-3: Fast and Accurate Attention with Asynchrony and Low-precision (Score: 146, Comments: 22): FlashAttention-3 引入了一种在 Large Language Models (LLMs) 中计算 Attention 的新方法,在保持准确性的同时,比以往方法提速 2-4 倍。该技术采用了异步 IO (asynchronous IO) 和低精度计算 (low-precision computation),能够高效处理更长的序列,并可能支持训练具有更长上下文长度 (context lengths) 的更大型模型。这项由斯坦福大学和 NVIDIA 研究人员在 论文 中详述的进展,可能会显著影响更强大的 LLM 的开发和部署。

Theme 2. Advanced AI-Generated Visual Content

-

[/r/StableDiffusion] fal drops AuraFlow (Score: 322, Comments: 95): fal 推出了 AuraFlow,这是一款结合了 Stable Diffusion 和 Midjourney 优势的新型图像生成模型。AuraFlow 旨在提供高质量的图像生成,并改进连贯性 (coherence) 和构图 (composition),解决如面部和手部畸形等常见问题。该模型目前可通过 fal 的 API 获取,并将集成到其无代码 AI 应用构建器 (no-code AI app builder) 中。

-

[/r/StableDiffusion] AnimateDiff and LivePortrait (First real test) (Score: 580, Comments: 66): AnimateDiff 和 LivePortrait 的集成展示了从静态图像创建动画肖像的潜力。该过程涉及使用 AnimateDiff 从单张图像生成 16 帧动画,然后将其输入 LivePortrait 以产生更真实的动画效果。这种工具组合展示了一种通过流体、自然的动作让静态图像焕发生机的极具前景的方法。

-

[/r/singularity] Al-Generated Movie Trailer (Score: 157, Comments: 41): AI 生成的电影预告片展示了电影制作中先进的视觉能力。该预告片使用人工智能创建,展示了通常与高预算制作相关的逼真 CGI 角色、动态场景过渡和复杂的视觉效果,突显了 AI 通过降低成本和扩大创意可能性来彻底改变电影行业的潜力。

Theme 3. AI Progress Tracking and Benchmarking

-

[/r/OpenAI] OpenAI Develops System to Track Progress Toward Human-Level AI (Score: 232, Comments: 75): OpenAI 推出了一套名为 AI Preparedness Framework 的新系统,用于监测和评估向人类水平人工智能 (human-level AI) 迈进的进度。该框架旨在通过 5 级量表(从窄域 AI 到 AGI)评估 AI 系统在 12 项关键能力上的表现,包括语言理解、推理和任务完成。这一举措是 OpenAI 负责任地开发先进 AI 系统并为政策制定者提供有关 AI 进展的见解所做努力的一部分。

-

[/r/singularity] Rorschach test for AI: is this good or bad? (Score: 110, Comments: 152): 针对 AI 的罗夏墨迹测试 (Rorschach tests) 被提议作为一种评估 AI 能力的方法,特别是在图像解释和推理方面。该概念建议使用类似于传统罗夏墨迹测试的模糊图像,来评估 AI 感知、解释和解释视觉信息的能力。这种方法可能会揭示 AI 认知过程和局限性的见解,但也引发了关于此类评估对人工智能系统有效性和可靠性的质疑。

Theme 4. AI Content Regulation and Copyright Issues

-

[/r/StableDiffusion] 专注于 AI 的 COPIED 法案将使删除数字水印成为违法行为 (Score: 136, Comments: 155): “参议员提出 COPIED 法案以打击 AI 内容滥用”。由一组参议员提出的 COPIED 法案 旨在通过建立 内容认证和 AI 生成材料检测 标准,打击 AI 模型对内容的未经授权使用。该法案将使 删除数字水印成为违法行为,允许内容所有者 起诉未经许可使用其作品的公司,并要求 NIST 制定 内容来源证明 和 合成内容检测 的标准,同时禁止使用 受保护内容来训练 AI 模型。该法案得到了 SAG-AFTRA 和 RIAA 等行业团体的支持,是监管 AI 技术更广泛推动的一部分,并授权各州总检察长 (AGs) 和 FTC 执行其条款。

-

[/r/LocalLLaMA] AI 的危险并非大多数人所想的那样。 (Score: 100, Comments: 115): AI 的真正危险源于过度评估,而非超级智能。该帖子认为,AI 的真正危险不在于其成为超级智能的潜力,而在于其当前的 局限性被忽视。作者指出,AI 正被部署在一些其 缺乏智能 可能会引发问题的领域,并引用了 AI 生成的虚假法律案例 和 自动驾驶汽车中存在偏见的行人检测 作为例子。他们还认为,围绕 AI 安全的大部分讨论是由 “护城河建设” (moat-building) 和保护 先发优势 (first-mover advantages) 驱动的,而非真正的担忧。

AI Discord 摘要

摘要的摘要之摘要

1. LLM 进展与训练技术

- FlashAttention 加速 Transformer 训练:FlashAttention-3 的发布承诺在 FP16 上实现高达 1.5-2 倍的速度提升,在 H100 GPUs 上达到 740 TFLOPS,实现 75% 的利用率,并在使用 FP8 时可能达到 1.2 PFLOPS。

- 这项技术由 Colfax、Tri Dao、Meta AIT 团队 和 Cutlass 团队 共同开发,通过最小化注意力机制中的内存读写,已经加速了 GPT-4 和 Llama 3 等模型的训练。

- Q-Galore 增强内存高效的 LLM 训练:新型 Q-Galore 方法 结合了量化和低秩投影,与 GaLore 相比,显著减少了大型语言模型的内存占用和训练时间。

- 与依赖耗时的 SVD 操作的 GaLore 不同,Q-Galore 观察到某些梯度子空间会提前收敛,而其他子空间则频繁变化,从而在不牺牲准确性的情况下实现更高效的训练。

- Llama 3 405B 多模态模型即将发布:据 报道,Meta Platforms 将于 7 月 23 日(Llama 2 发布一年后)发布其参数量最大的 Llama 3 模型,拥有 405B 参数,并作为 多模态 (multimodal) 产品提供。

- 这一发布引发了社区的热烈讨论,重点围绕运行如此巨大的模型所需的 基础设施要求,例如 8x H100s 或 8x MI300X GPUs。

2. 开源 AI 进展

- AuraFlow:最大的开源 Text-to-Image 模型:由 Fal AI 开发的 AuraFlow 已作为最大的开源 Text-to-Image 模型发布,采用 Apache 2.0 许可证,已在

diffusers中获得支持,并在 GenEval 上取得了 state-of-the-art 的结果。- LoRA support 即将推出,目前模型处于 beta 阶段,社区反馈至关重要。感谢 @cloneofsimo 和 @isidentical 做出的重大贡献。

- Cohere Toolkit 走向开源:Cohere 在 GitHub 上开源了他们的 chat interface,并计划进行 OCI integration,正如 Sssandra 所宣布的那样。

- Mapler 对将该开源工具包用于个人项目表示兴奋,并将向社区更新进展。

- OpenArena 促进 LLM Dataset 增强:GitHub 上的 OpenArena 项目 让语言模型相互竞争,并由第三个模型担任裁判,通过竞争性挑战来提高 dataset 质量。

- 受关于 Arena Learning 的 WizardLM 论文 启发,OpenArena 利用 AI 标注的结果进行 LLM 的 supervised fine-tuning 和 reinforcement learning。

3. Community Collaboration and Knowledge Sharing

- LlamaIndex 发布 Agentic RAG Cookbooks:LlamaIndex 与来自 AIatMeta 的 @jeffxtang 合作发布了 关于 agentic RAG 的 cookbooks,涵盖了从 routing、tool use 到 multi-document agent 构建的主题。

- 此外,由 @tb_tomaz 和 Neo4j 提供的 Cypher snippet 可以有效地执行 entity deduplication,辅助知识图谱(knowledge graph)的创建,该内容已分享在 Neo4j GitHub 上。

- 用于 Continued Pretraining 的 Unsloth Notebooks:Unsloth 提供了用于通过 Ollama 和 Hugging Face 模型训练本地模型的 notebooks,并处理了跨不同序列长度的 continued pretraining。

- 社区讨论了针对不同

max_seq_length的 concatenation 和 truncation 技术,以及在 LoRA 和 PEFT 设置中理解参数差异。

- 社区讨论了针对不同

- LangChain 优化与最佳实践:LangChain 社区分享了 embedding functions 的优化技术,例如使用 caching mechanisms(in-memory 或 Redis)以避免重复计算 embeddings,并考虑使用 async requests。

- 讨论还涉及了处理大型数据集时 FAISS vs Chroma 的选择,结合两者的优势:使用 Chroma 进行 persistence,使用 FAISS 进行 similarity search,并提高 LangChain agent 的效率。

4. Hardware Benchmarking and Adoption

- 评估 AI 工作负载的 GPU:讨论对比了 3090 vs 4090 GPUs 在 AI 工作负载中的价值主张,由于代际性能提升相对较小,许多人更倾向于性价比更高的 3090。

- 关于即将推出的 NVIDIA 5090 仅有 28GB VRAM 而非 32GB 的传闻,引发了使用 3090 构建经济实惠的 multi-GPU servers 以增加 VRAM 容量的建议。

- H100 GPU 的兴奋与采用挑战:H100 GPUs 的到来引起了极大的兴奋,成员们惊叹于 ‘H100 go brrrrr’,并讨论了相比前几代产品的显著性能提升。

- 然而,有人担心 Flash attn3 目前仅限于 H100 支持,希望它能遵循 Flash attn2 的路径,扩展到 3090 和 4090 GPUs。

- 本地 AI 模型基准测试:一位成员分享了他们的 个人基准测试表,涵盖推理、STEM、coding 和 censorship 类别,使用加权评分系统评估了 83 个任务中的各种本地 AI 模型。

- 虽然这不代表更广泛的基准测试,但该表提供了一个人的经验见解,并突显了社区对全面模型评估日益增长的兴趣。

PART 1: High level Discord summaries

HuggingFace Discord

- RT-DETR 领先于 YOLO:RT-DETR 在速度和准确性上超越了 YOLO,并与 Roboflow 联手推进目标检测,现在可以通过 transformers 库 无缝访问。

- 该模型的优势在一篇研究论文 (https://arxiv.org/abs/2304.08069?ref=blog.roboflow.com) 中得到了证实,支持将 RT-DETR 集成到现有工作流中并提升检测任务的表现。

- 利用 Hiera 模型提升效率:transformers 库现在包含了一个变革性的视觉模型 Hiera,它简化了层次结构的复杂性,并在图像分类等性能任务中表现出色。

- Hiera 的灵活性体现在其多种实现中,包括 HieraForImageClassification 和 HieraBackbone,详见 GitHub Pull Request。

- 工具包精简 LLM 微调流程:Georgian-io 工具包 首次亮相,旨在简化多个 LLM 的微调,简化端到端的数据科学流程。

- 这是一个多功能工具包,它支持通过统一的 config 运行批处理实验、评估指标,并执行超参数和 Prompt 消融实验。

- AuraFlow 景观可视化:AuraFlow 被誉为最大的开源 text-to-image 模型,最近因其在 GenEval 中表现出的出色结果而备受关注,并得到了

diffusers的支持。- 随着 LoRA 支持 即将到来,官方鼓励通过 fal 的 Discord 进行持续开发和社区反馈,为进一步增强功能铺平道路。

- qdurllm Demo 展示新能力:qdurllm demo 展示了直观输出方面的飞跃,并邀请社区对其先进的交互模型提供反馈。

- 该产品为潜在的新兴用例以及集成化、可访问的进步开启了对话。

Stability.ai (Stable Diffusion) Discord

- ComfyUI Reactor 恢复安装:参考 YouTube 视频 提供了无错安装 ComfyUI InsightFace 的解决方案。

- 这一变通方法已得到用户确认,对 2024 年发布的版本依然有效。

- Deforum 深入研究独特的色彩动态:为了微调抽象视频的美感,讨论了在 Deforum Stable Diffusion API 中将

color_coherence设置为 None 作为增强色彩过渡的潜在方法。- 征集社区意见以优化视觉项目中的鲜艳度和清晰度。

- auto1111 上的生成中断查询:用户在 auto1111 设置中遇到了停止生成过程的显著延迟,将其归因于 VRAM 限制和软件细微差别。

- 有人将其比作高速列车的逐渐减速,强调了在突然停止期间需要耐心。

- 分析 AI 工具的性价比:社区讨论了商业 AI 工具(如 Runway,提供每月 $90 的方案)的成本,并与免费的本地 AI 选项进行了对比。

- 尽管免费工具很有吸引力,但成员们认识到高级服务通常能提供更卓越的功能和增强的特性。

- 扩大放大规模:追求免费工具:对免费创意图像 upscaling 工具的搜索促成了对 Krita 和 GIMP 等易于获取的软件的推荐。

- 这些替代方案因其有用的功能且没有经济门槛而受到称赞,符合社区注重资源的偏好。

CUDA MODE Discord

- FA3 的胜利与 CUDA 的担忧:一场激烈的辩论评估了 FA3 vs cuDNN 和 ThunderKittens 的优劣,揭示了尽管 FA3 在 Attention 机制中具有潜在的加速诱惑,但人们更倾向于简单和易用性。

- 围绕 FP8 实现障碍 的技术担忧以及 ThunderKittens 中不存在的 FP8 轨道,引发了对维护复杂性的评估。

- 评估 GPU 访问选项:成员们赞扬了 Google Colab 无缝的 GPU 访问,同时比较了租用 GPU 时 Coreweave 和 Lambda Labs 的优缺点,强调了价格和分配问题。

- 讨论强调 Google Cloud GPU 是笔记本以外用途中更昂贵但更强大的选择,提升了 Colab 在钻研 CUDA kernels 时的易用性地位。

- 优化矩阵乘法:对话探讨了矩阵乘法中有效的线程分配策略,建议由于内存布局的原因,每行一个线程在缓存和数据加载方面效率更高。

- 随着有关内存排列的见解浮现,“合并 (coalescing)”的概念成为焦点,强调了在最后一个矩阵维度上进行归约 (reducing) 的效率。

- AI 训练中的创新策略:成员们讨论了在 FSDP 中使用 tensor subclass 的可行性,因为像 bitnet work 这样新兴项目暗示了分布式训练中不断增长的应用。

- 社区认可了持续的贡献,并准备合作制定一份 启用 tensor subclass 的开发者指南,以应对未来的需求。

- LLM.C 内部的协作与增长:LLM.C 社区 正忙于围绕模型共享和资源整合的倡议,这在 Hugging Face 上组织结构的创建中可见一斑。

- 分享了关于执行优化和微调大规模模型的见解,还激发了关于 FP8 带来 33% 速度提升 的想法,尽管需要考虑内存重用。

Modular (Mojo 🔥) Discord

- LLVM 创始人的纪事:最近一段采访 LLVM、Clang、Swift 和 Mojo 创始人的 Primeagen 视频 在 YouTube 上公开后引发了讨论。

- 参与者指出,详细的见解对于理解 Mojo 创作背后的开发哲学是非常棒的资源。

- Mojo 的 REPL 迭代:围绕 Mojo REPL 缺乏表达式立即输出的争论不断,并将其与 Python 的 REPL 行为进行了比较。

- 尽管当前功能不会直接显示像

1+1这样的结果,但建议成员通过 GitHub issues 提交请求以整合这些功能。

- 尽管当前功能不会直接显示像

- MAX 网站改版拥抱清晰度:Modular 的 MAX framework 占据了 改版后网站 的核心位置,强调了其广泛的开发者基础和清晰的许可条款。

- 该网站展示了 Max 的性能实力与 Mojo 语言提供的易用性之间的协同作用,而无需深入底层编码。

- 通过 Mojo 的 MAX 获得 GPU 收益:出现了一场关于在 MAX 中使用 Mojo 编写自定义 GPU kernels 以增强性能的有前景的对话。

- 这为利用 MAX 强大的接口和 Mojo 敏捷的 kernel 编译开辟了道路,而无需直接涉及 CUDA。

- MAX Model 执行中的数据类型差异:在执行 MAX Model 时出现了 数据类型问题,导致在使用

PythonObjects时预期与实际结果不匹配。- 将

np.full()操作的dtype修正为np.float32提供了解决方案,强调了模型执行参数中所需的精度。

- 将

Unsloth AI (Daniel Han) Discord

- Gemini 随 Token 扩展而飞跃:Gemini 1.5 Pro 拥有 200 万 Token 窗口,并引入了 context caching 和 code execution 功能。

- AI 开发者对无限制的 JSON 容量感到兴奋。

- FlashAttention 在 Hopper GPU 上疾驰:FlashAttention-3 承诺实现高效的 Hopper GPU 利用率,FLOPs 利用率高达 35%,详见 Tech Blog。

- “大幅提升 FLOPs 利用率”仅限于 Hopper 用户。

- TF-ID 模型瞄准视觉语言任务:胡一飞(Yifei Hu)发布了 TF-ID 模型,包括训练代码、数据集和权重,采用 MIT License,适用于视觉语言任务。

- 这些模型仅需几百个特定领域的元素即可进行 finetune。

- CodeGeeX4 削弱了 GPT 的优势:新的 CodeGeeX4-ALL-9B 模型在代码生成能力上盖过了 GPT-3.5 和 GPT-4。

- 该模型实现了顶尖性能,拥有 128k context,并支持多种编程语言。

- Meta 备受期待的 LLaMA 3 亮相:Meta Platform 计划于 7 月 23 日发布其 LLaMA 3 模型,这可能会带来显著的 AI 进展,引发了广泛关注。

- 此次发布(详见此处)可能会重塑 AI 应用部署的硬件偏好。

Nous Research AI Discord

- OpenAI 预告博士级别的突破:OpenAI 暗示即将推出的模型将具备等同于博士学位的解题能力,引发了关于接近 AGI 的讨论。

- 一位匿名人士泄露了 GPT-4 的演示视频,展示了其先进的类人解题能力。

- Anthropic 的 AI 预测:Anthropic 的 Dario Amodei 预测了即将到来的 AI Safety Levels,暗示 A.S.L. 3 可能最早在今年出现,而 A.S.L. 4 将在 2025-2028 年间出现。

- A.S.L. 4 引发了对生物和网络技术滥用可能加剧全球风险的警示。

- 社区质疑 OpenAI 的策略:在潜在突破的消息中,社区中出现了对 OpenAI 战略性发布模式的怀疑声音。

- 讨论围绕着 OpenAI 的预告可能是一种旨在提高估值的手段,尽管他们之前已经取得了成就。

- 用 llm.c 玩转 GPT-2:Karpathy 展示了使用 llm.c 高效复制 GPT-2 (1.6B) 的过程,兼顾了性能与成本效益。

- 该实现证明了 llm.c 进行大规模语言模型训练的能力,仅需 24 小时即可完成。

- C++ 带来的简单与安全:Safetensors.cpp 作为 LibTorch 的零依赖 C++ 库首次亮相,减轻了模型开发中的数据处理负担。

- 目标很明确:简化模型数据流程,确保工作流更加顺畅且高效。

Perplexity AI Discord

- Perplexity Labs:用还是不用?:关于 Perplexity Labs 实用性的辩论激增,社区成员剖析了其在不同设备上的通用性。

- 利弊分析被广泛讨论,重点关注了 Labs 的集成优势,并质疑其相对于移动端使用与 Web 界面的优势。

- Claude 3.5 碾压 Claude 3 Opus:Claude 3.5 在推理和逻辑方面优于其前身 Claude 3 Opus 的卓越表现引起了所有人的关注,预示着模型主导地位的转变。

- 虽然对 Claude 3.5 的赞誉是一致的,但人们对 Opus 3.5 等未来版本重新平衡局势的潜力产生了猜测。

- AI 成为糖尿病管理的灯塔:用于糖尿病管理的 AI 成为焦点,讨论围绕协助患者和医生的 App 展开,重点在于洞察推导而非仅仅是胰岛素调整。

- 最近的进展得到了关注,这些进展不仅提供自动胰岛素给药,还提供预测性见解,重塑了患者护理。

- Error 524 阴云笼罩 Perplexity API:AI 工程师报告称,在将 Perplexity 与异步框架集成时,尽管保持在规定限制内,仍偶尔出现 Error 524。

- 切换模型增加了难题,在

llama-3-{8b/70b}-instruct到llama-3-sonar-{large/small}-32k-online之间的转换导致了类似的错误,令用户感到困惑。

- 切换模型增加了难题,在

- Cloudflare 引发 Perplexity API 动荡:排错过程揭示了 Cloudflare 是罪魁祸首,它导致了 VPN 访问 Perplexity API 被阻断,这对许多人来说是一个新发现。

- 虽然有些人感到困扰,但其他人发现绕过 VPN 是有效的解决方法,恢复了访问并平息了这场风波。

Eleuther Discord

- GPT-4Chan 终结了 TruthfulQA 的统治地位:来自 Maxime Labonne 的推文重新引发了关于 GPT-4Chan 尽管在 ChatGPT 出现后仍曾在 TruthfulQA 上占据主导地位的讨论。

- 参与者一致认为,像 TruthfulQA 这样的一些基准测试可能会误导,而像 MT-Bench 这样的基准测试被认为更能反映真实性能。

- Jsonnet,配置界“必要的恶”?:虽然 Jsonnet 因其精简的配置能力而受到赞赏,但一场讨论揭示了它在调试方面的不足,导致用户对其爱恨交织。

- 尽管面临挑战,Jsonnet 因其简洁性而在各种配置任务选项中脱颖而出,其作用得到了认可。

- 伦敦 AI 聚会未达预期:论坛上表达了对伦敦 AI 聚会的失望,反映出它们对于寻求更深层次 AI 探讨的人来说还不够。

- 建议指向学术研讨会和诸如 ICML 之类的会议,以满足对更实质性技术集会的渴望。

- LLM 面临简单但严峻的挑战:更新后的 Alice in Wonderland 论文 揭示了一些简单的谜题,这些谜题难倒了像 Claude 3.5 Sonnet 这样的 SOTA 模型。

- 围绕 SOTA LLM 无法处理简单修改的讨论,突显了对稳健基准测试的需求,并增强了我们对模型局限性的理解。

- 内存带宽:GPT-2 训练的限制因素:讨论围绕在一小时内使用万亿级 Token 数据集训练 GPT-2 模型所需的 1000 倍内存带宽放大要求展开。

- 焦点转向 Hadamard 变换,将其作为量化难题的创新解决方案,详见 Together 的博客文章。

Latent Space Discord

- FlashAttention-3 激发 GPU 性能:FlashAttention-3 现已发布,承诺在 FP16 上实现 1.5-2 倍的速度提升,在 H100 GPUs 上达到高达 740 TFLOPS。

- 据报道,新版本在 H100 上实现了 75% 的利用率,并有可能在使用 FP8 时达到 1.2 PFLOPS。

- OpenAI 利润丰厚的账目:根据最近的一份报告,OpenAI 的收入预计将达到 19 亿美元,其中 ChatGPT Plus 领跑。

- 这一推测突显了 OpenAI 可能在行业中处于领先地位,其 ChatGPT Enterprise、API 和 Team 产品的数据表现令人印象深刻。

- OpenAI 揭晓 AGI 框架:OpenAI 发布了一个用于追踪 AGI 的 5 级框架,并将自己定位在第 2 级。

- GPT-4 的推理能力在最近的一次会议上得到了展示,表明了该战略框架中概述的进展。

- 去中心化 AI 训练起飞:Prime Intellect 的 OpenDiLoCo(借鉴自 DeepMind 的模型)支持在全球节点上进行分布式 AI 训练。

- 一个成功的案例涉及一个在三个不同国家的多个节点上训练的 1.1B 参数模型。

- Fireworks 在 AI 融资领域崭露头角:Fireworks AI 最近为其旨在推进复合 AI 系统发展的平台获得了 5200 万美元的 B 轮融资。

- 资金将用于 Nvidia 和 AMD 的集成,并量身定制企业级 AI 解决方案。

LangChain AI Discord

- 使用 Indexify 进行无缝合成:Prashant Dixit 在 Towards AI 的出版物中重点介绍了从非结构化源中进行结构化数据提取的方法。

- 介绍了使用 Indexify 创建数据摄取和提取流水线的方法,更多见解请参阅 Towards AI 的文章。

- 向量优势:Chroma 优于 OpenAI:讨论围绕正确加载带有 OpenAI embeddings 的 Chroma 向量存储所需的配置展开,强调了为了无错运行而保持一致的

collection_name。- 参与者探索了持久化存储策略以及对嵌入文档的有效管理,以减少冗余计算。

- 光速 Embeddings:交流了加速 OpenAI embedding 函数的技术,缓存策略是核心,范围从 in-memory 到使用 Redis 等工具。

- 改进嵌入过程的方法包括减少 token 加载和利用异步嵌入请求。

- FAISS 还是 Chroma:数据集的抉择:随后展开了关于 FAISS vs Chroma 的辩论,倾向于使用 FAISS 高效处理大规模数据集,而 Chroma 则因其在小规模集合中的持久化能力而受到青睐。

- 一种结合了 Chroma 持久化存储和 FAISS 相似性搜索的混合方法被认为是一种有效的解决方案。

- LangChain Agents 的进展:剖析了关于 LangChain agents 不必要的重新嵌入(reembedding)挑战,重点关注最小化向量存储初始化时间。

- 提议的解决方案涵盖了持久化机制以及其他各种改进,以增强 LangChain agents 的运行。

LM Studio Discord

- FlashAttention 点燃 LLM 性能:一项技术回顾揭示了 FlashAttention 及其后续版本如何简化 Transformer 训练,通过优化的内存操作大幅增加了 GPT-4 和 Llama 3 的上下文长度。

- NVIDIA 的 4090 相比 3090 仅有微小提升,但 FlashAttention 技术的加入引发了关于在新方法的内存管理效率下,是否真正需要高端显卡的讨论。

- 关于 NVIDIA 下一步行动的传闻:传言暗示 NVIDIA 5090 仅配备 28GB VRAM,而非预期的 32GB,这引发了广泛猜测;同时一篇 Reddit 帖子 提供了一个获取海量 VRAM 的 DIY 替代方案。

- 虽然关于 3090 更好的性价比仍有争论,但多 V100 设置作为 AI 任务有力竞争者的可能性也得到了剖析,讨论倾向于使用单一高性能 GPU 构建以获得最佳周转效率。

- Vulkan 迎来支持浪潮:由于 OpenCL 表现滞后,无法在 7600XT 上加载模型,逐渐在 AI 工作中失宠,有传言称 Vulkan 将进入 LM Studio 的支持列表,承诺为模型交互带来新体验。

- 讨论指出 Vulkan 的受欢迎程度正超越 OpenCL,这对 ollama 用户来说是一个受欢迎的变化,但在热切期待中,具体的发布日期仍未确定。

- 爱因斯坦品牌引力:Salesforce 投入了高达 2000 万美元 将其新 AI 模型命名为 Einstein,这引发了业内的各种调侃,以及对这笔投资明智性的审慎评估。

- 现场充满幽默气氛,有人生动地想象 Einstein 的形象被困在公司框架中,并对 AI 品牌束缚可能成为梗的潜力发表了俏皮话。

- 使用 LM Studio 进行响应式 AI 开发:一项创意尝试出现,一名工程师通过 LM Studio 的 API 将 Gemma 2 集成到 React 应用程序中,并建议考虑使用像 Faiss 这样的 embedding 数据库进行 RAG 设置,以优化批量 PDF 处理。

- 随着开发者交流成败经验并倡导社区内更具同理心的支持,LM Studio 的 SDK 被推崇为将前沿 AI 融入具有丰富用户交互应用的得力助手。

OpenAI Discord

- 去中心化为芯片赋能:讨论集中在去中心化计算对 AI 任务的好处,利用 stable diffusion 和未被利用的闲置处理能力来优化 CMOS 芯片。

- 用户呼吁通过去中心化扩展高性能计算 (HPC) 能力,从而实现精细的并行计算。

- OpenAI 的下一代 AI 蓝图:OpenAI 揭示了一个新的层级系统,描述了从具有博士级问题解决能力的 ‘Reasoners’ 到具有更广泛能力的 ‘Agents’ 和 ‘Organizations’ 的进展。

- Claude 因其在文档理解方面优于 ChatGPT 而受到关注,这表明人们对上下文长度的关注度日益提高。

- ChatGPT-5 的期待达到顶峰:GeekyGadgets 的消息暗示 ChatGPT-5 测试将于 2024 年底开始,引发了用户的兴奋与怀疑。

- 预期的 ChatGPT-5 功能包括增强的情绪智力、减少指令重复以及可能涉足多模态能力。

- 对 ChatGPT-4o “健忘症”的担忧日益增加:用户反映虽然 ChatGPT-4o 速度很快,但经常忘记最近的指令,质疑其在编程等任务中的效能。

- 对 v3.5 记忆能力的怀旧突显了性能速度与操作召回率之间的权衡。

- RAG 聊天机器人提示词微调:开发者正在微调 RAG 聊天机器人的指令,旨在减少收到奇怪或矛盾答案的可能性。

- 社区建议提高聊天机器人提示词的清晰度,以确保有效且逻辑严密的交互。

Cohere Discord

- Command R Plus 的实际应用场景揭晓:由 Mapler 领导的社区成员们集思广益,探讨了 Command R Plus 模型的实际应用,涵盖了社交媒体内容创作、播客描述撰写以及团队沟通增强。

- 值得注意的是,Sssandra 强调了她日常将该模型与 Notion 和 Google Drive 集成,以方便处理社区咨询。

- 利用 Cohere 实现自动更新革命:目前正在讨论如何利用 Command R Plus 和 Lang chain,通过 Discord 中的 webhooks 自动推送 AI 新闻,Mapler 正领导这一计划。

- Karthik_99_ 已主动提供帮助,建议可以集成类似 chat-GPT 的界面,目前正等待社区反馈。

- Cohere 工具箱进入开源生态系统:Sssandra 自豪地分享了 Cohere 的聊天界面已在 GitHub 上开源的消息,并预告了即将进行的 OCI 集成。

- Mapler 表现出极大热情,打算将其用于个人项目,并向社区更新进展。

- 追求 AI 生成的独特表情符号:Roazzy 发起了关于开发 AI 驱动工具来创建独特表情符号的讨论,目前的方法还局限于手动创作。

- Karthik_99_ 询问了现有解决方案,强调了该功能在用户驱动型平台中的潜力。

- Cohere Embedding Model 在成本效益上的突破:一位成员发布消息称 Cohere’s embedding model 已将运营成本大幅降低了 40-70%,引发了热烈讨论。

- 该公告获得了社区的一致好评,表达了对这种高性价比进展的赞赏。

Interconnects (Nathan Lambert) Discord

- Llama 向更大规模学习的跨越:拥有 405B 参数的 Llama 3 即将于 7 月 23 日 发布,引发了广泛期待。该模型被设计为更强大的 Multimodal 模型,详情见此简报。

- 从 Llama 2 到 3 的飞跃加速了通往复杂 AI 的道路,引发了围绕支持性基础架构的讨论,正如 Stephanie Palazzolo 所发并被社区频道转发的内容。

- OpenAI 神秘的 Strawberry 策略:关于 OpenAI’s Strawberry 项目的泄露信息显示,它与斯坦福大学 2022 年的 STaR 方法有相似之处,突显了 AI 推理技术的进步,据 Reuters 报道。

- 社区对这一秘密行动充满了猜测和分析,认为这可能成为 OpenAI 追求更具上下文理解能力和连贯性 AI 模型过程中的一个重要里程碑。

- Self-hosting 大模型:一种特权式的困境:深入探讨 Self-hosting 400B 参数模型的物流需求后发现,需要大约 400GB VRAM。这使得对话转向了资源可用性,并倾向于在自有硬件不足时使用 API。

- 这种情况让 GPU 租赁的超大规模算力提供商(Hyperscalers)备受关注,尤其是当不涉及私有数据关注时,这是从技术社区对托管复杂性和 API 优势的剖析中得出的结论。

- Distillation 难题:Sequential Soft-targeting:著名论文中描述的 Soft-target distillation 过程正受到审视,有人提问关于在保持概率的同时进行 Sequential 处理的可能性。

- 社区反馈指向了一些替代策略,例如在在线建模过程中对齐内部表示(Internal Representations),以及这可能如何简化现有方法。

- GPT-4:价格优于性能?:在各种 AI 服务中,GPT-4 以 每月 20 美元 的价格脱颖而出,成为卓越模型的代表,使竞争对手的低价替代方案显得黯然失色。

- 诸如 aaron holmes 的推文进一步推动了对比讨论,聚焦于 AI 模型估值、企业选择和消费者偏好的持续对话。

tinygrad (George Hotz) Discord

- tinygrad 的索引精通:George Hotz 在 tinygrad 中引入了一种创新的索引内核,这是一种打破常规的补充,通过创新性地折叠求和循环(sum loop)绕过了典型的限制。

- 这种后端生成的方法确保了严格且高效的内存访问子集,优化了内核性能。

- 借鉴 PyTorch 路线图规划航向:一名成员建议效仿 PyTorch 分享的 2024 H2 计划,主张采取精确且开放式的开发策略。

- 其目标是镜像 PyTorch 的透明路径,为增长和开发提供清晰的基础。

- tinygrad 中的梯度下降困境:从头开始实现梯度下降的尝试遇到了阻碍,一名成员指出在没有定义

optimizer.step的情况下过程非常缓慢。- 他们寻求优化缓慢步骤的见解,参考了 代码样本 和 George Hotz 的手动实现策略。

- 优化张量操作:Hotz 的命令

model.weights.assign(model.weights - lr * model.weights.grad).realize()简化了张量操作(高效梯度下降的关键组件)。- 正如 George Hotz 所言,理解 realization 的必要性成为了计算实例化的关键。

- 解决张量索引 Bug:在处理张量操作时,一个断言错误暴露了张量索引中的 Bug,导致了 “idx.max too big” 的复杂问题。

- 参与此次调试会议凸显了社区在完善 tinygrad 内核效率方面的作用。

OpenAccess AI Collective (axolotl) Discord

- H100 GPU 引发性能热潮:H100 GPU 在成员中引发了一波热情,反馈强调了其在性能能力上的重大飞跃。

- H100 系列的迅捷性能预示着计算能力的新基准,显而易见地超越了其前代产品。

- 奖励模型中的 Attention Masking 受到审视:Attention Masking 在 reward_health_models 中的作用和影响成为辩论话题,社区寻求其必要性的澄清。

- 虽然关于其与 axolotl 特定训练方法相关性的疑问依然存在,但开放式讨论标志着对该技术的持续探索。

- OpenRouter 与 OpenArena 的连接受到关注:社区成员对集成 openrouter.ai API 以开发 WizardLM arena 数据集 的开源等效版本表现出兴趣。

- 其中提到使用 ollama 开发社区驱动的 OpenArena 项目 取得的进展,强调了协作开发。

- Flash Attention 兼容性引发疑问:Flash attn3 的兼容性问题引发了讨论,并指出了对 H100 GPU 的限制。

- 人们对更广泛的 GPU 支持寄予厚望,正如之前 Flash attn2 更新适配了 3090 和 4090 一样。

- GaLore vs. Q-Galore:量化占据领先:讨论强调 Q-Galore 是 GaLore 的高效继任者,采用量化技术缩短训练时间,详情见 Hugging Face 论文。

- Q-Galore 的方法在继承 GaLore 策略的同时避免了 SVD 的时间开销,成为处理梯度子空间的重要升级。

OpenRouter (Alex Atallah) Discord

- DeepInfra 数据困境讨论:一名成员对 DeepInfra 的数据政策表示担忧,引发了关于公司如何处理从用户输入中获取的训练数据的讨论。

- 讨论明确了 DeepInfra 会记录使用情况,但不会利用用户输入进行训练,详情见其 隐私政策。

- Beta 集成功能吸引更智能的机器人:关于 Integrations (Beta) 功能的讨论展开,重点在于为 Groq 等外部提供商使用自定义 API key。

- 对话预期未来的扩展可能会探索模型 API 之外的集成,引发了对潜在应用场景的好奇。

- 为挑剔的模型优化 Prompt 位置:成员们交流了提高模型性能的技巧,包括建议将文本 Prompt 置于图像之后,以辅助能力较弱的模型。

- 据报道,这种放置技术可以增强理解力,并让能力较低的模型给出更好的回复。

- 405b 的到来激发 AI 追随者的热情:即将发布的 405b 模型 引起了轰动,社区期待值很高。

- 社区的热议由 Bindu Reddy 的推文 助推,该推文提到了模型的预期发布,将 7 月 23 日标记为开源 AGI 的重要日子。

- 专业化推测引发学者讨论:一场关于多个专业化模型是否优于单个通用模型的对话浮出水面,涉及 OpenAI 和 Anthropic 等公司。

- Alex Atallah 加入了辩论,主张考虑专业化模型,并征求社区对首选类型的意见。

LAION Discord

- Clip Retrieval 失效:一位用户注意到 clip retrieval 不再可用,引发了关于获取数据集替代方法的询问。

- 该问题似乎与数据集的移除有关,这可能意味着对数据可用性的更广泛限制。

- 内存占用大户模型:一个小规模模型训练任务出现了异常高的 19GB 内存占用,引起了频道对内存效率低下的关注。

- 社区正在积极探究为什么一个仅有 25 万参数的模型在较小的 batch size 下会吞噬如此多的内存。

- Nematron 340B 代码探索:关于 Nematron 340B 代码示例的咨询激增,重点在于奖励模型(reward model)的参数管理。

- 目前细节仍然很少,这为频道内共享编码实践提供了机会。

- AuraFlow 带来的华丽流动:Fal AI 的新文本生成图像模型 AuraFlow 随着其 发布公告 在频道内引起关注。

- 它在遵循 Prompt 方面的熟练表现,重新点燃了人们对 开源 AI 领域 的信心。

- LLMs 的 AIW 难题:一篇更新的 ArXiv 论文展示了 AIW 问题,揭示了 LLMs 在基础任务推理能力上的巨大鸿沟。

- 讨论围绕当前基准测试(benchmarks)的不足,以及 该论文 所强调的至关重要但被忽视的能力展开。

LlamaIndex Discord

- Agentic RAG 的成功秘诀:LlamaIndex 与 AIatMeta 合作,发布了关于 agentic RAG 的 cookbook,涵盖了从 agent 路由到多文档 agent 构建的多方面主题。

- 热情的爱好者们通过 Twitter 公告 初步了解,并在此处 here 获得了进一步见解。

- 通过 Cypher 片段实现去重趣闻:由 @tb_tomaz 和 Neo4j 团队打造,一段强大的 Cypher 片段简化了 entity deduplication(实体去重)的艺术,将技术实力与 URI 魔法相结合。

- 为了引起关注,他们分享了一个实用的 示例片段,并在 Neo4j GitHub 上简化了代码获取路径。

- Gemini 功能调用的澄清请求:Gemini 模型的 function calling 功能存在困惑;GitHub commits 看起来很有希望,但遇到了报错,声称 API 不支持。

- 澄清路径建议通过

pip install -U llama-index-llms-vertexai升级工具包,希望能拨开围绕 Gemini-1.5-flash-latest 能力的迷雾。

- 澄清路径建议通过

- 聚焦库:索引大型代码:爱好者们剖析了索引大型代码库的策略,讨论将代码翻译为 markdown-pseudocode(Markdown 伪代码)是否能增强聊天机器人的理解力。

- 对话围绕双聊天机器人系统的需求展开,一个用于问答,另一个用于生成代码片段。

- RAG 评审:略读规范文档:设想了 RAG 在剖析冗长规范文档中的作用,旨在不耗尽 token 限制的情况下提高评审流程的效率。

- 社区思考了评估庞大规范的方法,权衡了节省 token 的优势与 RAG 的潜力。

OpenInterpreter Discord

- 调用错误解析:用户报告在调用

OpenInterpreter.chat()时出现 APIConnectionError,且 ‘select’ 无法确定 agent 的角色。- 如 文档 所述,通过显式传递 LLM provider 可能会解决该错误。

- 使用 Phi-3 进行快速函数调用:Phi-3 因其快速且可靠的 function calls 引起关注,暗示了全本地 Fast Fourier 运行的潜力。

- 人们对这一优化寄予厚望,这可能意味着在不久的将来实现 更快的计算。

- GUI 的重大进展:Open Interpreter 的 GUI 迎来了重大升级,现在具备分支聊天、可编辑消息、自动运行代码和聊天保存功能。

- 这些强大的新功能也带有一些限制,详见 GitHub 仓库。

LLM Finetuning (Hamel + Dan) Discord

- 解决遥测问题:讨论围绕 self-hosted ML telemetry(自托管 ML 遥测)展开,重点关注 Langfuse、WandB 和 OpenLLMTelemetry 等平台。

- 成员们强调了选择一个符合 ML 项目 特定需求的平台的重要性。

- 聊天机器人的 API Key 寻求:一位需要 OpenAI API key 的成员表达了对聊天机器人项目教程的需求,强调了其短期必要性。

- 重点在于在教程中使用该 API key 进行演示。

- 寻求额度澄清:出现了关于额度余额的查询,用户 reneesyliu-571636 直接询问如何进行 credit balance check(余额检查)。

- 另一位成员寻求关于其账户状态的帮助,可能暗示了关于账户管理这一话题的更广泛问题。

Mozilla AI Discord

- 倡导影响 AI:Llamafile 迈向立法:Mozilla 的 Udbhav Tiwari 在美国参议院面前倡导开放 AI 系统,强调透明和可访问技术的重要性。

- 参议院听证会的焦点在于开放性在 AI 中的关键作用,这与 Mozilla 自身的倡导方向高度一致。

- 开发者时间延长:仍欢迎申请!:错过了 Builders Accelerator 的早期窗口?别担心,在初始截止日期之后仍然欢迎提交申请。

- 之前已分享过详细信息,感兴趣的各方可以查看计划目标并按照此公告中的说明进行申请。

- 不要错过:AI 活动盛会等待着你:一系列引人入胜的活动即将登场,包括结合 LLM 的 Open Interpreter、Benjamin Minixhofer 关于 Zero Shot Tokenizer Transfer 的演讲,以及与资深工程师进行的 AutoFix 环节。

- 渴望参与?请为即将举行的活动预留虚拟席位,参与前沿 AI 工具和讨论。

- 雕琢开源 AI 定义:Open Source AI Definition Draft v 0.0.8 步入聚光灯下,寻求社区见解并与 OECD 的 AI 系统解读保持一致。

- 呼吁社区行动起来,在 OSI 博客上审查并评论这一不断演进的成果。

- 整数还是浮点数:量化困境:AI 工程师们正在思考 llama.cpp 在 matmul 操作中是使用整数还是浮点数计算,这与 ggml-quants.c 中的程序有关。

- 这一数学策略——技术爱好者的热门话题——可能需要在进行整数点积运算之前对浮点激活值进行量化。

DiscoResearch Discord

- LLM 在 OpenArena 中展开对决:LLM Arena 是一个对战区,来自 Ollama 和 OpenAI 端点的语言模型在第三个模型作为裁判的指导下进行决斗。

- 其目标是提高数据集质量,已在 OpenArena 的 GitHub 上通过竞争性挑战进行了展示。

- WizardLM 论文为 Arena Learning 施展魔法:OpenArena 从 WizardLM 论文中汲取灵感,倡导在 LLM 训练后进行 Arena Learning。

- 通过模拟聊天机器人战斗并利用 AI 标注的数据集,该方法通过监督微调和强化学习技术来磨练模型。

MLOps @Chipro Discord

- 拓展 MLOps 的视野:发起了一场关于涵盖产品和研究等不同领域的讨论,特别是推荐系统、信息检索 (IR) 和检索增强生成 (RAG)。

- 对话鼓励开放性建议,并表达了对探索 Elastic 及其在这些领域潜力的特定兴趣。

- Elastic 爱好者涌现:另一位用户表达了同样的看法,表示愿意就 Elastic 进行详细对话。

- 该用户标记了一位同事,以启动关于 Elastic 如何增强他们当前业务的深入讨论。

Alignment Lab AI Discord 没有新消息。如果该频道长期沉寂,请告知我们,我们将将其移除。

LLM Perf Enthusiasts AI Discord 没有新消息。如果该频道长期沉寂,请告知我们,我们将将其移除。

AI Stack Devs (Yoko Li) Discord 没有新消息。如果该频道长期沉寂,请告知我们,我们将将其移除。

Torchtune Discord 没有新消息。如果该频道长期沉寂,请告知我们,我们将将其移除。

AI21 Labs (Jamba) Discord 没有新消息。如果该频道长期沉寂,请告知我们,我们将将其移除。

第二部分:各频道详细摘要与链接

完整的各频道细分内容已针对电子邮件进行了截断。

如果您喜欢 AInews,请分享给朋友!提前致谢!