ainews-to-be-named-5745

SciCode:HumanEval 迎来 STEM 博士级升级

博士级基准测试突显了大语言模型(LLM)在编写科学问题代码方面的困难,GPT-4 和 Claude 3.5 Sonnet 在新的 SciCode 基准测试中得分均低于 5%。Anthropic 将 Claude 3.5 Sonnet 的最大输出 token 限制翻倍至 8192 个。Q-GaLore 方法支持在单块 16GB 显存的 GPU 上训练 LLaMA-7B。Mosaic 编译器现在可为英伟达(NVIDIA)H100 GPU 生成高效代码。Hugging Face 上的 Dolphin 2.9.3-Yi-1.5-34B-32k-GGUF 模型下载量已超过 11.1 万次。Llama 3 表现强劲,在 MATH 数据集上实现了 90% 的零样本准确率。关于模型训练中合成数据的局限性及其形式的讨论仍在继续。

博士级基准测试(PhD-level benchmarks)就是你所需的一切。

2024年7月15日至7月16日的 AI 新闻。 我们为您检查了 7 个 subreddit、384 个 Twitter 账号 和 29 个 Discord(466 个频道和 2228 条消息)。 预计节省阅读时间(以 200wpm 计算):248 分钟。您现在可以标记 @smol_ai 进行 AINews 讨论!

到处都是许多小的更新——HuggingFace 的 SmolLM 复现了 MobileLLM(我们一周前的报道),Yi Tay 撰写了《BERT 之死》(我们两周前的播客),以及旧金山的 1 个街区在 Exa、SFCompute 和 Brev 的交易中筹集/出售了超过 3000 万美元(祝贺朋友们!)。

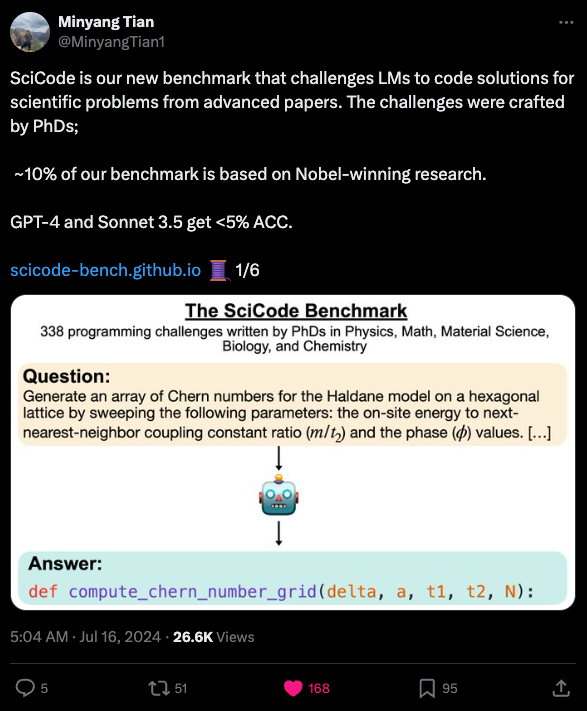

然而,我们今天的技术亮点是 SciCode,它挑战 LM 为高级论文中的科学问题编写代码解决方案。这些挑战由博士精心设计(约 10% 基于诺贝尔奖级别的研究),而两个领先的 LLM,GPT-4 和 Sonnet 3.5,在这个新基准测试中的得分低于 5%。

除了 HumanEval 和 MBPP 之外,下一个声称是顶级编程基准测试的是 SWEBench(更多关于我们报道的信息),但它的运行成本很高,而且更多是对 Agent 系统的集成测试,而不是对纯粹编程能力/世界知识的测试。SciCode 为非常流行的 HumanEval 方法提供了一个很好的扩展,易于且廉价地运行,但对于 SOTA LLM 来说仍然非常困难,提供了一个很好的评估梯度。

没有什么是永恒的(SOTA SWEbench 在 6 个月内从 2% 增长到 40%),但如果做得好,新的且能立即应用的基准测试工作是非常棒的。

AI Twitter 回顾

所有回顾均由 Claude 3.5 Sonnet 完成,从 4 次运行中择优。

AI 模型开发

- Anthropic API 更新:@alexalbert__ 指出,Anthropic 在 Anthropic API 中将 Claude 3.5 Sonnet 的最大输出 Token 限制从 4096 翻倍至 8192,只需在 API 调用中添加请求头 “anthropic-beta”: “max-tokens-3-5-sonnet-2024-07-15” 即可。

- 有效的 Claude Sonnet 3.5 编程系统提示词:@rohanpaul_ai 分享了一个有效的 Claude Sonnet 3.5 编程系统提示词,并解释了引导式思维链步骤:代码审查(Code Review)、规划(Planning)、输出安全审查(Output Security Review)。

- Q-GaLore 支持在 16GB GPU 上训练 7B 模型:@rohanpaul_ai 指出,Q-GaLore 结合了低精度训练、低秩梯度和延迟逐层子空间探索,支持在单个 16GB NVIDIA RTX 4060 Ti 上从头开始训练 LLaMA-7B,尽管速度通常较慢。

- Mosaic 编译器生成高效的 H100 代码:@tri_dao 强调,最初为 TPU 设计的 Mosaic 编译器可以生成非常高效的 H100 代码,显示了 AI 加速器的趋同性。

- Hugging Face 上的 Dolphin 2.9.3-Yi-1.5-34B-32k-GGUF 模型:@01AI_Yi 赞扬了 @bartowski1182 和 @cognitivecompai 在 Hugging Face 上发布的卓越 Yi 微调模型,上个月下载量超过 11.1 万次。

AI 模型性能与基准测试

- Llama 3 模型性能:@awnihannun 对比了 ChatGPT(免费版)与在 M2 Ultra 上运行的 MLX LM(搭载 Gemma 2 9B),显示出相当的性能。@teortaxesTex 指出 Llama 3 在 MATH 数据集上实现了 90% 的 Zero-shot 准确率。

- 合成数据的局限性:@abacaj 认为合成数据很愚蠢,且不太可能产生更好的模型,并质疑了合成指令的真实性。@Teknium1 反驳称合成数据有多种形式,下笼统的结论是不明智的。

- 使用 LLM 评估 LLM:@percyliang 强调了使用 LLM 生成输入并评估其他 LLM 输出的强大能力(如 AlpacaEval 所示),同时也对过度依赖自动评估(automatic evals)提出了警告。

- LLM-as-a-judge 技术:@cwolferesearch 概述了使用 LLM 评估其他 LLM 输出的最新研究,包括早期研究、揭示偏见的更正式分析以及专门的评估器。

AI 安全与监管

- FTC 因收购 VR 公司起诉 Meta:@ID_AA_Carmack 提到他被卷入了两个法庭案件,其中 FTC 因 Meta 收购小型 VR 公司而起诉该公司;他指出大型科技公司已全面大幅减少收购,这对初创公司不利,因为收购退出(acquisition exits)渠道正在收窄。

- 扼杀开源 AI 可能会使 AI 安全政治化:@jeremyphoward 警告称,扼杀开源 AI 可能会导致 AI 安全政治化,而开源才是解决方案。

- LLM 并非智能,只是记忆机器:@svpino 认为 LLM 是极其强大的记忆机器,虽然令人印象深刻但并不具备智能。它们可以记忆大量数据并从中进行少量泛化,但无法适应新问题、合成新颖的解决方案、跟上世界变化或进行推理。

AI 应用与演示

- AI 与机器人每周回顾:@adcock_brett 提供了过去一周最重要的 AI 和机器人研究与进展的详细分析。

- Agentic RAG 与多智能体架构概念:@jerryjliu0 分享了 @nicolaygerold 关于 Agentic RAG 和多智能体架构概念的推文串和图表,这些内容曾在他们的 @aiDotEngineer 演讲中讨论过。

- M2 Ultra 上的 MLX LM (Gemma 2 9B) 对比 ChatGPT:@awnihannun 对比了 ChatGPT(免费版)与在 M2 Ultra 上运行的 MLX LM(搭载 Gemma 2 9B)。

- Odyssey AI 视频生成平台:@adcock_brett 指出 Odyssey 结束隐身模式,推出了一个“好莱坞级”的 AI 视频生成平台,正在开发四个专门的 AI 视频模型。

迷因与幽默

- 9.11 大于 9.9:@goodside 在一条幽默推文中开玩笑说“9.11 大于 9.9”,并在随后的推文中进行了变体和解释。

- Perplexity 办公室:@AravSrinivas 分享了一张题为“新 Perplexity 办公室!”的幽默图片。

AI Reddit 回顾

涵盖 r/LocalLlama, r/machinelearning, r/openai, r/stablediffusion, r/ArtificialInteligence, /r/LLMDevs, /r/Singularity。评论抓取功能现已上线,但仍有很大改进空间!

主题 1. 新前沿

- [/r/singularity] 另一位知情人士透露,OpenAI 内部测试的 AI 在 MATH 数据集上得分超过 90% (Score: 206, Comments: 59): 据报道 OpenAI 的 AI 在 MATH 数据集上得分超过 90%。一位匿名消息人士称,OpenAI 内部测试了一个 AI 系统,能够在 MATH 数据集上达到 超过 90% 的准确率,这表明 AI 在数学问题解决能力方面取得了重大进展。如果得到证实,这一进展对于 AI 应对复杂数学挑战及其在需要高级数学推理的各个领域的应用可能产生深远影响。

- [/r/singularity] 一台新型量子计算机打破了 Google Sycamore 机器创造的世界纪录。新型 56 量子比特 H2-1 计算机将“量子霸权”纪录提高了 100 倍。 (Score: 365, Comments: 110): Xanadu 的 56 量子比特 H2-1 量子计算机据报道在量子霸权(quantum supremacy)基准测试中超越了 Google 的 Sycamore 机器,提升幅度达 100 倍。这一成就标志着量子计算能力的重大飞跃,可能加速该领域向实际应用迈进。该消息由 @dr_singularity 在 X(原 Twitter)上分享,但更多细节和验证尚待提供。

主题 2. 用于细节图像生成的先进 Stable Diffusion 技术

-

[/r/StableDiffusion] Tile controlnet + Tiled diffusion = 非常逼真的放大器工作流 (Score: 517, Comments: 109): Tile controlnet 结合 Tiled diffusion 创建了一个非常高效的逼真图像放大工作流。该技术允许在保持精细细节和纹理的同时,将图像放大到 4K 或 8K 分辨率,超越了传统 AI 放大器的质量。该过程涉及使用 controlnet 生成高分辨率的瓦片(tile)模式,然后将其作为 tiled diffusion 的引导,从而生成无缝且细节丰富的最终图像。

-

[/r/StableDiffusion] 用 SD 创造细节丰富的世界仍然是我最喜欢做的事情! (Score: 357, Comments: 49): 使用 Stable Diffusion 创造精细的奇幻世界仍然是创意表达的首选。生成复杂、富有想象力的景观和环境的能力展示了 AI 在视觉艺术创作中的力量。这项技术让艺术家和爱好者能够以非凡的细节和深度将他们的奇幻愿景变为现实。

- NeededMonster 详细介绍了他们创建精细奇幻世界的 4 阶段工作流,包括初始提示词(prompting)、局部重绘/外延绘制(inpainting/outpainting)、放大以及细节微调。每张图片的制作过程可能需要 1.5 小时。

- 评论者称赞这些图像具有“书封质量”和“目前见过的最佳作品”,一些人建议该艺术家的技能“值得雇佣”。NeededMonster 表示有兴趣寻找此类图像创作的工作。

主题 3. 使用 Unsloth 和 Ollama 微调 Llama 3

- [/r/LocalLLaMA] 分步教程:如何使用 Unsloth + Google Colab 微调 Llama 3 (8B) 并将其部署到 Ollama (Score: 219, Comments: 41): 基于 Unsloth 的 Llama 3 微调教程。本教程演示了如何使用 Unsloth 微调 Llama-3 (8B) 并将其部署到 Ollama 以供本地使用。该过程包括使用 Google Colab 获取免费 GPU 资源,在 Alpaca 数据集上进行微调,并导出模型到 Ollama(自动创建

Modelfile)。关键特性包括 微调速度提升 2 倍、内存占用减少 70%,以及通过 Unsloth 的conversation_extension参数支持多轮对话。

AI Discord 摘要

摘要之摘要的摘要

1. Mamba 模型掀起波澜

- Codestral Mamba 崭露头角:Mistral AI 发布了 Codestral Mamba,这是一个 7B 的编程模型,采用 Mamba2 架构而非 Transformer,提供线性时间推理和无限序列处理能力。

- 该模型采用 Apache 2.0 许可证,旨在提高代码生产力。社区讨论强调了其对 LLM 架构 的潜在影响,一些人指出它尚未在

llama.cpp等流行框架中得到支持。

- 该模型采用 Apache 2.0 许可证,旨在提高代码生产力。社区讨论强调了其对 LLM 架构 的潜在影响,一些人指出它尚未在

- Mathstral 增强 STEM 实力:除了 Codestral Mamba,Mistral AI 还推出了 Mathstral,这是一个针对 STEM 推理进行微调的 7B 模型,在 MATH 基准测试中获得了 56.6% 的优异成绩,在 MMLU 基准测试中获得了 63.47%。

- Mathstral 是与 Project Numina 合作开发的,体现了针对特定领域优化的专业化模型日益增长的趋势,有可能重塑科学和技术领域的 AI 应用。

2. 高效 LLM 架构的演进

- SmolLM 展现小巧而强大的力量:SmolLM 推出了参数量从 135M 到 1.7B 的新型 SOTA 模型,这些模型在高质量的网络、代码和合成数据上进行训练,性能超越了 MobileLLM 和 Phi1.5 等更大型的模型。

- 这些紧凑型模型突显了高效、设备端 LLM 部署日益增长的重要性。此次发布引发了关于平衡模型大小与性能的讨论,特别是针对边缘计算和移动应用。

- Q-Sparse 为稀疏化增色:研究人员介绍了 Q-Sparse,这是一种使完全稀疏激活的大语言模型 (LLMs) 能够以更高效率实现与稠密基准模型相当结果的技术。

- 这一进展是在 BitNet b1.58 发布四个月后取得的,BitNet b1.58 将 LLMs 压缩到了 1.58 bits。AI 社区讨论了 Q-Sparse 如何潜在地重塑 LLM 训练和推理,特别是对于资源受限的环境。

3. AI 教育与基准测试的突破

- Karpathy 在 AI 教育领域的“尤里卡时刻”:Andrej Karpathy 宣布启动 Eureka Labs,这是一个 AI 原生教育平台,首门课程为 LLM101n,这是一门关于训练个人 AI 模型的本科级课程。

- 该计划旨在将 AI 专业知识与创新教学方法相结合,有可能改变 AI 的教学和学习方式。社区反应非常积极,并讨论了其对普及 AI 教育的意义。

- SciCode 为 LLM 评估设定新标准:研究人员推出了 SciCode,这是一个新的基准测试,挑战 LLMs 为来自高级论文(包括诺贝尔奖获奖研究)的科学问题编写代码解决方案。

- 初步测试显示,即使是 GPT-4 和 Claude 3.5 Sonnet 等先进模型,其准确率也低于 5%,突显了该基准测试的难度。AI 社区讨论了其对模型评估的潜在影响,以及对更严格、特定领域测试的需求。

第一部分:Discord 高层级摘要

Unsloth AI (Daniel Han) Discord

- NVIDIA 告别特定项目:NVIDIA 关停某个项目引发了社区成员对其未来的猜测,并触发了关于如何保护工作成果免受突然中断影响的讨论。

- 一位用户建议将本地存储作为项目关停的应急方案,旨在最大限度地减少工作损失。

- RAG 受到审视:围绕 RAG (Retrieval-Augmented Generation) 的质疑声不断,据报道该技术入门容易,但要微调到完美状态却极具挑战且成本高昂。

- 一项针对优化的深入研究揭示了其中的复杂性,成员们提到了 “微调 LLM、embedder 和 reranker” 的艰巨任务。

- 模型微调价格不菲:微调一个超过 200GB 的语言模型可能会产生巨额费用,这引发了关于推进大模型在财务准入门槛上的争论。

- Google Cloud 的 A2 实例 成为一种可能但依然昂贵的替代方案,强调了成本在规模化方程中的分量。

- Codestral Mamba 投入行动:Mistral AI 的 Codestral Mamba 凭借线性时间推理(linear time inference)能力取得突破,为提升代码生产力提供了快速解决方案。

- Mathstral 随之发布,重点展示了其在 STEM 领域的高级推理能力,并因其底层实力而备受关注。

- Unsloth Pro 专属俱乐部:目前处于 NDA 阶段的新版 Unsloth Pro 令人兴奋,它支持多 GPU 和 DRM 系统,但仅限于付费订阅模式。

- 尽管仅限高级用户,但人们对其针对多样化部署的有效 DRM 系统寄予厚望。

Modular (Mojo 🔥) Discord

- FlatBuffers 对抗 Protobuf 尽显优势:社区讨论了 FlatBuffers 相比 Protobuf 的优势,强调了 FlatBuffers 的性能以及 Apache Arrow 的集成,尽管后者仍使用 Protobuf 进行数据传输。

- 尽管效率很高,但 FlatBuffers 面临着使用难度较大和行业渗透率较低的挑战,引发了关于选择序列化框架的辩论。

- Mojo 的 Python 兼容性难题:一项关于禁用与 Python 完全兼容的 Mojo 模式提案引发讨论,旨在推动 以 Mojo 为中心的语法 和 健壮的错误处理。

- 讨论包括建议采用类似 Rust 的单子(monadic)错误处理以增强可靠性,避免传统的 try-catch 块。

- MAX Graph API 教程遇到障碍:学习者在 MAX Graph API 教程 中遇到困难,碰到了 Python 脚本差异和安装错误。

- 社区干预纠正了诸如 Jupyter kernels 不匹配和导入问题等错误,并建议新手使用 nightly builds 以获得更顺畅的体验。

- Mistral 7B 编程模型以无限序列令人惊叹:Mistral 发布了利用 Mamba2 的全新 7B 编程模型,凭借其序列处理能力改变了代码生产力的格局。

- 社区对该 模型 表现出极大的热情,并分享了用于 GUI 构建和 ONNX 转换的资源。

- 错误处理引发 Mojo 热议:关于 Mojo 错误处理的讨论激增,对于显式错误传播及其对系统编程中函数的影响存在强烈观点。

- 一个核心主题是强调显式声明以改进代码维护,并适应 GPU 和 FPGA 等多样化硬件上的错误处理。

HuggingFace Discord

- 冠军数学解题模型现已开源:AI 数学奥林匹克冠军 NuminaMath 已正式开源,该 7B 模型在 Kaggle 上取得了 29/50 的优异成绩。

- 该模型经过两个阶段的精细微调,利用了海量的数学题和专门为 GPT-4 优化的合成数据集。

- Whisper Timestamped 实现逐词标记:Whisper Timestamped 在语音识别领域再下一城,通过 Transformers.js 推出了支持多语言的强大浏览器端解决方案。

- 这一进展为浏览器端视频编辑工具提供了完整的代码支持和带时间戳转录的神奇演示。

- 语音大师:Nvidia BigVGAN v2 翱翔:Nvidia 发布了 BigVGAN v2,这是他们最新的神经声码器(Neural Vocoder),在 A100 上能更快速地将梅尔频谱图(Mel spectrograms)合成为音频。

- 该模型通过升级的 CUDA 核心、精调的判别器(discriminator)和共鸣损失函数进行了改造,承诺提供支持高达 44 kHz 的听觉盛宴。

- 强强联手:Hugging Face x Keras:Keras 通过与 Hugging Face 的合作引入了 NLP 功能,为开发者在神经文本处理领域拓展了边界。

- 此次融合旨在将一系列 NLP 功能引入 Keras 生态系统,为开发者提供无缝的模型集成体验。

- 界面革新:Hugging Face Tokens:Hugging Face 改进了其 Token 管理界面,增加了 Token 过期日期和显示最后四位数字等新功能。

- 此次 UI 升级旨在保护您的珍贵 Token,充当 Token 列表的管家,只需一眼即可掌握详细信息。

Stability.ai (Stable Diffusion) Discord

- 告别 NSFW:AI Morph 加强管控:Daily Joy Studio 开发的工具 AI Morph 因停止允许 NSFW 内容并显示“不符合指南”警报而引发讨论。

- 社区反应不一,有人猜测这对内容创作的影响,而另一些人则在讨论替代工具。

- 使用 Stable Diffusion 创作动漫艺术:用户咨询了如何精细调整 Stable Diffusion 以提高动漫艺术的颜色、服饰和面部表情准确性,暗示了对细粒度控制机制的需求。

- 几位用户交流了技巧,并指向了一些 GitHub 仓库作为潜在资源。

- Detweiler 的教程:社区最爱:社区对 Scott Detweiler 在 YouTube 上的 Stable Diffusion 教程表示赞赏,称赞其对工具的高质量见解。

- 他作为 Stability.ai 质量保证角色的贡献受到关注,巩固了他作为学习首选来源的地位。

- 自制 AI 工具融合本地与 Stable Diffusion:关于开发一款巧妙集成 Stable Diffusion 的本地 AI 工具的讨论非常热烈,该工具已成为 capt.asic 的首选。

- 讨论延伸到了将 Stable Diffusion 与本地语言模型 (LLM) 支持相结合的有效性。

- AI 显卡之争:4090 vs. 7900XTX:针对 AI 任务的 GPU 性能引发了辩论,NVIDIA 的 4090 与 AMD 的 7900XTX 在性价比和易用性方面展开对决。

- 在规格讨论中,Google Colab 项目的链接和规格对比进一步推动了讨论。

CUDA MODE Discord

- CUDA Kernel 奇遇与 PyTorch 实力:#general 频道讨论了在 Python 脚本中通过 PyTorch 调用 CUDA kernel 的话题,建议使用 PyTorch profiler 来梳理哪些 ATen 函数被触发。

- 讨论中强调了一场性能拉锯战,引用了一门课程,其中原生 CUDA 矩阵乘法 kernel 耗时 6ms,而其 PyTorch 对应版本仅需 2ms,这引发了关于 PyTorch kernel 在 CNN 卷积操作中效率的讨论。

- Spectral Compute 的 SCALE 工具包大获成功:SCALE 出现在 #cool-links 中,因其能够将 CUDA 应用程序转译为适用于 AMD GPU 的程序而受到赞誉,这一举措可能会改变计算范式。

- 随着未来支持更多 GPU 厂商的承诺,开发者被引导至 SCALE 的文档以获取教程和示例,预示着跨平台 GPU 编程灵活性可能大幅提升。

- Suno 寻找机器学习大师:#jobs 频道重点介绍了 Suno 招募 ML 工程师的活动,要求精通 torch.compile 和 triton 以构建实时音频模型;根据职位公告,熟悉 Cutlass 是加分项而非必选。

- 实习岗位也已上线,为初学者提供了进入 Suno ML 领域参与训练和推理复杂协作的切入点。

- Lightning Strikes 与 Huggingface 开发进展:#beginner 的讨论展示了 Lightning AI’s Studios,这是一个设计精巧的混合云端浏览器开发环境;而关于 Huggingface Spaces Dev Mode 的 CUDA 开发愿景仍悬而未决。

- 后者收到了关于在 Huggingface 生态系统中进行 CUDA 尝试可行性的咨询,反映出社区正处于实验与探索的前沿。

- Karpathy 在 AI+教育领域的灵光一现:Andrej Karpathy 宣布通过 Eureka Labs 进军 AI 辅助教育领域;#llmdotc 的讨论涉及了将教学与技术结合以服务 AI 爱好者的意图。

- 前导课程 LLM101n 标志着 Eureka 使命的开始,旨在增强教育的可及性和参与度,为 AI 潜在重塑学习体验奠定基础。

OpenRouter (Alex Atallah) Discord

- OpenRouter 的慷慨之举:OpenRouter 慷慨地向社区提供了对 Qwen 2 7B Instruct 模型的免费访问,为热衷技术的工程师增强了 AI 工具储备。

- 要使用此服务,用户可以访问 OpenRouter 并在无需订阅的情况下使用该模型。

- Gemini 辩论:免费层的挫败感:针对通过免费层提供的 Google Gemini 1.0 出现了不同的观点,强烈的意见认为它未达到 OpenAI GPT-4o 的基准。

- 一位成员强调了 Gemini 1.5 Pro 中被忽视的潜力,称尽管它在编程方面有些怪癖,但具有出色的创作能力。

- OpenRouter 波动:连接困扰:OpenRouter 用户在访问网站及其 API 时遇到了不稳定的中断,引发了社区内的一系列担忧。

- 官方声明将零星的停机归因于瞬时路由绕路以及 Cloudflare 等第三方服务的潜在问题。

- 渴望 Llama 3 更长的上下文:工程师们分享了对 Llama 3-70B Instruct 中 8k 上下文窗口限制 的困扰,并思考更优的替代方案。

- 提供扩展上下文能力的模型建议包括 Euryale 和 Magnum-72B,但其一致性和成本因素仍是关注点。

- OpenRouter 访问的必要性与细微差别:关于 OpenRouter 模型可访问性的澄清在用户中传开,指出并非所有模型都是免费的,有些需要付费协议。

- 尽管存在困惑,OpenRouter 确实提供了一系列免费的 API 和模型,而托管企业级 dry-run 模型则需要强调特定的商业合同。

Perplexity AI Discord

- Perplexity AI 动荡:Pro 级别的困扰:用户在 Perplexity AI 表达了对 Pro Subscription Support 的不满,尽管收到了确认邮件,但在不同设备上仍面临激活问题。

- 讨论围绕着诸如为不同集合(collections)实现模型设置等问题展开,并对新的 Perplexity Office 表示兴奋。

- Alphabet 的大胆收购:230 亿美元成交:Alphabet 耗资 230 亿美元的巨额收购引起了轰动,引发了市场波动,你可以在 YouTube 简报中了解详情。

- 随之而来的猜测和讨论集中在这一举动将如何开启新的篇章,使 Alphabet 成为潜在市场扩张的焦点。

- 发现月球避难所:未来宇航员的洞穴:在静海(Mare Tranquillitatis)发现的一个可进入的月球洞穴可能成为宇航员居住的福音,因为它能抵御月球的极端环境。

- 根据 Perplexity AI 的报道,该洞穴宽度至少为 130 英尺,环境更加温和,是潜在月球基地的理想选址。

- 7-Eleven 的体验提升:旨在取悦客户:为了提升购物愉悦感,7-Eleven 正准备进行重大升级,可能会重塑消费者互动格局。

- 7-Eleven 邀请你探索此次升级,这或许会为零售便利性树立新标杆。

- API 焦虑:pplx-api 的波动:

pplx-api用户群体讨论了缺失的功能(如deleted_urls的等效项)以及影响sonar模型的 524 错误带来的挫败感。- 建议的解决方法包括设置

"stream": True,以便在llama-3-sonar-small-32k-online及相关模型出现超时时保持连接活跃。

- 建议的解决方法包括设置

Interconnects (Nathan Lambert) Discord

- Codestral Mamba 凭借无限序列建模出击:Codestral Mamba 的推出具有线性时间推理(linear time inference)特点,标志着 AI 处理无限序列能力的一个里程碑,助力提升代码生产力基准。

- 该模型由 Albert Gu 和 Tri Dao 合作开发,Codestral 的架构可与顶尖的 Transformer 模型竞争,预示着向更高效的序列学习转变。

- Mathstral 精准处理数字:专注于 STEM 领域的 Mathstral 在 MATH 基准测试中达到 56.6%,在 MMLU 基准测试中达到 63.47%,增强了在特定技术领域的表现。

- Mathstral 与 Project Numina 合作,代表了在专业领域中速度与高层级推理之间的精确平衡。

- SmolLM 在端侧表现强劲:SmolLM 的新 SOTA 模型提供了高性能与缩减的规模,在 LLM 的端侧部署方面取得了进展。

- 这些模型超越了 MobileLLM 等模型,表明了在保持足够效能的同时进行小型化的趋势,这对于移动应用至关重要。

- Eureka Labs 启发 AI 与教育的交汇:凭借其 AI 原生助教,Eureka Labs 为 AI 驱动的教育体验铺平了道路,首个产品为 LLM101n。

- Eureka 的创新方法旨在让学生通过训练自己的 AI 来构建理解,彻底改变教育方法论。

- 倡导策略强化中的公平竞争:讨论围绕策略强化(policy reinforcement)中退化情况(degenerate cases)的效用展开,用于管理获胜和失败策略中的常见前缀。

- 尽管公认需要深入研究,但对详细技术细节的关注可能会引入策略优化(policy optimization)中的先进方法。

Eleuther Discord

- GPT-4 对 GSM8k 的掌握:GPT-4 的性能实力在其处理大部分 GSM8k 训练集的能力中得到了体现;这是从 GPT-4 技术报告中分享的一个有趣事实。

- 社区重点关注了 GPT-4 的记忆力表现,这类细节通常会在社交平台上引起广泛反响。

- 指令微调(Instruction Tuning)语法受到审视:生成的指令微调数据集中的语法引发了讨论,人们质疑这种方法与 OpenAI 使用项目符号进行思维链(chaining thoughts)的方法相比孰优孰劣。

- 社区对在微调数据集中包含特定标记的潜在可能性感到好奇,从而引发了关于数据集完整性的对话。

- 显微镜下的 GPU 故障:成员们试图了解模型训练期间 GPU 故障的频率,并参考了诸如 Reka 技术报告之类的报告。

- 像 OPT/BLOOM 日志这样的开源资源,成为了那些旨在分析大规模 AI 训练环境稳定性的人员的首选来源。

- 状态空间模型(State Space Models)的进展:状态空间模型权重的创新构建推动了讨论,这项研究展示了它们在上下文中学习动力系统的能力。

- 研究人员就这些模型在无需额外参数调整的情况下预测系统状态的潜力交换了意见,强调了它们的实用性。

- 神经元数量:人类 vs 动物:关于人类与动物智力差异的辩论十分激烈,人们公认人类在规划和创造力方面具有优越性,尽管感官能力与动物相当。

- 对话涉及了人类更大的新皮层及其增加的褶皱,这可能有助于我们独特的认知能力。

Latent Space Discord

- Anthropic 的 Token 突破:Anthropic 展示了他们的滴灌式公关策略,透露 API 中 Claude 3.5 Sonnet 的 Token 限制从 4096 提升到了 8192,这让开发者们欢欣鼓舞。

- 一位热心的开发者表达了满足感,并在一条庆祝推文中评论了过去的限制,强调了这一增强功能。

- LangGraph vs XState 对决:一位成员预告了他们使用 XState 构建 LLM Agent 的工作,并在 GitHub 上公开将其方法论与 LangGraph 进行对比,热情随之高涨。

- 期待感正在积聚,大家期待着一份详尽的分析,以界定两者之间的优势,丰富那些尝试基于状态机的 AI Agent 的 AI 工程师的工具箱。

- Qwen2 取代前代产品:Qwen2 发布了一系列性能超越 Qwen1.5 的语言模型,提供 0.5 到 720 亿参数范围,旨在与闭源对手展开竞争。

- 该系列同时推出了稠密模型和 MoE 模型,社区正在仔细研读 Qwen2 技术报告中的承诺。

LM Studio Discord

- LM Studio:网络连接:LM Studio 用户讨论了家庭网络服务器的 Android 应用访问,重点介绍了 Wireguard 等 VPN 工具用于安全的服务器连接。

- 否定了对 Intel GPU 的全面支持,建议在处理 AI 任务时使用其他硬件以获得更好的性能。

- Bug 与支持:对话碰撞:Gemma 2 在

llama.cpp中获得了支持,而 Phi 3 small 则因不兼容问题被搁置。- 社区深入研究了 LMS 模型加载变慢的问题,指出弹出并重新加载是解决性能迟缓的快速修复方法。

- 与巨人同行编码:Deepseek 与 Lunaris:在为 128GB RAM 系统寻找理想的本地编码模型时,目标锁定在了 Deepseek V2,这是一个拥有 21B 专家的模型。

- L3-12B-Lunaris 变体之间的精确差异引发了对话,重点在于尝试免费的 LLM 以获取性能见解。

- 图形故障:大小并不重要:LM Studio 中的

f32文件夹异常引起了关注,导致一些人思考外观 Bug 对用户体验的影响。- Flash Attention 被认为是 F16 GGUF 模型加载问题的罪魁祸首,停用它可以恢复 RTX 3090 上的功能。

- STEM 专用:Mathstral 亮相:Mistral AI 推出了 Mathstral,这是他们最新的以 STEM 为中心的模型,承诺性能优于其前身 Mistral 7B。

- 社区模型计划重点推介了 Mathstral,邀请 AI 爱好者参与 LM Studio Discord 上的讨论。

Nous Research AI Discord

- Evol-Instruct V2 & Auto 带来的进化式指令飞跃:WizardLM 宣布 Evol-Instruct V2 将 WizardLM-2 的能力从三个进化领域扩展到数十个,可能增强 AI 研究的公平性和效率。

- Auto Evol-Instruct 展示了显著的性能提升,在 MT-bench 上提升了 10.44%,在 HumanEval 上提升了 12%,在 GSM8k 上提升了 6.9%,超越了人工设计的方法。

- Q-Sparse:高效计算:由 Hongyu Wang 介绍的 Q-Sparse 声称通过优化受内存限制(memory-bound)过程的计算来提升 LLM 计算效率。

- 这一创新紧随 BitNet b1.58 实现将 LLM 压缩至 1.58 bits 之后四个月出现。

- SpreadsheetLLM:微软在数据领域的新前沿:Microsoft 创新推出的 SpreadsheetLLM 在电子表格任务中表现出色,这可能导致数据管理和分析领域的重大转变。

- 一篇 预印本论文 强调了 SpreadsheetLLM 的发布,引发了关于自动化对就业市场影响的辩论。

- 高温警报:城市温度与技术解决方案:在极端气温下,关于将屋顶涂成白色的讨论兴起,并得到了 耶鲁大学文章 的支持,以减少城市热岛效应。

- 一种可反射 98% 阳光的超级白漆发明在 YouTube 演示 中展示,引发了关于其被动冷却建筑潜力的讨论。

- AI 素养:解码 Tokenization 的烦恼:讨论了 LLM 在处理阿拉伯语符号时与 tiktoken 库 的冲突;解码错误导致原始字符串被特殊 Token 替换,给文本生成带来了挑战。

- Tokenization 过程的可变性显而易见,结果在 UTF-8 序列 和 0x80-0xFF 字节之间波动,引发了对

cl100k_base的 Tokenization 可逆性的担忧。

- Tokenization 过程的可变性显而易见,结果在 UTF-8 序列 和 0x80-0xFF 字节之间波动,引发了对

OpenAI Discord

- Sora 备受期待的到来:根据 OpenAI 博客文章,关于 Sora 在 2024 年第四季度发布日期的讨论已经浮现。OpenAI 尚未确认这些推测。

- 有人提醒不要信任非官方来源(如随机的 Reddit 或 Twitter 帖子)的发布预测。

- 微型奇迹:GPT Mini 的潜在角色:Lymsys 中传闻的 GPT mini 引起了轰动,尽管细节仍然稀少且未经证实。

- 存在怀疑态度,认为许多预测缺乏具体依据。

- 利用 GPT-4 编程从零到英雄:讨论了 GPT-4 如何协助爱好者编写 移动游戏,并指出虽然它提供了结构,但警惕的错误检查至关重要。

- 分享了没有编程经验的个人制作 Web App 的成功案例,将其进步归功于 GPT-4 的指导。

- GPT 模型的语言课程:AI 模型之间的性能差异与其语言训练的程度有关,影响了回答质量。

- 讨论范围涵盖了模型对地区方言的混淆,以及 GPT-4 从随意语调向更正式语调的转变,这些都影响了用户体验。

- 聊天机器人开发的挑战:一名学生尝试创建 孟加拉语/Banglish 支持聊天机器人,引发了关于使用 100 条对话进行适度 Fine-tuning 是否有益的讨论。

- 回复澄清说,虽然 Fine-tuning 有助于模式识别,但这些可能会在超出 Context Window 后被遗忘,从而影响对话流。

LlamaIndex Discord

- LlamaIndex 的通往更好 RAG 之桥:一场 LlamaIndex 研讨会将深入探讨如何通过高级解析和元数据提取来增强 RAG,并邀请 Deasie 的创始人分享相关见解。

- 据其官网详细介绍,Deasie 的标注工作流据称可以优化 RAG,自动生成层级化的元数据标签。

- 高级文档处理策略:LlamaIndex 的新 Cookbook 将 LlamaParse 和 GPT-4o 结合成一种混合文本/图像的 RAG 架构,以处理多样化的文档元素。

- 同时,Sonnet-3.5 在图表理解方面的出色表现,预示着通过多模态模型和 LlamaParse 的最新版本可以实现更好的数据解读。

- 使用 LlamaIndex 和 GraphRAG 进行细节图谱化:用户对比了 llamaindex property graph 与 Microsoft GraphRAG 的能力,强调了属性图在 text-to-cypher 等检索方法中的灵活性,正如 Cheesyfishes 所概述的那样。

- GraphRAG 的社区聚类与属性图的自定义功能形成了对比,相关示例可在文档中找到。

- 精简 AI 基础设施:围绕 LLM 响应的高效源检索展开了讨论,例如

get_formatted_sources()等方法有助于追踪数据来源,这在 LlamaIndex 的教程中有所提及。- AI 社区正在积极寻求可访问的公共向量数据集,以降低基础设施的复杂性,并倾向于预托管选项,尽管目前尚未提到具体的服务。

- 提升索引加载效率:成员们分享了加速加载大型索引的策略,建议将并行化作为一个潜在途径,并引发了关于优化

QueryPipelines等方法的讨论。- 对于 Neo4J 节点中的数据嵌入,社区转向使用

PropertyGraphIndex.from_documents(),该过程在 LlamaIndex 源代码中有详细说明。

- 对于 Neo4J 节点中的数据嵌入,社区转向使用

Cohere Discord

- Cohere Python 社区中的协作:一位参与者建议那些有兴趣为开源项目做贡献的人探索 Cohere Python Library,以促进社区驱动的改进。

- 该库的一位爱好者暗示他们打算很快进行 contribute(贡献),这可能会加强协作努力。

- Discord 分类难题需要 Prompt 优化:尽管主题各异,但 Discord 机器人将所有帖子错误地归类到 ‘opensource’ 类别,这暗示了自动帖子分类中存在问题。

- 一位同事插话推测,简单的 prompt adjustment(提示词调整)就可以纠正这一偏差,这让人联想到 r/openai 中被错误路由的帖子。

- 垃圾信息诈骗引发预警提议:一位积极的成员提议将创建防诈骗意识内容作为服务器新成员入职引导的一部分,以提高安全性。

- 该建议得到了支持,并引发了关于实施社区安全最佳实践的讨论。

- Max Welling 的炉边谈话备受期待:C4AI 宣布了与阿姆斯特丹大学 Max Welling 的炉边谈话,这一消息令人兴奋。

- 然而,宣传过程中出现了一个小插曲,即不必要的 @everyone 提醒,为此官方已道歉。

- Discord 重申招聘规则:服务器提醒不允许发布招聘信息,以强化社区准则。

- 成员被敦促通过私下讨论进行就业接洽,强调尊重专业协议。

LangChain AI Discord

- 微调管道助力功能实现:微调管道(finetuning pipeline)成为讨论的核心,成员们通过分享管道策略来交流解决问题的思路。

- 一位成员强调了使用 100 组对话进行 LLM 训练的应用,以增强孟加拉语聊天机器人的响应能力。

- MessageGraph 的时间戳时钟:在 MessageGraph 中添加时间戳以实现消息时序自动化的技术咨询,引发了社区成员间的对话。

- 随后引发了关于是否需要使用 StateGraph 进行自定义时间状态管理的推测。

- Verbis 发布:隐私保护的先锋:Verbis 是一款开源的 MacOS 应用程序,通过利用 GenAI 模型进行本地数据处理,承诺提升生产力。

- 该应用在欢呼声中发布,保证不向第三方共享数据,大胆强调隐私保护。在 GitHub 上了解更多

- Web 端的 RAG:LangChain 与 WebLLM 的协同:一段演示展示了 LangChain 和 WebLLM 在浏览器环境中的强大实力,部署了一个用于即时问答的聊天模型。

- 分享的视频实操展示了 Visual Agents,并强调了强大的浏览器内用户体验。观看演示

OpenAccess AI Collective (axolotl) Discord

- 深入动态微调:成员们对 PyTorch tuner 的推出表现出极大的好奇,并就其高效交换和优化指令模型(instruction models)的潜力进行了交流。

- 讨论中强调了该 tuner 调整上下文长度的能力,并提醒过长的长度可能会非常消耗 VRAM。

- Mistral 模板引发的困扰:讨论表明 Mistral 独特的聊天模板偏离了常规,给用户带来了操作上的困扰。

- 聊天模板的复杂性引发了关于微调策略的对话,以规避出现的问题。

- 合并方法论至关重要:Axolotl 仓库活动频繁,一个新的 pull request 正在制定中,标志着开发工作的进展。

- 然而,Direct Policy Optimization (DPO) 方法的简单性受到了质疑,揭示了其在基础 tokenization 和 masking 之外的局限性。

- LoRA 层引领潮流:一个围绕

lora_target_linear展开的专题论坛形成了,这是一个 LoRA 配置开关,用于改变线性层的适配方式,以实现更高效的微调。- 该设置在 Axolotl 微调中的作用引发了讨论,尽管关于在某些层禁用 LoRA 的一些疑问仍未得到解答。

Torchtune Discord

- Torchtune v0.2.0 震撼发布:备受期待的 Torchtune v0.2.0 发布,标志着一个重要的里程碑,新增了令人兴奋的模型和 recipes。

- 社区贡献丰富了该版本,其特点是包含 sample packing 等数据集增强功能,以提高性能并支持多样化的应用。

- 无需反向传播负担的评估:为了优化 checkpoint 的选择,可以在不进行反向传播的情况下计算评估期间的 loss;参与者讨论了绘制 loss 曲线,并在训练和评估数据集之间进行对比。

- 建议包括修改 默认 recipe 配置,并结合测试集划分以及在模型 eval 模式下使用

torch.no_grad()的 eval 循环。

- 建议包括修改 默认 recipe 配置,并结合测试集划分以及在模型 eval 模式下使用

- RoPE 嵌入助力超长上下文:长上下文建模在 Torchtune 的 RFC 中关于扩展 RoPE (Rotary Positional Embeddings) 的提案中获得了关注,为大文档和代码补全任务铺平了道路。

- 讨论围绕支持超过 8K 的 RoPE 上下文展开,这可以改变对大容量文档和详细代码库的理解。

LAION Discord

- ComfyUI 团队策划迪士尼干扰:一名参与者透露,ComfyUI 恶意节点攻击的幕后黑手声称还策划了迪士尼网络攻击,挑战了该公司的数字防御。

- 有人提到,虽然一些人认为迪士尼攻击是混乱行为,但也有人猜测并期待 FBI 对这些事件进行潜在调查。

- Codestral 的 Mamba 崭露头角:最近的一篇帖子分享了一项名为 Codestral Mamba 的突破,这是 Mistral AI 的最新更新,引发了关于其功能和潜在应用的讨论。

- 关于其性能的细节、与其他模型的比较以及技术规格尚未详细阐述,这让社区对其影响感到好奇。

- YouTube 带来新鲜教程诱惑:一名公会成员发布了一个新 YouTube 教程链接,旨在以视频形式提供教育内容。

- 视频的教育价值及其与 AI 工程师社区的相关性细节未被讨论,促使成员们独立寻找该内容。

OpenInterpreter Discord

- Meta 智能眼镜面临挑战:工程师们正努力将 Open Interpreter 集成到 RayBan Stories 中,但由于缺乏官方 SDK 和难以获取硬件访问权限而受阻。

- 拆解设备的尝试揭示了障碍,并在 Pastebin 文档中进行了讨论,涉及对内部粘合剂和提高改装透明度的担忧。

- Google Glass:Open Interpreter 的新窗口?:鉴于破解 RayBan Stories 的困难,Google Glass 被提议作为可能的替代平台。

- 该建议提出后对话寥寥,表明需要进一步调查或社区投入。

- O1 Light 硬件:耐心消磨殆尽:社区对 O1 Light 硬件预订长达数月的延迟感到不满,且更新消息一直处于令人烦恼的沉默状态。

- 成员们表达了他们的不满,表明对产品的期待已变得紧张,缺乏沟通加剧了他们的不安。

LLM Finetuning (Hamel + Dan) Discord

- 消除困惑:访问 GPT-4o 微调:关于 GPT-4o 微调访问权限的咨询得到了澄清,即必须获得 OpenAI 的邀请,正如一位用户引用 Kyle 的声明所强调的那样。

- 讨论在 #general 频道展开,反映了社区探索微调能力的渴望。

- OpenPipeAI 支持 GPT-4o:负责任地训练:OpenPipeAI 宣布支持 GPT-4o 训练,Corbtt 呼吁负责任地使用。

- 这一更新为 AI 工程师在 AI 训练任务中更有效地利用课程学分提供了途径。

tinygrad (George Hotz) Discord

- 深入 Tinygrad 核心:剖析中间表示:人们对 tinygrad 的中间语言产生了浓厚兴趣,用户对 IR 中深度学习算子的结构感到好奇。

- 大家交流了利用调试选项 DEBUG=3 来深入了解底层 IR 的技巧,同时 GRAPH=1 和 GRAPHUOPS=1 命令成为可视化 tinygrad 内部复杂性的首选选项。

- Tinygrad 轶事:可视化与调试动态:在讨论中,有人分享了使用 DEBUG=3 调试 tinygrad 的心得,揭示了中间表示错综复杂的底层细节。

- 此外,对于那些热衷于可视化的人来说,调用 GRAPH=1 和 GRAPHUOPS=1 可以将 tinygrad 抽象的内部结构转化为清晰的图形。

Mozilla AI Discord

- 通过 Open Interpreter 开启洞察:Mike Bird 重点介绍了 Open Interpreter,并邀请大家积极参与。

- 在阐述 Open Interpreter 的过程中,通过鼓励观众提问来推动互动。

- 与 Interpreter 互动:在 Mike Bird 展示项目细节时,现场围绕 Open Interpreter 展开了热烈讨论。

- 演示期间,与会者受邀针对 Open Interpreter 进行提问并进一步深入交流。

Alignment Lab AI Discord 没有新消息。如果该社区长期处于沉寂状态,请告知我们,我们将将其移除。

LLM Perf Enthusiasts AI Discord 没有新消息。如果该社区长期处于沉寂状态,请告知我们,我们将将其移除。

AI Stack Devs (Yoko Li) Discord 没有新消息。如果该社区长期处于沉寂状态,请告知我们,我们将将其移除。

MLOps @Chipro Discord 没有新消息。如果该社区长期处于沉寂状态,请告知我们,我们将将其移除。

DiscoResearch Discord 没有新消息。如果该社区长期处于沉寂状态,请告知我们,我们将将其移除。

AI21 Labs (Jamba) Discord 没有新消息。如果该社区长期处于沉寂状态,请告知我们,我们将将其移除。

第二部分:按频道划分的详细摘要和链接

为了便于邮件阅读,完整的频道分类明细已被截断。

如果你喜欢 AInews,请分享给朋友!预谢支持!