ainews-llama-31-the-synthetic-data-model

Llama 3.1:合成数据模型

Meta AI 发布了 Llama 3.1,其中包括一个 405B(4050亿)参数模型,该模型触及了诸如《欧盟人工智能法案》和 SB 1047 等监管考量。该模型在代码、数学、多语言、长上下文和工具使用的微调中大量采用了合成数据技术,并利用来自 Llama 2 的合成偏好数据进行了 RLHF(基于人类反馈的强化学习)。

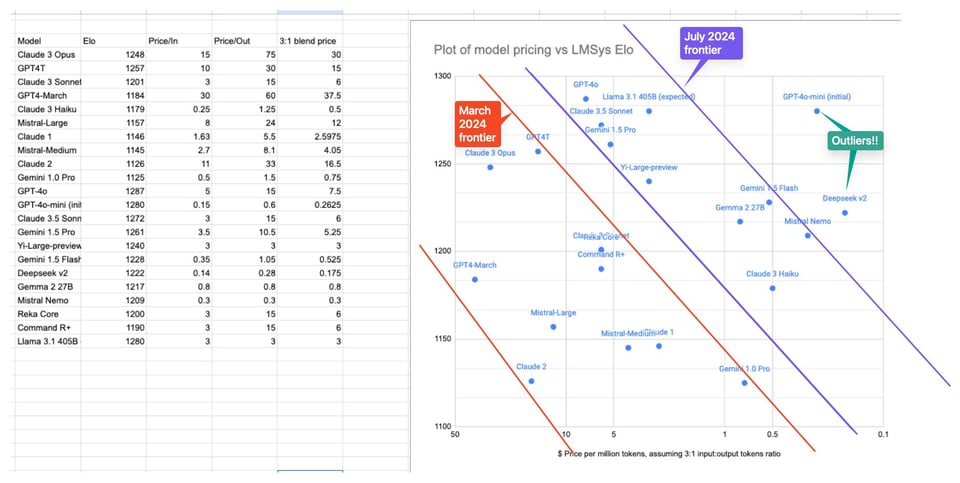

此次发布与各大推理服务提供商协同进行,其中 Groq 展示了每秒 750 个 token 的推理速度,而 Fireworks 在价格方面具有领先优势。更新后的许可协议明确允许生成合成数据,这标志着开源前沿级大语言模型迈出了重要一步,也体现了自三月以来成本效益的显著提升。

Synthetic Data is all you need.

2024年7月22日至7月23日的 AI 新闻。我们为您检查了 7 个 subreddits、384 个 Twitter 账号 和 30 个 Discord(474 个频道和 5128 条消息)。预计节省阅读时间(按 200wpm 计算):473 分钟。您现在可以标记 @smol_ai 进行 AINews 讨论!

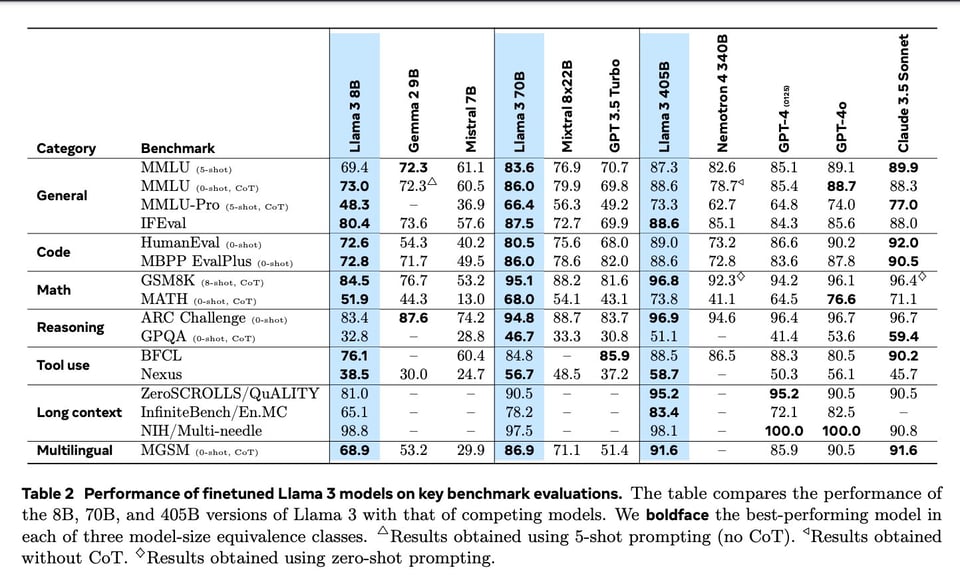

Llama 3.1 来了! (网站、视频、论文、代码、模型、Zuck、Latent Space 播客)。包括 405B 模型,它同时触发了 欧盟 AI 法案 (EU AI act) 和 SB 1047。完整论文 包含了你想要的所有 Frontier Model 对比:

我们假设您已经阅读了 昨天 的头条新闻。它目前还没有在 LMsys 上线,但 SEAL 和 Allen AI 的 ZeroEval 的独立评估结果令人期待(尽管存在一些 分歧)。这是一次跨越行业内几乎所有推理提供商的协同发布,当然也包括 Groq 展示的 750tok/s 惊人推理速度演示。推理定价也已公布,Fireworks 处于领先地位。

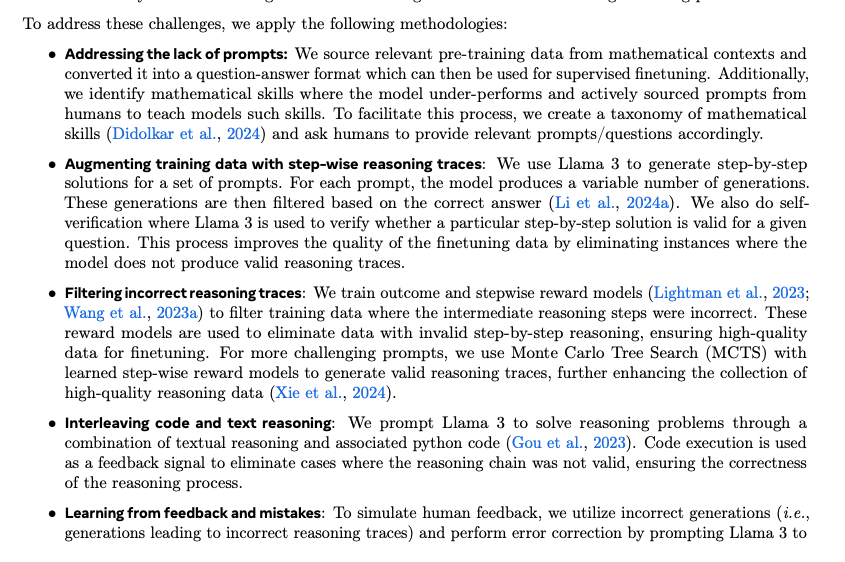

虽然人们普遍推测 8B 和 70B 是 405B 的 “离线蒸馏 (offline distillations)”,但 Llama 3.1 中的 Synthetic Data 元素比预期的要多得多。论文中明确指出:

- 代码 SFT:3 种 Synthetic Data 方法 用于 405B 的自我引导(bootstrapping),包括代码执行反馈、编程语言翻译和文档回译(docs backtranslation)。

-

数学 SFT:

- 多语言 SFT:“为了在非英语语言中收集更高质量的人类标注,我们通过从预训练运行中分支出来,并继续在由 90% 多语言 Token 组成的数据混合上进行预训练,从而训练出一个多语言专家模型。”

- 长上下文 SFT:“由于阅读冗长上下文的性质既乏味又耗时,让模型人类标注此类示例在很大程度上是不切实际的,因此我们主要依靠 Synthetic Data 来填补这一空白。 我们使用早期版本的 Llama 3,根据关键的长上下文用例生成 Synthetic Data:(可能是多轮的) 问答、长文档摘要以及代码库推理,并在下文中进行更详细的描述。”

- 工具使用 SFT:针对 Brave Search、Wolfram Alpha 和 Python 解释器(一个新的特殊

ipython角色)进行了训练,支持单次、嵌套、并行和多轮函数调用 (function calling)。 - RLHF:DPO 偏好数据广泛应用于 Llama 2 的生成结果。正如 Thomas 在播客中所说:“Llama 3 的后训练(post-training)基本上没有任何人类编写的答案……它只是利用了来自 Llama 2 的纯 Synthetic Data。”

最后但同样重要的一点是,Llama 3.1 获得了许可证更新,明确允许将其用于 Synthetic Data 生成。

我们终于拥有了一个 Frontier 级别的开源 LLM。值得注意的是,自三月份以来,整个行业在 单位智能成本 (cost per intelligence) 方面取得了巨大的进步,而且未来只会变得更好。

AI Twitter 摘要

所有摘要均由 Claude 3.5 Sonnet 完成,取 4 次运行中的最佳结果。

Meta AI

- Llama 3.1 405B 模型:@bindureddy 指出 Llama-3.1 405B 的基准测试在 Reddit 上泄露,表现优于 GPT-4o。@Teknium1 分享了一张对比 Llama-3.1 405/70/8b 与 GPT-4o 的图片,展示了目前已开源的 SOTA 前沿模型。@abacaj 提到 Meta 训练和发布 open weights 模型速度比 OpenAI 发布闭源模型还要快。

- Llama 3 70B 性能:@rohanpaul_ai 强调 70B 模型在体积缩小 6 倍的情况下达到了 GPT-4 的水平。这是 base 模型,而非经过 instruct tuned 的模型。@rohanpaul_ai 指出 70B 模型正在蚕食 405B 的领地,而大模型的作用将是用于蒸馏 (distill)。

- 开源模型进展:@teortaxesTex 称之为 “老当益壮” (Old Man Strength) 开源模型的黎明。@abacaj 提到 OpenAI 的模型并没有显著提升,因此 Meta 的模型将在 open weights 领域追赶上来。

AI 助手与 Agent

- Omnipilot AI:@svpino 介绍了 @OmnipilotAI,这是一款 AI 应用,可以在任何你能打字的地方输入,并利用屏幕内容的完整 context。它适用于所有 macOS 应用程序,并使用 Claude Sonet 3.5, Gemini 和 GPT-4o。示例包括回复电子邮件、自动补全终端命令、完成文档以及发送 Slack 消息。

- Mixture of agents:@llama_index 分享了 @1littlecoder 的视频,介绍了 “mixture of agents”——使用多个本地语言模型,性能可能超越单个模型。其中包括使用 LlamaIndex 和 Ollama 实现的教程,在分层架构中结合了 Llama 3, Mistral, StableLM 等模型。

- Agent 规划:@hwchase17 讨论了 Agent 规划的未来。虽然模型的改进会有所帮助,但优秀的 prompting 和自定义认知架构始终是使 Agent 适应特定任务所必需的。

基准测试与评估

- LLM-as-a-Judge:@cwolferesearch 概述了 LLM-as-a-Judge,即使用更强大的 LLM 来评估另一个 LLM 输出的质量。关键要点包括使用足够能力的 judge 模型、prompt 设置(pairwise vs pointwise)、提高 pointwise 评分稳定性、chain-of-thought prompting、temperature 设置以及考虑位置偏差 (position bias)。

- 事实不一致检测:@sophiamyang 分享了关于使用 @weights_biases 微调和评估 @MistralAI 模型以检测文本摘要中的事实不一致和幻觉 (hallucinations) 的指南。该工作基于 @eugeneyan 的研究,是 Mistral Cookbook 的一部分。

- 复杂问题回答:@OfirPress 推出了一项新的基准测试,用于评估 AI 助手回答复杂自然语言问题的能力,例如“我附近有哪些餐厅提供 25 美元以下的素食和无麸质主菜?”,目标是推动开发更好的助手。

框架与工具

- DSPy:@lateinteraction 分享了一篇论文,发现 DSPy 优化器在优化权重和 prompt 之间交替进行,比仅优化其中之一可获得高达 26% 的提升。@lateinteraction 指出基于模块化 NLP 程序的组合式优化器是未来,并建议组合使用 BootstrapFewShot 和 BootstrapFinetune 优化器。

- LangChain:@hwchase17 指向了新的 LangChain 更新日志 (Changelog),以便更好地沟通他们发布的所有内容。@LangChainAI 强调了 LangGraph.js 中无需额外配置的无缝 LangSmith 追踪,使得利用 LangSmith 的功能构建 Agent 变得更加容易。

- EDA-GPT:@LangChainAI 介绍了 EDA-GPT,一个开源的数据分析助手,可简化数据探索、可视化和洞察。它具有可配置的 UI 并与 LangChain 集成。

AI Reddit 摘要

/r/LocalLlama 摘要

主题 1. 在本地运行大语言模型

-

如果你必须问如何本地运行 405B (Score: 287, Comments: 122):该帖子探讨了在本地运行 4050 亿参数模型的不可能性。文章直言不讳地指出,如果有人需要询问如何做到这一点,那么他们根本无法实现,暗示这项任务超出了典型消费级硬件的能力范围。

-

请为我们这些 GPU 贫民分享你们的 LLaMA 3.1 405B 使用体验 (Score: 52, Comments: 30):该帖子请求用户分享在本地运行 LLaMA 3.1 405B 的经验,特别是针对那些 GPU 资源有限的用户。虽然正文中没有提供具体的经验,但标题表明了人们对了解这种超大语言模型在消费级硬件上的表现,以及 GPU 性能较低的用户所面临的挑战有着浓厚兴趣。

-

我希望当初那个笨拙的自己能早点知道的 Ollama 网站“专业技巧”: (Score: 72, Comments: 24):该帖子重点介绍了使用 Ollama 网站下载和运行 AI 模型的几个“专业技巧”。关键功能包括:通过“Tags”链接访问模型的不同量化版本 (quantizations);通过搜索框访问隐藏的模型类型排序功能;在模型表格中查找最大上下文窗口大小 (max context window sizes);以及使用顶部搜索框访问更广泛的模型列表(包括用户提交的模型)。作者已经使用 Ollama 6-8 个月,分享这些见解是为了帮助其他可能忽略了这些功能的人。

主题 2. LLaMA 3.1 405B 模型发布与基准测试

-

[Azure Llama 3.1 基准测试] (https://github.com/Azure/azureml-assets/pull/3180/files) (Score: 349, Comments: 268):Microsoft 发布了 Azure Llama 3.1 的基准测试结果,显示出比之前版本的改进。该模型在 MMLU 基准测试中获得了 94.4% 的分数,超过了 GPT-3.5 并接近 GPT-4 的性能。Azure Llama 3.1 在代码生成和多轮对话方面也表现出强大的能力,使其成为 AI 模型领域中极具竞争力的选择。

-

[Llama 3.1 405B, 70B, 8B 指令微调版基准测试] (https://i.redd.it/62ov7fzck5ed1.jpeg) (Score: 137, Comments: 28):Meta 发布了 LLaMA 3.1,包含 405B、70B 和 8B 参数的模型,所有模型都经过了指令微调 (instruct-tuned)。405B 模型在各种基准测试中达到了业界领先 (state-of-the-art) 的水平,在多项任务上超越了 GPT-4,而 70B 模型在面对 Claude 2 和 GPT-3.5 时也表现出极具竞争力的结果。

-

LLaMA 3.1 405B 基座模型开放下载 (Score: 589, Comments: 314):大小为 764GiB (~820GB) 的 LLaMA 3.1 405B 基座模型 (base model) 现已开放下载。可以通过 Hugging Face 链接、磁力链接或 种子文件获取该模型,来源归功于 4chan 论坛的一个帖子。

- 用户讨论了运行 405B 模型的可能性,建议包括使用 2x A100 GPU (160GB VRAM) 配合低量化版本,或者在 Hetzner 上以每月 200-250 美元的价格租用拥有 数 TB RAM 的服务器,在 Q8/Q4 量化下可能达到 每秒 1-2 个 token。

- 关于在 Nintendo 64 上运行该模型或“下载更多 VRAM”的幽默评论引发了对硬件限制的讨论。用户推测,消费级 GPU 可能需要 5-10 年才能处理如此巨大的模型。

- 一些人质疑泄露的真实性,指出其与之前的泄露(如 Mistral medium (Miqu-1))有相似之处。另一些人则争论这是否是 Meta 在正式发布前为了营销目的而进行的有意“泄露”。

主题 3. 分布式与联邦 AI 推理

-

LocalAI 2.19 发布!支持 P2P、自动发现、联邦实例(Federated instances)和分片模型加载(sharded model loading)! (Score: 52, Comments: 7): LocalAI 2.19 引入了联邦实例和通过 P2P 进行的分片模型加载,允许用户跨多个节点结合 GPU 和 CPU 算力来运行大型模型,而无需昂贵的硬件。该版本包括一个新的 P2P 仪表板用于轻松设置联邦实例,在二进制发行版中集成了 Text-to-Speech,并改进了 WebUI、安装脚本以及支持 embeddings 的 llama-cpp 后端。

-

Ollama 已更新以适配 Mistral NeMo,现已提供正式下载 (Score: 63, Comments: 13): Ollama 已更新,增加了对 Mistral NeMo 模型的支持,现已开放下载。用户报告称,在拥有 16GB VRAM 的 4060 Ti GPU 上,NeMo 的表现比 Llama 3 8b 和 Gemma 2 9b 模型更快、更好,并指出这是继 Gemma 发布后本地 AI 模型的又一重大进展。

- 用户称赞了 Mistral NeMo 12b 的性能,其中一位指出它“完美通过(NAILED)”了 48k context 测试,并表现出流利的法语水平。然而,随着即将发布的 Llama 3.1 8b,它的使用寿命可能较短。

- 一些用户对下载该模型表示兴奋,而另一些人则认为它与 tiger-gemma2 相比令人失望,特别是在多轮对话中的指令遵循方面。

- Mistral NeMo 的发布时机被描述为对开发者来说“非常遗憾”,因为它紧随其他重要模型的发布之后。

主题 4. 新 AI 模型发布与泄露

- Nvidia 发布了两个新的基础模型:Minitron 8B 和 4B,是 Nemotron-4 15B 的剪枝版本 (Score: 69, Comments: 3): Nvidia 发布了 Minitron 8B 和 4B,这是其 Nemotron-4 15B 模型的剪枝(pruned)版本,与从头开始训练相比,它们需要的 训练 token 减少了多达 40 倍,并节省了 1.8 倍的计算成本。这些模型在 MMLU 评分上比从头训练的模型提高了多达 16%,性能与 Mistral 7B 和 Llama-3 8B 等模型相当,仅用于研究和开发目的。

- 剪枝模型(Pruned models) 在 AI 领域并不常见,Minitron 8B 和 4B 是值得注意的例外。这种稀缺性引起了研究人员和开发者的兴趣。

- 剪枝(pruning) 的概念在直觉上与 量化(quantization) 相似,尽管一些用户推测对剪枝后的模型进行量化可能会对性能产生负面影响。

- AWQ (Activation-aware Weight Quantization) 被拿来与剪枝进行比较,剪枝可能通过减少整体模型维度而不仅仅是压缩位表示来提供更大的收益。

- llama 3.1 download.sh 提交记录 (Score: 66, Comments: 18): Meta Llama GitHub 仓库最近的一次提交表明 LLaMA 3.1 可能即将发布。该提交可在 https://github.com/meta-llama/llama/commit/12b676b909368581d39cebafae57226688d5676a 查看,其中包含一个 download.sh 脚本,可能预示着模型分发的准备工作。

- 提交内容显示了 Base 和 Instruct 版本的 405B 模型,变体标记为 mp16、mp8 和 fp8。用户推测 “mp” 可能代表 混合精度(mixed precision),暗示了针对打包混合精度模型的量化感知训练(quantization-aware training)。

- 关于 Instruct 模型中 fb8 标签的讨论得出结论,这很可能是 fp8 的拼写错误,文件中的证据支持了这一点。用户对分析权重精度以实现更好的低比特量化的潜力感到兴奋。

- 提交作者 samuelselvan 此前曾向 Hugging Face 上传过一个被认为可疑的 LLaMA 3.1 模型。用户对 Meta 直接发布模型的量化版本表现出极大的热情。

- Llama 3 405b 在 4chan 上泄露了?太期待了!还有一天!! (Score: 210, Comments: 38): 关于 LLaMA 3.1 405B 模型在 4chan 上泄露的消息正在流传,但这些说法尚未经过证实,且很可能是虚假的。据称的泄露发生在预期官方发布的前一天,引发了对其真实性的怀疑。对待此类泄露信息应保持谨慎,并等待来自 Meta 或其他可靠来源的官方确认。

- 据报道,一个包含该模型的 HuggingFace 仓库 在 2 天前 曾公开可见,这可能让潜在的泄露者获得了访问权限。用户对该模型的 70B 和 8B 版本表现出了浓厚兴趣。

- 相比于等待官方发布,一些用户对没有对齐 (alignment) 或护栏 (guardrails) 的 纯基础模型 (base model) 更感兴趣。/r/LocalLLaMA 上的另一个帖子讨论了所谓的 405B base model 下载。

- 用户正尝试运行该模型,其中一人计划使用 7x24GB GPU 配置 将其转换为 4-bit GGUF 量化。另一位用户分享了他们尝试运行该模型的 YouTube 链接。

AI Reddit 全摘要

r/machinelearning, r/openai, r/stablediffusion, r/ArtificialInteligence, /r/LLMDevs, /r/Singularity

主题 1. OpenAI 的全民基本收入 (UBI) 实验结果

-

[/r/singularity] OpenResearch 团队发布了他们 UBI 研究的首个结果 (OpenAI) (Score: 280, Comments: 84): OpenResearch(OpenAI 的一个团队)发布了其 全民基本收入 (UBI) 研究 的初步结果。这项在 肯尼亚村庄 进行的研究发现,1,000 美元的现金转移 产生了显著的积极影响,包括资产增加了 400 美元,以及挨饿的可能性降低了 40%。这些发现为支持通过直接现金转移缓解贫困的有效性提供了更多证据。

-

[/r/OpenAI] OpenAI 创始人 Sam Altman 秘密向随机人群发放了 4500 万美元——作为一项实验 (Score: 272, Comments: 75): Sam Altman 的 4500 万美元 UBI 实验揭晓:这位 OpenAI 创始人 秘密地向美国两个州的 3,000 人 发放了 4500 万美元,作为 全民基本收入 (UBI) 实验 的一部分。参与者每月领取 1,000 美元,持续长达 五年。该研究旨在评估无条件现金转移对受助者的生活质量、时间利用和财务状况的影响。

- 3,000 名参与者 每月领取 1,000 美元或 50 美元,持续长达 五年,许多 Redditor 表达了加入该实验的愿望。该研究针对 德克萨斯州和伊利诺伊州 城市、郊区和农村地区,家庭收入低于 联邦贫困线 300% 的 21-40 岁 人群。

- 一些用户批评该实验是 科技亿万富翁 的公关手段 (PR move),旨在缓解人们对 AI 驱动的失业 的担忧;而另一些人则认为,鉴于政府在这一问题上行动迟缓,私人的 UBI 实验是必要的。

- 讨论中出现了关于就业未来的看法,一些人预测由于 AI 的进步,失业率将突然飙升,当各行各业的传统工作变得稀缺时,可能会导致 UBI 的广泛实施。

主题 4. AI 研究员对 AGI 时间线的预测

-

[/r/singularity] 前 OpenAI 研究员的预测 (Score: 243, Comments: 151): 前 OpenAI 研究员预测 AGI 时间线:前 OpenAI 研究员 Paul Christiano 估计,到 2030 年有 20-30% 的机会实现 AGI,到 2040 年有 60-70% 的机会。他认为目前的 AI 系统距离 AGI 还很远,但在推理 (reasoning) 和规划 (planning) 等领域的快速进展可能会在未来几年带来重大突破。

-

[/r/singularity] “顶尖秘密实验室的大多数员工都在认真地根据 2027 年数字神灵的出现来规划他们的生活” (Score: 579, Comments: 450): AI 研究人员预见数字神灵:根据该帖子,据报道,顶尖秘密 AI 实验室的大多数员工正根据 2027 年预期出现的数字神灵来规划他们的生活。虽然没有提供具体的来源或证据,但这一说法表明 AI 研究人员在看待未来 AI 系统的潜在能力和影响方面,心态发生了重大转变。

-

[/r/singularity] Nick Bostrom 表示,在 AI 能够完成人脑所能做的一切事情后不久,它将学会更好、更快地完成这些事情,而人类智能将变得过时 (Score: 323, Comments: 258): Nick Bostrom 警告称 AI 将以快速且变革性的方式超越人类智能。他预测,一旦 AI 能够匹配人脑的能力,它将迅速在所有领域超越人类,使人类智能变得过时。这种加速的进步暗示了潜在的智能爆炸,即 AI 的能力迅速超过人类,从而导致重大的社会和生存影响。

- Nick Bostrom 的警告引发了辩论,一些人因 AI 能够连接 100k GPUs 而称其为“显而易见的废话”,而另一些人则考虑到目前关于 AI 能力的持续争论,捍卫了他信息的重要性。

- 讨论范围从幽默的梗图到关于“被解决的世界”的哲学思考,一位用户描述了一个假设的 2055 年场景,即 AGI 和 ASI 带来了医学突破、全沉浸式 VR 和模拟现实。

- 一些用户对 AI 解决海洋退化等重大问题表示乐观,而另一些人则对潜在的负面结果表示担忧,例如人口减少的情景,或由于阻力而实施必要变革所面临的挑战。

主题 5. AI 训练基础设施的新进展

- [/r/singularity] Elon 表示,今天一个模型已开始在世界上最新且最强大的 AI 集群上进行训练 (Score: 239, Comments: 328): Elon Musk 宣布突破性的 AI 进展:一个新的 AI 模型已开始在 Musk 声称的全球最强大的 AI 集群上进行训练。这一公告标志着 AI 计算能力的重大里程碑,有可能推高大语言模型训练和性能的边界。

AI Discord 摘要

摘要之摘要的摘要

1. LLM 进展与基准测试

- Llama 3.1 发布热潮:Llama 3.1 模型(包括 8B 和 405B)现已发布,在社区中引发了巨大反响。用户分享了他们的经验和故障排除技巧,以解决如本地运行模型以及在微调期间管理高 loss 值等问题。

- 社区赞扬了该模型的性能,一些人指出它在基准测试中超越了现有的私有模型,而另一些人则强调了实际部署中的挑战。

- Meta 对开源 AI 的承诺:Meta 发布了包含 405B 等模型的 Llama 3.1,推向了开源 AI 的新边界,提供 128K token context 并支持多种语言。此举符合 Mark Zuckerberg 通过开放协作促进创新的愿景。

- 社区讨论了此次发布的战略意义,强调了该模型挑战 GPT-4 等顶级闭源替代方案的潜力。

2. 优化 LLM 推理与训练

- 高效微调技术讨论:ReFT 论文介绍了一种比 LoRA 参数效率高 15x-60x 的方法,该方法通过作用于 residual stream,在结合训练任务与优化参数方面提供了灵活性。

- 社区成员与主作者进行了交流,以了解其实际应用,强调了该方法在提高微调效率方面的潜力。

- GPU 兼容性挑战:用户报告了 Linux 上的 GPU 检测问题,特别是 Radeon RX5700XT,引发了对 RDNA 1 support 的关注。讨论强调了正确配置对于 GPU 识别的重要性。

- 一些用户确认扩展包未能解决问题,表明需要进一步的故障排除以及开发者的潜在更新。

3. 开源 AI 框架与社区努力

- LlamaIndex 关于高效文档检索的网络研讨会:即将举行的网络研讨会将于本周五上午 9am PT 讨论使用 Vision Language Models 进行高效文档检索。参与者可以报名学习文档处理领域的前沿技术。

- 研讨会旨在探索 ColPali 使用 Vision Language Models 嵌入 page screenshots 的创新方法,从而增强对复杂文档的检索性能。

- Magpie 论文引发辩论:成员们辩论了 Magpie 论文中见解的实用性,质疑生成的指令是提供了实质性的效用,还是仅仅是一个 party trick(噱头)。

- 讨论突显了对指令生成新兴技术的持续评估,反映了社区对新研究的批判性参与。

4. 多模态 AI 与生成模型创新

- UltraPixel 创建高分辨率图像:UltraPixel 是一个能够生成极高质量细节的高分辨率图像的项目,通过专注于 clarity(清晰度)和 detail(细节)推向了图像生成的边界。

- 社区对该项目的功能表现出浓厚兴趣,探索了其潜在应用,并分享了项目链接以供进一步参与。

- Idefics2 和 CodeGemma:新型多模态模型:Idefics2 8B Chatty 专注于提升聊天交互体验,而 CodeGemma 1.1 7B 则精进了编程能力。

- 这些模型代表了多模态 AI 的重大进步,社区讨论了它们在增强用户交互和编程任务方面的潜力。

第一部分:高层级 Discord 摘要

HuggingFace Discord

- NuminaMath 数据集发布:NuminaMath 数据集已发布,包含约 1M 个数学问题-解答对,曾助力获得 AI Math Olympiad 的 Progress Prize。其中包括专为 Chain of Thought 和 Tool-integrated reasoning 设计的子集,显著提升了在数学竞赛基准测试中的表现。

- 在这些数据集上训练的模型展示了同类最佳性能,超越了现有的私有模型。请在 🤗 Hub 查看发布内容。

- Llama 3.1 发布引发热潮:近期 Llama 3.1 的发布引发了广泛关注,8B 和 405B 等模型现已开放测试。用户正积极分享使用经验,包括在本地运行模型时的故障排除。

- 社区参与并分享了各种见解,并为早期采用者面临的运行挑战提供支持。

- 模型微调中的挑战:在针对特定任务微调模型时,高 Loss 值和性能问题引发了一些挫败感。社区建议了一些资源和实践方法来有效应对这些挑战。

- 知识交流旨在改进模型训练和评估流程。

- UltraPixel 创作高分辨率图像:UltraPixel 作为一个能够生成极高质量细节的高分辨率图像项目被展示。该计划专注于清晰度和细节,推向了图像生成的边界。

- 访问此链接查看该项目。

- 对分割技术的兴趣:另一位成员对在使用扩散模型去除背景的同时,如何应用有效的分割技术 (segmentation techniques) 表示出兴趣。他们正在寻求关于成功方法或模型的建议。

- 对话旨在探索图像分割的最佳实践。

Nous Research AI Discord

- Magpie 论文引发辩论:成员们讨论了 Magpie 论文 中的见解是否具有实质性效用,还是仅仅是一个噱头 (party trick),重点关注生成指令的质量和多样性。

- 这一探讨突显了对指令生成领域新兴技术的持续评估。

- ReFT 论文揭示高效微调方法:ReFT 论文 的第一作者澄清说,该方法通过在 residual stream 上操作,比 LoRA 的参数效率高出 15x-60x。

- 这为结合训练任务与优化参数提供了灵活性,强化了高效微调策略的相关性。

- Bud-E 语音助手获得关注:Bud-E 语音助手 演示强调了其开源潜力,目前已针对 Ubuntu 进行了优化,Christoph 正在领导黑客松活动以吸引社区参与。

- 此类协作努力旨在促进志愿者的贡献,扩大项目范围。

- Llama 3.1 在基准测试中表现出色:Llama 3.1 405B Instruct-Turbo 在 GSM8K 上排名第一,在逻辑推理方面与 GPT-4o 旗鼓相当,尽管在 MMLU-Redux 上的表现似乎稍弱。

- 这种差异强化了在不同基准数据集上进行全面评估的重要性。

- 推荐 Kuzu 图数据库:成员们推荐了与 LlamaIndex 集成的 Kuzu GraphStore,特别是其 MIT license 确保了开发者的可访问性。

- 采用先进的图数据库功能为数据管理提供了可行的替代方案,尤其是在复杂系统中。

LM Studio Discord

- LM Studio 性能见解:用户强调了 Llama 3.1 模型之间的性能差异,指出运行大型模型需要大量的 GPU 资源,特别是 405B 变体。

- 一位用户幽默地评论说,为了有效运行这些模型,需要 一个小国家的电力供应。

- 模型下载困扰:由于 DNS 问题以及 Llama 3.1 的流行导致 Hugging Face 流量激增,几位成员指出下载模型存在困难。

- 一位用户建议在应用内提供禁用 IPv6 的选项,以缓解其中的一些下载挑战。

- GPU 兼容性挑战:新的 Linux 用户报告了 LM Studio 在识别 Radeon RX5700XT 等 GPU 时遇到麻烦,引发了对 RDNA 1 support 的担忧。

- 讨论强调了正确配置 GPU 识别的重要性,一些用户确认 extension packs 并不能解决这些问题。

- Llama 3.1 提供新特性:Llama 3.1 已经发布并带来了改进,包括高达 128k 的上下文长度,可在 Hugging Face 上下载。

- 鼓励用户探索该模型增强的性能,特别是针对内存密集型任务。

- 更新后 ROCm 性能问题:一位用户指出,更新到 ROCm 0.2.28 导致推理速度显著变慢,其 7900XT 的功耗降至 150w。

- 回退到 0.2.27 恢复了性能,这表明需要明确新版本中的功能变化。

Perplexity AI Discord

- Llama 3.1 405B 发布与 API 集成:备受期待的 Llama 3.1 405B 模型现已在 Perplexity 上线,可与 GPT-4o 和 Claude Sonnet 3.5 媲美,增强了平台的 AI 能力。

- 用户询问了将 Llama 3.1 405B 添加到 Perplexity API 的情况,询问是否很快会推出,并分享了关于模型性能的各种体验。

- 对 Llama 3.1 性能的担忧:用户报告了 Llama 3.1 405B 的问题,包括回答重复以及理解亚洲符号方面的困难,导致许多人考虑回退到 Claude 3.5 Sonnet。

- 对比评估表明,虽然 Llama 3.1 是一个飞跃,但 Claude 在速度和编程任务方面仍具有优势。

- 探索 Dark Oxygen 和 Mercury’s Diamonds:最近的一项讨论集中在 Dark Oxygen 上,提出了关于其对大气研究和生态平衡影响的问题。

- 此外,关于 Diamonds on Mercury 的见解也浮出水面,引发了人们对可能导致其形成的地球物理过程的兴趣。

- Beach-Cleaning Robots 大放异彩:beach-cleaning robot technology 的创新受到关注,展示了有效应对海洋污染的努力。

- 这些机器人对 marine ecosystems 的影响是讨论的一个重点,会上分享了来自试验的实时数据。

- Perplexity API 的 DSGVO 合规性:用户对 Perplexity API 是否符合 DSGVO 标准表示担忧,寻求数据保护合规性方面的澄清。

- 对话中分享了引用 GDPR 合规性的 服务条款。

Stability.ai (Stable Diffusion) Discord

- AI 模型排名,Kolors 位居榜首:在最新的讨论中,用户对 AI 模型进行了排名,Kolors 因其出色的速度和性能位列第一,随后是 Auraflow、Pixart Sigma 和 Hunyuan。

- Kolors 的表现非常符合用户对 SD3 的预期。

- 训练 Lycoris 遇到兼容性障碍:讨论集中在使用 ComfyUI 和 Kohya-ss 等工具训练 Lycoris,用户对需要 Python 3.10.9 或更高版本的兼容性要求表示沮丧。

- 期待 Onetrainer 可能会发布更新以简化这一过程。

- 社区对 Stable Diffusion 的反应:用户辩论了社区对 Stable Diffusion 的看法,认为最近的批评通常源于对模型许可(licensing)的误解。

- 用户对营销策略以及针对 Stability AI 的负面情绪表示担忧。

- AI 采样方法的创新:引入了一个新的采样器节点,实现了 Strong Stability Preserving Runge-Kutta 和隐式变步长求解器,引起了用户对提升 AI 性能的兴趣。

- 用户热烈讨论了这些更新为 AI 模型效能带来的潜在改进。

- 关于 AI 体验的闲聊:随着用户分享 AI 的个人体验(包括学习编程语言和评估与健康相关的专注力挑战),一般性讨论也蓬勃发展。

- 这些闲聊增加了对 AI 日常应用的深入理解。

OpenRouter (Alex Atallah) Discord

- Llama 3 405B 发布,价格极具竞争力:Llama 3 405B 以 $3/M tokens 的价格发布,与 GPT-4o 和 Claude 3.5 Sonnet 展开竞争,同时展示了用于生成合成数据的惊人 128K token 上下文。

- 用户反应热烈,评论道“这是目前最好的开源 LLM”,并对该模型的能力表示兴奋。

- 对模型性能的担忧日益增加:关于 Llama 405B 的反馈显示性能结果褒贬不一,特别是在翻译任务中,其表现不如 Claude 和 GPT-4。

- 一些用户报告 70B 版本在生成几个 token 后会出现“乱码”,引发了对其在特定任务使用中可靠性的担忧。

- 令人兴奋的 OpenRouter 功能更新:OpenRouter 的新功能包括追溯发票(Retroactive Invoices)、自定义密钥以及 Playground 的改进,全面增强了用户功能。

- 鼓励社区成员在这里分享反馈,以进一步优化用户体验。

- 发起多 LLM 提示词竞赛:宣布了一项针对 Llama 405B、GPT-4o 和 Claude 3.5 Sonnet 的提示词竞赛(prompting competition),参与者有机会赢取 15 个免费额度。

- 参与者渴望了解评审标准,特别是关于什么才算作“高难度提示词”。

- DeepSeek Coder V2 推理提供商公布:引入了 DeepSeek Coder V2 新的私有推理提供商,在不进行输入训练的情况下运行,这显著拓宽了 OpenRouter 的服务范围。

- 用户可以开始通过 DeepSeek Coder 探索该服务。

CUDA MODE Discord

- CUDA 中 Flash Attention 的困惑:一名成员对 Flash Attention 中寄存器的高效管理提出了疑问,并对其在 CUDA 编程中与共享内存(shared memory)结合使用的方式表示关注。

- 这引发了在高性能计算(high-performance computing)背景下对寄存器分配策略进行更清晰说明的广泛需求。

- Torch Compile 的内存挑战:在一个小型 Bert 模型中使用

torch.compile导致了显著的 RAM 占用,迫使 batch size 从 512 削减至 160,且性能落后于 eager mode。- 测试表明,尽管存在这些担忧,模型仍成功编译,这突显了 PyTorch 中的内存管理问题。

- Meta Llama 3.1 专注于文本:Meta 发布的 Llama 3.1 405B 将上下文长度扩展至 128K 并支持八种语言,目前暂不支持多模态(multi-modal)功能,这引发了战略层面的讨论。

- 这一功能的缺失符合对其潜在财务收益以及在财报发布前竞争定位的预期。

- 优化 CUDA Kernel 性能:用户经验表明,转向分块矩阵乘法(tiled matrix multiplication)带来的性能提升有限,这与一篇关于 CUDA 矩阵乘法基准测试的相关文章结论相似。

- 讨论强调了计算强度(compute intensity)对于优化 Kernel 性能的重要性,尤其是在早期阶段。

- AMD 上的 Stable Diffusion 加速:一篇文章详细介绍了如何使用适用于 AMD RDNA3 GPU 的 Composable Kernel 库 来优化 Stable Diffusion 在 RX7900XTX 上的推理(inferencing)。

- 此外,最近的一个 GitHub pull request 强调了对 AMD ROCm 上 Flash Attention 的支持,该支持对 mi200 & mi300 有效。

OpenAI Discord

- GEMINI 竞赛引发关注:一名成员对 Google 的 GEMINI 竞赛 表现出极大热情,正在为该黑客松(hackathon)寻找潜在的合作伙伴。

- 如果你有兴趣合作,请联系!

- Llama 3.1 模型引发褒贬不一的反应:成员们对 Llama-3.1 模型做出了反应,一些人认为与 Claude 和 Gemini 等早期迭代版本相比,它显得“缺乏灵魂”,后者被认为保留了更多的创作深度。

- 这一讨论指出了用户对近期模型体验和预期的分歧。

- 微调 Llama 3.1 以获得无审查输出:一位用户正致力于微调 Llama-3.1 405B 的无审查版本,目标是在经过几周的训练后,在 Hugging Face 上发布 Llama3.1-406B-uncensored。

- 这一努力凸显了开发受限模型替代方案的持续兴趣。

- Discord 中的语音 AI 面临挑战:围绕创建能够参与 Discord 语音频道 的 AI 机器人展开了讨论,强调了由于目前的限制,该任务具有复杂性。

- 成员们指出了有效实施所需解决的技术挑战。

- 热切期待 Alpha 版本发布:成员们正焦急地等待 Alpha 版本的发布,有些人每 20 分钟检查一次应用,对它是会在 7 月底还是更早发布表示不确定。

- 呼吁开发者就时间表进行更清晰的沟通。

Modular (Mojo 🔥) Discord

- Mojo 社区会议演讲征集:8 月 12 日的 Mojo 社区会议 正在公开征集演讲,旨在展示开发者在 Mojo 中构建的内容。

- 成员可以报名分享经验和项目,增强社区参与度。

- 字符串和缓冲区优化成为焦点:标准库中关于 short string optimization(短字符串优化)和 small buffer optimization(小缓冲区优化)的工作正被提议进行演示,突显了其在未来会议中的相关性。

- 这项工作与过去以性能增强为中心的讨论主题相一致。

- 在 Ubuntu 虚拟机上安装 Mojo 变得简单:讨论了在 Windows 的 Ubuntu 虚拟机中安装 Mojo 的方法,建议将 WSL 和 Docker 作为可行方案。

- 虽然有人担心可能出现的安装问题,但普遍共识是使用虚拟机是合适的。

- Mojo:游戏引擎开发的未来:讨论了 Mojo 在创建下一代游戏引擎方面的潜力,强调了其对通过 GPU 进行异构计算(heterogeneous compute)的强大支持。

- 提到了分配器(allocator)处理方面的挑战,表明在游戏开发模式中存在一些障碍。

- 将 Mojo 与 C 库链接:关于改进 Mojo 与 C 库(特别是利用 libpcap)链接能力的对话正在进行中。

- 成员们主张在 Linux 上的 Mojo 默认使用 ktls,以增强网络功能。

Eleuther Discord

- FSDP 与 nn.Parameters 的性能困扰:一位用户在使用 FSDP 添加

nn.Parameters时遇到了 20 倍的减速,但 16 的参数大小显著提升了性能。- 他们讨论了 buffer alignment(缓冲区对齐)如何影响 CPU 性能,尽管 GPU kernel 运行很快。

- 在高端硬件上访问 Llama 3.1 Instruct:一位成员成功在 8xH100 80GB 上托管了 Llama 3.1 405B instruct,可通过 聊天界面 和 API 访问。

- 然而,访问需要登录,引发了关于成本和硬件限制的讨论。

- 引入 Switch SAE 以实现高效训练:Switch SAE 架构改进了稀疏自编码器(SAEs)的扩展性,解决了跨层的训练挑战。

- 相关论文表明,这可能有助于从超智能语言模型中恢复特征。

- 对 Llama 3 图像编码的担忧:讨论中提到 Llama 3 的图像编码器分辨率限制为 224x224,建议使用 vqvae-gan 风格的 tokenizer 进行增强。

- 建议关注 Armen 的小组,强调了潜在的改进空间。

- 评估任务分组策略:成员们建议对嵌套任务使用 groups(组),对简单安排使用 tags(标签),这一建议得到了 Hailey Schoelkopf 的认可。

- 该方法旨在有效地简化任务组织。

Interconnects (Nathan Lambert) Discord

- Meta 推出 Premium Llama 405B:推测 Meta 可能会在 7 月 23 日 宣布 Premium 版本的 Llama 405B,此前 Meta 最近取消了对 Llama 模型的限制,为更多样化的应用铺平了道路。

- 这一变化引发了关于更广泛用例的讨论,不再仅仅局限于增强其他模型。

- NVIDIA 的市场策略:有人担心 NVIDIA 可能会垄断 AI 领域,旨在将 硬件、CUDA 和模型产品结合起来。

- 一位用户指出,这种主导地位可能会带来巨额利润,尽管监管挑战可能会阻碍这一愿景。

- OpenAI 的定价动态:OpenAI 推出 gpt-4o-mini 每天高达 2M tokens 的免费微调,引发了关于 AI 竞争性定价环境的讨论。

- 成员们将定价格局描述为混乱,这是为了应对日益激烈的竞争而出现的。

- Llama 3.1 超出预期:Llama 3.1 的发布引入了拥有 405B 参数 的模型并增强了多语言能力,在评估中表现出与 GPT-4 相似的性能。

- 随后展开了关于潜在 模型水印 和用户下载跟踪的讨论,重点关注合规性和隐私问题。

- Magpie 的合成数据创新:Magpie 论文 强调了一种为 LLM 生成 高质量指令数据 的方法,该方法在 词汇多样性 方面超过了现有的数据源。

- 值得注意的是,在 Magpie IFT 数据集 上微调的 LLaMA 3 Base 在 AlpacaEval 上的表现比原始 LLaMA 3 Instruct 模型高出 9.5%。

OpenAccess AI Collective (axolotl) Discord

- Llama 3.1 发布引发褒贬不一的反应:Llama 3.1 的发布引起了复杂的情绪,特别是针对其在 Mistral 等模型背景下的实用性。一些成员表达了不满,正如一位成员所说:“该死,他们不喜欢 Llama 的发布”。

- 尽管有热度,但反馈表明需要更好的性能指标以及相对于前代产品更明显的优势。

- 用户面临 Llama 3.1 的训练挑战:在训练 Llama 3.1 时,与

rope_scaling配置相关的错误导致了社区的挫败感。通过更新 Transformers 找到了解决方法,展示了用户的韧性,一位用户评论道:“似乎起作用了,谢谢!”。- 这突显了新模型发布时持续存在的故障排除这一更广泛的主题。

- 对 Llama 3.1 语言包含性的担忧:Llama 3.1 排除对中文的支持引发了关于其全球影响的讨论。虽然 Tokenizer 包含中文,但缺乏优先级被批评为战略失误。

- 这次对话指出 AI 模型中语言包容性的持续必要性。

- 评估分数对比:Llama 3.1 vs Qwen:社区讨论集中在比较 Llama 3.1 的 cmmlu 和 ceval 分数,结果显示仅有边际提升。成员指出,虽然 Qwen 自报的分数更高,但评估指标的差异使得直接比较变得复杂。

- 这反映了社区对不断发展的模型性能基准的持续关注。

- 探索 LLM 蒸馏流水线:一位成员分享了 LLM Distillery GitHub 仓库,重点介绍了一个专注于预计算 Logits 和 KL divergence(KL 散度)进行 LLM 蒸馏的流水线。这表明了改进蒸馏过程的积极态度。

- 社区对优化此类流水线的兴趣反映了对提高模型训练效率的持续承诺。

DSPy Discord

- Code Confluence 工具生成 GitHub 摘要:受 DSPy 启发,一位成员介绍了 Code Confluence,这是一个使用 Antlr、Chapi 和 DSPy 流水线构建的 OSS 工具,旨在创建 GitHub 仓库的详细摘要。该工具的性能很有前景,正如在其 DSPy 仓库中演示的那样。

- 他们还分享了资源,包括 Unoplat Code Confluence GitHub 和名为 OSS Atlas 的摘要汇编。

- 新 AI 研究论文预警:一位成员分享了一篇题为 2407.12865 的 AI 研究论文链接,引发了对其研究结果的兴趣。鼓励社区成员分析并讨论其影响。

- 有人请求任何在代码中复现该发现或找到现有实现的人进行分享。

- JSON 生成库的比较:成员们讨论了 Jsonformer 和 Outlines 等库在结构化 JSON 生成方面的优势,指出 Outlines 对 Pydantic 格式提供了更好的支持。虽然 Jsonformer 在严格合规性方面表现出色,但 Guidance 和 Outlines 提供了灵活性,但也增加了复杂性。

- 考虑到社区的反馈,他们正在探索每个库在工作流中的实际应用。

- Llama3 结构化输出的挑战:用户表示在使用 DSPy 从 Llama3 获取正确结构化输出时遇到困难。他们建议将

dspy.configure(experimental=True)与 TypedChainOfThought 结合使用,以提高成功率。- 有人对即使在类型检查失败时也能查看模型输出表示担忧,发现

inspect_history在调试方面存在局限性。

- 有人对即使在类型检查失败时也能查看模型输出表示担忧,发现

- 探索 ColPali 用于医疗文档:由于之前使用 ColBert 和标准 Embedding 模型失败,一位成员分享了使用 ColPali 对带有图像的医疗文档进行 RAG 的经验。目前正在计划研究其他的 Vision-Language Models。

- 这一探索旨在增强从复杂文档类型中检索信息的有效性。

LlamaIndex Discord

- 关于高效文档检索的 LlamaIndex 网络研讨会:参加本周五上午 9 点(太平洋时间)举行的使用视觉语言模型进行高效文档检索的网络研讨会。在此注册以探索前沿技术。

- ColPali 引入了一种创新技术,直接使用 Vision Language Models 嵌入页面截图,增强了对传统解析难以处理的复杂文档的检索。

- TiDB Future App 黑客松提供 30,000 美元奖金:参加 TiDB Future App Hackathon 2024,有机会赢取总计 30,000 美元的奖金池,其中冠军可获得 12,000 美元。该竞赛敦促使用最新的 TiDB Serverless with Vector Search 构建创新的 AI 解决方案。

- 鼓励开发者与 @pingcap 合作,展示他们在构建高级应用方面的最佳成果。

- 探索 LlamaIndex 的 Mixture-of-Agents:一段新视频展示了使用多个本地语言模型的 “mixture of agents” 方法,其表现有可能超越 GPT-4 等独立模型。查看分步教程以深入了解这一增强技术。

- 支持者认为这种方法可以提供竞争优势,特别是在需要多样化模型能力的项目中。

- Llama 3.1 模型现已发布:Llama 3.1 系列现在包括 8B、70B 和 405B 模型,可通过带有 Ollama 的 LlamaIndex 访问,尽管最大的模型需要大量的计算资源。探索 Fireworks AI 的托管解决方案以获取支持。

- 用户在选择较大的模型时应评估其计算能力,以确保最佳性能。

- 澄清 context_window 参数以改进模型使用:

context_window参数定义了影响模型输入和输出能力的总 Token 限制。计算错误可能会因超出限制而导致 ValueError 等错误。- 建议用户调整输入大小或选择具有更大 Context 能力的模型,以优化输出效率。

Latent Space Discord

- Llama 3.1 发布引发关注:Llama 3.1 的发布包括 405B 模型,标志着开源 LLM 的一个重要里程碑,其卓越的能力足以与封闭模型媲美。

- 初步评估显示它是第一个具有前沿能力的开源模型,因其对迭代研发的可访问性而受到称赞。

- 国际语言学奥林匹克竞赛 (IOL):国际语言学奥林匹克竞赛 (IOL) 开幕,挑战学生利用逻辑翻译冷门语言,类似于高风险的数学竞赛。

- 参赛者在长达六小时的时间内解决看似不可能的问题,突显了逻辑推理与语言的交集。

- Llama 定价见解:Llama 3.1 的 405B 模型在 Fireworks 和 Together 等平台上的定价约为每百万 Token 4-5 美元。

- 这种具有竞争力的定价策略旨在随着采用率的增长,在潜在提价之前占领市场份额。

- Llama 性能评估:早期评估表明 Llama 3.1 在 GSM8K 和 ZebraLogic 逻辑推理等基准测试中排名很高,介于 Sonnet 3.5 和 GPT-4o 之间。

- 在对比测试中注意到,在超长 Token 长度后保持 Schema 一致性等挑战。

- GPT-4o mini 微调发布:OpenAI 宣布了 GPT-4o mini 的微调功能,面向 Tier 4 和 5 用户开放,在 9 月 23 日之前,每天前 200 万个训练 Token 免费。

- 这一举措旨在扩大访问和定制化,用户正在评估其相对于新发布的 Llama 3.1 的表现。

LangChain AI Discord

- AgentState vs InnerAgentState 详解:一场讨论澄清了

AgentState与InnerAgentState之间的区别,提供了AgentState的定义,并建议查看 LangChain 文档以获取更多细节。AgentState的关键字段包括messages和next,这对于 LangChain 中依赖上下文的操作至关重要。

- 设置 Chroma 向量数据库:分享了如何在 Python 中使用开源解决方案将 Chroma 设置为向量数据库的说明,需要安装

langchain-chroma并通过 Docker 运行服务器。- 示例展示了

.add、.get和.similarity_search等方法,并强调了使用OpenAIEmbeddings时必须持有 OpenAI API Key。

- 示例展示了

- 使用 Composio 创建调度 Agent:一份关于使用 Composio、LangChain 和 ChatGPT 创建调度 Agent(Scheduler Agent)的指南,可以实现通过电子邮件进行流线化的活动调度。指南可在此处获取。

- Composio 为 Agent 增强了有效的工具,如调度示例中所示,强调了任务处理的效率。

- YouTube 笔记生成器上线了!:宣布推出 YouTube Notes Generator,这是一个用于从 YouTube 视频生成笔记的开源项目,旨在方便用户直接从视频内容中更轻松地记录笔记。

- 在 LinkedIn 上了解更多关于此工具及其功能的信息。

- 使用 AI 进行高效代码审查:一段名为 ‘AI Code Reviewer Ft. Ollama & Langchain’ 的新视频介绍了一个 CLI 工具,旨在增强开发者的代码审查流程;点击此处观看。

- 该工具旨在通过促进开发团队中高效的代码评估来简化工作流。

Cohere Discord

- 新成员加入 Cohere 社区:新成员展示了加入 Cohere 的热情,引发了社区的积极欢迎。

- 社区张开双臂欢迎新手,为讨论营造了亲切的氛围。

- 使用 Midicaps 数据集进行创新微调:基于以往成功项目的经验,使用 midicaps 进行微调的工作取得了进展,展现出良好的前景。

- 成员们强调了过去努力取得的良好结果,预示着未来可能的突破。

- 澄清 Cohere 的 OCR 解决方案:Cohere 利用 unstructured.io 来实现其 OCR 能力,并对外部集成保持开放选择。

- 社区就 OCR 功能的定制和增强进行了富有成效的讨论。

- 探讨 RAG 聊天机器人系统:RAG 架构聊天机器人系统中的对话历史管理成为热门话题,重点讨论了向量数据库的使用。

- 提出了点赞/点踩等反馈机制,以优化交互体验。

- 发布具有重大改进的 Rerank 3 Nimble:Rerank 3 Nimble 亮相,在保持准确性的同时提供 3 倍的吞吐量,现已在 AWS SageMaker 上可用。

- 迎接企业搜索速度的提升! 这一基础模型提升了检索增强生成(RAG)的性能。

Torchtune Discord

- Llama 3.1 正式发布!:Meta 今天早上发布了最新的模型 Llama 3.1,支持 8B 和 70B instruct 模型。查看 Llama 3.1 Model Cards and Prompt formats 了解详情。

- 现场气氛非常热烈,甚至出现了一些因兴奋而导致的拼写错误和低级错误。

- MPS 支持 Pull Request 讨论:标题为 MPS support by maximegmd 的 Pull Request 引入了对 MPS 设备上 BF16 的检查,旨在改进本地 Mac 电脑上的测试。讨论指出由于共同祖先差异 (common ancestor diff) 可能存在问题,建议采用 rebase 可能是更好的方法。

- 该 PR 被强调为对于使用 MPS 的开发者的关键更新。

- LoRA 问题依然存在:有人提出了关于 LoRA 实现未按预期运行的持续性问题,并给出了调试建议。一位贡献者指出在最近的尝试中遇到了 CUDA 硬编码 (hardcoding) 的挑战。

- 这一问题凸显了对模型性能进行更深层次排查的必要性。

- Git 工作流挑战重重:Git 工作流 挑战一直是热门话题,许多人在解决之前的冲突后又陷入了新的冲突循环。有人建议调整工作流以尽量减少这些冲突。

- 对于贡献者来说,有效的冲突解决策略似乎是一个始终紧迫的需求。

- 引入 Pad ID 错误修复 PR:Pull Request #1211 解决了 generate 过程中显示 pad ID 的关键 bug,旨在防止此问题再次发生。它明确了 utils.generate 中 Pad ID 默认为 0 的隐含假设。

- 这一修复对于确保在未来的生成任务中正确处理特殊 token 至关重要。

tinygrad (George Hotz) Discord

- 需要帮助重现 matmul-free-llm:有人请求协助在 tinygrad 中重现 matmul-free-llm,旨在利用 高效算子 (kernels) 并整合 fp8。

- 希望能尽快无缝适配 Blackwell fp4。

- M1 结果与 CI 不同:一位 M1 用户遇到了与 CI 不同的结果,正在寻求关于如何使用 conda 和环境变量正确设置测试的说明。

- 由于启用

PYTHON=1时会导致测试中出现 IndexError,目前存在困惑。

- 由于启用

- cumsum 性能问题:一位新成员正在探索 tinygrad 中 nn.Embedding 的 O(n) 实现,以及如何借鉴 PyTorch 的技术将 cumsum 从 O(n^2) 优化到 O(n)。

- 有人推测某些约束使得这项任务具有挑战性,尤其是这还是一个 $1000 的悬赏任务。

- 寻求使用 PyTorch 进行增量测试的模式:一位成员询问了在 PyTorch 中按 Linear, MLP, MoE 和 LinearAttentionMoE 顺序增量测试模型性能的有效模式。

- 他们质疑从头开始测试是否比增量测试更有效率。

- 在 tinygrad 中开发分子动力学引擎:一个团队正尝试在 tinygrad 中实现 分子动力学 (Molecular Dynamics) 引擎,以训练预测分子构型能量的模型,但在梯度计算方面面临挑战。

- 他们需要预测能量相对于输入位置的梯度来计算力,但由于对模型权重进行了两次反向传播 (backpropagate),导致出现了问题。

LAION Discord

- Int8 实现已确认:成员们讨论了使用 Int8 的情况,其中一人确认其有效,显示了开发者对优化技术的兴趣。

- 有人请求“等一下(Hold a sec)”,表明在实现过程中可能需要额外的指导和社区支持。

- ComfyUI Flow 脚本指导:一位用户请求一个 ComfyUI flow 脚本,随后得到了利用该框架实现更平滑设置流程的建议。

- 这反映了社区在处理复杂系统集成时,倾向于追求效率和首选工作流的趋势。

- Llama 3.1 设定新标准:Llama 3.1 405B 的发布引入了 128K 的上下文长度,在八种语言中提供了显著的能力。

- 这一飞跃使 Llama 3.1 成为领先模型的强力竞争者,讨论集中在其多样化的功能上。

- Meta 的开源承诺:正如 Mark Zuckerberg 的信中所述,Meta 强调了其对 开源 AI 的奉献,突出了开发者和社区的利益。

- 这与其在 AI 生态系统中促进协作的愿景一致,旨在实现工具和资源的更广泛可及性。

- Llama 3.1 中的上下文大小增强:讨论批评了之前的 8K 上下文大小不足以处理大型文档,现在 Llama 3.1 中新的 128K 大小解决了这一问题。

- 这一改进被认为对于需要广泛文档处理的任务至关重要,显著提升了模型性能。

OpenInterpreter Discord

- Llama 3.1 405B 令用户惊叹:据报道,Llama 3.1 405B 与 OpenInterpreter 配合得非常出色。与 GPT-4o 不同,它不需要不断的提醒或重启来完成多项任务。

- 用户强调,与 GPT-4o 相比,Llama 3.1 405B 提供的体验显著提高了生产力。

- 对 GPT-4o 的挫败感:一位用户表达了对 GPT-4o 的挑战,需要频繁的提示才能在电脑上执行任务。这种挫败感凸显了用户在使用 Llama 3.1 405B 时获得的无缝体验。

- 这种对比表明用户更倾向于选择 Llama 3.1 405B 来进行高效的任务管理。

- 在 MacOS 上使用 Coqui 模型进行语音输入?:有人询问在 MacOS 上使用本地 Coqui model 进行语音输入的问题。目前尚未有成功的实现报告。

- 社区参与保持开放,但尚未出现进一步的回复来澄清该应用的可行性。

- Expo App 对 Apple Watch 的支持能力:讨论确认 Expo app 理论上应该能够为 Apple Watch 构建应用程序。然而,没有提供进一步的细节或确认。

- 虽然持乐观态度,但社区仍在等待在 Apple Watch 环境下对该能力的实际验证。

- 设备的发货时间线:一位成员询问了特定设备的 发货时间线,表达了对其状态的好奇。对话中没有分享更新或时间表。

- 信息的缺乏表明在发货状态方面需要更清晰的沟通。

Alignment Lab AI Discord

- 关于 OpenOrca 数据集许可的澄清:一位成员询问适用于 OpenOrca 数据集的 MIT License 是否允许商业化使用源自 GPT-4 Model 的输出。

- 其输出可以用于商业目的吗? 这一问题突出了围绕 AI 数据集许可的持续讨论。

- 开源合成数据集的计划:另一位成员透露了开源 合成数据集(synthetic dataset) 的意图,旨在支持商业和非商业项目,强调了其在 AI 生态系统中的相关性。

- 他们提到正在评估对 OpenOrca 可能存在的依赖,这引发了关于其在更广泛数据集领域中许可影响的问题。

LLM Finetuning (Hamel + Dan) Discord

- 迈阿密聚会意向引发讨论:一名成员询问了在 迈阿密 (Miami) 举办潜在 meetups 的可能性,寻求与该地区其他人的联系以进行聚会。

- 到目前为止,关于这次聚会查询,还没有进一步的回复或安排。

- 8月纽约聚会获得关注:另一名成员表示有兴趣参加 8 月下旬在 纽约 (NYC) 举行的 meetup,表达了社区互动的愿望。

- 这一讨论暗示了纽约地区本地 AI 爱好者的活动协调可能性。

AI Stack Devs (Yoko Li) Discord

- 艺术家寻求合作:Aria,一位 2D/3D 艺术家,表达了与社区内其他人合作的兴趣。他们邀请感兴趣的成员通过 DM 联系以开展潜在项目。

- 这为 Guild 中任何希望将 艺术 技能融入其 AI 项目(特别是在可视化或游戏领域)的人提供了机会。

- AI 工程师的参与机会:合作呼吁强调了将 AI engineering 与艺术和设计等创意领域融合的日益增长的兴趣。

- 此类合作可以增强 AI 项目 的视觉效果,从而可能带来更具吸引力的用户体验。

Mozilla AI Discord

- Mozilla Accelerator 申请截止日期临近:Mozilla Accelerator 的申请截止日期即将到来,该项目提供为期 12 周 的计划,以及高达 $100k 的非稀释性资金。

- 参与者还将在与 Mozilla 共同举办的 demo day 上展示他们的项目,为获取反馈和曝光提供关键时刻。有问题吗?

- 准备参加 Zero Shot Tokenizer Transfer 活动:提醒即将举行的与 Benjamin Minixhofer 合作的 Zero Shot Tokenizer Transfer 活动,计划于本月举行。

- 详情可以在 活动链接 中找到,鼓励感兴趣的工程师参与。

- 介绍 AutoFix:开源 Issue 修复工具:AutoFix 是一个开源工具,可以直接从 Sentry.io 提交 PR,从而简化 Issue 管理。

- 在此处链接的详细帖子中了解有关此工具功能的更多信息:AutoFix 信息。

LLM Perf Enthusiasts AI Discord 没有新消息。如果该频道长期沉寂,请告知我们,我们将将其移除。

MLOps @Chipro Discord 没有新消息。如果该频道长期沉寂,请告知我们,我们将将其移除。

DiscoResearch Discord 没有新消息。如果该频道长期沉寂,请告知我们,我们将将其移除。

AI21 Labs (Jamba) Discord 没有新消息。如果该频道长期沉寂,请告知我们,我们将将其移除。

第 2 部分:按频道划分的详细摘要与链接

由于邮件长度限制,完整的频道细分内容已被截断。

如果你喜欢 AInews,请分享给朋友!提前感谢!