ainews-gpt4o-august-100-structured-outputs-for

GPT-4o 八月更新 + 面向所有人的 100% 结构化输出(GPT-4o 八月版)

OpenAI 发布了全新的 gpt-4o-2024-08-06 模型,拥有 16k 上下文窗口,价格比之前的 5 月版 4o 降低了 33-50%。该模型还引入了全新的结构化输出(Structured Output)API,旨在提升输出质量并降低重试成本。

Meta AI 推出了 Llama 3.1,这款拥有 4050 亿参数的模型在基准测试中超越了 GPT-4 和 Claude 3.5 Sonnet,同时 Meta 还扩大了 Llama Impact Grant 资助计划。

Google DeepMind 低调发布了 Gemini 1.5 Pro,其在 LMSYS 基准测试中表现优于 GPT-4o、Claude-3.5 和 Llama 3.1,并领跑视觉模型排行榜(Vision Leaderboard)。

Yi-Large Turbo 作为一款高性价比的升级版本亮相,定价为每百万 token 0.19 美元。

在硬件领域,John Carmack 强调了 NVIDIA H100 GPU 在处理大规模 AI 工作负载方面的卓越性能;同时,Groq 宣布计划在 2025 年第一季度前部署 10.8 万个 LPU。

新兴的 AI 工具与技术包括 RAG(检索增强生成)、用于构建智能体混合(Mixture of Agents)系统的 JamAI Base 平台,以及 LangSmith 增强的过滤功能。此外,Google DeepMind 还引入了 PEER(参数高效专家检索)架构。

Pydantic/Zod is all you need.

2024/8/5-2024/8/6 的 AI News。我们为你检查了 7 个 subreddits、384 个 Twitter 和 28 个 Discord(249 个频道,2423 条消息)。预计节省阅读时间(以 200wpm 计算):247 分钟。你现在可以标记 @smol_ai 进行 AINews 讨论了!

又是新前沿模型发布的日子!(Blog, Simonw writeup)

就像我们针对 4o-mini 所做的那样,今天的 AINews 包含 2 期,使用完全相同的提示词运行 —— 你正在阅读的这一期所有频道摘要均由 gpt-4o-2024-08-06 生成,这是今天发布的最新 4o 模型,具有 16k context(比之前长 4 倍,但仍少于 alpha Long Output 模型),价格比 4o-May 低 33-50%。

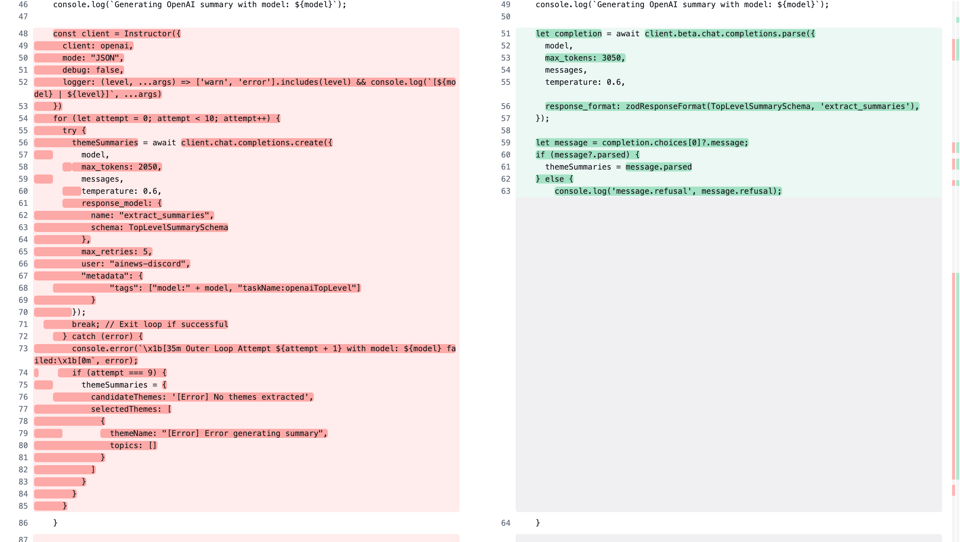

我们正好通过 Instructor 库使用 Structured Output 运行 AINews(进行“chain of thought 摘要”),因此切换模型为我们节省了一些代码行,更重要的是节省了重试的费用(由于 OpenAI 采用了受限语法采样,你不再需要在格式错误的 JSON 上花费任何重试费用或时间)。

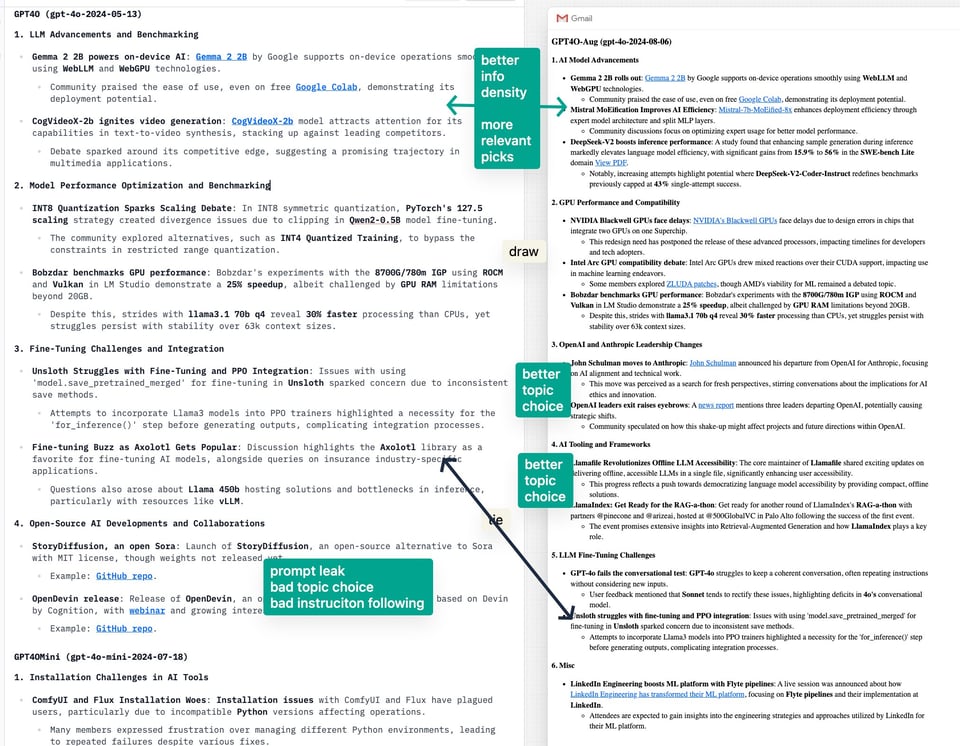

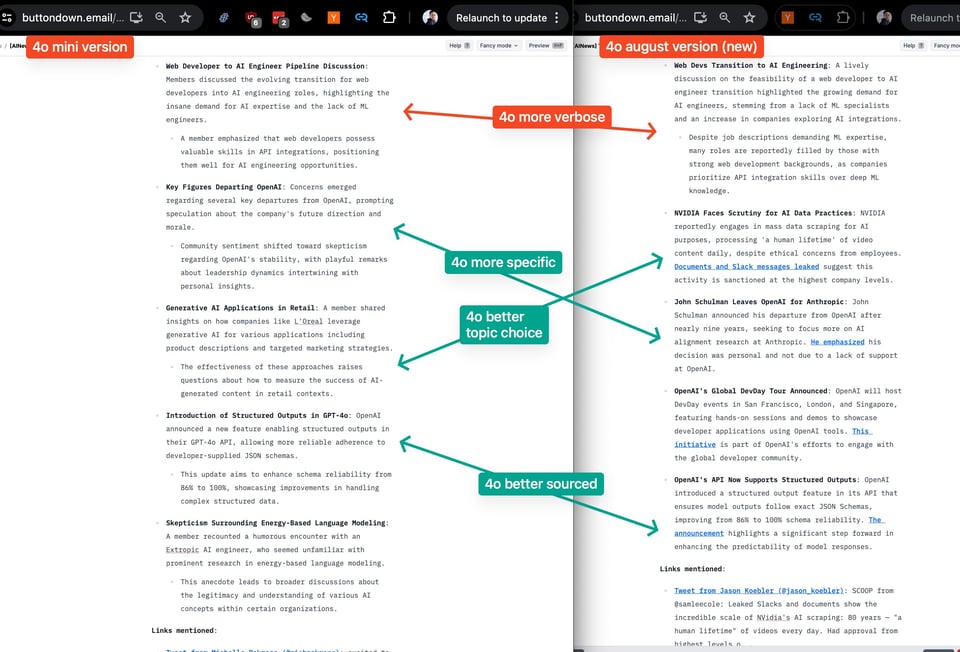

根据我们的摘要 vibe check 和提示词,新模型似乎绝对优于 4o-May(这里选取了一个示例,但你可以亲自查看今天收到的两封邮件):

并且在大多数情况下优于 4o-mini(我们上次的结论是它与 4o-May 相当,但价格便宜得多):

撇开适用于所有模型的全新 Structured Output API 不谈,我们认为这次意外的 4o 模型升级是一件好事 —— 4o August 实际上是 GPT 4.6 或 4.7,具体取决于你的计算方式。目前我们还没有关于该模型的任何公开 ELO 或 benchmark 指标,但我们敢打赌这将会是一个深藏不露的热门产品 —— 甚至可能是 Q*/Strawberry 的秘密发布?

Table of Contents 和 Channel Summaries 已移至此邮件的网页版:!

AI Twitter 综述

所有综述均由 Claude 3.5 Sonnet 完成,取 4 次运行中的最佳结果。

AI 模型更新与基准测试

- Llama 3.1:Meta 发布了 Llama 3.1,这是一个拥有 4050 亿参数的大语言模型,在多个基准测试中超越了 GPT-4 和 Claude 3.5 Sonnet。Llama Impact Grant 计划正在扩大,以支持全球组织基于 Llama 进行构建。

- Gemini 1.5 Pro:Google DeepMind 悄然发布了 Gemini 1.5 Pro,据报道其在 LMSYS 上的表现优于 GPT-4o、Claude-3.5 和 Llama 3.1,并在 Vision Leaderboard 上排名第一。它在多语言任务和技术领域表现出色。

- Yi-Large Turbo:作为 Yi-Large 的强力且具性价比的升级版推出,输入和输出价格均为每 1M tokens 0.19 美元。

AI 硬件与基础设施

- NVIDIA H100 GPUs:John Carmack 分享了关于 H100 性能的见解,指出在 AI 工作负载方面,10 万块 H100 的算力比目前所有 3000 万台现役 Xbox 的总和还要强大。

- Groq LPUs:Jonathan Ross 宣布计划在 2025 年第一季度末之前将 108,000 个 LPU 投入生产,并扩大云端和核心工程团队。

AI 开发与工具

- RAG (Retrieval-Augmented Generation):关于 RAG 重要性的讨论,旨在整合人类输入并增强 AI 系统的能力。

- JamAI Base:一个无需编码即可构建 Mixture of Agents (MoA) 系统的新平台,利用了 Task Optimizers 和 Execution Engines。

- LangSmith:LangSmith 中 Trace 的新过滤功能,允许基于 JSON 键值对进行更精确的过滤。

AI 研究与技术

- PEER (Parameter Efficient Expert Retrieval):来自 Google DeepMind 的新架构,在 Transformer 模型中使用超过一百万个小型“专家”来替代大型前馈层。

- POA (Pre-training Once for All):一种创新的三分支自监督训练框架,能够同时预训练多种尺寸的模型。

- Similarity-based Example Selection:研究表明,使用基于相似性的 In-context 示例选择,可以显著提升低资源机器翻译的效果。

AI 伦理与社会影响

- Data Monopoly Concerns:关于潜在数据垄断的讨论,如果从互联网服务下载内容变得非法,可能会导致供应商锁定。

- AI Safety:关于 AI 智能本质和安全措施的辩论,Yann LeCun 对一些常见的 AI 风险叙事提出了反对意见。

AI 实际应用

- Code Generation:关于 AI 代码生成有效性的观察,例如研究人员在身体受限的情况下使用 Claude 进行编码。

- Model Selection Guide:针对各种任务的 AI 模型选择建议,包括代码生成、搜索、文档分析和创意写作。

AI 社区与教育

- AI and Games Textbook:Julian Togelius 和 Georgios Yannakakis 发布了其《AI and Games》教科书第二版的草案,寻求社区反馈以进行改进。

- AI Education Programs:Google DeepMind 庆祝了 AIMS 的 AI for Science 硕士项目的首批毕业生,并提供了奖学金和资源。

AI Reddit 综述

/r/LocalLlama 综述

主题 1. AI 模型的架构创新

- Flux 的架构图 :) 好像没有论文,所以快速看了一下他们的代码。对于理解当前的 Diffusion 架构可能很有用 (Score: 461, Comments: 35): Flux 的 diffusion models 架构图在没有随附论文的情况下,提供了对当前 diffusion 架构的深入见解。该图表通过检查 Flux 的 code 得出,直观地展示了模型的结构和组件,可能有助于理解当代的 diffusion model 设计。

主题 2. 开源 AI 模型的进展

- 为什么没人讨论 InternLM 2.5 20B? (Score: 247, Comments: 98): InternLM 2.5 20B 在基准测试中表现出 令人印象深刻的性能,超越了 Gemma 2 27B 并接近 Llama 3.1 70B。该模型在 MATH 0 shot 上取得了卓越的 64.7 分,接近 3.5 Sonnet 的 71.1 分,并且可能通过 8-bit quantization 在 4090 GPU 上运行。

-

灵光一现:如果我们制作 Magnum 32b 和 12b 的 V2 版本会怎样(剧透:我们做到了!) (Score: 54, Comments: 15): Magnum-32b v2 和 Magnum-12b v2 模型已经发布,并根据用户反馈进行了改进。这些模型在 Hugging Face 上提供 GGUF 和 EXL2 格式,开发人员正在寻求用户的进一步反馈以完善模型。

- 用户询问了潜在的 Mistral-based models,并讨论了 32b V1 模型在 Koboldcpp 和 Textgenui 等应用中的最佳 sampler settings。

- 该模型的 预期用途 被幽默地描述为“狐狸精研究 (foxgirl studies)”,而其他人则指出 v1 模型存在 多语言性能问题,并推测 72B 和 32B 版本之间的差异。

- 一些用户报告了 12B v2 8bpw exl2 模型的问题,遇到了 胡言乱语 和 严重的幻觉 (hallucination),且不受 prompt templates 或 sample settings 更改的影响。

主题 3. LLM 的新颖应用与能力

- 我们正在制作一款由 LLM 驱动法术和世界生成的游戏 (Score: 413, Comments: 81): 开发人员正在创建一款利用 Large Language Models (LLMs) 进行动态 法术和世界生成 的游戏。这种方法允许根据玩家输入创建 独特的法术 和 程序生成的模型世界,从而可能提供更加个性化和身临其境的游戏体验。虽然没有提供关于游戏机制或发布的具体细节,但该概念展示了 AI 在游戏开发中的创新应用。

-

Gemini 1.5 Pro Experimental 0801 作为一个闭源模型,其去审查程度令人惊讶 (Score: 54, Comments: 23): Google 的 Gemini 1.5 Pro Experimental 0801 模型在添加到 UGI-Leaderboard 时展示了令人惊讶的去审查能力。在安全设置设为“Block none”并使用特定 system prompt 的情况下,该模型愿意对有争议且可能非法的查询提供答复,尽管其意愿(W/10)略低于排行榜上的平均模型。

- 用户报告了 Gemini 1.5 Pro Experimental 0801 去审查能力的参差不齐的结果。一些人发现它拒绝了所有请求,而另一些人则成功诱导它回答了关于 盗版、自杀方法和毒品制造 的查询。

- 该模型在处理性内容时表现出不一致的行为,拒绝了一些请求,但在以不同方式提示时同意编写 色情故事。用户注意到在测试这些功能时其 Google 账号 可能面临的风险。

- 在 SillyTavern 的暂存分支中,Gemini 1.5 Pro Experimental 0801 显示出比其他版本更少的过滤。用户还发现它比普通的 Gemini 1.5 Pro 更聪明,后者有时被描述为“精神分裂 (schizo)”。

主题 4. 主要 AI 公司的领导层变动

-

Sam 会为了关停 Llama 4 而“恐吓”山姆大叔(美国政府)吗? (Score: 59, Comments: 31): Sam Altman 可能向政府监管机构进行 GPT-5 的私下演示,据推测这可能会影响对开源 AI 发展(特别是 Llama 4)的限制。这种假设情景表明,Altman 可能会故意惊吓监管机构,以限制来自开源模型的竞争,从而在不断发展的 open LLM era 中为其公司争取优势。

- Meta 可能会在美国境外训练开源 LLM,而 Mistral 也在提供具有竞争力的模型。然而,EU AI Act 引入了大量的文档要求,可能会阻碍欧洲生成式模型的发展。

- 出人意料的是,Zuckerberg 正在倡导保护开源 AI,而政府也表示不会限制开源 AI。有人认为,这种立场有利于所有非 OpenAI 实体挑战 OpenAI 被认为的垄断地位。

- FTC 负责人 Lina Khan 据报道支持 open weight 模型,这可能会减轻对限制的担忧。监管界似乎将 AI 软件视为类似于 90 年代初的互联网而非加密技术,这表明监管方式可能不会那么严格。

-

OpenAI 联合创始人 Schulman 和 Brockman 退居二线。Schulman 离职加入 Anthropic。 (Score: 317, Comments: 94): OpenAI 联合创始人 Adam D’Angelo 和 Ilya Sutskever 正在退居二线,而 Schulman 离职加入 Anthropic。这一进展是在最近围绕 Sam Altman 被短暂解雇并复职为 CEO 的争议之后发生的,该事件导致了 OpenAI 内部的重大变化。这些关键人物的离职标志着 OpenAI 领导结构以及潜在战略方向的显著转变。

- 对 OpenAI 内部问题的担忧,以及对 GPT5/strawberry/Q* 开发问题或 Sam Altman 领导风格的猜测。一些用户将离职归因于每个人的不同因素。

- 讨论了 OpenAI 关键人物(Schulman、Brockman、Altman)名字的巧合,并对 AI 相关的姓氏进行了幽默评论,还将其与 Hideo Kojima 的角色命名风格进行了比较。

- 用户对 Anthropic 表达了复杂的情绪,在称赞 Claude 的同时,也批评了该公司被认为的“自大情结 (megalomaniac complex)”和审查做法。关于在 AI 行业中“商人”与现有领导层相比的优缺点的辩论随之展开。

全球 AI Reddit 综述

r/machinelearning, r/openai, r/stablediffusion, r/ArtificialInteligence, /r/LLMDevs, /r/Singularity

AI 研发

- Google DeepMind 推进多模态学习:一篇 Google DeepMind 的论文展示了如何通过联合样本选择(joint example selection)进行数据策展,从而加速多模态学习 (/r/MachineLearning)。

- Microsoft 的 MInference 加速长文本推理:Microsoft 的 MInference 技术能够在保持准确性的同时,实现长文本任务中高达数百万个 token 的推理 (/r/MachineLearning)。

- 利用网络策展的人格(Personas)扩展合成数据生成:一篇关于扩展合成数据生成的论文利用从网络数据中策展的 10 亿个人格来生成多样化的合成数据 (/r/MachineLearning)。

- 据传 NVIDIA 正在抓取海量视频数据:泄露文件显示,NVIDIA 每天抓取相当于“一个人一生长度”的视频来训练 AI 模型 (/r/singularity)。

AI 模型发布与改进

- Salesforce 发布 xLAM-1b 模型:拥有 10 亿参数的 xLAM-1b 模型在函数调用(function calling)方面实现了 70% 的准确率,尽管体积较小,但超越了 GPT-3.5 (/r/LocalLLaMA)。

- Phi-3 Mini 更新函数调用功能:Rubra AI 发布了更新后的 具有函数调用能力的 Phi-3 Mini 模型,其性能可与 Mistral-7b v3 竞争 (/r/LocalLLaMA)。

AI 行业新闻与动态

- OpenAI 多位核心高管离职:三位关键领导者正离开 OpenAI:总裁 Greg Brockman(长期休假)、John Schulman(加入 Anthropic)以及产品负责人 Peter Deng (/r/OpenAI, /r/singularity)。

- Elon Musk 对 OpenAI 提起诉讼:Musk 已对 OpenAI 和 Sam Altman 提起新诉讼 (/r/singularity)。

- Anthropic 创始人讨论 AI 发展:一位 Anthropic 创始人表示,即使现在停止 AI 研发,现有能力仍能带来数年甚至数十年的持续改进 (/r/singularity)。

神经技术与脑机接口

- Elon Musk 对 Neuralink 的最新主张:Musk 预测脑芯片植入患者将在 1-2 年内超越职业玩家,并谈到赋予人类“超能力” (/r/singularity)。

迷因与幽默

- 一个对比某记者 11 年间对 AI 截然不同观点的迷因 (/r/singularity)。

- 一张对 2030 年进行幽默推测的图片 (/r/singularity)。

AI Discord 综述

摘要的摘要之摘要

Claude 3 Sonnet

1. LLM 进展与基准测试

- Llama 3 登顶排行榜:来自 Meta 的 Llama 3 在 ChatbotArena 等排行榜上迅速崛起,在超过 50,000 场对决中超越了 GPT-4-Turbo 和 Claude 3 Opus 等模型。

- 示例对比强调了模型在 AlignBench 和 MT-Bench 等基准测试中的表现,其中 DeepSeek-V2 拥有 236B 参数,并在某些领域超越了 GPT-4。

- 新型开源模型推动最先进水平:来自 IBM 的 Granite-8B-Code-Instruct 等新型模型增强了代码任务的指令遵循(instruction following)能力,而 DeepSeek-V2 则推出了拥有 236B 参数 的巨型模型。

- AlignBench 和 MT-Bench 的排行榜对比显示 DeepSeek-V2 在某些领域优于 GPT-4,引发了关于不断演进的最先进技术水平(state of the art)的讨论。

2. 模型性能优化与推理

- **量化技术减小模型占用空间:[Quantization]** 技术(如 AQLM 和 QuaRot)旨在实现在保持性能的同时,在单个 GPU 上运行大语言模型 (LLMs)。

- 示例:AQLM 项目 展示了在 RTX3090 GPU 上运行 Llama-3-70b 模型。

- **DMC 提升吞吐量达 370% **: 通过 Dynamic Memory Compression (DMC) 等方法提升 Transformer 效率的努力显示出在 H100 GPUs 上将吞吐量提高多达 370% 的潜力。

- 示例:

@p_nawrot的 DMC 论文 探讨了 DMC 技术。

- 示例:

- **使用 Consistency LLMs 进行并行解码:Consistency LLMs** 等技术探索了并行 Token 解码,以降低推理延迟。

- SARATHI 框架还通过采用分块预填充(chunked-prefills)和解码最大化批处理(decode-maximal batching)来解决 LLM 推理中的效率低下问题,从而提高 GPU 利用率。

- **CUDA Kernels 加速操作:讨论集中在优化 CUDA 操作上,例如融合逐元素操作(element-wise operations),使用 **Thrust 库的

transform来实现接近带宽饱和的性能。- 示例:Thrust 文档 重点介绍了相关的 CUDA kernel 函数。

3. 开源 AI 框架与社区努力

- **Axolotl 支持多种数据集格式**:Axolotl 现在支持用于指令微调和预训练 LLMs 的多种数据集格式。

- 社区对 Axolotl 在开源模型开发和微调方面不断增强的能力表示赞赏。

- **LlamaIndex 集成吴恩达课程:LlamaIndex** 宣布与吴恩达的 DeepLearning.ai 合作推出一门关于构建 Agentic RAG 系统的新课程。

- 该课程强调了 LlamaIndex 在开发企业级检索增强生成 (RAG) 系统中的作用。

- **RefuelLLM-2 针对“乏味”任务进行优化:RefuelLLM-2** 已开源,声称是处理“乏味数据任务(unsexy data tasks)”的最佳 LLM。

- 社区讨论了 RefuelLLM-2 在不同领域的性能和应用。

- **Mojo 预告 Python 集成和加速器:Modular 的深度解析** 预告了 Mojo 在 Python 集成和 AI 扩展(如

_bfloat16_)方面的潜力。- 像带有脉动阵列(systolic arrays)的 PCIe 卡这样的定制加速器也被认为是 Mojo 开源发布后的未来候选方案。

4. 多模态 AI 与生成模型创新

- **Idefics2 和 CodeGemma 提升能力:Idefics2 8B Chatty** 专注于提升聊天交互,而 CodeGemma 1.1 7B 则精进了编程能力。

- 这些新的多模态模型展示了在对话式 AI 和代码生成等领域的进展。

- **Phi3 将 AI 聊天机器人带入 WebGPU:Phi 3** 模型通过 WebGPU 将强大的 AI 聊天机器人带入浏览器。

- 这一进步使得通过 WebGPU 平台进行私密的设备端 AI 交互成为可能。

- **IC-Light 改进图像重打光:开源项目 **IC-Light 专注于改进图像重打光(relighting)技术。

- 社区成员分享了在 ComfyUI 等工具中利用 IC-Light 的资源和技术。

5. 微调挑战与提示工程策略

- **Axolotl Prompting 见解:强调了提示词设计 (prompt design)** 和使用正确模板(包括文本结束标记 tokens)的重要性,这些因素会影响模型在微调和评估期间的性能。

- 示例:Axolotl prompters.py 展示了提示词工程技术。

- **用于提示词控制的 Logit Bias:讨论了提示词工程 (prompt engineering)** 策略,例如将复杂任务拆分为多个提示词,以及研究 logit bias 以更好地控制输出。

- 示例:OpenAI logit bias 指南 解释了相关技术。

- **用于检索的

Token****:教导 LLM 在不确定时使用 ` ` token 进行**信息检索**,可以提高在低频查询上的表现。 - 示例:ArXiv 论文 介绍了这项技术。

Claude 3.5 Sonnet

1. LLM 进展与基准测试

- DeepSeek-V2 在基准测试中挑战 GPT-4:DeepSeek-V2 是一款拥有 236B 参数的新模型,在 AlignBench 和 MT-Bench 等基准测试中表现优于 GPT-4,展示了大型语言模型能力的重大进步。

- 该模型的表现引发了关于其对 AI 领域潜在影响的讨论,社区成员分析了其在各种任务和领域中的优势。

- John Schulman 加入 Anthropic 的战略举措:OpenAI 联合创始人 John Schulman 宣布离职 并加入 Anthropic,理由是希望更深入地关注 AI 对齐 (AI alignment) 和技术工作。

- 此举紧随 OpenAI 最近的重组(包括解散其超级对齐团队),并引发了关于 AI 安全研究与开发未来方向的讨论。

- Gemma 2 2B:Google 的紧凑型强力模型:Google 发布了 Gemma 2 2B,这是一款拥有 2.6B 参数的模型,专为高效的设备端使用而设计,兼容 WebLLM 和 WebGPU 等平台。

- 该模型的发布受到了热烈欢迎,特别是它能够在 Google Colab 等免费平台上流畅运行,展示了强大 AI 模型日益增长的可访问性。

2. 推理优化与硬件进展

- Cublas hgemm 提升 Windows 性能:cublas hgemm 库已实现 Windows 兼容,在 4090 GPU 上实现了高达 315 tflops 的性能,而 torch nn.Linear 仅为 166 tflops,显著增强了 AI 任务的性能。

- 用户报告在 4090 上运行 flux 达到了约 2.4 it/s,标志着大型语言模型在消费级硬件上的推理速度和效率有了实质性提升。

- Aurora 超级计算机剑指 ExaFLOP 里程碑:位于阿贡国家实验室的 Aurora 超级计算机在经过性能优化后,预计将突破 2 ExaFLOPS,有望成为全球最快的超级计算机。

- 讨论强调了 Aurora 独特的 Intel GPU 架构,支持输出 16x8 矩阵的 Tensor Core 指令,引发了对其在 AI 和科学计算应用中潜力的关注。

- ZeRO++ 大幅削减 GPU 通信开销:ZeRO++ 是一种新的优化技术,有望将大型模型在 GPU 上训练的通信开销降低 4 倍,显著提高训练效率。

- 这一进展对于分布式 AI 训练设置尤为重要,可能使大规模语言模型的训练更加快速且更具成本效益。

3. 开源 AI 与社区协作

- SB1047 引发开源 AI 辩论:一封反对 SB1047(AI 安全法案)的公开信正在流传,警告该法案可能通过潜在的禁止开源模型和威胁学术自由,对开源研究和创新产生负面影响。

- 社区对此存在分歧,一些人支持 AI 安全监管,而包括 Anthropic 在内的其他公司则警告不要扼杀创新,并暗示该法案可能在学术和经济方面产生意想不到的负面后果。

- Wiseflow:开源数据挖掘工具:Wiseflow 是一款开源信息挖掘工具,旨在高效地从包括网站和社交平台在内的各种在线资源中提取和分类数据。

- 该工具引起了 AI 社区的兴趣,有人建议将其与 Golden Ret 等其他开源项目集成,为 AI 应用创建动态知识库。

- AgentGenesis 助力 AI 开发:AgentGenesis 是一款开源 AI 组件库,旨在为开发者提供用于 Gen AI 应用的复制粘贴代码片段,承诺将开发效率提高 10 倍。

- 该项目采用 MIT 许可证,包含一个全面的代码库,提供 RAG flows 和 QnA bots 模板,并正在积极寻求贡献者以增强其功能。

4. 多模态 AI 与创意应用

- CogVideoX-2b:视频合成的新前沿:新款文本生成视频合成模型 CogVideoX-2b 的发布因其根据文本描述生成视频内容的能力而备受关注。

- 初步评论表明,CogVideoX-2b 在该领域具有与领先模型竞争的实力,引发了关于其潜在应用及对多媒体内容创作影响的讨论。

- Flux AI 挑战图像生成巨头:据报道,Flux AI 的 ‘Schnell’ 模型在图像生成的一致性方面表现优于 Midjourney 6,展示了 AI 生成视觉内容的重大进步。

- 用户称赞该模型能够生成高度逼真且细节丰富的图像(尽管偶尔会有细微拼写错误),这标志着 AI 生成视觉媒体质量的一次飞跃。

- MiniCPM-Llama3 推进多模态交互:MiniCPM-Llama3 2.5 现在支持多图输入,并在 OCR 和文档理解等任务中展现出巨大潜力,为多模态交互提供了强大的功能。

- 该模型的进步凸显了日益增长的趋势,即开发更通用的 AI 系统,能够同时处理和理解包括文本和图像在内的多种输入类型。

GPT4O (gpt-4o-2024-05-13)

1. LLM 进展与基准测试

- Gemma 2 2B 助力端侧 AI:Google 的 Gemma 2 2B 通过 WebLLM 和 WebGPU 技术流畅支持端侧运行。

- 社区对其易用性表示赞赏,甚至在免费的 Google Colab 上也能运行,展示了其部署潜力。

- CogVideoX-2b 引燃视频生成领域:CogVideoX-2b 模型因其在文本生成视频(text-to-video)合成方面的能力而备受关注,可与领先的竞争对手一较高下。

- 围绕其竞争优势引发了讨论,暗示了其在多媒体应用中的广阔前景。

2. 模型性能优化与基准测试

- INT8 量化引发缩放讨论:在 INT8 对称量化中,PyTorch 的 127.5 缩放策略在 Qwen2-0.5B 模型微调中因截断问题导致了发散。

- 社区探索了替代方案,如 INT4 量化训练,以绕过受限范围量化的约束。

- Bobzdar 测试 GPU 性能:Bobzdar 在 LM Studio 中使用 ROCM 和 Vulkan 对 8700G/780m IGP 进行的实验显示速度提升了 25%,尽管受到超过 20GB 的 GPU RAM 限制的挑战。

- 尽管如此,llama3.1 70b q4 的进展显示其处理速度比 CPU 快 30%,但在超过 63k 的 context size 稳定性方面仍存在困难。

3. 微调挑战与集成

- Unsloth 在微调和 PPO 集成方面遇到困难:在 Unsloth 中使用 ‘model.save_pretrained_merged’ 进行微调时出现的问题引发了关注,原因是保存方法不一致。

- 将 Llama3 模型整合到 PPO trainer 中的尝试凸显了在生成输出前进行 ‘for_inference()’ 步骤的必要性,这使集成过程变得复杂。

- Axolotl 走红引发微调热议:讨论强调了 Axolotl 库是微调 AI 模型的热门选择,同时还有关于保险行业特定应用的咨询。

- 此外,还出现了关于 Llama 450b 托管方案和推理瓶颈的问题,特别是在使用 vLLM 等资源时。

4. 开源 AI 发展与协作

- StoryDiffusion,开源版 Sora:发布了 StoryDiffusion,这是 Sora 的开源替代方案,采用 MIT 许可证,但权重尚未发布。

- 示例:GitHub repo。

- OpenDevin 发布:发布了 OpenDevin,这是一个基于 Cognition 的 Devin 的开源自主 AI Agent 工程师,并举行了 webinar,在 GitHub 上的关注度不断提高。

- 示例:GitHub repo。

GPT4OMini (gpt-4o-mini-2024-07-18)

1. AI 工具中的安装挑战

- ComfyUI 和 Flux 的安装困扰:ComfyUI 和 Flux 的安装问题一直困扰着用户,特别是由于不兼容的 Python 版本影响了运行。

- 许多成员对管理不同的 Python 环境表示沮丧,尽管尝试了各种修复方法,但仍导致反复失败。

- 本地 LLM 设置问题:使用 Open Interpreter 设置本地 LLM 时导致了不必要的下载,并在模型选择期间引发了 openai.APIConnectionError。

- 用户正在私下协调以解决此问题,这突显了本地模型设置的复杂性。

2. 模型性能与优化讨论

- Mistral-7b-MoEified-8x 模型效率:Mistral-7b-MoEified-8x 模型通过将 MLP 层划分为分片来优化专家使用,从而提高了部署效率。

- 社区讨论集中在利用这种模型架构来增强特定应用中的性能。

- Llama3 模型的性能挑战:用户报告了微调后的 Llama3.1 推理时间不一致,根据加载需求,时间从毫秒到一分钟以上不等。

- 这些波动突显了在生产环境中部署 Llama3 模型时,需要更好的集成实践。

3. AI 伦理与数据实践

- NVIDIA 的数据抓取争议:NVIDIA 因据称每天抓取大量视频数据用于 AI 训练而面临抵制,这引发了员工的伦理担忧。

- 泄露的文件证实了管理层批准了这些做法,在公司内部引发了巨大的动荡。

- 反对 AI 安全监管法案 SB1047:一封反对加州 SB1047 法案的公开信指出,人们担心该法案可能会扼杀 AI 领域的开源研究和创新。

- 成员们讨论了该法案潜在的负面影响,并呼吁签名支持反对意见。

4. 新兴 AI 项目与协作

- Open Medical Reasoning Tasks 项目启动:Open Medical Reasoning Tasks 项目 旨在联合 AI 和医学界,共同完成全面的推理任务。

- 该倡议寻求通过贡献来推进 AI 在医疗保健领域的应用,反映了这些领域日益增长的交集。

- Gemma 2 2B 的能力:Google 的 Gemma 2 2B 模型支持设备端运行,展示了令人印象深刻的部署潜力。

- 社区反馈强调了它的易用性,特别是在 Google Colab 等环境中。

5. AI 框架与库的进展

- Mojo 中 InlineList 的新特性:Mojo 正在 InlineList 中引入新方法,例如

__moveinit__和__copyinit__,旨在增强其功能集。- 这些进展标志着 Mojo 致力于改进其数据结构能力,以备未来发展。

- Bits and Bytes 基金会更新:最新的 Bits and Bytes pull request 引起了库开发爱好者的兴趣。

- 这一进展被视为该库演进的关键,社区正在密切关注其进展。

GPT4O-Aug (gpt-4o-2024-08-06)

1. AI 模型进展

- Gemma 2 2B 发布:Google 推出的 Gemma 2 2B 通过 WebLLM 和 WebGPU 技术支持流畅的端侧运行。

- 社区对其易用性表示赞赏,甚至在免费版的 Google Colab 上也能运行,展示了其部署潜力。

- Mistral MoE 化提升 AI 效率:Mistral-7b-MoEified-8x 通过专家模型架构和拆分 MLP 层增强了部署效率。

- 社区讨论集中在优化专家使用率以获得更好的模型性能。

- DeepSeek-V2 提升推理性能:一项研究发现,在推理过程中增强样本生成可显著提升语言模型的效率,在 SWE-bench Lite 领域的提升幅度从 15.9% 显著增长至 56% 查看 PDF。

- 值得注意的是,增加尝试次数凸显了潜力,其中 DeepSeek-V2-Coder-Instruct 重新定义了此前单次尝试成功率上限为 43% 的基准测试。

2. GPU 性能与兼容性

- NVIDIA Blackwell GPU 面临延迟:NVIDIA 的 Blackwell GPU 因在单个 Superchip 上集成两个 GPU 的芯片设计错误而面临延迟。

- 这一重新设计的需求推迟了这些先进处理器的发布,影响了开发者和技术采用者的进度表。

- Intel Arc GPU 兼容性争论:Intel Arc GPU 因其对 CUDA 的支持评价褒贬不一,影响了其在机器学习领域的应用。

- 一些成员探索了 ZLUDA 补丁,尽管 AMD 在 ML 方面的可行性仍然是一个备受争议的话题。

- Bobzdar 评测 GPU 性能:Bobzdar 在 LM Studio 中使用 ROCM 和 Vulkan 对 8700G/780m IGP 进行的实验显示速度提升了 25%,尽管受到超过 20GB 的 GPU RAM 限制的挑战。

- 尽管如此,在 llama3.1 70b q4 上的进展显示其处理速度比 CPU 快 30%,但在超过 63k 上下文大小时仍存在稳定性问题。

3. OpenAI 与 Anthropic 高层变动

- John Schulman 加入 Anthropic:John Schulman 宣布离开 OpenAI 加入 Anthropic,专注于 AI 对齐(AI alignment)和技术工作。

- 这一举动被视为在寻求新的视角,引发了关于其对 AI 伦理和创新影响的讨论。

- OpenAI 高管离职引发关注:一份新闻报道提到三位领导者离开 OpenAI,可能导致战略转型。

- 社区推测这次人事变动可能会如何影响 OpenAI 内部的项目和未来方向。

4. AI 工具与框架

- Llamafile 彻底改变离线 LLM 可访问性:Llamafile 的核心维护者分享了关于在单个文件中提供离线、可访问 LLM 的激动人心更新,显著增强了用户可访问性。

- 这一进展反映了通过提供紧凑的离线解决方案来推动语言模型使用大众化的趋势。

- LlamaIndex:准备迎接 RAG-a-thon:继首届活动成功举办后,LlamaIndex 将与合作伙伴 @pinecone 和 @arizeai 在帕罗奥图的 @500GlobalVC 举办新一轮 RAG-a-thon。

- 该活动承诺将提供关于检索增强生成(RAG)以及 LlamaIndex 如何发挥关键作用的深入见解。

5. LLM 微调挑战

- GPT-4o 未能通过对话测试:GPT-4o 在保持连贯对话方面表现吃力,经常在不考虑新输入的情况下重复指令。

- 用户反馈提到 Sonnet 往往能纠正这些问题,凸显了 4o 对话模型的缺陷。

- Unsloth 在微调和 PPO 集成方面遇到困难:在 Unsloth 中使用 ‘model.save_pretrained_merged’ 进行微调时出现的问题引发了关注,原因是保存方法不一致。

- 将 Llama3 模型整合到 PPO 训练器中的尝试凸显了在生成输出前进行 ‘for_inference()’ 步骤的必要性,这使集成过程变得复杂。

6. 其他

- LinkedIn 工程团队利用 Flyte 流水线提升 ML 平台:官方宣布了一场关于 LinkedIn 工程团队如何转型其 ML 平台的直播会议,重点介绍 Flyte 流水线 及其在 LinkedIn 的实现。

- 预计与会者将深入了解 LinkedIn 在其 ML 平台中使用的工程策略和方法。

第一部分:Discord 高层级摘要

Stability.ai (Stable Diffusion) Discord

- 安装困境困扰用户:由于 Python 版本与 SD 操作不兼容,安装和配置 ComfyUI 和 Flux 被证明存在问题。

- 成员们对管理不同的 Python 环境表达了挫败感,强调了尽管尝试了各种修复方法,但仍反复失败。

- ControlNet 的风格创意:通过使用 ControlNet,用户分享了将照片转换为线稿的方法,并比较了涉及 DreamShaper 和 pony 模型的技术。

- 重点在于利用 Lora models 配合特定的基础模型来实现目标艺术输出。

- Auto1111 的 Inpainting 引起关注:探索了使用 Auto1111 工具进行精细的 Inpainting 任务,例如将特定海报插入图像中。

- 在细节管理方面,Inpainting 和 ControlNet 成为优于 Photoshop 等手动工具的首选替代方案。

- Intel Arc GPU 兼容性辩论:Intel Arc GPU 因其对 CUDA 的支持引起了褒贬不一的反应,影响了其在机器学习领域的应用。

- 一些成员探索了 ZLUDA patches,尽管 AMD 在 ML 方面的可行性仍然是一个讨论话题。

- 回顾社区争端:回顾了不同 SD forums 调节团队之间的历史冲突,突显了过去的 Discord 和 Reddit 动态。

- 这些争端揭示了管理开源 AI 社区的复杂性,反映出过去的情况与当前的用户动态息息相关。

Unsloth AI (Daniel Han) Discord

- Mistral-7b 的 MoEification 提升效率:Mistral-7b-MoEified-8x 采用了将 MLP 层划分为多个具有特定投影的拆分方法,以增强部署专家模型的效率。

- 社区专注于通过利用这些拆分模型架构来优化专家模型的使用,以获得更好的性能。

- Unsloth 在 Fine-Tuning 和 PPO 集成方面的困难:在 Unsloth 中使用

model.save_pretrained_merged进行 Fine-Tuning 时出现的问题引起了关注,原因是保存方法不一致。- 将 Llama3 模型集成到 PPO 训练器的尝试突显了在生成输出之前进行

for_inference()步骤的必要性,这使集成过程变得复杂。

- 将 Llama3 模型集成到 PPO 训练器的尝试突显了在生成输出之前进行

- BigLlama 模型合并带来挑战:通过 Meta-Llama 和 Mergekit 创建的 BigLlama-3.1-1T-Instruct 模型已被证明存在问题,因为合并后的权重需要训练。

- 尽管社区充满热情,但许多人认为在经过适当的训练和校准之前,它是“无用的”。

- Llama-3-8b-bnb 合并策略得到澄清:用户通过在 gguf 量化之前指定 16-bit 配置,解决了使用 LoRA 适配器合并 Llama-3-8b-bnb 的挑战。

- 该过程涉及遵循精确的合并指令,以确保无缝集成和性能。

- 探索 LLaMA3 的 RunPod 配置:由于运营费用高昂,讨论了在 RunPod 上运行 LLaMA3 model 的成本效益策略。

- 社区成员正在探索能够在保持模型性能效率的同时最大限度降低成本的配置。

HuggingFace Discord

- Gemma 2 2B 正式推出:Google 发布的 Gemma 2 2B 通过 WebLLM 和 WebGPU 技术实现了流畅的设备端运行。

- 社区对其易用性表示赞赏,甚至在免费版的 Google Colab 上也能运行,展示了其部署潜力。

- CogVideoX-2b 引燃视频生成领域:CogVideoX-2b 模型因其在文本到视频合成方面的能力而备受关注,可与领先的竞争对手抗衡。

- 围绕其竞争优势引发了辩论,预示着其在多媒体应用领域有着广阔的前景。

- 结构化输出受到关注:OpenAI Blog 将结构化输出定位为行业标准,引发了关于过往贡献的讨论。

- 此次发布引发了对过去作品的反思,暗示了机器学习输出标准化格局的演变。

- 深度估计的新构想:一篇 CVPR 2022 论文 介绍了一种结合双目立体视觉和单目结构光的 depth estimation(深度估计)技术,吸引了社区的兴趣。

- 社区对这些研究成果的实际落地表现出浓厚兴趣,表明了对计算机视觉领域可操作性见解的追求。

- AniTalker 彻底改变动画对话:基于 X-LANCE 的 AniTalker 项目增强了动画对话者中的面部动作描绘,提供了细微的身份分离。

- 测试展示了其在实时对话模拟中的实际效能,暗示了在交互式媒体中更广泛的应用。

LM Studio Discord

- LMStudio 准备推出 RAG 设置功能:LMStudio 的 RAG setup 功能引起了热议,预计将在 0.3.0 版本中首次亮相。这促使部分用户暂时使用 AnythingLLM 作为替代方案,尽管有些用户遇到了文件访问障碍。

- 讨论强调了对 Meta 的 LLaMA 集成的兴趣,一些人指出了初始设置的挑战,这些挑战可能会在未来的更新中得到简化。

- GPU 爱好者辩论未来的性能提升:NVIDIA 4090 是否值得升级引发了辩论,一些用户质疑其相对于 3080 的性能提升,并考虑双卡设置或切换到其他平台等替代方案。

- 关于即将推出的 RTX 5090 的改进推测升温,预计 VRAM 将维持在 4090 的 24GB,但希望有更好的能效和计算能力。

- 在市场波动中制定 GPU 升级策略:显卡市场面临动荡,2024 年 eBay 上 P40 显卡价格飙升,而 3090 的稀缺引发了人们对传闻中 AMD 48GB VRAM 显卡的兴趣。

- 社区成员强调了在考虑升级时进行 VRAM 可扩展性及电源兼容性检查的必要性,并提出了将 2060 Super 与 3060 组合等具有成本效益的解决方案。

- 量化背景下的 K-V Cache 探讨:关于 K-V cache 设置及其在模型量化中作用的循环讨论,激发了优化 Flash Attention 技术的兴趣。

- 对话包括分享改进注意力机制的指南和资源,暗示了对最大化计算吞吐量的追求。

- Bobzdar 深入评测 GPU 性能:Bobzdar 在 LM Studio 中使用 ROCM 和 Vulkan 对 8700G/780m IGP 进行的实验显示了 25% 的加速,尽管受到 20GB 以上 GPU RAM 限制的挑战。

- 尽管如此,llama3.1 70b q4 的进展显示其处理速度比 CPU 快 30%,但在超过 63k 的上下文大小(context sizes)下仍存在稳定性问题。

CUDA MODE Discord

- Hermes 之谜:PyTorch 2.4 vs CUDA 12.4:用户在运行 PyTorch 2.4 与 CUDA 12.4 时遇到了构建中断问题,而使用 CUDA 12.1 则能顺利运行。

- 进一步的见解提到通过 conda 安装了 CUDA 12.6,表明存在复杂的版本依赖关系。

- cublas hgemm 在 Windows 上表现强劲:cublas hgemm 库现在可以在 Windows 上运行,在 4090 GPU 上的性能提升至 315 tflops,相比之下 nn.Linear 仅为 166 tflops。

- 用户报告在运行 flux 时达到了约 2.4 it/s,标志着性能提升的一个里程碑。

- INT8 量化引发缩放争议:在 INT8 对称量化中,PyTorch 的 127.5 缩放策略在 Qwen2-0.5B 模型微调中因截断(clipping)导致了发散问题。

- 社区探索了替代方案,例如 INT4 量化训练,以绕过受限范围量化的约束。

- ZHULDA 3 在 AMD 的主张下消失:在 AMD 撤回此前授予的开发许可后,ZHUDA 3 项目已从 GitHub 下架。

- 社区对雇佣合同条款感到困惑,该条款允许在 AMD 认为不合适的情况下发布,凸显了模糊的合同义务。

- Hudson River Trading 高薪招募 GPU 专家:Hudson River Trading 正在寻找精通 GPU 优化的专家,重点是 CUDA kernel 开发和 PyTorch 增强。

- 该公司提供实习岗位和高达 $798K/年 的竞争性薪资,展示了高频交易领域巨大的财务吸引力。

Nous Research AI Discord

- Nvidia 进军对话式 AI:Nvidia 推出了 UltraSteer-V0 数据集,包含 230 万条对话,在 22 天内标注了 9 个细粒度信号。

- 数据使用 Nvidia 的 Llama2-13B-SteerLM-RM 奖励模型进行处理,评估从质量到创造力的各种属性。

- OpenAI 高管离职引发关注:一份新闻报道提到三位领导者离开 OpenAI,可能导致战略转变。

- 社区推测这次人事变动将如何影响 OpenAI 内部的项目和未来方向。

- Flux AI 图像生成超越竞争对手:Flux AI 的 “Schnell” 与 Midjourney 6 展开竞争,在图像生成的连贯性方面表现更优,展示了先进的模型能力。

- 尽管有细微的拼写错误,“Schnell” 生成的图像仍表现出极高的逼真度,表明其较竞争对手有了重大进步。

- 医学界通过新倡议加入 AI 领域:Open Medical Reasoning Tasks 项目启动,旨在联合医学界和 AI 社区,共同完成全面的推理任务。

- 该倡议利用 AI 医疗领域的进展,构建广泛的医学推理任务,并在相关研究中获得关注。

- Axolotl 走红引发微调热议:讨论强调 Axolotl 库是微调 AI 模型的热门选择,同时还有关于保险行业特定应用的咨询。

- 此外,还出现了关于 Llama 450b 托管方案以及推理瓶颈(特别是使用 vLLM 等资源时)的问题。

Latent Space Discord

- Web 开发者无缝转型 AI:由于 ML 专家短缺以及企业对 AI 应用开发的投入不断增加,关于从 Web 开发转向 AI 工程实用性的讨论非常热烈。

- 尽管职位发布通常强调 ML 资历,但由于公司高度重视 API 集成能力,这些职位经常由具有扎实 Web 开发经验的人员填补。

- NVIDIA 因 AI 数据收集遭受抨击:NVIDIA 被指控为 AI 项目进行大规模数据抓取,每天处理相当于“一个人一生”长度的视频材料,并得到了高层管理人员的批准。流出的文件和 Slack 消息证实了这一操作。

- NVIDIA 对伦理问题的漠视引发了员工的极大不满,也引发了公众对企业责任的质疑。

- John Schulman 从 OpenAI 跳槽至 Anthropic:John Schulman 宣布在 OpenAI 任职九年后离职,加入 Anthropic 以专注于 AI Alignment(AI 对齐)研究。

- 他澄清说,他的决定并非因为 OpenAI 缺乏支持,而是出于深入研究工作的个人抱负。

- OpenAI 通过 DevDay 与全球受众互动:OpenAI 宣布将在旧金山、伦敦和新加坡举办一系列 DevDay 活动,旨在通过研讨会和演示展示开发者如何利用 OpenAI 的工具进行实现。

- 此次巡展代表了 OpenAI 与全球开发者建立联系的战略,强化了其在社区中的角色。

- OpenAI API 可靠性大幅提升:OpenAI 在其 API 中实现了 Structured Outputs(结构化输出)功能,确保模型响应严格遵守 JSON Schemas,从而将 Schema 精度从 86% 提升至 100%。

- 最近的更新标志着在实现模型输出的一致性和可预测性方面迈出了一大步。

OpenAI Discord

- OpenAI DevDay 走向全球:OpenAI 宣布 DevDay 将前往 旧金山、伦敦和新加坡 等城市,在今年秋季为开发者提供实操环节和演示。

- 鼓励开发者与 OpenAI 工程师见面,在 AI 开发领域学习和交流想法。

- 桌面端 ChatGPT 应用与 Search GPT 发布:成员们根据 Sam Altman 的信息,讨论了 Windows 版 桌面端 ChatGPT 应用 的发布日期以及 Search GPT 的公测。

- Search GPT 已正式分发,确认了有关其可用性的查询。

- 利用 Structured Outputs:OpenAI 推出了 Structured Outputs,可生成与提供的 Schema 一致的 JSON 响应,增强了 API 交互体验。

- Python 和 Node SDK 提供原生支持,承诺为用户提供一致的输出并降低成本。

- AI 重塑游戏世界:一位成员设想 AI 通过实现独特的角色设计和动态 NPC 交互 来提升像《博德之门 3》(BG3)这样的游戏。

- 生成式 AI 在游戏中的应用预计将增强 玩家沉浸感 并彻底改变传统游戏体验。

- Bing AI Creator 使用 DALL-E 3:Bing AI Image Creator 采用了 DALL-E 3 技术,与最近的更新保持一致。

- 尽管有所改进,用户仍注意到输出质量存在不一致,并表达了不满。

Perplexity AI Discord

- GPT-4o 未能通过对话测试:GPT-4o 在保持连贯对话方面表现吃力,经常在不考虑新输入的情况下重复指令。

- 用户反馈提到 Sonnet 倾向于纠正这些问题,凸显了 4o 对话模型的缺陷。

- 排序 AI 旨在解决内容混乱:一所大学正在开展一个创新的 内容排序和推荐引擎 项目,旨在改进数据库内容的优先级排序。

- 同行建议使用 RAG 等平台和本地模型来增强项目的影响力和复杂性。

- NVIDIA GPU 故障:NVIDIA Blackwell GPU 因在单个 Superchip 上集成两个 GPU 的芯片设计错误而面临延迟。

- 这一重新设计的需求推迟了这些先进处理器的发布,影响了开发者和技术采用者的进度表。

- API 故障削弱用户信心:API 结果出现意外损坏,在撰写文章时,初始行之后的内容会出现乱码。

- 文档确认 API 模型弃用计划于 2024 年 8 月进行,包括 llama-3-sonar-small-32k 模型。

Eleuther Discord

- Meta 通过大规模网络掌握分布式 AI 训练:在 ACM SIGCOMM 2024 上,Meta 展示了其连接数千个 GPU 的庞大 AI 网络,这对于训练 LLAMA 3.1 405B 等模型至关重要。

- 他们关于 RDMA over Ethernet for Distributed AI Training 的研究强调了支持全球最广泛 AI 网络之一的架构。

- SB1047 引发 AI 社区争议:一封反对 SB1047(即《AI 安全法案》)的公开信正在征集签名,警告该法案可能会抑制开源研究与创新 (Google Form)。

- Anthropic 承认监管的必要性,但暗示该法案可能会限制创新,并带来潜在的负面学术和经济影响。

- 机械式异常检测:有前景但表现不一:Eleuther AI 评估了机械式异常检测 (mechanistic anomaly detection) 方法,发现它们有时不如传统技术,详见 博客文章。

- 在全量数据批次上性能有所提升;然而,并非所有任务都有收益,这强调了需要进一步完善的研究领域。

- 扩展 SAEs:近期的探索与资源:Eleuther AI 讨论了 Structural Attention Equations (SAEs),并提供了指向 Monosemantic Features 论文 等基础和现代著作的链接。

- 目前正在努力将 SAEs 从玩具模型扩展到 13B 参数,Anthropic 和 OpenAI 在 扩展论文 中展示了显著的合作。

- lm-eval-harness 轻松适配自定义模型:Eleuther AI 鼓励在自定义架构中使用 lm-eval-harness,并在 GitHub 示例 中提供了指南链接。

- 讨论涉及了批处理的细微差别,并确认了默认包含 BOS token,突显了 eval-harness 在测试环境中的适应性。

LangChain AI Discord

- GPU 溢出:在 CPU 上运行模型:用户在尝试于显存(vRAM)仅为 8GB 的 GPU 上运行大型模型时遇到了内存溢出问题,导致不得不采用完全利用 CPU 的变通方案,尽管性能较慢。

- 针对处理 GPU 显存不足的最佳实践展开了讨论,强调了速度与能力之间的权衡。

- LangChain 集成难题:由于缺乏文档,关于如何在 LangChain v2.0 中结合 RunnableWithMessageHistory 进行聊天机器人开发的问题频出。

- 建议通过现有的教程探索存储消息历史 (message history) 的方法,这暗示了开发者面临的常见障碍。

- 自动代码审查的缺陷引发抱怨:GPT-4o 在正确评估 GitHub diffs 中的位置时出现问题,促使用户寻求替代的数据处理方法。

- 建议避免使用视觉模型,转而采用特定于编码的方法,这凸显了将 AI 应用于代码审查的挑战。

- AgentGenesis 邀请开源协作:AgentGenesis 项目提供了一个 AI 代码片段库,目前正在寻求贡献者以增强其开发,并强调其采用开源 MIT 许可证。

- 鼓励通过其 GitHub 仓库 进行积极的社区协作和贡献,以构建一个强大的可重用代码库。

- Mood2Music 应用精准触达:Mood2Music 应用承诺根据用户的情绪推荐音乐,并与 Spotify 和 Apple Music 无缝集成。

- 这款创新应用旨在通过情绪检测自动创建播放列表来提升用户体验,其特色是独特的 AI 自拍分析功能。

Interconnects (Nathan Lambert) Discord

- John Schulman 意外转投 Anthropic:John Schulman 宣布离开 OpenAI 加入 Anthropic,重点关注 AI alignment 和技术工作。

- 此举被视为在寻求新的视角,引发了关于 AI 伦理和创新影响的讨论。

- 关于 Gemini 计划的泄露传闻引发成员兴趣:社区对有关 OpenAI 的 Gemini 计划的泄露信息进行了推测,对围绕 Gemini 2 的神秘进展感到惊叹。

- 这种好奇心引发了关于 OpenAI 内部潜在技术进步和战略方向的疑问。

- Flux Pro 在 AI 模型中提供独特体验:Flux Pro 被描述为提供了与竞争对手明显不同的用户体验。

- 讨论集中在它的独特方法可能并非源于基准测试,而是源于主观的用户满意度。

- 数据依赖性影响模型收益:对话强调,模型性能受益于将数据分解为 \( (x, y_w) \) 和 \( (x, y_l) \) 等组件,这在很大程度上取决于 data noise levels。

- 初创公司通常选择噪声数据策略来绕过标准的 supervised fine-tuning,正如一次提及 Meta 的 Chameleon 方法的 ICML 讨论中所指出的。

- Claude 在用户体验上落后于 ChatGPT:成员们认为 Claude 不如 ChatGPT,指出它类似于旧的 GPT-3.5 模型,而 ChatGPT 则因其灵活性和记忆性能受到称赞。

- 这引发了关于下一代 AI 工具的技术进步和用户期望的对话。

OpenRouter (Alex Atallah) Discord

- GPT4-4o 发布,具备结构化输出能力:新模型 GPT4-4o-2024-08-06 已在 OpenRouter 上发布,增强了结构化输出(Structured Output)能力。

- 此更新包括在响应格式中提供 JSON schema 的能力,鼓励用户在指定频道报告严格模式(strict mode)的问题。

- AI 模型性能风波:与 haiku/flash/4o 相比,yi-vision 和 firellava 模型在测试条件下表现不佳,凸显了持续的价格和效率挑战。

- 讨论暗示 Google Gemini 1.5 即将降价,将其定位为更具成本效益的替代方案。

- 高性价比的 GPT-4o 在 Token 管理上取得进展:通过采用更具成本效益的 gpt-4o-2024-08-06,开发者现在可以在输入上节省 50%,在输出上节省 33%。

- 社区对话表明,效率和战略规划是该模型降低成本的关键因素。

- 计算 OpenRouter API 成本:关于 OpenRouter API 成本计算的详细讨论强调,在请求后使用

generation端点可以进行准确的支出跟踪。- 这种方法允许用户在按需付费方案中有效管理资金,而无需在流式响应中嵌入成本详情。

- Google Gemini 节流问题:Google Gemini Pro 1.5 的用户因严重的速率限制(rate limiting)面临

RESOURCE_EXHAUSTED错误。- 有必要调整使用预期,目前对于这些速率限制约束还没有立即的解决方案。

LlamaIndex Discord

- LlamaIndex:为 RAG-a-thon 做好准备:在首届活动取得成功后,LlamaIndex 将与合作伙伴 @pinecone 和 @arizeai 在帕洛阿尔托的 @500GlobalVC 举办新一轮的 RAG-a-thon。

- 该活动承诺将深入探讨 Retrieval-Augmented Generation 以及 LlamaIndex 在其中发挥的关键作用。

- 关于 RAG 增强型编程助手的网络研讨会:与 CodiumAI 合作的网络研讨会 邀请参与者探索 RAG 增强型编程助手,展示 LlamaIndex 如何提升 AI 生成代码的质量。

- 参与者必须注册并验证 Token 所有权;会议将展示维护上下文代码完整性的实际应用。

- RabbitMQ 弥合 Agent 间的差距:@pavan_mantha1 的一篇博客探讨了如何使用 RabbitMQ 在多 Agent 系统中实现 Agent 之间的有效通信。

- 这一创新设置集成了 @ollama 和 @qdrant_engine 等工具,以简化 LlamaIndex 内部的操作流程。

- Function Calling 故障导致 CI 崩溃:LlamaIndex 的

function_calling.py产生了一个 TypeError,阻碍了 CI 流程,该问题已通过升级特定依赖项得到解决。- 旧的软件包要求引发了问题,促使团队加强依赖项规范,以避免未来出现此类故障。

- 显微镜下的向量数据库:分享了一份 Vector DB 对比,用于评估不同向量数据库的能力。

- 鼓励社区分享使用各种 VectorDB 的经验见解,以教育和加强知识共享。

Cohere Discord

- Galileo 幻觉指数引发开源辩论:Galileo 的幻觉指数 (Hallucination Index) 引发了关于 LLM 开源分类的讨论,突显了在对 Command R Plus 等模型进行分类时的模糊性。

- 用户就 Open weights 与完全开源之间的区别进行了争论,主张建立更清晰的标准,并可能设立一个单独的类别。

- Command R Plus 许可争议升温:Galileo 澄清了他们对开源的定义,即包含支持商业用途的模型,并将 Command R Plus 的 Creative Commons 许可视为一种限制。

- 成员们讨论了为 ‘Open weights’ 创建一个新类别的必要性,建议用明确的许可分类取代宽泛的开源标签。

- Mistral 在 Apache 2.0 协议下的 Open weights:Mistral 的模型因其宽松的 Apache 2.0 许可而脱颖而出,提供了比通常的 Open weights 更多的自由度。

- 讨论包括分享 Mistral 的文档,强调了他们在预训练和指令微调模型透明度方面的倡议。

- 用于 RAG 项目的 Cohere Toolkit:一名成员将 Cohere Toolkit 用于 AI 奖学金项目,展示了其在开发跨多个特定领域数据库的 RAG LLM 中的应用。

- 该工具包的集成旨在探索来自 Confluence 等平台的内容,增强其在各种专业环境中的实用性。

- 探索第三方 API 集成的可行性:正在讨论从 Cohere 模型切换到第三方 API(如 OpenAI 的 Chat GPT 和 Gemini 1.5)的可能性。

- 使用这些外部 API 的潜力显然有望扩大现有项目的范围和适应性。

Modular (Mojo 🔥) Discord

- InlineList 取得令人兴奋的新特性进展:Mojo 中 InlineList 的开发正在推进,根据最近的 GitHub pull request,引入了

__moveinit__和__copyinit__方法,旨在增强功能集。- 这些新方法似乎是由技术优先级驱动的,暗示了

InlineList增强功能的未来潜力。

- 这些新方法似乎是由技术优先级驱动的,暗示了

- Mojo 通过小缓冲区策略优化 List:Mojo 中

List的小缓冲区优化 (Small buffer optimization) 引入了灵活性,允许通过List[SomeType, 16]等参数进行栈空间分配,详见 Gabriel De Marmiesse 的 PR。- 这一改进最终可能会消除对独立

InlineList类型的需求,从而简化现有架构。

- 这一改进最终可能会消除对独立

- Mojo 在自定义加速器方面的新前景:带有脉动阵列 (systolic arrays) 的 PCIe 卡等自定义加速器有望在 Mojo 开源后成为其潜在支持对象,展示了新的硬件集成可能性。

- 尽管热情高涨,但目前使用 Mojo 进行自定义算子 (kernel) 替换仍具挑战性,因为在 RISC-V 目标支持可用之前,像降低 PyTorch IR 这样的现有流程仍占据主导地位。

LAION Discord

- OpenAI 领导层变动,John Schulman 加入 Anthropic:OpenAI 联合创始人 John Schulman 宣布离开并加入竞争对手 Anthropic,这是受 OpenAI 近期重组的推动。

- 此次领导层变动发生在 OpenAI 解散其超级对齐 (superalignment) 团队仅三个月后,暗示了内部战略的转变。

- 开源模型训练面临高成本障碍:开源社区承认,昂贵的模型训练限制了 SOTA (state-of-the-art) 模型的开发。

- 更廉价的训练可能会带来开源模型的繁荣,暂且不谈数据来源的伦理挑战。

- Meta 的 JASCO 项目因法律问题受阻:Meta 低调进行的 JASCO 项目面临延迟,可能归因于与 Udio 和 Suno 的诉讼。

- 人们的担忧日益增加,因为这些法律纠纷可能会减缓专有 AI 的技术进步。

- 验证准确率达到 84%,引发“信徒”狂欢:模型验证准确率达到 84%,这是一个值得关注的里程碑,人们引用《黑客帝国》(The Matrix) 的梗来庆祝。

- 随着这一突破,热情高涨,呼应了那句经典台词:“他开始相信了 (He’s beginning to believe)”。

- CIFAR 的频率保持与相位查询:有人对 CIFAR 图像在傅里叶分析中的频率恒定性与潜在的相位偏移提出了询问。

- 这种好奇心引发了关于图像频率是否保持稳定而相位动态发生变化的讨论。

tinygrad (George Hotz) Discord

- Tinygrad 的 Aurora 雄心:成员们在 general 频道探讨了在 Aurora(配备 Intel GPU 支持的尖端超级计算机)上运行 tinygrad 的可行性。

- 见解显示,Aurora 的 GPU 可以利用独特的 Tensor Core 指令,输出 16x8 矩阵,优化后性能可能超过 2 ExaFLOPS。

- FP8 Nvidia 悬赏任务中的精度风险:关于 FP8 Nvidia 悬赏任务的咨询不断,重点在于精度是否需要 E4M3、E5M2 或同时满足这两种标准。

- 该悬赏反映了 Nvidia 对多样化精度要求的重视,挑战开发者在不同模式下进行优化。

- 解决 Tinygrad 中的 Tensor 切片 Bug:修复了 Tinygrad 中导致 Tensor 切片出现

AssertionError的 Bug,确保切片保持连续性,此消息已由 George Hotz 确认。- 该解决方案明确了 Buffer 到 DEFINE_GLOBAL 的转换,这是 Tinygrad 计算操作中一个令人困扰的问题。

- JIT 与 Batch Size 的博弈:数据集中不一致的 Batch Size 导致了 JIT 错误,建议包括跳过或单独处理最后一个 Batch 以防止错误。

- George Hotz 建议确保不对最后一个不完整的 Batch 执行 JIT,以平滑工作流。

- 解锁计算机代数解决方案:分享了关于计算机代数的学习笔记,旨在帮助理解 Tinygrad 的 shapetracker 和符号数学,访问地址见此处。

- 该仓库加深了对 Tinygrad 结构的理解,为深入研究高级符号计算的热心人士提供了宝贵知识。

DSPy Discord

- Wiseflow 高效挖掘数据:Wiseflow 被誉为一种敏捷的数据提取工具,能够系统地对网站和社交媒体的信息进行分类并上传到数据库,详情可见 GitHub。

- 成员们讨论了将 Golden Ret 与 Wiseflow 集成,以构建一个强大的动态知识库。

- HybridAGI 发布新版本:HybridAGI 项目发布了新版本,重点关注易用性和优化数据流水线(data pipelines),并推出了 Vector-only RAG 和 Knowledge Graph RAG 等新功能,已在 GitHub 上分享。

- 社区对其在各种 AI 设置中实现无缝神经符号计算(neuro-symbolic computation)的应用表现出浓厚兴趣。

- 基于 LLM 的 Agent 旨在挖掘 AGI 潜力:最近的一篇论文深入探讨了基于 LLM 的 Agent 规避自主性和自我完善等限制的前景,挑战了传统的 LLM 约束 查看 PDF。

- 越来越多的人呼吁在软件工程中建立明确的标准来区分 LLM 和 Agent,并强调了统一标准的必要性。

- 推理计算提升性能:一项研究发现,在推理过程中增强样本生成可显著提高语言模型的效率,在 SWE-bench Lite 领域的增益从 15.9% 显著提升至 56% 查看 PDF。

- 值得注意的是,增加尝试次数凸显了潜力,其中 DeepSeek-V2-Coder-Instruct 重新定义了此前上限为 43% 的单次尝试成功率基准。

- MIPRO 的性能指标参差不齐:在性能讨论中,有人指出 MIPRO 通常优于 BootstrapFewShotWithRandomSearch,但在不同情况下表现并不一致。

- 关于 MIPROv2 的进一步提问确认了其目前尚不支持断言(assertions),这是社区期待已久的功能。

OpenAccess AI Collective (axolotl) Discord

- 合成数据策略增强推理任务:一位社区成员针对 8b 模型提出了一种合成数据生成策略,通过在合成指令中加入 Chain-of-Thought (CoT),专注于 text-to-SQL 等推理任务。

- 讨论了一种在生成最终 SQL 查询之前先进行 CoT 训练的方法,以提高模型性能。

- LoRA Adapter 合并中的 MD5 哈希一致性得到确认:关于合并 LoRA Adapter 时 MD5 哈希一致性 的咨询得到了确认,即预期结果确实应该是一致的。

- 任何与预期 MD5 哈希结果的偏差都被讨论为潜在问题的迹象。

- Bits and Bytes Pull Request 引起关注:用户们认识到 最新的 Bits and Bytes Foundation pull request 对库开发爱好者具有重要意义。

- 该 Pull Request 被视为该库演进过程中的关键进展,正受到社区的密切关注。

- Gemma 2 27b QLoRA 需要微调:注意到了 Gemma 2 27b 的 QLoRA 存在问题,特别是关于调整学习率以配合最新的 flash attention 从而改善结果。

- 建议调整 QLoRA 参数以增强性能,特别是在集成 flash attention 等新模块时。

- UV:一个强大的 Python 包管理器:UV 是一个用 Rust 编写的新型 Python 包管理器,因其在高效处理安装方面的惊人速度而被引入。

- UV 被认为是 pip 的更快替代方案,因其可能改进 docker build 过程而受到关注。

Torchtune Discord

- Torchtune 推出 PPO 集成:Torchtune 添加了 PPO 训练 recipes,使其功能支持 Reinforcement Learning from Human Feedback (RLHF)。

- 这一扩展允许更强大的训练过程,增强了该平台支持的模型在 RLHF 方面的可用性。

- Qwen2 模型加入 Torchtune 阵容:Torchtune 扩展了支持范围,包括 Qwen2 模型,目前 7B 模型已可用,后续还将推出更多小型模型。

- 对不同模型尺寸的扩展支持旨在增强 Torchtune 对多样化机器学习需求的适应能力。

- Llama3 文件路径排查变得更简单:成员们讨论了 Llama3 模型面临的挑战,强调了正确的 checkpointer 和 tokenizer 路径,以及为 LLAMA3 Instruct 模型自动配置 prompt。

- 这些确认简化了用户在面对 prompt 变异性和模型干扰问题时的处理流程。

- Torchtune 计划进行模型页面改版:成员们正在考虑重构 Model Page,以适配包括 multimodal LLMs 在内的新模型和未来模型。

- 提议的改版包括一个模型索引页,用于统一处理下载和配置模型等任务。

- PreferenceDataset 得到增强:Torchtune 的 PreferenceDataset 现在拥有统一的数据流水线,支持最近 GitHub pull request 中概述的聊天功能。

- 此次重构旨在简化数据处理,并征求社区反馈以进一步完善转换设计。

OpenInterpreter Discord

- Open Interpreter 中本地 LLM 设置出现失误:在 Open Interpreter 中使用本地 LLM 进行设置时,选择 llamafile 后会导致不必要的下载,从而引发 openai.APIConnectionError。

- 相关解决工作正在进行中,用户正通过私信协调解决方案。

- Open Interpreter 的安全性问题:一位用户对 Open Interpreter 的数据隐私和安全性表示担忧,询问系统间的通信是否包含端到端加密。

- 该用户热衷于了解加密标准和数据保留政策,特别是涉及第三方参与时。

- Python 版本支持困惑:Open Interpreter 目前支持 Python 3.10 和 3.11,这让询问 Python 3.12 支持的用户无所适从。

- 建议通过 Microsoft App Store 进行安装验证以检查兼容性。

- 分享 Ollama 模型设置提示:用户讨论了使用

ollama list设置本地模型的方法,并强调了模型对 VRAM 的前提要求。- 有关付费模型所需的 API key 详情,请参阅 GitHub 说明。

Mozilla AI Discord

- Llamafile 彻底改变了离线 LLM 的可访问性:Llamafile 的核心维护者分享了关于在单个文件中提供离线、可访问 LLM 的最新进展,显著增强了用户的可访问性。

- 这一进展反映了通过提供紧凑的离线解决方案来推动语言模型访问民主化的努力。

- Mozilla AI 以礼品卡激励反馈:Mozilla AI 发起了一项 社区调查,为参与者提供赢取 $25 礼品卡 的机会,以换取宝贵的反馈。

- 该倡议旨在从社区收集深入的见解,为未来的开发提供参考。

- sqlite-vec 发布派对引发关注:sqlite-vec 的发布派对 正式开启,邀请爱好者探索新功能并参与互动演示。

- 该活动由核心维护者主持,展示了 SQLite 中向量数据处理方面的实质性进展。

- 机器学习论文研讨引发热议:社区深入探讨了 机器学习论文研讨,主题包括 “Communicative Agents” 和 “Extended Mind Transformers”,揭示了新的分析视角。

- 这些讨论激发了关于这些新发现的潜在影响和实施方案的讨论。

- Local AI AMA 弘扬开源精神:Local AI 的维护者进行了一场成功的 AMA,重点介绍了他们作为 OpenAI 的开源、自托管替代方案。

- 该活动强调了对开源开发和社区驱动创新的承诺。

MLOps @Chipro Discord

- LinkedIn 工程团队利用 Flyte 流水线提升 ML 平台:宣布了一场关于 LinkedIn 工程团队如何改造其 ML 平台 的直播会议,重点关注 Flyte 流水线 及其在 LinkedIn 的实施。

- 预计参与者将深入了解 LinkedIn 在其 ML 平台中使用的工程策略和方法。

- Flyte 流水线的实际应用:直播活动涵盖了 Flyte 流水线,展示了它们在 LinkedIn 基础设施中的实际应用。

- 参与者将探索 LinkedIn 如何利用 Flyte 来提高运营效率。

Alignment Lab AI Discord 没有新消息。如果该频道长期沉寂,请告知我们,我们将将其移除。

LLM Finetuning (Hamel + Dan) Discord 没有新消息。如果该频道长期沉寂,请告知我们,我们将将其移除。

DiscoResearch Discord 没有新消息。如果该频道长期沉寂,请告知我们,我们将将其移除。

AI21 Labs (Jamba) Discord 没有新消息。如果该频道长期沉寂,请告知我们,我们将将其移除。

PART 2: 按频道划分的详细摘要和链接

完整的频道详细解析已为邮件格式进行截断。

如果您喜欢 AInews,请分享给朋友!预谢!