ainews-grok-2-and-chatgpt-4o-latest-confuses

Grok 2! 和 ChatGPT-4o-latest 把大家都搞糊涂了。

OpenAI 在 ChatGPT 中低调发布了全新的 GPT-4o 模型(与 API 版本有所不同),并在 Lmsys Arena 竞技场基准测试中重新夺回了数学、编程和指令遵循等多个类别的冠军宝座。

与此同时,X.ai 推出了 Grok 2,其性能超越了 Claude 3.5 Sonnet 和此前的 GPT-4o 版本,并计划发布企业级 API。Grok 2 集成了 Black Forest Labs 的 Flux.1,这是一款性能超越 Stable Diffusion 3 的开源文生图模型。

Google DeepMind 宣布推出 Gemini Advanced,增强了对话功能并实现了与 Pixel 设备的集成。

AI 研究员 Yann LeCun (ylecun) 强调了大型语言模型(LLM)在学习和创造力方面的局限性;而 rohanpaul_ai 则讨论了一个名为“AI 科学家”(AI Scientist)的系统,该系统能以极低的成本生成可发表的机器学习研究成果。此外,Andrej Karpathy (karpathy) 警告称,LLM 的分词器(Tokenizer)存在类似于 SQL 注入的安全风险。

一天之内发布两个前沿模型?!

AI News (2024/08/13-2024/08/14)。我们为您查看了 7 个 subreddits、384 个 Twitter 账号 和 29 个 Discord 社区(253 个频道,2414 条消息)。预计节省阅读时间(以 200wpm 计算):294 分钟。您现在可以标记 @smol_ai 进行 AINews 讨论!

比较容易讨论的进展是上周在 ChatGPT 中悄悄发布的全新 GPT-4o 模型的确认。需要明确的是,这与上周在 API 中发布的另一个 GPT-4o 模型不同(即我们之前报道过的支持 structured outputs 的那个版本)。

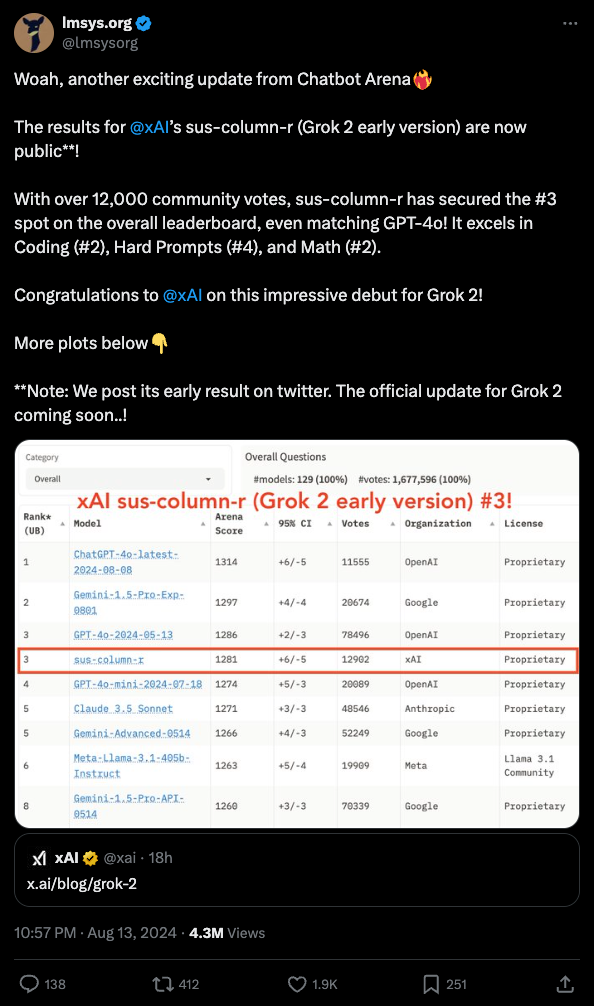

几乎没有人对此感到完全满意 —— 从新的命名结构,到愈发低调的发布方式,甚至是模型性能 —— 尽管其性能令人印象深刻,并从 Gemini 1.5 Pro August 手中夺回了 Lmsys arena 的第一名。

新版 ChatGPT-4o 类别排名:

- 总榜:#1

- 数学:#1-2

- 编程:#1

- 高难度提示词:#1

- 指令遵循:#1

- 长查询:#1

- 多轮对话:#1

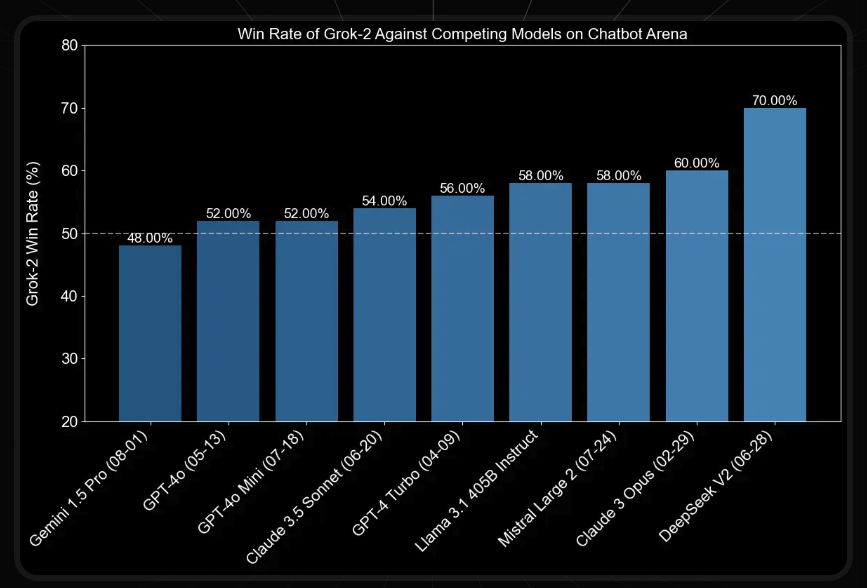

相比之下,X.ai 的 Grok 2 的故事线要清晰得多,它于昨晚太平洋时间晚上 11 点发布,并被证实就是 sus-column-r,而不是许多人之前猜测的 Cohere。Grok 2 击败了 Claude 3.5 Sonnet 以及 GPT 4o May 和 Mini:

虽然 Grok 1(我们的报道见此)的主要特点是其 open weights 性质,但 Grok 2 目前仅面向 X 的高级订阅用户发布,不过官方博客提到 Grok-2 和 Grok-2 mini 将于“本月晚些时候”在 X 的新企业级 API 平台上发布。

X 平台上的 Grok 2 还集成了 Black Forest Labs 的 Flux.1 模型(我们的报道见此),该模型相对较少审查,并且已经在开源文本生成图像社区中取代了 Stable Diffusion 3(与此同时,Google 的 Imagen 3 随着新论文的发布也正趋于更加开放)。

AI Twitter 摘要

所有摘要均由 Claude 3.5 Sonnet 生成,从 4 次运行中择优。

AI 模型更新与能力

-

Gemini Advanced:Google DeepMind 发布了 Gemini Live,这是一种与 Gemini 进行更自然对话的新方式。功能包括头脑风暴、插话提问以及暂停/恢复对话。@GoogleDeepMind 强调了其在搭载 Google Tensor G4 芯片的 Pixel 设备上的集成。

-

LLM 局限性:@ylecun 强调,LLM 无法回答其训练数据之外的问题或解决相关问题,无法在没有人类帮助的情况下获得新技能,也无法发明新事物。他认为,仅靠扩大 LLM 规模并不会产生具备这些能力的系统。

-

AI Scientist:讨论了一篇关于 AI Scientist 系统的论文,该系统能够生成研究构思、进行实验并撰写机器学习论文。@rohanpaul_ai 指出,它可以产出超过顶级 ML 会议录用门槛的论文,且每篇论文的成本低于 15 美元。

-

模型性能:@OfirPress 提到,OpenAI 发布了 SWE-bench 任务的一个子集,经人工验证是可解的,可以被视为 “SWE-bench Easy”。

AI 开发与工具

-

Tokenization 问题:@karpathy 警告称,由于输入字符串中特殊 Token 的解析问题,LLM 的 Tokenizers 可能存在类似于 SQL 注入攻击的安全漏洞。

-

多 Agent 系统:@jerryjliu0 展示了一个复杂多 Agent 系统的简洁实现,证明了事件驱动架构和可定制性的优势。

-

Prompt Engineering:@dzhng 分享了使用 LLM 生成结构化输出的技巧,强调了 Schema 中属性顺序的重要性,并建议添加 “reason” 字段以提高性能。

-

RAG 改进:@rohanpaul_ai 讨论了 EyeLevel 的 GroundX,这是一种 RAG 的新方法,将文档处理为语义对象,从而保留上下文信息并提高检索准确性。

行业与研究趋势

-

NoSQL 辩论:@svpino 引发了关于 NoSQL 数据库现状和相关性的讨论。

-

AI Alignment:@RichardMCNgo 对 AI Alignment 工作可能为政府审查 AI 系统提供掩护表示担忧。

-

开源模型:@bindureddy 提到了开源 LLM 在编程能力方面即将迎来的改进,暗示将有新版本发布。

-

AI 研究论文:AI Scientist 系统生成研究论文的能力引发了关于学术出版未来以及 AI 在科学发现中作用的讨论。

AI Reddit 摘要

/r/LocalLlama 摘要

主题 1. 新开源 LLM 发布:InternLM2.5

- 我们已在 HuggingFace 上发布了 InternLM2.5 的 1.8B 和 20B 新模型。 (Score: 63, Comments: 20):InternLM2.5 已在 HuggingFace 上发布了 1.8B 和 20B 尺寸的新模型。1.8B 模型被描述为超轻量级且高度可适配,而 20B 模型功能更强大,适用于复杂任务。这些模型可在 HuggingFace 上获取,项目详情可见 GitHub。

- InternLM2.5 模型具有 1M token 上下文窗口,但用户反映在使用 Xtuner、axolotl 和 swift 等微调工具时遇到挑战,正在寻求关于有效微调方法的建议。

- 用户在使用 LMDeploy 将 InternLM 模型部署为 API 时遇到了问题,报告了乱码输出或无响应,并就正确的实现方式提出了疑问。

- 与最初的担忧相反,模型支持 llama.cpp,这一点已通过 1.8B 和 20B 版本的 HuggingFace 模型页面链接得到确认。

主题 2. 具有桌面控制能力的先进 AI Agents

- 给 Llama 一个它自己的 Windows 实例 (Score: 52, Comments: 24):LLaMA(一种大型语言模型)被赋予了对 Windows 实例的控制权,并可以访问各种 API,包括屏幕截图、鼠标和键盘控制以及终端使用。该 AI 模型自命名为 “Patrick”,出生日期为 1975 年 4 月 4 日,它被释放出来利用这些能力去实现一系列目标,展示了其像人类用户一样与计算机系统交互的能力。

- 用户对该项目的开源可用性和方法论表示关注,要求上传到 GitHub,并对 AI 的任务执行过程感到好奇。开发者承诺会分享图片并可能将项目开源。

- 讨论集中在 AI 系统的技术层面,包括如何为文本模型理解而解码屏幕截图,以及使用 Vision Language Models (VLMs) 进行图像文本处理。文中分享了 Hugging Face 的 VLM 博客链接以供参考。

- 评论者幽默地推测 AI 可能会发现并沉迷于《上古卷轴5:天际》(Skyrim)或《英雄联盟》(League of Legends)等游戏,并提到了赋予 AI 系统自主权和计算机访问权限可能带来的意外后果。

主题 3. Grok 2.0 Mini 在 LMSYS Arena 中表现惊人

- [LMSYS 上的 sus-column-r 就是 Grok] (Score: 140, Comments: 112):Grok 2.0 Mini 已被确认为 LMSYS Arena 排行榜上 “sus-column-r” 条目背后的模型。这一发现表明,xAI 的最新模型在各种基准测试和任务中正与其他领先的 AI 系统展开激烈竞争。在 LMSYS Arena 上识别出 Grok 2.0 Mini,为将其与其他主流 AI 模型在功能和性能方面进行直接比较提供了机会。

- Grok 2.0 Mini 被证实为 LMSYS Arena 上的 “sus-column-r” 模型,其表现可与顶级 AI 模型媲美。用户对 AI 军备竞赛以及一年内可能出现的令人印象深刻的进展感到兴奋。

- 该模型的表现引发了褒贬不一的反应,一些人称赞其能力,而另一些人则保持怀疑。Elon Musk 通过 Twitter 确认了 Grok 2.0 Mini 的身份,用户注意到其无审查(uncensored)特性,并将其与 Command R+ 进行比较。

- 讨论围绕模型大小展开,推测 “mini” 可能仍意味着高达 170B 的参数。用户争论是否会发布权重,Musk 表示新模型发布与开源之间有 5 个月的时间差。

AI Reddit 全面回顾

r/machinelearning, r/openai, r/stablediffusion, r/ArtificialInteligence, /r/LLMDevs, /r/Singularity

AI 模型发布与改进

-

Google Gemini 语音对话模式发布:The Verge 报道 Google 已为 Gemini 推出了实时语音对话模式,标志着 AI 与人类交互的重大进步。

-

Agent Q:自愈式 Web Agent:MultiOn AI 宣布在 AI 研究方面取得突破,推出 Agent Q,其具备针对 Web Agent 的规划和自愈能力。

-

FLUX 在 24GB GPU 上实现全量微调:Stable Diffusion 社区报告了 FLUX 模型微调的重大进展,现在仅需 24GB GPU 即可实现,该功能可能很快会加入 Kohya。

AI 发展与行业新闻

-

OpenAI 延迟推出的语音模式:一篇文章指出,OpenAI 承诺的 ChatGPT 语音模式在发布三个月后仍未兑现。

- 一位用户声称正处于 Alpha 测试阶段,这表明缓慢的推送正在进行中。

- 另一位用户提到取消了 ChatGPT 订阅并转向 Poe,理由是其他模型的表现更好。

-

AI 炒作与虚假信息:多篇帖子讨论了 “草莓”事件,一名 Twitter 用户发布了关于 AI 进展的虚假声明,引发了社区内关于 AI 炒作和虚假信息的讨论。

社区管理

-

禁止虚假信息:r/singularity 版主宣布封禁特定用户名及相关的 Twitter 链接,以打击虚假信息和恶意挑衅。

-

社区对虚假声明的回应:多篇帖子呼吁封禁那些传播 AI 进展虚假信息的用户。

AI Discord 摘要

由 GPT4O (gpt-4o-2024-05-13) 生成的摘要之摘要的摘要

1. LLM 模型进展

- Hermes 2.5 超越 Hermes 2:Hermes 2.5 在添加代码指令示例后,在各项基准测试中表现优于 Hermes 2,其 MMLU 基准测试得分为 52.3,而 Hermes 2 为 34.5。

- 这一改进突显了代码指令示例对模型性能的显著影响,为基准测试对比设定了新标准。

- X 发布 Grok-2 Beta 版:来自 X 的新 AI 模型 Grok-2 声称具备最先进的推理能力,显著推动了该领域的发展。

- 该模型的发布预计将对行业产生重大影响,展示了 X 对创新 AI 开发的承诺。

2. Prompt Engineering 技术

- 批判性思维技术汇编:一位成员正在编写一个综合性的 Prompt,融合了苏格拉底教学法 (Socratic Method)、布鲁姆分类法 (Bloom’s Taxonomy) 和科学方法 (Scientific Method) 等技术。

- 目标是创建能够鼓励批判性思维的 Prompt,整合了如 TRIZ、演绎推理和 SWOT 分析等方法。

- 解决 OpenAI 响应不一致问题:一位用户通过要求提供完整的命令列表提高了 Prompt 的清晰度,使响应准确率达到了 100%。

- 这突显了 Prompt Engineering 中清晰输出格式的重要性,减少了模型行为的不一致性。

3. API 性能与优化

- Anthropic 的 Prompt Caching:Anthropic 推出了 Prompt Caching,可将 API 输入成本降低高达 90%,延迟降低高达 80%。

- 该功能可能会彻底改变 API 效率,对于寻求高性价比解决方案的开发者来说,这是一个极具吸引力的选择。

- Perplexity API HTML 格式化:用户寻求从 Perplexity API 获得一致的 HTML 格式响应,并正在尝试使用 System Prompt 和

markdown2模块。- 这种方法可能会平衡响应质量和 HTML 格式化,增强 API 输出的可用性。

4. 开源 AI 工具

- LlamaIndex Box Reader 集成:LlamaIndex 现在提供 Box Readers,可将 Box 文档集成到 LLM 工作流中,并提供四种数据提取方法。

- 这些 Reader 通过 CCG 或 JWT 进行身份验证,并允许在 LLM 中加载、搜索和检索 Box 文件及元数据。

- RealtimeSTT 与 Faster-Whisper 集成:OpenInterpreter 现在使用 RealtimeSTT 和 Faster-Whisper 进行实时语音转文本,提供实时性能。

- 这一集成增强了 OpenInterpreter 的可用性,特别是在性能较低的设备上。

5. 模型部署与集成

- Mojo 基准测试与性能:一位成员质疑为什么 Mojo benchmarks 只与 C 进行对比,建议增加与 Go 和 Rust 的对比。

- 讨论强调了为了更广泛的发布,需要一个具有 RHEL 8 最低内核要求的静态链接构建。

- 在外部硬盘运行 LM Studio:用户可以通过重新定位目录或使用符号链接,从外部硬盘运行 LM Studio。

- 这种灵活性解决了空间限制问题,使得管理大型模型文件变得更加容易。

GPT4OMini (gpt-4o-mini-2024-07-18)

1. Grok-2 与模型性能

- Grok-2 占据领先地位:由 x.ai 发布的 Grok-2 在 LMSYS leaderboard 上超越了 Claude 3.5 Sonnet 和 GPT-4-Turbo,展示了其在对话、编程和推理方面的先进能力。

- 该模型此前被称为 sus-column-r,目前处于 Beta 测试阶段,很快将通过 x.ai’s enterprise API 提供。

- AgentQ 声称获胜:来自 Infer 的新模型 AgentQ 声称其性能优于 Llama 3 70B BASE 达 340%,尽管它并未与 Claude 3 等更新的模型进行对比。

- 这一大胆的声明引发了关于其潜在影响以及缺乏相关能力证明文档的讨论。

2. 量化技术与模型合并策略

- HQQ+ 增强量化模型:HQQ+ 允许在量化模型上微调额外的 LoRa 适配器层,显著提高了 Llama2-7B 等模型的准确性。

- 该技术在 1-bit 和 2-bit 量化模型中均显示出卓越的效果,引发了关于其在各种项目中实现的讨论。

- Mistral 与模型合并策略:成员们讨论了 Mistral 面临的挑战,特别是其在没有持续预训练的情况下无法扩展超过 8k 上下文的限制,这是一个已知问题。

- 提出了关于合并策略的建议,包括应用 UltraChat 与基础 Mistral 之间的差异来提升性能。

3. 开源工具与社区贡献

- LlamaIndex Box Reader 集成:LlamaIndex 现在集成了 Box Readers,允许将 Box 文档无缝整合到 LLM 工作流中,并提供多种数据提取方法。

- 鼓励社区成员为这一集成做出贡献,增强 LlamaIndex 在文档处理方面的功能。

- OpenEmpathic 项目寻求贡献者:Open Empathic 项目正在寻找贡献者以扩展其类别,特别是在涉及用户生成内容的低端类别。

- 分享了一个关于如何贡献的教程视频,指导用户从 YouTube 贡献他们喜欢的电影场景。

4. AI 模型的局限性与改进

- Vision 的性能问题:用户对 Vision 无法准确检测简单任务(例如主体是向左看还是向右看)表示沮丧,突显了其局限性。

- 分享了 Vision 未能正确识别的畸形图像示例,引发了对其在关键应用中可靠性的担忧。

- 通过 Prompt Engineering 提高一致性:一位用户通过优化其 Prompt 以请求完整的命令列表,成功提高了 OpenAI 响应的一致性,实现了 100% 的准确率。

- 这强调了清晰且具体的 Prompt 在最大化模型性能方面的重要性。

5. AI 安全与伦理考量

- 用于 AI 安全测试的 RedOps 平台:RedOps 平台已被开发用于通过模拟真实攻击来评估 chatbots 和 voicebots 的安全性,从而发现漏洞。

- 这一举措强调了针对 AI 系统中的对抗性输入和社会工程学采取强大安全措施的必要性。

- AI 版权讨论趋势:关于 AI 版权的讨论表明,持续的论述可能会导向寡头垄断,特别是在即将举行的 ACL2024NLP 等会议的背景下。

- 这一评论反映了人们对伦理实践和 AI 治理未来格局日益增长的关注。

PART 1: High level Discord summaries

Unsloth AI (Daniel Han) Discord

- Hermes 2.5 超越 Hermes 2:在添加了代码指令示例后,Hermes 2.5 在各项基准测试中的表现似乎优于 Hermes 2。

- Hermes 2 在 MMLU 基准测试中得分为 34.5,而 Hermes 2.5 得分为 52.3。

- Mistral 的 8k 限制:成员们表示,如果不进行持续预训练(continued pretraining),Mistral 无法扩展到 8k 以上,且这是一个已知问题。

- 他们指出,性能的下一个前沿在于 mergekit 和 frankenMoE finetuning 的进一步工作。

- 模型合并策略引发讨论:一位成员建议将 UltraChat 和基础 Mistral 之间的差异应用到 Mistral-Yarn 上,作为一种潜在的合并策略。

- 其他人表示怀疑,但该成员保持乐观,并引用了过去在他们所谓的“诅咒模型合并”(cursed model merging)方面的成功尝试。

- Open Empathic 寻求贡献者:一位成员呼吁帮助扩展 Open Empathic 项目的类别,特别是低端类别。

- 他们分享了一个关于 Open Empathic 发布与教程的 YouTube 视频,指导用户从 YouTube 视频中贡献自己喜欢的电影场景,以及 OpenEmpathic 项目本身的链接。

- HQQ+ 助力量化模型:HQQ+ (High Quantization Quality Plus) 允许在量化模型上微调额外的 LoRa 适配器层,以提高其准确性和能力。

- 该技术在 1-bit 和 2-bit 量化模型中都显示出显著改进,特别是对于像 Llama2-7B 这样的小型模型。

Nous Research AI Discord

- X 发布 Grok-2 Beta 版:X 宣布发布 Grok-2 测试版,这是一款具有最先进推理能力的新 AI 模型。

- 该模型是 AI 推理领域的一个重大进步,可能会对行业产生重大影响。

- 在 ComfyUI 中使用 FLUX AI 放大图像:一个 YouTube 视频演示了如何在 ComfyUI 界面中使用 FLUX AI 放大图像。

- 开源大语言模型入门:2024 年 7 月的一次演讲对 开源大语言模型(open source large language models) 进行了易懂的介绍。

- 演讲涵盖了 AI 工作原理的基础知识,以及开源模型如何改变 AI 开发的格局。

- 语义分块被高估了:X 上的一位用户认为语义分块(semantic chunking)被高估了,强大的 regex 可以在不需要复杂语言模型的情况下准确分割文本。

- 他们声称其 50 行、2490 个字符的 regex 在 regex 的限制范围内已经尽可能强大,并且比语义分块更快、更具成本效益。

- Jina AI 的免费 Tokenizer API:Jina AI 提供了一个免费的 API 来对文本进行 Tokenize 并将长文本分割成块(chunks)。

- 该 API 利用结构线索和启发式方法,确保将文本准确分割成有意义的块,即使是对于 Markdown、HTML 和 LaTeX 等复杂的文本格式。

Stability.ai (Stable Diffusion) Discord

- AMD GPU 安装指南:一位成员询问在 AMD GPU 上运行 Stable Diffusion 的情况,并获知 GitHub 上有针对 NVIDIA 和 AMD 显卡的安装指南。

- 指南提供了在不同硬件配置上设置 Stable Diffusion 的详细说明。

- 多图生成的 ControlNet 链式调用:一位用户寻求在单次生成中使用多个 ControlNet 的帮助。

- 几位成员建议在 ComfyUI 中将它们链接起来,或者使用一个可以输入多个 ControlNet 的节点。

- ComfyUI vs InvokeAI:速度与控制:一位成员表示相比 Automatic1111 (InvokeAI),他们更喜欢 ComfyUI,理由是 ComfyUI 提供了更高的控制力和速度。

- 他们强调了 ComfyUI 直观的界面和强大的功能,使其成为用户的热门选择。

- SD3 vs Flux:优缺点:一位新用户询问了 SD3 与 Flux 相比的优缺点,指出 SD3 仍处于开发阶段,缺乏完整的功能。

- 另一方面,Flux 也有自己的怪癖和局限性,选择取决于个人需求和偏好。

- SDXL vs SD 1.5:新特性与差异:一位成员要求澄清什么是 SDXL 1.0 以及它与 SD 1.5 有何不同。

- 对话可能围绕 SDXL 的新特性和功能展开,例如改进的图像质量和更大的模型尺寸。

OpenRouter (Alex Atallah) Discord

- AgentQ 是一款游戏规则改变者:来自 Infer 的新模型 AgentQ 声称其表现优于 Llama 3 70B BASE 340%,但并未将其与 3.1, 405b, Mistral Large 2 或 Claude 3 等较新模型进行对比。

- 尽管未考虑 OpenRouter revenue,Infer 已在此处发布了关于 AgentQ 的研究论文 此处。

- ChatGPT-4o-Latest 只是一个新的别名:ChatGPT-4o-Latest 只是 gpt-4o-2024-08-06 的新名称,该模型已存在于 OpenRouter 上。

- 然而,关于该模型针对 ChatGPT 的优化以及缺乏适当文档的问题,困惑依然存在。

- Grok 2 攀升至排行榜第三名:xAI 模型的早期版本 Grok 2 已占据 LMSys Arena leaderboard 的第 3 位。

- 它在 Coding、Hard Prompts 和 Math 方面表现出色,甚至在排行榜上与 GPT-4o 持平。

- Anthropic 的 Prompt Caching:重新定义效率:Anthropic 为其 Claude 3 models 引入了 prompt caching 功能。

- 该功能可为长提示词降低高达 90% 的成本和 85% 的延迟,并有可能集成到 OpenRouter 中。

Modular (Mojo 🔥) Discord

- Mojo 基准测试:对比的疑问:一位成员质疑为什么 Mojo benchmarks 仅与 C 语言对比,并询问是否可以与 Go 和 Rust 进行基准测试。

- 另一位成员建议目前将 Magic CLI 视为这些问题的解决方案,并且具有 RHEL 8 最低内核要求的静态链接构建可能比 RPM 更好,因为它可以允许在其他发行版上进行打包。

- Mojo 的多线程困境:Mojo 目前为了性能采用单线程,但除了使用 MAX 启动并行内核外,还没有良好的多线程 API。

- 一位成员询问 Mojo 是否有支持多进程或改进网络处理的计划,因为网络性能对他们的工作至关重要。

- Mojo vs Go/Rust:网络速度与性能:一位成员询问 Mojo 在网络速度方面是否比 Go 更快,以及它是否能像 Rust 一样处理繁重任务。

- Mojo 的 MAX 平台:揭开神秘面纱:一位成员质疑 MAX 的本质,不确定它是一个平台、模块还是其他东西。

- 另一位成员解释说 MAX 是一个平台,Mojo 是其组件之一,它还包括 GPU、graph API 和其他组件。

- Mojo RPM 构建:寻求流畅的 RHEL 体验:一位成员询问 Mojo .rpm 构建的预计发布时间 (ETA),表达了在没有 containerd 的 RHEL 机器上运行 Mojo 的愿望。

- 他们承认这可能是一个合适的首步。

OpenAI Discord

- Gemini Advanced:实时对话功能在哪?:一位购买了 Gemini Advanced 的用户在应用中找不到实时对话选项。

- 其他用户推测其处于 Alpha 测试阶段,将像之前 OpenAI 模型发布一样逐步扩大推广范围。

- Vision 的性能挣扎:一位用户对 Vision 在检测主体是向左看还是向右看时的糟糕表现感到惊讶。

- 他们甚至提供了一张高度变形的图像,但 Vision 声称其完全正常,这突显了在识别图像变形方面的局限性。

- 针对批判性思维的 Prompt Engineering:一位成员正在构建一个综合提示词,结合了 Socratic Method、Bloom’s Taxonomy 和 Scientific Method 等批判性思维方法。

- 他们还整合了 TRIZ、演绎和归纳推理、Fermi estimation 等,旨在创建一个鼓励批判性思维的提示词。

- GPTs 和 Web Search:Web Browser GPT:一位成员询问了 webbrowsergpt,这是一个专门为网页搜索设计的 GPT,可在 “Explore GPTs” 部分访问。

- 这个 GPT 可以提供比手动指示通用 GPT 搜索网页更好的搜索结果。

- 自定义 GPT 训练问题:一位用户报告称,他们的自定义 GPT 模型没有记住训练期间指定的所有规则和单词。

- 其他用户推测这可能是由于超过了 context token limit,或者是故意的模型限制,但目前尚不清楚。

Perplexity AI Discord

- Perplexity 面临用户对其网站性能的投诉:用户在 Perplexity 上遇到了严重的延迟和响应缓慢,尤其是 Perplexity Pro 用户。

- 这些问题甚至让一些用户质疑 Perplexity 是否能取代 Sonnet 或 Opus 作为他们的默认搜索引擎,凸显了为了维持用户满意度而迅速解决问题的必要性。

- Perplexity Pro 饱受延迟困扰:付费的 Perplexity Pro 用户报告了响应时间缓慢,甚至服务完全停滞的情况。

- 这些投诉强调了用户对付费产品提供更可靠、响应更迅速服务的期望,给 Perplexity 带来了及时解决这些问题的压力。

- Perplexity 网站更新引发褒贬不一的反应:Perplexity 团队成员确认正在努力修复 Bug 和问题,包括一个影响网站切换开关(toggles)的 Bug。

- 然而,许多用户仍对性能问题感到沮丧,并要求回滚到之前的版本,这凸显了在开发过程中进行全面测试和收集用户反馈的必要性。

- Perplexity 支持团队应对工作量增加:Perplexity 的支持团队正面临关于近期网站更新的用户反馈和报告激增。

- 用户对团队的工作量表示担忧,并敦促他们优先解决问题,同时也认识到维持支持团队健康的工作与生活平衡的重要性。

- API 用户寻求 HTML 格式的响应:Perplexity API 用户正在寻求一致的 HTML 格式响应,并尝试通过各种 System Prompts 来实现。

- 有建议提出利用

markdown2模块进行 HTML 转换,从而消除对 Prompt Engineering 的需求并确保一致的 HTML 输出。

- 有建议提出利用

LM Studio Discord

- Gemma-2 表现出色,但缺少 System Prompt:Gemma-2 模型在其尺寸级别是一个很好的选择,但缺少一个关键组件:System Prompt。

- 这使得它容易偏离用户指令,尽管在其他方面它的表现相当不错。

- Android 版 LM Studio 尚不可用:有用户询问是否有可以连接到 LM Studio server 的 Android app。

- 目前还没有这样的应用。

- LM Studio 可以从外部驱动器运行:用户询问是否可以从外接硬盘运行 LM Studio。

- 建议用户可以迁移 LM Studio directory,或使用符号链接(symbolic link)连接到另一个驱动器,甚至是网络驱动器。

- LM Studio 是桌面应用程序,而非 Headless 模式:用户想知道运行 LM Studio 是否需要 GUI OS。

- 虽然 LM Studio 是桌面应用,但用户可以设置 VNC server 或寻找变通方法使其在 Ubuntu 上运行,尽管它并非为 headless 使用而设计。

- LM Studio 可以加载多模态模型:用户询问 LM Studio 是否可以托管多模态 LLM server。

- 虽然 LM Studio 不能生成图像,但它可以加载能够处理图像数据的模型,从而有效地使其成为多模态 LLM。

Latent Space Discord

- Pliny 要求 MultiOn System Prompt:知名 AI 研究员 Pliny 威胁称,如果 DivGarg9 不在 15 分钟内给出答复,他将在 GitHub 上泄露完整的 MultiOn System Prompt。

- 此举源于 Twitter 上关于各种 AI 模型能力及其在特定 Benchmark 上表现的持续争论。

- AnswerAI ColBERT:小模型,大成果:AnswerAI 发布了一个小巧但强大的 ColBERT 模型版本,名为 answerai-colbert-small-v1,在 BEIR Benchmark 中甚至击败了 bge-base。

- 这证明了较小模型在完成特定任务时实现高性能的有效性,可能提供更具成本效益的解决方案。

- Gemini Live 演示遭吐槽:Swyxio 在 YouTube 上批评了 Google 的 Gemini Live 演示,认为其“令人尴尬 (cringe)”。

- 随后引发了关于 Gemini 潜力的讨论,一些人强调其增强语音助手的能力,而另一些人则保持怀疑。

- GPT-4o 在 Chatbot Arena 中表现优于 Gemini:OpenAI 最新的 GPT-4o 模型在 Chatbot Arena 中进行了测试,整体表现已超越 Google 的 Gemini-1.5-Pro-Exp。

- 新的 GPT-4o 模型在技术领域表现出显著进步,特别是在 Coding、Instruction-following 和 Hard Prompts 方面,巩固了其在排行榜首位的地位。

- Grok 2 亮相,能力惊人:xAI 发布了 Grok-2 的早期预览版,这是对其前代模型 Grok-1.5 的重大突破,展示了在 Chat、Coding 和 Reasoning 方面的能力。

- Grok-2 已在 LMSYS 排行榜上进行了测试,表现优于 Claude 3.5 Sonnet 和 GPT-4-Turbo,尽管目前尚未通过 API 提供。

Interconnects (Nathan Lambert) Discord

- Grok-2 成为新王者:Grok-2,来自 x.ai 的新模型,已在 𝕏 开启 Beta 测试,在 LMSYS 排行榜上超过了 Claude 3.5 Sonnet 和 GPT-4-Turbo。

- 这个新模型目前可供 Beta 测试,随着它在 AI 领域获得关注,其后续表现值得期待。

- Anthropic API:更便宜、更快速,但仍有待完善:Anthropic 的 API 引入了 Prompt Caching,将 API 输入成本降低了高达 90%,延迟降低了高达 80%。

- 虽然这一进步值得赞赏,但该 API 仍面临挑战,包括 API 响应慢以及缺乏 Projects & Artifacts API。

- Anthropic 从尴尬到尖端的华丽转身:Anthropic 已从一个不太受欢迎的组织转型为被视为该领域领导者的组织。

- 他们对创新和 Prompt Caching 的承诺为他们在 AI 社区赢得了新的尊重。

- GPT-4o 获得优化:OpenAI 改进了 GPT-4o 模型,发布为

gpt-4o-latest,并表示在进行长期研究的同时,将继续迭代现有模型。- 这个新模型现在可以通过 ChatGPT API 获取,定价目前尚未公布。

- AI 版权讨论与寡头垄断:一位用户分享了 @asayeed 的推文链接,该推文认为 AI 版权讨论正走向寡头垄断。

- 这一观察是在 #ACL2024NLP 的背景下提出的,暗示这可能是即将举行的会议上的热门讨论话题。

LlamaIndex Discord

- LlamaIndex Box Reader 集成:LlamaIndex 现在提供 Box Readers,可将 Box 文档无缝集成到您的 LLM 工作流中。

- 这些 Reader 提供四种数据提取方法,通过 CCG 或 JWT 进行身份验证,并允许您在 LLM 中加载、搜索和检索 Box 文件及其元数据。

- 使用 Relik 构建知识图谱:Relik 是一个用于快速、轻量级信息提取模型的框架,它简化了知识图谱的构建,无需昂贵的 LLM。

- 了解如何设置实体提取流水线并使用 Relik 创建知识图谱。

- 使用 Azure AI Search 构建鲁棒的 RAG 系统:LlamaIndex Workflows 现在可以与 Azure AI Search 和 Azure OpenAI 集成,以构建鲁棒的检索增强生成 (RAG) 系统。

- 了解如何为 Azure AI Search 实现自定义数据连接器,并使用 LlamaIndex Workflows 创建强大的 RAG 系统。

- 不一致的 OpenAI 响应 - 针对一致性的 Prompt Engineering:一位用户遇到了 OpenAI Prompt 结果不一致的问题,模型有时即使可以回答问题也会给出否定答案。

- 该用户通过要求提供完整的命令列表成功改进了 Prompt,实现了 100% 的准确率,凸显了清晰的输出格式对 LLM 的重要性。

astream_chat()函数中的 LlamaIndex Agent 和 Tool Calls:一位用户寻求关于在 LlamaIndex Agent 中处理 Tool Calls 的指导,特别是在使用astream_chat()函数时。- 讨论得出结论,Tool Calls 应首先在 LLM 响应的

message.tool_calls字段中发送,以确保在 Agent 中正确处理 Tool Calls。

- 讨论得出结论,Tool Calls 应首先在 LLM 响应的

Cohere Discord

- Grok 2 发布,开启招聘热潮:xAI 正式发布了 Grok 2,这是一款此前在 LMSYS chatbot arena 上被称为 sus-column-r 和 column-r 的新语言模型。

- xAI 正在为其后训练团队积极招聘,强调了他们构建有用且真实的 AI 系统的愿望。

- Cohere Toolkit 安装困难:一位用户在尝试为其本地安装的 Cohere Toolkit 添加 OpenAI 的自定义部署时遇到了困难。

- 尽管遵循了概述的步骤,自定义部署仍未出现在 UI (localhost:4000) 或 Postgres 容器数据库的 ‘deployment’ 表中。

- Rerank API 故障排除:一位用户尝试利用 Cohere 文档中的 Rerank 概览文档,但遇到了错误 “unknown field: parameter model is not a valid field”。

- 他们尝试重启内核并抑制警告,但未能解决该问题。

- 企业搜索聊天机器人开发:一位用户正在构建一个“企业搜索聊天机器人”应用程序,以访问存储在 Confluence 中的公司数据。

- 他们是 Fellowship.ai 最新一批学员的一员,将此项目用于研究和学习。

LangChain AI Discord

- LangChain 用户希望获得更多支持:一位成员对 LangChain 论坛中基础问题(特别是与 LangGraph 和 LangSmith 相关的问题)缺乏及时支持表示担忧。

- 他们还指出,许多通用支持问题被发布在 LangChain Discord 服务器上,而其他论坛中的相关请求却无人问津。

- LangSmith Plus:是否可以访问 LangGraph Cloud?:一位成员询问 LangSmith Plus 用户是否将获得 LangGraph Cloud 的访问权限。

- 未提供答案。

- LangChain Postgres 库与缓存详解:一位成员询问关于将

langchain_postgres库与set_llm_cache(一种缓存 LLM 结果的方法)结合使用的问题。- 他们被告知虽然没有

langchain_postgres库,但可以使用langchain_community.cache模块中的SQLAlchemyCache类将 LLM 结果缓存到 PostgreSQL 数据库中。

- 他们被告知虽然没有

- Rubik’s AI 提供 2 个月免费高级版:Rubik’s AI 是一个提供 GPT-4o、Claude-3 Opus 和 Mistral Large 等模型的平台,目前正提供 2 个月的免费高级访问权限。

- 用户可以在 signup.php 使用促销代码 RUBIX 领取此优惠。

- RedOps 平台应对 AI 安全担忧:一个团队开发了 RedOps,这是一个旨在通过故意尝试破坏聊天机器人和语音机器人来评估其安全性的平台。

- 该倡议强调了 AI 模型容易受到对抗性输入和社交工程操纵的脆弱性,强调了对鲁棒安全措施的迫切需求。

Torchtune Discord

- Torchtune 需要更小的模型来进行 PPO 全量微调 (Full Finetune):一位成员尝试在

NF4+compile下使用lora_dpo_single_devicerecipe,并建议优先考虑其他 recipe,例如ppo_full_finetune_single_device。- 他们请求一个能放入 16GB GPU 的更小模型,并建议将 Qwen2-1.5B 作为该 recipe 的合适选项。

- Torchtune 的 CPU Offload 优化器和 Torchao 依赖:一位成员询问 Torchtune 如何处理 Torchao 版本依赖,因为 CPU offload 优化器已包含在 Torchao main 分支中,并计划在下个版本发布。

- 他们提议将 CPU offload 代码的副本合并到 Torchtune 中,并在 Torchao 实现可用时再行调用。

- 使用 TinyLlama 1B 实现高效的 Torchtune PPO 全量微调:鉴于 Llama2 分类器的可用性,一位成员建议在 PPO 全量微调 recipe 中使用 TinyLlama 1B(或 0.5B)。

- 他们提供了 GitHub 上 1B 配置的链接,并建议调整 batch sizes 以进行内存优化。

OpenAccess AI Collective (axolotl) Discord

- 埃隆·马斯克的 Grok 2 表现卓越:Grok 2 是来自埃隆·马斯克 x.ai 的新语言模型,已发布早期预览版,并因其在聊天、编程和推理方面的“前沿能力”而备受推崇。

- Grok 2 在 LMSYS 排行榜上被称为 “sus-column-r”,其 Elo 分数高于 Claude 3.5 Sonnet 和 GPT-4-Turbo。

- Fineweb-Edu 数据集现已强化 (Fortified):可在 Hugging Face 上获取的 Fineweb-Edu 数据集已通过删除重复数据和添加 embeddings 进行了强化。

- 它现在被称为 Fineweb-Edu-Fortified,并包含一个

count列,指示文本在数据集中出现的次数。

- 它现在被称为 Fineweb-Edu-Fortified,并包含一个

- Mistral Large 2 仍在开发中:一位用户询问 Mistral Large 2 是否已经完成训练。

- 回复指出该模型尚未完成训练。

- axolotl 模型加载:

load_model标志和and False条件解析:一位用户询问在加载模型时,为什么axolotl/utils/models.py文件中使用了and False条件。- 该条件用于确保如果

load_model标志设置为False,则不会加载模型。

- 该条件用于确保如果

- OpenAI Chat 端点 - 无法继续 Assistant 响应:一位用户询问是否可以使用官方 OpenAI chat 端点继续完成部分生成的 assistant 响应。

- 回复指出,虽然他们在继续本地模型响应方面取得了成功,但 OpenAI 的 chat 端点始终会阻止 assistant 响应的继续生成。

LAION Discord

- Grok-2 表现优于 GPT-4 和 Claude:x.ai 发布了 Grok-2,该模型比 Grok-1.5 强大得多,在聊天、编程和推理方面具备前沿能力。

- Grok-2 的早期版本(代号 “sus-column-r”)已在 LMSYS 排行榜上进行了测试,目前其表现优于 Claude 3.5 Sonnet 和 GPT-4-Turbo。

- Grok-2:公开和企业测试版:Grok-2 和 Grok-2 mini 目前在 𝕏 上处于测试阶段,并将于本月晚些时候通过 x.ai 的企业级 API 提供。

- x.ai 很快将发布多模态理解 (multimodal understanding) 预览版,作为 𝕏 和 API 上 Grok 体验的核心部分。

- 需要开源图像标注 GUI:一位成员正在寻求推荐,以获取能够快速高效标注图像的优秀开源 GUI。

- 他们特别感兴趣的是支持单点标注、直线标注和绘制多边形分割掩码 (polygonal segmentation masks) 的 GUI。

- 埃隆·马斯克与开发者许可证:关于埃隆·马斯克可能使用开发者许可证并挑战权重许可证 (weight licenses) 的讨论。

- 对话围绕埃隆·马斯克利用开发者许可证来潜在规避权重许可证限制的想法展开。

- Schnelle 的付费功能:一位成员提到软件工具 Schnelle 的专业功能可能需要付费订阅。

- 他们还指出 Schnelle 的定价结构对于价格敏感型用户可能并不理想。

tinygrad (George Hotz) Discord

- ConvTranspose2D 支持 3D 数据:一位用户对如何在

tinygrad中将ConvTranspose2D用于 3D 数据感到困惑,但它确实有效!- 问题在于

kernel_size应该作为一个长度为 3 的元组传递,而不是一个整数,例如kernel_size=(3, 3, 3)。文档应该进行改进以澄清这一点。

- 问题在于

- CLANG=1 和 LAZYCACHE 导致的 Tinygrad 错误:一位用户报告在 GPU (3070ti) 上运行 Tinygrad 并使用

CLANG=1执行Tensor.zeros操作时出现RuntimeError: wait_result: 10000 ms TIMEOUT!错误,但在CUDA=1下运行正常。- 该错误可能与 Tinygrad 中的 LAZYCACHE 功能有关,一位用户建议该功能“容易出错(bug prone)”,并建议将其删除并在 schedule 中进行去重。

OpenInterpreter Discord

- OpenInterpreter Pip 发布:昨晚向 pip 推送了新版本的 OpenInterpreter。

- 下一个重大更新“开发者更新(the developer update)”仍在开发中,包含许多新的实用功能。

- 本地 LLM 非常耗能:本地 LLM 需要大量的处理能力。

- 建议在云端运行 LLM,特别是对于使用默认设置的 OpenInterpreter。

- RealtimeSTT 与 Faster-Whisper 集成:OpenInterpreter 现在使用 RealtimeSTT,它依赖于 Faster-Whisper 进行实时语音转文本。

- 这种组合为大多数用户提供了实时性能,并且在性能较低的设备上尚未出现问题。

- Obsidian 插件与万物互转(Anything-to-Anything):分享了一个 YouTube 视频,展示了在 Obsidian 中使用 Open Interpreter 进行万物互转。

- 该视频推广了使用 Open Interpreter Obsidian 插件来控制 Obsidian 库,并展示了其转换各种数据类型的能力。

- 工具使用周二(Tool Use Tuesday)与视频制作:一位用户提到计划为一个涉及使用 Open Interpreter 和 Obsidian 的竞赛制作视频演示。

- 他们还提到探索向量搜索并使用 Manim 来可视化有向图(digraphs),表明重点在于提高视频制作技能并利用“工具使用周二”这一主题。

MLOps @Chipro Discord

- Poe 的 Previews 黑客松:Poe 正与 @agihouse_org 合作举办 Previews 黑客松,参与者可以竞争创造创新且实用的聊天内生成式 UI 体验。

- 黑客松面向所有创作者开放,更多信息请访问 https://app.agihouse.org/events/poe-previews-hackathon-20240817。

- Modal Labs:最佳微调平台:一位成员认为 Modal Labs 是微调开源 LLM 的最佳平台。

- 这表明 Modal 为开发大语言模型的开发者提供了宝贵的工具和资源。

- 图像特征存储加速训练:为一个 R&D 团队构建了一个简单的特征存储(feature store),用于存储在线预处理期间从图像中提取的特征。

- 这使每次训练运行的时间减少了 30-60 分钟,为模型开发节省了大量时间。

- 适用于多样化模型的通用特征存储:该特征存储是通用的,处理图像 ID、提取方法以及指向对象存储中提取特征的指针。

- 这使其能够容纳从小型到大型的各种模型,确保高效的特征存储和检索。

DiscoResearch Discord

- Mistral 难以扩展超过 8k:成员们表示,如果不进行持续预训练(continued pretraining),Mistral 无法扩展到 8k 以上,这是一个已知问题。

- 他们指出,mergekit 和 frankenMoE finetuning 的进一步工作是性能的下一个前沿。

- 关于模型合并策略的讨论:一位成员建议将 UltraChat 和基础 Mistral 之间的差异应用到 Mistral-Yarn,作为一种潜在的合并策略。

- 其他人表示怀疑,但该成员保持乐观,并引用了过去在他们称之为“诅咒模型合并(cursed model merging)”方面的成功尝试。

LLM Finetuning (Hamel + Dan) Discord

- 自动化 Jupyter Notebook 探索:一位成员询问了关于现有库或开源项目的信息,这些项目可以帮助构建一个自动化修改 Jupyter Notebook 的系统。

- 目标是创建一个 Agentic 流水线,用于交换单元格、生成变体并验证输出,类似于 Devin 项目,但专注于特定的微小任务。

- Jupyter Notebook 自动化:游戏规则改变者:提议的系统将以一个正在运行的 Jupyter Notebook 作为输入,并通过交换单元格对其进行修改。

- 这一自动化过程将生成多个版本,从而能够高效地探索不同的 Notebook 配置,并可能带来更好的结果。

Alignment Lab AI Discord 没有新消息。如果该服务器沉寂时间过长,请告知我们,我们将将其移除。

Mozilla AI Discord 没有新消息。如果该服务器沉寂时间过长,请告知我们,我们将将其移除。

AI21 Labs (Jamba) Discord 没有新消息。如果该服务器沉寂时间过长,请告知我们,我们将将其移除。

第 2 部分:渠道详细摘要与链接

完整的频道细分内容已针对电子邮件进行截断。

如果您喜欢 AInews,请分享给朋友!预谢!