ainews-aiphone-16-the-visual-intelligence-phone

AIPhone 16:视觉智能手机

苹果发布了全新的 iPhone 16 系列,其特色是“视觉智能”(Visual Intelligence)。这是一种集成了相机控制、苹果地图和 Siri 的新 AI 功能,强调隐私保护,并优先使用默认服务而非 OpenAI 等第三方 AI。苹果照片(Apple Photos)现在包含先进的视频理解功能,支持时间戳识别。与此同时,Reflection-70B 声称是顶级的开源模型,但基准测试显示其性能接近 Llama 3 70B,且略逊于 Qwen 2 72B。Yann LeCun 强调了大型语言模型(LLM)在规划能力方面面临的持续挑战,并指出 Llama-3.1-405b 和 Claude 等模型表现出了一定的能力,而 GPT-4 和 Gemini 则相对落后。Weights & Biases 正在赞助一项旨在推进 LLM 评估技术的活动,并提供奖金和 API 访问权限。

Apple Intelligence 或许就是你所需的一切。

2024年9月6日至9月9日的 AI 新闻。我们为你查看了 7 个 subreddits、384 个 Twitter 账号 和 30 个 Discord 服务(215 个频道,7493 条消息)。预计节省阅读时间(以 200wpm 计算):774 分钟。你现在可以标记 @smol_ai 进行 AINews 讨论了!

在今天的 Apple 特别活动 中,新款 iPhone 16 系列正式发布,同时花费了 5 分钟 介绍了 Apple Intelligence 的一些更新(我们假设你已经跟进了我们关于 WWDC 和 Beta 版本 的报道)。

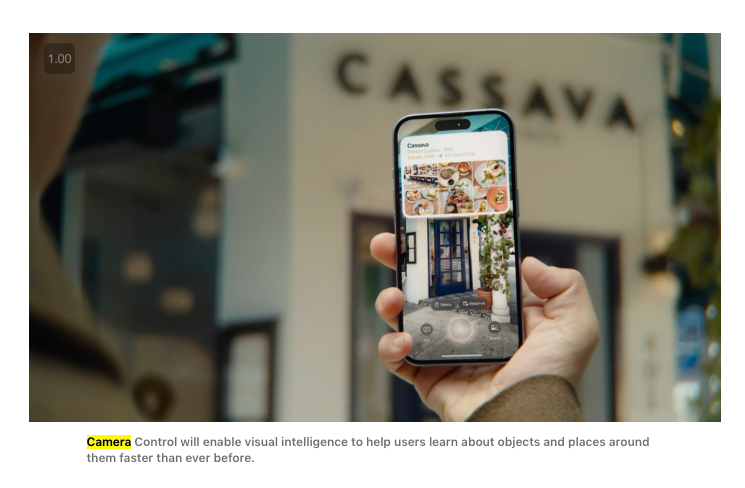

最新的更新是他们现在称之为 Visual Intelligence 的功能,随 iPhone 16 新增的专用 Camera Control 按钮一同推出:

正如在 Winds of AI Winter 播客 中讨论并现已得到证实的那样,Apple 正在将 OpenAI 商品化,并将自己的服务放在首位:

据推测,用户最终将能够在新的 UI 中配置 Ask 和 Search 按钮调用的内容,但每个 Visual Intelligence 请求都会首先通过 Apple Maps 和 Siri 运行,然后才是那些第三方服务。Apple 在这里通过抢先运行、作为默认选项以及保证私密/免费而获胜,这出人意料地比追求“最强”更具防御性。

Apple Photos 现在也具备了非常出色的视频理解能力,甚至可以精确到视频中的时间戳:

Craig Federighi 在他的环节中称这是 Apple Intelligence 的一部分,但其中一些功能已经出现在 iOS 18.0 beta 中(Apple Intelligence 仅在 iOS 18.1 中发布)。

你可以阅读 Hacker News 的评论 了解其他亮点和愤世嫉俗的观点,但这就是今天最重大的必知事项。

还要过多少年,Apple Visual Intelligence 才会变成……始终开启?

关于 Reflection 70B 的说明:我们上周的报道(以及 Twitter 评论)涵盖了周五已知的批评,但周末出现了更多质疑其主张的证据。我们预计本周会有更多进展,因此现在将其作为另一个标题故事还为时过早,但感兴趣的读者可以滚动到下方的 /r/localLlama 部分查看完整说明。

也许我们应该致力于开发更多不可作弊的 LLM evals?好消息是,本月的推理支持由我们的朋友 W&B 提供……

由 Weights & Biases 赞助:如果你是湾区的开发者,在 9月21/22日,Weights & Biases 邀请你与他们一起黑客马拉松,推动 LLM-evaluators 现状 的发展。在 W&B Judgement Day hack 中构建更好的 LLM Judges —— 5000 美元奖金,提供 API 访问和食物。

AI Twitter 摘要

所有摘要均由 Claude 3.5 Sonnet 完成,取 4 次运行中的最佳结果。

AI 模型进展与基准测试

-

Reflection-70B 的宣称:@JJitsev 报道称,Reflection-70B 声称根据通用基准测试,它是“全球顶尖的开源模型”。然而,使用 AIW 问题的初步测试显示,该模型接近 Llama 3 70B,且略逊于 Qwen 2 72B,并未达到其宣称的顶尖性能。

-

LLM 规划能力:@ylecun 指出 LLM 在规划方面仍然面临困难。Llama-3.1-405b 和 Claude 在 Blocksworld 上表现出一定的规划能力,而 GPT4 和 Gemini 表现不佳。所有模型在 Mystery Blocksworld 上的表现都被描述为“极其糟糕”。

-

PLANSEARCH 算法:@rohanpaul_ai 重点介绍了一种名为 PLANSEARCH 的用于代码生成的搜索算法。它生成多样化的观察结果,以自然语言构建计划,并将有前景的计划转化为代码。Claude 3.5 使用该方法在 LiveCodeBench 上实现了 77.0% 的 pass@200,优于无搜索基准。

AI 工具与应用

-

RAG 流水线开发:@dzhng 报告称,使用 Cursor AI composer 在不到一小时内编写了一个 RAG 流水线,并使用 Hyde 和 Cohere reranker 进行了优化,期间没有编写一行代码。整个过程是通过语音听写完成的。

-

Google AI 的 Illuminate:@rohanpaul_ai 提到 Google AI 发布了 Illuminate,这是一个将研究论文转换为短播客的工具。用户可能需要等待几天。

-

Claude 对比 Google:@svpino 分享了一次经历:在尝试使用 Google 解决一个问题数小时未果后,Claude 在 5 分钟内就提供了该问题的分步指导。

AI 研究与进展

-

AlphaProteo:@adcock_brett 报道了 Google DeepMind 推出的 AlphaProteo,这是一个 AI 系统,旨在创建用于与特定分子靶点结合的定制蛋白质,有望加速药物发现和癌症研究。

-

AI 驱动的研究助手:@LangChainAI 分享了一个先进的 AI 驱动研究助手系统,该系统使用多个专门的 Agent 执行数据分析、可视化和报告生成等任务。它是开源的,并使用了 LangGraph。

-

顶级 ML 论文:@dair_ai 列出了本周顶级的 ML 论文,包括 OLMoE、LongCite、AlphaProteo、Role of RAG Noise in LLMs、Strategic Chain-of-Thought 以及 RAG in the Era of Long-Context LLMs。

AI 伦理与社会影响

-

移民担忧:@fchollet 对潜在的移民执法行动表示担忧,认为在某些情况下法律文件可能无法提供保护。

-

AI 的更广泛影响:@bindureddy 强调 AI 不仅仅是炒作或商业周期,他指出我们正在创造比人类更有能力的新生命,AI “远比金钱重要”。

硬件与基础设施

-

Framework 13 电脑:@svpino 提到购买了一台 Framework 13 电脑(Batch 3)用于运行 Ubuntu,在使用了 14 年 Mac 后转向了新平台。

-

Llama 3 性能:@vipulved 报告称,随着新推理引擎的发布,Llama 3 405B 在 Together API 上突破了 100 TPS 大关,在 NVIDIA H100 GPU 上达到了 106.9 TPS。

AI Reddit 摘要

/r/LocalLlama 摘要

主题 1. Reflection 70B 争议:潜在的 API 欺诈与社区抵制

-

确认:REFLECTION 70B 的官方 API 是 SONNET 3.5 (得分: 278, 评论: 168): Reflection 70B 的官方 API 已被确认为 Sonnet 3.5。这一信息与之前的推测一致,并澄清了支持这一大语言模型的技术架构。确认 Sonnet 3.5 作为 API 意味着为使用 Reflection 70B 的开发者提供了特定的功能和集成方法。

-

[OpenRouter Reflection 70B 声称自己是 Claude,由 Anthropic 创建(你可以亲自尝试)] (Score: 68, Comments: 29): 通过 OpenRouter API 提供的 Reflection 70B 模型声称自己是 Claude,并表示它是由 Anthropic 开发的。这一断言引发了人们对该模型真实身份和来源的质疑,因为 Anthropic 不太可能在不发布公告的情况下通过第三方 API 发布 Claude。建议用户亲自测试该模型以验证这些说法并评估其能力。

-

[Reflection 70B (Free) 现在已失效] (Score: 86, Comments: 25): Reflection 70B 免费 API 目前无法运行,原因可能是 Claude 额度耗尽。尝试访问该服务的用户遇到了错误,这表明底层 AI 模型可能已不再可用,或无法通过免费层级访问。

- Reflection 70B API 停机归因于 Claude 额度耗尽,用户猜测开发者的最终目的。一篇 VentureBeat 文章 曾大肆宣传 GlaiveAI 是 OpenAI 和 Anthropic 的威胁,但主流媒体尚未报道这一后续影响。

- OpenRouter 将 API 版本替换为了一个开放权重版本,名称仍为 Reflection 70B (Free)。用户质疑 OpenRouter 的审核流程,而该公司辩称其在没有进行广泛审查的情况下快速部署了模型。

- 一些用户认为这次事件与之前的 Glaive-instruct 3b 争议如出一辙,表明存在为了融资而炒作模型的模式。其他人则猜测这次损害名誉的事件背后可能存在潜在的干扰项或别有用心。

主题 2. Reflection 70B 事件带来的社区教训:AI 中的信任与验证

-

[好了,就是这个。据说是“那个东西”的新权重。] (Score: 67, Comments: 77): 该帖子暗示发布了 Reflection 70B(一个大型语言模型)的新权重。然而,正如帖子标题中谨慎且不确定的语气所暗示的那样,社区似乎对这次发布的真实性或重要性仍持高度怀疑态度。

- [Reflection 70B 的经验教训] (Score: 114, Comments: 51): 该帖子强调了 AI 研究中模型验证和基准测试怀疑论的关键重要性。它建议所有的基准测试都应该从通过仔细检查识别所使用的特定模型(例如 LLAMA、GPT-4、Sonnet)开始,并警告不要在没有亲自复制和验证的情况下信任基准测试或 API 的声明。

- 用户强调了通过 Lmarena 和 livebench 等平台验证模型的重要性,并警告不要信任来自未知来源的未经证实的说法。社区表示需要意识到人们倾向于相信突破性改进的偏见。

- 越来越多的证据表明 Matt Shumer 可能在其 AI 模型声明上撒了谎。一些人猜测这可能是由于心理健康问题,考虑到从项目构思到揭露欺诈的时间跨度非常短。

- 评论者强调了根据实际使用案例开发个人基准测试的重要性,以避免陷入炒作。他们还指出,这次事件突显了人们对开源权重模型很快就能匹配或超越专有选项的期望。

- 非凡的主张需要非凡的证据,而 Reflection 70B 显然缺乏这一点 (Score: 177, Comments: 31): 帖子标题 “Extraordinary claims require extraordinary evidence, something Reflection 70B clearly lacks” 表达了对 Reflection 70B 模型相关主张的怀疑。然而,帖子正文仅包含不完整的短语 “Extraordinary c”,未能为作者预期的论点或批评提供足够的上下文来进行有意义的总结。

- 与私有 API 相比,使用最新的 HuggingFace release 进行基准测试时,Reflection 70B 的性能显著下降。用户推测私有 API 实际上是 Claude,从而引发了对该模型声称的能力的怀疑。

- 关于 Matt Shumer 的最终目的产生了疑问,因为他最终需要交付一个可运行的模型。一些人认为他没有预料到他的主张会获得如此高的关注度,而另一些人则将此情况与 LK99 和 Elon Musk 的 FSD 承诺相提并论。

- 用户批评 Shumer 缺乏技术知识,指出他在社交媒体上询问关于 LORA 的问题。这一事件被视为可能损害他的信誉,一些人甚至将其贴上骗局的标签。

Theme 3. 围绕 Reflection 70B 争议的梗图与幽默

- 你是谁? (Score: 363, Comments: 34): 该帖子展示了一个 meme(梗图),描绘了 Reflection 70B 对“你是谁?”这一问题的回答前后不一。图像显示了该 AI 模型做出的多个相互矛盾的身份声明,包括自称是 AI language model、人类,甚至是耶稣基督。这个梗图突出了 AI 模型自我意识不一致的问题,以及它们产生关于自身身份的矛盾陈述的倾向。

- Reflection 70B 的争议引发了大量的 memes 和讨论,用户注意到随着对其真实性的怀疑增加,模型的回答从 Claude 变为 OpenAI 再到 Llama 70B。

- 一位用户建议 Reflection 背后的开发者正在利用商业 SOTA 模型收集数据进行重新训练,旨在最终交付一个能部分实现其主张的模型。其他人则对开发者的真实意图表示怀疑。

- 帖子提供了一个关于争议的详细解释,描述了该模型最初如何给用户留下深刻印象,但在发布后未能达到预期表现。调查显示,请求被转发到了热门模型(如 Claude Sonnet),导致了欺骗指控。

- 太长不看 (TL;DR) (Score: 249, Comments: 12): 该帖子仅由一张总结近期 Reflection 70B 情况的梗图组成。该梗图使用流行格式幽默地对比了模型发布的预期与现实,暗示 Reflection 70B 的实际表现或影响可能远未达到最初的炒作或预期。

- Twitter AI 社区 因过度炒作 Reflection 70B 而受到批评,并提到它实际上是在 Reddit 上接受测试的。用户指出了 /r/OpenAI 和 /r/Singularity 等子版块中的类似行为。

- 一些用户对该梗图及其创作者表示困惑或批评,而另一些人则为该发布辩护,指出它提供了免费访问与 Claude Sonnet 3.5 相当的模型的机会。

- 一位用户建议,围绕 Reflection 70B 的炒作可能是由于 OpenAI 转向 B2B SaaS,这表明开源 AI 社区渴望新的发展。

- POV : The anthropic employee under NDA that see all the API requests from a guy called « matt.schumer.freeaccounttrial27 » (Score: 442, Comments: 17):一名受 NDA 约束的 Anthropic 员工观察到一个名为 “matt.schumer.freeaccounttrial27” 的可疑账户发出的 API 请求。该用户名暗示其可能试图规避免费试用限制或进行未经授权的访问,引发了对 Anthropic API 服务中账户滥用和安全影响的担忧。

- 用户们调侃了 API 滥用的潜在后果,其中一条评论建议,随着诈骗策略的升级,身份可以从“IT 部门的 Matt”演变为“关塔那摩牢房里的 Matt”。

- 讨论帖随后转向幽默风格,出现了关于 Anthropic 雇佣猫咪的评论,包括“喵 🐱”和“作为一只猫,我可以证实这一点”等俏皮回复。

- 一些用户对该帖子本身提出了批评,有人建议发起“浪费我们时间的集体诉讼”,另一个人则指出原帖中误用了“POV”(Point of View)一词。

Theme 4. Advancements in Open-Source AI Models and Tools

- gemma-2-9b-it-WPO-HB surpassed gemma-2-9b-it-simpo on AlpacaEval 2.0 Leaderboard (Score: 30, Comments: 5):gemma-2-9b-it-WPO-HB 模型在 AlpacaEval 2.0 Leaderboard 上表现优于 gemma-2-9b-it-simpo,得分为 80.31,而后者为 79.99。这一改进证明了 WPO-HB (Weighted Prompt Optimization with Human Baseline) 技术在增强模型指令遵循任务性能方面的有效性。

- WPO (Weighted Preference Optimization) 技术在最近的一篇论文中有所详述,其中 “hybrid” 是指偏好优化数据集中包含了人工生成数据和合成数据的混合。

- AlpacaEval 2.0 可能需要更新,因为它目前使用 GPT4-1106-preview 进行人类偏好基准测试。建议包括使用 gpt-4o-2024-08-06 并使用 claude-3-5-sonnet-20240620 进行验证。

- gemma-2-9b-it-WPO-HB 模型可在 Hugging Face 上获取,它在不同排行榜上均超越了 gemma-2-9b-it-simpo 和 llama-3-70b-it,引发了进一步测试的兴趣。

- New upstage release: SOLAR-Pro-PT (Score: 33, Comments: 10):Upstage 发布了 SOLAR-Pro-PT,这是一个可在 Hugging Face 上获取的新预训练模型。该模型可通过 upstage/SOLAR-Pro-PT 访问,不过目前关于其功能和架构的详细信息还很有限。

- 用户推测 SOLAR-Pro-PT 可能是一个扩展规模的 Nemo 模型。之前的 SOLAR 模型因其相对于体积的性能表现给用户留下了深刻印象。

- 该模型的条款和条件禁止重新分发,但允许进行微调并开源生成的模型。一些用户建议在空数据集上对其进行微调,以创建量化版本。

- 人们期待 nousresearch 对该模型进行微调,因为他们之前的 Open Hermes solar 微调版本在编码和推理任务中备受推崇。

- 支持文本、图像、音频和多模态模型的本地推理 Ollama 替代方案 (Score: 54, Comments: 34):Nexa SDK 是一个新的工具包,支持使用 ONNX 和 GGML 格式进行 文本、音频、图像生成 和 多模态模型 的本地推理。它包含一个带有 JSON schema、支持 function calling 和 streaming 的 OpenAI 兼容 API,以及一个用于轻松测试和部署的 Streamlit UI。它可以在任何带有 Python 环境的设备上运行,并支持 GPU 加速。开发者正在为该项目寻求社区反馈和建议,该项目已在 GitHub 上发布:https://github.com/NexaAI/nexa-sdk。

- 社区请求了对 AMD GPU 的 ROCm 支持,开发者计划在下周添加。该 SDK 已经支持 ONNX 和 GGML 格式,这些格式现已具备 ROCm 兼容性。

- 一位用户将 Nexa SDK 与 Ollama 进行了比较,并提出了改进建议,如确保模型准确性、提供清晰的更新信息,以及改进模型管理和命名规范。

- 对 Nexa SDK 的建议包括将 K quantization 作为默认设置,提供 I matrix quantization,并改进模型列表和下载体验,以层级化方式显示不同的量化版本。

AI Reddit 全面回顾

r/machinelearning, r/openai, r/stablediffusion, r/ArtificialInteligence, /r/LLMDevs, /r/Singularity

AI 模型开发与发布

-

Salesforce 的 xLAM-1b 模型在 function calling 方面超越 GPT-3.5:一个 10 亿参数的模型在 function calling 中实现了 70% 的准确率,尽管体积更小,但表现优于 GPT-3.5。

-

Phi-3 Mini 更新支持 function calling:Rubra AI 发布了更新后的 具有 function calling 能力的 Phi-3 Mini 模型,可与 Mistral-7b v3 竞争。

-

Reflection API 争议:一个 带有 prompt engineering 的 Sonnet 3.5 封装层 被当作新模型进行营销,引发了关于 AI 炒作和验证的讨论。

AI 研究与应用

-

乳腺癌的病毒疗法:一位 病毒学家使用实验性病毒疗法成功治愈了自己复发的乳腺癌,引发了关于医学伦理和自我实验的讨论。

-

Waymo 无人驾驶出租车进展:Waymo 每周提供 100,000 次无人驾驶出租车服务 但尚未盈利,这让人联想到 Uber 和 YouTube 等公司的早期发展策略。

-

AI 生成视频创作:演示了 如何使用多种工具创建 AI 生成视频,包括用于生成的 ComfyUI、Runway GEN.3 以及用于音乐生成的 SUNO。

AI 开发工具与可视化

- TensorHue 可视化库:一个 开源的 Python 张量可视化库,兼容 PyTorch、JAX、TensorFlow、Numpy 和 Pillow,旨在简化张量内容的调试。

AI 伦理与社会影响

- AI 生成艺术的评估:关于 将重点从识别 AI 生成艺术转向评估其质量 的讨论,强调了创意领域对 AI 看法的演变。

AI 行业与市场趋势

- 数据增长与 AI 训练:迈克尔·戴尔(Michael Dell)声称 全球数据量每 6-7 个月就会翻倍,戴尔科技拥有 120,000 PB 的数据,而先进 AI 模型训练仅使用了 1 PB。

梗与幽默

- 一个关于 OpenAI 发布周期 以及对新模型期待的幽默视频。

AI Discord 摘要

GPT4O (gpt-4o-2024-05-13) 汇总的摘要之摘要

1. AI 模型性能

- Reflection 70B 表现不及预期:Reflection 70B 在基准测试中的表现落后于 Llama 3.1,引发了对其能力的质疑;独立测试显示其得分较低,且权重发布延迟。

- Matt Shumer 承认上传至 Hugging Face 的权重存在问题,并承诺很快会修复。

- DeepSeek Coder 遭遇困境:用户报告 DeepSeek Coder 出现故障并无法提供任何回复,尽管 状态页面 显示正常,但这表明可能存在上游问题。

- 这加剧了用户对 API limitations 和服务不一致性的现有挫败感。

- CancerLLM 和 MedUnA 推动医疗 AI 进步:在 TrialBench 等基准测试的支持下,CancerLLM 和 MedUnA 正在增强临床应用和医学影像能力。

- 讨论强调了深入研究医学论文以提高研究可见性的重要性。

2. AI 工具与集成

- Aider 提升工作流效率:社区成员分享了他们的 Aider workflows,集成了 CodeCompanion 等工具以简化项目设置,并强调了清晰规划的重要性。

- 预计一个经过优化的 System Prompt 将增强 Aider 的 output consistency(输出一致性)。

- OpenInterpreter 的资源管理困扰:虽然 01 应用允许快速访问音频文件,但用户在 Mac 上面临性能波动,导致结果不一致。

- 一位用户表示,由于 01 应用的稳定性问题,他们更倾向于使用纯净版的 OpenInterpreter。

3. 开源 AI 进展

- GitHub 开源 AI 面板讨论会:GitHub 将于下周四 (9/19) 在其旧金山办公室举办一场免费的 开源 AI 面板讨论会,讨论接入、民主化以及开源对 AI 的影响。

- 小组成员包括来自 Ollama、Nous Research、Black Forest Labs 和 Unsloth AI 的代表。

- Finegrain 的开源图像分割模型:Finegrain 发布了一款开源 image segmentation model,其表现优于闭源替代方案,可在 Hugging Face 上通过 MIT License 获取。

- 未来的改进包括一种更微妙的提示方法,以实现超越简单边界框的增强型消除歧义功能。

4. 基准测试与评估

- 模型训练中的过拟合担忧:人们对 overfitting(过拟合)表示担忧,认为基准测试往往具有误导性,且模型无论规模大小都不可避免地会经历过拟合,这导致了对基准测试可靠性的怀疑。

- 一位成员希望他们关于 benchmark issues 的文章能在 NeurIPS 上获得审阅,并强调了评估面临的挑战。

- 基准测试的局限性得到认可:成员们分享了关于 benchmark limitations 的见解,指出尽管存在缺陷,但基准测试对于比较仍然至关重要。

- 讨论强调了使用多样化基准测试来衡量 AI 模型的必要性,并指出了对特定数据集过拟合的风险。

5. AI 社区活动

- 柏林 AI Hackathon:Factory Network x Tech: Berlin AI Hackathon 定于 9 月 28-29 日 在 Factory Berlin Mitte 举行,旨在聚集 50-100 名有动力推动 AI-driven innovations 的开发者。

- 参与者可以在协作环境中改进现有产品或启动新项目。

- LLVM 开发者大会:即将于 10 月举行的 秋季 LLVM 开发者大会 将包含 5 场由 Modular 带来的演讲,主题涵盖 Mojo 和 GPU programming。

- 活动结束后,录制课程将在 YouTube 上发布,这引起了与会者的极大兴趣。

第一部分:高层级 Discord 摘要

HuggingFace Discord

- Hugging Face Inference API 故障:用户在通过 Hugging Face Inference API 访问私有模型时遇到“凭证错误”(bad credentials),且通常缺乏有用的日志。

- 建议的解决方案包括验证 API token 设置,以及审查影响功能的最新更新。

- 在 Hugging Face 上微调模型:讨论指出,在 Hugging Face 上微调的模型可能并不总是能正确上传,导致仓库中缺少文件。

- 用户建议在转换过程中仔细检查配置并管理较大的模型,以获得最佳结果。

- AI 艺术生成的挑战:社区分享了生成高质量 AI 艺术的经验,强调了肢体和手部表现方面持续存在的问题。

- 有人建议,更简单、更“俗气”的提示词在产生理想结果方面出人意料地更有效。

- 通用近似定理(Universal Approximation Theorem)见解:成员们分析了 Universal Approximation Theorem,引用了 Wikipedia 获取基础细节。

- 讨论揭示了 Haykin 的工作 中的局限性,以及来自 Leshno et al. 关于连续性更好的泛化研究。

- 探索医疗 AI 进展:最近的更新重点介绍了 CancerLLM 和 MedUnA 在临床应用中的作用,以及 TrialBench 等基准测试。

- 成员们对深入研究医疗论文表现出极大的热情,提升了重要研究的曝光度。

aider (Paul Gauthier) Discord

- DeepSeek 在基准测试准确率方面表现挣扎:用户对 DeepSeek Coder 的性能表示担忧,指出其可能使用了错误的模型 ID,导致仪表盘上的统计数据较差。

- 目前两个模型 ID 都指向 DeepSeek 2.5,这可能是导致基准测试问题的原因之一。

- Aider 提升工作流效率:社区成员分享了他们的 Aider 工作流,集成了 CodeCompanion 等工具以简化项目设置,并强调了清晰规划的重要性。

- 引入经过改进的系统提示词(system prompt)预计将增强 Aider 的输出一致性。

- Reflection 70B 表现逊于 Llama3 70B:Reflection 70B 在代码编辑基准测试中得分 42%,而 Llama3 70B 达到了 49%;Aider 的修改版本在某些标签下缺乏必要的功能。

- 欲了解更多详情,请查看 排行榜。

- V0 更新显示出强劲的性能指标:专为 NextJS UIs 定制的 v0 最近更新展示了卓越的能力,用户分享了一个 YouTube 视频 展示其潜力。

- 欲获取更多见解,请访问 v0.dev/chat 查看演示和更新。

- 关于 AI 对开发者岗位影响的担忧:成员们对先进的 AI 工具 可能如何改变开发者角色表示担忧,引发了关于岗位过度饱和和职业相关性的疑问。

- 随着 AI 的不断进化,关于开发领域劳动力未来的紧张情绪正在上升。

OpenRouter (Alex Atallah) Discord

- Reflection API 开放测试:Reflection API 现在可以在 OpenRouter 上免费进行测试,托管版本和内部版本之间存在显著的性能差异。

- Matt Shumer 表示,托管 API 目前尚未完全优化,预计很快会推出修复版本。

- ISO20022 在加密货币领域引起关注:成员们被敦促研究 ISO20022,因为它可能会在加密货币的发展中显著影响金融交易。

- 讨论强调了该标准的意义,反映出人们对其与不断演变的金融格局相关性的兴趣日益浓厚。

- DeepSeek Coder 面临 API 故障:用户报告称 DeepSeek Coder 响应为零且运行异常,尽管状态页面显示没有报告问题,但这表明可能存在上游问题。

- 这一复杂情况加剧了用户对现有 API 限制和服务可用性不一致的挫败感。

- Vertex AI 的 Base64 编码变通方案:针对 Vertex AI 的 JSON 上传问题设计了一个变通方案;现在建议用户在提交前将整个 JSON 转换为 Base64。

- 该技术源自 GitHub PR 讨论,简化了传输过程。

- 多模态模型的集成:技术人员询问了将本地图像与多模态模型结合的方法,重点关注正确集成的请求格式。

- 提供了关于将图像编码为 Base64 格式以促进直接 API 交互的指导。

Stability.ai (Stable Diffusion) Discord

- LoRA 与 Dreambooth 的对决:LoRA 体积小且易于分享,允许在运行时组合,而 Dreambooth 则生成大得多的完整 Checkpoints。

- 两种训练方法在有限的图像下都能表现出色,Kohya 和 OneTrainer 处于领先地位,而 Kohya 在受欢迎程度方面夺冠。

- 600 美元以下的预算级 GPU 指南:对于本地图像生成,用户建议在 600 美元预算内考虑二手的 3090 或 2080,以提升依赖 VRAM 的性能。

- 增加 VRAM 可确保更好的结果,特别是对于本地训练任务。

- 向后兼容性的最后希望:用户呼吁新的 Stable Diffusion 模型保持与 SD1.5 LoRA 的向后兼容性,因为 SD1.5 仍然受到用户的青睐。

- 对话强调了 SD1.5 在构图方面的优势,许多人断言较新的模型尚未超越其效果。

- 内容创作评论:网红与创作者:针对网红文化(influencer culture)出现了一种批评,这种文化迫使内容创作者通过 Patreon 和 YouTube 等平台变现。

- 一些社区成员渴望回归到商业化程度较低的内容创作,同时平衡网红营销的现实。

- LoRA 增强图像生成:用户强调,提高 AI 生成图像的细节在很大程度上取决于工作流的增强,而不仅仅是 Prompt,其中 LoRA 被证明是必不可少的。

- 许多人在图像制作中加入了 Detail Tweaker XL 等组合,以实现效果最大化。

LM Studio Discord

- 用户对 LM Studio v0.3 表示担忧:关于 LM Studio v0.3 的反馈显示,用户对移除 v0.2 中的功能感到失望,引发了关于潜在版本降级的讨论。

- 针对缺失 system prompts 和设置调整的担忧,促使开发者向用户保证更新即将发布。

- 模型配置 Bug 影响性能:用户面临模型配置问题,特别是关于 GPU offloading 和 context length 设置,影响了助手的消息连续性。

- 建议的解决方案包括调整 GPU layers 并确保 dedicated VRAM,因为有用户遇到了 context overflow 错误。

- 对训练 Small Language Models 的兴趣:讨论集中在训练较小语言模型的可行性上,权衡数据集质量和参数数量与预期的 training loss。

- 多位成员强调了支持冷门语言和获取高质量数据集的具体挑战。

- 导航 LM Studio 服务器交互:用户澄清,与 LM Studio 服务器交互必须发送 API requests,而不是通过 Web 界面。

- 一位用户在掌握了正确的 API request 格式后获得了成功,解决了之前的问题。

- 对 Apple 硬件的期待:围绕 Apple 即将发布的硬件公告存在猜测,特别是关于 5090 GPU 及其与之前型号相比的能力。

- 预期表明,Apple 将在下一波硬件中凭借创新的内存架构保持领先地位。

Perplexity AI Discord

- 订阅取消引发愤怒:用户对使用泄露的 promo codes 后订阅被取消感到沮丧,并报告称 Perplexity 团队的支持响应有限。

- 许多人正在寻求对此问题的澄清,觉得对自己的订阅状态一无所知。

- 模型使用限制引发混乱:需要澄清关于模型使用的强制限制,Pro 用户面临 450 次查询的上限,而 Claude Opus 用户仅为 50 次。

- 关于如何在交互过程中准确指定所用模型的问题不断出现,表明缺乏直接的指导。

- API 响应缺乏深度:用户注意到 API 响应较短,缺乏 Web 响应的丰富性,引发了对默认响应格式的担忧。

- 他们正在寻找调整参数以增强 API 输出的建议,指出了潜在的改进领域。

- 支付方式错误导致挫败感:许多用户在尝试设置 API 访问时报告了支付方式的身份验证问题,多张卡片出现各种错误。

- 这个问题似乎很普遍,因为其他人也提到了类似的支付挑战,特别是安全码错误消息。

- Web Scraping 替代方案出现:讨论转向了 Perplexity 功能的替代方案,提到了 You.com 和 Kagi 等利用 Web Scraping 的其他搜索引擎。

- 这些选项因有效解决与知识截止(knowledge cutoffs)和生成响应不准确相关的问题而受到关注。

Cohere Discord

- Cohere 技术应对审核垃圾信息:成员们强调了 Cohere 的分类技术如何有效地过滤加密货币垃圾信息,维护服务器讨论的完整性。

- 一位用户评论道:“这是进行愉快对话的必备工具!”,强调了该 Bot 的重要性。

- Wittgenstein 发布 LLM Web 应用:一位成员分享了他们新编写的 LLM Web 应用的 GitHub 链接,并表示期待反馈。

- 他们确认该应用使用了 Langchain,并已部署在云端的 Streamlit 上。

- 对加密货币诈骗者的担忧:成员们对渗透到 AI 领域的加密货币诈骗表示沮丧,这影响了合法技术进步的声誉。

- 一位爱好者指出,此类垃圾信息在更广泛的讨论中损害了 AI 的可信度。

- 探索 Cohere 产品及其应用:成员们对 Cohere 产品表现出兴趣,并提到了 Cohere 博客上定期发布的客户使用案例。

- 在 Cookbooks 中可以找到使用见解和入门代码,为成员的项目提供灵感。

- 无效的 raw prompt 和 API 使用挑战:成员们讨论了与

raw_prompting参数相关的 400 Bad Request 错误,并澄清了如何配置输出。- 一位成员指出:“理解对话轮次(chat turns)至关重要”,这强化了 API 文档清晰度的必要性。

Nous Research AI Discord

- Reflection 70B 表现平平的基准测试:最近的评估显示,Reflection 70B 在 aider 代码编辑基准测试中得分为 42%,低于 Llama 3.1 的 49%。

- 这种差异导致了对其能力的怀疑,以及部分模型权重延迟发布的问题,引发了对透明度的质疑。

- 肿瘤学医疗 LLM 的进展:重点介绍的 CancerLLM 和 MedUnA 等模型增强了在肿瘤学和医学影像中的应用,在临床环境中展现出前景。

- 像 OpenlifesciAI 的推文 详细描述了它们在改善患者护理方面的影响。

- 通过 RL 训练实现 AGI:讨论强调,通过强化训练结合强化学习 (RL) 可能会实现 AGI。

- 然而,对于 Transformer 在实现监督语义智能 (SSI) 方面的有效性仍存在疑问。

- PlanSearch 引入多样化的 LLM 输出:Scale SEAL 发布了 PlanSearch,这是一种通过自然语言搜索促进输出多样性,从而提高 LLM 推理能力的方法。

- Hugh Zhang 指出,这使得在推理时能够进行更深层次的推理,代表了模型能力的战略转变。

- 扩展模型规模以增强推理能力:通过在多样化、干净的数据集上进行训练,扩展更大规模的模型可能会解决推理挑战,从而提高性能。

- 尽管如此,对于资源需求以及当前认知模拟在实现类人推理方面的局限性,人们仍存有疑虑。

CUDA MODE Discord

- Together AI 的 MLP Kernels 性能超越 cuBLAS:成员们讨论了 Together AI 的 MLP kernels 如何实现 20% 的速度提升,并观察到 SwiGLU 驱动了性能增长。对话暗示 Tri Dao 将在即将举行的 CUDA MODE IRL 活动中分享更多见解。

- 这引发了关于与 cuBLAS 效率指标对比的询问,并促使了关于在机器学习框架中实现具有竞争力的加速效果的交流。

- ROCm/AMD 落后于 NVIDIA:讨论引发了关于为何 ROCm/AMD 在 AI 浪潮中难以像 NVIDIA 那样获利的担忧,成员们质疑了企业信任问题。尽管 PyTorch 兼容 ROCm,但社区共识认为 NVIDIA 的硬件在实际应用中表现更佳。

- 这些见解引发了对 AMD 在不断变化的 GPU 市场中所做战略决策的推测。

- Triton Matmul 集成展现潜力:Thunder 频道会议重点介绍了 Triton Matmul 的应用,聚焦于自定义 kernel 的实际集成。感兴趣的人可以观看 YouTube 视频 回顾。

- 成员们对 fusing operations 的部署表现出热情,并预告了未来在 Liger kernel 上的应用。

- AMD 发布 UDNA 架构:在 IFA 2024 上,AMD 推出了 UDNA,这是一种合并了 RDNA 和 CDNA 的统一架构,旨在更好地与 NVIDIA 的 CUDA 生态竞争。这一战略转型表明了其致力于提升游戏和计算领域性能的决心。

- 此外,AMD 决定降低旗舰游戏 GPU 的优先级,反映了其扩大在多样化 GPU 应用中影响力的更广泛战略,不再仅仅局限于高端游戏。

- 关于 PyTorch ignore_index 的担忧:已确认 Cross Entropy 中

ignore_index的处理避免了无效内存访问,通过 early returns 有效地管理了各种条件。展示正确处理方式的测试用例让担忧的成员们放了心。- 随着性能调优讨论的不断深入,这次交流指出了 kernel 实现中稳健测试的重要性。

OpenAI Discord

- Reflection Llama-3.1 宣称夺得开源模型桂冠:新发布的 Reflection Llama-3.1 70B 模型被声称是目前最好的开源 LLM,利用 Reflection-Tuning 增强了推理能力。

- 用户报告早期的问题已得到解决,鼓励进行进一步测试以获得更好的结果。

- 关于 OpenAI 神秘的 ‘GPT Next’ 的澄清:成员们对 GPT Next 是一个新模型持怀疑态度,OpenAI 澄清这只是一个比喻性术语,没有实际含义。

- 尽管有了澄清,但在期望不断增高的情况下,由于缺乏具体的更新,挫败感依然存在。

- 运行 Llama 3.1 70B 的硬件需求:为了成功运行 Llama 3.1 70B 等模型,用户需要高规格的 GPU PC 或至少拥有 8GB VRAM 的 Apple Silicon Mac。

- 在各种配置上的经验表明,资源不足会严重阻碍性能。

- 通过 Prompt Engineering 增强 AI 输出:成员们建议使用类似“以 Terry Pratchett 的写作风格”等风格来创意性地提升 AI 回复,展示了 prompt 的适应性。

- 强调了结构化输出模板和定义的 chunking 策略对于高效 API 交互的重要性。

- 关于使用 AI 进行股票分析的辩论:对于使用 OpenAI 模型进行股票分析持谨慎态度,主张不要在没有历史数据的情况下仅依赖 prompt。

- 讨论指向了实时更新和传统模型对于全面评估的必要性。

Modular (Mojo 🔥) Discord

- 通过 DLHandle 将 C 与 Mojo 集成:成员们讨论了如何使用

DLHandle动态链接到共享库,从而将 C 代码与 Mojo 集成,实现两者之间的函数调用。- 示例展示了从 C 库加载后成功执行了一个检查数字是否为偶数的函数。

- LLVM 开发者大会精华:即将于 10 月举行的 秋季 LLVM 开发者大会 将包含 5 场由 Modular 带来的演讲,主题涵盖 Mojo 和 GPU 编程。

- 与会者表示期待,会议录像预计将在活动结束后发布在 YouTube 上。

- Subprocess 实现愿景:一位成员表示有兴趣在 Mojo stdlib 中实现 Subprocess 功能,这表明了增强该库的意愿。

- 有人对在旧硬件上搭建开发环境的挑战表示担忧,强调了资源方面的困难。

- DType 在 Dict 键中的角色:讨论集中在为什么

DType不能作为 Dict 的键,并指出 DType.uint8 是一个值而非类型。- 成员们提到,由于其与具有特定约束的 SIMD 类型紧密相关,更改此实现可能会很复杂。

- 多精度算术探索:成员们讨论了在 Mojo 中开发多精度整数算术包的潜力,参考了类似于 Rust 的实现。

- 一位参与者分享了一个 GitHub 链接,展示了该功能在

uint包上的进展。

- 一位参与者分享了一个 GitHub 链接,展示了该功能在

Eleuther Discord

- DeepMind 资源分配转向:一位前 DeepMind 员工指出,项目所需的 算力 (compute) 很大程度上取决于其 产品导向,尤其是在转向 genai 之后。

- 这一见解引发了关于基础研究可能面临资源缩减的讨论,正如社区普遍存在的怀疑态度所指出的那样。

- 抓取 Quora 数据问题:成员们探讨了在 AI 训练数据集中使用 Quora 数据 的潜力,承认其价值但也对其 TOS 表示担忧。

- 讨论强调了由于严格的监管,抓取数据可能并不可行。

- 发布 TurkishMMLU 数据集:TurkishMMLU 正式发布,并附带了数据集链接和相关的 GitHub issue。

- 这一补充旨在加强土耳其语的语言模型评估,如 相关论文 所述。

- ML 中幂律曲线的见解:成员们讨论了 幂律曲线 (power law curves) 如何有效地模拟 ML 中的 性能缩放 (performance scaling),并参考了与估计任务中的缩放定律相关的统计模型。

- 一位成员指出 LLM loss 的缩放定律 与统计估计中的缩放定律相似,表明均方误差按 N^(-1/2) 缩放。

- 探索 Adaptive Transformers:讨论集中在“带有 Adaptive Transformers 的持续上下文学习”,这允许 Transformer 在不改变参数的情况下,利用先验知识适应新任务。

- 该技术旨在实现高适应性,同时最大限度地降低灾难性遗忘风险,吸引了多个领域的关注。

Interconnects (Nathan Lambert) Discord

- Reflection API 性能受到质疑:Reflection 70B 模型面临审查,被怀疑只是在 Llama 3.0 之上针对基准测试集训练的 LoRA;由于评估存在缺陷,其顶级性能的说法具有误导性。

- 最初的私有 API 测试结果优于公开版本,引发了对各版本间不一致性的担忧。

- AI 模型发布实践遭到批评:围绕在没有稳健验证的情况下发布重大模型公告的不专业行为引发了辩论,导致社区对 AI 能力产生不信任。

- 成员们敦促行业在公开发布声明前执行更严格的评估标准,并指出预期膨胀的趋势令人担忧。

- OpenAI 成员转投 Anthropic 引发讨论:讨论集中在 OpenAI 联合创始人 John Schulman 转投 Anthropic 一事,这被描述为一种超现实的现象,突显了领导层的变动。

- 关于频繁提到“来自 OpenAI(现就职于 Anthropic)”的调侃捕捉到了社区动态的变化。

- 围绕 GPT Next 的投机性热议:KDDI Summit 演示文稿中出现了一个标记为 GPT Next 的模型并引发猜测,OpenAI 澄清这只是一个比喻性的占位符。

- 公司发言人指出,图形表示仅具说明性,并不代表未来发布的路线图。

- 内部官僚主义拖慢 Google 速度:一位前 Googler 表达了对 Google 内部严重官僚主义的担忧,称众多的内部利益相关者阻碍了项目的有效执行。

- 这种情绪强调了员工在大组织中面临的挑战,内部政治往往会阻碍生产力。

Latent Space Discord

- AI Codex 助力 Cursor:用于 Cursor 的新 AI Codex 实现了自我改进功能,如自动保存洞察和智能分类。

- 成员们建议,使用一个月后可能会揭示其效率方面的宝贵学习成果。

- Reflection API 令人侧目:Reflection API 似乎是一个 Sonnet 3.5 的 wrapper,据报道它过滤掉了对 Claude 的引用以掩盖其身份。

- 各种评估表明其性能可能与宣传不符,引发了对基准测试方法的质疑。

- Apple 大胆推进 AI 进展:Apple 最近的活动预告了 Apple Intelligence 的重大更新,暗示了可能改进的 Siri 和即将推出的 AI 手机。

- 这引发了对竞争影响的兴奋,许多成员呼吁 Apple 工程师分享见解。

- Gemini 推出全新 Enum Mode:Logan K 宣布在 Gemini API 中推出 Enum Mode,通过允许从预定义选项中进行选择来增强结构化输出。

- 这项创新旨在简化开发者与 Gemini 框架交互时的决策过程。

- 对写实 LoRA 模型的关注:一位用户展示了一个写实 LoRA 模型,其细节处理能力正吸引着 Stable Diffusion 社区。

- 围绕其表现(尤其是意想不到的动漫图像)的讨论引起了极大关注。

OpenInterpreter Discord

- OpenInterpreter 的资源管理困扰:虽然 01 app 允许快速访问音频文件,但用户在 Mac 上面临性能波动,导致结果不一致。

- 一位用户表示,由于 01 app 的稳定性问题,他们更倾向于使用原生的 OpenInterpreter。

- 呼吁在 OpenInterpreter 中加入 AI Skills:用户渴望为标准版 OpenInterpreter 发布 AI Skills,而不仅仅是 01 app,这显示了对增强功能的需求。

- 用户对 01 app 相对于基础版 OpenInterpreter 的性能表现感到沮丧。

- 01 Light 停产及退款:团队宣布正式结束 01 Light 项目,重点转向免费的 01 app,并正在处理所有硬件订单的退款。

- 焦急等待设备的用户中普遍存在失望情绪,但官方保证将通过 help@openinterpreter.com 处理退款。

- Scriptomatic 在开源模型上的成功:一名成员成功将 Scriptomatic 与开源模型的结构化输出集成,并计划很快提交 PR。

- 他们对 Dspy 提供的支持表示感谢,并强调了他们涉及 grepping and printing 的系统化方法。

- Instructor 库增强 LLM 输出:分享了 Instructor 库,该库旨在通过基于 Pydantic 的易用 API 简化 LLM 的结构化输出。

- Instructor 将简化验证、重试和流式传输,从而增强用户的 LLM 工作流。

LlamaIndex Discord

- 使用 llama-deploy 部署 Agentic 系统:探索这个使用 LlamaIndex 和 getreflex 将 Agentic 系统部署为微服务的全栈示例。

- 这种设置简化了聊天机器人系统,使其成为追求效率的开发者的首选。

- 轻松运行 Reflection 70B:如果你的笔记本电脑支持,现在可以使用 Ollama 直接从 LlamaIndex 运行 Reflection 70B(详情点击此处)。

- 这种能力允许在没有大规模基础设施要求的情况下进行动手实验。

- 构建高级 RAG 流水线:查看这篇关于使用 Amazon Bedrock 构建具有动态查询路由的高级 Agentic RAG 流水线的指南。

- 该教程涵盖了有效优化 RAG 实现的所有必要步骤。

- 自动化财务分析工作流:一篇博客文章讨论了创建一个 Agentic 总结系统,用于自动化季度和年度财务分析(阅读更多)。

- 这种方法可以显著提高财务报告和洞察的效率。

- RAG 环境的动态 ETL:了解 LLM 如何通过特定数据的决策来自动化 ETL 过程,如本教程所述。

- 这种方法通过适应不同的数据集特征,增强了数据提取和过滤。

Torchtune Discord

- Gemma 模型配置更新:为了使用 Torchtune 配置 Gemma 9B 模型,用户建议根据 config.json 中的特定参数修改配置中的

model条目。- 该方法利用了组件构建器(component builder),旨在为各种模型规模提供灵活性。

- Torchtune 中支持 Gemma 2 的挑战:讨论围绕在 Torchtune 中支持 Gemma 2 的困难展开,主要原因是 logit-softcapping 问题和带宽限制。

- Gemma 2 中迅速发展的架构改进导致了大量待实现的请求功能积压。

- Torchtune 的拟议增强功能:强调了一个关于 Torchtune 中填充序列(padding sequence)行为的潜在 Bug,并提出了一个 PR,通过澄清 flip 方法来修复该问题。

- 目标是实现与 torch pad_sequence 的功能对等,增强库的整体功能。

- 生成过程中的缓存处理需要改进:用户讨论了生成过程中缓存行为的修改需求,建议在 attention 模块的连续前向调用中使用

torch.inference_mode。- 尽管如此,他们承认为

.forward()设置显式标志可能会产生更稳健的解决方案。

- 尽管如此,他们承认为

- 分块线性方法(Chunked Linear Method)实现参考:一位成员分享了对来自 GitHub gist 的分块线性结合交叉熵的整洁实现的兴趣,将其作为 Torchtune 的潜在增强功能。

- 由于该库目前将 LM-head 与损失计算分离,集成此方法可能会面临挑战。

LangChain AI Discord

- .astream_events() 解码困境:用户报告了在解码来自 .astream_events() 的流时遇到的挑战,特别是通过各种分支和事件类型进行繁琐的手动序列化。

- 参与者强调缺乏有用的资源,呼吁提供参考实现以减轻这一过程的负担。

- Gradio 并发处理困难:在启动具有 10 个标签页的 Gradio 后,尽管并发限制更高,但仅生成了 6 个请求,这暗示了潜在的配置问题。

- 用户指出了硬件限制,建议进一步调查处理并发请求的方法。

- Azure OpenAI 集成面临 500 错误:一位用户在与 Azure OpenAI 交互时遇到 500 错误,引发了对端点参数的查询。

- 建议包括验证环境变量和命名规范,以潜在地解决这些排错难题。

- VAKX 提供无代码 AI 助手构建:VAKX 作为一个无代码平台被引入,使用户能够构建 AI 助手,具有 VAKChat 集成等功能。

- 鼓励成员探索 VAKX 和 Start Building for Free 链接以进行快速设置。

- Selenium 与 GPT-4 Vision 集成:一个实验性项目展示了 Selenium 与 GPT-4 vision model 的集成,详细过程可在 此 YouTube 视频 中查看。

- 围绕利用此集成通过向量数据库进行更有效的自动化测试引发了关注。

OpenAccess AI Collective (axolotl) Discord

- 过拟合问题成为讨论焦点:成员们提出了关于 overfitting 的问题,强调基准测试可能会误导预期,并暗示无论模型规模如何,模型都不可避免地会经历过拟合。

- “我不再相信基准测试了” 表达了对基于不充分数据的模型评估可靠性的怀疑。

- 基准测试的局限性受到审视:分享了关于 benchmark 局限性的见解,揭示了尽管存在缺陷,它们对于模型间的比较仍然至关重要。

- 一位成员对他们关于 benchmark 问题的文章能在 NeurIPS 上接受评审表示乐观,强调了当前的评估挑战。

- AI 工具被揭露为骗局:最近一款被大肆宣传的 AI 工具 被证实是骗局,它虚假地声称可以与 Claude 3.5 或 GPT-4 相媲美。

- 讨论强调了此类骗局造成的 时间损失 及其在各个频道中产生的干扰性质。

- 关于 RAG API 的紧急咨询:一位成员紧急寻求 RAG APIs 的使用经验,由于其模型尚未就绪,需要立即为项目提供支持。

- 他们强调了 24/7 托管 成本的挑战,并寻求有效管理其 AI 项目的替代方案。

- H100 的 8-Bit 加载限制受到质疑:一位成员询问为什么 H100 不支持以 8-bit 格式加载模型,寻求关于此限制的澄清。

- 他们重申了获取有关 H100 在 8-bit 模型加载 方面限制见解的紧迫性。

LAION Discord

- 柏林 AI 黑客松预示创新:Factory Network x Tech: Berlin AI Hackathon 定于 9月28-29日 在 Factory Berlin Mitte 举行,旨在聚集 50-100 名有动力推动 AI 驱动创新 的开发者。

- 参与者可以在协作环境中改进现有产品或启动新项目,培养创造性方法。

- Finegrain 的开源突破:Finegrain 发布了一个开源的 图像分割模型,其性能优于闭源替代方案,可在 Hugging Face 上通过 MIT License 获取。

- 未来的改进包括一种更微妙的提示方法,以增强歧义消除和超出简单边界框的可用性。

- Concrete ML 面临扩展问题:讨论指出 Concrete ML 需要 Quantization Aware Training (QAT) 才能与同态加密有效集成,这可能导致潜在的性能折衷。

- 成员们提出了对文档有限的担忧,特别是其在机器学习中大型模型上的适用性。

- 免费开源 AI 面板活动:GitHub 将于 9月19日 在旧金山举办 开源 AI 面板 活动,邀请了来自 Ollama 和 Nous Research 等组织的知名嘉宾。

- 虽然可以免费参加,但由于座位有限,必须预先注册,因此尽早报名至关重要。

- AI 中的多模态引起关注:AI 中 multimodality 的兴起受到了关注,例如 Meta AI transfusion 和 DeepMind RT-2 等示例展示了重大进展。

- 讨论建议研究采用 RAG、API 交互、网页搜索和 Python 执行等技术的 工具增强生成 (tool augmented generation)。

DSPy Discord

- LanceDB 集成 PR 已提交:一名成员提交了 LanceDB 集成 PR,将其作为检索器 (retriever) 添加到项目中,以处理大型数据集。

- 他们请求特定用户对评审过程提供反馈和修改建议,强调在功能增强方面的协作。

- 对 GPT-3.5 弃用的复杂情绪:成员们讨论了在 GPT-3.5 弃用后不同的用户体验,指出模型性能不一致,尤其是像 4o-mini 这样的模型。

- 一名用户建议使用顶级的闭源模型作为教师模型来指导低端模型,以提高性能的一致性。

- AttributeError 困扰 MIPROv2:有用户报告在 MIPROv2 中遇到

AttributeError,表明GenerateModuleInstruction函数中可能存在潜在问题。- 讨论围绕建议的修复方案展开,一些成员指出 CookLangFormatter 代码中可能存在问题。

- 微调小型 LLM 引发热议:一名成员分享了使用独特的 reflection 数据集微调小型 LLM 的成功经验,该模型已在 Hugging Face 上提供交互。

- 他们提供了链接,同时鼓励其他人探索他们在该领域的发现。

- CookLangFormatter 问题备受关注:成员们辩论了 CookLangFormatter 类中的潜在问题,识别出方法签名中的错误。

- 在修改后,一名用户报告了积极的结果,并建议在 GitHub 上记录该问题以供未来参考。

tinygrad (George Hotz) Discord

- WebGPU PR #6304 引起轰动:由 geohot 提交的 WebGPU PR #6304 标志着在 Asahi Linux 上恢复 WebGPU 功能的重大努力,并附带 $300 悬赏金 (bounty)。

- 一名成员指出:“这是该计划的一个充满希望的开始,” 强调了社区对该提案的兴奋。

- 多 GPU Tensor 问题使开发复杂化:开发者在进行 multi-GPU 操作时遇到 AssertionError,该操作要求所有缓冲区共享同一个设备。

- 一名沮丧的用户评论道:“我花了足够的时间……确信这个目标与 tinygrad 目前处理多 GPU tensor 的方式是正交的。”

- GGUF PR 面临延迟和困惑:关于多个 GGUF PR 停滞状态的担忧日益增加,这些 PR 缺乏合并和明确的项目方向。

- 一名用户询问了 GGUF 的 roadmap,强调了对后续指导的需求。

- 模型分片 (Model Sharding) 的挑战:讨论揭示了模型分片的问题,即某些设置在单 GPU 上运行正常,但在扩展到多个设备时会失败。

- 一名用户观察到 “George 对我的变通方案表示反对……”,表明围绕解决方案存在复杂的对话。

Gorilla LLM (Berkeley Function Calling) Discord

- xLAM Prompt 偏离标准:成员们讨论了 xLAM 使用的独特 system prompt,详见 Hugging Face 模型卡。

- 这引发了关于个性化 Prompt 如何偏离 BFCL 默认设置的分析。

- LLaMA 缺乏 Function Calling 的清晰说明:参与者指出 LLaMA 没有提供关于 function calling 的文档,引发了对 Prompt 格式的担忧。

- 虽然被归类为 Prompt 模型,但由于文档不足,LLaMA 对 Function Calling 的处理仍然模糊不清。

- GitHub 冲突导致集成延迟:一名用户报告其 Pull Request #625 面临合并冲突,阻碍了合并进程。

- 在解决冲突后,他们重新提交了一个新的 Pull Request #627 以促进集成。

- 探索通过 VLLM 进行模型评估:有人询问在设置 VLLM 服务后如何评估模型。

- 该询问反映了社区对模型评估方法论和最佳实践的浓厚兴趣。

- 介绍 Hammer-7b 处理器 (Handler):社区讨论了新的 Hammer-7b 处理器,强调了相关 Pull Request 中概述的功能。

- 包含 CSV 表格 的详细文档突出了模型准确性和性能指标。

LLM Finetuning (Hamel + Dan) Discord

- 4090 GPU 支持更大的模型:凭借 4090 GPU,工程师可以并发运行更大的 embedding 模型,包括 Llama-8b,并应考虑使用 3.1 版本以获得增强的性能。

- 这种配置提升了处理任务的效率,并允许更复杂的模型平稳运行。

- Milvus 的混合搜索魔力:讨论强调了在 Milvus 上结合使用 BGE 和 BM25 的混合搜索,并参考了 GitHub repository 中的示例。

- 该示例有效地展示了如何结合 sparse 和 dense 混合搜索以改进数据检索。

- 通过 Reranking 提升结果:实现一个利用每个 chunk 的 metadata 的 reranker,有助于优先排序并优化结果排序。

- 该方法旨在增强数据处理能力,使检索到的信息更具相关性和准确性。

Alignment Lab AI Discord

- 理解基于 RAG 的检索评估:一位成员询问了在特定领域背景下评估 RAG based retrieval 系统所需的 evaluation metrics(评估指标)。

- 他们不确定是将自己的 RAG approach 与其他 LLMs 进行比较,还是针对不使用 RAG 的结果进行评估。

- RAG 的比较策略:同一位成员思考是仅进行有无 RAG 的对比,还是也要与其他 large language models 进行对比。

- 这个问题引起了兴趣,促使成员们考虑在项目中评估 RAG 有效性的各种方法。

MLOps @Chipro Discord

- GitHub 主办开源 AI 研讨会:GitHub 将于下周四 (9/19) 在其旧金山办公室举办一场免费的 开源 AI 研讨会,旨在讨论 AI 的准入、民主化以及开源的影响。

- 小组成员包括来自 Ollama、Nous Research、Black Forest Labs 和 Unsloth AI 的代表,为 AI 社区的重要对话做出贡献。

- AI 研讨会需要注册审批:与会者需要注册活动,注册需经主办方批准,以便有效管理参会人数。

- 随着 AI 领域对该活动的兴趣日益增长,此流程旨在确保环境可控。

Mozilla AI Discord 没有新消息。如果该社区长时间保持安静,请告知我们,我们将将其移除。

DiscoResearch Discord 没有新消息。如果该社区长时间保持安静,请告知我们,我们将将其移除。

AI21 Labs (Jamba) Discord 没有新消息。如果该社区长时间保持安静,请告知我们,我们将将其移除。

第 2 部分:按频道详细摘要和链接

完整的频道细分内容已针对邮件进行截断。

如果您喜欢 AInews,请分享给朋友!提前感谢!