ainews-learnings-from-o1-ama

以下是“Learnings from o1 AMA”的中文翻译: **o1 AMA 总结** (或者:**从 o1 AMA 中获得的启发/学习心得**)

OpenAI 发布了 o1 模型系列,该系列被誉为该公司“迄今为止功能最强、对齐度最高的模型”,通过强化学习训练以增强推理能力。o1-preview 模型在 ARC-AGI 测试中得分为 21%,在 aider 代码编辑测试中得分约为 80%(超过了 Claude 3.5 Sonnet 的 77%),在 Cognition-Golden 测试中得分约为 52%。这些数据展示了模型从“记忆答案”向“内化推理逻辑”的转变。

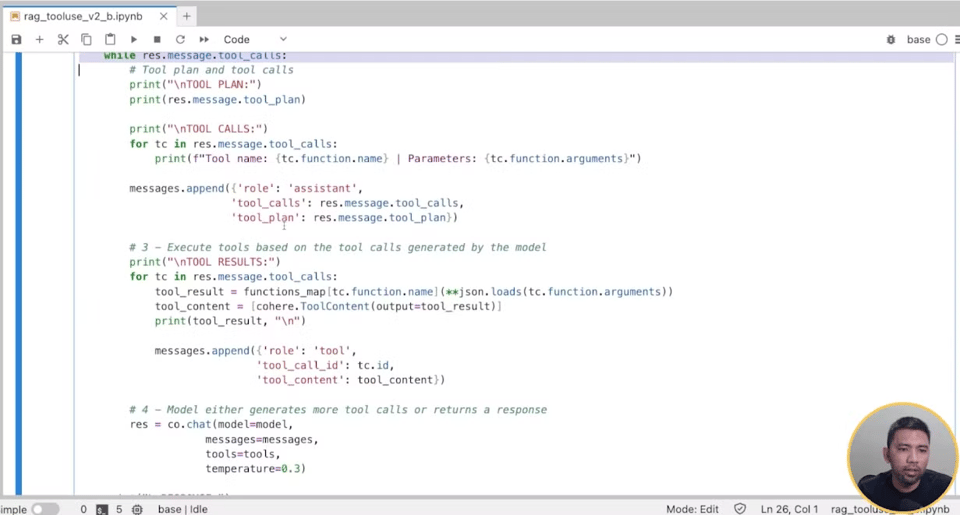

该模型采用了独特的思维链(chain-of-thought)方法,实现了“系统 2 思维”(System II thinking),从而能更有效地解决问题。专家 Andrew Mayne 建议将 o1 视为一个能提供周详解释的“聪明朋友”。此外,由 Weights & Biases、Cohere 和 Weaviate 赞助的高级 RAG 课程提供了混合搜索和提示词策略,旨在优化 AI 解决方案。

对基于 RL 的 CoT 的赞赏就是你所需要的一切。

2024年9月12日至9月13日的 AI 新闻。我们为您检查了 7 个 subreddits、433 个 Twitter 账号 和 30 个 Discord 服务端(216 个频道和 5103 条消息)。预计节省阅读时间(以 200wpm 计算):502 分钟。您现在可以标记 @smol_ai 进行 AINews 讨论!

在 o1 发布后的第二天,我们了解到:

- o1-preview 在 ARC-AGI 上得分 21%(SOTA 为 46%):“总而言之,o1 代表了从‘记住答案’到‘记住推理’的范式转变,但它并没有脱离更广泛的范式,即通过拟合分布曲线来使一切都符合分布,从而提升性能。”

- o1-preview 在 aider 代码编辑上得分约 80%(SOTA - Claude 3.5 Sonnet 为 77%):“o1-preview 模型在遵循 aider 的 diff 编辑格式方面遇到了困难。o1-mini 模型在遵循 whole 和 diff 编辑格式方面都遇到了困难。Aider 非常宽容,并努力接受任何接近正确格式的内容。令人惊讶的是,如此强大的模型在简单文本输出格式的语法要求上会遇到困难。aider 似乎有可能优化其 prompts 和编辑格式,以更好地利用 o1 模型。”

- o1-preview 在 Cognition-Golden 上得分约 52%,并附带建议:“Chain-of-thought 和要求模型‘大声思考’是以前模型的常用 prompts。相反,我们发现要求 o1 只给出最终答案通常表现更好,因为无论如何它都会在回答之前进行思考。o1 需要更密集的 context,并且对杂乱和不必要的 tokens 更加敏感。传统的 prompting 方法通常在给出指令时存在冗余,我们发现这会对 o1 的性能产生负面影响。”

- Andrew Mayne 的 o1 prompting 建议:“不要把它看作传统的聊天模型。在你的脑海中把 o1 想象成一个非常聪明的朋友,你会给她发私信来解决问题。她会回复一个经过深思熟虑的解释,引导你完成各个步骤。”

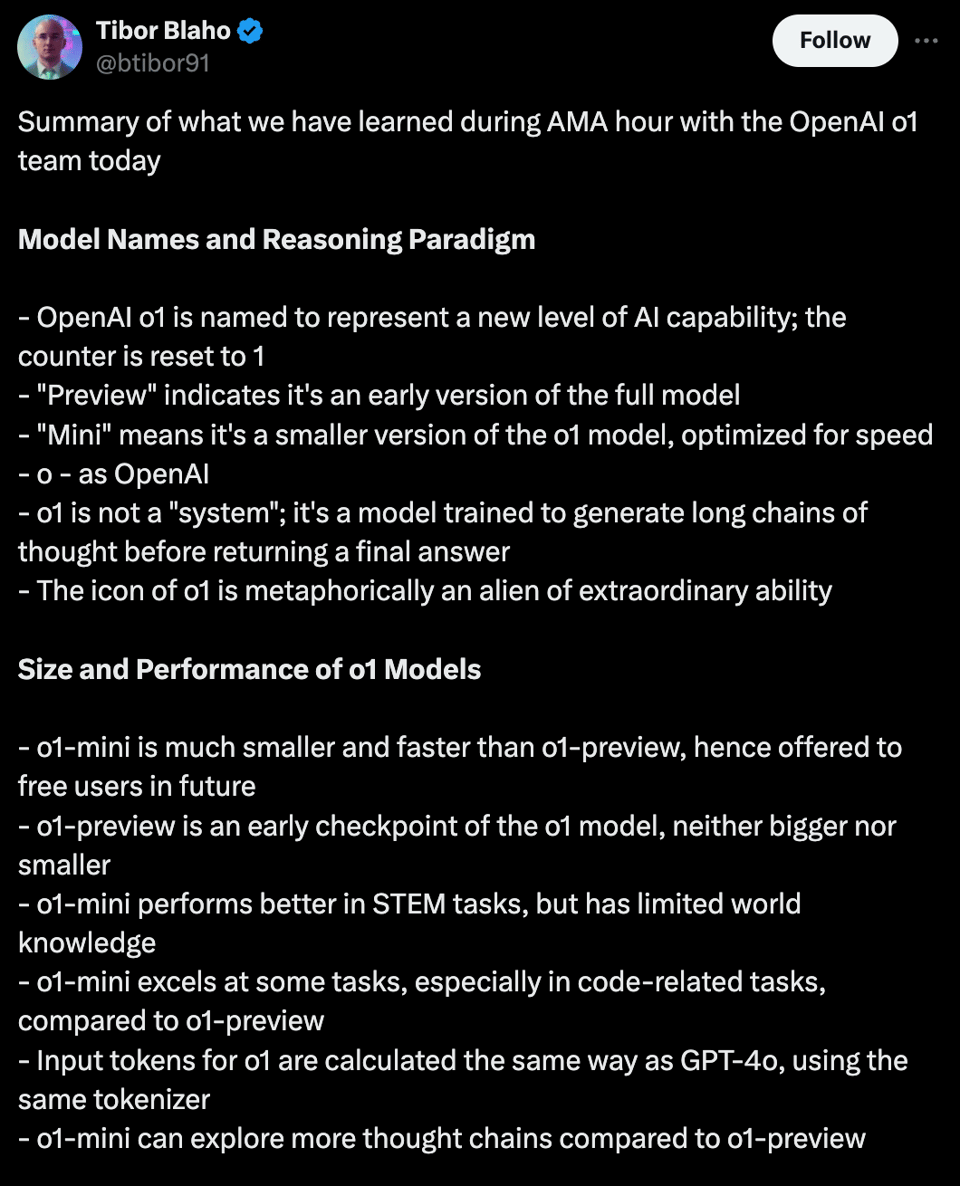

- OpenAI 研究团队 AMA —— 最后这一点由 Tibor Blahe 总结得最好:

除此之外,这是一个安静的周五,所以你可以查看最新的 Latent Space 与 OpenAI 的播客,或者报名参加下周的旧金山黑客松,该活动由本月的赞助商、我们亲爱的朋友 WandB 为您带来!

由 Weights & Biases 赞助的高级 RAG 课程:超越基础的 RAG 实现,探索 hybrid search 和高级 prompting 等高级策略,以优化性能、评估和部署。向来自 Weights & Biases、Cohere 和 Weaviate 的行业专家学习如何克服常见的 RAG 挑战并构建强大的 AI 解决方案,还可获得免费的 Cohere 额度!

AI Twitter 综述

所有综述均由 Claude 3.5 Sonnet 完成,取 4 次运行中的最佳结果。

OpenAI 发布 o1 模型系列

-

模型能力:@sama 发布了 o1,这是 OpenAI “迄今为止最强大且对齐程度最高”的一系列模型。这些模型通过强化学习进行训练,在回答之前会深入思考问题,从而提升了推理能力。

-

性能提升:@sama 强调了在各种基准测试中的显著提升。@rohanpaul_ai 指出 o1 在 57 个 MMLU 子类别中的 54 个上超越了 GPT-4o,并在 MMMU 上达到了 78.2%,使其具备了与人类专家竞争的实力。

-

推理方法:@gdb 解释了 o1 使用独特的思维链(chain-of-thought)过程,使其能够分解问题、纠正错误并调整方法。与之前模型的“系统 I 思维(System I thinking)”相比,这实现了“系统 II 思维(System II thinking)”。

-

模型变体:@sama 宣布 o1-preview 和 o1-mini 立即在 ChatGPT 中面向 Plus 和 Team 用户开放,并在 API 中面向 tier 5 用户开放。@BorisMPower 澄清 tier-5 API 访问权限需要累计支付 1,000 美元且自首次成功付款起超过 30 天。

-

技术细节:@virattt 指出 o1 引入了一类新的“推理标记(reasoning tokens)”,这些标记按输出标记计费,并计入 128K 上下文窗口。OpenAI 建议预留 25K 标记用于推理,这实际上将可用上下文减少到约 100K 标记。

-

安全性改进:@lilianweng 提到 o1 在安全性和鲁棒性指标上有显著提升,对安全规则进行推理是教授模型人类价值观和原则的一种有效方式。

-

推理侧扩展(Inference Time Scaling):@DrJimFan 强调了 o1 代表了向推理侧扩展的转变,即计算资源被用于推理过程而非仅仅是预训练。这允许通过诸如蒙特卡洛树搜索(Monte Carlo tree search)等技术获得更精炼的输出。

-

潜在应用:@swyx 分享了 o1 用于经济学、遗传学、物理学和编程任务的示例,展示了其跨领域的通用性。

-

开发者访问:@LangChainAI 宣布 LangChain Python 和 JS/TS 立即支持 o1,允许开发者将新模型集成到他们的应用中。

反应与分析

-

范式转移:包括 @willdepue 在内的许多用户强调,o1 代表了 AI 开发的新范式,在不久的将来有快速提升的潜力。

-

与其他模型对比:虽然许多人印象深刻,但也有一些用户如 @aaron_defazio 批评 OpenAI 的发布公告中缺乏与其他实验室之前的 SOTA(state-of-the-art)模型的对比。

-

隐藏的推理过程:@vagabondjack 指出 OpenAI 出于“竞争优势”等原因,未向用户展示完整的思维链文本。

-

成本考量:@labenz 指出 o1 的输出标记定价与最初的 GPT-3 定价一致,为 0.06 美元/1K 标记,输入标记便宜 75%。然而,隐藏的推理标记可能会使许多用例的总成本与之前的模型相当。

梗与幽默

-

@karpathy 调侃 o1-mini 拒绝解决黎曼猜想(Riemann Hypothesis),幽默地引用了模型的潜在局限性。

-

几个用户拿模型名称开玩笑,@huybery 调侃道:“既然 OpenAI o1 来了,Qwen q1 还会远吗?”

AI Reddit 综述

/r/LocalLlama 综述

主题 1. OpenAI o1:AI 推理能力的飞跃

- Evals - OpenAI o1 (Score: 110, Comments: 21): OpenAI 的 o1 模型在 STEM 和编程任务中表现出显著进步,其最新的评估结果揭示了这一点。该模型在数学、物理和计算机科学等领域比之前的版本提高了 20-30%,在算法问题解决和代码生成方面表现尤为强劲。这些改进表明 AI 在技术和科学应用方面的能力有了显著跨越。

- 用户质疑为什么语言模型在 AP English 考试中的表现不如复杂的 STEM 任务,并指出解决 IMO 问题似乎比语言类测试更具挑战性。

- 讨论中包含了“🍓”评论,但在没有额外背景的情况下,其相关性或含义尚不明确。

- 用户对该模型在博士级问题上超越人类专家的能力表示兴奋,强调了这一成就的重要性。

- Preliminary LiveBench results for reasoning: o1-mini decisively beats Claude Sonnet 3.5 (Score: 268, Comments: 129): 根据初步的 LiveBench 结果,新款 AI 模型 o1-mini 在推理基准测试中决定性地击败了 Claude 3.5 Sonnet。Bindu Reddy 在 Twitter 上分享了这些发现,表明 AI 推理能力取得了重大进展。

- o1-mini 在 STEM 和代码领域优于 o1-preview,用户注意到它在 lmarena 等平台上的卓越推理能力。随着更多的强化学习和思考时间,该模型的性能会进一步提升。

- 用户争论将 o1-mini 与其他模型进行比较是否公平,因为它使用了内置的 Chain of Thought (CoT) 推理。一些人认为这是一个合法的功能,而另一些人则认为这是在基准测试中“投机取巧”。

- OpenRouter 允许有限度地访问 o1-mini,价格为 $3.00/1M input tokens 和 $12.00/1M output tokens,限制为每天 12 条消息。尽管 token 消耗很高,用户仍对尝试该模型表示兴奋。

- “We’re releasing a preview of OpenAI o1—a new series of AI models designed to spend more time thinking before they respond” - OpenAI (Score: 641, Comments: 248): OpenAI 宣布发布 o1 预览版,这是一个全新的 AI 模型系列,旨在在回答之前花费更多时间思考。这些模型经过工程设计,展现出高级推理能力,有可能提高 AI 生成内容的质量和深度。该公告表明 OpenAI 正在专注于改进 AI 系统的审议过程,这可能会在各种应用中带来更周到、更准确的回答。

- OpenAI 的新 o1 模型在推理能力方面表现出显著改进,在 IMO 预选赛中获得 83% 的分数(相比之下 GPT-4 为 13%),并在 Codeforces 编程竞赛中达到 89% 的分位数。然而,一些用户对现实世界的表现持怀疑态度。

- 隐藏思维链 (Chain of Thought) 过程的决定引发了批评,用户将其贴上“ClosedAI”的标签,并对透明度降低表示担忧。一些人推测,巧妙的提示可能仍会揭示模型的思考过程。

- 讨论中还将其与最近的“Reflection”争议进行了比较,探讨这是否是类似概念的更复杂实现。该模型还声称对 jailbreaking 尝试的抵抗力提高了 4 倍,一些人将其负面地视为审查制度的加强。

主题 2. 开源和本地 LLM 的进展

- DataGemma 发布 - Google 系列 (27B 模型) (Score: 122, Comments: 58): Google 发布了 DataGemma,这是一个专为数据分析任务设计的 27B 参数语言模型系列。该系列模型包括 DataGemma-2b、DataGemma-7b 和 DataGemma-27b 等变体,在包含 3 万亿 token 的多样化数据集上进行了训练,能够根据自然语言指令执行 数据操作、分析 和 可视化 等任务。这些模型根据 Apache 2.0 许可证 提供给研究使用。

- RIG (Retrieval-Interleaved Generation,检索交错生成) 是 Google 为 DataGemma 引入的一个新术语,通过查询可信来源并针对 Data Commons 进行事实核查来增强 Gemma 2。这一特性使 DataGemma 在生成回答时能够检索准确的统计数据。

- 用户演示了 RIG 的功能,展示了它如何查询 Data Commons 来填充关键统计数据,例如加州桑尼维尔(Sunnyvale, CA)的人口信息。这种方法有可能减少 AI 生成回答中的幻觉(hallucinations)。

- 一些用户对尝试 DataGemma 表示兴奋,但也指出希望模型能有 更大的上下文窗口(context windows)。文中还分享了关于 DataGemma 的 Google 官方博客文章以提供更多信息。

- 6 款主流 LLM 推理引擎大比拼 (Score: 42, Comments: 38): 该帖子对比了 6 款主流 LLM 推理引擎 的本地部署情况,重点关注推理质量而非仅仅是速度。作者使用来自“其他”类别的 256 个精选 MMLU Pro 问题 进行了测试,在不同引擎上运行了具有各种量化级别的 Llama 3.1 8B 模型。结果显示,较低的量化级别并不总是导致较低的质量,在本次特定测试中,vLLM 的 AWQ 量化 表现最好,不过作者提醒不要将这些结果推广到所有用例。

- 建议测试 vLLM 的 AWQ 引擎,作者确认其表现“相当不错”并进行了额外测试。AWQ 引擎代表了 vLLM 的 “4 bit” 版本,并且最近整合了 Marlin 内核。

- 讨论中提到了使用 Triton TensorRT-LLM 后端 进行测试。作者指出它“以难以配置著称”,并且需要签署 NVIDIA AI Enterprise License 协议 才能访问 docker 镜像。

- TensorRT-LLM 配置的复杂性被重点强调,作者分享了一张 快速入门指南的截图。这让一位原本认为 Triton 是免费且开源的 评论者感到惊讶。

- 对 WebGPU + transformers.js (v3) 感到兴奋:在浏览器中利用全部 (GPU) 硬件 (Score: 49, Comments: 7): WebGPU 和 transformers.js v3 现在支持 在 Web 浏览器中充分利用 GPU 硬件,从而在无需 Python 服务器或复杂设置的情况下,显著提升 AI 任务的性能。作者报告称,在 M3 Max 上,嵌入模型(embedding models)相比 WASM 有 40-75 倍的加速,在带有集成显卡或旧款 GPU 的消费级笔记本电脑上有 4-20 倍的加速。这项技术为 Stable Diffusion、Whisper 和 GenAI 等各种 AI 应用实现了私有的设备端推理,这些应用可以免费托管在 GitHub Pages 等平台上,正如 SemanticFinder 等项目所展示的那样。

- privacyparachute 展示了一个具有 会议转录 和音频/视频 自动字幕生成 功能的项目,并为录制参与者提供了隐私控制。该项目利用了 u/xenovatech 的工作成果。

- 关于浏览器可运行模型能力的讨论中,SeymourBits 最初认为它们很基础(大约是 2019 年的水平)。privacyparachute 反驳道,使用正确的 Web-AI 框架可以运行最新的模型,并推荐 WebLLM 作为示例。

- 评论强调了 基于浏览器的 AI 应用 的持续发展,展示了原帖中所讨论技术的实际应用。

主题 3:关于 AI 透明度以及开源与闭源开发的辩论

-

“o1 仍然存在缺陷,仍然受到限制,而且初次使用时看起来比长时间使用后更令人印象深刻。” (Score: 108, Comments: 49):OpenAI 的 CEO Sam Altman 在 Twitter 线程中回应了对 GPT-4 Turbo with vision(被称为 “o1”)的批评,承认了其缺陷和局限性。他强调,虽然该模型最初可能看起来令人印象深刻,但长时间使用会暴露其短板,并强调了关于 AI 能力和局限性进行负责任沟通的重要性。

- OpenAI 隐藏了 o1 使用的 CoT 以获得竞争优势。 (Score: 40, Comments: 17):据报道,OpenAI 正在隐藏其 o1 模型使用的思维链 (CoT),以保持竞争优势。帖子指出,通过针对特定指标优化 CoT 提示词,可以使用开源软件 (OSS) 模型开发出最先进 (SoTA) 的模型,并提到 DSPy 是实现这一方法的工具。

- 考虑到公司之间的人才流动,Anthropic 可能已经具备了复制或超越 OpenAI o1 模型的能力。据报道,他们的 Sonnet 3.5 模型已经领先了 3 个月,尽管由于算力限制,其使用可能受到限制。

- OpenAI 承认审查会显著降低模型智能,这引发了人们的兴趣,特别是与生成思维链 (CoT) 输出相关的部分。

- 对隐藏 CoT 的关注可能是 OpenAI 的一种战略叙事。一些人认为,更底层的过程,如 Anthropic 在稀疏自编码器 (sparse autoencoder) 研究中探索的内容,可能更好地解释 AI 模型中的 Token 选择和记忆形成。

- 如果 OpenAI 能让 GPT4o-mini 在推理方面大幅优于 Claude 3.5,这是否预示着本地 LLM 很快也能做到同样的事情? (Score: 111, Comments: 39):帖子讨论了开源替代方案在推理能力上匹配或超越封闭 AI 系统的潜力。它认为,如果 GPT4o-mini 能在推理任务中显著优于 Claude 3.5,那么通过使用思维链 (CoT) 实现,类似的改进可能很快就能在本地 LLM 中实现。作者引用了一些研究,表明当给予通过 CoT 进行“思考”的机会时,GPT3.5 的推理能力可以超过 GPT4,这意味着开源模型可以采用类似的技术。

- OpenAI o1 的训练理论包括使用 GPT-4 生成解决方案、应用 STaR 论文的方法以及直接使用 RL。这个过程可能涉及多种方法的结合,专家标注的成本可能高达数亿美元。

- “超级秘方”可能在于数据集质量。OpenAI 的 system card 和 “Let’s verify step by step” 论文提供了对其方法的见解,其中包括用于指令微调的强化学习 (reinforcement learning)。

- 一项使用 Nisten’s prompt 与 c4ai-command-r-08-2024-Q4_K_M.gguf 模型进行的实验展示了改进的问题解决能力,表明开源替代方案在推理任务中潜力匹配封闭 AI 系统。

主题 4. 用于 LLM 训练的新数据生成技术

- Hugging Face 增加了直接从浏览器中使用 SQL 查询所有 200,000 多个数据集的选项! (Score: 215, Comments: 15):Hugging Face 推出了一项新功能,允许用户直接从浏览器中使用 SQL 查询超过 200,000 个数据集。这一增强功能实现了无需下载数据集即可进行数据探索和分析,提供了一种与平台上海量数据集交互的更高效方式。

- 该功能由 DuckDB WASM 驱动,允许 SQL 查询直接在浏览器中运行。用户可以分享他们的 SQL 查询和视图,并提供反馈或功能请求。

- 用户对 Hugging Face 提供广泛带宽、存储和 CPU 资源的能力表示赞赏。该功能因其在过滤数据集和下载结果方面的实用性而受到好评。

- 几位用户发现该工具对特定任务很有帮助,例如统计数据集元素数量以及执行他们之前在本地使用 DuckDB 设置的分析。

- 我专门为 RP 制作了一个数据生成流水线:输入故事,输出以其主题和特征为灵感的 RP 数据 (Score: 46, Comments: 15): 作者介绍了 RPToolkit,这是一个用于根据输入故事生成 角色扮演数据集 (roleplaying datasets) 的开源流水线,并针对 local models 进行了优化。该流水线可以创建多样化、丰富的多轮角色扮演数据,反映输入故事的主题、流派和情感内容。作者展示了其能力,使用 Llama 3 70b 和 Mistral Large 2 模型创建了一个包含约 1000 个 RP 会话的数据集。该工具旨在解决 RP 模型创作者的数据生成问题,允许用户创建针对特定流派或主题定制的数据集,而无需直接引用输入数据,从而可能规避版权问题。

- 用户询问了用于数据集生成的推荐 LLM,作者建议使用 turboderp/Mistral-Large-Instruct-2407-123B-exl2 和 Llama 3 70b。Magnum 123B 模型也因其处理复杂角色和场景的能力而被推荐。

- 作者提供了 RPToolkit 与原始 Augmentoolkit 的详细对比,强调了改进之处,如专用的 RP 流水线、彻底翻新的配置、分类器创建流水线以及为了提高速度而采用的 async。

- 讨论涉及了潜在的应用,包括使用 RPToolkit 为写作创建故事讲述数据集。作者建议可以直接使用它,或者修改 Prompt 以专注于故事写作而非对话。

其他 AI Subreddit 回顾

r/machinelearning, r/openai, r/stablediffusion, r/ArtificialInteligence, /r/LLMDevs, /r/Singularity

AI 模型发布与改进

-

OpenAI 发布 o1:OpenAI 发布了一个名为 o1 的全新推理模型系列,旨在响应前花费更多时间进行思考。o1-preview 模型现已在 ChatGPT 和 API 中可用。它在科学、编程和数学等复杂任务中表现出更强的性能。

-

o1-mini 性能:o1-mini 模型在推理基准测试中获得高分,超越了之前的模型。这表明即使在新的 o1 系列的较小版本中也有显著改进。

-

Flux 模型进展:由 Black Forest Labs(原 SD 团队)开发的 Flux AI 模型正在生成高质量图像并受到 AI 爱好者的欢迎。它被视为对 Stable Diffusion 模型的重大改进。

AI 研究与技术

-

新的扩展范式 (Scaling Paradigm):一位 OpenAI 研究员表示 o1 代表了一种新的扩展范式,暗示他们不再受预训练 (pretraining) 的瓶颈限制。这可能预示着 AI 模型开发和扩展方式的转变。

-

推理能力:据称 o1 模型具有增强的推理能力,可能代表了 AI 技术的重大进步。然而,一些用户对这些改进的程度表示怀疑。

AI 模型对比与社区反应

-

Flux vs Stable Diffusion:关于 Flux 表现优于 Stable Diffusion 模型的讨论正在进行中,许多用户报告 Flux 的效果更好,尤其是结合 LoRA 技术时。

-

MiniMax 视频生成:一篇文章声称 MiniMax 在 AI 视频生成方面已经超越了 Sora,展示了在普通观察者看来非常真实的滑板剪辑。

AI Discord 回顾

摘要的摘要的摘要

O1-mini

主题 1. OpenAI o1 模型:性能与局限性

- OpenAI o1 在推理方面表现出色,但在编程方面受挫:新发布的 OpenAI o1 模型在 reasoning 和数学方面表现卓越,超越了 Claude 3.5 Sonnet,但与 GPT-4 和 Claude 3.5 Sonnet 相比,在编程任务中表现令人失望。用户观察到它能生成不错的文章和教育内容,但在实际编程应用中表现挣扎。

- 速率限制(Rate Limits)收紧了 o1 的使用:OpenRouter 将 o1 模型限制为每天 30 次请求,导致许多用户在发送约 12 条消息后就达到了速率限制,引发了不满。这一限制引发了关于其如何影响复杂任务执行以及未来是否可能提高限制的讨论。

- 首次商业太空行走完成:首次商业太空行走的完成是一个重要的里程碑,一篇讨论任务关键事件和结果的文章对此进行了详细阐述。

Theme 2. AI 训练增强与优化

- Prompt Caching 大幅削减 90% 的成本:OpenRouter 引入的 Prompt caching 允许用户在 Anthropic 和 DeepSeek 等供应商处实现延迟加速,并可能获得 90% 的 prompt tokens 折扣,预计未来还将扩大范围。这一功能正在重塑频繁使用 AI 用户的成本结构。

- 量化技术提升模型效率:Unsloth AI 和 CUDA MODE 等社区深入研究了独立的 quantization 和 dequantization 过程,探索了 QLoRA 等方法,并就 dynamic quantization 在管理 VRAM 限制的同时增强模型性能的优势展开了辩论。

- 结合 KL 散度的强化学习:在 Eleuther Discord 中讨论到,在 reinforcement learning 中使用 KL divergence 作为辅助损失函数,有助于防止模型遗忘关键任务,从而平衡审核(moderation)与创造力。

Theme 3. AI 工具、集成与平台

- OAuth 集成简化 AI 开发:OpenRouter 增强了对

vscode:和cursor:等编程插件的 OAuth 支持,促进了自定义 AI 模型无缝集成到开发环境中,提高了开发者的工作流效率。 - Modular 的 Magic 和 Mojo 更新 AI 工具包:MAX 24.5 和 Mojo 24.5 引入了显著的性能提升和 Python 3.12 兼容性,利用新的 Magic 包管理器简化了安装和环境管理。这些更新使 Modular 成为开发者极具竞争力的 AI 解决方案。

- WebGPU Puzzles 发布,助力学习 GPU 编程:由 Sarah Pan 和 Austin Huang 开发的新应用 WebGPU Puzzles 通过基于浏览器的交互式挑战教授 GPU programming,使得在没有专用硬件的情况下进行 GPU 访问实践成为可能。

Theme 4. AI 法规、伦理与对齐

- 加州 SB 1047 AI 安全法案面临否决风险:拟议的 SB 1047 法案旨在监管加州的 AI 安全,但由于政治影响,有 66%-80% 的概率被否决。讨论强调了该法案对政治气候和公众对 AI 监管看法的依赖。

- 对 AI 审查和对齐(Alignment)的担忧:在多个 Discord 频道中,成员们表达了对 RLHF 可能会使 AI 模型“变笨”的担忧,从而降低其在技术任务中的效用。人们强调要在 AI moderation 与保持创造力和功能性之间取得平衡。

- STaR 技术增强模型推理:在 LAION 中,将 Chain-of-Thought (CoT) 与 Reinforcement Learning 相结合,显著提高了模型在复杂推理任务上的表现,突显了高质量数据收集的重要性。

Theme 5. 社区活动、协作与支持

- 黑客松与合作推动 AI 创新:诸如 LlamaIndex hackathon 等活动提供了超过 $20,000 的奖金,促进了 Retrieval-Augmented Generation (RAG) 项目并鼓励社区主导的 AI agent 开发。与 OpenSea 等平台合作提供的 free mint 机会也吸引了社区参与。

- 私人聚会与工作机会强化 AI 网络:Fleak AI 在旧金山的私人欢乐时光活动以及 Vantager 的 AI Engineer 职位空缺提供了社交和职业机会,增强了 AI 领域的社区联系和专业成长。

- OpenInterpreter 移动端应用反馈:用户报告了 OpenInterpreter 移动端应用在语音响应功能方面的挑战,敦促改进用户交互和开发者响应速度,并鼓励社区贡献以增强文档和故障排除。

O1-preview

主题 1. OpenAI 的 o1 模型引发兴奋与争论

- o1 模型在数学方面表现惊艳,但在代码方面受挫:OpenAI 的新 o1 model 让 AI 社区议论纷纷,其推理和数学能力令用户印象深刻,但与 GPT-4 和 Claude 3.5 Sonnet 相比,其不尽如人意的代码表现让用户感到困惑。

- o1 在复杂推理任务中表现出色,但在交付有用的代码输出方面却很吃力,引发了褒贬不一的反应。

- 速率限制给 o1 的亮相泼了冷水:o1 的早期采用者正面临严格的 rate limits —— 有些用户在仅发送 12 条消息 后就达到了上限 —— 这引发了关于该模型在严肃用途中实用性的沮丧和讨论。

- 用户正在质疑 Token 消耗的差异以及对其有效执行复杂任务能力的影响。

- 基准测试之争:o1 是否公平竞争?:关于 AI 模型基准测试公平性的辩论被点燃,o1 独特的答案选择机制使其难以与 GPT-4o 等模型进行直接比较。

- 呼吁考虑计算预算和选择方法的基准测试,突显了评估 AI 进展的复杂性。

主题 2. 开发者通过 AI 集成增强工具功能

- OAuth 与 AI 助力编程智商提升:OpenRouter 为

vscode:和cursor:等插件引入了 OAuth support,让开发者能够将自定义 AI 模型无缝集成到他们的代码编辑器中。- 此次更新将 AI 驱动的解决方案直接带入 IDE,极大地提升了工作流效率。

- TypeScript 通过 LlamaIndex.TS 发布接入 AI:LlamaIndex.TS 为 TypeScript 带来了先进的 AI 功能,通过为 TS 爱好者量身定制的工具简化了开发。

- 该软件包提供了关键功能,以简化 AI 在 TypeScript 项目中的集成。

- Vim 爱好者齐聚探讨 AI 驱动的编辑:开发者分享了精通 Vim 和 Neovim 的资源,包括一个 关于配置的 YouTube 播放列表,旨在通过 AI 辅助提高编程速度。

- 社区协作将 AI 集成到编辑器中,提高效率并分享最佳实践。

主题 3. 微调者面临训练挑战

- 内存泄漏导致 GPU 崩溃:开发者在使用可变 GPU batch sizes 时正努力解决 PyTorch 中的内存泄漏问题,突显了张量大小波动带来的困扰以及对更好处理可变序列长度的需求。

- 对填充效率低下的担忧引发了对内存陷阱稳健解决方案的呼吁。

- VRAM 限制考验微调者的耐心:社区成员在严格的 VRAM 限制下努力微调 Llama3 等模型,尝试使用 learning rate schedulers 和 gradient accumulation steps 等策略。

- “反复试验仍然是我们的座右铭,” 一位用户沉思道,反映了大家对高效配置的共同追求。

- Phi-3.5 训练进展缓慢:由于 LoRA adapters 未能学习到任何实质性内容,训练 phi-3.5 的尝试让用户感到愤慨,从而引发了错误报告和对可能故障的深入研究。

- 随着微调者在这一难以捉摸的模型面前碰壁,挫败感不断增加。

主题 4. 新工具和模型搅动 AI 领域

- MAX 24.5 凭借 45% 的速度提升一马当先:MAX 24.5 首次亮相,在 int4k Llama token generation 方面带来了高达 45% 的性能提升,令追求速度的开发者们感到欣喜。

- 新的驱动接口和 Token 效率使 MAX 成为 AI 工具领域的一位重量级竞争者。

- Open Interpreter 的 Token 节食计划让用户感到饥渴:Open Interpreter 仅在 6 个请求中就消耗了 10,000 tokens,导致用户质疑其巨大的消耗量,并寻求更智能的方法来优化 Token 使用。

- 讨论集中在如何在不牺牲功能的前提下减少 Token 消耗。

- 战锤粉丝利用 Adaptive RAG 砥砺前行:Warhammer Adaptive RAG 项目 聚集了粉丝和开发者,展示了 local models 的创新用途,以及 hallucination 检测和 answer grading 等功能。

- 社区反馈推动了项目的演进,体现了协作式 AI 开发的精神。

主题 5. AI 政策与可访问性对话升温

- 加州 AI 法案面临政治摊牌:拟议的 California SB 1047 AI safety bill 引发了辩论,在政治博弈中,被否决的可能性估计在 66%-80% 之间。

- 该法案不确定的命运凸显了 AI 领域创新与监管之间的紧张关系。

- OpenAI 是否让每个人的口袋里都装进了一个博士?:用户对 OpenAI 的进步感到惊叹,认为 AI 的进步 “就像在每个人的口袋里装了一个博士学位”,同时也在思考社会是否真正理解了这种转变的规模。

- 这一讨论突显了 AI 对知识获取便捷性的变革性影响。

- AI 基准测试公平竞争的呼声愈发响亮:关于 AI 模型评估的争论愈演愈烈,倡导者推动将计算预算(compute budgets)和选择方法纳入基准测试,以创造公平的竞争环境。

- 社区正在寻求更细致的指标,以准确反映 AI 的能力和进展。

第一部分:Discord 高层摘要

OpenRouter (Alex Atallah) Discord

- OpenAI o1 模型对所有人开放:新的 OpenAI o1 模型系列现已上线,允许客户端一次性流式传输所有 Token,但最初受到每天 30 个请求的 rate limits 限制,导致用户在 12 条消息后就会遇到速率限制错误。

- 这种有限的发布引发了关于这些约束如何影响编码和推理任务中不同应用的使用模式的讨论。

- Prompt Caching 带来成本节省:Prompt caching 现在使用户能够实现延迟加速,并在共享缓存项时获得潜在的 90% prompt tokens 折扣,目前已对 Anthropic 和 DeepSeek 生效。

- 该功能的扩展预计将覆盖更多供应商,可能会重塑频繁用户的成本结构。

- 增强 OAuth 支持以进行工具集成:OpenRouter 为

vscode:和cursor:等编码插件引入了 OAuth support,促进了自定义 AI 模型的无缝集成。- 此次更新允许开发者将他们的 AI 驱动解决方案直接引入 IDE,从而提高工作流效率。

- 速率限制令用户失望:用户对 OpenRouter 最近将 o1 模型限制为 每天 30 个请求 的更新表示沮丧,他们认为这阻碍了他们有效执行复杂任务的能力。

- 许多人渴望看到使用模式如何演变,以及是否有提高这些限制的潜力。

- 空响应的技术问题:当用户报告在 completion JSON 中收到 60 行空行 时,出现了技术疑虑,这表明存在需要解决的稳定性问题。

- 一位社区成员建议在重新考虑响应的可靠性之前,给系统调整留出一段等待期。

OpenAI Discord

- OpenAI o1 在与 GPT-4 的对比中表现参差不齐:用户指出 OpenAI o1 在推理和数学方面表现出色,但在编程方面的表现与 GPT-4 和 Claude 3.5 Sonnet 相比令人失望。

- 虽然它能生成不错的文章和教育内容,但在编程能力方面存在相当大的局限性。

- AI 在艺术和创意中不断演变的角色:讨论指出 AI 生成的艺术在挑战人类艺术极限的同时,也造成了低质量内容的饱和。

- 参与者设想了一个 AI 辅助而非取代人类创造力的未来,尽管对内容质量仍有担忧。

- 澄清聊天机器人的 RAG 与 Fine-Tuning:一名成员询问了检索增强生成 (RAG) 与微调对于教育聊天机器人的益处,得到的共识是 RAG 在处理上下文驱动的提问时更具优势。

- 专家强调,微调调整的是行为而非知识,因此不太适合实时问答。

- ChatGPT 在歌曲翻译方面面临挫折:用户反映 ChatGPT 在翻译生成的歌曲时表现挣扎,由于其创意内容指南的限制,通常只返回片段而非完整歌词。

- 这种限制阻碍了许多用户追求的项目连续性,增加了扩展过去对话的复杂性。

- 用户界面更改引发投诉:成员们对最近的用户界面更改表示不满,特别是复制和粘贴功能破坏了行分隔。

- 随着成员在不断演变的界面中操作,这导致了易用性问题和挫败感。

Unsloth AI (Daniel Han) Discord

- Unsloth Pro 发布推测:社区热切期待 Unsloth Pro 的发布,传闻其目标客户为大型企业,发布时间为“完成后”。

- 成员们开玩笑地将开发进度比作建造罗马,暗示正在取得实质性进展。

- 在 RTX 4090 上测试 Gemma2:在具有 8k 上下文的 RTX 4090 上对 Gemma2 27b 进行的初步测试显示出前景,尽管潜在的 VRAM 限制仍令人担忧。

- 对梯度累积步数(gradient accumulation steps)的需求凸显了大型模型面临的持续挑战。

- Mistral NeMo 性能评估:早期反馈表明 Mistral NeMo 的性能与 12b 模型 持平,这引起了部分用户的一些失望。

- 参与者思考更精炼的示例是否能提升性能。

- AI 审核与创意担忧:用户担心来自人类反馈的强化学习 (RLHF) 可能会让 AI 模型“变笨”,强调了在审核与创意之间取得平衡的重要性。

- 提议实施中间件过滤,以在确保安全的同时保留原创性。

- 在有限 VRAM 下微调模型:社区讨论围绕在 VRAM 限制下使用 Qlora 进行微调的挑战,重点关注最佳学习率 (LR) 调度器的选择。

- 随着成员寻找默认余弦调度(cosine scheduling)之外的替代方案,反复试验仍是一个共同主题。

HuggingFace Discord

- 使用 Ophrase 和 Oproof 革新 CLI 工具:社区成员分享了关于使用 Ophrase 和 Oproof 革新 CLI 工具的见解。他们的方法旨在显著提升开发者体验。

- 他们的创新技术启发了开发者重新思考命令行功能。

- Hugging Face 模型完整性挑战:用户报告了 Hugging Face 上一个热门模型的完整性问题,暗示其包含误导性信息并违反了内容政策规则。

- 讨论强调了用户在下载模型后可能感到的失望,因为其性能显著低于宣传的 Benchmarks。

- 使用 Llama cpp 探索 Reflection 70B:重点介绍了一个使用 Llama cpp 构建的 Reflection 70B 项目,展示了该领域的高级能力。

- 成员们指出,能够轻松获取最先进的模型是一项关键优势。

- 新的波斯语数据集增强多语言数据:社区推出了一个 波斯语数据集,包含从 Wikipedia 翻译的 6K 个句子,这对于增强多语言 AI 能力至关重要。

- 参与者赞扬了其在改进波斯语模型和训练数据多样性方面的潜力。

- Arena Learning 提升性能:Arena Learning 被讨论为一种在训练后(Post-training)阶段提高模型性能的方法,并显示出显著效果。

- 社区成员渴望将这些见解应用到自己的模型中,以获得更好的结果。

Nous Research AI Discord

- O1-mini 表现优于 O1-preview:用户报告 O1-mini 相比 O1-preview 表现出更好的性能,这可能是因为它能够在给定时间范围内执行更多的 Chain of Thought (CoT) 轮次。

- 一位用户正在等待完整发布以明确当前的能力,对立即购买表现出犹豫。

- Hermes 3 的突破:Hermes 3 相比 Hermes 2 有了显著增强,在角色扮演、长上下文连贯性和推理能力方面有明显改进。

- 许多人正在关注其在需要扩展上下文长度的应用中的潜力,引发了对其 API 能力的兴趣。

- 模型对齐的担忧:强调了对自主模型对齐(Model Alignment)的担忧,指出如果模型在没有对齐的情况下实现更高的智能,存在失去控制的风险。

- 讨论强调了理解开发者意图以预先应对对齐挑战的重要性。

- GameGen-O 展示功能:GameGen-O 通过一个受《西游记》启发的 Demo 展示了其功能,因其创新能力而备受关注。

- 贡献者包括来自 香港科技大学 和 腾讯光子工作室 (Tencent’s LightSpeed Studios) 的成员,表明了研究合作。

- ReST-MCTS 自训练进展:ReST-MCTS 方法通过将过程奖励指导(Process Reward Guidance)与树搜索(Tree Search)相结合,提供了增强的自训练,提升了 LLM 训练数据的质量。

- 该技术显著超越了之前的算法,通过迭代训练不断优化具有高质量输出的语言模型。

Perplexity AI Discord

- OpenAI O1 模型待集成:用户正热切期待将 OpenAI O1 模型集成到 Perplexity 中,一些人提到了已经集成该模型的竞争对手。

- 虽然许多人希望快速更新,但也有人认为像 Claude Sonnet 这样的模型表现已经很出色了。

- API 额度困惑:用户对 5 美元 API 额度补充的时间点不明确,争论其是在每月 1 号还是在每个计费周期的第一天重置。

- 用户非常希望能进一步明确这些时间点, 尤其是那些管理订阅状态的用户。

- 商业太空行走标志着一个里程碑:首次商业太空行走已正式完成,并发布了一篇详细文章讨论关键任务事件和结果。

- 在此处阅读完整更新。

- 内部服务器错误阻碍 API 访问:有报告称出现内部服务器错误(状态码 500),表明用户在尝试访问 API 时面临严重问题。

- 此错误在关键操作期间对 Perplexity 服务的有效利用构成了挑战。

- 强调 OpenPerplex API 优势:用户表达了对 OpenPerplex API 的偏好,理由是其具有引用、多语言支持和更高的速率限制(rate limits)等优点。

- 这反映了优于其他可用 API 的良好用户体验, 突显了其效用。

Latent Space Discord

- OpenAI o1 收到褒贬不一的反馈:用户报告称 OpenAI 的 o1 模型表现参差不齐,在重推理任务中表现出色,但总体上往往无法提供有用的输出,导致透明度方面的担忧。

- “他们说 Cursor 的代码补全不行?” 这引发了对用于评估的研究方法的质疑。

- 李飞飞(Fei-Fei Li)启动 World Labs:李飞飞公布了 World Labs,专注于空间智能(spatial intelligence),并获得了 2.3 亿美元的融资,旨在开发能够进行 3D 感知和交互的 Large World Models。

- 该计划正吸引 AI 社区的顶尖人才,渴望解决现实世界的复杂问题。

- Cursor 遇到扩展性问题:据报道,Cursor 在代码补全和文档生成功能方面面临扩展性问题,阻碍了用户体验。

- 讨论强调了用户的挫败感,表明该工具的性能未达到预期。

- HTEC AI Copilot 报告的见解:HTEC 团队评估了 26 个 AI 工具,由于测试有限,结果尚无定论,这让人对其关于 AI Copilot 的分析深度产生怀疑。

- 尽管参与者对每个工具都进行了“涉猎(dabbled)”,但该报告似乎更倾向于线索生成(lead generation),而非深入的可用性见解。

- 探索 Vim 和 Neovim 资源:成员们承认 Vim 的学习曲线陡峭,但指出一旦掌握,编码速度会显著提升,许多人通过完成 Vim Adventures 游戏来增强技能。

- 此外,社区成员分享了各种 Neovim 资源,包括一个 YouTube 配置播放列表,以促进学习和协作。

CUDA MODE Discord

- 创新量化技术:一名成员正在通过在测试期间对输入和权重进行独立的 quantization 和 dequantization 处理来提高模型精度,同时讨论激活值动态量化的优劣。

- 他们面临量化逻辑的调试问题,呼吁提供一个最小运行示例,以帮助理解和实际应用。

- Llama 3 集成仓库:已启动一个功能分支,用于向 llm.c 添加 Llama 3 support,从现有模型文件的副本开始,并保留计划中的 RoPE 和 SwiGLU 的 PRs。

- 这项工作旨在合并回 master 分支之前,纳入重大的进展和优化。

- 利用 Liger Kernel 协助微调 BERT:出现了关于使用 Liger kernel 进行 BERT fine-tuning 的求助,成员们在等待将 liger ops 集成到 Thunder 的增强功能时寻求参考代码。

- 在没有 liger ops 的情况下,可能需要对模型进行调整,从而引发了围绕满足模型要求的持续修改的讨论。

- 通过自定义算子简单提升性能:讨论了为 FFT 实现 Cooley-Tukey algorithm,并针对各种应用中的增强性能进行了优化。

- GH200 架构的 KV-cache offloading 也因其在 LLM inference 任务中最大化效率的重要性而受到关注。

- WebGPU Puzzles 发布用于学习:新推出的应用 WebGPU Puzzles 旨在通过直接在浏览器中进行的编码挑战来教授用户 GPU programming。

- 该应用由 Sarah Pan 和 Austin Huang 开发,利用 WebGPU 在不需要专用硬件的情况下实现 GPU 访问。

Interconnects (Nathan Lambert) Discord

- OpenAI o1 模型表现令人惊讶:新发布的 OpenAI o1 model 在 AIME 等基准测试中取得了令人印象深刻的分数,但在 ARC Prize 上的表现却出奇地低。

- 虽然 o1 擅长竞赛数学题,但其泛化到其他问题类型的能力仍然有限,这引发了对其部署的疑问。

- 加州 SB 1047 与 AI 监管:关于 AI safety 的 SB 1047 bill 提案由于政治影响,被否决的可能性预计在 66%-80%。

- 讨论表明,该法案的命运可能在很大程度上取决于周围的政治气候和公众对 AI 监管的看法。

- 关于 AI 模型基准测试公平性的辩论:围绕 AI 模型基准测试的公平性展开了讨论,特别关注与 o1 和 GPT-4o 等模型相关的 pass@k metrics 的复杂性。

- 参与者认为基准测试应该考虑计算预算,这使得直接比较变得复杂,尤其是考虑到 o1 独特的答案选择机制。

- 了解 API 分级系统:成员们强调,要在 API tier system 中达到 Tier 5,用户需要花费 $1000。一位用户分享说他们在 Tier 3,而另一个团队已经超过了 Tier 5。

- 这引发了关于支出层级对功能和能力访问影响的讨论。

- 对思维链推理的见解:o1 模型中的推理错误被指出会导致有缺陷的 Chain-of-Thought 输出,导致错误螺旋式上升并得出错误结论。

- 成员们讨论了这种现象如何揭示了维持 AI 推理连贯性的重大挑战,从而影响可靠性。

Stability.ai (Stable Diffusion) Discord

- A1111 vs Forge:性能权衡:用户比较了 A1111 和 Forge 在 XYZ 图表上的生成时间叠加,发现 Schnell 生成图像的速度通常更快,但代价是与 Dev 相比质量存在差异。

- 这引发了关于模型性能指标中速度与质量之间平衡的问题。

- Pony 模型:困惑重重:关于 Pony 模型 提示词的讨论凸显了训练数据的不一致性,用户对其分数标签(score tags)的有效性感到困惑。

- 对于这些提示词在实践中是否能产生预期结果,人们持怀疑态度。

- 警惕诈骗:保持警觉!:对欺诈性投资建议的担忧增加,强调用户需要对虚假加密货币计划保持警惕。

- 对话强调了在类似讨论中识别危险信号的至关重要性。

- 动态采样器:向前迈进:将 Dynamic compensation samplers(动态补偿采样器)集成到 AI 模型训练中,激发了用户对增强图像生成技术的兴趣。

- 社区对新工具及其对性能的潜在影响充满了热情。

- 关键 Token:创建高质量图像:分享了一系列有效的提示词 Token,如 ‘cinematic’ 和 ‘scenic colorful background’,展示了它们在提高图像生成质量方面的效用。

- 讨论强调了关于最佳 Token 使用的不同意见,以及对基于研究的见解的需求。

LM Studio Discord

- o1-preview 推出速度加快:成员报告称已分批获得

o1-preview的访问权限,在 Windows internals 等任务上表现出良好的性能。- 尽管大家非常兴奋,但一些用户对推出的速度表示沮丧。

- 辩论最大性能的 GPU 配置:讨论集中在单插槽 6x RTX 4090 还是双插槽 4x RTX 4090 设置能产生更优越的性能,特别是对于大型模型。

- 共识是,将模型放入 VRAM 至关重要,其表现通常优于更多依赖系统 RAM 的配置。

- 文本转语音 API 发布:一名成员发布了一个与 OpenAI 端点兼容的 Text-to-Speech API,强调其无需 GPU 即可实现的高效率。

- 集成细节可以在 GitHub 仓库中找到,鼓励用户参与。

- 市场趋势推高 GPU 价格:GPU 价格显著上涨,特别是 3090 和 P40 型号,这归因于 AI 任务需求的增长。

- 成员们分享了在当地市场寻找价格合理的 GPU 的困难经历,反映了更广泛的供需问题。

- VRAM 对模型性能的影响:参与者一致认为模型大小和可用 VRAM 会显著影响性能,建议不要对深度模型使用 Q8 设置。

- 有人呼吁进行更直接的查询,以协助新手优化其设置。

LlamaIndex Discord

- LlamaIndex.TS 发布新功能!:LlamaIndex.TS 现在可供 TypeScript 开发者使用,通过流线型集成增强了功能。请在 NPM 上查看。

- 该包旨在通过提供专门针对 TypeScript 开发者的关键工具来简化开发任务。

- LlamaIndex Hackathon 令人兴奋的现金奖励:第二届 LlamaIndex hackathon 定于 10 月 11 日至 13 日举行,为参与者准备了超过 $20,000 的现金和额度奖励。在此注册。

- 该活动围绕在开发高级 AI Agent 中实现 Retrieval-Augmented Generation (RAG) 展开。

- LlamaIndex 在 function calls 方面的局限性:讨论显示 LlamaIndex 在当前的 API 配置下不支持 function calls,从而阻碍了工具的使用。成员确认目前仍不支持 function calling 和 streaming。

- 鼓励用户关注更新,因为未来可能会推出新功能,或者探索替代配置。

- LlamaParse 展示高级 Excel 解析功能:一段新视频展示了 LlamaParse 的高级 Excel 解析功能,强调了其对多工作表和复杂表格结构的支持。在此查看演示。

- LlamaParse 采用的递归检索技术增强了无缝总结复杂数据设置的能力。

- 探索 ChromaDB 集成:一位用户寻求在 LlamaIndex 中使用 ChromaDB 检索文档上下文的帮助,特别是关于查询响应方面。建议他们检查

response.source_nodes以获取准确的文档上下文。- 讨论中明确了对元数据的依赖,提高了对 AI 查询中文档处理的理解。

Eleuther Discord

- KL Divergence 增强 RL 稳定性:成员们讨论了将 KL divergence 作为强化学习中的辅助损失的应用,以防止模型遗忘关键任务,特别是在 MineRL 体系中。

- 有人担心对齐的奖励函数可能会削弱 KL divergence 的益处,从而暴露当前 RL 方法的缺陷。

- 混合精度训练机制揭秘:针对在混合精度训练中同时使用 FP32 和 FP16 的基本原理提出了疑问,数值稳定性和内存带宽被列为主要考虑因素。

- 指出在某些操作中使用 FP32 可以显著减少不稳定性,而这种不稳定性通常是整体吞吐量的瓶颈。

- 探索 RL 中的 Off-Policy 方法:研究了强化学习中探索策略的细微差别,成员们一致认为像 Q-learning 这样的 off-policy 方法比 on-policy 方法提供了更好的探索灵活性。

- 讨论强调了在应用辅助损失项以促进探索,与避免创建单独且可能繁琐的探索策略之间保持微妙平衡的重要性。

- OpenAI 在知识获取方面达到新高度:一位参与者对 OpenAI 在知识民主化方面的贡献缺乏赞赏表示担忧,认为它实际上让每个人的口袋里都装进了一个博士。

- 这引发了关于社会对 AI 进步及其在日常应用中集成的看法的更广泛对话。

- Tokenizers 在添加新语言时需要重新训练:讨论了在 ML 模型中添加新语言时重新训练 tokenizer 的必要性,这标志着全面重新训练对有效性的重要性。

- 成员们承认,虽然有限的 pretraining 可能适用于结构相似的语言,但在自然语言语境下,全面的重新训练仍然至关重要。

Cohere Discord

- AdEMAMix Optimizer 引起关注:关于 AdEMAMix Optimizer 的讨论强调了其在提高 Parakeet 训练效率方面的潜力,可在 20 小时内达成目标。

- 成员们推测了其对模型训练策略的影响,强调了对各种效率技术的需求。

- Cohere API 支出限制设置:用户分享了通过 Cohere dashboard 设置 Cohere API 使用每日或每月支出限制的方法,以管理潜在成本。

- 一些用户在访问选项时遇到障碍,引发了联系 Cohere support 寻求解决的建议。

- 使用 Command R+ 进行律师考试微调:一位硕士毕业生寻求关于使用 Command R+ 微调 llama2 以应对美国律师考试的意见,并向其他用户征求建议。

- 小组建议进行本地实验,并仔细阅读 Cohere’s documentation 以获得最佳指导。

- AI 疲劳信号显现:成员们注意到 AI 进展中可能出现了实用性胜过炒作的转变,表明有用应用程序的增长趋势。

- 分析将此与该领域快速演变的技能要求相类比,将当前环境比作创新的“原始汤”。

- 在 API 请求上实施速率限制:有人建议针对每个 IP 地址应用 API requests 的速率限制,以减轻滥用并有效控制流量。

- 这种预防措施被认为对于防范恶意活动可能导致的突发使用高峰至关重要。

Modular (Mojo 🔥) Discord

- MAX 24.5 性能提升:MAX 24.5 已发布,在 int4k Llama token 生成方面实现了 45% 的性能提升,并为开发者引入了新的驱动接口。查看 MAX changelog 中的完整变更。

- 此版本使 MAX 成为更具竞争力的选择,特别是在依赖高效 token 处理的环境中。

- Mojo 24.5 带来 Python 支持:Mojo 24.5 增加了对隐式变量定义的支持,引入了新的标准库 API,并兼容 Python 3.12。详情可见 Mojo changelog。

- 这些增强功能表明 Mojo 拥有强劲的发展轨迹,在利用 Python 最新特性的同时简化了开发工作流。

- StringSlice 简化数据处理:一位成员强调了在 Mojo 中使用

StringSlice(unsafe_from_utf8=path)将Span[UInt8]转换为字符串视图的方法。该方法阐明了关键字参数在此上下文中的运作方式。- 理解这一点有助于更好地利用 Mojo 生态系统中的字符串处理,特别是对于数据驱动的任务。

- MAX 嵌入功能的替代方案:讨论明确了 MAX 缺乏对 Embedding 和向量数据库功能的内在支持;建议使用 ChromaDB、Qdrant 和 Weaviate 等替代方案进行语义搜索。一篇博客文章提供了利用这些工具增强语义搜索的示例。

- 这一缺失凸显了开发者需要利用外部库来实现全面的搜索功能。

- Google Colab 中的兼容性问题:由于安装问题,在 Google Colab 中运行 MAX 引起了关注;用户被鼓励创建 GitHub issues 以对此事进行调查。Colab Issue #223 记录了正在进行的讨论,以征求社区意见。

- 解决这些兼容性问题对于最大限度地提高使用流行 notebook 环境的开发者的可访问性至关重要。

OpenInterpreter Discord

- Open Interpreter Token 使用引发讨论:关于 Open Interpreter 仅在 6 次请求中就消耗了 10,000 tokens 的情况引发了关注,其效率受到了质疑。这开启了关于 Token 处理潜在优化策略的对话。

- 成员们正在积极讨论哪些策略可以在不牺牲功能的情况下提高 Token 利用率。

- iPhone App 设置所需步骤:一名成员请求关于启动新 iPhone app 的清晰指令,鉴于其初学者身份,寻求关于克隆 repo 和设置流程的指导。

- 另一名用户迅速推荐了这份设置指南以协助安装。

- LiveKit 连接挑战:有报告称在移动数据而非 Wi-Fi 环境下使用时,LiveKit 存在连接问题,导致在 MacBook 上的访问变得复杂。成员们要求提供复现这些连接错误的详细步骤。

- 随着用户推动协作排查以有效解决常见的 LiveKit 问题,社区参与度激增。

- 移动端 App 语音响应缺失:反馈指出 Open Interpreter 移动端 App 在提供语音响应方面存在困难,虽然能识别命令但无法执行语音输出。非响应式的女教师功能被特别提及。

- 随着用户指出 App 缺乏反馈,批评声浮现,敦促开发者优化用户交互并改善整体体验。

- 记录社区贡献:目前正在推动改进社区文档,特别是关于 LiveKit 设置的部分,据称 90% 的用户面临基础性问题。

- Mike 鼓励成员提交带有可行解决方案的 pull requests,强调了需要清晰指南来避开常见陷阱的必要性。

DSPy Discord

- 探索 O1 功能:在最近实现支持后,成员们正在测试 DSPy 的 O1 support,以期实现无缝集成。

- 活跃的讨论凸显了社区对从新功能中提取价值的浓厚兴趣。

- DSPy 2.4.16 版本非常出色!:DSPy 2.4.16 版本已正式发布,引入了增强用户体验的

dspy.LM功能。- 用户报告在更新后成功实现了 LiteLLM models,鼓励更广泛的采用。

- RAG:检索增强的瑰宝:成员们正在探索如何使用更新的 DSPy 模块将传统的 LLM 查询适配为 RAG(检索增强生成)。

- 社区分享了相关资源,包括 simple RAG 和 MIPRO compilation 的链接,推动了动手实验。

- 对 Google Vertex AI 的担忧:用户指出了 Google Vertex AI 的集成问题,报告称尽管设置正确但仍出现服务错误。

- 协作解决问题的重点集中在 LiteLLM models 的优化环境,强调了代理配置。

- RAG 讨论中的动态提示词:社区成员正在辩论在提示词中封装动态上下文以实现有效 RAG 实施的最佳实践。

- 对话强调了上下文驱动提示词在增强不同场景结果中的必要性。

OpenAccess AI Collective (axolotl) Discord

- 内存泄漏困扰 GPU Batch Size:讨论揭示了在每个 GPU batch size 使用打包样本(packed samples)时,PyTorch 中波动的 Tensor 大小会导致内存泄漏。

- 参与者对序列中的 Padding 表示担忧,强调需要解决方案来减轻这些内存陷阱。

- Upstage Solar Pro 模型引发热议:围绕 Upstage Solar Pro 模型的关注度激增,特别是其适用于最佳单卡推理的 22B 配置;并将其与 LLaMA 3.1 进行了对比。

- 尽管感到兴奋,成员们对创作者提出的大胆主张表示怀疑,警惕潜在的过度承诺。

- 对 Liger Kernels 的好奇:一位成员寻求关于实现 Liger kernels 的见解,希望从他人的经验中了解性能结果。

- 这一咨询反映了对增强 LLM 优化和可用性的广泛兴趣。

- 训练 phi-3.5 遇到障碍:训练 phi-3.5 的尝试令人沮丧,据报道 LoRA adapters 学习到的内容极少,相关问题已记录在 GitHub report 中。

- 参与者发现了一个可能导致训练结果不佳的潜在 Bug,并表达了他们的沮丧。

- Gradient Norms 引发困惑:一位用户在 LoRA 配置中设置了

max_grad_norm: 2,但却遇到了异常高的 grad_norm 值,峰值达到 2156.37。- 关于日志是否准确反映了裁剪值的问题仍然存在;该用户的 LoRA setup 还包括了针对 Pythia 模型的各种微调设置。

LAION Discord

- Llama 3.1 8B 微调版发布:一位成员宣布了 Llama 3.1 8B finetune model,并正在寻找合作者来增强其数据集,该模型作为 flection model 的概念验证。

- 这次讨论激发了对复制各种 YouTube 频道中看到的结果的兴趣,展示了实际应用和社区贡献。

- 对开源 SD 的担忧:一位参与者指出 Stable Diffusion 在开源领域似乎停滞不前,暗示社区贡献正在下降。

- “基本上,如果你关心开源,SD 似乎已经死了,” 这促使大家重新评估对开源项目的参与。

- 与 OpenSea 合作的 Free Mint 活动:服务器宣布与 OpenSea 合作,为成员提供新的 free mint 机会,可通过 CLAIM link 访问。

- 提醒参与者,某些领取过程可能会产生 gas fees,鼓励社区成员尽快行动。

- Tier 5 API 访问成本高昂:Tier 5 API access 与之前的模型(如 GPT-4o)相比,其成本效益引发了担忧,导致对其能力的乐观态度趋于谨慎。

- “不会比 gpt4o 差多少” 反映了在平衡预算与寻求 API 效能提升方面的讨论。

- STaR 技术增强模型训练:将 Chain-of-Thought (CoT) 与 Reinforcement Learning 相结合显著提升了模型性能,正如 STaR 技术在复杂推理任务中的有效性所强调的那样。

- 强调了高质量数据收集的重要性,并认为 “必须是聪明人参与,所以它不可能便宜,” 肯定了数据智能与模型训练效果之间的联系。

Torchtune Discord

- Torchtune 0.2.1 在 Mac 上安装失败:由于未满足 torchao==0.3.1 的依赖关系,torchtune 0.2.1 版本在 Mac 上安装失败,导致其在 MacBook 上无法使用。成员们指出,即将发布的 torchao 0.6.0 可能会通过提供 macOS wheels 来解决此问题。

- 影响 Mac 安装的问题引发了不满,进一步强调了在未来版本中需要更平滑的依赖管理。

- 支持 Mac M1 的 torchao wheels 现已发布:torchao wheels 现已确认可用于 Mac M1,显著提升了 Mac 用户的兼容性。预计此更新将增强在该架构上运行 torchtune 的功能。

- 兼容性的提升提供了一条切实可行的路径,允许用户在 M1 环境下更好地利用 Torchtune。

- 将 Recipe 测试切换至 GPU:成员们讨论了将当前的 recipe 测试从 CPU 迁移到 GPU 的方案,此前由于历史限制,这一操作一直受到约束。有人建议将测试指定为 GPU 特有(GPU-specific),以确保在 GPU 不可用时保持灵活性。

- 这一转变被定位为充分发挥计算能力并简化未来测试流程的关键。

- 增强型 Batched Generation 计划:一个旨在优化 batched generation 的新型轻量级 recipe 正在开发中,意在与项目目标和用户需求保持一致。社区非常鼓励对这一新方法提供反馈。

- 成员们表示渴望参与这一生成优化方案的测试,该方案旨在简化流程的同时保持有效性。

- 可迭代数据集的 Online Packing 即将推出:未来计划包括为可迭代数据集(iterable datasets)实现 online packing,有望在工作流中实现更好的数据处理和操作效率。这一进展旨在支持 Torchtune 内部的持续开发。

- 社区期待其数据策略的增强,并对迭代过程的潜在影响感到兴奋。

LangChain AI Discord

- LangChain AWS ChatBedrockConverse 与对话历史:一位用户询问 LangChain 的 AWS ChatBedrockConverse 是否支持在检索链中维护 conversational history(对话历史),这对于对话式 AI 功能至关重要。

- 这引发了关于 AI 框架内历史管理影响的讨论。

- 向量数据库实现困难:一位用户报告了在实现 Upstash Redis 以替换内存中的 MemoryVectorStore 来存储 PDF 分片的向量嵌入(vector embeddings)时遇到的挑战。

- 他们寻求社区帮助,并提到在使用 Pinecone 等替代方案时也遇到了问题。

- Warhammer Adaptive RAG 项目初具规模:一位社区成员分享了一个专注于 Warhammer Adaptive RAG 的 GitHub 项目,寻求关于 hallucination(幻觉)和 answer grading(答案评分)等功能的反馈。

- 反馈强调了该项目对 local models(本地模型)的创新使用。

- Vantager 的 AI 工程师职位机会:一位成员宣布了 Vantager 招聘 Founding AI Engineer(创始 AI 工程师)的消息,该公司致力于开发用于资本配置的 AI 原生平台。

- 鼓励候选人查看 job board(招聘板)了解详情,并提到了 VC 的支持以及对解决重大数据挑战的关注。

- OpenAI 的变革性影响:一位成员对 OpenAI 的进步表示惊叹,认为这感觉就像是“给每个人的口袋里都塞进了一个博士”。

- 他们对社会是否充分理解这些技术带来的冲击性变化表示担忧。

tinygrad (George Hotz) Discord

- 论坛成员讨论礼仪:一位成员强调了基本论坛礼仪的重要性,指出重复的求助请求可能会挫伤他人提供帮助的积极性。

- 浪费他人时间会阻碍社区参与,呼吁采用更好的沟通实践。

- Tinygrad 的 MypyC 编译进展:一位成员详细介绍了他们进行 MypyC 编译的系统方法,为了提高效率,从整个项目深入到单个文件。

- 编译的文件包括

tinygrad/device.py和tinygrad/tensor.py,表明项目取得了重大进展。

- 编译的文件包括

- 使用 Tinygrad 成功运行 Llama-7B:该成员使用 Llama-7B 模型成功运行了 examples/llama.py,并指出平均耗时提升了 12%。

- 他们提供了 Llama-7B 仓库的链接以供参考所使用的模型。

- 为 MypyC 功能修改代码:对多个文件进行了代码修改,包括重写生成器和添加装饰器,以启用 MypyC 功能。

- 该成员将他们的更改描述为初稿,在进一步完善之前寻求团队反馈。

- C 扩展的未来考虑:该成员建议,如果要将 C 扩展集成到 Tinygrad 中,应采取逐步推进的方法以方便更改。

- 他们渴望在完成贡献之前,确保正在进行的工作与更广泛的项目目标保持一致。

Gorilla LLM (Berkeley Function Calling) Discord

- Gorilla OpenFunctions 模型准确率为零:gorilla-openfunctions-v2 模型的评估在 258 次测试后返回的准确率为 0.0,尽管 model_result_raw 与 possible_answer 一致。

- 这种异常现象表明可能存在更深层次的问题,需要进行超出表面输出的进一步调查。

- 解码 AST 抛出错误:在执行用户信息函数期间出现错误,具体表现为 Invalid syntax. Failed to decode AST 消息。

- 报告还强调了数据类型不匹配,指出无法将 str(而非 ‘list’)连接到 str,这表明可能存在 bug。

- 用户信息检索成功完成:模型成功检索了 ID 7890 的用户信息,确认用户名为 user7890,电子邮件为 user7890@example.com。

- 此操作完成了对 黑色 特殊物品的特定请求,在报告的问题中展示了部分功能。

LLM Finetuning (Hamel + Dan) Discord

- 微调 LLM 以获得更好的翻译:一位成员询问了专门针对翻译微调 LLM 的经验,指出许多模型虽然能捕捉大意,但会遗漏关键的语气和风格元素。

- 这凸显了改进翻译质量技术以保留本质细微差别的必要性。

- 在翻译中捕捉语气的困难:虽然 LLM 提供了不错的翻译,但它们往往难以有效地传达原始的语气和风格。

- 成员们呼吁分享增强翻译忠实度的方法和见解,以应对这些长期存在的挑战。

MLOps @Chipro Discord

- Fleak AI 举办私人聚会:Fleak AI 今晚在旧金山的此地点为其社区组织了一场私人欢乐时光(happy hour)活动,旨在讨论更新并促进联系。

- 这次聚会提供了一个与同行开发者和用户建立网络并进行互动的机会,增强了社区纽带。

- Fleak 作为 Serverless API 构建器:Fleak 将自己定位为专为 AI 工作流量身定制的 Serverless API 构建器,特别擅长 sentiment labeling(情感标注)等功能。

- 这一功能使 Fleak 成为希望在项目中简化 API 集成的开发者的宝贵工具。

- Fleak 专注于社区建设:该活动旨在通过更频繁的线下聚会(从这次欢乐时光活动开始)来加强社区参与。

- 组织者希望营造一个温馨的环境,鼓励参与者之间进行开放式讨论和建立联系。

Alignment Lab AI Discord 没有新消息。如果该频道(guild)长时间没有活动,请告知我们,我们将将其移除。

Mozilla AI Discord 没有新消息。如果该频道(guild)长时间没有活动,请告知我们,我们将将其移除。

DiscoResearch Discord 没有新消息。如果该频道(guild)长时间没有活动,请告知我们,我们将将其移除。

AI21 Labs (Jamba) Discord 没有新消息。如果该频道(guild)长时间没有活动,请告知我们,我们将将其移除。

第 2 部分:频道详细摘要和链接

完整的频道分类明细已在邮件中截断。

如果你喜欢 AInews,请分享给朋友!提前致谢!