ainews-a-quiet-weekend-8098

一个安静的周末

OpenAI 发布了全新的 o1 模型,该模型利用强化学习和思维链提示(chain-of-thought prompting)在推理基准测试中表现卓越,并取得了高达 120 分的类智商得分。Google DeepMind 推出了 DataGemma,旨在通过将大语言模型(LLM)与现实世界数据相连来减少“幻觉”现象,同时还发布了利用扩散方法提升机器人灵巧性的 ALOHA 和 DemoStart。Adobe 预展示了其 Firefly AI 视频模型,具备文本生成视频和生成式扩展功能。Mistral 推出了多模态模型 Pixtral 12B,而腾讯则展示了 GameGen-O 开放世界视频游戏生成模型。来自斯坦福大学、OpenAI、微软、Mila 和圣母大学的多篇研究论文聚焦于高级推理、自我验证和反思微调(reflection tuning)技术。陶哲轩(Terence Tao)和 George Hotz 等专家对 o1 的能力发表了虽有分歧但总体乐观的看法。种子轮融资方面,Supermaven 筹集了 1200 万美元,11x 筹集了 2400 万美元。

Patience is all you need.

2024年9月13日至9月16日的 AI 新闻。我们为您检查了 7 个 subreddits、433 个 Twitter 和 30 个 Discord(220 个频道,6976 条消息)。预计节省阅读时间(按 200wpm 计算):757 分钟。您现在可以标记 @smol_ai 进行 AINews 讨论!

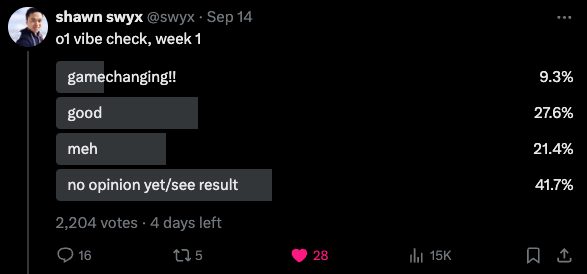

大家整个周末都在探索 o1,目前的评价相当两极分化:

天体物理学博士们、George Hotz 和 Terence Tao 都很喜欢它,还有人手动在自定义 IQ 测试中给它打出了 120 分。

其他新闻:

- Supermaven 宣布了由 Bessemer 领投的 1200 万美元种子轮融资

- 11x 宣布了由 Benchmark 领投的 2400 万美元 A 轮融资

- Luma Labs 推出了 Dream Machine 的 API

- Cohere、Anthropic 和 Latent Space University 推出了课程。

让人不禁好奇,即将推出的 Gemini 2 究竟需要多强大才能与 o1 媲美……

AI Twitter 摘要

所有摘要均由 Claude 3.5 Sonnet 完成,取 4 次运行中的最佳结果。

AI 模型进展与行业动态

-

OpenAI 的 o1 模型:OpenAI 发布了名为 “o1” 的新模型(也称为 Project Strawberry/Q*),该模型使用强化学习和 Chain-of-Thought(思维链)在回答前进行“思考”。@adcock_brett 指出它打破了推理基准。根据 @rohanpaul_ai 的说法,该模型在 IQ 测试中获得了 35 题中的 25 个正确答案,超越了大多数人类。

- Google DeepMind 进展:

- Google 推出了 DataGemma,旨在将 Large Language Models 与现实世界数据连接起来,目标是减少 AI 幻觉 @adcock_brett。

- DeepMind 展示了两个新的 AI 系统,ALOHA 和 DemoStart,利用 Diffusion 方法提升了机器人的灵巧性 @adcock_brett。

- 其他行业动态:

- Adobe 预览了其 Firefly AI Video Model,具有 Text to Video、Image to Video 和 Generative Extend 等功能 @adcock_brett。

- 法国 AI 初创公司 Mistral 发布了 Pixtral 12B,这是一个能够同时处理图像和文本的多模态模型 @adcock_brett。

- 腾讯展示了 GameGen-O,一个“开放世界视频游戏生成”模型 @adcock_brett。

AI 研究与论文

- 重点介绍了多篇可能有助于理解 OpenAI o1 模型的论文,包括:

- 斯坦福大学的 “Quiet-STaR: Language Models Can Teach Themselves to Think Before Speaking”

- MultiOn/斯坦福大学的 “Agent Q: Advanced Reasoning and Learning for Autonomous AI Agents”

- OpenAI 的 “Let’s Verify Step by Step”

- 微软、Mila 的 “V-STaR: Training Verifiers for Self-Taught Reasoners”

- 圣母大学、腾讯的 “Learn Beyond The Answer: Training Language Models with Reflection for Mathematical Reasoning” @_philschmid

- 提到了一篇关于 “Selective Reflection-Tuning” 的论文,描述了 2023 年 Reflection-Tuning 方法的改进版本 @rohanpaul_ai。

AI 能力与基准测试

-

@bindureddy 声称 AI 的 IQ 已达到 120,超越了大多数人类,但指出它在感知和环境理解方面仍有欠缺。

-

@fchollet 评论说,虽然 AI 可以泛化,但仅限于局部泛化,在面对简单的问题修改或新颖问题时仍然会失效。

-

著名数学家陶哲轩(Terence Tao)对 o1 的数学能力发表了评论,结论褒贬不一,但总体持乐观态度 @mathemagic1an。

行业观点与辩论

-

关于 “Large Language Models” (LLMs) 这一术语的讨论,有人认为它正变得名不副实 @karpathy。

-

@ylecun 批评对非时间序列进行 Auto-regressive 预测是“纯粹的谬误”。

-

Sam Altman 评论说,o1 标志着一个重要新范式的开始,并就 AI 进展表示“未来几年我们已稳操胜券” @rohanpaul_ai。

AI Reddit 摘要

/r/LocalLlama 摘要

主题 1. Llama 3.1 405B:GPT-4 的开源竞争对手

- Llama 405B 在本地运行! (Score: 81, Comments: 23): 该帖子展示了 Llama 405B 在 Apple Silicon 硬件上本地运行的情况,具体包括 Mac Studio M2 Ultra 和 Macbook Pro M3 Max,速度达到了 2.5 tokens/sec。该设置由 Exo (https://github.com/exo-explore) 和 Apple MLX 作为后端引擎驱动,Apple MLX 的创建者还分享了一个重要的优化技巧,即通过设置特定的 sysctl 参数来提升性能。

- 通过向集群中添加一个配备 3090 GPU 的 Linux 系统,Llama 405B 的性能得到了进一步提升,达到了 153.56 TFLOPS。该设置使用 wifi 进行设备间的连接。

- 该项目利用了 4-bit quantization,通过 GPU 的吞吐量接近 500GB/sec。开发者正在探索使用 tinygrad 集成 Nvidia 3090。

- 虽然 2.5 tokens/sec 的速度被认为是可以接受的,但在 Prompt 仅有 6 个 token 的情况下,30.43 秒的首个 token 响应时间被指出是一个局限。用户可以通过 Exo GitHub repository 尝试该设置。

- 我用我的小规模基准测试运行了 o1-preview,它的得分与 Llama 3.1 405B 几乎完全一致 (Score: 169, Comments: 52): Llama 3.1 405B 和 OpenAI 的 o1-preview 模型在一次小规模基准测试中获得了几乎相同的分数。基准测试结果表明,o1-preview 可能是 Llama 3.1 405B 的一个微调版本,这可能暗示了 Meta 与 OpenAI 之间的合作。这种性能对等也意味着 o1-preview 在某些任务中可能达到了 GPT-4 的水平。

- 基准测试的创建者 dubesor86 分享了完整的基准测试结果,并指出由于严格的额度限制,测试成本非常昂贵。模型之间的价格差异归因于基础成本乘以所使用的不可见 token 的数量。

- 几位用户对 Claude 3.5 Sonnet 在编程基准测试中出人意料的低表现提出了质疑,特别是与大众共识和个人体验相比。基准测试创建者强调,结果会根据具体用例和技能水平而有所不同。

- 用户讨论了通过使用类似于 o1 的 Chain of Thought (CoT) 提示词来提高 Llama 在推理任务中表现的潜力。基准测试创建者对此表示感兴趣,但更倾向于在官方结果中保持模型的默认行为。

主题 2. O1 模型的先进推理能力

- 受新 o1 模型的启发,Benjamin Klieger 在 @GroqInc 上利用 Llama-3.1 快速开发了 g1 (Score: 260, Comments: 58): Benjamin Klieger 开发了 g1,这是一个受 O1 启发并在 Groq 硬件上由 Llama-3.1 驱动的模型。该实现旨在利用 Llama-3.1 架构复制 O1 的推理能力,从而可能在替代基础设施上提供类似的性能。

- Benjamin Klieger 的 infinite bookshelf 项目引起了关注,讨论集中在其对 Groq 的依赖以及本地实现的潜力。一位用户分享了一个有趣的晚餐模拟,参与者包括历史人物和来自未来的 AI。

- 用户辩论了仅通过提示词复制 O1 性能的有效性,质疑带有多步训练数据的强化学习是否对 O1 的能力至关重要。一些人建议使用 Chain of Thought (CoT) 输出进行进一步的模型微调。

- 提议的使用 JSON 格式进行逐步解释的推理提示词遭到了批评,用户指出强制模型以 JSON 格式响应会降低回答质量,特别是对于像 Llama 这样的小型模型。

- 这是揭示 o1 思考步骤的方法吗? (得分: 92, 评论: 41): 该帖子讨论了一种通过 prompt engineering 技巧 揭示 o1 思考步骤 的潜在方法。该技术涉及要求 o1 解释其任务每一步的推理过程,旨在理解 AI 的决策过程。然而,这种方法在真实揭示 o1 内部思维过程方面的有效性仍不确定。

- 用户建议 o1 的思考步骤 可能由一个 较小的 LLM 进行总结,这使得揭示真实的内部过程变得困难。一些人推测这可能是一个 agentic system 或由 专门的 Agent 协调任务。

- 试图揭示 o1 的 chain of thought 可能会导致 OpenAI 发出取消 o1 访问权限的威胁。用户报告收到了警告此类尝试的电子邮件,导致对该模型的探测减少。

- 关于 o1 能力的理论包括一种潜在的 带有 reflection tokens 的算法,允许在 inference 期间进行递归循环,以及通过训练来识别并避免响应“不良”指令,同时保持对这些指令的内部模型。

主题 3. 在线 LLM 提供商和服务对比

- 大型 LLM 提供商,你使用哪一个以及为什么? (得分: 46, 评论: 39): 该帖子讨论了为无法在本地运行大型模型的用户提供的 各种大型语言模型 (LLM) 提供商,提到了 Together, Poe, You.com, Groq, OpenRouter 和 Fireworks 等选项。作者对 Poe 与原始模型相比输出长度缩短表示不满,并寻求其他提供商的建议,询问选择付费服务的标准,以及如何识别那些使用未经修改且没有人工缩短输出的 LLM 提供商。

- OpenRouter 因其丰富的模型种类、定价选项和免费选择而受到高度推荐。用户赞赏其负载均衡功能以及在不更改 API 请求的情况下切换支持模型的能力。

- 几位用户更喜欢组合使用提供商,包括 OpenAI, Anthropic, Google, Together.AI 和 vast.AI/RunPod。这种方法可以获得 SOTA 性能、免费选项以及运行独特模型的能力,每月费用通常在 $15 以下。

- Google Gemini 和 Cohere 因其免费计划而受欢迎,而一些用户则选择本地解决方案(如 Ollama)或开源替代方案(如 open-webui),以避免订阅费并保持数据控制。

- 我对 o1-preview 进行了小规模基准测试,其得分与 Llama 3.1 405B 几乎相同 (得分: 169, 评论: 52): o1-preview 在一次小规模基准测试中表现与 Llama 3.1 405B 几乎完全一致。该基准测试包括 算术、常识推理 和 语言理解 等各种任务,两种模型在各项测试中都取得了相似的分数。这表明 o1-preview 可能是 Llama 3.1 405B 的有力竞争替代方案,尽管需要对更大规模的基准测试进行进一步测试以确认这些初步发现。

- 基准测试的创建者 dubesor86 分享了 完整基准测试结果,并指出由于 严格的限制 (harsh caps) 和 不可见 token (invisible tokens),测试成本非常昂贵。模型之间的定价差异归因于基础成本乘以 token 使用量。

- 用户质疑 Claude 3.5 Sonnet 在代码任务中的表现不佳,这与他们的个人体验相反。基准测试创建者强调,结果因具体用例而异,“编程”是一个具有多样化需求的宽泛术语。

- o1-preview 的基准测试成本大约比测试 Llama 3.1 405B 贵 52 倍。用户对测试方法表示关注,包括本地构建、租用实例和 API 使用。

主题 4. 本地 LLM 工具和应用的进展

-

分享我的屏幕分析叠加 (Screen Analysis Overlay) 应用 (得分: 58, 评论: 10): 该帖子介绍了一款 屏幕分析叠加应用,旨在配合 本地 LLM 进行实时屏幕分析。该应用捕获屏幕,通过本地 LLM 进行处理,并将结果显示为叠加层,允许用户在与计算机交互的同时接收关于屏幕内容的 AI 驱动见解。开发者提到计划将该项目开源,并寻求关于潜在用例和改进的反馈。

-

我大幅更新了我的 Python 程序,它允许通过 llama.cpp 运行的本地 LLM 在互联网上查找信息,现在它能够完整地对最相关的结果进行网页抓取(web scraping)! (Score: 133, Comments: 19):作者显著更新了他们的 Python 程序,该程序使通过 llama.cpp 运行的 local LLMs 能够访问互联网信息,现在支持对最相关的搜索结果进行完整的 web scraping。该程序允许 LLM 选择搜索查询,从 10 个结果中挑选 2 个最相关的结果,从这些结果中收集信息,并进行进一步搜索或回答用户的问题。此次更新还包括一个 llm_config.py 文件,用于自定义 llama.cpp settings 并启用 GPU support。更新后的项目已在 GitHub 上发布。

- 用户对该项目表示赞赏,其中一位建议增加 OpenAI compatible API endpoints 以提高可用性。作者同意着手实现这一功能,并指出这大约需要“几周时间”。

- 讨论显示 llama-cpp-python 具有内置的 OpenAI compatible API,这可以作为将该项目集成到更大规模个人助手工作中的起点。用户强调了在带有 OpenAI API 的服务器上运行 llama.cpp 的潜在性能优势。

- 讨论中提供了一个详细的实现建议,包括 spin up the server、modularize the code 以及 refactor get_llm_response() 以查询 API 终端。评论者称赞了该项目的简洁性和实现方法。

其他 AI Subreddit 回顾

r/machinelearning, r/openai, r/stablediffusion, r/ArtificialInteligence, /r/LLMDevs, /r/Singularity

AI 模型进展与能力

-

OpenAI 的 o1 模型在推理和编程能力方面表现出显著提升:多篇帖子强调了 o1 的能力,包括从零开始创建视频游戏、生成复杂的动画以及执行大规模代码重构。该模型在需要长时间推理的任务中表现尤为出色。

-

AI 能力的飞速进步:帖子讨论了据报道 o1 的 IQ 提升了 30 点,达到 120 IQ,超越了 90% 的人类。另一篇帖子提到 OpenAI 的路线图暗示模型很快将达到博士级推理水平并具备 Agent 般的能力。

-

多模态 AI 的改进:一篇 Google Deepmind 论文展示了通过联合样本选择在多模态学习方面取得的进展。

AI 研究与基础设施

-

前沿 AI 模型对计算能力的巨大需求:Oracle 的 Larry Ellison 讨论了建造核反应堆为大型 GPU 集群供电的计划,估计 3 年内成本将达 1000 亿美元,以在 AI 开发中保持竞争力。

-

AI 推理速度的突破:Microsoft 的 MInference 技术能够在保持准确性的同时,为长上下文任务实现高达数百万 Token 的推理。

-

合成数据创建的新方法:一篇关于扩展合成数据创建的论文利用 LLM 中的多样化视角,从 10 亿个网络策划的 Persona(人格角色)中生成数据。

AI 模型发布与对比

-

Salesforce 发布 xLAM-1b:尽管规模较小,这个 10 亿参数的模型在 Function Calling(函数调用)方面实现了 70% 的准确率,超越了 GPT 3.5。

-

现有模型的更新:Rubra AI 发布了更新后的 Phi-3 Mini 模型,具备 Function Calling 能力,可与 Mistral-7b v3 竞争。

-

模型间的对比:一份关于 o1-mini 和 Claude Sonnet 3.5 在编程任务中的详细对比突出了各模型的优缺点。

AI 的社会与经济影响

-

潜在的就业市场冲击:一份报告指出 AI 将在一年内影响 6000 万个美国和墨西哥的工作岗位。

-

关于 AI 对各行业影响的辩论:围绕 AI 进展如何影响软件开发和其他知识型工作的讨论。

AI 应用与工具

-

AI 生成内容创作:示例包括用于图像生成的微缩人物 LoRA以及用于心理健康支持的肯定卡片。

AI Discord 回顾

由 o1-preview 生成的摘要之摘要的摘要

主题 1:OpenAI 的 o1 模型引发 AI 社区辩论

-

O1 模型在给人留下深刻印象的同时也同样令人失望:OpenAI 的新 O1 模型(o1-preview 和 o1-mini)引起了轰动,一些用户称赞其推理能力,而另一些用户则认为其回答过于机械化且不尽如人意。这些模型褒贬不一的反响突显了在推进 AI 推理方面持续存在的挑战。

-

社区质疑 O1 相较于现有模型的优势:用户正在将 O1 与 GPT-4o 等模型进行比较,争论 O1 的思维链推理(chain-of-thought reasoning) 是否带来了显著改进,还是仅仅是炒作。讨论集中在 O1 在复杂任务中的表现及其在现实世界中的适用性。

-

关于 O1 开发和数据使用的猜测不断涌现:爱好者们正在对 O1 进行逆向工程(reverse engineering),以了解其训练过程以及对用户交互数据的依赖。对隐私的担忧以及在开源模型中复制 O1 能力的可行性引发了激烈的辩论。

主题 2:AI 编程工具改变开发工作流

-

Aider 和 O1 在 Bug 修复方面胜过竞争对手:开发者们正在庆祝 Aider 和 OpenAI 的 O1 在 Bug 修复方面的表现优于 Claude 等模型。这些工具提供详细的、分步的输出,简化了复杂代码库中的故障排除工作。

-

Cursor AI 轻松应对大规模代码库编辑:Cursor AI 正在解决令 O1 等模型望而却步的大规模代码编辑挑战。其专门的编程助手通过更高效地处理重大变更来提高生产力。

-

AI 在编程中日益增长的角色引发就业市场担忧:围绕 AI 可能取代初级开发人员的讨论正在加剧,引发了关于人类在编程中未来角色的对话。重点在于促进 AI 与人类协作,以保持资深开发人员的竞争力。

主题 3:模型微调与训练依然复杂

-

对表现不佳模型的挫败感与日俱增:Gemma2、Mistral 和 Phi 3.5 等模型在训练期间表现不佳,导致用户感到恼火。挑战包括高 VRAM 占用和不理想的输出,突显了对更好训练解决方案的需求。

-

LLama 3.1 成为一个亮点:在普遍存在的训练问题中,LLama 3.1 以其强劲的性能脱颖而出。用户报告称,与其他模型相比,其效果更好,尽管由于其复杂性,用户仍面临配置障碍。

-

INT8 混合精度训练带来显著加速:INT8 混合精度训练(mixed-precision training)的引入有望在 NVIDIA 4090 GPU 上实现高达 70% 的加速。这一进步允许在不牺牲准确性的情况下实现更快的训练,特别是在消费级硬件上。

主题 4:AI 的创意应用受到关注

-

GameGen-O 开启游戏开发新前沿:腾讯的 GameGen-O 推出了一种扩散 Transformer(diffusion transformer)模型,可以生成开放世界视频游戏。这一创新令渴望利用 AI 加速游戏创作的开发者们感到兴奋。

-

艺术家利用 AI 进行角色设计和动画制作:创意人士正在使用 Stable Diffusion、ControlNet 和 LoRA 训练来制作令人惊叹的角色设计和动画。这些工具正在彻底改变艺术工作流,并扩展了数字艺术的可能性。

-

Diffusion Illusions 以令人惊叹的艺术作品吸引眼球:Diffusion Illusions 项目展示了通过扩散模型生成的交互式视错觉作品。该项目已被 SIGGRAPH 2024 接收,它推向了 AI 生成艺术和视觉感知的边界。

主题 5:围绕 AI 技术的安全与伦理担忧

-

StealC 恶意软件利用 Chrome 钓鱼获取密码:新的 StealC 恶意软件将 Chrome 用户困在全屏模式下,强迫他们通过虚假登录页面泄露 Google 密码。这种复杂的攻击引发了对浏览器安全漏洞的警惕。

-

关于 AI 模型审查的辩论升温:用户对 Phi 3.5 等模型中严重的审查(censorship)感到不满,这阻碍了技术任务和编程辅助。社区呼吁在必要的审核与 AI 模型的实际效用之间取得平衡。

-

“Humanity’s Last Exam” 倡议引发争议:Dan Hendrycks 宣布为在 Humanity’s Last Exam 中用难题挑战 AI 提供 500,000 美元奖金池。虽然一些人对推动 AI 进步的努力表示赞赏,但另一些人则对其在 AI 监管和政策影响方面的含义表示担忧。

第一部分:Discord 高层摘要

aider (Paul Gauthier) Discord

- O1 在 Bug 修复方面优于 Claude:O1 在 Bug 修复方面表现出色,在速度和准确性上超过了 Sonnet 等 Claude 模型,尤其是在编程场景中。

- 用户强调了 O1 提供详细输出的能力,有助于解决复杂的代码故障。

- Sonnet 3.5 面临兼容性问题:Sonnet 3.5 在处理较大上下文时表现吃力,且会误解指令,这让处理复杂编程任务的用户感到沮丧。

- 相比之下,O1 的输出被描述为直接且有效,最大限度地减少了困惑。

- Aider 脚本实现工作流自动化:Aider 用户可以使用命令行

--message参数简化任务,直接发送命令以实现流程自动化。- 这种方法允许通过简单的 Shell 脚本在多个文件上更轻松地进行批处理。

- Game Gen - O 彻底改变游戏开发:Game Gen - O 的推出为基于 Diffusion-Transformer 模型的开放世界视频游戏创作提供了新功能。

- 该工具在社区中引起了轰动,因为它有望加速 AI 驱动的游戏开发。

- The Big Prompt Library 发布:Big Prompt Library 仓库提供了一系列 Prompt 和 LLM 指令,帮助用户进行有效的 Prompt 构建。

- 该资源对于使用 ChatGPT 和 Claude 等系统的开发者至关重要,提升了用户体验。

Unsloth AI (Daniel Han) Discord

- Gemma2 和 Mistral 模型表现不佳:用户指出 Gemma2 和 Mistral 在训练中表现不佳,特别是与 LLama 3.1 相比,同时对 VRAM 限制感到沮丧。

- 针对成功训练所需的必要配置提出了担忧,这使工作流变得复杂。

- LLama 3.1 在性能上表现出色:随着用户发现 LLama 3.1 的表现优于其他尝试过的模型,热情高涨,而 Gemma 2 9B 在适当设置下也显示出潜力。

- 成员们注意到由于 Gemma 2 体积较大,需要调整设置,并引发了关于优化的讨论。

- 求职成为新热潮:随着求职活动全面展开,成员们注意到在机器学习市场回暖之际,人们开始投资 LinkedIn Premium 等服务以寻求机会。

- 一位博士持有者正在经历从学术界向企业的转型,原因是机器学习领域的博士后职位正在缩减。

- 关于招聘流程的辩论:对话围绕倡导公平的招聘流程展开,挑战那些看重记忆力而非技能评估的传统方法。

- 招聘中强调技能和增长潜力而非单纯的人脉,旨在建立一种改进后的模型。

- 对 DPO 的质疑引发了替代方案的建议:一位成员对 Direct Preference Optimization (DPO) 表示怀疑,暗示在工作中探索 KTO 等替代方案。

- 与会者之间出现了关于 DPO Loss 类型的持续讨论以及分享经验的愿望。

OpenRouter (Alex Atallah) Discord

- 用户讨论 OpenRouter 模型的上下文限制:针对 OpenRouter 上各种模型显示的上下文长度产生了疑虑,特别是扩展版本的支持大小与声明内容之间存在差异。

- 这引发了对提高模型能力透明度和更新沟通方式的呼吁,以便用户更清晰地理解。

- 性能问题引发模型审查:用户报告了 Venus Chub AI 和 WizardLM-2 等模型出现异常输出和响应中断的情况,引发了对不同提供商之间一致性的警惕。

- 正在进行的讨论旨在收集用户体验,以确定这些问题是普遍存在的还是孤立事件。

- 有效的 Prompt Engineering 技术成为关注焦点:关于使用 XML 标签以改进模型响应的讨论非常突出,同时也分享了优化 Prompt Engineering 的教育资源。

- 分享的教程侧重于 Prompt 操作方法,为提高 AI 交互中的用户参与度提供了见解。

- 集成与 API 配置混淆警报:有报告称 hyperbolic key 被链接到了非预期的计费提供商,引发了关于命名规范和集成清晰度的讨论。

- 用户表示需要在 JSON 配置中加入更强大的错误处理机制,特别是要求强制检查集成密钥的存在,以提高设置的可靠性。

- 提供商配置期间需要失败反馈:讨论强调了用户在配置提供商时无法查看失败详情的挫败感,这增加了排查问题的难度。

- 用户寻求 OpenRouter 提供更清晰的机制,以有效识别和解决集成问题,从而提高整体设置的成功率。

Perplexity AI Discord

- Perplexity AI 的性能挑战:用户报告 Perplexity AI 经历了严重的延迟和服务器宕机,引发了对平台高流量导致响应延迟的担忧。

- 这一持续存在的问题引发了对其在高峰使用时段服务可靠性的质疑。

- API 错误频发:成员注意到 API 调用返回了 500 和 524 等错误,导致人们怀疑存在影响运营的广泛问题。

- 随着用户讨论引用输出的不一致和超时问题,担忧进一步升级,呼吁改进对 API 交互的处理。

- AI 模型的对比分析:用户对比了各种 AI 模型,观察到在显著场景下,原始的 OpenAI 模型表现优于 You.com 和 Monica 等替代方案。

- 即将推出的 Opus 3.5 模型被视为潜在的游戏规则改变者,预计将超越现有的性能基准。

- Korean Emotion Video Dataset 的出现:对 Korean Emotion Video Dataset 的兴趣达到顶峰,该数据集旨在增强 AI 的情感识别能力,为实际应用开辟了道路。

- 讨论强调了其对研究和 AI 系统情感智能影响的兴奋感。

- Microstrategy 对加密货币的大胆押注:对话集中在 Microstrategy 的十亿美元投资上,分析了其对加密货币市场的潜在影响。

- 成员们辩论了该公司的战略策略,评估了与市场稳定性相关的风险。

HuggingFace Discord

- LLM 微调中的挑战:用户在利用 FSDP 和 BF16 AMP 微调 Llama 8b 等模型时面临 29G 的高 GPU 显存占用,促使一些人回归原生 PyTorch 调用进行调试。

- 这一问题引起了对 LLM 训练中资源管理的关注,并突显了对优化显存消耗的持续追求。

- 改进的 Inference API 文档:根据用户反馈,Hugging Face Inference API 文档已得到改进,具有更清晰的速率限制和更好的代码示例。此次更新旨在简化 AI 部署,使其更加用户友好。

- 正如此公告所示,此举展示了 Hugging Face 致力于提升用户体验的承诺。

- 新型医疗 LLM 及其影响:Chai-1 Foundation model 在预测分子结构方面表现出色,为 medical AI 的进步做出了贡献,正如最近的更新所述。

- BrainWave 和 DS-ViT 等创新模型正在推进诊断评估技术,推动模型训练数据集实现更高的透明度。

- 多语言模型的高效 Tokenizer 训练:关于重新训练 Tokenizer 的讨论强调了在保持原始数据性能的同时整合多种语言的灵活性,尽管也出现了对歧义性增加的担忧。

- 持续预训练(continued pretraining)被提出作为减轻这些挑战的一种方法,表明了社区对 NLP 多语言能力的参与。

- Nitro 赠送活动引发关注:一名成员宣布了 Nitro giveaway,邀请参与者与服务器互动,在社区中引发了轻松的关注。

- 尽管带有幽默色彩,这一公告展示了社区在促进互动和连接方面的努力。

Nous Research AI Discord

- StealC 恶意软件针对 Chrome 用户:一种名为 StealC 的新发现恶意软件通过锁定浏览器并强迫用户通过欺骗性登录界面泄露 Google 密码来限制 Chrome 用户,引发了重大的安全担忧。

- 该恶意软件利用全屏自助服务终端模式(kiosk mode)诱导用户提交敏感信息,这与传统的网络钓鱼方法有逻辑上的相似之处。

- 腾讯 GameGen-O 变革视频游戏:腾讯推出了 GameGen-O,这是一种用于生成开放世界视频游戏的扩散 Transformer 模型,利用了来自 100 多个下一代游戏的广泛数据。

- 该模型在 OGameData 上进行训练,能够实现更具互动性的游戏玩法,并通过先进的模拟技术提高了视频游戏开发的标准。

- 基于拖拽的图像编辑创新方法:InstantDrag 流水线通过消除对掩码或文本提示的需求,增强了基于拖拽的图像编辑,利用双网络系统实现实时、照片级的编辑。

- 通过利用来自真实世界视频数据集的运动动力学,该方法显著加快了编辑过程,展示了创意应用的潜力。

- 探索 AI 训练中的精度退火 (Precision Annealing):一名成员提出了关于 precision annealing 的查询,建议在 FP8 进行预训练,并切换到 BF16 或 FP32,以在最终训练阶段最大化吞吐量。

- 他们强调这种方法可以优化训练方案中的资源利用,因为它减轻了显存限制。

- 评估指标与性能见解:在评估中,QLoRA 显示出优于传统 LoRA 方法的性能,表明在微调效率方面具有优势。

- 成员们对 QLoRA、全量微调(full fine-tuning)和原始模型的性能指标进行了对比分析,并对观察到的百分比差异进行了讨论。

OpenAI Discord

- O1 撰写长篇论文:一位成员展示了 O1 生成涵盖从 indev 到 1.21 的主要 Minecraft updates 详细文章的能力,令社区感到兴奋。

- 这突显了 O1 先进的写作熟练度及其在创意应用方面的潜力。

- 模型 Fine-tuning 面临挑战:用户对 fine-tuning results 表示担忧,报告称缺乏改进且训练损失(training loss)波动,从而引发了关于模型选择(model selection)的建议。

- 对话强调了 Fine-tuning 并不总是能产生有效结果,促使人们寻求战略性调整。

- Custom GPT 功能引发疑问:关于 Custom GPTs’ functionality 的咨询揭示了其随所用模型而异的变动性,并要求明确模型选择。

- 分享的见解包括参考资料的潜在链接,强调了在启动对话时需要更清晰的指导。

- ChatGPT 响应一致性问题:用户应对了 ChatGPT 在遵循预定序列方面的挑战,特别是在 RPGs 的战斗中。

- 建议包括使用 Discord bot 格式收集响应,然后将其输入 ChatGPT 进行分析,旨在简化交互。

- 使用 ChatGPT 探索游戏机制:剖析了一个涉及 60% 失败几率 游戏的场景,指出 ChatGPT 倾向于产生误导性解释。

- 讨论揭示了财富积累策略的复杂性以及模型在处理游戏语境时的性能差异。

CUDA MODE Discord

- CUDA-MODE Hackathon 引起远程参与兴趣:关于即将举行的 CUDA-MODE hackathon 远程参与的提议引发了关于其可行性和组织工作的讨论。

- 虽然一些成员支持远程赛道,但其他人指出了大型线下活动的挑战。

- Triton Kernel 启动开销问题:人们对 Triton 中的 kernel launch overhead 表示担忧,有报告称对于中等规模的矩阵,它消耗了 10-20% 的执行时间。

- 一个 GitHub issue 详细说明了 kernel 执行需要 80us,但启动它却需要 220us。

- INT8 混合精度训练带来的显著提升:最新的 torchao 0.5 release 展示了 INT8 混合精度训练(mixed-precision training)在 NVIDIA 4090 GPU 上实现了高达 70% 的加速,且没有明显的精度损失。

- 这一进展突显了训练效率的增强,特别有利于在保持收敛性的同时惠及消费级 GPU。

- Liger-Kernel v0.3.0 正式上线!:Liger-Kernel v0.3.0 发布,带来了重大进展,社区对其支持表示赞赏。

- 团队邀请社区体验新功能并提供反馈。

- BitNet 训练面临效率挑战:最近的讨论表明 BitNet model training 仍在挣扎中,近期的试验未报告显著进展。

- 成员们对与位运算(bitwise operations)相关的 GPU 效率低下表示担忧,强调了对定制硬件方案的需求。

LM Studio Discord

- GPU 加速问题依然存在:用户报告了 LM Studio 中未利用 GPU 加速的问题,提示在 Developer > LM Runtimes 下进行检查。一次成功的更新使一位用户的 GPU 利用率显著上升。

- 排查实践揭示了潜在的配置误解,从而实现了更高效的设置。

- 模型兼容性困境:LM Studio 主要支持 GGUF 模型,但并非所有列出的模型都能按预期运行,特别是在多模态任务中。这一限制引发了对模型性能和功能可用性的担忧。

- 参与者分享了关于仍无法使用的功能的见解,表明在利用 LM Studio 时,预期与现实之间存在差距。

- Strix Halo APU 能力炒作:关于 Strix Halo APU 运行大型 AI 模型潜力的讨论十分激烈,有说法称可为其 iGPU 分配高达 20GB。虽然提到了对 ROCm 的支持,但也出现了关于任务卸载影响性能的担忧。

- 关于处理效率的竞争性观点浮出水面,强调了平衡 CPU 和 GPU 任务的重要性。

- RTX 4090 加速 AI 查询:凭借三块 RTX 4090 显卡,一位成员报告在查询期间达到了 110 tokens per second。这引发了关于电源设置以有效发挥此类性能的讨论。

- 讨论集中在优化配置以提高电源效率和 GPU 性能。

- 为 LLM 优化 RAM:运行大型模型需要足够的系统 RAM,有案例表明 192GB DDR5 可以支持 Llama 3.1 等模型。然而,也有观点认为如果模型经过良好优化,64GB 可能就足够了。

- 参与者交流了优化策略,在 RAM 容量和模型需求之间寻找平衡。

Latent Space Discord

- OpenAI o1 模型发布:OpenAI 发布了 o1 模型,旨在提高复杂任务的推理能力,因其在科学和编程应用中的潜力而受到关注。

- 据报道,新模型性能优于旧版本,但在处理大型编辑时仍感吃力,这是 Cursor AI 正在通过其专门的编程助手解决的挑战。

- AI 初创公司融资激增:11x AI 在 A 轮融资中筹集了 2400 万美元,其 ARR 增长了 15 倍并推出了新的数字员工,彰显了其快速增长。

- 同样,Supermaven AI 获得了 1200 万美元 资金,用于开发一款能与其模型无缝集成的 AI 文本编辑器。

- HTEC 关于 AI Copilots 的报告:近岸咨询公司 HTEC 发布了一份关于他们使用 26 种 AI 编程工具经验的 报告,不过访问需要注册。

- 成员们讨论了报告中提到的简短使用和局限性是否真实反映了这些工具的能力。

- Voice Mode API 讨论:本期内容深入探讨了新的 Voice Mode API,它允许更具交互性和动态的对话能力。

- 它强调了这一功能如何改变用户在各种平台上与 AI 的交互。

- ChatGPT 扩展策略:讨论了扩展 ChatGPT 的策略,特别关注于增加延迟以及用于优化的 Prompt/Schema caching 技术。

- 团队解决了关于 模型可复现性 以及 API 不断演进的 分层和速率限制 策略的担忧。

Interconnects (Nathan Lambert) Discord

- OpenAI 的 o1 模型引起关注:OpenAI 最近发布的 o1-preview 和 o1-mini 模型引发了关于其有趣的推理模式以及用户交互数据对模型开发可能产生影响的讨论。

- 一位用户强调了一个令人惊讶的发现:mini 的推理时间并不比 preview 长,但生成的响应却更长,这挑战了人们的预期。

- Humanity’s Last Exam 发布公告:Dan Hendrycks 推出了 Humanity’s Last Exam,征集高难度的 AI 问题,奖金池高达 500,000 美元,截止日期为 2024 年 11 月 1 日。此举引发了关于其对 AI 监管影响的褒贬不一的反应。

- 人们对 Hendrycks 的游说工作及其与政治的联系表示担忧,这可能会根据性能指标影响未来的 AI 政策。

- RL 爱好者讨论 Reverse Curriculum Learning:关于 LLMs 中 Reverse Curriculum Learning 的新兴论文引发了关于其在 RL 社区使用受限的讨论,用户指出它尚未获得广泛认可。

- 成员们认为 Reverse Curriculum Learning 比较笨重,主要适用于利基应用 (niche applications),导致其在更广泛的背景下较为罕见。

- 对 LLM 模型发展的期待:人们对计划于 2025 年实现的未来 LLM 进展充满期待,讨论反映出对模型能力潜在突破的热情日益高涨。

- 成员们察觉到情绪的显著转变,指出格局已经发生变化,标志着可能出现类似于过去进步的里程碑。

- Poe 订阅服务评估:用户辩论了他们对 Poe 订阅服务的体验,尽管支付 20 美元即可访问所有可用的 LLMs,但对其易用性感受复杂。

- 用户对界面设计提出了担忧,表示与 Claude 和 ChatGPT 等竞争对手相比,更倾向于更具吸引力的美学设计。

Cohere Discord

- 探索 Fei-Fei Li 的推理方法:成员们对 Fei-Fei Li 解决推理问题的技术表示好奇,旨在收集她在 AI 背景下相关方法的见解。

- 工程师们明显渴望更深入地了解像她这样的方法论,这可能会为正在进行的 AI 进展提供参考。

- Command-R-Plus-08-2024 输出问题:一位用户报告称,与之前的版本相比,Command-R-Plus-08-2024 模型产生的输出重复性更高,特别是在创意任务中。

- 这引发了关于长 Prompt 如何进一步影响性能的讨论,并促使人们探索替代模型。

- Cohere 开发者办公时间公告:Cohere 将于今天东部时间下午 1 点举办开发者办公时间,讨论 Command 模型系列的更新,包括 RAG 和 Safety Modes 的新功能。

- 与会者可以期待了解模型效率和实际应用方面的重大改进。

- 实施 Safety Modes 以增强控制:Cohere 推出了 Safety Modes,旨在让企业客户更好地控制模型的使用和交互。

- 此次更新加强了治理,同时确保模型有效性保持不变。

- 招聘信息担忧与社区焦点:一位成员呼吁从讨论中移除与 Cohere 无关的招聘信息,强调社区话题相关性的必要性。

- 这反映了保持讨论与 Cohere 社区利益和目标紧密一致的承诺。

Stability.ai (Stable Diffusion) Discord

- 用户在 FLUX 模型上遇到困难:成员们报告了在运行 FLUX 模型时遇到的问题,特别是关于

.sft和.safetensor等格式,以及与 Forge 等工具的兼容性问题。- 建议切换到 ComfyUI 以获得更好的支持,用户们分享了关于特定模型大小的使用经验。

- 创作具有风格的角色:一位用户寻求关于使用 Stable Diffusion checkpoints 和提示词技巧生成类似于 Cheetara 角色的建议。

- 讨论内容包括适用于后期 3D 建模的角色艺术专用 checkpoints,并引用了 Cheetara GIF 作为灵感。

- 精通图像编辑:出现了关于从图像中移除文本和利用 inpainting 方法的技巧建议,其中 GIMP 等工具被重点提及。

- 用户讨论了各种在保持质量的同时增强图像的 AI 工具,包括 Piximperfect 的教程。

- 使用 ControlNet 制作角色动画:关于利用 ControlNet 和 LoRA 训练创建矢量风格角色动画的见解不断涌现,强调了使用正确训练样本的重要性。

- 贡献者分享了使用 ControlNet 技术改进艺术渲染中角色姿势和结构的技巧。

- 技术支持困扰:一位用户在安装 Stable Diffusion 期间遇到错误,被建议在支持频道分享其错误日志以便进行故障排除。

- 分享了指向 安装指南 的有用链接,强调了详细日志的重要性。

Modular (Mojo 🔥) Discord

- 用户验证流程上线:Discord 服务器已实施 用户验证 流程,要求成员通过 #verify 频道的机器人提交其电子邮件地址,未验证用户仍保留只读权限。

- 选择不进行验证的成员将面临 发送消息功能受限,强调了这一新步骤的重要性。

- 引入入门引导问题以优化体验:电子邮件验证后,用户将回答 两个多选题入门引导问题,旨在提升其服务器体验。

- 该举措反映了为新老成员改进引导流程的努力。

- Mojo 在 Python 互操作性方面面临挑战:讨论显示 Mojo 目前无法导入 Python 模块或调用其函数,阻碍了有效的互操作性,而这对于无缝集成至关重要。

- 参与者热衷于在 Mojo 和 Python 之间实现 zero-copy 数据交换 的方法,特别是在性能敏感的场景下。

- Count Leading Zeros 面临编译时限制:用户报告称

clz函数在编译时难以运行,原因是其依赖于 LLVM intrinsics,而这些在现阶段无法执行。- 提出了一种计算前导零的替代实现,突显了标准库中对更好编译时能力的需求。

- 用于讨论服务器变更的新频道:已建立一个专门讨论 即将到来的服务器变更 的频道,允许成员分享建议并提出问题。

- 此举标志着通过社区投入和对话来增强 用户体验 的承诺。

Eleuther Discord

- 理解混合精度训练的挑战:虽然 mixed precision training 可以通过同时以 fp32 和 fp16 存储模型来提升性能,但它也会在正向传播(forward pass)期间使计算负载翻倍——这是一个值得注意的权衡。

- 成员们强调了在预算限制下平衡速度和资源利用率的重要性。

- CoreWeave 的重大估值:CoreWeave 正在洽谈出售股份,公司估值达到 230 亿美元,反映了其在 AI 驱动的云计算领域的卓越地位。

- 此举引起了知名财经媒体的极大关注,突显了该行业的竞争格局。

- 探讨 AI 的社会影响:讨论反映了 OpenAI 如何有效地实现了更广泛的信息获取,将其比作在“每个人的口袋里放了一个博士”,而公众对这些变化的反应极小。

- 成员们强调需要就 transformative effects(变革性影响)以及 AI 持续融入日常生活进行更深层次的对话。

- RWKV 团队挑战 RNN 极限:RWKV 团队在 RNN 架构进步方面引起了轰动,其中 Smerky 等人的贡献尤其受到认可。

- 这一创新举措因其在社区内的潜在影响而受到了关注和赞誉。

- 对小数据集模型过拟合的担忧:一位成员表示仅使用 9 张图像 很难让模型过拟合,这引发了关于在处理更大数据集时可能出现的学习问题的讨论。

- 共识是,如果无法对如此小的样本进行过拟合,可能预示着未来会面临更大的困难。

LlamaIndex Discord

- LlamaParse 在解析 Excel 数据方面表现出色:在 最近的视频 中,展示了 LlamaParse 先进的 Excel 解析能力,包括处理多个工作表和复杂表格。LlamaParse 利用 recursive retrieval 自动总结复杂表格,提高了效率。

- 此功能显著提升了可用性,特别是对于处理复杂 Excel 文件的用户。

- TypeScript 工作流引入 LlamaIndex:如该 公告 所述,LlamaIndex 现已将 workflows 集成到 TypeScript 中。这一新功能旨在简化 TypeScript 用户的开发流程。

- 这种集成有助于使该框架对于使用 TypeScript 的开发者来说更加易用和高效。

- 单元测试在 LLM 应用中的重要性:单元测试被强调为减轻 LLM 应用中随机性的关键,一篇详细介绍使用 CircleCI 构建和测试 RAG 应用的博客文章中强调了这一点。适当的单元测试对于防止 AI 应用中出现意外行为至关重要。

- 讨论强调了对 AI 驱动项目质量和可靠性的承诺。

- Vectara-Agentic 库简化 RAG 实现:查看由成员开发的 vectara-agentic,这是一个简化构建由 LlamaIndex 和 Vectara 驱动的 agentic RAG 的库。它提供了构建能够进行规划和工具使用的 Agent 的工具,并兼容各种模型提供商。

- 这种灵活性使开发者能够更高效地实现 RAG 解决方案。

- 本地 LLM 提供成本优化:成员们讨论了运行 Local LLM 与使用 OpenAI 服务相比可以显著降低成本。在 OpenAI 和本地模型之间做出选择时,总拥有成本 (TCOS) 被认为是一个重要因素。

- 这一考量强调了优化 AI 解决方案以获得更好成本效率的日益增长的趋势。

OpenInterpreter Discord

- 理解 GPU 边际收益递减:GPU 的边际收益递减点在游戏领域出现在 2-3 个 GPU 之后,在渲染领域出现在 4-6 个 GPU 之后,这很大程度上归因于 PCIe 带宽限制。

- 文档问题被认为是影响用户 GPU 设置体验的一个主要担忧。

- Open Interpreter 中的非流式响应:成员们讨论了如何在命令行模式下停止流式响应;选项包括使用 –plain 标志或

claude-3.5模型。- 该反馈旨在提高与命令行交互时的易用性和舒适度。

- 对 ChatGPT O1 模型发布的困惑:关于 ChatGPT 的 O1 模型存在担忧,有人推测其发布可能会削弱现有的替代方案,尽管这一观点受到了另一位成员的挑战。

- 虽然 O1 在推理方面表现出色,但批评者指出它在执行代码任务时不如早期的 model 4 等模型有效。

- Livekit 设置错误警报:约 90% 的用户报告了 Livekit 设置问题,将其归咎于文档不足。

- 有人提议创建一个全面的设置指南以增强用户支持。

- 令人兴奋的用于编排的 MoA LLM 库:MoA LLM 库 引入了一种在受神经网络启发的架构中编排 LLM 的方法,旨在改进模型协作。

- 这一开源项目为高效整合多个 LLM 提供了一个框架。

OpenAccess AI Collective (axolotl) Discord

- 关于 O1 模型有效性的辩论:对 O1 模型的评价褒贬不一;虽然有些人称赞其 Chain of Thought 界面,但其他人认为其机械化的响应令人失望。

- 一位成员提到,尽管 UI 表现稳健,但整体性能仍有很大提升空间。

- OpenAI 的 O1 开发时间线澄清:一位成员透露,OpenAI 开发 O1 (Strawberry/Q*) 已有很长时间,这与它是快速产出结果的说法相反。

- 他们指出 O1 采用了代理式思维链 (agentic chain of thought),表现出对幻觉等常见问题的抵御能力。

- 掩码问题导致的分词错误:一位成员报告了由于新的逐轮掩码策略导致出现 Tokenization 错误,该策略遮蔽了最后一轮结束的 Token。

- 他们将此问题关联到了在 GitHub 上提交的一份详尽的 bug 报告。

- Phi 3.5 在分类任务中的挫败:成员们表达了在开发 Phi 3.5 句子分类器时的挣扎,该分类器无法产生正确的分类输出。

- 一位成员选择分享了他们的 简易句子分类器,并承认目前可能会暂时放弃。

- vLLM 与 Adapter 兼容性问题:围绕 vLLM 无法正确解释

qkv_proj层展开了讨论,这影响了使用 Axolotl 的 Adapter 训练的模型。- 有趣的是,虽然一个 LORA 模型在合并过程中显示没有学习到内容,但作为基础模型之上的独立 Adapter 运行时表现良好。

LangChain AI Discord

- 提供 GenAI/RAG/CV 咨询:一位成员宣布提供 GenAI、RAG 和 CV 方面的咨询服务,以协助初创公司进行原型开发。

- 感兴趣的成员可以直接联系以寻求合作机会。

- OpenAI 引发社会反思:人们对 OpenAI 在社会似乎未发生变化的情况下对知识获取的影响表示担忧。

- 讨论包括关于加速自动化如何引导我们进入后稀缺时代的思考。

- LangGraph Cloud 定价不确定性:一位成员询问了 LangGraph Cloud 在 Beta 阶段后的潜在成本,考虑是否开发自定义的 FastAPI 封装。

- 对可行长期定价模型的担忧是讨论的一个重点。

- 流式 LLM 输出解析问题:讨论了在流式 LLM 输出期间解析不完整 JSON 字符串的问题,特别是使用 Pydantic 解析器时。

- 尽管最初持怀疑态度,但从

parse_result切换到parse方法产生了更好的结果。

- 尽管最初持怀疑态度,但从

- 聊天历史管理挑战:用户表达了在使用 LangChain 管理聊天历史方面的困难,特别是在跟踪特定应用的消息时。

- 他们强调了在整合这些数据时维持事务完整性的问题。

DSPy Discord

- 优化 RAG 查询结构:一位成员建议在单个模块中优化 RAG,通过将来自内存和提示词的数据打包到 ‘context’ 字段来增强结果。该方法参考了这个简单的 RAG 示例并得到了确认。

- 另一位成员认可了这一策略的实用性,并指出了其在数据处理方面的优势。

- DSPy 中的 Visual LLM 使用案例:有人询问在 DSPy 中使用 Visual LLM 模型进行图像描述的可能性,另一位成员推测下周可能会推出。文中引用了一个很有前景的 GPT-4 Vision API PR,暗示集成工作正在进行中。

- 这一预期功能引发了社区对即将到来的新能力的狂热期待。

- 寻求 GitHub 贡献:一位成员表达了为 DSPy 项目做贡献的兴趣并询问了是否有可用的赏金(bounties),随后引发了讨论。信息显示,更多的集成变更即将到来,预计完成时间为 7-10 天。

- 贡献的前景在社区内引起了兴奋,表明了大家对协作开发的共同渴望。

tinygrad (George Hotz) Discord

- Tinygrad 添加运行时类型检查:George Hotz 宣布 Tinygrad 支持

TYPED=1进行运行时类型检查,在运行python3 test/test_ops.py测试时发现了类型错误。一个 GitHub PR 提议修复大部分类型错误,目前还剩一个未解决。- 社区反馈强调了健壮的类型检查的重要性,进一步强化了编写规范代码的必要性。

- Tinygrad 0.9.2 在 AMD 上测试失败:一位用户报告在将 Tinygrad 从 0.9.0 升级到 0.9.2 时遇到问题,遇到了与

struct_kfd_ioctl_criu_args相关的 AttributeError。怀疑根本原因是内核版本与库的要求之间可能存在不匹配。- 诊断结果表明,Tinygrad 在针对 AMD 用户的兼容性文档和故障排除指南方面可能存在缺失。

- Tinygrad 库讨论引发关注:成员们讨论了 tinygrad 生态系统内库的开发,特别提到了 timm 和 torchvision 作为候选。这次对话引发了关于此类库的实际必要性和当前实现的询问。

- 当一位用户质疑这些库在 tinygrad 中的实际效用时,讨论升级,表明在集成方面需要更清晰的说明。

- 调查 VRAM 分配峰值:一位成员寻求关于诊断 Tinygrad 运行期间 VRAM 分配峰值的建议,强调了框架内内存监控工具的知识空白。这一询问凸显了对更强大的诊断工具的需求。

- 了解 VRAM 行为对于优化性能和防止密集处理任务期间的崩溃至关重要。

- 报告 Tensor 修改错误:用户在修改 Tinygrad 中的 Tensor 时遇到错误,特别是在元素自增期间。他们引用了一个与该问题一致的未解决 GitHub issue,重点在于 contiguous 属性。

- 该用户的发现强化了关于 Tensor 操作的全面测试和文档的重要性。

Torchtune Discord

- 掌握 Checkpoints 管理:要在特定的 token 计数处实现 checkpoints,请利用

num_tokens字段并过滤 padding tokens,详见此处。调整保存逻辑对于准确跟踪和从保存状态恢复至关重要。- 成员们强调了在训练期间进行 all gather 以统计所有 rank 总数的必要性。

- 引入 Cosine 学习率衰减:成员们讨论了集成

torchtune.modules.get_cosine_schedule_with_warmup以实现学习率的余弦衰减,目前已应用于 LoRA recipes。建议在 mid-epoch 恢复时跳过从 epoch 编号推导步数的操作,以实现更平滑的过渡。- 建议成员们密切关注这些实现,以便将其纳入 full finetune recipe。

- 关于 CUDA 与 CPU 操作的辩论:有人询问 token 操作是否可以在 CPU 上进行,得到的确认是

num_tokens不是 CUDA tensors,但建议使用 CUDA。尽管对 CPU 效率仍有疑问,但对 CUDA 进程的偏好依然存在。- 讨论显示出不确定性,但明显倾向于使用 CUDA 以获得这些操作的最佳性能。

- 在线打包(Online Packing)支持即将到来:团队计划在添加对 iterable datasets 的支持后立即实现在线打包。此举有望提高批量数据处理的效率。

- 成员们对这将为未来项目带来的能力提升表示兴奋。

- CI GPU 测试失败引发关注:与 GPU 测试相关的持续 CI 问题(特别是

test_eleuther_eval.py)源于 transformers.pipelines 中的导入错误,虽然有 504 个测试通过,但重大错误阻止了完成。这引发了对系统整体稳定性的警报。- 成员们正在积极讨论潜在的修复方案并调查异常情况,以确保 CI 运行更加顺畅。

LAION Discord

- 生成式 AI 瞬间创作艺术:一位成员展示了使用 NotebookLM 创作的艺术作品,仅用 2 分钟 即可完全生成。他们分享了一个激动人心的 YouTube 视频,记录了这一快速创作过程。

- 他们对生成式 AI 的能力发出了“活在当下真好”的感慨。

- Steve Mould 的错觉探索:一位成员在 YouTube 上分享了《这种新型错觉真的很难制作》,深入探讨了 AI 生成的错觉。视频包含了关于 Jane Street 实习的见解,可以在此处观看。

- 他们指出生成式 AI 创造的图像在不同光照条件下会发生变化。

- 扩散错觉(Diffusion Illusions)成为焦点:一位成员介绍了 Diffusion Illusions 网站,该网站展示了通过扩散模型生成的交互式视错觉。该网站链接到他们被 SIGGRAPH 2024 接收的项目,包括一段 YouTube 演讲。

- 主要贡献者包括 Ryan Burgert 和 Xiang Li,展示了扩散模型的引人注目的应用。

- 寻求图像中的文本:一位成员寻求关于如何高效地在图像中嵌入文本以创建全面数据集的建议,目标是扩展到 数百万张图像。

- 这一讨论突显了为 AI 应用自动化创建文本嵌入图像数据集的需求。

MLOps @Chipro Discord

- 预训练 VLMs 需要大量算力:一位成员对使用预训练 视觉语言模型 (VLMs) 缺乏 算力资源 表示担忧,这些模型本质上需要大量的计算能力。

- 讨论强调,这些模型的有效性在很大程度上取决于是否有合适的硬件来处理其密集的计算需求。

- 异常检测需要明确:一位成员询问 异常检测 应该关注日志还是实际的 时间序列数据,从而引发了对数据类型的深入探讨。

- 共享了几种用于时间序列分析的方法论,包括 Transformer 模型、卡尔曼滤波 (Kalman Filters) 和 孤立森林 (isolation forests),并建议使用 z-scores 进行误差评估。

Gorilla LLM (Berkeley Function Calling) Discord

- 模型在 Function Calling 方面表现挣扎:讨论显示该模型目前仅具备聊天能力,在相关性(relevance)方面得分仅为 1,无法执行任何 Function Calling,在其他能力方面得分为 0。

- 这一 Bug 显著限制了模型的功能,阻碍了用户体验并降低了预期。

- 模型生成对话而非 Function Call:成员们表示担心模型输出的是对话式响应而非执行 Function Calling,导致沟通误解和评分错误。

- 这导致该尝试被自动标记为错误,影响了处理响应的准确性。

- 无效语法触发 AST Decoder 失败:错误消息标记为 ‘Invalid syntax’,导致 Abstract Syntax Tree (AST) 解码失败,分类为 ‘ast_decoder:decoder_failed’。

- 该问题表明在解析模型输出时存在关键问题,为故障排除带来了挑战。

PART 2: Detailed by-Channel summaries and links

邮件中已截断完整的频道细分内容。

如果您喜欢 AInews,请分享给朋友!预谢!