ainews-not-much-happened-this-weekend-5817

这个周末没什么特别的。

2024年10月4日至10月7日的AI新闻重点介绍了以下几项进展:

OpenAI的o1-preview在处理复杂任务时表现强劲,但在简单任务上却显得吃力;与此同时,Claude 3.5 Sonnet通过高级提示工程(prompting)技术,能够展现出与其相当的推理能力。Meta推出了Movie Gen,这是一款用于文本生成视频及编辑的前沿多媒体基础模型。Reka更新了其21B Flash模型,新增了时间维度视频理解、原生音频支持以及工具调用功能。

业界对专注于提示词和微调的“开源版o1”复现工作的兴趣日益增长,其中Entropix正在探索基于熵的采样技术。LangChainAI展示了一个用于复杂问答的检索代理(Retrieval Agent),同时一项关于合成数据生成的研究对417个模型进行了综述。RNN(循环神经网络)的复兴表明,高效的并行训练正使其具备与Transformer模型一较高下的竞争力。此外,受生物启发的AI安全方法也受到了关注。

“一个安静的周末和空调,就是你所需要的一切。”

一个安静的周末和空调就是你所需要的一切。

2024年10月4日至10月7日的 AI News。我们为您检查了 7 个 subreddits、433 个 Twitters 和 31 个 Discords(226 个频道和 5768 条消息)。预计节省阅读时间(以 200wpm 计算):640 分钟。您现在可以标记 @smol_ai 进行 AINews 讨论!

有几件值得注意的事,但没有足以登上头条的新闻:

- Cursor 登上了 Lex Fridman 的访谈,这是该节目首次同时邀请 4 位嘉宾,也是 Lex 报道开发者工具和早期初创公司的一个显著突破。Imrat 对该播客的 20 点总结非常实用。

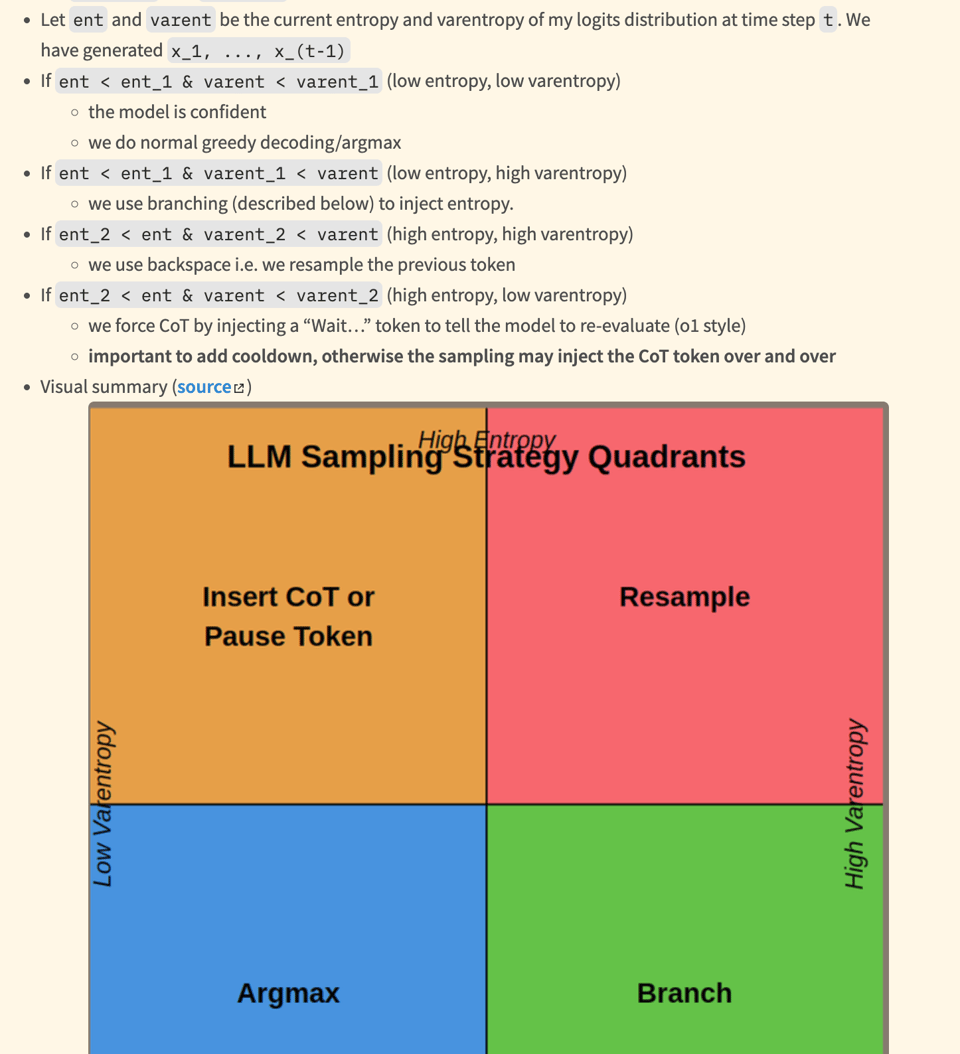

- 人们对 “open o1” 的复现表现出浓厚兴趣。诚然,目前还没有基于 RL 的:大多数是 prompting 技巧 和 finetunes,但最有前景的项目可能是 entropix,它使用 entropy-based sampling 来插入 pause tokens。

- Reka 更新了他们的 21B Flash Model,增加了时间理解(针对视频)和原生音频支持(无需独立的 ASR),以及 tool use 和 instruction chaining。

- SWEBench 发布了一个多模态版本。

AI Twitter 综述

所有综述均由 Claude 3.5 Sonnet 完成,取 4 次运行中的最佳结果。

AI 模型进展与对比

-

OpenAI 的 o1-preview 性能:@JJitsev 指出 o1-preview 声称在奥林匹克竞赛和博士级任务中表现强劲,但在更简单的 AIW+ 问题上表现出波动,表明可能存在泛化缺陷。@giffmana 观察到 o1-preview 显然处于领先地位,解决了 2/6 个变体,并在其余变体中获得了约 50% 的分数,而其他模型的得分不足 10%。

-

Claude 3.5 Sonnet 对比 OpenAI o1:@_philschmid 报告称,可以通过提示词引导 Claude 3.5 Sonnet 增加推理时间计算(test-time compute),从而匹配 OpenAI o1 等推理强模型。该方法结合了 Dynamic Chain of Thoughts、反思(reflection)和口头强化(verbal reinforcement)。

-

LLM 收敛:@karpathy 观察到许多 LLM 听起来很相似,都使用列表、讨论“多方面”(multifaceted)问题,并主动提供进一步帮助。@rasbt 认为这可能是由于外部公司为偏好微调(preference tuning)提供了数据集。

-

Movie Gen:Meta 发布了 Movie Gen,被描述为“迄今为止最先进的媒体基础模型”。它可以根据文本生成高质量的 AI 视频,并进行精确的视频编辑。

AI 研究与应用

-

检索增强生成 (RAG):@LangChainAI 分享了一个使用 LangGraph 和 Exa 实现的 Retrieval Agent,用于更复杂的问答应用。

-

AI 在客户支持中的应用:@glennko 报告称构建了端到端的客户服务 Agent,已为一家 F500 客户自动化处理了 60-70% 的客户支持量。

-

合成数据生成:发布了一份关于过去十年中 417 个合成数据生成 (SDG) 模型的综合综述,涵盖了 20 种不同的模型类型和 42 种亚型。

-

RNN 复兴:一篇论文发现,通过移除隐藏状态依赖,LSTM 和 GRU 可以高效地并行训练,使其在长序列任务中能与 Transformer 和 Mamba 竞争。

AI 安全与伦理

-

生物启发式 AI 安全:@labenz 强调了 AE Studio 在生物启发方法方面的工作,旨在设计更具协作性且更少欺骗性的 AI 系统,包括训练模型预测其内部状态,并最小化自我与他者的区别。

-

AI 风险辩论:@RichardMCNgo 讨论了 AI 风险辩论中的两极分化,指出怀疑论者通常回避不确定性下的成本效益推理,而许多末日论者(doomers)则过于贝叶斯化(Bayesian)。

行业新闻与进展

-

OpenAI 融资:OpenAI 完成了新一轮 66 亿美元融资,公司估值达到 1570 亿美元,巩固了其作为全球资金最雄厚的 AI 初创公司的地位。

-

Cloudflare SQLite 改进:@swyx 强调了 Cloudflare 对 SQLite 的改进,包括具有异步性能的同步查询,以及将状态回滚到过去 30 天内任意时间点的能力。

梗与幽默

-

@ylecun 对一条未指明的推文回复了 “Haha 😄”。

-

@bindureddy 拿 Elon Musk 因政治观点而遭受仇恨的讽刺现象开玩笑,尽管其初衷是停止仇恨并传播快乐。

AI Reddit 综述

/r/LocalLlama 综述

主题 1. 小规模 LLM 性能的进展

- Adaptive Inference-Time Compute: LLMs Can Predict if They Can Do Better, Even Mid-Generation (Score: 66, Comments: 3): Adaptive Inference-Time Compute(自适应推理时间计算)允许 Large Language Models (LLMs) 在生成过程中动态调整其计算资源,从而可能提高输出质量。该方法涉及模型预测额外的计算是否会增强其性能(即使是在生成中期),并据此进行调整。这项技术可以使 LLMs 更加高效、有效地利用计算资源,潜在地提升其整体性能和适应性。

- [{‘id’: ‘lqn3n3c’, ‘score’: 8, ‘body’: “这是一篇如果配有代码会好得多的论文。不需要太极端,只要一个基础实现和良好的文档,我就能想办法把它挂载到我喜欢的推理引擎上。有趣的是,过去一周我看到的优质研究论文比整个夏天都多。我不知道是 o1 的发布促使研究人员拿出了他们的干货,还是仅仅是一个周期性的现象。”, ‘author’: ‘XMasterrrr’, ‘is_submitter’: False, ‘replies’: [{‘id’: ‘lqn4dmw’, ‘score’: 2, ‘body’: “是的,我最近看到了很多好论文。最近大家非常关注 CoT 和推理。我希望有人能根据这个拼凑出可用的代码,看起来非常有趣。”, ‘author’: ‘Thrumpwart’, ‘is_submitter’: True, ‘replies’: []}, {‘id’: ‘lqni1zg’, ‘score’: 2, ‘body’: ‘>我们发布了一个 公开的 GitHub 实现 以供复现。就在附录的最上方… GitHub 目前是空的,但有可分享的代码,他们计划发布。如果你真的很在意,也许可以开个 issue 问问预计发布时间(ETA)是什么时候。’, ‘author’: ‘Chelono’, ‘is_submitter’: False, ‘replies’: []}]}]

- 3B Qwen2.5 finetune beats Llama3.1-8B on Leaderboard (Score: 69, Comments: 11): 一个基于 Arcee.ai 的 EvolKit 创建的挑战性问题进行微调的 Qwen2.5-3B 模型,在 Leaderboard v2 评估中超越了 Llama3.1-8B,在 BBH 上获得了 0.4223 分,在 GPQA 上获得了 0.2710 分,六项基准测试的平均分为 0.2979。该模型可在 Hugging Face Spaces 上进行测试,但创作者提醒,由于其专门的训练数据和 qwen-research license,它可能尚未达到生产级要求。

Theme 2. 开源社区复现 o1 推理能力的努力

-

It’s not o1, it’s just CoT (Score: 95, Comments: 35): 该帖子批评了开源社区尝试复现 OpenAI 的 Q/Strawberry**(也称为 **o1**)的行为,认为许多尝试只是简单的 **Chain of Thought (CoT)** 实现,而非真正的 o1 能力。作者指出,**Q/Strawberry 可能涉及标准 RLHF 之外的 Reinforcement Learning 技术,并敦促开源社区专注于开发真正的 o1 能力,而不是将 CoT 嵌入到现有的 Large Language Models (LLMs) 中。为了说明区别,帖子引用了 OpenAI 官方博客文章,展示了原始的隐藏推理链,特别是强调了 “Cipher” 示例,以证明 o1 与传统 CoT 相比截然不同的方法。

- 在现有模型基础上复现 o1 推理的新尝试 (评分: 81, 评论: 58):一项新尝试旨在现有语言模型上复现 o1 reasoning,重点是在无需重新训练的情况下增强模型能力。该方法涉及开发一种专门的 Prompt,引导模型生成更具结构化和逻辑性的输出,从而可能提高其在复杂推理任务中的表现。这种方法可能提供一种利用当前 AI 模型进行高级推理的途径,而无需支付训练新架构的计算成本。

- 用户讨论了在本地复现 o1 reasoning 的可行性,一些人认为这不仅仅需要一个训练良好的 LLM。讨论强调了实现类似功能和速度需要多次 AI 调用以及显著的技术改进。

- 一位用户提议了一个测试:计算 “strawberry” 中字母 ‘R’ 的数量,并指出 70B 模型通常会诉诸于拼读单词。这表明大型模型中出现了一种新兴特征,即尽管不“认识”单个字母,它们也能进行拼写和计数。

- 讨论对该帖子的观点进行了批评,一位用户认为这更多是在现有模型上复现“只是 CoT,而非 o1”。其他人则幽默地将这种尝试比作业余火箭科学,对该方案的可行性表示怀疑。

- 介绍我的推理模型:无标签,纯逻辑 (评分: 322, 评论: 100):该帖子介绍了一个受 o1 系统启发的推理模型,它在用户输入和助手输出之间增加了一个中间推理步骤。作者使用来自 Reasoning-base-20k 集合的 10,000 列数据集训练了两个模型:Reasoning Llama 3.2 1b-v0.1 和 Reasoning Qwen2.5 0.5b v0.1。两个模型均已在 HuggingFace 上发布,帖子中提供了链接。

- 该模型被描述为 CoT (Chain of Thought) 而非 o1,用户指出 o1 的推理链显著更长(5400 Llama3 tokens 对比 1000),并且涉及蒙特卡洛树搜索算法 (tree-search monte carlo algorithm)。

- 一位用户根据泄露的 o1 信息实现了一个 16 步推理流水线,并使用 Gemini 8B Flash 进行了测试。该实现提高了代码生成结果,但每条响应耗时约 2 分钟。Colab 链接已提供。

- 用户请求并获得了模型的 GGUF 版本。人们有兴趣将此方法应用于更大的模型,如 Qwen 2.5 72b 或 32B,一些人建议针对基座模型进行基准测试以评估改进效果。

主题 3. 用于本地 LLM 推理的 DIY AI 硬件

-

搭建了我的首台 AI + 视频处理工作站 - 3x 4090 (评分: 378, 评论: 79):该帖子描述了一台高性能的 AI 和视频处理工作站,配置包括 Threadripper 3960X CPU、3x NVIDIA RTX 4090 GPU(两块 Suprim Liquid X 和一块 Founders Edition)以及 128GB DDR4 RAM,采用 NZXT H9 Flow 机箱和 1600W PSU。该系统旨在离线运行处理敏感数据的 Llama 3.2 70B 模型(带有 3万-4万词的 Prompt),实现了 10 tokens/秒 的吞吐量,在使用 Ollama 和 AnythingLLM 时 Prompt 评估速度表现出色,同时还能通过 Topaz Video AI 进行视频超分辨率和 AI 增强。

-

AMD Instinct Mi60 (评分: 31, 评论: 32):在 eBay 上以 299 美元购买的 AMD Instinct Mi60 GPU,拥有 32GB HBM2 显存和 1TB/s 带宽,可在 Ubuntu 24.04、AMDGPU-pro 驱动和 ROCm 6.2 环境下工作。使用 Llama-bench 的基准测试显示,Mi60 运行 qwen2.5-32b-instruct-q6_k 的速度为 pp512 达到 11.42 ± 2.75 t/s,tg128 达到 4.79 ± 0.36 t/s;而 llama3.1 8b - Q8 的速度为 pp512 达到 233.25 ± 0.23 t/s,tg128 达到 35.44 ± 0.08 t/s,性能受限于 100W TDP。

主题 5. 多模态 AI:结合视觉与语言

- Qwen 2 VL 7B Sydney - 喜欢评论你狗狗照片的视觉模型 (Score: 32, Comments: 15): Qwen 2 VL 7B Sydney 是一款全新的视觉语言模型 (Vision Language Model),旨在对图像提供详细的评论,尤其擅长描述狗狗的照片。该模型由 Alibaba 开发,能够生成长达数段的图像描述,与传统的图像标注模型相比,其输出内容更加详尽。

- 用户对将视觉语言模型与经过角色扮演微调的 LLM 合并以增强图像交互表现出了浓厚兴趣。同时,也有人担心大公司会限制此类模型的访问,并以 Chameleon 为例。

- 该模型的创建者分享了使用 Sydney 的人格 (personality) 对 Qwen 2 VL 7B 进行微调的计划,旨在创建一个更加积极且具有互动性的多模态模型。该项目涉及 42M tokens 的文本和图像数据,所有资源均已开源。

- 讨论还涉及了该模型与 LM Studio 的兼容性,由于 llama.cpp 尚不支持 Qwen 2 VL 7B,目前不太可能兼容。创建者提供了一个推理脚本,并指出为了获得最佳性能,需要配备 24GB VRAM GPU。

其他 AI Subreddit 摘要

r/machinelearning, r/openai, r/stablediffusion, r/ArtificialInteligence, /r/LLMDevs, /r/Singularity

待完成

AI Discord 摘要

摘要的摘要之摘要

Claude 3.5 Sonnet

1. AI 模型发布与基准测试

- DeepSeek V2 挑战 GPT-4:DeepSeek-V2 已发布,声称在 AlignBench 和 MT-Bench 等基准测试的某些领域超越了 GPT-4。

- 该模型的表现引发了 Twitter 上的讨论,一些人对相比现有模型的改进程度持怀疑态度。

- Dracarys 2 作为顶级开源编程模型亮相:Dracarys 2 被介绍为一款强大的开源编程模型,在 LiveCodeBench 等基准测试中表现优于 Sonnet 3.5。

- 虽然在代码编辑任务中达到了 67% 的准确率,但一些用户认为它更多是现有模型的重新包装,而非能力的重大创新。

- Open O1 挑战闭源模型:Open O1 项目 旨在创建一个开源模型,在推理、编程和数学解题方面达到 OpenAI o1 的性能水平。

- 然而,一些社区成员认为围绕 Open O1 的讨论缺乏深度,呼吁对此类模型及其声称的能力进行更严格的审查。

2. AI Agent 与推理能力的进展

- SwiftSage v2 增强推理能力:SwiftSage v2 的发布引入了一个集成快慢思考的推理 Agent 系统,专注于复杂问题的 In-context learning。

- 该开源项目旨在数学和 MMLU 风格的推理任务中与闭源系统竞争,展示了在各种认知挑战中的优势。

- GenRM 彻底改变奖励模型:GenRM 的引入使得奖励模型可以作为 Next-token predictor 而非传统的分类器进行训练,从而为奖励模型开启了 Chain-of-Thought 推理。

- 这一创新提供了统一的策略和奖励模型,增强了各种任务的整体表现,并可能改善 AI 与人类价值观的对齐。

- 用于连续潜空间推理的 COCONUT 范式:一篇新论文介绍了 COCONUT,这是一种允许语言模型在连续潜空间 (Continuous Latent Space) 而非传统语言空间中进行推理的范式。

- 这种方法表明,利用隐藏状态 (Hidden states) 进行推理可以缓解传统模型中 Token 的限制,从而实现更复杂的思考并可能增强 LLM 的能力。

3. AI 工具与基础设施改进

- Mojo 基准测试框架发布:Mojo 引入了一个用于运行时性能评估的 benchmark package,类似于 Go 的测试框架。

- 用户现在可以使用

benchmark.run高效评估函数性能,并报告平均耗时和迭代次数,从而增强 Mojo 生态系统中的开发工作流。

- 用户现在可以使用

- LlamaIndex RAG-a-thon 宣布举行:LlamaIndex Agentic RAG-a-thon 定于 10 月 11 日至 13 日在硅谷举行,重点关注与 Pinecone 和 VESSL AI 合作的 Retrieval-Augmented Generation 技术。

- 该活动旨在推进企业级应用的 AI agents,开发者有机会赢得现金奖励,详见此链接。

- Entropix 增强 Prompt 优化:Entropix/Entropy Guided Adaptive Sampler 增强了 Prompt 优化,专注于 attention entropy 以提升模型性能。

- 正如 @_xjdr 在社交媒体上所述,其优势包括提高叙事连贯性和减少幻觉,甚至在小型模型中也展现出了这种能力。

4. 开源 AI 项目与协作

- Meta Movie Gen 研究论文发布:Meta 发布了一篇研究论文,详细介绍了他们在电影生成建模方面的 Movie Gen 创新。

- 该文档是理解 Meta 在电影生成技术进步背后方法论的重要参考,提供了对其最新 AI 驱动创意工具的见解。

- Python 3.13 发布带来重大更新:Python 3.13 正式发布,包含重大更新,包括更好的 REPL 以及无需 GIL 运行 Python 的选项。

- 亮点功能还包括对 iOS 和 Android 平台的改进支持,由于 Beeware 项目的发展,这些平台被标记为 Tier 3 支持。

- Intel 与 Inflection AI 合作开展企业级 AI:Intel 与 Inflection AI 宣布合作推出企业级 AI 系统,标志着企业级 AI 领域的重大进展。

- 这一合作伙伴关系暗示了企业环境中技术使用方式的潜在重塑,尽管初步公告中未提供系统功能的具体细节。

GPT4O (gpt-4o-2024-05-13)

1. LLM 进展

- Qwen 模型媲美 LLaMA:关于 Qwen 2.5 7B 模型的讨论显示,它们在对话任务中的表现与 LLaMA 模型相当,并指出在训练效率方面存在显著差异。

- 针对这些模型之间切换性能的担忧被提出,暗示了在微调策略(fine-tuning strategies)中存在优化的潜力。

- Llama 3.2 模型加载问题:用户在 LM Studio 中加载模型时面临挑战,特别是在处理 ‘gguf’ 格式时,出现了与 AVX2 等过时 CPU 指令相关的错误。

- 建议包括升级硬件或切换到 Linux,突显了对更好兼容性解决方案的需求。

2. 模型性能优化

- DALI Dataloader 展示了惊人的吞吐量:DALI Dataloader 实现了每秒读取 5,000 张 512x512 JPEG 图像,展示了在大尺寸图像变换中对 GPU 资源的有效利用。

- 成员们注意到即使在全量 ImageNet transforms 下其性能依然稳定,强调了其高效性。

- 优化 Onnxruntime Web 体积:讨论集中在如何通过使用精简版本,将 Onnxruntime Web 的默认 WASM 大小从 20 MB 减少到更易于管理的 444K。

- 成员们探索了如 LTO 和 tree shaking 等策略,以便在合并自定义推理逻辑的同时进一步优化包体积。

- 使用 CUDA 并行化 RNN:讨论了使用 CUDA 并行化 RNN 的挑战,并引用了如 S4 和 Mamba 等创新解决方案。

- 社区对克服顺序依赖关系表现出浓厚兴趣,突显了该领域正在进行的深入研究。

3. 多模态 AI 创新

- Reka Flash 更新增强了多模态能力:最新的 Reka Flash 更新现在支持文本、图像、视频和音频的交错多模态输入,显著提升了功能性。

- 这一增强突显了在多模态理解(multimodal understanding)和实际应用方面的进展。

- 探索 Luma AI 的魔力:讨论集中在 Luma AI 及其令人印象深刻的视频应用上,特别是它在电影剪辑和创建独特摄像机运动方面的实用性。

- 成员们分享了资源和案例,强调了该工具在创意领域的潜力。

4. 开源 AI 框架

- OpenRouter 与 Fal.ai 合作:OpenRouter 已与 Fal.ai 建立合作伙伴关系,通过此链接增强了 Fal 图像工作流中的 LLM 和 VLM 能力。

- 此次集成允许用户利用先进的 AI 模型来改进图像处理任务。

- API4AI 助力 AI 集成:API4AI 平台促进了与 OpenAI 和 Azure 等服务的轻松集成,提供了多样化的现实世界交互 API。

- 这些功能使开发者能够构建强大的 AI 应用,提升功能和用户体验。

5. 微调挑战

- 微调 LLaMA 的挑战:用户注意到 LLaMA 3.1 在训练后产生无尽输出的问题,标志着微调过程中的挑战。

- 讨论强调了使用正确的聊天模板(chat templates)和序列结束(end-of-sequence)定义对于改善模型行为的必要性。

- 在模型微调中使用 LoRA:在微调中使用 LoRA 的可行性引发了辩论,一些人认为全量微调(full fine-tuning)总体上可能会产生更好的结果。

- 关于 LoRA 有效实施的不同观点浮出水面,突显了其在处理已经微调过的模型时的局限性。

GPT4O-Aug (gpt-4o-2024-08-06)

1. 模型微调与优化

- LLaMA 模型微调中的挑战:Discord 上的用户报告了在微调 LLaMA 3.1 等模型时遇到的问题,如生成输出无止尽,并强调了正确使用聊天模板(chat templates)和序列结束(end-of-sequence)定义的重要性。讨论重点关注了 LoRA 作为微调策略的重要性,并对其与全量微调(full fine-tuning)的效果进行了辩论。

- 社区分享了克服这些挑战的策略,例如合并数据集以获得更好的结果,以及利用 LoRA 进行高效微调。

- 量化与内存优化:NF4 训练等技术被指出可以将 VRAM 需求从 16G 降低到 10G,提供显著的性能提升。社区讨论还涵盖了优化 Onnxruntime Web 大小以及测试期间 CUDA 内存管理的策略。

- 成员们庆祝通过 NF4 将速度从 每步 11 秒 提升到 每步 7 秒,强调了这些优化对模型性能的益处。

2. AI 模型集成与应用

- OpenRouter 增强图像工作流:OpenRouter 与 Fal.ai 集成,增强了图像工作流中的 LLM 和 VLM 能力,允许用户使用 Gemini 简化任务。

- 此次集成有望为用户提高效率和产出,鼓励他们利用新功能重新思考流程。

- Companion Discord 机器人彻底改变参与方式:由 Cohere 驱动的 Companion 机器人引入了动态角色建模和审核功能,旨在提升 Discord 社区内的用户互动。

- 该项目邀请大家进行探索,因为它加强了审核效率并增强了社区讨论。

3. AI 研究与开发

- Meta 发布 Movie Gen 研究论文:Meta 关于 Movie Gen 的研究论文 深入介绍了他们在电影生成建模方面的进展,突出了创新的方法论。

- 该文档是理解 Meta 在电影生成技术进步背后方法论的重要参考。

- Entropix 采样器能力探索:Entropix/Entropy Guided Adaptive Sampler 通过优化注意力熵(attention entropy),展示了在提升模型性能、减少幻觉和增强叙事一致性方面的改进。

- 该项目即使在小模型中也显示出可喜的结果,表明其在提高叙事连贯性方面具有显著能力。

4. AI 工具与框架

- Sci Scope 提供个性化 AI 研究摘要:Sci Scope 每周汇总并总结新的 ArXiv 论文,提供个性化时事通讯,让研究人员及时了解关键进展。

- 订阅者受益于与其兴趣相关的定制论文列表,确保他们不会错过 AI 研究中的重要进展。

- Aider v0.59.0 发布带来增强功能:新的 Aider v0.59.0 版本包括对

/read-only命令的更新、YAML 配置格式更改,以及通过新的完整性检查(sanity checks)实现的性能改进。- 这些更新通过在编码任务期间更好的处理提高了性能,并引入了新的完整性检查以简化启动流程。

5. AI 社区与支持

- LlamaIndex RAG-a-thon 开幕:LlamaIndex Agentic RAG-a-thon 活动与 Pinecone 和 VESSL AI 合作,专注于推进检索增强生成(Retrieval-Augmented Generation)技术。

- 该活动旨在推进企业级应用的 AI agents,开发者有机会赢取现金奖励。

- AI 工具的社区支持:Discord 社区强调了协作和反馈的重要性,用户寻求 Cohere 和 OpenRouter 等工具的支持以改进其 AI 工作流。

- 鼓励成员联系以获取支持并分享反馈,强调了社区驱动改进的重要性。

O1-mini

主题 1. 模型微调与训练挑战

- 通过 Unsloth Studio 克服微调瓶颈:即将推出的 Unsloth Studio GUI 通过自动化数据集格式化和依赖管理来简化微调过程,目标用户是缺乏高级编程技能的初学者。

- 用户报告了 LLaMA 3.1 等模型在训练后生成无止尽输出的挑战,强调了需要适当的聊天模板和序列结束定义以获得更好的行为。

- LoRA 在模型精炼中的局限性引发辩论:LoRA 在模型微调中的可行性引发了争论,一些人主张通过全量微调(full fine-tuning)以获得更优结果,而另一些人则强调了 LoRA 在处理已微调模型时的约束。

- 关于如何有效实施 LoRA 出现了不同的观点,展示了其局限性以及社区对更好微调优化技术的追求。

- 梯度检查点(Gradient Checkpointing)增强 TinyGrad 训练效率:实现梯度检查点(gradient checkpointing)对于在 TinyGrad 中高效训练大型模型至关重要,使其能够处理超出小型玩具模型规模的参数。

- 如果没有这些优化,TinyGrad 中的模型在进行大规模训练时会非常吃力,从而限制了它们的实际应用。

主题 2. 新模型发布与性能对比

- Qwen 2.5 在对话任务中与 LLaMA 旗鼓相当:讨论显示 Qwen 2.5 7B 模型在对话任务中的表现与 LLaMA 相似,并对其训练效率和潜在的性能切换进行了辩论。

- 用户报告了微调能力方面的显著差异,表明 Qwen 是未来模型优化的一个可行替代方案。

- Dracarys 2 在代码基准测试中超越 Sonnet 3.5:新发布的 Dracarys 2 模型在 LiveCodeBench 等性能基准测试中超过了 Sonnet 3.5,在代码编辑任务中达到了 67% 的准确率。

- 尽管其初始声明令人印象深刻,但一些用户质疑其创新性,认为它只是现有模型的重新包装,而非突破性的进展。

- Phi-3.5 模型因安全特性面临社区抵制:Microsoft 的 Phi-3.5 模型因其过度的审查设计而遭到社区的嘲讽,导致 Hugging Face 上出现了无审查版本的分享。

- 用户通过讽刺性的回应,表达了对该模型因过度内容限制而在技术任务中缺乏实用性的担忧。

主题 3. 集成、工具与部署

- Unsloth Studio 简化 AI 模型训练:Unsloth Studio GUI 的推出旨在降低 AI 模型微调的难度,通过自动处理数据集格式化和依赖管理,特别照顾到没有深厚编程知识的初学者。

- 用户强调了它在减轻常见微调问题方面的潜力,从而增强了更广泛用户群体的可访问性。

- RYFAI 应用推动私有 AI 访问:开源的 RYFAI 应用强调离线运行和用户隐私,旨在为 Ollama 和 OpenWebUI 等成熟的 AI 工具提供具有竞争力的替代方案。

- 讨论中涉及了对市场饱和度和差异化策略的担忧,用户对其与更成熟解决方案的竞争能力持辩论态度。

- TorchAO 期待 NF4 支持以优化 VRAM:社区热切期待 TorchAO 中 NF4 的实现,这可以将 VRAM 需求从 16G 降低到 10G,并将训练速度从每步 11 秒提高到 7 秒。

- 成员们对这些预期的性能增强表示赞赏,认为它们是高效模型微调和资源管理的变革者。

主题 4. API 问题、成本与支持

- Cohere API 错误导致项目中断:用户在模型微调过程中频繁遇到 Cohere API 错误(如 ‘InternalServerError’),导致项目进度严重受阻。

- 管理员承认由于错误积压过多,正在优先处理支持工单,并敦促受影响的用户在解决方案实施期间保持耐心。

- 大规模媒体分析导致 OpenAI API 成本上升:使用 OpenAI API 分析数千个媒体文件可能会超过 12,000 美元,这引发了关于本地解决方案可行性的讨论,尽管本地方案也伴随着高昂的存储和处理成本。

- 用户询问潜在的具有成本效益的替代方案,在云端 API 的便利性与项目预算的财务挑战之间进行权衡。

- OpenRouter API 持续出现重复生成问题:用户报告在使用 OpenRouter API 时持续出现重复生成的响应,这表明存在特定于设置的问题,而一些用户在调整响应解析器后遇到了 404 错误。

- 故障排除建议包括审查 API 设置配置并优化响应解析器,以减轻重复响应问题。

主题 5. 数据流水线与合成数据的使用

- Canvas 项目中合成数据增强了模型训练:Canvas 项目利用合成数据生成技术(例如蒸馏来自 OpenAI o1-preview 的输出)来微调 GPT-4o,从而实现 AI 模型能力的快速提升。

- 这种方法允许在不需要大量人工生成数据集的情况下实现可扩展的模型改进,展示了数据处理方面的效率和创新。

- SWE-bench Multimodal 评估视觉问题解决能力:新推出的 SWE-bench Multimodal 从 17 个 JavaScript 仓库中引入了 617 个新任务,以评估 AI Agent 解决视觉 GitHub 问题的能力,解决了目前 Agent 性能的局限性。

- 这一全面的基准测试旨在提高 AI 模型在真实编码环境中的多模态理解和实际问题解决能力。

- Entropix 采样器警告不要过度使用合成数据:Entropix/Entropy Guided Adaptive Sampler 警告不要过度使用来自 AI 输出的合成数据,以防止模型过拟合,同时也承认其在早期训练阶段的有效性。

- 用户正在探索替代的数据生成方法,重点是通过平衡的数据集策略来维持模型的可靠性和性能。

O1-preview

主题 1:微调与模型训练中的创新与工具

- Unsloth GUI 让初学者的微调变得轻而易举:即将推出的 ‘Unsloth Studio’ GUI 旨在通过自动处理数据集格式化和依赖关系来简化微调。这一创新针对的是那些在没有高级编程技能的情况下进行模型训练时面临挑战的初学者。

- Torchtune 听取建议:KTO 训练支持请求:用户渴望在 Torchtune 中获得 KTO 训练 支持,建议将其添加到 DPO 配方中。开发人员建议提交一个 issue 来跟踪此功能请求。

- TinyGrad 通过梯度检查点加速训练:讨论强调了 tinygrad 中 梯度检查点 (gradient checkpointing) 对于高效训练大型模型的重要性。如果没有这些优化,tinygrad 只能处理 “非常小的玩具模型”,从而限制了其整体性能。

主题 2:新 AI 模型及其能力

- OpenAI 的 o1 模型声称思考方式不同,引发质疑:关于 OpenAI o1 将推理直接集成到模型中的争论不断,一些人称其为 “简化” 并质疑其真实能力。怀疑论者强调,潜在的挑战可能尚未得到充分解决。

- Dracarys 2 吐火,占据顶尖编码模型宝座:Dracarys 2 宣布自己是世界上最好的开源编码模型,在 LiveCodeBench 上以 67% 的得分超越了 Sonnet 3.5。批评者认为它是现有模型的翻版,而非真正的创新。

- Meta 发布重磅消息:Movie Gen 研究论文发布:Meta 分享了他们的 Movie Gen 研究论文,详细介绍了生成式电影建模方面的进展。该文档对于理解 Meta 在电影生成技术创新背后的方法论至关重要。

主题 3:AI 辅助工具与应用的增强

- Agent 群体自动创建 YouTube 视频,接管内容创作:该项目展示了如何使用 LlamaIndex 构建一个 Agent “集群”,根据自然语言提示词自主创建 AI 生成的 YouTube 视频。这种方法突显了 multi-agent architectures 在简化视频生成工作流方面的潜力。

- Cursor 团队编写未来,与 Lex Fridman 对话:Cursor team 在与 Lex Fridman 的对话中讨论了 AI 辅助编程和编码的未来,展示了他们的创新环境。话题涵盖了 GitHub Copilot 以及 AI 集成到编码工作流中的复杂性。

- Companion Discord 机器人通过 Cohere 集成结交朋友:新的 Companion bot 利用 Cohere 增强动态人格建模和用户交互,同时为 Discord 服务器提供集成的审核工具。这加强了 Discord 内部的社区参与度和审核效率。

主题 4:AI 社区应对平台与 API 故障

- Cohere 用户因 API 错误和 429 问题抓狂:沮丧的用户报告了 Cohere API 持续出现的 ‘InternalServerError’ 和 429 errors,影响了他们的项目和测试。版主确认由于积压严重,正在优先处理支持工单。

- Perplexity AI 削减 Opus 限制,用户因消息次数减少而抗议:随着 Perplexity AI 将 Opus 消息限制减少到 每天 10 条,引发了用户愤怒;用户的强烈抵制显然导致其恢复到了 50 条消息。用户对突然的变化表示不满,并提出了关于消费者权益的问题。

- Aider 陷入困境,用户抱怨性能缓慢:用户在使用 Sonnet 3.5 API 时,尤其是在处理大文件时,遇到了 Aider 的显著延迟。建议包括限制上下文文件和使用 verbose 标志,许多人正在寻求 OpenRouter 等替代方案进行 API 管理。

主题 5:AI 研究与理论探索的进展

- 基于熵的采样有望实现更智能的 AI Prompt:Entropix project 引入了 Entropy Guided Adaptive Sampling,通过评估注意力熵来增强 Prompt 优化。其优势包括提高叙事一致性和减少幻觉,表明即使在小模型中也具备这种能力。

- GenRM 融合策略与奖励模型以实现更好的 AI 对齐:Generative Reward Models (GenRM) 的引入将奖励模型训练为 next-token 预测器,改善了 Chain-of-Thought reasoning 以及与人类价值观的对齐。该方法旨在提升决策中的推理能力。

- RWKV 系列版本更迭让研究人员眼花缭乱:社区成员难以追踪 RWKV 各个版本的变化;一篇 论文 提供了逐步概述以帮助理解。这突显了在快速演进的模型中需要更清晰的文档说明。

第一部分:Discord 高层级摘要

Unsloth AI (Daniel Han) Discord

- Unsloth GUI 简化微调:即将推出的 “Unsloth Studio” GUI 旨在通过自动管理数据集格式化和依赖项来简化微调流程。

- 这一创新针对的是那些缺乏高级编程技能、在模型训练中面临挑战的初学者。

- Qwen 模型媲美 LLaMA:讨论强调 Qwen 2.5 7B 模型在对话任务中的表现与 LLaMA 模型相似,用户报告了在训练效率方面的显著差异。

- 提出了关于在两个模型之间切换性能的担忧,暗示了微调优化的潜在途径。

- LLaMA 微调中的挑战:用户注意到 LLaMA 3.1 在训练后会出现无尽生成输出的问题,这标志着微调过程中的挑战。

- 讨论集中在为了改善模型行为而使用正确的聊天模板和序列结束(end-of-sequence)定义的必要性。

- 在模型微调中使用 LoRA:在微调中使用 LoRA 的可行性引发了辩论,一些人认为全量微调(full fine-tuning)可能会产生更好的整体结果。

- 关于如何有效实施 LoRA 的不同意见浮出水面,强调了其在处理已经微调过的模型时的局限性。

- RYFAI 应用带来私有 AI 访问:RYFAI 的推出(一款适用于各种操作系统的开源应用)强调了用户隐私和离线运行。

- 对其与成熟工具竞争的能力提出了担忧,并讨论了市场饱和度和差异化问题。

HuggingFace Discord

- 关于 AGI 和 AI 推理的辩论:一场关于 AGI 可实现性 的讨论展开,强调其与类似于人类大脑功能的概率结构之间的关系。

- 参与者强调了 LLM 与人类思维过程中推理的不同解释。

- Hugging Face 模型与内存限制:用户询问了 Hugging Face 上如 Llama 3.1 等模型的上下文窗口(context windows),并分享了在高内存配置下的经验。

- 对在云平台上运行高上下文模型相关成本的担忧非常普遍。

- 模型微调的挑战:用户报告了在微调模型方面的困扰,特别是注意到 DETR 模型 在边界框(bounding boxes)方面的不准确性,并提供了进一步的上下文链接。

- 这些不准确性引发了关于针对特定任务优化性能的讨论。

- 合成数据的探索:对话涉及了使用合成数据的影响,警告尽管初始性能有所提高,但仍存在潜在的过拟合风险。

- 参与者表达了学习替代数据生成方法以优化模型训练的共同兴趣。

- 持续的服务中断更新:10 月 6 日报告了影响 Share API 和 Share Links 的服务中断,用户被引导至 状态页面 获取更新。

- 幸运的是,很快宣布所有受影响的系统已恢复在线,缓解了用户的使用中断。

GPU MODE Discord

- LLM 训练器咨询引发关注:一名成员表示想花 100 小时用 Rust 和 Triton 编写一个 LLM 训练器,Sasha 可提供咨询或合作。

- 这可能会带来 LLM 训练领域的创新发展。

- DALI Dataloader 展示了惊人的吞吐量:DALI Dataloader 每秒可以读取 5,000 张 512x512 的 JPEG 图片,有效地利用 GPU 资源进行大规模图像变换。

- 成员们注意到,即使在进行完整的 ImageNet transforms 时,其性能依然强劲。

- 使用 CUDA 并行化 RNN 的进展:讨论集中在使用 CUDA 并行化 RNN 的挑战上,并参考了 S4 和 Mamba 等创新解决方案。

- 这揭示了社区对于克服 RNN 架构中顺序依赖关系的兴趣。

- 优化 Onnxruntime Web 大小:Onnxruntime Web 的默认 WASM 大小为 20 MB,引发了关于在整合自定义推理逻辑时进行优化的讨论。

- 成员们探索了各种策略,包括使用仅 444K 的精简版本,以实现潜在的效率提升。

- 期待 TorchAO 支持 NF4:成员们表达了对 TorchAO 实现 NF4 的渴望,指出它可以将 VRAM 需求从 16G 降低到 10G。

- 他们庆祝速度从 每步 11 秒 提升到 每步 7 秒,强调了性能的增强。

OpenAI Discord

- 文档分类自动化:用户探索了 AI 工具如何通过内容分析显著简化文档分类,强调了增强效率的结构化方法。

- 有人对项目目标的沟通可能存在脱节表示担忧,这可能会阻碍自动化进程。

- OpenAI API 的成本影响:在讨论财务方面时,发现使用 OpenAI API 分析数千个媒体文件的费用可能超过 $12,000,这对依赖该服务的项目构成了挑战。

- 这引发了对本地解决方案可行性的询问,尽管本地存储和处理能力也涉及潜在的高昂成本。

- GPT-4 处理复杂数学的能力:据报道,GPT-4o 能有效应对复杂的数学挑战,尤其是与 Wolfram 等插件结合使用时。

- 一位用户提到了 GPT 行为的随机性(stochastic nature),并建议通过与外部工具更紧密的集成来增强可靠性。

- 有效关键词选择的需求:一位用户试图从 12,000 个关键词的大型集合中筛选出 50 个关键词,由于模型的 context window 限制,这一任务面临挑战,凸显了任务的复杂性。

- 参与者建议采用批量查询和结构化数据展示来简化关键词选择过程。

- Prompt Engineering 的挑战:许多用户表示在编写有效 Prompt 方面存在困难,特别是在处理确定性任务时,这表明缺乏向 AI 传达需求的简化方法。

- 对话强调了在创建可执行 Prompt 所需理解方面的差距,建议需要更清晰的指南。

aider (Paul Gauthier) Discord

- Aider v0.59.0 发布带来增强功能:新版本 v0.59.0 增强了对

/read-only命令的支持,增加了 shell 风格的自动补全,并更新了 YAML 配置格式以提高清晰度。- 该更新通过在编码任务期间更好的处理提升了性能,并引入了新的 sanity checks 以简化启动流程。

- 对 Aider 性能缓慢的担忧:用户在使用 Sonnet 3.5 API 时遇到了 Aider 的显著延迟,特别是在处理大文件或广泛的代码上下文时。

- 建议包括限制上下文文件和使用 verbose 标志,许多用户正在寻求像 OpenRouter 这样的替代方案来进行 API 管理。

- 推介 Dracarys 2 作为顶级编码模型:Dracarys 2 被宣布为一款强大的编码模型,在 LiveCodeBench 等性能基准测试中超越了 Sonnet 3.5。

- 虽然它在代码编辑方面达到了 67%,但一些用户认为它只是现有模型的翻版,而非真正的能力创新。

- Python 3.13 特性脱颖而出:Python 3.13 的正式发布展示了诸如更好的 REPL 以及在没有 GIL 的情况下运行 Python 等增强功能。

- 值得注意的更新还包括通过 Beeware 项目扩展了对 iOS 和 Android 作为 Tier 3 supported 平台的支持。

- 语义搜索技术的创新:关于 semantic search 优于关键词搜索的讨论强调了其根据含义而非精确匹配来增强查询结果的能力。

- 然而,实例表明,过度依赖语义搜索可能会在实际应用中导致意想不到的糟糕结果。

Nous Research AI Discord

- Nous Research 通过新模型进行创新:Nous 推出了 Forge 和 Hermes-3-Llama-3.1-8B 等令人兴奋的项目,展示了其在用户导向可控性 (user-directed steerability) 方面的尖端技术。

- 这些进步突显了令人印象深刻的创造力和性能,有可能改变 AI 的未来发展。

- Meta Movie Gen 研究论文发布:Meta 发布了一篇研究论文,详细介绍了他们在生成建模方面的 Movie Gen 创新。

- 该文档是理解 Meta 在视频生成技术方面进步的方法论的重要参考。

- GenRM 增强奖励模型训练:GenRM 的引入展示了奖励模型训练方式的重大转变,集成了 next-token predictions 和 Chain-of-Thought 推理。

- 这一进步通过利用统一的策略和奖励模型,提升了众多任务的性能。

- SwiftSage v2 开源 Agent 推出:集成了不同思维方式以增强推理能力的新型 SwiftSage v2 Agent 系统现已在 GitHub 上可用。

- 该系统针对复杂问题,展示了在使用 in-context learning 的各种推理任务中的优势。

- Open Reasoning Tasks 项目说明:Open Reasoning Tasks 频道被明确为一个讨论 GitHub 上正在进行的工作的协作空间。

- 鼓励成员贡献与增强 AI 系统推理任务相关的见解和开发成果。

LM Studio Discord

- 模型加载困扰:用户在 LM Studio 中加载模型时遇到问题,遇到诸如 ‘No LM Runtime found for model format ‘gguf’!’ 之类的错误,这通常是由于 CPU 指令集(如 AVX2)过旧导致的。

- 他们建议升级硬件或切换到 Linux 以获得更好的兼容性。

- GPU 配置难题:社区评估了在多 GPU 设置中混合使用 GPU 的挑战,特别是使用 4090 和 3090 型号,强调了潜在的性能限制。

- 共识表明,虽然混合使用是可行的,但较慢的 GPU 往往会成为整体性能的瓶颈。

- 图像处理见解:关于支持图像处理模型的问题,推荐将 MiniCPM-V-2_6-GGUF 作为一个可行的选择。

- 用户对图像尺寸以及分辨率如何影响模型推理时间表示关注。

- 提示词模板要点:正确使用提示词模板对 LLM 至关重要;不恰当的模板可能导致输出中出现意外的 Token。

- 讨论显示,偏离默认模板可能会导致显著的输出不匹配。

- GPU 显存对决:对比性能讨论强调,拥有 24GB VRAM 的 Tesla P40 非常适合 AI 任务,而拥有 16GB 的 RTX 4060Ti 在某些场景下也能胜任。

- 针对 P40 在 Stable Diffusion 中较慢的表现存在担忧,强调了其能力未被充分利用。

OpenRouter (Alex Atallah) Discord

- OpenRouter 与 Fal.ai 合作:OpenRouter 已正式与 Fal.ai 建立合作伙伴关系,通过此链接增强图像工作流中的 LLM 和 VLM 能力。

- 用户可以使用 OpenRouter 上的 Gemini 重新构思他们的工作流,以简化图像处理任务。

- API4AI 助力 AI 集成:API4AI 平台促进了与 OpenAI 和 Azure 等服务的轻松集成,提供了一系列现实世界交互 API,包括邮件处理和图像生成。

- 这些功能使开发者能够更有效地构建多样化的 AI 应用程序。

- 重复生成问题依然存在:用户报告在使用 OpenRouter API 时出现重复生成响应的问题,这表明存在特定于设置的问题,而一些用户在调整响应解析器后遇到了 404 错误。

- 这表明需要排查潜在的超时或 API 可用性延迟。

- 数学模型在 STEM 任务中表现出色:用户强调 o1-mini 是数学 STEM 任务的首选模型,因为它在渲染输出方面效率很高,同时也引发了关于 LaTeX 渲染能力的讨论。

- 社区热衷于优化 OpenRouter 环境中的数学公式交互。

- 寻求非营利组织折扣:出现了关于非洲非营利教育机构获取 OpenRouter 服务潜在折扣的咨询。

- 这反映了 AI 社区内对于教育倡议能够获得负担得起的技术支持的广泛愿望。

Eleuther Discord

- MATS 项目迎来新导师:Alignment Science 联合负责人 Jan Leike 将担任 MATS Winter 2024-25 的导师,申请截止日期为 10 月 6 日晚上 11:59 PT。

- 该导师项目提供了对对齐科学的深刻见解,使其成为潜在申请者梦寐以求的机会。

- 理解 ICLR 论文发布时间:讨论澄清了 ICLR 论文发布的时间通常取决于评审过程,并可能存在草案的非正式分享。

- 成员们强调,了解这些时间线对于保持研究可见性至关重要,特别是对于那些等待最终预印本的人。

- RWKV 系列及版本控制挑战:社区探讨了追踪 RWKV 系列版本变化的困难,表明需要更清晰的文档。

- 链接的论文提供了 RWKV 变更的逐步概述,这可能有助于测试和研究理解。

- 增强 AI 对齐的生成式奖励模型:成员们讨论了思维链生成式奖励模型 (CoT-GenRM),旨在提高训练后性能以及与人类价值观的对齐。

- 通过融合人类和 AI 生成的反馈,该方法旨在提升决策中的推理能力。

- 开发中对 JAX 模型的支持:关于为 JAX 模型 提供一流支持的潜力的对话被激发,成员们渴望获得更新。

- 这突显了人们对于优化框架以适应机器学习开发中不断变化的需求日益增长的兴趣。

Cohere Discord

- Cohere API 错误与困扰:用户在项目过程中遇到了频繁的 Cohere API 错误,如 ‘InternalServerError’,特别是在微调页面上,影响了推进试验至关重要的技术。

- 版主确认由于积压严重,已优先处理支持工单,成员们强调了 429 错误 影响了多个用户。

- Companion Discord 机器人革新互动体验:引入了利用 Cohere 的 Discord 机器人 Companion,以增强动态人格建模和用户互动,同时提供集成的审核功能。

- 该 GitHub 项目旨在提升社区讨论质量,并邀请大家探索,因为它加强了 Discord 内的审核效率。

- 关于 API 商业用途的讨论:社区成员确认 Cohere API 可用于商业用途,目标是企业解决方案,同时引导用户查看 FAQ 以获取许可详情。

- 讨论强调了 API 稳定性和效率的重要性,开发者们热衷于了解从其他平台迁移的细微差别。

- Rerank API 响应受到关注:有关 Rerank API 在使用 return_documents: True 参数时未返回预期文档数据的担忧浮出水面,阻碍了数据检索过程。

- 用户渴望了解最近的更新是否改变了功能,并寻求对之前受损效率的解答。

- 社区关注协作与反馈:成员们敦促用户联系支持部门并与 Cohere 团队分享反馈,强调了社区驱动改进的重要性。

- 对话围绕着提供可操作见解的必要性展开,以改善 Cohere 生态系统中的用户体验和技术性能。

Latent Space Discord

- SWE-bench Multimodal 发布,旨在解决视觉问题:新的 SWE-bench Multimodal 旨在评估 Agent 解决视觉 GitHub 问题的能力,包含来自 17 个 JavaScript 仓库的 617 个新任务,并引入了 SWE-agent Multimodal 以实现更好的处理。

- 该计划针对现有 Agent 的局限性,推动在视觉问题解决中有效地完成任务。

- Reka Flash 更新增强了多模态能力:Reka Flash 的最新更新支持交错的多模态输入,如文本、图像、视频和音频,显著提升了其功能。

- 这一增强突出了在实际应用中多模态理解和推理方面的进展。

- Cursor 团队与 Lex Fridman 讨论 AI 辅助编程:在与 Lex Fridman 的对话中,Cursor 团队深入探讨了 AI 辅助编程和不断演变的编程未来,展示了他们的创新环境。

- 讨论涵盖了具有影响力的议题,如 GitHub Copilot 以及 AI 集成到编程工作流中的复杂性。

- Discord 音频故障困扰用户:成员在通话过程中遇到音频问题,由于听取困难,有人建议切换到 Zoom。

- Verymadbear 调侃道:“如果麦克风没出问题,那就不叫真正的会议”,道出了大家面临的挫败感。

- 探索 Luma AI 的魔力:对话集中在 Luma AI,展示了使用该工具开发的令人印象深刻的视频应用和项目,特别是它在电影剪辑中的实用性。

- Karan 强调了 Luma 为电影制作带来的创造力,并强调了其实现独特镜头运动的能力。

Stability.ai (Stable Diffusion) Discord

- AMD vs NVIDIA:关于 SD 的大辩论:用户在 Stable Diffusion 生成图像时更倾向于选择 RTX 4070 而非 RX 6900 XT,理由是性能更优。

- 一些人建议将 3080 Ti 作为 4070 的替代方案,其速度快 30%,为 GPU 对比增加了另一个维度。

- CogVideoX 在视频生成领域夺冠:在文本到视频(text-to-video)生成方面,CogVideoX 目前是领先的开源模型,超越了像 Svd 这样的旧模型。

- 用户指出 Stability 已经落后,替代模型被证明在认知能力上更胜一筹。

- UI 之战:Stable Diffusion 的 ComfyUI vs Forge UI:从 Automatic1111 转型时,用户在 ComfyUI 和 Forge UI 之间产生了分歧,两者都展示了独特的优势。

- 虽然许多人因为易用性而偏好 ComfyUI,但也有人欣赏 Forge 作为 Auto1111 的优秀分支所带来的增强功能。

- LoRA 训练难题困扰社区:用户在为 SDXL 训练 LoRA 时表达了挑战,并在专门用于故障排除的社区频道中寻求帮助。

- 社区成员积极提供支持,分享资源以协助创建有效的 LoRA 模型。

- 生成后编辑:用户想要更多功能:围绕生成后编辑的讨论不断涌现,重点在于上传并重新生成特定图像区域的能力。

- 用户对突出显示并更改生成图像部分的理念很感兴趣,寻求工作流的改进。

Perplexity AI Discord

- Opus 限制引发用户愤怒:用户对 Opus 消息突然减少到 每天 10 条 表示沮丧,并对消费者权益提出了质疑。

- 随后的更新表明限制可能已恢复到 50 条消息,缓解了社区内的一些担忧。

- Perplexity 遭遇用户困扰:多位用户报告了 Perplexity 在访问 Pro 功能和客户支持延迟方面的问题。

- 随着用户注意到平台转向推广内容而非实质性的功能增强,担忧情绪日益增加。

- 开发团队的重心受到质疑:用户对开发团队在 Mac app 之外的优先级提出了疑问,希望看到更多显眼的新功能。

- 社区反馈暗示,平台重心似乎转向了赠品活动,而非重大的平台改进。

- 探索 API 的 Structured Outputs:关于在 Perplexity API 中集成 Structured Outputs 的讨论,借鉴了 OpenAI library 中的功能。

- 这一探索强调了人们对扩展 API 功能以更好满足用户需求日益增长的兴趣。

- 量子钟(Quantum Clocks)承诺更高精度:一个涉及 quantum clocks 的创新概念突显了精密计时领域的进展。

- 该技术承诺比传统方法具有更高的准确性,为未来的应用打开了大门。

LlamaIndex Discord

- LlamaIndex 在 Milvus DB 集成方面遇到困难:由于意外的 API 更改以及对原生对象的依赖,用户报告了在将 Milvus DB 集成到其 LlamaIndex 工作流中时面临的挑战。

- 他们呼吁采用更模块化的设计,以便在不强制依赖结构化对象的情况下有效利用预构建组件。

- Swarm Agents 创建 AI 生成的视频:一个项目展示了如何构建一个 Agent “集群(swarm)”,从自然语言提示词开始自主创建 AI 生成的 YouTube 视频,详见 此教程。

- 这种方法突显了 multi-agent architectures 在简化视频生成工作流方面的潜力。

- RAG 流水线中的动态数据源推理:在 RAG 流水线之上的 Agent 层允许将不同的数据源构建为“工具”,从而增强对源检索的推理,总结见 此处。

- 这种动态方法强调了数据处理正转向更具交互性和响应性的检索机制。

- Agentic Retrieval 的快速设置:一份实用的指南提供了 RAG 中 agentic retrieval 的快速设置,与静态检索方法相比,为更灵活的数据处理铺平了道路,详见 此指南。

- 用户对实现的简便性表示赞赏,这标志着检索架构使用方式的转变。

- 通过 Multi-Agent 系统实现法律合规:一个 multi-agent system 协助公司评估法规合规性并起草法律回复,更多详情见 此处。

- 该系统实现了法律判例审查的自动化,展示了法律工作流中显著的效率提升。

tinygrad (George Hotz) Discord

- 梯度检查点(Gradient Checkpointing)增强训练:一名成员询问了 gradient checkpointing,这对于高效训练大型模型至关重要,并强调了它在提升训练能力方面的作用。

- 如果没有这些优化,tinygrad 只能处理非常小的玩具模型,从而限制了其整体性能。

- 用于色彩空间适配的 VAE 训练:围绕训练 Variational Autoencoder (VAE) 以使现有模型适配 CIE LAB 色彩空间以改善输出展开了讨论。

- 对输入的重大更改将需要超出简单 finetuning 范围的广泛修改,从而使过程复杂化。

- 澄清 Tinybox 并非服务器工具:一位用户寻求关于 tinygrad 功能的澄清,询问它是否充当运行 LLM 的本地服务器。

- 澄清指出 tinygrad 更类似于 PyTorch,侧重于开发而非服务器功能。

- KAN 网络带来快速训练:尽管存在炒作,成员们注意到在 TinyGrad 中很难找到现有的 KAN networks 实现,同时展示了能够实现高效训练的示例。

- FastKAN 在 MNIST 上实现了 10 倍加速,强调了其性能优势。

- VIZ 和调度器(Scheduler)增强更新:成员们收到了关于 VIZ server 完全重写的更新,目标是增强内核和图重写。

- 随着开发的继续,进展的主要阻碍包括解决 ASSIGN 问题以及完善融合(fusion)和分组逻辑(grouping logic)。

Interconnects (Nathan Lambert) Discord

- OpenAI o1 集成推理能力:讨论透露 OpenAI o1 直接在模型中集成了推理,超越了推理过程中传统的 MCTS 等方法。

- 尽管如此,对于底层挑战的简化仍存在怀疑,特别是因为某些讨论似乎受到了审查。

- Entropix 提供提示词优化:Entropix/Entropy Guided Adaptive Sampler 增强了提示词优化,专注于注意力熵(attention entropy)以提升模型性能。

- 提到的优势包括提高叙事连贯性和减少幻觉,这表明即使在小模型中也具备这些能力。

- Reflection 70B 未能达到基准测试水平:一位成员对他们复制的 Reflection 70B 表示失望,该模型未能匹配其最初报告的基准测试结果。

- 尽管如此,他们仍致力于反思微调概念,并承诺很快会提供更详细的见解。

- Open O1 作为竞争对手出现:Open O1 作为专有模型的有力替代方案被引入,声称在推理、编程和数学任务方面具有优越性。

- 一些社区成员认为讨论缺乏深度,要求对该模型进行更透彻的分析。

- RNN 投资诉求引起关注:一条推文热切呼吁资助开发“再多一个 RNN”,声称它可以摧毁 Transformer 并解决长上下文问题。

- 该成员满怀热情地强调了支持的紧迫性,敦促社区采取行动。

DSPy Discord

- 类生成(Class Generation)Notebook 发布:GitHub 仓库现在新增了一个关于类生成的 Jupyter notebook,展示了来自 DSPy 和 Jinja2 的结构化输出。

- 该项目旨在增强结构化输出生成,并邀请在 GitHub 上进行进一步贡献。

- 即将举行现场编程(Livecoding)活动:宣布了一场激动人心的现场编程活动,成员们可以直接在 Discord 中观察 Notebook 的创建过程。

- 鼓励成员加入讨论帖,在会议期间进行互动,促进协作式 Notebook 开发。

- TypedPredictors 已准备就绪:有关于在没有模式格式化逻辑的情况下使用

TypedPredictors的讨论,估计可以在大约 100 行代码内实现。- 预计很快会集成到

dspy.Predict中,为开发者提供高效路径。

- 预计很快会集成到

- 可追溯性(Traceability)并不像看起来那么棘手:一位用户询问如何在不使用外部库的情况下为 DSPy 添加可追溯性,以跟踪 Token 数量并管理成本。

- 建议利用

your_lm.history属性来有效监控支出。

- 建议利用

- 从 dspy.OllamaLocal 转向 dspy.LM 时面临挑战:一位新用户报告在从

dspy.OllamaLocal切换到dspy.LM期间出现段错误(segmentation fault),表明可能存在版本不匹配。- 回复建议重新安装 DSPy 或确认使用正确的模型端点以解决该问题。

LLM Agents (Berkeley MOOC) Discord

- 来自 chat_manager 的实时流传输:一个 streamlit UI 实现了来自 chat_manager 的实时流传输,这得益于一个用于自定义消息处理的 GitHub pull request。

- 此设置对于需要用户对消息进行即时反馈的交互式应用至关重要。

- 线下出席名额专属:由于容量限制,只有 Berkeley 的学生可以线下参加即将举行的讲座,限制了更广泛的访问。

- 这一限制在关于非 Berkeley 学生座位可用性的讨论中得到了确认。

- Omar 的讲座引发热烈反响:成员们对 Omar 即将举行的关于 DSPy 的讲座表示热切期待,强调了其相关性。

- 强调了对 DSPy 项目的积极贡献,反映了成员们在提升专业知识方面的投入。

- 成员参与 DSPy 贡献:一位成员详细介绍了他们最近对 DSPy 项目的贡献,展示了他们的参与度以及增强该框架的愿望。

- 这种持续的参与标志着社区对改进 DSPy 功能的浓厚兴趣。

Modular (Mojo 🔥) Discord

- 重构 Mojo 参数约定语法:一位成员分享了一份关于重构参数约定语法的提案,旨在完善 Mojo 编程语言的各个方面。

- 他们鼓励通过 GitHub Issue 提供社区反馈,以帮助完善该提案。

- Mojo 发布基准测试框架:Mojo 引入了一个用于运行时性能评估的 benchmark 软件包,类似于 Go 的测试框架。

- 成员们讨论了使用

benchmark.run来高效评估函数性能,并报告平均耗时和迭代次数。

- 成员们讨论了使用

- 枚举现在支持 Variant 类型:成员们澄清说 Mojo 中没有专门的枚举语法,但 Variant 类型可以提供类似的功能。

- 在引入完整的 sum types 之前,可以通过 struct 声明和别名来创建标签。

- Max Inference Engine 遇到错误:用户报告了在 Intel NUC 上使用 max inference engine 时的问题,遇到了与

libTorchRuntimePlugin-2_4_1_post100.so和 ONNX 操作相关的错误。- 问题包括操作合法化失败以及更改 opset 版本时的并发症。

- 兼容性 Torch 版本澄清:一位用户询问了 PyTorch 的安装情况,问道 你使用的是哪个 torch 版本? 以确保兼容性。

- 提供的输出显示 PyTorch 版本为 2.4.1.post100,并包括关于 GCC 版本 13.3 和来自 conda-forge 的 Intel 优化的细节。

Torchtune Discord

- Torchtune 缺乏 KTO 训练支持:一位成员询问 Torchtune 是否支持 KTO 训练,有迹象表明,如果有必要,这可能会被添加到 DPO recipe 中。

- 他们建议提交一个 issue 来跟踪此功能请求。

- 大型自定义 CSV 数据集出现 AssertionError:用户报告说,当 shuffle=false 时,大于 100MB 的自定义 CSV 数据集会出现 AssertionError,但较小的数据集运行正常。

- 这表明错误可能与数据集大小有关,而非代码本身。

- LLAMA 3.2 3B 微调问题:关于 LLAMA 3.2 3B 的全量微调进行了讨论,强调蒸馏模型通常需要特定处理,如较低的学习率。

- 一位用户提高了学习率以获得满意的损失曲线,尽管他们缺乏全面的评估数据。

- Grace Hopper 芯片备受关注:成员们分享了关于 Grace Hopper 芯片性能的查询,特别是它们与带有 Hopper GPU 的标准架构相比如何。

- 这说明了人们对使用新硬件设计所带来的影响有着浓厚的兴趣。

- 训练效率:最大序列长度 vs Batch Size:建议优化最大序列长度而非增加 batch size,以增强 blockmask dimension 的性能。

- 使用较长的序列可能会提高打包效率,但由于静态打包方法,可能会减少数据打乱。

OpenAccess AI Collective (axolotl) Discord

- 微调后的 GPT-4 模型消失了:一位成员幽默地声称 OpenAI 可能拿走了所有人的微调 GPT-4 模型,并表示 ‘I lost my models’(我丢了我的模型),并暗示其性能很垃圾。

- 另一位成员指出,‘you only finetune weights you own,’(你只能微调你拥有的权重),强调了使用共享资源的风险。

- 群组 Logo 更改引发混乱:一位成员表示由于 Logo 更改,他们跟丢了社区,并幽默地哀叹这造成的困惑。

- 这强调了品牌变更对社区认可度的影响。

- Intel 与 Inflection AI 联手:一位成员分享了一篇文章,详细介绍了 Intel 与 Inflection AI 合作推出企业级 AI 系统的情况,称其很有趣。

- 这一公告表明企业级 AI 领域将有重大发展,可能会重塑技术的使用方式。

- 探索 Axolotl 的非 pip 打包工具:一位成员询问是否可以将 Axolotl 切换到像 uv 这样的非 pip 打包工具,因为他们对依赖项问题感到沮丧。

- 他们表示愿意为增强包管理体验做出贡献。

- fschat 包未找到错误:一位用户报告在安装

axolotl[deepspeed,flash-attn]时出现 ‘Could not find a version that satisfies the requirement fschat (unavailable)’ 错误。- 列出的可用版本范围从 0.1.1 到 0.2.36,但没有一个被标记为可用,这引起了困惑。

LAION Discord

- LlamaIndex RAG-a-thon 启动:LlamaIndex Agentic RAG-a-thon 定于 10 月 11 日至 13 日在硅谷举行,重点关注与 Pinecone 和 VESSL AI 合作的 Retrieval-Augmented Generation 技术。

- 该活动旨在推进用于企业应用的 AI agents,开发者有机会赢得现金奖励,详见此链接。

- O1 在简单任务上失败:讨论显示,O1 声称在奥林匹克级别的任务中表现强劲,但在更简单的问题上却表现挣扎,引发了对其泛化能力的担忧,正如相关讨论中所述。

- 这些发现引发了关于 SOTA LLMs 如何有效管理泛化的问题,这一担忧得到了研究论文的支持。

- 寻求 Clip Retrieval API 的明确说明:人们对 clip retrieval API 持续关注,一位成员询问更新情况,表明该技术开发方面的沟通存在断层。

- 缺乏回应表明需要团队负责人或开发者提供更多信息。

- 分享 Epoch 训练经验:一位用户分享了使用 80,000 epochs 进行训练的心得,为关于模型训练性能的深入对话奠定了基础。

- 这一细节突显了在模型训练中实现最佳结果的不同方法。

- 新工具进入竞技场:分享了一个指向 AutoArena 的链接,被认为是一个有趣的工具,反映了对模型改进资源的兴趣。

- 这种兴趣强调了社区在 AI 开发中利用实用工具的推动力。

OpenInterpreter Discord

- Grimes 在 Coachella 的 01 AI 构建方案揭晓:一份指南概述了 Grimes 和 Bella Poarch 如何在 Coachella 音乐节上使用宏键盘和麦克风设置他们的 01 AI 助手。这个简单的设置包括购买宏键盘和麦克风,并重新映射按钮以与 AI 交互。

- 成员们了解到,这种设置可以实现与助手的高效直接互动,强调了在动态环境中的可用性。

- 本地 LlamaFile 模型面临的挑战:一位成员在尝试交互时遇到了本地 LlamaFile 模型的错误,提示:‘Model not found or error in checking vision support’。根据链接的配置,他们的模型 ‘Meta-Llama-3.1-8B-Instruct’ 应该被正确映射。

- 这引发了对配置细节的困惑,并导致了关于 litellm/model_prices_and_context_window.json 中上下文和定价的讨论。

- Discord Automod 针对垃圾信息控制:有一项讨论建议使用 Discord Automod 拦截普通用户的 @everyone 标签,以减少垃圾信息。一位成员指出,95% 的垃圾信息机器人都会尝试标记所有人,这使其成为一种有效的方法。

- 实施此举可以简化社区互动,在关键讨论期间最大限度地减少垃圾信息的干扰。

- 比较 01 的成本:11 Labs vs OpenAI:一位成员提出了关于在 11 Labs 和 OpenAI 之间使用 01 服务 相关成本的问题。有人担心可能需要升级他们在 11 Labs 的会员资格。

- 这反映了人们对了解使用这些平台的财务影响的广泛兴趣,特别是对于那些严重依赖多种服务的用户。

- 创新的数字助手帽子创意:一位用户提议将 帽子 与 数字助手 集成,具备扬声器、麦克风和一键通(push-to-talk)按钮功能,以实现无缝交互。该项目旨在包含 手机通知、问答和日历管理,可能发展为一个带有构建指南的开源项目。

- 另一位用户对这种能增强其 编程项目 的设备表示热衷,强调了对提高 编程效率 的渴望。

LangChain AI Discord

- 加入 LlamaIndex RAG-a-thon!:LlamaIndex Agentic RAG-a-thon 将于 10 月 11-13 日 在硅谷举行,重点关注 Retrieval-Augmented Generation 技术。

- 使用自然语言实现 QA 自动化:一位成员讨论了 Autonoma,这是一个使用 自然语言 和 计算机视觉 自动化 QA 的平台,旨在减少 Bug。

- 主要功能包括 Web 和移动端支持、CI/CD 就绪以及 自愈(self-healing) 能力。

- 通过 Sci Scope 保持领先:Sci Scope 每周汇总新的 ArXiv 论文,并将个性化摘要直接发送到您的收件箱。

- 这种个性化的新闻通讯确保订阅者不会错过 AI 研究中的关键进展。

- 对具备支付能力的 Agent 的兴趣:一位用户提出了关于能够花钱的 Agent 的问题,引发了关于该领域潜在应用和创新的讨论。

- 虽然没有分享具体的项目,但这个概念引起了许多成员的兴趣。

- 多工具 Agent 实现指南:成员们表达了对如何实现使用多个工具的 Agent 的指导需求,反映了对有效数据源集成的需求。

- 在社区内,创建能够利用多样化工具的 Agent 的兴趣持续增长。

MLOps @Chipro Discord

- 第五届年度 MLOps World + GenAI 大会即将到来!:参加 11 月 7 日至 8 日在德克萨斯州奥斯汀举行的 MLOps World + GenAI Conference,届时将有 50+ 个主题、实操工作坊和社交机会。点击此处查看完整议程,包括 11 月 6 日的额外虚拟会议日!

- 记好你的时间表! 这是 AI 工程师交流并了解 MLOps 最新动态的绝佳机会。

- Manifold Research Lab 发布 CRC 更新:Manifold 正在举办名为 CRCs 的互动更新活动,探讨 Multimodality、Robotics 以及各种研究项目的突破。在他们的活动页面获取更多见解,并点击此处加入社区。

- 这些会议提供了对前沿研究的深入探讨,非常适合想要在该领域保持领先地位的技术爱好者。

Mozilla AI Discord

- 播客重点介绍 Data Pipelines:本周三,AIFoundry.org 将主持一场播客,涵盖用于模型 fine-tuning 的 data pipelines,并强调成功所需的必要数据量。

- 预计该活动将引发关于各种 fine-tuning 任务所需最佳调整的讨论。

- 社区关于数据选择的疑问:社区围绕数据选择和处理过程展开了热烈讨论,许多人正在寻求有效方法的指导。

- 重点在于调整这些流程,以增强对特定 fine-tuning 任务的适用性。

DiscoResearch Discord

- 发布新研究见解:分享了一篇题为“Title of the Paper”的新研究论文,重点关注 AI 方法论的进展。

- 这突显了 AI 研究的持续演进及其对未来 benchmarks 的影响。

- AI Benchmarking 讨论:讨论强调了在技术不断发展的背景下,开发稳健的 benchmarks 以准确评估 AI 性能的重要性。

- 成员们强调需要制定标准,以确保不同 AI 模型之间的可比性。

Alignment Lab AI Discord 没有新消息。如果该频道长时间没有动静,请告知我们,我们将予以移除。

LLM Finetuning (Hamel + Dan) Discord 没有新消息。如果该频道长时间没有动静,请告知我们,我们将予以移除。

Gorilla LLM (Berkeley Function Calling) Discord 没有新消息。如果该频道长时间没有动静,请告知我们,我们将予以移除。

AI21 Labs (Jamba) Discord 没有新消息。如果该频道长时间没有动静,请告知我们,我们将予以移除。

第 2 部分:各频道详细摘要和链接

完整的频道细分内容已为邮件格式进行截断。

如果您喜欢 AInews,请分享给朋友!提前感谢!