ainews-did-nvidias-nemotron-70b-train-on-test

目前没有证据表明英伟达(Nvidia)的 **Llama-3.1-Nemotron-70B-Instruct** 模型在测试集上进行了训练(即所谓的“数据污染”或“洗题”)。 以下是关于这一争议的背景和详细说明: 1. **质疑的起因**: 这种质疑主要源于该模型在 **RewardBench**(一个衡量模型对人类偏好判断准确性的权威基准测试)上的惊人表现。Nemotron-70B 登顶了该排行榜,其得分(约 94.1)显著超过了 GPT-4o 和 Claude 3.5 Sonnet 等顶尖模型。由于其分数极高,一些开发者和研究人员怀疑是否存在数据泄露。 2. **英伟达的解释**: 英伟达官方表示,该模型的卓越表现归功于其**训练方法和高质量的数据集**。他们使用了: * **HelpSteer2 数据集**:这是一个开源的高质量偏好数据集,旨在帮助模型更好地理解人类的意图。 * **RLHF(强化学习)优化**:英伟达采用了先进的对齐技术,使模型在处理复杂指令和评估回答质量方面表现更佳。 3. **社区评估**: 虽然社区中存在讨论,但目前并没有技术报告或证据证明英伟达违反了评估规范。在大型语言模型(LLM)领域,当一个模型在特定榜单上表现异常出色时,通常都会引发此类讨论,但英伟达通过开源其模型权重和部分训练数据集,展示了其研究的透明度。 **总结:** 官方立场和目前的技术分析都倾向于认为,Nemotron 70B 的高分是由于**模型对齐(Alignment)技术的进步和高质量合成数据的应用**,而非直接在测试集上进行训练。

英伟达(NVIDIA)的 Nemotron-70B 模型尽管在 Arena Hard、AlpacaEval 和 MT-Bench 上表现强劲,但仍引发了一些审视,因为在 GPQA 和 MMLU Pro 等部分标准基准测试中,该模型相较于基础的 Llama-3.1-70B 并未表现出提升。全新的 HelpSteer2-Preference 数据集 在提升部分基准测试表现的同时,对其他方面的负面影响极小。

与此同时,Mistral 发布了 Ministral 3B 和 8B 模型,具备 128k 上下文长度,并在 Mistral 商业许可下,在多项基准测试中超越了 Llama-3.1 和 GPT-4o。此外,通过使用 RLHF (REINFORCE) 训练,英伟达的 Nemotron 70B 在关键基准测试上也超过了 GPT-4o 和 Claude-3.5-Sonnet。

另外,Zep 推出了 Graphiti,这是一个基于 Neo4j 构建的开源时序知识图谱记忆层,专为 AI 智能体(AI agents)设计。

对标准评估的耐心就是你所需要的一切。

2024年10月15日至10月16日的 AI 新闻。我们为你检查了 7 个 subreddits、433 个 Twitter 账号 和 31 个 Discord 社区(228 个频道,1716 条消息)。预计节省阅读时间(以 200wpm 计算):218 分钟。你现在可以标记 @smol_ai 进行 AINews 讨论了!

Nvidia 的 Nemotron 成功地持续获得了关注:我们在最近几个月报道了 Nemotron 340B、Mistral-Nemo 和 Minitron。

然而,昨天的 Nemotron-70B 正在受到更多的审查。

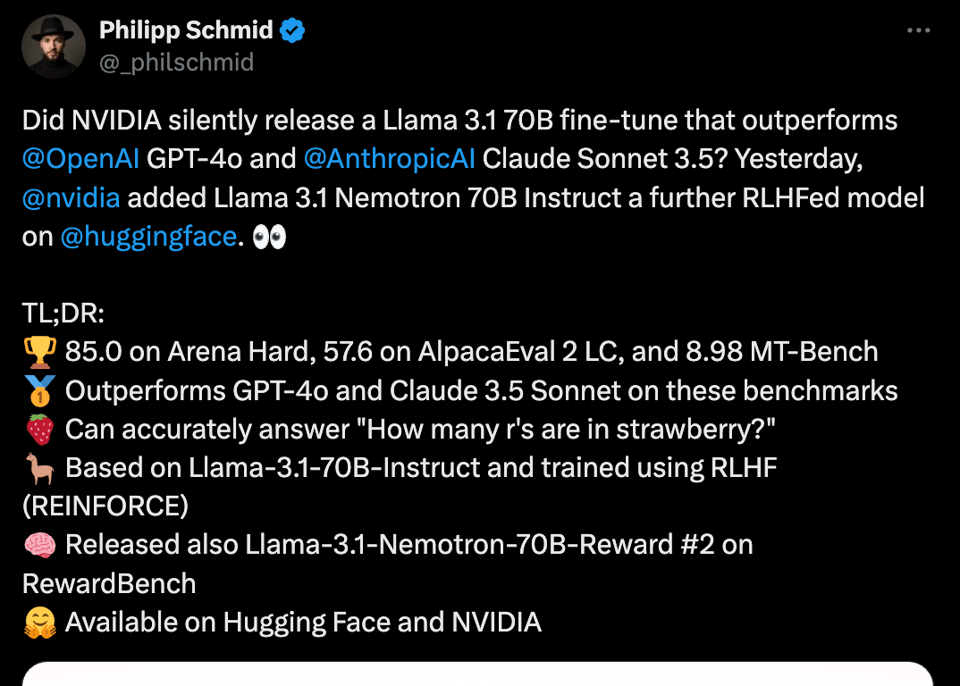

这是一个非常熟悉的模式:发布新的开源模型,声称“我们家里也有 GPTx/ClaudeY”,在稍微有些不同但仍然可信的基准测试中得分很高,并且它能数出 strawberry 中 r 的数量。

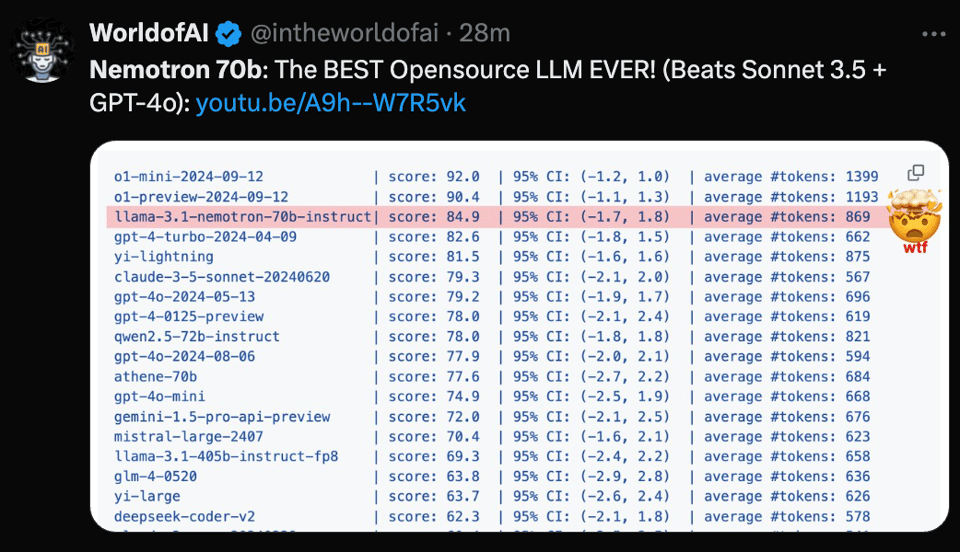

在这种情况下,Nvidia 选择在 Arena Hard、AlpacaEval 和 MT-Bench 上营销其新款 Llama-3.1-Nemotron-70B 的性能,公平地说,这三个是领先的 LLM-as-Judge 基准测试。当以表格形式呈现时,结果看起来非常令人兴奋:

当应用 LMArena 的新风格控制(style control)时,模型的性能有所下降,但这本身并不足为奇。更有趣的是,其他标准基准测试,如 GPQA、MMLU Pro 和 aider,与基础的 70B Llama 3.1 模型相比没有变化或表现更差,这让兴奋的 /r/LocalLlama 社区感到有些失望。

真相可能很简单:没有在测试集上训练,但新的 HelpSteer2-Preference 数据集(统一了基于 Bradley-Terry 和回归的奖励模型)恰好提高了这三个基准测试的性能,而其他基准测试的损失极小。在缺乏正式的 LMArena ELO 评分的情况下,这似乎只是降低了自动化基准测试的价值,仅此而已。

不过,使用 entropix 采样的 Nemotron 版本令人印象深刻,这是一个我们曾简略报道过的持续发展的案例。

[由 Zep 赞助] Zep 是一个为 AI Agent 和助手构建的低延迟记忆层,基于一个简单的核心原语:时序知识图谱(temporal knowledge graph)。这是一种非常酷且灵活的方式,用于建模客户和产品等复杂实体之间不断变化的关系。你可以使用他们新的开源工具 Graphiti 将其插入到你的 Agent 中。

swyx 评论:我们上周报道了 Zep 作为一个记忆层,看起来 Graphiti 是时序知识图谱记忆抽象的核心。值得注意的是,它不仅可以在你输入“片段(episodes)”时自主为你构建知识图谱,而且它底层是基于 Neo4j 构建的!

AI Twitter 简报

所有简报均由 Claude 3.5 Sonnet 完成,取 4 次运行中的最佳结果。

AI 模型发布与更新

-

Mistral 发布新模型:@AlphaSignalAI 和 @MistralAI 宣布发布 Ministral 3B 和 8B 模型,在各种基准测试中优于 Llama 3.1 和 GPT-4o 等现有模型。这些模型具有 128k 上下文长度,并根据 Mistral Commercial License 提供。

-

NVIDIA 的 Nemotron 70B 表现优于竞争对手:@reach_vb 和 @AlphaSignalAI 强调 NVIDIA 的 Nemotron 70B 在 Arena Hard 和 MT Bench 等基准测试中超越了 GPT-4o 和 Claude 3.5 Sonnet,展示了通过 RLHF (REINFORCE) 训练技术带来的显著改进。

-

Hugging Face 集成:@reach_vb 和 @_philschmid 分享了关于 Hugging Face 合作的更新,包括能够使用 Ollama 直接在平台上运行任何 GGUF model,增强了像 Llama 3.2 3B 这样模型的易用性和部署。

AI 研究与创新

-

高级认知架构:@francoisfleuret 和 @AIatMeta 讨论了具有 memory、personality 和 emotional intelligence 的长期运行 Agent 在 cognitive architecture 方面的突破,强调了在 Minecraft 上碾压现有基准测试(如 Voyager)的研究。

-

上下文强化学习 (ICRL):@rohanpaul_ai 展示了关于 ICRL 的研究结果,证明了 LLM 如何仅通过 reward signals 进行适应,通过 Explorative ICRL 将 Banking-77 等任务的性能显著提高了 66.0% 的准确率。

-

LLM 中的任务叠加 (Task Superposition):@rohanpaul_ai 探讨了 LLM 同时执行 多个不同任务 的能力,揭示了 更大的模型 表现出更高的 task completion rates,以及对 in-context distributions 更好的 calibration。

AI 工具与 API

-

使用 Amazon Bedrock 的无服务器 Agent 工作流:@DeepLearningAI 推出了一门关于 Amazon Bedrock 的新课程,使开发人员能够 构建可扩展的 Agent 并为 负责任的运营 实施 security guardrails。

-

动态少样本提示 (Dynamic Few-Shot Prompting):@llama_index 分享了关于 dynamic few-shot prompting 的见解,这是一种根据查询检索相关示例的技术,通过使用 LLama Index workflows 增强了在 customer support、text-to-SQL 和 structured outputs 中的应用。

-

TorchTitan 仓库:@Ethan_smith_20 赞扬了 torchTitan 仓库全面的 parallelism capabilities,无需修改模型即可简化 deep learning 中 parallel computing 的开发过程。

行业新闻与见解

-

能源与人类深度探讨:@MajmudarAdam 对 energy 如何塑造人类文明及其对 deep learning 的未来影响进行了广泛分析,涵盖了从 energy physics 到 energy distribution systems 及其与 geopolitics 关系的主题。

-

AI 对劳动力和效率的影响:@mustafasuleyman 强调了制定策略以主动 塑造 AI 对工作和劳动者的影响 的重要性,并承认 AI 对 job market 影响的不确定性。

-

Hugging Face 社区增长:@francoisfleuret 和 @_akhaliq 报告了 Hugging Face 社区的显著增长,新的 leaderboards 和 model evaluations 提升了该平台在 AI research 领域的地位。

AI 应用与用例

-

用于创意内容的 Suno Scenes:@suno_ai_ 推出了 Suno Scenes,这是一款可以直接从移动设备将 照片和视频 转换为 独特歌曲 的工具,使用户能够从个人媒体创作 电影配乐 和 搞笑歌曲 等内容。

-

网络犯罪中的 AI:@DeepLearningAI 讨论了一项研究,揭示了一个 AI applications 助长 cybercrime 的 黑市,尽管在现实世界中的成功有限,但在两个月内赚取了超过 28,000 美元。

-

基于 LLM 的多智能体系统:@rohanpaul_ai 展示了 OPTIMA framework,它增强了 基于 LLM 的多智能体系统 中的 communication efficiency 和 task effectiveness,在信息交换任务上实现了高达 2.8 倍的性能提升。

迷因与幽默

-

AI 生成的小吃食谱:@nearcyan 幽默地分享了对 AI assistant Claude 的不满,因为它建议了一些荒谬的食谱,比如把 糖放进微波炉 做零食,并将其比作 4chan 风格 的内容。

-

与 AI 一起烹饪:@nearcyan 发布了一条关于用 Claude 煎牛排的幽默推文,将这种体验描述为与一个“自闭症” AI 打交道,突显了 AI 交互中的怪癖和出人意料的行为。

-

AI 迷因(Meme)的流行:@francoisfleuret 反思了迷因(memes)的力量,认为 AI 模型可以快速塑造迷因,从而触及人类心理的根本,加速了迷因进化(memetic evolution)的自然过程。

AI 教育与职业

-

教授 AI 基础知识:@jxmnop 表示需要教育软件工程师掌握分类基础知识,包括成对匹配(pair-wise matching)、聚类(clustering)、Bootstrapping 和统计检验(statistical tests),强调了基础知识在软件工程中的重要性。

-

AI 职业机会:@mervenoyann 和 @seb_ruder 为有志于攻读 MSc 或 PhD 的候选人推荐了机会,重点介绍了 David 的实验室以及 Mila 研究友好的氛围。

-

前端开发挑战:@ekzhang1 指出,大多数 CS PhDs 缺乏前端编码技能,并承认这是可以接受的,同时强调了 AI 研究中专业技能的重要性。

AI Reddit 摘要

/r/LocalLlama 摘要

主题 1:为 50 种语言普及医疗 LLM

- 为 50 种语言普及医疗 LLM (Score: 48, Comments: 7):ApolloMoE 引入了一种新的基于电路的范式(circuits-based paradigm),用于解释多语言语境下的路由,识别了“最后阶段展开(Spread Out in the End)”机制,并利用语系专家将医疗 LLM 扩展到 50 种语言。该项目开源了所有资源,包括 GitHub 上的代码和 Huggingface 上的模型,以及用于扩展多语言医疗 LLM 能力的数据集。

- 英语答案在闭源 AI 中得分最低,作者将其归因于中文和英文评估集的广泛覆盖。这突显了改进稀有语言医疗衡量标准集的必要性。

- 该模型在不同语言中的表现通过按语言平均准确率并在同一组衡量标准上进行测试来评估,作者认为这是一种合理的方法。

- 一位用户注意到该项目涵盖的 50 种语言中缺少罗马尼亚语,从而对语言选择标准提出了疑问。

主题 2:在单张 GPU 上为 Llama-3-8B 提供 330 万上下文

- LoLCATS - hazyresearch 集合(线性化 Llama 3.1 模型 8B、70B 和 405B) (Score: 31, Comments: 12):HazyResearch 发布了 LoLCATS,这是一系列线性化 Llama 3.1 模型,涵盖 8B、70B 和 405B 尺寸。这些模型基于线性化注意力 Transformer(Linearized Attention Transformer)架构,与标准 Transformer 相比,提供了更高的性能和效率,可能在更大的数据集上实现更快的推理和训练。

- 线性化注意力 Transformer 架构将二次注意力替换为线性注意力,有可能提高大上下文长度下的推理性能,尤其是在没有 flash-attn 的情况下。

- 405B 模型的 MMLU 分数从 83 降至 72.2,这引发了关于线性化模型实际应用的疑问,尽管它们在长上下文、大海捞针(needle-in-haystack)和少样本(few-shot)任务中具有潜在优势。

- 该项目包括 Thunder kittens,推理代码可在 GitHub 上获取,vLLM 支持即将推出。

- 在单显卡上为 Llama-3-8B 提供 330 万上下文服务 (Score: 31, Comments: 7): MIT 和 NVIDIA 的研究人员推出了 DuoAttention,这是一种在单张 A100 GPU 上为 Llama-3-8B 实现 330 万 token 上下文的方法。该技术在他们的 arXiv 论文中进行了详细阐述,并在开源 GitHub 仓库中实现,从而允许长上下文推理的实际应用。

- DuoAttention 使用两个 KV caches:一个用于关键检索头 (retrieval heads) 的完整缓存,以及一个用于流式头 (streaming heads) 的恒定缓存。这使得 Llama-3-8B 能够在单张 A100 GPU 上处理 330 万 token,比标准的完整注意力 FP16 部署实现了 6.4 倍的容量提升。

- 用户讨论了对更好的长上下文基准测试的需求,RULER 因仅测试检索能力而受到批评。Michelangelo 评估 (LSQ) 被建议作为一种更稳健的替代方案,用于测试更广泛的长上下文用例。

- 虽然 DuoAttention 显著减小了 KV cache 的大小,但一些用户指出,对于超过 64k tokens 且保持连贯的模型来说,原始容量并非唯一的挑战。然而,其他人强调,像这样增量式的改进有助于该领域的整体进步。

主题 3. LLM 中无需提示词的思维链推理

- 无需提示词的思维链推理 [Google 论文] (Score: 115, Comments: 51): Google 研究人员引入了 思维链 (CoT) 解码,这是一种使大语言模型能够在没有显式提示的情况下进行多步推理的方法。该技术在推理过程中修改了模型的采样过程,在各种推理任务中实现了与标准 CoT 提示相当或更好的性能。该方法证明了 CoT 推理能力是语言模型固有的,可以通过解码策略激活,而不是依赖于特定的提示词。

- 分享了一个用于复现思维链 (CoT) 解码方法的 GitHub 仓库。用户注意到论文结果与开源实现之间存在性能差距,论文显示较小的模型从该技术中获益较少。

- 论文表明,智能采样可以提高 LLM 性能,类似于 entropix。结果显示,不同规模的模型都有提升,基座模型 (base models) 比指令模型 (instruct models) 受益更多,甚至在增加模型参数也无济于事的任务上也是如此。

- 一些用户在他们的项目中实现了 CoT 解码,例如 optillm 以及针对 Llama 3.2 3B 的逐步实现。其他人讨论了处理 arXiv 论文的挑战以及当前 LLM 在真实推理能力方面的局限性。

主题 4. Elevenlabs 的本地文本转语音替代方案

- 在家里搭建像 Elevenlabs 这样的文本转语音系统有多难? (Score: 54, Comments: 33): 该帖子讨论了建立本地文本转语音 (TTS) 流水线作为使用 Elevenlabs 的替代方案,旨在节省成本并增加控制力。作者配备了 i9 13900 处理器和 4070 GPU,正在寻求构建此类系统的建议,询问他人的经验、模型选择和硬件配置,新配置的预算为 4000-5000 美元。

主题 5. 用于程序化内容生成的 LLM 驱动游戏主持人

- 我正在构建一个使用 LLM 作为 Gamemaster 来创造事物的项目,希望获得更多创意来扩展这个想法。 (Score: 60, Comments: 29):该项目使用 Large Language Model (LLM) 作为 Gamemaster,在具有 Infinite Craft 风格合成系统 的游戏中生成生物及其属性和能力。该 LLM(具体为拥有 90 亿参数的 Gemma 2)负责决定从生物名称到 Sprite 选择、元素类型、统计数据和能力的一切,且全部在仅有 6 GB VRAM 的电脑上本地运行。开发者强调了该模型在 function calling 方面的有效性,以及在保持创造力的同时最大限度减少幻觉的表现,并寻求关于利用 递归分层列表选择 (recursive layered list picking) 来通过 LLM 构建连贯游戏元素的扩展思路。

- 用户对该项目表现出浓厚兴趣,多人请求提供 GitHub 仓库以便亲自尝试。开发者表示待项目进一步完善后会分享更多内容。

- 关于替代模型的讨论包括测试 L3.2 3B 和 Qwen Coder 2.5 7B 的建议,开发者指出 Qwen 模型 在其测试中表现良好,接近 Gemma 2。

- 扩展创意包括使用 图像生成模型 制作 Sprite、为合成激励实现 伤害类型和抗性,以及创建一个 NPC 定居点系统。开发者正在考虑 任务原型系统 (quest archetype system) 以及如何利用 LLM 让生物显得更具生命力。

其他 AI Subreddit 摘要

r/machinelearning, r/openai, r/stablediffusion, r/ArtificialInteligence, /r/LLMDevs, /r/Singularity

AI 研究与开发

-

Google DeepMind 通过联合样本选择推进多模态学习,展示了数据策展如何加速多模态学习 (来源)。

-

Microsoft 的 MInference 技术 能够在保持准确性的同时,实现长上下文任务中多达数百万个 tokens 的推理 (来源)。

-

一篇关于 扩展合成数据生成 (scaling synthetic data creation) 的论文利用 LLM 内部的多样化视角,从 10 亿个网络策划的角色人格 (personas) 中生成数据 (来源)。

AI 模型发布与能力

-

Salesforce 发布了 xLAM-1b,这是一个 10 亿参数的模型,在 function calling 方面实现了 70% 的准确率,超越了 GPT 3.5。

-

Rubra AI 在 6 月发布了更新的 Phi-3 Mini 模型,具备 function calling 能力,可与 Mistral-7b v3 竞争。

-

关于 AI 推理能力 的讨论,争论焦点在于当前模型是真正具备推理能力,还是仅仅在进行模式匹配 (来源)。

AI 伦理与政策

-

拜登政府出于国家安全考虑,正在考虑 限制向某些国家销售 GPU,这可能会影响全球 AI 的发展 (来源)。

-

Anthropic 宣布了 更新的负责任扩展策略 (Responsible Scaling Policy),暗示在解决安全问题的同时,正准备发布更先进的模型 (来源)。

AI 应用与演示

-

使用 Flux Dev 演示 AI 生成的 HD-2D 像素游戏重制,展示了在游戏开发和视觉艺术领域的潜在应用 (来源)。

-

关于 AI 生成内容 的潜力和局限性的讨论,包括社交媒体平台上虚假的餐厅简介 (来源)。

AI 行业动态

-

关于实现人类水平 AI 时间表的持续辩论,Yann LeCun 等专家认为这可能还需要几年甚至十年的时间 (来源)。

-

对新模型发布的期待,例如基于政策更新推测 Anthropic 可能发布 Opus 3.5 (来源)。

AI Discord 摘要

由 O1-preview 生成的摘要之摘要的摘要

主题 1. Mistral 的新边缘模型引发 AI 社区热议

- Mistral 发布 Ministral 3B 和 8B,但权重在哪?: Mistral 推出 Ministral 3B 和 Ministral 8B,这是专为设备端使用设计的边缘模型,支持高达 128k 上下文长度。但开发者们感到沮丧,因为 Ministral 3B 仅限 API 访问,未发布权重。

- 模型许可引发关于 Mistral 仅限 API 的 3B 模型的争论: 社区对 Ministral 3B 仅限 API 表示不满,认为限制性的许可阻碍了设备端使用和独立开发。

- Mistral 的发布让开发者既兴奋又沮丧: 虽然 Ministral 8B 以非商业许可提供,但开发者对 3B 模型缺失权重感到遗憾,质疑此次发布的实用性。

主题 2. NVIDIA 的 Nemotron 70B 碾压竞争对手

- Nemotron 70B 展现实力,表现优于 GPT-4o 和 Claude 3.5: NVIDIA 的 Nemotron 70B 击败了 Llama 3.1 405B、GPT-4o 和 Claude 3.5 Sonnet,在 Arena Hard 上获得了 85.0 分,而其他模型仅为 79 分左右。

- NVIDIA 投下 Nemotron 炸弹,社区大为震惊: AI 界议论纷纷,NVIDIA 悄然发布 Nemotron 70B,在没有大肆宣传的情况下撼动了基准测试排行榜。

- Nemotron 出色表现引发基准测试困惑: 用户对 MT Bench 分数的差异展开辩论,对 Nemotron 近乎“好得令人难以置信”的结果表示怀疑。

主题 3. SageAttention 彻底改变 Transformer 效率

- SageAttention 将 Attention 速度提升 2.1 倍,让 FlashAttention2 望尘莫及: 介绍 SageAttention,这是一种 8-bit 量化方法,比 FlashAttention2 快 2.1 倍,且精度损失极小。

- 驯服 O(N²):SageAttention 降低了 Attention 复杂度: SageAttention 解决了 Transformer 中的 O(N²) 瓶颈,有望为语言和图像模型提供更快的推理。

- 8-Bit 是新的 16-Bit:SageAttention 让量化再次变酷: 凭借高效的 8-bit 量化,SageAttention 证明了低精度仍能提供顶尖性能。

主题 4. AI 助手之苦:从 DALL-E 的失望到过度审查

- DALL-E 的“糟糕”图像输出让用户摸不着头脑: 沮丧的用户将 DALL-E 的图像生成贴上“糟糕”的标签,对其能力表示失望。

- LLM 忽略 Token 限制,开启无尽长谈: 用户报告 AI 助手公然无视 Token 限制和停止指令,导致输出失控并引发用户不满。

- 被审查的模型拒绝配合,用户寻求“去审查”黑客手段: 过度审查的模型甚至拒绝回答基础查询,迫使用户不顾潜在风险去探索去审查技术。

主题 5. 开源工具助力社区协作

- Open Interpreter 与 Ollama 联手打造本地 LLM 体验: Open Interpreter 现在允许通过 Ollama 在 Hugging Face 上运行任何 GGUF 模型,通过简单的命令让本地 LLM 更加触手可及。

- Inferencemax 简化 LLM 推理: 新项目 Inferencemax 旨在简化 LLM 推理,反映了社区为降低 AI 开发门槛所做的努力。

- AIFoundry 寻求 GitHub 指导以提升开源水平: AIFoundry.org 正在寻求指导以效仿 Axolotl 的 GitHub 实力,希望增强其开源本地模型推理计划。

第一部分:高层级 Discord 摘要

HuggingFace Discord

-

Gradio 5.0 增强功能:Gradio 5.0 已发布,带来了安全性和用户界面的更新,超过 600 万次下载量证明了其受欢迎程度。

- 详尽的安全报告现已公开,向用户保证了已完成的改进。

-

Sentence Transformers v3.2.0 提升速度:Sentence Transformers v3.2.0 引入了 ONNX 和 OpenVINO 等新后端,可实现 2x-3x 的加速,使用静态嵌入(static embeddings)时加速可达 500x。

- 更快的推理能力支持高达 10k 文本/秒的处理速度,更多详情见 Model2Vec。

-

HuggingChat 中的多模态交互:HuggingChat 的最新更新集成了 Llama-Vision 11B Instruct,支持丰富的多模态交互。

- 这一重大升级鼓励用户在平台内探索这些新功能,从而提升用户体验。

-

AI 模型性能讨论:关于配置为 72GB VRAM 和 128GB DDR4 RAM 的 AI 模型设置的假设性讨论认为,潜在处理速度可达 5-6 t/s。

- 讨论中还涉及了自定义 PyTorch 集成,强调了自动梯度(automatic gradients)对于提高模型效率的重要性。

-

Ollama 与 GGUF 模型的交互:使用 Ollama 允许用户直接在本地与 GGUF 模型交互,简化了命令使用,无需创建新的

Modelfiles。- Ollama 支持运行 Hugging Face 上的任何 4.5 万个 GGUF 检查点,提高了可访问性。

Perplexity AI Discord

-

Perplexity AI 推出购物功能:Perplexity AI 正在推出“Perplexity Purchases”,以简化购买流程和价格比较。

- 用户反馈差异显著,一些人怀念该平台最初专注于搜索而非商业的初衷。

-

Reasoning Mode 给用户留下深刻印象:成员们称赞了用于编程的 Reasoning Mode,强调了其分析能力和由此产生的准确输出。

- 成功案例不断涌现,随着用户分享他们的积极体验,进一步巩固了该功能的可靠性。

-

对增强 API 的兴趣:用户对 API 的好奇心日益增强,多位用户引用了同一个搜索结果来定义什么是 API。

- 这一趋势表明成员们对基础技术的参与度更深。

-

关于 LFM 40B API 可用性的查询:一位成员询问如何通过 labs.perplexity.com 上的 API 访问 LFM 40B 模型,但尚未得到回复。

- 信息的缺失凸显了在模型可用性沟通方面可能存在的差距。

-

对聊天中用户体验的担忧:用户对论坛的动态表示担忧,认为其过于非正式,不适合严肃的 AI 讨论。

- 这导致了要求加强管理的呼声,以保持对技术主题的关注,而非闲聊。

OpenRouter (Alex Atallah) Discord

-

Grok 2 停机维护:Grok 2 目前处于离线维护状态,导致用户在尝试访问时遇到 404 错误。该模型重新上线后将发布公告。

- 用户对此表示沮丧,因为 Grok 2 在编程任务中的表现优于其他模型,特别是击败了 Llama 3.2。

-

NVIDIA Nemotron 70B 碾压竞争对手:NVIDIA 的 Nemotron 70B 在基准测试中超越了 Llama 3.1 405B、GPT-4o 和 Claude 3.5 Sonnet,在 Arena Hard 上得分 85.0,而竞争对手的得分均在 79 分左右。详细对比可以在这里查看。

- 这一兴奋点在 OpenRouter 公告中达到顶峰,该公告展示了其在多项评估中的卓越性能。

-

ChatGPT 语音模式教学词汇:一位用户展示了 ChatGPT Advanced Voice Mode 利用《火影忍者》(Naruto)的例子来教授词汇,称这种体验“简直太疯狂了!”。他们分享了一个 演示链接 以收集反馈。

- 讨论集中在个性化 AI 学习 的潜力上,并预测由于其高效性,它将极大地改变教育格局。

-

Infermatic 网络困扰:Infermatic 的供应商面临持续的网络问题,导致模型生成乱码,特别是在达到 8k Context Limit 之后。用户被告知供应商正在回滚到之前的版本,以纠正这些 VLLM 推理问题。

- 人们对模型性能受到的影响表示担忧,因为这个 Bug 阻碍了有效的交互。

-

Mistral 推出口袋级 LLM:Mistral 宣布发布两个新模型:Ministral 3B 和 8B,专为边缘计算场景设计,并承诺提升性能。这些模型拥有更长的上下文长度,并在知识和推理任务中增强了能力。

- 此举旨在将 LLM 的应用扩展到传统设置之外,详见 Mistral 的公告。

Unsloth AI (Daniel Han) Discord

-

INTELLECT-1 发布,助力去中心化训练:INTELLECT-1 的发布邀请各方为一个专注于去中心化训练的 100 亿参数模型贡献力量,旨在实现开源 AGI。此前发布的 OpenDiLoCo 增强了 AI 模型训练的可扩展性。

- 这一倡议标志着向全球分布式 AI 迈出了重要一步,目前规模已从 1B 扩展到 10B 参数。

-

Unsloth 训练显示出显著改进:用户报告称

unsloth_train的收敛效果明显优于以前的方法,并有望支持resume_from_checkpoint=True。然而,关于旧版UnslothTrainer缺失扩展功能的询问也随之而来。- 社区对这些增强功能表示赞赏,同时也寻求关于这一过渡背后逻辑的进一步说明。

-

社区询问 Mistral 8B 支持情况:关于统一 Unsloth 与新 Mistral 8B 模型 兼容性的讨论引发了一些架构方面的关注。社区的热情围绕着新模型的端侧计算能力展开。

- 成员们渴望获得更新,并认可 Mistral 8B 在实际应用中的潜力。

-

SageAttention 实现惊人的加速:SageAttention 论文介绍了一种高效的 8-bit 量化方法 用于 Attention,在保持模型准确性的同时,分别比 FlashAttention2 和 xformers 快 2.1 倍 和 2.7 倍。该量化方法解决了通常出现的 O(N^2) 复杂度问题。

- SageAttention 代表了一项关键进展,显著加快了多种模型的推理速度。

-

量化技术的探索:讨论揭示了将全量微调技术与量化方法(特别是 QLoRA)混合使用的挑战,用户分享了关于层调优(Layer Tuning)的见解。对于在保持其他层完全可训练的同时量化某些层的可行性,仍存在怀疑。

- 社区正在辩论是否需要专门的配置来平衡性能和效率。

Eleuther Discord

- Yandex YaLM 100B 引起轰动:拥有 1000 亿参数的 Yandex YaLM 100B 模型已成为一个重要的参与者,尤其是在非西方市场。

- 据指出,它可能是俄罗斯使用最广泛的 LLM,与其在西方圈子中较低的认可度形成鲜明对比。

- SwiGLU 与 SinGLU 的对决:一场关于选择 SwiGLU 还是 SinGLU 的辩论被点燃,强调了 SinGLU 的速度和更低的 loss,但变革的阻力依然存在。

- 这种惯性源于与大规模训练运行(large training runs)相关的风险以及既定的实践惯例。

- OpenAI embeddings 表现不佳:参与者对 OpenAI embedding 模型的性能表示担忧,这些模型似乎落后于 2024 benchmarks。

- Mistral finetunes 等模型的饱和表明 OpenAI 的方法存在竞争差距。

- 机械可解释性(Mechanistic Interpretability)项目招募志愿者:一名学生表达了加入 EleutherAI 可解释性相关项目的渴望,特别是在当前的机会背景下。

- 成员们建议加入 Mechanistic Interpretability Discord 以在该领域进行进一步探索。

- A/B 测试方法解决反转问题:人们对 A/B 测试技术的兴趣日益增加,这些技术可以缓解反转诅咒 (reversal curse),从而增强实验结果。

- 参与者将这种方法标记为“非常 a/b”,指出了它在实际应用中的相关性。

aider (Paul Gauthier) Discord

- 多个 Aider 可以安全共存:关于运行多个 Aider 实例的担忧得到了缓解,确认只要不编辑相同的文件,它们就不会互相干扰。

- 成员们幽默地建议,如果管理得当,这可能会变成一场“LLM 派对”。

- Mistral 推出新款边缘模型:Mistral 最近发布了专注于设备端(on-device)和边缘计算(edge computing)的 Ministral 3B 和 8B 模型,提升了效率和能力。

- 这些模型在推理和常识知识方面取得了重大进展,是优化上下文长度的理想选择。

- Gemini API 流式传输稳定性有待提高:用户报告称,由于 Gemini 的 API 连接不稳定导致频繁中断,禁用流式传输(streaming)后表现更好。

- 共识指出,这种不稳定性是影响基于 Gemini 的工具性能的常见问题。

- Aider 命令行工具设置要点:为了有效利用 Aider 命令行工具,用户必须加载其

.env文件或通过load_dotenv()进行配置,以确保功能正常。- 正确的环境设置对于在 Aider 中顺利运行脚本至关重要。

- API 和代码生成的挑战:用户在处理 rate limits 的同时,在使用更新后的 Assistant API 生成准确的函数调用(function calls)方面面临困难。

- 这种繁忙的情况强调了需要清晰的文档和社区支持来应对新兴挑战。

Nous Research AI Discord

- Unsloth 提供多 GPU 支持:讨论集中在 Unsloth 是否能有效支持多 GPU 设置,并期待即将发布的视觉微调(vision fine-tuning)支持更新。

- 成员们对其付费版本在增强性能方面的可靠性进行了推测。

- Mistral 发布新模型:Mistral 推出了专为边缘计算设计的 Ministral 3B 和 Ministral 8B,在常识推理方面拥有令人印象深刻的数据,并支持 128k context length。

- 这些模型承诺提供高效的本地推理,专门迎合现代计算需求。

- Nvidia Nemotron 70B 声称性能领先:据各种评估指标显示,Nvidia Nemotron 70B 据称超越了 Claude 3.5 和 Llama 3.1 等竞争对手。

- 关于 MT Bench 分数存在困惑,各模型的报告性能与实际性能之间存在差异。

- AI 模型显示困惑的回答:模型 H3-405b 因其重复的困惑回答而受到关注,尤其是当被问及它的起源或身份时。

- 令人苦恼的困惑表达案例增加了 AI 身份讨论的趣味性。

- SageAttention 提高推理效率:研究强调了 SageAttention,这是一种量化技术,在性能损失极小的情况下,比 FlashAttention2 的 Attention 性能提升了 2.1 倍。

- 这一进步将使广泛的任务受益,特别是在大规模语言应用中。

GPU MODE Discord

-

寻找开源音频模型:一位用户询问是否有类似于 NotebookLM 中的高质量开源音频模型,并提到虽然存在许多 Text-to-Speech 选项,但没有一个能与之媲美。

- 参与者一致认为,市场上缺乏强大的音频模型。

-

Lambda Labs 与 Voltage Park 的对决:讨论集中在 Lambda Labs 和 Voltage Park 是仅有的可靠硬件供应商,其中 Voltage Park 以更多存储空间著称,但仅限于德克萨斯州。

- 参与者对其他供应商持续存在的 PCIe 问题表示担忧,这影响了 GPU 设置的可靠性。

-

Triton 编程的主要挑战:成员们强调了 Triton 的各种问题,包括在 Windows 上编程的困难以及 INT4 packed data 中的 bug 导致 LLVM 错误。

- 许多用户感到沮丧,指出 Triton 编译带来的性能提升通常来自 Torch 而非 Triton 本身。

-

ServiceNow 招聘机器学习开发人员:ServiceNow 正在招聘一名 Staff Machine Learning Developer,负责其支持 Starcoder2 的开源训练框架,该框架比 Megatron-LM 更快。

- 职位详情可在 Smart Recruiters 找到。

-

生成式 AI 书籍发布公告:Yuri Plotkin 宣布了他即将出版的关于 Generative AI 的书籍,涵盖了包括 Bayesian inference 和 latent variable models 在内的基础算法,详情请见 书籍网站。

- 他鼓励在 Twitter 上关注他以获取持续更新,并分享了该领域关键概念的见解。

LM Studio Discord

-

SageAttention 提升性能:新方法 SageAttention 通过为 attention 提供高效的 quantization,加速了 transformer 模型的推理,比现有方法实现了 2.1 倍 的提升。

- 该技术显示出比 FlashAttention3 更优的准确性,对语言和图像生成都有影响。

-

Llama 8B 每秒 Token 数(TPS)的差异:用户报告了 Llama 8B 的 tokens per second (TPS) 范围很广,在 1070 Ti GPU 上的 Q6_K 设置可达到约 28-35 TPS。

- 性能与 context length、quantization 和 GPU VRAM 带宽等因素密切相关。

-

GPU 性能至关重要:新一代 GPU(如 4080 或 4090)的性能大幅超越了旧型号(如 1070 Ti),但需要正确的配置才能发挥最大效能。

- 利用 tensor cores 和增强的内存带宽对于实现显著的性能提升至关重要。

-

编译模型的挑战:用户询问了 LM Studio 目前对自定义编译版本 Llama.cpp 的支持情况,得到的回复建议使用命令行工具

lms进行模型加载。- 该解决方案支持重启后的持久性,缓解了编译模型面临的一些挑战。

-

Token 生成速度受到关注:成员们强调了高容量模型下缓慢的 Token 生成速度,某些设置的峰值仅为 0.25 tokens/sec,说明了 CPU 瓶颈。

- 许多本地设置都感受到了这些限制,因此有人推动在需要时考虑云服务以获得更好的性能。

OpenAI Discord

-

Grok 2 显示出潜力:成员们对测试 Grok 2 表现出浓厚兴趣,表明对新模型的关注度日益增加。

- 虽然缺乏具体的性能细节,但热度暗示 Grok 2 可能是一个值得关注的进展。

-

DALL-E 的图像生成表现不佳:DALL-E 的能力受到批评,一位成员直接将其图像输出标记为 bad。

- 社区对图像生成的期望很高,这一反馈凸显了对其性能的失望。

-

模型参数之谜:关于 4o-mini 和 GPT-3.5 等模型参数规模的辩论非常激烈,有推测认为 4o-mini 的参数量设定在 1 billion parameters。

- 不同的意见表明社区在模型大小与性能之间的关系上存在困惑。

-

GPTs 在 PDF 理解方面遇到困难:成员们注意到 GPTs 在回复前无法读取完整的 PDFs,通常导致引用的信息不完整。

- 建议将 key information in the main instructions(关键信息放在主指令中)以帮助提高回复的准确性。

-

使用 ChatGPT 创建网站内容的指南:一位用户寻求关于使用 ChatGPT 构建网站的建议,并询问有效 Prompt 编写的策略。

- 重点被放在从 trustworthy and scientific materials(可靠且科学的材料)中获取内容,强调了对质量的关注。

tinygrad (George Hotz) Discord

-

Tinygrad 机器学习库的连胜势头:一位成员描述了 tinygrad 注定会脱颖而出的三个关键原因:使用 BEAM 和 MCTS 的 efficient kernel search、少于 10k lines 的简洁代码库,以及 lazy execution 模型。

- “这避免了每个设备组合一个内核的组合噩梦……”,强调了通过其精简方法实现的性能提升。

-

Tinybox 预订困惑:关于 tinybox 预订的讨论引发了对支付方式和相关费用的询问,特别是它是否会像之前的型号一样采用 Stripe。

- 成员们对如何使用现有方式进行预订支付流程表示好奇。

-

OpenCL 处理引起关注:在 Stable Diffusion 中遇到全黑输出后,出现了关于 Out Of Memory (OOM) 处理的担忧,并对 OpenCL 的能力提出了疑问。

- 一位成员寻求澄清该实现是否有效地解决了 tinygrad 中的这些内存溢出情况。

-

MSE 和 MAE 实现简化:有人提议将 MSE 和 MAE 函数直接集成到 tensors 中,声称只需几行代码即可实现。

- 他们引用了一个 GitHub pull request,展示了实现过程及测试。

-

Windows 兼容性问题确实存在:Windows 11 出现问题,Python 安装引导用户进入 Microsoft Store,表明存在兼容性障碍。

- 讨论中提到了早前的 sqlite issues,强调了使用正确 Python 版本的必要性。

LAION Discord

-

Microdiffusion 实现进展:社区正热切期待 Microdiffusion 论文的实现,该项目设定了 $2k 的训练目标,并已获得 7 天 的 H100 计算资源,有望显著降低训练成本。

- 讨论集中在预处理协助以及在实验准备后寻求短期改进。

-

数据预处理挑战凸显:一位成员指出,由于 Hugging Face 的 300GB 限制,上传大型数据集存在困难,建议将数据分块或使用托管在 S3 上的 webdataset。

- 他们的目标是通过根据长宽比将图像分类到多个数据集中,来高效地预处理数据并进行流式传输。

-

用于高效数据处理的 Webdataset:参与者讨论了使用 webdataset 作为管理大型数据集的变通方案,从而实现与 PyTorch 的流式对接。

- 一位成员坚持认为,webdataset 打包将增强对其预期的 1TB 数据集的管理。

-

Dinov2 分层优化:讨论集中在将 Dinov2 蒸馏到早期层,从而提高图像相关下游任务的效率。

- 值得注意的是,与仅依赖 CLIP embedding 的 cross attention 相比,该方法表现出更优越的性能。

-

推出用于超声心动图的 EchoPrime:EchoPrime 作为一个基于多视图对比学习的模型出现,在 1200 多万个视频-报告对上进行了训练,解决了传统超声心动图 AI 的挑战。

- 这一新的基础模型增强了心脏成像的性能和应用范围。

LlamaIndex Discord

-

实验动态 Few-shot Prompting:动态 few-shot prompting 通过根据查询(query)检索相关示例而非使用固定集合,来增强 LLM 的微调(fine-tuning)(更多详情)。该方法改进了各种应用中的 prompt 上下文关联。

- 参与者指向了一个相关的讨论帖,强调了在该方法中相关示例的重要性。

-

Mistral 发布全新 Edge-Class 模型:Mistral 推出了备受关注的 edge-class 模型,通过 ‘pip install llama-index-llms-mistralai’ 提供首日支持(安装链接)。这允许开发者快速将这些模型集成到他们的系统中。

- 该公告引起了社区的关注,凸显了其在当前 AI 领域的相关性(公告链接)。

-

使用 Azure 增强多模态 RAG 系统:一份指南说明了如何利用 Azure AI Search 和 Azure OpenAI 结合 LlamaIndex 构建多模态 RAG 系统,指导如何提高检索准确性(查看指南)。这份详尽的文档包含了实际实现的基准测试。

- 该教程侧重于最大化不同 AI 系统间的上下文检索,提供了这条推文中分享的有价值的技术。

-

优化 Neo4jPropertyGraphStore 的创建:创建 Neo4jPropertyGraphStore 可能非常耗时,特别是在处理 64,322 个节点时,这引发了关于内存优化和模式(schema)简化的讨论。建议包括将

refresh_schema设置为 false,以减少昂贵的模式相关调用。- 社区反馈表明,这些调整可以显著提升初始化期间的性能。

-

研究多 Agent 编排工作流:用户询问如何在 LlamaIndex 中复制 OpenAI 的 Swarm 功能,重点是将工作流(workflows)作为核心方法。讨论引出了多 Agent 通信的示例,并辅以博客文章和 GitHub 仓库支持。

- 这一探索旨在开发高效的解决方案,利用现有工作流在多个 Agent 之间编排动作。

Interconnects (Nathan Lambert) Discord

-

Mistral 庆祝 Ministral 模型发布:在 Mistral 7B 发布一周年之际,Mistral 推出了两款边缘模型:Ministral 3B 和 Ministral 8B。这些模型专为设备端使用而设计,具备隐私优先的推理能力,并支持高达 128k 的上下文长度。

- 社区对 Ministral 3B 未开放权重表示失望,并对其与拥有非商业权重的 Ministral 8B 相比的潜在性能提出了质疑。

-

AI2 OLMo 实习岗位提供极具竞争力的薪资:AI2 正在为 OLMo 项目招聘研究实习生,薪资范围为 86,520 美元至 123,600 美元。实习生将有机会在为期 12 周的实习中领导 NLP 和 Machine Learning 领域的重要研究。

- 实习生可以自主定义研究项目并在高水平期刊上发表论文,这使得该机会在竞争激烈的环境中备受追捧。

-

Snailbot 扩展其功能:Snailbot 现在正被用于音频 Feed 帖子,体现了其在内容共享方面增强的功能。

- 这被视为一种一举两得的改进,用户对该 Bot 的新用例表示兴奋。

-

音频分发的挑战:用户表达了在音频内容分发方面面临的挑战,强调需要有效的策略。

- 一位用户幽默地将他们的问题比作某个流行笔记应用的梗图,表明了社区内普遍存在的挫败感。

-

Hackernews 曝光度难题:关于在 Hackernews 上发布内容的陷阱一直存在担忧,特别是关于链接可见性以及对直接链接的潜在惩罚。

- 成员们讨论了应对曝光度问题的复杂性,并建议采取避免直接链接的策略以增强内容参与度。

Latent Space Discord

-

Gemini 免费版表现不佳:用户报告了 Gemini 免费版 的超时和失败问题,对其声称的每天 1.5B token 的处理能力表示怀疑。

- 正如几位成员推测的那样,实际有效使用量可能更接近 0.05B token。

-

Mistral 加入边缘模型竞争:Mistral 推出了 Ministral 3B 和 Ministral 8B 模型,旨在应用于设备端,增强了 10B 以下量级模型的常识和推理能力。

- 然而,3B 模型仅限 API 使用,限制了其在设备端的应用,并引发了关于限制性许可的批评。

-

Nvidia 的 Llama 3.1 Nemotron 令人瞩目:据报道,Nvidia 的 Llama 3.1 Nemotron 70B 在各项 Benchmark 中均超越了 GPT-4o 和 Claude Sonnet 3.5,引起了社区的兴奋。

- 辩论随之而来:面对这款尖端模型,Sonnet 3.5 用户是否还能维持其竞争力。

-

E2B 的 SDK 获得融资助力:E2B 发布了 v1.0 SDK,并完成了令人印象深刻的 1150 万美元种子轮融资,目标是利用安全沙箱进行 AI 代码解释。

- 这家初创公司声称每月运行数百万个沙箱,其著名合作伙伴包括 Perplexity。

-

呼吁开发 LLM 性能基准测试工具:一位成员提出了开发类似于 CPUBenchmark 风格的工具,专门用于 LLM 比较,以改进目前有限的排行榜。

- 现有的工具(如 lmsys/hugging face 排行榜)无法在模型之间进行有效的直接比较。

Cohere Discord

-

Cohere 社区每日激发灵感:成员们从 Cohere 社区中获得了每日动力,非常赞赏其互助的氛围。

- “说实话,很多事情,尤其是这个社区的每一天!” 反映了大家共享的积极情绪。

-

职位机会说明:提醒大家,关于 Cohere 的职位咨询应转至 careers page。

- 成员强调了团队对于利用 ML/AI 技术解决现实世界挑战的热情。

-

明天参加 RAG++ AMA!:继社区表现出极大兴趣后,另一场关于 RAG 开发的 AMA(由 Ayush Thakur 和 Meor Amer 主持)将于明天 11:00 AM ET 开始。

- 该会议关联到 RAG++ 课程,承诺将提供关于当前发展的见解。

-

Cohere Embed API 错误处理说明:针对 Cohere Embed API 错误处理的咨询,建议在文档嵌入失败时根据特定错误代码实现重试逻辑。

- “错误可能导致整个批次的失败,” 建议在管理 Embeddings 时要小心。

-

聊天机器人支持 Text-to-Speech 了!:聊天机器人响应引入了 Text-to-Speech 功能,引发了热烈讨论,并为用户分享了 setup guide。

- “太棒了!” 是一位用户的热情回应,表明新功能得到了有效的采用。

Modular (Mojo 🔥) Discord

-

Playground 受到用户喜爱:成员们对 Playground 功能表达了由衷的喜爱,感谢 Modular 的改进和支持。欲了解更多信息,可以阅读 Playground 文档。

- 这些积极反馈凸显了社区意见在改进工具中的重要性。

-

预留社区展示会日期:社区会议定于 10月21日 举行,届时将有现场展示环节,参与者可以演示他们的 MAX 和 Mojo 项目。每个时段持续 5-10 分钟,允许分享学习心得和反馈。

- 这样的参与有助于催化开发者之间的协作和知识共享。

-

奇怪的 Mojo Bug 已修复:一名成员发现了一个可复现的 Mojo bug,但随后自行修复了它,并提议将贡献加入更新日志。他们鼓励其他人报告类似问题以增强平台。

- 这种主动的方法可以带来更快的 Bug 解决速度和更好的软件稳定性。

-

Inferencemax 项目简化 API:一名成员分享了他们名为 Inferencemax 的新项目,旨在简化 LLM inference,尽管它可能无法完全满足现有的所有需求。代码使用 Python 编写,并计划进行性能改进。

- 该项目反映了在创建更易用的 Inference API 领域所做的持续努力。

-

Jakub 为 MAX 开发的 Python API 引起关注:关于 Jakub 对 MAX 的 Python API 贡献的咨询引导至了一个 community meeting 链接,他在会上发表了讲话。虽然该 API 尚未完全发布,但它在 Nightly Builds 中的出现旨在展示其易用性。

- 此类讨论强调了对提高可用性的 API 开发的期待。

Stability.ai (Stable Diffusion) Discord

-

需要矿产资源海报制作协助:一名成员寻求制作关于 mineral resources 的大学项目海报的帮助,向社区征求指导。

- 另一名成员建议他们在聊天中分享具体需求,以便获得更直接的支持。

-

SD3 在处理人体姿势时表现不佳:讨论集中在 SD3 在处理躺姿或倒立姿势时的性能缺陷,指出其表现普遍较差。

- 一位参与者强调,无论什么姿势,经常会出现变形,这表明是一个持续存在的问题。

-

LLM 忽略 Token 限制:一位用户对 LLM 无法遵守 token limits 或停止命令表示沮丧,导致输出混乱。

- 他们推测可能是 Prompt 模板存在问题,并邀请资深用户提供见解。

-

澄清 LyCORIS 与 LoRA 的混淆:一名成员询问 LyCORIS 文件夹的用途,因为现在所有内容都移到了 LoRA,对此表示困惑。

- 另一位用户回应解释说,该文件夹是以前扩展程序所必需的,现在已被 Auto1111 等新界面整合。

-

新 Web3 项目招聘职位:更新分享了一个新 Web3 project 的启动,该项目正在招聘包括 Developer 和 Moderator 在内的多个职位,薪资具有竞争力。

- 鼓励感兴趣的候选人直接联系以获取有关可用职位的更多具体信息。

OpenInterpreter Discord

-

Open Interpreter GitHub Copilot 扩展建议:一名成员提议创建一个 Open Interpreter GitHub Copilot extension,而另一名成员表示他们缺乏 bandwidth 去执行,但愿意指导社区的工作。

- 他们鼓励社区内部协作,共同实现这个项目。

-

对 Mozilla AI 演讲的期待:成员们对即将到来的 Mozilla AI 演讲表示期待,敦促大家将其添加到日历中。

- 分享了活动链接以便访问。

-

应用关闭时报告 Kernel panic:一名成员报告在关闭 Open Interpreter 应用时出现 kernel panic,促使 MikeBirdTech 建议创建一个专门的故障排除帖子。

- 报告应附带所使用版本的详细信息,以便有效解决。

-

新的本地 LLMs 功能:最近的更新现在支持通过 Ollama 轻松运行 Hugging Face 上的任何 GGUF 模型,只需指向仓库即可。

- 用户可以通过简单的命令运行 Llama 3.2 3B,使本地 LLMs 更加易于访问。

-

对本地 LLMs 更新的正面反馈:成员们对直接运行模型的新功能表示热烈欢迎,强调这是对本地 LLMs 的重大增强。

- 提到了对之前缺失功能的赞赏,特别是与 Jan 相关的部分。

DSPy Discord

- 单元测试 DSPy Workflow 系统:一位成员宣布他们正在 Discord 频道中对一个 DSPy 驱动的 Workflow 系统进行单元测试。请关注该频道以获取测试过程的进度更新和反馈。

- 此次测试旨在完善工作流并确保可靠性,鼓励社区对发现的问题提供建议。

- dspygen 框架重大更新:dspygen 框架近期发布了重大更新,该框架旨在 dslmodel 之外进行改进。这旨在增强 GPT、BERT 和 LLaMA 等语言模型的 DSPy 工作流。

- 更新重点在于引入更多功能和优化,从而实现现有系统内更好的集成。

- LightRAG 表现优于 GraphRAG:根据这篇论文的详细描述,最近的观点认为 LightRAG 在有效性和成本效率方面比 GraphRAG 有显著提升。作者提出 LightRAG 解决了现有 RAG 系统的局限性,通过创新的图结构提高了上下文感知(contextual awareness)和信息检索能力。

- 他们断言,这些创新降低了运营成本并提升了整体系统性能。

- DSPy 与 GPT-O1+ 的集成取得进展:更新后的文档引入了一个长篇 RAG 示例,用于构建一个关于技术主题的 DSPy 问答系统。用户可以通过

pip install -U dspy安装 DSPy,教程可在 DSPy 文档中找到。- 此次集成预计将简化工作流并提升 DSPy 框架内的用户体验。

- 改进文档编写方法:关于即将进行的 DSPy 文档翻新的讨论已经展开,重点是改进节奏和风格。参与者正在考虑是使用 HTML 文档还是详细的 notebooks,并提到了执行缓存(caches for execution)的实用性。

- 此次翻新旨在提高用户的清晰度和可访问性,使用户能够更轻松地查阅文档。

LangChain AI Discord

- LangChain 社区即将关闭:目前的 LangChain Discord 社区将于 2024 年 10 月 31 日关闭,以为全新的用户空间腾出空间,新空间旨在更具互动性和趣味性。

- 成员可以通过填写此处的表格来关注更新,并鼓励通过 community@langchain.dev 提供反馈。

- API 路由建议征集:一位成员正在寻求关于使用 Agent 将用户查询路由到不同 API 的指导,并提到他们在 Docker Compose 中设置了 5 个 API。

- 此项咨询旨在优化其项目结构并提升用户与 API 交互的体验。

- Playground 空白页困扰:成员们反映了 Playground 中的一个重大问题,即带有 Optional 字段的输入类型会导致页面加载为空白,并在控制台中报错。

- 该问题可能源于输入模式(schema)中的 null 类型与 jsonforms 冲突,从而阻碍了功能使用。

- 针对 Playground 问题已提交 GitHub Issue:一位成员提交了 GitHub Issue #782,以跟踪与 Optional 字段导致加载失败相关的 Playground 问题。

- 这是解决 LangChain Playground 内关键可用性问题的持续努力的一部分。

- Remote Runnable 工具绑定咨询:一位成员询问在 Remote Runnable 中缺失用于工具绑定的 bind_tools() 方法的问题,这为改进提供了契机。

- 这一讨论可能为 LangChain 环境中更好的工具管理奠定基础。

OpenAccess AI Collective (axolotl) Discord

-

AIFoundry 寻求 GitHub 指导:AIFoundry.org 正在寻求关于其 GitHub 组织和设计的指导,旨在效仿 Axolotl 的精简方法。

- Yulia 表达了希望获得指导的愿望,以增强他们专注于本地模型推理(local model inference)的开源计划。

-

Mistral 访问规则说明:要访问 Hugging Face 上新的 Mistral-8B-Instruct-2410 模型,用户必须提供联系方式并获得非标准用途的许可。

- 访问权限取决于 Mistral AI 的同意,并呼吁用户查看其隐私政策以确保合规。

-

L3.1 Ethereal Rainbow 发布风险:L3.1 Ethereal Rainbow 仓库因包含敏感且潜在有害的内容而被标记,用户需谨慎使用。

- 该仓库因其敏感材料引发了警告,用户应仔细考虑该内容的影响。

-

微调 L3.1 模型:L3.1 模型已使用超过 2.5 亿个 Tokens 进行微调,并保持了 16k 的序列长度能力,增强了其在创意写作应用中的性能。

- 这种对 RP(角色扮演)和创意写作 的关注,标志着在敏感语境下增强模型实际可用性的针对性努力。

Torchtune Discord

-

成员热议新论文:社区对标题为 arxiv:2410.06511 的论文反响热烈,成员们认为这是一篇极佳的读物。

- 一位成员确认他们仍在研读该论文,强调了其质量和社区的参与度。

-

对论文质量的一致好评:关于该论文的总体评价非常积极,多位成员强调了其令人印象深刻的内容。

- 一些人提到他们仍在深入研究细节,反映了大家对其见解的共同兴趣。

LLM Agents (Berkeley MOOC) Discord

-

LLM 在 zero-shot 优化方面表现出色:最近的研究表明,Large Language Models (LLMs) 可以在多目标优化等复杂问题上执行 zero-shot 优化。

- 这一应用可能在工程任务中发挥重要作用,例如火箭喷嘴设计和风电场布局优化。

-

认识 Language-Model-Based Evolutionary Optimizer (LEO):LEO 被介绍为一种利用 LLM 进行数值优化的新型种群算法(population-based approach),其表现与基于梯度和无梯度方法不相上下。

- 然而,对输出中可能出现幻觉(hallucination)的担忧表明,在其应用中需要进行细致的管理。

-

社区热议 LLM 设计应用:社区讨论反映了对 LLM 在工程设计中实际应用的浓厚兴趣,特别是关注其推理能力。

- 成员们热衷于合作探讨 LLM 如何应对现实世界的工程挑战。

Mozilla AI Discord

-

AI Stewardship Practice 试点项目:MaRS Discovery District 正在为 AI Stewardship Practice 项目提供免费名额,目标受众为 AI 领域的专业人士。

- 该计划为希望对 AI 产生积极影响的研究人员、企业家和教育工作者提供微凭证(microcredential);更多信息请点击此处。

-

征集 AI 课程试点参与者:有机会加入该计划的课程试点,价值 500 CAD,鼓励感兴趣的参与者尽快响应。

- 名额将根据跟帖回复情况分配,对于想要参与的人来说,迅速行动至关重要。

The Alignment Lab AI Discord 没有新消息。如果该频道长期保持沉默,请告知我们,我们将将其移除。

The LLM Finetuning (Hamel + Dan) Discord 没有新消息。如果该频道长期保持沉默,请告知我们,我们将将其移除。

The MLOps @Chipro Discord 没有新消息。如果该频道长期保持沉默,请告知我们,我们将将其移除。

The DiscoResearch Discord 没有新消息。如果该频道长期保持沉默,请告知我们,我们将将其移除。

The Gorilla LLM (Berkeley Function Calling) Discord 没有新消息。如果该频道长期保持沉默,请告知我们,我们将将其移除。

The AI21 Labs (Jamba) Discord 没有新消息。如果该频道长期保持沉默,请告知我们,我们将将其移除。

PART 2: 按频道详细摘要和链接

完整的频道细分内容已在邮件中截断。

如果您喜欢 AInews,请分享给朋友!提前感谢!