ainews-not-much-happened-today-5175

今天没什么事发生。

Anthropic 发布了升级版的 Claude 3.5 Sonnet 和 Claude 3.5 Haiku 模型,其核心亮点是具备全新的“计算机使用能力”(computer use capability),允许模型通过查看屏幕截图并执行移动鼠标、点击和打字等操作来与计算机界面进行交互。Claude 3.5 Sonnet 在 SWE-bench Verified 基准测试中以 49% 的得分刷新了编程性能纪录(SOTA),超越了 OpenAI 的 o1-preview。Anthropic 致力于教授模型通用的计算机技能,而非仅限于特定任务的工具,并预计该能力将迎来快速提升。

其他发布的消息还包括:开源视频生成模型 Mochi 1;拥有 Large 和 Medium 变体的 Stable Diffusion 3.5;以及 Cohere 推出的用于文本和图像搜索的多模态嵌入模型 Embed 3。François Chollet 推出了 KerasHub,将 KerasNLP 和 KerasCV 统一,并提供了 37 个预训练模型。微软推出了 Differential Transformer(微分 Transformer),旨在通过微分注意力图减少注意力噪声;此外,Rasbt 也分享了关于 Transformer 注意力层的最新研究。

你只需要一个安静的日子。

2024/10/22-2024/10/23 的 AI 新闻。我们为您检查了 7 个 subreddits、433 个 Twitters 和 31 个 Discords(229 个频道和 3078 条消息)。预计节省阅读时间(以 200wpm 计算):346 分钟。您现在可以标记 @smol_ai 进行 AINews 讨论!

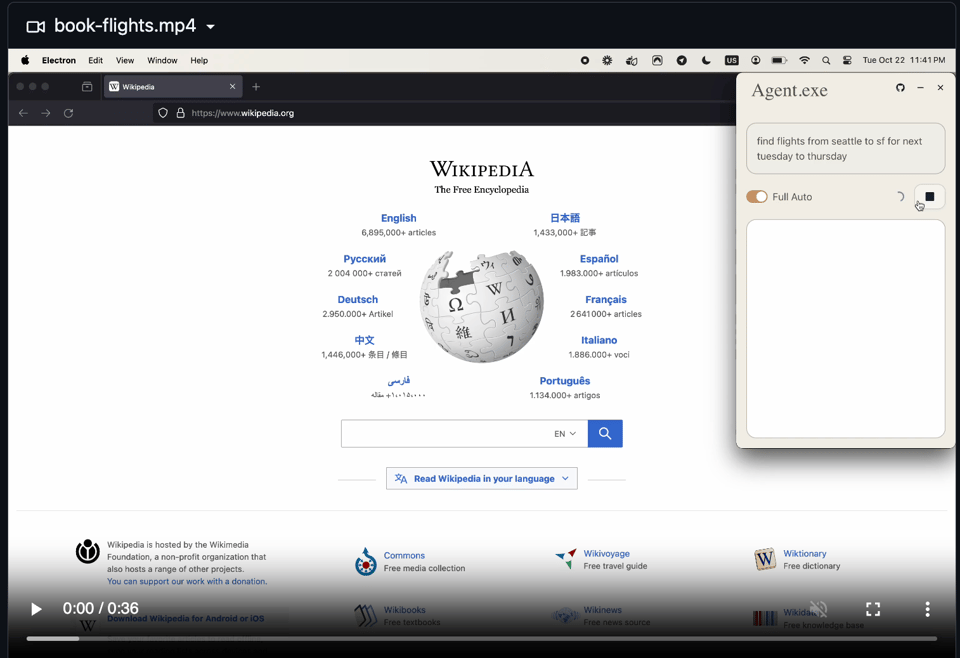

人们仍在深入探索 Anthropic 新推出的 Computer Use demo/usecases 的影响。有些人指出了它的失败之处并剖析其术语,另一些人则将其连接到了手机模拟器和真实手机上。Kyle Corbitt 竟然在 6 小时内为 Computer Use 编写了一个完整的桌面应用程序,这样你就不用去启动 Anthropic 提供的 Docker demo 了。

但房间里的每一个人都深信,这将在短时间内迅速变得更好。

AI Twitter 摘要

所有摘要均由 Claude 3.5 Sonnet 完成,取 4 次运行中的最佳结果。

Anthropic 的 Claude 3.5 发布及计算机使用能力 (Computer Use Capability)

-

新模型与新功能:@AnthropicAI 宣布了升级版的 Claude 3.5 Sonnet、全新的 Claude 3.5 Haiku 模型,以及处于 Beta 阶段的计算机使用能力。这使得 Claude 可以通过观察屏幕、移动光标、点击和打字来与计算机进行交互。

-

计算机使用详情:@alexalbert__ 解释说,计算机使用 API 允许 Claude 感知并与计算机界面交互。用户输入屏幕截图,Claude 返回下一步要执行的操作(例如:移动鼠标、点击、输入文本)。

-

性能提升:@alexalbert__ 指出,新版 3.5 Sonnet 在编程性能方面取得了显著进步,在 SWE-bench Verified 测试中以 49% 的得分创下了 SOTA(业内领先水平),超越了包括 OpenAI 的 o1-preview 在内的所有模型。

-

Haiku 模型:@alexalbert__ 分享道,新的 Claude 3.5 Haiku 取代了 3.0 Haiku,成为 Anthropic 速度最快且价格最低的模型,在编程任务上的表现甚至优于许多顶尖模型。

-

开发过程:@AnthropicAI 提到,他们正在教 Claude 掌握通用的计算机技能,而不是为特定任务制作专用工具,从而使其能够使用为人类设计的标准软件。

-

局限性与未来改进:@AnthropicAI 承认 Claude 目前使用计算机的能力尚不完美,在滚动、拖拽和缩放等操作上仍面临挑战。他们预计在未来几个月内会有快速改进。

其他 AI 模型发布与更新

-

Mochi 1:@_parasj 宣布了 Mochi 1,这是一款根据 Apache 2.0 许可证发布的全新 SOTA 开源视频生成模型。

-

Stable Diffusion 3.5:@rohanpaul_ai 报道了 Stable Diffusion 3.5 的发布,包括 Large(8B 参数)和 Medium(2.5B 参数)变体,在训练稳定性和微调灵活性方面有所提升。

-

Embed 3:@cohere 推出了 Embed 3,这是一款多模态嵌入模型,使企业能够构建可跨文本和图像数据源进行搜索的系统。

-

KerasHub:@fchollet 宣布推出 KerasHub,将 KerasNLP 和 KerasCV 整合为一个涵盖所有模态的统一包,包括 37 个预训练模型及相关工作流。

AI 研究与开发

-

Differential Transformer:@rohanpaul_ai 讨论了来自 Microsoft 的一篇新论文,该论文引入了 “Differential Transformer”,它利用微分注意力图来消除注意力噪声,并引导模型走向稀疏注意力。

-

注意力层移除:@rasbt 分享了一篇题为《What Matters In Transformers?》的论文发现,在 Llama 等 LLM 中移除一半的注意力层并不会明显降低建模性能。

-

RAGProbe:@rohanpaul_ai 重点介绍了一篇引入 RAGProbe 的论文,这是一种用于评估 RAG(检索增强生成)流水线的自动化方法,揭示了各种数据集中的局限性和失败率。

行业动态与合作

-

Perplexity Pro:@AravSrinivas 宣布 Perplexity Pro 正在转型为推理驱动的搜索 Agent,用于处理涉及数分钟浏览和工作流的更复杂查询。

-

Timbaland 与 Suno:@suno_ai_ 分享了格莱美获奖制作人 Timbaland 正在与 Suno AI 合作,探索 AI 如何帮助他在音乐制作中重新发现创意。

-

Replit 集成:@pirroh 提到 Replit 已在其 Agent 中集成 Claude 计算机使用功能,作为人类反馈的替代方案,并称其“运行良好”。

AI Reddit 摘要

/r/LocalLlama 摘要

主题 1. 重大 LLM 更新:Claude 3.5 与 Stable Diffusion 3.5

- Stability AI 发布了 Stable Diffusion 3.5,包含三个版本,Medium 版将于 10 月 29 日发布。 (Score: 110, Comments: 40): Stability AI 发布了 Stable Diffusion 3.5,提供三个版本:Base、Medium 和 Large。Base 模型现已可用,Medium 定于 10 月 29 日发布,Large 将在稍后推出。新版本在图像质量、文本理解以及构图、光照和解剖准确性等方面都有所提升。

- 用户幽默地注意到 Stability AI 在其博客中包含了一张草地上的女人的图片,引用了之前的梗。一些人测试了该模型生成此场景的能力,结果褒贬不一,包括出现了意外的 NSFW 内容。

- 用户对 SD3.5 和 Flux1-dev 进行了对比,报告称在有限的测试中,Flux1-dev 通常能产生更写实的效果,且畸变更少。

- 社区讨论了 SD3.5 的潜在应用,包括将其作为微调项目的基座。然而,一些人指出 license 限制可能会限制其在某些用例中的采用。

- 推出 computer use 功能、全新的 Claude 3.5 Sonnet 以及 Claude 3.5 Haiku (Score: 187, Comments: 82): Anthropic 推出了 Claude 3.5 Sonnet 和 Claude 3.5 Haiku,并引入了 computer use 能力,允许 AI 与虚拟机进行交互。这些模型现在可以执行网页浏览、文件操作和运行代码等任务。Sonnet 相比 Claude 3.0 性能有所提升,而 Haiku 为简单任务提供了更快、更具成本效益的选择。新版本可通过 API 和 Claude 网页界面使用,computer use 目前处于 beta 阶段,仅对部分客户开放。

- Claude 3.5 Sonnet 较之前版本有显著的性能提升,用户注意到其在 coding 任务中的强势表现。该模型现在以 beta 形式提供 computer use 能力,允许与虚拟机交互以执行网页浏览和文件操作等任务。

- 用户对赋予 Claude 远程代码执行能力带来的安全影响表示担忧。Anthropic 建议在使用 computer use 功能时采取预防措施,例如使用专用的虚拟机并限制对敏感数据的访问。

- Claude 模型的命名约定变得令人困惑,Claude 3.5 Sonnet 和 Claude 3.5 Sonnet (new) 可能会导致混淆。用户建议采用更清晰的版本命名,并将当前的命名策略与三星和索尼等公司的复杂产品命名进行了比较。

主题 2. 开源 AI 模型进展与复现工作

- O1 Replication Journey: A Strategic Progress Report – Part I (Score: 34, Comments: 6): 作者报告了他们在复制 OpenAI O1 模型 方面的进展,重点关注 120B 参数模型 中的前 120 亿参数。他们概述了在扩大规模之前通过训练较小模型来验证组件的策略,并已成功使用 Flash Attention 和 Rotary Embeddings 等技术训练了高达 1.3B 参数 的模型。接下来的步骤包括扩展到 12B 参数,并实现 Multi-Query Attention 和 Grouped-Query Attention 等附加功能。

- 针对有关数据集构成和创建过程的问题,作者澄清说,文章的重点是 学习方法和结果,而不是数据集。

- 这份尚未被广泛讨论的 O1 Replication Journey 技术报告介绍了从 “Shortcut Learning” 向 “Journey Learning” 的转变,并利用各种方法探索了 O1 的思维结构、Reward Models 以及 长思维构建 (Long Thought Construction)。

- 一位评论者指出,该项目成功产生了类似于 O1 带有注释的 长篇推理回答,但也指出 研究产物(微调模型和 “Abel” 数据集)目前尚未公开。

- 🚀 Introducing Fast Apply - Replicate Cursor’s Instant Apply model (Score: 187, Comments: 40): Fast Apply 是一个开源的、经过微调的 Qwen2.5 Coder Model,旨在快速应用来自高级模型的代码更新以生成完整编辑后的文件,其灵感来自 Cursor 的 Instant Apply 模型。该项目提供两个模型(1.5B 和 7B),使用快速推理供应商 (Fireworks) 时性能速度分别达到 ~340 tok/s 和 ~150 tok/s,使其适合日常使用且足够轻量,可以在本地运行。该项目完全开源,模型、数据和脚本可在 HuggingFace 和 GitHub 上获取,并可在 Google Colab 上试用。

- 该项目因其 开源 属性受到赞扬,用户对其易用性和改进潜力表示热赏。开发者提到计划使用 DeepSeek 等工具创建 更好的 Benchmark。

- 用户询问了 1.5B 和 7B 模型之间的准确率比较。开发者分享了一个粗略的 Benchmark,显示 1.5B 模型在其尺寸下表现出色,建议用户在尝试 7B 版本之前先从它开始。

- 讨论涉及了与 continue.dev 和 Aider 等其他工具的潜在 集成。开发者表示有兴趣提交 PRs,以支持并将该项目与目前仅支持 diff/whole 格式的现有平台集成。

Theme 3. AI Model Comparison Tools and Cost Optimization

- 我开发了一个 LLM 比较工具——你可能为 API 多支付了 50% 的费用(分析了 200 多个模型/供应商) (Score: 44, Comments: 16): 一位开发者创建了一个免费工具 (https://whatllm.vercel.app/),用于比较 15 个以上供应商的 200 多个 LLM 模型,分析价格、性能和质量得分。关键发现包括显著的价格差异(例如,在质量相近的情况下,Qwen 2.5 72B 比 Claude 3.5 Sonnet 便宜 94%)和性能差异(例如,Cerebras 的 Llama 3.1 70B 比 Amazon Bedrock 版本快 18 倍且便宜 40%)。

- 开发者提供了可视化图表来帮助理解数据,包括比较价格、速度和质量等指标。他们使用 Nebius AI Studio 的免费推理额度和 Llama 70B Fast 进行数据处理和比较。

- 讨论中涉及了质量指数的有效性,开发者指出 Qwen 2.5 在 MMLU-pro 和 HumanEval 上的得分仅略低于昂贵模型,但在 Math 基准测试中得分更高。

- 用户对该工具表示赞赏,有人称其为寻找最佳 LLM 供应商的“游戏规则改变者”。开发者还向寻找位于芬兰和法国的欧洲数据中心的 LLM 用户推荐了 Nebius AI Studio。

- Transformers.js v3 正式发布:支持 WebGPU、新模型与任务、新量化方式、兼容 Deno & Bun 等…… (Score: 75, Comments: 4): Transformers.js v3 已发布,引入了 WebGPU 支持,可在兼容设备上显著提高推理速度。此次更新包括新模型和任务,如文本转语音 (text-to-speech)、语音识别 (speech recognition) 和图像分割 (image segmentation),以及扩展的量化选项,并兼容 Deno 和 Bun 运行时。此版本旨在提升性能并扩展该库在 JavaScript 环境中处理机器学习任务的能力。

- Transformers.js v3 的发布亮点包括:WebGPU 支持使推理速度提升高达 100 倍,支持 120 种架构和超过 1200 个预转换模型。该更新兼容 Node.js、Deno 和 Bun 运行时。

- 用户对该库的性能表现出极大热情,有人提到对模型在浏览器中运行的速度感到惊讶。社区对这项技术的广泛开发和分享表示感谢。

- 一位开发者询问是否可以包含发布过程中使用的 ONNX 转换脚本,表现出对该库模型转换背后技术细节的兴趣。

Theme 4. 用于 AI 开发的 GPU 硬件讨论

- 如果泄露的规格属实,你最高愿意为 5090 支付多少钱? (Score: 32, Comments: 94): 该帖子推测了 NVIDIA 即将推出的 5090 GPU 的潜在规格和性能。据称 5090 可能配备 512-bit 显存位宽、32GB 显存,在 AI 工作负载方面比目前的 4090 型号快 70%。

- 用户对 32GB VRAM 的价值进行了辩论,一些人认为这对于 LLM 工作负载来说是不够的。许多人更倾向于使用多个 3090 或 4090 以获得更大的总显存容量,特别是为了运行 70B 模型。

- 关于 5090 潜在定价的讨论,估计范围在 2000 美元到 3500 美元之间。一些人推测 4090 的价格可能会下降,从而可能导致二手 GPU 涌入市场。

- 用户将 5090 与其他选项(如多张 3090 或 A6000)进行了比较。用户强调,对于 AI 工作负载,总显存 (VRAM) 的重要性高于原始性能。

其他 AI Subreddit 回顾

r/machinelearning, r/openai, r/stablediffusion, r/ArtificialInteligence, /r/LLMDevs, /r/Singularity

AI 模型发布与改进

-

Anthropic 发布更新后的 Claude 3.5 模型:Anthropic 宣布了 Claude 3.5 Sonnet 和 Claude 3.5 Haiku 的更新版本,在各项基准测试中均有性能提升。据报道,新的 Sonnet 模型在 推理、代码生成和分析能力方面表现出显著改进。

-

Stability AI 发布 SD 3.5:Stability AI 发布了 Stable Diffusion 3.5,包括一个 80 亿参数的大模型和一个更快的 “turbo” 版本。早期测试表明,与之前的版本相比,其在图像质量和提示词遵循度(prompt adherence)方面有所提升。

-

Mochi 1 视频生成模型:一款名为 Mochi 1 的新型开源视频生成模型发布,声称在运动质量和人物渲染方面达到了 SOTA 性能。

AI 能力与应用

-

Claude 的计算机控制能力:Anthropic 展示了 Claude 的新能力:控制计算机并执行诸如在线订披萨等任务。这项功能允许 Claude 与网页界面和应用程序进行交互。

-

AI 玩 Paperclips 游戏:一项实验展示了 Claude 自主玩 Paperclips 游戏,证明了其制定策略并根据新信息进行修订的能力。

-

OpenAI 正在开发软件自动化工具:有报告指出 OpenAI 正在 开发新产品以自动化复杂的软件编程任务,这可能是为了应对来自 Anthropic 的竞争。

AI 开发与研究

-

修复 LLM 训练 Bug:一位研究人员 修复了影响 LLM 训练的关键 Bug,特别是与梯度累积(gradient accumulation)相关的 Bug,这些问题此前可能影响了模型的质量和准确性。

-

五角大楼的 AI Deepfake 项目:据报道,美国国防部正 寻求创建具有说服力的 AI 生成在线人格,用于潜在的影响力行动(influence operations)。

AI 伦理与安全

-

字节跳动实习生因恶意代码被解雇:字节跳动的一名实习生因 涉嫌在 AI 模型中植入恶意代码而被解雇,这引发了人们对 AI 安全和访问控制的担忧。

-

Claude 的反越狱措施:更新后的 Claude 3.5 模型似乎 增强了针对越狱(jailbreaking)尝试的防御,展示了对潜在操纵更复杂的检测能力。

AI Discord 回顾

由 O1-preview 生成的摘要之摘要的摘要

主题 1:Claude 3.5 席卷 AI 世界

- Claude 3.5 在编程技能上提升 15%,令人惊叹:OpenAI 和 Unsloth AI 社区对 Claude 3.5 Sonnet 在 SWE-bench 上 15% 的性能提升感到兴奋,尤其是在编程任务中。该模型全新的 computer use 功能允许 Agent 像人类一样与计算机交互。

- OpenRouter 揭晓“时空旅行”版 Claude 3.5 版本:OpenRouter 发布了较旧的 Claude 3.5 Sonnet 版本,如 Claude 3.5 Sonnet (2024-06-20),让用户能够怀旧地访问之前的迭代版本。

- 开发者们正在钻研 Claude 的新技巧:OpenInterpreter 等社区正在探索将 Claude 3.5 与

interpreter --os等命令集成,测试 Anthropic 的模型并分享见解。

2. 创意与实用领域的创新 AI 应用

- DreamCut AI 革新视频编辑:DreamCut AI 利用 Claude AI 自主安装和调试软件,简化视频编辑任务。该工具目前处于早期访问阶段,它绕过了传统的设计阶段,标志着向 AI 驱动编程的转变。

- GeoGuessr AI 机器人实现自动化游戏:一段 YouTube 教程 展示了如何使用 Multimodal Vision LLMs(如 GPT-4o、Claude 3.5 和 Gemini 1.5)编写一个玩 GeoGuessr 的 AI 机器人。该项目集成了 LangChain,用于对交互式游戏环境做出响应。

- AI 驱动的客服机器人:Aider 推出了一套多 Agent 礼宾系统,结合了工具调用(tool calling)、记忆和人类协作,用于高级客服应用。这次彻底改造允许开发者更有效地迭代和增强客服机器人。

主题 3:亮眼的新工具助力 AI 进步

- Anyscale 的单 Kernel 奇迹旨在加速推理:GPU MODE 社区对 Anyscale 开发的使用单个 CUDA kernel 的推理引擎议论纷纷,该引擎性能可能超越传统方法。

- CUDABench 号召所有编码者对 LLM 进行基准测试:博士生们邀请社区为 CUDABench 做出贡献,这是一个评估 LLM 的 CUDA 代码生成能力的基准测试。

- Fast Apply 为代码更新提速:基于 Qwen2.5 Coder Model 的 Fast Apply 通过以 340 tok/s(针对 1.5B 模型)的惊人速度应用更新,彻底改变了编码方式。

主题 4:AI 的阴暗面引发担忧

- AI 被指与青少年自杀悲剧有关:各社区正在讨论关于一名 14 岁少年自杀与 AI 交互有关的报告,引发了对 AI 心理健康影响的警惕。

- Character.AI 在悲剧发生后增加安全功能:针对该事件,Character.AI 宣布了新的安全更新以防止未来的伤害。

- 辩论激烈:AI 是对抗孤独的良友还是祸首?:Latent Space 的成员深入探讨了 AI 是缓解了孤独还是加剧了孤立,对于技术在心理健康中的作用意见不一。

主题 5:ZK Proofs 让用户掌控自己的数据

- ChatGPT 用户为拥有聊天记录所有权而欢呼:OpenBlock 的 Proof of ChatGPT 使用 ZK proofs 让用户拥有自己的聊天日志,从而增强开源模型的数据训练。

- 社区拥抱数据主权运动:HuggingFace 和 Nous Research 的讨论呼应了对数据所有权的热情,强调了透明且可验证的用户数据在 AI 开发中的重要性。

第一部分:Discord 高层级摘要

HuggingFace Discord

-

Stable Diffusion 3.5 性能辩论:成员们讨论了对 Stable Diffusion 3.5 褒贬不一的看法,注意到目前人们对测试新功能并将其与其他替代方案进行对比充满热情。

- 这场持续的辩论凸显了人们对提高生成模型性能的浓厚兴趣。

-

使用 LLM 自动化 CAD:一位成员提议使用 LLM 和 RAG 系统 来自动化 CAD 文件的创建,并寻求有关系统设计方法的见解。

- 讨论表明社区致力于通过集成 AI 技术来提高效率。

-

探索 MIT AI 课程:一位成员分享了一个包含 MIT 6.034 Artificial Intelligence 的 YouTube 播放列表,并称赞其基础内容的价值。

- 社区的强烈反应表明,对于那些深入研究 AI 概念的人来说,这是必看内容。

-

Vintern-3B-beta 问世:Vintern-3B-beta 模型集成了超过 1000 万个越南语问答对 (QnAs),将其定位为市场上 LLaVA 的竞争对手。

- 这种集成展示了在高质量语言模型训练中利用数据集方面的进展。

-

ZK Proofs 增强 ChatGPT:利用 ZK proofs(零知识证明),ChatGPT 现在允许用户拥有自己的聊天记录,从而增强了开源模型的可验证训练数据。

- 正如 演示推文 中所强调的,这标志着一个重大的进步。

OpenAI Discord

-

Claude 3.5 Sonnet 提升性能:Claude 3.5 Sonnet 在 SWE-bench 和增强型基准测试中显示出 15% 的性能提升,表明微调(fine-tuning)效果显著。

- 主动学习(active learning)技术的整合似乎增强了模型处理计算机任务的效能。

-

Anthropic 发布 Computer Use 工具:Anthropic 推出了一种新颖的工具,使 Agent 能够直接在计算机上执行任务,旨在重塑 Agent 的能力。

- 该工具利用先进的数据处理,旨在为 API 消费者提供更无缝的用户体验。

-

GPT-4 升级时间表悬而未决:围绕预期的 GPT-4 升级,讨论热情高涨,但几个月前的提到内容仍是主要的参考点。

- 据报道,免费用户获得 GPTs 的访问权限大约发生在 4-5 个月前。

-

模型表现出较弱的空间感:讨论显示,模型经常表现出较弱的空间感,实际上是在没有真正理解的情况下模仿答案。

- 这种现象类似于儿童的死记硬背,表明在深度理解能力方面存在缺陷。

-

关于 Realtime API 性能的讨论:有用户担心 Realtime API 在遵循系统提示词(system prompts)方面不如 GPT-4o 有效,这让许多用户感到失望。

- 参与者寻求关于调整提示词以提高与 API 交互质量的建议。

Unsloth AI (Daniel Han) Discord

-

Claude 3.5 带来重大升级:Anthropic 发布了升级后的 Claude 3.5 Sonnet 和 Claude 3.5 Haiku 模型,在编码任务中引入了高级功能,包括目前处于 Beta 阶段的 computer use 功能。

- 这一新能力允许开发者指示 Claude 以类似于人类用户的方式与计算机交互,增强了其在实际编码场景中的实用性。

-

Kaggle 在 PyTorch 安装上遇到困难:用户报告了 Kaggle 上与不同 CUDA 版本相关的持续

ImportError问题,在尝试运行 PyTorch 时,建议降级到 CUDA 12.1。- 此解决方法解决了兼容性问题,并确保现有库安装的运行更加顺畅。

-

模型微调挑战依然存在:用户讨论了模型在微调(fine-tuning)过程中重复输入的倾向,建议通过改变系统提示词来减轻这种过拟合(overfitting)。

- 社区成员担心训练样本不足可能导致对基础模型的依赖,从而产生重复的输出。

-

Fast Apply 彻底改变编码任务:基于 Qwen2.5 Coder Model 构建的 Fast Apply 运行高效,无需重复编辑即可应用代码更新,显著提高了编码效率。

- 性能指标显示 1.5B 模型的速度达到 340 tok/s,该工具展示了 AI 解决方案如何增强编码工作流的生产力。

-

社区齐心协力修复 Bug:提交了两个重要的 Pull Request (PR):一个用于解决 Studio 环境中的导入问题,另一个用于修正由 Tokenizer Bug 引起的 NoneType 错误。

- 这些 PR 强调了社区在完善 Unsloth 功能和及时解决用户报告问题方面的积极态度。

Stability.ai (Stable Diffusion) Discord

-

Stable Diffusion 3.5 获得神经架构升级:参与者强调 Stable Diffusion 3.5 采用了类似于 Flux 的神经网络架构,需要社区驱动的训练工作来进行优化。

- 社区就 finetuning 的重要性达成共识,以充分发挥新模型的能力。

-

动漫艺术 Prompting 秘籍公开:对于生成动漫艺术,用户建议使用带有精确提示词的 SD 3.5,而不是依赖 LoRAs,以获得最佳效果。

- 社区建议专注于 Stable Diffusion 3.5 以提升图像质量,并避免因错误使用 LoRAs 带来的陷阱。

-

图像质量报告参差不齐:用户报告图像输出不稳定,特别是在提示词与错误的 checkpoints 匹配或使用不合适的 LoRAs 时。

- 讨论强调了确保模型与提示词对齐的必要性,以减少不理想的生成结果。

-

立即实现模型组织自动化!:用户表达了对能够自动分类和管理文件夹内 AI 模型文件工具的需求,以提高整体工作流效率。

- 鼓励参与者在服务器的技术支持频道中寻找潜在自动化工具的解决方案。

-

分享提升生成工作流的工具:讨论了各种增强 AI 生成的工具和方法,提到了 ComfyUI 和 fp8 models 等实用工具,以改进任务管理。

- 参与者分享了个人经验,促进了社区学习,并探索新工具以优化其 AI 模型体验。

aider (Paul Gauthier) Discord

-

Aider v0.60.0 增强功能:Aider v0.60.0 的发布包括改进的代码编辑、对 Sonnet 10/22 的全面支持,以及增强用户交互和文件处理的错误修复。

- 值得注意的功能包括模型元数据管理,以及 Aider 在此版本中编写了 49% 的代码,展示了其生产力。

-

Claude 3.5 Sonnet 表现优于之前的模型:用户报告称 Claude 3.5 Sonnet 模型明显优于之前的 O1 models,能以更少的提示词完成复杂任务。

- 一位用户强调了它能有效地将 VAD library 集成到代码库中,表明其可用性有了飞跃。

-

DreamCut AI 彻底改变视频编辑:DreamCut AI 是使用 Claude AI 构建的,耗时 3 个月,编写了超过 50k 行代码,目前处于早期访问阶段,供用户测试其 AI 编辑工具。

- 正如社区成员所指出的,这一举措绕过了传统的设计阶段,表明了向 AI 驱动编码的转变。

-

Mistral API 身份验证问题:一位用户报告了 Aider 中 Mistral API 的 AuthenticationError,但通过重新创建身份验证密钥成功解决了该问题。

- 这一事件反映了目前 Mistral 集成设置中对 API 访问和身份验证稳定性的持续关注。

-

Repo Map 增强功能说明:关于 repo map 功能的讨论重申了其对相关代码上下文的依赖,这对于标记到标识符的准确代码修改至关重要。

- 根据 Paul 的澄清,模型根据标识符的定义和引用对其进行评估,从而形成有效的编辑路径。

OpenRouter (Alex Atallah) Discord

-

Claude 3.5 Sonnet 版本发布:旧版本的 Claude 3.5 Sonnet 现在可以下载并带有时间戳:Claude 3.5 Sonnet 和 Claude 3.5 Sonnet: Beta。

- 这些版本由 OpenRouter 提供,为用户提供了对先前迭代版本的增强访问。

-

Lumimaid v0.2 增强功能:新推出的 Lumimaid v0.2 是 Llama 3.1 70B 的微调版本,与 Lumimaid v0.1 相比提供了显著增强的数据集,可在此处获取:llama-3.1-lumimaid-70b。

- 由于数据集细节的更新,用户可以期待性能的提升。

-

Magnum v4 展示独特功能:Magnum v4 已发布,其散文质量复制能力类似于 Sonnet 和 Opus,可在此处访问:magnum-v4-72b。

- 该模型延续了提升 AI 生成文本输出质量的趋势。

-

OpenRouter 上的 API Key 成本差异:用户强调了在使用 OpenRouter 与直接使用供应商 Key 时的 API 成本差异,部分用户面临意外费用。

- 用户了解不同模型如何影响其在 OpenRouter 下的总成本至关重要。

-

自定义供应商 Key 的 Beta 测试访问:自定义供应商 Key 正处于 Beta 测试阶段,访问请求通过特定的 Discord 频道管理;不支持自行注册。

- 成员可以私信(DM)他们的 OpenRouter 电子邮件地址以获取访问权限,这反映了对这些集成的浓厚兴趣。

LM Studio Discord

-

在 LM Studio 中下载模型:用户在 LM Studio 中查找和下载大型模型(特别是 Nvidia 的 70B Nemotron)时面临挑战,需要新的终端命令技巧。

- 搜索功能的更改迫使用户使用特定的键盘快捷键,使模型获取过程变得复杂。

-

LLM 在编程任务中表现不足:由于 Mistral 和 Llama 3.2 等模型在准确的代码输出方面表现吃力,而 GPT-3.5 和 GPT-4 的表现持续显著优于它们,用户感到沮丧。

- 由于对性能不足的共识,用户开始探索替代工具来辅助编程任务。

-

探索模型量化选项:讨论强调了对量化方法(Q2, Q4, Q8)的多样化偏好及其对模型性能的影响,特别是关于最佳位压缩(bit compression)方面。

- 虽然建议谨慎使用 Q2,但一些用户指出较大的模型在较低位量化下表现更好。

-

Ryzen AI 的 NPU 支持受到关注:关于配置 LM Studio 以利用 Ryzen 处理器的 NPU 的咨询出现,揭示了在实现和功能方面持续存在的挑战。

- 澄清显示,llama.cpp 仅支持 Ascend NPU,这使得 Ryzen 的 NPU 功能仍不明朗。

-

AMD vs. Nvidia:GPU 大对决:在对比 RX 7900 XTX 和 RTX 3090 时,用户强调了 CUDA 支持 对于最佳 LLM 性能的重要性,更倾向于 Nvidia 显卡。

- 关于跨品牌多 GPU(multi-GPU)设置的效果报告褒贬不一,特别是关于最近更新的 ROCm 6.1.3 的支持情况。

Perplexity AI Discord

-

用户对新版 Sonnet 3.5 表示不满:多位用户对 Sonnet 3.5 模型表示不满,指出其内容输出量有所减少,特别是在学术写作任务中。

- 用户对移除旧版模型表示担忧,认为旧模型在多种使用场景下表现更优。

-

Web Search 集成问题依然存在:据报告,当启用 Web Search 时,Spaces 中的 preprompt 会失效,这给用户带来了困扰。

- 用户指出该问题一直未得到解决,团队已承认需要进行修复。

-

账户积分仍未转移:一名用户报告称,尽管多次向支持部门咨询,其 account credits 仍未完成转移。

- 支持部门在过去三天内未作回应,导致用户挫败感加剧。

-

探索先进的 AI 驱动事实核查:一份关于 AI 驱动事实核查 的合集讨论了来源可靠性评估等技术。

- 该合集强调了透明度和人工监督对于有效打击虚假信息的必要性。

-

Claude Computer Use 模型引发 RPA 警报:一篇关于 Claude 的电脑控制能力 的帖子暗示了其对机器人流程自动化 (RPA) 可能带来的风险。

- 专家警告称,这一创新可能会对现有的工作流挑战带来重大挑战。

GPU MODE Discord

-

LLM 激活量化辩论:一场关于对输入变化敏感的 LLM 激活值 (activations) 应该进行激进量化还是保持高精度的讨论展开了。

- 这引发了对模型性能的担忧,以及量化中精度权衡的问题。

-

bf16 的精度担忧:有观点担心 bf16 在多次梯度累积(gradient accumulations)过程中,可能会因为精度问题导致更新取消 (canceled updates)。

- 精度至关重要,尤其是当它影响到模型训练的稳定性时。

-

Anyscale 的单 Kernel 推理:分享了关于 Anyscale 正在开发一种使用单个 CUDA kernel 的推理引擎的更新,并征求对其效率的看法。

- 人们对于可能超越传统推理方法感到兴奋。

-

CUDABench 提案:博士生们提交了一份关于 CUDABench 的提案,这是一个评估 LLM 的 CUDA 代码生成能力的基准测试,并鼓励社区贡献。

- 该项目旨在建立跨多种 DSL 的兼容性,同时专注于 torch inline CUDA kernels。

-

Monkey Patching CrossEntropy 的挑战:在 transformers 中对 CrossEntropyLoss 进行 monkey patching 策略时出现了新挑战,特别是在最新的 GA 补丁版本中。

- 原始的 CrossEntropy 函数可以在此处查看。

Nous Research AI Discord

-

Hermes 70B API 在 Hyperbolic 上线:Hermes 70B API 现已在 Hyperbolic 上可用,为开发者和企业提供了获取大语言模型的更广渠道。欲了解更多详情,请查看此处的公告。

- 此次发布标志着在让每个人都能使用强大的 AI 工具方面迈出了重要一步。

-

Nous Research 的 Forge 项目引发热潮:成员们对 “Forge” 项目表现出极大的热情,该项目在一段由 Nous Research 联合创始人 Karan 参与的 YouTube 视频中被重点介绍。随后展开了关于该项目相关知识图谱实现的讨论。

- 社区成员对 Forge 在利用先进数据集方面的能力寄予厚望。

-

ZK 技术革新证明生成:来自 OpenBlock 的通用数据协议(UDP)的最新应用使 ChatGPT 用户能够拥有自己的聊天记录,同时增强了开源模型可验证训练数据的可用性。这种方法在改进 AI 训练中的数据来源和互操作性方面迈出了重要一步。

- 一位成员澄清说,ZK proofs 在服务器端需要几秒钟,由于 @zkemail 基础设施的进步,一些 UDP 证明现在只需不到一秒;请点击此处查看。

-

Claude 迎来自动化改进:Claude 增加了一个系统提示词(system prompt),用于修正“误导性注意力”(misguided attention)问题,增强了其上下文理解能力。Claude 还努力澄清谜题约束,但有时会因疏忽而误解问题。

- 用户注意到 Claude 的自我反思能力有所增强,在处理逻辑谜题时,其回答变得更加精炼。

-

AI 角色扮演动态探索:探索了 AI 角色扮演的动态,特别是系统提示词(system prompts)如何影响 AI 模型在各种场景下的响应。成员们讨论了如果按照某些方式进行指令引导,模型可能会表现出混乱行为的可能性,这挑战了固有审查制度的观点。

- 这一持续的对话突显了提示词工程(prompt engineering)与 AI 行为之间错综复杂的关系。

Eleuther Discord

-

棋手解释走法:大多数顶级棋手能够阐述引擎(engine)走法背后的动机,但他们在复杂局面下对线路进行排名的能力仍存疑问。

- 关于人类与引擎心目中理想走法的定义,这一持续的探究让社区保持着关注。

-

象棋作弊指控引发争议:一位前世界冠军根据一位热门主播在直播解说中的走法解释,指控其作弊。

- 这一事件凸显了评论员面临的压力,并引发了关于走法有效性的新辩论。

-

LLM 自我解释的准确性:针对 LLM 在缺乏上下文理解时自我解释的准确性,人们表达了担忧。

- 社区正在探索改进训练数据如何能增强这些解释。

-

Molmo 视觉模型即将问世:Molmo 项目计划发布在 PixMo 数据集上训练的开源视觉语言模型,并提供多个 checkpoint。

- 这些模型旨在多模态(multimodal)领域达到 state-of-the-art 性能,同时保持完全开源。

-

通过研究学习 DINOv2:一位成员请求获取理解 DINOv2 的资源,随后其他成员分享了一篇详述其方法论的相关研究论文。

- 该论文提供了由顶尖专家推进的 DINOv2 基础方面的见解。

Latent Space Discord

-

Anthropic Mouse Generator 展示:一位同事展示了 Anthropic Mouse Generator,它能令人印象深刻地自主安装和调试软件,但仍需要特定指令才能运行。

- 批评者指出,如果没有指导,它无法执行下棋等任务,凸显了当前 AI Agent 的局限性。

-

Ideogram Canvas 威胁 Canva:关于 Ideogram Canvas 的讨论揭示了其创新功能,如 Magic Fill 和 Extend,这些功能可以轻松编辑和组合图像。

- 参与者表示,由于其卓越的能力,它可能与 Canva 等现有工具竞争,引发了竞争担忧。

-

讨论 AI 对孤独感的影响:一起涉及 14 岁少年自杀的悲剧事件引发了关于 AI 对孤独感影响的对话,引发了对心理健康和技术角色的担忧。

- 参与者辩论了 AI 是能连接人们还是加剧了孤立,并就其有效性分享了不同观点。

-

vLLM 中的 Speculative Decoding 提升速度:最近的一篇博客文章详细介绍了 vLLM 中 speculative decoding 的增强功能,旨在通过大小模型加速 Token 生成。

- 这项技术寻求提高性能并集成优化 AI 功能的新方法,如这篇博客所述。

-

介绍新的会议自动化工具:agent.exe 的发布允许用户通过 Claude 3.5 Sonnet 控制计算机,标志着会议自动化工具的重大进步。

- 预计 2025 年自动化和效率将进一步提高,GitHub 上的 agent.exe 已经引起了关注。

LlamaIndex Discord

-

加入 Llama Impact Hackathon 寻找 AI 解决方案:参加 11 月 8 日至 10 日在旧金山举行的为期 3 天的 Llama Impact Hackathon,奖金池为 $15,000,其中包括为最佳使用 LlamaIndex 提供的 $1000 特别奖。

- 该活动提供线下和线上选项,用于使用 Meta 的 Llama 3.2 模型构建 AI 解决方案。

-

Box AI 与 LlamaIndex 无缝协作:利用 Box AI 无需下载即可查询文档,并从非结构化内容中提取结构化数据,同时将其与 LlamaIndex Agent 集成,详见这篇文章。

- 这种集成增强了工作流,使用户处理文档更加轻松。

-

构建高级客户服务机器人:最近的一次更新允许创建一个 multi-agent concierge system(多 Agent 礼宾系统),该系统结合了工具调用、记忆和人工协作,适用于客户服务应用。

- 这次大修帮助开发者更有效地迭代客户服务机器人,正如 Logan Markewich 所分享的。

-

工作流中的持久化 Context:关于允许 Context 在工作流的多次运行中持久化的讨论,并提供了使用 JsonSerializer 进行序列化的示例。

- 这种方法允许用户稍后恢复其工作流而不会丢失 Context,解决了常见的痛点。

-

迁移到 Anthropic LLM:用户在用 Anthropic LLM 替换 ChatGPT 时面临挑战,特别是关于 OpenAI API key 的提示。

- 建议包括必须使用本地 Embedding 模型,以消除对 OpenAI 服务的依赖。

tinygrad (George Hotz) Discord

-

关于 Tensor int64/uint64 支持的澄清:讨论明确了 Tensors 现在支持 int64/uint64,这一点通过检查

dtype.py得到了确认。- 这一澄清是在讨论实现 SHA3 时提出的,突显了 tinygrad 不断演进的能力。

-

Action Chunking Transformers 训练耗时过长:在没有 JIT 的情况下,训练拥有 5500 万 参数的 Action Chunking Transformers 需要 两天 时间,这引发了关于性能增强的疑问。

- 成员们对缓慢的推理时间以及 JIT 训练期间反复出现的 loss parameter 问题表示沮丧。

-

TinyJIT Loss Parameter 打印困惑:用户在 JIT 函数中打印 loss 时遇到困难,争论了

.item()的使用及其对准确显示数值的影响。- 建议避免返回非 Tensor 类型,以防止对 JIT 执行产生不良影响。

-

通过 BEAM 设置缩短训练时间:一个建议是使用

BEAM=2运行,以在漫长的训练过程中潜在地增强性能并加快 kernel 运行速度。- 反馈表明,这种方法在训练实践中已经取得了更快的结果。

-

对 AI accelerator 字节码逆向工程的兴趣:一位用户寻求关于从 AI accelerator 逆向工程字节码的方法建议,引发了社区的广泛关注。

- 成员们讨论了可以辅助启动逆向工程过程的工具和框架。

Interconnects (Nathan Lambert) Discord

-

Claude AI 的乐趣:一位成员报告说使用 Claude AI 是一次有趣的体验,并暗示很快会分享更多示例。

- 这表明关于其功能和能力的更多细节可能很快就会发布。

-

深入探讨持续预训练 (Continuous Pretraining):有疑问提出,GPT-4o 是从头开始使用 200k 词表 tokenizer 进行预训练的,还是在从 100k tokenizer 切换后继续训练的。

- 有人对训练中期 (mid-training) 的混乱性质表示担忧,指出跟踪此类转换存在挑战。

-

Character.AI 表达哀悼:Character.AI 就一起不幸的用户事件表达了哀悼,并强调了此处提供的新安全功能。

- 一位成员分享了一篇《纽约时报》的文章,进一步说明了情况的背景。

-

Anthropic 向 B2B 转型:Anthropic 正在演变为一家 B2B 公司,这与 OpenAI 对消费者应用的关注形成对比,特别是在有趣任务与平淡任务的权衡方面。

- 讨论强调了消费者更倾向于有趣的活动,而不是自动化可能处理的无聊任务(如购物)。

-

Microsoft 引人入胜的 AI 演示:Microsoft 对 AI 的趣味应用(如 Minecraft 中的游戏自动化)与 Anthropic 对日常任务的关注形成鲜明对比,点击此处查看。

- 这突显了 AI 领域截然不同的策略,反映了不同的目标受众和目标。

OpenInterpreter Discord

-

Screenpipe 引起关注:成员们称赞了 Screenpipe 在管理构建日志方面的实用性,展示了它对于寻求高效日志解决方案的开发者的潜力。

- 一位用户强调了在开发工作流中拥有清晰且有条理的构建日志所带来的重大影响。

-

Claude 3.5 模型演进:Anthropic 推出了 Claude 3.5 Sonnet 模型,该模型具有显著的代码增强功能和全新的 computer use 能力(目前处于公开测试阶段),允许 AI 更自然地与用户界面进行交互。

- 然而,由于需要持续截屏,引发了对该模型效率和运营成本的担忧;更多详情请点击此处。

-

对 Open Interpreter 路线图的质疑:成员们讨论了 Open Interpreter 的路线图,断言其独特的能力使其区别于主流 AI 产品。

- 一些怀疑者对与成熟模型的竞争表示担忧,而另一些人则强调了社区驱动开发的重要性。

-

应对 AI 屏幕交互挑战:针对使用截图作为 AI 输入的低效性出现了担忧,这促使人们建议直接从应用程序中提取必要的数据点。

- 成员们认识到需要增强数据处理方法,以规避目前对截图依赖的局限性。

-

呼吁测试新的 Anthropic 集成:一位成员介绍了用于集成 Anthropic 模型的

interpreter --os命令,敦促其他人在正式发布前协助测试该功能。- 测试表明,增加屏幕尺寸和文本清晰度有助于降低模型使用过程中的错误率。

Cohere Discord

-

Cohere API 试用提供免费访问:Cohere 提供 试用 API key,允许在试用期间免费访问所有模型,频率限制为 每分钟 20 次调用,使用生产 key 后可提升至 每分钟 500 次调用。

- 这种设置允许工程师在投入生产环境之前探索各种模型。

-

新兴的多模态 Command 模型:讨论引发了对 多模态 Command 模型 的兴趣,建议增加一个集成不同交互模式的 Global connection 功能。

- 这反映了人们对先进模型能力及其潜在应用的新奇好奇心。

-

11 月 23 日的 Agentic Builder Day:OpenSesame 将于 11 月 23 日举办 Agentic Builder Day,邀请开发者使用 Cohere Models 参加小型 AI Agent 黑客松,申请现已开放。

- 该活动旨在促进对 AI Agent 感兴趣的开发者之间的合作与竞争。

-

Ollama Mistral 性能担忧:成员们表达了对 Ollama Mistral 的问题,注意到性能波动和幻觉倾向,这使他们的项目变得复杂。

- 一位用户链接到了他们的 GitHub gist,详细介绍了尽管面临这些挑战,他们仍能有效生成 prompt 的方法。

-

Tool Calls 与 Cohere V2 API 错误:用户报告了 Cohere V2 API 中 tool calls 的 内部服务器错误,特别是强调了缺失的 tool_plan field 导致了一些问题。

- 引用了 Cohere 文档 以澄清正确的工具集成方式。

Modular (Mojo 🔥) Discord

-

对 stdlib 讨论的热情:一位成员在补完上一次社区讨论后,表达了加入 stdlib contributor meetings 的兴奋之情。

- 这种热情得到了他人的积极回应,鼓励大家参与对话。

-

Mojo 中的串口通信困扰:一位用户寻求在 Mojo 中通过端口实现 serial communication 的指导;目前的支持仅限于 libc 中可用的功能。

- 这表明有必要进一步增强 Mojo 的通信能力。

-

关于 Mojo 中 C/C++ 支持的辩论:讨论了 Mojo 中 C/C++ support 的存在及其潜在益处。

- 然而,关于这种支持对用户的实际应用价值,意见不一。

-

MAX Engine 发布 C API 公告:C API 现已可用于 MAX Engine,尽管目前没有集成 graph API 的即时计划。

- 官方保证,如果情况有变,将沟通关于 graph API 的更新。

-

使用 C 探索 Graph API:一位成员指出可以使用 C 构建 graph builder API,建议在 Mojo 之外尝试其他方法。

- 这为跨编程语言的潜在协作开启了讨论。

Torchtune Discord

-

TorchTune 配置在 .yaml 文件上出现失误:一位成员指出,在 TorchTune 运行命令中使用 .yaml 文件扩展名会因暗示本地配置而引起混淆。

- 他们指出,如果没有足够的错误信息,调试过程会令人沮丧。

-

多 GPU 测试引发疑问:一位用户询问了在 2 GPUs 上的测试能力,反映了一个普遍关注的问题。

- 另一位用户提到了在 1 GPU 和 2 GPUs 上运行 lora_finetune_distributed 脚本时出现的错误信息问题。

-

确认使用 TorchTune 进行微调:针对 custom Llama 模型微调的查询,回复确认 TorchTune 为自定义提供了灵活性。

- 鼓励成员进一步参与关于自定义组件的讨论,以获得更好的支持。

-

Linters 和 pre-commit hooks 存在 Bug:成员报告了 linters and pre-commit hooks 的问题,指出它们未按预期工作。

- 要跳过某行,需要同时使用

# noqa和# fmt: on ... #fmt: off,这被认为异常复杂。

- 要跳过某行,需要同时使用

-

PR #1868 中的 CI 混乱:一位成员揭示了 PR #1868 中 CI 的异常行为,并寻求协助解决持续存在的问题。

- 关于 CI 问题解决情况的询问表明,值得庆幸的是,该问题现在应该已经 fixed。

LangChain AI Discord

-

帮助塑造开发者工具:一位成员分享了一个调查链接,旨在收集开发者对将创意转化为成果所面临挑战的见解,完成大约需要 5-7 分钟。

- 该调查探讨了开发者产生创意的频率、面临的障碍,以及对简化项目实现的解决方案的兴趣。

-

针对开发者的 AI 影响研究:一项评估 AI 工具对软件工程影响的硕士研究正在征集开发者参与,参与者填写此处的简短问卷,有机会赢取 $200NZD 礼品卡。

- 该研究旨在收集关于 AI 集成到工程工作流中的宝贵数据,同时为参与者提供奖励。

-

使用 AI 工具解锁资金:一个 AI 驱动的平台上线,通过匹配相关投资者帮助用户寻找资金,为前 200 名候补名单注册者提供 free Startup Accelerator pack,目前仅剩 62 个名额。

- 感兴趣的人士请立即注册,通过增强的搜索功能加速实现创业梦想。

-

构建 AI GeoGuessr 玩家:一个新的 YouTube 教程展示了如何编写一个 AI 机器人,利用 Multimodal Vision LLMs(如 GPT-4o, Claude 3.5, 和 Gemini 1.5)自主玩 GeoGuessr。

- 该教程涉及 Python programming 并使用 LangChain,使机器人能够有效地与游戏环境交互。

-

询问马尼拉开发者:一位成员询问是否有人位于 Manila,暗示希望促进当地开发者之间的联系。

- 这一询问可能会为马尼拉科技圈的社区建设或潜在协作创造机会。

DSPy Discord

-

正在开发中的全球最先进工作流系统:一位成员宣布了开发全球最先进工作流系统的计划,并预定于周一进行现场演示,以展示其运行机制和升级流程。

- 该环节旨在深入探讨系统功能,重点讨论计划中的增强功能和即将推出的特性。

-

DSPy 设定宏大的融资目标:继 CrewAI 成功获得 1800 万美元融资后,一位成员提议 DSPy 的目标应至少为 5000 万美元,并表示渴望作为第 5 号或第 10 号员工早期加入。

- “我们还在等什么?”这一发言活跃了讨论氛围,强调了立即开展融资工作的行动号召。

- 有效合成数据生成的指标:一位成员探讨了使用 DSPy 根据文本输入为 QA 用途生成合成数据的潜力,并提出了关于适用指标的问题。

- 回复建议利用 LLM as a judge(LLM 作为评判者),并建立一套标准,用于在没有 Ground Truth(基准真相)的情况下评估开放式生成内容。

-

Groundedness(扎实度)作为合成数据的指标:在合成数据的讨论中,一位成员建议 Ground Truth 应源自生成时使用的文本,并指出 Groundedness 是一个关键指标。

- 他们对分享的协作见解表示感谢,凸显了成员们在该话题上的参与精神。

LLM Agents (Berkeley MOOC) Discord

-

LLM Agents MOOC 报名困惑:多位成员反映在提交 LLM Agents MOOC 报名表 后未收到确认邮件,导致对申请状态感到不确定。

- 这种反馈的缺失引起了预期收到正式录取通知的用户对报名流程的担忧。

-

Hackathon 项目代码必须开源:在 Hackathon 期间,成员们确认了必须将其项目代码 100% 开源的要求,这是参加最终演示的规定条件。

- 这种对代码透明度的强调符合 Hackathon 促进参与者之间协作开发的初衷。

-

对 Agent 创建教程的需求:一位参与者询问了关于在不依赖外部平台的情况下从零开始创建 Agent 的教程,强调了对易获取教育资源的需求。

- 这种兴趣凸显了社区对在 Agent 开发工作流中实现自给自足的渴望。

LLM Finetuning (Hamel + Dan) Discord

-

利用 Axolotl Discord 获取配置:利用 🦎 Axolotl Discord 频道分享和查找针对你的用例定制的配置,GitHub 上还附带示例文件夹。查看 Discussions 标签页 以获取见解和分享的用例。

- 利用社区成果来优化你的配置,并调整现有设置以更好地适配你的项目。

-

通过 LangSmith 最大化 Prompt 效能:探索 🛠️ LangSmith Prompt Hub,它提供了针对各种模型和用例的大量 Prompt 集合,提升你的 Prompt Engineering 技能。访问 Amazing Public Datasets 仓库 获取高质量数据集。

- 分享你自己的 Prompt 并发现新想法,以促进协作并提升模型性能。

-

数据竞赛的 Kaggle 解决方案:查看《最全面的 Kaggle 解决方案和创意列表》,获取关于竞赛数据科学的丰富见解。在 GitHub 此处 访问完整集合。

- 该资源是希望增强其方法论和策略的数据工程师的宝库。

-

Hugging Face 的模型对齐方案:在 Hugging Face 上寻找强大的方案(Recipes),使语言模型与人类及 AI 偏好对齐,这对于持续的 Fine-tuning 至关重要。在 此处 发现这些宝贵资源。

- 借鉴社区最佳实践的见解,有效地对齐你的模型。

-

介绍用于便捷消息抓取的新 Discord 机器人:一个新创建的 Discord 机器人旨在简化频道消息的抓取工作,目前需要协助邀请成员加入该机器人。感兴趣的用户可以通过此 链接 邀请该机器人。

- 参与其中以增强你的 Discord 体验,并可能实现有价值讨论内容的自动化收集。

OpenAccess AI Collective (axolotl) Discord

-

2.5.0 为 gfx1100 引入实验性 Triton FA 支持:在 2.5.0 版本中,用户可以通过设置环境变量

TORCH_ROCM_AOTRITON_ENABLE_EXPERIMENTAL=1为 gfx1100 启用 实验性 Triton Flash Attention (FA)。更多详情请参阅 此 GitHub issue。- 一个 UserWarning 指出 Navi31 GPU 上的 Flash Attention 支持仍处于实验阶段。

-

Mixtral 与 Llama 3.2:使用之争:鉴于 Llama 3.2 的进步,关于使用 Mixtral 的可行性引发了讨论。社区成员正在审视这两个模型的优缺点,以确定哪个应该优先使用。

- 这一询问凸显了模型选择中不断演进的格局,反映了性能指标和对特定任务的适用性。

Gorilla LLM (Berkeley Function Calling) Discord

-

模型评估中的空评分报告:一位用户报告称,在

handler_map.py中注册新的模型处理器后,执行bfcl evaluate --model mynewmodel --test-category ast导致评分报告结果为 0/0 的空报告。- 另一位成员建议确保在评估之前运行了

bfcl generate ...命令,强调了获取准确评分结果的依赖关系。

- 另一位成员建议确保在评估之前运行了

-

评估前生成模型的重要性:讨论强调了在模型评估之前运行

bfcl generate命令,以避免测试期间出现空报告。- 这表明缺少模型生成步骤可能会直接影响评估结果的有效性。

PART 2: Detailed by-Channel summaries and links

完整的频道明细已为邮件格式截断。

如果您喜欢 AInews,请分享给朋友!预先感谢!