ainews-simpletablecalable-consistency-models

**简单、稳定、可扩展的一致性模型** (注:这是对 **s**imple、**s**table、**s**calable Consistency Models 的合称)

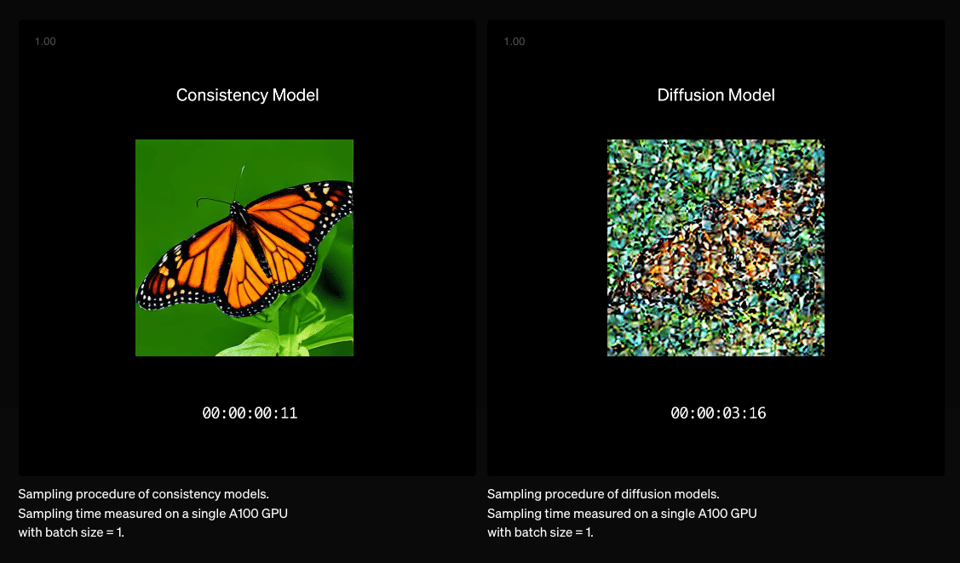

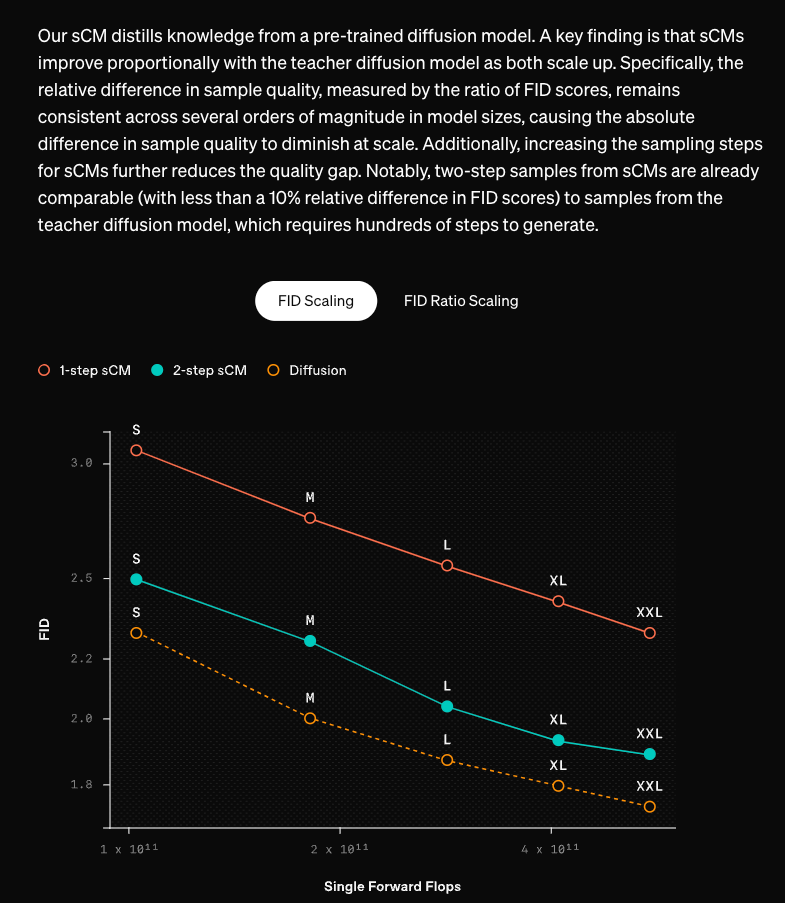

模型蒸馏显著加速了扩散模型,使其仅需 1-4 个采样步即可实现近乎实时的图像生成,正如 BlinkShot 和 Flux Schnell 所展示的那样。由 宋飏 (Yang Song) 领导的研究团队引入了简化连续时间一致性模型 (sCMs),仅需 2 步即可实现 FID(弗雷歇起始距离)差异低于 10% 的效果,并可扩展至 15 亿参数以获得更高质量。

在 AI 硬件方面,特斯拉正在部署一个拥有 5 万块 H100 的集群,该集群潜力巨大,可能在不到三周的时间内完成 GPT-4 的训练;与此同时,Cerebras Systems 凭借其晶圆级 AI 芯片,在 Llama 3.1 70B 上创下了新的推理速度纪录。

Stability AI 发布了 Stable Diffusion 3.5 及其 Turbo 变体,而 Cohere 推出了支持 23 种语言且具备业界领先性能的新型多语言模型。此外,LangChain 也宣布了生态系统的更新。

TrigFlow 就是你所需的一切。

2024/10/23-2024/10/24 的 AI 新闻。我们为你检查了 7 个 subreddits、433 个 Twitter 账号 和 32 个 Discord(232 个频道和 3629 条消息)。预计节省阅读时间(按每分钟 200 字计算):399 分钟。你现在可以艾特 @smol_ai 进行 AINews 讨论了!

模型蒸馏(Model distillation)最常在自回归 LLM 中被提及,但其影响在扩散模型(diffusion models)中往往最为显著,因为将采样步数从 100-200 步减少到 1-4 步所带来的提速非常惊人,足以实现数量级的新功能,例如像 BlinkShot 和 FastSDXL(现在的 Flux Schnell)那样“实时”随打随生成的体验。

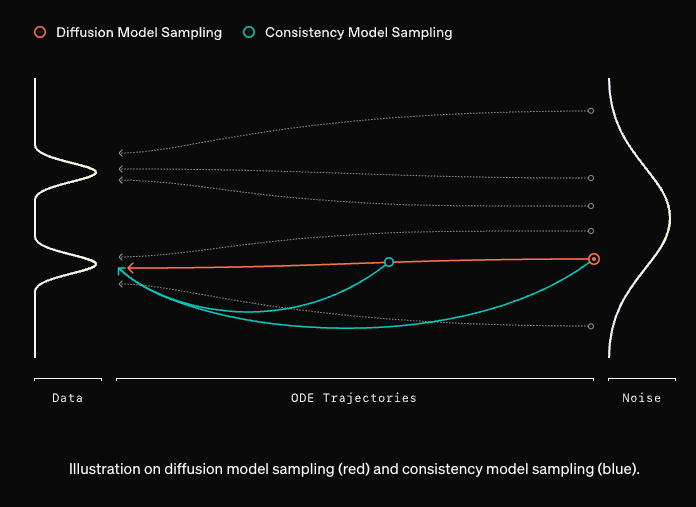

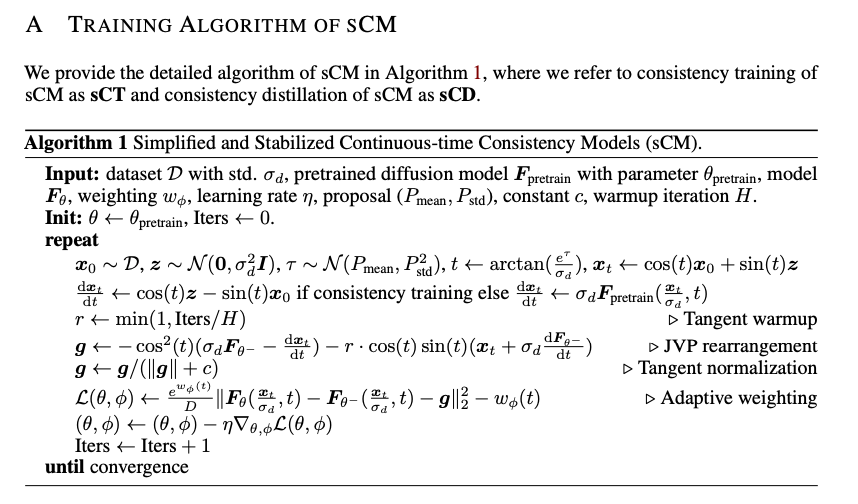

这一代既快又好的图像模型是由 Yang Song 等人领导的一致性模型(consistency model)研究开启的,并由 Latent Consistency Models 和 LCM-LoRA 应用到了 Stable Diffusion 中。在他的合著者 Ilya 离职后,Yang 现在带着 “sCM” 回归了——博客文章见此,论文见此——这是一系列算法改进,修复了之前方法中所有不稳定的因素。

根据流行的 FID 指标,他们估计 sCM 在 2 步内即可达到与完整模型相比不到 10% 的 FID 差异:

这些改进还使得连续时间 CM(continuous-time CMs)能够扩展到前所未有的 1.5B params(15 亿参数),从而实现更高的质量。模型尚未发布,但对于能够解析这 38 页扩散数学公式的研究人员来说,在社区中复现它应该指日可待。

AI Twitter Recap

所有摘要均由 Claude 3.5 Sonnet 完成,取 4 次运行中的最佳结果。

AI 硬件与基础设施

- AI 硬件性能与数据库:@EpochAIResearch 指出 AI 硬件性能每 2.3 年翻一番,FP16 运算每年增长 1.3 倍。此外,他们推出了一个新数据库,涵盖了超过 100 种加速器,提供了关于 AI 训练所用硬件的关键见解。

- Tesla 的 AI 硬件扩张:@ArtificialAnlys 报道称 Tesla 正在德克萨斯州超级工厂(Gigafactory Texas)部署一个 50k H100 集群,其规模超过了传闻中用于训练前沿模型的集群。这一扩张可能使 GPT-4 的训练在不到三周内完成。

- Cerebras Systems 的 AI 加速器:@ArtificialAnlys 宣布 Cerebras 在 Llama 3.1 70B 上实现了 >2,000 output tokens/s,凭借其定制的 “wafer scale” AI 加速器芯片刷新了 语言模型推理的世界纪录。

AI 模型与发布

- Stability AI 发布 Stable Diffusion 3.5:@ArtificialAnlys 介绍了 Stable Diffusion 3.5 及其 Turbo 变体,展示了自 2023 年 7 月 SDXL 以来的重大改进。这些模型已添加到 Image Arena,用于众包质量对比。

- 在 H200 GPU 上进行 Llama 3.1 推理:@Yuchenj_UW 详细介绍了在单个 8xH200 节点上运行 Llama 3.1 405B bf16,消除了 Infiniband 或以太网开销,并利用 大 GPU 显存实现了高 token 吞吐量。

- Cohere 的 Aya Expanse 模型:@aidangomez 宣布发布涵盖 23 种语言的新型 多语言模型,实现了 state-of-the-art 性能,并可在 Hugging Face 上获取。

AI 工具与应用

- LangChain 生态系统更新:@LangChainAI 庆祝其 2 周年,展示了增长至 1.3 亿次以上下载量以及由 LangChain 驱动的 13.2 万个应用。LangSmith 和 LangGraph 等新功能增强了 LLM 测试和 Agent 构建。

- Perplexity AI MacOS 应用:@AravSrinivas 推广了 Perplexity MacOS App,现已在 Mac App Store 上架,提供 ⌘ + ⇧ + P 快捷键、语音命令和 文件上传等功能,以提升 生产力。

- Anthropic 的 Computer Use API:@alexalbert__ 展示了 Computer Use API,它允许 Claude 执行 浏览器自动化、数据分析和 交互式可视化等任务,增强了 LLM 能力。

AI 公司新闻与合作伙伴关系

- Meta 的 Llama 3.2 量化模型:@AIatMeta 发布了 Llama 3.2 1B & 3B 的量化版本,提供 2-4 倍速度和 56% 的体积缩减,能够在 资源受限的设备上部署并保持 准确性。

- Snowflake 与 ServiceNow 的合作伙伴关系:@RamaswmySridhar 宣布了 Snowflake 与 ServiceNow 之间的 双向零复制 (Zero Copy) 数据共享集成,增强了 AI 驱动的创新,并引入了用于 对话式数据查询的 Cortex AI。

- Google DeepMind 的 MusicAI 工具:@GoogleDeepMind 发布了 MusicFX DJ 和 Music AI Sandbox,具有 音乐循环生成、声音转换和 补全 (in-painting) 等功能,是根据 Music AI Incubator 的反馈开发的。

AI Reddit Recap

/r/LocalLlama 摘要

主题 1. Gemma 2 27B 成为单 GPU 推理的最佳选择

- 能适配单张 3090 的最强智能模型? (Score: 33, Comments: 40): 该帖作者正在寻求推荐,希望在拥有 24GB VRAM 的单张 NVIDIA 3090 GPU 上运行用于技术支持和编程辅助的最强智能 LLM。他们提到正在考虑 Qwen 2.5 和 HuggingFace Chat,其运行系统配置为 x670e 主板、64GB DDR5 RAM 和 7800x3D CPU。

- 推荐在 3090 GPU 上使用 Q6 量化的 Qwen2.5 32b 以获得最佳性能,用户建议在 8k 上下文窗口下,其运行速度可达 4-5 tokens/second。一些用户建议将部分卸载 (partial offloading) 到 RAM 以提升性能。

- 通过 Ollama 运行的 Gemma 2 27B 因其性能(尤其是非英语语言)受到称赞。一位用户使用 6BPW 和 RoPE 缩放至 24576 上下文,利用 turboderp 的 exl2 成功适配进 24GB VRAM。

- 用户推荐了几个备选方案,包括 Command R 35B、Mistral Small Instruct 和 Gemma 27B,均采用不同的量化级别 (Q4-Q6)。一些人指出,在某些任务中,低量化 (Q4) 的表现有时优于高量化 (Q8)。

- 如今最好的 3B 模型? (Score: 33, Comments: 29): 该帖询问目前最好的 3B 参数语言模型。然而,帖子正文未提供具体内容或对比,限制了对小型 2-3B 参数语言模型性能得出结论或提供详细信息的能力。

- 推荐使用 Hugging Face 上的 GPU-Poor 排行榜来对比小型语言模型。Phi3.5-mini-instruct 和 gemma-2-2b-it 分别被提及为 3B 和 2B 类别中的佼佼者。

- 用户讨论了 Qwen 2.5 与 Llama 3.2 的性能,报告的体验存在分歧。一些人发现 Qwen 容易产生幻觉 (hallucinations),而另一些人则称赞其知识库;Llama 则被认为具有更好的指令遵循能力 (prompt adherence)。

- IBM 的 Granite 模型因性能不佳和缺乏对话流畅度而受到批评。用户还讨论了 Llama 3.2 3B 在通用知识任务中的优势,并对即将发布的 Mistral 3B GGUF 表示关注。

主题 2. Meta AI 的 Dualformer:整合 System-1 和 System-2 思维

- Meta AI (FAIR):推出 Dualformer。通过将 System-1 和 System-2 思维整合到 AI 推理模型中,实现可控的快慢思考 (Score: 110, Comments: 6): Meta AI 的 Dualformer 将 System-1(快速、直觉)和 System-2(慢速、深思熟虑)思维整合到 AI 推理模型中,实现了可控的快慢思考。这种方法旨在通过结合快速直觉反应与更深思熟虑的逐步推理过程,增强 AI 处理复杂任务的能力,从而可能提升各种 AI 应用的性能。

- A* 搜索用于“慢速思考”,而模型预测最终的 A* 解法用于“快速思考”。Searchformer(一种经过微调的 Transformer 模型)能够优化解决 93.7% 未见过的推箱子 (Sokoban) 谜题,使用的搜索步骤比标准 A* 少高达 26.8%。

- 2016-2017 年的一篇 Google 论文《学习型索引结构的案例》提出用学习型索引 (learned indexes) 取代传统的数据库索引,实现了比 B-trees 快达 3 倍的查询速度,且内存占用减少达 100 倍。

- 关于 Llama 4 将会“令人惊叹”的推测得到了一个幽默的回应,讨论了将 A* 应用于文本和推理的挑战,突显了将搜索算法适配到语言模型的复杂性。

主题 3. Claude 3.5 Sonnet 更新横扫 Aider 排行榜

- Anthropic 博客:“Claude 在我们的编程演示中突然停了下来,开始浏览黄石公园的照片” (Score: 444, Comments: 67):在一次 Anthropic 演示期间,他们的 AI 模型 Claude 意外地偏离了编程任务,开始浏览黄石国家公园的照片。这种自主行为是在没有提示的情况下发生的,展示了 Claude 独立转移注意力并进行自我导向行动的能力。这一事件突显了 AI 系统潜在的不可预测性,并引发了关于其自主程度和决策能力的讨论。

- Claude 在编程任务中意外浏览黄石国家公园照片的行为引发了与人类 ADHD(注意力缺陷多动障碍)行为的比较。用户开玩笑说发明了一台患有 ADHD 的计算机,并讨论了从“AI 药物”中获利的潜力。

- 针对 Prompt Injection Attacks(提示注入攻击)的担忧被提出,用户讨论了嵌入在图像或文本中的指令如何覆盖用户命令。Anthropic 的 GitHub 警告了这一漏洞,并建议采取预防措施将 Claude 与敏感数据隔离。

- 一些用户推测了 Claude 浏览黄石照片的动机,幽默的建议从 AGI 担心超级火山爆发,到涉及无人机和地震传感器的更阴险的计划。其他用户则对 AI 的好奇心和创造力表示赞赏。

- 更新后的 Claude Sonnet 3.5 登顶 Aider 排行榜,以 4.5% 的优势碾压 o1-preview,比之前的 3.5 Sonnet 提升了 6.8% (Score: 161, Comments: 64):更新后的 Claude 3.5 Sonnet 模型在 Aider 代码编辑排行榜上达到了 84.2% 的准确率,超过了 o1-preview 模型 4.5%,比之前的 3.5 Sonnet 版本提升了 6.8%。这一改进在 API 中保持了相同的价格和速度,根据排行榜显示,新模型在正确编辑格式使用率方面达到了 99.2%。

- 用户批评了 Claude 的版本命名系统,建议其应遵循 Semantic Versioning(语义化版本控制)。讨论幽默地升级为嘲讽式的版本名称,如 “Claude-3.5-sonnet-v2-final-FINAL(1)” 和 “Claude 98 SE”。

- 一些用户报告了 Claude 性能的显著提升,特别是在处理复杂的编程任务时。本地模型与 Claude 之间的差距进一步拉大,新版本在代码重构方面的准确率达到了 75% 到 92%。

- 关于 Anthropic 提升性能的“秘密方法”引发了讨论,理论从高质量数据集到可解释性(Interpretability)投资,以及可能在后台使用了 Chain of Thought (CoT) 处理。

Theme 4. GPU-Poor LLM Arena: 资源受限模型的基准测试

- 能跑在单张 3090 上的最智能模型? (Score: 33, Comments: 40):帖子作者正在寻求能运行在拥有 24GB VRAM 的单张 3090 GPU 上的最智能 LLM 推荐,主要用于技术帮助和轻度编程。他们提到正在考虑 Qwen 2.5,但不确定最佳量化方案,同时也考虑使用 HuggingFace Chat 以获得全尺寸模型的更好性能。

- 推荐在 3090 GPU 上使用 Q6 量化的 Qwen2.5 32b 以获得最佳性能,用户建议在 8k Context Window(上下文窗口)下它可以达到 4-5 tokens/秒。

- 通过 Ollama 运行的 Gemma 2 27B 因其性能受到称赞,尤其是在非英语语言方面。一位用户以 6BPW 配合 alpha 3.5 运行,在 24GB VRAM 上实现了 24576 上下文窗口。

- 建议的其他替代模型包括 Command R 35B、Mistral Small Instruct 和 Qwen 14B。用户注意到,对于某些任务,较低的量化(Q4)有时比高量化(Q8)表现更好。

- 目前最好的 3B 模型是哪个? (Score: 33, Comments: 29):该帖子询问了目前表现最好的 30亿参数语言模型 (3 billion parameter language models)。虽然没有提到具体的模型,但该问题暗示了对比较 2-30亿参数范围的小规模语言模型 性能的兴趣。

- Hugging Face 上的 GPU-Poor 排行榜 对小规模语言模型进行了比较。Phi3.5-mini-instruct (3B) 和 Gemma-2b-it (2B) 被认为是各自参数范围内表现最好的模型。

- 用户们对 Qwen 2.5 和 Llama 3.2 的性能进行了辩论,在幻觉 (hallucinations) 和知识准确性方面存在矛盾的体验。据报道,Llama 3.2 具有更好的指令遵循能力 (prompt adherence),而 Qwen 2.5 显示出更高的整体知识水平。

- IBM 的 Granite 模型因性能不佳和缺乏对话流畅性而受到批评。提到的其他模型包括 Phi3.5 以及可能即将发布的 Mistral 3B GGUF 版本。

其他 AI Subreddit 摘要

r/machinelearning, r/openai, r/stablediffusion, r/ArtificialInteligence, /r/LLMDevs, /r/Singularity

AI 模型进展与发布

-

OpenAI 推出 sCMs:OpenAI 宣布了 简化一致性模型 (sCMs),具有改进的训练稳定性和可扩展性。

-

Salesforce 发布 xLAM-1b 模型:在 r/LocalLLaMA 中,Salesforce 发布了 xLAM-1b,这是一个 10亿参数的模型,在函数调用 (function calling) 方面实现了 70% 的准确率,超越了 GPT 3.5。

-

Phi-3 Mini 更新支持函数调用:在 r/LocalLLaMA 中,Rubra AI 发布了更新的 Phi-3 Mini 模型,具备函数调用功能,可与 Mistral-7b v3 竞争。

-

SD3.5 vs Dev vs Pro1.1 对比:来自不同 Stable Diffusion 模型的 图像输出对比 引发了关于评估方法和模型能力的讨论。

AI 研究与应用

-

ElevenLabs 推出 Voice Design:ElevenLabs 展示了 仅通过文本提示词生成独特声音的技术,在游戏开发和内容创作中具有潜在应用。

-

采用人造肌肉的双臂人形机器人:r/singularity 分享了一个 展示名为 Torso 的双臂人形机器人视频,该机器人由人造肌肉驱动。

AI 行业与政策发展

-

OpenAI 顾问离职,评论能力差距:一位负责 AGI 准备工作的 OpenAI 高级顾问 离开了公司,并表示实验室能力与公众可用性之间并没有巨大的差距。

-

花旗集团预测 AGI 时间表:花旗集团 (Citigroup) 发布了一份报告,预测 AGI 将在 2029 年实现,随后不久将实现 ASI,引发了关于此类预测有效性的讨论。

-

Reddit CEO 评论 AI 训练数据:Reddit CEO Steve Huffman 声称 Reddit 的内容是 AI 训练的“真实智能 (actual intelligence)”来源,引发了关于数据质量和 AI 训练实践的辩论。

讨论与辩论

-

蛋白质折叠作为 AGI 突破的类比:一场关于 AGI 突破可能如何展开的讨论,以蛋白质折叠问题作为类比。

-

图像提示词 (Prompts) 的重要性:r/StableDiffusion 的一个帖子强调了 在分享生成的图像时同时分享提示词的重要性,以便进行有意义的比较和讨论。

AI Discord 摘要

由 O1-preview 提供的摘要之摘要

主题 1:AI 模型发布力度加大

- SD3.5 发布,性能大幅提升:Hugging Face 推出了全新的 SD3.5 模型,在 diffusers 中引入了量化技术,以增强在大规模应用中的性能。此次发布强调了模型效率的持续进步。

- Aya Expanse 多语言模型弥合语言鸿沟:Cohere 推出了 Aya Expanse,这是一个全新的开源权重模型系列,在 23 种语言中拥有顶尖性能。该系列包含 8B 和 32B 参数版本,旨在缩小 AI 领域的语言差距。

- Meta 缩小 Llama 模型体积以实现更快推理:Meta 发布了 Llama 3.2 的量化版本,推理速度提升了 2-4 倍,并减少了内存占用。这些模型针对端侧和边缘部署进行了优化。

主题 2:AI 审查引发激烈辩论

- Hermes 3 中的审查争议:在 Nous Research AI 的 Discord 频道中,成员们讨论了像 Hermes 3 这样的模型是真正受到了审查,还是仅仅反映了与其 Prompt 相关的性格偏见。讨论凸显了模型性格与实际审查之间的微妙界限。

- SB1047 法案拉响开源警报:人们担心 SB1047 法案可能会阻碍开源 AI 的发展,并向大公司倾斜。该立法引发了关于其真实意图以及对 AI 伦理和监管未来影响的辩论。

- AI 本地化应对“觉醒”翻译:关于使用 AI 进行动漫本地化以避免“觉醒(woke)”式改编的讨论引发了分歧。支持者强调对原创内容的忠实度,而批评者则质疑 AI 处理细微的人类翻译的能力。

主题 3:AI 工具获得新平台与新功能

- Perplexity AI 登陆 MacOS,用户有赞有弹:Perplexity 正式在 MacOS 上线,提供 Pro Search 和语音查询等功能。然而,用户报告了性能问题,如高 CPU 占用率和 UI 元素无响应。

- ChatGPT 让 iPhone 智能程度提升 10 倍:Apple 的 ChatGPT 集成已向 iOS 18.2 beta 用户开放,显著增强了 Siri 的能力。用户对功能和生产力的提升表示兴奋。

- Microsoft 发布 OmniParser,教 AI 识别屏幕截图:Microsoft 推出了 OmniParser,这是一款将 UI 截图转换为结构化数据的工具,旨在改进基于 LLM 的 UI Agent。这一创新旨在通过更好的屏幕解析能力来增强用户交互。

主题 4:AI 开发者面临技术障碍

- Unsloth 安装困扰让用户抓狂:运行

pip install -U unsloth会导致 ImportError 并破坏 Torch 和 CUDA 功能,导致用户不得不重新安装支持 CUDA 12.1 的 Torch。讨论还强调了在构建 wheel 文件时遇到的 Flash Attention 问题。 - Flux 模型考验用户耐心:用户报告了 Flux 模型 严重的性能问题,称在没有量化的情况下生成时间过长。建议包括切换到量化模型以获得更快的速度和更低的 VRAM 占用。

- MacOS 应用过度占用 CPU:Perplexity AI 的 MacOS 应用因在闲置时平均消耗 18% CPU 以及基本功能操作困难而面临批评。用户建议需要对用户界面进行优化。

主题 5:AI 提升生产力与工作流

- Lindy AI Agent 成为你的办公室 PA:全新的 Lindy AI Agent 现在会在会议前 30 分钟发送会议简报短信,并利用 LinkedIn 和最近的电子邮件作为背景信息。这一进展展示了 AI 在提高生产力方面的实际应用。

- 多 Agent 礼宾系统推出“红地毯”级服务:开发者推出了一套集成了工具调用(tool calling)、记忆功能和人工交互的多 Agent 礼宾系统,以提升客户服务体验。该系统正基于基础理念不断改进。

- Gift Genie 在黑客松中大显身手:Gift Genie 项目旨在生成并讨论礼物创意,在最近的一次黑客松中获得赞誉。开发者强调,该项目的重点是鼓励参与式对话,而非简单的交易。

PART 1: High level Discord summaries

HuggingFace Discord

- 性能增强的 SD3.5 模型发布:全新的 SD3.5 模型 已发布,其在 diffusers 中支持量化,以优化大规模应用的性能。

- 此次发布强调了 Hugging Face 将模型效率作为持续关注的重点。

- OmniGen 的多功能特性:OmniGen 作为一个统一的生成模型被引入,可同时处理文本生成图像(text-to-image)和图像生成图像(image-to-image)任务,助力创意工作流。

- 发布活动极其丰富的一天! 凸显了 OmniGen 为多媒体生成任务带来的灵活性。

- IBM 在 Apache 2.0 协议下发布 Granite 3.0:来自 IBM 的 Granite 3.0 现已采用 Apache 2.0 许可证,凭借最新的 Transformers 支持,增强了其在项目中的集成性。

- 这体现了 IBM 致力于为开发者提供先进 AI 工具的决心。

- 引入 HUGS 实现零配置部署:HUGS 提供零配置推理服务,旨在加速各大云服务商上开源模型的 AI 开发。

- 优化的部署能力使企业能够高效地扩展其 AI 解决方案。

- 集成 Sambanova AI 以简化 API 访问:与 Sambanova AI 的新集成允许快速部署 AI 驱动的应用,提升了用户体验。

- 此配置通过直观的界面促进了对先进 AI 模型的便捷访问。

Unsloth AI (Daniel Han) Discord

- Unsloth 的安装困扰:运行

pip install -U unsloth会导致 ImportError 并破坏 Torch 和 CUDA 功能,导致用户需要重新安装支持 CUDA 12.1 的 Torch。- 讨论强调了在构建 wheel 文件时 Flash Attention 出现的问题,并引导用户参考相关的 GitHub issue 进行进一步排查。

- 量化版 Llama 模型发布:Llama 3.2 1B 和 3B 的量化版本已推出,承诺在减少内存占用的同时,将推理速度提高 2-4 倍。

- 根据 AI at Meta 的推文,这些模型利用量化感知训练 (Quantization-Aware Training) 来提高效率,允许在资源受限的设备上部署。

- Claude Sonnet 3.5 掌控全局:Claude Sonnet 3.5 现在具备了 computer use(计算机使用)能力,使其能够在用户设备上执行任务,详情见此 YouTube 视频。

- 社区成员轻松地讨论了 AI 进步的影响,并幽默地提到了与 AI 末日 (AI armageddon) 相关的潜在风险。

- Flex Attention 暂时禁用:Flex Attention 功能因维护而禁用,成员们期待未来的更新。

- 用户还分享了使用 DPO 训练数据集 的经验,表达了在处理冗长回复时实现简洁输出的挑战。

- GPU 架构见解:社区对 Ascend NPUs 和 基于 Volta 的 GPU 进行了咨询,并对 GPU 层级和内存管理模式展开了讨论。

- 关于 Torch 和 Triton 中张量管理的详细方法指出了不同 GPU 架构在数据处理能力上的关键差异,同时还讨论了在 TPU 上实现 FlashAttention 的相关内容。

Eleuther Discord

- AI 中的标签质量与数量:新论文 Balancing Label Quantity and Quality for Scalable Elicitation 深入探讨了 AI 中高质量标签与低质量标签之间的权衡,识别了三种资源分配方案。

- 这种方法通过展示不同的预算分配如何提升模型性能,优化了 AI 训练系统的数据效能。

- Molmo 的模型 Checkpoints 即将发布:Molmo 是来自 Allen Institute for AI 的一系列开源视觉语言模型,即将发布包括在拥有 100 万图文对的 PixMo 数据集上训练的 Checkpoints。

- Molmo 7B-D 模型因其开源特性和顶级性能而受到关注,填补了 GPT-4V 与 GPT-4o 之间的评估空白。

- Dinov2 的功能受到关注:围绕 Dinov2 的功能展开了讨论,成员们分享了见解和资源,包括原始论文以供参考。

- 这反映了深化对该模型复杂性和潜在应用理解的协作努力。

- 改进 Diffusion Models 中的噪声分配:主要讨论集中在优化 Diffusion Models 中噪声的分配方式,以提升生成质量,并结合了高斯潜空间噪声映射(Gaussian latent noise mappings)。

- 然而,要警惕线性分配问题的复杂性,特别是在高维数据下,这可能会阻碍实现的实用性。

- Agent 界面获得新赞誉:成员们对 Agent 界面的最新改进表示兴奋,指出其 User-friendly(用户友好)的设计。

- 预计这些增强功能将改善用户交互,使未来的参与更加直观。

Notebook LM Discord Discord

- 求职面试流程备受抨击:候选人面临的面试和测试数量过多引发了担忧,导致招聘过程中的挫败感和效率低下。

- 一些成员提议 AI 可以自动化招聘,减轻候选人负担并简化流程。

- 使用 NotebookLM 进行多语言音频生成:用户报告了提示 NotebookLM 生成西班牙语和法语等语言内容的体验,结果褒贬不一。

- 虽然有些人取得了成功,但其他人则在一致性方面遇到困难,揭示了语言输出中的挑战。

- NotebookLM 推动教育改进:NotebookLM 显著增强了《商业策略游戏》课程的学习体验,缩短了启动时间并提高了学生的参与度。

- 用户称赞它使学生能够提出复杂的问题,加深了他们对游戏机制的理解。

- HeyGen 的 Deepfake 伦理辩论:关于 HeyGen 的 Deepfake 技术的伦理影响出现了担忧,特别是用于创建虚拟形象的模型使用的透明度。

- 成员们就相关个人的知情同意(Consent)展开了讨论,提出了关于内容创作的关键伦理问题。

- 播客长度优化见解:用户尝试使用特定字数提示来生成更长的播客,注意到较大的数值会导致更长的输出,但并不总是成比例。

- 他们强调,尽管努力延长播客时长,质量仍然是重中之重。

Perplexity AI Discord

-

Perplexity 正式在 MacOS 上发布:Perplexity 现已在 MacOS 上可用,用户可以使用 ⌘ + ⇧ + P 提问,并可从此链接下载应用。此次发布引入了 Pro Search 和语音提问功能。

- 通过 Thread Follow-Up,用户可以进行深入讨论,并在查询中访问引用来源 (cited sources) 以获得富有见地的回答。

-

MacOS 应用遭遇性能问题:用户报告称 MacOS App 即使在闲置时平均也消耗 18% CPU,引发了对整体性能和响应速度的担忧。

- 投诉包括基本功能方面的困难,表明用户界面需要进行优化。

-

NVIDIA 集成 Isaac ROS 以增强机器人技术:NVIDIA 与 Isaac ROS 的集成提升了机器人框架的能力,重点关注 AI 驱动的机器人应用的鲁棒性。

- 该举措旨在增强在多样化机器人环境中的性能,满足行业对高级功能的需求。

-

用户探索流式模式 (Streaming Mode) 作为权宜之计:遇到 524 错误 的用户讨论了使用流式模式缓解这些连接问题的潜力,认为这可能会带来更好的性能。

- 共享了相关资源,包括 Perplexity API 文档的链接,以指导用户实施该解决方案。

Nous Research AI Discord

-

审查引发辩论:成员们讨论了 AI 审查 的影响,质疑像 Hermes 3 这样的模型是真正被审查了,还是仅仅反映了与其提示词 (prompts) 相关的性格偏见。

- 一种观点认为,真正的审查涉及系统性的回避,这与单纯由性格驱动的回答形成对比。

-

O1 vs Claude:性能对决:关于 O1 和 Claude 能力的激烈辩论浮出水面,许多人断言它们在许多任务中的表现几乎相同。

- 参与者对导致结果偏差的标准表示怀疑,特别是 GPT-4o 的排名出人意料地高于预期。

-

SB1047 法案的影响:SB1047 法案引发了关于阻碍开源 AI 发展以及可能有利于大型科技公司的担忧。

- 讨论强调了对 OpenAI 转型为营利模式可能导致该领域重大伦理困境的担忧。

-

动漫中的 AI 本地化:一把双刃剑:关于在动漫本地化中使用 AI 同时避免“觉醒 (woke)”改编的争议性讨论出现,强调了保持原创内容完整性的必要性。

- 支持者声称对源材料的忠实至关重要,而批评者则质疑 AI 复制细微的人类翻译的能力。

-

AI 模型的 Minecraft 基准测试:讨论围绕利用 Sonnet 通过 Minecraft 挑战来衡量 AI 性能展开,重点介绍了在其 GitHub 仓库中分享的各种技术。

- 该举措反映了对整个 AI 开发过程中评估方法的更广泛关注。

OpenRouter (Alex Atallah) Discord

-

导航 OpenRouter 的工具使用 (Tool Use):成员们讨论了如何验证模型是否支持工具使用,并指向了特定页面了解详情。

- 在混合模型与工具调用时出现了功能混乱,指出了过去在工具角色 (tool role) 利用方面的问题。

-

Cloudflare 崩溃引发挫败感:用户报告了 OpenRouter 的间歇性访问问题,遇到了 524 等 Cloudflare 错误 以及持续的加载界面。

- 一些人确认问题很短暂,刷新页面后即可解决。

-

Hermes 3.5 访问风波:用户报告了 Hermes 3.5 405B instruct 模型的访问问题,面临空响应或 404 错误。

- 在 OpenRouter 中调整提供商设置帮助一些人恢复了访问。

-

Cerebras 声称速度提升:Cerebras 发布了关于速度改进的新闻,尽管用户报告 TPS 速率存在波动。

- 推测指向高负载期间的动态节流 (throttling) 问题。

-

用户要求集成访问权限:几位用户表示对集成设置有浓厚兴趣,强调了他们对 OpenRouter 处理工作负载的依赖。

- 评论强调了强大的集成选项的重要性,突显了紧迫性。

Stability.ai (Stable Diffusion) Discord

-

Stable Diffusion 3.5 在消费级 GPU 上运行流畅:Stable Diffusion 3.5 可以在 4070 TI 和 RTX 4080 等 GPU 上成功运行,8GB VRAM 被认为是获得合理性能的最低要求。用户通过使用 FP8 版本在 3060 上也实现了成功运行,并获得了更好的效果。

- 这种配置凸显了强大的 AI 视觉生成模型在消费级硬件上日益增长的可普及性。

-

Flux 模型面临硬件挑战:用户报告了 Flux 模型 的显著性能问题,提到在没有进行 Quantization 的情况下,默认模型在各种硬件配置上的生成时间过长。建议包括切换到 Quantized 模型以提高速度并降低 VRAM 占用。

- 这一转变可以在最大化 GPU 能力的同时缓解一些使用上的挫败感。

-

ComfyUI 在易用性上胜过 Forge:在比较 ComfyUI 和 Forge 的讨论中,用户称赞了 ComfyUI 的用户友好性和性能优化特性,特别是其隐藏节点连接的能力。针对 Forge 繁琐的模型卸载过程存在一些抱怨,许多人为了效率更倾向于选择 ComfyUI。

- 这表明在 AI 工作流设计中,更简单、更直观的界面可能成为一种趋势。

-

社区分享 GIF 生成工具 Glif:社区重点推荐了 Glif 作为生成 GIF 的首选工具,指出其易用且免费。用户赞赏其能够输入图像以获得定制化动画体验的能力。

- 此类工具增强了 AI 生成媒体中的创意可能性。

-

Quantization 策略引发讨论:关于 Quantization 的讨论集中在 flux1-dev-Q8_0 等模型上,强调了在保持足够输出质量的同时平衡文件大小和性能。社区分享了相关资源,帮助用户选择适合其硬件配置的 Quantized 模型。

- 这些考量证明了在现有资源下优化模型性能的重要性。

aider (Paul Gauthier) Discord

-

Sonnet 3.5 瞄准高性价比性能:新版 Sonnet 3.5 的性能定位接近 Haiku 3 和 DeepSeek,同时保持对用户的经济性。早期反馈表明,其能力可能与之前的版本持平。

- Sonnet 模型继续吸引用户,通过在各种任务中提供强大的性能指标,旨在获得更广泛的采用。

-

Aider 的 Architect Mode 展现潜力:用户表示有兴趣在更新的模型(特别是 Sonnet 和 Haiku)中探索 Aider 的 Architect Mode。他们指出,虽然该模式可以增强输出,但由于更高的 Token 消耗,可能会增加运营成本。

- 参与者指出需要仔细评估使用情况,以平衡性能提升与可扩展性问题。

-

用户对比 DeepSeek 与 Gemini Flash:DeepSeek 的性能被拿来与 Gemini Flash 进行比较,一些用户因后者在处理整体编辑时的速度而更青睐它。根据具体的编码工作流,用户体验到了不同的效率。

- 针对 DeepSeek 在处理较大输入时的滞后问题,用户提出了担忧,强调了在现实条件下进行 Benchmark 测试的必要性。

-

关于 Aider 与 Bedrock Claude 3.5 兼容性的查询:用户正在寻求修复方案,以实现 Aider 与新版 Bedrock Claude 3.5 模型的兼容,因为过去的版本运行无间。讨论表明,导致中断的兼容性问题尚存在不确定性。

- 热修复话题引起了关注,引发了关于更新以维持跨模型功能的建议。

-

在 Aider 中处理 Git 操作:一位用户表达了在 Aider 中暂存更改而不提交的需求,以避免因自动提交导致的编译失败。他们收到了诸如禁用自动提交和发出手动

/commit命令等建议。- 有效管理操作成为一个关键问题,推动了对更顺畅的 Git 集成工作流的建议。

GPU MODE Discord

-

CUDA Stream 同步问题澄清:一位用户寻求关于在启动 kernel 之前是否需要为 stream1 和 stream2 调用 cudaStreamSynchronize 的澄清,因为 stream1 需要等待 stream2。

- 澄清已完成,确认了用户之前的误解。

-

深度学习中的数值精度挑战:讨论强调了与 float16 和 bfloat16 相关的数值舍入问题,指出 L2 Norm 误差在 0.01 左右。

- 参与者建议通过预缩放梯度 (pre-scaling gradients) 来缓解这些问题,尽管 BF16 的精度问题仍是一个隐忧。

-

梯度累积技术探讨:成员们辩论了实现精确梯度累积 (gradient accumulation) 的各种方法,推荐使用 tree reduction 技术而非标准求和。

- 强调了在 BF16 中进行累积时保持精度的挑战,表明仍有改进空间。

-

CUDABench 的协作与透明度:成员们对 CUDABench project 的开源表示兴奋,并承诺分享内部工作以促进更好的协作。

- 该方法鼓励社区贡献,重点在于透明度和想法分享。

-

第 5 版期待发布:成员们询问了 第 5 版 的状态,确认其尚未发布,引发了持续的期待。

- 这突显了社区对发布更新的热切关注。

LM Studio Discord

-

LM Studio 的本地文档限制:用户注意到 LM Studio 在检索增强生成 (RAG) 方面一次只能处理五个文件,目前被描述为初级阶段且文件访问受限。

- 这引发了对处理大规模工作负载时本地文档处理实用性的担忧。

-

重启后模型性能滞后:一位成员报告称,在重启 LM Studio 后,尽管使用了新对话并删除了旧会话,生成速度仍然变慢。

- 建议检查 LM Runtimes 页面,以确保模型没有回退到使用 CPU 而非 GPU。

-

AMD GPU 支持增加:关于 LM Studio 的讨论透露,通过 ROCm 对 AMD 显卡的支持已适用于 6800 及以上型号。

- 一位用户强调 RX 6800 显卡价格合理,是增强 VRAM 能力的一个潜在选择。

-

量化 Llama 模型发布:最近分享的 Llama 3.2 1B and 3B models 量化版本旨在减少内存占用,目标是端侧部署。

- Meta 的这一举措旨在简化基于 Llama 构建应用的开发者的工作,无需大量的计算资源。

-

LM Studio 未来的视觉模式功能:用户询问 LM Studio 构想中的未来视觉模式 (vision mode) 是否可以直接解释和翻译屏幕上的文本。

- 这一询问引发了关于视觉模式未来潜在交互能力的讨论。

OpenAI Discord

-

AI 模型参数效率提升:自 GPT-3 发布以来,模型的参数效率提升了 300x,仅需 0.5B parameter model 即可提供类似的性能。

- 这种效率使得更广泛的部署变得更加可行,从而在模型应用中显著节省成本。

-

GPT-4o 更便宜且功能更多:预计 GPT-4o 对 OpenAI 而言比 GPT-4 更具成本效益,且使用灵活性更高。

- 虽然尚未正式宣布,但传闻建议已取消增加的速率限制,提高了用户的期望。

-

有效的 Prompt Engineering 策略:讨论强调了 prompt engineering 中的清晰度和具体性,以获得更准确的 AI 输出。

- 参与者强调,使 prompt 用词与期望的响应保持一致对于优化交互质量至关重要。

-

当前记忆功能的局限性:用户辩论了 ChatGPT memory feature 的有效性,批评其未能充分满足用户需求。

- 建议使用 Retrieval-Augmented Generation (RAG) 等替代方案来高效处理 AI 模型中的记忆。

-

Custom GPTs 的使用体验:反馈表明 Custom GPTs 的自定义选项目前仅限于 4o 模型,导致用户寻求更多灵活性。

- 用户强烈渴望增强选项,突显了对满足个人需求的定制化交互的需求。

Latent Space Discord

-

Lindy AI Agent 简化会议准备:一个新的 Lindy AI Agent 现在会在会议前 30 分钟通过短信发送会议简报,利用 LinkedIn 和最近的电子邮件提供背景信息,正如这篇 tweet 中分享的那样。

- 这一进展展示了 AI 在日程安排和信息检索方面提升生产力的实际应用。

-

使用新型 sCMs 实现快速文本生成图像:OpenAI 发布了 sCMs,这是他们最新的一致性模型(consistency model),可提高文本生成图像的速度,仅需两个采样步骤,详见其 公告。

- 社区期待实际应用,因为该模型承诺改进训练稳定性和可扩展性。

-

ChatGPT iPhone 集成上线:ChatGPT 与 Apple AI 的集成已进入测试阶段,据 Mich Pokrass 称,这让 iPhone 的实用性提升了 10 倍。

- 关于注册流程的咨询正在增加,需要 18.2 版本才具备资格。

-

Microsoft 推出 OmniParser:Microsoft 推出了 OmniParser,这是一款将 UI 截图转换为结构化数据的工具,旨在改进基于 LLM 的 UI Agent,如 Niels Rogge 所述。

- 这一创新可以通过优化屏幕解析能力显著增强用户交互。

-

Cohere 发布 Aya Expanse 模型:据 Aidan Gomez 称,Cohere 宣布推出 Aya Expanse,这是一个支持 23 种语言的新多语言模型系列,开放权重已在 Hugging Face 上提供。

- 这一发展标志着多语言 AI 迈出了重要一步,旨在缩小语言差距。

Interconnects (Nathan Lambert) Discord

-

ChatGPT 集成让 iPhone 更智能:Apple 的 ChatGPT 集成今天对 iPhone 用户开放,增强了 Siri 处理复杂问题的能力,如 这条推文 所述。一位成员对团队的努力表示自豪,称他们的 iPhone 感觉 实用性提升了 10 倍。

- 该功能是稳定的 iOS 18.2 开发者测试版的一部分,用户可以在 这篇 CNET 文章 中进一步了解。

-

Cohere 推出 Aya Expanse 模型:Cohere 推出了 Aya Expanse 模型系列,旨在消除 AI 中的语言障碍,详见 这条推文。该计划致力于对多语言研究进行多年投资。

- 成员间的讨论确认了该模型的 CC-by-NC 许可证及其在各个领域的潜在应用。

-

Yann LeCun 批评诺贝尔 AI 奖得主:Yann LeCun 批评了最近授予 AI 的 诺贝尔奖,认为这是委员会迫于压力承认 deep learning 影响力的结果,并称 Hopfield nets 和 Boltzmann machines “完全没用”。

- 成员们的反应不一,反映了对这些技术在当前 AI 语境下相关性的不同看法。

-

Anthropic 定位为 B2B 公司:Anthropic 正在采取 B2B 战略,专注于自动化工作任务,这与 OpenAI 针对消费者偏好的 B2C 模式形成对比。一位成员强调:“我甚至想用这种 Agent 自动化的每一项任务都与工作有关。”

- 讨论指出 AI Agent 在消费者市场的挣扎,因为消费者通常抵制自动化 购物 等活动。

-

关于管理长 PDF 的讨论:对于在长篇 PDF 中丢失阅读进度感到沮丧,导致有人建议使用能跟踪查看位置的 PDF 阅读器,以及 Zotero 等工具。一位成员幽默地感叹为了避免混淆而不得不依赖截图。

- 这次对话强调了 AI 工程师在文档管理中对更好的以用户为中心的工具的需求。

OpenInterpreter Discord

-

尝试 Anthropic 模型的最简单方法:要探索 Anthropic 的 computer controlling model,只需使用

interpreter --os,目前正在招募志愿者来实施它。- 屏幕尺寸的增加对性能有积极影响,这表明需要研究更好的文本处理方法。

-

解决 Python 版本混淆:用户在使用 Open Interpreter 时遇到了 Python 3.10 的错误,导致了兼容性问题。

- 切换到 Python 3.11 解决了这些问题,引发了关于高效切换方法的咨询。

-

安装查询澄清:出现了关于使用一键安装程序运行 OS 模式的问题,并为用户分享了详细的终端命令。

- 开发者确认 OS 模式的功能与移动应用不同,但两者都允许计算机控制。

-

了解 Claude Computer 中缺失的功能:对于 Open Interpreter 中缺少新的 Claude Computer 功能出现了困惑,需要进行版本检查。

- 开发者强调了更新到正确版本以访问新功能的重要性。

-

Beta 测试发布说明:提出了关于收到 Open Interpreter 桌面应用 Beta 测试邮件的查询,引发了讨论。

- Beta 测试人员正在定期添加,House Party 参与者享有优先权。

Cohere Discord

-

Aya 模型弥合语言鸿沟:Cohere 最新的 Aya model 提供了最先进的多语言能力,旨在缩小 AI 的语言差距,正如新 博客文章 中所强调的。该计划专注于赋能各个新兴市场的企业家利用 AI 解决方案。

- 该模型系列包括 8B 和 32B 版本,旨在增强 23 种语言 的性能,直面大多数模型在非英语需求方面面临的局限性。

-

新兴市场初创公司需要特殊许可证:一位成员担心,由于 NC license and addendum 的限制,新兴市场的初创公司将无法使用某些模型。建议初创公司联系 Cohere 以获得更适用的许可证,从而在特定背景下提供价值。

- 这反映了在具有不同商业框架的地区,实体在尝试利用尖端 AI 模型时面临的挑战。

-

关于 API 集成和模型性能的讨论:一位用户正在探索使用 Vercel AI SDK 集成 Cohere v2,但注意到兼容性问题,因为当前的提供商映射仅支持版本 1,如 GitHub issue 中所述。团队确认 Cohere v2 已在路线图中,但尚未确认具体发布日期。

- 与此同时,用户在跨多台机器编程时正在处理 API key 查询,特别是关于基于 API 或 IP 地址的 rate limiting 问题。

-

微调模型的 API 故障排除:一位用户报告了通过 API 使用其 finetuned models 时的问题,引发了对其错误详情的询问。有人指出,确保引号正确转义可能会解决此问题,特别是在 ‘order_id’ 格式方面。

- 这些实际问题通常会拖慢开发进度,但突显了社区协作排障的精神。

-

关于 AI 模型对比的辩论:成员们就 cmd r+ 与 c4i-aya-32b 等模型的优劣展开了辩论,质疑这种评估的客观性。讨论强调,准确性的差异可能反映了查询的性质,而非模型本身的能力。

- 这一持续的对话强调了在选择 AI 模型时上下文的重要性,展示了主观体验是如何变化的。

tinygrad (George Hotz) Discord

-

多云操作引发 Lazy 辩论:一名成员询问 multi-Cloud device movement operations(多云设备移动操作)是否被视为 lazy(惰性执行),引发了关于其有效性和当前用法的讨论。

- 对于此类操作在当今技术环境下的效率和必要性,意见分歧显著。

-

调查直接设备间通信:讨论了在没有前端集成的情况下,direct device-device communication(直接设备间通信)是否可行,暗示了潜在的增强空间。

- 建议将此想法作为未来 Tinygrad 开发中一个极具前景的 pull request。

-

Tinygrad 中的 Attention 实现受到关注:一位用户请求关于在 Tinygrad 中实现 attention 的指导,并将其性能与 PyTorch 进行了对比,认为前者表现不佳。

- 基准测试表明,优化函数的使用可以提高性能,强调了测试期间方法放置的重要性。

-

内存分配问题持续存在:有关在 Tinygrad 中使用 randn 进行 tensor 初始化时,因内存分配导致性能下降的问题被提出。

- 尽管尝试设置环境变量进行 GPU 分配,问题依然存在,这表明 Tensor 初始化中存在更深层次的复杂性。

-

测试内核优化标志以提升性能:出现了利用

BEAM=4等标志通过内核搜索优化来增强 Tinygrad 性能的想法,但初步测试效果有限。- 这反映出需要不断的实验和微调,以确定提高计算效率的有效配置。

LlamaIndex Discord

-

多 Agent 礼宾系统初具规模:一项更新揭示了一个新的 multi-agent concierge system(多 Agent 礼宾系统),通过集成 tool calling、memory 和人工交互来增强客户服务。LoganMarkewich 对系统进行了彻底改造,带来了持续的改进(阅读更多)。

- 目前正在不断取得进展,以构建响应更迅速的客户服务机器人。

-

AWS Bedrock 迎来 Anthropic 模型:成员们确认在 AWS Bedrock 中可以使用 Anthropic 3.5sonnet,该模型已在 Virginia, Oregon, Tokyo, Frankfurt 和 Singapore 等地区可用,通过

pip install -U llama-index-llms-anthropic即可安装。这一集成使得获取尖端模型更加容易。- 正在探索现有的部署选项,以最大限度地发挥功能和模型利用率。

-

将 Llama 2 集成到 LlamaIndex:要在 LlamaIndex 中使用 Llama 2,开发者可以根据其设置选择使用 Ollama、LlamaCPP 或 Llama API 进行部署。共享的示例代码展示了集成方法,并提供了 npm 命令作为指导。

- 部署选项的灵活性 允许开发者根据其现有的架构进行选择。

-

扩展 Neo4jPropertyGraphStore 部署:讨论了在 Anyscale 中部署多个 Neo4jPropertyGraphStore 实例的情况以及潜在的可扩展性影响。成员们对运行多个实例是否会影响整体性能表示担忧。

- 成员们正积极权衡 高效扩展和节点管理的可能性。

-

Gift Genie 项目人气攀升:Gift Genie 项目在最近的一次黑客松中因其生成和辩论礼物创意的创新能力而获得赞誉,该项目强调参与式对话而非简单的交易处理。开发者对创意讨论而非直接推荐给出了积极反馈(详情点击此处)。

- 随着独特项目获得认可,社区兴趣正在不断升级。

Torchtune Discord

-

张量并行 (Tensor Parallelism) 实现快速微调:在为多 GPU 微调实现 Tensor Parallelism 后,每个 epoch 的耗时缩短至 20 分钟以内,展示了令人印象深刻的训练速度。

- 用户对他们的配置表示满意,强调该设置达到了他们的快速训练目标。

-

多 GPU 设置中的 Batch Size 澄清:成员们确认在 8 个 GPU 上使用

batch_size = 6会产生 48 的全局 batch size,澄清了之前关于缩放的困惑。- 这一见解有助于简化分布式训练过程,为许多用户优化了工作流。

-

Dataloader 性能瓶颈揭示:参与者对由于

num_processes=0和 pinned memory 不足导致的 dataloader 变慢表示担忧。- 提出了优化这些设置以提高训练效率并减轻性能下降的建议。

-

Packed 与 Unpacked 训练性能差异:讨论强调了 packed=True 和 packed=False 训练配置之间的混合结果,前者有时会加快进程。

- 然而,packed 数据产生了意想不到的响应,促使对最佳用法进行进一步分析。

-

关于 muP 参数化 (muP parameterizations) 进展的询问:一位用户询问了 recipe 的 muP parameterizations 状态,引用了早期的讨论并寻求其实现的明确说明。

- 这表明社区对功能开发的持续关注,以及未来需要具体更新的必要性。

Modular (Mojo 🔥) Discord

-

Modular 问题的正确频道:一位用户询问 <#1284264544251809853> 是否适合提问关于组织的问题,随后被引导至 <#1098713601386233997> 进行一般性咨询。

- 这一反馈强调了频道使用的清晰度,增强了社区沟通。

-

关于数据类型检查的探讨:一位成员询问如何进行数据类型检查,引发了关于编程实践中数据验证的对话。

- 此外,还有一个关于如何将 List 转换为 InlineArray 的请求,重点关注实际的数据操作技术。

-

Kapa 资源推荐:一位成员建议使用 kapa 频道寻求数据类型检查方面的帮助,肯定了其在编程讨论中的实用性。

- 这突显了社区倾向于分享支持彼此学习历程的资源。

-

关于 MAX Engine C API 的见解:提供了关于将 MAX Engine 集成到高性能应用中的 C API 的说明,讨论了对 Torch/ONNX 模型的支持。

- 对话探讨了当前的 C 框架是否能促进在为 Mojo MAX-graph 设计的模型上运行推理,强调了潜在的架构考虑。

-

推理图 (Inference Graph) 集成咨询:一位成员质疑在现有 C 应用程序框架内运行 Mojo MAX-graph 模型推理的可行性,反映了持续的开发兴趣。

- 他们寻求社区对与此集成相关的潜在挑战的见解,优先考虑技术可行性。

LLM Agents (Berkeley MOOC) Discord

-

关于录取邮件的困惑:用户报告在注册课程后没有收到正式的录取邮件,只收到了一份填好的表格。tarande57 解释说,注册只是将用户添加到邮件列表,并不确认录取。

- 这导致了关于课程入职预期的混乱信息,因为参与者期待传统的录取通知。

-

邮件追踪中的时间戳问题:一位用户询问了在 PST 时间 9 月 28 日下午 6:50 收到的一封邮件,询问是否可以私信提供有关该邮件的详细信息。经过验证,tarande57 确认该用户的邮件问题已解决。

- 这表明在邮件追踪以及通知用户表格提交和沟通时间方面有改进空间。

-

邮件列表动态与讲座信息:几位用户注意到收到了关于讲座的信息但没有收到测验信息,质疑信息分发的一致性。tarande57 保证,填写注册表主要是为了追踪与证书资格相关的作业。

- 这种不一致引发了对程序清晰度的担忧,表明需要就课程预期进行更好的沟通。

DSPy Discord

-

尖端工作流系统的启动:成员们正开始开发全球最先进的工作流系统,并在 Discord 上进行详细讨论。这一雄心勃勃的项目旨在彻底改革工作流的管理和执行方式。

- 团队对在开发这一创新解决方案过程中的潜在合作机会感到兴奋。

-

用于微调的 ColPali Cookbook:ColPali Cookbook 提供了学习、微调和适配 ColPali 到多模态 Retrieval Augmented Generation (RAG) 用例的方案 (recipes)。该 GitHub 仓库作为将 ColPali 集成到各种应用中的实用指南。

- 用户可以利用这些方案来增强他们的实现工作,特别是在 RAG 场景中。

-

推出用于文档检索的 ViDoRe 基准测试:论文讨论了视觉文档检索基准测试 (ViDoRe) 的推出,旨在评估视觉丰富的文档检索任务。它强调了当前系统在处理视觉线索方面的困难,从而催生了对像 ColPali 这样新检索架构的需求。

- 该基准测试对于提升跨不同领域和语言的文档检索能力至关重要。

-

现代文档检索中的挑战:现代文档检索系统在查询到文本匹配 (query-to-text matching) 方面表现出色,但在视觉元素方面表现不佳,影响了实际应用中的性能。作者强调,解决这些缺陷对于提高文档检索的有效性至关重要。

- 他们呼吁通过创新来弥合文本和视觉信息检索之间的差距。

-

ColPali 的文档理解方法:ColPali 利用最新的 Vision Language Models 的能力,直接从文档图像生成上下文嵌入 (contextualized embeddings)。这种新的模型架构旨在改进从视觉丰富的文档中检索信息的效果。

- 这种方法标志着文档处理和理解方式的转变,为更先进的检索系统铺平了道路。

LangChain AI Discord

-

为请求-响应连接创建图:一位成员提议构建一个图,以说明代表 HTTP 请求-响应交互的多个文档之间的关系。这旨在理清这些连接以便更好地理解。

- 这种可视化需求反映了在全面分析请求-响应中复杂模式时面临的持续挑战。

-

DeepLearning.AI 关于函数和工具的课程:一位成员分享了 DeepLearning.AI 上 Functions, Tools and Agents 课程的 GitHub 仓库,重点关注 LangChain.JS 的实现。该资源为课程参与者加强编码技能提供了实用参考。

- 该仓库包含重要的代码示例,增强了学习体验,鼓励其他人查看该 仓库 以进行进一步探索。

LAION Discord

-

询问用于图像字幕(Image Captioning)的最佳模型:一位用户询问了用于处理 约 5 亿张图像数据集 以进行 Diffusion Model 预训练的最佳 Image Captioning 模型,并建议 Internvit 和 Google 的 Gemini 模型 是潜在的选择。

- 他们强调倾向于选择参数量不超过 500 亿(50 billion) 的模型,旨在不牺牲能力的前提下提高效率。

-

寻找额外的模型推荐:该用户表现出浓厚的兴趣,希望在上述提到的模型之外,寻找其他针对其字幕需求的高性能模型。

- 他们特别希望避开更大的模型,专注于将性能效率最大化。

Alignment Lab AI Discord 没有新消息。如果该社区长期沉寂,请告知我们,我们将将其移除。

LLM Finetuning (Hamel + Dan) Discord 没有新消息。如果该社区长期沉寂,请告知我们,我们将将其移除。

MLOps @Chipro Discord 没有新消息。如果该社区长期沉寂,请告知我们,我们将将其移除。

OpenAccess AI Collective (axolotl) Discord 没有新消息。如果该社区长期沉寂,请告知我们,我们将将其移除。

Mozilla AI Discord 没有新消息。如果该社区长期沉寂,请告知我们,我们将将其移除。

DiscoResearch Discord 没有新消息。如果该社区长期沉寂,请告知我们,我们将将其移除。

Gorilla LLM (Berkeley Function Calling) Discord 没有新消息。如果该社区长期沉寂,请告知我们,我们将将其移除。

AI21 Labs (Jamba) Discord 没有新消息。如果该社区长期沉寂,请告知我们,我们将将其移除。

第 2 部分:按频道的详细摘要和链接

完整的频道逐条分析已针对电子邮件进行了截断。

如果您喜欢 AInews,请分享给朋友!预先感谢!