ainews-lmsys-killed-model-versioning-gpt-4o-1120

LMSys 终结了模型版本化 (gpt 4o 1120, gemini exp 1121)

2024年11月21日至11月22日的AI新闻摘要重点报道了前沿实验室之间激烈的竞争。OpenAI的gpt-4o-2024-11-20与Google DeepMind的gemini-exp-1121在Lmsys排行榜上交替领先。包括Anthropic在内的各大领先实验室正呈现出一种新趋势:即使用基于日期的模型标识符,而非传统的版本号。

DeepSeek R1作为一款强有力的开源替代方案备受瞩目,尤其是在中美AI竞争的背景下。Gemini-Exp-1121因其在视觉、编程和推理能力的提升而受到赞誉。此外,MistralAI在帕罗奥图(Palo Alto)开设了新办公室进行扩张,标志着公司的业务增长和人才招聘需求。

日期就是你所需的一切 (Dates are all you need)。

2024年11月21日至11月22日的 AI 新闻。我们为你检查了 7 个 subreddits、433 个 Twitter 账号 和 30 个 Discord 服务(217 个频道,2501 条消息)。为你节省了预计 237 分钟 的阅读时间(按每分钟 200 字计算)。你现在可以标记 @smol_ai 进行 AINews 讨论了!

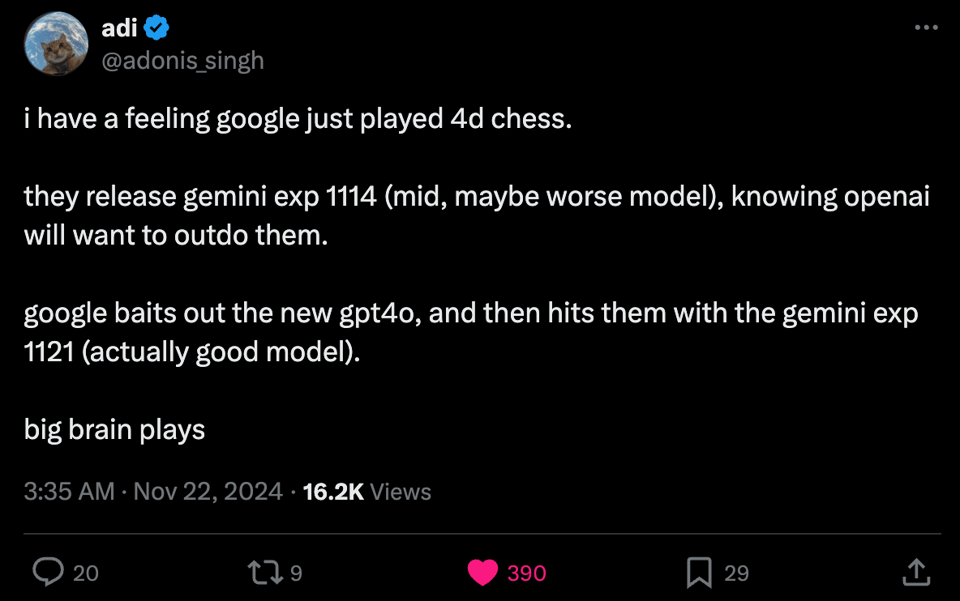

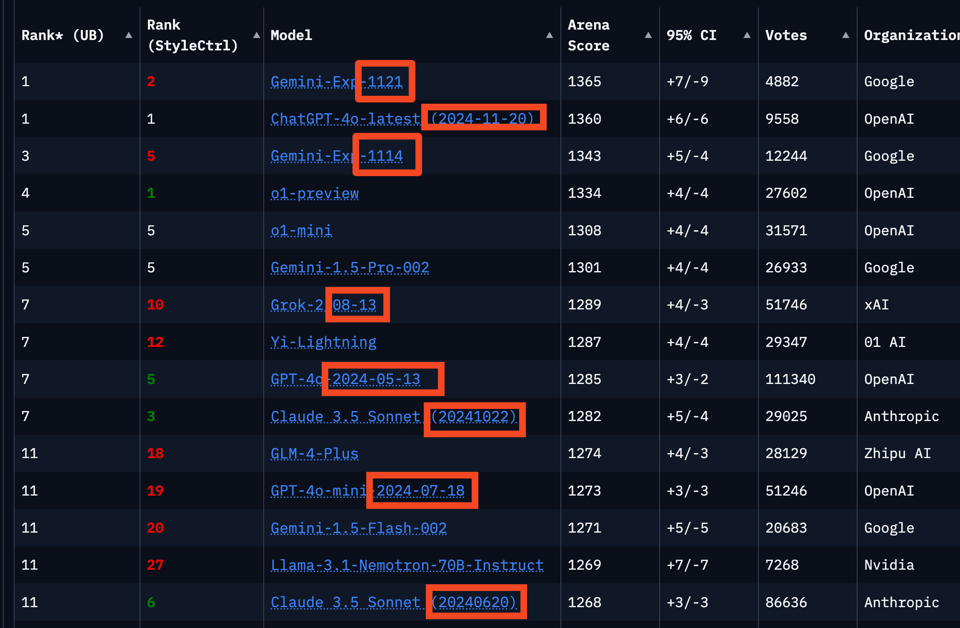

前沿实验室的竞争动态正变得有些荒谬。我们曾有一个规则,即新的 SOTA 模型总是占据榜首,上周我们报道了 Gemini Exp 1114,尽管除了其 LMSYS 排名外几乎没有其他有用的细节。但昨天 OpenAI 凭借 gpt-4o-2024-11-20 再次超越了它们,幸运的是我们没有报道这个(多亏了 DeepSeek R1),因为它现在被怀疑是一个更差(但更快)的模型(我们不知道这是否属实,但如果 OpenAI 实际上是将一个 “mini” 模型冠以主线模型的品牌并希望我们不会注意到,那将是一个非常严重的指控)。与此同时,今天 Gemini Exp 1121 发布了——再次从 OpenAI 手中夺回了 LMSYS 的榜首位置。

事情变得如此荒谬,以至于这个调侃 OpenAI 与 Gemini 发布巧合的笑话看起来都有几分可信:

这种完全抛弃模型发布礼节的行为,总是可以用“我们只是想尽快把这些东西交到开发者手中”之类的善意借口来辩解。但我们现在面临的情况是,所有三家前沿实验室(提醒一下,Anthropic 尽管表现得有些冷嘲热讽,但也一直在玩这种“只有日期更新而没有版本号”的游戏)都拥有仅通过日期而非版本号来识别的 SOTA 模型变体,以维持在 LMSYS 上的地位。

我们是不再进行版本命名了吗?希望不是,因为我们仍在讨论 o2、GPT-5、Claude 4 和 Gemini 2,但在 100k clusters 扩建过程中的这段过渡期停滞,是一个没人真正满意的局部最小值 (local minima)。

AI Twitter 摘要

所有摘要均由 Claude 3.5 Sonnet 完成,取 4 次运行中的最佳结果。

主题 1. DeepSeek 与全球 AI 进展

- DeepSeek R1 的表现:DeepSeek R1 与 OpenAI o1-preview 进行了对比,其“思考过程(thoughts)”直接流式输出,且在推理过程中未使用 MCTS。@saranormous 强调了该模型的强大实力,暗示芯片管制对于来自中国日益增长的竞争是无效的,@bindureddy 也对此表示赞同,并称赞了 R1 的开源特性。

- 市场影响与预测:Deepseek-r1 作为 OpenAI 等现有领导者的竞争替代方案正受到关注,关于中美 AI 竞赛的讨论进一步强调了这一点。

主题 2. 模型发布与技术发展

- Google 的 Gemini-Exp-1121:该模型因其在视觉、编程和创意写作方面的改进而受到赞誉。@Lmarena_ai 讨论了它在 Chatbot Arena 排行榜上与 GPT-4o 并驾齐驱的上升势头,展示了性能的快速提升。

- 增强功能:据 @_akhaliq 称,全新的编程熟练度、更强的推理能力以及改进的视觉理解能力使 Gemini-Exp-1121 成为一股强大的力量。

-

Mistral 的扩张:MistralAI 宣布在帕洛阿尔托(Palo Alto)开设新办公室,预示着业务增长并在多个领域提供开放职位。正如 @sophiamyang 所指出的,这一扩张反映了扩大运营规模和人才储备的战略推进。

- Claude Pro 与 Google Docs 集成:Anthropic 为 Claude AI 增加了 Google Docs 集成功能,旨在简化组织层面的文档管理。

主题 3. AI 框架与数据集发布

- SmolTalk 数据集亮相:SmolTalk 是一个采用 Apache 2.0 协议的 100 万样本数据集,通过新的合成数据集提升了 SmolLM v2 的性能。该倡议有望增强各种模型的输出效果,如摘要提取和重写。

- 数据集集成与性能:该数据集与 OpenHermes2.5 等公共资源相结合,其表现优于在类似模型规模上训练的竞争对手,使其成为语言模型训练中的高影响力资源。

主题 4. 创新 AI 应用与工具

- LangGraph Agents 与 LangChain 的语音功能:一段视频教程展示了如何使用 OpenAI 的 Whisper 进行输入并使用 ElevenLabs 进行语音输出,将 LangGraph Agent 转化为语音启用助手。

- OpenRecovery 对 LangGraph 的使用:由 LangChain 重点介绍,该应用在成瘾康复中的使用证明了其实际的适应性和可扩展性。

主题 5. 基准测试与行业分析

- AI 性能与行业洞察:Menlo Ventures 发布了一份关于生成式 AI 演进的报告,强调了顶级用例和集成策略,并指出 Anthropic 在市场中的份额正在增长。

- 模型微调与评估:报告指出,行业正从微调(fine-tuning)转向更先进的 RAG 和 Agentic AI 技术,强调了 LLM 工程师在优化 AI 应用中的价值。

主题 6. 迷因/幽默

- 与 AI 及 OpenAI 的奇遇:@aidan_mclau 幽默地思考了将新语言模型行为归入明确定义的类别的挑战,反映了当前 AI 发展中经常不可预测的本质。

AI Reddit 摘要

/r/LocalLlama 摘要

主题 1. M4 Max 128GB:通过 MLX 以 11 t/s 的速度运行 72B 模型

- M4 Max 128GB 运行 Qwen 72B Q4 MLX,速度达 11 tokens/second。 (Score: 476, Comments: 181): 配备 128GB 内存的 Apple M4 Max 成功以每秒 11 tokens 的速度运行 Qwen 72B Q4 MLX 模型。这一性能指标展示了 Apple silicon 高效处理大型语言模型(LLM)的能力。

- 用户讨论了功耗和散热表现,指出系统在推理过程中功耗高达 190W,且运行温度较高。M4 Max 在实现这一性能的同时,功耗显著低于配备多块 NVIDIA 3090 或 A6000 的同类配置。

- M4 Max 的内存带宽为 546 GB/s,性能为 11 tokens/second,相比 M1 Max(409.6 GB/s 和 6.17 tokens/second)有显著提升。用户成功测试了包括 Qwen 72B、Mistral 128B 以及具有 32k context 窗口的小型编程模型在内的多种模型。

- 讨论对比了组装台式机(仅 GPU 就需约 4000 美元)与 4700 美元 的 M4 Max 笔记本电脑的成本,许多人强调了 Apple 系统在运行本地 LLM 时的便携性优势和完整解决方案特性,特别是在旅行或电力受限的场所。

- Mac 用户:适用于 Apple Silicon (MLX) 的新 Mistral Large MLX 量化版本 (Score: 91, Comments: 23): 一位开发者使用 MLX-LM 创建了针对 Apple Silicon 优化的 Mistral Large 2-bit 和 4-bit 量化版本,其中 q2 版本在 M4 Max 上运行速度达到 7.4 tokens/second,同时占用 42.3GB RAM。这些模型可在 HuggingFace 上获取,并能在 LMStudio 或其他 MLX 兼容系统中运行,其在 M-series 芯片上的性能有望优于 GGUF 模型。

- 用户询问了性能对比,测试显示 MLX 模型在 Apple Silicon 上的运行速度比 GGUF 版本快约 20%,多位用户独立确认了这一点。

- 问题集中在实际使用上,包括如何通过 LMStudio 运行模型,用户可以从 HuggingFace 手动下载并放入 LMStudio cache folder 以供识别。

- 用户讨论了硬件兼容性,特别是关于 M4 Pro 64GB 运行 Mistral Large 变体的能力,并有兴趣将其性能与 Llama 3.1 70B Q4 进行对比。

主题 2. DeepSeek R1-Lite Preview 展示了强大的推理能力

- DeepSeek AI 的 R1-Lite-Preview 展示了它的实力……天哪!!太惊人了!! (Score: 146, Comments: 19): DeepSeek 的 R1-Lite-Preview 模型展示了先进的能力,尽管帖子正文中未提供具体示例或细节。帖子标题表达了对模型性能的热情,但缺乏关于其实际能力或 benchmarks 的实质性信息。

- Base32 解码能力在不同模型之间差异显著,GPT-4 表现成功,而其他模型则表现挣扎。讨论强调大多数开源模型在处理密码(ciphers)方面表现不佳,尽管由于 base64 在训练数据中非常普遍,它们处理 base64 的效果很好。

- 在 DeepSeek 的 R1-Lite-Preview 中注意到了 MLX 知识空白,这表明其参数容量有限,无法涵盖全面的领域知识。这一限制反映出该模型可能比其他当代模型规模更小。

- 对 tokenization 限制的讨论解释了模型在编码/解码任务中的表现,目前的模型使用基于 token 而非基于字符的处理方式。用户将这种限制比作人类试图计算看不见的原子——这是一种系统限制,而非智力衡量标准。

- DeepSeek R1-Lite 令人印象深刻,甚至让 Qwen 2.5 coder 显得逊色,这就是我这么说的原因,我在最近的 Codeforces 竞赛题目中测试了 R1-Lite(虚拟参赛),它的表现非常……非常出色 (Score: 135, Comments: 44): DeepSeek R1-Lite 在通过虚拟参赛测试的 Codeforces 竞赛编程题目中,展现出优于 Qwen 2.5 的性能。发帖者强调了 R1-Lite 的卓越表现,但未提供具体的指标或详细对比。

- DeepSeek R1-Lite 在不同任务中表现参差不齐——在处理乱序字母 (scrambled letters)和数字加密 (number encryption)方面很成功,但在 Playfair Cipher 上始终失败。用户指出它擅长处理如算法竞赛 (competitive programming)任务等小范围问题,但在现实世界的编程场景中可能会遇到困难。

- R1-Lite 与 Qwen 2.5 的对比测试显示,Qwen 在实际任务中表现更好,有用户报告在 Unity C# 脚本编写和实现射线检测悬挂系统 (raycast suspension system)方面取得了成功。两个模型都能编写俄罗斯方块 (Tetris),Qwen 仅用一次尝试就完成了,而 R1 用了两次。

- 用户强调,在算法竞赛中的成功并不一定能转化为现实世界的编程能力。建议在 atcoder.jp 和 Codeforces 等平台上使用独特的、最近的题目进行测试,以便更好地评估模型。

主题 3. Gemini-exp-1121 凭借增强的 Coding 和 Vision 能力登顶 LMSYS

- Google 发布新模型,登顶 LMSYS 排行榜 (Score: 139, Comments: 53): Google 发布了 Gemini-exp-1121,该模型在 LMSYS 排行榜的编程和视觉任务中获得了最高分。该模型代表了对之前 Gemini 版本的改进,尽管公告中未提供具体的性能指标。

- LMSYS 排行榜的排名备受争议,用户认为 Claude 排名第 7 说明了基准测试的局限性。多位用户报告 Claude 在现实应用中优于竞争对手,特别是在编程和技术任务方面。

- Gemini 的新视觉能力可以通过处理完整的图像上下文来实现直接的漫画翻译 (manga translation),相比传统的 OCR + 翻译 流程具有优势。这种方法能更好地处理依赖上下文的元素,如角色性别和专业术语。

- Google 和 OpenAI 之间出现了一种竞争模式,两家公司不断发布模型以争夺排行榜首位。Gemini-exp-1121 的发布似乎是紧随 OpenAI 最近发布模型后的战略举措。

主题 4. Allen AI 的 Tulu 3:基于 Llama 3.1 的开源指令模型

- Tülu 3 —— 一系列具有完全开放数据、评估代码和训练算法的 SOTA 指令模型 (Score: 117, Comments: 23): Allen AI 发布了 Tülu 3,这是一个开源指令遵循模型 (instruction-following models) 的集合,提供了对训练数据、评估代码和训练算法的完整访问权限。这些模型旨在提升 state-of-the-art 性能,同时在开发过程中保持完全透明。

- Tülu 3 是 Llama 3.1 微调 (fine-tunes) 的集合,而非从零开始构建的模型,提供 8B 和 70B 版本。社区成员已经创建了 GGUF 量化版本 和 4-bit 变体 以提高易用性。

- 性能基准测试显示,8B 模型 超过了 Qwen 2.5 7B Instruct,而 70B 模型 优于 Qwen 2.5 72B Instruct、GPT-4o Mini 和 Claude 3.5 Haiku。发布内容包括全面的训练数据、奖励模型和超参数。

- Allen AI 宣布其完全开源的 OLMo 模型系列将在本月获得更新。关于 Tülu 3 训练过程的详细讨论可以在新发布的播客中找到。

主题 5. NVIDIA KVPress:开源 KV Cache 压缩研究

- NVIDIA 发布用于 KV 压缩研究的新仓库 (Score: 48, Comments: 7): NVIDIA 发布了一个名为 kvpress 的开源库,旨在解决大型语言模型中的 KV cache 压缩 挑战。例如,llama 3.1-70B 模型在 float16 精度下处理 1M tokens 需要 330GB 的内存。该库基于 🤗 Transformers 构建,引入了一种新的 “expected attention” 方法,并为研究人员开发和基准测试压缩技术提供了工具,代码托管在 kvpress。

- kvpress 目前不支持 KV cache 量化,但根据 FAQ,它可以与剪枝策略结合使用,在从 float16 转换为 int4 时,有望实现高达 4 倍的压缩。

- 这是提供的评论中唯一有意义的讨论点——其他评论和回复没有增加实质性的总结信息。

其他 AI Subreddit 回顾

r/machinelearning, r/openai, r/stablediffusion, r/ArtificialInteligence, /r/LLMDevs, /r/Singularity

主题 1. Flux.1 工具套件扩展了 SD 的功能

- FLUX 重大新闻发布。这非常重要。使用 FLUX DEV 的 Inpainting 和 Outpainting 效果优于付费版 Adobe Photoshop。FLUX 团队发布了类似 Canny 和 Depth 的 ControlNet,以及图像变体和概念迁移(如风格迁移或 0-shot 面部迁移)。 (Score: 739, Comments: 194): Black Forest Labs 发布了其 Flux.1 Tools 控制套件,其具备的 inpainting 和 outpainting 能力可与 Adobe Photoshop 竞争,同时还包含了针对 Canny 和 Depth 控制的 ControlNet 风格功能。此次发布还包括 image variation(图像变体)和 concept transfer(概念迁移)工具,支持 style transfer(风格迁移)和 zero-shot face transfer(zero-shot 面部迁移)功能。

- ComfyUI 在发布首日即提供了对 Flux Tools 的支持,并附带详细的实现示例。完整模型需要 27GB VRAM,不过 LoRA 版本 已在 Huggingface 上提供。

- 社区反馈表明其 outpainting 能力非常强大,可与 Midjourney 媲美,用户尤其称赞 Redux IP adapter 的性能和强度。这些工具已公开用于 FLUX DEV 模型,实现细节见 Black Forest Labs。

- 用户批评了标题党的发布方式,并要求更直接的技术沟通,同时也注意到 Civitai 上已提供 FP8 版本,以满足较低 VRAM 的需求。

- ComfyUI 首日支持 FLUX 工具 (Score: 149, Comments: 26): ComfyUI 在发布当天立即增加了对 FLUX Tools 的支持,尽管帖子中未提供集成的具体细节。

- ComfyUI 用户报告已成功集成 Flux Tools,SwarmUI 也按照 GitHub 文档为所有模型变体提供原生支持。

- 用户发现 Redux 效果过强且无法与 FP8_scaled 模型配合使用的问题,但通过调整 ConditioningSetTimestepRange 和 ConditioningSetAreaStrength 参数有所改善。建议使用 ImageCompositeMasked 或 Inpaint Crop/Stitch 节点的正确合成工作流,以防止 VAE 降级。

- 该实现支持 Redux Adapter、Fill Model 以及 ControlNet Models & LoRAs(特别是 Depth 和 Canny),演示工作流可在 CivitAI 获取。

- Flux Redux 无文本提示词 (评分: 43, 评论: 30): Redux adapter 测试侧重于无文本提示词的图像变体 (image variation) 能力,尽管帖子正文未提供具体细节或结果。

- FLUX.1 Redux 适配器专注于在保持风格和场景的同时生成带有变体的图像,且不会重新生成面部。用户反馈其结果更快、更精确,特别是在更换衣服和背景的 inpainting(局部重绘)功能方面。

- ComfyUI 的实现需要将 sigclip vision model 放置在 models/clip_vision 文件夹中。更新和工作流可以在 ComfyUI 示例页面找到。

- Flux Tools 与 ComfyUI 的集成提供了 ControlNet、变体以及 in/outpainting(局部重绘/扩图)等功能,详见 Black Forest Labs 文档。实现指南可在 ComfyUI 博客查阅。

主题 2. NVIDIA/MIT 发布 SANA:高效的 Sub-1B 参数扩散模型

- SANA 的扩散代码刚刚发布 (评分: 103, 评论: 52): SANA 扩散模型的训练和推理代码已由 NVlabs 在 GitHub 上发布。模型权重预计将在 HuggingFace 的 “Efficient-Large-Model/Sana_1600M_1024px” 路径下提供,但目前尚无法访问。

- SANA 模型的核心特性是能够直接输出 4096x4096 图像,尽管一些用户指出 UltraPixel 和 Cascade 等模型也能实现这一点。该模型有 0.6B 和 1.6B 参数两种尺寸,明显小于 SDXL (2B) 和 Flux Dev (12B)。

- 该模型由 NVIDIA、MIT 和清华大学的研究人员发布,采用 CC BY-NC-SA 4.0 许可证。用户注意到这比 PixArt-Sigma 的 OpenRail++ 许可证更具限制性,但对大公司发布模型权重这一罕见举动表示赞赏。

- 技术讨论集中在该模型的速度优势和微调 (fine-tuning) 潜力上,其中 0.6B 版本被考虑用于特定专业场景。该模型已在 HuggingFace 上线,文件大小为 6.4GB。

- 测试 CogVideoX1.5-5B i2v 模型 (评分: 177, 评论: 51): 社区对 CogVideoX1.5-5B 这一图生视频 (image-to-video) 模型进行了测试和评估讨论。帖子正文未提供关于测试程序或结果的足够上下文细节。

- 该模型的工作流 (workflow) 可在 Civitai 获取,建议分辨率在 720p 以上。根据 Kijai 文档,v1.5 版本仍处于测试阶段,目前仅支持 1344x768。

- 使用 4090 GPU,生成 1024x640 分辨率视频约需 3 分钟,1216x832 约需 5 分钟。配备 24GB VRAM 的 3090 可以在不开启 ‘enable_sequential_cpu_offload’ 功能的情况下运行。

- 技术限制包括 GGUF 版本性能较差且偶尔崩溃、与动漫风格图像不兼容,以及在 Windows 上尝试以 1024x640 分辨率生成 81 帧时可能出现 显存溢出 (OOM) 问题。

主题 3. ChatGPT 4o 11月更新:写作能力提升,测试分数下降

- gpt-4o-2024-11-20 在 MMLU、GPQA、MATH 和 SimpleQA 上的得分低于 gpt-4o-2024-08-06 (得分: 77, 评论: 17): GPT-4o 的 2024 年 11 月更新显示,与 8 月版本相比,在包括 MMLU、GPQA、MATH 和 SimpleQA 在内的多个基准测试中性能有所下降。由于缺乏额外的上下文,无法分析具体的得分差异或下降的潜在原因。

- 根据 lifearchitect.ai 的数据,最新版 GPT-4o 的性能下降显著,GPQA 下降了 13.37%,MMLU 下降了 3.38%。该模型在某些基准测试中的得分现在低于 Claude 3.5 Sonnet、Llama 3.1 405B、Grok 2,甚至低于 Grok 2 mini。

- 多位用户认为 OpenAI 正在针对创意写作和用户吸引力进行优化,而非事实准确性,这可能解释了基准测试性能下降的原因。这种权衡导致创意任务有了“令人惊叹”的改进,但牺牲了客观正确性。

- 用户表达了对专门模型命名(如 “gpt-4o-creative-writing” 或 “gpt-4o-coding“)的渴望,并认为这些变化是由成本优化驱动的。Anthropic 的 Sonnet 模型也出现了类似的专业化趋势,显示出特定任务的改进和退步。

- OpenAI 的新更新使其成为史上最伟大的作词人 (ChatGPT + Suno) (得分: 57, 评论: 27): OpenAI 发布了一项更新,当与 Suno 结合使用时,增强了其在歌词方面的创意写作能力。帖子正文中未提供额外的上下文或具体的改进细节。

- 用户将该 AI 的说唱风格与包括 Eminem、Notorious B.I.G.、Talib Kweli 和 Blackalicious 在内的多位艺术家进行比较,一些人认为它超越了 98% 的人类说唱。原始来源通过 Twitter/X 分享。

- 技术改进似乎集中在 LLM 的押韵能力上,同时保持连贯的叙事结构。多位用户注意到 AI 在提供有意义内容的同时保持一致模式的能力。

- 多条评论对 AI 的快速进步表示担忧,一位用户指出,人类不仅在数学和国际象棋方面被超越,现在在说唱等创意追求方面也被超越。这种情绪暗示了对 AI 能力的重大忧虑。

主题 4. 需求压力迫使 Claude 免费用户受限于 Haiku

- 免费账户现在(永久性地?)被路由至 3.5 Haiku (得分: 52, 评论: 40): Claude 免费账户现在默认使用 Haiku 模型,这是由用户 u/Xxyz260 通过对 2023 年 10 月 7 日袭击事件的特定提示词测试发现的。这一变化似乎并未公布,用户报告在 18 小时内间歇性地访问过 Sonnet 3.5,随后又回退到 Haiku,这表明 Anthropic 可能正在进行负载均衡测试。

- 用户通过测试确认免费账户接收的是 Haiku 3.5 而非 Haiku 3,测试结果中的证据表明,模型知识来源于系统提示词而非模型本身。

- 一个核心担忧是,Pro 用户在耗尽 Sonnet 额度后无法访问最新的 Haiku 3.5 模型,而免费用户却默认获得了更新版本。

- 关于 ChatGPT 相比 Claude 变得更具吸引力的讨论(特别是在编程任务方面),用户对 Anthropic 处理服务变更的方式以及缺乏透明度表示沮丧。

- 他们打算解决 Claude 服务器过载的问题吗? (Score: 27, Comments: 46): 一位用户报告称,由于免费账户的服务器可用性问题,无法访问 Claude Sonnet 3.5,同时发现 Claude Haiku 在遵循指令方面不可靠。该用户表示,尽管他们将 Claude 广泛用于研究、创意写作和内容创作,但作为一名大学生,每月 $20 的 Claude Pro 订阅费用过高。

- Claude Sonnet 的免费使用受服务器负载影响严重,尤其是在美国办公时间,有用户报告长达 14 小时无法使用。欧洲用户指出在他们的白天时段访问情况较好。

- 甚至付费用户也遇到了过载问题,这表明 Anthropic 的服务器容量限制非常显著。除非公司扩大容量或训练成本下降,否则免费用户的情况不太可能改善。

- 关于 Haiku 模型版本(3.0 vs 3.5)存在困惑,用户分享了对比截图并注意到移动应用和网页 UI 显示不一致,这暗示可能存在 A/B 测试或 UI Bug。

AI Discord 摘要

由 O1-mini 生成的摘要之摘要的总结

主题 1. 新 AI 模型凭借增强功能实现跨越式发展

- Tülu 3 发布,性能超越 Llama 3.1: Nathan Lambert 宣布发布 Tülu 3,这是一个开放的前沿模型,通过引入一种新型的带有可验证奖励的强化学习 (Reinforcement Learning with Verifiable Rewards) 方法,在多项任务中表现优于 Llama 3.1。这一进步确保了在实际应用中更高的准确性和可靠性。

- Gemini Experimental 1121 登顶 Chatbot Arena 基准测试: Google DeepMind 的 Gemini-Exp-1121 在 Chatbot Arena 中并列第一,超越了 GPT-4o-1120。其在代码编写和推理能力方面的显著提升突显了 AI 模型性能的快速进步。

- Qwen 2.5 在代码编辑方面达到 GPT-4o 级别性能: 开源模型如 Qwen 2.5 32B 在 Aider 的代码编辑基准测试中表现出极具竞争力的性能,与 GPT-4o 持平。用户强调了模型量化 (Quantization) 的关键作用,并指出不同量化级别会导致显著的性能差异。

主题 2. 先进的微调技术提升模型效率

- Unsloth AI 引入视觉支持,微调速度翻倍: Unsloth 为 LLaMA、Pixtral 和 Qwen 等模型推出了视觉支持,通过将微调速度提高 2 倍并将显存占用减少 70%,增强了开发者的能力。这使得 Unsloth 在基准测试中领先于 Flash Attention 2 (FA2) 和 Hugging Face (HF)。

- 上下文位置编码 (CoPE) 增强模型表达能力: 上下文位置编码 (Contextual Position Encoding, CoPE) 根据 Token 上下文而非固定计数来调整位置编码,从而产生更具表达能力的模型。该方法改进了对 Flip-Flop 等选择性任务的处理,而传统的位置编码在这些任务中表现不佳。

- AnchorAttention 为长上下文模型减少超过 50% 的训练时间: 一篇新论文介绍了 AnchorAttention,这是一种即插即用的解决方案,在增强长上下文性能的同时,将训练时间缩短了 50% 以上。它兼容 FlashAttention 和 FlexAttention,适用于视频理解等应用场景。

主题 3. 硬件解决方案和性能优化驱动 AI 效率

- 基于云端的 GPU 租赁以每月 25-50 美元的价格提升模型速度:转向云服务器托管模型每月成本为 $25-50,且与本地硬件相比显著提升了模型速度。用户发现云端托管的 GPU 更具性价比且性能更强,避免了本地部署(on-premises)的局限性。

- YOLO 在实时视频目标检测中表现卓越:YOLO 仍然是视频目标检测的首选,并由 YOLO-VIDEO 资源提供支持。持续的策略旨在优化 YOLO 在实时处理场景中的性能。

- MI300X GPU 在长时间运行时遇到严重的挂起问题:成员报告称,在配合 axolotl 进行长达 12-19 小时 的长时间运行时,MI300X GPU 会出现间歇性 GPU 挂起,主要发生在 6 小时 之后。这些稳定性问题正在 GitHub Issue #4021 中进行跟踪,包括 loss 和 learning rate 等详细指标。

主题 4. API 和集成助力自定义部署与增强

- Hugging Face Endpoints 支持自定义 Handler 文件:Hugging Face Endpoints 现在允许使用 handler.py 文件部署自定义 AI 模型,从而实现定制化的预处理和后处理。实现 EndpointHandler 类可确保根据特定需求进行灵活且高效的模型部署。

- Model Context Protocol (MCP) 增强本地交互:Anthropic 的 Claude Desktop 现在支持 Model Context Protocol (MCP),能够通过 Python 和 TypeScript SDK 增强与模型的本地交互。虽然远程连接功能尚待开发,但初始支持已包含多种 SDK,引发了对扩展功能的关注。

- OpenRouter API 文档已澄清以实现无缝集成:用户对 OpenRouter API 文档中关于 context window 的功能表示困惑。建议进行改进以提高清晰度,协助与 LangChain 等工具的无缝集成,并优化高上下文提示词的 provider selection。

主题 5. 全面的模型评估和基准测试对比揭示 AI 进展

- Perplexity Pro 在特定任务的准确性上优于 ChatGPT:用户对比了 Perplexity 与 ChatGPT,指出 Perplexity 被认为更准确,并在特定功能上具有优势。一位参与者强调,Perplexity 的某些功能在流行度激增之前就已经开发完成,凸显了其强大的能力。

- SageAttention 通过 8-Bit 量化提升注意力机制效率:SageAttention 方法为 attention mechanisms 引入了一种高效的 8-bit quantization 方案,在保持 accuracy 的同时提升了每秒操作数。这一改进解决了传统上与长序列相关的高计算复杂度问题。

- DeepSeek-R1-Lite-Preview 在编程基准测试中展示了卓越的推理能力:DeepSeek 推出了 DeepSeek-R1-Lite-Preview,在编程基准测试中展示了令人印象深刻的 reasoning capabilities。像 Zhihong Shao 这样的用户赞扬了它在编程和数学挑战中的表现,突出了其应用价值。

第 1 部分:Discord 高层级摘要

Unsloth AI (Daniel Han) Discord

- Unsloth 推出视觉支持:Unsloth 正式推出了 vision support,支持对 LLaMA、Pixtral 和 Qwen 等模型进行微调,显著增强了开发者的能力。

- 该功能将微调速度提升了 2x,并减少了 70% 的内存占用,使 Unsloth 在基准测试中领先于 Flash Attention 2 (FA2) 和 Hugging Face (HF)。

- Qwen 和 LLaMA 微调增强:用户正在探索微调 Qwen 和 LLaMA 的 Base 及 Instruct 模型的可行性,讨论集中在创建和合并 LoRAs。

- Unsloth 的视觉支持通过将 4-bit LoRAs 转换回 16-bit 来简化合并过程,从而优化了微调流程。

- Llama 3.2 Vision 亮相:Unsloth 现已支持 Llama 3.2 Vision 模型,实现了 2x 更快 的训练速度和 70% 的内存节省,同时支持 4-8x 更长的 context lengths。

- 此次发布包括用于 Radiography 和 Maths OCR to LaTeX 等任务的 Google Colab notebooks,可通过 Colab 链接 访问。

- AnchorAttention 提升长上下文训练:一篇新论文介绍了 AnchorAttention,这是一种增强长上下文性能并将训练时间缩短 50% 以上的方法。

- 该解决方案兼容 FlashAttention 和 FlexAttention,适用于视频理解等应用。

- 训练 Checkpoint 选择策略:关于选择合适训练 Checkpoint 的讨论揭示了多种方法,一些成员选择广泛使用 Checkpoint,而另一些成员则主张根据特定指标进行战略性选择。

- 参与者强调了性能基准测试的重要性,并分享了优化训练工作流中 Checkpoint 选择的经验。

Interconnects (Nathan Lambert) Discord

- Tülu 3 发布创新:Nathan Lambert 宣布发布 Tülu 3,这是一个在多项任务上超越 Llama 3.1 的开源前沿模型,并结合了新型的 Reinforcement Learning with Verifiable Rewards 方法。

- 新模型仅针对准确的生成结果奖励算法,增强了其在实际应用中的性能和可靠性。

- Nvidia 的 AI Wall 担忧:来自 The Economist 的一篇文章报道称,尽管社区普遍存在怀疑态度,但 Nvidia 的 CEO 淡化了对 AI 已“撞墙”的担忧。

- 这一立场加剧了关于 AI 进步当前轨迹 以及对持续创新迫切需求的讨论。

- Gemini 在 Chatbot Arena 的表现:Google DeepMind 的 Gemini-Exp-1121 在 Chatbot Arena 中并列第一,在最近的基准测试中超越了 GPT-4o-1120。

- Gemini-Exp-1121 在 coding 和 reasoning 能力方面表现出显著提升,突显了 AI 模型性能的快速进步。

- Reinforcement Learning with Verifiable Rewards:Tülu 3 采用了一种名为 Reinforcement Learning with Verifiable Rewards 的新技术,该技术在受限的数学问题上训练模型并奖励正确输出,详见 Nathan Lambert 的 推文。

- 该方法旨在通过在训练期间严格激励正确回答,确保模型生成结果具有更高的准确性。

- Anthropic 的 Model Context Protocol:Anthropic 的 Claude Desktop 现在支持 Model Context Protocol (MCP),能够通过 Python 和 TypeScript SDK 增强与模型的本地交互。

- 虽然初步支持包括各种 SDK,但远程连接功能尚待未来更新,这引发了人们对扩展功能的兴趣。

HuggingFace Discord

- SageAttention 增强了 Attention 机制:SageAttention 方法为 attention 机制引入了一种高效的量化方法,通过优化计算资源提升了每秒操作数。

- 该技术在保持准确性的同时,解决了与长序列相关的高复杂度问题,使其成为对传统方法的一项极具价值的改进。

- 使用自定义 Handler 文件部署 AI 模型:Hugging Face Endpoints 现在支持使用 handler.py 文件部署自定义 AI 模型,从而实现定制化的预处理和后处理。

- 实现 EndpointHandler 类可确保模型部署的灵活性和高效性,满足特定的部署需求。

- 开发出自动化 AI 研究助手:一个新的 Python 程序将本地 LLMs 转换为自动化网页研究员,根据用户查询提供详细的摘要和来源。

- 该助手将查询系统地分解为子主题,提高了从各种在线来源收集和分析信息的效率。

- YOLO 在视频目标检测中表现出色:YOLO 仍然是视频目标检测的首选,YOLO-VIDEO 资源为有效实现提供了支持。

- 讨论强调了优化 YOLO 在视频流中性能的持续策略,解决了与实时处理相关的挑战。

- MOUSE-I 简化了 Web 服务部署:MOUSE-I 能够利用 AI 自动化在 60 秒内将简单的 prompt 转换为全球部署的 Web 服务。

- 该工具非常适合寻求快速部署解决方案而无需进行大量手动配置的初创公司、开发人员和教育工作者。

OpenAI Discord

- Perplexity 在准确性上优于 ChatGPT:用户将 Perplexity 与 ChatGPT 进行了比较,强调 Perplexity 被认为更准确,并在特定功能上具有优势。

- 一位参与者指出,Perplexity 的某些功能在流行度飙升之前就已经在开发中。

- GPT-4 提升产品分类效率:一位成员分享了他们使用 GPT-4 的 prompt 对产品进行分类的经验,涵盖了从杂货到服装的各类目,效果显著。

- 他们指出,虽然分类效果很好,但由于 prompt 结构较长,token 使用量很高。

- GPT-4o 增强了基于图像的分类:一位成员描述了使用 GPT-4o 根据标题和图像对产品进行分类,通过全面的 prompt 结构实现了极佳的效果。

- 然而,他们指出大量的 token 使用量对其系统的可扩展性构成了挑战。

- 通过 Prompt 优化简化流程:讨论集中在如何在保持分类任务中 prompt 有效性的同时,最小化 token 使用量。

- 建议包括探索 prompt 缓存等方法,以简化流程并减少冗余。

- Prompt 缓存降低 Token 消耗:成员们建议实施 prompt 缓存技术,以减少分类工作流中重复的输入 token。

- 他们建议咨询 API 相关资源,以进一步协助优化 token 使用量。

LM Studio Discord

- Hermes 3 超出预期:一位成员青睐 Hermes 3,因其卓越的写作技巧和对 Prompt 的遵循能力,但指出在高上下文(16K+)下会出现短语重复。

- 这一偏好凸显了 Hermes 3 的进步,但也暴露了其在高效处理长上下文方面的局限性。

- 基于云端的 GPU 租赁:转向云服务器进行模型托管的成本为 每月 25-50 美元,且与本地硬件相比提升了模型速度。

- 用户发现云端托管的 GPU 具有更高的性价比和性能,避免了本地部署的限制。

- LLM GPU 对比:成员们对比了 AMD 和 NVIDIA GPU,最近的驱动更新影响了 AMD 的 ROCM 支持。

- 共识倾向于选择 NVIDIA,因为它在 AI 应用中具有更好的软件兼容性和支持。

- 混合 GPU 配置阻碍性能:由于共享资源限制,包含 1x 4090 + 2x A6000 GPU 的配置表现不如其他配置,降低了 Token 生成速率。

- 用户强调,配置中最慢的 GPU(例如 4090)可能会限制整体处理速度。

- 2000 美元本地 LLM 服务器的可行性:在 2000 美元 预算下为 2-10 个用户 搭建本地 LLM 服务器,在单 GPU 并发方面面临挑战。

- 开发者建议使用云解决方案,以缓解与预算和旧硬件相关的性能瓶颈。

aider (Paul Gauthier) Discord

- Qwen 2.5 性能媲美 GPT-4o:像 Qwen 2.5 32B 这样的开源模型在 Aider 的代码编辑基准测试中表现出极具竞争力的性能,与 GPT-4o 相当,而效果最差的版本则与 GPT-3.5 Turbo 持平。

- 用户强调了模型 Quantization(量化)的重大影响,指出不同的量化级别会导致显著的性能差异。

- Aider v0.64.0 引入新功能:最新的 Aider v0.64.0 版本包含了用于 Prompt 编写的新

/editor命令,并全面支持 gpt-4o-2024-11-20。- 此更新增强了 Shell 命令的清晰度,允许用户查看确认信息并无缝选择加入 Analytics。

- Gemini 模型增强 AI 能力:截至 2024 年 11 月 21 日,Gemini Experimental Model 提供了改进的 Coding、Reasoning 和 Vision 能力。

- 用户正在利用 Gemini 的高级功能来实现更复杂的 AI 交互并提高编码效率。

- 模型量化影响讨论:正如 Aider 的量化分析所强调的,Model Quantization 显著影响 AI 性能,尤其是在代码编辑方面。

- 社区讨论了如何优化量化级别,以有效平衡性能和资源利用率。

- DeepSeek-R1-Lite-Preview 提升推理能力:DeepSeek 推出了 DeepSeek-R1-Lite-Preview,在代码基准测试中展示了令人印象深刻的推理能力,详见其最新发布。

- 像 Zhihong Shao 这样的用户称赞了它在编码和数学挑战中的表现,强调了其实际应用价值。

OpenRouter (Alex Atallah) Discord

- OpenRouter 发布五个新模型:OpenRouter 推出了具有改进文本能力的 GPT-4o,以及 Mistral Large (link)、Pixtral Large (link)、Grok Vision Beta (link) 和 Gemini Experimental 1114 (link)。

- 这些模型提升了各项 Benchmark 的表现,为 AI 工程师提供了可供探索的高级功能。

- Mistral Medium 已弃用,建议使用替代方案:Mistral Medium 模型已被弃用,由于 priority not enabled 导致访问错误。

- 建议用户切换到 Mistral-Large、Mistral-Small 或 Mistral-Tiny 以继续使用服务而不受干扰。

- Gemini Experimental 1121 发布并带来升级:Gemini Experimental 1121 模型已发布,在 coding、reasoning 和 vision 能力方面有所增强。

- 尽管与 LearnLM 模型共享配额限制,社区仍渴望评估其性能和潜在应用。

- OpenRouter API 文档澄清:用户对 OpenRouter API 文档中关于 context window 功能的描述表示困惑。

- 建议提高文档清晰度,以协助与 LangChain 等工具的无缝集成。

- 请求为 Claude 3.5 提供自定义 Provider Key:一名成员请求为 Claude 3.5 Sonnet 提供 custom provider key,因为在主 Claude app 上的使用额度已耗尽。

- 该请求旨在提供一种替代方案来管理使用限制并提升用户体验。

Stability.ai (Stable Diffusion) Discord

- Flux 的 VRAM 烦恼:成员们讨论了有效使用 Flux 的资源需求,指出它需要大量的 VRAM 且生成图像速度较慢。Black Forest Labs 发布了 FLUX.1 Tools,增强了对其基础模型的控制和可引导性。

- 一位成员强调,使用 Loras 可以增强 Flux 在 NSFW 内容方面的输出,尽管 Flux 并非专门为此目的训练。

- 优化 SDXL 性能:对于 SDXL,应用

--xformers和--no-half-vae等最佳实践可以提高在 12GB VRAM 系统上的性能。成员们指出,SDXL 的衍生模型 Pony 需要特殊 token,并且与 XL Loras 存在兼容性问题。- 这些配置有助于提高 SDXL 效率,而 Pony 的局限性突显了模型兼容性方面的挑战。

- 使用 SDXL Lightning 增强图像提示词:一位用户询问如何通过 Python 在 SDXL Lightning 中使用图像提示词 (image prompts),特别是将照片插入特定环境中。这展示了社区对结合图像提示词与多样化背景以提升生成能力的兴趣。

- 讨论表明,利用 Python 集成来增强 SDXL Lightning 在图像生成任务中的灵活性已成为一种趋势。

- 缓解生成时间过长的问题:在使用各种模型时,随机出现的生成时间过长令人沮丧,引发了对潜在原因的讨论。成员们推测,内存管理问题(如将资源加载到 VRAM)可能会导致这些减速。

- 解决这些延迟对于改善用户体验至关重要,建议指向优化 VRAM 使用以提高生成速度。

- 保障 AI Model 使用安全:有成员对收到索要钱包地址等个人信息的异常请求表示担忧,导致成员怀疑社区内存在诈骗者。鼓励用户报告此类事件以维护安全环境。

- 社区强调安全性,寻求通过主动应对与 AI model 滥用相关的潜在威胁来保护其成员。

Eleuther Discord

- 上下文位置编码 (CoPE) 提升模型适应性:一项关于 Contextual Position Encoding (CoPE) 的提案建议根据 token 上下文而非固定计数来调整位置编码,从而产生更具 表现力的模型 (expressive models)。该方法旨在改进对 Flip-Flop 等选择性任务的处理,而传统方法在这些任务中表现不佳。

- 成员们讨论了 CoPE 增强位置编码适应性的潜力,这可能在需要细致理解 token 关系的复杂 NLP 任务中带来更好的性能。

- Forgetting Transformer 在长上下文任务中超越传统架构:Forgetting Transformer 是一种引入了遗忘门 (forget gate) 的变体,与标准架构相比,在 长上下文任务 (long-context tasks) 上表现出更好的性能。值得注意的是,该模型消了对位置嵌入 (position embeddings) 的需求,同时在扩展训练上下文中保持有效性。

- Forgetting Transformer 的引入为通过更有效地管理长期依赖关系来提升 LLM 性能 指明了一个充满希望的方向。

- Sparse Upcycling 通过推理权衡提升模型质量:最近的一篇 Databricks 论文 评估了 sparse upcycling 与持续预训练在增强模型方面的权衡,发现 sparse upcycling 能带来更高的 模型质量。然而,这种改进伴随着 40% 的推理时间增加,凸显了部署方面的挑战。

- 研究结果强调了在 模型性能 与实际部署约束之间取得平衡的难度,强调了模型开发中战略优化方法的必要性。

- Scaling Laws 以极低的训练成本预测模型性能:最近的一篇 论文 介绍了一种观察方法,利用约 100 个公开可用的模型,在不进行直接训练的情况下开发 scaling laws,从而能够根据 规模 (scale) 预测语言模型的性能。该方法突出了训练 效率 (efficiency) 的差异,提出性能取决于一个低维的能力空间。

- 研究表明,scaling law 模型 虽然成本高昂,但仍远低于训练完整目标模型的成本;据报道,Meta 在此类预测上的支出仅为目标模型预算的 0.1% 到 1%。

- lm-eval 增强了剪枝模型的基准测试:一位用户询问当前版本的 lm-eval 是否支持剪枝模型(特别是使用 WANDA 的模型)的 zero-shot 基准测试,并遇到了库版本过旧的问题。讨论建议查阅文档以了解现有的限制。

- 为了解决与 Groq API 的集成问题,建议在

OPENAI_API_KEY环境变量中设置 API key,这成功解决了无法识别 API key 参数的问题。

- 为了解决与 Groq API 的集成问题,建议在

Perplexity AI Discord

- Perplexity Pro 推出高级功能:成员们讨论了 Perplexity Pro 的各项功能,强调了 Pro 用户可以使用更先进的 models,以此将其与 ChatGPT 区分开来。

- 讨论中包含了关于 搜索 (search) 和 工具集成 (tool integration) 的见解,这些功能提升了用户体验。

- 宝可梦数据助力新型 AI 模型:一段 YouTube 视频 探讨了如何利用 Pokémon 数据 开发新型 AI 模型,提供了关于游戏领域技术进步的见解。

- 这可能会改变数据在 AI 应用中的利用方式。

- NVIDIA 的 Omniverse Blueprint 变革 CAD/CAE:一位成员分享了关于 NVIDIA Omniverse Blueprint 的见解,展示了其在设计和模拟领域对 CAD 和 CAE 的变革潜力。

- 许多人对其如何将先进技术整合到传统工作流中感到兴奋。

- 讨论“自带 API Key”模式的采用:一位成员询问了关于 自带 API key (bring your own API key) 构建基于 Perplexity 的替代平台的许可问题,并概述了安全的数据管理实践。

- 这种方法涉及将用户提供的 key 进行 加密 并 存储在 cookies 中,这引发了关于是否符合 OpenAI 标准 的疑问。

- 增强前端应用中的会话管理:针对简化请求,一位用户通过将 会话管理 (session management) 类比为 存储 session ID 的 cookies,解释了 Web 应用中的会话管理。

- 讨论强调了用户身份验证如何依赖于验证会话,而不是直接存储敏感数据。

Latent Space Discord

- Truffles 设备引起关注:被描述为“白色云状半透明物体”的 Truffles 设备支持 LLM 的自托管。欲了解更多信息,请访问 Truffles。

- 一名成员幽默地称其为“发光的乳房植入物”,突显了其独特的外观。

- Vercel 收购 Grep 以增强代码搜索:Vercel 宣布收购 Grep,以增强开发者在超过 500,000 个公共仓库中搜索代码的工具。

- Grep 的创始人 Dan Fox 将加入 Vercel 的 AI 团队以推进这一能力。

- Tülu 3 在任务表现上超越 Llama 3:经过两年开发的 Tülu 3,通过新的 SFT 数据和优化技术,在特定任务上优于 Llama 3.1 Instruct。

- 项目负责人对他们在 RLHF 方面的进展感到兴奋。

- Black Forest Labs 发布 Flux Tools:Black Forest Labs 推出了 Flux Tools,具有用于图像处理的 inpainting 和 outpainting 功能。用户可以在 Replicate 上运行它。

- 该套件旨在为其 text-to-image 模型增加可控性。

- Google 发布 Gemini API 实验性模型:Gemini 发布了新的实验性模型,增强了编程能力。

- 详情请参阅 Gemini API 文档。

Nous Research AI Discord

- DeepSeek R1-Lite 提升 MATH 性能:传闻称 DeepSeek R1-Lite 是一个拥有 2.4B 激活参数 的 16B MOE 模型,根据一条 推文,它将 MATH 分数从 17.1 显著提升至 91.6。

- 由于成员们对 微信公告 表示怀疑,认为如此巨大的性能跨越可行性存疑,因此引发了争议。

- Llama-Mesh 论文引起关注:一名成员建议阅读 llama-mesh 论文,称赞其见解在群组中“相当不错”。

- 这一建议是在关于推进 AI 架构和协作研究的更广泛对话中提出的。

- 多 Agent 框架面临输出多样性限制:有人担心,在像“AI 企业家”这样的多 Agent 框架中使用反 Token 化输出,可能会因为丢弃了 KV caches 而导致 隐藏信息丢失。

- 这种潜在的信息丢失可能是导致此类系统中观察到的 输出多样性受限 的原因之一。

- Soft Prompts 落后于 Fine Tuning:Soft prompts 往往被 fine tuning 和 LoRA 等技术掩盖,后者被认为在开源应用中更有效。

- 参与者强调,soft prompts 存在泛化能力有限的问题,并且在性能和优化方面需要权衡。

- CoPilot Arena 发布初始排名:CoPilot Arena 的首届结果在 LMarena 的博客 上揭晓,显示出参与者之间竞争激烈。

- 然而,该分析仅考虑了旧版本的 Sonnet,引发了关于在比赛中使用过时模型所产生影响的讨论。

GPU MODE Discord

- Triton Kernel 调试与 GEMM 优化:用户解决了 Triton interpreter 的准确性问题,并讨论了通过 block size 调整和 swizzling 技术实现的性能提升,参考了 triton.language.swizzle2d 等工具。

- Triton GEMM 在 ROCm 上表现出的 无冲突 (conflict-free) 性能令人惊讶,引发了关于优化 GEMM 操作以提高计算效率的讨论。

- 行优先顺序的 cuBLAS 矩阵乘法:重点讨论了

cublasSgemm面临的挑战,特别是关于行优先 (row-major) 与列优先 (column-major) 顺序的操作,详见相关的 Stack Overflow 帖子。- 用户辩论了在非方阵矩阵乘法中使用

CUBLAS_OP_N与CUBLAS_OP_T的影响,并指出了与现有代码库的兼容性问题。

- 用户辩论了在非方阵矩阵乘法中使用

- MI250 GPU 上的 ROCm 编译与 FP16 GEMM:开发者报告了使用 ROCm 的

make命令时编译时间过长的问题,尝试调整-j标志但改进有限。- 关于 MI250 GPU 上 FP16 GEMM (v3) 的输入形状变换存在困惑,导致用户请求澄清共享内存 (shared memory) 和输入形状的相关问题。

- 训练后 (Post-Training) AI 技术的进展:发布了一项新的综述 Tulu 3,涵盖了 RL 中的人类偏好 (Human Preferences in RL) 和持续学习 (Continual Learning) 等训练后方法。

- 讨论了关于 Constitutional AI 和递归摘要 (Recursive Summarization) 框架的研究,强调了利用人类反馈来增强任务性能的模型。

Notebook LM Discord Discord

- NotebookLM 的 GitHub 遍历限制:用户报告称 NotebookLM 难以通过输入仓库主页来遍历 GitHub 仓库,因为它缺乏网站遍历能力。一位成员建议将站点转换为 Markdown 或 PDF 以改进处理效果。

- 无法直接处理网站使得使用 NotebookLM 进行仓库分析变得复杂,导致用户不得不采用手动内容转换等变通方法。

- 音频提示词 (Audio Prompt) 生成的增强:一位用户提议通过提供特定的提示词来增强 NotebookLM,以生成更具影响力的音频输出,从而改善解释效果和主题理解。

- 正如社区所讨论的,该策略旨在通过更清晰的音频内容促进对指定主题的深入理解。

- 为特定任务集成多个 LLM:社区成员分享了针对特定需求定制的使用多个大语言模型 (LLM) 的工作流,并对 NotebookLM 的生成能力表示赞赏。

- 这种方法强调了结合各种 AI 工具来支持基于对话的项目(如用户博客文章中所述)的有效性。

- ElevenLabs 在文本转语音 (TTS) AI 领域的统治地位:讨论强调 ElevenLabs 是领先的文本转语音 AI,表现优于 RLS 和 Tortoise 等竞争对手。一位用户回忆了在该初创公司融资轮之前的早期体验。

- ElevenLabs 对语音合成和无脸视频创作的影响被强调为行业内的变革性工具。

- NotebookLM 的稳定性与安全标记 (Safety Flags) 问题:用户注意到 NotebookLM 内部的安全标记和不稳定性有所增加,导致功能受限和任务受阻。

- 社区成员建议通过私信 (DM) 提供示例以便调试,并将这些瞬态问题归因于正在进行的应用程序改进。

LlamaIndex Discord

- 使用 LlamaIndex 和 Redis 构建 AI Agent 架构:参加即将于 12 月 12 日举行的网络研讨会,学习如何使用 LlamaIndex 和 Redis 构建 agentic systems 以分解复杂任务。

- 参与者将了解降低成本、优化延迟的最佳实践,并获得关于语义缓存 (semantic caching) 机制的见解。

- 使用 Memgraph 和 LlamaIndex 构建知识图谱:学习如何设置 Memgraph 并将其与 LlamaIndex 集成,从而从非结构化文本数据中构建知识图谱 (knowledge graph)。

- 本次会议将探讨对构建的图谱进行自然语言查询,以及有效可视化连接的方法。

- 使用 LlamaParse 进行 PDF 表格提取:一位成员推荐使用 LlamaParse 从 PDF 文件中提取表格数据,并强调了其在实现最优 RAG 方面的有效性。

- 分享了一个提供信息的 GitHub 链接,详细介绍了其解析功能。

- Create-Llama 前端配置:一位用户询问了寻求 Create-Llama 帮助的最佳频道,特别是关于在选择 Express 框架时,新版本中缺少 Next.js 前端选项的问题。

- 另一位参与者确认可以直接在频道中发布查询以获得团队支持。

- 弃用 Llama-Agents 转而使用 Llama-Deploy:一位成员注意到在升级到 Llama-index 0.11.20 时存在依赖问题,并指出 llama-agents 已被弃用,取而代之的是 llama_deploy。

- 他们提供了 Llama Deploy GitHub 页面的链接以获取更多背景信息。

Cohere Discord

- 30 天 Python 挑战:一位成员分享了他们参加 30 Days of Python 挑战的经历,该挑战强调循序渐进的学习,并利用 GitHub 仓库获取资源和灵感。

- 他们正积极参与该仓库的内容,以便在这个结构化的 30 天计划中提升 Python 技能。

- 毕业设计项目 API:一位成员表示倾向于在他们的毕业设计项目中使用 Go 来开发 API,突显了在实际应用中对不同编程语言的探索。

- 他们的选择反映了社区对利用 Go 的并发特性构建健壮 API 的兴趣。

- Cohere GitHub 仓库:一位成员强调 Cohere GitHub 仓库(GitHub 链接)是贡献者的绝佳起点,展示了各种项目。

- 他们鼓励探索仓库中的可用工具,并在不同项目中分享反馈或新想法。

- 用于 RAG 应用的 Cohere Toolkit:Cohere Toolkit(GitHub 链接)被提及为一个专门为 RAG 应用设计的高级 UI,旨在促进快速构建和部署。

- 该工具包包含一系列预构建组件,旨在提高用户生产力。

- 多模态 Embedding 发布:分享了关于多模态 Embedding (multimodal embeddings) 改进的令人振奋的更新,计划于明年年初在 Bedrock 和合作伙伴平台上发布。

- 一名团队成员将标记速率限制 (rate limit) 问题以供进一步讨论,从而解决可扩展性方面的疑虑。

Modular (Mojo 🔥) Discord

- Mojo 的 Async 功能正在开发中:成员报告称 Mojo 的 async 功能目前正在开发中,尚无现成的 async 函数可用。

- 编译器目前将同步代码转换为异步代码,导致在 async 调用期间执行的是同步操作。

- Mojo 社区频道发布:为了方便成员互动,已发布专门的 Mojo 社区频道,可通过 mojo-community 访问。

- 该频道作为 Mojo 开发和使用相关持续讨论的中心枢纽。

- Moonshine ASR 模型在 Mojo 上的性能:使用 moonshine.mojo 和 moonshine.py 对 Moonshine ASR 模型进行了基准测试。处理 10s 语音的执行时间为 82ms,而 ONNX runtime 为 46ms。

- 这表明 Mojo 和 Python 版本相比优化后的 ONNX runtime 慢了 1.8x。

- Mojo 脚本优化挑战:开发者在 Mojo 脚本中传递

TensorMap时遇到了 Model.execute 崩溃的问题,由于不支持解包(unpacking),必须手动列出参数。- 这些问题突显了 Mojo 代码开发中对脚本优化和改进规范的需求。

- Mojo 模型中的 CPU 利用率:用户观察到在 Mojo 中运行模型时 CPU 利用率不一致,全量 CPU 能力和超线程被忽略。

- 这表明需要进一步优化以在模型执行期间最大化资源利用率。

Torchtune Discord

- Torchtune 更新了贡献者指南:团队发布了 新指南 以帮助 Torchtune 维护者和贡献者了解所需功能。

- 这些指南明确了何时使用 fork 与示例仓库进行演示,从而简化了贡献流程。

- 为 Torchtune 提议扩展包:一位成员建议引入类似 torchtune[simpo] 和 torchtune[rlhf] 的扩展包(extender packages),以简化包的包含。

- 该提案旨在降低复杂性,并在不进行过度检查的情况下有效管理资源问题。

- 针对 max_global_bsz 的二分搜索策略:建议为 max_global_bsz 实现一种“最后成功”的二分搜索方法,默认值为小于数据集的 2 的幂。

- 该策略将把 max_iterations 作为参数以提高效率。

- 关于 UV 易用性的反馈:一位成员询问了其他人使用 UV 的经验,寻求关于其易用性的意见。

- 另一位成员部分肯定了它的效用,指出它看起来很有吸引力且现代。

- 可选包解决 TorchAO 问题:讨论了可选包功能是否可以解决用户手动下载 TorchAO 的需求。

- 回复表明,虽然它可能提供一些解决方案,但仍有其他考虑因素需要处理。

DSPy Discord

- Prompt Signature 修改:一位成员询问如何为了调试目的修改 prompt signature 格式,以避免可解析的 JSON schema 注释,特别是通过构建 adapter。

- 讨论探索了构建自定义 adapter 等方法,以在 DSPy 中实现 prompt signature 定制。

- DSPy 中的 Adapter 配置:一位用户建议构建一个 adapter 并使用

dspy.configure(adapter=YourAdapter())进行配置以修改 prompt,并指向dspy/adapters/目录中的现有 adapter 以获取进一步说明。- 利用 DSPy 中现有的 adapter 可以帮助实现有效的 prompt signature 定制。

- 针对特定情况的短语优化:关于针对 bool、int 和 JSON 等特定类型调整短语的问题,已澄清这些是基于一套维护的 model signatures。

- 这些短语总体上并不高度依赖于具体的语言模型,这表明了一种通用的公式化方法。

LLM Agents (Berkeley MOOC) Discord

- Intel AMA 会议定于 11 月 21 日:参加 11 月 21 日下午 3 点(PT 时间)举行的 Intel Hackathon AMA,直接与 Intel 专家交流。

- 别忘了在这里观看直播,并为这次 Ask Intel Anything 的机会设置提醒。

- Quiz 10 发布状态更新:一位成员询问了 Quiz 10 的发布状态,该测验尚未在网站上发布。

- 另一位成员确认,一旦 Quiz 10 上线(可能在 一两天内),将发送电子邮件通知。

- Hackathon 频道混淆事件:一位成员对 Quiz 10 的更新表示感谢,但幽默地承认自己在错误的频道询问了 hackathon 的事。

- 这次交流反映了社区内常见的频道混淆情况,为对话增添了轻松的氛围。

tinygrad (George Hotz) Discord

- 探讨 int64 Indexing 的必要性:一位用户质疑在不涉及大型 Tensor 的情况下 int64 indexing 的必要性,引发了其他人的思考。

- 另一位用户链接了 ops_hip.py 文件,为该讨论提供更多背景。

- 剖析 ops_hip.py 文件的差异:一位成员指出了 tinygrad 仓库中两个 ops_hip.py 文件之间的区别,认为前者可能因为错误的 import 而未被维护。

- 他们注意到后者仅在一个外部 benchmarking 脚本的上下文中被引用,而该脚本也包含错误的 import。

- ops_hip.py 文件的维护状态:针对维护疑问,另一位用户确认 extra 目录下的 ops_hip.py 未被维护,而 tinygrad 版本的在设置 HIP=1 时应该可以正常工作。

- 这表明虽然代码的某些部分可能没有被积极管理,但其他部分仍可以配置为正确运行。

MLOps @Chipro Discord

- 活动链接出现混淆:一位成员表示在 Luma 上找不到活动链接,寻求对其状态的澄清。

- Chiphuyen 表示抱歉,解释说由于生病,活动未能重新安排。

- 祝愿生病的成员早日康复:另一位成员感谢 Chiphuyen 的更新,并祝愿其早日康复。

- 这体现了社区在活动管理面临挑战时的支持精神。

OpenInterpreter Discord

- 紧急寻求 AI 专家:用户 michel.0816 紧急请求 AI 专家,表示迫切需要帮助。

- 另一位成员建议将问题发布在指定频道,以获得更好的曝光度。

- Carter Grant 的求职信息:Carter Grant 是一位在 React、Node.js 和 AI/ML 领域拥有 6 年经验的 full-stack developer,他发布了自己的求职信息。

- 他表示渴望为有意义的项目做出贡献。

OpenAccess AI Collective (axolotl) Discord

- MI300X GPU 在六小时后停滞:一位成员报告称,在使用 axolotl 进行持续 12-19 小时 的标准 ablation set 8 x runs 期间,出现了 间歇性 GPU 挂起,主要发生在 6 小时标记 之后。

- 这些稳定性问题已被记录并在 GitHub Issue #4021 中进行跟踪,其中包含 loss 和 learning rate 等详细指标以提供技术背景。

- 正确进行 Prompting?工程师辩论其必要性:在 community-showcase 频道中,一位成员质疑了正确进行 Prompting 的必要性,并分享了一个 YouTube 视频 来支持讨论。

- 这一疑问引发了 AI 工程师之间关于 Prompt Engineering 技术当前相关性和有效性的对话。

LAION Discord

- 训练 Autoencoder:一位成员强调了 训练 Autoencoder 对于实现模型效率的重要性,重点关注增强性能的技术和实现策略。

- 对话深入探讨了提高 Autoencoder 性能的方法,包括各种训练技术。

- Autoencoder 架构的复杂性:成员们讨论了当前模型中 Autoencoder 架构的复杂性,探索了先进结构如何提升模型能力。

- 不同算法的有效性及其对 Autoencoder 内数据表示的影响是讨论的关键点。

Mozilla AI Discord

- Refact.AI 现场演示:Refact.AI 团队正在进行现场演示,展示他们的 autonomous agent 和创新工具。

- 点击此处加入直播活动并参与对话。

- Mozilla 发布 Web Applets:Mozilla 启动了开源项目 Web Applets,旨在为 Web 开发 AI 原生应用。

- 该项目推广 open standards 和可访问性,促进开发者之间的协作,详情见此处。

- Mozilla 的 Public AI 倡议:Mozilla 在过去一年中推进了 14 个本地 AI 项目,以倡导 Public AI 并构建必要的开发者工具。

- 该计划旨在通过强调社区参与的协作方式,促进开源 AI 技术的发展。

Gorilla LLM (Berkeley Function Calling) Discord

- 关于 Llama 3.2 Prompt 格式的咨询:一位成员询问了关于 Llama 3.2 缺少特定 Prompt 使用的问题,并引用了 Prompt 格式文档。

- 该问题强调了对 System Prompt 中 function definitions 明确说明的需求,并强调了其对有效使用的重要性。

- 对 Prompt 适用性的兴趣:对话显示出人们对理解 Llama 3.2 中 applicability of prompts 的广泛兴趣。

- 这反映了关于通过 effective prompting 最大化模型性能的最佳实践的持续讨论。

Alignment Lab AI Discord 没有新消息。如果该频道长时间没有动静,请告知我们,我们将将其移除。

LLM Finetuning (Hamel + Dan) Discord 没有新消息。如果该频道长时间没有动静,请告知我们,我们将将其移除。

AI21 Labs (Jamba) Discord 没有新消息。如果该频道长时间没有动静,请告知我们,我们将将其移除。

第 2 部分:按频道详细摘要和链接

完整的频道细分内容已为邮件版进行缩减。

如果您喜欢 AInews,请分享给朋友!提前感谢!