ainews-qwen-with-questions-32b-open-weights

Qwen with Questions:32B 开源权重推理模型在 GPQA/AIME/Math500 表现上逼近 o1。

DeepSeek r1 在“开源 o1”模型的竞争中处于领先地位,但尚未发布权重;与此同时,Justin Lin 发布了 QwQ,这是一个 32B 开源权重模型,在基准测试中表现优于 GPT-4o 和 Claude 3.5 Sonnet。QwQ 似乎是 Qwen 2.5 的微调版本,强调通过顺序搜索和反思来解决复杂问题。

SambaNova 宣传其 RDU 在推理任务上优于 GPU,突显了 AI 系统重心从训练向推理的转变。在 Twitter 上,Hugging Face 宣布了对 llama.cpp 实例的 CPU 部署支持;Marker v1 作为一种更快速、更准确的部署工具正式发布;Agentic RAG(代理式检索增强生成)的发展则专注于集成外部工具和高级 LLM 链,以提升响应准确性。

开源 AI 社区的势头日益强劲,随着 Flux 等模型的普及,反映出 AI 正在向涵盖图像、视频、音频和生物学在内的多模态模型转变。

Think different.

2024年11月27日至11月28日的 AI 新闻。我们为您检查了 7 个 subreddits、433 个 Twitter 账号 和 29 个 Discord 服务器(198 个频道和 2864 条消息)。预计节省阅读时间(按 200wpm 计算):341 分钟。您现在可以标记 @smol_ai 进行 AINews 讨论!

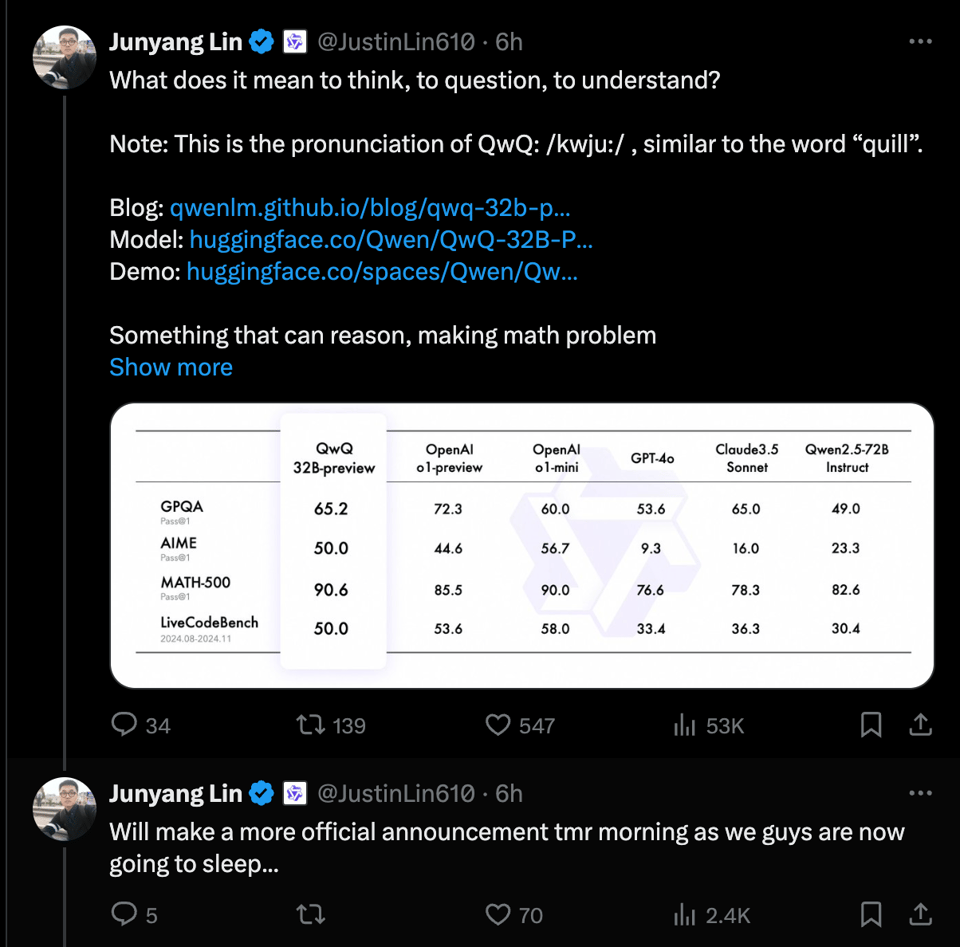

在“开源 o1”的竞赛中,DeepSeek r1(我们的报道在此)仍然拥有最好的结果,但尚未发布权重。听起来疲惫不堪的 Justin Lin 今天突然发布了 QwQ,包括权重、Demo 等一切:

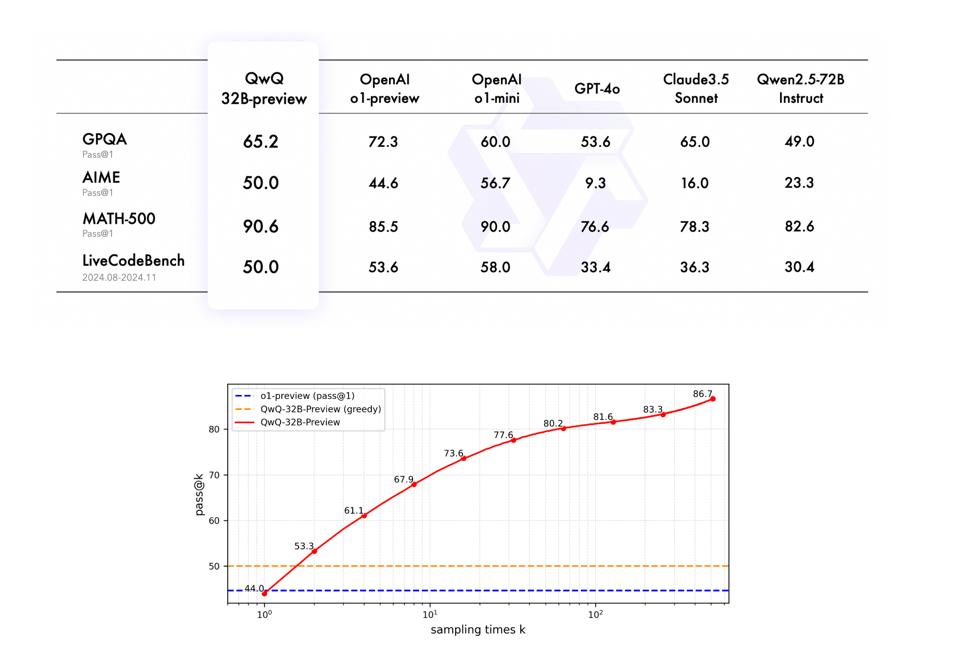

值得注意的是,这个 32B 的开源权重模型在每个基准测试中都完全击败了 GPT-4o 和 Claude 3.5 Sonnet。

对 QwQ 进行分类是一项尴尬的任务:它在采样时间扩展(sampling time scaling)方面做了一些模糊的尝试,足以让 /r/localLlama 感到兴奋:

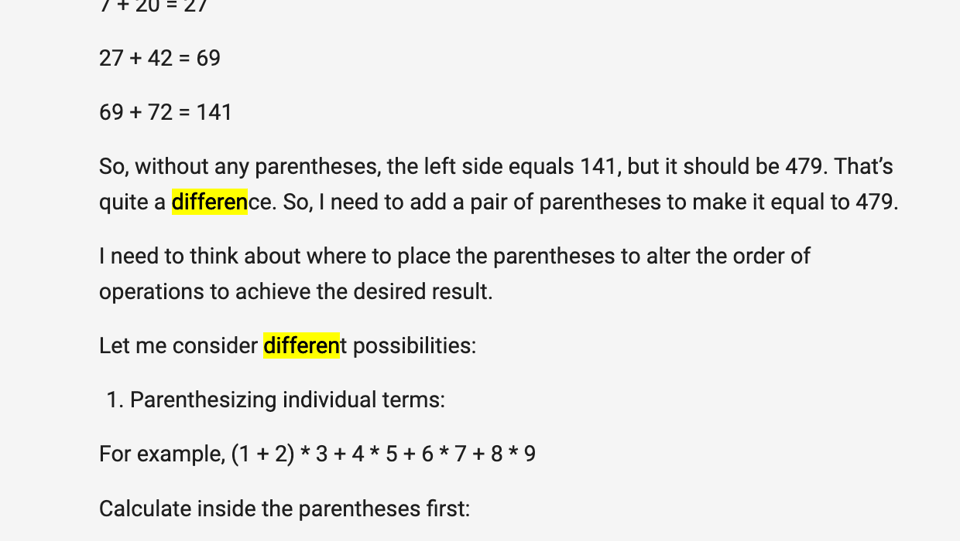

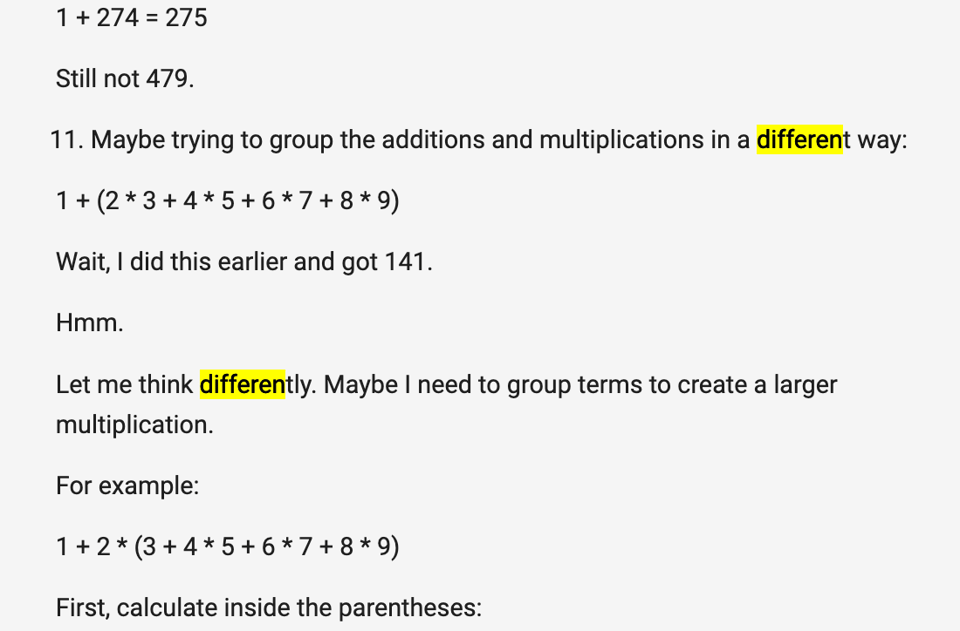

但模型权重本身显示它看起来像是一个 Qwen 32B 模型(可能是 Qwen 2.5,我们的报道在此),所以也许它只是经过微调,学会了“花时间思考、质疑和反思”,“仔细检查工作并从错误中学习”。“这种仔细反思和自我质疑的过程在解决复杂问题方面取得了显著突破”。所有这些都是模糊的 ChatGPT 式描述,并不构成技术报告,但该模型是真实、在线且可下载的,这说明了很多问题。开源的“推理轨迹”(reasoning traces)展示了它是如何被调整以进行顺序搜索(sequential search)的:

更完整的技术报告即将发布,但如果结果属实,这确实令人印象深刻……也许真正的讽刺在于 Reflection 70B(我们的报道在此)并没有错,只是生不逢时……

[由 SambaNova 赞助] 推理(Inference)正迅速成为 AI 系统的主导功能,取代了模型训练。是时候开始使用专为该任务构建的处理器了。SambaNova 的 RDU 在速度和灵活性方面比 GPU 具有一些独特的优势。

swyx 的评论:RDU 回归了!如果像 QwQ 这样简单的 32B 自回归(autoregressive)LLM 就能击败 4o 和 3.5 Sonnet,那对于替代计算供应商来说是非常好的消息,他们可以对这种标准模型架构进行极致优化,实现快得惊人且廉价的推理。

AI Twitter 摘要

所有摘要均由 Claude 3.5 Sonnet 完成,取 4 次运行中的最佳结果。

主题 1. Hugging Face 与模型部署

- Hugging Face 在 CPU 上的推理端点:@ggerganov 宣布 Hugging Face 现在支持在 CPU 服务器上部署由 llama.cpp 驱动的实例,这标志着向更广泛的低成本云端 LLM 可用性迈进了一步。

- @VikParuchuri 分享了 Marker v1 的发布,该工具速度快了 2 倍且准确度更高,预示着 AI 模型部署基础设施的进步。

- Agentic RAG 进展:@dair_ai 讨论了 Agentic RAG,强调了其在构建利用外部工具增强响应准确性的稳健 RAG 系统中的效用。

- 讨论重点介绍了将更先进的 LLM 链和向量库 (vector stores) 集成到系统中的策略,旨在提高 AI 响应的精度。

主题 2. 开源 AI 势头

- 热门 AI 模型讨论:@ClementDelangue 指出 @bfl_ml 的 Flux 成为 Hugging Face 上最受欢迎的模型,表明使用重点正从 LLM 转向多模态模型。

- 对话包含了关于图像、视频、音频和生物模型使用量增加的见解,显示出企业环境中对多样化 AI 模型更广泛的接受和集成。

- SmolLM 招聘活动:@LoubnaBenAllal1 宣布了 SmolLM 的实习机会,专注于 LLM 训练和数据集策划,突显了对开发小型、高效模型日益增长的需求。

主题 3. NVIDIA 与 CUDA 进展

- CUDA Graphs 与 PyTorch 增强:@ID_AA_Carmack 赞扬了 CUDA graphs 的效率,主张通过单进程多 GPU (single-process-multi-GPU) 程序简化 PyTorch 中的流程,以提高计算速度和生产力。

- 对话涉及了优化 PyTorch 中 DataParallel 以利用单进程效率的建议。

- Torch Distributed 与 NVLink 讨论:@ID_AA_Carmack 质疑了 torch.distributed 在 NVIDIA GB200 NVL72 方面的能力,强调了处理多 GPU 时的复杂性和注意事项。

主题 4. 风投惯例的影响与 AI 行业洞察

- 风险投资批评与机遇:@saranormous 批评了一些风投的不理性决策,主张建立更强大的伙伴关系以保护创始人。

-

@marktenenholtz 分享了对应届毕业生高期望以及管理初级程序员挑战的看法,暗示了全行业对人才可持续增长的担忧。

- AI 中的 Stripe 与 POS 系统:@marktenenholtz 强调了 Stripe 在提高业务数据质量方面的作用,指出 POS 系统 提供高投资回报率 (ROI),对于利用 AI 进行数据采集的企业至关重要。

主题 5. 多模态模型开发

- ShowUI 发布:@_akhaliq 讨论了 ShowUI,这是一个设计为 GUI 视觉 Agent 的视觉-语言-动作模型,标志着将 AI 集成到交互式应用中的趋势。

- @multimodalart 赞扬了 QwenVL-Flux 的功能,它增加了图像变体和风格迁移等功能,增强了多模态 AI 应用。

主题 6. 梗与幽默

- 幽默与 AI 文化:@swyx 以幽默的方式看待 AI 发展,并提到了 Neuralink 和 AI 爱好者文化。

- @c_valenzuelab 分享了一个关于 AI 的机智虚构场景,探讨了过去的玩具在当今蓬勃发展的 AI 景观中可能如何被重新构思。

AI Reddit 摘要

/r/LocalLlama 摘要

主题 1. QwQ-32B:Qwen 的新推理模型媲美 O1-Preview

- QwQ: “深思未知的边界” - 似乎是带有 Test-Time Scaling 的 Qwen (Score: 216, Comments: 84): Qwen 宣布预览发布其名为 QwQ 的新 32B 语言模型,该模型似乎实现了 test-time scaling。仅从标题来看,该模型的重点似乎在于推理能力和探索知识边界,尽管在没有额外上下文的情况下无法确定具体功能。

- 在 HuggingFace 上的初步测试表明,QwQ-32B 的表现与 OpenAI 的 O1 preview 相当,用户注意到其推理过程非常冗长。目前已提供多个量化版本,包括适用于 24GB VRAM 的 Q4_K_M 和适用于 16GB VRAM 的 Q3_K_S。

- 用户报告该模型在推理时显著地“话多”,在 temperature=0 时,对于简单问题使用了多达 3,846 tokens(相比之下 O1 为 1,472)。该模型需要特定的 system prompt,其中提到 “You are Qwen developed by Alibaba” 以获得最佳性能。

- 技术测试显示,该模型在处理诸如“爱丽丝的姐妹”等复杂推理问题时表现强劲,但在遵循严格输出格式方面存在一些局限。用户注意到某些内容可能存在审查问题,且与其他推理模型相比性能表现不一。

- Qwen Reasoning Model????? QwQ?? (Score: 52, Comments: 9): 该帖子似乎在询问 QwQ 的发布情况,这似乎与 Qwen Reasoning Model 有关,但未提供具体细节或背景。帖子包含一张截图,但没有关于模型功能或发布时间的额外背景信息。

- QwQ-32B-Preview 模型已在 Hugging Face 上发布,并在其博客文章中进行了详细说明。初步测试显示其与其他模型相比具有强劲的性能。

- 用户报告称,这款 32B 参数开源模型 的表现与 O1-preview 相当,表明开源语言模型取得了重大进展。该模型展示了特别强大的推理能力。

- 该模型由 Qwen 发布,可立即进行测试,早期用户在与现有模型的对比测试中报告了积极的结果。

主题 2. Qwen2.5-Coder-32B AWQ 量化优于其他方法

- Qwen2.5-Coder-32B-Instruct-AWQ: 使用 OptiLLM 和 Aider 进行基准测试 (Score: 58, Comments: 16): Qwen2.5-Coder-32B-Instruct 模型在 2x3090 GPU 上使用 AWQ 量化进行了基准测试,测试了包括 Best of N Sampling、Chain of Code 以及通过 Aider 和 OptiLLM 实现的不同编辑格式在内的各种配置。在使用 “whole” 编辑格式和 temperature 0.2 时,达到了 74.6% 的峰值 pass@2 分数。测试显示 AWQ_marlin 量化优于普通 AWQ,而 “whole” 编辑格式的表现始终优于 “diff” 格式,且较低的 temperature 设置(0.2 对比 0.7)产生了更高的成功率,尽管 chain-of-code 和 best-of-n 技术虽然减少了错误,但对整体成功率的影响微乎其微。

- VRAM 使用情况和 temperature=0 的测试是社区关注的重点,用户请求在 temperature 为 0、0.05 和 0.1 以及各种 topk 设置(20、50、100、200、1000)下进行额外基准测试。

- AWQ_marlin 量化模型可在 Huggingface 获取,并可以使用 SgLang 运行时通过参数 ”–quantization awq_marlin” 启用。

- 用户建议测试 min_p sampling,推荐参数为 temperature=0.2、top_p=1、min_p=0.9 和 num_keep=256,并引用了关于其优势的相关 Hugging Face 讨论。

- Qwen2.5-Coder-32B-Instruct - 使用几天后的评测 (Score: 86, Comments: 87): Qwen2.5-Coder-32B-Instruct 模型在搭载 Oobabooga WebUI 的 3090 GPU 上进行了测试,结果显示出明显的局限性,包括在缺乏信息时编造回答、提供错误的代码审查建议,以及在处理 protobuf 实现或跨会话维持上下文等复杂任务时失败。尽管有这些缺点,该模型在编写 Doxygen 注释方面表现出色,在用户验证的前提下能提供有价值的代码审查反馈,并可作为改进代码的有效交流对象,对于能够批判性评估其输出的开发者来说是一个有用的工具。

- 用户强调原帖使用的是 4-bit 量化模型,这会显著损害性能。多位专家建议至少使用 6-bit 或 8-bit 精度 的 GGUF 格式,并配合适当的 GPU offloading 以获得最佳效果。

- Mistral Large 被称赞在编程任务上优于 GPT/Claude,用户提到了其 10 亿 token 限制、免费访问以及更好的代码生成能力。据观察,与竞争对手相比,该模型能生成更准确、可编译的代码。

- 几位用户强调了正确的 system prompts 和 sampling parameters 对获得最佳结果的重要性,并分享了诸如此指南之类的资源。Unsloth “fixed” 128K 模型 配合 Q5_K_M 量化 被推荐作为替代方案。

Theme 3. 32B 模型推理的性价比硬件配置

- 运行 32B 模型最便宜的硬件 (Score: 63, Comments: 107): 讨论了 32B 语言模型 的运行需求,重点在于如何将模型完全放入 GPU RAM 中并实现 >20 tokens/second 的性能。帖子对比了 NVIDIA GPU,指出单块 RTX 3090 只能处理 Q4 量化,同时探索了双 RTX 3060 显卡与价格约 1200 欧元 的二手双 3090 方案的优劣。

- 用户讨论了替代硬件方案,包括售价 $90-300 的 Tesla P40 GPU(运行 72B 模型 速度为 6-7 tokens/second),以及双 RTX 3060 在运行 Qwen 2.5 32B 模型时达到 13-14 tokens/second。

- 一个使用 exllama v2 的显著配置展示了在单块 RTX 3090 上运行 32B 模型,采用 5 bits per weight、32K context 和 Q6 cache,并开启了 flash attention 和 cache 量化。

- 性能对比显示,RTX 4090 处理 Prompt 的速度比 M3 Max 快 15.74 倍,而 Intel Arc A770s 被建议作为具有更高显存带宽的预算选项,但存在软件兼容性问题。

Theme 4. NVIDIA Star-Attention:长序列处理速度提升 11 倍

- GitHub - NVIDIA/Star-Attention: Efficient LLM Inference over Long Sequences (Score: 51, Comments: 4): NVIDIA 在 GitHub 上发布了 Star-Attention,这是一种用于处理 Large Language Models 长序列的新型注意力机制。该项目旨在提高处理超长文本序列时 LLM 推理 的效率。

- Star-Attention 通过将注意力计算分散到多台机器上,在保持 95-100% 准确度的同时,实现了内存占用和推理时间高达 11 倍 的缩减。该机制采用了包含 blockwise-local 和 sequence-global 注意力阶段的两阶段分块稀疏近似 (two-phase block-sparse approximation)。

- SageAttention2 被建议作为单机注意力优化的更好替代方案,而 Star-Attention 主要对大型计算集群和分布式系统有益。

- 用户指出,这是 NVIDIA 的一种策略,通过支持跨多台机器的分布式计算来处理注意力机制,从而鼓励用户购买更多显卡。

其他 AI 子版块回顾

r/machinelearning, r/openai, r/stablediffusion, r/ArtificialInteligence, /r/LLMDevs, /r/Singularity

Theme 1. Claude 获得 Model Context Protocol 以实现直接系统访问

- MCP 对我来说感觉像是 Level 3 (Score: 32, Comments: 23):Claude 展示了自主编码能力,通过独立编写和执行 Python 代码,绕过传统的 API 集成方法,利用环境文件夹访问 Bing API。这一发现表明,通过直接代码执行,扩展工具使用和 agent swarms 具有潜力,使 AI 系统 能够通过编写和运行自己的程序以更高的自主性运行。

- Claude desktop app 中的 MCP 功能实现了无需传统 API 集成的自主代码执行。可以通过桌面应用配置菜单中的 developer settings 进行访问。

- 用户强调了 Claude 如何独立创建和执行工具来完成它无法立即完成的任务,包括抓取文档和通过自定义解决方案获取信息。

- 虽然自主编码能力很强大,但人们也对未来可能的限制以及为了防止环境/数据问题而进行适当 sandboxing 的需求提出了担忧。目前有一个 Python library 可用于实现自定义服务器和工具。

- Model Context Protocol 是我想要的一切 (Score: 28, Comments: 12):Model Context Protocol (MCP) 使 Claude 能够直接与计算机系统和 API 交互,代表了 AI 系统集成方面的重大进步。

- 用户 cyanheads 创建了一个 实现 MCP 工具的指南,展示了仅需 $3 API 成本的协议实现。

- 带有 MCP 的 Claude desktop app 通过注入系统提示词(system prompt)的工具函数,实现了与互联网访问、计算机系统和智能家居设备的原生集成。该功能通过一个 天气工具示例 得到了演示。

- 实际演示包括 Claude 将 Pac-Man 游戏 写入本地磁盘,并利用互联网研究能力创建了一篇关于 quantum computing breakthroughs 的博客文章,展示了该系统在文件系统交互和网络研究方面的多功能性。

主题 2. ChatGPT Voice 实现 15% 的冷启动电话转化率

- 我让 ChatGPT 帮我打销售电话……它真的在成交 (Score: 144, Comments: 67):作者尝试将 ChatGPT’s voice mode 用于房地产冷启动电话(cold calls),在 100 次通话 中实现了 12-15% 的有意义对话率 和 2-3% 的会议预订率,显著优于其 3-4% 对话率 的手动尝试。成功源于 AI 的预先披露 和新奇因素,潜在客户出于对技术的好奇而在通话中停留更长时间,其中一个案例促成了 签署合同,同时 AI 保持了一贯的专业精神并能有效处理拒绝。

- 该系统每月约需 $840 的 OpenAI API 费用,在目前的 Tier 3 访问权限下可处理 21 路并发通话,并有潜力在 Tier 5 扩展到 500 路并发通话。后端实现使用 Twilio 和 websockets,代码量约为 5000 行。

- 针对 TCPA 合规性 提出了法律担忧,截至 2024 年,违反 Do Not Call Registry 的规定可能面临 每路违规 $50,120 的罚款。用户指出,AI 通话需要事先获得明确的书面同意,以避免集体诉讼。

- 新奇因素 被强调为一个关键但暂时的优势,预计 AI 冷启动电话 将在几个月内广泛应用于销售领域。一些用户建议创建 AI receptionists 来应对预期中增加的 AI 冷启动电话。

主题 3. OpenAI 获得软银 15 亿美元投资并推动军事合同

- OpenAI 获得来自 SoftBank 的 15 亿美元新投资,允许员工通过要约收购出售股份 (Score: 108, Comments: 2): OpenAI 通过要约收购获得了来自 SoftBank 的 15 亿美元投资,使员工能够出售其股份。继 2023 年早些时候与 Microsoft 达成重大交易后,此次投资延续了 OpenAI 强劲的融资势头。

- SoftBank 的参与引起了评论者的担忧,因为其投资记录充满争议,特别是最近一些面临重大挑战的高知名度科技投资。

- AI 公司(从 Meta 到 OpenAI)的新一轮“圈地运动”是军事合同 (Score: 111, Comments: 6): Meta、OpenAI 和其他 AI 公司正将 美国军事和国防合同 视为新的收入来源和市场扩张机会。帖子正文未提供更多背景或具体细节。

- 政府支出和军事合同被视为科技公司可靠的收入来源,评论者指出这遵循了将业务增长与国防资金挂钩的历史模式。

- 社区对 AI 公司与军事应用合作表示担忧和怀疑,并提到了 Skynet 以及对安全影响的质疑。

- 讨论强调这些合同是由纳税人的钱资助的,暗示公众在这些 AI 发展中拥有利益。

主题 4. Blender 的本地 LLaMa-Mesh 集成发布

- Blender 的本地 LLaMa-Mesh 集成刚刚发布! (Score: 81, Comments: 7): Blender 的 LLaMa-Mesh AI 集成已发布,实现了本地处理能力。帖子缺少关于功能、实现细节或下载信息的额外详情。

- LLaMa-Mesh AI 项目已在 HuggingFace 上发布,供初步发布和测试。

- 用户对该工具的潜力表示乐观,特别是与现有的扩散模型 (diffusion model) 网格生成方法相比。

AI Discord 摘要

由 O1-preview 提供的摘要之摘要的总结

主题 1. AI 模型在效率和性能上取得新突破

- Deepseek 在推理基准测试中超越 OpenAI: Deepseek 的 R1 模型在多个推理基准测试中超越了 OpenAI 的 o1,标志着 AI 领导地位的转变。在 High-Flyer 雄厚的计算资源(包括估计 5 万张 Hopper GPU)支持下,Deepseek 计划开源模型并提供具有竞争力的 API 定价。

- OLMo 2 在 AI 对决中超越开源模型: OLMo 2 推出了新的 7B 和 13B 模型,其表现优于其他开源模型,特别是在递归推理和复杂的 AI 应用中。高管们对 OLMo 2 的能力议论纷纷,反映了 AI 技术的尖端进步。

- MH-MoE 模型在不增加体积的情况下提升 AI 效率: MH-MoE 论文提出了一种多头机制,在匹配稀疏 MoE 模型性能的同时超越了标准实现。令人印象深刻的是,它与 BitNet 等 1-bit LLMs 兼容,扩展了其在低精度 AI 环境中的实用性。

主题 2. AI 工具和基础设施升级

- TinyCloud 携 GPU 大军发布——54x 7900XTXs:Tinygrad 宣布即将推出 TinyCloud,计划在年底前通过 9 台 tinybox reds 为贡献者提供 54 个 GPU 的访问权限。凭借确保稳定性的定制驱动程序,用户只需使用 API key 即可轻松调用这些算力——无需复杂操作,只有纯粹的 GPU 动力。

- MAX Engine 凭借全新 Graph APIs 展现实力:MAX 24.3 版本引入了可扩展性,允许通过 MAX Graph APIs 创建自定义模型。旨在实现低延迟、高吞吐量的推理,MAX 优化了基于 ONNX 等格式的实时 AI 工作负载——这是对 AI 基础设施领域的一次有力冲击。

- Sonnet 现在支持读取 PDF 了——没开玩笑!:Aider 中的 Sonnet 现在支持读取 PDF,使其成为开发者更全能的助手。用户反馈该功能运行顺畅,称其“能有效解析 PDF 文件”并提升了工作流——这绝对是生产力的巨大飞跃。

主题 3:AI 社区应对伦理困境

- Bsky 数据集风波让研究人员陷入困境:一名 Hugging Face 员工创建的 Bluesky 帖子数据集在遭到强烈抵制后被撤下,尽管其符合服务条款。此次撤除阻碍了社交媒体研究,对小型研究人员打击最大,而大型实验室则未受影响——这是典型的“小人物吃亏”案例。

- Sora 视频生成器泄露引发 AI 界骚动:OpenAI 的 Sora Video Generator 泄露引发了热烈讨论,一段 YouTube 视频 爆出了内幕。社区成员剖析了该工具的性能,并批评了迅速撤销公共访问权限的行为——AI 圈总是少不了戏剧性事件。

主题 4:用户应对 AI 工具的成长烦恼

- Cursor Agent 陷入无尽文件夹乱象:用户报告称 Cursor Agent 正在生成无尽的文件夹,而不是进行合理的组织——这简直是目录界的“衔尾蛇”。许多人建议提供更清晰的指令来纠正 Agent 的行为——没人喜欢混乱的工作空间。

- Jamba 1.5 Mini 在函数调用上出差错:通过 OpenRouter 使用的 Jamba 1.5 mini 模型在处理 function calls 时返回空响应。虽然在不使用函数调用时表现正常,但用户们正困惑地检查代码——function calling 不应该是黑盒。

- Prompting 研究让工程师陷入两难:参与者对缺乏一致的实证性 prompting 研究表示沮丧,相互矛盾的研究让情况变得扑朔迷离。社区正在寻求有效的 prompting 技术的明确指导——标准化刻不容缓。

主题 5:AI 行业的巨额资金与动态

- PlayAI 融资 2100 万美元助力语音 AI:PlayAI 从 Kindred Ventures 和 Y Combinator 获得了 2100 万美元,用于开发直观的语音 AI 界面。这笔资金注入旨在增强语音优先界面,让机人交互像爵士乐独奏一样流畅。

- 生成式 AI 支出高达 138 亿美元:生成式 AI 支出在 2024 年飙升至 138 亿美元,标志着从 AI 幻想向现实应用的转变。企业正在慷慨解囊,但决策者仍在努力思考如何获得最大的投资回报。

- SmolVLM 以小身躯掀起大波澜:SmolVLM 作为一个 2B VLM,为端侧推理(on-device inference)树立了新标准,在 GPU RAM 占用和 token 吞吐量方面优于竞争对手。它可以在 Google Colab 上进行微调,让强大的 AI 在消费级硬件上触手可及——小模型,大能量。

第一部分:Discord 高层级摘要

Modular (Mojo 🔥) Discord

-

MAX Engine 在 AI 推理方面优于 ONNX:MAX Engine 被定义为一个旨在利用模型的 AI 推理强力引擎,而 ONNX 作为一个模型格式,支持包括 ONNX、TorchScript 和原生 Mojo 图在内的多种格式。

- MAX 旨在跨多种硬件提供低延迟、高吞吐量的推理,相比 ONNX 侧重于模型传输,它更优化了实时模型推理。

-

内存压力导致 Mojo 测试执行变慢:在 Mojo 目录中运行所有测试的时间明显长于运行单个测试,这表明多个 mojo-test-executors 带来了潜在的内存压力。

- 逐步注释掉测试函数可以改善运行时间,这表明内存泄漏或高内存占用导致了速度变慢。

-

MAX 24.3 版本增强了引擎功能:最近发布的 MAX 24.3 版本 强调了其可扩展性,允许用户通过 MAX Graph APIs 创建自定义模型。

- Graph API 促进了 Mojo 中高性能符号计算图的实现,使 MAX 的定位超越了单纯的模型格式。

-

Mojo 增强内存管理策略:讨论显示,Chrome 的内存占用导致了 Mojo 测试执行期间的性能问题,凸显了整体系统的内存压力。

- 用户承认需要更好的硬件来处理工作负载,并强调了有效资源管理的必要性。

-

Mojo 的 Origin 追踪提升了内存安全性:关于 Mojo 中 Origin 追踪的讨论透露,目前

vec及其元素共享相同的 Origin,但新的实现将引入独立的 Origin,以实现更精确的 aliasing(别名)控制。- 引入两个 Origin(向量的 Origin 和其元素的 Origin)将通过准确追踪潜在的 aliasing 场景来确保内存安全。

Cursor IDE Discord

-

Cursor Agent 的文件夹故障:用户报告称 Cursor Agent 正在创建无穷无尽的文件夹,而不是正确地组织它们,这表明存在潜在的 Bug。他们建议提供更清晰的命令可以增强 Agent 功能,并防止在管理项目结构时产生混淆。

- 这些问题在 Cursor 论坛上得到了广泛讨论,强调了提高命令清晰度以简化文件夹组织的必要性。

-

Cursor v0.43.5 功能变更:最新的 Cursor 0.43.5 版本更新引发了关于功能缺失的讨论,包括 @web 功能的更改以及标签页(tabs)系统的移除。尽管有这些变化,一些用户仍然赞赏 Cursor 对其生产力的持续贡献。

- 详细的反馈可以在 Cursor Changelog 中找到,用户在其中表达了对新功能集的担忧和赞赏。

-

Model Context Protocol 集成:用户对在 Cursor 中实现 Model Context Protocol (MCP) 表现出浓厚兴趣,以便创建自定义工具和上下文提供者。用户认为 MCP 可以通过提供更多定制化功能来极大提升整体用户体验。

- 关于 MCP 潜力的讨论在 Cursor 文档中得到了强调,突出了其在扩展 Cursor 能力方面的作用。

-

Cursor 增强开发者工作流:许多用户分享了使用 Cursor 的积极体验,强调了它如何改变了他们的编码和项目执行方式。得益于 Cursor,即使是非专业开发者在处理雄心勃勃的项目时也感到更有信心。

- 这些令人振奋的体验经常在 Cursor 论坛中被提及,展示了 Cursor 对开发工作流的影响。

-

Cursor 中的 Markdown 格式挑战:用户讨论了 Cursor 中的 Markdown 格式问题,特别是代码块无法正确应用的问题。他们正在寻求解决方案或快捷键绑定,以增强工作流并在最新更新中更好地管理文件。

- 针对这些 Markdown 问题的解决方案和变通方法在多个论坛帖子中进行了探讨,表明对改进 Markdown 支持的持续需求。

OpenAI Discord

-

Sora Video Generator 泄露引发讨论:最近 OpenAI 的 Sora Video Generator 泄露事件引发了热议,并提到了一个详细介绍该事件的 YouTube 视频。

- 社区成员讨论了该工具的性能以及泄露后立即撤销公共访问权限的问题。

-

ChatGPT 的图像分析显示出不同的结果:用户实验了 ChatGPT 的图像分析能力,注意到基于 Prompt 结构和图像呈现方式的不一致性。

- 反馈强调,与无引导的交互相比,提供图像上下文时的交互效果更好。

-

经验性 Prompting 研究缺乏共识:参与者对经验性 Prompting 研究的稀缺表示沮丧,理由是研究结果相互矛盾且缺乏标准化方法。

- 在众多相互矛盾的论文中,社区寻求关于有效 Prompting 技术的明确指导。

-

AI Phone Agents 旨在实现类人交互:讨论强调 AI Phone Agents 应该模拟人类交互,而不是模仿脚本化的 IVR 响应。

- 成员们强调了 AI 在通话过程中理解上下文并验证关键信息的重要性。

-

开发全面的模型测试框架:工程师们讨论了如何创建强大的模型测试框架,能够大规模评估模型并跟踪 Prompt 的更改。

- 建议包括实施验证系统,以确保在不同用例中的响应准确性和一致性。

Nous Research AI Discord

-

MH-MoE 提高模型效率:MH-MoE 论文详细介绍了一种多头机制,该机制聚合来自不同专家空间的信息,实现了与稀疏 MoE 模型相当的性能,同时超越了标准实现。

- 此外,它与 BitNet 等 1-bit LLMs 兼容,扩展了其在低精度环境下的适用性。

-

Star Attention 增强 LLM 推理:Star Attention 引入了一种块稀疏注意力机制,可将长序列的推理时间和内存使用量减少高达 11 倍,同时保持 95-100% 的准确率。

- 该机制与基于 Transformer 的 LLMs 无缝集成,促进了长序列任务的高效处理。

-

DALL-E 的变分界争议:关于 DALL-E 论文中提出的变分界(variational bound)存在持续争议,有人断言由于对条件独立性的错误假设,该变分界可能存在缺陷。

- 参与者正在审查这些潜在的疏忽是否会影响模型中提出的不等式的有效性。

-

Qwen 的开源权重推理模型:新发布的 Qwen 推理模型被认为是第一个能够执行高级推理任务的大型开源权重模型,可通过量化至 4 bits 来实现。

- 然而,一些参与者对之前被归类为推理模型的模型表示怀疑,并引用了其他展示推理能力的方法。

-

OLMo 的增长与性能:自 2024 年 2 月以来,OLMo-0424 在下游性能方面表现出显著改进,特别是通过比其前代产品提升性能。

- 增长生态系统也见证了来自 LLM360 的 Amber 和 M-A-P 的 Neo 模型等项目的贡献,增强了模型开发的开放性。

Eleuther Discord

-

RWKV-7 实现 soft AGI 的潜力:开发者表示希望推迟 RWKV-8 的开发,认为 RWKV-7 的能力足以作为 soft AGI 的候选者,并承认仍需进一步改进。

- 他们强调虽然 RWKV-7 很稳定,但在过渡到 RWKV-8 之前仍有可以增强的领域。

-

Mamba 2 架构的效率:社区对新的 Mamba 2 架构感到好奇,特别是其效率方面以及与现有模型的对比。

- 重点关注 Mamba 2 是否允许更多的 tensor parallelism,或者是否比传统架构更具优势。

-

SSMs 与图曲率的关系:参与者讨论了 SSMs (State Space Models) 在消息传递(message passing)方面的潜力,强调了图中顶点度 (vertex degree) 与流形上曲率 (curvature) 之间的类比。

- 他们指出,较高的顶点度与负曲率相关,展示了高斯曲率(Gaussian curvature)的离散版本。

-

RunPod 服务器的 OpenAI 端点配置:一位用户发现 RunPod 教程没有明确提到 OpenAI completions 的正确端点,而这是成功通信所必需的。

- 为了使其工作,请使用 此端点 并在请求中提供模型。

OpenRouter (Alex Atallah) Discord

-

Gemini Flash 1.5 容量提升:OpenRouter 对 Gemini Flash 1.5 的容量进行了重大提升,解决了用户反馈的 rate limiting 问题。鼓励遇到问题的用户重试请求。

- 这一增强预计将通过增加整体系统容量,显著改善高流量期间的用户体验。

-

提供商路由优化:该平台现在正将呈指数级增长的流量路由到成本最低的提供商,确保用户平均能享受到更低的价格。更多细节可以在 提供商路由文档 中找到。

- 该策略通过在必要时回退到其他提供商的机制来维持性能,从而优化成本效益。

-

Grok Vision Beta 发布:OpenRouter 正在增加 Grok Vision Beta 的容量,鼓励用户在 Grok Vision Beta 进行测试。

- 此次发布为用户提供了在服务扩展过程中探索增强型视觉能力的机会。

-

EVA Qwen2.5 价格翻倍:用户观察到 EVA Qwen2.5 72B 的价格翻了一倍,引发了关于这一变化是促销性质还是标准涨价的疑问。

- 推测认为,价格调整可能是由竞争加剧和不断变化的业务策略驱动的。

-

Jamba 1.5 模型问题:用户报告了来自 AI21 Labs 的 Jamba 1.5 mini 模型的问题,具体表现为在调用函数时收到空响应。

- 尽管尝试了不同版本,问题依然存在,导致用户推测这可能与消息准备或后端挑战有关。

Interconnects (Nathan Lambert) Discord

-

QwQ-32B-Preview 推动 AI 推理:QwQ-32B-Preview 是一款增强 AI 推理能力 的实验性模型,尽管它在 语言混杂 和 递归推理循环 方面仍存在挑战。

- 尽管存在这些问题,多位成员对其在 数学 和 编程 任务中的表现表示兴奋。

-

Olmo 在一致性上超越 Llama:根据社区讨论,Olmo 模型 在各项任务中表现出一致的性能,使其与 Llama 区别开来。

- 此外,据称 Tülu 在特定提示词下的表现优于 Olmo 2,引发了关于领先模型的辩论。

-

低比特量化优化训练不足的 LLM:一项关于 Low-Bit Quantization 的研究显示,低比特量化 有利于训练不足的大语言模型,且模型规模越大,性能退化越小。

- 预测表明,使用超过 100 万亿 token 训练的模型可能会遭遇量化性能问题。

-

Deepseek 在推理基准测试中超越 OpenAI:Deepseek 的 R1 模型 在多个推理基准测试中超越了 OpenAI 的 o1,凸显了这家初创公司在 AI 领域的潜力。

- 在 High-Flyer 雄厚的算力资源支持下(包括估计 5 万张 Hopper GPU),Deepseek 准备开源模型并在中国启动极具竞争力的 API 定价。

-

Bsky 数据集风波干扰研究:一名 HF 员工创建的 Bluesky 帖子数据集 在遭到强烈抵制后被删除,尽管该数据集符合 ToS。

- 此次删除使 社交媒体研究 受到挫折,讨论集中在对小型研究人员的影响以及即将发布的 数据集 上。

Perplexity AI Discord

-

Perplexity 引擎弃用:关于 Perplexity 引擎弃用 的讨论出现,用户对未来的支持和功能更新表示担忧。

- 参与者建议转向 Exa 或 Brave 等替代方案,以维持项目的稳定性和连续性。

-

Perplexity Pro 中的图像生成:Perplexity Pro 现在支持图像生成,但用户注意到对输出的控制有限,使其更适合偶尔使用而非精细项目。

- 目前没有专门的图像生成页面,这是提升用户体验的一个反馈点。

-

增强的模型选择优势:Perplexity 订阅者可以使用 Sonnet、4o 和 Grok 2 等先进模型,这些模型显著提升了编程和数学计算等复杂任务的性能。

- 虽然免费版本能满足基本需求,但订阅版为需要更强大功能的用户提供了实质性优势。

-

Perplexity API 金融数据源:有关于 Perplexity API 所使用的 金融数据源 及其为内部项目集成 股票代码数据 能力的咨询。

- 引用了一张截图来展示可用的金融信息类型,强调了该 API 在实时数据应用中的实用性。

-

Perplexity API 中的 Reddit 引用支持:用户注意到 Perplexity API 不再支持 Reddit 引用,并质疑这一变化的深层原因。

- 这一改动影响了那些依赖 Reddit 作为数据源的用户,引发了关于替代引用方法的讨论。

aider (Paul Gauthier) Discord

-

Sonnet 引入 PDF 支持:Sonnet 现在支持读取 PDF,通过命令

aider --install-main-branch启用。用户反馈 Sonnet 能够通过新功能有效解析 PDF 文件。- 成功使用 PDF 读取功能的成员分享了正面反馈,这增强了他们在 Aider 中的工作流。

-

QwQ 模型面临性能障碍:多位用户在 glhf.chat 上对 QwQ 模型进行基准测试时遇到了 网关超时错误。

- 正如社区所讨论的,QwQ 模型的加载延迟正在影响其在性能测试中的响应速度。

-

为隐私实现本地 Whisper API:一位成员分享了他们在 Apple M4 Mac mini 上托管本地 Whisper API 进行语音转录的配置,重点关注隐私保护。

- 他们提供了

curl命令示例,并将 API 托管在 Whisper.cpp Server 上供社区测试。

- 他们提供了

Unsloth AI (Daniel Han) Discord

-

Axolotl 与 Unsloth 框架对比:一位成员对比了 Axolotl 和 Unsloth,强调 Axolotl 可能显得臃肿,而 Unsloth 提供了更精简的代码库。Instruction Tuning – Axolotl。

- 数据集质量被强调为优于框架选择,一位用户指出性能很大程度上取决于数据集的质量,而非底层框架。

-

RTX 3090 价格波动:讨论显示 RTX 3090 的价格差异巨大,平均价格在 1500 美元左右,但有些挂牌价低至 550 美元。

- 这种价格差异表明市场波动剧烈,成员们对如此广泛的价格区间感到惊讶。

-

GPU 托管方案与 Docker:成员们表示更倾向于选择拥有可扩展 GPU(可按分钟开启)的 24GB GPU 托管商,并强调运行 Docker 容器以减少 SSH 依赖。

- 对 Docker 容器的关注反映了通过容器化实现高效、灵活的 GPU 资源管理的趋势。

-

使用多 GPU 微调本地模型:用户寻求关于使用 JSON 数据文件微调本地 Llama 3.2 模型的建议,并对支持 multi-GPU 以增强性能表现出浓厚兴趣。

- 虽然 multi-GPU 支持仍在开发中,但已向有兴趣参与的成员开放了限量 Beta 测试。

-

理解等式中的运算顺序:一位成员复习了运算顺序以纠正一个等式,确认乘法优先于加法,从而得出表达式 1 + 23 + 45 + 67 + 89 = 141(而非 479)。

- 该修正遵循 PEMDAS 规则,指出了原始等式结构中的误解。

Stability.ai (Stable Diffusion) Discord

-

通配符(Wildcard)定义之争:参与者讨论了编程中“Wildcards”的不同解释,对比了 Civitai 和 Python 环境下的语境,并引用了 Merriam-Webster 定义。

- 术语使用的差异受到编程历史的影响,导致在不同场景下如何正确应用通配符存在多种观点。

-

图像生成工作流挑战:一位用户报告称,尽管使用了合适的 Prompt 和风格指南,但在生成一致的角色图像方面仍存在困难,正在寻求工作流优化方案。

- 建议包括尝试 image-to-image generation 方法,并利用 Civitai 等平台上的现有工作流来增强一致性。

-

ControlNet 在 Large Turbo 模型上的性能:一位成员确认了 ControlNet 功能在 3.5 large turbo 模型上的有效性,引发了关于其与新模型兼容性的讨论。

- 这激发了成员们对使用最新模型版本时的性能指标和潜在集成挑战的兴趣。

-

创建高质量图像:讨论强调了时间、探索和 Prompt 实验在创作高质量角色肖像中的重要性。

- 建议用户参考成功的 workflows,并考虑使用多种技术来提升图像输出质量。

-

Stable Diffusion 插件问题:过时的 Stable Diffusion 扩展导致了 Checkpoint 兼容性问题,促使一位用户寻求插件更新。

- 社区建议检查插件仓库以获取最新更新,并提到一些用户在尝试排障后仍然遇到问题。

Notebook LM Discord Discord

-

NotebookLM 中的讽刺性测试:一位成员正在 NotebookLM 中尝试讽刺性文章,并指出该模型大约有一半时间能识别出笑话,而另一半时间则失败。

- 他们专门指示模型质疑作者的人性,从而产生了 YouTube 视频中展示的幽默结果。

-

AI 语音与视频展示:AI 在一段新视频中展示了其语音和视频能力,幽默地强调了手指的缺失。

-

Gemini 模型评估:一位成员在 Google AI Studio 中进行了两个 Gemini 模型的对比,并在 NotebookLM 中总结了发现。

- 分享了来自 NotebookLM 的配套音频概述,希望这些见解能传达给 Google 的开发团队。

-

NotebookLM 功能问题:用户报告了 NotebookLM 的功能问题,例如表示访问困难的黄色渐变警告以及 AI 性能不稳定的情况。

- 用户担心现有的聊天会话可能会丢失,以及 NotebookLM 当前聊天系统的临时性。

-

播客时长挑战:一位用户观察到,尽管有缩短长度的自定义指令,生成的播客时长始终在 20 分钟左右。

- 建议指示 AI 为忙碌的受众创建更简洁的内容,以便更好地管理播客时长。

Cohere Discord

-

Cohere API 与 LiteLLM 的集成:用户在将 Cohere API 与 LiteLLM 集成时遇到了困难,特别是关于引用(citations)功能无法按预期工作的问题。

- 他们强调 LiteLLM 作为一个元库(meta library)与多个 LLM 供应商对接,并请求 Cohere 团队协助改进此集成。

-

增强 LiteLLM 中的引用支持:目前的 LiteLLM 实现缺乏对 Cohere 聊天端点返回的引用的支持,限制了其可用性。

- 用户建议在 LiteLLM 代码中添加新参数来处理引用,并表示愿意贡献代码或等待维护者的回复。

-

全栈 AI 工程专业知识:一位成员强调了其作为全栈 AI 工程师的角色,拥有超过 6 年设计和部署可扩展 Web 应用程序及 AI 驱动解决方案的经验,使用的技术包括 React、Angular、Django 和 FastAPI。

- 他们详细介绍了自己在 Docker、Kubernetes 以及跨 AWS、GCP 和 Azure 等云平台的 CI/CD 流水线方面的技能,并分享了他们的 GitHub 仓库:AIXerum。

Latent Space Discord

-

PlayAI 融资 2100 万美元以增强语音 AI:PlayAI 已从 Kindred Ventures 和 Y Combinator 获得了 2100 万美元 的资金,用于为开发者和企业开发直观的语音 AI 接口。

- 此次资本注入旨在改进无缝的语音优先接口,重点是增强人机交互,将其作为一种自然的通信媒介。

-

OLMo 2 性能超越开源替代方案:OLMo 2 推出了全新的 7B 和 13B 模型,其性能超越了其他开源模型,特别是在递归推理和各种 AI 应用方面。

- 高管们对 OLMo 2 的潜力感到兴奋,理由是它在处理复杂的 AI 场景方面表现出色,反映了 AI 技术的最新进展。

-

SmolVLM 为端侧 VLM 设定新标准:SmolVLM(一个 2B VLM)已经发布,旨在实现端侧推理,在 GPU RAM 占用和 token 吞吐量方面均优于竞争对手。

- 该模型支持在 Google Colab 上进行微调,并专门针对需要在消费级硬件上进行高效处理的使用场景进行了优化。

-

Deepseek 模型在推理方面超越 OpenAI:Deepseek 最近的 AI 模型在推理基准测试中表现优于 OpenAI,引起了 AI 社区的关注。

- 在中国对冲基金幻方量化(High-Flyer)的支持下,Deepseek 致力于构建基础技术并提供价格亲民的 API。

-

2024 年企业生成式 AI 支出达到 138 亿美元:生成式 AI 支出在 2024 年飙升至 138 亿美元,表明企业内部正从实验阶段转向执行阶段。

- 尽管对更广泛的采用持乐观态度,但决策者在定义有效的实施策略方面仍面临挑战。

GPU MODE Discord

-

LoLCATs 线性 LLM 吞吐量减半:LoLCATs 论文探讨了在不进行全模型微调的情况下线性化 LLM,结果显示在小 batch size 下,其吞吐量比 FA2 降低了 50%。

- 尽管节省了内存,但线性化模型并未超越此前预期的二次复杂度注意力模型,这引发了对其整体效率的质疑。

-

ThunderKittens 发布 FP8 支持:正如其博客文章所述,ThunderKittens 引入了 FP8 支持和 fp8 kernel,仅用 95 行代码就实现了 1500 TFLOPS。

- 团队强调通过简化 kernel 编写来推进新架构的研究,实现细节可在其 GitHub 仓库中找到。

-

FLOPS 计数工具提高准确性:统计 FLOPS 面临挑战,因为现有脚本会遗漏许多操作,从而影响研究的可靠性;建议使用 fvcore 和 torch_flops 等工具进行精确测量。

- 准确的 FLOPS 计数对于验证模型性能至关重要,社区倡导采用这些增强工具以减少差异。

-

cublaslt 加速大矩阵运算:cublaslt 被认为是管理低精度大矩阵的最快选择,在矩阵运算中表现出令人印象深刻的速度。

- 这种优化对于旨在提升大规模矩阵计算性能的 AI 工程师特别有益。

-

LLM Coder 增强 Claude 集成:LLM Coder 项目旨在通过在 prompt 中提供主要 API 并将其集成到 VS Code 中,来提高 Claude 对库的理解。

- 该倡议寻求提供更准确的代码建议,并邀请开发者表达兴趣并为其开发做出贡献。

LlamaIndex Discord

-

LlamaParse 集成 Azure OpenAI 端点:LlamaParse 现在支持 Azure OpenAI 端点,在确保企业级安全性的同时,增强了其解析复杂文档格式的能力。

- 这一集成允许用户通过定制的 API 端点,在应用程序中有效地管理敏感数据。

-

CXL 内存提升 RAG 流水线性能:来自 MemVerge 的研究表明,利用 CXL 内存可以显著扩展 RAG 应用程序的可用内存,从而实现全内存运行。

- 这一进展预计将提升检索增强生成(RAG)系统的性能和可扩展性。

-

使用 LlamaIndex 构建质量感知型文档聊天机器人:通过结合用于文档摄取与检索的 LlamaIndex 和用于监控的 aimon_ai,开发者可以构建一个具有质量感知能力的文档聊天机器人,主动检查幻觉等问题。

- LlamaIndex 利用 milvus 作为向量存储,确保聊天机器人能够进行高效且有力的数据检索。

-

MSIgnite 展示 LlamaParse 和 LlamaCloud 功能:在 #MSIgnite 期间,Farzad Sunavala 和 @seldo 在分组会议中发布了关于 LlamaParse 和 LlamaCloud 的重大公告。

- 演示重点展示了多模态解析,突出了 LlamaParse 处理各种文档格式的能力。

-

BM25 检索器与 Postgres 的兼容性:一位成员询问关于构建 BM25 检索器并将其存储在 Postgres 数据库中的问题,得到的回复建议需要一个 BM25 扩展来实现此功能。

- 这种集成将在 Postgres 管理的环境中实现更高效的检索过程。

tinygrad (George Hotz) Discord

-

TinyCloud 发布,搭载 54 块 7900XTX GPU:即将发布的 TinyCloud 令人期待,到今年年底,它将包含 9 台 tinybox red,共配备 54 块 7900XTX GPU,供在 tinygrad 中使用 CLOUD=1 的贡献者使用。

- 来自 tiny corp 的推文确认,由于使用了定制驱动程序,该设置将非常稳定,确保用户只需一个 API key 即可简便使用。

-

招聘云基础设施和 FPGA 专家:GeorgeHotz 强调需要聘请一名全职云基础设施开发人员来推进 TinyCloud 项目,并征集有意贡献的 FPGA 后端专家。

- 他强调这是支持开发并有效维护项目基础设施的必要条件。

-

流片就绪:支持 Qualcomm DSP 和 Google TPU:根据 GeorgeHotz 的概述,流片(tapeout)就绪的前置条件包括从 tinygrad 中移除 LLVM,并添加对 Qualcomm DSP 和 Google TPU 的支持。

- 此外,目前的重点还包括开发 tinybox FPGA 版本,目标是实现自主 AMD 技术栈。

-

tinygrad 中的 GPU 基数排序优化:用户讨论了通过支持 64 位、负数和浮点数来增强 GPU 基数排序(radix sort),并强调通过分块(chunking)来提高大数组的性能。

- 一个相关的示例展示了使用 UOp.range() 来优化 Python 循环。

-

排序算法的向量化技术:参与者探索了潜在的向量化技术,以优化排序算法中迭代数字并更新排序输出的部分。

- 其中一个建议包括使用直方图为每个位置预填充一个常量张量,以实现更高效的赋值。

Torchtune Discord

-

Torchtune 提交数突破 1000 次:一名成员祝贺团队在 Torchtune 主仓库完成了第 1000 次 commit,这体现了项目团队的专注与投入。

- 附带的图片展示了这一里程碑,突显了团队的辛勤工作和承诺。

-

由 Torchtune 驱动的教育聊天机器人:一位用户正在利用 OpenAI assistants 开发一款专注于问答(QA)和网络安全的教育聊天机器人,并寻求关于 Torchtune 兼容性和微调流程的指导。

- Torchtune 强调开源模型,需要获取模型权重(model weights)才能进行有效的微调。

-

提升 LoRA 训练性能:成员们讨论了 LoRA 单设备 recipes 的性能,询问了训练速度和收敛时间。

- 一位成员指出,将学习率提高 10 倍可以改善训练性能,这暗示了一个潜在的优化路径。

-

通过 Activation Offloading 提升内存效率:对话涉及了 DPO 中的 activation offloading,成员们表示并未观察到显著的内存收益。

- 一位成员幽默地表达了困惑,同时在寻求一个可能澄清这些问题的公开 PR。

OpenInterpreter Discord

-

Open Interpreter OS 模式 vs 普通模式:Open Interpreter 现在通过 CLI 提供普通模式,并通过具有 GUI 功能的 OS 模式提供服务,后者需要多个模型进行控制。

- 一位用户强调,他们打算将 OS 模式用作通用的网页爬虫,并专注于 CLI 应用。

-

Open Interpreter Point API 问题:用户报告称 Open Interpreter Point API 似乎已宕机,并持续出现错误。

- 这些困难引起了社区对该 API 可靠性的担忧。

-

围绕 MCP 工具的兴奋:新的 MCP tool 引起了巨大的反响,成员们将其描述为“疯狂的”且非常巨大(really HUGE)。

- 这反映了社区对探索其功能的兴趣日益增长。

-

MCP 工具集成与速查表:成员们分享了已安装的 MCP 服务器和工具列表,包括 Filesystem、Brave Search、SQLite 和 PostgreSQL。

- 此外,还提供了速查表(cheatsheets)以帮助最大限度地利用 MCP,强调了社区共享资源的重要性。

Axolotl AI Discord

-

SmolLM2-1.7B 发布:社区对 SmolLM2-1.7B 的发布表现出极大的热情,强调了其对 LLM 任务前端开发的影响。

- “这太疯狂了!”一位成员评论道,强调了开发者在可访问性和能力方面的转变。

-

Transformers.js v3 发布:Hugging Face 宣布发布 Transformers.js v3,引入了 WebGPU 支持,其性能比 WASM 快达 100 倍。

- 该更新包括 25 个新的示例项目和 120 种支持的架构,为开发者提供了丰富的资源。

-

前端 LLM 集成:一位成员强调了 LLM 任务在前端的集成,这标志着应用开发的一个重要演进。

- 这一进步展示了当今开发者可以利用的日益增强的能力。

-

Qwen 2.5 微调配置:一位用户寻求在 Axolotl 中配置 Qwen 2.5 模型全量微调的指导,重点关注影响训练效果的参数。

- 存在关于特定 unfrozen_parameters 必要性的疑问,表明需要对模型配置有更深入的理解。

-

模型配置指导:用户对微调各种模型的配置设置表现出浓厚兴趣。

- 一位用户询问如何获取未来模型类似设置过程的指导,突显了持续的社区学习。

MLOps @Chipro Discord

-

Feature Store 网络研讨会助力 ML 流水线:参加由创始人 Simba Khadder 主持的 12 月 3 日太平洋时间上午 8 点的 Feature Store 网络研讨会。了解 Featureform 和 Databricks 如何通过简化 ML 生态系统中的 Feature Store 类型,来促进大规模数据流水线的管理。

- 本次会议将深入探讨处理 PB 级(petabyte-level) 数据以及使用 Apache Iceberg 实现版本控制,为增强你的 ML 项目提供实战见解。

-

GitHub 总部举办 Multi-Agent 训练营:注册参加 12 月 4 日在 GitHub 总部举行的 Multi-Agent Framework Bootcamp。参与专注于 Multi-Agent 系统的专家演讲和工作坊,并获得与行业领袖交流的机会。

- 议程包括由 Lorenze Jay 和 John Gilhuly 带来的《使用 CrewAI 自动化繁琐事务》以及《通过评估构建生产就绪的 Agents》等环节。

-

为 AI 工程师分享 LLMOps 资源:一位成员分享了一个 LLMOps 资源,强调了其三部分结构,并敦促同行将其加入书签以进行全面的 LLMOps 学习。

- Large language models 正在推动一场变革浪潮,使 LLMOps 成为 AI 工程中新兴的运营框架。

-

LLMs 彻底改变技术交互:Large Language Models (LLMs) 正在重塑与技术的交互方式,为 chatbots、virtual assistants 和高级搜索引擎提供动力。

- 它们在开发个性化推荐系统中的作用标志着行业内运营方法的重大转变。

LAION Discord

-

使用 Whisper 进行高效音频字幕生成:一位用户寻求使用 Whisper 加快音频数据集字幕生成的方法,但在对短音频文件进行批处理时遇到了问题。

- 他们强调,Batching(批处理)将处理时间从 13 分钟缩短到了 1 分钟,并进一步优化至 17 秒。

-

Whisper 批处理优化:用户讨论了在 Whisper 中对短音频文件进行批处理的挑战,旨在提高效率。

- 强调了通过批处理减少处理时间的效果,展示了从 13 分钟到 17 秒的飞跃。

-

字幕脚本限制:用户分享了用于 Whisper 音频处理的 字幕脚本。

- 他们指出,该脚本在批处理机制中难以高效处理短音频文件。

-

Faster Whisper 集成:提到了 GitHub 上的 Faster Whisper,以利用 CTranslate2 提升转录速度。

- 该用户表示打算利用此工具更快速地处理其音频数据集。

Gorilla LLM (Berkeley Function Calling) Discord

-

BFCL 中的 Llama 3.2 默认提示词:据用户观察,Llama 3.2 模型使用了来自 BFCL 的默认系统提示词。

- 这种对标准配置的依赖表明在评估模型性能时具有一致的基准。

-

多轮对话类别影响准确率:于 9 月中旬引入的多轮对话(multi turn)类别导致 v3 版本发布后整体准确率明显下降。

- 这些具有挑战性的类别对各种模型的平均得分产生了负面影响,而 v1 和 v2 基本上未受影响。

-

新指标导致排行榜分数变化:10/21 和 11/17 的最新排行榜更新显示,由于引入了针对多轮对话类别的新评估指标,分数出现了显著波动。

- 之前正确的条目现在可能被标记为错误,这突显了旧版状态检查器(state checker)的局限性以及新指标 PR #733 的改进。

-

公开发布生成结果:已宣布计划上传并公开分享用于排行榜检查点的所有生成结果,以方便查看错误日志。

- 这一举措旨在为观察到的不同模型间的 Agentic 行为差异提供更深入的见解。

-

多轮对话类别中 Prompting 模型 vs FC:在多轮对话类别中,Prompting 模型的表现往往优于其 FC (Function Calling) 对应模型。

- 这一观察结果引发了关于在具有挑战性的评估场景中 Prompting 有效性的讨论。

LLM Agents (Berkeley MOOC) Discord

- 测验分数确认邮件缺失:一名成员报告在提交后未收到测验分数的确认邮件,这引发了对通知系统可靠性的担忧。

- 作为回应,另一名成员建议检查垃圾邮件文件夹或使用不同的电子邮件地址,以确保提交已被正确记录。

- 电子邮件提交故障排除:为了解决电子邮件问题,一名成员建议验证是否发送了来自 Google Forms 的确认邮件。

- 他们强调,如果没有收到电子邮件,很可能表明提交未成功,并建议进一步调查表单的配置。

Mozilla AI Discord

- Hidden States Unconference 邀请 AI 创新者:欢迎参加在旧金山举行的 Hidden States Unconference,这是一场研究人员和工程师探索 AI 界面和隐藏状态的聚会,时间为 12月5日。

- 这一为期一天的活动旨在通过协作讨论推向 AI 方法的边界。

- 宣布构建超轻量级 RAG 应用工作坊:在 12月10日 即将举行的工作坊中,学习如何使用 sqlite-vec 和 llamafile 配合 Python 创建检索增强生成 (RAG) 应用程序。

- 参与者将体验在没有任何额外依赖项的情况下构建应用程序。

- ESM-1 生物表征学习启动:Paper Reading Club 将于 12月12日 讨论 Meta AI 的 ESM-1 蛋白质语言模型,作为生物表征学习系列的一部分。

- 本次会议旨在吸引参与者关注 AI 在生物研究中的创新应用。

- Demo Night 展示湾区创新:参加 12月15日 的旧金山 Demo Night,见证来自 AI 领域当地创作者的突破性演示。

- 该活动由 Gen AI Collective 主办,重点展示技术与创意的交汇。

- 与 Linda Dounia Rebeiz 一起解决数据偏差:12月20日 加入《时代》周刊百大人物 Linda Dounia Rebeiz,了解她使用策划数据集训练无偏见 AI 的方法。

- 她将讨论使 AI 能够反映现实而非强化偏见的策略。

AI21 Labs (Jamba) Discord

- Jamba 1.5 Mini 集成至 OpenRouter:一名成员尝试通过 OpenRouter 使用 Jamba 1.5 Mini Model,并配置了位置和用户名等参数。

- 然而,与不使用函数调用的成功输出相比,function calling 在 JSON 响应的 content 字段中返回了空输出。

- OpenRouter 上的 Function Calling 产生空输出:当通过 OpenRouter 使用 function calling 时,Jamba 1.5 Mini Model 在 JSON 响应中返回了空的 content 字段。

- 这一问题在不调用 function calling 的情况下并未出现,表明该设置存在特定问题。

- OpenRouter 使用的密码更改请求:一名成员请求更改与通过 OpenRouter 使用 Jamba 1.5 Mini Model 相关的密码。

- 他们详细说明了为用户数据管理设置的参数,如位置和用户名。

HuggingFace Discord 没有新消息。如果该公会长时间保持沉默,请告知我们,我们将将其移除。

第二部分:按频道详细摘要与链接

完整的逐频道详情已针对电子邮件进行截断。

如果您喜欢 AInews,请分享给朋友!预谢!