ainews-google-wakes-up-gemini-20-et-al

以下是几种不同语气的翻译供你参考: * **标准直译:** 谷歌觉醒:Gemini 2.0 及其他 * **更具冲击力(新闻标题风):** 谷歌发力:Gemini 2.0 及其系列产品 * **意译:** 谷歌苏醒:Gemini 2.0 等重磅发布

Google DeepMind 推出了 Gemini 2.0 Flash,这是一款性能超越 Gemini 1.5 Pro 和 o1-preview 的新型多模态模型,具备视觉和语音 API、多语言能力以及原生工具调用功能。它为 Project Astra 和 Project Mariner 等新型 AI 智能体提供动力,其中 Project Mariner 在 WebVoyager 基准测试中达到了 83.5% 的业界领先水平。OpenAI 宣布了 ChatGPT 与 Apple 设备的集成,实现了 Siri 接入和视觉智能功能。Claude 3.5 Sonnet 被指出是 Opus 的蒸馏版本。AI 社区在 NeurIPS 2024 上的反响非常积极,标志着谷歌在 AI 创新领域的强势回归。关键主题包括多模态、智能体开发、多语言性、基准测试和模型发布。

TPUs are all you need.

2024年12月10日至12月11日的 AI 新闻。我们为您检查了 7 个 subreddits、433 个 Twitters 和 31 个 Discords(207 个频道,6549 条消息)。预计节省阅读时间(按每分钟 200 字计算):649 分钟。您现在可以标记 @smol_ai 进行 AINews 讨论!

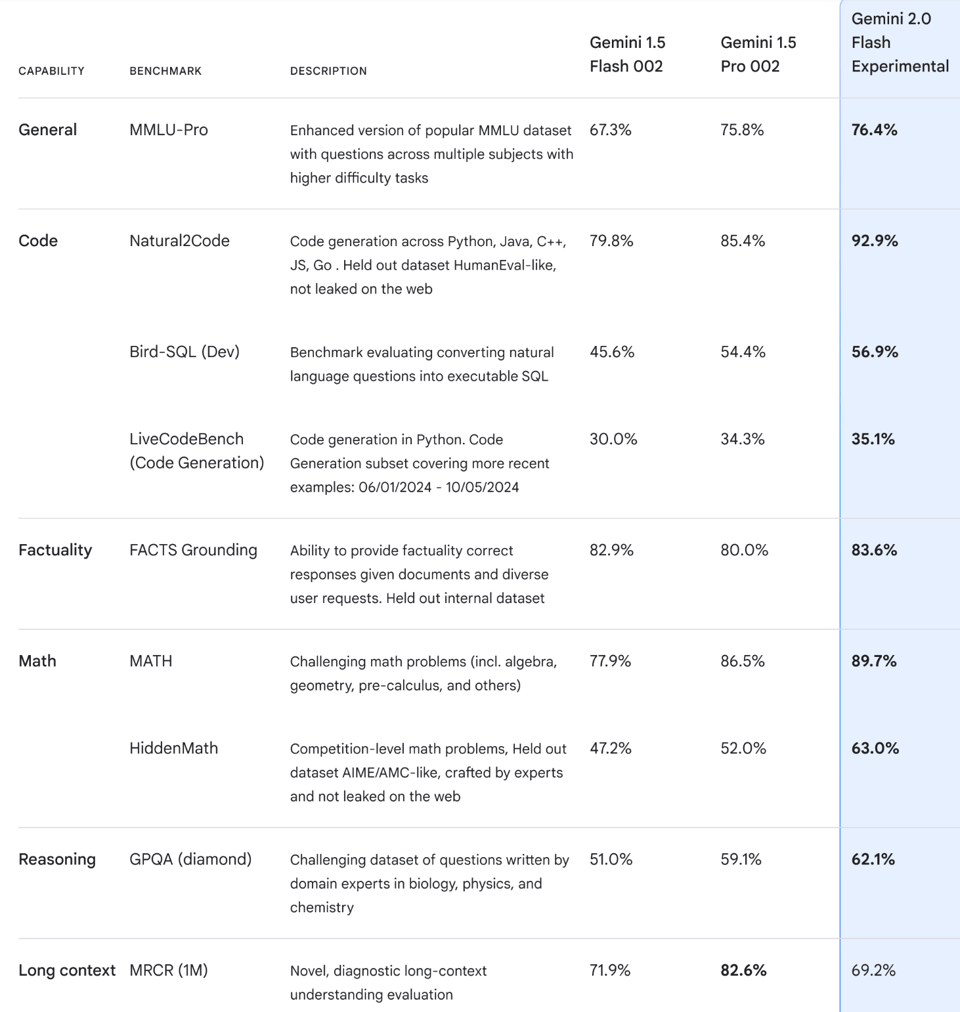

这是 NeurIPS 的第一天会议,正如之前通过各种 Gemini-Exp 版本所预热的那样,Sundar Pichai 强势推出了 Google 的首个官方 Gemini 2 模型 —— Gemini Flash。 没人预料到 2.0 Flash 能击败 1.5 Pro,但事实确实如此:

它在 LMArena 上也击败了 o1-preview(但仍落后于 Gemini-Exp-1206,即疑似的 2.0 Pro 模型)。

价格是“免费”的 —— 只要 2.0 Flash 仍处于实验阶段。仿佛这还不够,2.0 Flash 还发布了多模态(视觉和语音)API,Paige Bailey 甚至顺道参加了今天的 Latent Space LIVE/Thrilla on Chinchilla 活动,展示了它如何实现 OpenAI 今天不敢发布的功能:

图像输出(Image output)也经过了训练并进行了预热但尚未发布,但它可以以你从未见过的方式“画出猫头鹰的其余部分”(draw the rest of the owl)。

他们还宣布了一系列限量预览的功能:

- Deep Research:“一个可以深入研究复杂主题并为您创建包含相关来源链接报告的研究助手。”

- Project Mariner:一个浏览器 Agent,“能够理解并推理浏览器屏幕上的各种信息 —— 像素、文本、代码、图像 + 表单 —— 然后利用这些信息为您完成任务”,在 WebVoyager 基准测试中达到了 83.5% 的 SOTA。

- Project Astra 更新:多语言支持、新的工具使用(tool use)、10 分钟的会话记忆、流式/原生音频延迟。

- Jules,一个将使用 Gemini 2.0 的实验性 AI 驱动代码 Agent。Jules 异步工作并集成到您的 GitHub 工作流中,在您专注于真正想要构建的内容时,处理 Bug 修复和其他耗时的任务。Jules 创建全面的多步骤计划来解决问题,高效地修改多个文件,甚至准备 Pull Request 以将修复直接提交回 GitHub。

NeurIPS 现场以及线上 X/Reddit/Discord 上的每个人评论和印象都非常正面。Google 强势回归!

AI Twitter 综述

所有综述由 Claude 3.5 Sonnet 完成,取 4 次运行中的最佳结果。

以下是按相关类别整理的关键讨论:

重大模型发布与更新

-

Gemini 2.0 Flash 发布:@demishassabis 宣布了 Gemini 2.0 Flash,其性能超越 1.5 Pro 且速度快两倍,具备原生 Tool Use、多语言能力以及包括图像生成和 Text-to-Speech 在内的全新多模态功能。该模型将驱动 Project Astra 和 Project Mariner 等新的 Agent 原型。

-

ChatGPT + Apple 集成:OpenAI 宣布 ChatGPT 已集成到 iOS、iPadOS 和 macOS 的 Apple 体验中,允许通过 Siri、视觉智能功能和写作工具进行访问。

-

Claude 性能:@scaling01 指出 Claude 3.5 Sonnet 似乎是 Opus 的蒸馏版本,且 Opus 训练完成已得到确认。

行业发展与分析

-

Google 的进展:多位研究人员观察到 Google 的进步,Gemini 2.0 Flash 表现强劲,但指出其尚未达到生产就绪状态。该模型在 SWE-bench 等基准测试中取得了令人印象深刻的成绩。

-

竞争动态:@drjwrae 强调,虽然 1.5 Flash 因其性价比而受欢迎,但 2.0 带来的性能已匹配或超过 1.5 Pro。

-

商业影响:关于市场动态的讨论,@saranormous 指出 AI 行业的博弈才刚刚开始,并将其与互联网发展历经数十年才尘埃落定的过程进行了类比。

研究与技术进展

-

NeurIPS 会议:多位研究人员分享了来自 #NeurIPS2024 的更新,包括 @gneubig 关于 Agent、LLM + 神经科学以及 Alignment 的演讲。

-

LSTM 讨论:@hardmaru 分享了 Sepp Hochreiter 关于 xLSTM 在推理速度和参数效率方面优于 Attention Transformer 的主题演讲。

幽默与梗

-

行业评论:@nearcyan 提到:“Twitter 对 OpenAI 的 12 天发布活动感到惊艳的唯一方式,就是它以 GPT-5 开始并以 GPT-17 结束。”

-

AI 模型命名:关于 AI 模型命名惯例的讨论,各种幽默的观点 针对不同公司的做法发表了看法。

AI Reddit 综述

/r/LocalLlama 综述

主题 1. Gemini 2.0 Flash 的成就与对比

- Gemini 2.0 Flash 在 SWE-Bench 上击败 Claude Sonnet 3.5 出乎我的意料 (得分: 287, 评论: 53):Gemini 2.0 Flash 在 SWE-bench Verified 基准测试中达到了 51.8% 的性能,超过了 Claude Sonnet 3.5 的 50.8%。GPT-4o 和 o1-preview 等其他模型的得分在 31.0% 到 41.0% 之间,显示出显著的性能差距。

- Scaffolding 与测试方法:讨论强调了 Scaffolding 在模型性能中的重要性,一些用户指出 Gemini 2.0 Flash 利用多种采样方法来获得高分,而不像 Claude Sonnet 3.5 被认为是一个更直接的模型。争论点在于,由于测试方法论的差异(例如使用数百个样本对比 Single-shot 方法),模型之间的比较是否公平。

- Context Window 与性能:Gemini 2.0 Flash 因其更大的 Context Window 而受到关注,一些用户认为这使其优于 Claude 和 o1 等模型。这种能力被视为处理现实世界软件工程任务的关键,促成了其在 SWE-bench Verified 基准测试中的高分。

- 行业观点与担忧:关于 Google 和 OpenAI 等公司在 AI 领域主导地位的更广泛讨论,用户对这种控制权带来的影响表示担忧。一些人因为 Google 对开源项目的贡献而更青睐它,而另一些人则担心 OpenAI 等公司快节奏的开发方式。

- Gemini Flash 2.0 experimental (Score: 141, Comments: 53): Gemini Flash 2.0 正在被讨论,这与 Sundar Pichai 通过其 Twitter 帖子 宣布的一项实验性更新有关。该更新据推测包含新功能或改进,尽管帖子中未提供具体细节。

- Gemini 2.0 Flash 性能: 该模型在 natural code 上表现出 92.3% 的准确率,取得了显著进步,相比 1.5 Pro 版本提升了 7%,使 Google 成为 OpenAI 的强力竞争对手。然而,与之前的 1.5 Flash 模型相比,它在 MRCR 长上下文基准测试中的表现较差,这表明在通用改进与特定能力之间存在权衡。

- API 与使用: 用户可以通过 Google AI Studio 以“按需付费”模式访问该模型,费用为 每 1M token 输入 $1.25 以及 每 1M token 输出 $5。AI Studio 中有 每日 1500 次回复的限制,部分用户遇到了 QUOTA_EXHAUSTED 问题,这可能是由于 API key 的配置导致的。

- 市场与未来预期: 用户对具有增强多模态能力的 Gemma 3 充满期待,反映了用户对未来发展的兴趣。该模型的定价策略被视为潜在的市场主导因素,其对原生工具使用和实时应用的集成被强调为一项关键创新。

- Gemini 2.0 Flash Experimental, 有人试过吗? (Score: 96, Comments: 44): Gemini 2.0 Flash Experimental 提供了 多模态理解与生成 能力,支持处理代码以及生成文本和图像等用例。界面详细列出了 定价,在 128K tokens 以内及以上,输入和输出 token 均为 $0.00,知识截止日期 为 2024 年 8 月,速率限制 设置为每分钟 15 次请求。

- Gemini 2.0 的 物体定位 (object localization) 能力给用户留下了深刻印象,它可以检测指定的物体类型并绘制边界框,而无需进行自定义 ML 训练,这是 ChatGPT 所不具备的功能。

- 用户注意到了 Gemini 2.0 的 速度,一些人将其在数据科学任务中的表现与 Claude 进行了比较。虽然这两个模型在错误纠正方面都表现欠佳,但用户赞赏 Google 采用多个模型相互测试的方法,尽管遇到了需求限制,且与 Claude 更复杂的功能相比,其提供的功能较为基础。

- 据报道存在一些兼容性问题,例如与 cline 和 cursor composer 的兼容性,不过建议采用编辑扩展文件等变通方法。此外,根据公告,图像生成 目前仅限于早期测试人员。

主题 2. QRWKV6-32B 与 Finch-MoE-37B-A11B:线性模型的创新

- 新型线性模型:QRWKV6-32B(基于 Qwen2.5-32B 的 RWKV6)和基于 RWKV 的 MoE:Finch-MoE-37B-A11B (Score: 81, Comments: 28): Recursal 发布了两个实验性模型 QRWKV6-32B 和 Finch-MoE-37B-A11B,它们利用高效的 RWKV Linear attention 机制来降低时间复杂度。QRWKV6 将 Qwen2.5 架构与 RWKV6 相结合,允许在不从头开始重新训练的情况下进行转换;而 Finch-MoE 是一个 Mixture-of-experts 模型,总参数量为 37B,激活参数量为 11B,并承诺未来会进行扩展和改进。更多模型如 Q-RWKV-6 72B Instruct 和 Q-RWKV-7 32B 正在开发中。欲了解更多详情,请访问其 Hugging Face model cards 和 Finch-MoE。

- RWKV 的潜力与局限性:评论者讨论认为,虽然 RWKV 具有理论上的速度优势并能处理长 context lengths,但目前的推理引擎尚未针对充分实现这些优势进行优化。尽管由于训练资源有限导致对短 context lengths 有所担忧,但人们对将 Transformer 转换为 RWKV 的实用性仍感兴趣。

- 实施挑战:在 koboldcpp 等平台上实施 QRWKV6 等新架构存在挑战,因为这通常需要社区投入专门精力进行适配和实现。RWKV 社区被认为有潜力最终克服这些障碍。

- 未来发展与预期:评论者对 RWKV 7 等未来模型以及 QwQ 模型表示期待。人们对线性推理模型抱有希望,讨论中还涉及了需要 reasoning-style 数据来改进模型转换和推理时的思考过程。

- QwQ-32B Preview 的 Speculative Decoding 可以使用 Qwen-2.5 Coder 7B 完成! (Score: 69, Comments: 28): 该帖子讨论了使用 Qwen-2.5 Coder 7B 作为 QwQ-32B Speculative Decoding 的 draft model,并指出这两个模型的 vocab sizes 匹配。在 16 GB VRAM 的系统上,性能提升有限,但作者预计在更大 VRAM 的 GPU(如 24 GB)上会有显著改进。主观上,配合 Qwen Coder 的 QwQ 显得更加自信且逻辑清晰,尽管它使用了更多的字符和时间;作者邀请其他人进行实验并分享结果。提供了详细输出的 PDF link。

- Speculative Decoding 技术:关于在较大的 QwQ-32B 模型中使用较小的 draft model 的有效性存在争论。一些用户建议,当较小模型的尺寸显著小于较大模型的十分之一(例如 0.5B 或 1.5B 模型)时,速度提升才明显,而模型过大则效果不佳。

- 性能观察:用户报告称,在某些配置下,Speculative Decoding 可以带来 1.5x 到 2x 的加速,尽管逻辑或质量上的感知提升是主观的。建议使用固定 seed 来验证感知的改进是源于 Speculative Decoding,还是由于 GPU offload 不准确等其他因素。

- Speculative Decoding 方法:提到了两种 Speculative Decoding 方法:一种是从两个模型中采样,仅在采样一致时才使用较小模型;另一种是使用较小模型的 logits 进行 rejection sampling。llama.cpp 中实现的具体方法对某些用户来说仍不明确。

Other AI Subreddit Recap

r/machinelearning, r/openai, r/stablediffusion, r/ArtificialInteligence, /r/LLMDevs, /r/Singularity

Theme 1. Google’s Gemini 2.0: Strategic Release Amidst OpenAI Announcements

- Google 在 OpenAI 每日直播前几小时发布 Gemini 2.0: (Score: 244, Comments: 64):Google 在 OpenAI 每日直播活动开始前几小时发布了 Gemini 2.0,引发了关于 GPT-5/Epsilon 可能获得确认的猜测。这一时机暗示了这两家科技巨头在 AI 领域的竞争态势。

- Gemini 2.0 性能:用户注意到 Gemini Flash 2.0 在基准测试中表现异常出色,有人认为它的表现可能超过 Sonnet 3.5 等模型,且性价比可能高于 4o-mini。其上下文窗口(context window)比前代产品显著增大,使其在编程任务中特别有用。

- 市场动态:舆论强烈支持 Google 与 OpenAI 之间的竞争,因为这能推动创新并防止垄断导致的停滞。用户赞赏这种竞争格局,它促使公司不断改进其产品。

- 采用与普及:尽管对其知名度存在一些怀疑,但 Gemini 已集成到许多 Google 产品中,随着其性能得到更多认可,这可能会促进其普及。它已在 AI Studio 等平台上开放测试,用户发现它易于访问且功能强大。

- Google 刚刚推出了 Gemini 2.0 (Score: 202, Comments: 45):Google 在 OpenAI 周期间推出了 Gemini 2.0,这表明其采取了战略举措来展示 AI 技术和可访问性方面的进展。

- 讨论中强调了对 Google Gemini 2.0 的怀疑,一些用户因缺乏新的核心智能特性以及对 Google 历史上在演示中过度承诺的担忧而表示失望。另一些人则反驳称,Gemini 已经可以在 aistudio 上进行测试,预计 Agents 将于 1 月推出,部分用户报告了对该技术的积极体验。

- 讨论还强调了 Google 凭借其 TPUs 的使用在价格上压低 OpenAI 的潜力,暗示 Google 可能会主导 AI 市场。对 OpenAI 定价策略和产品发布(如每月 200 美元的模型和 Sora 的发布)的批评,暗示了其财务困境以及相对于 Google 集成化方法的竞争劣势。

- 一些用户猜测公告的战略时机,Google 的发布时机可能旨在抢在 OpenAI 预期的公告之前。竞争格局被视为一种动态的“针锋相对”环境,一些用户表示乐于看到这些主要的 AI 公司进行竞争。

主题 2. Google GenCast:15 天 AI 天气预报引领未来预测

- Google 称其 AI 天气模型精通 15 天预报 (Score: 286, Comments: 38):据报道,DeepMind 的 GenCast AI 模型在 15 天天气预报中实现了超过 97% 的精度,在 35 个以上国家的表现优于各种传统模型。欲了解更多详情,请参阅 phys.org 上的文章。

- 用户对 AI 驱动的天气预报的准确性表示怀疑,一些人指出目前超过 5 天的预报通常不可靠。一位评论者认为,对于两周以上的预报,历史平均值可能比预测更准确。

- GenCast 模型的代码库可通过出版物中的链接访问,这对于有兴趣进一步检查或利用该模型的人来说非常有用。

- 讨论涉及了 AI 模型潜在的数据来源,一些用户猜测像 GenCast 这样的模型可能依赖 NOAA 数据。然而,其他人强调 AI 不会取代卫星和气象站等传统数据收集方法。

主题 3. ChatGPT 停机:提升稳定性和用户依赖性的困扰

- 我来问问 ChatGPT 是不是挂了… 看来其他 5,000,000 人也是这么想的… (Score: 299, Comments: 186): ChatGPT 遭遇宕机,在期末考试期间给学生带来了困扰。这一问题引起了广泛关注,许多用户都在寻求确认服务是否中断。

- 期末周期间 ChatGPT 的宕机引发了学生的极大不满,凸显了它作为学习和完成作业工具的重要性。用户表达了在编程和头脑风暴等任务中对它的依赖,并强调它不仅仅是作弊的手段。

- 服务中断引发了幽默又无奈的反应,一些用户开玩笑地责怪自己导致了崩溃,而另一些人则回忆起使用 Chegg 等替代方案的经历。这一事件凸显了在关键学术时期对 AI 工具的高需求和依赖。

- 多条评论指出此类宕机非常罕见,认为这是由于使用量增加和近期更新导致的倒霉时机。宕机引发了幽默的调侃,同时也引发了对学术表现受影响的严重担忧。

-

**[⚠️ ChatGPT, API & SORA 目前已宕机!重大故障 2024年12月11日](https://i.redd.it/25fc77iu4b6e1.png)** (Score: 195, Comments: 80): 重大故障:在 2024年12月11日,严重的宕机影响了 ChatGPT、API 和 Sora 服务,OpenAI 的状态页面显示正在调查中。90 天运行时间图表显示 API 和 ChatGPT 处于“Major Outage”状态,而 Labs 和 Playground 仍保持“Operational”。 - 许多用户推测 iOS 18.2 更新和最近推出的 Sora 导致了此次宕机,集成到 Siri 和 Writing Tools 中的 ChatGPT 支持等新功能可能给服务器带来了压力。dopedub 指出,这些更新的时机可能选得不好,导致了系统过载。

- 舆论普遍反映了对 ChatGPT 的依赖,如 legend503 的评论强调了在 AI 工具不可用时,这种依赖是多么脆弱。用户对宕机表达了沮丧和幽默,一些人建议在宕机期间使用替代平台或方法来访问 ChatGPT。

- 用户分享了各种变通方法,例如尝试通过 iPhone 或使用 mobile app 访问 ChatGPT,并报告取得了一些成功。InspectorOk6664 等人指出,他们设法访问了服务,尽管功能有限,这表明宕机的影响在不同平台上有所不同。

主题 4. Sora AI 批评:产出逊于竞争对手,引发用户不满

- Sora 太糟糕了 (Score: 350, Comments: 193): Sora 的表现受到严厉批评,因为它无法准确生成视频,即使是让猫跳舞这样的简单任务,产出的质量也很差。用户对 Sora 的成本表示不满,认为与其他更有效且通常更便宜或免费的 text-to-video 生成器相比,除非有显著改进,否则该服务的价格并不合理。

- Sora 的性能与局限性:许多用户一致认为 Sora 的表现不如 Runway Gen-3 和 Luma 等替代方案,并抱怨它无法有效处理 image-to-video 生成等任务。用户注意到,公开版的 Sora 是一个缩减版的 “Turbo” 模型,缺乏早期展示的演示版本所具备的计算能力。

- 技术与市场挑战:评论认为 Sora 的局限性源于计算限制以及平衡需求与可用资源的需要,导致发布的是一个“缩水”版本。这让那些期待早期演示中展示的功能的用户感到失望,因为那些演示可能使用了比公开版更多的资源。

- 社区情绪与对比:社区对 OpenAI 处理 Sora 的方式表示怀疑,一些人推测该产品是为了与 Google 的 Gemini Pro 竞争而战略性发布的。用户还批评 OpenAI 的 Dalle 不如 MidJourney,表明了对 OpenAI 产品相对于竞争对手的普遍不满。

- 使用 Sora AI 重现我最喜欢的 AI 视频 (得分: 2574, 评论: 140): Sora AI 因无法完成预期任务而受到批评,导致了负面的用户反馈。该帖子提到尝试使用 Sora AI 重现一段最喜欢的 AI 视频,突显了用户对其表现的不满。

- 用户压倒性地更喜欢原始视频而非 Sora AI 的重制版,理由是原版更具幽默感和吸引力。许多评论对 AI 生成内容的真实感和质量表示不满,一些用户还注意到了不当元素,如色情帧。

- 用户对 Sora AI 使用的 Prompt 和训练数据 存在推测和好奇,一些用户质疑它是否在不当内容上进行了训练。讨论暗示了用户希望了解该 AI 的开发过程及其局限性。

- 对话中包含了对 AI 输出的幽默和批评性评论,例如将其与游戏角色进行比较,以及提及 9/11 等文化事件。尽管存在批评,但人们也认可了该 AI 在展示技术演进和潜在未来应用方面的作用。

AI Discord 摘要

由 O1-mini 生成的摘要之摘要之摘要

主题 1. 新 AI 模型与重大更新

- Gemini 2.0 Flash 以卓越性能发布:Google DeepMind 推出了 Gemini 2.0 Flash,在 Chatbot Arena 总榜中首次亮相即排名第 3,表现优于 Flash-002 等模型。此次发布增强了多模态能力和编程性能,为 AI 模型开发树立了新标杆。

- Nous Research 发布 Hermes 3 以增强推理能力:Nous Research 在 Hugging Face 上发布了 Hermes 3 3B,提供针对尺寸和性能优化的量化 GGUF 版本。Hermes 3 在用户对齐、Agent 性能和推理方面引入了高级功能,标志着其较前代产品的重大升级。

- Windsurf Wave 1 增强开发者工具:Windsurf Wave 1 正式发布,集成了 Cascade Memories 和自动终端命令等主要自主工具。此次更新还提升了图像输入能力,并支持 WSL 和 devcontainers 等开发环境。查看完整变更日志了解详细增强功能。

主题 2. AI 工具性能与对比分析

- Windsurf 在 AI 工具对比中超越 Cursor:社区讨论强调 Windsurf 是比 Cursor 更优越的 AI 工具,强调其更可靠的通信和透明的变更日志。用户赞赏 Windsurf 的更新方式和响应速度,使其在 AI 工具领域处于领先地位。

- Muon 优化器成为 AdamW 的强力替代方案:Muon 优化器因其稳健的基准性能和坚实的数学基础而受到关注,被定位为 AdamW 等传统优化器的可行替代方案。尽管它尚未超越 AdamW,但其在 Llama 3 等模型中的韧性突显了其在未来开发中的潜力。

- Gemini 2.0 Flash 在编程任务中超越竞争对手:Gemini 2.0 Flash 因其在空间推理和迭代图像编辑方面的卓越表现而受到称赞,超越了 Claude 3.5 和 o1 Pro 等模型。用户注意到了其极具竞争力的基准测试结果,引发了关于其相对于现有产品进步的进一步讨论。

主题 3. 功能集成与平台增强

- ChatGPT 与 Apple 生态系统无缝集成:在 12 Days of OpenAI 活动期间,ChatGPT 成功集成到 iOS 和 macOS。由 Sam Altman 及其团队成员演示,此次集成包括增强的节日主题功能,旨在节日期间吸引用户。

- NotebookLM 通过集成 Gemini 2.0 提升功能:NotebookLM 确认集成了 Gemini 2.0,增强了其在 Discord 频道内进行实时 AI 交互的能力。尽管品牌选择受到了一些幽默的批评,但此次升级预计将增强 NotebookLM 的性能。

- Supabase 集成增强 Bolt.new 工作流:Bolt.new 在直播中预览了其 Supabase 集成,承诺为开发者提供改进的工作流功能。此次集成旨在简化现有流程,并通过增强平台的实用性来吸引更多用户。

主题 4. 定价、使用透明度和订阅模式

- Windsurf 推出透明定价和使用情况更新:Windsurf 推出了更新的定价系统,其特点是新增了 快速设置面板,可显示当前方案的使用情况和试用期到期时间。该更新还在 Cascade 中包含了一个“Legacy Chat”模式,在耗尽 Flow Credits 后激活,提供有限的功能而无需额外费用。

- 自助升级方案简化订阅管理:Windsurf 推出了自助升级方案按钮,允许用户通过此链接轻松访问更新的方案。此功能简化了根据项目需求扩展订阅的过程,提升了用户体验和灵活性。

- 30 美元 Pro 方案扩展 Open Interpreter 的应用能力:Killianlucas 宣布 Open Interpreter 的 30 美元每月桌面应用方案增加了使用限制,并为免费用户提供无需 API key 的应用访问。他建议除非用户发现扩展功能非常有益,否则可以坚持使用免费方案,因为该应用在 Beta 阶段仍在快速演进。

主题 5. 训练、微调和前沿研究

- Eleuther 分析训练 Jacobian 矩阵以揭示参数依赖性:Eleuther 的研究人员在 arXiv 上发表了一篇论文,探讨了训练 Jacobian,通过分析导数矩阵揭示了最终参数如何依赖于初始参数。该研究区分了 bulk 和 chaotic 子空间,为神经训练动力学提供了见解。

- Qwen 2.5 微调中的挑战凸显了集成难度:在 Unsloth AI Discord 中,用户报告了从微调后的 Qwen 2.5 模型获取数值输出的困难,特别是在简单的乘法查询中。讨论强调集成特定领域知识具有挑战性,建议 pre-training 或采用 RAG 解决方案可能会提供更有效的结果。

- LLM 训练创新:COCONUT 和 RWKV 架构:COCONUT (Chain of Continuous Thought) 的引入使 LLM 能够在连续潜空间(latent space)内进行推理,通过直接嵌入(embedding)方法优化处理。此外,发布了新的 RWKV 架构,如 Flock of Finches 和 QRWKV-6 32B,强调在不牺牲性能的情况下优化训练成本。

第 1 部分:高层 Discord 摘要

Codeium / Windsurf Discord

- Wave 1 发布增强了 Windsurf 的能力:Windsurf Wave 1 正式发布,引入了主要的自主工具,如 Cascade Memories 和 自动化终端命令。此次更新还包括增强的 图像输入功能,以及对 WSL 和 devcontainers 等开发环境的支持。查看完整的 changelog 获取详细信息。

- 用户对新功能表示兴奋,强调 Cascade Memories 的集成是一项重大改进。此次发布旨在通过自动化终端命令和支持多样化的开发环境来简化开发者的工作流。

- Windsurf 价格和使用透明度更新:Windsurf 正在推出更新的定价系统,其特点是新增了 快速设置面板,可显示当前方案的使用情况和试用有效期。有关更改的详细信息可在 定价页面 查看。

- 更新在 Cascade 中引入了 “Legacy Chat” 模式,当用户耗尽 Flow Credits 时该模式会激活,允许在不使用额外额度的情况下使用有限的功能。此更改旨在提供更清晰的使用指标,并提高用户管理订阅的透明度。

- Windsurf 中增强的 Python 支持:Windsurf 改进了对 Python 的语言支持,为开发者提供更好的集成和高级功能。这一增强是该平台致力于为开发者提供更有效工具的一部分。

- 此外,还引入了自助升级方案按钮,使用户能够通过 此链接 轻松访问更新的方案。此功能简化了根据项目需求扩展订阅的过程。

- Cascade 图像上传和功能增强:Cascade 图像上传 不再受 1MB 限制,允许用户无缝分享更大的文件。这项改进是持续提升平台可用性和功能努力的一部分。

- 提高的上传限制旨在支持更广泛的工作流,使用户能够将更高分辨率的图像合并到项目中,而不会遇到大小限制。这一变化有助于提供更灵活、更高效的用户体验。

- 报告 Cascade 模型性能问题:用户报告 Cascade Base 正在经历性能问题,如卡死和无响应,这影响了其在编码任务中的可靠性。一些用户在使用过程中遇到了 HTTP 504 错误。

- 有推测认为这些不稳定性问题可能与 OpenAI 持续存在的问题有关,导致几位用户考虑降级或切换到替代工具。社区正在积极讨论潜在的解决方案,以缓解这些性能挑战。

OpenAI Discord

- ChatGPT Apple Integration: 在 YouTube 演示中,Sam Altman、Miqdad Jaffer 和 Dave Cummings 在 12 Days of OpenAI 活动期间展示了 ChatGPT 集成到 iOS 和 macOS 的功能。

- 节日演示中,团队成员身穿节日毛衣,旨在增强观众互动并体现节日季精神。

- Gemini 2.0 Flash Outperforms: Gemini 2.0 Flash 因其卓越性能受到用户称赞,尤其是在空间推理和迭代图像编辑方面,表现优于 o1 Pro 等模型。

- 社区对比突出了 Gemini 2.0 Flash 的竞争性基准测试,引发了关于其相对于 OpenAI 产品进步的讨论。

- OpenAI Services Experience Downtime: 根据状态更新报告,OpenAI 经历了影响 ChatGPT 及相关 API 工具的服务中断。

- 用户注意到中断与 Apple 集成公告同时发生,截至 2024 年 12 月 11 日,API 流量已部分恢复,但 Sora 仍处于宕机状态。

- Challenges in Fine-Tuning OpenAI Models: 开发者报告称,尽管完成了训练,经过微调的 OpenAI 模型仍会生成泛泛的回答,并就其 JSONL 配置寻求帮助。

- 正在征求社区反馈以识别训练数据中的潜在问题,旨在提高模型的针对性和性能。

- Chaining Custom GPT Tools: 用户在单个提示词中链接多个 Custom GPT 工具时遇到困难,通常只有第一个工具的 API 调用被执行。

- 建议包括添加元功能指令和使用规范的工具名称,以改进工具交互管理。

Cursor IDE Discord

- Cursor Slows Amid OpenAI Model Hiccups: 用户报告 Cursor 持续出现性能问题,特别是请求响应缓慢和代码库索引问题。这些问题似乎与 OpenAI 模型 的上游问题有关,导致平台性能下降。Cursor Status 显示持续的停机影响了核心功能。

- 社区成员对 Cursor 在停机期间无法有效编码表示沮丧。关于长上下文模式的功能请求引起了广泛关注,但正式支持仍待定。

- Agent Mode Hangs Code Flow: Cursor 的 Agent 模式 因在处理代码或访问代码库时频繁卡死而面临广泛投诉。用户发现重新索引或重启 Cursor 可以暂时缓解这些问题。

- 尽管有临时修复方案,但 Agent 模式 中断的反复发生继续阻碍开发者的生产力,引发了社区内关于潜在长期解决方案的讨论。

- Windsurf Surges Past in AI Tool Comparisons: 讨论强调 Windsurf 是比 Cursor 更优秀的 AI 工具,强调其更可靠的沟通和透明的更新日志。用户赞赏 Windsurf 处理更新和反馈集成的方式。

- 参与者指出,虽然 Cursor 提供了独特的功能,但其更新日志的透明度和响应速度落后于 Windsurf 等竞争对手,这表明在满足用户期望方面仍有改进空间。

- Gemini 2.0 Shines Twice as Fast: Sundar Pichai 宣布推出 Gemini 2.0 Flash,其在关键基准测试上的表现优于 Gemini 1.5 Pro,且速度提升了两倍。这一进步标志着 Gemini 模型开发的一个重要里程碑。

- AI 社区正密切关注 Gemini 2.0 的进展,对其性能提升以及对 Claude 等现有模型的潜在影响寄予厚望。

- Windsurf’s Transparent Changelogs Impress: Windsurf 用户称赞该工具在 Windsurf Editor Changelogs 中提供的清晰沟通和详细记录。这种透明度展示了对用户反馈和持续改进的坚定承诺。

- Windsurf 互动模式的好评与 Cursor 形成对比,引发了关于采用类似透明做法以增强用户信任和满意度的讨论。

Eleuther Discord

- 训练 Jacobian 分析揭示参数依赖性:最近发表在 arXiv 上的一篇论文探讨了训练 Jacobian,通过分析导数矩阵揭示了最终参数如何取决于初始参数。研究强调,训练将参数空间操纵为主体 (bulk) 和混沌 (chaotic) 子空间。

- 由于计算限制,该研究使用了 5K 参数的 MLP 进行,但在 62K 参数的图像分类器中观察到了类似的频谱模式,这表明对神经训练动力学 (neural training dynamics) 具有更广泛的意义。

- Muon 优化器脱颖而出成为强力竞争者:Muon 因其稳健的基准性能和坚实的数学基础而受到关注,使其成为 AdamW 等现有优化器的可行替代方案。Keller Jordan 详细介绍了其在优化神经网络隐藏层方面的潜力。

- 虽然 Muon 尚未果断超越 AdamW,但它在应对 Llama 3 等模型中观察到的问题时表现出的韧性,凸显了其在未来优化器开发中的前景。

- 解决大语言模型中的固有偏见:即将发表的一篇论文讨论了大型语言模型中的有害偏见是其当前架构的内在结果,主张对 AI 设计原则进行根本性的重新评估。研究强调,偏见源于数据集近似和模型架构。

- 这一观点鼓励 AI 社区专注于理解偏见的根本原因,而不仅仅是调整具体的实现,从而促进更有效的偏见缓解策略。

- 在 lm_eval_harness 中集成 HumanEval 以增强困惑度指标:lm_eval_harness 正被用于评估模型在 jsonl 文件 格式数据集上的困惑度 (perplexity),成员们分享了自定义任务配置。一个特定的 Pull Request (#2559) 旨在促进批量推理,解决处理效率低下的问题。

- 此次集成旨在提供对比研究必不可少的 per-token perplexity 结果,社区成员正积极贡献解决方案以简化评估工作流。

- 新 RWKV 架构发布增强模型效率:新的 RWKV 架构,即 Flock of Finches 和 QRWKV-6 32B 已经发布,强调在不牺牲性能的情况下优化训练成本。

- 这些模型展示了与大型同类模型相当的能力,同时保持了较低的计算需求,使其对可扩展的 AI 应用具有吸引力。

Bolt.new / Stackblitz Discord

- Cole 在 Twitter 上推广 OSS Bolt:在一次直播会议中,Cole 讨论了 OSS Bolt,分享了其历程和进展,社区在 Twitter 上观看了相关内容。

- OSS Bolt 正在获得关注,最新的 Bolt Office Hours: Week 8 现已在 YouTube 上线,其中包含增强观众参与度的资源链接。

- Supabase 预览增强 Bolt:一次直播提供了 Supabase 集成 的预览 (sneak peek),旨在增强现有工作流并吸引开发者的兴趣。

- 正如直播中所揭示的,这次 Supabase 集成 有望改进工作流功能,令开发者社区感到兴奋。

- 在 Stripe 集成方面 Supabase 优于 Firebase:几位用户讨论了从 Firebase 迁移到 Supabase 以获得更好的 Stripe 集成,并评估了每个数据库的优缺点。

- 选择 Supabase 的决定是出于避免供应商锁定 (vendor lock-in) 的愿望,使其成为一些应用开发者的首选。

- Shopify API 集成助力 Web 应用:一位正在开发与其 Shopify 商店同步的 Web 应用的成员收到了集成 Shopify API 的建议,并引用了 Shopify API 文档。

- 实施 Shopify API 集成 可确保该应用独有的安全数据访问,并利用全面的文档进行无缝开发。

- Bolt AI Token 消耗引发担忧:用户报告了对 Bolt AI 反复出错并在未解决问题的情况下消耗大量 Token 的沮丧情绪,其中一位用户在没有产生任何变化的情况下使用了 200k tokens。

- 问题归因于底层的 AI 模型 Claude,这促使人们建议改进 Prompt 的构建方式,以尽量减少调试过程中的 Token 浪费。

Unsloth AI (Daniel Han) Discord

- Qwen 2.5 微调面临数字输出问题:一位用户报告了在从微调后的 Qwen 2.5 模型获取数字输出时遇到的挑战,特别是在处理简单的乘法查询时。

- 讨论强调,整合特定领域知识非常困难,并建议 pre-training(预训练)或采用 RAG 解决方案 可能会提供更有效的结果。

- Gemini Voice 超越竞争对手:社区成员对 Gemini Voice 的功能表示兴奋,称其表现“疯狂”且优于现有的某些替代方案。

- 对比指出,OpenAI 的实时语音 API 成本更高且功能较弱,使 Gemini Voice 成为更优的选择。

- 管理训练期间的内存峰值:用户对训练阶段 RAM 和 GPU RAM 使用量出现意外峰值表示担忧,这导致了 Colab 上的运行时崩溃。

- 用户建议通过调整 batch sizes、平衡 dataset lengths 以及确保 high-quality data 等策略来缓解内存问题。

- 使用 llama.cpp 进行有效的模型转换:用户讨论了利用 llama.cpp 进行模型转换,分享了经验和故障排除方法以简化流程。

- 一位成员通过执行全新安装并利用 PyTorch 2.2 作为特定的依赖版本,成功解决了转换问题。

- WizardLM Arena 数据集现已发布:一位成员将 WizardLM Arena 论文中使用的所有数据集上传到了 该仓库,提交记录 b31fa9d 已于一天前通过验证。

- 这些数据集为复制 WizardLM Arena 实验和进一步研究提供了全面的资源。

Nous Research AI Discord

- Hermes 3 发布,推理能力升级:Hermes 3 3B 已在 Hugging Face 上发布,并提供量化的 GGUF 版本以优化大小和性能,在 user alignment(用户对齐)、agentic performance(Agent 性能)和 reasoning(推理)方面引入了先进功能。

- 此次发布标志着从 Hermes 2 开始的重大升级,增强了 AI 工程师使用该模型的整体效率和有效性。

- Google DeepMind 首次推出 Gemini 2.0:Google DeepMind 揭晓了 Gemini 2.0,包括具有改进的多模态输出和性能的实验性 Gemini 2.0 Flash 版本,正如其 官方推文 所宣布的那样。

- Gemini 2.0 Flash 的引入旨在通过增强的 tool use capabilities(工具使用能力)促进新的 agentic experiences(Agent 体验)。

- DNF 推进 4D 生成建模:DNF 模型引入了一种用于生成建模的新 4D 表示,使用字典学习(dictionary learning)方法捕捉可变形形状的高保真细节,详见 项目页面。

- YouTube 概览 展示了 DNF 的应用,体现了时间一致性和卓越的形状质量。

- COCONUT 增强 LLM 推理过程:COCONUT (Chain of Continuous Thought) 使 LLM 能够在连续潜空间(continuous latent space)内进行推理,通过更直接的 embedding 方式优化处理,如 研究论文 中所述。

- 该方法建立在 Schmidhuber 关于循环高速公路网络(Recurrent Highway Networks)的工作基础上,通过梯度下降提供端到端优化,以提高推理效率。

- Forge Bot 简化 Discord 访问:成员现在可以通过 Discord 机器人访问 Forge,无需 API 审批,只需从 customize 页面选择 Forge Beta 角色并导航至相应频道即可。

- 这一增强功能方便了 AI 工程师在服务器内进行即时测试和协作。

Stability.ai (Stable Diffusion) Discord

- VRAM 使用与管理:用户讨论了以 JSON 格式缓存 prompt 如何影响内存使用,指出存储 20 个 prompt 仅消耗几兆字节。他们还探索了在 FP8 等较低精度下运行模型以降低内存成本。

- 优化 FP8 精度 对于在大规模 AI 部署中高效管理 VRAM 至关重要。

- 图像增强的 AI 模型推荐:一位用户请求生成 spaceships(飞船)的模型推荐,提到他们正在使用 Dream Shaper 和 Juggernaut。另一位成员建议,如果现有模型不能满足需求,可以训练一个 LoRA。

- 训练 LoRA 可以为特定的图像生成需求提供定制化增强。

- GPU 黄牛问题:成员们分享了关于黄牛可能如何部署网络爬虫在发布当日抢购 GPUs 的见解。一位用户表达了对在黄牛之前获取 GPU 的担忧,提到由于身处美国境外,他们避免了排队。

- 防止 GPU 黄牛需要物理排队以外的策略,特别是对于国际用户。

- 用于图像分类和打标签的 AI:一位用户询问了从图像中提取标签或 prompt 的工具,引发了关于 图像分类 技术的讨论。Clip Interrogator 被推荐为一种可以在没有先验元数据的情况下描述图像的工具。

- Clip Interrogator 可以自动执行打标签过程,提高管理大型图像数据集的效率。

- 语音训练的 AI 程序:用户讨论了通常用于针对特定声音训练 AI 的程序,其中 Applio 被提及为一个潜在工具。对话强调了对 语音操作 和 AI 训练应用的兴趣。

- 选择像 Applio 这样的合适程序可以改进特定语音 AI 训练任务的工作流程。

Notebook LM Discord Discord

- 将 NotebookLM 集成到 Discord:一位成员讨论了在 Discord 中添加 聊天功能,使用户能够直接查询 NotebookLM 以增强交互性。

- 这种集成旨在为寻求在 Discord 公会内进行实时 AI 互动的玩家提供无缝连接。

- 用于 TTRPG 规则转换的 NotebookLM:一位成员展示了使用 100 页的自定义 TTRPG 规则书 配合 NotebookLM,将叙述性描述转换为特定的游戏机制。

- 他们强调了该工具在将复杂规则转化为可操作机制方面的有效性,从而促进更流畅的游戏体验。

- 利用 NotebookLM 增强播客:用户探索了利用 NotebookLM 进行播客创作,包括自定义主持人以及利用来自 Talking Heads Green Screen Podcast 的视觉效果。

- 成员们建议采用 chromakey(色键)技术 来个性化播客背景,提升视觉吸引力。

- Gemini 2.0 集成到 NotebookLM:讨论确认了 Gemini 2.0 与 NotebookLM 的集成,成员们幽默地注意到品牌推广中缺少 Gemini 符号。

- 尽管对品牌选择有轻松的批评,但预计这一转变将增强 NotebookLM 的能力。

- NotebookLM 功能和 AI 工具体验:用户研究了 NotebookLM 的限制,包括每个笔记本最多 1,000 条笔记、每条 100,000 个字符 以及 50 个来源,并对 PDF 大小限制提出了疑问。

- 此外,成员们分享了使用 Snapchat AI 和 Instagram 聊天 AI 等工具的积极体验,强调了 NotebookLM 在挑战时期对他们工作流程的实用性。

Interconnects (Nathan Lambert) Discord

- Gemini 2.0 Flash 发布:Google 推出了 Gemini 2.0 Flash,强调了其与前代版本相比卓越的 multimodal capabilities(多模态能力)和增强的 coding performance(编程性能)。Google DeepMind blog 详细报道了此次发布活动,并强调了其顶级的 benchmark 分数。

- 用户称赞了 Gemini 2.0 Flash 强大的 coding functionalities,并将其与 Claude 等平台进行了比较。然而,正如多条 tweets 中讨论的那样,一些人对其相对于其他模型的 stability(稳定性)和 effectiveness(有效性)提出了担忧。

- NeurIPS 上的 Scaling Laws 辩论:Dylan Patel 将在 NeurIPS 参加一场关于 scaling laws 的 Oxford Style Debate(牛津式辩论),挑战“仅靠 scaling 就能推动 AI 进步”的观点。该活动承诺将回应来自行业影响力人士的批评,注册详情可见其 tweet。

- 社区表现出强烈的参与意愿,认为这种辩论形式既有趣又有见地。讨论强调了 search(搜索)、adaptation(适配)和 program synthesis(程序合成)比单纯的模型 scaling 更重要,反映了更广泛的 AI development trends(AI 发展趋势)。

- 加入 Meta 的 Llama 团队:一位成员宣布了他们即将在 AI at Meta’s Llama team 担任的角色,旨在开发下一代 Llama models。此举强调了致力于培养一个与 AGI goals 和 open-source initiatives(开源倡议)相一致的更健康的 AI ecosystem。

- 尽管过去在 Llama 3.2-vision 上遇到过挑战,该公告还是引发了关于将 Gemini 的见解整合到 Llama 项目中的讨论。成员们幽默地辩论了展示 Kambhampathi’s works 可能带来的干扰,突显了社区对这一新尝试的支持。

- OpenAI 以产品为中心的策略:OpenAI 继续强调 product-centric approach(以产品为中心的方法),通过专注于 user-friendly products(用户友好型产品)保持其在 AI 领域的领导地位。正如社区讨论中所观察到的,这种策略使 OpenAI 在竞争对手滞后时保持领先。

- 对 usability(易用性)的关注确保了 OpenAI 的发展保持相关性和影响力,强化了 practical applications(实际应用)在持续的 AI 进步中的重要性。

- LLM 创造力基准测试:关于评估 LLM capabilities 在创意任务中表现的 讨论 出现,揭示了 benchmark scores 与 user satisfaction(用户满意度)之间的差异。尽管 Claude-3 并不总是在创造力指标上领先,但它仍然很受欢迎。

- 社区成员正在探索更好地评估 LLM creative outputs(创意输出)的方法论,旨在使 benchmarking practices(基准测试实践)与实际的 user experiences(用户体验)和期望相一致。

LM Studio Discord

- 在 LM Studio 中最大化 GPU 利用率:讨论集中在如何使用多个 GPUs(包括 两个 3070 和一个 3060ti),目前 LM Studio 的 GPU offload 功能仅为一个简单的开关。

- 由于现有的限制,用户正在探索通过 environment variables(环境变量)来增强多 GPU 性能的权宜之计。

- 利用生成式 AI 推进文档合并:一位成员寻求使用生成式 AI 合并两个文档的方法,但建议倾向于传统技术,如 MS Word merge option。

- 替代方案包括编写自定义脚本进行精确合并,而不是依赖模糊的 AI prompts。

- 通过 API 集成启用模型 Web 访问:关于为模型提供 web access 的咨询得到的回答指出,这需要 custom API solutions,而不是标准的聊天界面。

- 这表明人们对将模型与 external tools and websites(外部工具和网站)集成以增强操作能力的兴趣日益浓厚。

- 在硬件配置中集成 Alphacool 的 D5 泵:Alphacool 推出了预装 D5 pump 的型号,给一些成员留下了深刻印象。

- 然而,一位成员对没有选择这种配置表示遗憾,原因是他们包含 4 GPUs 和 8 HDDs 的庞大配置存在空间限制。

Latent Space Discord

- Gemini 2.0 Flash 发布:Google 宣布推出 Gemini 2.0 Flash,该模型在 Chatbot Arena 综合排名中位列第 3,表现优于之前的 Flash-002 等模型。

- Gemini 2.0 Flash 在困难提示词(hard prompts)和编程任务中提供了增强的性能,并集成了实时多模态交互。

- Hyperbolic 完成 1200 万美元 A 轮融资:Hyperbolic 成功筹集了 1200 万美元 A 轮资金,旨在开发一个开放的 AI 平台,其开放 GPU 市场以 $0.99/小时的价格提供 H100 SXM GPU。

- 此次融资强调了 AI 基础设施开发中的透明度和社区协作。

- Stainless 获得 2500 万美元 A 轮融资:Stainless API 宣布完成由 a16z 和 Sequoia 领投的 2500 万美元 A 轮融资,旨在增强其 AI SDK 产品。

- 这笔投资将支持为 AI 开发者构建一个强大的生态系统。

- Nous Simulators 发布:Nous Research 推出了 Nous Simulators,用于在社交语境中实验人类与 AI 的交互。

- 该平台旨在提供对 AI 行为和交互的见解。

- 实时多模态 API 亮相:Logan K 介绍了由 Gemini 2.0 Flash 驱动的新型 Realtime Multimodal API,支持实时音频、视频和文本流。

- 该 API 促进了后台的动态工具调用,从而实现无缝的交互体验。

Modular (Mojo 🔥) Discord

- C23 标准化纯函数(Pure Functions):通过在 C23 中包含此特性,C 和 C++ 中的纯函数标准化已经实现,详细指南参考 n2956 和 p0078。

- 此次更新通过清晰地标记纯函数来促进更好的优化,增强了代码的可预测性和性能。

- Modular 论坛链接位置隐蔽:用户对 Modular 网站的论坛链接难以找到表示沮丧,该链接被埋在 Company 栏目下。

- 团队正致力于改进论坛,并计划在 1 月份正式公开发布,以提高可访问性。

- Mojo 的 Multi-Paxos 实现问题:一个用 C++ 实现的 Multi-Paxos 共识协议在初步测试中失败,因为它无法有效处理多个提案。

- 缺乏超时、领导者切换和重试等基本功能,这类似于神经网络中反向传播(back-propagation)的必要性。

- 关于 Mojo Struct __del__ 设计的辩论:社区讨论了 Mojo struct 的

__del__方法应该是选择性加入(opt-in)还是选择性退出(opt-out),权衡了一致性与开发者人机工程学(ergonomics)。- 一些成员倾向于减少样板代码(boilerplate code),而另一些成员则主张在 Trait 和方法之间采用统一的方法。

- 命名结果(Named Results)带来的性能提升:Mojo 中的命名结果允许直接写入地址,避免了昂贵的移动操作(move operations),并在函数返回期间提供性能保证。

- 虽然该特性主要提供保证,但在移动操作不可行的情况下,它能提高效率。

Cohere Discord

- Maya 多模态模型发布:介绍 Maya,这是一个开源、多语言的视觉语言模型,支持 8 种语言,专注于文化多样性,基于 LLaVA 框架构建。

- 在 Apache 2.0 许可证下开发,Maya 的论文强调了其指令微调(instruction-finetuned)能力,社区正热切期待博客文章和额外资源。

- Rerank 3.5 英文模型计划:一位成员询问了 Rerank 3.5 英文模型的后续开发计划,寻求对未来增强功能的见解。

- 截至目前,该询问尚未得到回应,使得 Rerank 3.5 模型的计划悬而未决。

- Aya Expanse 增强 Command 系列:讨论强调 Aya Expanse 可能受益于 Command 系列的性能,暗示了改进的指令遵循(instruction following)能力。

- 成员们暗示,由于 Aya Expanse 可能是基于 Command 系列构建的,它在处理和执行命令方面可能提供增强的性能。

- 持续的 API 403 错误:用户报告在使用 API 请求生成器时遇到 403 错误,即使在禁用 VPN 并使用 Trial API key 后也是如此。

- 分享的细节包括使用来自中国的 IPv6 地址和特定的 curl 命令,但该问题在社区内仍未解决。

- 寻求用于量化的高质量数据集:成员们正在寻找适合量化的高质量数据集,特别是对 aya_dataset 中的 ‘re-annotations’ 标签感兴趣。

- 社区强调需要具有大量样本的数据集,以支持稳健的量化任务。

LLM Agents (Berkeley MOOC) Discord

- 黑客松提交截止至 12 月 17 日:参与者必须在 12 月 17 日之前提交其黑客松作品,并遵守提供的指南。

- 此外,书面文章作业的截止日期为 PST 时间 12 月 12 日晚上 11:59,这与之前要求的 12 份讲座总结是分开的。

- 书面文章作业的详细指南:学生需要在 Twitter、Threads 或 LinkedIn 等平台上发布一篇约 500 字的帖子,并链接到 MOOC 网站。

- 文章提交按通过或不通过计分,且必须使用注册课程时相同的电子邮件提交,以确保获得相应学分。

- ToolBench 平台在 ICLR’24 上展示:ToolBench 项目在 ICLR’24 上展出,作为一个用于工具学习的大语言模型训练、服务和评估的开放平台。

- 该平台旨在为 AI 工程师提供增强的资源和框架,以推进大语言模型中的工具集成。

- AI 模型函数调用的进展:AI 模型正越来越多地利用详细的函数描述(function descriptions)和签名(signatures),根据用户提示设置参数,以提高泛化能力。

- 这一进展表明 AI 模型与预定义函数之间的交互趋向于更加复杂,增强了它们的运行复杂度。

OpenInterpreter Discord

- O1 Pro 启用高级控制功能:一位成员提议在 OS 模式下使用 Open Interpreter 来控制 O1 Pro,从而实现网页搜索、canvas 和文件上传等功能。

- 另一位用户考虑通过逆向工程 O1 Pro 来控制 Open Interpreter,并评论道 “这开启的可能性……天哪。”

- Open Interpreter App Beta 访问权限仅限 Mac:成员们确认 Open Interpreter app 目前处于 beta 阶段,需要邀请码,且仅限 Mac 用户使用。

- 一位成员对身处等候名单却无法访问表示沮丧,而另一位成员分享了获取邀请的联系方式。

- 对新网站设计的评价褒贬不一:用户对新网站设计给出了不同的反馈,有人表示最初看起来 “有点突兀”,但后来逐渐习惯了。

- 其他人指出该设计仍在开发中,并计划在未来的更新中加入更酷的叠加效果。

- 30 美元的 Pro 计划扩展了 App 功能:Killianlucas 解释说,每月 30 美元的桌面应用计划增加了使用限制,并为免费用户提供无需 API key 即可使用的应用。

- 他建议除非用户觉得非常有益,否则可以坚持使用免费计划,因为该应用在 beta 阶段发展迅速。

- Actions Beta App 专注于文件修改:Actions 功能被强调为一个专注于文件修改的 beta 应用,这与仅在终端中可用的 OS 模式有所不同。

- 成员们被鼓励探索这一新功能,尽管一些人遇到了限制,其中一人指出在测试时用尽了他们的 token 限制。

Torchtune Discord

- QRWKV6-32B 实现了 1000 倍的计算效率:基于 Qwen2.5-32B 架构 构建的 QRWKV6-32B 模型在匹配原始 32B 性能的同时,在推理中提供了 1000 倍的计算效率。

- 训练在 16 台 AMD MI300X GPU(192GB VRAM)上耗时 8 小时 完成,展示了计算成本的显著降低。

- Finch-MoE-37B-A11B 引入 linear attention:作为新 RWKV 变体 的一部分,Finch-MoE-37B-A11B 模型采用了 linear attention 机制,以提高处理 长上下文(long contexts) 的效率。

- 这一转变突显了 RWKV 架构在增强计算性能方面的持续发展。

- DoraLinear 增强了参数初始化:DoraLinear 通过利用

to_empty方法进行幅度初始化(magnitude initialization)提升了用户体验,确保其不会破坏现有功能。- 在

to_empty方法中实现swap_tensors有助于在初始化期间进行正确的设备处理,这对于不同设备上的 tensors 至关重要。

- 在

DSPy Discord

- O1 系列简化了 DSPy 工作流:一位成员询问了 O1 系列模型 对 DSPy 工作流 的影响,认为 MIPRO 的推荐参数 可能需要针对优化进行调整。

- 他们推测新模型可能会导致 更少的优化周期 或 评估更少的候选程序。

- DSPy 中的通用优化错误:一位用户报告在优化过程中遇到了 奇怪的通用错误,并提到了在特定频道发布的相关 bug。

- 这一问题突显了社区在优化 DSPy 工作流时面临的持续 挑战。

- DSPy Settings 中的 ‘backtrack_to’ 属性错误:一位成员分享了一个错误,即 ‘backtrack_to’ 不是 DSPy 中 Settings 的属性,并寻求帮助。

- 另一位用户指出该问题 早些时候已解决,可能是由于某些 async 使用导致的。

- 关于视频和音频 IO 重点的辩论:一位用户发起了关于 DSPy 内部 视频和音频 IO 的讨论,引发了成员们的不同意见。

- 一位成员主张集中精力处理 文本和图像输入,理由是现有功能的有效性。

LAION Discord

- Grassroots Science 推动多语言 LLM 开发:Grassroots Science 倡议将于 2025 年 2 月启动,旨在通过与 SEACrowd 和 Masakhane 等伙伴合作进行众包数据收集,开发多语言 LLM。

- 该项目专注于创建全面的多语言数据集,并评估人类偏好数据,以使模型符合多样化的用户需求。

- LLaMA 3.2 吞吐量故障排除:一位用户正在 A100 GPU 上优化 LLaMA 3.2 在 10,000 token 输入下的推理吞吐量,目标是达到每秒约 200 tokens,但目前性能较慢。

- 讨论建议采用 Batching、Prompt 缓存以及利用量化模型等技术来提升吞吐量。

- TGI 3.0 在 Token 处理上超越 vLLM:据 Hugging Face 报告,TGI 3.0 处理 token 的数量是 vLLM 的三倍,运行速度快 13 倍,提升了对长 Prompt 的处理能力。

- 凭借更低的内存占用,TGI 3.0 在 LLaMA 3.1-8B 上支持高达 30k tokens,而 vLLM 的限制为 10k tokens。

- 模型缩放怀疑论者青睐小模型:一位成员质疑将模型扩展到超过 10 亿参数的必要性,并表示:“10 亿参数对任何人来说都足够了。”,同时倡导超高效的小模型。

- 讨论批评了“规模即一切(scale-is-all-you-need)”的方法,强调了模型训练效率方面的优势。

- COCONUT 为 LLM 引入连续推理:Chain of Continuous Thought (COCONUT) 被作为一种新的 LLM 推理方法提出,详情见此 推文。

- COCONUT 将最后的隐藏状态(hidden state)作为输入嵌入(embedding),通过梯度下降实现端到端优化,而非传统的隐藏状态与 token 映射。

Axolotl AI Discord

- 默认设置建议:用户建议 ‘default’ 应该成为默认设置。

- **:

Mozilla AI Discord

- Mozilla AI 招聘社区参与负责人:Mozilla AI 正在招聘一名 社区参与负责人 (Head of Community Engagement),该职位为远程办公,直接向 CEO 汇报。

- 该角色负责领导和扩展跨多个渠道的社区计划,以提升参与度。

- 推出用于 LLM 选择的 Lumigator:Mozilla 正在开发 Lumigator,这是一款旨在帮助开发者为其项目选择最佳 LLM 的工具。

- 该产品是 Mozilla 致力于向开发者社区提供可靠开源 AI 解决方案的一部分。

- 开发者中心优化 AI 资源:Mozilla AI 正在启动 Developer Hub,提供用于构建开源 AI 的精选资源。

- 该倡议旨在增强 AI 开发过程中的用户自主权和透明度。

- Blueprints 开源 AI 集成:Blueprints 倡议专注于通过入门代码仓库开源 AI 集成,以启动 AI 项目。

- 这些资源旨在帮助开发者快速在应用中实现 AI 解决方案。

- 社区参与负责人职位咨询:感兴趣的申请人可以在专门的 话题 中提出关于社区参与负责人职位的问题。

- 这一职位彰显了 Mozilla AI 对社区驱动倡议的专注。

tinygrad (George Hotz) Discord 没有新消息。如果该服务器长时间没有活动,请告知我们,我们将将其移除。

MLOps @Chipro Discord 没有新消息。如果该服务器长时间没有活动,请告知我们,我们将将其移除。

HuggingFace Discord 没有新消息。如果该服务器长时间没有活动,请告知我们,我们将将其移除。

Gorilla LLM (Berkeley Function Calling) Discord 没有新消息。如果该服务器长时间没有活动,请告知我们,我们将将其移除。

AI21 Labs (Jamba) Discord 没有新消息。如果该服务器长时间没有活动,请告知我们,我们将将其移除。

第 2 部分:各频道详细摘要与链接

完整的各频道详细分类已在邮件中截断。

如果你喜欢 AInews,请分享给朋友!提前感谢!