ainews-not-much-happened-today-5863

今天没发生什么特别的事。

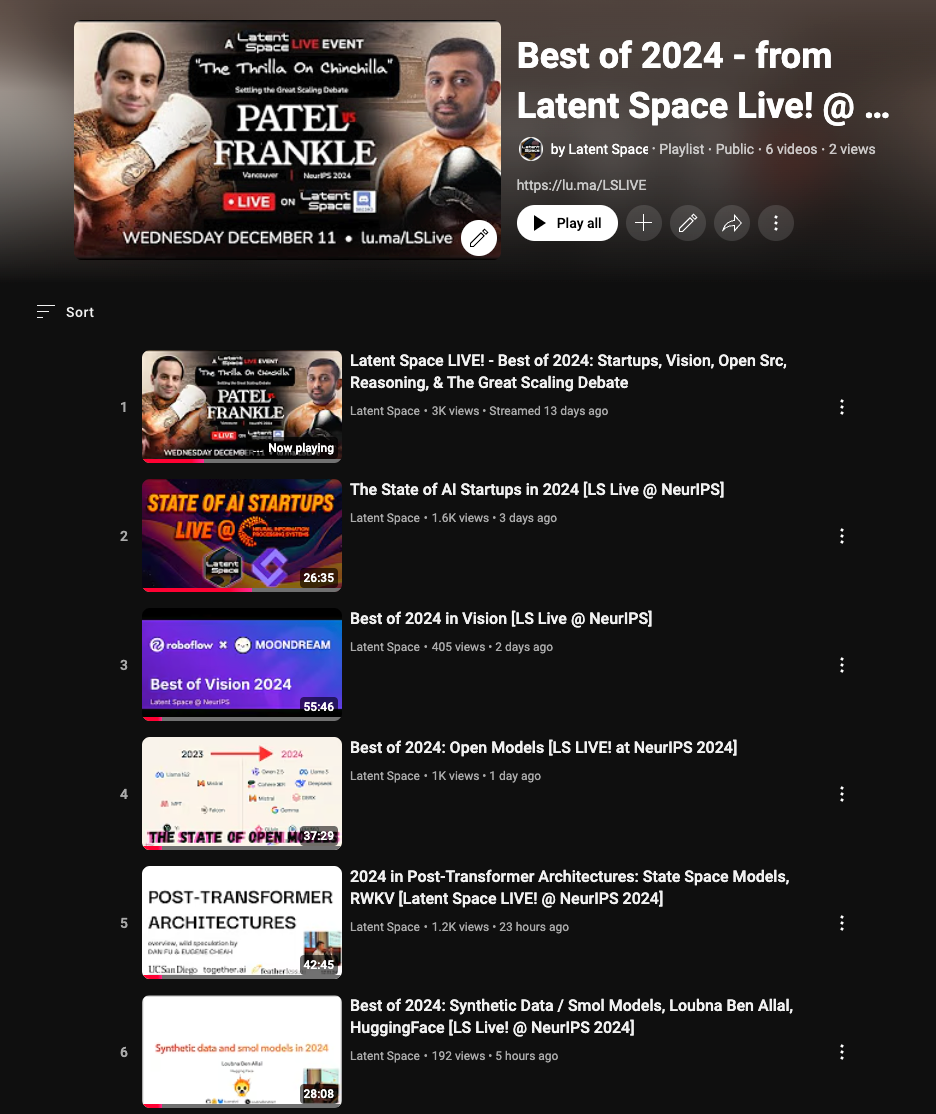

Qwen 团队推出了 QVQ,这是其实验性 QwQ(类 o1 模型)的视觉增强版,其基准测试表现与 Claude 3.5 Sonnet 相当。讨论内容包括 Bret Taylor 对自主软件开发的见解,他认为这与 Copilot 时代截然不同。Latent Space LIVE! 讲座涵盖了 2024 年 AI 初创公司、视觉、开源模型、后 Transformer 架构、合成数据、小型模型(smol models)以及智能体(agents)等亮点。

由 Claude 3.5 Sonnet 整理的推特回顾强调了衡量大语言模型(LLM)校准和虚假置信度的基准测试提案,其中 QVQ 的表现优于 GPT-4o 和 Claude Sonnet 3.5。AI 对齐方面的辩论集中在模型意图性以及对 Claude 等模型中“对齐伪装(alignment faking)”现象的批评。OpenAI 的更新包括全新的 o3 和 o3-mini 模型以及一种深思熟虑的对齐策略。

ASAL 项目是 MIT、OpenAI 和瑞士 AI 实验室 IDSIA 的合作项目,旨在自动化人工生命的发现。个人故事揭示了尽管拥有高学历和资质,但在申请美国移民局(USCIS)绿卡被拒时的挫败感。GeminiCoder 等新工具实现了应用的快速创建,而一个利用 Reflex 和 Llama Index 构建的合同审查智能体则可用于检查 GDPR 合规性。此外,文中还分享了节日问候和表情包。

一个安静的平安夜就是你所需要的一切。

2024年12月23日至12月24日的 AI News。我们为您检查了 7 个 subreddits、433 个 Twitter 账号 和 32 个 Discord 服务(215 个频道和 2265 条消息)。预计节省阅读时间(以 200wpm 计算):257 分钟。您现在可以标记 @smol_ai 进行 AINews 讨论!

Qwen 团队推出了他们实验性 QwQ o1 克隆版的视觉版本,名为 QVQ,但基准测试显示其表现大多与 Claude 3.5 Sonnet 持平。此外,还有一些关于 Bret Taylor 关于 autonomous software dev 的最新文章 的讨论(这与 Copilot 时代有所不同)。

Latent Space LIVE! 的个人演讲正在发布,以陪伴您度过假期,并回顾 2024 年在 AI Startups, Vision, Open Models, Post-Transformers, Synthetic Data, Smol Models, Agents 等领域的最佳成果。

在此投放您的广告!

我们在 12 月短暂关闭了广告位,但现在再次开放 2025 年 1 月 AINews 的广告位。请发送邮件至 swyx@smol.ai,每天触达超过 3 万名 AI Engineers!

AI Twitter 综述

所有综述均由 Claude 3.5 Sonnet 完成,取 4 次运行中的最佳结果。

AI 模型与基准测试

- 开发 LLM 校准基准:@tamaybes 提议创建一个 benchmark,用于衡量大语言模型 自信地断言错误信息 的倾向,并评估其在进行概率性陈述时的 calibration(校准)能力。

- AI 模型性能的进步:@reach_vb 宣布推出 QVQ,这是首个具有 vision capabilities(视觉能力)的开源多模态 o1-like model,其表现优于 GPT-4o 和 Claude Sonnet 3.5 等模型。

AI 对齐与伦理

- AI 系统中的意图性:@BrivaelLp 强调需要 破解 AI 的意图性 (intentionality),并指出即使是最智能的 AI 也需要 意图限制 (intentional limits) 才能有效运行。

- 关于对齐伪装的辩论:@teortaxesTex 批评了关于 Claude 等 AI 模型中 alignment faking(对齐伪装)的研究,认为工程化的 魅力行为 (charismatic behaviors) 并不能准确代表通用的对齐挑战。

公司新闻与合作

- OpenAI 的最新进展:@TheTuringPost 分享了关于 OpenAI o3 和 o3-mini 模型、一种新的 deliberative alignment strategy(审议式对齐策略)以及改进后的 o1 模型 的更新。

- 协作 AI 研究项目:@SakanaAILabs 宣布了 ASAL 项目,该项目与 MIT、OpenAI 以及 瑞士 AI 实验室 IDSIA 合作,旨在利用 foundation models 自动化发现 artificial life(人工生命)。

移民与个人讨论

- 绿卡被拒经历:@Yuchenj_UW 对 绿卡被拒 表示沮丧,批评 USCIS 尽管他拥有 PhD 学位并担任 Apple CTO,但仍给出了武断的理由。多条回复强调了在移民系统中的类似经历和挫败感。

- 为申请者提供支持与建议:@deedydas 向 @Yuchenj_UW 提供了支持和建议,鼓励他在 green card application 过程中尽管遇到挫折也要坚持不懈。

技术工具与项目

- GeminiCoder 介绍:@osanseviero 推出了 GeminiCoder,这是一款允许用户通过简单提示词在几秒钟内 创建应用 的工具。

- 自动化合同审查 Agent:@llama_index 展示了一个使用 Reflex 和 Llama Index 构建的 contract review agent,能够检查供应商协议中的 GDPR compliance(GDPR 合规性)。

梗/幽默与节日问候

- 节日祝福与庆典:@ollama 祝大家 圣诞快乐,而 @ClementDelangue 分享了来自 巴黎圣母院 (Notre Dame Paris) 圣诞子夜弥撒 的感人时刻。

- 幽默轶事:@TheGregYang 分享了一个有趣的故事,关于他母亲对他头像的严厉评价,为节日增添了一抹轻松的色彩。

AI Reddit 综述

/r/LocalLlama 综述

主题 1. Qwen/QVQ-72B 在 MMMU 评估中达到 70.3 分

- Qwen/QVQ-72B-Preview · Hugging Face (评分: 72, 评论: 10):Qwen/QVQ-72B 的预览版已在 Hugging Face 上线,表明其在 AI 社区的模型探索和实验中具有重要意义。

- QVQ-72B 在 MMMU 数据集上获得了 70.3 的分数,展示了其在大学级多学科评估中的性能。用户希望获得更多 post-training(后训练)细节,相关资源可在 Qwen 博客文章 和 Hugging Face 上找到。

- 一位用户分享了一张截图,说明了该模型的彻底性以及从中文翻译的能力,强调了其令人印象深刻的表现。有请求希望 Hugging Face 将其作为热推理模型 (warm inference model) 启用。

- model size(模型大小)的差异被指出,文中提到了 73.4B parameters 而不是 72B,这在用户中引起了一些困惑。

- QVQ - Qwen 新发布 (评分: 267, 评论: 40): QVQ 模型在 MMMU 基准测试中获得了 70.3 的分数,超越了 Qwen2-VL-72B-Instruct 模型的表现。图片展示了 QVQ 在 MathVista、MathVision 和 OlympiadBench 等多项测试中的卓越结果,表明其相较于 OpenAI 和 GPT-4 等竞争对手有显著提升。

- 讨论重点关注了 QVQ 模型的许可协议,并询问了其具体类型;同时提到 QwQ 采用 Apache 许可证,且在其参数规模下表现出色。由于 QVQ 规模更大,预计其性能将优于 QwQ。

- 提到了演示版中的 NSFW 过滤器,但模型本身似乎是未经审查(uncensored)的,对游走在边缘的图像没有拒绝反应,这表明其采用了灵活的内容审核方式。

- 用户对 QVQ 模型在 Hugging Face 上的发布表示赞赏,称赞了阿里巴巴创新的开源贡献,并呼吁在 Llama 和 Qwen 等模型之间进行更全面的基准测试对比。

- 伙计们,是我疯了还是这篇论文完全是胡扯 哈哈 (评分: 86, 评论: 43): 该帖子缺乏足够的上下文或内容来提供详细摘要。

- 评论者批评 ICOM 项目存在可疑的主张、缺乏透明度,并依赖 GPT-3.5 和 GPT-4 API,这导致其因违反规则而被 ARC-AGI 挑战赛取消资格。他们认为该项目似乎只是现有 LLM 的肤浅包装器,未能展示任何独特或先进的能力。

- 人们对 ICOM 论文的可信度持怀疑态度,指责其存在自我引用、格式不统一以及在没有训练数据的情况下声称超越基准测试的夸大言论。评论者嘲讽该论文更像是一种营销手段而非合法的科学贡献,并质疑其发表背后的动机。

- 讨论强调了 ICOM 项目对 C# 的依赖(这在 AI 研究中并不典型),以及使用 Excel 进行可视化,暗示其缺乏专业性。评论者对该项目在没有严谨证据或同行评审的情况下声称取得重大里程碑表示难以置信,将其比作伪科学尝试。

主题 2. 3B 规模模型对比:Llama vs Granite vs Hermes

- Llama 3.2 3B 太棒了 (评分: 321, 评论: 121): Llama 3.2-3B 非常高效且易于使用,特别是在保留上下文和高效处理西班牙语方面表现出色,可与 Stable LM 3B 媲美。该模型(特别是 llama-3.2-3b-instruct-abliterated.Q4_K_M.gguf 版本)在第十代 i3 CPU 上运行良好,速度约为 每秒 10 个 token。

- 用户讨论了在各种设备上运行 Llama 3.2-3B 的情况,包括 iPhone、Pixel 7 手机,甚至是 8GB 内存的树莓派 5,突显了其跨平台的效率和通用性。一些用户报告了 token 生成速度,其中一位提到在 M1 Max 上达到了 每秒 100 个 token。

- 用户将 Llama 3.2-3B 与 Granite3.1-3B-MoE 和 Hermes 3B 等其他模型进行了对比,部分用户更青睐新模型,因为它们具有 32K token 上下文和内置函数调用(function calling)等功能。还有人提到 3.3 版本更好,尽管注意到了 70B 规模的限制。

- 围绕 LMStudio 和 Ollama 等软件工具和平台的讨论突显了易用性和性能方面的差异,一些用户由于设计和实现选择而表达了强烈的偏好。Q4_K_M 变体的大小和性能也引发了争论,一位用户称其大小为 42GB。

主题 3. GGUF 模型现在可以通过 Hugging Face 在 Ollama 中私密使用

- 你现在可以直接在 Ollama 中运行来自 Hugging Face Hub 的 私有 GGUF 文件 (Score: 129, Comments: 29): Hugging Face 已支持在 Ollama 中直接运行其 Hub 上的 私有 GGUF。用户只需将他们的 Ollama SSH key 添加到 Hugging Face 个人资料中即可使用此功能,从而能够以相同的用户体验运行私有的 fine-tunes 和 quants。完整的说明和详情可在 Hugging Face 文档页面查看。

- GGUF 格式与量化:GGUF 是一种用于 llamacpp 及类似后端的模型格式,包含权重和元数据。文件大小反映了内存占用情况,各种量化(从 Q2 到 Q8)会影响压缩率和体积,从而在仓库中提供一系列不同大小的模型。

- 在 Ollama 上运行私有模型:这项新功能允许通过向 Hugging Face 上传 SSH key,直接在 Ollama 中运行私有 GGUF 模型。用户现在可以运行其命名空间下的私有模型,这是以前不具备的能力,增强了模型管理和执行的灵活性。

- 本地执行与存储:使用 Ollama,用户可以从服务器拉取混淆的 GGUF 文件和元数据,并将其存储在本地执行。这适用于公开和私有模型,并新增了使用用户的 Ollama public key 管理私有仓库的功能。

其他 AI Subreddit 综述

/r/Singularity, /r/Oobabooga, /r/MachineLearning, /r/OpenAI, /r/ClaudeAI, /r/StableDiffusion, /r/ChatGPT

主题 1. 对用于确定 LLM 智能的“陷阱式 (Gotcha)”测试的批评

- [D] 能不能别再在标题里用 “is all we need” 了?(得分:335,评论:74):该帖子批评了在科学论文标题中过度使用 “… is all we need” 这一短语的现象,认为这通常缺乏科学价值,仅仅是一种吸引眼球的策略。作者呼吁减少其使用,并指出这已成为一种不良做法。

- 评论者们幽默地批评了如 “is all we need” 这样被滥用的论文标题,并提出了诸如 “attention (grabbing) is all we need” 和 “better title names is all we need” 之类的替代方案。他们对科学论文中的标题党行为表示沮丧,并建议对这类投稿采取直接拒稿 (desk reject) 政策。

- 大家一致反对在科学论文中使用复杂的缩写,用户指出除非是引入一个经常被引用的资源,否则这些缩写是不必要的。milesper 批评了从单词中间取字母组成缩写的做法,而 H4RZ3RK4S3 建议发布一个关于最佳实践的愿望清单帖子。

- Successful-Western27 强调了这一短语的普遍性,指出过去 6 个月里 Arxiv 上有超过 150 篇标题包含 “is all you need” 的论文,这引发了关于该平台作为科学资源角色的讨论。yannbouteiller 和 TheJoshuaJacksonFive 质疑了 Arxiv 的可信度,称其为“美化版的博客”。

主题 2. 7.6 万美元的机器狗现在只需 1600 美元,AI 几乎免费

- 7.6 万美元的机器狗现在只需 1600 美元,AI 几乎免费,到底发生了什么?(得分:424,评论:294):该帖子讨论了先进技术价格的剧烈下降,重点提到 Boston Dynamics 的机器狗价格从 76,000 美元降至 1,600 美元,以及 GPT-4o Mini 的使用成本仅为 每 1,000 tokens 0.00015 美元(与 GPT-3 的初始定价相比)。作者质疑这些降价是资本主义的结果还是在贬低创新的价值,并思考了让尖端技术广泛普及的影响,以及价格“逐底竞争”的潜在后果。

- 技术通缩:像 broose_the_moose 这样的评论者认为,技术的降价是由制造、工程和算法突破的持续创新驱动的,这表明全球生活质量有提高的趋势,而不是创新的贬值。

- 社会影响与融合:讨论强调了廉价技术潜在的社会影响,wonderingStarDusts 主张采用集体主义方式进行技术分配,而 Nuckyduck 等人则展望了一个人类与技术更加融合的未来,可能导致一个“无需工作”的社会。

- 实际应用与局限性:评论者对负担得起的技术的实际应用表示感兴趣,例如 CrybullyModsSuck 想要一个洗衣服机器人,而 dronemastersaga 指出了局限性,指出 1,600 美元的机器狗是不可编程的,与 17,000 美元的可编程同类产品相比更像是一个玩具。

AI Discord 纪要

由 o1-2024-12-17 整理的“摘要之摘要”的总结

主题 1. 下一代模型之争

- QVQ-72B 碾压 GPT4o 与 Claude 3.5:Qwen 的 72B 视觉能力模型以其惊人的准确度解决数学和几何任务,令测试者大为震惊。用户吹捧它“击败了 GPT4o”,并暗示未来在图像和文本任务中将有巨大的协同效应。

- Phi-4 偶尔产生幻觉:测试者发现它能完美处理 XOR MLP,但在基础提示词上却表现不佳,证明其在某些查询上有巨大飞跃,而在其他查询中则表现拉胯。频繁出现的“随机幻觉”使其难以维持稳定的高光表现。

- OpenAI 的 O3 蓄势待发:据称新款“O3”融合了来自 STEM 专家的过程追踪与合成数据。传闻称其在训练后使用了 RL(强化学习)以实现“更长、更好的思考”,令早期的 GPT 方案相形见绌。

主题 2. 工具与开发集成

- Cursor IDE 展示 AppImage 与 DB 技巧:Linux 用户非常喜欢 Cursor 将代码生成限制提升至 25 次以及便捷的 AppImage 设置。他们还利用 AI 获取本地 API 指南,以创纪录的速度构建 Next.js 技术栈。

- Windsurf 等带来的多 Agent 狂热:开发者们分享了如 “multi-agent-orchestrator” 和 “PromptoLab” 等用于驾驭多个 AI 的框架。一些人将其与 OpenRouter 的新端点结合,用于自定义工作流。

- 给人类发邮件以获取更多额度:Cursor、Windsurf 等工具根据用户请求提高了使用上限。人们开玩笑说要写一封情真意切的“增加额度”申请信,以便在假期开启编程狂欢。

主题 3. GPU 与速度动态

- EPYC CPU 表现超出预期:有报告称,在 64 核 EPYC 服务器上运行较小的 LLM 时,CPU 达到 26 tokens/sec,GPU 达到 332 tokens/sec。他们调侃道:“PCIe 4 转接卡解决了崩溃 Bug”,并已将目光投向了下一代 PCIe 5。

- AMD 软件备受指责:SemiAnalysis 痛批 AMD 的驱动堆栈,称其改进承诺只是空谈。一位用户半开玩笑地感叹道:“世界想要垄断”,以此表达对实际修复进度缓慢的无奈。

- 量化之争与三值化技巧:研究人员通过三值化权重(ternary weights)大幅削减模型体积,将 175B 模型存储在约 20MB 中。他们吹嘘“无需反向传播!”,引发了关于训练效率的疯狂推测。

主题 4. AI 现实世界应用

- 诈骗者与恶意链接:Stability.ai 的关注者遭受了来自被黑非活跃账户的诈骗攻击。他们赞扬了警觉的机器人,并重申了那句老话:“警惕是关键。”

- 合同审查与发票 Agent:LlamaIndex 开发者分享了用于解析发票或检查 GDPR 合规性的单行代码。他们庆祝通过这些精通文档处理的 Agent 削减了数小时的人工审查时间。

- AI 播客与语音乐趣:NotebookLM 的粉丝们正在热捧一个仅限受邀参加的 AI 驱动播客平台。其他人则提议接入 Google News,通过动态 RSS 获取每日头条,满足听觉需求。

主题 5. RL、摘要与微调动态

- OREO 在 MATH 上达到 52.5%:离线 RL(Offline RL)超越了 DPO,让区区 1.5B 的 LLM 在无需任何新配对数据的情况下即可处理多步推理。测试时的“价值引导树搜索”基本上是锦上添花。

- 免费 AI 书籍摘要与 Embedding 盛宴:Nous Research 的成员分享了阅读技巧,赞扬了像 Mixedbread’s embeddings 这样的开源成果。他们表示:“重排序(Reranking)的实力有目共睹”,非常适合 RAG 工作流。

- QLoRa 探索与 GPT4All 梦想:足智多谋的开发者在 8GB GPU 上微调 3B–14B 模型,并对比了 QLoRa、BnB 4bit 和 GGUF。他们在应对内存限制和本地托管设置的同时,追求更快的推理速度。

第一部分:高层级 Discord 摘要

Codeium (Windsurf) Discord

- Windsurf 的钱包烦恼:在 12 月的讨论中,用户抨击了 Windsurf 的 3:1 额度充值方案过于昂贵,并引用了更新后的定价详情。

- 一些人调侃说,这一政策迫使他们使用多个账号,这种被认为不公平的成本倾斜方案引发了广泛不满。

- 编程模型大比拼:贡献者们对比了 Sonnet 3.5、Claude、Gemini 和 Haiku (Anthropic 最小的模型),指出在代码补全准确性方面的差异极小。

- 他们强调了根据任务选择最佳模型的重要性,并称赞 Windsurf 实现了无缝的多 AI 集成。

- 多 Agent 狂热:社区成员重点推荐了 awslabs/multi-agent-orchestrator 和 heltonteixeira/openrouterai 用于处理复杂的 Agent 编排。

- 他们还提到了用于 Prompt 评估的 PromptoLab,并指向了 Addyo’s substack 和 Builder.io 的文章,探讨 AI 编程方法。

- Pro 计划的混乱:用户报告 Windsurf 的支持响应需要等待数天,其中一个关于自动编辑功能的工单 12 天未得到回复。

- 另一位用户声称积压的工作导致 Pro 状态无法更新,加剧了假期淡季期间的不满情绪。

Cursor IDE Discord

- Cursor IDE 实力增强:社区成员讨论了 Cursor IDE 的新更新,将使用限制从 10 提升到 25,并引用了 Cursor - Build Software Faster 以获取扩展功能。

- 他们将其与 Windsurf 等同类解决方案进行了对比,强调了 Cursor 的稳定性和便利性。

- Sonnet 超越 Grok 和 Gemini:用户将 Sonnet 与 Grok 和 Gemini 进行了比较,称赞其在编程任务上的表现优于 Grok 的最新更新。

- 他们指出了较新版本 Grok 中的幻觉问题,进一步巩固了 Sonnet 在性能一致性方面的声誉。

- 在 Linux 上驯服 AppImage:指南介绍了如何在 Linux 上将 Cursor 作为 AppImage 运行,参考了 AppImage for x64,并在标记为可执行后运行。

- 少数用户遇到了障碍,并使用 Gear Lever 来处理该过程,从而简化了整个安装流程。

- 使用 Cursor 设置本地 API 和数据库:一位开发者询问如何使用 Cursor 运行本地 API 和数据库,并被鼓励向 AI 寻求详细步骤。

- 其他人指出了 Next.js 文档 可能存在的协同效应,建议采用“边做边试”的方法来确认兼容性。

- 联系人工以获取更高限制:社区中出现了一些幽默的讨论,关于通过发邮件给支持团队来申请超过 Cursor 新增加的 25 次限制的额度。

- 社区成员分享了成功案例,称支持团队响应迅速并增加了容量。

Nous Research AI Discord

- Phi-4 的得与失?:社区测试了 Phi-4 模型的事实准确性,此前该模型使用内置的

pow()函数生成了一个可以运行的 XOR MLP。- 一位用户对其在某些请求上的成功感到惊讶,但也指出频繁的幻觉阻碍了其可靠性。

- Qwen Coder 7B 对决 14B:成员们对比了 Qwen Coder 7B 和 14B 在编程任务中的表现,观察了在不同量化设置下的性能变化。

- 他们发现 Qwen 2.5 Coder 7B 有时无法处理常规 Prompt,而其他替代方案也显示出明显的代码生成问题。

- 量化之争继续:参与者讨论了不断变化的量化领域,提到 QTIP 适用于参数量超过 7B 的模型。

- 他们强调了彻底的基准测试的重要性,并推荐将 Llama.Cpp-Toolbox 作为一个简单的界面。

- Hugging Face 贡献者集结:一位贡献者强调了他们在 Hugging Face 的参与,引用了 PyTorchModelHubMixin 和 transformers PR #35010。

- 他们还欢迎在 Discord 机器人和其他代码上的协作,引导同行访问 他们的 GitHub 直接参与。

- 免费 AI 摘要助力学习:#interesting-links 频道的一位用户推荐了 Free AI Book Summaries 以供快速参考。

- 他们分享该资源是为了满足 AI 核心读物的快速阅读和深入探索需求。

Unsloth AI (Daniel Han) Discord

- 量化奇技与 GGUF 收益 (Quant Quirks & GGUF Gains):参与者探讨了将 Unsloth 模型转换为 GGUF 以实现更快推理的方法,指出 BnB 4bit 可能会限制任何重大的速度提升,并强调高质量数据是训练的关键。

- 他们得出结论,仅靠量化无法取代强大的数据集,并称赞 Unsloth 的 VRAM 友好方法和一致的性能。

- QLoRa 探索与 Sprint 模式 (QLoRa Quests & Sprint Mode):用户想知道在 8 GB 显卡上使用 Llama 3.2:3B 模型进行 QLoRa 微调是否可行,分享了关于内存限制的经验和担忧。

- 他们还询问了 sprint mode,并附上了一张暗示未来功能的图片,但尚未收到确切的发布日期。

- Unsloth 对比 Ollama 及速度场景 (Unsloth vs Ollama & Speed Scenes):一位成员评估了 Unsloth 作为 Ollama 替代方案的可能性,对宣称的 2x faster inference(2倍推理速度)很感兴趣,但注意到缺乏现成的聊天模板。

- 其他人承认 Ollama 设置更简单,而 Unsloth 需要更多手动调整,但承诺会有强大的速度优势。

- Pro 版延迟与多 GPU 测试 (Pro Delays & Multi-GPU Trials):当用户发现尽管愿意付费但 Unsloth Pro 仍无法使用时感到沮丧,因为该工具尚未发售。

- 他们听说 Multi-GPU 支持正处于测试阶段,计划于 2025 年发布,这进一步激发了对高级功能的期待。

- Mixedbread 的 Embedding 优势 (Mixedbread’s Embedding Edge):社区成员推荐将 Mixedbread 用于 RAG 任务,并将其与 MTEB leaderboard 上的 Stella 和 Qwen 等其他开源模型进行了比较。

- 他们链接了 Mixedbread 模型 并指出了其 reranking 功能,促使其他人尝试将其用于 sentence embeddings。

Stability.ai (Stable Diffusion) Discord

- 诈骗者破坏服务器 (Scammers Subvert Servers):一个小组解释了诈骗者如何通过黑掉不活跃账户并向用户发送恶意链接来破坏 Discord 服务器。

- 一位用户强调了专门用于过滤这些攻击的 bots,并表示“警惕是关键”。

- GPU 租赁引发质疑 (GPU Rentals Rouse Skepticism):参与者辩论了在某些平台上仅以 $0.18/hr 租赁 GPU 的合法性。

- 一位用户称其“好得令人难以置信”,指出低端硬件在其他地方的价格更高。

- 局部重绘策略焦点 (Inpainting Tactics in Focus):成员们比较了多种 AI inpainting 工作流,包括为了获得更强效果而使用的链式模型。

- 他们建议使用高质量模型以实现最简设置,同时有效地混合多种元素。

- LTXV 领衔视频生成 (Video Generation Crowned by LTXV):几位参与者推荐将 LTXV 或 Hunyuan 用于稳定的视频扩散任务,称赞它们的资源效率和性能。

- 其他人将这些解决方案与处理帧效率低下的过时模型进行了对比,引用了新方法中更好的优化。

- Stable Diffusion 离线步骤 (Stable Diffusion Offline Steps):一位用户询问了 Stable Diffusion 的离线使用,引发了关于本地 web UI 设置的建议。

- 资源包括一份 Webui 安装指南,详细说明了 GPU 限制和离线安装技巧。

Stackblitz (Bolt.new) Discord

- 季节性放缓:AI 的奇怪特性 (Seasonal Slowdowns: AI’s Odd Quirk):一项基于 TikTok 的研究表明,AI 在 8月 和 圣诞节 前后效率会降低,在这些缓慢时期会采用人类数据的模式。

- 成员们讨论了提供季节性见解以提升性能,建议这些低迷月份可能是进行有趣实验的最佳时机。

- 项目痛点:浪费时间与访问受限 (Project Pains: Wasted Time and Limited Access):一位用户在任务上花费了 $15 和 3 小时 却未获成功,对缺乏即时结果感到沮丧。

- 其他人对只能访问过去 30 天 的聊天记录表示担忧,引发了关于检索旧 Bolt 项目以供未来参考的问题。

- Mongo 混乱:Bolt 的连接难题 (Mongo Mayhem: Bolt’s Connection Conundrum):社区成员在将 MongoDB 与 Bolt 连接时遇到困难,理由是后端限制阻碍了直接的数据库连接。

- 他们提到使用 Firebase 或 Supabase 作为更兼容的选择,并参考了 Bolters.io 文档 以获取替代方案。

- MVP 动力:AI 工具激发快速构建 (MVP Momentum: AI Tools Spark Swift Builds):用户称赞 Bolt.new 能够为小型 MVP 生成生产就绪的代码,强调需要了解其参数以实现更顺畅的工作流。

- 他们分享了 Bolters.io 等社区资源,以完善 AI-driven development 方法,同时管理对速度和稳定性的预期。

OpenRouter (Alex Atallah) Discord

- 节日 Web Search 功能推出:OpenRouter 为任何语言模型引入了 Web Search,让工程师在节日期间也能实时获取信息,正如这个现场演示所示。

- 这一免费升级出现在公告频道中,并可能扩展为官方 API 功能,引发了关于 Token 使用成本管理的讨论。

- 模型大幅降价激发热情:多款模型降价,例如 qwen/qwen-2.5 coder 系列降价 -12%,nousresearch/hermes-3 降价 -11%,meta-llama 更是大幅降价 -31% 以鼓励使用。

- 开发者称这是节日工作负载的及时福利,并引用了赞扬这些高性价比变化的社区反馈。

- Endpoints API 进入 Beta 测试:OpenRouter 推出了 Endpoints API 的 Beta 版本,可在此链接查看,供开发者探索模型元数据。

- 尽管目前缺少官方文档,但该预览版预示着即将推出的增强功能,包括精细化定制和更深层的集成选项。

- Qwen 模型引发褒贬不一的反应:社区成员将 QVQ-72B 与 Llama 3.3 及 Phi-4 进行了对比,注意到其在处理数学和几何方面的差异,同时也称赞了其特定优势。

- 他们参考了 Hugging Face 仓库以获取更多见解,并指出了指令遵循方面的差距以及不同任务的熟练程度。

- Claude 3.5 Beta 消除困惑:参与者确认 Claude 3.5 beta 和 Claude 3.5 实际上是相同的,只是 Beta 版拥有独立的受控 Endpoint。

- 关于编码能力一致性的保证打消了用户对两个版本性能差异的疑问。

Perplexity AI Discord

- OpenAI O3 强势登场:OpenAI 推出了 O3 Model,承诺为 AI 驱动的工作流提供先进功能,并在 #[sharing] 频道分享了亮点。

- 社区反馈称 O3 是“AI 进化的重要一步”,并强调其在推理能力和用户体验方面的提升。

- Gemini 取得进展:Google 在 Google AI Studio 上预热了 Gemini,将其定位为下一代多模态方案。

- 成员们推测 Perplexity 将进行集成,并引用了 TestingCatalog News 的推文,其中暗示了 Gemini 2.0 Pro 的消息。

- ClingyBench 测试 AI 依恋程度:f1shy-dev 引入了 ClingyBench,通过数值差异来衡量 AI 模型的“粘人程度”。

- 参与者好奇“类情感”行为是否可以量化,称 ClingyBench 是用户与模型交互中一个有趣的实验。

- LLMAAS 受到关注:成员们探索了 LLMAAS 的应用场景,集思广益简化大语言模型托管的方法。

- 他们讨论了负载处理和定价结构,将 LLMAAS 视为多个 AI 利益相关者之间可行的协作渠道。

- Llama 3 低调发布:#[pplx-api] 频道简要提到了 Llama 3,但关于性能或发布时间的官方细节较少。

- 几位用户要求提供更深入的技术规范,认为官方声明对于彻底的技术评估来说“过于简短”。

aider (Paul Gauthier) Discord

- Aider 与 .gitignore 的讨论:成员们确认 Aider 遵循

.gitignore规则,并引用了官方文档。- 然而,关于未来被忽略的文件是否会被加载仍存在困惑,这促使人们呼吁提供更清晰的文档。

- 语音 UI 尝试:一位正在为 Aider 开发实时语音交互 UI 的用户强调了对专用 API 的需求,并引用了此 GitHub 项目。

- 他们对语音驱动功能表示兴奋,暗示了直接语音命令的新可能性。

- Qwen 的 QVQ-72B 崛起:讨论者注意到 QVQ-72B 令人印象深刻的视觉推理能力,引用了 Hugging Face 链接。

- 他们指出了其在 MMMU 上的强劲性能指标,引发了对未来视觉 AI 基准测试的好奇。

- BigCode-Bench 热议:简要提到了 BigCode-Bench,这是一个针对编程模型的评估资源。

- 该链接激发了追踪性能数据并确保不同模型系列之间进行准确比较的兴趣。

- Cursor IDE 与 Aider 的和谐共存:用户称赞 Cursor IDE 遵循

.gitignore并提供类似于 VS Code 的编程环境,参考了 Cursor 文档。- 他们注意到简单的设置导入以及在将 Cursor 与 Aider 结合进行编程任务时的流畅工作流。

OpenAI Discord

- Meta 的大概念模型举措:Meta 推出了 large concept models,以扩展高级 AI 任务中的关键应用。

- 成员们称赞了这种方法,称其为完善模型能力的重要一步。

- Claude 在编程方面超越 ChatGPT:从 ChatGPT 切换到 Claude 后,在复杂度增加的任务中表现出更好的编程性能。

- 然而,其他人建议在大型项目中使用 Gemini,因为它具有更好的 Token 限制。

- O1 助力 ESLint 配置:开发者考虑使用 O1,因为它具有更高的模型限制,并有潜力处理现代 Lint 设置。

- 他们讨论了预先向 O1 提供最近的配置,以减轻知识过时的问题。

- 个性化中的记忆增强:用户启用了 memory 功能来存储个人数据,旨在获得更具上下文感知能力的 AI 回复。

- 几位参与者看到了采用持久化记忆进行更深层次交互的前景。

- 食谱生成的两种方式:讨论集中在以最低成本构建高级食谱的自顶向下与自底向上方法。

- 小组权衡了检索模式和多样性需求如何与有效的产出生成相互作用。

Modular (Mojo 🔥) Discord

- Mojo 冲刺高频交易 (HFT):一些成员表示 Mojo 在某些任务中超越了 C,表明它可以支持 High-Frequency Trading 算法。

- 他们还提到了一家举办 Kaggle Math Olympiad event 的公司,表明了对简单实验之外的现实应用兴趣。

- Bug 追踪:’input()’ 崩溃:一位用户发现,在没有输入的情况下按下 ctrl-d 会导致 Mojo 崩溃,记录在 Issue #3908 中。

- 开发者建议澄清错误消息,并确认目前无法读取 errno。

- Mojo 的 GPU 进展仍在酝酿中:参与者注意到 GPU support 仍处于预览阶段,目前阻碍了与 NuMojo 的集成。

- 他们的目标时间表约为一年,以实现更强大的增强功能,希望能加速 Mojo 在 ML 任务中的应用。

- MAX 中的 Mandelbrot 崩溃:MAX 中的 Mandelbrot 实现由于 dlsym 错误在 Mac 上崩溃,暗示了 Python 构建的局限性。

- 分享了一个改进的 custom op 以优化 C 初始化,他们计划在 1 月份进行进一步完善并合并。

- Mojo vs Julia:科学计算之争:关于 Mojo 可能在数值计算工作中与 Julia 竞争的辩论兴起,参考了模仿 Python 在 numpy 和 matplotlib 方面成功的尝试。

- 虽然像 numojo 这样的库正在涌现,但成员们预见要建立一个完全成熟的生态系统还需要大量的开发。

Notebook LM Discord Discord

- Akas 增强 AI 音频:一位成员介绍了 https://akashq.com 上的 Akas 应用,这是一个仅限邀请的平台,用于上传和分享 AI 生成的播客,并称其消除了内容发现的麻烦。

- 社区对这一概念表示欢迎,强调了对存储和访问由 NotebookLM 驱动的音频的更直接方式的需求。

- NotebookLM 获得赞誉与批评:一位用户称赞 NotebookLM 处理了跨越 20 年的系列丛书,称其对于保持角色、情节漏洞和故事情节的条理性至关重要。

- 其他人报告了 UI 错误,频繁的页面刷新干扰了创作流程,凸显了对移动端和桌面端更流畅使用体验的持续需求。

- RSS 在 AI 播客中占据主导地位:一位参与者坚持认为 RSS feeds 对可发现性至关重要,强调了许多平台如何依赖标准化订阅源。

- 小组讨论了为每个用户生成动态 RSS,以及挂接 Google News 获取头条新闻以增强 AI 驱动的音频内容。

- Project Mariner 规划网络航线:Google 的 Project Mariner 作为一款由 Gemini 驱动的 AI Agent 亮相,可在 Chrome 中自动执行网页任务(如填写表单),详见这篇 TechCrunch 文章。

- 成员们称其为 AI 在浏览领域的重大飞跃,预计用户处理基于 Web 的任务的方式将发生变革。

- 年度回顾获得 LLM 助力:一位用户结合使用 NotebookLM 和 Claude 来完善他们的年度评估,展示了 LLM 如何检测绩效模式。

- 他们将其描述为“我自己的 Google 搜索”,并归功于这些 LLM 工具 照亮了个人改进的机会。

Latent Space Discord

- 概念热潮:Large Concept Models:新的 Large Concept Models 论文探讨了用于语言建模的句子级表示,但参与者对其即时效用表示怀疑。

- 一些人看到了与可控想法框架 (steerable idea frameworks) 的协同作用,尽管对现实可行性持怀疑态度,但仍感到兴奋。

- OCTAVE 的即时语音功能:Hume 推出了 OCTAVE,这是一款能够实时生成语音和个性的语音语言模型,如此公告所示。

- 社区反应强调了逼真的语音合成可能变得广泛可用。

- xAI 的 60 亿美元融资潮:xAI 宣布了 60 亿美元的 Series C 融资,投资者包括 a16z、Blackrock 和 Fidelity,详见其声明。

- 对话暗示硬件可能转向 AMD,参考了 Dylan Patel 的推文。

- 后 Transformer 时代与亚二次方 (Subquadratic) 对决:一场由 @realDanFu 和 @picocreator 主持的特别会议探讨了 Transformer 之外的亚二次方注意力机制,分享于此播客。

- 他们对超过 1000 万 token 的上下文长度与 RAG 的对比发表了大胆见解,引发了 Scaling 爱好者的辩论。

- 合成数据与 “Smol” 惊喜:在 Latent.Space 的回顾中,Loubna 展示了今年在合成数据 (Synthetic Data) 和 Smol Models 方面取得的顶级成就。

- 他们讨论了模型崩溃 (model collapse),重点介绍了 Phi 和 FineWeb 等教科书级数据集,并考虑了用于更广泛用途的端侧 (on-device) 解决方案。

Interconnects (Nathan Lambert) Discord

- QvQ 72B 与 GPT4o & Claude Sonnet 3.5 的对决:Qwen 的 QvQ 72B 模型已在 Hugging Face 发布,具备视觉能力,据报道在性能上击败了 GPT4o 和 Claude Sonnet 3.5 (链接)。

- 社区成员强调了该模型在推理任务中的显著提升,并对更先进的视觉-语言协同效应表示出极大的热情。

- O1/O3 加权解码 vs. 多数投票 (Majority Voting):成员们讨论了 O1/O3 技术是否依赖于并行轨迹生成和 Majority Voting 来进行具有成本效益的最终答案选择。

- 一些人建议从最佳候选池中挑选 Reward Model 输出最高的结果,而另一些人则质疑简单的 Top-reward 方法是否能匹配或超过 Majority Voting。

- QVQ Vision 与乘积法则 (Product Rule):来自 Qwen 的 QVQ 视觉推理模型应用了数学函数和导数,如其 博客文章 所示,展示了基于乘积法则的评估。

- 一个在 x=2 处的导数示例给出了 -29,这表明在先进的 LLM 中将符号数学逻辑与视觉任务结合具有潜力。

- AMD 软件吐槽与 500 美元的订阅:一段关于 AMD 软件 的 Dylan 视频 因其循环往复的风格和有限的清晰度引起了褒贬不一的反应。

- 与此同时,一位用户支付了 500 美元 订阅 Semianalysis,并开玩笑说如果听从聊天建议去投资 Nvidia 股票会赚得更多。

- 精选 LM 推理论文出现:一套汇编的 LM 推理 论文重点介绍了 Prompting、Reward Modeling 和 Self-training,同时跳过了肤浅的 Chain-of-Thought 示例。

- 这些论文涵盖了确定性和学习型验证器,并征求可能被遗漏的任何有影响力的作品。

LM Studio Discord

- Intel AVX2 澄清 LM Studio 的加载路径:工程师确认 LM Studio 支持带有 AVX2 指令 的现代 Intel CPU,并引用 i9-12900k 作为已确认的工作示例。

- 一位用户在使用 llama 3.3 mlx 70b 4bit 时遇到了 Exit Code 6 错误,暗示 Context Length 或模型大小可能超出了系统能力,尽管其他人报告成功加载了更大的模型。

- EPYC 的耐力:令人惊讶的 CPU 增益:测试显示 64 核 EPYC 处理器 在使用 8b 和 1b 模型时,CPU 输出达到 26 tokens per second,GPU 达到 332,表现超出预期。

- 讨论强调了 PCIe 4 risers 如何解决了 ASUS 主板的问题,激发了对 PCIe 5 risers 和 MCIO 线缆 以进一步提升性能的好奇心。

- Granite 在真实代码测试中的差距:一位用户表达了对 Granite 模型 的沮丧,声称尽管网上好评如潮,但它们在编程练习中屡屡失败。

- 这种不匹配引发了关于模型在实践中的可信度与营销宣传之间差距的辩论,其他人则质疑 Granite 的炒作是否言过其实。

- ComfyUI 与 4090 GPU:显存 (VRAM) 增加但 GPU 痛苦:在一个系统中运行两块 4090 GPU 技术上提供了 48GB VRAM,但在 ComfyUI 中实现最大吞吐量仍然具有挑战性。

- 参与者指出,除非 Context Size 有需求,否则仅靠 VRAM 无法确保更快的速度,并建议在使用大型语言模型时使用 Draft Models 来优化任务。

GPU MODE Discord

- PyTorch 的符号化重排 (Symbolic Shuffle):在 PyTorch 构建中,整数(可能还有浮点数)会触发符号化重编译,正如 torch.SymInt 中所强调的,这促使人们更倾向于预先设置而非运行时预热。

- 贡献者计划进行进一步实验,以确认 floats 是否也采用这种符号化方法,旨在避免在 kernel 中触发多次即时编译 (JIT)。

- Triton 的类型提示 TMA 策略:Triton 开发者考虑了类似

def program_id(axis: int) -> tl.tensor的类型提示 (type hints),同时研究了 async TMA 和 warp specialization 以利用 Hopper 硬件。- 他们讨论了 TMA 与不带 warp specialization 的

ldgsts之间的区别,强调了多阶段和持久化 kernel 以实现更灵活的代码生成。

- 他们讨论了 TMA 与不带 warp specialization 的

- GPU 基准测试对决:Torch vs. Triton:讨论对比了 triton.testing.do_bench 和 torch.inductor.utils.print_performance,指出在某些循环中缺少

torch.cuda.synchronize()以及对 kernel 计时可能产生的影响。- 参与者参考了 这段 Triton 测试代码片段 以及用于测量 kernel 耗时的 CUDA events,并建议单个流会按顺序处理启动。

- BitNet 的三元权重革命:BitNet 因使用三元权重 (ternary weights) 进行训练而受到关注,号称能减少 97% 的能耗,并将 175B 模型存储在约 20MB 中,详见 Noise Step 论文。

- 一种名为 Training in 1.58B With No Gradient Memory 的方法绕过了反向传播,引发了关于在 MNIST 等小型基准测试上使用轻量级内存方法的讨论。

- OREO 离线强化学习 (Offline RL) 崛起:一种名为 OREO 的方法在不使用额外问题集的情况下,利用 1.5B 语言模型在 MATH 上达到了 52.5% 的准确率,如此推文所述。

- 它避开了成对数据,在多步推理中表现优于 DPO,并允许在测试时进行价值引导树搜索 (value-guided tree search) 以获得免费的性能提升。

Eleuther Discord

- 持久化 Pythia:预训练步骤传奇:一位用户请求以一定间隔提供额外的 Pythia 模型检查点(包括优化器状态 (optimizer states)),以便恢复预训练。

- 他们特别需要在 160M/1.4B/2.8B 系列中增加 10 个额外步骤,并承认文件体积巨大。

- 幻觉难题:AI 的现实扭曲:《纽约时报》一篇关于 AI 幻觉 的文章引发了关于高级模型中误导性输出的讨论。

- 参与者指出,验证结果以防止这些虚假主张掩盖真实进展仍是一项持续的挑战。

- ASAL 的重大飞跃:自动化人工生命:自动化人工生命搜索 (ASAL) 方法利用基础模型 (foundation models) 来寻找能够生成目标现象和开放式新颖性的模拟。

- 该方法旨在减少人工生命 (ALife) 中的手动猜测,提供了使用 FMs 而非暴力破解来测试进化系统的新方法。

- 协处理器热潮:LLM 卸载以获取收益:研究分享了一种策略,让冻结的 LLM 调用离线协处理器,增强其键值缓存 (KV cache) 以提升性能。

- 这带来了更低的延迟和更好的推理能力,因为 LLM 将更繁重的任务交给专用硬件,从而实现显著的加速。

- CLEAR 势头:扩散 Transformer 竞速:扩散 Transformer (Diffusion Transformers) 引入了名为 CLEAR 的局部策略线性注意力 (linear attention),降低了高分辨率图像生成的复杂度。

- 讨论还强调了对基于物理的指标以及自动化研究框架潜在合作伙伴的兴趣。

LlamaIndex Discord

- SKU Agent 大幅减少人工匹配:查看 @ravithejads 的新教程,展示了 document agent 如何解析发票并将行项目与标准化 SKU 匹配,详见此教程。

- 它显著减少了人工工作量,展示了在发票场景下 agentic 工作流的效率。

- 单行代码合同审查器应对 GDPR:@MarcuSchiesser 的一个新模板展示了如何使用 @getreflex 和 llama_index 仅用一行代码构建 contract review agent,如这条推文所示。

- 它检查供应商协议的 GDPR 合规性,暗示了一种精简的合同分析方法。

- Ollama LLM 超出其 Context Window:用户观察到本地使用 Ollama LLM 时出现 context window 问题,即使 Prompt 很短且 top_k=1 也是如此。

- 他们建议增加 LLM 超时时间以避免溢出,展示了如何通过配置调整来解决本地 LLM 的限制。

- VectorIndexRetriever 遭遇序列化障碍:@megabyte0581 在使用 VectorIndexRetriever 时遇到了 ValueError,提示 IndexNode 对象不可序列化,参考 Issue #11478。

- 他们指出使用 Chroma 作为 Vector DB,并转向递归检索方法作为权宜之计。

- 关于 Llama Index 消息批处理 API 的咨询:@snowbloom 询问是否可以通过 Llama Index LLM class 调用 OpenAI/Anthropic 的 Message Batching API,但未得到立即回复。

- 这凸显了在 LLM 工作流中对批处理请求处理需要更清晰指导的持续需求。

Nomic.ai (GPT4All) Discord

- Azure 支出忧虑与 GPT4All:一位开发者质疑在 Azure AI 上运行 GPT4All 是否具有成本效益,理由是 GPU VM 价格高昂。

- 他们担心开源托管的预算限制,其他人则警告大量使用可能会导致巨额账单。

- 视觉差异与 AI “幻觉”:一位用户分享了一个展示 vision model 的 YouTube 视频,尽管据报道该模型对其能力产生了“幻觉”。

- 另一位观察者认为其可靠性存疑,并指向后续片段以获取更多证据。

- o1 模型挂钩与 GPT4All 进展:一位成员通过连接 OpenAI 兼容服务器,在 GPT4All 上尝试使用 o1 模型。

- 社区反馈确认了该设置的成功,表明模型集成相对简单。

- Ollama 代理路径与 GPT4All:一位开发者考虑通过服务器上的 Ollama 路由 GPT4All 请求,以避免本地安装。

- 另一位用户确认通过将 GPT4All 指向 URL 端点 取得了成功,实现了一个轻松的远程代理工作流。

- LocalFiles 限制之谜:一位用户注意到 GPT4All 仅引用了 LocalFiles 中的一小部分文件,忽略了完整集合。

- 他们怀疑文档覆盖不完整,从而引发了关于 GPT4All 在批量查询中如何处理多个文件的问题。

LLM Agents (Berkeley MOOC) Discord

- 无值得注意的 LLM 讨论 #1:除了 MOOC 的行政任务外,没有出现高级 LLM 或 AI 主题,因此没有技术亮点。

- 根据指南,我们略过平凡的证书表格问题。

- 无值得注意的 LLM 讨论 #2:这些对话中未涉及新模型、数据集或训练策略。

- 因此,根据这些指南,我们没有相关内容可以分享。

tinygrad (George Hotz) Discord

- SemiAnalysis 抨击 AMD 的软件:SemiAnalysis 批评了 AMD 的软件现状,质疑该公司是否会交付真正的改进。

- 成员们回应称 talk is cheap(空谈无益),强调了世界趋向于垄断的普遍担忧。

- Lean 证明悬赏吸引关注:一位社区成员对 Lean 证明悬赏 表现出兴趣,并请求支持以应对挑战。

- 他们寻求形式化方法领域其他人的见解,希望能加速进度。

- Discord 规则困惑:提醒查看 Discord 规则让几位找不到规则的成员感到困惑。

- 他们的评论如 I do not see the rules for this discord 强调了需要更清晰的指南。

- Tinygrad 因类 Torch 转换受赞赏:一位用户称赞 Tinygrad API 紧密模仿 Torch,使复杂项目的迁移变得更简单。

- 他们指出 ChatGPT 可以毫不费力地将 Torch 转换为 Tinygrad,强调了该库易于上手的设计。

Cohere Discord

- 史努比的圣诞惊喜:一位用户发布了一张史努比穿着圣诞老人衣服摇铃的卡通图,展示了节前的节日气氛。

- 这个欢快的 GIF 引发了 ‘What’s cooking this X-mas?’ 的询问和轻松的讨论,成员们交换了节日表情和想法。

- 圣诞烹饪好奇心:参与者聊起了圣诞烹饪计划,集思广益可能的节日菜单和零食。

- 他们表达了对即将到来的聚会和盛宴的兴奋,分享俏皮的鼓励以激发更多节日气氛。

OpenInterpreter Discord

- 失误与疲劳:一位用户表达了对重复错误的困惑,在几乎连续的循环中应对技术障碍时开玩笑地称自己为 nuub(菜鸟)。

- 他们还提到在屏幕前花费了很长时间,加剧了挫败感,并促使社区询问 ‘Why does this happen?’。

- TLDraw 工具预告:有人分享了 computer.tldraw.com 的链接,建议将其作为可视化或故障排除问题的潜在资源。

- 细节仍然有限,但这一提及引起了寻求新方法来解决持续挫败感的参与者的兴趣。

DSPy Discord

- pyn8n v4 发布,带来 Pythonic 工作流能力:新的 pyn8n v4 通过代码驱动的动态工作流生成(Dynamic Workflow Generation)和用户友好的对话式 CLI 升级了 n8n 自动化。

- 此版本使开发者能够高效地创建、管理和监控工作流,将先进的编排功能与直观的 Python API 相结合。

- Ash Framework 与 n8n API Wrapper 集成:Ash Framework 在整个 n8n 工作流中集成了高级业务逻辑,且对自动化人员保持透明。

- 新的 n8n API Wrapper 还简化了直接的 REST 调用,结合了通过 DSLModel 进行的节点部署,以简化自动化任务。

MLOps @Chipro Discord

- #general-ml 频道中的简短致谢:一位用户发布了 “pretty cool thanks for sharing!”,引用了一个未指明的资源,没有更多细节。没有引入额外的对话点,讨论非常短暂。

- 消息中没有分享具体的链接、代码库或技术见解。因此,该频道除了这条笔记外,没有看到任何延伸的讨论或后续。

- 缺乏进一步内容:没有其他参与者加入对话,也没有提出任何新问题或公告。整体聊天内容极少,没有提供更深层次的 AI 或 MLOps 见解。

- 由于没有额外的上下文或参考资料,这里没有更多可探索的内容。这条消息实际上结束了该环节,没有出现新的话题。

LAION Discord

- GPT-4o 获得视觉优势:一位用户分享了 Greg Brockman 的推文,展示了一张由 GPT-4o 生成的图像,标志着 AI 驱动视觉效果的不断进化。

- 社区成员将其视为重大进步,反映了对下一代图像创作潜力的兴奋。

- 团队增强 GPT-4o 的工具箱:参与者强调了为提升 GPT-4o 图像生成能力而进行的持续优化。

- 他们对团队的职业精神表示赞赏,并对 AI 成像的未来增强寄予厚望。

Axolotl AI Discord 没有新消息。如果该服务器长期沉默,请告知我们,我们将将其移除。

Torchtune Discord 没有新消息。如果该服务器长期沉默,请告知我们,我们将将其移除。

Mozilla AI Discord 没有新消息。如果该服务器长期沉默,请告知我们,我们将将其移除。

HuggingFace Discord 没有新消息。如果该服务器长期沉默,请告知我们,我们将将其移除。

Gorilla LLM (Berkeley Function Calling) Discord 没有新消息。如果该服务器长期沉默,请告知我们,我们将将其移除。

AI21 Labs (Jamba) Discord 没有新消息。如果该服务器长期沉默,请告知我们,我们将将其移除。

第 2 部分:按频道划分的详细摘要和链接

邮件版已截断完整的频道详细分析。

如果您喜欢 AInews,请分享给朋友!预先感谢!