ainews-not-much-happened-today-4979

今天没发生什么事。

以下是该文本的中文翻译:

Olmo 2 发布了一份详细的技术报告,展示了一个前沿完全开源模型在预训练、中期训练及后期训练阶段的全部细节。开源推理解决方案 PRIME 实现了 26.7% 的 pass@1,在基准测试中超越了 GPT-4o。性能提升方面,Qwen 32B (4-bit) 在 M4 Max 芯片上的生成速度超过了 40 tokens/秒,而 libvips 在图像缩放处理上比 Pillow 快 25 倍。文中还介绍了一些新工具,包括用于 Swagger 2.0 文档生成的 Swaggo/swag、与 Git 兼容的版本控制系统 Jujutsu (jj) 以及安全工具 Portspoof。机器人领域的进展包括一个具有数米宽视野和更高帧率的武器检测系统。硬件基准测试对比了 H100 和 MI300x 加速器。应用场景涵盖了利用 PRIME 进行医疗错误检测,以及集成 LangChainAI 和 Vercel AI SDK 的金融 AI 智能体。架构方面的见解指出,目前需要类似于 SSM(状态空间模型) 或 RNN(循环神经网络) 的技术突破。

开年平淡的一周

2025年1月2日至1月3日的 AI 新闻。我们为您检查了 7 个 subreddits、433 个 Twitter 账号 和 32 个 Discord(217 个频道,2120 条消息)。预计节省阅读时间(以 200wpm 计算):236 分钟。您现在可以标记 @smol_ai 进行 AINews 讨论!

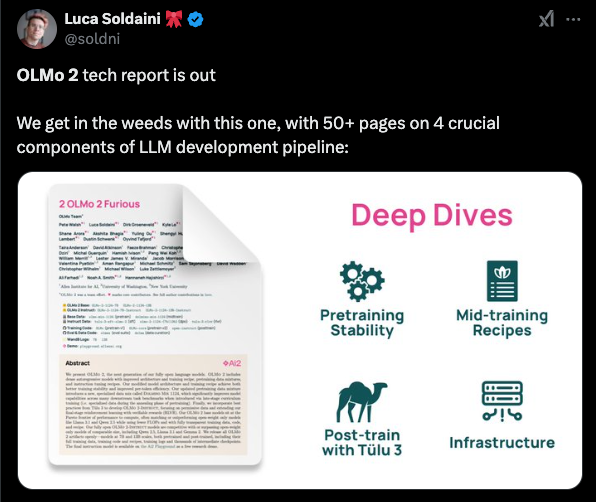

| 许多“开源 o1”模仿者引发了不少关注,但大多未能建立足够的信心,与此同时 o1 继续给人留下深刻印象。Olmo 2 发布了他们的技术报告(我们之前的报道见此),作为少数仅存的前沿完全开源模型之一,该报告提供了典型的完整 {pre | mid | post}-training 细节。 |

AI Twitter 回顾

所有摘要均由 Claude 3.5 Sonnet 完成,取 4 次运行中的最佳结果。

AI 模型与性能

-

模型开发与基准测试:@_akhaliq 介绍了 PRIME,这是一种提升语言模型推理能力的开源解决方案,实现了 26.7% pass@1,超越了 GPT-4o。此外,@_jasonwei 讨论了在评估 Chain-of-Thought 方法时数据集选择的重要性,强调了它们在数学和编程任务中的有效性。

-

优化技术:@vikhyatk 对 libvips 进行了基准测试,发现其在调整图像大小时比 Pillow 快 25 倍。此外,@awnihannun 报告称,Qwen 32B (4-bit) 在 M4 Max 上的生成速度超过 40 toks/sec,突显了性能的提升。

-

架构见解:@arohan 批评了尽管计算量呈指数级增长,但架构突破却停滞不前,并建议可能需要类似于 SSMs 或 RNNs 的架构突破。

AI 工具与框架

-

开发工具:@tom_doerr 分享了 Swaggo/swag,这是一个从 Go 代码注释生成 Swagger 2.0 文档的工具,支持 Gin 和 Echo 等框架。此外,@hendrikbgr 宣布了 Cerebras Systems 与 LangChain.js 的集成,为 JavaScript/TypeScript 应用启用流式传输 (streaming)、工具调用 (tool calling) 和结构化输出 (structured output)。

-

Agent 框架:@jerryjliu0 预览了即将到来的 2025 年 Agent 架构,重点关注报告生成和客户支持等领域的可定制性。

-

版本控制与安全工具:@tom_doerr 介绍了 Jujutsu (jj),这是一个兼容 Git 的 VCS,使用 changesets 实现更简单的版本控制;以及 Portspoof,这是一种安全工具,可使所有 TCP 端口 看起来都处于开放状态以威慑攻击者。

机器人与硬件

-

机器人进展:@adcock_brett 展示了其武器检测系统的 Gen 2 版本,具有数米宽的视野和更快的图像帧率。此外,@shuchaobi 推广了由其最新硬件设计驱动的视频语音模型。

-

硬件优化:@StasBekman 添加了高端加速器缓存大小章节,比较了不同制造商的缓存架构;@StasBekman 分享了 H100 vs MI300x 的基准测试,指出不同的用例有不同的胜出者。

AI 应用与用例

-

医疗与金融应用:@reach_vb 讨论了通过 Process Reinforcement through Implicit Rewards (PRIME) 增强临床笔记中的医疗错误检测。@virattt 发布了一个集成了 LangChainAI 和 Vercel AI SDK 的 AI 金融 Agent 生产级应用。

-

创意与教育工具:@andrew_n_carr 展示了如何使用 Gemini 和 Imagen 3.0 等工具将 文本转换为 3D 打印物体。@virattt 还重点介绍了 Aguvis,这是一个适用于多个平台的 视觉 GUI Agent。

-

工作流与自动化:@bindureddy 详细介绍了 Agents 如何管理 工作流、数据转换和可视化组件,而 @llama_index 则提供了在发票处理中构建 Agentic Workflows 的资源。

行业动态与新闻

-

公司成长与投资:@sophiamyang 庆祝在 MistralAI 工作满一周年,并指出团队已从 20 人增长到 100 多人。@Technium1 报道称,今年各大数据中心(Datacenters)的支出已达 800 亿美元。

-

监管与市场趋势:@tom_doerr 批评了欧盟快速推进的监管政策,@RichardMCNgo 则谈到了对 H-1B 签证持有者的担忧以及技术投资下降的问题。

-

AI 领导力与会议:@swyx 宣布 AIEWF 的 AI 领导力分论坛现已在 YouTube 上线,其中包括来自 @MarkMoyou (NVIDIA) 和 @prathle (Neo4j) 等领导者的见解。

社区与个人感悟

-

悼念与个人故事:@DrJimFan 分享了对 Felix Hill 的由衷悼念,对其逝世表示哀悼,并反思了 AI 社区内部面临的巨大压力。

-

生产力与学习:@swyx 强调了自我驱动项目对个人成长的重要性,@RichardMCNgo 则提倡记录工作流程以增强学习效果和数据可用性。

梗与幽默

-

轻松视角:@Scaling01 调侃了架构见解的无关紧要性,而 @HamelHusain 则用多个 🤣 表情符号分享了幽默的反应。

-

幽默轶事:@andersonbcdefg 发布了关于弄丢电饭煲的推文,@teortaxesTex 对有趣的内容回复了 “🤣🤣🤣🤣”。

-

有趣的观察:@nearcyan 幽默地对比了推特想法的数量与质量,@thinkzarak 则分享了关于 AI 在社会中角色的机智见解。

AI Reddit 综述

/r/LocalLlama 综述

主题 1:LLM 性能飞跃催生对新 Benchmark 的需求

- Killed by LLM – I collected data on AI benchmarks we thought would last years (Score: 98, Comments: 18): GPT-4 在 2023 年彻底改变了 AI 基准测试,不仅超越了最先进的分数,还使其趋于饱和,标志着一个类似于通过 Turing Test 的重要里程碑。到 2024 年,其他模型如 O1/O3 和 Sonnet 3.5/4o 纷纷赶上,使数学、推理和视觉基准测试达到饱和,而 Llama 3/Qwen 2.5 则让开源权重模型具备了竞争力。作者主张在 2025 年改进基准测试,以更好地衡量现实世界的可靠性,因为当前的基准测试无法评估预期在 2030 年前解决的任务,并邀请大家为其 GitHub 仓库 贡献力量以进行进一步开发。

- 评论者讨论了 GPT-4 和 O1/O3 等 AI 模型在处理复杂任务时的局限性,指出它们擅长生成初始代码或样板代码,但在集成、安全和利基问题上表现挣扎。他们强调,虽然这些模型可以提供令人印象深刻的概览和解决方案,但在处理更大、更复杂的应用时往往会失败。

- 对话强调了编码范式转变的潜在需求,建议采用为 AI 理解而优化代码的框架。Robk001 和 Gremlation 讨论了将代码分解为小的、易于管理的块如何提高 AI 性能,后者指出高质量的输入会带来更好的 AI 输出。

- 像 Grouchy-Course2092 和 butteryspoink 这样的用户分享了在向 AI 模型提供详细输入时生产力提高的经验。他们指出,结构化的方法(如使用 SDS+Kanban boards)可以显著提高 AI 生成代码的质量,这表明用户输入质量在 AI 有效性中起着至关重要作用。

- LLM as survival knowledge base (Score: 83, Comments: 88): Large Language Models (LLMs) 作为动态知识库,提供针对特定场景和可用资源的即时建议,超越了书籍或电视节目等传统媒体。作者针对假设情景实验了流行的本地模型,发现它们通常有效,并寻求其他进行过类似研究并确定了“末日”场景首选模型的人的见解。

- 电力和资源担忧:由于高功耗,在生存场景中使用 LLMs 的实用性存在争议。一些人认为,小型模型(如 7-9B)配合便携式太阳能装置可能会有用,而另一些人则强调将宝贵资源用于可能不可靠的 AI 输出是低效的。ForceBru 强调了 LLM 输出的随机性,而其他人建议将 LLM 与书籍等传统资源结合使用,以获得更可靠的指导。

- 可信度与幻觉:包括 Azuras33 和 Calcidiol 在内的许多评论者对 LLM 的幻觉表示担忧,建议将 Retrieval-Augmented Generation (RAG) 与维基百科导出等落地数据源集成,以提高可靠性。AppearanceHeavy6724 等人讨论了多次询问同一问题以识别一致答案并降低幻觉风险的技术。

- 模型微调与实际应用:Lolzinventor 和 benutzername1337 讨论了针对生存特定知识微调较小模型(如 Llama 3.2 3B)的潜力,并指出从生存和 DIY 资源中策划数据集的重要性。Benutzername1337 分享了在生存旅行中使用 8B 模型的个人经验,强调了其效用以及受电力限制的局限性。

Theme 2. Deepseek V3 Hosted on Fireworks, Privacy and Pricing

- Deepseek V3 托管于 Fireworks (不收集数据, $0.9/m, 25t/s) (Score: 119, Comments: 65): Deepseek V3 现已托管在 Fireworks 上,与 Deepseek API 不同,它通过不收集或销售数据来提供增强的隐私保护。该模型支持完整的 128k context size,成本为 $0.9/m,运行速度为 25t/s;然而,其服务条款引发了隐私方面的担忧。OpenRouter 可以代理到 Fireworks,且正如其 Twitter thread 中讨论的那样,目前已有支持 fine-tuning 的计划。

- 隐私担忧与可信度:用户对 Fireworks 的隐私声明表示怀疑,指出公司通常拥有广泛的服务条款,允许其广泛使用提交的内容。文中强调了对数据收集和潜在滥用的担忧,一些用户对 Fireworks 的可信度提出了质疑。

- 性能与成本问题:用户报告了通过 OpenRouter 访问 Fireworks 时的不满,理由是与其他替代方案相比,响应时间更慢且成本更高。有提到 Deepseek V3 是一个 MoE model,在 671B 参数中仅激活 37B,这使得它在大规模运行时更便宜,但用户仍对低廉的定价持怀疑态度。

- 技术实现与基础设施:讨论涉及了 Deepseek V3 性能所需的技术基础设施,认为其成本效益可能源于对内存的高效利用和基础设施设计。引用了 Exolabs’ blog 以深入了解在 Mac Minis 等替代硬件上运行此类模型的见解。

- Deepseek-V3 GGUF 版 (Score: 63, Comments: 26): u/fairydreaming 和 u/bullerwins 已将 DeepSeek-V3 GGUF 量化版上传至 Hugging Face。有人请求上传在 512GB DDR4 RAM 和 单张 3090 GPU 环境下的 t/s 表现。

- 内存需求:讨论强调 q4km 需要大约 380 GB RAM 加上额外的上下文空间,总计接近 500 GB,这使得它不适合内存较小的系统,如 搭载 m4 芯片的 Macbook Pro。提到 Q2 量化的 RAM 需求较低,为 200 GB,但被认为效果不佳。

- 硬件考量:用户正在讨论硬件升级,其中一人计划订购额外的 256GB DDR5 RAM 来测试该配置,而其他人则表示受限于主板限制。bullerwins 提供了性能基准测试,指出在其配置下使用 Q4_K_M 时,prompt processing 为 14t/s,text generation 为 4t/s,并提到使用了拥有 8 个 DDR4 内存通道 的 EPYC 7402 CPU。

- 性能对比:关于 CPU 与 4x3090 GPU 的性能存在争论,bullerwins 指出,与 GPU 相比,使用 CPU 时 prompt 处理性能损失 28%,推理性能损失 12%。GPU 只能加载 61 层中的 7 层,凸显了在这种情况下 GPU 显存的局限性。

主题 3. 清华 Eurus-2:新型 RL 方法超越 Qwen2.5

- 训练一个超越 GPT-4o 的 7B 模型? (Score: 74, Comments: 10): 清华团队推出了 PRIME (Process Reinforcement through Implicit Rewards) 和 Eurus-2,通过仅使用 1/10 的数据,使 7B 模型 实现了超越 Qwen2.5-Math-Instruct 的高级推理能力。他们的方法通过实施 implicit process reward modeling(隐式过程奖励建模)来解决强化学习 (RL) 中的挑战,以应对精确且可扩展的密集奖励以及 RL 算法效率的问题。GitHub 链接

- GPU 需求:David202023 询问了硬件需求,寻求训练 7B 模型 所需硬件的详细信息,表明了对技术规范的兴趣。

- 图片显示问题:tehnic 提出了无法查看图片的问题,暗示项目资源可能存在访问性或托管问题。

- 模型测试:ozzie123 表达了下载和评估模型的计划,展示了社区的参与度以及对项目成果的实际兴趣。

主题 4. OLMo 2.0:竞争性开源模型发布

- 2 OLMo 2 Furious (Score: 117, Comments: 29): OLMo 2 旨在性能上超越 Llama 3.1 和 Qwen 2.5,预示着 AI 模型开发领域竞争激烈。帖子标题暗示了对速度和强度的关注,可能参考了《速度与激情》(Fast and Furious)系列电影。

- OLMo 2 的性能与数据策略:OLMo 2 模型位于计算性能的 Pareto frontier(帕累托前沿),经常超越 Llama 3.1 和 Qwen 2.5 等模型。团队采用了自下而上的数据策展策略,通过合成数据专注于数学等特定能力,同时通过高质量的预训练数据保持通用模型能力。

- 社区与开源参与:OLMo 2 的发布因其开放性而受到赞誉,包括 7B 和 13B 规模在内的所有模型均可在 Hugging Face 上获取。社区赞赏该项目的完全开源性质,认可其透明的训练数据、代码和方案(recipes)。

- 未来发展与社区互动:OLMo 团队正积极与社区互动,讨论潜在的更大模型(32B 或 70B),并正在进行将 Molmo recipe 应用于 OLMo 2 权重的实验。团队还在 Hugging Face 上分享了 Molmo 的训练数据链接。

Other AI Subreddit Recap

/r/Singularity, /r/Oobabooga, /r/MachineLearning, /r/OpenAI, /r/ClaudeAI, /r/StableDiffusion, /r/ChatGPT

主题 1. 视频生成工具对比:Sora vs Veo2 vs Minimax

- Pov trying to use the $200 version of Sora… (Score: 164, Comments: 47): 该帖子缺乏具体内容或上下文来进行详细总结,因为标题仅提到了 200 美元版本的 Sora,未做进一步阐述。

- 讨论重点关注 AI 模型中的内容过滤问题,用户对非性内容触发的政策违规表示沮丧。一些人认为过滤系统过于严格,特别是在描绘女性方面,并质疑当前内容审核方法的有效性。

- 用户讨论了 hailuoai.video 和 minimax 等视频生成替代方案,并比较了它们的功能和效果。Veo2 因其卓越的效果而受到关注,尽管由于候补名单限制,访问权限有限;hunyuan video 也被提及为一个强有力的竞争对手。

- 用户讨论了 AI 训练中的版权悖论,指出允许模型使用受版权保护的材料进行训练,却限制生成与其相似的输出,这存在不一致性。此外,还提出了对内容拒绝率高以及为了避免负面宣传而可能增加限制的担忧。

主题 2. GPT-4o:优于 GPT-3.5 的高级推理能力

- Clear example of GPT-4o showing actual reasoning and self-awareness. GPT-3.5 could not do this (Score: 112, Comments: 74): 该帖子讨论了 GPT-4o 在高级推理和自我意识方面的能力,指出这些功能是对 GPT-3.5 的改进。帖子正文未提供具体示例或上下文。

- 讨论指出,GPT-4o 识别和解释模式的能力并不代表推理,而是增强了的模式识别。评论者强调,模型识别“HELLO”等模式的能力归功于其训练和 tokenization 过程,而非任何形式的自我意识或推理。

- 包括 Roquentin 和 BarniclesBarn 在内的几位评论者解释说,模型的表现归功于 tokenization 和 embeddings,这使其能够在没有明确指令的情况下识别模式。这与模型基于先前上下文预测下一个 token 的设计相一致,而不是展示真正的推理或内省。

- 对话还涉及了将 “HELLO”模式作为测试的局限性,建议使用不明显的模式可以更好地展示推理能力。ThreeKiloZero 等人认为,模型庞大的训练数据集和多参数结构使其能够匹配模式而非推理,这表明上下文和训练数据在其回答中具有重要性。

AI Discord 摘要回顾

由 o1-2024-12-17 生成的摘要之摘要的摘要

主题 1. 性能风云与降速风波

- DeepSeek 性能下滑:用户抱怨 DeepSeek v3 的 TPS 降至 0.6,引发了对服务器扩容的呼声。他们密切关注状态页面寻找缓解迹象,但许多人仍渴望更快的模型。

- Windsurf 与 Cascade 额度冲突:用户发现 Windsurf 中的内部错误消耗了额度,导致混乱。尽管有自动化保证,扣费仍在继续,引发了大量关于退款的沮丧帖子。

- ComfyUI 幕后机制:SwarmUI 运行在 ComfyUI 的后端以实现用户友好的渲染,而像 Omnigen 或 SANA 这样的竞争方案则相对落后。粉丝们称赞 LTXVideo 和 HunyuanVideo 能以极小的质量损失实现极速的视频生成。

主题 2. 额度紧缩与成本困惑

- 60 万美元模型训练的账单冲击:工程师们分享了训练大模型时令人咋舌的 GPU 账单,其中 7B 参数模型的成本约为 8.5 万美元。他们讨论了更便宜的托管方案,如 RunPod 以及来自 LoQT 论文 的低秩适配器。

- 支付问题困扰 API 用户:OpenRouter 的信用卡被拒以及 Perplexity 的订阅异常引发了混乱。一些人通过更换卡片或清除缓存解决了问题,但烦恼情绪仍在蔓延。

- Flex 与 Premium 额度:多个社区抨击了使用上限和额度无法结转的问题。为未使用的 Token 付费或处理“内部错误”会话,促使人们呼吁更透明的方案。

主题 3. 模型首秀与微调热潮

- Sonus-1 大放异彩:其 Mini、Air、Pro 和 Reasoning 变体因 2025 年先进的文本生成能力引发热议。一则 推文 展示了结合 Aider 与 Sonus mini 模型实现的快速代码输出。

- Swarm 库加入 NPM:这个 TypeScript 多 Agent AI 库宣称拥有超越 OpenAI Swarm 的协同效应,因其模块化设计赢得赞誉。其他人则将希望寄托在 ICML 2025 的 PersonaNLP 上,专注于基于人格的 NLP 任务。

- Qwen2-VL 与 Llama 3.1 引发微调热:社区正在努力解决视觉适配器部分缺失或失效的问题,而 Llama 3.x 和 SmallThinker-3B 性能飙升。人们还在使用 Unsloth、Axolotl 或 Hugging Face Transformers/PEFT 进行自定义任务微调。

主题 4. 工具的突破与摩擦

- GraphRAG 与 Graphrag 占据头条:新的检索增强生成策略激发了人们对代码和文本任务的兴趣。讨论涵盖了多检索器设置和加权向量以改进查询结果。

- 发票 Agent 与 K-Summary 测试版:LlamaIndex 展示了自动对发票进行支出类别和成本中心分类的功能,而韩国市场的新摘要工具也吸引了测试者。用户对 Torchtune 中的分块交叉熵和内存友好方法赞不绝口。

- AI 编程热潮:Codeium、Cursor 和 Aider 社区在应对随机代码更改、Linting 狂热和受限的套餐等级。尽管感到沮丧,许多人仍称赞更快的开发周期和更一致的代码建议。

主题 5. 硬件、VRAM 与 HPC 探索

- RTX 50xx VRAM 争议 让工程师们怀疑 NVIDIA 人为限制了显存。他们思考更大的 VRAM 还是巧妙的内存卸载(offload)方案才是真正的出路。

- Torch.compile 令人头疼:用户在 Inductor 缓存、Flash Attention 中的动态分支以及棘手的 Triton 内核调用方面遇到了严重的降速。他们测试了环境黑客手段以规避段错误(segfaults),希望官方补丁能解决编译混乱。

- 1-bit LLM 热潮:BitNet 关于三值权重和大幅削减资源的讨论令 HPC 爱好者感到兴奋。一些人赌这些低比特突破将在不牺牲模型准确性的情况下大幅削减训练账单。

第一部分:高层级 Discord 摘要

Codeium (Windsurf) Discord

- Windsurf 的动荡困扰:许多成员报告了 Windsurf 的重大性能问题,理由是频繁的内部错误和运行缓慢,并引用了这条关于将 Figma 设计变为现实的推文。

- 他们还观察到 Claude 3.5 Sonnet 在会话中途性能下降,尽管 Plan Settings 中有官方免责声明,但仍导致了意外的额度消耗。

- Cascade 额度争议:社区讨论集中在 Cascade 甚至在操作失败时也会扣除额度,重复的“内部错误”消息导致了困惑。

-

几位用户声称,尽管有自动保证,这些扣费仍然存在,促使一些人通过 [Support Windsurf Editor and Codeium extensions](https://codeium.com/support) 进行申诉。

-

- DeepSeek v3 与 Sonnet 3.6 的对决:尽管基准测试声称如此,一些人认为 DeepSeek v3 不如 Sonnet 3.6,更倾向于使用 Gemini 等免费替代方案。

- 他们对 DeepSeek 的真实优势表示怀疑,而其他人则引用 Things we learned about LLMs in 2024 以获取更多数据。

- Windsurf 中的代码编辑混乱:用户提到了随机的代码更改和未完成的任务,要求提供更清晰的解决方案以保持 AI 工作流的连续性。

- 许多人诉诸于将指令保存在外部文件中,然后重新加载它们以保持对话不偏离轨道。

- 额度系统怨言:成员批评了 Premium 和 Flex 额度结构,抱怨使用上限和未能结转的问题。

-

他们敦促建立更公平的分配模型,据报道通过电子邮件和 [Support Windsurf Editor and Codeium extensions](https://codeium.com/support) 取得的效果参差不齐。

-

aider (Paul Gauthier) Discord

- Sonus-1 登台亮相:新推出的 Sonus-1 系列(Mini, Air, Pro, Reasoning)在一篇博客文章中发布,重点关注 2025 年的高级文本生成能力。

- Rubik’s AI 的一条推文强调了 mini 模型中快速的代码生成,引发了关于与 Aider 协同作用的讨论。

- Deepseek 在重载下步履蹒跚:社区成员观察到 Deepseek 降至 1.2 TPS,引发了对服务器容量和可靠性的投诉。

- 其他人证实 Deepseek Chat v3 仍可通过

--model openrouter/deepseek/deepseek-chat访问,但质疑是否需要更多服务器。

- 其他人证实 Deepseek Chat v3 仍可通过

- OpenRouter 的 API Key 困惑:一些人在使用 OpenRouter API 时遇到了身份验证难题,怀疑配置文件中的密钥放置不正确。

- 一位用户通过仔细检查模型设置确认成功,建议社区注意 YAML 中隐藏的空格。

- Tailwind 和 Graphrag 备受关注:成员们探索将 Tailwind CSS 文档上下文添加到 Aider 中,建议复制或索引相关信息以便快速参考。

- 微软的 Graphrag 工具也作为 RAG 替代方案出现,激发了对更高效 CLI 实现的兴趣。

- Aider 愿望清单扩大:用户请求切换类定义和先验上下文以优化代码编辑,旨在减少无关建议。

- 他们还设想了对命令提示符更好的控制,将高级上下文管理视为首要的下一步。

Unsloth AI (Daniel Han) Discord

- OpenWebUI 导出扩展了数据集视野:成员们讨论了从 OpenWebUI 导出聊天 JSON 以创建数据集,并参考了所有者的格式建议。

- 他们强调了与 vLLM 等本地推理设置的潜在协同效应,指出将结构良好的数据与先进的推理相结合可以改善训练结果。

- Ollama 量化困惑:围绕 Ollama 的模型量化出现了挑战,用户注意到默认的 GGUF 文件以 FP16 运行。

- 与会者建议进行手动调整,并指向 mesosan/lora_model config 以寻求潜在解决方案。

- 分类任务的微调热潮:社区成员推荐将 Llama 3.1 8B 和 Llama 3.2 3B 用于中等复杂度的任务,并称其在分类任务中表现良好。

- 他们强调使用 RTX 4090 等 GPU 硬件,并指出 Unsloth 的文档 中关于高效微调的技巧。

- 复旦大学专注于 O1 复现:最近的一份 复旦报告 深入报道了 O1 复现工作,详见这篇论文。

- 一位成员称赞其为迄今为止最详尽的资源,引发了对 O1 项目后续步骤的兴趣。

- Process Reinforcement 暗示代码发布:Process Reinforcement 论文因其关于隐式奖励的思想而受到关注,尽管许多人对缺乏代码表示遗憾。

- 社区成员对代码即将发布保持乐观,将其描述为值得关注的 进行中工作 (work in progress)。

Cursor IDE Discord

- DeepSeek V3 模型的隐私谜题:成员们对 DeepSeek V3 可能存储代码并在私有数据上进行训练表示担忧,强调了隐私问题以及在用户项目中的不确定收益。

- 他们质疑个人和企业的风险,辩论该模型的优势是否足以证明其可能的数据保留方式是合理的。

- Cursor 大幅缩减开发时间:一位用户分享了一个成功的案例,使用 Cursor 配合 SignalR 在远短于预期的时间内完成了一个项目。

- 其他人也纷纷给出正面反馈,指出 AI 驱动的工具如何帮助他们更自信地应对复杂的开发任务。

Nous Research AI Discord

- Swarm 入侵 NPM:新发布的用于 multi-agent AI 的 Swarm library 已上线 NPM,提供了超越 OpenAI Swarm 的协作系统高级模式。它采用 TypeScript 构建,具有模型无关 (model-agnostic) 的设计,且在一天前刚刚更新。

- 社区成员赞扬了其模块化结构,称其为迈向 灵活多智能体 (flexible multi-agent) 协同的大胆一步,在性能上可能超越旧框架。

- PersonaNLP 为 ICML 2025 做准备:计划中的 ICML 2025 PersonaNLP 工作坊正在征集论文和共享任务,重点关注语言建模中以用户为中心的方法。组织者正公开与有兴趣改进基于角色的 NLP 方法的研究人员进行协调。

- 参与者建议开设专门频道进行更深入的协作,并表达了增强工作坊范围的热情。

- 巨型模型成本飙升:最近的讨论显示,模型训练 账单已达到 $600,000,Hacker News 帖子和 Moin Nadeem 的推文也强调了这一点。成员们指出,仅一个 7B 模型在商业 GPU 上的成本就约为 $85,000。

- Hermes 数据困境:社区成员发现 Hermes 中没有针对某些成人场景的显式训练数据,推测这种遗漏可能会限制模型的更广泛能力。他们质疑缺乏此类数据是否会限制知识的广度。

- 有人声称跳过这些数据点会移除潜在的关键细微差别,而其他人则认为这是为了获得更简单的模型输出而进行的合理折中。

- Llama 权重分析:分析师在 Llama2 的 K 和 Q 权重中发现了意想不到的振幅模式,暗示 Token 的重要性不一致。他们分享的图像表明权重在表示关键特征时存在部分冗余。

- 成员们讨论了专门的微调或 Token 级门控 (token-level gating) 作为可能的补救措施,强调了改进 Llama2 架构的新角度。

LM Studio Discord

- Extractor.io 的消失之谜:一位用户发现 Extractor.io 似乎已不复存在,尽管有这个精选 LLM 列表作为替代方案,但仍引发了困惑。

- 其他人对这种突然消失表示质疑,一些人认为它可能合并到了不同的域名或进行了品牌重塑。

- LM Studio 仅限文本:社区成员确认 LM Studio 专注于大语言模型(LLM),无法生成图像。

- 他们建议使用 Pixtral 处理图片任务,并指出它依赖于 MLX Engine,且仅在特定硬件上运行。

- 没有视觉能力的 Qwen2-VL:爱好者们观察到 Qwen2-VL-7B-Instruct-abliterated 由于缺少 vision adapter(视觉适配器),无法处理图像。

- 他们强调,对基础模型进行 proper quantization(正确量化)对于充分发挥其文本能力的优势至关重要。

- 用整个互联网进行训练?:一位用户提出了将所有互联网数据喂给 AI 的想法,但许多人指出,庞大的规模和低劣的数据质量是潜在的陷阱。

- 他们强调 bad data(坏数据)会损害性能,因此 quality(质量)必须胜过单纯的数量。

- 通过 GPU Offload 加速任务生成:本地 LLM 粉丝利用 GPU 支持来加速使用 Llama 3.1 生成任务的过程,并获得了更好的响应效果。

- 他们建议选择启用 GPU 的模型并观察 Task Manager(任务管理器)指标,并提到了在 4070 Ti Super 配置下的成功案例。

Notebook LM Discord Discord

- AI 中的多语言尝试:爱好者们通过编写创意 Prompt,在非英语环境下测试了 audio overviews(音频概览),在语言扩展方面取得了部分成功。

- 他们报告称翻译质量参差不齐,并建议使用更好的 language-specific models(特定语言模型)来解决这些差距。

- K-Summary Beta 引起关注:一位用户推广了一款在韩国市场迅速崛起的全新 AI summarization(AI 摘要)产品,为 Beta 测试人员提供了体验精简摘要的机会。

- 几位社区成员表示渴望将其与现有的摘要工具进行对比,以实现更快的文本处理。

- 自定义功能引发辩论:成员们担心 adjusting system prompts(调整系统提示词)可能会暴露绕过常规 AI 限制的方法。

- 他们辩论了创作自由与 AI 安全使用之间的界限,权衡了潜在收益与滥用风险。

Stackblitz (Bolt.new) Discord

- Bolt 为 Web 应用引入 AI 逻辑:一位成员分享了在他们的 Bolt Web 应用中集成 logic/AI 的计划,在赞扬视觉效果的同时表示需要更强的功能,并参考了 BoltStudio.ai。

- 他们征求了将代码驱动的工作流与 AI 模块合并的策略,并提到增量升级和本地测试是可行的前进方向。

- Supabase 简化 Bolt 中的邮箱登录:开发者们称赞了 Supabase 邮箱身份验证在基于 Bolt 的应用中的表现,强调了使用 local storage 来管理用户角色。

- 他们指向 StackBlitz Labs 以实现前端与灵活后端的桥接,同时也承认关于 Bolt 的 token 使用情况仍存在争议。

Perplexity AI Discord

- O1 对阵 ChatGPT:Perplexity 的强力搜索:Perplexity O1 引发了褒贬不一的反应,一些人抱怨每日 10 次搜索的限制并称其为麻烦,而另一些人则认为它在以搜索为中心的任务中大有可为。

- 与 ChatGPT 的对比中,Opus 因其无限使用和超长上下文而受到称赞,如这条推文所述。

- Grok 的收获或抱怨:尽管成本较低,一些人仍称 Grok 为他们用过的“最差模型”,引发了关于模型可靠性的辩论。

- 另一些人则吹捧 3.5 Sonnet model 表现更强,暗示用户忠诚度正在发生转移。

- Perplexity 的 UI 大改与订阅:最近的 UI 更改增加了股票和天气信息,促使一位用户清理缓存以避开恼人的首页元素。

- 成员们在 AravSrinivas 的推文中讨论了无限查询和省钱方案,展示了多样化的订阅选择。

- 令人印象深刻的 2025 年 AI 面试题:一份分享的指南概述了应对 2025 年棘手 AI 问题的方法,详情见此链接。

- 参与者认为,充分的准备对于在招聘环境中保持竞争力至关重要。

- 基于欧洲的 API 和 1.5B-Token 聊天机器人的愿景:一位用户期待与 pro search 速度相匹配的欧洲服务器,以支持性能更佳的 1.5B-token 聊天机器人。

- 他们认为这种集成将增强聊天机器人的实用性,特别是对于大规模 token 的使用。

OpenRouter (Alex Atallah) Discord

- OpenRouter 的身份验证困扰:多位用户在尝试请求时遇到了 ‘Unauthorized’ 错误,即使在 OpenRouter 账户有余额且 API key 正确的情况下也是如此。他们报告称更改了 HTTPS 地址并调整了证书,但仍未解决。

- 一些人推测问题可能涉及 n8n 配置不匹配或连接问题,并指出手动调整 URL 设置仍然失败。

- DeepSeek 令人恐惧的拖累:社区成员抱怨 DeepSeek v3 的速度仅为 0.6 TPS,导致响应缓慢。DeepSeek 服务状态页面显示需求量巨大且可能存在扩容不足。

- 他们担心使用量已超出目前的预测,呼吁在更广泛推广之前提升容量。

- 结构化输出寻求救星:一位用户希望寻找 gpt-4-mini 的替代方案来处理 JSON 格式的回复,但在目前的阵容中发现选择有限。其他人建议使用 Gemini Flash,并指向 LiteLLM 以在统一界面中处理多个 API。

- 他们注意到了潜在的速率限制约束,并建议监控使用指标,同时参考了 RouteLLM 作为跨模型路由请求的另一种解决方案。

- Janitor AI 加入 OpenRouter:成员们讨论了如何将 Janitor AI 与 OpenRouter 关联,重点关注 API 端点的高级设置。他们概述了切换某些身份验证字段并匹配代理 URL 以实现协同使用。

- 分享了各种配置,结论是正确的 URL 对齐和 token 处理使集成变得无缝。

- 信用卡被拒,付款失败:一些用户在尝试通过 OpenRouter 付款时发现信用卡支付失败,尽管不同的卡有时可以正常工作。一位用户指出 Capital One 卡存在持续问题,而第二张卡则处理成功。

- 他们考虑了特定银行的规则或 OpenRouter 支付网关的特性,建议受影响的用户尝试多种计费方式。

Stability.ai (Stable Diffusion) Discord

- SwarmUI 凭借 ComfyUI 飞速发展:成员们解释了 SwarmUI 如何利用 ComfyUI 的后端在保持相同性能的同时提供更简洁的 UI,强调了其易用性和强大的功能。

- 他们还重点介绍了一个 Stable Diffusion Webui Extension,该扩展可以简化模型管理,引发了关于提升工作流效率的前端讨论。

- SANA 与 Omnigen 的空间对决:社区测试了 SANA 在小型硬件上的快速推理能力,并将其与速度较慢且图像质量有时逊于 SDXL 的 Omnigen 进行了对比。

- 爱好者们质疑 SANA 是否值得占用 HDD 空间,尤其是当 Flux 可能提供更好的模型性能时。

- LTXVideo 与 HunyuanVideo 全速前进:LTXVideo 因在新 GPU 上渲染速度更快且质量几乎无损而获得赞誉,超越了旧的视频流水线。

- 与此同时,HunyuanVideo 引入了更快的步数(steps)和更好的压缩技术,激发了人们对近期视频生成领域进展的热情。

- Flux Dev 在图像生成文本需求中表现出色:成员们认为 Flux Dev 是在图像中嵌入文本的顶级开源模型,足以与 Ideogramv2 和 DALL-E 3 等闭源方案竞争。

- 他们还提到 Flux 1.1 Ultra 是输出清晰文本的“最佳闭源模型”,并引用了用户测试和并排对比结果。

- GPU 收益与内存必备要求:爱好者们建议在 AI 任务中使用 RTX-series 显卡,并建议等待可能进一步降价的新品发布。

- 他们强调至少需要 32GB RAM 和充足的 VRAM 才能保证图像生成的流畅性,并突出了稳定性方面的优势。

Eleuther Discord

- RTX 50xx VRAM 限制引发热议:工程师们讨论了 RTX 50xx 系列中传闻的 VRAM 限制,怀疑 NVIDIA 人为限制显存以避免产品线重叠。

- 一些人质疑增加的 GB 容量对 AI 任务是否重要,表达了对潜在性能瓶颈的沮丧。

- VRAM vs. RAM:内存大混战:多位参与者主张将 VRAM 重新分类为 L3 Cache,并指出在某些场景下,普通 RAM 的速度可能比 VRAM 慢 4 倍。

- 其他人思考了在 VRAM 和 RAM 之间进行指令流水线化的可能性,并警告称任何不匹配都可能阻碍大规模模型推理的吞吐量。

- 高阶 Attention 带来新变革:研究人员探索了 attention on attention 技术,参考了 Quartic Transformer 中的扩展,并将其与 Mamba 或 SSM 风格的卷积联系起来。

- 他们将这些想法与 ring attention 联系在一起,引用了第二篇论文中更大的上下文窗口,并指出了可能的线图(line-graph)或超图(hypergraph)平行关系。

- HYMBA 阻击 SWA:社区成员认为 HYMBA 在某些层混合全注意力(full attention)可能会削弱 SWA 或 SSM 背后的效率收益。

- 他们权衡了更强大的跨窗口表示与额外开销之间的利弊,指出实际的性能提升仍需进一步测试。

- Pytorch Flex Attention Bug 依然存在:一些用户报告了 Pytorch 的 Flex Attention 持续存在问题,这阻碍了实现复杂注意力模式的尝试。

- 他们发现

torch.compile经常与一些较少使用的模型特性发生冲突,迫使他们在修复方案出台前退回到标准的 attention 层。

- 他们发现

Latent Space Discord

- 2024 LLMs & Image Generation Gains:即将发布的文章 LLMs in 2024 聚焦了 Large Language Models 在 2024 年的重大飞跃,包括 multimodal(多模态)扩展和激烈的价格竞争。社区还注意到生成式图像带来的 meme culture(迷因文化)趋势,这些图像将普通人变成了喜剧性的“bro”,并赋予了 Santa(圣诞老人)一个严肃的形象。

- 成员们认为这些跨领域的突破促进了更广泛的创意应用,并强调了新指标如何推动 LLM 性能边界。他们还观察到成本降低和易于访问的 API 加速了小型项目的采用。

- Text Extraction Throwdown:一项 基准研究 测试了使用各种库解析 regulatory document(监管文档)的效果。贡献者们特别指出 pdfium + tesseract 组合在处理棘手的数据提取任务中表现出色。

- 他们强调,这些解决方案比单机 OCR 或 PDF 解析工具能更好地处理现实世界的复杂性。一些人认为工作流集成是构建稳健文本流水线的下一个重要步骤。

- SmallThinker-3B’s Surging Stats:Hugging Face 上新的 SmallThinker-3B-preview 在多项评估中超越了 Qwen2.5-3B-Instruct。这款紧凑型模型针对资源受限的场景,但在基准测试分数上显示出显著飞跃。

- 它对边缘友好型占用的强调拓宽了实际应用场景,在较小的占用空间与强大的性能之间架起了桥梁。一些参与者怀疑这些改进源于专门的微调和数据策化。

- OLMo2’s Outstanding Outline:OLMo2 技术报告 长达 50 多页,详细介绍了 LLM development 流水线中的四个关键组件。它对数据处理、模型架构、评估和部署策略进行了深入分解。

- 读者称赞其直接揭示现实世界经验的做法,突出了可重复和可扩展训练的最佳实践。该报告鼓励开发者以更深的技术清晰度来优化现有工作流。

- Summit & Transformers Tactics:仅限受邀参加的 AI Engineer Summit 在 10:1 的申请比例下回归,旨在展示 AI engineering 的新突破。组织者回顾了 3000 座 世博会规模的成功,吸引了超过 100 万 在线观看。

- 与此同时,来自 此资源 的 Understanding Transformers 综述为学习 self-attention 和现代架构变体提供了一条结构化路径。峰会策划者鼓励为推动社区知识进步的高级讲解内容提供客座发布机会。

GPU MODE Discord

- GPU GEMM Gains:一位用户指出 GPU 上实际与理论 GEMM 性能之间存在差异,引用了 Notion 上的文章和相关的 Twitter 帖子。

- 他们暗示,宣布“最佳性能”可能会激发社区提供更先进的解决方案。

- Triton Tuning Troubles:据报道,移除 TRITON_INTERPRET 可以大幅提升 Triton kernel 的性能,尤其是在矩阵乘法任务中。

- 其他人证实,将 batch size 设置为 16 或更多,并针对大输入调整浮点容差,可以缓解 kernel 调用问题。

- The Flash br/bc Dilemma:一位用户询问在 Flash Attention 中使用动态 br/bc 以获得更好的适应性,但其他人坚持认为固定尺寸要“快 10 万亿倍”。

- 他们建议像 Flash Attention 那样编译多个版本,旨在平衡速度与更灵活的参数。

- Torch Inductor Cache Letdown:一次讨论涉及 Inductor 缓存加载时间过长的问题,即使使用基于 Redis 的远程缓存,加载时间也达到了 5 分钟。

- 他们怀疑编译后的 kernel 加载仍然会导致延迟,这促使人们对内存使用和激活需求进行额外审查。

- P-1 AI’s Radical AGI Push:P-1 AI 正在招聘 artificial general engineering(通用人工智能工程)计划的人员,开放职位见此。

- 他们的核心团队成员来自前 DeepMind、Microsoft、DARPA 等,旨在利用 multimodal LLMs 和 GNN 增强物理系统设计,处理曾经被认为不可行的任务。

Interconnects (Nathan Lambert) Discord

- LoRA 库之争:TRL 胜过 Unsloth:#ml-questions 频道对 LLM 微调工具的优劣展开了辩论,称赞 TRL 详尽的文档,同时认为 Unsloth 过于难用,并引用了 LLM 微调库对比。

- 尽管 Unsloth 拥有 2 万个 GitHub Star,但成员们更推荐使用 Hugging Face 的 Transformers/PEFT,以及 Axolotl 和 Llama Factory 来进行更简单的 LoRA 微调。

- 门控游戏:MoE 与 OLMoE:#ml-questions 的成员询问了关于 Mixture of Experts 的门控网络,特别是 Deepseek v3 中使用的路由机制。

- 一位用户推荐了 OLMoE 论文,强调其较少的专家数量使复杂性保持在可控范围内。

- 2 万人规模的预录教程之争:在 #random 频道,社区讨论了是否应向 2 万名观众分享预录教程,并强调这些演讲已获得好评。

- 另一位用户开玩笑地将 UK AI Safety Institute 称为“情报特工”,而其他人则注意到 LinkedIn 在 AI 圈子中的竞争性。

- 苦涩的教训与 Felix 的遗产:在 #reads 频道,成员们哀悼 Felix 的逝世,他是 The Bittersweet Lesson 的作者,给社区留下了深刻印象。

- 他们讨论了通过 PDF 备份来保护他的作品,担心注销的 Google 账号可能会中断未来的访问。

- SnailBot 的迟缓恶作剧:在 #posts 频道,SnailBot 引发了笑声,用户称其为“一只慢吞吞的蜗牛”,并对其性能惊呼“天哪”。

- 它喜剧般的节奏娱乐了许多人,大家觉得它那蜗牛般的一致性名副其实。

OpenAI Discord

- FLUX.1 [dev] 助力新鲜图像生成:成员们重点介绍了 FLUX.1 [dev],这是一个用于文本到图像合成的 12B 参数 rectified flow transformer,引用了 Black Forest Labs 的公告。

- 他们指出其质量仅次于 FLUX.1 [pro],并包含用于科学研究的 open weights(开放权重),反映出社区对实验的热情。

- ChatGPT 搜索可靠性备受关注:一位用户询问 ChatGPT 是否能处理实时网络结果,并将其与 Perplexity 等专业工具进行了对比。

- 社区反馈表明,该模型可能会受到数据更新的限制,一些人更倾向于使用外部搜索解决方案来弥补信息缺失。

Cohere Discord

- Cohere 闪亮发布 Rerank-3.5:成员们以热情的祝福迎接新的一年,期待 rerank-3.5 很快在 Azure 上部署,为高级文本处理提供下一代排序器。

- 对话包括了对潜在用例的询问,有人问 “到目前为止你觉得它怎么样?”,突显了社区对提升性能的见解的渴望。

- Embedding 速率限制提升与最佳实践:用户探索了通过联系 Cohere support 来申请提高 embedding rate limits 的流程,旨在处理更繁重的工作负载。

- 社区成员概述了现有的 API 限制:试用版每分钟 100 次请求,生产版每分钟 2,000 次请求,强调应高效使用以避免超限。

Torchtune Discord

- Torchtune 势头强劲:社区成员称赞 Torchtune 在多个 AI 模型中得到了更广泛的应用,并强调了一种衡量性能的方法。

- 一位用户建议探索 transformer module 的替代评估方法,以获得更好的见解。

- Chunked Cross Entropy 提升内存效率:Chunked cross entropy 通过拆分计算来减少内存使用,如 PR #1390 所示。

- 其中一个变体使用了 log_softmax 而不是

F.cross_entropy,引发了关于性能和内存优化的讨论。

- 其中一个变体使用了 log_softmax 而不是

- A6000 上的 Flex Attention 寻求变通方案:成员们在 A6000 上遇到了 PyTorch Torchtune 的 bug,发现通过

torch.compile()设置flex_attention_compiled可以实现内核变通。- 他们提议使用环境变量的方法,并警告说 2.6.0 版本中是否会有永久修复尚不确定,参考 Issue #2218。

LlamaIndex Discord

- 使用 LlamaParse 的发票智能:最近的一个 Notebook 演示展示了一个自定义的发票处理 Agent,它利用 LlamaParse 实现流畅的工作流,自动对支出类别和成本中心进行分类。

- 成员们强调了自动化在减少人工错误和加速财务相关任务方面的作用,并参考了该 Agent 更高效地处理发票流水线的方法。

- 数据存储的简单 JSON 方案:社区成员讨论了将 LLM 评估数据集存储在 S3、Git LFS 或本地 JSON 文件中的方案,强调了极低的开销和简单的结构。

- 他们建议对大型 JSON 数据进行压缩,并推荐使用 Pydantic 进行快速集成,同时指出选择 SQL 还是 NoSQL 取决于数据集的大小。

- 多检索器融合难题:一位用户将 2 个向量嵌入(vector embedding)检索器与 2 个 BM25 检索器结合使用,但报告称这种融合设置的查询结果较差。

- 讨论指向了通过调整权重、索引或重排序(re-ranking)策略来提升混合检索方法响应质量的方向。

OpenInterpreter Discord

- Open Interpreter 表现不佳但获得认可:用户批评 Open Interpreter 1.0 的表现不如经典版本,缺少代码执行和网页浏览功能,并分享了 GitHub 上的 OpenInterpreter 作为参考。他们还强调了来自 OpenProject、Rasa 和 Kotaemon 的重要开源贡献。

- 参与者强调了文本格式损坏和搜索工具缺失的问题,但仍赞扬开源社区推动了新功能的开发。

- 安装步骤简化设置:出现了针对 Mac、Windows 和 Linux 的 Open Interpreter 单行安装流程,可实现快速的 Web UI 体验。好友们证实该方法简化了安装后的命令执行。

- 好奇的用户在 #general 频道测试了该设置,确认这免去了他们手动配置环境的麻烦。

- WhatsApp 笑话与对全天候交易工具的需求:一位用户尝试了 网页版 WhatsApp 消息发送,开玩笑说这给乏味的文字聊天注入了活力。这次交流促使其他人分享了个人技术驱动的日常生活经验。

- 另一场讨论集中在对全天候交易点击器的需求上,暗示需要一种永不休眠的操作系统级解决方案来持续执行命令。

Modular (Mojo 🔥) Discord

- 对 Mojo 链表的渴望:有人请求一个能在 nightly 版本上运行的链表(linked list)代码库,凸显了在 Mojo 生态系统中对快速访问数据结构的渴望。

- 贡献者们就高效的原型设计发表了意见,并建议将极小的开销作为精简探索的关键动力。

- 使用 Mojo 打造 CLI 和 TUI 工具:一位开发者展示了他们在 Mojo 中构建 CLI 和 TUI 库的学习过程,为命令行爱好者开发了新的实用工具。

- 其他人开玩笑说要打造一个新的 Mojo Shell,模仿 bash 和 zsh,进一步增强了社区对深度终端集成的热情。

- AST 探索与调试风波:成员们分享了他们在

RootAstNode和DisplayAstNode等索引风格树上的成功经验,但在使用 Mojo 调试器时遇到了段错误(segmentation faults)。- GitHub issue #3917 记录了在 –debug-level full 下的这些崩溃,引发了关于复杂递归结构的激烈交流。

LLM Agents (Berkeley MOOC) Discord

- 1 月份 LLM Agents 证书的喜讯:成员们根据最新更新确认,LLM Agents MOOC 的证书将于 1 月底颁发。

- 他们建议大家保持关注以获取更多详情,并引导感兴趣的学习者访问 2025 春季注册页面。

- 2024 秋季落幕,2025 春季招手:2024 秋季的入学现已关闭,失去了获得该学期证书的机会。

- 成员们鼓励通过提供的表格加入 2025 春季课程,并提到课程大纲即将迎来改进。

DSPy Discord

- Gemini 的 GraphRAG 进展:一位用户询问是否使用了特定的 GraphRAG 方法,结果发现 Gemini 调整了针对代码相关实体的默认提示词,以增强提取效果。

- 他们指出,这种方法可以提高实体提取步骤的清晰度,重点在于优化 DSPy 的功能。

- 赠与者博弈(Donor’s Game)的深入探索:一名成员使用 DSPy 对博弈论中的 Donor’s Game 进行了模拟,以复制多代之间重复的策略升级。

- 他们引用了 一个 GitHub 仓库,该仓库实现了《LLM Agents 间的合作文化演进》(Cultural Evolution of Cooperation among LLM Agents)中的方法,探索鼓励 LLM agents 之间合作行为的方式。

tinygrad (George Hotz) Discord

- tinygrad 对 Windows 的支持:一名成员询问 tinygrad 是否接受 Windows Bug 修复的 Pull Request,并强调了在 Windows 并非主要关注点的情况下支持该系统的挑战。

- 另一名成员推测,如果这些修复能保持一致性和稳定性,将会受到欢迎,这表明了对跨平台扩展持谨慎但开放的态度。

- Shapetracker 深度解析:一名成员赞扬了 tinygrad 文档的详尽性,并引用了 tinygrad-notes 博客 以获取更深入的见解。

- 他们寻求关于基于

Shapetracker的矩阵内存中索引和步长(stride)计算的细节,并请求相关参考资料以澄清底层原理。

- 他们寻求关于基于

MLOps @Chipro Discord

- WandB 与 MLflow 的长跑:许多人注意到 Weights & Biases 提供托管服务,而 MLflow 可以自行托管以获得更多控制权。

- 两个平台都能有效地追踪机器学习实验,团队的选择取决于成本和对工作流所有权的期望。

- 数据日志的妙用:一些人提到将实验结果存储在 Postgres 或 Clickhouse 中,作为基础版本控制的备选方案。

- 他们一致认为,在无法使用专门平台时,这是一种务实的路线。

- 经典机器学习(Classical ML)的现状:一位用户质疑在 LLM 时代,经典机器学习(如推荐系统和时间序列)是否正在淡出。

- 其他人持反对意见,认为尽管 LLM 备受关注,但这些领域仍然至关重要。

- BitNet 进军 1-bit 领域:关于 BitNet 的近期研究展示了 1-bit LLMs 在降低资源需求的同时,性能可媲美全精度模型。

- 研究人员引用了 这篇论文,描述了三值权重(ternary weights)如何实现更廉价且高效的硬件支持。

Nomic.ai (GPT4All) Discord

- AI 阅读器:低成本笔记本电脑的 PDF 问答:一位在非洲构建低成本系统的用户希望开发一种 AI 阅读器,在访问 PDF 时打开聊天 GUI,以帮助学生进行测试和内容理解,并正在探索 Nomic embed 的用法。

- 他们计划在本地硬件上处理内容 embeddings,并询问如何提供实时的模拟考试反馈,同时强调要最小化重新索引(re-indexing)的开销。

- 动态领域的内权威性排名:一位参与者建议以一种随 计算机科学 演进而变化的方式来衡量教育材料的权威性。

- 他们担心频繁重新索引带来的性能开销,提出了一种更灵活的方法来保持数据的时效性。

- 在搜索中提升学生成绩单的权重:贡献者建议给 学生成绩单 增加额外权重,以在内容检索中反映个人的学术成长。

- 他们认为更个性化的索引方法是下一个转变方向,让个人能够更精确地追踪学习成就。

- 按学科索引以增强资源控制:用户提出了一种专注于 学科 而非单一参考资料(如书籍)的索引系统,旨在包含补充文章和笔记。

- 他们认为这种方法能更好地覆盖知识盲点,并为备考提供更直接的资源选择。

LAION Discord

- Blender 与 AI 在 3D 领域的结合:在 #general 频道中,有人询问关于利用 AI 驱动与 Blender 协作进行高级 3D 标注的问题,并提到了社区中的协同效应。

- 他们正在寻找合作伙伴来扩展 Blender 的功能,旨在将 AI 更深层地集成到基于几何的任务中。

- 脑电波与动物趣谈:一位参与者提到了利用 Animals and EEG 进行 语言/动作映射 (language/action mapping),寻找探索 AI 和神经科学在动物研究中应用的团队。

- 他们希望通过 EEG 数据解码 动物行为,这预示着生物启发式实验可能迎来新浪潮。

- YoavhaCohen 的推文出现:#research 频道中出现了一个指向 这条推文 的链接,但未提供更多细节。

- 虽然内容神秘,但暗示了对 YoavhaCohen 未来动态的关注,引发了好奇。

Axolotl AI Discord 没有新消息。如果该频道长期沉寂,请告知我们,我们将将其移除。

Mozilla AI Discord 没有新消息。如果该频道长期沉寂,请告知我们,我们将将其移除。

HuggingFace Discord 没有新消息。如果该频道长期沉寂,请告知我们,我们将将其移除。

Gorilla LLM (Berkeley Function Calling) Discord 没有新消息。如果该频道长期沉寂,请告知我们,我们将将其移除。

AI21 Labs (Jamba) Discord 没有新消息。如果该频道长期沉寂,请告知我们,我们将将其移除。

PART 2: 各频道详细摘要与链接

完整的频道逐条分析已针对电子邮件进行了截断。

如果您喜欢 AInews,请分享给朋友!预谢!