ainews-llada-large-language-diffusion-models

LLaDA:大语言扩散模型

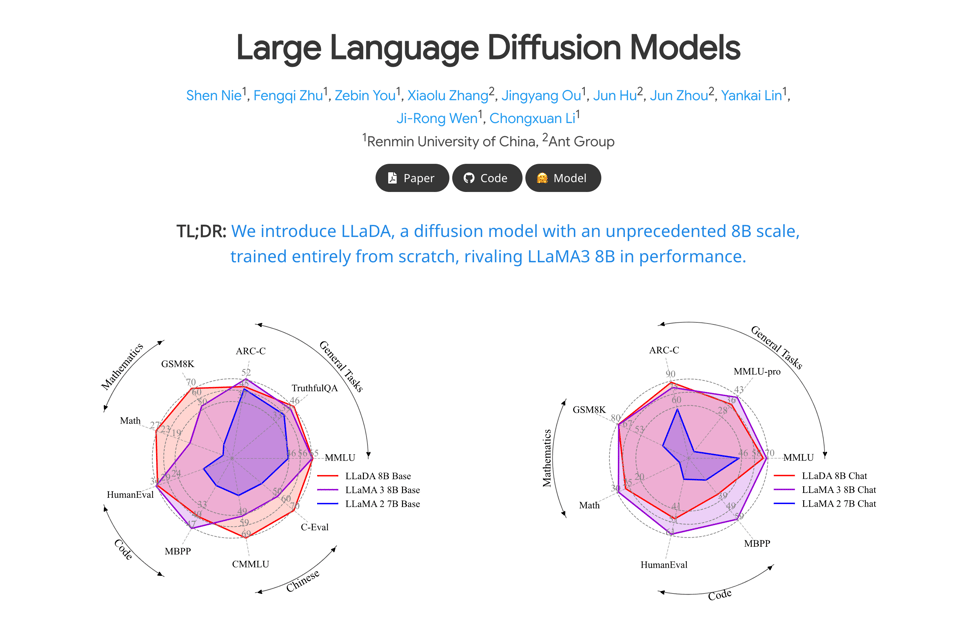

LLaDA (Large Language Diffusion Model) 8B 是一款突破性的基于扩散(diffusion-based)的语言模型,其性能可与 LLaMA 3 8B 媲美,而训练所需的 Token 数量仅为后者的七分之一(2 万亿 Token),并消耗了 13 万个 H800 GPU 小时。它通过在扩散过程中预测均匀掩码(masked)的 Token,引入了一种新颖的文本生成方法,从而实现了多轮对话和指令遵循能力。

与此同时,阶跃星辰 (StepFun AI) 发布了两款重磅模型:Step-Video-T2V 30B,这是一款文生视频模型,能够生成高达 204 帧且具有高连贯性和运动质量的视频;以及 Step-Audio-Chat 132B,这是一款语音对语音(voice-to-voice)模型。

此外,诸如 Scale AI 的 EnigmaEval 和 剑桥大学的 ZeroBench 等极具挑战性的多模态基准测试显示,目前的尖端模型在这些测试中得分竟然为零,凸显了这些任务的巨大难度。业界还注意到扩散模型在语言建模领域的回归——这种此前仅处于推测阶段的架构,如今已成功实现了规模化应用。

中国 AI 就是你所需的一切?

2025年2月14日至2025年2月17日的 AI 新闻。我们为你检查了 7 个 subreddits、433 个 Twitter 账号 和 29 个 Discord(211 个频道,11039 条消息)。预计节省阅读时间(以 200wpm 计算):1163 分钟。你现在可以标记 @smol_ai 进行 AINews 讨论!

今天每个人都能有所收获。

在美国节假日的今晚晚些时候 Grok 3 预期发布之前,今天是值得关注的“小事”之日。要么是:

- 当天发布的大模型是两款 StepFun 模型:Step-Video-T2V(30B Text to Video,具有显著的连贯性,包括 Sora 都会出错的著名高难度芭蕾舞者动作)和 Step-Audio-Chat(一个 132B 的 voice to voice 模型)。

- 或者你可以关注 Scale AI 的 EnigmaEval(极难的多模态谜题)或剑桥大学的 ZeroBench(100 个手动策划的多步视觉推理问题),在这些评测中,目前的顶级模型得分均为 0。

- 或者你可以看看 Schulman 和 Zoph 关于 post-training 的最新演讲。

但我们选择将今日的头条新闻授予 LLaDA: Large Language Diffusion Models,这是第一个扩展到足以与 Llama 3 8B 等自回归模型竞争的文本扩散模型。

这是一种“白鲸”式的替代 LLM 架构,此前一直处于推测阶段,直到现在才成功扩展。其核心技巧是调整扩散模型以预测均匀掩码的 token,在扩散过程中生成文本:

对于那些习惯了文本从左到右流式输出的人来说,扩散模型似乎不太实用……直到你尝试在预设的文本结构和词汇选择之间进行填充(infill),或者创建连贯的长篇故事结构。LLaDA 可能是更大变革的开端。

AI Twitter 简报

AI 模型与研究发布

- LLaDA (Large Language Diffusion Model) 8B:@arankomatsuzaki 宣布发布 LLaDA,这是一个从零开始训练的 8B 参数扩散语言模型。其性能与 LLaMA3 8B 相当,但使用的 Token 数量减少了 7 倍(2T tokens)。@_akhaliq 强调 LLaDA 在文本生成中采用了 diffusion model 方法,与传统的从左到右生成方式不同。@omarsar0 进一步详细介绍了 LLaDA 的特性,指出其具有竞争力的性能、可扩展性、突破了逆转诅咒 (reversal curse),以及具备 多轮对话和指令遵循 的能力。@iScienceLuvr 强调 LLaDA-8B 在标准基准测试中超越了 Llama-2 7B,并与 Llama-3 8B 表现持平。该模型在 2.3 万亿 tokens 上进行了训练,耗费了 13 万个 H800 GPU 小时。@gallabytes 对其“扩散”属性提出质疑,指出虽然作为一种新方法令人印象深刻,但缺乏 SDE、概率流或噪声。@maximelabonne 对扩散模型在语言领域的回归表示惊讶。

- Step-Video-T2V 30B:@arankomatsuzaki 分享了 Step-Video-T2V 的开源发布。这是一个 30B 参数的文本生成视频模型,能够生成多达 204 帧 的视频,并强调其生成的 高质量视频具有强大的运动动力学和一致的内容。@_akhaliq 还讨论了 Step-Video-T2V 技术报告,详细介绍了视频基础模型的实践、挑战和未来。@reach_vb 宣布发布来自 @StepFun_ai 的 30B 文本生成视频模型,还提到了一个用于更快推理的 Turbo 模型,并且该模型采用 MIT 许可证。

- Step-Audio 130B:@_akhaliq 宣布了 Step-Audio,这是一个 1300 亿参数的多模态 LLM,用于理解和生成人类语音。@reach_vb 针对这个 132B 参数的端到端语音语言模型 (Speech LM) 问道:“chat,这是真的吗?”,并将其描述为“语音输入,语音输出 🤯”,同时指出其采用 APACHE 2.0 许可证。

- Mistral Saba:@sophiamyang 宣布了 Mistral Saba,这是 MistralAI 的首个区域语言模型,拥有 24B 参数,在来自 中东和南亚 的数据集上训练,支持 阿拉伯语和印度语系语言,特别是 泰米尔语和马拉雅拉姆语。@sophiamyang 指出该模型可通过 la Plateforme 上的 API

mistral-saba-2502获取,并提供定制训练服务。

基准测试与性能

- LLaDA 性能:@iScienceLuvr 指出 LLaDA 8B 在标准零样本/少样本学习任务上超越了 Llama-2 7B,且表现与 Llama-3 8B 持平。@arankomatsuzaki 强调尽管训练数据较少,LLaDA 的性能仍与 LLaMA3 8B 旗鼓相当。

- ZSEval 基准测试:@lateinteraction 介绍了 ZSEval,这是一个新的 LLM 基准测试,利用 多人游戏 让模型在 知识、推理和规划 方面展开竞争,同时还测试了使用 DSPy 优化 的 自我改进能力。

- GPQA 分数提升:@casper_hansen_ 质疑为什么在 99.9% 为数学内容的数据集上进行 SFT 会将 GPQA 分数 从 45.30% 提升至 62.02%,并询问是基础模型的数学能力较弱,还是 GPQA Diamond 与数学相关。

- Mistral Saba 的阿拉伯语基准测试表现:@sophiamyang 提到了 Mistral Saba 在阿拉伯语基准测试中的强劲表现。

工具与库

- OmniParser 更新:@reach_vb 宣布了 Microsoft 对 OmniParser 的静默更新,这是一款屏幕解析工具,并指出其比 v1 快 60%,在 4090 上具有亚秒级延迟。@mervenoyann 强调了改进后且更快的 OmniParser 是一款用于 Web 自动化的突破性截图解析器,它是开源的,并且可以与 Qwen2.5VL, DeepSeek R1, 4o/o1/o3 mini 等模型配合使用。

- Ollama 模型下载:@ollama 确认看到来自 Ollama 的模型下载流向主要的云托管商,并且 @ollama 确认 Ollama 是用 Go 编写的。

- LangGraph.js 结合 MongoDB:@LangChainAI 宣布了一场关于使用 MongoDB 数据平台结合 LangGraph.js 构建 JavaScript AI Agent 的网络研讨会,内容涵盖 Node.js 集成和状态持久化。

- Arch AI 原生代理:@_akhaliq 介绍了 Arch,这是一个由 Envoy 贡献者构建的 Agent 原生 AI 代理 (AI-native proxy),具有边缘护栏 (edge guardrails)、任务路由与 Function Calling 以及可观测性等功能。

中国与 DeepSeek 焦点

- DeepSeek 的崛起:@teortaxesTex 指出 DeepSeek 的文锋 推动了中国股市增长约 1.3 万亿美元,并暗示 DeepSeek 的叙事完成了任何经济刺激措施都无法做到的事情。@teortaxesTex 描述了 CCTV 关于杭州科技的报道,其中包括 DeepSeek, Unitree, DeepRobotics 和 Game Science,强调了先进技术与怀旧传播方式之间的对比。@teortaxesTex 将 DeepSeek 与腾讯、小米、华为、阿里巴巴列为参加北京座谈会的重要科技领袖,文锋作为唯一的 AI 领域代表出席。

- 文锋的影响力:@teortaxesTex 表示文锋将激励一代又一代的亚洲技术宅 (autists),并且 @teortaxesTex 建议文锋少年感的外貌非常适合改编成动漫/漫画,甚至比《Dr. Stone》更好。@teortaxesTex 确认梁文锋会见了习近平,并注意到他在与党内精英会面时始终如一的西装和姿势。

- 中国科技座谈会:@teortaxesTex 分析称北京座谈会具有深刻的象征意义,指出了文锋和星星的加入、百度和字节跳动的缺席、与马云的和解,以及王沪宁的主持。@teortaxesTex 提到 习近平思想 的作者 王沪宁 主持了该科技座谈会。

Perplexity Deep Research 与使用

- Deep Research 发布与使用:@AravSrinivas 表示 Perplexity 上的 Deep Research 使用量正在飙升 🚀,占据了搜索 QPS 的很大一部分。@AravSrinivas 宣传 Perplexity 提供几乎无限的 Deep Research Agent。@AravSrinivas 演示了 Deep Research 作为小型企业注册法律顾问 的功能,强调了其相比昂贵的人类顾问的易得性。@AravSrinivas 展示了 Perplexity Deep Research 作为产品经理进行路线图规划,展望了公司中的 AI 员工/实习生。@AravSrinivas 展示了 Perplexity Deep Research 像 Bill Ackman 一样撰写投资备忘录,并以 $UBER 为例。

- Deep Research 问题与改进:@AravSrinivas 承认 Perplexity Deep Research 在财务查询方面存在不准确性,例如过时的比特币价格和公司市值,并承诺进行修复并提供更可靠的数据源。@AravSrinivas 征求关于 Deep Research 的反馈,请求演示需求和痛点,并提到可能支持更长的报告和学术来源。@hrishioa 分享了使用 Deep Research 的技巧,包括在搜索前通过 对话 来提供上下文。@hrishioa 提供了在使用和不使用 Prompt 工程的情况下,以及使用 o1pro 代替 o3minihigh 时 Deep Research 的示例。

AI 与社会、伦理及未来

- AI Robotics 突破:@adcock_brett 宣布 今年是我们一直期待的 AI Robotics 突破之年,并表示 10 年前还为时过早。@adcock_brett 表达了让 人形机器人制造并驾驶 eVTOL 的梦想。@Meta 宣布 Meta 的 AI 现在可以通过非侵入性脑活动记录以 80% 的准确率读取思想,强调了其对脑损伤患者的潜力以及神经科学与 AI 之间的协同作用。

- ASI 与生存风险:@teortaxesTex 断言:“我的个人 ASI 将根据我的决定给我提供尽可能多的怪物(而且是我想要的口味)。除此之外的一切都是灭绝事件”。@sama 提到,在品味极高的测试者中,“尝试 GPT-4.5 更多地是一种‘感受到 AGI’的时刻”。@teortaxesTex 调侃说“ASI 最后的孤注一掷 (Hail Mary)”拯救了一个崩溃的帝国。

- 法律与服务中的 AI:@finbarrtimbers 建议,如果 Harvey(AI 律师事务所)是法律的未来,那么自然的结论是创办自己的律师事务所并统治该垂直领域。@finbarrtimbers 对律师事务所等服务型公司像软件公司一样提高利润率表示看空。@andersonbcdefg 表示,由于所有权规则,“不可能”建立一家既是科技公司又用股权奖励非律师员工的律师事务所。

- LLM 中的偏见与观点:@fabianstelzer 认为 LLM 是媒体出版商,会有自己的观点,将偏见视为一种特性而非缺陷,并预测会出现 “福克斯新闻版和纽约时报版模型”。

- AI 安全与伦理:@mmitchell_ai 注意到人们对他们主张“不应开发完全自主的 AI Agent”的论文很感兴趣。@teortaxesTex 将“安全主义 (Safetyism)”确定为通往成熟人类道路上的三个大过滤器事件之一。

- AI 开发的未来:@omarsar0 预测我们将不再关心驱动 AI 系统的具体模型,产品或开发体验将成为获胜的关键因素。@ClementDelangue 呼吁回归更 开放、透明和协作的 AI,让人想起 2016-2020 年。

幽默/迷因

- Grok 3 热度:@aidan_mclau 开了一个黑色幽默的玩笑:“一个人为了告诉我们 Grok 3 到底有多好而牺牲了,永远不要忘记”,获得了超过一百万的曝光量。@marktenenholtz 鼓励大家为 Grok 3 的发布造势,期待一个“拥有比 GPT-4 大得多的集群的顶尖团队能交付出什么”。@teortaxesTex 评论道:“如果属实,这也不过如此。即便拥有 60k 个 GPU,我也能预见到 Grok 3 甚至无法确保哪怕一天的领先地位”。

- ChatGPT-4o 的编程实力:@_akhaliq 分享了由 ChatGPT-4o 生成的令人印象深刻的代码,用于弹球模拟;@_akhaliq 展示了另一个用于旋转 ASCII 球体的 ChatGPT-4o 代码,并将其与 @flavioAd 的原始测试进行了对比。@mckbrando 简单地表示:“我不知道我们做了什么,但现在的 ChatGPT 感觉变酷了”。

AI Reddit 摘要

/r/LocalLlama 摘要

主题 1. Zonos:开源权重语音克隆模型

- Zonos,一个易于使用的 1.6B 开源权重文本转语音模型,可以从 10 秒的剪辑中创建新语音或克隆语音 (得分: 330, 评论: 80): Zonos 是一个 1.6B 参数的开源权重文本转语音模型,可以生成新语音或从短至 10 秒 的剪辑中克隆语音。它在 8GB VRAM 上运行效率很高,并且可以使用 Docker 在 Linux 上轻松设置,同时提供了一个 Windows 友好分支(尽管作者未对其进行担保)。该模型及其混合版本可在 Hugging Face 上获取,作者建议使用 Ocenaudio 编辑语音样本。

- 用户讨论了 Zonos 的技术设置,包括在 Linux 和 Windows 上使用 Docker,以及 Windows 用户需要 WSL2 来启用带有 Nvidia Container Toolkit 的 Docker。一些用户报告了 docker-compose.yml 的问题,并需要调整 network_mode 和端口以确保正常运行。

- 关于 Zonos 与 ElevenLabs 相比的性能和质量存在争论,一些用户认为 Zonos 不够自然和富有表现力,而另一些人则欣赏其成本效益和语音克隆的潜力。用户注意到 espeak 被用于音素化,这可能会影响非英语语言的表现。

- 讨论强调了 Zonos 的局限性和潜在改进方向,例如 30 秒的输出限制,以及在生成的语音中需要更好的重音和情感控制。社区期待未来的更新和改进,一些用户表示有兴趣将 Zonos 用于 sillytavern 等应用,并将其与 Kokoro 和 Fairseq 等其他模型进行比较。

主题 2. OpenArc Python API 增强 Intel 推理

- 今天我发布了 OpenArc,这是一个用于在 Intel CPU、GPU 和 NPU 上实现更快推理的 Python 服务 API。低层级、极简依赖,并附带首个用于模型转换的 GUI 工具。 (Score: 279, Comments: 44): OpenArc 是一款新推出的轻量级推理引擎,旨在利用 Transformers 中的 Optimum-Intel 来发挥 Intel 硬件加速性能。它具有一个包含四个端点的强类型 API、原生聊天模板,以及一个用于维护暴露参数的 pydantic 模型。OpenArc 面向 Intel 加速器和边缘设备的用户,提供了一种低层级的上下文管理方法,并推广了在本地与 LLM 交互的 API 调用设计模式。未来的更新包括 OpenAI proxy、docker compose 示例以及对多 GPU 执行的支持。

- 厂商锁定担忧:用户对厂商锁定表示担忧,强调了在 Apple、Intel、Nvidia 和 AMD 等多种硬件上运行模型的重要性。摆脱 GPU 依赖运行 LLM 的能力将促进本地执行,打破 Nvidia 在市场上的主导地位。

- 性能与兼容性:人们对 OpenVINO 与 llama.cpp 的性能对比很感兴趣,讨论强调 OpenVINO 使用独特的图表示进行量化,这与 llama.cpp 没有直接可比性。轶事证据表明 OpenVINO 在高精度下速度更快,目前正在努力针对较新模型对其性能进行基准测试。

- 社区与协作:几位用户对该项目表示赞赏,并对未来的更新表示期待,特别是用于在低成本 Intel VPS 上进行测试的 Docker compose 示例。还有人呼吁开展协作,特别是那些针对 Intel 平台开发类似项目的用户,其中一位用户特别提到了在多系统模型托管和分布式微调方面的工作。

主题 3. DeepSeek-R1: MoE 模型 CPU 性能

- DeepSeek-R1 纯 CPU 性能 (671B, Unsloth 2.51bit, UD-Q2_K_XL) (Score: 120, Comments: 59): DeepSeek-R1 作为一个 671B 模型,由于其 MoE 特性,在纯 CPU 推理性能方面表现出色,测试在 Xeon w5-3435X 和 TR pro 5955wx 等多种 CPU 上进行。使用 Unsloth 的 2.51-bit 量化相比 1.58-bit 提供了更好的质量和速度,在 Xeon w5-3435X 上达到了 4.86 tok/s。kTransformer 通过混合使用 CPU 和 GPU 提供了近 2 倍的性能提升,尽管它受限于 VRAM 的上下文长度。作者正在寻求更多的 CPU 性能数据,并指出 STREAM 基准测试结果低于预期,计划针对 kTransformer v0.3 和 Prompt 处理速率进行更新。

- 性能对比:用户正在讨论各种 CPU 的性能,包括 Xeon w5-3435X、Epyc Rome 和 Threadripper 5965wx,重点关注内存带宽和 CCD 的影响。Xeon Sapphire Rapids 显示出低于预期的实际带宽,而 Epyc Rome 搭配 DDR4 内存提供了良好的性价比,在 STREAM 上达到了约 160GB/s。

- 优化技术:优化速度的建议包括尝试线程数、避免 KV cache 量化,以及使用

--no-mmap --mlock等标志来提高 Prompt 处理速度。CheatCodesOfLife 提供了针对不同缓存类型和量化设置的详细性能对比。 - 量化与速度:Unsloth 的 2.51-bit 量化方法因其优于 1.58-bit 的性能而受到关注,用户报告了不同配置下的不同速度。值得注意的是,thereisonlythedance 提到通过部分卸载(offload)达到了每秒 6 个 token,而其他人则指出了硬件升级对性能提升的影响。

其他 AI 版块回顾

/r/Singularity, /r/Oobabooga, /r/MachineLearning, /r/OpenAI, /r/ClaudeAI, /r/StableDiffusion, /r/ChatGPT, /r/ChatGPTCoding

主题 1. Nvidia GPU:10 个月内算力翻倍引发疑问

- Nvidia 算力每 10 个月翻一番 (Score: 481, Comments: 37): NVIDIA 的算力预计每 10 个月翻一番,正如一张显示从 2020 年到 2024 年跨越 Hopper、Ampere、Volta 和 Pascal 等 GPU 世代的 FLOP/s 指数级增长图表所示。数据表明预计增长率为每年 2.3 倍,置信区间在 2.2 到 2.5 倍之间。

- 用户质疑 NVIDIA 算力预测的准确性,认为这些数字可能涉及不同精度级别的比较(例如 FP16 到 FP8),这可能会夸大感知到的性能提升。人们对所引用的具体 FLOPS 类型感到好奇,假设倾向于可能是 FP16 中的 Tensor FLOPS。

- 讨论将增长率与摩尔定律 (Moore’s Law) 进行了比较,指出虽然摩尔定律涉及晶体管数量,但 NVIDIA 的预测涵盖了性能和生产规模。用户强调该图表反映的是总装机算力,而不仅仅是单个 GPU 的算力,如果生产数量增加,这可能会产生误导。

- 对于增长率是否会超过需求存在怀疑,评论指出算力需求的增长甚至比供应还要快。用户询问了 Blackwell GPU 的状态及其维持这种增长的潜力,并反思了视频处理等领域对更多算力的需求。

主题 2. Video-to-Video AI 的进展:混元 (Hunyuan) 的哈利·波特动漫

- 哈利·波特动漫 2024 - 混元 Video to Video (Score: 683, Comments: 69): 该帖子提到了利用混元 (Hunyuan) Video-to-Video 模型进行的 Harry Potter Anime 2024 转换。然而,帖子正文中没有提供更多细节或背景。

- 用户对工作流和渲染细节表示感兴趣,并要求提供有关 GPU 使用情况和渲染所需时间的信息。Inner-Reflections 分享了一个 Lora 模型 的链接,并提到了 controlnets 改进结果的潜力。

- 用户对一致性和角色设计提出了担忧,指出了诸如罗恩的发色和缺乏面部表情等问题。DaddyKiwwi 和 FourtyMichaelMichael 讨论了保持风格一致性的挑战,这可能是由于渲染限制造成的。

- Neither_Sir5514 等人强调了对低帧率 2D 艺术风格的偏好,这与不太吸引人的 2.5D 类皮克斯风格形成对比。Liquidphantom 补充说,动漫通常在动作场面为 12fps,对话场面为 8fps,强调了这项技术对动画的适用性。

主题 3. 开源视频模型 Step-Video-T2V:高需求,高创新

- 新开源视频模型:Step-Video-T2V (Score: 330, Comments: 63): 该帖子介绍了一个新的开源视频模型 Step-Video-T2V。帖子正文中没有提供额外的细节或背景。

- VRAM 需求与优化:Step-Video-T2V 模型需要 80GB VRAM 才能达到最佳性能,但讨论表明,通过量化 (quantization) 和优化,它可能在 24GB VRAM 上运行。预计集成到 Diffusers 库中将增强优化能力。

- 技术细节与资源:该模型被描述为拥有 300 亿参数,具有深度压缩 VAE,可实现 16x16 空间和 8x 时间压缩比。代码和权重等资源可在 GitHub 和 Hugging Face 上获得。

- VRAM 创新:一篇链接文章讨论了 SanDisk 的新 HBF 内存,该内存可以在 GPU 上实现高达 4TB 的 VRAM,这可能有利于读取密集型任务,但由于延迟比 HBM 高,对训练的益处较小。有人猜测 GPU 会采用混合 HBF/HBM 架构,以平衡计算和存储需求。

主题 4. AI Agent Apply Hero:大规模职位申请及其影响

- AI Agent Apply Hero 已完成超过 160 万份职位申请 (分数:301,评论:30):AI Agent Apply Hero 使用 Claude 驱动其模型,已提交了超过 160 万份职位申请,展示了 AI 能力的重大进步。该 Reddit 帖子强调了 AI 技术在未来几年的快速发展和潜力。

- 评论者对 AI Agent Apply Hero 的有效性表示怀疑,认为它制造了不必要的干扰,并对其获得工作的成功率提出质疑。Deep_Area_3790 和 DaShibaDoge 对其给职位申请过程带来的影响以及这 160 万份申请 的实际结果表示担忧。

- 一些用户(如 EngineeringSmooth398 和 Halbaras)批评了公司繁琐的职位申请流程,认为 AI 工具可能会凸显当前系统的冗余和低效。literum 建议未来 AI 可能会更高效地管理职位申请,类似于公司使用 AI 进行简历筛选的方式。

- Funny_Ad_3472 幽默地指出了自动化申请与人为因素之间的脱节,提到由于 AI 自动化,被叫去参加自己都不记得申请过的职位的面试是多么奇怪。

主题 5. AI 图像修复:放大 Windows XP Bliss 壁纸

- 经典的 Windows XP Bliss 壁纸从 800x600 放大至 8K (7680x4320) - 使用 Flux Dev 进行扩图与放大 (分数:170,评论:22):经典的 Windows XP ‘Bliss’ 壁纸 已使用 Flux Dev 等 AI 工具 从 800x600 分辨率放大至 8K (7680x4320)。这展示了 AI 在增强经典数字图像方面的应用。

- 讨论强调了 ‘Bliss’ 图像的原始拍摄地点,并指出该地点已经存在许多高质量图像,从而质疑 AI 放大的必要性。External_Waltz_8927 等人批评了 AI 生成的 8K 图像缺乏细节,认为不当的设置(如过度的去噪)可能会降低图像质量。

- LatentSpacer 分享了使用 AI 进行图像放大的详细 workflow(工作流),包括该过程的 链接,并强调了调整去噪和 tile size 等设置的重要性。最终图像分享在此处,并在 Photopea 中进行了微调以去除伪影。

- 对话还提到了在 archive.org 上可以找到 PNG 格式 的 存档高清原图。此外还有关于原片相机 Mamiya RB67 及其大底片格式的讨论,这种格式提供了丰富的细节,建议在 AI 提示词中使用它以获得更好的输出质量。

AI Discord 摘要

由 Gemini 2.0 Flash Thinking 提供的摘要之摘要

主题 1. Grok 3 引发 AI 辩论:马斯克的言论遭遇社区质疑

- 马斯克吹捧 Grok 3 为“地球上最聪明的 AI”:埃隆·马斯克预告了即将发布的 Grok 3,宣称它是 “地球上最聪明的 AI” 并安排了现场演示,这在用户中引发了热议,但也带来了对其实际效用和潜在偏见的怀疑。人们担心 Grok 3 过度迎合文化偏好而非真正的智能,与此同时,OpenAI 董事会坚决拒绝了马斯克控制该公司的 974 亿美元 报价,并表示 “OpenAI 不予出售。” (彭博社报道)

- 用户推测 Grok 3 的能力:爱好者们正热切期待 Grok 3,一位用户乐观地表示:“如果 Grok 3 强 10 倍,那就全剧终了”,同时引用了 Sam Altman 的推文,该推文预告了 ChatGPT-4o 的改进。然而,一些人担心 Grok 可能会根据其编程成为宣传工具,并期待评估其相对于 O1 等现有 AI 模型的表现。

- Grok 潜在的政治倾向引发关注:用户表示担心由埃隆·马斯克支持的 Grok 可能会表现出反映其政治观点的偏见,强调 AI 需要平衡的审查制度并避免政治叙事。讨论集中在 AI 是否应该影响政治观点,希望 Grok 3 在技术上表现出色,但担心它可能成为宣传工具。

主题 2. DeepSeek 模型推动性能与伦理讨论

- DeepSeek R1 竞逐推理桂冠:用户们正将 DeepSeek R1 与 O3 Mini High 进行对比,并倾向于认为 R1 在推理任务上表现更优。Nebius AI Studio 的一条推文指出 DeepSeek R1 的性能端点达到了 60+ tokens/秒。虽然 R1 在推理方面表现出色,但 O3 Mini High 在不同场景下的连贯性也受到了关注。

- DeepSeek R1 的推理 Token 在 OpenRouter 上引发疑问:OpenRouter 的用户观察到免费版 DeepSeek R1 模型存在异常,推理 token 意外地出现在响应内容中,而不是独立的字段里。OpenRouter 团队正在解决这些问题,以优化开源推理模型的行为,并参考了 DeepSeek 的 GitHub 使用指南。

- 关于 DeepSeek 是否为 CCP 项目的辩论:LM Studio 社区就 DeepSeek 是否为 CCP 项目展开了轻度辩论,讨论了其资金来源和 AI 的快速进步。有推测认为,AI 发展的飞速节奏可能会带来不可预见的突破;同时,一些用户根据 Aider 用户的报告,对 DeepSeek 受训练数据和 Web 界面设置影响而可能存在的审查制度表示担忧。

主题 3. Llama 3.2 挑战 VRAM 限制并催生量化解决方案

- Llama 3.2 吞噬 VRAM:Hugging Face 用户正面临 Llama 3.2 模型在本地使用时需要 20GB VRAM 的难题,这促使人们探索如 EasyQZ 等量化技术,以便在显存有限的 GPU 上运行更大的模型。性能基准测试结果显示,一个 9B 模型 的表现出人意料地优于更大规模的模型。

- Unsloth 优化 Llama 3.2 微调:Unsloth AI 强调其能够对 Llama 3.2 进行微调,支持高达 32k token 的扩展上下文长度,展示了在处理长序列方面的重大进展。他们还修复了 Phi-4 中的错误,并提供了 Llama 3.2 和 Phi-4 的微调教程(Unsloth 博客,Unsloth 博客 Phi-4,YouTube 教程)。

- Torchtune 社区增强 Llama 3.3 Tokenizer:Torchtune 社区就为 Llama3 tokenizer 添加“tool”选项达成共识,以确保与“ipython”的向后兼容性,展示了协作改进的成果。此次更新反映了在优化和调整模型以适应多样化应用并保持兼容性方面的持续努力。

主题 4. RAG 与微调之争加剧:效率与应用重点凸显

- 微调在性能上压倒 RAG:Unsloth AI Discord 成员发现,在拥有充足训练数据的情况下,微调的表现显著优于 RAG,从而在 LLM 应用中实现卓越性能。一位成员建议 RAG 可能会变得小众化,而微调将成为大多数用例的主流方法。

- RAG 在大型代码库中面临 Repomap 障碍:Aider 用户讨论了 RAG 和 Repomap 在大型仓库中的低效问题,观察到随着代码库规模增加,收益递减,并建议使用 BM25 和 RAG 的混合评分来改进搜索。文中引用了一篇关于 10k 仓库规模代码库 RAG 的博客文章,概述了弥补 LLM 上下文缺口的方法。

- Perplexity Deep Research 挑战传统搜索:Perplexity AI 推出了 Deep Research,该功能通过多次搜索和来源分析生成深度研究报告,为免费用户提供每天 5 次查询,Pro 用户则为 500 次。用户评价指出了其与 OpenAI 产品相比的局限性和偶尔出现的“幻觉”问题,但仍对其未来的改进抱有希望(Perplexity 博客)。

主题 5. 社区驱动的工具化与优化工作推动 AI 开发进阶

- Unsloth 的招聘挑战寻求深度学习问题解决者:Unsloth AI 推出了五项挑战,为深度学习优化专家提供高达 50 万美元/年 的年薪,寻求社区在 Griffin 和 FSDP2 等领域的贡献。该计划旨在通过开放的社区参与加速关键技术领域的进步。

- OpenRouter 图表实时数据更新及 Tooltip 扩展发布:OpenRouter 通过 Google AI 的 Vertex 增强了其吞吐量和延迟图表的实时更新功能(OpenRouter 公告),并推出了 Versatile AI Tooltip Chrome 扩展,以便使用 OpenRouter 模型快速处理文本。该扩展专注于高效的摘要和翻译(Chrome 应用商店)。

- Cursor IDE 用户创新 MCP Server 配置:Cursor IDE 用户正在积极分享创新的 MCP Server 配置,包括 Brave Search 和 Sequential Thinking(详见此 YouTube 视频),以增强编码工作流和文档处理。据报告,这些配置显著提高了编码过程的可靠性。

第一部分:Discord 高层级摘要

Unsloth AI (Daniel Han) Discord

- Unsloth 发布招聘挑战:Unsloth 宣布了五项挑战,为深度学习优化领域的问题解决者提供高达 50 万美元/年 的薪资。

- 公司寻求社区在 Griffin、FSDP2 和其他技术领域的进步做出贡献。

- 用户对 AI Agents 持怀疑态度:关于 AI Agents 定义的讨论兴起,一些人认为它们仅仅是精心编写的 Prompts,而非突破性技术。

- 成员们对围绕 AI Agents 的炒作表示担忧,强调实用性比营销语言更重要。

- CUDA OOM 错误困扰用户:成员们讨论了在训练过程中遇到 CUDA Out-of-Memory (OOM) 错误的问题,这可能是由于数据不平衡导致的。

- 尽管使用了类似的设置,但即使是数据的差异也可能导致 VRAM 负载激增,从而使解决工作变得复杂。

- Fine Tuning 在性能上优于 RAG:成员们发现,在拥有足够训练数据的情况下,Fine Tuning 的表现可以显著优于 RAG,从而提高 LLM 应用的整体性能。

- 一位成员建议,RAG 可能会被委派给利基用途,而 Fine Tuning 将继续占据主导地位。

- 提出 SCION 优化器:提出了一种新的优化器 SCION,它可能在不使用 Adam 的情况下训练大型神经网络,在减少内存占用的同时改善结果。

- 这引发了关于 SCION 在模型训练中高效管理计算资源的实际应用的讨论。

Perplexity AI Discord

- Perplexity 发布 Deep Research:Perplexity AI 推出了 Deep Research 功能,该功能通过多次搜索和来源分析生成深度研究报告。非订阅用户每天限 5 次查询,Pro 用户每天限 500 次。

- Deep Research 已在 Web 端上线,并即将登陆 iOS、Android 和 Mac。根据官方博客介绍,它在“人类最后的考试”(Humanity’s Last Exam)等专家级任务中获得了高分。

- 用户批评 Deep Research 的局限性:用户正在将 Perplexity Pro 与 You.com 进行比较,指出 Deep Research 存在限制,且偶尔会产生响应幻觉(hallucinates),导致部分用户考虑价格更具吸引力的替代方案。

- 尽管存在担忧,且在 Reddit 上出现了与 OpenAI 产品的负面对比,但社区成员仍对 Perplexity 未来功能的改进抱有希望。

- Sonar API 缺失引用问题曝光:成员们反映 Sonar API 未能按预期返回引用(citations),尽管输出内容中包含了参考标识,这引发了对其功能的困惑。

- 一位用户澄清说,引用是独立的,需要正确的访问权限,详见 Perplexity 文档。

- DeepSeek 的影响引发辩论:成员们正在探讨 DeepSeek 对 AI 方法论的潜在影响,认可其重塑当前实践的能力,如 Perplexity AI 页面所述。

- 虽然一些人强调了其在 AI 深度方面的优势,但另一些人则对集成难度表示担忧。

- 以太坊 Spectra 升级受到关注:社区分享并讨论了最近的 Ethereum Spectra 升级,指出了其对网络架构的关键改动和增强。

- 对话集中在对去中心化应用(dApps)和更广泛的 Ethereum 生态系统的潜在影响上,这些内容在 Perplexity AI 页面进行了总结。

HuggingFace Discord

- HF 用户应对 Llama 3.2 的 VRAM 需求:Hugging Face 用户正在讨论本地模型的使用,指出 Llama 3.2 模型需要 20GB VRAM,并正在探索如 EasyQZ 等量化方案,以便在低 VRAM 的 GPU 上运行更大的模型。

- 用户正在交流各种模型的性能指标,其中一个 9B 模型展现出了令人印象深刻的能力,其表现优于许多尺寸更大的模型。

- Science News Bot 加入战场:Science News Bot 已在 GitHub 上发布,旨在提供最新的科学进展和研究。

- Mini PyTorch 团队为 PyTorch 爱好者和开发者发布了一个轻量级替代方案,可在 GitHub 上获取。

- 多语言 NER 模型展现潜力:GLiNER-MoE-MultiLingual 模型是一个零样本(zero-shot)命名实体识别(NER)模型,展示了先进的 NER 能力。该模型使用 NOMIC-MOE 架构训练了一个 epoch,可通过此处访问。

- 优化后的 SwarmFormer 现在具备局部窗口注意力(local windowed attention)和 token-to-cluster 门控功能,增强了移动端和边缘环境的计算效率。

- 差分隐私受到关注!:一位成员发布了关于差分隐私(Differential Privacy)的系列博客,首篇入门文章名为《差分隐私!!但为什么?》,点击此处阅读。

- 该系列强调了在各种场景下,从数据中提取洞察与保护个人隐私之间的关键平衡。

- HF 课程参与者期待新单元:Hugging Face Agents 课程的参与者庆祝完成了 Unit 1 并获得了证书,而新学习者则在寻求通过 Hugging Face 官方页面访问课程材料的指导。

- 社区成员提议组建学习小组,奖金材料及后续单元预计将定期发布。

Codeium (Windsurf) Discord

- Windsurf 发布 1.3.4 补丁: Windsurf 1.3.4 补丁已发布,修复了 Cascade 写入工具中的 bug 并解决了消息取消问题。详情请参阅 changelog。

- 关键修复包括更好的 Cascade Base 额度处理和更清晰的身份验证登录错误消息。

- Model Context Protocol 获得 Cascade 支持: Cascade 现在支持 Model Context Protocol (MCP),允许对已配置的 MCP 服务器进行工具调用,用户应使用锤子图标进行设置。

- 此功能适用于所有个人计划,每次 MCP 工具调用消耗一个 flow act。

- JetBrains 扩展用户翘首以盼: 用户希望更新 JetBrains 扩展,特别是刷新 DeepSeek 和 Gemini 2.0 Flash 等工具的模型列表。

- 一名开发者回应称更新即将发布,并强调由于企业用户的需求,Codeium 扩展正在进行持续维护。

- Windsurf 引发对 Codeium 扩展的不满: 用户对 Windsurf 掩盖了原始 Codeium 扩展 感到不满,感叹两者缺乏功能对等。

- 一些用户感到非常沮丧,正在寻找 Qodo 等替代方案。

- Cascade 的自动保存:是意外的救星还是阴险的破坏者?: 报告显示 Cascade 会在不询问的情况下自动应用更改,导致对代码编辑产生困惑。

- 建议的解决方法是开启新的对话历史记录以避开自动建议。

LM Studio Discord

- Qwen MLX 模型引发困扰: 用户报告在 Macbook Ultra 上加载 Qwen MLX 模型 时出现

ModuleNotFoundError,建议更新到mlx-engine/0.6.0可能会有帮助。- 尽管尝试了修复问题(包括删除特定目录),但即使在最新版本中,问题依然存在。

- RX580 性能乏力: RX580 GPU 在运行 LLM 时面临限制,建议转向支持 ROCm 的较新模型以获得更好的性能。

- 鼓励用户使用 vast.ai 等云服务来评估 GPU 模型的性能,而无需进行大量的期初投资。

- DeepSeek 被贴上 CCP 项目标签: 社区对 DeepSeek 是否为 CCP 项目及其在 AI 技术快速进步背景下的资金来源进行了轻微辩论。

- 小组推测 AI 进步的速度可能会带来意想不到的突破。

- API Key 问题困扰本地服务器用户: 用户对 LM Studio 中的本地服务器 API 需要 OpenAI API key 表示沮丧。

- 聊天参与者建议通过修改代码来有效绕过本地设置的 API key 要求。

- 4060 Ti 表现出色: RTX 4060 Ti 在高效处理 AI 模型方面表现出色,特别是在每秒 token 数方面。

- 对比显示 RTX 3090 的表现也令人赞赏,特别是运行大型模型时。

aider (Paul Gauthier) Discord

- Grok 3 热度持续升温:爱好者们对即将发布的 Grok 3 充满期待,并对其能力和性能提升进行了推测;有报道称 Grok 3 已开启早期访问,其中包括名为 Ara 的语音模式。

- 一位用户推测了潜在的改进,称 “如果 Grok 3 强 10 倍,那就游戏结束了”,同时引用了 Sam Altman 的推文,该推文预告了 ChatGPT-4o 的改进。

- R1 与 O3 Mini High 争夺推理之王:用户正在权衡 DeepSeek R1 和 O3 Mini High,发现 R1 在推理能力上更受青睐;讨论中提到了 Nebius AI Studio 的推文,称 DeepSeek R1 的性能端点达到了 60+ tokens/second。

- 反馈表明,虽然 R1 在某些推理任务中表现出色,但 O3 Mini High 在各种场景下提供了更好的一致性。

- RAG 在 Repomap 方面遭遇瓶颈:参与者正在努力解决 RAG 和 Repomap 在庞大仓库中的效率问题,观察到随着代码库的膨胀,收益正在递减;一个建议是使用 BM25 和 RAG 的混合评分来增强搜索结果。

- 讨论涉及了一篇关于 针对 1 万个仓库规模的代码库构建 RAG 的博客文章,概述了弥补 LLM 上下文差距的方法。

- Gemini Flash 2.0 的速度令人惊喜:轶事证据表明,与 Sonnet 相比,Gemini Flash 2.0 提供了更快、更具成本效益的解决方案,且推理和数学技能出奇地强大。

- 这一发现引发了用户在评估不同 AI 模型的性能和效率时的比较与讨论。

- Aider 遭遇棘手 Bug:在最近的更新后,Aider 用户报告了一些 Bug,特别是命令解析障碍和

.dockerfile处理问题。- 社区还对 DeepSeek 中潜在的审查制度表示担忧,这受到训练数据和 Web 界面设置的影响。

OpenAI Discord

- Grok 潜在的政治倾向引发辩论:用户担心由 Elon Musk 支持的 Grok 可能会表现出反映其政治观点和在 Twitter 上行为的偏见,强调了 AI 进行合理审查以及避免政治叙事的必要性。

- 讨论涉及了 AI 是否应该影响政治观点,一些人希望 Grok 3 能在与现有 AI 的竞争中表现出色,而另一些人则担心它可能会根据其编程成为宣传工具。

- AI 生成的代码引发安全警报:用户强调了依赖 AI 生成的代码 的风险,因为存在不安全字符串拼接等潜在安全漏洞,强调了开发者进行严格代码审查的重要性。

- 讨论强调,如果未经人类专家彻底审核,AI 糟糕的编码实践可能会给应用程序引入漏洞。

- GPT Store Action 需要隐私政策:一名成员报告在尝试在 GPT Store 发布时遇到错误,提示 “Public actions require valid privacy policy URLs”(公开 Action 需要有效的隐私政策 URL)。

- 另一名成员建议,填写 Action 中的隐私政策字段可以解决此问题。

- 多 Agent 系统规避 Token 限制:成员们讨论了 AI 交互中 token output streams 的限制,分享了这对其项目影响的挫败感和经验。

- 有建议称,使用 multi-agent 设置可能有助于在生成较长输出时规避 Token 限制,同时注意到 MCP (Model Context Protocol) 在简化 API 交互方面的潜力。

Stability.ai (Stable Diffusion) Discord

- SD 1.7.0 优于 1.10:用户报告称 Stable Diffusion 1.7.0 比 1.10 更高效,具有更快的加载速度和改进的提示词遵循度(prompt adherence)。

- 相比之下,用户发现 1.10 版本经常生成不令人满意的图像,理由是加载时间更长且结果不稳定。

- 披露最佳 LORA 训练方案:为了获得更好的 LORA training 效果,根据用户的讨论,建议针对目标主体准备约 50-150 张图像。

- 社区还推荐使用 Koyha LORA 等工具来简化特定风格的训练过程。

- 本地 AI > 在线 AI?:用户主张在本地运行 AI 模型,强调与在线服务相比,本地具有更大的控制权和自定义空间。

- 他们建议,为了获得最佳性能,需要配备至少 8GB VRAM 的 NVIDIA GPU 和 32GB RAM。

- 精通图像生成:讨论涵盖了有效的图像创建方法,包括使用区域提示词(regional prompting)和优化提示词中的词序以获得更好的结果。

- 强调提示词结构的清晰度是获得卓越图像结果的关键因素。

- ComfyUI:强大但复杂:虽然承认 ComfyUI 对新用户来说可能比较难上手,但社区认可其在图像生成工作流中的灵活性和广泛功能。

- 拖放式图像上传等便捷工具简化了 AI 生成任务。

Cursor IDE Discord

- Claude 性能大幅下滑:用户报告称 Claude 的性能显著变慢,且过去几天其上下文感知能力有所下降,导致一些人认为它被“削弱(nerfed)”了。一位用户建议尝试 Anthropic 新的 Thinking 模型,并在模型设置中开启 Thinking 以查看 Claude 的思考过程,详见此推文。

- 成员们表示沮丧并开始探索替代模型,并指出根据此 Reddit 帖子,它可能在没有正式模型更新的情况下经历了内部调整。

- MCP Server 配置引发创新:用户分享了各种 MCP server 配置,强调使用 Brave Search 和 Sequential Thinking 来提高性能,详见此 YouTube 视频。据报道,这些配置增强了编码过程的可靠性和文档记录。

- 一位用户还在寻求 MCP 的基础“hello world”示例,表明对更易获取资源的需求,另一位用户分享了关于 Tavily MCP 的链接。

- Grok 3 的发布引发好奇:Grok 3 的发布引起了兴趣,用户对其与现有模型的性能对比感到好奇,并有推测称后端更新可能会使其与更新的 Llama 版本对齐。

- 在经历了之前令人失望的发布后,用户表达了测试 Grok 3 以验证其能力的渴望。关于推出的新闻在此推文中进行了讨论。

- Cursor 的任务处理面临审查:人们对 Cursor 高效管理大量任务和处理大型文件的能力提出了担忧,特别是在 Agent 模式下,即使是拥有无限 token 的用户也是如此。由于这些限制,用户可能需要考虑替代方案。您可以通过此链接查看模型。

- 一位用户分享了 PearAI,这是一个开源的 AI 驱动代码编辑器,作为一种可能的替代方案。另一位用户分享了一条测试多个 AI 工具的推文,用于将简单的 Figma UI 设计转换为代码。

- 免费试用漏洞令 Cursor 用户担忧:用户担心可能存在的漏洞允许滥用 Cursor 的免费试用,引发了关于安全和监管的对话。如此推文所示,有一个使用 Cloudflare 无限续订 Cursor 的教程和脚本。

- 社区对这些问题感到沮丧,敦促 Cursor 团队对滥用行为保持警惕,一位用户分享了一个用于自动登录 Cursor 的 GitHub 仓库。

OpenRouter (Alex Atallah) Discord

- OpenRouter 的实时图表获得更新:得益于 Google AI 的 Vertex 增强功能,OpenRouter 的 throughput(吞吐量)和 latency(延迟)图表现在可以实时更新,详情见其 公告。

- AI Tooltip 扩展程序诞生:Versatile AI Tooltip Chrome 扩展程序允许用户使用 OpenRouter 模型快速处理文本,只需配置 API key 即可。

- 它专注于以低廉的价格总结文章和翻译文本片段,详情可在 Chrome Web Store 查看。

- Toledo1 提供按需 AI 服务:Toledo1 平台提供基于 按提问付费(pay-per-question) 模式的私有 AI 助手对话,结合了多个 AI 以确保准确性。

- 它具有易于安装的客户端搜索功能,通过 Toledo1 提供企业级安全性,且无需订阅费。

- DeepSeek R1 的推理表现引发关注:用户注意到 DeepSeek R1 免费模型存在不一致性,推理 token(reasoning tokens)意外地出现在响应内容中,而不是作为单独的字段。

- OpenRouter 团队正在跟踪管理开源推理模型行为的解决方案,使用建议可在 DeepSeek 的 GitHub 上找到。

- 数据隐私成为棘手问题:有人担心强制路由到特定国家可能违反数据保护法,因此主张提供基于区域的路由选项以满足合规性。

- OpenRouter 承认了这一需求,并正在探索支持欧盟(EU)特定路由的选项,以实现更好的法律合规性,特别是针对目前围绕 OpenAI SDK 的讨论。

Interconnects (Nathan Lambert) Discord

- 马斯克的 Grok 3 引发争论:Elon Musk 宣布将发布 Grok 3 并安排了现场演示,称其为“地球上最智能的 AI”,这引发了关于其是否符合用户实际需求以及其“based”特性的复杂反应。现场演示定于太平洋时间周一晚上 8 点进行。

- 一些人担心该模型针对文化偏见进行了过度调整;此外,OpenAI 董事会拒绝了马斯克 974 亿美元控制该公司的出价,并表示:“OpenAI 是非卖品。” 据 Bloomberg 报道,董事会强调他们一致拒绝了马斯克破坏竞争的企图。

- Mistral Saba 旨在打造区域性 AI:Mistral Saba 是一个 24B 参数模型,专为中东和南亚设计,强调通过定制训练能力来提升语言表达、细微差别和文化背景。 Mistral AI 将其作为服务于特定地理区域、市场和客户的众多定制训练模型之一推出。

- 这一举措凸显了为特定区域市场量身定制 AI 模型而非依赖通用模型的趋势,展示了区域细微差别在专业化应用中变得越来越重要。

- 腾讯混元 LLM Turbo-S 即将亮相:腾讯计划公开发布其 Hunyuan LLM Turbo-S 和视频生成模型 HunyuanVideo I2V,预计于 2025 年第一季度发布,正如 青龍聖者在推特上发布的消息 所述。

- 这一公告反映了腾讯在竞争激烈的 AI 领域(尤其是视频技术领域)加强地位的雄心,有可能重塑媒体和娱乐领域的 AI 应用。

- GRPO 与 SFT 搭配使用!:成员们注意到 GRPO 并非旨在取代 SFT;相反,两者应结合使用以获得最佳效果。Trelis Research 在推特上发布了关于 GRPO vs SFT 视频的预告。

- 这种模型训练的协作方法受到希望通过利用 GRPO 和 SFT 技术各自优势来最大化模型性能的用户的青睐。

- LLaDA 挑战自回归模型:论文介绍了 LLaDA,这是一种扩散模型,通过展示其在可扩展性和指令遵循能力方面的潜力,挑战了传统的自回归模型(ARMs),详见 Large Language Diffusion Models。

- LLaDA 的引入引发了 AI 社区对其作为扩散模型分类的讨论和审查,观察结果指出其缺乏传统的扩散特征。

Eleuther Discord

- Data URIs 激发 AI 图像生成讨论:一位成员探索了训练 AI 使用 Data URIs 或 Base64 编码生成图像,允许在不使用外部链接的情况下存储图像,但指出这种方法在用户界面中通常显示为 blob。

- 讨论强调了在使用 Data URIs 处理 AI 生成图像时,存储便利性与显示质量之间的权衡。

- 神童现象启发 AI 进步:关于数学和国际象棋等领域常见神童的讨论引发了关注,暗示这些领域可能是 AI 取得进步的希望之地。

- 另一位成员推测音乐可能也符合这种模式,并质疑为什么它没有被归类为“简单”领域。

- NovelAI 揭秘采样器奥秘:NovelAI 对采样方法(sampling methods)的理解得到了进化,因为他们决定提供多种采样器算法(sampler algorithms),从而促使开发人员弄清楚其中涉及的复杂性。

- 这与其他组织形成了对比,那些组织最初不提供复杂的采样器,因此缺乏投入大量精力去理解它们的动力。

- 重复惩罚(Repetition Penalty)依然棘手:文本生成中的重复惩罚是一种统计方法,用于缓解水平较低的作者常见的过度重复问题。

- 虽然优秀的作者可以成功地利用重复来达到戏剧效果,但在开发采样策略(sampler policies)时,区分好的重复和坏的重复仍然是一个挑战。

- DEQs 的深度挑战 RNN 的时间维度:关于 DEQs 的讨论强调了它们与循环结构的关系,重点关注权重共享(weight tying)的影响以及隐藏层收敛到不动点(fixed points)的潜力。

- 参与者指出,与处理时间变化的 RNN 不同,DEQs 强调深度,并可以使用隐式微分(implicit differentiation)方法进行反向传播。

Nous Research AI Discord

- DeepHermes 在推理方面表现出色:用户报告称 DeepHermes 模型比目前的 R1 蒸馏模型(distillates)更好地遵循指令,并被认为是第一个可用的通用推理模型。根据 VentureBeat 的报道,一名 DeepHermes-3 用户在 MacBook Pro M4 Max 消费级硬件上报告的处理速度为每秒 28.98 个 tokens。

- 有建议认为推理任务和数据集可以进一步增强这一性能。

- 呼吁开源旧模型:针对 Anthropic 可能删除 Claude 3 且不计划将其开源的决定,人们表达了担忧,尽管该模型已经发布一段时间。有人认为发布旧模型可以建立良好声誉,并有利于公司在开源社区中的名声。

- 成员们提到了 Hugging Face 首席执行官 Clement Delangue 之前的工作,他在这段 Youtube 视频中讨论了 OpenAI、DeepSeek 以及他公司的创新。

- 强化学习 (RL) 助力 LLM:分享了关于 Reinforcement Learning (RL) 和奖励机制如何有效增强 LLM 的见解,特别是在对齐(alignment)工具方面。历史资料表明,早在其他公司采用类似策略之前,研究人员就已经意识到了这些技术。

- Google 首席科学家 Jeff Dean 在这段视频中讨论了他在 Google 的 25 年历程,从 PageRank 到 AGI。

- 关于模型训练成本的辩论:一场关于训练 1B model 所需成本的讨论浮出水面,完整配置的估计费用从数千到数万美元不等。虽然在消费级 GPU 上进行训练是可行的,但数据和架构的进步可能会随着时间的推移影响整体成本效益。

- 一位参与者提到,通过精细的数据选择和训练策略,有可能以大约 $200 到 $1,000 的价格实现一个 1.5B model,并链接到了 1.5-Pints 技术报告。

- LLaDA 扩散模型挑战 LLM:LLaDA 论文介绍了一种扩散模型,通过为概率推理提供一种有原则的生成方法,重新定义了大语言模型 (LLM) 的格局。LLaDA 展示了强大的可扩展性,并可与领先的 LLM 竞争。

- LLaDA 在 In-context learning 和多轮对话中的卓越表现,使其成为 GPT-4o 等成熟模型的竞争替代方案。

Yannick Kilcher Discord

- Splines 在 AI 中展现出潜力:讨论强调了在 AI 模型中使用 NURBS 和 splines 进行增强函数逼近并减少过拟合的潜力,这与传统的多项式形成对比。更多研究可见于 NeuralSVG: An Implicit Representation for Text-to-Vector Generation。

- 参与者探讨了在开发新的 AI 方法论中光滑度和拓扑结构的重要性,旨在实现更好的泛化能力。

- UltraMem 提升推理速度:在论文 Ultra-Sparse Memory Network 中详细介绍的 UltraMem 架构,利用大规模、超稀疏记忆层来提高推理速度和模型性能。

- 该架构在保持计算效率的同时,可能比传统的 MoE 方法更具优势。

- 社区寻求论文讨论主持人:成员们正积极鼓励更多人参与主持论文讨论,以丰富小组内的观点。物流细节在 #paper-discussion 中讨论。

- 建议包括开发一个带有依赖链接的经典论文层次树,以简化理解和知识进阶。

- Mistral 的 Saba 支持多种语言:MistralAI 推出了 Mistral Saba,这是一个拥有 240 亿参数的区域语言模型,在来自中东和南亚的数据集上进行了训练。

- 该模型在阿拉伯语以及泰米尔语和马拉雅拉姆语等南印度语言方面表现出色,专注于区域语言细微差别。

- OpenAI 起草机器人伦理指南:OpenAI 发布了其 机器人 50 定律,定义了安全的 AI 行为和现代 AI 伦理准则,扩展了阿西莫夫最初的三大定律。

- 该文件旨在使 AI 模型与人类价值观和安全保持一致,为正在进行的 AI 责任讨论做出贡献。

Cohere Discord

- Cohere API 可能获得 OpenAI 兼容性:一名成员询问了 Cohere API 与 OpenAI 的兼容性,得到了反馈并被转介给产品团队,目前尚未给出明确的时间表。

- 另一名成员正在构建一个兼容各种 AI 模型的深度研究克隆版,仅需基础 URL 和模型规范即可进行 LLM 提供商初始化。

- 社区辩论审核模型:成员们辩论了审核模型的有效性,对 Llamaguard 表示不满,并为他们的特定用例寻找更好的替代方案。

- 一些人正在使用 OpenAI 的 omni 审核,但希望 Cohere 能尽快发布新模型。

- 排除技术故障:一名成员报告在全新安装后 cohere 包出现 ModuleNotFoundError,建议认为是环境问题。

- 另一名用户报告了登录错误并分享了截图,鉴于错误上下文不明确,期待社区协助。

- Aya-8b 集成遇到问题:一名将 Cohere Aya-8b 模型集成到其应用程序中的成员遇到了该特定模型版本的 API 支持问题。

- 分享了一个使用 c4ai-aya-expanse-8b 模型的请求示例,并参考了相关资源进行排查,而其他成员则在 Rerank API 上遇到了超时问题。

- Embed API 速率限制:Embed API 的生产环境速率限制为每分钟 2,000 次调用,无论嵌入的 token 数量多少,这实际上将其限制为每分钟总共 2,000 个文档。

- 用户幽默地测试了 AI 对颜色的偏好,但 AI 表示它没有个人偏好。

Latent Space Discord

- Perplexity 推出 Deep Research Agent:新的 Perplexity Deep Research Agent 提供免费层级和 每月 20 美元 的专家研究员选项,约三分钟即可生成报告。

- 用户反馈指出输出尚可,但建议后续功能可以更好地 “利用深度研究 (leverage deep research)”,仍有进一步改进的潜力。

- 马斯克预告 Grok 3 发布:Elon Musk 宣布即将通过现场演示发布 Grok 3,并大胆宣称其为 “地球上最聪明的 AI”,但外界仍持怀疑态度。

- 社区成员反应不一,在保持热情的同时,考虑到竞争格局和 Grok 之前的性能问题,也表达了审慎态度。

- StepFun 开源多模态模型:StepFun 开源了 Step-Video-T2V(一个需要 80G VRAM 的 30B 文本转视频模型)以及他们的 Step-Audio-Chat 模型,后者已在 Hugging Face 上线。

- 评估显示该 音频聊天模型表现远超竞争对手,突显了在 multimodal AI 领域的增强能力。

- Zed 预测下一次编辑:Zed 推出了一款名为 Zeta 的新 编辑预测模型,旨在通过预测代码编辑来提升开发者生产力。

- 尽管社区赞赏开源举措,但也有人质疑 Zeta 在性能上是否能与 Cursor 和 Copilot 等成熟工具抗衡。

- Eliza 引发怀旧:成员们回顾了 Eliza 作为早期 AI 治疗师的影响,并讨论了相关的 播客剧集。

- 参与者推测了如果它在今天发布可能产生的影响,并引用了 Gary Marcus 的评论,假设其能获得 1000 亿美元融资。

MCP (Glama) Discord

- MCP 服务器增强工作流:成员们讨论了多个 MCP 服务器,包括用于 顺序思维 (sequential thinking)、文件系统访问、Web 搜索 和 GitHub 仓库评估 的服务器。

- 这些工具提供了增强功能,以简化各种任务并提高效率。

- Glama 网站遭遇故障:用户报告由于其托管地 IAD 地区的网络中断,导致无法访问 Glama 网站。

- 包括加载缓慢和超时在内的问题最终得到了解决。

- 分享 Prompt 工具推荐:一位用户在 MCP 环境中寻求 Prompt 管理工具的建议;推荐包括 LLMling、用于文档的 MCP-llms-txt 以及 Langfuse。

- 这些工具旨在协助更好的 Prompting 和工作流维护。

- SSE Wrappers 开发挑战:开发者讨论了为 MCP 服务器创建 SSE wrappers 的挑战,特别是关于在不修改现有服务器代码的情况下进行通信的问题。

- Neon 的 MCP 服务器简化数据库管理:来自 Neon 的 Daniel 介绍了 Neon 的 MCP 服务器,允许用户通过 Neon API 使用自然语言管理数据库。

- 这通过使用 Large Language Models (LLMs) 进行交互,简化了数据库工作流。

Modular (Mojo 🔥) Discord

- MAX 可能简化 NumPy:一位成员推测,通过将工作外包给 MAX,用 Mojo 编写的 NumPy 将比 C 语言版本更简单。

- 另一位成员表示赞同,认为这种方法可以显著提高效率和可维护性。

- 社区关注 Polars:一位用户请求获取 Polars 的 Discord 链接,这是一个由 Rust 驱动的 DataFrame 库。

- 快速的响应确认了 Polars 在 Mojo 社区中的相关性和现有知名度。

- Mojo 关注 GPU,包括 Metal:讨论围绕 Mojo 为 GPU 编译代码的计划展开,并可能支持 Apple 的 Metal API。

- 最终策略包括为包括 Apple Silicon 在内的各种硬件实现 MAX 驱动程序,从而为更广泛的兼容性打开大门。

- AI 助手加入 Mojo 重构:一位用户探索了使用 AI 将大型 Python 项目重构为 Mojo,特别是针对小型类,并利用其合理的 Mojo 知识。

- 另一位成员建议尝试

Gemini 2.0 Flash变体,但提醒完全自动化该过程将非常困难。

- 另一位成员建议尝试

- Mojo 需要更清晰的错误提示:用户强调需要提高 Mojo 错误消息 的清晰度,以帮助理解该语言。

- 一位成员指出,在从其他语言迁移代码时,Mojo 的 borrow checker(借用检查器)增加了额外的复杂性,通常需要完全重新构建架构。

Torchtune Discord

- FSDP 替代 Deepspeed Zero:一位成员询问如何在 Torchtune 中使用 Deepspeed Zero,但 ebsmothers 澄清说他们使用的是 FSDP,它等同于 ZeRO-3。

- 另一位成员建议使用 distributed recipes,无需额外设置即可获得与 Zero 相关的能力。

- GRPO PR 需要一些维护:参与者讨论了 GRPO PR 的进展,指出需要单元测试和一个实验性组件文件夹来存放各种数据集(参见 PR #2398)。

- 重点放在了在进行生成更改时保持向后兼容性。

- Tool 角色进入 Llama3.3:大家达成共识,在 Llama3 tokenizer 中添加 “tool” 选项,提供与 “ipython” 的向后兼容性(参见 tokenizer.py)。

- 贡献者们积极辩论了引入新 tokenizer 构建器的影响,并细致地处理模型版本检查。

- 依赖问题导致开发环境膨胀:成员们对开发环境中不断增加的可选依赖列表表示担忧,特别是与日志框架相关的依赖。

- 有人提议对依赖项进行分类,使用户能够仅安装所需的日志框架,从而最大限度地减少不必要的臃肿。

- 裁剪/缩尾处理(Winsorization)挽救 RLHF:建议在

rlhf.get_batch_log_probs函数中添加裁剪(clipping)或缩尾处理(winsorization)选项,以解决由于对数行为导致的丢弃序列结束(EOS)标记的问题。- 这被认为是处理对数概率(log probabilities)方面的一个潜在改进。

tinygrad (George Hotz) Discord

- Tensor 操作更加灵活:成员们建议

Tensor.tril和triu应该接受Tensor而非int作为对角线参数,以便在 KV-cache 空间的分块注意力(blockwise attention)自定义 Kernel 中提供更大的灵活性。- psychofauna 提倡使用

int | Tensor的理想签名,以简化跨维度的多条对角线管理。

- psychofauna 提倡使用

- Tinygrad Bug 修复悬赏启动:一位用户发布了一个 Bug 修复悬赏的 PR,并根据他们对测试失败的分析指出该任务非常简单。

- 他们认为相关的测试可能代表了一个修复或拼写错误,尚待对近期提交(commits)进行进一步审查。

- 寻找 HEVC 解码器工具:继 HEVC 解码器之后,一位用户询问了用于命令队列管理的工具,并提到之前使用的 ioctl 嗅探器(sniffer)非常有帮助。

- nimlgen 提到存在用于转储队列的代码,尽管可能需要针对当前用途进行调整。

- Attention 实现接近完成:一位成员报告称,通过改编

extra/models/llama.py中的现有代码,并参考顶尖的 Hugging Face 仓库进行评估,已实现了完整的com.microsoft.Attention。- 该实现在 250 个测试中通过了 201 个,失败主要是由于各种量化格式下的数值不准确。

- Tinychat 针对移动端强化:一位用户宣布了对 Tinychat 的增强,特别针对移动设备上 WASM 的稳定性,相关更改已记录在他们的 PR 中。

- 他们目前正在清理代码以准备合并,并欢迎就这些更新进行咨询。

LlamaIndex Discord

- LlamaParse 全面揭秘!:@mesudarshan 展示了 LlamaParse 的功能,强调了其多种解析模式以及解析音频/图像的能力,并进一步增强了 JSON 模式,详见此处。

- 他在此链接中对各项功能进行了全面分解。

- LlamaIndex.TS 瘦身!:LlamaIndex.TS 获得了更新,通过瘦身使其更易于交付,极大地提升了可用性,改进详情见此处。

- 该版本让开发者能够更快地将 LlamaIndex 集成到基于 Typescript 的 LLM 应用中。

- 使用 LlamaIndex 部署销售外联 Agent:分享了一个自动化销售外联 Agent教程,该 Agent 利用 @llama_index workflows 撰写外联邮件并根据回复管理会议日程,演示见此处和此处。

- 该 Agent 帮助生成外联邮件并安排会议。

- LLM 联盟(Consortium)问答!:Massimiliano Pippi 引入了 @karpathy 的 LLM 联盟概念实现,允许通过多个 LLM 回答问题并比较答案,在此处和此处有更充分的解释。

- 该项目探索了协作式 LLM 响应。

- Mistral Saba 小模型首次亮相:Mistral AI 推出了 Mistral Saba,这是一个专注于阿拉伯语的新模型,LlamaIndex 立即提供了支持,用户可以使用

pip install llama-index-llms-mistralai进行安装,更多信息。- 它提供了一个专门针对阿拉伯语的小模型。

Nomic.ai (GPT4All) Discord

- 寻找 **Nomic Embed Text V2 源码:一位成员在寻找 **Nomic Embed Text V2 的源代码和训练数据,起初未果,直到另一位成员分享了 GitHub repository 和 Hugging Face page。

- 讨论强调了开源项目清晰文档和可发现性的重要性。

- DeepSeek 模型绑定出现故障:用户报告在加载 DeepSeek-R1-Distill-Qwen-1.5B-Q4_0.gguf 模型时出错,暗示可能是由于过时的 python bindings 导致的。

- 另一位成员建议更新 llama.cpp 库以解决冲突。

- LocalDoc 数据转储?:用户询问在 GPT4All 中启用 LocalDoc 是否会将数据发送到云端,以及在初始使用后如何禁用它。

- 解决方案包括取消勾选 Enable Data Lake 设置以防止数据共享。

- Code Llama 模板纠纷:用户请求协助配置 Code Llama 模型的聊天模板。

- 分享了一个消息模板的基础示例,并强调可能需要模型的特定仓库或全名以获得更好的支持。

- 模型工具调用探索:一位成员询问如何验证模型在执行过程中是否有效地使用了工具。

- 给出的建议是咨询模型开发者的文档,以确认该模型是否专门针对 tool calling 进行了训练。

LLM Agents (Berkeley MOOC) Discord

- 伯克利 RDI 实习招募人才:伯克利负责任去中心化智能中心 (RDI) 为加州大学伯克利分校的学生提供实习机会,重点关注市场营销和 Web 开发,申请通过 此链接 和

samanthaguo@berkeley.edu进行滚动审核。- 职责包括制定营销策略、管理社交媒体、增强网站以及为 YouTube 频道制作多媒体内容;优先考虑具备设计工具、GitHub 和多媒体制作技能的人选。

- CS294/194-280 课程注册指南:学生可以通过 CalCentral 注册 CS194-280(课程编号 33840)和 CS294-280(课程编号 33841),候补名单中的学生可使用 申请表。

- 虽然接受逾期注册,但有关课程的问题应提交至 Edstem,而不是通过电子邮件联系工作人员。

- DeepSeek 推理讨论已安排:举行了一场关于 DeepSeek 推理方法和 GRPO 的讨论,探讨如何将 GRPO 风格的推理集成到较小的模型中。

- 学习小组还在每周论坛中讨论了 Yu Su 教授 的 Lecture 3。

- FinRL-DeepSeek 网络研讨会首发 CVaR-PPO 扩展:2 月 25 日举行的 FinRL-DeepSeek 网络研讨会将展示 CVaR-PPO 的扩展版本,该版本结合了由 LLMs 生成的交易建议和风险评估,并提供开源代码、数据和 AI 交易 Agent。

- 将分享在 Nasdaq-100 上的回测结果。

- Quiz 3 预计很快发布:成员们询问了 Quiz 3 的发布日期,由于日程安排问题,该测验有所延迟。

- 目前预计将在下周初发布。

DSPy Discord

- DSPy Code Golf 竞赛启动:成员们讨论了参与 DSPy code golf,建议围绕创建简洁的 DSPy 解决方案和分享快速技巧(quick hacks)开展竞赛。

- 一位成员指出这是花时间在有趣的编程挑战上的绝佳借口,并链接了 Omar Khattab (@lateinteraction) 展示 DSPy 用法的推文。

- Qwen 0.5B 处理 JSON 输出:一位成员寻求关于使用 Qwen 0.5B 确保 多标签分类任务 输出 JSON 的指导,重点关注必要的配置。

- 另一位成员建议使用 DSPy 的 JSONAdapter 来进行正确的 JSON 输出 格式化,并提供了示例代码。

- 自定义 DSPy 实现出现:一位成员分享了他们 fork 并定制的 Parlant 实现,增加了 DSPy 支持,确保了 JSON 输出 的正常工作。

- 他们提供了一个可以集成到 Parlant server 中的示例运行,以获得最佳性能。

- 常量参数放置位置探讨:有人请求澄清常量参数应该包含在 signature docstring 中,还是作为流水线设置中的 InputField。

- 讨论包括了对 mipro 和 bootstrapfewshotrandomsearch 优化过程影响的考虑。

- MIpro 反馈循环策略:关于如何向 MIpro 传递错误答案反馈的问题被提出,而不仅仅是将其视为一个次要指标。

- 该咨询寻求有效传达输出错误原因的方法,以提高模型的性能。

MLOps @Chipro Discord

- FinRL-DeepSeek 网络研讨会发布:一场关于 FinRL-DeepSeek 算法交易 的网络研讨会已宣布,展示了 CVaR-PPO 的扩展,该扩展集成了来自 LLMs 的交易建议和风险评估,计划于 CST 时间 2 月 25 日晚上 8 点 举行,注册链接在此。

- 研讨会承诺提供 开源代码、数据、交易 Agent 以及在 Nasdaq-100 上的回测结果,强调了可部署 AI Agent 的可用性。

- 关于研讨会录像的咨询:一位成员询问如何获取 FinRL-DeepSeek 网络研讨会 的录像。

- 这表明人们对研讨会内容有浓厚兴趣,特别是对于无法参加直播的人。

Gorilla LLM (Berkeley Function Calling) Discord 没有新消息。如果该公会沉寂时间过长,请告知我们,我们将将其移除。

AI21 Labs (Jamba) Discord 没有新消息。如果该公会沉寂时间过长,请告知我们,我们将将其移除。

PART 2: 频道详细摘要与链接

由于邮件篇幅限制,各频道的详细分析已截断。

如果您喜欢 AInews,请分享给朋友!预谢!