ainews-ai-engineer-summit-day-1

AI工程师峰会 第一天

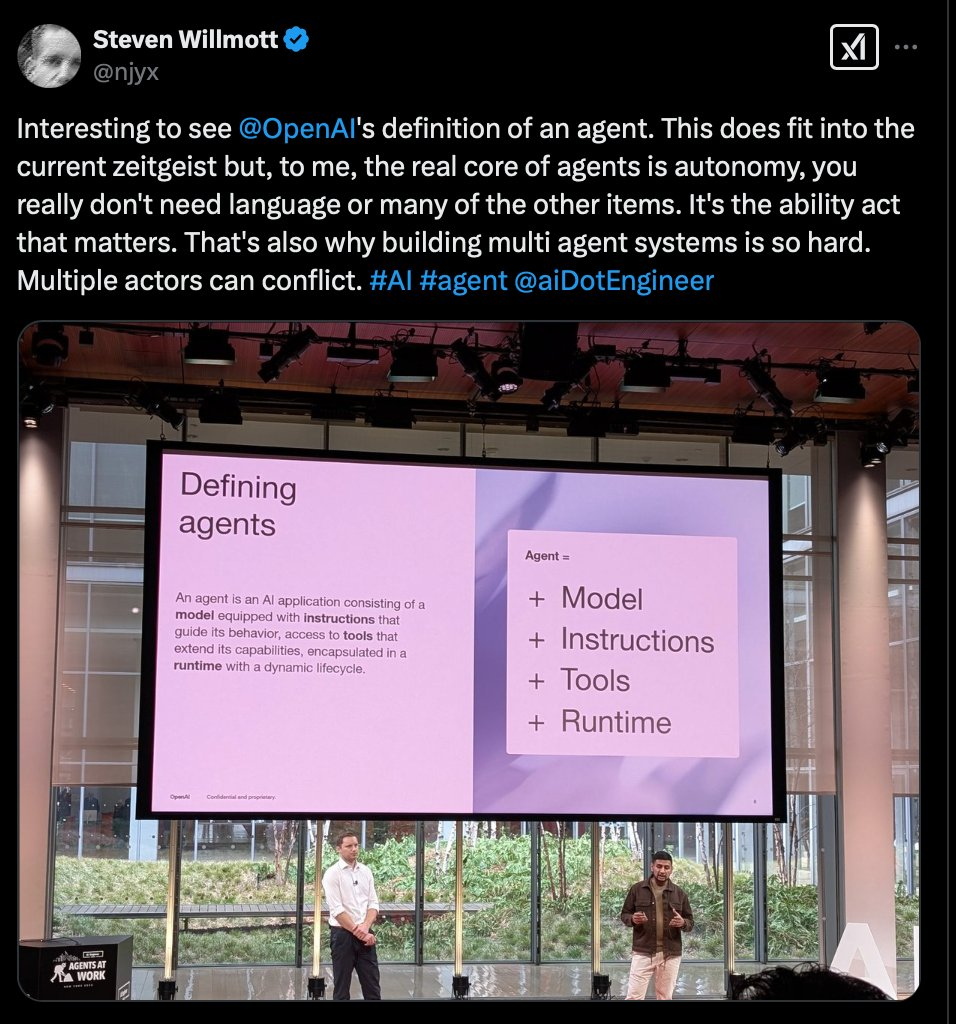

在纽约举行的 AIE 峰会(AI Engineer Summit)重点展示了多场关键演讲,包括 Grace Isford 的趋势主题演讲、Neo4j 与辉瑞(Pfizer)的联合演示,以及 OpenAI 对智能体(Agents)的首次定义。与会演讲者宣布了总计 9.3 亿美元的融资。

在 AI 推特(X)上,讨论热点集中在 Grok-3 和 o3-mini 模型,并围绕性能和基准测试展开了辩论,其中提到了 Grok-3 创纪录的 4e26 至 5e26 FLOP 计算规模。o3-mini 模型在 Sakana AI 的代码中发现了一个关键的 CUDA 内核错误。DeepSeek-R1 作为一种具有显著训练批量大小的开源替代方案备受推崇。此外,阿里巴巴宣布发布 Qwen 2.5-VL 模型。

AI Engineers are all you need.

2025年2月19日至2月20日的 AI 新闻。我们为您检查了 7 个 subreddits、433 个 Twitter 账号 和 29 个 Discord(211 个频道和 6423 条消息)。预计节省阅读时间(以 200wpm 计算):647 分钟。您现在可以标记 @smol_ai 进行 AINews 讨论!

AIE Summit 第一天在纽约圆满结束。

如果非要我们选出 3 个最值得关注的演讲,请查看 Grace Isford 的趋势主题演讲、Neo4j/Pfizer 的演示,以及 OpenAI 首次定义 Agents。演讲者/赞助商宣布了 $9.3 亿美元的融资。多个 Anthropic 数据点 在社交媒体上走红。

您可以在此处观看完整的录播:

https://www.youtube.com/watch?v=L89GzWEILkM

第二天将侧重于 Agent Engineering,而第三天将举行线下工作坊和新的线上环节。

AI Twitter 回顾

模型、基准测试与性能

-

Grok-3 的性能与能力:@BorisMPower 报告称,与 Grok 3 相比,o3-mini 在每项评估中都表现更好,并指出 Grok 3 虽然不错但被过度宣传了。这引发了与来自 xAI 的 @ibab 的讨论,后者回应称他们使用了相同的评估方法。来自 xAI 的 @Yuhu_ai_ 为 Grok 3 的性能辩护,声称他们的 mini 模型在 AIME 2024、GPQA 和 LCB 的 pass@1 指标上超越了 o3-mini high,并认为基准测试无法完全体现模型智能。@aidan_mclau 批评 Grok 3 的图表展示为“图表犯罪(chart crimes)”。@itsclivetime 分享了 Grok 3 的初步正面体验,注意到其在 Deep Research 中的速度,但也提到了编码速度较慢和偶尔崩溃的问题。@nrehiew_ 为 xAI 的评估报告辩护,称其遵循了 OpenAI 的惯例,问题在于清晰度而非欺骗。@teortaxesTex 对因看好 Grok 而遭受的指责表示惊讶。@EpochAIResearch 指出 Grok-3 创纪录的算力规模,估计为 4e26 到 5e26 FLOP,使其成为首个训练算力超过 1e26 FLOP 的已发布模型。

-

o3-mini 性能与 CUDA Kernel 问题:@giffmana 强调,o3-mini 在 11 秒内发现并解决了 Sakana AI 的 CUDA kernels 问题,揭示了一个使其看起来快 150 倍但实际上慢 3 倍的 bug。@giffmana 强调了学到的经验:简单的 CUDA 代码不太可能超越经过优化的 kernels,不一致的基准测试预示着问题,以及 o3-mini 在调试方面非常高效。@main_horse 也进行了基准测试,发现 Sakana AI 声称的 150 倍加速实际上慢了 3 倍,并指出了其 CUDA kernel 的问题。

-

DeepSeek R1 的能力与训练:@teortaxesTex 提到了 “受 R1 启发的 RL 寒武纪大爆发”,指出其科学配方与其他顶尖实验室相似,强调了从令人沮丧的“绝望废话”中的转变。@togethercompute 推广 DeepSeek-R1 作为闭源模型的开源替代方案,在 NVIDIA GPU 上提供快速推理。@andrew_n_carr 分享了 关于 DeepSeek 训练的一个冷知识,指出 14 万亿 token 的训练中 batch size 约为 60M token,与 Llama 1 较小的 batch size 形成对比。

-

Qwen 2.5-VL 模型发布:@Alibaba_Qwen 发布了 Qwen2.5-VL 技术报告,详细介绍了其架构和训练过程,强调了其与 Qwen2.5-72B 的能力对齐以及行业领先的视觉语义解析能力。@Alibaba_Qwen 还发布了 3B、7B 和 72B 尺寸的 Qwen2.5-VL AWQ 量化模型。@_akhaliq 分享了 Qwen2.5-VL 技术报告的发布。@arankomatsuzaki 也宣布了 Qwen2.5-VL 技术报告的发布。@_philschmid 详细介绍了 Qwen Vision Language Models 的训练方式,强调了动态分辨率处理和重新设计的 Vision Transformer。

-

SmolVLM2 视频模型:@mervenoyann 发布了 SmolVLM2,“世界上最小的视频模型”,包含 256M、500M 和 2.2B 三种尺寸,并提供 iPhone 应用、VLC 集成以及精彩片段提取器。@reach_vb 重点介绍了 SmolVLM2,这是采用 Apache 2.0 协议的 VideoLM,参数量从 256M 到 2.2B 不等,并指出它们可以在免费的 Colab 甚至 iPhone 上运行。@awnihannun 推广了 SmolVLM2 对 MLX 和 MLX Swift 的首日支持,实现了在 Apple 设备上的本地运行。

-

用于机器人技术的 Helix VLA 模型:@adcock_brett 发布了 Helix 的技术报告,这是一款通用视觉-语言-动作 (VLA) 模型。@adcock_brett 将 Helix 的架构描述为“System 1, System 2”,包含一个 7B 参数的 VLM 和一个 80M 参数的视觉运动策略,运行在嵌入式 GPU 上。@adcock_brett 展示了 Helix 机器人抓取家用物品,@adcock_brett 详细介绍了 Helix 以 200Hz 频率协调 35 自由度 (DoF) 的动作空间。@adcock_brett 展示了 两台机器人使用 Helix 协作存放杂货。@adcock_brett 强调了 Helix 在机器人技术方面的类人思考和泛化能力。@adcock_brett 将 Helix 介绍为“像人类一样思考的 AI”,目标是让机器人走进家庭。

-

SholtoBench AGI 基准测试:@nearcyan 宣布了 SholtoBench,这是一个追踪 Sholto Douglas (@_sholtodouglas) 在 AGI 实验室就业情况的新 AGI 基准测试。@nearcyan 提供了 SholtoBench 官方网站的链接,并感谢了匿名贡献者。

-

AIME 2025 性能图表:@teortaxesTex 分享了 AIME 2025 的“Teortaxes 最终版”性能图表,对比了 o3-mini, Grok-3, DeepSeek-R1 和 Gemini-2 FlashThinking 等模型。@teortaxesTex 评论了一些实验室发布“愚蠢且变形的图表”来宣称达到 SoTA。@teortaxesTex 展示了 AIME 2025 结果的汇总,旨在追求清晰度,避免“图表造假”。

-

Grok DeepSearch 评估:@casper_hansen_ 发现 Grok DeepSearch “相当不错”,注意到了它的查询扩展功能,并对其与 OpenAI 的 DeepResearch 的对比提出了疑问。

-

LLM Scaling Laws 与数据质量:@JonathanRoss321 讨论了 LLM Scaling Laws,认为 即使互联网数据耗尽,通过提高数据质量,改进仍能继续,并引用 AlphaGo Zero 的自我博弈作为合成数据推动进步的例子。

-

FlexTok 图像分词器:@iScienceLuvr 重点介绍了 FlexTok,这是来自 Apple 和 EPFL 的新型分词器 (Tokenizer),它将 2D 图像投影为可变长度的 1D Token 序列,从而实现层级化和语义化压缩。

-

视觉语言模型训练:@_philschmid 解释了 像 @Alibaba_Qwen 2.5-VL 这样的视觉语言模型是如何训练的,详细说明了预训练阶段(仅 ViT、多模态、长上下文)和后训练阶段(SFT 和 DPO)。

-

vLLM 结合 DeepSeek 模块提速:@vllm_project 宣布 vLLM v0.7.3 现在支持 DeepSeek 的 Multi-Token Prediction 模块,实现了高达 69% 的速度提升。

开源与社区

-

开源 AI 模型:@togethercompute 坚定了他们的信念,即 “AI 的未来属于开源”,并围绕开源模型和高性能基础设施构建其云服务公司。@_akhaliq 向 @bradlightcap 表示祝贺,并建议 开源模型可以进一步增强他们的成功。@cognitivecompai 表达了对 @arcee_ai 新发布的 Apache 2.0 协议项目的高度赞赏。

-

Hugging Face 推理支持扩展:@_akhaliq 宣布 Hugging Face Inference 提供商现在支持超过 8 个不同的供应商和近 100 个模型。

-

LangChain Agent 组件与 Open Deep Research:@LangChainAI 宣传了 Interrupt 会议,来自 Uber 的演讲者将分享 基于 LangGraph 的可重用 Agent 组件。@LangChainAI 推出了 Open Deep Research,这是一个可配置的开源深度研究 Agent。@LangChainAI 在炉边谈话中重点介绍了 Decagon 的 AI Agent 引擎,该引擎已被 Duolingo 和 Notion 等公司使用。

-

Unsloth 显存高效型 GRPO:@danielhanchen 宣布 GRPO(R1 背后的算法)在 @UnslothAI 中实现了高达 90% 的显存节省,在 54GB 显存上即可实现 20K 上下文长度的 GRPO,而其他训练框架则需要 510GB。

-

Lumina2 LoRA 微调发布:@RisingSayak 宣布在 Apache 2.0 协议下发布 Lumina2 LoRA 微调。

-

Offmute 开源会议总结:@_philschmid 展示了 Offmute,这是一个使用 Google DeepMind Gemini 2.0 进行会议转录、分析和总结的开源项目,可生成结构化报告和关键要点。

-

SongGen 开源文本转音乐模型:@multimodalart 宣布 SongGen 加入 YuE 成为开源文本转音乐模型,类似于 Suno,允许用户根据语音样本、描述和歌词创作歌曲。

研究与开发

-

AI CUDA Engineer - Agentic CUDA 核函数优化:@DrJimFan 重点介绍了 Sakana AI 的 “AI CUDA Engineer”,这是一个能够生成优化后的 CUDA 核函数的 Agentic 系统,利用 AI 来加速 AI。@omarsar0 拆解了 Sakana AI 的 AI CUDA Engineer,解释了其用于核函数优化的端到端 Agentic 系统。@SakanaAILabs 宣布了 “AI CUDA Engineer” Agent 系统,该系统可自动生成 CUDA 核函数,潜在地将模型处理速度提高 10-100 倍,并发布了一个包含 17,000 多个 CUDA 核函数的数据集。@omarsar0 详细介绍了 AI CUDA Engineer 的 Agentic 流水线,包括 PyTorch 到 CUDA 的转换和进化优化。@omarsar0 提到可以获取由 AI CUDA Engineer 创建的 17,000 多个经过验证的 CUDA 核函数存档。

-

Thinking Preference Optimization (TPO):@_akhaliq 分享了关于 Thinking Preference Optimization(思考偏好优化)的研究链接。

-

用于高效网页爬取的 Craw4LLM:@_akhaliq 发布了关于 Craw4LLM 的消息,这是一种用于 LLM 预训练的高效网页爬取技术。

-

通过基于 3DGS 的强化学习实现驾驶策略的 RAD:@_akhaliq 分享了 RAD 研究,该研究使用大规模基于 3DGS 的 Reinforcement Learning 训练端到端驾驶策略。

-

Autellix - LLM Agent 的高效推理引擎:@_akhaliq 重点介绍了 Autellix,这是一个将 LLM Agent 作为通用程序运行的高效推理引擎。

-

用于 3D 分子生成的 NExT-Mol:@_akhaliq 分享了 NExT-Mol 研究,该研究探讨了 3D Diffusion 结合 1D Language Modeling 用于 3D 分子生成。

-

小模型向强推理者学习:@_akhaliq 链接了一项关于小模型难以从强推理者(Strong Reasoners)中学习的研究。

-

用于复杂推理的 NaturalReasoning 数据集:@maximelabonne 介绍了 NaturalReasoning,这是一个旨在无需人工标注即可提高 LLM 复杂推理能力的新指令数据集,强调质量优于数量以及训练数据的多样性。

-

用于目标检测的细粒度分布细化(Fine-grained Distribution Refinement):@skalskip92 介绍了 D-FINE,一种“新型” SOTA 目标检测器,它使用细粒度分布细化技术,通过迭代边缘偏移调整和在网络层间共享精确分布来提高边界框(bounding box)的准确性。

-

用于生物分子平衡结构预测的 BioEmu:@reach_vb 重点介绍了 Microsoft 的 BioEmu,这是一个用于高效预测生物分子平衡结构系综的大规模深度学习模型,每小时能够采样数千个结构。

机器人与具身智能(Robotics and Embodiment)

-

Figure 的 Helix 人形机器人 AI:Figure AI 正在开发 Helix,这是一款用于人形机器人的 AI 模型,展示了包括杂货存储和物体操作在内的多种能力(来自 @adcock_brett 的推文)。他们正在为 Helix、训练基础设施(Training Infra)、大规模训练(Large Scale Training)、操作工程师(Manipulation Engineer)、大规模模型评估(Large Scale Model Evals)以及强化学习(Reinforcement Learning) 扩展其 AI 团队 (@adcock_brett)。他们的目标是在 2025 年实现量产并交付更多机器人,重点关注家庭机器人 (@adcock_brett)。

-

机器人上的 7B LLM 对比用于数学的 o3:@abacaj 表示 “在机器人上运行 7B LLM 比使用 o3 解决博士级数学问题更有趣”。@abacaj 发现一个 7B 参数的板载视觉 LLM 驱动机器人“很有趣且在预料之中”,并指出了模型能力的提升。@abacaj 幽默地建议 “7B LLM 会帮你洗碗,而 o3 不会”。

-

Skyfire AI 无人机营救警员:@AndrewYNg 分享了一个关于 Skyfire AI 无人机营救一名警员生命的故事,该无人机在交通执法期间定位到了处于困境的警员,从而实现了快速增援和干预。

工具与应用

-

Glass 4.0 AI 临床决策支持平台:@GlassHealthHQ 推出了 Glass 4.0,这是他们更新后的 AI 临床决策支持平台,具有连续对话、高级推理、扩展的医学文献覆盖范围以及更快的响应速度。

-

AI-Toolkit UI:@ostrisai 分享了 AI-Toolkit UI 的进展,指出“困难的部分已经完成”,目前正在进行 UI 清理,随后将添加“有趣的功能”。

-

用于 AI 应用构建的 Gradio Sketch:@_akhaliq 重点介绍了一种使用 “gradio sketch” 构建 AI 应用的新方法,该方法支持通过视觉组件选择和配置来生成 Python 代码。

-

Gemini App 深度研究(Deep Research):@GoogleDeepMind 宣布 Deep Research 已在 150 个国家/地区以 45 种以上语言向 Gemini Advanced 用户开放,其功能类似于个人 AI 研究助手。

-

Elicit 系统综述:@elicitorg 推出了 Elicit Systematic Reviews,支持研究综述的自动搜索、筛选和数据提取,旨在在用户控制下加速研究进程。

-

搭载 Qwen 2.5 模型的 PocketPal 移动应用:Qwen 2.5 模型(包括 1.5B (Q8) 和 3B (Q5_0) 版本)已添加到 适用于 iOS 和 Android 平台的 PocketPal 移动应用中。用户可以通过该项目的 GitHub 仓库提供反馈或报告问题,开发者承诺会在时间允许的情况下解决这些问题。该应用支持多种聊天模板(ChatML, Llama, Gemma)和模型,用户对比了 Qwen 2.5 3B (Q5)、Gemma 2 2B (Q6) 和 Danube 3 的性能。开发者提供了 截图。

AI Reddit 摘要

/r/LocalLlama 摘要

主题 1. Qwen2.5-VL-Instruct 在视觉和视频任务中表现出色

- Qwen/Qwen2.5-VL-3B/7B/72B-Instruct 发布了!! (Score: 489, Comments: 75): Qwen2.5-VL 带来了显著增强,包括改进的 visual understanding(用于识别图像中的物体、文本、图表和布局),以及使其能够进行推理并与计算机和手机等工具交互的 agentic capabilities。它还具有针对一小时以上视频的 long video comprehension、具有精确物体识别和定位能力的 visual localization,以及针对发票和表格等复杂数据的 structured output generation,使其在金融和商业领域具有高度适用性。模型链接可在 Hugging Face 上找到。

- 用户注意到了 Qwen2.5-VL 及其 AWQ versions 的发布,对其发布时机有些困惑。Recoil42 强调了其 long video comprehension 功能在视频行业的潜在影响,而其他人则讨论了处理长视频(特别是使用 70B model 时)所需的巨大 VRAM requirements。

- 分享了不同模型大小和量化版本的 Benchmark results,包括 MMMU_VAL、DocVQA_VAL 和 MathVista_MINI 等性能指标,展示了 BF16 和 AWQ 量化之间的差异。对比了 3B, 7B, and 72B models,通常 AWQ 的表现略低于 BF16。

- 用户讨论了 compatibility and support 问题,包括 ollama 或 llama.cpp 是否支持该模型,并分享了在不同平台上运行模型的解决方案,如 Mac 上的 MLX 和 Nvidia/Linux 上的 TabbyAPI。还讨论了 exl2 format 及其与较新 Nvidia 硬件的兼容性。

Theme 2. Reverb-7b 在 Open LLM Leaderboards 中表现优异

-

**New AI Model Ozone AI** (Score: 164, Comments: 54): 来自 Ozone AI 的最新 AI 模型 Reverb-7b 已发布,展示了 7B 模型性能的显著提升。该模型在来自 Claude 3.5 Sonnet 和 GPT-4o 的超过 2 亿个 tokens 上进行了训练,并基于 Qwen 2.5 7b 进行了微调。Reverb-7b 在 Open LLM Leaderboard 上超越了其他 7B 模型,尤其在 MMLU Pro 数据集上表现出色,各学科平均准确率达到 0.4006。更多详情和模型可在 Hugging Face 找到,后续模型包括目前正在训练的 14B 版本。 - 性能担忧: 用户对 Reverb-7b 的创意写作能力表示担忧,指出尽管其 MMLU Pro 分数很高,但在该领域表现不佳,这表明其侧重于 STEM 学科而非多样化的词汇知识。

- 模型差异化: 该模型是 Qwen 2.5 7b 的微调版本,在智能和创意写作方面比之前的版本有所改进,正如用户将其与 llama 3.1 8B 等模型对比时所指出的。

- 数据集与发布: 由于盈利动机,数据集目前保持封闭,但未来有开放计划。Reverb-7b 的 GGUF 版本已在 Hugging Face 发布,用户已将其转换为 mlx 格式以获得更广泛的可用性。

Theme 3. SmolVLM2:优化视频任务的紧凑型模型

- SmolVLM2: New open-source video models running on your toaster (Score: 104, Comments: 15): Hugging Face 的 Merve 发布了 SmolVLM2,提供了 256M, 500M, and 2.2B 尺寸的新型开源视觉语言模型。此次发布包括对 transformers and MLX 的零日支持、一个使用 500M 模型的 iPhone 应用、使用 2.2B 模型进行描述分割的 VLC 集成,以及同样基于 2.2B 模型的视频高光提取器。更多详情可以在他们的 blog 中找到。

- Zero-shot vision 被解释为视觉模型在没有针对特定任务进行直接训练的情况下,利用通用知识执行任务的能力。给出的例子是在测试时为指定的新标签分类图像。

- 用户对 Hugging Face 在小型模型上的工作表示赞赏,指出 SmolVLM2 尽管体积紧凑,但性能令人印象深刻。该模型在各种应用中的集成和实用性被视为重大成就。

- Merve 提供了 SmolVLM2 的 blog 链接以及 checkpoints and demos 集合,方便进一步探索和使用该模型。

主题 4. 开源 AI Agent 挑战新前沿

- 使用 Canva 的 Agent。事情变得疯狂了…… (Score: 125, Comments: 47): 该帖子讨论了一个使用 Canva 并可能绕过 CAPTCHA 的 AI Agent,展示了在自动化通常需要人类交互的任务方面的先进能力。帖子正文的缺失表明需要依靠随附的视频来获取更多背景信息。

- 帖子中展示的 AI Agent 具有绕过 CAPTCHA 的能力,尽管人们对这类演示的真实性仍持怀疑态度,建议通过亲自使用来验证。该项目已开源,可在 GitHub 上获取。

- 人们对该 Agent 与 OpenAI 之外的其他 multimodal models 的兼容性很感兴趣,并确认它可以与其他开源模型配合使用,尽管性能可能会有所不同。运行成本可以通过租用 GPU 来控制,价格约为每小时 1.5 美元。

- 将 Canva 与 AI 配合使用的设置需要详细的指令,这表明是一个反复试验的过程。有人提出了对 Agent 适应界面变化的担忧,强调了在 Prompt 或知识库中需要精确控制细节的必要性。

其他 AI Subreddit 回顾

/r/Singularity, /r/Oobabooga, /r/MachineLearning, /r/OpenAI, /r/ClaudeAI, /r/StableDiffusion, /r/ChatGPT, /r/ChatGPTCoding

主题 1. 多模态 AI 系统:连接文本与视觉

- “事实上……再想一想” 这种 AI (Score: 103, Comments: 44): 该帖子讨论了 AI 对数值数据理解中的一个常见错误,特别是 AI 如何误解小数。给出的例子展示了 9.11 和 9.9 之间的比较,说明 9.9 更大,因为 0.90 大于 0.11,强调了正确解析小数部分的重要性。

- 类人困惑:讨论强调了 AI 在解释数字时的最初困惑与人类乍看之下可能产生的误解类似,但人类可以迅速分析并纠正自己的理解。

- AI 的自我纠正:用户注意到像 ChatGPT 这样的 AI 在回答中途承认错误的案例,这与人类意识到错误时的行为相似。

- 误解中的幽默:评论幽默地将数值误解与其他语境(如物理尺寸或日期)进行比较,并调侃 AI 像人类一样掩盖错误的倾向。

AI Discord 摘要

由 o1-preview-2024-09-12 生成的摘要之摘要的摘要

主题 1. Grok 3 从 OpenAI 手中夺走焦点

- Grok 3 碾压 ChatGPT 无法处理的编程任务:用户报告称 Grok 3 解决了 ChatGPT Pro 难以应对的复杂编程问题,促使许多人考虑转向 SuperGrok。

- SuperGrok 以极低价格提供高级 AI 服务:每月 $30 的 SuperGrok 被认为比每月 $250 的 ChatGPT Pro 订阅更具性价比,导致用户重新评估他们的 AI 服务选择。

- Grok 3 成为社区的新“死党”:热情的用户因其性能、速度和用户友好的界面而称 Grok 3 为他们的“bestie”,许多人称赞其无限的 API 和即将推出的功能。

主题 2. Unsloth 的 GRPO 算法大幅降低 VRAM 需求

- 仅需 5GB VRAM 即可训练 GRPO 模型——无需魔法!:Unsloth 发布了新算法,可实现 10 倍长的上下文长度和 90% 的 VRAM 节省,允许在不损失精度的情况下仅用 5GB VRAM 进行训练。

- 社区欢呼 Unsloth 的 VRAM 节省突破:用户表达了兴奋和感谢,并在其项目中使用 Unsloth 的 Google Colab notebooks 分享了改进成果。

- Llama 3.1 训练减少了 90% 的 VRAM 需求:受 Horace He 的梯度检查点(gradient checkpointing)技术启发,Unsloth 的 GRPO 算法将 Llama 3.1 的 VRAM 需求从 510.8GB 降低到 54.3GB。

主题 3. AI CUDA Engineer 夸张的提速声明引发质疑

- “AI CUDA Engineer”声称提速 100 倍,工程师们表示抗议:Sakana AI 推出了一款 AI 系统,号称在 CUDA kernel 优化方面实现了 10-100 倍的提速,但怀疑者指出其基准测试存在缺陷且存在根本性 bug。

- “NOP Kernels”赢得了比赛——但什么也没做!:成员们发现某些 kernel 通过实际上不执行任何操作来实现提速,凸显了“奖励作弊”(reward hacking)的案例,并对系统的有效性提出质疑。

- 过度炒作的 AI Kernel 遭到社区吐槽:专家们拆穿了令人印象深刻的提速谎言,揭露了内存重用和错误评估等问题;AI 尚未准备好取代人类 CUDA 工程师。

主题 4. 微软凭借 Majorana 1 实现量子飞跃,但遭遇怀疑

- 微软凭借 Majorana 1 芯片承诺百万量子比特的未来:微软推出了全球首款由拓扑量子比特(topological qubits)驱动的量子处理器,旨在实现 100 万个量子比特的可扩展性。

- 拓扑量子比特详解——真的是这样吗?:在一段 YouTube 视频中,微软团队讨论了拓扑量子比特,但一些人对其需要“氦致冷机”的实际应用仍持怀疑态度。

- Nadella 大肆宣传量子技术,用户却在抱怨 Teams:尽管 Satya Nadella 宣传微软的量子突破,用户却对 Teams 和 Copilot 等现有产品表示不满,质疑微软对创新而非产品质量的关注。

主题 5. AI 公司狂揽巨资,押注推理爆发

- Lambda 获 4.8 亿美元融资助力 AI 云:Lambda 宣布完成 4.8 亿美元 D 轮融资,以增强其 AI 计算资源,旨在成为专为 AI 定制的云服务首选。

- Arize AI 融资 7000 万美元以完善 AI 评估:Arize AI 获得资金以推进 AI 评估和可观测性,确保 AI Agent 大规模可靠运行。

- Baseten 和 Together Compute 豪赌 2025 年推理热潮:Baseten 融资 7500 万美元,Together Compute 融资 3.05 亿美元,双方都在为他们认为的 AI 推理技术关键年做准备。

第一部分:高层级 Discord 摘要

OpenAI Discord

- Grok 3 表现优于 OpenAI 模型:Grok 3 在基准测试和解决 ChatGPT Pro 难以处理的代码任务方面表现出更优越的性能。

- 用户对 Grok 3 的能力表现出更强的信心,报告称它解决了 o1 Pro 无法解决的复杂问题,并考虑转向 SuperGrok。

- SuperGrok 提供更好的订阅价值:每月 30 美元的 SuperGrok 被认为比 ChatGPT Pro 每月 250 美元的订阅更具性价比。

- 用户认为 SuperGrok 在性能和使用限制方面具有优势,导致许多人重新评估其 AI 服务订阅。

- Grok 语音模式的期待:社区成员期待 Grok 即将推出的功能,如语音模式和自定义指令,认为这些功能将进一步增强其效用和竞争力。

- Grok 3 模型的 API 因其无限制的能力而受到关注,允许进行广泛的交互,而没有某些其他模型中常见的严格限制。他们正在积极寻求更多集成。

- 提议保存聊天 URL 以返回有价值的讨论:一位成员提议保存聊天的 URL,以便轻松返回有价值的讨论,并鼓励他人在指定频道分享想法,以便 OpenAI 看到。

- 他们还建议使用 ‘good1’ 或 ‘Track this chat’ 等关键词来帮助记住重要的聊天记录。

- 预期的提示词工程故障排除:一位成员表达了对通话的渴望,以确定问题是由于 prompt 还是软件故障引起的,这比预期花费了更多时间。

- 该成员感谢他人的有益建议,表示将记住这些见解以备将来参考,但在特定情况下需要“其他东西”。

Codeium (Windsurf) Discord

- DeepSeek-V3 授予无限访问权限!:DeepSeek-V3 现在对 Windsurf Pro 和 Ultimate 计划用户无限开放,提供 0 prompt credits 和 0 flow action credits 的不受限访问。

- Windsurf 鼓励用户查看此推文以了解有关此更改的更多信息。

- MCP 用例引发关注:Matt Li 分享了 MCP 内容,鼓励用户在 X 上探索其潜力,突显了社区对参与的渴望。

- 一个快速演示展示了 MCP 如何在 Cascade 中工作,为仍在探索其功能的人提供资源。

- Codeium 插件面临 EOL 猜测:用户对 JetBrains Codeium plugin 可能不再受支持表示担忧,对其缺乏方向感感到沮丧。

- 一位用户感叹道:看到 Codeium 作为一个插件被放弃真是太遗憾了。

- Cascade 的记忆系统需要改进:鼓励用户使用 ‘add to memory’ 和 ‘update memory’ 等命令来帮助 Cascade 记住项目细节,而将全局规则组织到单独文件中的提议结构旨在提高 Cascade 的性能。

- 关于 DeepSeek-V3 与 Cascade Base 优势的讨论。

- Windsurf 用户等待支持:用户报告在收到支持工单回复方面存在延迟,包括主题行中缺少带有预期工单编号的自动回复。

- 关于支持通信的正确电子邮件来源仍存在困惑。

Unsloth AI (Daniel Han) Discord

- Unsloth 发布 Long Context GRPO:Unsloth 发布了 Long Context GRPO,仅需 5GB VRAM 即可训练推理模型,承诺实现 10x 的上下文长度提升和 90% 的 VRAM 占用减少,详见此推文。

- 用户表达了兴奋之情并分享了他们的改进成果,同时感谢 Unsloth 提供免费资源,例如这个 Google Colab。

- 训练损失波动引发关注:用户观察到模型训练期间 training loss 存在显著波动,通常在多个 epoch 后才会稳定,用户正使用这个 Google Colab 进行调整。

- 社区建议调整 learning rate 并保持训练提示词(prompts)的清晰度,以减少 overfitting 并增强学习效果,这在 Unsloth 文档中也有提及。

- 5090 Mobile 规格激发升级幻想:RTX 5090 Mobile 将配备 24GB 显存,预计下周开始预订。

- 该公告引起了正积极考虑硬件升级的社区成员的兴趣。

- RAG 与 Fine-tuning 的细微差别揭晓:分享了一段名为 “RAG vs. Fine Tuning (Live demo)” 的 YouTube 视频,探讨了 fine tuning 是否比传统的 RAG 系统产生更好的结果。

- 观众要求提供更多比较 RAG 和 fine tuning 的案例,暗示了对未来演示中更全面见解的需求;创作者表示计划制作后续视频,详细介绍如何开始使用 Kolo。

- Triton 的自定义汇编效果显著:对挑战评分系统中的 custom_asm_works 含义进行了澄清,解释其涉及 Triton 中的 inline assembly,允许在没有 CUDA 的情况下对张量执行,详见 Triton 文档。

- 这被用作一种改进硬件内聚计时问题的技术,也是当前工作的重点。

LM Studio Discord

- 混元图像生成对 VRAM 要求较高:用于图像生成的 Hunyuan 模型现已可用,但至少需要 24GB VRAM,且主要在 NVIDIA 显卡上运行,生成视频内容需要几分钟时间。

- 用户热衷于测试 Hunyuan 与其他平台的能力对比。

- 用于 AI 任务的 A100 GPU:用户讨论了在 LM Studio 中使用 A100 GPU 的效用,强调了其 80GB VRAM 容量对 AI 任务的支持。

- 尽管成本可能很高,但人们对获取 A100 以提升性能表现出浓厚兴趣。

- AMD Ryzen AI Max+ CPU 媲美 RTX 4090:Ryzen AI Max+ 的规格引起了关注,有文章称其在 LLM 工作负载上击败了 Nvidia RTX 4090。

- 在独立基准测试出炉前,人们对其与现有 GPU 相比的实际性能仍持怀疑态度。

- Apple Silicon 因焊接组件受到批评:围绕 Apple 在笔记本电脑中焊接组件的讨论,这限制了可维修性和升级性。讨论还涉及对集成设计趋势限制内存配置灵活性的担忧。

- 用户表达了对允许硬件升级的系统的偏好。

- 推测解码深度探讨:根据用户反馈,某些模型的 Speculative decoding(推测解码)可能会导致较低的 token 接受率和较慢的性能。

- 用户分享了关于 token 接受率的经验,并询问了旨在最大化性能的最佳模型设置。

aider (Paul Gauthier) Discord

- Grok 3 占据领先地位:用户发现 Grok 3 的表现比 GPT-4o 更快,一些人为此取消了其他订阅,称 Grok 3 为他们的“最佳拍档”,因为它性能出色、价格更便宜且 UI 友好,参考 此 X 帖子。

- 值得注意的是,根据 xAI 的推文,Grok 3 目前免费提供(直到他们的服务器宕机),并为 Premium+ 和 SuperGrok 用户增加了访问权限。

- Aider 面临 Linux 参数大小限制:一位用户报告称,由于 Linux 参数大小限制,特别是深层嵌套的目录路径,很难向 Aider 传递大量文件。

- 他们建议使用带有

/load命令的文本文件作为变通方案,同时指出虽然仓库包含许多小文件,但嵌套目录路径的长度是一个主要问题。

- 他们建议使用带有

- SambaNova 夺得 DeepSeek-R1 效率桂冠:SambaNova 宣布,与现有模型相比,其提供的 DeepSeek-R1 服务在速度和成本上都有显著降低,达到了每秒 198 tokens,详见 其新闻稿。

- 根据一篇 Kotlin 博客文章,这一声明将 DeepSeek-R1 定位为高效模型,在 AI 模型应用和实现方面取得了重大进展。

- Aider 字体颜色引发可见性争议:用户对 Aider 中的字体颜色可见性表示担忧,尤其是浅色模式下的蓝色。

- 建议包括检查深色模式设置并确保正确配置以解决可见性问题。

- RAG 配置优于 AI Chat:一位成员表示,目前的 RAG 配置在编码需求方面比 AI Chat 的 RAG 功能效果更好。

- 另一位成员表示赞同,指出普通的 RAG 在处理代码时表现不佳,需要改进。

Cursor IDE Discord

- Cursor IDE 引发争议:用户报告了 Cursor 的 Sonnet 3.5 性能问题,对与之前版本相比的可靠性表示沮丧。

- 相比之下,Grok 3 在编码任务中的速度和解决问题的有效性受到了称赞,尽管一些人批评其所有者和过去的表现,以及缺乏 API 访问权限;参见 Grok 3 是一个…有趣的模型。

-

MCP 服务器令人头疼:用户讨论了在 Cursor 中设置和运行 MCP 服务器 的复杂性,一些人发现很难有效利用它;查看 [Perplexity Chat MCP Server Smithery](https://smithery.ai/server/@daniel-lxs/mcp-perplexity)。 - 社区成员建议,改进文档可以提升用户体验并简化安装,并指出 MCP 配置是针对 OSX 和 Linux 特有的,参见 issue #9 · anaisbetts/mcp-installer。

- AI 模型性能受到质疑:参与者对当前 AI 模型(尤其是 Claude)的性能表示不满,将输出的不一致归因于底层的 Prompting 和上下文管理问题。

- LLM 的响应变化是预料之中的,这突显了这些模型的随机性,但一些人希望 Grok-3 以及 Windsurf Pro 和 Ultimate 计划中提供的新 DeepSeek-V3 能有更好的表现,参见 Windsurf (@windsurf_ai) 的推文。

- 开发者工具引发挫败感:用户报告了使用 Cursor Tab 的挑战,一些人表示它在开发过程中引入了 Bug,减慢了工作流程。

- Cursor Composer 因生成更强大、更可靠的代码而受到称赞,但总体而言,开发者们正期待着由 Rainier AI 计算集群 提供支持的下一代 Amazon 和 Anthropic 模型,参见 Amazon 宣布与 Anthropic 合作推出新的“Rainier” AI 计算集群。

HuggingFace Discord

- Hugging Face 精装书上架:围绕新发布的 Hugging Face 主题精装书,大家反响热烈,这标志着在最近的博客文章中庆祝的一年团队合作成果。

- 感兴趣的人应该尽快行动以确保获得一本。

- Qwen2.5 取得训练突破:利用 Unsloth 的新算法,用户现在只需 5GB VRAM 即可训练 Qwen2.5 推理模型,实现 10倍长的上下文长度和 90% 的 VRAM 节省,详情见此博客。

- 这些改进为开发者提供了实用的工具。

- HF Spaces 托管快速视频生成器:讨论强调了 HF Spaces 上视频生成器的可用性,其中 ltxv 因其速度脱颖而出,仅需 10-15 秒即可生成视频。

- 有一个新的协作计划,旨在基于最新发布版本创建一个视频生成器。

- CommentRescueAI 加速 Python 文档生成:CommentRescueAI 是一款只需点击一下即可为 Python 代码添加 AI 生成的 docstrings 和注释的工具,现已在 VS Code 扩展市场上线。

- 开发者正在寻求社区关于改进想法的建议。

- Lumina2 使用 LoRA 进行微调:一个使用 LoRA 的 Lumina2 新微调脚本现已发布,在 Apache2.0 许可证下增强了用户能力,更多信息请参阅文档。

- 这促进了 AI 技术上的开放协作。

Perplexity AI Discord

- Perplexity AI 用户遭遇故障:用户报告了使用 Perplexity AI App 的挫败体验,提到在文本生成过程中存在延迟、高资源消耗和故障,但开发者可能正在处理。

- 特别是针对模型的性能提出了担忧,引发了关于开发团队是否正在积极解决这些持续问题的询问。

- 用户称 Grok 3 幻觉严重:围绕 Grok 3 的讨论显示出复杂的情绪;一些用户认为它比之前的模型表现更好,而另一些用户则注意到明显的幻觉行为。

- 用户将 Grok 3 与 Claude 和 O3 的组合进行了比较,通常更倾向于 Claude 以获得更可靠的性能。

- 墨西哥与 Google 在海湾地区的对峙:墨西哥采取大胆行动,就其在海湾附近的运营对 Google 发出威胁,凸显了持续的管辖权争议。

- 这一冲突凸显了科技公司与国家监管机构之间在机器学习使用方面日益增长的紧张关系。

- Sonar API 的困境引发担忧:一位用户对 Sonar API 的性能表示担忧,发现其结果比 llama-3.1-sonar-large-128k-online 等旧模型更差。

- 该用户报告称,旧模型在获取网站信息等任务中表现更好,对尽管价格相似但质量下降的情况表示失望。

- 传言 Deep Research API 即将推出:成员们正在询问将 deep research 能力集成到 API 中的可能性,这可能会带来令人兴奋的新功能。

- 一位用户表达了热情,感谢 Perplexity 团队在这一领域的持续工作。

Interconnects (Nathan Lambert) Discord

- 沙特阿拉伯发布 ALLaM:由沙特阿拉伯支持的 ALLaM 专注于创建阿拉伯语语言模型,以支持阿拉伯语技术生态系统,这代表了在当前地缘政治环境下对 LLM 的推动。

- 该模型可以生成阿拉伯语和英语文本,拥有 70B 参数。

- Mercor 为 AI 招聘融资 1 亿美元:Mercor 为其 AI 招聘平台融资 1 亿美元,该公司由年轻的 Thiel Fellows 创立,此次融资凸显了其快速增长,估值跃升至 20 亿美元。

- 讨论集中在 Mercor 在竞争激烈的 AI 领域中创新的营销驱动力。

- 创新的 GRPO 算法降低 VRAM 需求:Unsloth 发布了一种新的 GRPO 算法,将 Qwen2.5 训练的 VRAM 需求降低到仅 5GB,标志着重大改进。

- 该算法支持 10 倍长的上下文长度,提供了简化的设置,可能彻底改变模型训练效率。

- Nadella 宣传微软,但产品质量存疑:在最近的一段 YouTube 视频中,Satya Nadella 在宣传经济增长和微软的拓扑量子比特(topological qubit)突破的同时,分享了他对 AGI 的怀疑。

- 成员们表达了沮丧,质疑当 Teams 和 Copilot 等 Microsoft 产品表现不佳时,Satya Nadella 为何能被正面看待。

OpenRouter (Alex Atallah) Discord

- 推理 Token 引发不满:用户对 OpenRouter 实现中较低的 max_tokens 表示不满,这导致当 include_reasoning 默认为 false 时出现空响应或 null 响应。

- 提议的更改包括将 include_reasoning 默认设置为 true,并确保内容始终为字符串,避免 null 值以提高响应一致性,目前正通过投票收集社区意见。

- Weaver 扩展提供多功能选项:Weaver Chrome 扩展提供了高度可配置的选项,如 PDF 支持、与 Supabase 的云同步以及从浏览器直接进行 API 调用。

- 虽然目前免费且托管在 Vercel 的免费计划上,但由于使用限制,它可能面临访问限制,且没有后端数据日志记录。

- API 翻译器转为开源:一位用户分享了一个新开发的开源 Chrome 扩展,可通过 GitHub 获取,允许用户将任何内容转换为他们喜欢的风格。

- 该工具仅需要一个兼容 OpenAI 的 API 即可运行。

- Gemini 输出故障引发抱怨:用户报告了 Gemini 2.0 Flash 模型的结构化输出问题,指出在与 OpenRouter 集成时与 OpenAI 的模型存在差异。

- 反馈表明需要更清晰的 UI 指示模型能力,特别是关于输入类型和错误消息。

- DeepSeek 的性能下降令人担忧:一些用户报告称,DeepSeek 模型最初产生高质量响应,但随后在 OpenRouter 内部的响应质量显著下降。

- 讨论涉及了响应质量下降的可能原因和缓解策略。

Nous Research AI Discord

- Grok3 基准测试受到质疑:关于 Grok3 的性能和基准测试出现了疑问,成员们指称 xAI 可能在 cons@64 的使用数据上存在隐瞒。

- 质疑者对 Grok3 超越现有最先进模型的说法提出挑战,并分享了具体的反例。

- 用于神经网络优化的 EAs?:社区讨论了使用 evolutionary algorithms (进化算法) 来优化 neural networks,考虑到在高维情况下大规模扩展时收敛速度较慢的问题。

- 成员们讨论了在特定的训练流水线组件中使用 GAs 以提高模型性能,并将其与传统的 backpropagation 进行了对比。

- 代码数据集分享:成员们在 Hugging Face 上分享了代码数据集,建议将其用于增强现有模型。

- 对话强调了数据集质量的重要性,以及使用先进的推理模型(如 NovaSky-AI/Sky-T1_data_17k)重新加工现有数据集的可能性。

- Agents 协作进行优化:一位成员询问了关于 agents 协作以针对某一目标完善想法的研究,重点关注沟通机制和方法论。

- 对话中引用了一些个人实验,在这些实验中,agents 通过讨论和完善流程来实现特定结果,从而达到目标优化。

- Equilibrium Propagation 优于 Backprop?:社区探讨了 equilibrium propagation 作为训练基于能量的模型时 backpropagation 的替代方案,强调了其如 Equilibrium Propagation: Bridging the Gap Between Energy-Based Models and Backpropagation 所示的将预测推向最小误差配置的能力。

- 讨论涵盖了 equilibrium propagation 与 recurrent backpropagation 之间的相似性,强调了其在神经网络训练技术中的潜在应用,正如 Equivalence of Equilibrium Propagation and Recurrent Backpropagation 中所讨论的那样。

Yannick Kilcher Discord

- Logits 在训练中表现优于概率:讨论强调 logits 比归一化后的概率包含更多信息,认为不必要的归一化可能会阻碍优化。

- 共识是,虽然概率对于决策至关重要,但利用 logit space 可以优化特定模型的训练效率。

- Sparse Attention 受到关注:参与者探讨了 DeepSeek 关于 Native Sparse Attention 的论文,指出了其在效率和增强上下文理解方面的意义。

- 他们赞赏 DeepSeek 高标准的钻研精神以及使研究成果易于获取的能力。

- Microsoft 进入拓扑量子比特领域:Microsoft 推出了 Majorana 1,这是首个利用拓扑量子比特的 QPU,旨在实现高达一百万个量子比特的可扩展性,详见 Microsoft Azure Quantum Blog。

- 一段由 Microsoft 团队参与的 YouTube 视频 解释了 topological qubits 的重要性及其重新定义量子计算的潜力。

- Perplexity 突破审查障碍:据 The Decoder 报道,Perplexity AI 推出了 R1 1776,旨在通过专门的 post-training 技术绕过 Deepseek R1 模型中的审查。

- 这一进展展示了 AI 在应对和克服监管限制方面日益增长的作用。

- Google 发布 PaliGemma 2:愿景飞跃:Google 发布了 PaliGemma 2 mix checkpoints,这是一款增强型视觉语言模型,提供多种预训练尺寸,记录在他们的 博客文章 中。

- 该模型专为跨各种任务的 fine-tuning 而设计,在图像分割和科学问题回答等领域表现出色。

GPU MODE Discord

- Sakana AI 的 AI CUDA Engineer 自动化优化:AI CUDA Engineer 自动化生产高度优化的 CUDA kernel,声称比 PyTorch 中常见的机器学习操作快 10-100 倍。

- 该系统还发布了一个包含 17,000 多个经过验证的 CUDA kernel 的数据集以及一篇详述其能力的论文,尽管一些用户认为由于基准测试(baselines)较弱,该论文可能存在过度炒作。

- Unsloth 揭晓 10 倍上下文和 90% VRAM 节省:Unsloth 宣布了新算法,使得 Qwen2.5-1.5B 模型仅需 5GB VRAM 即可进行训练,实现了 90% 的 VRAM 占用减少,详情见其 blog。

- 对比基准测试显示,此前在 20K 上下文下为 Llama 3.1 运行标准的 GRPO QLoRA 设置需要 510.8GB VRAM,现在通过利用受 Horace He 实现启发的 gradient checkpointing algorithm,已降至 54.3GB。

- RTX 5080+ 面临 Triton 兼容性问题:一位成员分享了在 Triton 上使用 TorchRL 运行 RTX 5080+ 的经验,强调了与

torch.compile触发 Triton 相关的错误,最终通过移除 PyTorch-triton 安装解决了该问题。- 这引起了人们对 Triton 与 PyTorch 交互中仍然存在的兼容性问题的关注。

- Raw-Dogged Tensors 赢得置换胜利:一位成员提出了一种名为 raw-dogged Tensor 的新命名法,旨在使存储格式与 MMA_Atom 线程布局保持一致,并指出这显著降低了置换(permutation)复杂度。

- 另一位成员确认在 int8 matmul 中使用了这种方法,并强调这是避免 shared-memory bank conflicts 的必要手段。

Stability.ai (Stable Diffusion) Discord

- Stable Diffusion 略胜 Flux:成员们发现 Stable Diffusion (SD) 比 Flux 更精致,尽管他们承认 Flux 仍处于活跃开发中。

- 一位成员建议对比示例图像,看看哪种模型更符合个人品味。

- ControlNet 掌控图像姿态:ControlNet 使用深度图(depth maps)或线框图(wireframes)从姿态生成图像,处理诸如“手在前”或“手在后”等调整,以实现创意控制。

- 成员们指出,控制方法能够根据姿态实现精确的图像生成。

- DIY 自定义模型:一位用户询问关于聘请兼通 Stable Diffusion 和艺术的艺术家来创建自定义模型和提示词风格的事宜,引发了关于实用性的讨论。

- 社区建议,从长远来看,学习如何创建模型会更有益且更具成本效益。

- 从涂鸦到 AI 图像:一位用户分享了他们在 iPad 上使用草图引导 AI 图像生成的流程,寻求关于将涂鸦细化为成品图像的建议。

- 该用户发现 img2img 很有用,但想寻找从简单涂鸦开始的方法。

- Nvidia GPU 仍是图像生成的王者:Nvidia GPU 是流畅运行 Stable Diffusion 的推荐选择,而 AMD 选项可能会有性能问题。

- 用户分享了 GPU 配置,并讨论了模型与 GPU 能力的兼容性。

Eleuther Discord

- AI CUDA Engineer 引发质疑:AI CUDA Engineer 是一个声称在 CUDA kernel 生成方面能实现 10-100倍加速 的 AI 系统,但人们对其评估的准确性以及类似项目之前的误导性陈述产生了怀疑。

- 批评指出,一个所谓的 150倍加速 kernel 存在内存重用和根本性的 bugs,导致人们对生成的 kernel 的可靠性产生怀疑。

- 社区辩论 LLM-compiler 的可行性:成员们推测 LLM-compiler 是否能将高级 PyTorch 代码翻译成优化的机器代码,引发了热烈的讨论。

- 虽然很有趣,但大家达成共识,认为巨大的挑战(特别是缺乏通用指令集)可能会阻碍进展。

- Clockwork RNN 架构回归:围绕 Clockwork RNN(一种针对不同输入粒度使用独立模块的修订架构)的讨论引起了关注。

- 成员们辩论了此类架构在未来模型中的可行性,包括空洞卷积 (dilated convolutions) 和注意力机制 (attention mechanisms) 的应用。

- Llama 3.2 TPS 中的 NeoX vs NeMo:对 NeMo 和 NeoX 在 Llama 3.2 1B 配置 下的对比显示,NeoX 为 21.3K TPS,而 NeMo 为 25-26K TPS,配置文件已公开。

- 成员分享了 WandB run 以提供详细指标,供他人优化其设置。

Notebook LM Discord

- 播客 TTS 面临挑战:一位用户报告了 NotebookLM 中的 TTS 功能无法正确读取和解释其播客输入提示词的问题。

- 该用户表示,尽管尝试了各种提示词,但仍无法实现其播客主持人所需的语气,感到非常沮丧。

- 非 Google 用户访问权限辩论:一位成员询问是否可以像 Google Docs 一样,邀请没有 Google 账号的用户访问 NotebookLM 笔记本。

- 讨论强调了为那些未集成到 Google 生态系统中的用户提供替代协作方法的必要性。

- 通过播客探索特斯拉专利:一位用户在专利授权后分析了特斯拉的自动驾驶 AI,重点关注了 Lidar、Radar 和 Ultrasonics 等技术,并在播客中进行了讨论。

- 该用户在其 Patreon 上提供了一篇 免费 文章,邀请听众进一步探索他们的发现。

- AI 双人组助力 Homeschooling:一位用户分享了他们在 Homeschooling 过程中整合 NotebookLM 与 Gemini 的成功经验,并将其比作拥有了技术娴熟的助手。

- 这两个工具之间的协同作用显著帮助了教学工作的执行,提升了学习体验。

- AI 在文学细微差别处理上的挣扎:用户对 AI 对文学作品的误读 表示担忧,理由是 AI 误解了角色细节和叙事细微差别。

- 在某些情况下,即使提供了直接证据,AI 也会拒绝纠正,从而与原著的完整性产生冲突。

Torchtune Discord

- Torchtune 2025 年初路线图发布:2025 年上半年的官方 Torchtune 路线图已在 PyTorch dev-discuss 上发布,概述了该期间为 Torchtune 规划的关键方向和项目。

- 各种项目的完整 PyTorch 路线图集也可以在 dev-discuss 上访问,展示了整个平台令人兴奋的发展和正在进行的工作。

- Packing 导致 VRAM 爆炸:在 max_tokens 长度下对数据集使用 Packing 会显著增加 VRAM 需求,导致在 16K 序列长度时出现 out-of-memory 错误。

- 一位用户报告在不使用 Packing 的情况下内存占用为 30GB,强调了巨大的资源影响。

- 注意力机制辩论升温:讨论围绕整合非传统 Transformer 技术(如稀疏注意力和注意力压缩)的优先级展开,以提高序列缩放效率。

- 反馈表明存在兴趣,但由于既定方法的限制,整合新研究面临阻力。

- AdamWScheduleFree 作为优化器出现:关于 AdamWScheduleFree 作为 llama3.1 8B DPO 默认优化器的潜力正在讨论中,该优化器已在 2 个节点 16 个 GPU 上进行了测试。

- 提出了一种涉及调整 full-dpo Python 脚本的变通方法,以解决之前 FSDP 的问题。

- Hugging Face 发布 UltraScale Playbook:一位用户分享了托管在 Hugging Face 上的 UltraScale Playbook 链接,称其令人耳目一新。

- 该指南旨在指导用户在实际框架内扩展模型使用。

Latent Space Discord

- Baseten 获 7500 万美元融资,瞄准 2025 年推理市场:Baseten 宣布了由 @IVP 和 @sparkcapital 领投的 7500 万美元 C 轮融资,将 2025 年确定为 AI 推理技术的关键年份。

- 本轮融资包括来自 @01Advisors 的 Dick Costolo 和 Adam Bain 等新投资者,强调了 Baseten 的增长以及在 AI 基础设施领域的潜力;参见公告推文。

- Mastra 的 Agent 开放使用:开源项目 Mastra 推出了一款基于 Vercel AI SDK 构建 AI Agent 的 JavaScript SDK,强调集成和易用性;查看 Mastra 的 Agent 文档。

- 开发者正在探索 Mastra Agent 处理访问第三方 API 和自定义函数等任务的能力,从而增强工作流自动化。

- Arize AI 融资 7000 万美元押注可观测性:根据其 C 轮融资公告,Arize AI 已筹集 7000 万美元 C 轮融资,以推进生成式和决策模型中的 AI 评估与可观测性。

- 他们的使命是确保 AI Agent 在大规模运行时可靠工作,应对 AI 技术新发展带来的挑战。

- Lambda 融资 4.8 亿美元,目标 AI 云:Lambda 披露了由 Andra Capital 和 SGW 领投的 4.8 亿美元 D 轮融资,以巩固公司在 AI 计算资源领域的地位;参见 stephenbalaban 的公告。

- 这笔资金将帮助 Lambda 增强其作为专为 AI 定制的云服务的地位,提升其能力和产品以满足日益增长的行业需求。

- OpenAI’s 用户基数飙升:据 Brad Lightcap 称,OpenAI 报告 ChatGPT 每周活跃用户超过 4 亿,在不到三个月的时间里增长了 33%。

- 备受期待的 GPT-5 承诺向所有人提供免费无限使用,预计将整合现有模型,加剧 AI 领域的竞争。

MCP (Glama) Discord

- SSE 实现上线:一位成员确认在其项目中成功实现了 /sse,标志着 MCP functionality 的增强。

- 详情可在指定频道查看,突显了持续的改进。

- Glama 调试遭遇 Cursor 混淆:一位成员报告了在调试 Glama hosted models 时遇到的问题,Cursor 无法定位工具。

- 该问题主要归因于 node 路径使用不当以及可能遗漏了必要的引号,这占了 99% 的问题原因。

- 解决 Docker 安装困惑:一位新成员在通过 Docker 构建命令进行 Puppeteer installation 时需要帮助,随后对其进行了目录导航方面的澄清。

- 提供的指导确保了他们处于正确的父目录中,并解释了命令中

.的用法。

- 提供的指导确保了他们处于正确的父目录中,并解释了命令中

- Python REPL 加入 MCP:一位成员分享了一个支持 MCP STDIO 的简单 Python REPL 实现,并提供了最新的镜像以及 GitHub repository 链接。

- 关于 IPython support 的咨询得到了乐观回应,未来可能会添加,为进一步开发开辟了途径。

- Docker 部署步骤已明确:一位成员分享了一篇关于部署 Docker 化 MCP servers 的 blog post,解决了跨架构的环境搭建挑战。

- 该文章强调了 Docker 在确保开发环境一致性方面的作用,并提供了一份用于实现的 reference MCP Servers 列表。

Modular (Mojo 🔥) Discord

- MAX 25.1 直播已排期:已安排直播讨论 MAX 25.1,可以通过 LinkedIn 加入 并通过 Google Form 提交问题。

- 演讲者鼓励社区分享他们的问题,强调渴望听到社区的见解。

- Mojo 近期不太可能支持 Windows:由于在 Windows 上运行 AI clusters 的成本高昂,原生 Mojo Windows support 不在近期路线图中。

- 共识是 nix OSes 更适合计算任务,许多人转而使用云端 Linux 平台,从而降低了对 Windows 支持的紧迫性。

- 用于内存效率的 Slab Lists:一位成员将 slab list 定义为一种高效的数据结构,类似于

LinkedList[InlineArray[T, N]],旨在促进简洁性和良好的内存管理,并链接到了 nickziv/libslablist。- 该用户指出,这种结构在某些操作上可以达到 O(1) 性能,并且由于更好的缓存利用率,比链表提供更快的迭代速度。

- Mojo 弥合 Python 性能差距:大家一致认为 Mojo 源自 Python,但性能接近 C/C++/Rust,目标是未来实现类似 C++ 与 C 的兼容性。

- 社区认为 Mojo 的类型系统允许 Python-like 的体验,吸引了诸如 Nim 等语言的用户。

- Mojo 在底层易用性方面表现出色:一位成员评论说,与 C/C++ 相比,在 Mojo 中处理底层任务更加用户友好,表明 Mojo 使硬件利用变得更容易。

- 社区建议对于底层编码,Mojo 不需要严格遵循 Python 的语法,因为运行 Python 脚本对于许多用途来说已经足够了。

LlamaIndex Discord

- LlamaCloud 在欧盟上线:LlamaCloud EU 开启早期访问,提供全新的 SaaS 解决方案,具备安全的知识管理功能,并确保数据完全驻留在欧盟境内。

- 此次发布旨在为需要合规解决方案的欧洲公司扫清障碍,强调了安全性和数据驻留。

- LlamaParse 解析能力提升:LlamaParse 推出了全新的解析模式——Fast、Balanced 和 Premium,以有效满足多样化的文档解析需求。

- 这些升级增强了处理不同文档类型的通用性,以应对现有的文档解析挑战。

- Agent 陷入移交僵局:一位开发者报告了在多 Agent 工作流(multi-agent workflow)中,LLM 反复返回 ‘I am handing off to AgentXYZ’ 而不执行工具调用(tool calls)的问题。

- 建议包括将移交规则直接写入 system message 以更好地明确预期行为,但也有人担心这会破坏现有的 Prompt。

- Redis 竞态问题频发?:一位用户正在寻求策略,以有效地运行 1000 个并行批处理来持久化摘要索引(summary index),同时避免 Redis 中的竞态条件(race conditions)。

- 由于 Review Embeddings 存储在 Redis 命名空间中,该用户担心潜在的键冲突(key collisions)和资源限制。

- 诈骗币恶作剧!:关于在 Solana 上创建代币可能性的讨论,导致社区认为此类说法是诈骗(scams)。

- 此外,人们还对参与“诈骗币”项目的更广泛影响表示了担忧。

Cohere Discord

- 粉色状态受到关注:一位成员更新了他们的状态,显示为 “我现在是粉色的了。”

- 这种颜色变化可能有助于增加 Discord 社区的视觉动态。

- 身份共享提议遭到质疑:一位用户提议了一个涉及共享身份以获取 $100-1500 利润的合作机会,目标年龄段为 25-50 岁。

- 这引发了对此类安排中身份盗用影响的担忧,且对方未提供网站或相关文档,并引发了关于在公共论坛披露个人身份信息(PII)需保持谨慎的辩论。

- 请求关于没有咖啡的世界的文章:一位成员请求撰写一篇关于没有咖啡的世界所产生影响的文章,强调了其文化和经济意义。

- 这一请求表明了对咖啡不再可用的假设情景下生活方式变化的关注。

- 沟通清晰度被视为至关重要:书面沟通中的歧义引起了关注,建议使用更清晰的写作来防止误解。

- 成员们强调了改善沟通对于促进小组内积极协作的重要性。

AI21 Labs (Jamba) Discord

- 工程师深入研究 Jamba API:用户正积极探索 Jamba API,一位成员分享了用于发起 API 调用的代码并寻求语法帮助,而另一位成员则提供了详细的 API 使用大纲。

- 该综合大纲包括了 Header 和必要的参数,为频道内的其他工程师提供了实用指导。

- Jamba API 输出引发讨论:关于 Jamba API 的输出格式出现了担忧,特别是转义字符(escape characters)复杂化了不同语言中的数据处理。

- 确认了响应格式因语言而异,因此需要针对输出采用定制的处理方法。

- PHP 工程师处理 Jamba API 集成:一位 Symfony 和 PHP 工程师寻求关于将 Jamba API 响应转换为可用格式的建议,特别是处理特殊字符处理的问题。

- 其他成员指出可以针对 PHP 特定挑战和有效的输出处理寻求同行协助。

- 提议使用 AJAX 增强 Jamba API:一位成员建议利用 AJAX 来改进 Jamba API 的响应处理,尽管结果显示出不一致性。

- 注意到 Jamba 聊天窗口的输出格式有所不同,这影响了结果的呈现方式,并可能影响处理策略。

tinygrad (George Hotz) Discord

- 旧款 GeForce 在 RTX 4070 面前显得吃力:性能测试显示,一台旧款 GeForce 850M 在 8 秒后达到 3 tok/s,而 RTX 4070 在 1.9 秒内即可达到 12 tok/s。

- 然而,模型的整体可用性受到显著的计算成本和数值硬度(numerical stiffness)的限制。

- Int8 量化导致模型偏离轨道:成员指出,Int8 量化可能需要调整,因为在使用 Int8Linear 时,模型在几百个 token 后偶尔会“脱轨”。

- 有建议称,关于 tinychat 开发的讨论应在 私信或 GitHub 上进行,以便更加专注。

- 速度测试中 Torch 略胜 Tinygrad:速度测试表明,在 2048x2048 张量上,torch 的表现优于 tinygrad,torch 为 0.22 ms,而 tinygrad 为 0.42 ms。

- 然而,在 4096x4096 张量上,tinygrad 仅比 torch 慢 1.08 倍,这表明其缩放性能经过了优化。

- BEAM 可能提升性能:增加 BEAM 值可能会缓解性能限制,测试显示在 torch 中 BEAM=10 时,2048x2048 张量的耗时为 0.21 ms。

- 不同张量大小下的性能表现一致,突显了更高 BEAM 配置的潜在收益。

- 新的 PyTorch 频道上线:已创建一个专门用于 PyTorch 讨论的新频道。

- 意图是随着用户贡献的增加,鼓励更专注、更深入的交流。

Nomic.ai (GPT4All) Discord

- 系统消息(System Message)术语引发困惑:一位成员澄清说,UI 中现在使用了 “system message” 一词,表明命名惯例发生了变化。

- 另一位参与者肯定地表示,在操作这些系统时,旧习惯很难改变。

- 系统消息中的指令:纯英文可以吗?:提到在 “system message” 中可以使用纯英文指令,大多数模型都会遵循这些命令。

- 一些成员对这一过程的简便性表示怀疑,询问使用 Jinja 或 JSON 代码是否更有效。

- GPT4All 在图像处理方面表现不佳:一位成员询问是否可以像其他 AI 平台一样直接将图像粘贴到文本栏中,但得到的答复是 GPT4All 无法处理图像。

- 建议使用外部软件来完成此类任务。

- Nomic 和 NOIMC v2:是真的吗?:一位成员对 NOIMC v2 的实现表示困惑,质疑为什么它看起来实现得不正确。

- 另一位成员幽默地寻求确认自己是否在 Nomic 频道,以此表达他们的沮丧。

LLM Agents (Berkeley MOOC) Discord

- 2024 年 LLM Agents 课程依然有用:一位成员建议,虽然不是必须的,但旁听此 YouTube 播放列表中的 2024 年秋季课程可以加深理解,特别是对于 DSPy。

- 他们指出,本学期的教学大纲中没有 DSPy,这使得 2024 年秋季课程对那些对其感兴趣的人特别有用。

- LLM Agents 课程测验已存档:针对测验从当前教学大纲中消失的困惑,一位成员分享了 2024 年秋季课程的测验存档链接,位于此处。

- 那些开始学习较晚并想赶上进度的学生现在可以访问这些测验。

- 在 MOOC 上查找测验入口:针对寻找测验 1 和 2 的用户,有人指出可以在 MOOC 的页面或公告页面找到测验。

- 还提到所有证书均已发放,并鼓励学生报名参加 2025 年春季班。

- 课程结业通知:LLM Agents MOOC 已结束,但视频讲座在教学大纲中仍可访问。

- 所有证书均已发放,鼓励学生报名参加 2025 年春季班。

DSPy Discord

- Qwen/Qwen2.5-VL-7B-Instruct 在 HaizeLabs Judge Compute 上的评分存在差异:一位成员复现了与 HaizeLabs Judge Compute 相同的数据集,并发现使用 Qwen/Qwen2.5-VL-7B-Instruct 模型的评分范围从 2-stage 优化的 60%-70% 到 mipro2 的 88.50% 不等。

- 名为 LLM-AggreFact_DSPy 的项目已在 GitHub 上共享,其中包含与评估相关的源代码,可以更深入地了解所使用的方法论。

- Leonard Tang 发布 Verdict 库:Leonard Tang 发布了 Verdict,这是一个针对 judge-time compute scaling 的库,并指出 AI 的可靠性问题源于评估而非生成。

- 他强调,AI 的下一个进步应该集中在评估的改进上,这与对 pre-training 和 inference-time scaling 的强调形成了对比。

- DSPy 对话历史探讨:一位成员询问 DSPy 是否会自动将对话历史注入到调用中,这表明在进一步实现之前需保持谨慎。

- 这凸显了在不无意中覆盖先前上下文的情况下管理 AI 交互的潜在复杂性,特别是在更复杂的应用中。

- 导出 Prompt 到消息模板的说明:一位成员分享了一个 FAQ,解释了如何通过使用带有

dspy.ChatAdapter()的 Python 代码片段来冻结并导出 Prompt 到消息模板中。- 对方澄清说,这种方法会导致控制流逻辑丢失,并建议使用

program.save()或program.dump_state()作为更全面导出的替代方案。

- 对方澄清说,这种方法会导致控制流逻辑丢失,并建议使用

MLOps @Chipro Discord 没有新消息。如果该服务器长时间保持沉默,请告知我们,我们将将其移除。

Gorilla LLM (Berkeley Function Calling) Discord 没有新消息。如果该服务器长时间保持沉默,请告知我们,我们将将其移除。

第 2 部分:按频道详细摘要和链接

为了便于邮件阅读,完整的频道逐项细分已被截断。

如果您喜欢 AInews,请分享给朋友!预谢!