ainews-deepseeks-open-source-stack

DeepSeek 开源技术栈

PySpur 对 DeepSeek 的开源周进行了总结,重点介绍了多项引人注目的发布。Qwen QwQ-32B 模型被微调为 START,在博士级科学问答和数学基准测试中表现卓越。由 Hedra Labs 和 Together AI 推出的 Character-3 是一款全模态 AI 视频生成模型,能够创作逼真的动画内容。Google DeepMind 推出了具有 8k 上下文窗口的 Gemini 嵌入模型,在 MMTEB 榜单上排名第一,同时还发布了支持 Python 库和自动修复功能的 Gemini 2.0 代码执行器。Inception Labs 的 Mercury Coder 是一款基于扩散模型的代码生成模型,提供了更快的 Token 处理速度。OpenAI 发布了 GPT-4.5,这是他们迄今为止最大的模型,但在推理能力上不及某些竞争对手。AI21 Labs 推出了 Jamba Mini 1.6,其输出速度据称优于 Gemini 2.0 Flash、GPT-4o mini 和 Mistral Small 3。一个包含 190 万个扫描页面的新数据集已发布用于 OCR 基准测试,Mistral OCR 展示了具有竞争力的文档解析性能,但与基于 LLM/LVM 的方法相比尚未达到顶尖水平。“你需要的只是顶级工程师(Cracked engineers)。”

Cracked engineers are all you need.

AI 新闻(2025年3月7日-3月8日)。我们为您检查了 7 个 subreddits、433 个 Twitter 账号 和 28 个 Discord(224 个频道,4696 条消息)。预计节省阅读时间(按 200wpm 计算):406 分钟。您现在可以标记 @smol_ai 进行 AINews 讨论!

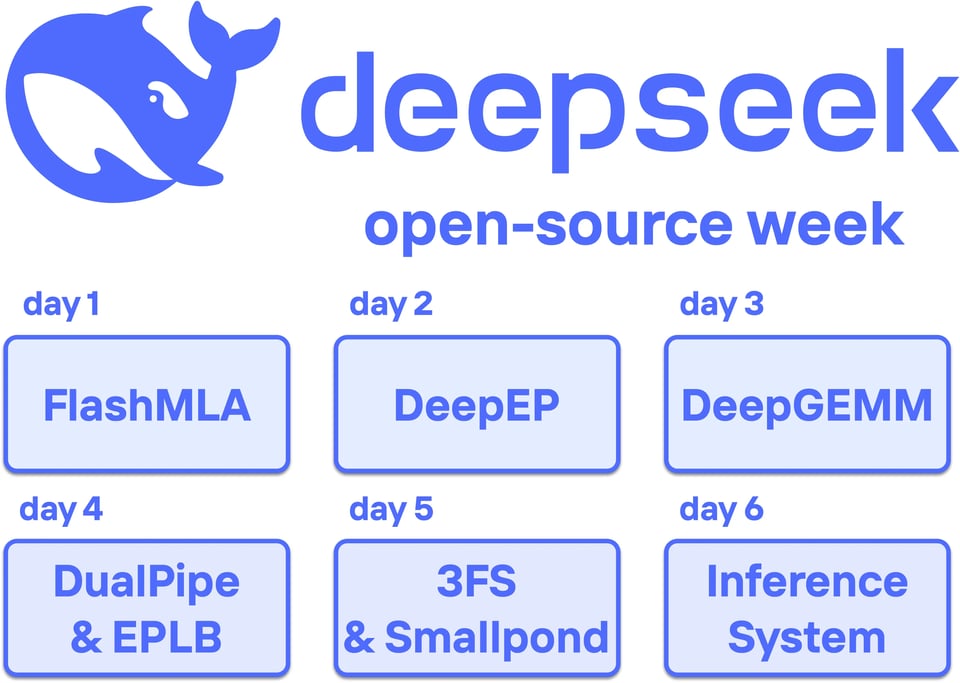

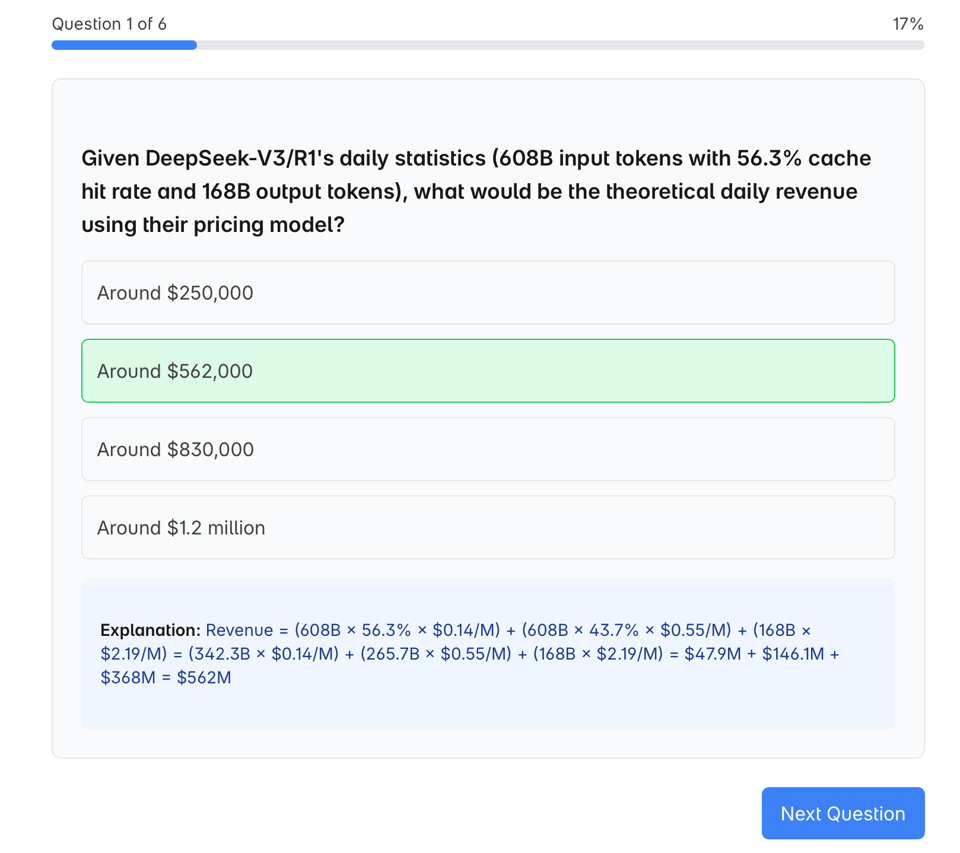

我们之前不太确定该如何报道 2 周前 DeepSeek 的“开源周”(Open Source Week),因为虽然每次发布都各具特色,但并未完全达到“普遍实用”的标准,而我们致力于报道“每日头条新闻”。不过,PySpur 的朋友们帮了我们一个忙,整理并总结了所有的发布内容:

它甚至还附带了小测验来测试您的理解和记忆!!

我们认为,这些内容整体上值得深入学习和内化。

AI Twitter 综述

模型与发布

- Qwen QwQ-32B Model: @_akhaliq 宣布发布 START,这是一个带有工具的自学推理器(Self-taught Reasoner with Tools),基于 Qwen-32B model 微调而成。START 在博士级科学问答 (GPQA)、竞赛级数学基准测试以及 LiveCodeBench 基准测试中均取得了极高的准确率。@lmarena_ai 欢迎 Qwen QwQ-32B 加入 Arena 进行对话,并指出根据 @reach_vb 的说法,它在 Hugging Face 上也正处于趋势榜。@danielhanchen 提供了针对 QwQ-32B 循环问题的调试指南,建议调整 sampler 并指出其对 quantization 较为敏感。他们还上传了 dynamic 4bit quants 和 GGUFs。

- Character-3 AI Video Model: @togethercompute 和 @realDanFu 重点介绍了 Character-3 的发布,这是由 @hedra_labs 开发并在 Together AI 上扩展的全模态 AI 视频生成模型。Character-3 可以将图像转化为具有逼真动作和手势的动画内容,正如 @TomLikesRobots 所展示的那样,他成功地将其用于 AI lipsync 和叙事。

- Gemini Embeddings and Code Executor: @_philschmid 报道了 Google DeepMind 新推出的实验性 Gemini embedding model,该模型在 MMTEB 排行榜上排名第一,拥有 8k context window,专为金融、科学、法律、搜索和代码应用而设计。他们还详细介绍了 Gemini 2.0 Code Executor 的工作原理,包括其自动修复尝试、文件输入支持、运行时限制以及支持的 Python 库,详情见 @_philschmid 和 @_philschmid 的推文。

- Mercury Coder: @DeepLearningAI 介绍了 Inception Labs 的 Mercury Coder,这是一款基于 diffusion 的代码生成模型,可同时处理 token,实现比 autoregressive 模型更快的速度。

- GPT-4.5 Release: @aidan_mclau 提到了一篇关于 GPT-4.5 的有趣文章。@DeepLearningAI 指出 OpenAI 发布了 GPT-4.5,称其为他们迄今为止最大的模型,但缺乏像 o1 和 o3 那样的 reasoning 能力。

- Jamba Mini 1.6: @AI21Labs 强调 Jamba Mini 1.6 在输出速度上超过了 Gemini 2.0 Flash、GPT-4o mini 和 Mistral Small 3。

- Mistral OCR: @vikhyatk 宣布发布了一个包含 1.9M 个使用 Pixtral 转录的扫描页面的新数据集,可能与 OCR 基准测试有关。@jerryjliu0 分享了 Mistral OCR 与其他模型的基准测试对比,发现其表现尚可且速度较快,但并非最佳的文档解析器,特别是与 Gemini 2.0、GPT-4o 和 Anthropic 的 Sonnet models 等基于 LLM/LVM 驱动的解析技术相比。@sophiamyang 和 @sophiamyang 还分享了 @Sam_Witteveen 关于 MistralAI OCR 的视频。

工具与应用

- MCP (Model Context Protocol): @mickeyxfriedman 观察到尽管 MCP 已经存在半年了,但围绕它的讨论突然激增。@hwchase17 强调了一个集成 MCP 的“最酷客户端”。@saranormous 描述了一个适用于各处的 MCP 智能客户端。@nearcyan 询问了“地下 MCP 市场”并宣布举办 SF MCP meetup @nearcyan。@abacaj 注意到了 MCP 的神秘感和流行趋势。@omarsar0 提供了原始的 MCP guide 作为理解它的最佳资源,以反击那些“错误的看法”。@_akhaliq 发布了一个 MCP Gradio client 的概念验证。

- Perplexity AI Search & Contest: @yusuf_i_mehdi 宣布 Copilot 中的 Think Deeper 功能现在由 o3-mini-high 驱动。@AravSrinivas 鼓励用户向 Perplexity 提问任何问题以对抗无知,并宣布了一项竞赛,为在 ICC 冠军杯决赛期间在 Perplexity 上提问的用户提供 1000 万卢比和旧金山之旅 的奖品 @perplexity_ai。@AravSrinivas 征求关于 Perplexity 中由 Sonnet 3.7 驱动的推理搜索 的反馈。

- Hedra Studio & Character-3 集成: @togethercompute 和 @realDanFu 强调了将 Hedra 的 Character-3 集成到 Hedra Studio 中,用于 AI 驱动的内容创作。@TomLikesRobots 强调了其在口型同步(lipsync)和故事讲述方面的易用性。

- AI-Gradio: @_akhaliq 宣布了 无代码 Gradio AI 应用。随后 @_akhaliq 提供了使用 ai-gradio 启动 Hugging Face models 的代码,并且 @_akhaliq 展示了如何使用 ai-gradio 通过几行代码构建一个使用 Qwen QwQ-32B 的 Vibe coding 应用。

- 适用于 Linux 的 Orion Browser: @vladquant 宣布开始开发 Orion Browser for Linux,扩展了 Kagi 的生态系统。

- ChatGPT for MacOS 代码编辑: @kevinweil 强调 ChatGPT for MacOS 现在可以直接在 IDE 中编辑代码。

- Together AI 的 Model Switch: @togethercompute 宣布与 Numbers Station AI 合作推出 Model Switch,该功能由托管在 Together AI 上的模型驱动,旨在让数据团队为 AI 驱动的分析选择高效的开源模型。

- Hugging Face 上的 Cursor AI: @ClementDelangue 注意到 Cursor AI 现已登陆 Hugging Face,并询问是否有有趣的集成。

研究与数据集

- START (Self-taught Reasoner with Tools):@_akhaliq 宣布了阿里巴巴的 START,这是一个基于 QwQ-32B 微调的模型,在推理和工具使用基准测试中表现强劲。

- PokéChamp:@_akhaliq 展示了 PokéChamp,一个用于宝可梦对战的专家级 Minimax Language Agent,其表现优于现有的 LLM 和基于规则的机器人,使用开源的 Llama 3.1 8B 模型达到了前 10% 的玩家排名。

- Token-Efficient Long Video Understanding:@arankomatsuzaki 分享了 Nvidia 关于 Multimodal LLMs 的 Token 高效长视频理解的研究,在减少计算量和延迟的同时实现了 SotA 结果。

- DCLM-Edu 数据集:@LoubnaBenAllal1 宣布了 DCLM-Edu,这是一个使用 FineWeb-Edu 分类器从 DCLM 过滤出的新数据集,专为较小模型优化。

- uCO3D 数据集:@AIatMeta 和 @AIatMeta 推出了 uCO3D,这是 Meta 新的大规模、公开可用的以物体为中心的 3D 深度学习和生成式 AI 数据集。

- LADDER 框架:@dair_ai 详细介绍了 LADDER,这是一个允许 LLM 递归生成并解决更简单问题变体的框架,通过自主难度驱动学习和 Test-Time Reinforcement Learning (TTRL) 提升了数学积分的准确性。

- 专用反馈与编辑模型:@_akhaliq 强调了关于使用专用反馈与编辑模型来增强开放式通用领域任务的推理时扩展(inference-time scaling)的研究。

- 针对逆转诅咒的 Masked Diffusion 模型:@cloneofsimo 宣布了一个击败逆转诅咒(reversal curse)的 Masked Diffusion 模型,并指出这将改变现状。

- 类脑 LLMs 研究:@TheTuringPost 总结了一项探索 LLMs 如何与大脑反应对齐的研究,发现随着模型获得推理能力和知识,这种对齐会减弱,且更大的模型并不一定更像大脑。

行业与商业

- Together AI 活动与合作伙伴关系:@togethercompute 宣传了他们在 Nvidia GTC 举办的 AI Pioneers Happy Hour,该活动由 @SemiAnalysis_ 和 @HypertecGroup 共同主办。@togethercompute 宣布联合创始人 @percyliang 将在 #HumanX 与 Sama CEO Wendy Gonzalez 共同探讨满足个人需求的基座模型。

- Anthropic 对白宫 RFI 的回应:@AnthropicAI 分享了他们针对 AI 行动计划信息请求(RFI)向白宫提交的建议。

- Kagi 以用户为中心的产品:@vladquant 在宣布推出适用于 Linux 的 Orion 浏览器时,强调了 Kagi 以用户为中心的产品生态系统。

- 2025 年 AI 应用开发:@DeepLearningAI 宣传了在 AI Dev 25 上关于 AI 应用开发未来的小组讨论,嘉宾包括 @nebiusai 的 @RomanChernin。

- 日本作为 AI 中心:@SakanaAILabs 分享了对 Sakana AI 联合创始人 Ren Ito 的采访,讨论了东京作为全球 AI 开发中心的潜力以及日本再次成为技术超级大国的雄心。

- 媒体中的 AI:@c_valenzuelab 认为 AI 不仅仅是媒体的未来,更是所有未来媒体的基石,正在改变创作、分发和体验。

- 开源商业模式:@ClementDelangue 质疑了开源不利于商业的观点,并强调了一些正面案例。

- 联合航空 AI 集成:@AravSrinivas 表示,一旦联合航空(United Airlines)完成 AI 部署,他将非常期待默认搭乘其航班。

观点与讨论

- MCP 热潮与理解:@mickeyxfriedman 质疑了突然出现的 MCP 热潮。@abacaj 和 @Teknium1 也对 MCP 狂热 发表了评论。@omarsar0 批评了关于 MCP 的“错误观点”。@clefourrier 寻求对 MCP 热潮的 ELI5 解释。

- Agentic AI 与反思 (Reflection):@TheTuringPost 讨论了 Agentic AI 中反思 的重要性,它使分析、自我修正和改进成为可能,并重点介绍了 Reflexion 和 ReAct 等框架。@pirroh 强调在 Agent 设计中要 超越 ReAct 进行思考。

- 语音 AI 的挑战与创新:@AndrewYNg 讨论了语音系统中 语音活动检测 (VAD) 的挑战,特别是在嘈杂环境下,并重点介绍了 Kyutai Labs 的 Moshi 模型,该模型通过使用持久的双向音频流消除了对显式 VAD 的需求。

- Scale is All You Need:@vikhyatk 开玩笑地表示,解决 AI 问题的简单方法是“更多数据、更多参数、更多 flops”,暗示 scale is all you need(规模就是一切)。

- 监督学习的局限性:@finbarrtimbers 论证了对 强化学习 (RL) 的需求,指出监督学习从根本上说是错误的范式,尽管它是必要的一步。

- 长上下文 (Long-Context) 挑战:@teortaxesTex 提到“残差流饱和 (residual stream saturation)”是长上下文讨论中一个讨论不足的问题。

- 中间任务的重要性:@cloneofsimo 讨论了“提出看似无关的中间任务来解决问题”的能力是智能的一个关键方面。

- 面试提问技巧:@vikhyatk 分享了一种名为“剥洋葱 (peeling the onion)”的 Amazon 面试技巧,通过追问来验证候选人的项目经验,从而评估其交付成果的能力。

- AI 讨论中的注意力集中:@jeremyphoward 感叹 AI 讨论中存在一种在不同话题间跳跃而缺乏持续关注的倾向。

- AGI 时间线与规划:@abacaj 讽刺地评论道,尽管敏捷团队连提前两个 sprint 的计划都制定不好,但 OAI 却在计划 2027 年实现 AGI。

- “开放” AI 与营销:@vikhyatk 批评了一些公司在 营销材料中歪曲其行为,并质疑最新发布的所谓“真正开放”的 AI 是否真的开放。

- 评估图表的解读:@cognitivecompai 警告不要盲目相信评估图表,尤其是那些与 R1 相比表现优异的图表,建议批判性地思考哪些模型和评估指标 (evals) 被忽略了。

- 超级智能的地缘政治:@jachiam0 和 @jachiam0 讨论了 目前缺乏公认的超级智能地缘政治处理方法,以及处理不当带来的严重风险。

- AI 与工作流失:@fabianstelzer 认为,虽然“狗屁工作 (bullshit jobs)”大多对 AI 免疫,但我们可能会看到其他工作通过要求“人工在环 (human-in-the-loop)”的法规来实现“公证化 (notarization)”,以保护它们免受 AI 的冲击。

幽默与迷因

- 孔子关于提问的名言:@AravSrinivas 引用了孔子的话:“问愚蠢问题的人只丢脸一分钟;不问愚蠢问题的人一辈子都是傻瓜。” 以此来推广 Perplexity。

- 2025 年 AI 博士梗图:@jxmnop 分享了一个幽默的“2025 年 AI 博士的一天”梗图,内容涉及极少的研究工作和大量的网球运动。

- MCP 是“上下文宫殿”:@nearcyan 幽默地将 MCP 描述为“MCP 不仅仅是一个上下文窗口(context window),而是一座上下文宫殿 👑”。

- “tinygrad 用户不知道‘无’的价值”:@typedfemale 发布了一个梗图:“tinygrad 用户不知道‘无’的价值,也不知道‘无’的代价”。

- “为什么 X 上的每个优化研究员头像里都有猫/狗?”:@eliebakouch 开玩笑地问道:“为什么 X 上的每个优化研究员(optimization researcher)的头像里都有一只猫或狗?”。

- “我以为我需要屏蔽政治,但现在我也得屏蔽 MCP 了”:@Teknium1 调侃说需要像屏蔽政治一样屏蔽 MCP 相关的内容。

AI Reddit 摘要

/r/LocalLlama 摘要

主题 1. 金融时报:带语音功能的 Llama 4 预计很快发布,增强语音 AI

- 金融时报:带语音功能的 Llama 4 预计将在未来几周发布 (得分: 108, 评论: 31):Meta 和 Sesame 预计将在未来几周发布集成语音能力的 Llama 4,为自托管语音聊天提供选择。作者表达了对集成 CarPlay 的 iOS 应用的兴趣,以便与私有 AI 服务器进行交互。

- 评论者讨论了 Llama 4 的潜在特性和能力,表达了对更小模型(0.5B 到 3B)的渴望,如 Llama-3.2-1B 用于快速实验,以及性能可与 Qwen 32B 媲美的中大型模型(10~20B)。此外,还有关于集成推理能力的讨论,一些人更倾向于将推理任务交给独立模型,以避免语音交互中的延迟。

- 关于 Llama 4 的预期发布时间存在争议,一些人预测它将与 LlamaCon 同时发布以提升活动知名度,另一些人则推测发布时间在 3 月中旬至 4 月初之间。讨论中还包含了一个与发布相关的预览图片链接。

- 存在对付费墙内容的担忧,用户分享了一个指向 archive.ph 的替代链接以访问文章摘要。此外,还提到了模型中的偏见问题,用户更倾向于那些不进行道德说教的模型。

主题 2. QwQ-32B 性能设置与改进

- QwQ-32B 无限生成修复 + 最佳实践,Bug 修复 (Score: 214, Comments: 26): 为了解决 QwQ-32B 的无限重复问题,作者建议使用特定设置,如

--repeat-penalty 1.1和--dry-multiplier 0.5,并建议添加--samplers "top_k;top_p;min_p;temperature;dry;typ_p;xtc"以防止无限生成。该指南还推荐了 Qwen 团队针对长上下文 (128K) 使用 YaRN 的建议,并提供了 Hugging Face 上各种量化模型的链接,包括动态 4bit 量化。- Llama-Server 中的参数覆盖:使用 llama-server 时,命令行参数(如

--temp 0.6)可能会被 HTTP 请求参数(如{"temperature":1.0})覆盖,从而影响最终输出。更多详情请参阅 GitHub 上的讨论。 - GRPO 与 QwQ-32B 的兼容性:用户询问了在低 GPU 资源下为 QwQ-32B 运行 GRPO 的情况,已确认只需在 GRPO notebook 中更改模型名称即可运行。

- Chat Template 使用:遵循 QwQ-32B 准确的聊天模板格式非常重要,包括换行符和

<think>等标签。然而,省略<think>标签仍然有效,因为模型会自动添加它;系统提示词(system prompts)可以通过在前面添加<|im_start|>system\n{system_prompt}<|im_end|>\n来使用。更多详情见教程。

- Llama-Server 中的参数覆盖:使用 llama-server 时,命令行参数(如

- 确保在 QwQ-32B 中使用适当的 0.6 温度 (Score: 107, Comments: 9): 作者最初在生成用于模拟球在旋转六边形内弹跳的 Pygame 脚本时,由于设置不正确遇到了问题,耗时 15 分钟仍未成功。后来他们发现 Ollama 设置已更新,建议 QwQ-32B 的温度为 0.6,更多详情可在 生成配置 中找到。

- Deepseek 和其他推理模型通常在温度参数为 0.6 时表现最佳,这与作者对 QwQ-32B 的发现一致。这种温度设置似乎是不同模型间的通用建议。

主题 3. QwQ vs. qwen 2.5 Coder Instruct: 32B 之战

- AIDER - 正如我所怀疑的,QwQ 32b 在编程方面比 qwen 2.5 coder instruct 32b 聪明得多 (Score: 241, Comments: 79): QwQ-32B 在编程任务中优于 Qwen 2.5-Coder 32B-Instruct,在 Aider polyglot benchmark 中实现了更高的正确完成率。尽管性能优越,但 QwQ-32B 的总成本高于 Qwen 2.5-Coder,正如 Paul Gauthier 在 2025 年 3 月 6 日更新的柱状图所示。

- 图表设计问题:包括 SirTwitchALot 和 Pedalnomica 在内的几位评论者指出,图表设计令人困惑,特别是使用了两个 y 轴且图例不清晰、缺少颜色。这种误导性的呈现使得理解 QwQ-32B 和 Qwen 2.5-Coder 之间的性能与成本对比变得复杂。

- 性能和配置关注:关于 QwQ-32B 性能的讨论中,someonesmall 强调其在 Aider polyglot benchmark 中的完成率为 20.9%,而 Qwen 2.5-Coder 为 16.4%,但其正确的 diff 格式率要低得多(67.6% vs. 99.6%)。BumbleSlob 等人对模型的表现表示不满,建议调整参数作为潜在解决方案。

- 模型大小和可用性:krileon 等人讨论了在消费级硬件上运行 QwQ-32B 等大型模型的实用性,建议通过购买二手 3090 GPU 来提高性能。对话反映了在没有高端硬件的情况下使用大型模型的挑战,以及未来更强大 GPU 的潜在普及性。

主题 4. Meta 的 Latent Tokens:推动 AI 推理向前发展

- Meta 发布 AI 重磅消息:Latent tokens 有助于提升 LLM 推理能力 (Score: 333, Comments: 40): Meta AI 研究人员发现,使用通过 VQ-VAE 压缩文本生成的 latent tokens 可以增强 Large Language Models (LLMs) 的推理能力。欲了解更多详情,请参阅 arXiv 上的论文。

- Latent Tokens 与推理效率:通过 VQ-VAE 创建的 latent tokens 压缩了 LLM 中的推理步骤,通过减少对冗长文本解释的需求,实现了更高效的推理。与仅在全文本解释上训练的模型相比,该方法允许 LLM 以更少的计算资源处理复杂任务,并在逻辑和数学问题中表现出更好的性能。

- 对其影响的评价褒贬不一:虽然一些用户看到了这种方法的潜力,但像 dp3471 这样的用户表示收益相对较小,并期待在与 progressive latent block transform 等其他技术结合时能有更显著的改进。Cheap_Ship6400 强调,Meta 的 latent 推理与 Deepseek 的 MLA 不同,它关注的是 token 嵌入空间,而不是注意力分数计算。

- 关于实现和未来前景的讨论:人们对实现细节感到好奇,特别是如何将 VQ-VAE 用于离散高维向量的 next-token 预测。一些用户(如 -p-e-w-)希望这些理论突破能有实际应用,而另一些用户则讨论了在 latent 空间进行推理的潜力,并将其与 diffusion LLMs 等其他新兴技术进行了比较。

其他 AI Subreddit 回顾

/r/Singularity, /r/Oobabooga, /r/MachineLearning, /r/OpenAI, /r/ClaudeAI, /r/StableDiffusion, /r/ChatGPT, /r/ChatGPTCoding

pipeline 出现错误,正在调试中… 抱歉

AI Discord 回顾

由 Gemini 2.0 Flash Thinking 生成的摘要之摘要

主题 1. IDE 对决:Cursor、Windsurf 与代码编辑器竞技场

- Cursor 在额度消耗竞赛中碾压 Codeium!:用户报告称 Cursor 比 Windsurf 更高效、更稳定,尤其是在处理大文件时,Cursor 的额度使用仅为 Windsurf 使用 Claude 3.7 成本的一小部分。Windsurf 用户正面临高额度消耗的问题,原因是重复的代码重写和文件分析,一名用户一天就消耗了 1200 额度,而其他用户则转向 Cursor 或 Trae 等免费替代方案以获得更好的资源管理。

- Cursor 0.47 缓解代码创作混乱!:Cursor 0.47 更新解决了 Sonnet 3.7 的问题,现在能更好地遵循自定义规则并在代码生成方面表现更佳,特别是对于创建 VS Code 分支的欢迎窗口等任务。用户注意到更新版本中使用了带有多个代码路径的 sequential thinking(顺序思维),改善了代码创建工作流。

- MCP 乱象:服务器设置难倒用户:用户在为 Windsurf 等代码编辑器设置 MCP 服务器时遇到困难,在尝试连接不同模型时遇到诸如 “Not Found: Resource not found” 之类的错误。建立 Model Context Protocol (MCP) 连接的困难凸显了在集成和利用外部服务与 AI 代码编辑器时面临的持续挑战。

主题 2. 模型基准测试与优化突破

- QwQ-32B 挑战 R1 的本地编程桂冠:QwQ-32B 被誉为本地 AI 编程的颠覆者,有可能在家庭环境下实现 SOTA 性能,尽管基准测试表明它在某些方面可能无法超越 R1。Daniel Han 发布了针对 QwQ-32B 循环问题的调试技巧,建议调整 llama.cpp 中的 sampler,并指出其对量化的敏感性,建议第一层和最后一层应保持不量化。

- ktransformers 声称 IQ1 量化碾压 BF16:ktransformers 发布了基准测试,声称 Deepseek R1 IQ1 量化的表现优于 BF16,这在 Unsloth AI Discord 中引发了怀疑和辩论,一名成员指出“他们本该写成 1.58bit 的”。虽然表格被认为不完整,但正在进行的基准测试正在对比 Deepseek v3 (chat model) vs R1 IQ1,这表明人们对高性能模型的极端量化方法有着浓厚兴趣。

- RoPE Scaling 拯救长上下文 Qwen2.5-Coder-3B:Qwen2.5-Coder-3B-bnb-4bit 模型的 32768 上下文长度通过使用 kaiokendev 的 3.906 RoPE scaling 扩展到了 128000,证实了只要架构是 Transformers,配合 RoPE 就可以处理 128k tokens。这展示了一种显著扩展小型模型上下文窗口的实用方法。

Theme 3. 扩散模型颠覆语言生成

- Inception Labs 以 Midjourney-Sora 级的速度切入文本生成领域:Inception Labs 正在开拓基于扩散的语言生成,旨在实现类似于 Midjourney 和 Sora 的前所未有的速度、质量和生成控制。成员们注意到 ML-GSAI/LLaDA 等开源替代方案的出现,表明扩散模型可能会以显著的速度提升彻底改变语言生成。

- 离散扩散模型引入 Ratios,激发效率:一位成员强调了来自 arxiv 的论文 Discrete Diffusion Modeling by Estimating the Ratios of the Data Distribution,认为它可能是 Inception Labs 产品的基础,并指出其重点在于估计数据分布比例以进行高效的扩散建模。求解 duals λ 涉及对 Lambert W function 的优化,这可能计算密集,因此建议使用 cvxpy 和 adjoint method 进行优化。

- LLaDA 模型:基于扩散的 LLM 范式转移出现:Large Language Diffusion Models (LLaDA) 代表了语言模型架构的一种新颖范式,使用去噪扩散过程进行并行的、从粗到细的文本生成,与传统的自回归 Transformers 形成对比。尽管在概念上具有吸引力,但 LLaDA 和类似模型可能会受到仅关注基准测试而非广泛现实任务训练的限制,成员们观察到了诸如段落重复等问题。

Theme 4. MCP 与 Agent 安全威胁迫在眉睫

- MCP 服务器面临恶意 Prompt Injection 威胁:关于 MCP 服务器 向 AI Agent 传递恶意 Prompt Injection 的担忧正在升级,这利用了模型对工具调用(tool calls)的固有信任超过了其内部知识。提出的缓解策略包括在首次使用时显示工具描述,并提醒用户指令变更以防止潜在的漏洞利用。

- 安全频道审查 MCP 漏洞利用:社区正在考虑建立一个专门的安全频道,以主动应对和预防 MCP exploit 漏洞,强调了在不完全了解后果的情况下将工具连接到 MCP Servers/Remote Hosts 的固有风险。讨论强调了合规性工具描述可能被操纵,从而诱导模型植入后门。

- Perplexity API 的版权赔偿条款引发警惕:用户对 Perplexity API 抓取受版权保护内容表示了版权担忧,并指出 Perplexity 的 API 条款将版权侵权的责任转移给了用户。提供知识产权(IP)赔偿的替代方案,如 OpenAI、Google Cloud 和 AWS Bedrock,被强调为在版权风险方面可能更安全的选择,并附带了它们各自的服务条款链接。

Theme 5. 硬件动态:9070XT vs 7900XTX 以及原生 FP4 支持

- 9070XT 在原生推理速度上完胜 7900XTX:9070XT GPU 在推理速度上超越了 7900XTX,运行相同的 qwen2.5 coder 14b q8_0 模型时速度分别为 44tok/sec 和 31tok/sec,且首字生成时间(first token time)达到亚秒级,而 7900XTX 则需要 4 秒。尽管由于 Windows 上的驱动限制使用了 Vulkan 而非 ROCm,9070XT 仍展现出显著的性能优势,部分用户报告整体性能提升高达 10%。

- 新 GPU 迎来原生 FP4 支持:与旧款显卡相比,9070 GPU 在 FP16 和 INT4/FP4 性能上表现出实质性提升,FP16 性能从 122 跃升至 389,而 INT4/FP4 性能从 122 飙升至 1557。这标志着 Nvidia 和 Radeon 都开始提供原生 FP4 支持,为高效的低精度推理和训练开启了新的可能性。

- Vulkan 与 ROCm 的性能之争升温:虽然 9070XT 目前在 Windows 上缺乏 ROCm 支持,但通过 LM Studio 使用 Vulkan 时,一些用户报告了令人惊讶的极具竞争力的推理速度,甚至在某些场景下超过了 ROCm。然而,也有人坚持认为 ROCm 本质上应该比 Vulkan 更快,暗示潜在的驱动问题可能导致某些用户基准测试结果偏向 Vulkan。

PART 1: High level Discord summaries

Cursor IDE Discord

- Cursor 在快速竞赛中与 Lmarena 交锋!:成员们使用 GPT-3.7 的单一提示词对比了 Cursor 和 Lmarena,初步印象认为 Cursor 的输出质量更好,并指出 Lmarena 生成的文本难以阅读。

- 随后的分析表明 Lmarena 更好地遵循了主题,但普遍共识是 两者的表现都很糟糕。

- Cursor 0.47 助力代码创作!:更新后,用户报告 Cursor 0.47 通过遵循自定义规则、符合 AI 自定义规则以及在代码生成方面表现更好(特别是针对 VS Code 分支的欢迎窗口),修复了 Sonnet 3.7 的问题。

- 他们注意到使用了带有多个代码路径的顺序思维(sequential thinking)以提高速度。

- Vibe Coding:得到验证与关注!:关于 vibe coding(构建微型 SaaS Web 应用)的讨论促使一名用户使用 Claude 本身在 VS Code 分支上构建了一个欢迎窗口。

- 一位成员将这种实践定义为 将 AI Agent 视为需要引导的孩子,并将其与构建需要编排经验的 Docker 化开源项目进行了对比。

- MCP:最大化模型能力!:成员们探索了使用 Model Context Protocol (MCP) 服务来增强像 Cursor 和 Claude 这样的 AI 代码编辑器,连接到诸如 Snowflake 数据库之类的服务。

- 一位成员发现 PearAI 提供了完整的上下文,而另一位成员发现 0.45 以上版本的 Cursor 往往会忽略

.cursorrules。

- 一位成员发现 PearAI 提供了完整的上下文,而另一位成员发现 0.45 以上版本的 Cursor 往往会忽略

- Cursor 错误激发周边灵感!:臭名昭著的 “Cursor is damaged and can’t be opened” 错误消息激发了周边商品的灵感,现在已有 T 恤 和 鼠标垫 出售。

- 这一幽默的转变凸显了社区在面对技术挫折时寻找乐趣的能力。

Unsloth AI (Daniel Han) Discord

- ktransformers 声称 IQ1 碾压 BF16:成员们讨论了 ktransformers 发布的 Deepseek R1 IQ1 基准测试,一位持怀疑态度的成员指出 他们本该写 1.58bit 的。

- 另一位成员指出表格并不完整,基准测试仍在进行中,展示的是 Deepseek v3(聊天模型)对比 R1 IQ1。

- Unsloth 的 GRPO 算法揭秘:成员们推测 Unsloth 是如何实现低 VRAM 占用的,暗示了异步梯度卸载(asynchronous gradient offloading),然而真正的节省源于对 GRPO 数学实现的重构。

- 其他效率提升来自中间层的梯度累积(gradient accumulation),结合梯度检查点(gradient checkpointing),以及更高效的算子(kernels)如 logsumexp。

- QwQ-32B 生成循环问题已修复:Daniel Han 发布了调试 QwQ-32B 模型循环问题的指南,建议在 llama.cpp 中使用采样器,例如 –samplers “top_k;top_p;min_p;temperature;dry;typ_p;xtc”,并上传了 动态 4bit 量化版 & GGUFs。

- 他表示 QwQ 对量化也很敏感 —— 前几层和最后几层应该保持未量化状态。

- Qwen 的 RLHF 成功案例:一位成员使用 Unsloth GRPO 在 Qwen7b 模型上成功实现了 RLHF,报告称在角色遵从度方面有显著提升。

- 然而,该模型在 IFeval 等严格指令遵循基准测试中表现出 明显的退化,特别是在格式约束和负面指令方面。

- RoPE Scaling 前来救场:Qwen2.5-Coder-3B-bnb-4bit 模型可以处理 32768 的序列长度,但在使用 kaiokendev 的 3.906 倍 RoPE scaling 后,被扩展到了 128000。

- 据确认,通过 RoPE,只要架构是 transformers,就可以处理 128k tokens。

Nomic.ai (GPT4All) Discord

- 注册表编辑可能导致蓝屏:一位成员分享称,在发现某个关键 .dll 文件占用大量 RAM 并将其删除后,导致下次启动时出现 蓝屏,并警告在没有备份的情况下进行注册表编辑的风险。

- 成员们普遍认为,在调整注册表后,备份个人文件并重装系统(reformat) 是明智之举。

- 量化影响性能和内存:用户讨论了量化,指出更倾向于使用 f16 量化 以在更小的负载中容纳更多参数,同时也承认其他量化方式可能会导致 flash attention 崩溃。

- 在量化的背景下,有人将浮点数描述为 有符号位大小,因此有符号 16 位整数就是 32。

- Windows 存在文件路径长度限制:成员们讨论了 Windows 中的文件路径长度限制,指出由于 Windows API 中的 MAX_PATH 定义,标准限制为 260 个字符,详见 Microsoft 文档。

- 这一限制可以通过注册表和应用程序清单(manifest)修改,为每个应用程序启用长路径行为来绕过,从而达到 NT kernel 的 32,767 个字符路径限制。

- Inception Labs 开发基于扩散模型的文本生成:Inception Labs 正在开创基于扩散模型(diffusion-based)的语言生成技术,受 Midjourney 和 Sora 等 AI 系统的启发,该技术有望提供前所未有的速度、质量和生成控制。

- 成员们注意到开源替代方案正在开发中,例如 ML-GSAI/LLaDA,并且这项技术可能很快会带来显著的速度提升。

- 去中心化信任认证(Trustless Authentication)是未来:成员们讨论了 trustless authentication 的潜力,即通过将人脸 3D 扫描和身份证件转换为加密字符串来充当数字护照,类似于 Persona 使用的商业模式。

- 它被设想为一个去中心化信任的验证数据库,文件中包含用户的个性化标签,生成的 deepfake 人脸扫描和身份证件将无法通过验证。

Codeium (Windsurf) Discord

- Windsurf 遭遇稳定性冲浪挫折:用户报告称 Windsurf 在最新更新后表现不稳定,指出存在无限循环、重复代码更改以及普遍的无响应等问题。

- 许多用户正转向 Cursor 或 Trae,理由是它们具有更好的稳定性和资源管理,一位用户表示:“我决定切换到 Cursor… 估计更稳定。我会在一个月左右回来看看它的情况。”

- 额度危机:Windsurf 的高昂消耗引发批评:由于 AI 反复重写代码或分析相同文件,用户正经历高额度消耗,导致不满。

- 一位用户抱怨在引入 Claude 3.7 后,一天内烧掉了 1200 flow credits,称其“100% 不稳定,100% 钱打水漂”,并指出该工具一次只能读取 50 行,读取一个 81 行的文件就要消耗 2 个额度。

- Cascade 终端问题频发:部分用户报告 Cascade 终端消失或变得无响应,且没有可见的设置可以修复。

- 一位用户提到了重启的临时解决方案,但问题会再次出现;另一位用户建议使用

CTRL Shift P清除所有缓存并重新加载窗口。

- 一位用户提到了重启的临时解决方案,但问题会再次出现;另一位用户建议使用

- 模型之争:Cursor 在额度竞赛中击败 Codeium:用户将 Windsurf 与 Cursor 进行对比,许多人发现 Cursor 在处理大文件时更高效、更稳定。

- 一位用户报告称,在 Claude 3.7 下,Cursor 的额度消耗仅为 “Windsurf 的一小部分”,而另一位用户报告称 “Trae 在免费阶段的表现比 Windsurf 好 100 倍”。

- MCP 乱象:用户在服务器设置中挣扎:用户在尝试使用 MCP 服务器时遇到问题,出现与模型或配置相关的错误。

- 一位用户收到了 “Not Found: Resource not found” 错误,尝试了不同模型但未获成功。

Perplexity AI Discord

- Perplexity Pro 会员权益引发问题:多位用户报告其 Perplexity Pro 账户被意外取消,怀疑是诈骗,后来发现是因为不符合针对 克罗地亚 的 Deutsche Telekom 客户提供的 “DT 1 Year Free HR” 优惠资格,详见服务条款。

- 官方支持确认取消是由于该优惠仅限 克罗地亚 用户,这让不符合条件的用户感到困惑。

- GPT-4.5 分级讨论引发推测:用户讨论了 Perplexity Pro 中 GPT-4.5 的可用性,确认每 24 小时有 10 次免费使用机会。

- 明确了 GPT-4.5 的使用成本非常高,建议使用自动模型选择可能就足以避免手动挑选模型。

- Complexity 扩展带来 Canvas 功能:一位用户解释了如何使用 Complexity 扩展在 Perplexity 中生成 Mermaid 图表,提供了类似 Canvas 的功能。

- 通过启用 Canvas 插件并提示 AI 创建 Mermaid 图表,用户可以通过点击代码块上的播放按钮进行渲染,更多信息见此 Discord 链接。

- Google Gemini 2.0 抢占地盘:来自 ArsTechnica 的文章 详细介绍了 Google 扩展由 Gemini 2.0 驱动的 AI 搜索功能。

- Google 正在测试一种 AI 模式,用 Gemini 生成的回答取代传统的搜索结果。

- 黄金位置:AI 驱动的产品植入:Perplexity 页面 报道了 Amazon Prime 如何为其内容测试 AI 配音。

- 其他 Perplexity 页面包括:苹果的折叠屏 iPhone、OpenAI 的 AI Agent 以及 DuckDuckGo 的 AI 搜索选项。

LM Studio Discord

- LM Studio 修复模板 Bug 并加速 RAG:LM Studio 0.3.12 现已发布稳定版,修复了 QwQ 32B jinja 解析相关的 Bug,该问题此前会导致

OpenSquareBracket !== CloseStatement错误,详见 完整发布说明。- 此外,RAG 中用于检索的文件分块(chunking)速度得到了显著提升,MacOS 系统现在可以正确索引外部 exFAT 驱动器上的 MLX 模型。

- Qwen Coder 在 M2 上略胜 DeepSeek:对于在配备 16GB RAM 的 Macbook M2 Pro 上进行编码任务,由于内存限制,建议选择 Qwen Coder 而非 DeepSeek v2.5,但需承认其性能仍会落后于云端模型。

- 成员们指出 Qwen 32B 的表现超出了其参数规模,性能至少与 Llama 3.3 70b 持平。

- Unsloth 加速 LLM 微调:推荐使用 Unsloth 来加速 Llama-3、Mistral、Phi-4 和 Gemma 等模型的微调,并降低内存占用。

- 成员们指出,微调比推理更耗费资源,而 LM Studio 目前的公开路线图中尚未包含此功能。

- 9070XT 在原始速度上碾压 7900XTX:一位用户对比了 9070XT 和 7900XTX 运行相同 qwen2.5 coder 14b q8_0 模型的情况,发现 9070XT 的运行速度约为 44tok/sec,首字延迟(time to first token)不到一秒;而 7900XTX 的速度为 31tok/sec,首字延迟达 4秒。

- 一位用户认为,那些看到 Vulkan 性能更佳的人可能遇到了驱动问题,因为 ROCm 应该远快于 Vulkan。

- 原生 FP4 支持到来:与旧款显卡相比,9070 显著提升了 FP16 和 INT4/FP4 的性能,FP16 为 122 vs 389,INT4/FP4 为 122 vs 1557。

- 这标志着 Nvidia 和 Radeon 都已提供原生 FP4 支持。同时,社区还讨论了量化对模型质量的影响,特别是更小的量化尺寸与潜在质量损失之间的权衡。

HuggingFace Discord

- 替代 Replit 的开源 Agent 方案引发讨论:成员们讨论了具有类似 Replit/Bolt 的 Agent 功能的开源替代方案,以及用于直接将视频保存到 Supabase bucket 的 export_to_video 功能。

- 社区讨论了具有集成 Agent 功能的商业产品的替代方案。

- 为 Gradio 应用提议 Dexie 封装:一位用户提议为 Gradio 应用 提供 Dexie 封装,以便更轻松地访问 IndexedDB,并引发了关于将其实现为自定义组件的讨论。

- 共享了 Gradio 开发者 Discord 频道的链接以供进一步讨论。

- 数据集引用争议发酵:一位用户怀疑研究论文《NotaGen: Symbolic Music Generation with LLM Training Paradigms》使用了他们的 Toast MIDI 数据集 但未进行妥善引用。

- 社区成员建议联系通讯作者,并为数据集生成 DOI,以确保学术软件能正确归属和识别该数据集。

- 寻求 OCR-2.0 微调指导:一位成员请求关于微调 OCR-2.0 的指导,他们认为这是目前最新且最好的模型,并链接了一份 SharePoint 文档。

- 该成员询问了根据文档微调 got/ocr-2.0 模型的适当步骤。

- 解码 AI Agent:组件 vs 实体:根据此回复,LLM 是一个具有工具调用能力的组件,其本身不是 Agent;一个 Agentic AI 模型 需要同时具备这两者。

- 关于 检索增强生成 (RAG) 系统是否可以被视为 LLM 与之交互的“环境”,争论仍在继续。

OpenRouter (Alex Atallah) Discord

- Perplexity API 引发版权担忧:用户指出 Perplexity API 存在版权问题,因为它抓取受版权保护的内容,并注意到 Perplexity 的 API 条款 将责任转嫁给了用户。

- OpenAI、Google Cloud 和 AWS Bedrock 等替代方案提供 IP 补偿(IP indemnification),将风险转移给供应商,参见:OpenAI 条款、Google Cloud 条款 和 AWS Bedrock 常见问题解答。

- Sonar Deep Research 模型因错误而陷入困境:成员报告 Perplexity Sonar Deep Research 频繁出现错误、高延迟(首个 Token 延迟高达 241 秒)以及异常高的推理 Token 计数。

- 一位成员提到在没有输出的情况下出现了 137k 推理 Token 计数,而其他人则确认该模型最终趋于稳定。

- Gemini Embedding Text Model 首次亮相:新的实验性 Gemini Embedding Text Model (gemini-embedding-exp-03-07) 现已在 Gemini API 中可用,性能超越了以往模型,参见 Google AI 博客。

- 该模型目前在 Massive Text Embedding Benchmark (MTEB) 多语言排行榜上排名第一,并支持更长的输入 Token 长度。

- OpenRouter 推理参数充满不一致性:用户发现 OpenRouter 的推理参数存在不一致,一些模型被标记为支持推理,但 Endpoint 却不支持,而一些提供商则不返回推理输出。

- 测试揭示了配置问题以及模型与 Endpoint 之间的差异,其中 Cloudflare 被指出缺少 /completions endpoint。

- Claude 3.7 在处理俄语提示词时受阻:一位用户报告 Claude 3.7 在处理俄语提示词时表现吃力,以英语回复并可能误解细微差别。

- 该问题在使用 Cline 与 OpenRouter 时出现,表明问题可能源于 Anthropic,而非插件或 OpenRouter 本身。

Latent Space Discord

- Minion.ai 宣告终结:成员报告 Minion.ai 已经 死亡,不要相信那些炒作,有人将其描述为 那个有 4 个卡通形象、本应为你执行 Agent 任务的东西。

- 它的关闭凸显了 AI 初创公司的波动性,以及对营销能力进行批判性评估的必要性。

- Google 扩展 Gemini Embedding 模型:Google 为开发者发布了一个实验性的 Gemini Embedding 模型,在 MTEB(多语言)上具有 SOTA 性能。

- 更新后的模型具有 8K Token 的输入上下文长度、3K 维度的输出,并支持 100 多种语言。

- Claude Code 进入 IDE 竞技场:成员讨论了将 Claude code 与 cursor.sh 以及 VSCode+Cline / roo-cline 进行比较,优先考虑代码质量而非成本。

- 讨论引用了之前的消息,表明对最佳编码环境的探索正在进行中。

- AI Personas 成为迷因霸主:引用一条 推文,一位成员提到,常态将转向体现性格类型的 AI PERSONAS。

- 该推文提到,Agent 将竞相成为特定子群体 x、y 和 z 的主要面孔,以完美捕捉废文博主(shitposters)、瘾君子、运动员、说唱歌手、自由主义者和迷因币(memecoin)玩家的精髓。

- Agent-as-a-Service 是未来吗?:成员们思考了 Agent-as-a-Service 模式的可行性。

- 一位成员提出了一个位于 DoorDash 前端的 Bot 想法,称之为 DoorDash MCP。

OpenAI Discord

- OpenAI 压缩 ChatGPT 消息限制:用户报告 ChatGPT 现在强制执行 每周 50 条消息 的限制,以防止服务滥用。

- 成员们对这种不便感到沮丧,并讨论了绕过限制的方法。

- HVAC 获得 LLM AI 助手:一位成员分享了一个基于 HVAC 安装手册 训练的 LLM YouTube 视频演示。

- 另一位成员建议使用 Mistral OCR 来处理手册,称赞其能以低廉的价格识别复杂的字体和表格。

- 本地 LLM 展示出超越云端的潜力:成员们讨论了在本地运行 LLM 与使用云服务的对比,其中一人主张本地 DIY LLM 相比“黑盒”云解决方案更具潜力。

- 讨论内容包括在 GPU 和 CPU 之间拆分进程,以及量化(quantization)在减少内存需求方面的优势。

- SimTheory 的主张引发质疑:一位用户推广了 SimTheory,称其以更低的价格提供比 OpenAI 更高的 O1 消息上限。

- 其他成员表示怀疑,质疑他们如何在提供更高限制的同时还能压低 OpenAI 的价格。

- 模型趋向于模仿,错失机会:模型倾向于紧密遵循请求模式,可能会忽略更好的方法,尤其是在模型可控性(steerability)增强的情况下。

- 有人评价道:当给出的代码是用锤子钉螺丝时,模型会照做,猜测我们知道自己想要什么。

aider (Paul Gauthier) Discord

- Aider 提倡推理指示器:用户请求 Aider 增加一个功能,以指示推理模型何时正在进行推理,特别是针对 Openrouter 上的 Deepseek R1 或 V3。

- 一位成员提议对 Aider 和 litellm 进行补丁,并引用了 litellm 中一个用于获取 **

** 标签内推理 token 的技巧。

- 一位成员提议对 Aider 和 litellm 进行补丁,并引用了 litellm 中一个用于获取 **

- Jamba 模型展示 Mamba-Transformer MoE 架构:AI21 Labs 推出了 Jamba 1.6 Large & Mini 模型,声称其质量和速度优于开源模型,并在具有 256K 上下文窗口 的长上下文任务中表现强劲。

- 该模型采用 Mamba-Transformer MoE 混合架构以提升成本效益,可以自托管部署或在 AI21 SaaS 中使用。

- 初创公司信赖 AI 编写的代码:一位 Y Combinator 顾问提到,当前这一批初创公司中,有四分之一的业务几乎完全基于 AI 编写的代码。

- 上下文未提供更多细节。

- Copilot 封禁 Aider 用户:一位用户报告因在 Aider 中极轻量使用 copilot-api 导致 Copilot 账号被封禁,并提醒其他用户注意。

- 其他人推测了可能的原因,如账号共享或频率限制,并引用了 copilot-api GitHub 仓库。

- QwQ-32B 挑战 R1:一位成员分享了关于 QwQ-32B 的链接,断言它永远改变了本地 AI 编程,并在家用环境下实现了 SOTA 性能。

- 另一位成员指出,基准测试讨论显示 QwQ-32B 可能很出色,但不一定比 R1 更好,特别是考虑到 Discord 中提到的模型大小。

Yannick Kilcher Discord

- DeepSeek 面临企业禁令:许多公司出于安全担忧正在禁用 DeepSeek,尽管其具有开源特性,这引发了关于媒体影响力、中国政府影响以及对 reviewable code 和本地执行需求的讨论。

- 一位成员指出 DeepSeek 就像 Deep Research + Operator + Claude Computer。

- 离散扩散模型获取比率:一位成员建议讨论来自 arxiv 的论文 Discrete Diffusion Modeling by Estimating the Ratios of the Data Distribution,并指出它可能是 Inception Labs 产品的基础。

- 进一步说明求解 duals λ 需要对 Lambert W function 进行优化,这在计算上可能效率低下,建议使用 cvxpy 和 adjoint method。

- 潜空间抽象缩短推理长度:一篇新论文提出了一种混合推理表示,使用来自 VQ-VAE 的 latent discrete tokens 来抽象初始步骤并缩短推理轨迹。

- 一位成员质疑这种 latent reasoning 是否仅仅是 context compression,另一位成员则开玩笑说可能需要电休克疗法 (ECT) 来防止 AI 领域滥用 reasoning 一词。

- OpenAI 放缓对 AGI 的立场:据 the-decoder.com 报道,OpenAI 正从期待突然的 AGI 突破转向将其发展视为一个持续的过程。

- 这种转变可能是由于 GPT 4.5 反响平平的结果,一些人指责 Sam Altman 将预期定得过高。

- 采样技术遏制 Agent 循环:在这篇论文和 GitHub repo 中详细介绍的 n-sigma-sampling 的使用,似乎可以减轻多步 Agentic 工作流中的不良采样和循环行为。

- 该技术无需复杂的概率操作即可高效过滤 token,无论 Temperature 缩放如何,都能保持稳定的采样空间。

MCP (Glama) Discord

- VSCode 在 Copilot 中拥抱 MCP:VSCode 计划在 GitHub Copilot 中添加 MCP 支持,正如其直播所示。

- 社区成员正在讨论开源和闭源 MCP 实现的影响。

- MCP 服务器面临提示词注入威胁:有人担心 MCP servers 向 AI Agent 提供恶意的提示词注入,利用模型对工具调用(tool calls)相对于内部知识的信任。

- 建议的缓解措施包括在首次使用时显示工具描述列表,并提醒用户任何指令更改以防止漏洞利用。

- 安全频道针对 MCP 漏洞利用:社区成员考虑创建一个安全频道来主动预防漏洞利用,强调了在不了解后果的情况下将工具连接到 MCP Servers/Remote Hosts 的风险。

- 讨论强调了合规工具描述可能诱导模型包含后门的潜力。

- Python MCP 快速入门困扰用户:用户报告了运行 Python MCP quickstart (此处) 时的错误,导致推荐使用 wong2/mcp-cli 作为更好的替代方案。

- 该替代方案被认为更易于使用,且对于初始 MCP 设置更可靠。

- Swagger 端点变得 MCP 友好:一位成员正在开发 mcp-openapi-proxy,将任何 swagger/openapi 端点转换为可发现的工具,模仿其 mcp-flowise server 的设计。

- 他们最新的 mcp-server 在 5ire 中运行,但在 Claude 桌面版上遇到问题,表明跨不同平台存在兼容性挑战。

Modular (Mojo 🔥) Discord

- Mojo 的灵活性引发辩论:关于 Mojo 的动态性及其对性能影响的讨论,引发了对使用场景以及灵活性与速度之间平衡的思考,参考了这篇 HN 帖子。

- 有建议认为,动态性应该只在被主动使用时才产生性能损失,但人们仍然担心即使没有类(class),它也可能对 struct 的性能产生潜在影响。

- Monkey Patching 面临审查:社区探索了在 Mojo 中实现动态行为的 monkey patching 替代方案,例如函数指针或组合,并指出它更慢、更难理解、破坏静态分析工具,且通常无法完成正确的多态性(polymorphism)所不能完成的事情。

- 讨论强调,过度的 monkey patching 会导致代码难以理解并干扰静态分析,认为其效用并不足以抵消其缺点。

- Python 库移植挑战:成员们应对了将 Python 库移植到 Mojo 的障碍,特别是在动态性和全局状态方面,建议对性能关键组件利用 CPython interop。

- 成员们对移植严重依赖 Python 动态性和全局状态的库表示担忧,特别是当该库无法以其他方式运行时。

- 协议多态性(Protocol Polymorphism)受到关注:强调了协议多态性在不使用类树的情况下实现多态性的优势,并引用了 PEP 544 以实现无类层次结构的多态性。

- 一些成员支持使用函数指针哈希表来实现动态行为,并倾向于在 Mojo 的单元测试中使用静态类型和所有权规则。

GPU MODE Discord

- SOTA Agent 方法在算法上很简洁:成员们讨论了 Arxiv 上 SOTA Agent 方法往往涉及相对简单的算法,类似于一个小型的状态机(state machine)。

- 这意味着复杂的框架抽象可能是不必要的,建议使用更简单的数据、状态和 API 调用管理抽象就足够了。

- Triton Autotune use_cuda_graph 引起困惑:一位成员寻求关于

triton.autotune中use_cuda_graph参数的澄清,不确定它如何应用于单个 CUDA kernel。- 困惑源于 CUDA graph 通常优化的是一系列 kernel 启动序列,这与

triton.autotune的单 kernel 作用域形成对比。

- 困惑源于 CUDA graph 通常优化的是一系列 kernel 启动序列,这与

- Nvidia 的 NCCL AllReduce 使用双二叉树实现,超越环形拓扑:NVIDIA 博客文章表明,与 AllReduce 操作的 2D 环形延迟相比,NCCL 2.4 中的双二叉树(double binary trees)提供了全带宽和更低的对数延迟。

- NCCL 2.4 中增加了双二叉树,提供了全带宽和甚至低于 2D 环形延迟的对数延迟。

- WoolyAI 发布用于 GPU 使用的 CUDA 抽象层 Beta 版:WoolyAI 为其 CUDA 抽象层发布了 Beta 版,该层将 Kernel Shader 执行与 CUDA 应用程序解耦,将应用程序编译为新的二进制文件,并将 shader 编译为 Wooly 指令集。

- 这实现了动态调度工作负载以优化 GPU 资源利用率;他们目前支持 PyTorch。

- Cute Kernels 自动调优 CUDA 和 Triton Kernel:一位成员发布了 Cute Kernels,这是一个通过对 Triton 和 CUDA 实现进行自动调优来加速训练的 kernel 集合,并且可以自动分发到 cutlass 或 Triton。

- 该实现已用于生产环境以训练 IBM 的 Granite LLM,因为 LLVM 编译器有时可以生成比 NVCC 更高效的代码,因此在 kernel 后端进行调优是有意义的。

Eleuther Discord

- 开源 AI 项目寻找新成员:一位新成员正在寻求关于 LLM pre-training、post-training、RL 和可解释性 (interpretability) 等领域有趣的开源 AI 项目推荐,并为对理论工作感兴趣的人推荐了 modded-nanoGPT。

- 另一位成员建议,如果该新成员对 pre-training 感兴趣,最值得参与的项目是 GPT-NeoX 训练库。

- Token Assorted 论文的词表存疑:一位成员推测,Token Assorted 论文可能只是在针对 latent codes 进行 next token prediction 的 fine-tuning 过程中,将 codebook 添加到了其词表中。

- 他们批评这种方法可能无法推广到开放推理领域,并建议在推理语料库中寻找 K 个最常见的字符串可能会产生更好的结果。

- TorchTitan 分片需要 All-Reduce:在关于 TorchTitan embedding 分片的讨论中,有人解释说,在原生 TP 下,如果输入 embedding 在 vocab 维度上进行了分片,则之后需要进行 all-reduce,以处理 embedding 层对缺失词汇元素输出为 0 的情况,这在 GitHub 的此 issue 中得到了澄清。

- 成员们讨论了 embedding 层为缺失 token 输出零的存储影响,指出通信后立即需要存储空间,但如果可以重用该存储,则是免费的。

- Logit Lens 揭示了 Llama-2 的语言偏见:一位成员分享了他们对这篇关于多语言语言模型的论文以及使用 Logit Lens 分析 Llama-2 系列的赞赏。

- 该论文探讨了在以英语为主的数据上训练的 Llama-2 模型如何处理非英语 prompt,揭示了模型在调整到输入语言之前,最初会倾向于英语翻译的阶段。

LlamaIndex Discord

- yWorks 展示实时知识图谱可视化:@yworks 展示了其用于可视化知识图谱的 SDK yFiles,提供实时更新和动态交互。

- 该演示强调了实时动态更新和交互知识图谱的能力。

- Anthropic Cookbook 扩展:LlamaIndex 团队更新并扩展了他们的 Anthropic Cookbook,这是学习通过简单的 completion 和 chat 方法进行基础 API 设置的权威资源。

- 该 Cookbook 是在 LlamaIndex 框架内设置和利用 Anthropic API 的全面指南。

- 调试 SQLTableRetrieverQueryEngine 的 Prompt 打印:一位成员询问如何打印 LlamaIndex 中 SQLTableRetrieverQueryEngine 使用的 prompt,另一位成员分享了代码片段

from llama_index.core import set_global_handler; set_global_handler("simple")以启用 prompt 打印。- 该解决方案为调试和理解 SQLTableRetrieverQueryEngine 在查询执行期间使用的 prompt 提供了一种实用方法。

- Jina AI 包遇到安装问题:一位成员报告了 Jina AI 包的导入错误,建议使用

npm install @llamaindex/jinaai安装 provider 包,并附上了 LlamaIndex 迁移文档的链接。- 迁移文档解释了 v0.9 中向 provider 包的转变,通过确保正确的包安装来解决导入错误。

- LlamaExtract Beta 版吸引早期采用者:一位成员请求访问 LlamaExtract 的 beta 版本,他们被告知需私信(DM)特定用户并提供电子邮件,同时参考了 LlamaExtract 文档。

- 该文档概述了 LlamaExtract 的入门流程,并为潜在的 beta 测试人员重点介绍了关键功能。

Cohere Discord

- Command R7B 推理速度拖慢?:一位用户报告在 Hugging Face 上使用 Command R7B 时推理时间较慢,这被归因于用户硬件配置不佳或模型执行效率低下。

- 成员澄清说,问题可能源于用户的设置,而非 Command R7B 本身的性能问题。

- Ollama 工具问题困扰用户:一位用户在 Ollama 和 Langchain 中使用

command-r7b:latest进行工具调用 (tool invocation) 时遇到问题,收到关于缺少工具访问权限的错误。- 指导建议确保工具传递使用正确的 JSON 格式,并验证 Ollama 的配置是否支持工具调用。

- 开发者寻求开源 AI 机会:一位具有 GPT-2 预训练和在 Hellaswag 上进行模型微调 (fine-tuning) 经验的开发者正在寻找有趣的开源 AI 项目进行贡献。

- 该成员还对在不列颠哥伦比亚省温哥华地区的社交活动感兴趣。

- 504 Gateway 错误再次出现!:用户报告了反复出现的 504 Gateway Errors 和 502 Server Errors,表明存在暂时的服务器端问题。

- 错误消息建议重试请求,表明这些问题是瞬态的。

- 图谱增强主题模型效果:一位成员建议使用知识图谱 (Knowledge Graphs) 来增强主题建模 (topic modelling),并特别推荐了来自 TogetherAI 的 LLM。

- 他们强调了 TogetherAI 提供的慷慨免费额度,鼓励在他们的平台上尝试主题建模任务。

Notebook LM Discord

- 播客克隆流程简化:一位用户分享了一个 YouTube 视频,展示了 NotebookLM 与 Wondercraft 结合使用,通过专业克隆的声音创建播客,简化了播客制作流程。

- 评论认为 Wondercraft 比 11Labs 和 HeyGen 提供了更精简的方法,尽管其订阅价格对于非营利性播客来说可能较高。

- 关于 Drive 数据加密的讨论:一位用户指出,虽然数据在传输到 Google Drive 期间是加密的,但在 Drive 本身存储时并未加密。

- 这意味着 Google、成功的黑客以及用户与其共享目录的人员都可以访问这些数据。

- AI 语音像真人一样结巴:一位用户附上了一个 wav 文件示例,指出生成的音频文件中的 AI 发言人现在会像普通人一样结巴,听起来非常自然。

- 用户还提到,结巴增加了音频长度,可能会在 Google 的每日限制内减少实际传达的信息量。

- 解锁分析师/指南聊天设置对时间线生成的影响:一位用户发现 NotebookLM 中的聊天设置(如分析师/指南、简短/详细)会影响时间线和概览的生成,因为主持人在生成音频概览时实质上是请求了这些设置。

- 该用户还指出,他们的助手会将简报概览、详细时间线、角色表和原始资料合并为一个文档。

- NotebookLM 获得 Chrome 扩展支持:成员们讨论了向 NotebookLM 上传 URL 列表以将每个 URL 添加为来源的可能性,并提到有几个 Chrome 扩展 可用于此目的。

DSPy Discord

- DSPy Batch 函数探讨并行工作:一位成员询问 DSPy 的 batch 函数是否可以将并行工作委托给运行两个相同 LLM 实例的 vllm 后端,并引用了参数 num_threads、max_errors 和 return_failed_examples。

- 建议如果 VRAM 足够,应增加 num_sequences 或 pipeline_parallel_size,而不是使用单独的 API。

- VLLM 流水线并行实现负载均衡:在 vllm 设置中将 pipeline parallel size 设置为 2 后,一位成员确认 vllm 会处理负载均衡。

- 鼓励进行基准测试,以比较处理时间与非并行方法的差异。

- 提议为负载均衡创建 LM 子类:一位成员提议,如果两个实例位于不同的节点上,可以创建一个 LM 的子类来进行负载均衡,因为 DSPy 原生不支持此功能。

- 虽然可以使用代理 (proxy) 转发请求,但从 vllm 端解决被认为是更好的方法。

AI21 Labs (Jamba) Discord

- 字符串替换代码片段受到关注:一名成员在

general-chat中发布了一个用于字符串替换的 PHP 代码片段:$cleanedString = str_replace(['!', '@', '#', '$', '%', '^'], '', "This is a test string!@#$%^");。- 该代码用于移除字符串中的特殊字符。

- 笔记本电脑摔落导致损坏:一名成员报告称他们的笔记本电脑在摔了一跤后损坏了。

- 他们形容损坏情况不容乐观。

tinygrad (George Hotz) Discord

- Tinygrad JIT 耗时 30 分钟:有用户报告 tinygrad JIT 编译器花费了超过 30 分钟来编译一个 2 层模型。

- 消息中未包含任何解决方案。

- Tinygrad Loss 变为 NaN:有用户询问在 tinygrad 中初始步(step 0)后 loss 变为 NaN(非数字)的原因。

- 消息中未包含任何解决方案。

Torchtune Discord

- Torchtune 计划增加音频支持:成员们讨论了未来将音频模态 (audio modality) 引入 Torchtune 的高层计划。

- 目前还没有具体的时间表或技术细节,表明其仍处于早期规划阶段。

- Torchtune 音频支持仍在计划中:团队继续表示他们计划在未来为 Torchtune 添加音频模态支持。

- 截至目前,具体的时间表和技术细节尚未确认,这表明该功能仍处于初步规划阶段。

LLM Agents (Berkeley MOOC) Discord

- LLM Agents (Berkeley MOOC) 链接请求:claire_csy 请求一个有效的 LLM Agents Berkeley MOOC 讨论链接,因为之前的链接已过期。

- 用户寻求访问 MOOC 课程讨论以进行进一步参与。

- 需要 LLM Agents MOOC 的有效链接:用户 claire_csy 报告称,现有的 LLM Agents MOOC 课程讨论链接已过期。

- 该请求强调了为对 Berkeley MOOC 感兴趣的参与者提供更新且可访问链接的需求。

Gorilla LLM (Berkeley Function Calling) Discord

- Diffusion LLMs 的热度引发辩论:一名社区成员询问了关于 Diffusion LLMs(特别是 Mercury 模型)发布的炒作,以及它是否会取代基于 Transformer 的模型。

- 他们提到阅读了白皮书但发现难以理解,正在寻求社区专家的见解。

- LLaDA 模型:基于 Diffusion 的 LLM 范式转变:一名社区成员分享了 diffusionllm.net 的链接,解释说 Large Language Diffusion Models (LLaDA) 代表了语言模型架构的一种新范式。

- 他们阐明,与传统的自回归 (AR) Transformers 不同,LLaDA 使用去噪扩散过程以并行的、由粗到细的方式生成文本。

MLOps @Chipro Discord 没有新消息。如果该频道长期沉寂,请告知我们,我们将移除它。

第二部分:按频道划分的详细摘要和链接

频道详细明细已在邮件中截断。

如果你喜欢 AInews,请分享给朋友!预谢!