ainews-halfmoon-is-reve-image-a-new-sota-image

Halfmoon 推出 Reve Image:由前 Adobe 和 Stability AI 三人组打造的全新 SOTA(最先进)图像模型。

Reve 是一款由前 Adobe 和 Stability 成员 Christian Cantrell、Taesung Park 和 Michaël Gharbi 联手打造的新型复合 AI 模型。它目前已成为评分最高的图像生成模型,在文本渲染和排版设计方面超越了 Recraft 和 Ideogram 等此前的顶尖模型。

该团队强调“通过逻辑增强视觉生成模型”以及“利用先进的语言能力理解用户意图”,从而能够根据自然语言输入对视觉图像进行迭代修正。此外,DeepSeek-V3-0324 和阿里巴巴的 Qwen2.5-VL-32B-Instruct 模型也已发布,它们在视觉任务基准测试和数学推理等方面均展现出显著的性能提升。

Composite AI is all you need?

2025年3月21日至3月24日的 AI 新闻。我们为您检查了 7 个 subreddit、433 个 Twitter 账号 和 29 个 Discord 服务器(227 个频道和 10464 条消息)。预计节省阅读时间(以 200wpm 计算):1129 分钟。您现在可以标记 @smol_ai 进行 AINews 讨论!

今天 Qwen 和 Deepseek 发布了一些不错的更新,但我们将头条位置留给了一个知名度较低但雄心勃勃的新进入者。

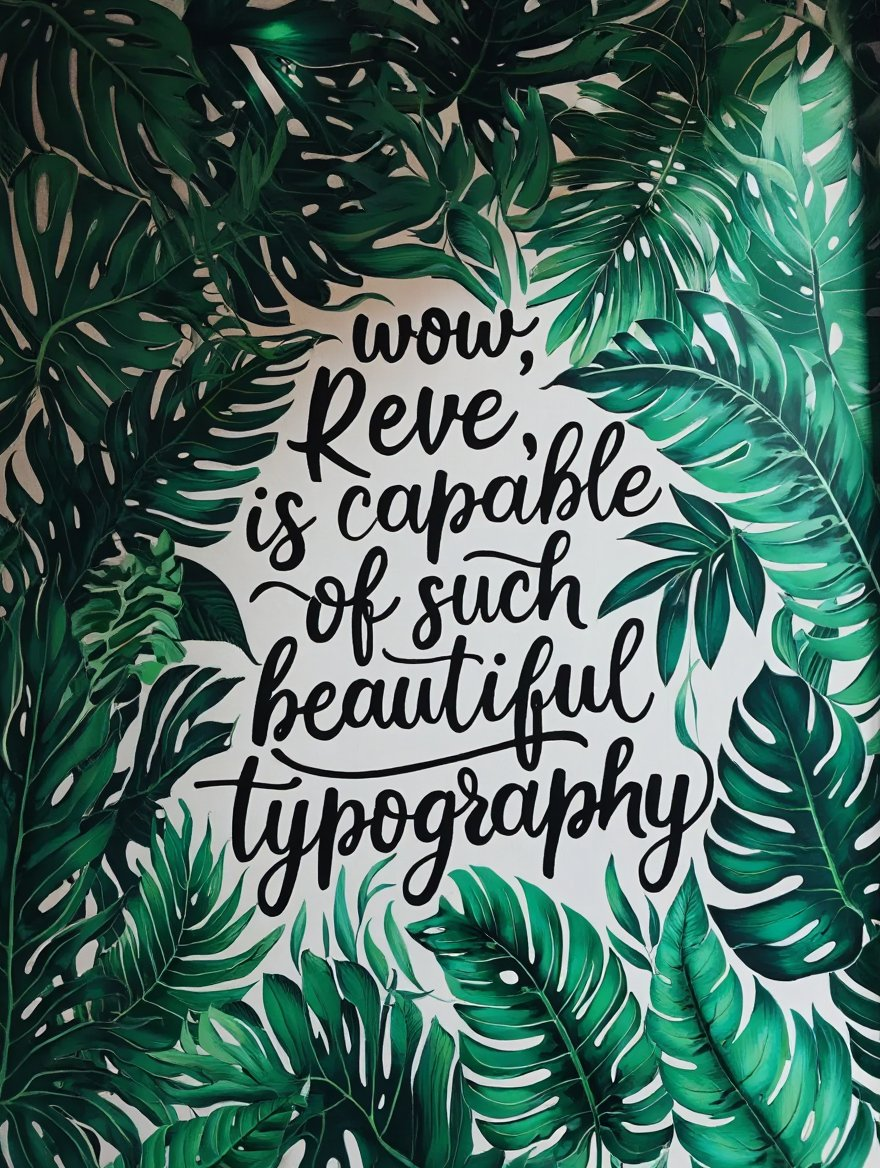

Reve(发音为 [ʀɛv],源自 “rêve”)已从 Artificial Analysis 的排行榜中脱颖而出,成为评分最高的 imagegen 模型,取代了之前的 SOTA 模型 Recraft。“该模型以其令人印象深刻的文本渲染、prompt adherence 和美学表现脱颖而出。” 我们发现它的上手体验非常简单。

而且它在 typography 方面击败了 Ideogram:

有趣的是,它来自前 Stability 产品副总裁 Christian Cantrell、Taesung Park 和 Michaël Gharbi。他们都是 Adobe 的校友,Michael 的公告最深入地揭示了他们的实现方式:

Reve 的使命是发明意图驱动(intent-driven)视觉创作的未来。捕捉创作意图需要机器对自然语言和其他交互有先进的理解。将这种意图转化为引人注目的视觉效果,需要交互式系统对它们生成的视觉世界有深刻的理解,以便它们能够迭代地进行修正。

今天的 text-to-image 模型本质上就是随机的世界片段生成器。没有智能。这既是数据问题,也是 representation 问题。我们需要为图像利用相当于完整文档的东西,但我们还没有很好的 representation。 我们在 Reve 的使命是用逻辑增强视觉生成模型。作为第一步,我们专注于通过先进的语言能力理解用户意图,从而实现卓越的复杂提示词理解和文本书写能力。

没有迹象表明它是一个单一模型,而更像是模型的某种 composite。这可能就是 Christian 想在 Stability 构建但没能实现的东西。

AI Twitter 摘要

以下是提供的推文中与 AI 相关的讨论摘要,已为技术受众进行分类:

模型发布与更新,包括性能表现

- DeepSeek V3-0324 发布与性能:@_akhaliq 宣布 DeepSeek-V3-0324 在 Hugging Face 上发布,@Teknium1 也注意到了其发布,@reach_vb 强调这是一个训练后更新(post-training update),具有提升下游性能的潜力。多位用户讨论了其性能和特性,包括 @teortaxesTex 认为它可与 Sonnet 3.6 媲美,以及 @teortaxesTex 指出在某些评估中它超越了 DeepSeek-R1 和 Claude-3.7。

- Qwen 2.5-VL-32B-Instruct 发布:@_akhaliq 宣布阿里巴巴的 Qwen2.5-VL-32B-Instruct 在 Hugging Face 上发布,@reach_vb 分享了性能基准测试,显示其在视觉任务上击败了 Qwen 2.5 72B 和 GPT 4o Mini,并增强了数学推理和人类偏好对齐。

- DeepSeek 模型推理服务:@_akhaliq 指出 DeepSeek 的新模型通过 Hyperbolic Labs 在 Hugging Face 上提供服务,@ClementDelangue 提到它也可以通过 FireworksAI 和 Hyperbolic Labs 获取。@Yuchenj_UW 表示 Hyperbolic Labs 现在支持 DeepSeek-V3-0324 的推理服务。

- MLX 上的 DeepSeek V3-0324:@reach_vb 报告称最新的 DeepSeek V3-0324 在配备 512GB 内存的 M3 Ultra 上使用 mlx-lm 运行速度超过 20 toks/sec,@awnihannun 也确认了这一点。

- NVIDIA Mamba 图像骨干网络:@mervenoyann 宣布 NVIDIA 在 Hugging Face 上发布了新的 Mamba 图像骨干网络,提供多种尺寸和分辨率。

Frameworks and Tools

- LangChain 和 LangGraph 使用案例:多条推文强调了 LangChain 和 LangGraph 的使用案例,包括沃达丰(Vodafone)用于数据运营的 AI 助手 @hwchase17,Klarna 用于客户支持的 AI 助手 @LangChainAI,以及一个医疗供应链 AI 系统 @LangChainAI。@hwchase17 还提到了 LangGraph 中的上下文管理。

- Weave-Agent 规划器讨论:@jd_pressman 讨论了 Weave-Agent 的设计与规划,考虑了 ReActTree 和 MuZero 等 Agent 规划方法。

- Smolagents 的增长:@AymericRoucher 宣布 smolagents 已达到 1.5 万个 GitHub Star,并正在通过 E2B 或 Docker 集成沙箱化代码执行。

- Together Chat:@togethercompute 推出了 Together Chat,其特点是使用 DeepSeek R1 等 OSS 模型进行网页搜索、编码、图像生成和图像分析,@togethercompute 列出了其技术栈。

Agent Engineering and Applications

- Agent 工程演讲与文章:@swyx 分享了关于 Agent 工程的演讲和文章,定义了 Agent,概述了六个要素,并讨论了它们的潜在影响。

- Linear 与 Codegen 集成:@mathemagic1an 宣布了 Codegen 与 Linear 的集成,使 Agent 能够解决工单并关闭重复项,并强调了 Linear 为机器人扩展的功能 @mathemagic1an。

- Agent 评估指标:@_philschmid 提倡使用 pass^k 而非 pass@k 来评估 Agent,认为这能提供更准确且符合用户体验的性能指标。

Economic and Strategic Implications

- AI 自动化与经济增长模型:@EpochAIResearch 讨论了 GATE,一个用于 AI 自动化经济影响的模型,预测了数万亿美元的 AI 投资、极端的算力扩展以及显著的经济增长。

- 美日国防创新奖:@SakanaAILabs 宣布 Sakana AI 在美日国防创新竞赛中获奖,凭借其新颖的 AI 解决方案脱颖而出。

- 关于中国与 AGI 的观点:@teortaxesTex 分享了关于中国技术和战略优势的多项观点,包括其国家能力、工业基础和 AGI 方面的努力。@teortaxesTex 还提到了 DeepSeek 的“补充品商品化 (commoditize your complement)”理论。

ARC-AGI 基准测试

- ARC-AGI-2 发布与竞赛:@fchollet 宣布发布 ARC-AGI-2,这是一个旨在衡量通用流体智力的基准测试,并启动了 ARC Prize 2025 竞赛,大奖奖金达 700,000 美元 @fchollet。他指出,目前顶尖的 AI 方法得分非常低,需要测试时自适应 (test-time adaptation),并讨论了评估方法论 @fchollet。

幽默与梗图

- 凭感觉编程 (Coding by Vibes):@gneubig 分享了一条关于通过提示词改进 Vibe Coding 的推文,区分了个人项目的 Vibe Coding 与 Agent 行为之间的差异。

AI Reddit 回顾

/r/LocalLlama 回顾

主题 1. DeepSeek V3-0324:性能及对比 R1 的预期

- DeepSeek 发布新的 V3 Checkpoint (V3-0324) (分数: 638, 评论: 125):DeepSeek 发布了其新的 V3 Checkpoint (V3-0324),其中可能包含针对先前版本的更新和改进。帖子中未提供有关具体功能或增强的进一步细节。

- 关于 DeepSeek-V3 Checkpoint (V3-0324) 的讨论包括对其作为未来 R2 版本基座的猜测,一些用户预计它将在 4 月发布。关于 R2 是否需要 V4 存在争论,有观点认为通过更好的 Scaling 和推理技术,无需新基座模型即可实现改进。

- 用户正在寻求基准测试结果以比较新模型的性能,一些人注意到目前尚未发布官方基准测试。由于权重已开源发布,预计很快会有独立测试,并有人呼吁 DeepSeek 像 Mistral 一样发布自己的基准测试。

- 有观察称该模型的编程能力有所提升,并已部署在 API 和 Web 平台上,一些用户注意到与原始版本相比,该版本审查更严格。MTP 模块因其在提高解码速度方面的作用而受到关注,根据研究论文所述,其实现了 1.8 倍的 TPS。

- 新版 DeepSeek V3 vs R1 (前者为 V3) (分数: 282, 评论: 56):该图片对比了两个版本的 DeepSeek 用户界面:V3 和 R1。V3 展示了更具动态感的设计,带有“多风”、“多雨”、“晴朗”和“下雪”的动画天气卡片;而 R1 提供了一个更简单的界面,带有“风”、“雨”、“太阳”和“雪”的切换按钮,每个按钮由单个图标表示。

- DeepSeek V3 和 R1 的界面正在进行对比,V3 提供动画天气卡片,而 R1 具有更简单的切换按钮。用户对每个界面对应的模型以及用于对比的提示词感到好奇。

- 尽管 DeepSeek 模型不是最便宜的,但由于成本和灵活性,用户更倾向于开源模型而非专有模型。据指出,Sonnet 比 V3 贵得多,尤其是在非高峰时段。

- 讨论中提到了在本地运行 command-a,并提供了进一步探索的链接,例如 Hugging Face 模型 和展示界面的 GIF。用户对视频等更多动态内容表现出兴趣,以便更好地理解动画功能。

- DeepSeek V3-0324 在我的代码创意基准测试中已经追平了 Sonnet 3.7 —— “用 Python 编写一个渲染包含多个彩色光源的有趣场景的光线追踪器(raytracer)。” (Score: 215, Comments: 43): DeepSeek V3-0324 在涉及 Python raytracer 任务的代码创意基准测试中追平了 Sonnet 3.7,展示了较其先前版本的显著改进。基准测试显示,虽然大多数 LLM 生成的是简单的 RGB 场景,但 Sonnet 3.7 以及现在的 DeepSeek V3-0324 产生了更复杂且更具美感的场景,尽管这种创意提升的方法仍处于推测阶段。更多细节和数据可在 GitHub 仓库中找到。

- DeepSeek V3-0324 因其“疯狂的品味(psychotic taste)”而受到关注,与前代相比,它更像 R1 或 QwQ 等推理模型,并且因其创意写作输出而面临批评,一些用户认为尽管其基准测试分数很高,但输出内容并不连贯。Gemma 3 在小说创作中的连贯性和创意备受瞩目,与经常受到批评的 R1 输出形成鲜明对比。

- R1 在基准测试中失败了,尽管进行了尝试,但未能生成可运行的程序,这引发了人们对其与旧版 DeepSeek V3 相比有效性的质疑。讨论表明,与之前的 DeepSeek 版本不同,R1 的长思维链(CoT)并不能保证成功的输出。

- 值得注意的是 DeepSeek V3-0324 和 Sonnet 3.7 的程序体积有所增加,有人推测这是否归功于针对更长生成长度的训练或其他优化。单次尝试生成 10kB 的代码被认为具有重大意义,预示着模型能力的潜在进步。

主题 2. Meta 的 ParetoQ 探索:2-bit 模型的承诺

- Meta 上个月发布了一篇似乎被忽视的论文。《ParetoQ: Scaling Laws in Extremely Low-bit LLM Quantization》。这是一个比 BitNet 更好的解决方案,这意味着如果 Meta 愿意(增加 10% 的额外计算量),他们可以为我们提供性能极高的 2-bit 模型。 (Score: 505, Comments: 49): Meta 的 ParetoQ 论文引入了极低比特 LLM 量化的扩展定律(scaling laws),提出了一个比 BitNet 更有效的解决方案。这使得仅需增加 10% 的计算需求即可交付高效的 2-bit 模型成为可能。

- 量化与性能: 讨论强调了 2-bit 量化在轻量级模型中的潜力,一些用户指出,这对于创意写作助手和聊天机器人等应用可能具有变革性。然而,人们也提出了对潜在速度下降以及量化对模型智能和指令遵循影响的担忧,并希望通过使用 vulkan/T-MAC kernels 来改进。

- 研究与对比: 用户讨论了 ParetoQ 框架作为一种更严谨的量化设置比较方法,强调了 2 到 3 bits 之间的学习转变。该论文因其优化 2-3 bit 模型训练的能力而受到关注,并与 AQLM 进行了对比,还提到了人类突触具有 4-5 bpw。

- 资源与参考: 讨论中提到了 Intel auto-round 项目和 DeepSeek-R1-int2-mixed-sym-inc 等资源,这些资源在保持 97.9% 准确率的情况下实现了相当的性能。论文链接:arxiv.org。

主题 3. 扩展 LLM 功能:从文本到多模态

- 我制作了一个关于 Transformer 工作原理的图表和解释 (Score: 272, Comments: 20): LLM 的功能正在向文本之外扩展,一位用户创建了一个图表和解释来阐述 Transformer 的运作方式。这项工作旨在为对 AI 和机器学习感兴趣的人提供对 Transformer 内部机制更清晰的理解。

- 输入和输出嵌入 (Input and Output Embeddings):讨论了现代 Transformer 架构中输入和输出嵌入是否仍然关联,用户指出获取这些架构全面且最新的概览非常困难。

- 资源与图表:多位用户分享了辅助理解 Transformer 的资源,包括 Cromulent123 的详细解释以及指向包含相关图表的 GitHub 页面的链接 (GitHub Llama Nuts and Bolts)。另一位用户推荐了 Ben Levinstein 的 Substack 上关于 Transformer 的概念指南。

- 关于 Transformer 功能的详细解释:Cromulent123 深入解释了 Transformer 的工作原理,重点关注 Token 嵌入过程、Query, Key, and Value Matrices 的作用,以及用于确定相关性的 Attention Scores 概念。他们还讨论了通过多个 Transformer 块进行上下文增强 (contextual enrichment) 的重要性,强调了对 Token 关系的细微理解。

- 我不再确切理解 LLM 到底是什么了 (Score: 233, Comments: 89): 作者对 Large Language Models (LLMs) 日益扩大的定义感到困惑,最初理解为基于文本数据预训练权重预测下一个词的系统。他们质疑 LLM 现在如何涵盖音频和图像生成等能力,并引用了处理 3D 点云数据的 SpatialLM 作为这种范围扩大的例子,寻求关于其与语言模型联系的澄清。

- 扩散模型与 LLM:关于像 Stable Diffusion 这样的模型是否属于 LLM 存在辩论,因为它们整合了 T5 来理解文本提示,尽管它们主要生成图像。Co0k1eGal3xy 认为,尽管这类模型传统上不属于 LLM 范畴,但由于其先进的语言理解能力,它们与 LLM 非常接近。

- Tokenization 与多模态模型:suprjami 解释说,所有数据(包括文本、图像和音频)都被 Tokenized 成数字供 LLM 处理,这使得它们能够学习不同媒体类型之间的关系。Chair-Short 详细说明了 Self-attention 机制和 Positional Encoding 如何使 LLM 能够处理不同的数据模态,暗示了从纯文本模型向多模态能力的转变。

- 定义 LLM:讨论突显了定义 LLM 时模糊的界限,一些人将其视为能够处理和生成语言的大型模型,无论输入类型如何。SnackerSnick 提到 LLM 使用 Tokenization 和 Embeddings 来预测后续 Token,而 Otherwise_Marzipan11 和 Co0k1eGal3xy 则认为品牌化以及与语言(无论是文本、音频还是图像)的交互促成了 LLM 这一标签的使用。

- Chatbot Arena 上可能出现的 Llama 4 原型 (Score: 105, Comments: 21): MetaAI 正在 Chatbot Arena 上测试几个匿名的 Llama/Meta 模型,这些模型可能是 Llama 4 的原型。像 aurora、ertiga、pinnacle、solaris 和 spectra 这样的模型支持图像功能,而 rhea 被识别为 Llama 3。

- 讨论显示了对 Chatbot Arena 上模型身份的怀疑,因为一些模型(如 anonymous-chatbot)声称来自 OpenAI,而其他模型(如 rage 和 phantom)则被怀疑是 Meta 的模型。用户注意到这些模型经常提供不一致的公司归属信息,这可能是由于防护模型(guard model)或幻觉(hallucinations)造成的。

- anonymous-chatbot 和 nebula 模型因其性能而受到关注,其中 nebula 因在测试中表现出色而特别受到称赞,而 rage 和 rhea 等模型收到的评价褒贬不一,其中 rhea 因其友好的态度和对表情符号的使用而受到关注。

- 关于是否有模型确实是 Llama 4 存在争议,用户指出没有模型明确自称为 Llama 4。一些评论认为 Meta 可能正在测试多样化的写作风格,或使用随机化的系统提示词来掩盖模型的真实来源。

主题 4. TeapotLLM 的影响:轻量级问答模型

- 发布 TeapotLLM - 一个开源的 ~800M 模型,用于抗幻觉问答和文档提取,完全在 CPU 上运行。 (Score: 163, Comments: 50): TeapotLLM 是一个开源模型,专为抗幻觉问答和文档提取而设计,采用约 8 亿参数 的架构。它经过优化,可以完全在 CPU 上运行,使其在无需专门硬件的情况下也能被广泛使用。

- TeapotLLM 的抗幻觉能力:讨论强调了该模型对抗幻觉的关注及其相对于 Qwen 和 Llama 等模型的表现,一些人对减少幻觉的说法表示怀疑。用户对其在幻觉排行榜上的排名感到好奇,目前已提供 demo 供测试。

- 模型的语言和输出能力:该模型主要以英语训练,但理论上支持 flan-t5 涵盖的所有语言。它可以使用将字段解析为类型化 JSON 的库将结构化数据提取为 JSON,详见 文档,不过人们对扩大语言支持和在 ollama 等平台上进行测试很感兴趣。

- 性能和资源占用:TeapotLLM 针对 CPU 使用进行了优化,可运行在 Google Colab 约 2GB 的 RAM 内,方便计算资源有限的用户使用。人们有兴趣探索在更现代的模型(如 Qwen 0.5B)上进行微调以潜在地增强性能,同时保持当前模型在文档提取和简洁回答方面的优势。

其他 AI 子版块回顾

/r/Singularity, /r/Oobabooga, /r/MachineLearning, /r/OpenAI, /r/ClaudeAI, /r/StableDiffusion, /r/ChatGPT, /r/ChatGPTCoding

主题 1. ChatGPT 中新增改进的 Memory Alpha 增强了交互体验

- 新的改进版 memory alpha 简直疯狂 (Score: 414, Comments: 241): 该帖子讨论了 ChatGPT 中新的改进版 memory alpha 功能,将其影响比作从 GPT-2 到 GPT-4 的跨越。作者对 DeepSeek 的竞争能力表示怀疑,除非他们采用类似的进步,并对 OpenAI 的持续领导地位表示信心。

- 许多用户对 ChatGPT 中新的 memory alpha 功能 的可用性和不一致性表示沮丧和困惑,一些用户尽管拥有 pro 订阅,却意外失去了访问权限。CyberNoche 和 jalpseon 强调了停用问题,而 alpha_rover 和 DamionPrime 分享了关于记忆持久性的积极体验。

- 讨论涉及了 ChatGPT 订阅的定价,Initial-Kangaroo-534 质疑每月支付 $200 的价值。与之形成对比的是 alpha_rover,他认为该功能对于项目连续性具有不可估量的价值,相比其他 AI 工具,他会非常想念这个功能。

- 一些评论者如 3xNEI 和 SillyTwo3470 推测了记忆功能的更广泛影响,认为这可能导致人机混合 (human-AI hybridization)。他们强调了增强个性化的潜力以及工具与伙伴之间界限的模糊,表明用户与 AI 交互方式将发生重大转变。

主题 2. Anthropic 的营收激增,追平 OpenAI 2023 年的数据

- Anthropic 目前月营收约 1.15 亿美元;与 2023 年 11 月的 OpenAI 持平 (Score: 272, Comments: 50): 据报道,Anthropic 每月产生 1.15 亿美元 的收入,追平了 OpenAI 在 2023 年 11 月的营收。2025 年的营收预测估计 20 亿美元 是可能的,40 亿美元 是乐观的,其中 Manus 为其营收贡献了约 每任务 2 美元。一张图片展示了从 2024 年 12 月到 2025 年 3 月年化营收增长了 40%,数据来自 Bay Area Times。

- Claude 的影响和使用: 用户强调 Claude Code 是一款改变游戏规则的工具,由于其在自动化编程任务方面的有效性,一些人每天在上面花费 $50。虽然提到了 AIDER 和 Cursor’s Agent 等替代方案,但被认为不如 Claude 有效,Claude 被描述为类似于拥有一个称职的实习生。

- 营收来源与背景: Anthropic 营收 的很大一部分归功于与 AWS Bedrock 的集成,随着企业广泛采用,预计将持续增长。讨论明确指出,报告的数字代表营收,而非利润。

- 模型对比与偏好: 用户比较了各种 AI 模型,指出尽管在某些情况下上下文窗口较小,但 Claude 提供了卓越的性能。提到了 OG 600b 模型 和 Sonnet 3.7,后者因其智能能力和迭代解决问题的能力而受到称赞。

主题 3. AI 驱动的 Bug 修复自动化:一场为期 27 天的实验

- 我让 AI 连续 27 天修复我生产环境中的 Bug - 经验教训 (Score: 191, Comments: 80): 在 27 天的时间里,作者使用 Claude 3.7 自动修复了 21 个独特的生产环境 Bug,结果有 12 个成功的一次性修复,6 个部分成功,以及 3 个由于错误假设或复杂问题导致的失败。尽管最初的时间投入超过了手动修复 Bug,但该系统减少了认知负荷和上下文切换,尽管它可能不适合利基或复杂的特定领域问题。

- 对开源的兴趣: 人们对该项目开源有浓厚兴趣,Relevant-Pitch-8450 表示打算在清理代码后分享。用户赞赏其 UI 设计,并看到了该工具的潜在效用。

- 潜在的商业化: 像 ClassyBukake 这样的评论者建议该工具可以作为一项服务进行货币化,强调了它从个人和商业角度的吸引力。

- 成本和时间效率: HelpRespawnedAsDee 提出了关于该工具在较长时间内的成本和时间效率的问题,建议继续使用以评估长期效益。

主题 4. 高级 Claude 工作流集成:MCP 外部工具

- 我的 Claude 工作流指南:使用 MCP 外部工具的高级设置 (Score: 124, Comments: 20): 该帖子提供了设置 Claude 桌面应用程序与 Brave Search 和 Tavily 等外部工具配合使用的详细指南,以增强其功能。这需要 Claude Pro 订阅(每月 20 美元)以及安装 Node.js 和 Python 等特定软件。指南包含了 Windows 和 macOS 的配置示例、访问开发者设置的说明,以及安装和设置问题的故障排除技巧。该指南强调了增强型网页搜索、文件系统访问和顺序思维(sequential thinking)的好处,并为有效使用提供了额外资源和安全性考量。

- Claude 桌面应用程序设置因其对非开发者的友好性而受到称赞,为普通桌面用户在无需编程技能的情况下增强 Claude 的能力搭建了桥梁。该指南与 Claude Code 进行了对比,后者为习惯于命令行界面(CLI)的技术型用户提供了更多灵活性。

- 推荐给那些有兴趣探索其功能的用户的 Claude Code 教程可在 YouTube 上观看。这突出了两种方法之间的区别:一种优先考虑易用性,另一种则侧重于高级自定义。

主题 5. Wan 2.1 视频帧功能在 AI 中的创新

- Wan-i2v - Prompt: a man throws a lady overboard from the front of a cruiseship. (Score: 812, Comments: 51): Wan-i2v AI 引入了新功能和进步,正如提示词场景 “a man throws a lady overboard from the front of a cruiseship”(一个男人从游轮前部将一位女士扔下船)所演示的那样。虽然该帖子没有提供更多细节,但它表明了 AI 生成内容对动作导向场景或潜在争议性主题的关注。

- Wan-i2v AI 被讨论为一种 image-to-video 工具,一些用户注意到它无法独立从电影 Titanic 中创建起始帧,这意味着它使用了直接的截图。这突显了 AI 在没有参考图像的情况下生成完全原创内容的潜在局限性。

- 用户幽默地批评了 AI 对物理学的理解,评论认为虽然 AI 目前可能无法掌握物理定律,但 Stable Diffusion 和 Wan2.1 等技术的进步正在迅速提高动画中真实物理效果的模拟,例如“胸部抖动”。

- 对话还涉及了 AI 生成电影替代结局的想法,用户开玩笑说要为 Titanic 等电影创作新的结局。这引发了关于版权问题以及专注于 AI 制作内容的 YouTube 频道潜力的讨论,尽管知识产权方面存在挑战。

- Wan 2.1 首尾帧功能官方模型即将发布 (Score: 100, Comments: 13): Wan 2.1 即将发布支持首尾帧插值(start and end frames interpolation)的官方模型,社交媒体平台用户 “danielzy1990” 证实了这一点。更多详情请参考 GitHub issue comment。

- 用户预期 Wan 2.1 的新模型将显著增强视频控制能力,一些人表达了对改进的期待,例如添加类似 Hunyuan 的引导层(guidance layer)以缩短生成时间。

- 与 Hunyuan 的对比突显了其效率:Hunyuan 以 24fps 生成视频片段的时间几乎只有 Wan 以 16fps 生成时间的一半,强调了引导训练(guidance training)的潜在优势。

- 人们对该模型支持多个定时关键帧(multiple timed keyframes)的能力很感兴趣,一些用户希望它能保持与现有 img2vid 功能的兼容性。

AI Discord 回顾

由 o1-preview-2024-09-12 生成的摘要之摘要的摘要

主题 1. DeepSeek V3 意外发布震撼 AI 社区

- DeepSeek V3 作为开源巨头登场:DeepSeek 发布了 DeepSeek V3,这是一个拥有 685B 参数的 Mixture-of-Experts 模型,采用 MIT license,可在 Hugging Face 上获取。社区对此感到兴奋,并将其性能与 OpenAI 的 o1 模型进行对比。

- DeepSeek V3 表现优于 R1?:用户声称 DeepSeek V3 在编程和前端任务中击败了 R1,即使没有 chain-of-thought 推理,并指出其成本效益和在数学方面的卓越表现。

- DeepSeek V3 发布时竟然没有 README!:DeepSeek 发布 DeepSeek V3 时没有提供完善的文档,用户对缺少 README 感到既有趣又困惑,但官方提供了一个用于实验的 playground。

主题 2. Qwen 模型及即将到来的 AI 创新

- Hugging Face Transformers 已添加 Qwen3 支持:开发者们非常激动,因为 Qwen3 的支持已集成到 Hugging Face Transformers 中,为即将到来的 Qwen3 模型做好了准备。

- Qwen2.5-VL-32B-Instruct 在 Apache 2.0 协议下发布:Qwen 发布了 Qwen2.5-VL-32B-Instruct,这是一个通过强化学习(reinforcement learning)微调的多模态视觉语言模型,增强了数学推理和视觉问题解决能力。

- Qwen3 将支持 CPU 推理?:用户推测 Qwen3-15B-A2B 因其尺寸原因,可能非常适合 CPU 推理,从而使先进的 AI 模型更加普及。

主题 3. LLM 推理训练的辩论与进展

- R1-Zero 训练偏差揭晓:研究人员揭示了类 R1-Zero 训练中的一种偏差,即使用行均值(row mean)会偏向更短的正确回答和更长的错误回答,从而影响模型输出。

- GRPO 的长度爆炸困扰从业者:用户正在努力解决 GRPO 训练导致的长度爆炸(length explosion)问题,并讨论了长度裁剪(length clipping)和课程学习(curriculum)等应对技术。

- MathFusion 增强 LLM 数学能力:MathFusion 通过跨问题指令合成增强了 LLM 的数学推理能力,提升了 DeepSeekMath-7B、Mistral-7B 和 Llama3-8B 等模型的表现。

主题 4. Agent 工程与 MCP 进展

- AGNCY 倡议推进 Agent 交互标准:Luke 领导的 AGNCY 旨在为 Agentic 交互创建开放标准,为开发更高效的 AI Agent 提供强大的框架。

- MCPwizard 简化 MCP Server 创建:开发者推出了 mcpwizard,这是一个 CLI 工具,可以简化 MCP Server 的创建和部署,从而轻松地为 Claude 等 AI 助手添加自定义工具。

- A16Z 探讨 MCP 与 AI 工具链的未来:A16Z 发布了关于 Model Context Protocol (MCP) 的深度研究,分析了其作为 AI 模型标准接口的潜力,并讨论了其对 AI 工具链的影响。

主题 5. NVIDIA Nemotron-H 模型与硬件进展

- NVIDIA 发布 Nemotron-H 混合模型:NVIDIA 推出了 Nemotron-H 系列,这是 Mamba-Transformer 混合模型,提供高达 3 倍 的速度提升,模型参数范围从 8B 到 47-56B。

- Mistral 24B 重新受到青睐:Mistral 24B 被誉为近期最伟大的发布之一,用户对其在 Apache 2.0 协议下的强大性能和易用性印象深刻。

- Flash Attention 与 Hopper 架构揭秘:爱好者们深入研究了 Flash Attention 优化,并澄清了关于 Hopper 架构 64B swizzle 的困惑,增强了对 NVIDIA GPU 架构的理解。

第一部分:高层级 Discord 摘要

Perplexity AI Discord

- Sonar 3.7 Bug 导致模型中断:一位用户报告了 Sonar 3.7 的一个 Bug,在编码时执行 chown 命令会导致模型退出并中断对话,用户想知道高源数据量与旧源数据量在性能上是否存在差异,以及搜索步骤之间的推理质量是否有区别。

- 一位用户跟进指出,根据他们的经验,这种差异相当大,并在此分享了截图。

- Sonar 模型给出截断的代码片段:多位用户报告称 Perplexity API 中的 Sonar model 会出现响应截断的问题,特别是在周末之后,尽管 JSON 格式是正确的。

- 一位用户提供了一个 JSON 请求和被截断响应的示例,并指出切换到 sonar-pro 可以解决该问题,但出于成本考虑这并非首选方案。

- Llama Index 与 Sonar 适配问题:一位用户在将 Sonar 配置为 Llama Index 的聊天引擎用于 RAG project 时遇到错误,并请求协助。

- 这凸显了在将 Sonar 与其他 AI 开发工具结合使用时可能面临的集成挑战。

- Deep Research 速率限制:一位用户询问是否可以放宽每分钟 100 deep researches 的限制,因为他们的应用程序有批量处理的需求。

- 这一询问强调了工作负载较大的用户对更高 API 使用限制的需求。

Unsloth AI (Daniel Han) Discord

- Bonsai Bitnet 征集测试者以对比 Qwen2.5:一位成员正在为 deepgrove/Bonsai 寻找测试者,询问 bitnet 与 Qwen2.5 0.5B 的对比情况。

- 他们还链接了一个相关的 Hugging Face Transformers PR,内容涉及添加 Qwen3 和 Qwen3MoE 的支持。

- Orpheus TTS 模型获得音频微调功能:根据新发布的 Unsloth notebook,Audio finetuning 已支持 Orpheus TTS 模型。

- 一位用户指出,这项工作全部由一位特定成员完成,且该 notebook 与本地音频 Tokenizing 后再进行常规 Llama3 finetuning 相比,流程要精简得多。

- Unsloth GitHub 接受直接 PR,但需等待:一位成员询问了如何向 Unsloth 的 GitHub 贡献代码,另一位成员确认直接提交 PR 是可以接受的,但由于近期 PR 和 Issue 数量较多,可能会有延迟。

- 讨论随后转向在 Colab 中修改数据准备步骤以适配 .txt 文件,旨在实现更廉价的推理,并链接了原始 Issue。

- GRPO 推理需要训练数据:一位用户询问是否可以仅对输出的部分内容进行训练,特别是希望模型在推理过程中能自主生成推理过程。

- 建议参考 GRPO notebooks 作为添加推理的标准方法,并指出模型在训练期间必须看到推理轨迹 (reasoning traces),才能在推理时将其纳入考虑。

- Unsloth 微调指南现已发布:一位成员制作了 fine-tuning with Unsloth 指南,涵盖了理论层面、实践案例以及如何使用 GRPO 创建推理模型。

- 该指南汇集了过去一年中所学到的所有知识。

LMArena Discord

- Nebula 抢占聊天机器人风头:成员们发现 Nebula(一个疑似来自 DeepMind 的匿名聊天机器人)表现非常出色,被认为是目前最强的匿名模型,在数学、英土(英语-土耳其语)翻译以及解决 Arc-AGI 问题方面优于其他模型。

- 它看起来与 Phantom 类似,用户认为后者是 Google 的模型,两者都在竞技场中接受测试。

- GPT-4o 获得人类对齐增强:通过 OpenAI 的后期训练,GPT-4o 得到了显著提升,由于自 12 月以来持续的预训练,可能很快就会超越 Grok 3。

- 推测认为它可能会登顶排行榜,这得益于 OpenAI 在 LM arena 人类偏好对齐方面的深厚造诣。

- Specter 演进为 Phantom 再到 Nebula:Specter、Phantom 和 Nebula 是同一模型的依次修订版本,在短短几周内展现了性能飞跃。

- 成员们注意到,从 Specter 到 Phantom 的性能提升比从 Phantom 到 Nebula 的提升更为显著。

- LMArena 修复 Bug 并调整排行榜:LMArena alpha 版本收到了包括 Bug 修复和新功能在内的更新,鼓励测试者使用密码

still-alpha在 alpha.lmarena.ai 继续测试。- 修复了一个导致消息无法保存和投票失败的 Bug;排行榜列现在支持排序并实现实时数据更新;可以通过 此 Google Forms 链接 提供反馈,并通过 此 Airtable 链接 提交 Bug 报告。

Cursor Community Discord

- Cursor 的 CMD+Backspace 组合键引发问题:用户对 Cursor 的 CMD+Backspace 导致意外删除项目感到沮丧,部分用户甚至丢失了多达 7 次 工作成果。

- Cursor 团队计划将默认键绑定更改为 CMD+Shift+Backspace,并提供配置选项,预计于周一推出。

- Claude 3.7 MAX 增加用户开销:Claude 3.7 Thinking(现更名为 Claude 3.7 MAX)从 Pro 订阅计划转为按量计费,因成本增加引起用户不满。

- 与标准的 Claude 3.7 Sonnet 相比,Claude 3.7 MAX 具有更高的上下文窗口和更多的 tool calls 次数。

- Windsurf 在响应速度上领先:一些用户发现 Windsurf 比 Cursor 更快、响应更灵敏,并指出了 Cursor 存在的卡顿和冻结问题。

- 其他用户则因回滚功能和 Agent 性能而更青睐 Cursor,尽管他们也承认 AI 编程仍面临挑战。

- MCP 组合成为热点:用户正在尝试各种 MCP (Model Context Protocol) 服务组合来增强像 Cursor 这样的 AI 编程 Agent,其中 Supabase MCP 备受关注。

- 一些用户认为 MCP 可能被过度炒作,并指出 Agent 存在过度使用或利用不足的情况,建议需要更清晰的指令。

- 3D 集成令 AI 编程者受挫:一位用户在尝试使用 Claude 将 3D 模型(FBX 格式)集成到 three.js 项目时遇到了困难,主要面临 FBXLoader 的问题。

- AI 在处理 3D 设计方面的局限性变得显而易见,建议切换到 GLTF 格式 并简化任务。

aider (Paul Gauthier) Discord

- DeepSeek V3-0324 击败 R1?:Aider 社区对新的 DeepSeek V3-0324 发布感到兴奋,认为它在编程和前端任务中表现优于 R1,尽管它缺乏思维链(chain of thought)。

- 成员们强调了它与之前版本相比在编程和数学方面的优势,在 Benchmark 中将其与 Sonnet 3.5 进行对比,并指出了其成本效益。

- Aider 驯服 Sonnet 的过度积极行为:Paul Gauthier 透露,他通过在 Prompt 中添加一行让其“冷静”的指令,成功缓解了 Sonnet 3.7 的过度积极行为;该功能现已在 main branch 中可用。

- 他鼓励用户根据他们的编程环节对这一调整提供反馈。

- Aider 启用新主页:Paul Gauthier 宣布在 aider.chat 发布 Aider 的新主页,展示了对 Claude 3.7 Sonnet、DeepSeek R1 & Chat V3、OpenAI o1、o3-mini & GPT-4o 等模型的兼容性,并支持超过 100 种编程语言。

- 此次更新为新用户提供了更好的入门介绍,并作为资源的中心枢纽。

- Aider 的 Context 命令简化对话:Paul Gauthier 在 Aider 中引入了一个实验性的

/context命令,可自动设置对话上下文,在与 Sonnet 3.7、R1 和 o3-mini 配合使用时效果最佳。- 这一新命令通过智能识别并向对话中添加相关文件,提升了用户体验。

- 社区策划 LLM 上下文:一位成员宣布推出 ctxs.ai/weekly,这是一个致力于收集 aider conventions、prompts 以及 LLM 面向的文档片段的网站。

- 目标是为 aider 社区 创建一个有用的资源库,该成员正积极征求关于如何改进该网站的反馈。

Nous Research AI Discord

- LCPP 上下文长度令人困惑:用户发现,在 LCPP 中将上下文长度设置为 100 仍会尝试分配 180GB 的 RAM,导致 VRAM 耗尽。

- 建议包括 Attention 覆盖了分配的上下文长度、缺少 ROPE 特定的参数,或使用 Q8 量化。

- Deepseek V3 媲美 Sonnet 3.7:Deepseek V3 0324 显示出与 Sonnet 3.7 相当的变化,暗示它们在架构上有着共同的进步,可参考这张图片。

- 一位用户甚至称其为具有 Sonnet 级别代码创造力的重大更新,并可能成为 R2 的基础。

- Transformers 抛弃归一化:受 Transformers without Normalization 论文启发,一位成员用 tanh 替换了归一化(normalization)。

- 讨论随后集中在推理时移除 Expert 及其对较小权重的影响。

- MathFusion 增强 LLM 数学能力:MathFusion 通过跨问题指令合成(cross-problem instruction synthesis)提高了 LLM 的数学推理能力,增强了 DeepSeekMath-7B、Mistral-7B 和 Llama3-8B 等模型(更多关于 MathFusion 的信息)。

- 该方法创建了 MathFusionQA 数据集,用于微调模型并在极少额外数据的情况下提升 Benchmark 准确率度。

- Qwen3 将支持 CPU 推理:transformers 库 PR#36878 显示正在添加 Qwen3 支持,这意味着这些模型很快将得到 transformers 库的支持。

- 一位用户推测 Qwen3-15B-A2B 由于其尺寸,可能是 CPU 推理的理想候选者。

OpenAI Discord

- Sam Altman 预告 GPT-5 发布:尽管没有正式公告,Sam Altman 确认 GPT-5 将于今年推出,引发了它可能在上半年发布以与 R2 或 Llama-4 竞争的猜测。

- OpenAI Discord 服务器的成员暗示,一个未公布的 API 可能也即将推出。

- GPT-4o:让用户彻底倒戈的模型:一位用户发现 GPT-4o 作为一个强大的日常工具,以至于他们很少切换模型,只有在 4o 消息用完,或者处理重要及未解决的问题时,才会使用 4.5, o1, o3 等其他模型。

- 该用户还声称构建了一个“引擎”,可以恢复 400+ 轮对话,并在超过 500 轮后继续保持上下文,且没有偏移或幻觉,全部通过默认 prompt 实现。

- Many-Shot Prompting 增强多模态模型实力:一篇研究论文(MANY-SHOT IN-CONTEXT LEARNING IN MULTIMODAL FOUNDATION MODELS)指出,像 GPT-4o 和 Gemini 1.5 Pro 这样的闭源模型从高达约 2,000 个示例的 many-shot 演示中获益显著,而权重开放模型则没有表现出同样的收益。

- 论文指出,与 few-shot 示例相比,当提供 many-shot 演示时,像 GPT-4o 和 Gemini 1.5 Pro 这样的大型多模态基础模型表现出显著的性能提升。

- 运行由 GPT-4o 驱动的 F1 车队:开源项目 FormulaGPT(github repo)模拟了由 LLM 驱动的车队之间的正面交锋,这些车队通过持续的推理、策略制定和细致的决策进行上下文和自适应思考。

- 观众可以在玩家 vs AI 模式中挑战高级语言模型,或在 AI vs AI 模式中观看顶级 AI 模型对决,同时观察每个维修站停靠、换胎或超车动作背后的详细 AI 推理。

- 规避 Turnitin AI 检测器,如果你敢的话:一名成员寻求关于如何规避 Turnitin AI 相似度检测的建议,因为其报告重复使用了公司的商业模式,这违反了 Turnitin 的 ToS。

- 其他人认为这看起来像是为了作业作弊而进行的刷屏申诉,并建议使用 humanize AI 工具。

OpenRouter (Alex Atallah) Discord

- OpenAI 的 o1-pro:奢侈品级的定价?:用户对 OpenAI o1-pro API 的定价反应强烈,其价格为 $150/M input tokens 和 $600/M output tokens,由于成本极高,有人称其为 GucciAI。

- 另一位成员开玩笑说,考虑到算力限制,API 的缓慢可能是一个刻意设计的特性,以防止过度支出。

- OpenRouter 上的图像生成功能缺失:一位用户询问关于在 gemini-2.0-flash-exp 模型中使用 Gemini 图像生成的问题,但被告知 OpenRouter 尚不支持图像生成。

- 团队表示,虽然图像生成已列入路线图,但目前没有支持 Flux 等图像模型的短期计划。

- Lambda 端点饱受 404 错误困扰:多位用户报告在尝试使用 Lambda 模型时遇到 404 ‘no endpoint found’ 错误,尽管 Lambda 的状态页面显示运行完全正常。

-

社区提供了建议,一些用户确认 **Llama 3.3 70B Instruct Lambda** 模型对他们来说运行正常。

-

- DeepSeek R1 挑战 OpenAI o1:成员们注意到 DeepSeek R1 模型(一个 671B 参数模型,推理时 37B 激活)的性能与 OpenAI o1 相当,但它是开源的,并根据 MIT 许可证发布。

- 它在 MIT 许可证下的可用性允许商业用途。

- Claude 3.7 Sonnet 因过载错误而停滞:用户报告在使用 Claude 3.7 Sonnet 时频繁出现过载错误,导致响应中断并被收取 input tokens 费用。

- 一位用户建议采用重试策略或切换到 Gemini 2.0 Pro 作为替代方案,同时承认 Claude 在翻译方面的优势。

LM Studio Discord

- LM Studio 缺少 NPU 支持:用户报告 LM Studio 尚未支持 NPU,但 0.3.11 版本中已提供 Ryzen AI 支持。

- 对于 2GB VRAM 等资源有限的用户,建议考虑使用 Q6 或 Q8 量化 的 Gemma 3 1B 以及 CUDA 运行时以提升性能。

- KV Cache 量化大幅降低显存需求:用户建议在运行具有 30k token 等长上下文窗口的模型时,利用 KV cache 8-bit 量化 来减少内存占用。

- 请记住,12GB VRAM 对于 32B 模型 可能不足,建议将 Phi-4 或 Qwen2.5 14b 作为极具吸引力的替代方案。

- 多 GPU 获得应用内管理功能:爱好者们对 LM Studio 的控制功能赞不绝口,该功能允许用户选择加载模型的 GPU,已在最新的 beta 版本中提供。

- 多名用户确认,最新的 LM Studio beta 版本原生支持多 GPU。

- Google Coral TPU 在 AI 领域表现不佳:Google Coral 双 TPU 不适合 AI 使用,因为它没有用于存储数据的板载内存。

- 一位拥有 8060s 的用户还询问了 Framework Desktop 的散热和功率余量。

- 4060 Ti:廉价推理的黄金选择:配备 16GB VRAM 的 RTX 4060 Ti 是 AI 推理的预算友好型首选,价格约为 500 美元/欧元。

- 一位用户提到,需要注意的是 AMD 显卡 未针对游戏进行优化,而 Nvidia 的 5000 系列 可能会出现熔断问题。

Yannick Kilcher Discord

- VPN 代码劫持 OpenAI 网站?:用户报告在 OpenAI 网站上看到了

<veepn-guard-alert>和<veepn-lock-screen>标签,暗示存在 VPN 注入,但这很可能是由他们自己的 VPN 注入的代码 sm0kywu.github.io/Amodal3R。- 看起来该用户只是在使用 VPN。

- cuOpt 解决 NVIDIA 的线性规划问题:根据 docs.nvidia.com,NVIDIA® cuOpt™ 是一款 GPU 加速的优化 AI 微服务,在 混合整数线性规划 (MILP)、线性规划 (LP) 和 车辆路径问题 (VRP) 方面表现出色。

- 看来这款微服务在 NVIDIA 内部广受好评且性能强大。

- CUDA Python 是新潮流?:成员们讨论了这是否真的是 blelbach 在 X 上提到的“CUDA Python 之年”,一些人断言 Python 对于 GPU 编程已经足够了。

- 其他人则嘲讽了现代 Python 程序员,并分享了一个名为《现代 Python 程序员》的 YouTube 视频。

- MoE 训练趋于稳定?:一位用户声称 MoE 训练不稳定,但另一位用户反驳说它们“两年来一直很稳定”,现在“与稠密网络(dense networks)差不多”。

- 稳定性主要归功于更好的算子(kernels)和无丢弃的 token 路由(dropless token routing),解决了数值不稳定和专家坍缩(expert collapse)等问题。

- DeepSeek-V3 悄然发布:成员们注意到 DeepSeek 发布了其 DeepSeek-V3-0324 模型,并且一篇博客文章重复使用了他们的图表。

- 该模型拥有 685B 参数,并提供 BF16、F8_E4M3 和 F32 等多种张量类型,并附带了微调和量化版本的链接。

GPU MODE Discord

- Flash Attention FA 调试:在关于理解 Flash Attention (FA) 的讨论中,一名成员建议通过编码和性能分析/调试来学习,并指出动手实现有助于理解普通 Attention,同样也适用于 Flash Attention。

- 一名成员在 Triton 中实现 Flash Attention 1 时遇到了问题:在 TRITON_INTERPRET=1 模式下可以运行,但在 CUDA 上有几个元素不匹配。在增加 rtol & atol 后,测试通过了。

- RTX 5080 获得 CUDA 12.8 支持:一名开发者发布了一个补丁,使 RTX 5080 能够完全兼容 CUDA 12.8 + PyTorch 2.5.0 以及 Blackwell / sm_120 架构,并提供了一个包含脚本、diff 文件和说明的 GitHub 仓库。

- 同时也确认了 WMMA 指令是“包装器”,在 SASS 中直接编译为 HMMA/IMMA/QMMA 指令,类似于 MMA 指令的运作方式,正如 CUDA Godbolt 上所示。

- 解读 Hopper 的 Swizzle:文档中对 Hopper 架构 中 64B swizzle 的描述让许多人感到困惑,但现在已澄清它是 64B (字节) 的 swizzle,其中每个方块是 128b (位),这对应于 8-bit 数据类型的 8x64 tile 和 16-bit 类型的 8x32 tile。

- 一名成员正在寻找 ROCm 专家,以帮助为 tilelang HIP 后端 实现无行间 bank 冲突的 swizzle。

- 牛津大学设立 AI 研究员职位:牛津大学现有一个研究员空缺(博士后级别或同等经验),与 Rui Ponte Costa 合作研究 游戏和神经影像中的 AI / RL,年薪 10 万英镑以上。

- 这项工作涉及开发一种 AI 驱动的技术,通过分析游戏数据来推断特定大脑区域对行为的贡献,从而实现 神经系统疾病的非侵入性诊断和治疗。

- Flash Attention 的连续内存:在 Flash Attention 中,张量以 (batch_size, N, num_heads, d) 格式存储,在 d 维度上是连续的(通常 > 64),这实现了高效的全局内存合并 (Global Memory Coalescing),每个线程可以加载 16B 的数据。

- 这也使得理解运行过程变得更加容易,因此可以使用 LLM 来辅助理解 kernel 代码,解释张量中特定位置的简单概念和变量状态。

Interconnects (Nathan Lambert) Discord

- Nvidia 工程师开发 Mamba-Transformer 混合模型:根据 Nvidia 的研究,他们推出了 Nemotron-H 模型系列,包括一系列 8B 和 47-56B 的模型,这些模型是 Mamba-Transformer 混合模型,提供了更快的推理速度。

- 该模型因其与其他模型相比在速度上的提升而受到关注。

- Mistral 24B 重新受到青睐:Mistral 24B 的发布被视为一个重大亮点,因为它实力强劲且提供了可获取的基座模型,此外还有在 Apache 2.0 许可下发布的新开源版本。

- 一名成员表示:“Mistral 24B 可能是过去几个月里最伟大的发布之一,模型非常强大,而且你还可以访问基座模型。”

- R1-Zero 训练的长度偏差被揭示:一项分析显示,在 类 R1-Zero 训练 中使用行均值 (row mean) 会引入偏差,倾向于更短的正确回答和更长的错误回答,详见 论文 及配套 代码。

- 切换到全局均值 (all mean) 可以在不增加长度的情况下获得相当的性能,这引发了对“推理长度增加与能力提升相关”的图表的质疑。

- 中国计划发起开源 AI 攻势:据 这条推文 称,中国计划向市场投放大量开源 AI 模型,以使 AI 软件商品化 并促进其硬件销售,这可能会动摇美国的科技主导地位。

- DeepSeek 模型的发布曾导致美国科技股总市值缩水约 1 万亿美元,突显了中国 AI 的潜在影响。

- 浏览器自动化通过 Infinibranch 实现规模化:Morph Cloud 的 Infinibranch 浏览器 被提议作为扩展浏览器使用 Agent 的可能解决方案,在为书籍列表查找亚马逊链接等任务上,将成功率提高到了约 80%。

- 由于重度使用 JavaScript 的单页应用、CAPTCHA 和复杂的机器人检测,传统的网页抓取方法已经过时。

Latent Space Discord

- Gemini 更新深度解析:Gemini 的 Dave Citron 加入了 @OfficialLoganK 的 Release Notes 播客,讨论了最近的更新,包括 personalization、Canvas、Audio Overviews 和 Deep Research,正如 Google Gemini App 所报道的。

- 讨论涵盖了从最近的应用发布到 Gemini app 中个性化的未来等话题,包括对用户数据和隐私考量的见解。

- Claude Code 获得八项新功能:Anthropic 为 Claude Code 推出了 八项 新功能,旨在帮助开发者更快速、更智能地构建,详情记录在他们的 工程博客 中。

- 功能包括一个新的 think 工具,引发了关于其实现和价值的讨论,一些人将其比作 Chain of Thought 提示。

-

A16Z 探讨 Model Context Protocol (MCP):A16Z 发布了对 Model Context Protocol (MCP) 的深度解析,探讨了其作为 AI 模型执行、数据获取和工具调用的标准接口的潜力,正如 API 是互联网的第一个伟大统一者一样 [A Deep Dive Into MCP and the Future of AI Tooling Andreessen Horowitz](https://a16z.com/a-deep-dive-into-mcp-and-the-future-of-ai-tooling/)。 - 该文章研究了 MCP 的用例、挑战以及它如何改变 AI 与工具交互的方式,并指出 API 曾是互联网的第一个伟大统一者,但 AI 模型目前还缺乏类似的对等物。

- Roboflow 发布用于实时目标检测的 RF-DETR:Roboflow 宣布了 RF-DETR,这是一个完全开源的实时目标检测模型,采用 Apache 2.0 许可证,可在 GitHub 上获取。

- RF-DETR 在 COCO 上实现了超过 60 mAP 的 SOTA 性能,其基础模型和大型模型的参数量分别为 29M 和 128M。

- Swyx 构建 Agent 的未来:Swyx 发布了关于 Agent Engineering 的 新演讲和文章,强调了在 @aiDotEngineer 全力投入 Agents 的原因。

- 讨论定义了 Agents(感谢 @simonw),并详细阐述了 Agent Engineering 的六个要素,探讨了 Agents 如何成为 ChatGPT 达到 10 亿月活跃用户 (MAU) 的路径。

Notebook LM Discord

- 征集移动端研究参与者:团队正在为一项关于移动端用例的研究征集参与者,鼓励个人分享见解,以增强对如何在移动设备上使用该工具的理解。

- 团队还宣布了即将到来的 AI 模型更新,更多细节将很快分享。

- NotebookLM 中逐渐出现思维导图:一位用户注意到他们的 NotebookLM 中缺少 mindmaps,而另一位用户确认在免费版本中已有该功能,这表明该功能正在逐步推出。

- mind map 功能评价褒贬不一,需要不断重新生成才能更新,且除了主题之外缺乏细节。

- NotebookLM 助力深度研究报告:一位用户使用 NotebookLM 进行研究,撰写详细报告以帮助人们了解情况,重点关注本地和区域新闻。

- 该用户还分享了一个播客节目的链接,讨论了 911 恶作剧电话的法律后果 911 Prank Call: The Felony Consequences。

- NotebookLM 作为 HR 政策中心:一位用户探索了将 NotebookLM 作为 HR 政策、员工手册和新员工入职的中心枢纽。

- 尽管这个概念很有前景,但用户注意到答案并不总是准确,并对有效的信息组织策略感到好奇。

- 通过缩放解决思维导图像素化问题:一位成员建议在下载 Mind Map 之前先放大标签页,以提高输出质量并解决像素化问题。

- 该成员称赞了其极大的上下文窗口和低幻觉率,甚至取消了对 ChatGPT 和 Claude 的订阅。

Eleuther Discord

- 虚拟测试器预测模型性能:一名成员提议建立一个虚拟测试环境,在训练前预测 AI 模型的可行性,从而可能节省资源并加速创新;该模拟器旨在确定模型是否有实际成功的机会,还是注定会早期失败。

- 虽然其他人指出,小规模测试新架构已经相对便宜,在 3090 上训练一天 L6D512 模型的成本约为 $5。

- EleutherAI 评估评估方法:一名成员在新的博客中详细介绍了 EleutherAI 的评估方法,并建立了一个 MkDocs 站点 以方便导航;他们还在等待 此 PR 的评审。

- 该贡献者被警告不要使用 AI 生成 PR 内容,强调需要审查贡献以避免增加垃圾内容。

- VectorAdam 声称具有旋转等变性:VectorAdam 将二阶矩更新修改为每个梯度向量的向量范数平方,解决了 Adam 中的坐标系偏差,可能提高旋转等变性。

- 有人指出 VectorAdam 与 Adafactor 不同,而更像是一个 block size = hidden dim 的分块近似。

- MechInterp 因处于学术界之外而面临抵制:成员们讨论了“mechinterp”品牌似乎受到了学术界的“抵制”,因为其中很大一部分内容处于传统学术渠道之外,且他们对这种范式持有抵触情绪。

- 一名成员发现触发激活的第一个 token 是 holocaust,但它不是激活最强的 token,并想知道神经元激活是否具有上下文特定性。

- 递归设计优于 GANs、CNNs 和 RL:一名成员介绍了一种使用递归设计的新颖图表,将其与传统的 GANs 区分开来;该实现强调结构组织而非顺序处理,利用 CNNs 进行过滤,并利用 RL 来优化响应。

- 另一名成员正在起草一个 PR,将评估逻辑更新到最新版本

lm_eval==0.4.8,参考了 Evals PR。

- 另一名成员正在起草一个 PR,将评估逻辑更新到最新版本

HuggingFace Discord

- HF Agents 课程拥抱新框架:Hugging Face Agents Course 现在集成了 LlamaIndex、LangChain 和 smolagents,为学习者提供多样的 Agent 框架方法,如这条推文所述。

- 使用 Agents 课程的成员指出 LangGraph 比较死板,这有助于在构建 smolagents 时指导他们的流程。

- pdf2notes 轻松转换 PDF 笔记:Pdf2Notes 使用 LlamaParse 和 Llama-3.3-70B 将 PDF 转换为有条理的笔记,还利用 DeepMind 的 Gemini 2 Flash 进行多模态解析,并封装在 Gradio 和 FastAPI 框架中。

- 一名成员询问 pdf2notes 是否可以 100% 本地运行而无需外部 API,对需要 Gemini 和 Groq 订阅表示担忧。

- SpatialLM 处理 3D 数据:SpatialLM 是一种旨在处理 3D 点云数据的 3D 大语言模型,已在 Hugging Face 上发布,地址为 manycore-research/SpatialLM-Llama-1B。

- InferenceClient API 抛出身份验证错误:一位用户报告在尝试使用

InferenceClientAPI 列出已部署模型时出现 403 Forbidden 错误,即使配置了允许调用 Inference Providers 的只读 Token。- 该错误表示调用 Inference Providers 的权限不足,一位用户发布了一个具有相同错误的 链接。

MCP (Glama) Discord

- MCP Prompt 测试需要 K8s:测试 MCP prompts 需要 Kubernetes 设置,例如在 此文件 和 此测试 中找到的那些。

- 此处 提供了另一个带有 prompts 的实现,用于管理 电动汽车充电站。

- Microsoft 发布官方 MCP C# SDK:Microsoft 发布了新的官方 C# SDK,用于 Model Context Protocol servers and clients,可在 此处 获取。

- 根据 Vercel AI SDK 4.2,该 SDK 为开发者提供了使用 JavaScript 和 TypeScript 构建 AI applications 的工具,并可集成到 Next.js 和 Svelte 等 Web 框架中。

- Zapier 集成 MCP:Zapier 发布了一个 MCP server,为 AI assistants 提供了超过 8,000 个集成接口,使其能与各种应用交互。

- 这种集成使 AI 能够执行现实世界的任务,如发送消息、管理数据、安排事件和更新记录,将其能力扩展到文本生成之外。

- MCPwizard 简化 Server 创建:一位成员介绍了 mcpwizard,这是一个 CLI tool,旨在简化 MCP servers 的创建和部署,重点介绍了初始化项目和向 Claude assistants 添加自定义工具等功能。

- 该工具的 GitHub repo 也已共享,供社区反馈和贡献。

- Google Sheets MCP Server 实现直接编辑:一位成员构建了一个 Google Sheet MCP server,允许 Claude 直接编辑电子表格,简化了数据处理和公式调整,如 此推文 中所述。

- 代码可以在 此处 找到。

Nomic.ai (GPT4All) Discord

- 使用特定语言对语言模型进行 Prompt 引导:成员们讨论了为了让语言模型以特定语言(如德语)回答,最好用该语言编写 system message,以避免触发 “Im Kontext Lernen”(语境学习)。

- 进一步建议 避免使用否定句 可以改善结果,并建议重新组织指令以使用主动动词。

- Mistral 模型版本说明:有提到 Mistral Nemo 是一个 12b 模型,而 Mistral 24b 是 Mistral 3 或 Mistral 3.1,并围绕项目的具体模型细节进行了讨论。

- 在识别确切模型时出现了困惑,一位成员强调需要精确的模型信息以避免问题。

- GPT4All 的 LocalDocs 神秘消失:一位用户报告称其整个 local docs 目录无故消失,引发了对潜在原因的讨论,如 安装文件夹的更改 或 缺乏管理员权限。

- 成员们建议备份 localdocs.db 文件和原始文档以防止数据丢失,并指出 Windows 11 更新可能会因为干扰驱动器盘符而导致此问题。

- LLM 考虑应用于医疗办公自动化:成员们讨论了在医疗办公环境中使用本地 LLM 帮助医生创建报告并辅助治疗的潜力,重点是让系统从过去的口述笔记中学习。

- 然而,有人提醒说,由于存在幻觉风险且需要精确信息,LLM 可能不适合处理财务或医疗数据。

- GPT4All 仍不支持视觉功能:一位成员询问 GPT4All 能运行的模型中是否有具备视觉能力的,确认结果是 GPT4All 不支持视觉功能。

- 建议使用 LM-Studio 等替代工具来处理视觉相关任务。

Modular (Mojo 🔥) Discord

- Open APIs 为可移植性铺平道路:在探索高性能软件解决方案时,使用诸如 OpenCL、OpenMP、OpenACC、Vulkan’s Compute API 和 SYCL 等开放且可移植的 API 是一个很好的起点。

- POCL 被指出是一个带有相关论文的学术项目。

- 民主化 AI 计算降低 GPU 成本:Chris Lattner 的系列文章《Democratizing AI Compute》强调了提高硬件利用率以减少对昂贵 GPU 需求的重要性。

- 该系列包括关于 CUDA、OpenCL 和 AI compilers (TVM and XLA) 的文章。

- MAX Platform 咨询:一位新用户询问了关于修改 max/pipeline 目录以及通过 pixi.toml 文件在 MAX Platform 内测试更改的问题。

- 具体来说,他们对在不将其作为依赖项下载的情况下更改 max-pipeline 感兴趣。

- Mojo 的格式化工具媲美 Black 和 fmt:Mojo 包含一个内置的格式化工具

mojo format,类似于 Python 中的Black或 Rust 中的fmt,用于代码格式化。- 同时,由于 Windows 编译器工具链处理起来非常麻烦,Windows 的 GPU 支持目前较为困难。

LlamaIndex Discord

- AGNCY 倡议寻求 Agent 标准:Luke 正在领导 AGNCY,这是一项致力于制定 Agent 交互开放标准的倡议。

- 该项目旨在为开发更有效且具有互操作性的 AI Agent 提供一个强大的框架。

- Deepseek 和 LlamaIndex 构建更智能的 RAG:Akshay Pachaar 详细介绍了一个新项目,该项目集成 Deepseek AI,使用 LlamaIndex 进行编排,Deepseek AI R1 进行推理,Ollama 在本地提供 R1 服务,并使用 Streamlit 作为 UI 来创建 RAG app;更多详情请见此处。

- 这旨在展示结合不同工具构建复杂应用程序的能力。

- 超时导致 Agent 工作流中断:一位成员报告称,由于 OpenAI endpoint 未处理的超时错误,他们的 Agent 工作流发生了崩溃。

- 建议捕获

WorkflowRuntimeException或Exception而不是WorkflowTimeoutError来解决此问题。

- 建议捕获

- 成员们思考多 Agent 系统中的 Function Calling:成员们正在思考通过 function calling 触发单个 Agent 是否可以取代多 Agent 系统中的程序范围回退机制。

- 核心问题是这两种设置是否可以在某些场景下实现相同的功能,从而可能简化系统架构。

- 打造面试刷题模式:一位成员正在使用 Llama 3.2、Sonnet 3.7 和 Dolphin 构建本地 AI,并将其混合成一个带有 RAG 和自定义 fine-tuning 的 16B 模型。

- 他正试图让他的 AI 去申请 AI/技术公司并通过面试,他在 face tracking、blender、unity、powershell 和 TTS 方面拥有经验。

Cohere Discord

- Command-R-Plus 驱动分子 AI 助手:一个由 Cohere 的 command-r-plus 驱动的 AI 助手正被用于构建结构生物学工具,并配备了 MolStar 分子查看器 (https://ai.doi.bio)。

- 该网站支持 “load” 命令,例如通过输入 “Show me 7zzz” 将 PDB entries 加载到查看器中。

- Cohere 澄清 Chat 安全政策:一名成员询问了 Cohere chat 功能的数据保留和安全政策,询问数据是否会被用于模型训练。

- Cohere 团队成员提供了 privacy policy(隐私政策)、data usage policy(数据使用政策)和 security policy(安全政策)的链接,并指出用户可以在其 dashboard 中控制数据设置。

- API 滥用被怀疑是 SSL 错误的原因:一名成员报告在向 API 快速发送请求时遇到 SSL errors,暗示尽管正确安装了 py.ssl 模块,但这可能是由于请求过于频繁导致的。

- 另一名成员认为问题可能源于不受信任的服务器证书,其他成员则指出 API rate limits 通常返回 429 error code 而非 SSL error。

- vnc-lm 发布支持 RAG 的 Discord 机器人:一名成员发布了其 Discord 机器人 vnc-lm 的新版本,其特点是拥有 RAG pipeline,能够利用来自 Wikipedia 和 DuckDuckGo 的数据增强 Prompt。

- 该机器人为每个 Prompt 增加约 500 tokens,附加五个来源信息分块以改进模型的上下文,代码已在 GitHub 上开源。

- vnc-lm 现在通过 Docker 支持所有 LLM:更新后的 Discord 机器人现在支持所有主流的本地和托管大语言模型 API(包括 Cohere),并支持 Docker 部署。

- 随着新版本的发布,用户可以轻松地在 Discord 内编辑消息并获取新的回复。

Torchtune Discord

- DeepSeek-V3 发布但缺少 README:DeepSeek 发布了 DeepSeek-V3,但在 Hugging Face 上缺少正式的 Readme,引发了社区的幽默调侃。

- 尽管缺乏文档,但目前已提供 Playground,允许用户实验该模型。

- 数据质量仍在折磨 AI 工程师:尽管经过多年的研究,即使在 fineweb 和 lima 等数据集得到认可后,定义和获取“优质数据”对于 AI 实验室来说仍然是一个挑战。

- 一名成员对持续缺乏有效的 PDF extraction 工具表示沮丧。

- LlamaExtract 工具实现文档结构化:LlamaIndex 推出了 LlamaExtract,这是一款使用 genAI-native agents 来结构化复杂文档的工具。

- 根据 Jerry Liu 的推文,它能适配最新的模型,从而准确地结构化财务报告和简历等文档。

- GRPO LoRA 分数出人意料地高:如此 Pull Request 所示,GRPO LoRA 3B single device 在 GMS8K 上达到了 54% 的准确率。

- 尽管在计算中出现了多加一个 +2 的错误,但它在处理新问题上的表现超出了预期。

- CUDA Graphs 压缩 GPU 操作:成员们讨论了 CUDA graphs,它将一堆 GPU 操作捕获为一个图,并将其作为单个操作启动。

- 这减少了从 CPU 启动 CUDA 操作的开销,从而减少了 GPU idle time(空闲时间)。

DSPy Discord

- DLCoT Optimizer 削减 Token: 新的 DLCoT (Deconstructing Long Chain-of-Thought) Optimizer 在保持或提高各项基准测试准确率的同时,将 Token 使用量削减了 70-90%,详见 pull request #8000。

- 它通过分割 CoT 内容、移除冗余路径、过滤错误链并重构连贯输出来增强思维链推理,同时可与 BootstrapFewShot 等现有 DSPy 优化器协同工作。

- DSPy 激发创意优化: 成员们讨论了如何通过优化 Prompt 和使用 good judge 将 DSPy 用于创意内容生成,并参考了 PAPILLON 和 Agentic Reward Modeling 等资源。

- 讨论强调了对示例 inputs 的需求,但如果评判器/指标可以在没有参考的情况下评估摘要,则不一定需要摘要(标签)。

- 通过 Prediction 实现细粒度反馈: 通过 Refine 实现细粒度反馈即将推出,届时可以对输出进行特定检查并提供针对性反馈。

- 版本 2.6.15 将支持返回

dspy.Prediction(score=...., feedback=....),从而为模块提供细粒度的反馈。

- 版本 2.6.15 将支持返回

- 多智能体协议标准探索检索: 成员们探索将多智能体协议标准 (MCP) 扩展到检索器/检索增强生成(RAG)。

- 他们正在讨论检索结果的共享 Schema,以及交换文档和 Embedding 的方法,以简化数据驱动的工作流,并降低组合多个模型和数据源的难度。

tinygrad (George Hotz) Discord

- 发现数据集来源: 一名成员在 仓库的 extra 目录 中找到了

datasets/sops.gz数据集,该数据集用于speed_compare_cuda_ptx。- 该数据集是通过同目录下的 generate_dataset.sh 脚本 生成的。

- 澄清 CUDA 移植配置: 当被问及将 Tinygrad 移植到 CUDA GPU 时,一名成员提供了 README.md 文件的链接,展示了项目支持的后端。

- 这表明 CUDA 支持信息可以在项目的文档中找到。

- 会议 #63 议程提醒: 第 63 次会议的议程包括 公司更新、量化 DSP、BERT、scheduler、driver、tensor cores、WebGPU、ONNX、RetinaNet 以及 Torch frontend 的讨论。

- 此外还计划讨论围绕 AMD LLVM backend 的悬赏任务,以及 test_ops、多 GPU 训练 和 torch compile 等话题。

- AMD LLVM Backend 进展: AMD LLVM backend 的进展涉及多个已合并的 Pull Request,并已在 Llama3 和 Flux 示例中进行了测试。

- 目前有一个 Pull Request 正在评审中,标志着该领域的持续开发。

- ONNX 前端出现: 宣布创建

tinygrad.frontend.onnx,标志着本周的工作重点将放在 ONNX 准备上。- 工作内容包括验证前 30 个 Hugging Face ONNX 仓库。

LLM Agents (Berkeley MOOC) Discord

- 测验标题拼写错误引发困惑:一名成员报告了 Quiz 7 标题中的拼写错误,导致在核对 Quiz 6 答案时产生困惑。

- 另一名成员确认了这一发现并向报告者表示感谢。

- AgentX Research Track 申请开放:入选学生将获得来自 Berkeley 博士后/导师 的指导,参与 AgentX Research Track 项目,截止日期为 PDT 时间 3 月 26 日晚上 11:59。

- 加入或在 AgentX 中取得成功并不强制要求导师指导,实验(labs)和证书声明表(Certificate Declaration form)将于 4 月发布,详见附图。

- Research Track 采用远程模式且无偿:一名成员确认 AgentX Research Track 指导 将以远程方式进行。

- 另一名成员澄清说,指导是无偿的,导师仅提供研究项目的指导。

MLOps @Chipro Discord 没有新消息。如果该社区长期沉寂,请告知我们,我们将将其移除。

Codeium (Windsurf) Discord 没有新消息。如果该社区长期沉寂,请告知我们,我们将将其移除。

Gorilla LLM (Berkeley Function Calling) Discord 没有新消息。如果该社区长期沉寂,请告知我们,我们将将其移除。

AI21 Labs (Jamba) Discord 没有新消息。如果该社区长期沉寂,请告知我们,我们将将其移除。

第二部分:分频道详细摘要与链接

完整的各频道详细分析已针对邮件进行缩减。

如果您喜欢 AInews,请分享给朋友!预谢!