ainews-not-much-happened-today-3156

今天没发生什么事。

OpenAI 发布了全新的 GPT-4o 模型,该模型具有增强的指令遵循、复杂问题解决以及原生图像生成能力。该模型在数学、编程和创意领域表现出更强的性能,并支持透明背景图像生成等功能。关于图像生成的内容过滤和政策讨论强调了在创作自由与防止危害之间取得平衡。DeepSeek V3-0324 API 已在 Hugging Face 上线,由 SambaNovaAI 提供支持,其表现优于基准测试以及 Gemini 2.0 Pro 和 Claude 3.7 Sonnet 等模型。Gemini 2.5 Pro 被推荐用于编程,而 Gemini 3 可以通过全新的 Model Garden SDK 轻松部署在 Google Cloud Vertex AI 上。Gemma 3 技术报告已在 arXiv 上发布。

平静的一天。

2025年3月26日至3月27日的 AI 新闻。我们为您检查了 7 个 subreddits、433 个 Twitter 账号 和 30 个 Discord 服务器(230 个频道和 7972 条消息)。为您节省了预计阅读时间(以 200wpm 计算):757 分钟。您现在可以标记 @smol_ai 进行 AINews 讨论!

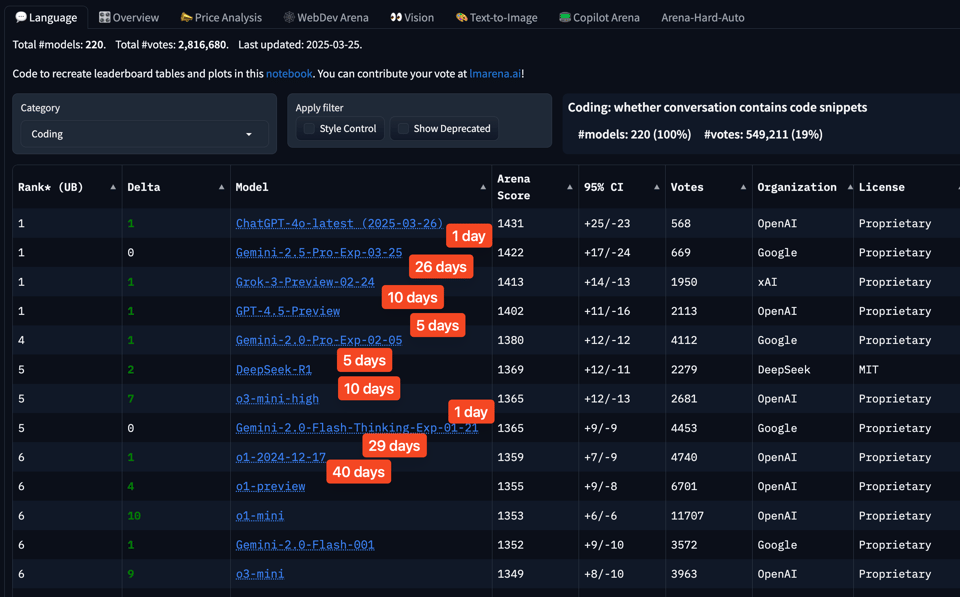

ChatGPT 中推出了 新的 4o 模型,但目前还没有博客文章,除了发布推文外细节不多,因此没有太多可报道的内容。然而,你可以看到最近 SOTA 模型之间的间隔时间正在缩短。

AI Twitter 综述

GPT-4o 与多模态模型

- OpenAI 的 GPT-4o 迎来了重大更新,根据 @OpenAI 的说法,它增强了遵循 详细指令 的能力,能够处理 复杂的计算和编程问题,并提升了 直觉和创造力,同时减少了 emoji 的使用 🙃。此外,更新后的

chatgpt-4o-latest现已在 API 中可用,计划在未来几周内将这些改进引入 API 中的日期版本模型,正如 @OpenAIDevs 所宣布的那样。 - GPT-4o 的原生图像生成 在指令遵循能力方面脱颖而出,@abacaj 指出目前没有任何产品能与之媲美。@iScienceLuvr 强调了 GPT-4o 生成的图表在构图、文本生成和整体流程方面令人印象深刻,并特别指出这些元素是在无需明确定义的情况下生成的。

- 关于图像生成内容过滤器的担忧 也被提及,@nrehiew_ 指出 OpenAI 的过滤器允许通过了一张令人惊讶的图像。

- 初始示例至关重要:@sama 强调在介绍新技术时,对展示的初始示例进行了仔细考量。

- 创造性自由与潜在危害:OpenAI 模型行为负责人 @joannejang 分享了在制定 4o 图像生成 政策时的思考与细微差别。她讨论了 OpenAI 如何从敏感领域的全面拒绝转向更精确的方法,重点在于防止现实世界的伤害,旨在最大化创造性自由的同时防止真实伤害,并保持谦逊,承认有很多未知领域,并随时准备根据学习到的经验进行调整。

- 带有透明背景的图像生成 是 GPT-4o 的一个酷炫功能,据 @giffmana 称,这对于创建各种素材非常有用。

- GPT-4o 的性能提升 相较于之前的版本非常明显,根据 lmarena.ai 的数据,LMSYS Chatbot Arena 显示其在数学、困难提示词(Hard Prompts)和编程类别中均有提升。

- 模型质量感知:@abacaj 发现 Google 的模型似乎永远处于预览或实验模式,等它们完全可用时,另一个模型已经超越了它们。它们让你窥见可能性,然后由其他人真正实现它。

DeepSeek 与 Gemini

- DeepSeek V3-0324 APIs 正在被 @ArtificialAnlys 在 10 个 API 中进行追踪,包括 DeepSeek 的第一方 API 以及来自 Fireworks、DeepInfra、Hyperbolic、Nebius、CentML、Novita、Replicate 和 SambaNova 的产品。它现在也通过 @SambaNovaAI 在 Hugging Face 上可用,速度达到 250+ t/s —— 为全球最快。它横扫了 MMLU-Pro (81.2) 和 AIME (59.4) 等基准测试,表现超越了 Gemini 2.0 Pro 和 Claude 3.7 Sonnet。

- Gemini 2.5 Pro:根据 @_philschmid 的说法,如果你目前正在使用 Claude,推荐在编程(coding)时使用 Gemini 2.5 Pro。

- Gemini 3:根据 @_philschmid 的说法,得益于全新的 Model Garden SDK,只需 3 行代码即可将 Gemini 3 部署到 Google Cloud Vertex AI。

- Gemma 3 技术报告:根据 @_philschmid 的说法,该报告现已发布在 arXiv 上。它为 Gemma 系列轻量级开放模型引入了多模态(multimodal)成员,参数规模从 10 亿到 270 亿不等。该版本引入了视觉理解能力、更广泛的语言覆盖范围以及更长的上下文——至少支持 128K tokens。

- GoogleDeepMind Gemini 的新函数调用(function calling)指南已由 @_philschmid 发布,该指南使用了新的 uSDKs,并包含针对 Python、JavaScript 和 REST 的多个完整示例。

- TxGemma:基于 GoogleDeepMind Gemma 模型构建,能够理解并预测小分子、化学品、蛋白质等的特性。根据 @GoogleDeepMind 的说法,这可以帮助科学家更快地识别有前景的靶点,预测临床试验结果,并降低整体成本。

AI 安全与可解释性

- Anthropic 的可解释性研究:@iScienceLuvr 重点介绍了这一研究。根据 @AnthropicAI 的说法,新的可解释性方法允许他们追踪模型“思考”过程中的步骤。

- Anthropic 正在招聘研究人员,共同开展 AI 可解释性(interpretability)方面的工作,消息来自 @AnthropicAI。

- Anthropic 经济指数(Economic Index):根据 @AnthropicAI 的说法,该指数正在发布第二份研究报告,并分享了更多基于匿名化 Claude 使用数据的资料集。

- AI 安全狂热(AI Safety Fads):@DanHendrycks 指出,每隔一两年就会出现一个新的 LW/AF 狂热(如 inner optimizers, ELK, Redwood’s injury classifier, SAEs),由于 LW/AF 的封闭性和资金集中化,这些趋势往往比学术界更加剧烈。

AI 工具与框架

- LangChain:现在为使用 LangChain 或 LangGraph 构建的应用提供完整的端到端(E2E)OTel 支持,实现了统一的可观测性(observability)、分布式追踪,并能够将 trace 发送到其他可观测性工具,消息来自 @LangChainAI。

- LangGraph BigTool:LangChain 展示了其在配合本地模型(通过 @ollama)使用超过 50 个工具时的可靠性。

- LlamaCloud:可以用作 MCP 服务器,允许用户将最新的数据引入其工作流,作为任何 MCP 客户端使用的工具,正如 @llama_index 所演示的那样。

- Cohere 的 Command A:这是一款能力强大且高效的模型,仅需 2 个 GPU 即可运行。根据 @cohere 的说法,它针对现实世界的 Agentic(智能体)和多语言任务进行了优化。

- Keras:为了庆祝原始版本发布 10 周年,Keras 推出了全新的主页,消息来自 @fchollet。

趋势与观点

- 生成式 AI 与吉卜力工作室:继 GPT-4o 发布后,根据 @iScienceLuvr 和 @aidan_mclau 的说法,围绕使用 Studio Ghibli(吉卜力工作室)风格生成的讨论非常激烈。@nearcyan 讨论了未来几年即将推出的“后现实过滤阶段”,届时现实将变成人们想要的任何样子(吉卜力、宝可梦或指环王等),随着每个人找到自己真正渴望的东西,他们将被划分到由纯粹的美和艺术(对许多人来说是欲望)构成的、专为他们优化的私人花园中。

- 未来属于 ASI:@aidan_mclau 表示,他们无法想象构建人工超级智能(ASI)只是为了赚钱、阻碍政治对手或进行 EA(有效利他主义)计算的套利。

- 对模型依赖的担忧:@nptacek 开始思考这里是否存在“构建者”与“整理者”的分歧,一些人想要某种整洁、有序的信息空间,而另一些人则完全适应于挑战事物存在边界的极限。

- GPU 熔断:@sama 发推称他们的 GPU 正在熔断,因为人们太喜欢 ChatGPT 中的图像功能了。

幽默/梗图

- 热门作品的反面:@nearcyan 定义了 AI 图像生成中所谓“热门作品(banger)”的对立面。

- 玩偶版 Jensen:@iScienceLuvr 发布了来自玩偶版 Jensen 的友好提醒。

- AGI = All Ghibli Images?:@_akhaliq 戏称 AGI 的意思是“全是吉卜力图像(All Ghibli Images)?”

- Gary Marcus 的观点:@cloneofsimo 调侃了 Gary Marcus 为 ML 社区提供的世界闻名、发人深省且具有创新价值的观点。

- DeepMind AI 尝试打造热门作品:@sama 提到 CLAIDE 试图打造一个热门作品,但却说“一个人的垃圾是另一个人的垃圾”。

AI Reddit 摘要

/r/LocalLLaMA 摘要

主题 1:DeepSeek V3 0324 在 Livebench 上超越 Claude 3.7,但存在幻觉问题

- DeepSeek V3 0324 在 Livebench 上超越 Claude 3.7 (Score: 148, Comments: 14):DeepSeek V3 (0324) 在 LiveBench 上取得了显著成绩,总排名第 10,超越了 Claude 3.7 Sonnet(基础模型),成为仅次于 GPT-4.5 Preview 的排名第二的非思考模型。这一表现表明,即将推出的 R2 模型可能会成为 AI 领域的强力竞争者。

- DeepSeek V3 的性能与幻觉问题:用户报告称 DeepSeek V3 的幻觉率从 4% 增加到 8%,使其在某些任务中不够可靠。尽管它能根据幻觉提示给出正确答案,但用户感到惊讶,并建议在 0.3 的低温度(temperature)下运行以缓解此问题。

- 与其他模型的比较:Gemini Pro 2.5 在推理方面比前代有显著提升,引发了人们对 V3.1 到 R2 潜在增强的关注。Anthropic 和 OpenAI 面临高昂的 API 成本挑战,但 OpenAI 的多模态能力(尤其是图像生成)被视为一大优势。

- LiveBench 与模型更新:人们对 grok-3-beta 从 LiveBench 中移除感到好奇。快速 R1 提供商可能需要时间来采用 V3,用户希望在即将到来的更新中(可能在 6 月)看到改进。

主题 2:微软的 KBLaM:LLM 中的即插即用知识

- 微软开发了一种更高效的向 LLM 添加知识的方法 (Score: 426, Comments: 56): Microsoft 开发了 KBLaM,这是一种旨在高效地将知识集成到 Large Language Models (LLMs) 中的新方法。该方法旨在通过增强其知识库来提高 LLMs 的性能和准确性,且不会显著增加计算需求。

- KBLaM 的局限性:用户指出 KBLaM 是一个研究原型,尚未达到生产就绪(production-ready)状态,在与不熟悉的知识库一起使用时,提供准确答案的能力有限。这表明它目前并不优于已经投入生产的现有 RAG 系统。

- 技术见解与挑战:该实现需要大量资源,例如测试一个 8B model 需要 A100 80GB,这表明其计算需求很高。该方法涉及语言 token 注意到(attending to)知识 token,但反之则不然,这引发了关于潜在知识差距的问题,例如在没有实际应用知识的情况下理解概念。

- 潜在应用与研究方向:人们对从训练数据中提取事实知识是否能优化参数使用感兴趣,这可能使模型更智能或更高效。然而,共识是广泛的知识对于智能至关重要,需要更多研究来探索通用知识应用和专家级机器人。

主题 3. Qwen Chat 上的新 QVQ-Max 功能增强了用户体验

- Qwen Chat 上的新 QVQ-Max (Score: 115, Comments: 16): Qwen Chat 推出了强大的视觉推理模型 “QVQ-Max”,以及该系列中最强大的语言模型 “Qwen2.5-Max”。用户界面在一个深色、简洁的设计背景下突出了每个模型的能力,包括 “Qwen2.5-Plus”、“QwQ-32B” 和 “Qwen2.5-Turbo”。

- QVQ-Max 和 Qwen2.5-Max 等其他模型引起了用户的兴趣,一些人计划将它们纳入测试计划,特别是在 M3 Ultra 等先进硬件上。

- 一条评论指出该模型目前是封闭(closed)的,表明目前的访问权限有限或受限。

- 人们对进一步的发展或发布充满期待,一名员工在 Twitter 上暗示预计在周四会有潜在的更新或增强。

主题 4. 尽管拥有 ASIC 优势,Gemini 2.5 Pro 仍面临性能批评

- Gemini 2.5 Pro 表现不佳 (Score: 106, Comments: 17): 标题为 “Gemini 2.5 Pro Dropping Balls” 的帖子将 Gemini 2.5 Pro 与 LLaMA 4 进行了比较,但正文缺乏详细内容。标题暗示了 Gemini 2.5 Pro 潜在的问题或缺陷。

- Gemini 2.5 Pro vs LLaMA 4:对于 Gemini 2.5 Pro 是否优于 LLaMA 4 存在怀疑,一些用户认为 Grok 只有在使用 64 采样时才能接近。然而,其他人认为目前没有模型(包括 Claude)能超越 Gemini 2.5 Pro。

- 技术优势:Google 使用自研 ASICs 为其带来了显著优势,而 Meta 和 Amazon 正分别尝试使用 MTIA 和 Tranium 赶超。Google 被认为领先了六到七代,这使得竞争充满挑战。

其他 AI 版块回顾

/r/Singularity, /r/Oobabooga, /r/MachineLearning, /r/OpenAI, /r/ClaudeAI, /r/StableDiffusion, /r/ChatGPT, /r/ChatGPTCoding

正在调试我们的流水线问题,抱歉…

AI Discord 回顾

由 Gemini 2.0 Flash Thinking 生成的摘要之摘要的摘要

主题 1. Gemini 2.5 Pro:速率限制、定价和性能炒作

- Cursor 用户遭遇 Gemini 2.5 Pro 速率限制瓶颈:Cursor 用户正面临 Gemini 2.5 Pro 极低的速率限制,部分用户报告仅在 两次 API 请求 后就触发了限流。目前的解决方法包括使用 Open Router 和个人 AI Studio API keys,也有建议称 Google Workspace Business 账户可能会解锁更高的限制。

- Cursor 为 Gemini 2.5 Pro 定价辩护,回应免费 API 质疑:Cursor 因对 Gemini 2.5 Pro 收费而面临用户抵制,因为该模型被认为可以通过 Google AI Studio API 免费使用。一位 Cursor 代表澄清说,收费是为了覆盖大规模使用的容量成本,因为 Google 在其使用级别上并未提供真正的免费层级。

- Gemini 2.5 Pro 在用户偏好上超越 Claude 3.5 Sonnet:用户评估显示 Gemini 2.5 Pro 已超越 Claude 3.5 Sonnet,在故事生成类别的顶级排名中占据了 3%,而 Sonnet 则从 74% 骤降至 18%。用户称赞 Gemini 2.5 处理长上下文的能力非常出色,部分用户确认在 AI Studio 上拥有 15K token 的上下文窗口。

主题 2. OpenAI 的 GPT-4o:更新、图像生成与政策转变

- GPT-4o 再次更新,在 Arena 排行榜攀升:OpenAI 的 GPT-4o 获得了重大更新,目前在 Arena 排行榜上位列第 2,超越了 GPT-4.5,并在 Coding 和 Hard Prompts 类别中并列第 1。据报道,此次更新提升了指令遵循、问题解决、直觉和创造力。

- OpenAI 放宽图像生成政策,GPU 负载面临极限:OpenAI 正在放宽其图像生成政策,从一味拒绝转变为防止现实世界的伤害,旨在提供更大的创作自由。Sam Altman 戏称由于图像生成的普及,GPU 正在融化,导致了临时的速率限制。

- Midjourney CEO 吐槽 4o 图像生成是“又慢又差”的梗:Midjourney CEO 对 GPT-4o 的图像生成不屑一顾,称其又慢又差,认为这只是一种融资手段和噱头(meme),而非严肃的创作工具。这一批评正值有关模型命名规范以及白宫删除一条包含吉卜力风格图像推文的讨论之际。

主题 3. Model Context Protocol (MCP) 势头强劲但也面临挑战

- OpenAI 和 Cloudflare 拥抱 Model Context Protocol (MCP):OpenAI CEO Sam Altman 宣布 OpenAI 产品(如 Agents SDK 和 ChatGPT 桌面应用)将支持 MCP,这标志着 MCP 普及迈出了重要一步。Cloudflare 现在也支持构建和部署远程 MCP servers,降低了准入门槛。

- Claude Desktop 在处理 MCP 提示词和资源时遇到困难:用户报告称,当 MCP servers 包含资源或提示词时,Claude Desktop 会陷入无限循环。一种解决方法是移除相关功能以防止 Claude 搜索这些元素,目前已发布 修复程序。

- LlamaCloud 集成为 MCP 服务器以提供实时数据:LlamaCloud 可以作为 MCP server 运行,从而将实时数据集成到任何 MCP client(包括 Claude Desktop)的工作流中。这允许用户利用现有的 LlamaCloud indexes 作为 MCP 的动态数据源。

主题 4. 本地 LLM 和工具更新:Unsloth, LM Studio 和 Aider

- Unsloth 发布 Dynamic Quantization 和 Orpheus TTS Notebook:Unsloth AI 发布了 Dynamic Quants(动态量化),以提高本地 LLM 的准确性和效率,并发布了 DeepSeek-V3-0324 GGUFs。他们还推出了 Orpheus TTS notebook,用于具有情感暗示和语音定制功能的人机交互式语音合成,在用户测试中表现优于 OpenAI 的 TTS。

- LM Studio 0.3.14 添加多 GPU 控制和优化:LM Studio 0.3.14 引入了针对多 GPU 设置的细粒度控制,允许用户通过启用/禁用 GPU 和选择分配策略来优化性能。此次更新还包括“Limit Model Offload”模式,以提高稳定性和长上下文处理能力,并针对 AMD GPUs 进行了增强。

- Aider 的 /context 命令简化代码导航:Aider 引入了

/context命令,自动识别并添加给定请求的相关文件,提高了大型代码库中的工作流效率。然而,用户报告了通过 OpenAI API compatibility layer 使用 Gemini 时存在兼容性问题以及 CPU 使用率飙升的情况。

主题 5. 图灵研究院动荡与开源 RL 系统 DAPO

- 艾伦·图灵研究院尽管获得资助仍面临大规模裁员和项目削减:Alan Turing Institute (ATI) 尽管最近获得了 1 亿英镑 的资金注入,仍计划大规模裁员并削减约四分之一的研究项目,引发了员工的反抗。在来自更广泛 AI 领域的竞争中,该研究院面临着生存危机。

- 字节跳动开源 RL 系统 DAPO 低调现身:ByteDance 和 Tsinghua AIR 发布了 DAPO,这是一个开源的 Reinforcement Learning 系统,该系统似乎“悄无声息”地出现了。成员们分享了链接,强调了其在 RL 研究社区中的潜在重要性。

- 灾难性过度训练论文挑战 LLM 预训练范式:一篇新论文提出了“catastrophic overtraining”(灾难性过度训练)一词,认为延长的预训练可能会降低微调性能,并使模型更难适应下游任务。论文指出,经过指令微调的 OLMo-1B 在延长预训练后表现更差。

PART 1: Discord 高层级摘要

Cursor Community Discord

- Cursor 在 Gemini 2.5 Pro 的 API 限制下受阻:用户报告在 Cursor 中使用 Gemini 2.5 Pro 时遇到了非常小的速率限制,低至 两次 API 请求 就会被限制。

- 一些成员正在结合使用 Gemini API、Requesty 和 Open Router 来绕过这些限制,而其他人指出 Google Workspace Business 账户可能会解锁更高的限制。

- Windsurf 和 Cursor 再次交锋:Windsurf 和 Cursor 之间的争论仍在继续,Windsurf 因其在原型设计期间的“全上下文”而受到青睐,而 Cursor 则在修复 Bug 方面更受欢迎。

- 一位用户抱怨 Windsurf 的 UI 样式与 Cursor 在页面间的一致性相比有所不足,而另一位用户则要求雇佣“官方 shitsurf 托儿”。

- 上下文窗口受 Cursor 限制?:一位用户询问 Cursor 是否将 Gemini 2.5 Pro 的上下文窗口限制为 30K,尽管该模型宣传有 1M 的上下文限制。

- 其他人补充说,虽然 Agentic 模型有 60k 的上下文窗口,但 Claude 3.7 有 120k 的上下文窗口,如果启用最高设置甚至可以达到 200k(尽管没有足够的数据确认这是否是 Vertex)。

- Gemini 2.5 Pro 的定价困惑:用户质疑为什么 Cursor 对 Gemini 2.5 Pro 收费,而通过 Google 的 AI Studio API 它是免费的,导致了不诚实的指控。

- Cursor 代表澄清说,费用涵盖了处理该模型使用所需的容量,因为 Google 在 Cursor 的规模上不提供免费层级,并补充说价格与 Gemini 2.0 Pro 持平。

- Cline 接管编码工作流:一些用户计划放弃 Cursor,选择 VSCode 搭配 Cline(使用 Gemini)进行编码,并使用来自 Fireworks 的 DeepSeek v3 进行规划。

- 一位用户表达了对 Cursor Tab 功能的怀念,并指出虽然大多数模型都在退步,但仍认可模型的实用性,但结论是“在 RTX 4090 级别上,本地模型都很糟糕”。

Perplexity AI Discord

- Perplexity Bot 加入 Discord:Perplexity 推出了 Perplexity Discord Bot 进行测试,直接在 Discord 频道内提供快速回答和事实核查,可通过艾特 <@&1354609473917816895> 或使用 /askperplexity 命令访问。

- 测试者可以探索 /askperplexity、使用 ❓ 表情符号对评论进行事实核查,以及通过 /meme 创建梗图,反馈可发送至 <#1354612654836154399> 频道以进行改进。

- GPT-4.5 从 Perplexity 悄然下架:成员们注意到 GPT-4.5 从 Perplexity.com 的模型选择中消失了,可能是出于成本考虑。

- Perplexity AI bot 澄清说,GPT-4.5 在科学推理、数学和编程方面通常优于 GPT-4o,而 GPT-4o 在通用和多模态使用方面表现出色。

- Complexity 扩展增强 Perplexity:用户讨论了 “Complexity” 扩展,这是一个旨在增强 Perplexity 功能的第三方插件。

- Perplexity AI bot 指出,虽然该扩展的功能作为原生选项可能很有益,但集成决策取决于用户需求、技术可行性和产品路线图(product roadmap)的一致性。

- MCP 服务器控制 Perplexity:用户探索了利用 Model Context Protocol (MCP) 服务器(如 Playwright),允许 Perplexity 通过可用的 MCP 服务器控制浏览器或其他应用程序。

- Perplexity AI bot 解释说,配置服务器与 Perplexity 的 API 配合使用可以实现自动化的浏览器操作和网页交互。

- 用户遇到 API 参数错误:一位用户遇到了与

response_format参数相关的错误,尽管账户内有额度,但这干扰了其应用功能并导致销售损失。- API 团队针对

search_domain_filter、related_questions、images和structured_outputs等参数实施了错误处理,并澄清这些参数从未对非 Tier 3 用户开放;详见 usage tiers。

- API 团队针对

Manus.im Discord Discord

- Gemini 2.5 Pro 初露锋芒:成员们初步称赞 Gemini 2.5 Pro 目前的编程表现相当不错,且远好于去年使用的任何 Gemini 模型。

- 一位用户提到,它将两个独立的动画组件合并为一个,实现了无缝的加载过渡。

- Manus 邀请码面临延迟:用户对 Manus 邀请码的等待时间 表示沮丧,有些人已经等待了一周多。

- 一位成员建议在注册和接收嵌入代码时使用无痕模式或不同的浏览器。

- Discord UI 侧边栏神秘消失:有用户报告其 Discord 侧边栏(特别是在 platform.openai.com 上)缺少图标、线程和消息。

- 一位成员建议将外观设置更改为紧凑视图,或检查 PC 显示设置以解决尺寸问题。

- WordPress 预发布站点在 Manus 中失败:一位成员报告称,自上次维护以来,他们在 Manus 中的 WordPress 预发布站点(staging site) 反复出现故障。

- 未找到解决方案。

- Manus 与 N8N 协作良好:成员们讨论了将 Manus 与 N8N 或 Make.com 结合使用,以实现流程自动化和工作流自动化。

- 一位成员正在构建他们的第一个 N8N 和 Manus 工作流,以连接全球的创意人士。

LMArena Discord

- Livebench 主要测试死记硬背的任务:成员们辩论了 Livebench 的优劣,一些人认为它主要测试 死记硬背的任务(rote tasks),并奖励 闪电式思考(flash thinking) 而非更深层次的推理。

- 这种对死记硬背任务的关注可能会扭曲结果并降低基准测试的可靠性。

- Gemini 2.5 Pro 提高了限制并引发关注:讨论了 Gemini 2.5 Pro 的能力,从 擅长数学 到表现出指令遵循问题,Logan Kilpatrick 在 X 上宣布提高了速率限制。

- 针对模型的一致性和稳定性,人们的担忧日益增加,特别是免费的 AI Studio 版本与付费的 Gemini Advanced 版本之间的差异。

- AI 审查制度辩论升温:讨论转向 AI 模型中的审查制度,人们担心西方模型过于 觉醒(woke),而中国模型则是 宣传复读机(propaganda parrots)。

- 成员们争论政府审查是否与安全护栏和法律合规有所区别。

- Qwen 3 发布在即:人们对即将发布的 Qwen 3 充满热情,并对其架构和性能进行了推测。

- 一些人期待一个具有令人印象深刻性能的 MoE 模型,而另一些人则对其与 Qwen 2.5 Max 相比的实际能力保持谨慎。

- DeepSeek V3 0324 分数惊人:DeepSeek V3 0324 在 SWE-bench 上令人印象深刻的分数受到关注,引发了对其相对于 GPT-4o 等其他模型编程能力的讨论。

- 有人认为这些编程能力的提升可能是 氛围编程(vibe coding) 或 基准测试微调(benchmark tuning) 的结果,而非模型架构的真正进步。

Unsloth AI (Daniel Han) Discord

- 选择性量化改进了 Unsloth 的 Dynamic Quants:Unsloth 的 Dynamic Quants 经过选择性量化,他们发布了 DeepSeek-V3-0324 GGUFs,包括 1-4-bit Dynamic 版本。

- 这允许在 llama.cpp、LMStudio 和 Open WebUI 中运行该模型,并提供了详细的说明指南。

- Unsloth 的 Orpheus TTS Notebook 表现出色:Unsloth 发布了 Orpheus TTS notebook,它能提供带有情感线索的类人语音,并允许用户以更少的 VRAM 更快地自定义声音和对话,详见这条推文。

- 它支持 single stage models,其中一名成员表示 Kokoro 将完全无法进行微调。

- YouTube 算法屈服于伽罗瓦理论:在 YouTube 上搜索了一次 Galois theory 后,一位成员开玩笑说他们的信息流现在充斥着关于 五次方程(quintics) 的视频。

- 他们调侃说这些算法在 8k ctx 之后就像“从行走退化到爬行”。

- Instruct 模型不进行预训练更好?:一位用户被建议 不要对 instruct 模型进行持续预训练,因为这会降低性能,且通常旨在添加新的领域知识,参考了 Unsloth 文档。

- 相反,鼓励该成员探索监督微调(SFT)来处理问答任务。

- 字节跳动的 DAPO 系统开启大门:成员们分享了 字节跳动开源 RL 系统 DAPO 的链接,指出它“似乎有点被忽视了”。

- 该系统来自 ByteDance Seed 和清华 AIR。

aider (Paul Gauthier) Discord

- Google Gemini 2.5 Pro 需求激增:据 @OfficialLoganK 的推文称,由于需求旺盛,Google 正在优先提高 Gemini 2.5 Pro 的速率限制(rate limits)。

- 为了绕过速率限制,OpenRouter 建议添加 AI Studio API key 并设置 OpenRouter。

- GPT-4o 在近期更新后获得关注:根据 OpenAI 的推文,GPT-4o 在 ChatGPT 中获得了更新,提升了指令遵循、技术问题解决、直觉和创造力。

- 它目前在 Arena Leaderboard 上排名第 2,超越了 GPT-4.5,并在 Coding 和 Hard Prompts 类别中并列第 1。

- Aider 新命令简化编码流程:Aider 新的

/context命令可自动识别并添加给定请求的相关文件,从而简化编码流程,尽管该功能仍处于测试阶段。- 这有助于处理大型代码库并节省时间,对于确定需要修改的内容非常有用,并且可以与 reasoning model 配合使用来头脑风暴 bug。

- Gemini 的 OpenAI API 面临兼容性问题:有用户报告 Gemini 无法与 OpenAI 兼容层(compatibility layer)配合使用,怀疑原因是 Litellm,尽管其他模型运行正常。

- 该用户通过反向代理访问所有 AI 服务,因此需要 OpenAI API 兼容性。

- 用户报告 Aider CPU 使用率飙升:一名用户报告 Aider 的 CPU 使用率突然飙升至 100%,导致 LLM 挂起或响应缓慢,尽管处理的是小型仓库。

- 用户正在寻求调试技巧,不确定从何处开始排查该问题。

OpenAI Discord

- 破折号爱好者的键盘转换:一名用户将键盘重新映射以偏好破折号(dash),引发了关于标点符号偏好和替代方案(如分号)的讨论,有人开玩笑说使用

^符号。- 这突显了个人在写作和交流风格中做出的细微且个性化的选择。

- Sora 的挑战:植物提示词与存疑的兔子:一名用户寻求帮助编写 Sora 提示词,以实现植物背景平滑变化的相机旋转效果,并分享了示例图片:criptomeria-na_kmienku-globosa-cr-300x300.webp。

- 与此同时,有人担心 Sora 在提示“兔子角色(bunny characters)”时会生成暗示性内容,引发了对内容审核的质疑。

- 图像生成:恶习还是愿景?:一名用户批评 AI 图像生成是一种贬低数字艺术价值的“恶习”,并分享了一张用它创建的图片:Screenshot_20250327_162135_Discord.jpg。

- 随后的分歧导致该用户被拉黑,凸显了对 AI 在艺术领域角色的不同看法。

- Arxiv 崛起:STEM 的快速舞台:Arxiv 作为 STEM 领域预出版平台的地位日益提升,引发了关于未经评审工作价值、利用“关键多数关注点”推动进步的潜力以及即将到来的 AI 同行评审(peer review)时代的辩论。

- 对传统同行评审过程的批评包括科学家付费参与评审并失去所有权,这激发了对 AI 创建更高效、更易访问系统的热情。

- 批量文件上传:一次性全部上传:成员们确认,为了确保模型在单个上下文中考虑所有文档,在使用 ChatGPT 等工具时,最好同时上传所有文件。

- 这种方法能确保模型整合来自所有文档的信息,前提是这些文件格式正确。

OpenRouter (Alex Atallah) Discord

- Gemini 2.5 容量紧缺:用户在运行 Gemini 2.5 时遇到

RESOURCE_EXHAUSTED错误,建议在 OpenRouter settings 中绑定 AI Studio key 以提升容量。- 强调了 Google 允许用户通过 AI Studio 付费以获取更高容量。

- Deepseek R1 响应为空导致停滞:有用户报告在使用 Deepseek R1 (Free) 时,即使使用新 Key,从 Chutes provider 获取的 API 响应也为空。

- 将 max_tokens 设置为 0 被认为是可能的诱因,但即使调整后问题依然存在。

- OpenRouter 提供商路由现状:一位用户在使用 AI SDK 跨 Google/Bedrock/Anthropic 路由 Gemini/Anthropic 时,发现并调试了一个路由 Bug。

- 即使

allow_fallbacks设置为 false,请求也未遵循定义的顺序,导致所有请求最终都指向了 Anthropic;官方人员确认了该路由 Bug。

- 即使

- OpenRouter 兼容性追求:一位用户发现,与通过 Spring AI 使用

openai/gpt-4o-mini相比,使用google/gemini-2.5-pro-exp-03-25:free时 OpenRouter 与 OpenAI SDK 的兼容性不足。- 一名成员坚持认为 OpenRouter 理应 100% 兼容,用户可能遇到了速率限制(rate limits),并建议使用 Mistral Small 3.1 和 Phi 3 模型进行测试。

- 免费使用 Gemini 2.5 Pro 的可能性:成员们分享了如何利用 OpenRouter 在 @cursor_ai 中免费运行 Gemini 2.5 Pro,并参考了一份 Cursor 教程。

- 该成员报告称,在经过简短的排障后,此方案解决了所遇到的问题。

LM Studio Discord

- LM Studio 引入多 GPU 支持:LM Studio 0.3.14 引入了多 GPU 设置控制,允许用户启用/禁用特定 GPU 并选择分配策略,以优化多 GPU 系统的性能。

- 该版本包含“限制模型卸载至专用 GPU 显存”(Limit Model Offload to Dedicated GPU memory)模式,提升了稳定性并优化了长上下文处理,同时针对 AMD GPUs 进行了增强。

- 视觉模型插件探索未果:成员们在寻找适用于 Hugging Face 模型的 vision model plugins,并指出 Mistral Small 仅支持文本且为 LM Studio 的 GGUF 格式。

- 虽然有人建议在 LM Studio 中使用 Mistral Small,但似乎没有人成功运行视觉模型(Vision Model)。

- Threadripper CPU 定位争论:成员们争论 AMD Threadripper CPU 是否属于“消费级”,尽管其市场定位为 HEDT(高端桌面)处理器,并引用了一篇 Gamers Nexus 文章。

- 一名成员认为,虽然面向家庭用户销售,但 Threadripper 实际上是专业工作站级别。

- Gemma 3 性能大幅提升:一位用户在刚购入的 9070XT 上使用 Gemma3 - 12b Q4_K_M 达到了 54 t/s(Vulkan,未开启 flash attention),而其 7800XT 在 Vulkan 下仅为 35 t/s,在 ROCm 下为 39 t/s。

- 成员们讨论了 Gemma3 模型即使在完全卸载(full offload)的情况下也会溢出到共享内存的问题,并指出上下文可能会填满 32 GB 的共享内存,同时有人询问如何加载超过 48GB 的大型模型。

- P100 已过时:一位成员询问花费 400 加元/200 美元 购买 P100 16GB 作为兴趣投资是否划算,但被强烈建议不要购买,称其为“电子垃圾”。

- 成员们指出其 Tesla 架构、不支持的 CUDA 版本,以及与 6750XT 等现代显卡相比低下的性能。

Eleuther Discord

- Deepseek V3 在 Mac 上可与云端抗衡:成员们将 Mac Studios 上运行 Deepseek V3 的速度(20toks/second)与云端实例进行了对比,并引用了这篇文章中报道的 AMD EPYC Rome 系统较慢的性能(4 tokens/sec)。

- 这种差异可能是由于 Mac 拥有更快的统一内存(unified RAM)。

- EleutherAI 考虑举办 ICLR 2025 聚会:EleutherAI 正在考虑举办一次 ICLR 2025 线下聚会,预计接待约 30 名参与者。

- 如果参与意向较高,可能会探索赞助机会。

- Qwen 32B 在 LLM harness 上停滞:一名成员在评估 Qwen 32B 模型时遇到了 LLM harness 问题,尽管使用了最新版本的 Transformers。

- 根本原因可能是由于分片模型拥有超过 10 个分片,且与 tied embeddings 相关,这可能是由 transformers 库本身触发的。

- Transformers 库触发错误报错:一名成员将一个误导性错误追溯到 transformers

4.50.2,并分享了一个运行4.50.0版本的 Colab notebook,该版本不存在此问题。- 问题源于存储空间不足,尽管错误消息提示是

AutoModel加载函数的问题;修复方案将以 PR 的形式提交给 lm-eval,以增加更好的错误处理。

- 问题源于存储空间不足,尽管错误消息提示是

- OLMo-1B 遭遇过度训练崩溃:根据这篇论文,在 3T tokens 上预训练的指令微调版 OLMo-1B 模型在标准 LLM 基准测试中的表现比其 2.3T token 的对应版本差 2% 以上。

- Gemma Team 也发表了一篇新论文,作者包括 Aishwarya Kamath、Johan Ferret 和 Shreya Pathak。

Interconnects (Nathan Lambert) Discord

- Gemini 2.5 Pro 夺走 Claude 3.5 Sonnet 宝座:根据评估,Gemini 2.5 Pro 在用户偏好中险胜 Claude 3.5 Sonnet,在故事元素组合的顶级排名中占据了 3%,而 Claude 3.5 Sonnet 从 74% 下降到 18%。

- 尽管发生了这种转变,用户仍称赞 Gemini 2.5 在处理长上下文时的无缝表现,一名用户在 AI Studio 上观察到了 15K token 的上下文窗口。

- OpenAI 营收飙升,AGI 梦想若隐若现:据 Bloomberg 报道详述,在 GPT-4o 的进步和专注于防止现实世界危害的修订版图像生成政策的推动下,OpenAI 预计今年营收将翻三倍达到 127 亿美元,并预计到 2029 年达到 1250 亿美元。

- 尽管由于 GPT-4o 图像生成的普及导致 GPU 资源受限,OpenAI 正在暂时实施速率限制,Sam Altman 指出:“看到人们喜欢 ChatGPT 中的图像非常有趣,但我们的 GPU 快要熔化了”。

- Midjourney CEO 抨击 4o 图像生成:据 X 上的报道,Midjourney CEO 批评 4o 的图像生成“又慢又差”,认为这只是一种融资手段和梗(meme),而不是创意工具。

- 这一批评出现在关于模型命名规范的讨论中,同时白宫删除了一条包含 Ghibli 风格图像的推文,该图像最初被描述为“阴暗”。

- 图灵研究院陷入深度动荡:尽管在 2024 年最近注入了 1 亿英镑,但据 researchprofessionalnews.com 报道,阿兰·图灵研究所 (ATI) 正面临大规模裁员,并计划削减约四分之一的研究项目,引发了员工动荡。

- 鉴于来自更广泛领域的竞争挑战,该研究所正面临生存威胁。

Modular (Mojo 🔥) Discord

- Mojo 在单位加法上遇到困难:

mojo频道的讨论强调了在处理不同单位(如千米/秒和米/分)加法时的挑战,涉及返回类型以及如何正确缩放数值的问题。- 一位成员指出,在这种情况下,scale 必须返回正确的结果,且目前无法在函数的返回类型中使用

-> A if cond else B这种逻辑。

- 一位成员指出,在这种情况下,scale 必须返回正确的结果,且目前无法在函数的返回类型中使用

- C Unions 在 Mojo 中引发辩论:一位成员询问

union如何进行底层转换(lowers into),另一位建议使用 C union。- 第二位成员指出,据我所知,CUDA 在某些 API 部分使用了 union。

- Traits 讨论揭示细微差别:关于扩展方法和 Traits 的讨论明确了扩展允许向 library types 添加方法,而由于孤儿规则(orphan rules),这一特性在 Rust 的

impl中无法直接实现。- 另一位成员纠正说,Rust 的

impl是可以实现库类型的。

- 另一位成员纠正说,Rust 的

- 隐式 Trait 实现引起关注:关于隐式 Trait 实现引发了辩论,一位成员希望这只是暂时的,并表示这 使得 marker traits 变得危险。

- 讨论了传播 Trait 实现的其他方法,包括命名的扩展以及评估健全性(soundness)的权衡。

- 元组可变性令人惊讶:一位成员指出,可以对元组内部的索引进行赋值,这展示了意想不到的可变性。

- 另一位成员澄清说,这是

__getitem__返回可变引用的副作用,并指出不应该是这种情况,这在 测试套件 中有所体现。

- 另一位成员澄清说,这是

HuggingFace Discord

- 字节跳动的 InfiniteYou 合并至 ComfyUI:字节跳动的 InfiniteYou 模型旨在灵活重塑照片并保持个人身份特征,已通过 此 GitHub 仓库 集成到 ComfyUI 中。

- 其目标是提供一种 平滑 的方式来生成不同的高质量图像,将 Claude 连接到 Vite。

- HF 推理 API 对免费用户设限:根据 HuggingFace 的 API 定价文档,免费用户在用完所有 monthly credits 后将无法再查询推理 API。

- 相比之下,PRO 或 Enterprise Hub 用户在请求超过订阅限制时将产生费用。

- Sieves 简化了零样本 NLP 流水线:介绍了 Sieves,这是一个无需训练、仅使用零样本生成模型构建 NLP 流水线的 工具。

- 它利用 Outlines、DSPy 和 LangChain 等库的结构化输出,确保生成模型的输出准确。

- Qwen 2.5 VL 在 Kaggle 上遇到内存错误:一位成员在 Kaggle 上运行 Qwen 2.5 VL 3b 描述一段 10 秒视频 时遇到了内存错误,此前他刚调试完最新 transformers 库 (4.50.0.dev0) 的导入问题。

- 建议包括使用更高规格的硬件、更小的模型或使用 Flash Attention 2 进行 GPU 卸载。

MCP (Glama) Discord

- Sama 信号支持:OpenAI 拥抱 MCP!:OpenAI 首席执行官 Sam Altman 宣布 MCP 支持 即将引入 OpenAI 产品,如 Agents SDK、ChatGPT 桌面应用和 Responses API。

- 这一举措被视为将 MCP 确立为处理业务相关任务的 Agent 骨干架构的关键一步,类似于 HTTP 对互联网的影响。

- Cloudflare 增强上下文:MCP 获得远程服务器工具支持:Cloudflare 现在支持使用 workers-oauth-provider 和 McpAgent 等工具构建和部署远程 MCP 服务器。

- 这一支持是一项重大进展,为开发者提供了更高效构建 MCP 服务器的资源。

- 规范问题浮现:Claude 在处理 MCP Prompt 时遇到困难:当 MCP 服务器包含资源或 Prompt 时,用户在 Claude Desktop 中遇到了导致无限查询的问题,但包含修复程序的 GitHub 新版本 已经发布。

- 一种解决方法是移除相关能力(capabilities),以防止 Claude 搜索缺失的资源和 Prompt。

- Canvas MCP 连接大学课程:一位成员为大学课程构建了一个 Canvas MCP,实现了资源和作业的自动化查询。

- 响应用户请求,作者添加了一个 Gradescope 集成 Agent,实现了对 Gradescope 的自主爬取。

- 全能 Docker Compose 预备 MCP 服务器:一个 全能 docker-compose 项目已创建,使用户能够通过 Portainer 轻松自托管 17 个 MCP 服务器。

- 该 compose 从公共 GitHub 项目中获取 Dockerfiles,确保更新能够自动应用。

Notebook LM Discord

- 思维导图功能公开上线:Notebook LM 的思维导图(Mind Map)功能现已向所有用户开放,团队对用户的耐心和反馈表示感谢,并附上了感谢图片。

- 一位成员指出,虽然思维导图结构整齐,但由于缺乏描述而浪费时间,而且用户无法控制思维导图的结构或描述的详细程度。

- 西班牙语播客生成停止:一位用户报告称,在“自定义(customize)”设置中生成西班牙语播客的功能已失效。

- 一位成员建议通过 NotebookLM API 加入播客创建功能,并指出利用该功能可以做出非常酷的东西。

- 笔记本共享令人沮丧:一位 Pro 用户 报告称无法通过链接共享 Notebook,即使内容是公开的 YouTube 视频。

- 提到的潜在解决方案包括确保接收者拥有活跃的 NLM 账户,以及手动通过电子邮件发送链接。

- Gemini 接受“火鸡测试”:一位成员对 Gemini 2.5 Pro 进行了“火鸡测试(Turkey Test)”,挑战其创作关于鸟的形而上学诗歌,并在此处分享了带有 NotebookLM 评论的视频。

- 用户通过交互模式(Interactive Mode)引导评论,从而过渡到一个令人满意的结局,偶然发现了 NBLM 的新用途。

- 高级研究功能有限制:一位成员询问了 Gemini Advanced 的深度研究限制,另一位成员回答说是每天 20 份研究报告。

- 第一位成员认为这与 ChatGPT 相比相当不错。

Yannick Kilcher Discord

- 提议 Sketch-to-Model 流水线:一名成员介绍了一种 “Sketch-to-Model” 流程(Sketch –> 2D/2.5D Concept/Image –> 3D Model –> Simulation),并探索了 Kernel Attention (KA) 的替代方案。

- 该成员提到 ChatGPT 暗示了一个类似于 KAN 的概念,并将其归于 Google DeepMind,而 Grok 3 则指出 xAI 团队正在积极研究 KAN。

- AI 解谜能力引发辩论:成员们思考 AI 是否能破解谜题书《Maze: Solve the World’s Most Challenging Puzzle》(Wikipedia)。

- 建议包括在 ARG 和旧的谜题游戏上训练 LLM,尽管大家承认某些谜题刻意设计的难度可能会难倒目前的推理模型。

- GPT-4o 确认采用自回归图像生成:根据 OpenAI’s Native Image Generation System Card 的说明,GPT-4o 已被确认为自回归图像生成模型。

- 推测认为 GPT-4o 可能正在重用图像输入 token 进行图像输出,通过 semantic encoder/decoder(语义编码器/解码器)输出与输入格式相同的图像 token。

- 图灵研究所削减研究项目:尽管获得了 1 亿英镑的资助,Alan Turing Institute (ATI) 仍计划进行大规模裁员,并削减四分之一的研究项目。

- 报告指出,由于这些削减,员工中出现了“公开反抗”的情绪。

- 《Tracing Thoughts in Language Model》研究受到剖析:成员们正在分析 Tracing Thoughts in a Language Model 及其相关的 YouTube 视频。

- 由于现有资料非常详尽,预计对话将跨越多个阶段。

GPU MODE Discord

- DP 和 TP Rank 之间的数据分布差异:据一名成员介绍,在分布式处理(DP)中,每个 rank 接收不同的数据,而在张量并行(TP)中,所有 rank 接收相同的数据。

- 他们建议 TRL (Transformer Reinforcement Learning) 应该已经自动管理这种分布,以确保高效的训练和资源利用。

- Triton Autotune 缺少 Pre/Post Hooks:

triton.Autotune或triton.Config不支持 pre_hook 和 post_hook,因为它们需要在运行时执行 Python 代码,而 Inductor 在 AOTI 中无法支持这一点。- 一名成员推测实现这种支持应该不难,并表示愿意提供帮助。

- Hopper 的 num_ctas 设置困扰 Triton 用户:用户在 Triton 中为 Hopper 使用大于 1 的

num_ctas值时,会遇到崩溃或RuntimeError: PassManager::run failed异常,根本原因尚不明确。- 这实际上限制了在使用 Triton 时针对 Hopper 架构的性能调优选项。

- CUDA 内存层级解析:一位用户解释了 CUDA 内存层级,并澄清了 DRAM 和 SRAM 之间的数据传输才是缓慢的根源。

- 这就是为什么内存合并(memory coalescing)以及最大化全局内存与共享内存之间的数据传输效率至关重要的原因。

- Red Hat 招聘 GPU Kernel 工程师:Red Hat 正在招聘不同级别的全职软件工程师,要求具备 C++, GPU kernels, CUDA, Triton, CUTLASS, PyTorch, 和 vLLM 方面的经验。

- 有意向的候选人请将简历和相关经验总结发送至 terrytangyuan@gmail.com,并在邮件主题中注明 “GPU Mode”。

LlamaIndex Discord

- LlamaCloud 兼作 MCP Server:LlamaCloud 可作为 MCP server 使用,为任何 MCP 客户端的工作流实现实时数据集成,如此视频演示所示。

- 此设置允许现有的 LlamaCloud index 作为 Claude Desktop 所使用的 MCP server 的数据源。

- Claude 利用来自 LlamaCloud 的数据:Claude Desktop 可以将现有的 LlamaCloud index 作为 MCP server 的数据源,将秒级更新的数据集成到 Claude 工作流中,详见此视频。

- 该功能增强了 Claude 在其工作流中访问和利用实时信息的能力。

- LlamaExtract 放弃 Schema 推断:去年宣布的 LlamaExtract 中的 Schema 推断功能已被降低优先级,因为大多数用户已经拥有所需的 Schema,详见 LlamaExtract 公告。

- 该功能未来可能会回归,但目前正在优先处理其他方面。

- LLM 用于为 PDF 和扫描图像生成描述:成员们讨论了将 LlamaParse 作为解析 PDF 的最佳解析工具;另一位成员建议使用 LLM 来读取并为图像生成描述(用于 RAG 应用),以回答来自上传 PDF 的问题。

- 另一位成员询问了针对手写数学作业等扫描文档的 Hybrid Chunking 和 OCR。

- 聊天机器人在 SQL 查询生成方面遇到困难:一位正在构建根据用户消息生成 SQL 查询的聊天机器人的用户报告称,即使在 SQL 文件中包含列注释,机器人也无法选择合适的列。

- 未提供具体解决方案,但鼓励该用户向团队提交 Bug 报告。

Latent Space Discord

- Nvidia 收购 Lepton AI:据 The Information 报道,Nvidia 已斥资数亿美元收购了推理服务提供商 Lepton AI,以增强其提高 GPU 利用率的软件产品。

- 此次收购旨在简化 GPU 利用率并加强其软件产品线。

- OpenAI 的 Agent 拥抱 MCP:Model Context Protocol (MCP) 现在已与 OpenAI Agents SDK 集成,支持使用各种 MCP server 为 Agent 提供工具,详见 Model Context Protocol 介绍。

- MCP 被设想为 AI 应用程序的 USB-C 接口,使向 LLM 提供上下文的过程标准化。

- Replit Agent v2 获得更强的自主性:Replit Agent v2 目前正与 Anthropic 的 Claude 3.7 Sonnet 一起进行早期访问,它拥有更强的自主性,在进行修改前会制定假设并搜索文件,详见 Replit 博客。

- 此次升级确保了它更加自主,且不太可能卡在同一个 Bug 上。

- GPT-4o 在排行榜上跃升:根据 Arena 排行榜,最新的 ChatGPT-4o 更新(2025-03-26)已飙升至 Arena 第 2 名,超越了 GPT-4.5,并有显著增强,在编程(Coding)和硬核提示词(Hard Prompts)方面并列第 1。

- 据报道,此次更新更擅长遵循详细指令,特别是包含多个请求的指令,并具有更好的直觉和创造力。

- OpenAI 放宽图像生成政策:OpenAI 正在将其图像生成政策从一味拒绝调整为防止现实世界的伤害,旨在最大限度地提高创作自由,同时避免实际伤害,正如 Joanne Jang 在她的博客文章中所述。

- 这一政策转变寻求在创意表达与伤害预防之间取得平衡。

Torchtune Discord

- FP8 QAT 运行被发现:一位成员正在探索 FP8 QAT,并在尝试对冷训练模型进行纯 QAT 运行时遇到了 此问题。

- 他们澄清说,虽然 FP8 QAT 是一个目标,但目前的资源有限。

- 优化器状态保持不变:一位成员确认激活 fake quant 不会改变优化器状态。

- 这一确认解决了关于量化实验中意外副作用的担忧。

- GRPO PR 寻求快速处理:一位成员强调了合并两个 GRPO PR(#2422 和 #2425)的紧迫性,指出 #2425 是一个关键的 bug 修复。

- 一位团队成员迅速回应并承诺处理这些 PR。

- 据称 Anthropic 转向 TensorFlow:有人指出 Anthropic 据称正在围绕 TensorFlow 进行标准化。

- 这引发了关于 PyTorch 在 Anthropic 内部未来的猜测。

- JoeI SORA 接管:一位成员分享了 JoeI SORA 在特定背景下的截图,回应了关于模型直觉的查询。

- 该成员调侃道,没有直觉,只有 JoeI。

Cohere Discord

- Cohere 探索向量数据库集成:成员们讨论了 向量数据库 的选择,一位成员分享了 Cohere 集成页面的链接,展示了 Elasticsearch、MongoDB、Redis、Haystack、Open Search、Vespa、Chroma、Qdrant、Weaviate、Pinecone 和 Milvus 等选项。

- 另一位成员询问关于在线托管向量数据库的问题,回复暗示 Cohere 会处理托管相关事宜。

- 创始人思考 AI Agent 定价:一位成员发起了一场关于创始人如何对 AI Agent 进行定价和变现的讨论,寻求与其他人的交流并验证见解。

- 另一位成员鼓励分享更多关于 AI Agent 定价策略的细节。

- Cohere 可能会参加 QCon London:一位成员询问 Cohere 今年是否会参加 QCon London,表示有兴趣与 Cohere 代表讨论 North 的访问权限。

- 他们去年参加了。

- 难民组织倡导生计:肯尼亚的一位难民介绍了 Pro-Right for Refugees,这是一个专注于促进难民获得 生计机会 并增强 Kakuma 难民营和 Kalobeyei 定居点和平生活的社区组织 (CBO)。

- 该 CBO 专注于和平建设、提高意识和生计倡议,邀请志愿者并为难民提供支持。

tinygrad (George Hotz) Discord

- 廉价组装预算级 AI 装备:一位成员探索使用从淘宝购买的旧 X99 组件、Xeons 和 32GB ECC DDR4 RAM 组装一套 7000-8000 元 的预算级 AI 装备。

- 另一位成员在快速调查后确认了该方案的可行性。

- AX650N 规格亮点:通过 产品页面链接 重点介绍了 AX650N 的规格,揭示了其具有 72Tops@int4, 18.0Tops@int8 NPU,并原生支持 Transformer 智能处理平台。

- 此外,AX650N 包含一个 八核 A55 CPU,支持 8K 视频编解码,并具有 双 HDMI 2.0 输出。

- AX650N 被逆向工程:一篇 博客文章 详细介绍了 AX650N 的逆向工程,报告其达到了 72.0 TOPS@INT4 和 18.0 TOPS@INT8。

- 文章还提到了移植较小 Transformer 模型的努力,并指向了一个相关的 GitHub repo。

- Tinygrad 的 PR 专注于 CPU 功能:分享了两个 Tinygrad 的 pull requests:PR #9546 和 PR #9554。

- 第一个 PR 解决了 test_failure_53 中递归错误 的潜在修复,而第二个 PR 旨在 继续将函数从 torch backend 的 CPU 中移出。

- TinyGrad 的代码生成揭秘:一位用户询问了 TinyGrad 的代码生成过程,引用了关于

CStyleCodegen和CUDACodegen类的过时信息,寻求理解从优化计划到低级代码的转换。- 鉴于用户对当前实现的困惑,讨论旨在澄清 TinyGrad 如何将优化计划转换为适用于各种设备(CPU/GPU)的可执行代码。

LLM Agents (Berkeley MOOC) Discord

- 允许分享课程录像:一位成员询问是否可以分享 LLM Agents Berkeley MOOC 的课程录像,管理员确认这是允许的,并鼓励新参与者注册。

- 这是新 MOOC 参与者入职流程的一部分。

- 正在考虑延长导师计划申请截止日期:一位成员请求延长导师计划(mentorship)的申请截止日期;管理员指出表单不会立即关闭。

- 然而,由于关注度很高且项目需要尽快启动,截止日期后的申请不保证会被考虑。

- 创业赛道(Entre Track)缺少导师计划:一位成员询问关于 Entre track 的导师计划,管理员澄清 Berkeley 并不提供该项服务。

- 4月/5月将会有赞助商的答疑时间(office hours)。

DSPy Discord

- AOT 分解推理过程:Atom of Thoughts (AOT) 将问题分解为结构化为有向无环图 (DAG) 的原子级子问题,这与维持整个树历史的 Tree of Thoughts (ToT) 形成对比。

- 发布者强调了 AOT 的无记忆推理步骤,以及针对原子子问题的显式“分解-收缩”阶段。

- 理想的评估数据集:AOT 的理想评估数据集应包括 GSM8K 和 MATH(带有逐步解题过程的数据集)、HotpotQA 和 2WikiMultihopQA(带有标注推理路径的数据集),以及显式详细说明中间推理步骤的数据集。

- 提供的示例包括用于测试和验证的

mock_llm_client.generate.side_effect = ["0.9", "42"]。

- 提供的示例包括用于测试和验证的

- LLMDecomposer 策略具有灵活性:AOT 利用了

LLMDecomposer提供的灵活分解功能,其 Prompt 会根据问题类型(MATH, MULTI_HOP)进行调整,支持自定义分解器,并启用动态 Prompt 选择。- 分解策略通过收缩验证阶段确保原子性,例如 Prompt:

QuestionType.MATH: Break down this mathematical question into smaller, logically connected subquestions: Question: {question}。

- 分解策略通过收缩验证阶段确保原子性,例如 Prompt:

- MiproV2 遇到 ValueError:一位用户在使用 MiproV2 时遇到了 ValueError,这与

signature.output_fields中不匹配的键有关,预期键为dict_keys(['proposed_instruction']),但实际收到的键为dict_keys([])。- 据报道,在 GitHub 上使用 Copro 时也遇到了类似问题,可能与

max_tokens设置有关。

- 据报道,在 GitHub 上使用 Copro 时也遇到了类似问题,可能与

Codeium (Windsurf) Discord

- Windsurf 现已支持 Gemini 2.5 Pro!:Gemini 2.5 Pro 现在可以在 Windsurf 中使用,每条消息为用户提供 1.0 用户 Prompt 额度,每次工具调用提供 1.0 Flow Action 额度。

- 该发布已在 X 上宣布。

- Gemini 2.5 Pro 导致 Windsurf 负载过重:由于负载巨大,Windsurf 在使用 Gemini 2.5 时遇到了速率限制(rate limiting)问题。

- 团队正在积极努力增加配额,并对带来的不便表示歉意。

Nomic.ai (GPT4All) Discord

- GPT4All 用户抱怨模型导入问题:用户报告在向 GPT4All 导入模型时遇到困难,系统似乎没有反应,此外还存在无法搜索模型列表的问题。

- 其他投诉包括选择模型时缺少模型大小信息、缺乏 LaTeX 支持以及模型列表排序不符合用户习惯。

- GPT4All 用户体验引发不满:用户对 GPT4All 的用户体验表示失望,提到了缺少 Embedder 选择选项等问题。

- 一位用户表示:你们正在流失用户……因为其他工具更加用户友好且更愿意保持开放。

MLOps @Chipro Discord 没有新消息。如果该社区长时间保持沉默,请告知我们,我们将将其移除。

Gorilla LLM (Berkeley Function Calling) Discord 没有新消息。如果该社区长时间保持沉默,请告知我们,我们将将其移除。

AI21 Labs (Jamba) Discord 没有新消息。如果该社区长时间保持沉默,请告知我们,我们将将其移除。

第 2 部分:详细的频道摘要和链接

完整的频道细分内容已在邮件中截断。

如果你喜欢 AInews,请分享给朋友!提前感谢!