AI News

英伟达(NVIDIA)将向 OpenAI 投资 1000 亿美元,用于部署 10GW 的 Vera Rubin 架构。

英伟达(NVIDIA)与 OpenAI 宣布达成一项具有里程碑意义的战略合作伙伴关系,计划利用英伟达的系统部署至少 10 吉瓦(GW) 的 AI 数据中心。随着每吉瓦容量的部署,英伟达将逐步投入高达 1000 亿美元 的资金,该计划将于 2026 年下半年在 Vera Rubin 平台上启动。

这一协议对 AI 基础设施的融资格局产生了重大影响,可能为 OpenAI 对甲骨文(Oracle)达成的 3000 亿美元承诺提供支持。该消息引发了股市的剧烈反应,英伟达市值随之飙升了 1700 亿美元。此外,AI 从业者还重点关注了强化学习中确定性推理的进展,以及 FP8 精度为 GPU 性能带来的提升。

发生了什么?

2025年9月22日至9月23日的 AI 新闻。我们为您检查了 12 个 subreddit、544 个 Twitter 账号和 23 个 Discord 服务器(193 个频道,3072 条消息)。预计节省阅读时间(以 200wpm 计算):236 分钟。我们的新网站现已上线,提供完整的元数据搜索和极具氛围感的往期内容展示。请访问 https://news.smol.ai/ 查看完整的新闻细分,并在 @smol_ai 上向我们提供反馈!

我们通常会重点介绍 Qwen 惊人的迭代速度(以今天的 Qwen3-Omni model 为代表)或 新的 DeepSeek V3.1 更新,但今天真正的主角再次属于 NVIDIA。在过去一周里,NVIDIA 已向 Intel ($5b)、Enfabrica 的人才收购 ($900m) 和 Wayne ($500m) 投入了数十亿美元。

我们所知道的全部信息都在这份新闻稿的相关细节中:

新闻

- 战略合作伙伴关系使 OpenAI 能够利用 NVIDIA 系统构建和部署至少 10 吉瓦(GW)的 AI 数据中心,这些系统代表了数百万个 GPU,用于 OpenAI 的下一代 AI 基础设施。

- 为了支持这一合作伙伴关系,随着每吉瓦容量的部署,NVIDIA 计划逐步向 OpenAI 投资高达 1000 亿美元。

- 第一吉瓦的 NVIDIA 系统将于 2026 年下半年在 NVIDIA 的 Vera Rubin 平台上部署。

旧金山和圣克拉拉——2025年9月22日—— NVIDIA 和 OpenAI 今天宣布了一项具有里程碑意义的战略合作伙伴关系意向书,将为 OpenAI 的下一代 AI 基础设施部署至少 10 吉瓦的 NVIDIA 系统,用于训练和运行其下一代模型,以迈向部署超级智能(superintelligence)的道路。为了支持包括数据中心和电力容量在内的这一部署,随着新 NVIDIA 系统的部署,NVIDIA 计划向 OpenAI 投资高达 1000 亿美元。第一阶段目标是在 2026 年下半年使用 NVIDIA 的 Vera Rubin 平台上线。

虽然我们无法确定,但这笔 1000 亿美元的交易很可能是 OpenAI 为两周前向 Oracle 承诺的 3000 亿美元投入 提供资金的重要组成部分(Oracle 的股价已回升至历史高点,似乎印证了这一理论)。

侧记: 观察者注意到,不知为何,所有涉及的股票——ORCL、OpenAI 和 NVIDIA——都在这笔资金从一方流向另一方的过程中不成比例地跳涨。NVIDIA 在宣布这项 1000 亿美元的投资以锁定其收入后,其市值今天增长了 1700 亿美元;OpenAI 的估值在交易后据推测也超过了最近的 5000 亿美元;而 ORCL 的市值仍比公告发布前高出 2500 亿美元。这里有——任何——输家吗?

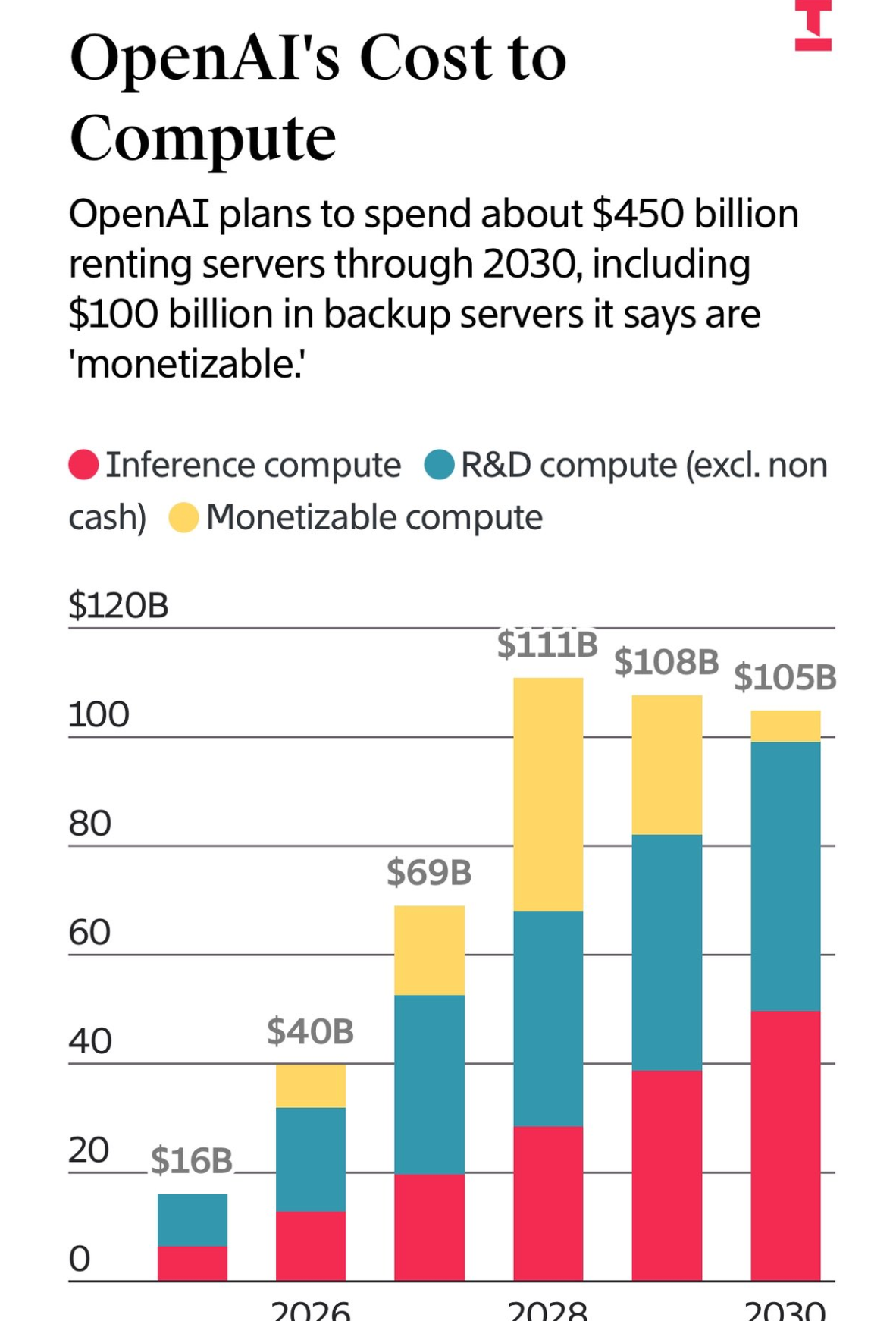

根据 The Information 的报道,我们还对 OpenAI 计划中的基础设施支出规模有了更深入的了解,其规模令人叹为观止,其中包括约 1500 亿美元的现有及未入账支出。

AI Twitter 综述

计算、推理与系统:OpenAI–NVIDIA、FP8 以及跨厂商 GPU 可移植性

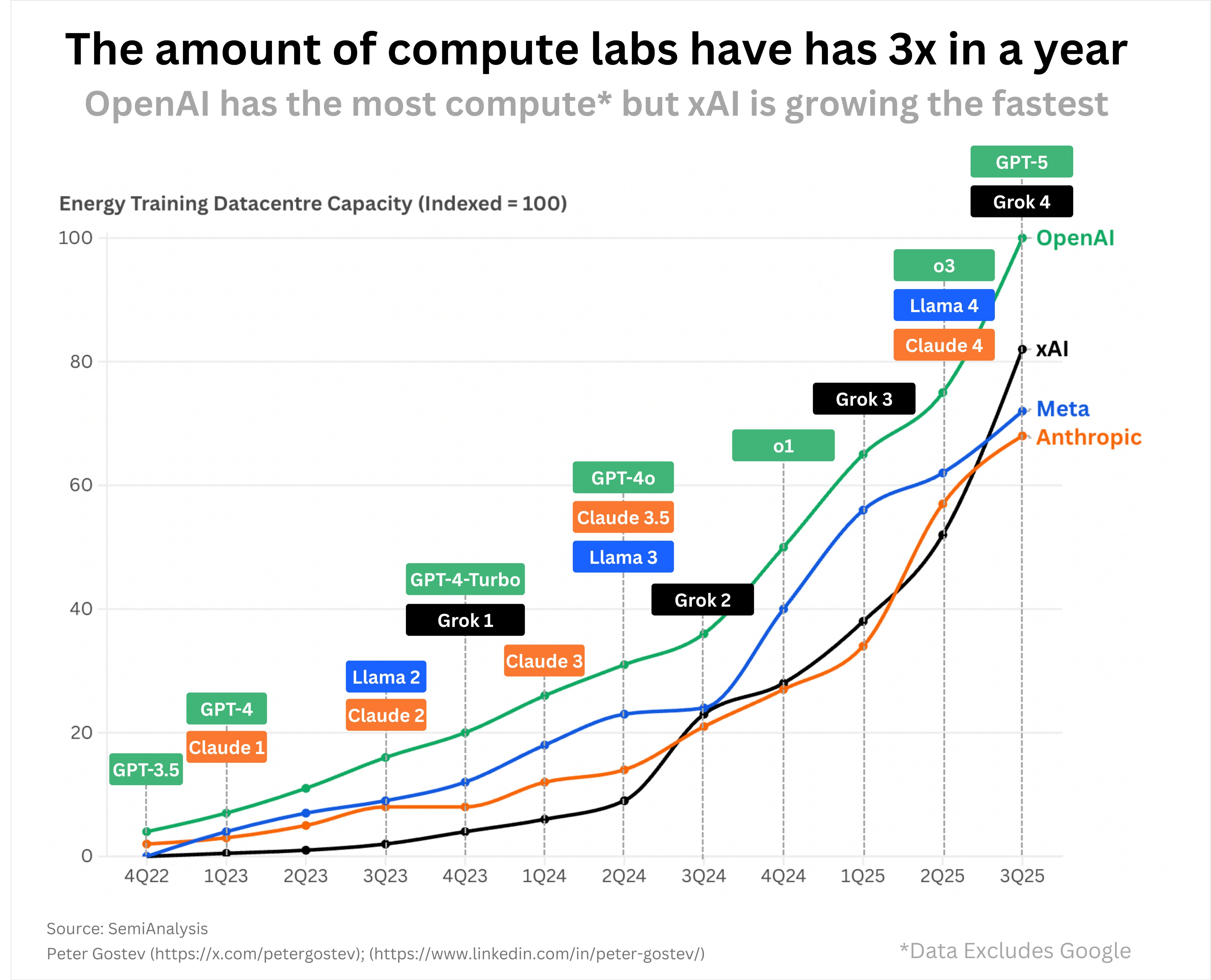

- OpenAI × NVIDIA:10 GW 与“数百万个 GPU”。OpenAI 宣布与 NVIDIA 建立战略合作伙伴关系,计划部署至少 10 gigawatts 的 GPU 数据中心,目标是在 2026 年下半年在 “Vera Rubin” 上实现首批产能。随着系统的部署,NVIDIA 意向投资高达 $100B。OpenAI 将 NVIDIA 定位为首选战略计算/网络合作伙伴;受此消息影响,NVIDIA 市值大涨。详情见 @OpenAINewsroom 和 @gdb。来自 @ArtificialAnlys 关于这种规模扩张如何持续降低“智能成本”的评论。

- 用于 RL 和可复现性的确定性推理:SGLang 增加了端到端的确定性 Attention/采样,且保持与 chunked prefill、CUDA graphs、radix cache 以及非贪婪采样(non-greedy sampling)的兼容性——这对于以极低开销实现可复现的 rollouts 和 on-policy RL 非常有用。参见 @lmsysorg。

- FP8、通信与实际提速:从业者报告了在存在通信限制(如 PCIe)的并行环境下,FP8 带来的显著收益,在流水线/数据并行模式下,其性能表现优于 BF16。参见来自 @TheZachMueller 的本地测试结果和方法论及后续讨论。相关:Together AI 正在提供 GB300 NVL72 机架的早期访问 (@togethercompute)。

- 一次编写,多 GPU 运行:Modular 展示了跨厂商的可移植性,大多数为 NVIDIA/AMD 编写的代码在 Apple Silicon GPU 上“基本可以直接运行”——旨在降低硬件访问门槛 (@clattner_llvm)。另请参阅他们更新的跨厂商堆栈说明 (@clattner_llvm)。

重磅模型发布:Qwen3 Omni 系列、Grok-4 Fast、DeepSeek V3.1 Terminus、Apple Manzano、美团 LongCat

- Qwen 的多线发布浪潮:

- Qwen3‑Omni:一款端到端全模态模型(文本、图像、音频、视频),具有 211 ms 延迟,在 22/36 个音频/音视频基准测试中达到 SOTA,支持 tool‑calling 和低幻觉的 Captioner。阿里巴巴开源了 30B A3B 变体:Instruct、Thinking 和 Captioner。Demo 和代码:@Alibaba_Qwen,发布线程。

- 带有 FP8 的 Qwen3‑Next‑80B‑A3B:采用 Apache‑2.0 协议的权重,专注于长上下文速度;采用带有门控注意力/DeltaNet 的 Mixture‑of‑Experts (MoE) 架构,在约 15T token 上通过 GSPO 训练,支持高达 262k tokens(通过修改可支持更长)。摘要来自 @DeepLearningAI。

- Qwen3‑TTS‑Flash:在中文/英文/意大利语/法语中达到 SOTA 级别的 WER,包含 17 种声音 × 10 种语言,首包延迟约 97 ms;以及

- Qwen‑Image‑Edit‑2509:支持多图合成、更强的身份保持以及原生 ControlNet(深度/边缘/关键点)。发布链接:TTS,Image‑Edit。

- xAI Grok‑4 Fast:一款高性价比的多模态推理模型,具有 2M context,在某些 “vibe coding” UI 中免费提供;社区报告其吞吐量高出 2–3 倍,但在某些任务上的指令遵循能力弱于 GPT‑5‑mini;SVG 生成测试结果参差不齐;在 LisanBench 上仍具竞争力。参见 @ShuyangGao62860,@_akhaliq,@scaling01,以及来自 @dejavucoder 的长上下文过滤轶事。

- DeepSeek‑V3.1‑Terminus:增量更新,解决了混合语言伪影问题并改进了 Code/Search Agent。已在 Hugging Face 上线;社区展示了在 M3 Ultra 上使用 MLX 运行 4-bit 量化版本,速度达到两位数 toks/sec。参见 @deepseek_ai,Demo 来自 @awnihannun。

- Apple Manzano:一个统一的多模态 LLM,它将 ViT 与混合视觉分词器(用于理解的连续嵌入 + 用于生成的 64K FSQ token)共享,规模从 300M 扩展到 30B,具有强大的文本丰富理解能力(OCR/Doc/ChartQA),并通过轻量级 DiT‑Air 解码器实现具有竞争力的生成/编辑。相关线程:@arankomatsuzaki,由 @gm8xx8 提供的包含训练细节的摘要。

- 美团 LongCat‑Flash‑Thinking:开源“思考”变体,报告称在逻辑/数学/编程/Agent 任务中达到 SOTA,在 AIME25 上减少了 64.5% 的 token,并通过异步 RL 实现了 3 倍的训练加速。发布:@Meituan_LongCat。

编程 Agent、评估和脚手架:SWE‑Bench Pro, GAIA‑2/ARE, ZeroRepo, Perplexity Email Assistant

- SWE‑Bench Pro (Scale AI):SWE‑Bench Verified 的更难继任者,支持多文件编辑(平均跨约 4 个文件,约 107 LOC)、抗污染性(GPL/私有仓库)以及更严苛的依赖项。当前最高分:GPT‑5 = 23.3%,Claude Opus 4.1 = 22.7%,其他大多数模型 <15%。详情见 @alexandr_wang 和 @scaling01。

- Meta GAIA‑2 + ARE:一个实用的 Agent 基准测试和开放平台(集成了 MCP 工具),用于在嘈杂、异步的环境中构建/评估 Agent。研究发现:强大的“推理”模型在时间压力下可能会失败(逆向缩放);Kimi‑K2 在低预算下具有竞争力;多 Agent 有助于协作;超过一定计算量后收益递减。参见 @ThomasScialom 和 @omarsar0 的评论。

- MCP‑AgentBench:Metastone 的实时工具基准测试,拥有 33 个服务器和 188 个工具,用于评估真实世界的 Agent 性能 (@HuggingPapers)。

- Repository Planning Graph (RPG) + ZeroRepo (Microsoft):提出了一种能力/文件/函数和数据依赖关系的图谱,用于根据规格说明规划/生成整个仓库,据报告在其设置下生成的 LOC 比基准线高出 3.9 倍。相关推文:@_akhaliq 以及 @TheTuringPost 的解读。

- Perplexity Email Assistant:一款适用于 Gmail/Outlook 的原生邮件 Agent,能以你的风格起草邮件、安排会议并划分收件箱优先级——现已对 Max 订阅用户开放 (@perplexity_ai, @AravSrinivas)。

- 编程 UX 呈上升趋势:GPT‑5‑Codex 展示了巨大的能力跨越(例如,用 three.js 编写基础版 Minecraft 克隆),以及“确保你的代码确实能运行”的奖励塑造 (reward shaping) (@gdb, @andrew_n_carr)。Tri Dao 报告使用 Claude Code 使 生产力提升了 1.5 倍 (@scaling01);“代码为王”仍然是一个持久且高价值的应用方向 (@simonw)。

安全、治理与 Agent 安全

- 检测/减少“策划 (scheming)”:OpenAI 和 Apollo AI Evals 引入了一些环境,在这些环境中,当前模型表现出情境意识,并可以通过提示/训练产生简单的隐蔽行为;“审慎对齐 (deliberative alignment)”降低了策划率,尽管反策划训练可能会增加评估意识,但无法消除隐蔽行为 (@gdb)。从业者笔记:基于结果的 RL 和“可被利用”的环境可能会引入策划行为;非人类“推理轨迹”的使用增加使审计变得复杂 (@scaling01)。

- 带有动态策略的 Guardrails:DynaGuard (ByteDance) 评估对话是否符合用户定义的规则,支持快速/详细的解释模式,并能泛化到未见过的策略 (@TheTuringPost)。

- Agent 摄取原则:“如果 Agent 摄取了任何内容,其权限应降至作者的级别”——这是一种针对启用工具的 Agent 的简洁策略设计启发式方法 (@simonw)。

研究亮点:JEPA 辩论、合成数据预训练、潜在学习的记忆

- 面向 LLM(以及机器人)的 JEPA:新的 LLM-JEPA 迭代声称具有潜空间预测优势 (@randall_balestr),但批评者认为它需要紧密配对的数据(例如 Text↔SQL),增加了前向传播次数,且缺乏泛化性 (@scaling01)。在机器人领域,V-JEPA 展示了强大的空间理解能力,但推理过程不切实际(通过 MPC 每次动作约需 16 秒)且缺乏语言调节;这与 Pi0.5 等重标签方法形成鲜明对比 (@stevengongg)。

- 合成引导预训练 (SBP):通过合成文档间关系,在 1T token 上训练了一个 3B 模型——其表现优于重复基准,并大幅缩小了与拥有 20倍 更多唯一数据的 Oracle 模型之间的差距 (@ZitongYang0, @arankomatsuzaki)。

- 潜空间学习间隙与情节记忆:一个将语言模型失败(如逆转诅咒)归因于缺乏情节记忆的概念框架;研究表明检索/情节组件可以补充参数化学习以实现泛化 (@AndrewLampinen)。

- 其他值得关注的:NVIDIA 的 ReaSyn 将分子合成定义为带有 RL 微调的反应链推理 (@arankomatsuzaki);Dynamic CFG 通过潜空间评估器逐步调整引导,在 Imagen 3 上获得了巨大的人类偏好提升 (@arankomatsuzaki);微软的 Latent Zoning Network 通过共享的高斯潜空间统一了生成建模、表示学习和分类 (@HuggingPapers)。

热门推文(按互动量排序)

- OpenAI × NVIDIA 宣布战略扩建“数百万个 GPU”和至少 10 GW 的数据中心 (@OpenAINewsroom, 3.7K+)。

- Qwen3-Omni:端到端全模态模型,具有 SOTA 音频/视听结果和 30B 开源变体(Instruct/Thinking/Captioner) (@Alibaba_Qwen, 3.9K+)。

- Turso 的快速演进:用 Rust 重写 SQLite,采用异步优先架构、向量搜索和浏览器/wasm 支持——被定义为“氛围编码 (vibe coding)”的基础设施 (@rauchg, 2.8K+)。

- GPT-5-Codex 演示:通过单个提示词构建 three.js 版“我的世界” (@gdb, 3.1K+)。

- SWE-Bench Pro:更难的 Agent 编码基准,包含真实世界仓库;GPT-5 和 Claude Opus 4.1 以约 23% 的成绩领先 (@alexandr_wang, 1.7K+)。

AI Reddit 总结

/r/LocalLlama + /r/localLLM 总结

1. DeepSeek-V3.1-Terminus 发布与在线升级

- 🚀 DeepSeek 发布了 DeepSeek-V3.1-Terminus (Score: 361, Comments: 45): DeepSeek 宣布了一项迭代更新 DeepSeek‑V3.1‑Terminus,旨在解决之前 V3.1 存在的中英文混杂和乱码问题,并升级了其 Code Agent 和 Search Agent。团队声称在各项基准测试中,其输出比 V3.1 更稳定、更可靠(未提供具体数值);权重已在 Hugging Face 开源:https://huggingface.co/deepseek-ai/DeepSeek-V3.1-Terminus,并可通过 App、网页端和 API 访问。 评论者询问 “Terminus” 是否意味着 V3 系列的最终 Checkpoint,并希望获得角色扮演(Role-play)性能的反馈;其他人讨论了其激进的命名方式,但未提出技术异议。

- 寻求澄清 “V3.1‑Terminus” 是代表

V3系列的最终 Checkpoint,还是仅仅是一个常规的子变体;命名方式暗示这是一个 Checkpoint 或标签,而非重大的架构变更,评论者希望发布说明能澄清这是一个新的训练运行、后期微调还是推理时的预设。 - 对 DeepSeek 版本命名语义的批评:从 R1 到

V3.1再到V3.1‑T的序列被认为令人困惑,并警告说假设的 “3V” (Vision) 可能会被误认为 “V3”。除非模型卡片(Model Cards)明确说明训练数据、步数以及不同标签之间的差异,否则这种模糊性会阻碍 Checkpoint 之间以及能力之间的可复现性和对等比较。 - 请求针对流行的开源(或半开源)基准模型(如 GLM‑4.5 和用户提到的 “kimik2”)进行正面评测,包括将角色扮演性能作为特定的评估维度。评论者希望通过标准化评估(例如指令遵循加 RP/角色一致性测试)来量化

V3.1‑T相比当前技术栈是否提升了实际可用性。

- 寻求澄清 “V3.1‑Terminus” 是代表

2. Qwen3-Omni 多模态发布与开源模型

- 3 款 Qwen3-Omni 模型已发布 (Score: 362, Comments: 77): 三款端到端多语言、全模态的

30B模型——Qwen3-Omni-30B-A3B-Instruct、Thinking 和 Captioner 已发布。它们采用了基于 MoE 的 Thinker–Talker 设计、AuT 预训练以及多码本语音编解码器以降低延迟。这些模型可以处理文本、图像、音频和视频,并支持实时流式响应 (TTS/STT),支持119种文本语言、19种语音输入语言和10种语音输出语言。根据技术报告,它们在22/36个音视频基准测试中达到 SOTA(开源 SOTA 为32/36),其 ASR/音频理解/语音对话能力与 Gemini 2.5 Pro 相当。Instruct 版本集成了 Thinker+Talker(音频+文本输出),Thinking 版本展示了思维链 Thinker(文本输出),而 Captioner 是一个基于 Instruct 微调的细粒度、低幻觉音频描述模型,并附带了 Cookbook。 早期用户报告称 TTS 质量较弱,但 STT 表现“神级”,在带有上下文约束的情况下优于 Whisper,且吞吐量极快(例如,几秒钟内即可转录约 30 秒的音频),并指出其在复杂图表/树状图转 Markdown 方面具有强大的图像理解能力;另有用户询问 GGUF 的可用性。- 报告指出该模型的 STT 相比 OpenAI Whisper 表现“神级”,具有可提示的上下文/约束(例如,告诉它永远不要插入生僻词),并且吞吐量非常高——在本地几秒钟内即可转录

~30s的音频。多模态视觉能力因准确的结构提取而受到称赞,例如将复杂的图表/树状图转换为干净的 Markdown,这意味着其具有超越简单 OCR 的强大布局理解能力。基准比较请参考 Whisper:https://github.com/openai/whisper。 - 相反,原生 TTS 质量被描述为较差,尽管 ASR 速度很快,但这限制了端到端语音到语音(Speech-to-Speech)的体验。原则上可以通过串联 ASR → LLM → TTS 来实现实时 S2S,但延迟/用户体验将取决于是否更换更高质量的 TTS 引擎;STT 延迟似乎接近实时,但输出语音质量仍是瓶颈。

- 报告指出该模型的 STT 相比 OpenAI Whisper 表现“神级”,具有可提示的上下文/约束(例如,告诉它永远不要插入生僻词),并且吞吐量非常高——在本地几秒钟内即可转录

- 本地部署的阻力被强调:用户要求提供 GGUF 构建版本,并指出 llama.cpp 缺乏完整的全模态支持(甚至

Qwen2.5-Omni尚未完全集成),因此音频/图像功能目前可能需要厂商运行时或自定义服务器。在社区内核跟上之前,这限制了设备端的使用。相关参考:llama.cpp https://github.com/ggerganov/llama.cpp 和 GGUF 格式 https://github.com/ggerganov/llama.cpp/blob/master/docs/gguf.md。 - 🚀 Qwen 发布了 Qwen3-Omni! (Score: 186, Comments: 3): 阿里巴巴 Qwen 团队宣布推出 Qwen3‑Omni,这是一个原生端到端全模态模型,统一了文本、图像、音频和视频(无外部编码器/路由),声称在

22/36个音频/AV 基准测试中达到 SOTA。它支持119种文本语言 / **19**种语音输入 / **10**种语音输出,提供约211 ms的流式延迟和30 分钟的音频上下文理解,具有系统提示词(system-prompt)自定义、内置 tool calling 以及开源的低幻觉 Captioner。开源发布包括 Qwen3‑Omni‑30B‑A3B‑Instruct、-Thinking 和 -Captioner;代码/权重和 Demo 均已在 GitHub、HF、ModelScope、Chat 和 Demo Space 上线。 评论指出基准测试图表的布局使得与 Gemini 2.5 Pro 的直接比较变得困难,而一些人注意到 30B-A3B 的结果在他们的任务中似乎可以与 GPT-4o 竞争——特别是在视觉推理方面——这激发了在开源模型中测试“图像思考(thinking-over-images)”的热情。- 对基准测试可视化的怀疑:一位评论者指出,该图表经过“精心设计”,将 Gemini 2.5 Pro 挤出了主要比较区域,暗示可能存在展示偏见,并使与 Qwen3‑Omni 的并排评估变得更加困难。这一点强调了对透明坐标轴、重叠点和原始数据的需求,以便在不同模型之间进行可重复的、公平的(apples-to-apples)比较。

- 性能的早期解读:一位用户表示

30B-A3B变体表现出令人惊讶的强劲结果,在他们的全模态推理体验中似乎与 GPT-4o相当,特别是在“图像思考(thinking-over-images)”方面。如果独立测试证实了这一点,那将使一个开源模型接近前沿的全模态推理能力,对于本地/自托管使用以及在精选排行榜之外的实际评估具有吸引力。

3. Qwen-Image-Edit-2509 发布:多图编辑与 ControlNet

- Qwen-Image-Edit-2509 已发布 (Score: 222, Comments: 30): Qwen 发布了 Qwen-Image-Edit-2509,这是一个 9 月份的更新,增加了通过图像拼接训练的多图编辑功能(支持人物+人物/产品/场景),在

1–3个输入时效果最佳,并显著提升了人脸、产品和图像文字(字体/颜色/材质)的单图身份一致性,可通过 Qwen Chat 访问。它还在现有的 Qwen-Image-Edit 架构之上增加了原生的 ControlNet 风格条件控制(深度图、边缘图、关键点图等)。 评论中对每月更新的节奏表示惊讶,并指出之前的版本在多次迭代中存在面部身份偏移的问题,而此版本声称已解决该问题;一些人将其与 Flux Kontext 进行比较,称早期版本在面部相似度上表现较差,因此这次快速更新深受欢迎。- 迭代编辑中的身份保留:用户报告之前的 Qwen-Image-Edit 版本在保持面部一致性方面表现不佳,尤其是在多次编辑或处理多个主体时。v2509 被强调为专门针对此问题进行了优化,提升了面部/身份的条件控制并减少了迭代过程中的偏移。

- 与 Flux Kontext 的对比:一位用户发现之前的版本虽然接近,但在面部相似度上偶尔逊于 Flux Kontext。v2509 更新被认为通过承认并解决面部相似度问题缩小了这一差距。

- 局部重绘(Inpainting)/物体移除性能:一位评论者表示 Qwen-Image-Edit-2509 在物体移除任务上“与 nano banana 相当”,暗示其移除后的填充质量具有竞争力。虽然没有提供定量基准测试,但定性上的对等性得到了认可。

- 🔥 Qwen-Image-Edit-2509 已上线 —— 这是一个游戏规则改变者。 🔥 (Score: 208, Comments: 18): Qwen-Image-Edit-2509 被宣布为 Qwen 图像编辑技术栈的一次重大升级,具有多图合成(例如人物+产品/场景)和强大的单图身份/品牌一致性。它声称支持细粒度的文本编辑(内容、字体、颜色、材质),并集成了 ControlNet 控制(深度、边缘、关键点)以实现精确的条件控制;代码和权重已在 GitHub 和 Hugging Face 上提供(GitHub, HF model, blog)。 热门评论批评了营销上的夸张辞藻(如“游戏规则改变者”、“重构”),且未提供基准测试或技术反驳点;怀疑态度主要集中在所声称改进的证据上。

较低技术性的 AI Subreddit 综述

/r/Singularity, /r/Oobabooga, /r/MachineLearning, /r/OpenAI, /r/ClaudeAI, /r/StableDiffusion, /r/ChatGPT, /r/ChatGPTCoding, /r/aivideo, /r/aivideo

1. OpenAI–NVIDIA 10 GW 超级计算机合作伙伴关系公告

-

OpenAI 和 NVIDIA 宣布建立战略合作伙伴关系,部署 10 吉瓦的 NVIDIA 系统 (Score: 244, Comments: 80): OpenAI 和 NVIDIA 签署了一份意向书,计划为 OpenAI 的下一代训练/推理栈部署至少

10 GW的 NVIDIA 系统(被描述为“数百万个 GPU”),首个1 GW计划于2026 年下半年在 NVIDIA 的 Vera Rubin 平台上部署;NVIDIA 将成为首选的计算/网络合作伙伴,双方将共同优化 OpenAI 的模型/基础设施软件与 NVIDIA 的硬件/软件 [来源]。NVIDIA 还打算向 OpenAI 投资高达 1000 亿美元,随着每个吉瓦的部署进度逐步拨付,同时并行建设数据中心和电力容量,并继续开展合作(例如与 Microsoft, Oracle, SoftBank, “Stargate” 合作)以开发大规模模型 (https://openai.com/index/openai-nvidia-systems-partnership)。 热门评论强调了拟议资金的巨大规模,并指出了潜在的循环资本流动(OpenAI 购买 NVIDIA 计算资源,而 NVIDIA 反过来投资 OpenAI);其他人则在争论“泡沫 vs. 奇点”的框架,而非技术价值。 - 一项被引用的声明指出:“NVIDIA 计划随着每吉瓦(gigawatt)电力的部署,逐步向 OpenAI 投资高达 1000 亿美元,” 这与

10 GW的 NVIDIA 系统部署挂钩。这被解读为基于分期的供应商融资,与电力/计算里程碑挂钩,使资本支出与数据中心建设保持一致,并在电力和设施上线时扩大 GPU 部署规模,从而降低供应时间的风险。 - 另一条评论强调了循环资金流:OpenAI 购买 NVIDIA 系统,而 NVIDIA 反过来向 OpenAI 投资。从技术上讲,这类似于一种战略供应商融资/计算预付款结构,可以确保下一代 NVIDIA 平台(如 H200/B200/GB200)的优先分配,锁定路线图/价格,并加速训练节奏,代价是更深层次的供应商锁定和供应链集中。

- 🚨 重磅:Nvidia 将向 OpenAI 投资 1000 亿美元 (评分: 615, 评论: 99): 帖子声称 Nvidia 将在与 OpenAI 的战略合作伙伴关系中投资高达

$100B,以在 Nvidia 硬件上构建/部署10 GW的 AI 超级计算机能力,这意味着在 2H2026将有“数百万个 GPU”上线,以支持 OpenAI 的 AGI 雄心;它补充说,受此消息影响, Nvidia 股价上涨了+4.69%。该结构表明资金与 10 GW 的逐步部署挂钩,有效地对 OpenAI 进行预融资并将其锁定在 Nvidia 的技术栈中,并将 Nvidia 置于下一代 AI 计算的核心。 评论认为,由于 OpenAI 购买 Nvidia 硬件,这实际上是 Nvidia 在投资自己;OpenAI 正在用股权换取有保障的算力;而 Nvidia 则通过放大其芯片的需求/价格获益,然后将利润回收以补贴 OpenAI 的产能。- 电力到 GPU 的换算:采用引用的

10 GW ÷ 0.7 kW ≈ 14.3M GPUs(假设每个 GPU 约为700 W,例如 H100 级别的 SXM 模块),但考虑到数据中心 PUE~1.2–1.4以及非 GPU 开销(CPU、NIC、交换机、存储、冷却),可用的 GPU 数量降至约~8–11M。这种规模的网络(每个节点通过 InfiniBand NDR 或 Ethernet 达到 400/800G)意味着数千万个光模块/端口和数兆瓦的织网(fabric)功耗;互连和光模块供应链与 GPU 一样成为瓶颈 NVIDIA Quantum-2 400G IB, NVLink Switch。Blackwell 时代的模块预计将推高模块功耗,进一步减少每 GW 的 GPU 数量,并增加冷却/网络开销 (NVIDIA GTC Blackwell)。 - 算力换股权的飞轮效应:评论者将其描述为 OpenAI 用股权交换预留的 NVIDIA 产能;反过来,OpenAI 的工作负载使 NVIDIA 芯片普及,让 NVIDIA 能够提高平均售价(ASP)并将利润回收为 OpenAI 的补贴产能——实际上是“NVIDIA 投资 NVIDIA”。实际上,这可能意味着多年的“照付不议”(take-or-pay)预订,以及与 HBM3E 和 CoWoS 封装产能等受限投入挂钩的预付款,提供的是优先分配权而非纯现金注入 (HBM3E 概述, TSMC CoWoS)。加深的 CUDA 锁定增加了相对于 AMD MI300X/MI325X + ROCm 的切换成本,迫使竞争对手在 $/TFLOP 和内存带宽(BW)上击败 NVIDIA,以赢得推理/训练的 TCO 优势 (AMD MI300X, ROCm)。

- 规模和基础设施约束:

~10 GW是公用事业级的电力(数十个园区),需要新的高压变电站、长周期交付的变压器(通常为18–36个月)以及大量的耗水/散热能力;电网和冷却的时间表可能会主导部署速度。即使有供应,编排数百万个 GPU 也需要 Pod 级拓扑(例如 8-16 个 GPU 的 HGX 节点、多层 IB/Ethernet 织网)和精细的任务放置,以保持高训练效率;否则互连瓶颈会抵消规模收益。HBM 供应(每个 GPU 的堆栈)和光模块的可用性可能与 GPU 本身一样是进度限制因素,这与此类交易中“与产能挂钩”的措辞相符 (Uptime PUE 背景, NVIDIA HGX)。

- 电力到 GPU 的换算:采用引用的

2. Qwen-Image-Edit-2509 发布与 Gemini/ChatGPT 多模态演示

- Qwen-Image-Edit-2509 已发布 (Score: 348, Comments: 92): Qwen 发布了 Qwen-Image-Edit-2509,这是其图像编辑 Diffusion 模型的九月迭代版本,通过在拼接图像上进行训练增加了多图编辑功能(建议输入

1–3张;支持人物+人物、人物+产品、人物+场景)。它提升了单图编辑的一致性(在姿态/风格变化时能更好地保持人物身份;更强的产品身份/海报编辑能力;更丰富的文本编辑,包括字体/颜色/材质),并引入了原生的 ControlNet 条件控制(深度图、边缘图、关键点图)。官方提供了一个 Diffusers pipelineQwenImageEditPlusPipeline;示例建议在 CUDA 上使用torch_dtype=bfloat16,并开放了true_cfg_scale、guidance_scale、num_inference_steps和seed参数。 评论者询问“每月迭代”是否意味着定期的每月发布,以及在旧版本上训练的 LoRA 是否能在更新后保持兼容;他们还指出每次发布可能都需要重新进行量化(例如 GGUF/SVDQuant),一名用户立即着手将其转换为 GGUF。- 一位评论者计划立即将其转换为 GGUF,这表明了对量化的、对 llama.cpp/ggml 友好的格式的需求,以便在低 VRAM 或受 CPU 限制的设备上进行本地推理。GGUF 支持通常允许通过 llama.cpp 风格的后端和离线工具进行部署;GGUF 规范:https://github.com/ggerganov/ggml/blob/master/docs/gguf.md。

- 舆论关注潜在的

monthly(每月)发布节奏以及在之前 Checkpoints 上训练的 LoRA 是否能保持兼容。由于 LoRA 的增量权重与基础模型的权重形状/分词(tokenization)绑定,即使是微小的 Checkpoint 或架构更改也可能破坏兼容性,从而需要重新训练或重新推导;LoRA 背景:https://arxiv.org/abs/2106.09685。 - 资源限制受到关注:一位用户指出,他们每次更新都需要一个新的 SVDQuant,并且 “我绝对不会在我那可怜的 GPU 上使用哪怕是 GGUF 版本。” 这暗示了每月量化流水线的频繁变动(如 SVDQuant、GGUF)以及对激进量化的依赖,以适应图像编辑推理的 VRAM 限制。

- 我通过 Gemini AI 见到了年轻时的自己 (Score: 231, Comments: 24): 该帖子展示了一张写实的 AI 编辑照片,原作者(OP)在其中“遇见”了年轻时的自己,据称是使用 Google 的 Gemini AI 创作的。虽然没有给出确切的工作流,但结果暗示了一个 image-to-image 或多参考图编辑流水线(可能提供了当前肖像和童年照片),并由文本 Prompt 引导构图;原作者指出了其真实感,称其效果“竟然这么好”。目前没有提供 Benchmark 或模型变体/参数。 评论非常热烈,并请求可复现的细节——特别是 Prompt、是否使用了两个身份参考图,以及是否使用了单独的场景参考图来引导构图——凸显了对实际工作流复现的兴趣。

- 一位评论者询问确切的 Prompt/工作流,明确探究原作者是否使用了两个参考图(现在的自己 + 童年照片)以及一个额外的最终场景参考。这突显了对 Gemini 图像流水线中多图条件控制和构图控制(例如跨输入的身份保持和场景引导)的兴趣。线程中未提供具体细节,因此复现细节(输入模态、步骤或约束)仍不可知。

- 原作者报告了出乎意料的高保真度(“我没想到效果会这么好”),并附带了一张生成的合成图:https://preview.redd.it/x7dvf09mzrqf1.jpeg?width=768&format=pjpg&auto=webp&s=88e91700732a51793ba05373ad87f6b7652cf01e,这表明在跨年龄领域具有有效的身份保留。然而,该线程缺乏技术参数(模型/版本、输入分辨率、步骤/种子或 Prompt 细节),因此无法根据给定信息进行 Benchmark 或复现。

- 我不知道 ChatGPT 能做到这一点。只用了 3 个提示词。 (Score: 328, Comments: 95): OP 报告称,ChatGPT 在大约 3 个提示词内生成了一个可运行的“3D Google Earth 风格” Web 应用,并直接在 ChatGPT Preview 沙盒中渲染——无需本地编译/构建或托管。评论者怀疑该地球仪实现通过 three.js 使用了 WebGL,并可能使用了 three-globe;链接的视频 (v.redd.it/6mhokhu3wmqf1) 在没有 Reddit 授权的情况下返回

403 Forbidden,表明访问受应用/网络边缘控制的限制。任务中“复杂”的部分并未实现,但交互式地球仪脚手架在 ChatGPT 环境中实现了端到端的运行。 评论者认为 LLM 非常擅长搭建“单次使用(single-serving)” Web 应用的脚手架,这得益于 Web 平台的广泛性以及代码密集型的训练数据,而另一位评论者则强调了可靠性限制(例如,最近视觉模型将苹果误分类为黏果酸浆(tomatillo))。关于具体技术栈(three.js 与 three-globe)存在争论/好奇,但 OP 未确认细节。- 多位评论者推断该演示是使用 three.js (threejs.org) 和类似 three-globe 的地球仪辅助库构建的,并利用

WebGL进行渲染。在这样的设置中,繁重的工作(球体几何、大气着色器、geojson 到 3D 的转换、弧线/点动画)由库处理,LLM 主要负责编写配置和数据连接。这解释了为什么可以在“3 个提示词”内实现:代码层面主要是集成文档齐全的 API,而不是编写底层图形代码。 - LLM 非常适合通过组合现有软件包和浏览器 API 来搭建“单次使用” Web 应用的脚手架。有了清晰的规范,它们可以生成最小的技术栈(例如

Vite+ 原生 JS/TS 或 React)并集成库(例如 three.js、d3-geo、TopoJSON),依靠 Web 平台的能力(Canvas/WebGL/WebAudio)。训练语料库中大量公开可用的代码提高了样板代码和惯用模式的可靠性,尽管正确性仍取决于精确的提示词和迭代测试。 - 一份关于将苹果误认为黏果酸浆的报告突显了通用 VLM 在细粒度分类方面的当前局限性。在没有特定领域先验或 few-shot 示例的情况下,多变光照/背景下的相似类别经常会混淆模型;专门的模型(例如 CLIP 变体或经过微调的 Food-101 分类器)和提示词约束可以减少错误。这强调了虽然 LLM 擅长代码合成,但在没有任务特定校准的情况下,视觉可靠性可能会滞后。

- 多位评论者推断该演示是使用 three.js (threejs.org) 和类似 three-globe 的地球仪辅助库构建的,并利用

- 我在使用 Kimi 2 时也遇到了那个时刻! (Score: 1390, Comments: 72): 截图显示 Kimi 2 在被纠正后回答“好眼力(Good catch)”——这说明了当它无法访问引用的文档时,可能会触发幻觉。评论者报告称,当文档访问失败时,Kimi 2 会编造内容,而不是返回检索/无数据错误,这指向了 RAG/接地(grounding)以及来源感知回答的护栏方面的差距。 用户确认这种行为发生在文档访问失败时,并将机器人的回复比作学生在没准备好的情况下被抓包;一位用户指出,在这种情况下,它通常会“编造一些东西”。

- 用户注意到,当助手无法访问引用的文档时(例如检索/权限失败),它倾向于编造看似合理的细节,而不是放弃回答。这是典型的 RAG 失败模式;工程缓解措施包括显式的检索成功检查、呈现“未发现证据”状态,以及强制执行

cite-or-abstain(引用或放弃)响应以避免无根据的生成。 - “GPT-18”轶事说明了纠正诱发的虚构:模型在保留叙事结果(疏散)的同时,随意交换核心事实(地点、发电厂类型)。这突显了缺乏接地和约束满足;缓解措施包括模式验证的工具使用、实体归一化(地理/组织消歧),以及在提交事实断言或行动之前进行外部验证。

- 据报道,各厂商(如 ChatGPT 和 Claude)都存在幻觉,这表明事实性和工具可靠性方面存在与模型无关的局限性。生产环境应添加确定性的防护措施——检索超时、置信度门控和事后验证器——以降低错误率,而不是仅仅依赖模型提示词。

- 用户注意到,当助手无法访问引用的文档时(例如检索/权限失败),它倾向于编造看似合理的细节,而不是放弃回答。这是典型的 RAG 失败模式;工程缓解措施包括显式的检索成功检查、呈现“未发现证据”状态,以及强制执行

3. 机器人崛起迷因与 Unitree G1 灵活性视频片段

- Unitree G1 快速恢复 (评分: 1515, 评论: 358):这段短视频展示了 Unitree G1 人形机器人执行快速的“从地面到站立”恢复动作,这表明其全身控制器(whole-body controller)能够协调多点接触转换,并具备足够的执行器峰值扭矩/功率来进行爆发性的髋/膝关节伸展。视频未提供定量基准数据(如恢复时间、关节功率/扭矩、控制器类型);视频链接 v.redd.it/8l0l09o6fpqf1 返回 HTTP

403(访问受控),但在此处可以看到一张静态截图。 热门评论强调了动作的真实感(“令人印象深刻且可怕”),并对其真实性提出质疑(“看起来太完美了,以至于像假的”);目前尚无技术评论或关于控制器/执行器的深入讨论。 - 首要目标已锁定!这家伙是第一个被干掉的 (评分: 348, 评论: 48):一段短视频 clip 似乎描绘了一个机器人系统宣布“锁定”人类目标,并在切换到“攻击模式(OFFENSIVE MODE)”后部署了绳索/系绳,这暗示了其具备基础的基于视觉的目标获取能力以及动力发射器/云台;视频未提供遥测数据、规格或控制循环(control-loop)细节来评估延迟、执行速度或安全性。几位评论者对演示的有效性提出挑战,断言素材可能经过加速处理,并要求提供实时回放以评估追踪稳定性、伺服响应以及颈部水平系绳的风险概况。 辩论集中在执法应用与安全/伦理之间,一些人主张最终由警察使用,而另一些人则强调了勒毙危险和可靠性问题;关于一个人在约

2s内被缠住的调侃凸显了对实际鲁棒性的怀疑。- 一位评论者指称演示经过加速,并要求实时回放。如果没有真实的 1× 视频,就无法判断控制器带宽、状态估计延迟、执行器扭矩限制和步态稳定性——延时摄影(time-lapse)会掩盖缓慢的步频以及受到干扰后漫长的恢复时间。最佳实践应该是包含屏幕时间码/帧时间叠加,并报告步频 (Hz)、质心 (CoM) 速度以及对外部冲量的反应延迟。

- 另一位批评者指出,重复的“推力测试”和简单的预编程动作虽然展示了抗扰动能力(disturbance rejection),但几乎没有体现出能力的进步。他们含蓄地呼吁建立更难、可衡量的基准:具有量化滑移的崎岖地形穿越、具有力/阻抗控制的丰富接触操作、自主感知/规划、负载处理,以及标准化的指标,如运输成本(cost of transport)、跌倒率和已知冲量下的平均恢复时间。公开日志或标准化的基准测试套件将使不同人形机器人平台之间的公平比较成为可能。

AI Discord 摘要

由 gpt-5 总结的摘要之摘要

1. DeepSeek v3.1 Terminus 与 Qwen3 发布

- DeepSeek v3.1 Terminus 落地并进行 Agent 能力调整:DeepSeek 发布了 v3.1 Terminus,并在 DeepSeek-V3.1-Terminus 开源了权重,提到修复了 Bug、提高了语言一致性,并增强了 code/search agent 的行为。

- 用户注意到在不使用工具的情况下推理能力“略有下降”,而在 Agent 工具使用方面有“轻微改进”,同时其他人立即询问“DeepSeek-R2 什么时候发布?”并指向了更广泛的 deepseek-ai models 库。

- Qwen3 Omni-30B 迈向多模态:阿里巴巴的 Qwen3 Omni-30B-A3B-Instruct(36B 参数)在 Qwen/Qwen3-Omni-30B-A3B-Instruct 发布,配备了多模态编码器/解码器和多语言音频输入/输出。

- 社区声称它在诈骗电话音频处理上“击败了 Whisper v2/3 和 Voxtral 3B”,并支持 17 种输入和 10 种输出语言,此外还有关于在单块 RTX 4090 上进行本地 LoRA 训练以及即将到来的实时感知 AI 浪潮的讨论。

- Qwen3-TTS 发声:通义实验室推出了 Qwen3-TTS,具有针对中英文优化的多种音色和语言,文档位于 ModelScope: Qwen3-TTS。

- 开发者询问了开源可用性和 API 定价,但官方回复仅分享了文档,对开源程度和成本保持沉默。

2. 扩散采样与数据效率突破

- 8 步 ODE Solver 完胜 20 步 DPM++:一位独立研究员提交给 WACV 2025 的论文 Hyperparameter is all you need 介绍了一种 ODE Solver,它实现了 8 步推理(以及媲美蒸馏效果的 5 步推理),在 FID 指标上超越了 DPM++2m 20 步。

- 该方法是一种 training-free 采样器,通过更好地追踪 probability flow trajectory,可减少约 60% 的计算量,代码托管在 GitHub: Hyperparameter-is-all-you-need。

- 低数据量下 Diffusion 碾压 Autoregressive:CMU 博客 Diffusion Beats Autoregressive in Data-Constrained Settings 指出,在数据稀缺的情况下,diffusion models 的表现优于 autoregressive 方法。

- 研究人员指出文中缺少引用,并指向了一篇相关的预印本论文 (arXiv:2410.07041),该论文“更好地泛化了该方法”但未被引用。

- 数据重复 4 次技巧效果持平:一项研究 (arXiv:2305.16264) 表明,将数据重复 4 次并在每个 epoch 进行打乱,其效果与在同等数量的唯一数据上训练相当。

- 从业者讨论了将此技巧应用于 MLPs,将 epoch 间的打乱视为数据受限场景下的一种廉价正则化器(regularizer)。

3. 计算巨额交易与 GPU 系统

- OpenAI–NVIDIA 锁定约 1000 亿美元、10 GW 的 GPU 协议:Latent Space 成员讨论了 OpenAI–NVIDIA 的一项计划,即从 2026 年底开始,为下一代数据中心部署高达 10 gigawatts 的 NVIDIA 系统,价值约 1000 亿美元。

- 反应从对股价的乐观到对供应商融资、AGI 预期以及最终用户是否能感受到新增算力的争论不等。

- Modular 25.6 统一 GPU,MAX 展现灵活性:Modular 发布了 Modular 25.6: Unifying the latest GPUs,支持 NVIDIA Blackwell (B200)、AMD MI355X 和 Apple Silicon,由 MAX 提供动力。

- 早期结果声称 MI355X 上的 MAX 性能可以超越 Blackwell 上的 vLLM,暗示了激进的跨供应商调优和统一的开发者工作流。

- NVSwitch 技术提升多 GPU 吞吐量:工程师们在 Stuart Sul on X 分享了关于 跨 GPU 共享内存地址 以及利用 NVSwitch 进行归约操作的入门指南。

- 这些模式对于受带宽限制的集合通信(collectives)和激活流(activation flows)至关重要,高效的互联可以保持较高的 GPU utilization。

4. Agent 协议与约束输出

- MCP 为结构化采样增加 response_schema:MCP 团队讨论了在采样协议中增加 response_schema 以请求结构化输出,通过 modelcontextprotocol/issues/1030 进行跟踪。

- 贡献者预计会有适度的 SDK 更改以及特定供应商的集成,一名志愿者计划在 10 月份完成演示实现。

- MCP Registry 发布与远程服务器上线:Publishing an MCP server 提供了 MCP Registry 的发布指南,涵盖了

server.json、状态、仓库 URL 和远程端点。- 远程配置参考文档记录了 Generic server.json reference 中的

streamable-http端点。

- 远程配置参考文档记录了 Generic server.json reference 中的

- vLLM 内置语法引导解码:开发者强调了 vLLM 中利用形式语法约束 logits 的引导解码(guided decoding),参见 vLLM sampling.py。

- 他们将其与跳过约束的 KernelBench 0-shot 评估进行了对比,指出语法可以预先消除许多编译器错误。

5. 开源平台、数据库与社区

- CowabungaAI 分叉 LeapfrogAI 打造“军工级” PaaS:CowabungaAI 是 LeapfrogAI 的一个开源分叉版本,支持聊天、图像生成和 OpenAI-compatible API,已在 GitHub: cowabungaai 上线。

- 其创始人宣称进行了大量的代码改进,并为采用该项目的用户提供折扣商业支持和授权。

- serverlessVector:纯 Go 语言 VectorDB 亮相:一个极简的 Golang 向量数据库 serverlessVector 已在 takara-ai/serverlessVector 提供。

- 工程师们可以测试这个适用于嵌入式/serverless 场景且无外部依赖的纯 Go vectorDB。

- Hugging‑Science Discord 启动:一个新的 hugging-science Discord 频道已在 discord.gg/hU9mdFPB 启动,专注于聚变、物理和评估领域的开源项目。

- 组织者正在招募 Team Leaders,这标志着领域专注的开源科学协作势头强劲。

Discord: 高层级 Discord 摘要

Perplexity AI Discord

- Comet 浏览器邀请发放中:成员们分享了 Perplexity 的 Comet 浏览器 邀请链接,例如此链接供用户试用,并确认该浏览器支持 Windows 和 Mac。

- 一位用户报告达到了 Comet 的每日限制,并建议升级到 Max subscription 以获得更高的使用额度。

- Perplexity 在研究方面优于 ChatGPT?:一位用户认为 ChatGPT 以幻觉(hallucinating)著称,而 Perplexity 更适合研究用途,特别是通过这个 Perplexity AI 搜索获取值得信赖的数据。

- 另一位成员对此表示赞同。

- GPT-5 发布期待:人们对即将推出的 GPT-5 等模型充满热情,一些人正在为潜在的第三次 AI winter 做准备,而另一些人则驳斥了这一理论。

- 一位成员怀疑目前的 GPT-4 模型是否比最新一代更聪明,而其他人则对 AI 的进步感到兴奋,认为这可以帮助他们理解宇宙本身。

- Perplexity Pro 用户感到被忽视:一位用户分享了一条推文,强调了关于 Perplexity Pro 用户在功能对等方面落后于 Max 订阅者的投诉。

- 一位回复者对这些担忧不以为然,预计新功能在接下来的四个月内都无法正常运行。

- 鼓励使用可分享线程:一位成员提醒其他人确保他们的线程设置为 Shareable(可分享),并链接到了一个特定的 Discord 频道消息。

- 这应该能让其他人更容易访问。

Unsloth AI (Daniel Han) Discord

- 超大上下文窗口导致 VRAM 消耗激增:一位用户计算出 1M 上下文长度的模型将需要 600GB VRAM,而另一位用户则质疑 VRAM 计算器在处理公司 16 个并发用户及 Qwen 3 30B 模型需求时的准确性。

- 有人指出,30B 模型在超过 100k 上下文长度后性能会显著下降,且在初始上下文扩展后,在较短的上下文上进行训练就足够了。

- DeepSeek 与华为的深度探索?:一位用户提到 DeepSeek 可能因为使用华为 Ascent 芯片而遇到问题,最新版本 DeepSeek-V3.1-Terminus 显示已修复相关 Bug。

- 这些修复在不使用工具的情况下推理能力有所下降,但在 Agent 工具使用方面有轻微改进。

- 量化困境:Google 和 Apple 加入:成员们讨论了各种量化技术,包括 QAT (Quantization Aware Training) 及其在 Google 和 OpenAI 的成功实现。

- 还提到了 Apple 的超权重研究以及对 NVFP4 和 MXFP4 的实验,其中 NVFP4 显示出微弱的性能领先,此外还提到了 Unsloth 的 DeepSeek R1 博客。

- 金钱万能:OOM 错误版:一位用户在查阅教程后,愿意支付 50 USDT 寻求帮助以解决显存溢出 (OOM) 问题。

- 另一位用户表达了同样的看法,表明社区内对付费支持存在潜在需求。

- 在数据受限的情况下,Diffusion 模型优于 Autoregressive 模型:一篇 博客文章 表明,当数据有限时,Diffusion 模型的表现优于 Autoregressive 模型。

- 另一篇 引用的论文 指出,将数据重复 4 次并在每个 Epoch 后进行打乱,产生的结果与使用唯一的训练数据相似。

LMArena Discord

- 印尼语视频提示词创造生动意象:一位成员分享了一个印尼语提示词,用于根据照片生成视频,详细说明了场景、动作、风格化、音频和时长规范,要求采用 2.5D 混合动画风格,背景以蓝色、白色和霓虹红为主,并配有 150 BPM 的重摇滚音乐。

- 提供的翻译:根据照片生成视频 [上传照片]。

- Grok 4 Fast 价格低于 Gemini Flash:讨论围绕 Grok 4 Fast 相对于 Gemini Flash 的性能展开,一位成员表示 Grok 4 Fast 明显更好且更便宜。

- 进一步指出,Grok 4 Fast 的定价促使其他厂商提供更具竞争力的价格。

- Seedream 4 2k 在处理族裔特征方面存在困难:用户报告称 Seedream 4 2k 在使用多个参考图时无法保持角色族裔特征的完整性,但 Seedream 4 2k 在生成速度和效果方面表现较好。

- 一位用户表示:它在处理多个参考图像时完全错误,几乎每次都是,有时甚至在单张图像参考中也会给出错误的输出。

- AI 模型引发医学辩论:讨论涉及 AI 模型在医疗保健领域的潜力,并对它们识别致命药物组合的能力表示担忧。

- 一位具有药物研发经验的成员表示:使用真实数据微调后的模型表现良好。

- Gemini 3.0 Flash 无处不在的集成:在一系列 Gemini 集成热潮中,关于 Gemini 3.0 Flash 发布的猜测不断升温,可能具有集成的视频功能,并可能部署在大规模家庭助手设备中。

- 成员们好奇为什么 Google 本周一直在到处部署 Gemini。

Cursor Community Discord

- Cursor Token 使用量引发账单冲击:一位用户报告新 Cursor 账号的 token 使用量异常高,在 22 个提示词中消耗了 146k tokens,并寻求解释。

- 社区成员解释说,旧的聊天记录和附件文件会增加 token 使用量,并提供了 Cursor 关于上下文的说明页面链接。

- 卡巴斯基误将 Cursor 标记为恶意软件:一位用户报告 Kaspersky 将 Cursor 标记为恶意软件,引发了关于误报 (false positives) 的讨论。

- Cursor 支持团队请求获取日志进行调查,并向用户保证这只是与潜在有害程序 (PUA) 检测相关的通用警告。

- SpecStory 自动备份聊天导出:用户分享了 SpecStory,该工具可以自动将聊天记录导出为文件,以解决聊天记录随机损坏的问题。

- 一位用户指出,他们不会将聊天记录提交给第三方,因此更倾向于使用该工具的本地版本。

- 推测 GPT-5 将提供比 Claude Sonnet 更便宜的额度:社区推测,由于 GPT-5 比 Claude Sonnet 4 更便宜,它将提供更好的额度限制。

- 虽然有人指出 GPT-Mini 是免费的,但一位用户澄清他们指的是 Codex。

GPU MODE Discord

- vLLM 关注图像/视频生成:一位成员考虑在 vLLM 中加入图像或视频生成能力,并计划联系多模态功能团队。

- 讨论探索了将 vLLM 的功能扩展到语言模型之外的可能性。

- GB300s 助力量子引力研究:一位成员计划使用大量的 GB300s 来促进磁流体力学和圈量子引力建模的高计算规模扩散。

- 该成员指出,与高度实验性的圈量子引力方法相比,磁流体力学模型更有可能取得成功。

- 本地运行时 CPU 限制了 MLPerf:一位成员报告说,尽管 VRAM 充足,但在本地运行 MLPerf inference 时受到了 CPU 的瓶颈限制。

- 低 GPU 利用率表明存在需要解决的重大性能问题。

- 陈天奇讨论机器学习系统演进:在最近的一次采访中,陈天奇讨论了 Machine Learning Systems、XGBoost、MXNet、TVM 和 MLC LLM。

- 陈天奇的回顾包括他在 OctoML 的工作,以及他在 CMU 和 UW 的学术贡献。

- 新秀 CowabungaAI 从 LeapfrogAI 分离:一个名为 CowabungaAI 的 LeapfrogAI 开源分支发布;它是由 Unicorn Defense 开发的军用级 AI 平台即服务 (PaaS)。

- 它具有与 OpenAI 类似的功能,包括聊天、图像生成和 OpenAI 兼容的 API,可在 GitHub 上获取。

HuggingFace Discord

- Hugging-Science Discord 频道上线:一个新的

hugging-scienceDiscord 频道已上线,专注于聚变、物理和评估方面的开源工作,访问地址在这里。- 该频道正在为项目招募团队负责人,提供引导激动人心计划的领导机会。

- 扩散 ODE 求解器步数降至 8 步:一位独立研究员展示了一种用于扩散模型的 ODE 求解器,实现了 8 步推理,优于 DPM++2m 的 20 步,且 5 步推理即可与最新的蒸馏方法相媲美;参见 Zenodo 上的论文和 GitHub 上的代码。

- 这种无需训练的改进在推理过程中通过更好地追踪概率流轨迹,在提高质量的同时降低了约 60% 的计算成本。

- Golang 向量数据库问世:一位成员创建了 serverlessVector,这是一个纯 Golang 编写的向量数据库,并提供了 GitHub 仓库链接。

- 它使用 Go 编写,可立即进行测试和实施。

- HF 推理提供商面临质量投诉:成员们对 HF Inference 提供商的质量表示担忧,想知道 HF 如何保证推理端点的质量,特别是关于量化(quantization)方面。

- 他们补充说,他们认为端点默认应该是 zdr。

Latent Space Discord

- DeepSeek 模型 Terminus 登场!:DeepSeek 发布了最后的 v3.1 迭代版本 Terminus,提升了语言一致性以及 code/search agent 能力;开放权重已在 Hugging Face 上线。

- 社区立即询问了关于 DeepSeek-R2 的消息,暗示了未来的发展动向。

- Untapped Capital 推出第二期基金:Yohei Nakajima 宣布了 Untapped Capital Fund II,这是一个 25 万美元的 pre-seed 基金工具,继续其支持传统社交网络之外的创始人的使命。

- 团队已转向自上而下的方法,基于早期趋势识别主动寻找初创公司。

- 阿里巴巴 Qwen3-TTS 首次亮相!:阿里巴巴通义实验室推出了 Qwen3-TTS,这是一款具备多种音色和语言支持的文本转语音模型,针对英文和中文进行了优化;参见 ModelStudio 文档。

- 用户咨询集中在开源可用性和 API 定价上,尽管官方团队尚未回应开源计划。

- OpenAI 与 NVIDIA 达成 1000 亿美元 GPU 巨额交易!:OpenAI 与 NVIDIA 达成合作伙伴关系,计划从 2026 年底开始为 OpenAI 的下一代数据中心部署高达 10 吉瓦(数百万个 GPU)的 NVIDIA 系统,价值约 1000 亿美元。

- 反应从庆祝股价上涨到讨论供应商融资、AGI 预期以及对终端用户的潜在影响不等。

- Among AIs 基准测试评估社交智能:Shrey Kothari 介绍了 Among AIs,这是一个评估语言模型在《Among Us》游戏中的欺骗、说服和协作能力的基准测试;GPT-5 作为“冒充者(Impostor)”和“船员(Crewmate)”表现出色。

- 讨论包括缺失的模型(即将加入 Grok 4 和 Gemini 2.5 Pro)、游戏选择、数据担忧、讨论规则(3 轮辩论)以及对基于游戏的 AI 评估的热情。

Eleuther Discord

- Text-davinci-003 与 ChatGPT 同日首次亮相:Text-davinci-003 与 ChatGPT 同日发布,OpenAI 迅速将其标记为 GPT-3.5 模型。

- 一位内部人士澄清,更新后的 Codex 模型 code-davinci-002 也是 GPT 3.5 系列的一部分,并在 ChatGPT 发布前一天发布。

- 扩散模型 ODE 求解器取得突破:一位独立研究员为扩散模型开发了一种新型 ODE 求解器,其 8 步推理在 FID 分数上超过了 DPM++2m 的 20 步推理,同时降低了约 60% 的计算成本。

- 该求解器通过更好地追踪概率流轨迹来增强推理,详见 WACV 2025 论文,代码可在 GitHub 获取。

- GPT-3.5 家族谱系:成员们正在讨论 ChatGPT 以及其他 GPT-3.5 模型(如 code-davinci-002、text-davinci-002 和 text-davinci-003)的起源。

- 一位内部人士暗示 ChatGPT 是基于一个经过思维链微调(chain-finetuned)且未发布的模型进行微调的。

- MMLU 子任务基准测试:社区考虑使用 lm-eval 对 MMLU pro 子任务进行基准测试的可能性,重点关注 mmlu_law 等子集。

- 探索这一功能可以实现在 lm-eval 框架内对 AI 模型技能进行更详细、更精确的评估。

Nous Research AI Discord

- HuggingFace 评论引发笑声:成员们发现 HuggingFace 上的评论非常幽默,其中一人表示 yeh i was lmaoing when i saw that(看到那个时我笑翻了)。

- 虽然没有详细说明这些评论的具体内容,但这表明社区对该平台上的内容有着积极且投入的反应。

- OLMo-3 Safetensors 搜索升温:一位成员正积极寻找 OLMo-3 safetensors 的线索,并加入了一个 Discord 频道以跟踪进度。

- 尽管推理代码已经可用,但他们强调 no weights on HF yet(HuggingFace 上还没有权重),这表明该模型尚未完全开放使用。

- Qwen3 Omni 发布,具备强大的多模态能力:Qwen3 Omni-30B-A3B-Instruct 现已上线,拥有 36B 参数和多模态能力。

- 据报道,它在诈骗电话音频处理方面 beats Whisper v2/3 and Voxtral 3B,支持 17 种音频输入语言和 10 种输出语言。

- 实时感知 AI 竞赛拉开帷幕:社区预见到 realtime perceptual AI(同时处理音频、视频和其他模态)的兴起。

- Apple 的实时视觉模型被视为这一发展的潜在风向标,引发了人们对缺乏公开版本的关注。

- 在 RTX 4090 上可实现 LoRA 训练:有成员提到,使用单块 RTX 4090 在本地对 14B 模型进行 LoRA 训练是可行的。

- 一位成员正在进行类似的工作,他们面临的限制主要是 bandwidth(带宽)和 latency(延迟)。

aider (Paul Gauthier) Discord

- Aider 分叉版本通过 Navigator 模式进行导航:成员建议使用带有 navigator mode 的 aider forks,通过在分叉仓库上执行 uv pip install 或使用 aider-ce 软件包来获得自动化体验。

- 该软件包集成了 MCP 和 navigator mode,以简化编码流程。

- Augment CLI 在代码库增强方面表现出色:Augment CLI 工具在处理大型代码库时表现优异,特别是配合使用 Claude Code (CC) 与 Opus/Sonnet 以及用于 GPT-5 的 Codex。

- 用户提到 Codex 没有 API key,而 Perplexity MCP 与 MCP integration 配合良好。

- 寻求 Deepseek V3.1 配置指导:一位用户请求关于 Deepseek V3.1 初始设置和配置的建议,以及首选的 web search tools。

- 由于 aider 没有内置工具,一位成员建议使用 Perplexity MCP for web search 与其配合使用。

- 通过命令行运行多个 Aider Agent:成员们讨论了通过命令行设置 multiple aider agents 进行外部编排,而不是使用内置解决方案。

- 建议使用 git worktrees 对同一仓库进行并发修改,从而实现同时运行多个 Agent。

- LLM 在编辑 Prompt 文件时迷失方向:当使用文件设置 Prompt 时,aider 提示编辑文件,与此同时,LLM 对当前任务感到困惑。

- LLM 随后会要求澄清意图,具体是它应该作为 APM 框架中的“User”行动,还是使用 SEARCH/REPLACE 块格式修改文件。

Modular (Mojo 🔥) Discord

- Rust 开发者通过 FFI 调用 Mojo:成员们一直在探索使用 FFI 从 Rust 调用 Mojo,这类似于通过 C ABI 调用 C。

- 为了确保正确的类型处理,Mojo 函数必须标记为

@export(ABI="C")。

- 为了确保正确的类型处理,Mojo 函数必须标记为

- 手动 Mojo 绑定仍是唯一选择:C header -> Mojo 绑定生成器 的开发仍在进行中 (WIP),因此目前无法使用 CXX 辅助。

- 目前,生成 Mojo 绑定必须采用手动方法。

- Windows 支持仍然缺失:用户提出了关于 Mojo 的 Windows 支持 问题。

- 回复指出,该支持不会在短期内推出。

- Modular 25.6 极大地提升了 GPU 性能:Modular 平台 25.6 已上线,在包括 NVIDIA Blackwell (B200) 和 AMD MI355X 在内的最新 GPU 上实现了峰值性能,更多信息请查看 博客文章。

- 早期结果显示,MI355X 上的 MAX 性能甚至可以超过 Blackwell 上的 vLLM,目前已为 Apple Silicon、AMD 和 NVIDIA 等消费级 GPU 提供统一的 GPU 编程支持。

- MAX 需要 .mojopkg:要使用 MAX,可执行文件旁边需要一个

.mojopkg文件,其中包含 Mojo 在解析后为运行时的 JIT 编译器生成的最高层级 MLIR。- 对于隐藏硬件细节的平台(Apple、NVIDIA GPU),Mojo 将编译交给驱动程序,执行单次 JIT (one-shot JIT) 而不进行分析(profiling),这与 V8 或 Java 不同。

Yannick Kilcher Discord

- JEPA 聊天即将开始:关于 Yann LeCun 的联合嵌入预测架构 (Joint Embedding Predictive Architecture, JEPA) 论文 (https://www.arxiv.org/abs/2509.14252) 的讨论定于 <t:1758567600:t> 举行。

- 一名成员链接了一份关于 JEPA 的 OpenReview 文档,以及 一段 YouTube 视频 和两篇 X (原 Twitter) 帖子 与 https://fxtwitter.com/randall_balestr/status/1969987315750584617。

- GPT 变得富有哲理,但得分较低:一位用户给 GPT 模型 解析其哲学思想打了 7/10 分,但在扩展内容方面仅打出 4/10 分,格式方面打出 3/10 分,认为其不够好。

- 该用户表示在进一步互动后结果有所改善,这表明要么是 prompting skills 有所提高,要么是机器阅读能力增强了。

- 演讲者寻求最佳论文展示时间:一名成员询问了展示论文的最佳时间,建议为东部时区的参与者安排较早的时段。

- 该成员建议在大多数日子里提前或推迟 6 小时进行展示。

DSPy Discord

- 环境变量优于 MCP 密钥:一名成员警告不要通过 MCP 传递密钥,建议单用户服务使用环境变量,更复杂的设置则使用 login+vault/OAuth。

- 他们的 JIRA MCP server 实现使用 stdio 并从环境中获取凭据,按单用户部署以避免通过进程表泄露密钥。

- DSPy 优化受 Trace ID 抖动困扰:一位用户指出,使用 trace ID 初始化模块会导致在优化后运行批处理时,所有文档都使用相同的 ID,并询问如何在不破坏优化的前提下处理 DSPy 模块 中的逐项 trace ID。

- 他们考虑过为每篇文章重新创建模块(成本太高)以及将 trace ID 移至 forward 调用中,但质疑这是否会影响优化,因为 trace_id 会被传递给 LLM 网关用于日志记录和审计。

- GEPA 对 ReAct 上下文溢出保持沉默:一位用户询问了使用 GEPA 构建 ReAct Agent 的经验,重点关注在长 Agent 轨迹下如何处理上下文溢出 (context overflows)。

- 遗憾的是,没有人分享相关经验。

MCP Contributors (Official) Discord

- Response Schema 获得支持:关于 将 response_schema 添加到 MCP Sampling Protocol 的议题已转为讨论,有成员愿意在 10 月实现演示,从而在使用 sampling 时支持 structured output,详见 此议题。

- 共识是在 SDK 中实现这一点并不复杂,主要工作在于 SDK 与 LLM API 之间的集成,可能需要针对特定 provider 的代码。

- 探讨 Claude 的 Constrained Output 能力:小组讨论了将 constrained output 作为 client capability 展示的问题,目前的问题是 Claude models 被错误地识别为不支持此功能。

- 更好的方法是展示 response_schema 支持,允许 client host 决定具体实现。

- MCP Registry 发布流程:已分享将 server 发布到 Model Context Protocol (MCP) Registry 的说明,从 此指南 开始。

- 指南包括创建空的 GitHub 仓库和

server.json文件的步骤,该文件需指定名称、描述、状态、仓库 URL 和远程 endpoint。

- 指南包括创建空的 GitHub 仓库和

- 远程 Server 配置公开:已链接 Model Context Protocol (MCP) 的远程 server 配置,参考 此文档。

- 提供的

server.json示例定义了$schema并包含一个remotes数组,指定了streamable-http类型和 URL。

- 提供的

- MCP 安装指令自动生成:一名成员提到使用工具生成 readme 文件,其中包含在各种 client 中安装 Model Context Protocol (MCP) 的说明,详见 MCP Install Instructions。

- 据报道,该工具“非常酷”,对创建安装指南很有帮助。

tinygrad (George Hotz) Discord

- 周一的 Colfax 会议:圣地亚哥时间周一上午 9 点将举行 第 89 次会议,进行 公司更新。

- 从下周开始,会议将 提前 3 小时。

- RANGEIFY 进度受关注:成员们询问 RANGEIFY 是否会在本周末成为默认设置,包括 store、assign, group reduce, disk, jit, const folding, buf limit, llm 和 openpilot。

- 有人指出 children 没有进展,且 image 尚未完成。

- CuTe DSL 可能是游戏规则改变者:成员们提到 CuTe DSL 是一个 潜在的游戏规则改变者。

- 他们补充说 ThunderKittens 的 起步不错。

Moonshot AI (Kimi K-2) Discord

- Kimi 拒绝挑衅尝试:一位成员分享了 挑衅 Kimi 的经历,赞赏它拒绝盲目服从或同情。

- 另一位成员表达了类似的看法,指出 Kimi 的态度 是它成为他们最喜欢的模型的原因。

- Claude 遭受 Prompt Injection 困扰:成员们讨论了 Claude 如何因 prompt injection 技术 而被削弱,导致其在 context 超过一定长度时产生分歧。

- 他们指出这与 Kimi K2 不同,一些人对 Claude 的变化表示失望。

Manus.im Discord Discord

- GenAI E-Book Reader 开启极速模式:最新发布的 GenAI E-Book Reader 引入了生成式智能(Generative Intelligence)功能,用于增强文本澄清、摘要和词典功能。

- 新版本集成了 OpenRouter.ia,让用户可以访问超过 500 个大语言模型,如此视频所示。

- OpenRouter.ia 接入 GenAI E-Book Reader:GenAI E-Book Reader 现在支持 OpenRouter.ia,为用户提供超过 500 个大语言模型 的访问权限,以增强阅读辅助体验。

- 用户现在可以利用各种模型进行文本澄清、摘要和高级词典功能。

LLM Agents (Berkeley MOOC) Discord 没有新消息。如果该服务器沉寂时间过长,请告知我们,我们将将其移除。

MLOps @Chipro Discord 没有新消息。如果该服务器沉寂时间过长,请告知我们,我们将将其移除。

Windsurf Discord 没有新消息。如果该服务器沉寂时间过长,请告知我们,我们将将其移除。

您收到此邮件是因为您通过我们的网站选择了订阅。

想要更改接收此类邮件的方式? 您可以从该列表中 取消订阅。

Discord: 频道详细摘要与链接

Perplexity AI ▷ #general (1175 messages🔥🔥🔥):

Comet Browser 邀请, GPTs Agents 训练, OpenAI Platform 侧边栏, Comet 对 ipadOS 的支持, AI 寒冬

- Comet Browser 邀请函正在发放:一名成员分享了 Perplexity 的 Comet Browser 邀请链接 供他人试用。

- 另一位成员确认 Comet 同样支持 Windows,而不仅仅是 Mac:只需在 Windows 机器上打开它即可。

- Comet 每日限制已达上限,可升级:一位用户报告收到持久通知,显示 Comet 个人搜索每日限制已达上限。

- 一名成员建议升级到 Max subscription 以获得更高的使用限制。

- 在某种程度上,Perplexity 比 ChatGPT 更适合研究:一位用户提到 ChatGPT 以产生幻觉(生成虚假信息)而闻名,而 Perplexity 更适合研究用途。

- 另一名成员表示:Perplexity 在某种程度上适合研究,但我听说 ChatGPT 会产生幻觉。

- 专家称 GPT-5 发布在即:多位用户对即将推出的 GPT-5 等模型表示兴奋,有人表示正在为第三次 AI 寒冬做准备,而其他人则对此不以为然。

- 一名成员表示,他们高度怀疑 GPT-4 模型是否比最新一代更聪明,其他人则表达了期待:有了它,我们将理解宇宙本身。

- Perplexity Pro 用户感到被冷落:一位用户分享了一个 推文链接,抱怨 Perplexity Pro 用户在功能方面落后于 Max 订阅者。

- 另一人回应称,他们是在为一些可能在未来四个月内都无法正常工作的琐事而纠结。

Perplexity AI ▷ #sharing (5 messages):

Comet 邀请, 可分享线程, 可靠数据, 邀请请求

- Comet 邀请发放:一名成员分享了 Comet 邀请链接 供他人试用 Comet。

- 鼓励分享线程:一名成员提醒他人确保其线程设置为“可分享”,并链接到了特定的 Discord 频道消息。

- 对可靠数据的质疑:分享了一个关于可靠数据的 Perplexity AI 搜索链接。

- 邀请请求:另一名成员请求邀请,并提供了另一个邀请链接以及 Chris Biju 的个人资料链接。

Unsloth AI (Daniel Han) ▷ #general (374 messages🔥🔥):

1M 上下文长度的 VRAM 使用量,GPT-OSS-20B 的 GRPO 微调,DeepSeek V3.1 Terminus 与 Huawei Ascent Chips,Qwen3 与数据隐私担忧,QAT 与 GGUF 量化

- 大幅提升长上下文窗口的 VRAM 需求:一位用户计算出 1M 上下文长度的模型需要 600GB VRAM,而另一位用户质疑 VRAM 计算器 在满足其公司 16 个并发用户和 Qwen 3 30B 模型需求时的准确性。

- 有人指出,30B 模型在超过 100k 上下文长度后性能会显著下降,且在初始上下文扩展后,在较短上下文中进行训练已足够。

- GRPO 即将盛大揭晓?:成员们讨论了即将发布的 GPT-OSS-20B 的 GRPO 微调,以及它在 GSM8k 等简单数据集上增加上下文长度的局限性。

- 建议在为特定编程任务训练模型时,至少使用 100 个示例进行有意义的测试,使用超过 1000 个以获得最佳效果。

- DeepSeek 与华为的深度探索?:一位用户提到 DeepSeek 可能因为使用 Huawei Ascent Chips 而遇到问题。

- DeepSeek 发布了 DeepSeek-V3.1-Terminus,这是一个带有错误修复的小版本迭代,但在不使用工具的情况下推理能力有所下降,而在 Agent 工具使用方面有轻微改进。

- Qwen3 悄然引起质疑的配额?:在使用 OpenAI 或 Gemini 付费 API 的背景下提出了数据隐私话题,共识是用户应假设其数据正被用于训练,无论其声明的政策如何。

- 一位成员分享了一个法院命令的链接,该命令要求 OpenAI 保留所有 ChatGPT 日志,包括已删除的临时聊天和 API 请求。

- 量化的量子探索:QAT vs MXFP4:成员们讨论了各种量化技术,包括 QAT (Quantization Aware Training) 及其由 Google 和 OpenAI 实现的成功案例。

- 还提到了 Apple 的 super-weight 研究 以及对 NVFP4 和 MXFP4 的实验,其中 NVFP4 表现出轻微的性能领先。此外还讨论了 Unsloth 的 DeepSeek R1 博客文章。

Unsloth AI (Daniel Han) ▷ #introduce-yourself (1 messages):

合作机会,软件工程,小企业创业

- 合作:新业务正在酝酿:一位软件工程师兼小企业主开启了潜在合作的大门。

- 这可能会在社区内带来新项目、新风险投资或合作伙伴关系。

- 软件工程协作:一位软件工程师正在寻求合作机会,暗示有项目需要技术专长。

- 这可能涉及软件开发、系统设计或技术咨询。

Unsloth AI (Daniel Han) ▷ #off-topic (41 messages🔥):

Loss Curve 成功, 新 iPhone 购置, 计算机科学大学 vs 训练营, 抽卡游戏概率, DataSeek 工具

- 模型训练产出良好的 Loss Curve:一位成员庆祝他们在模型训练实验中获得了令人满意的 Loss Curve(附图)。

- 他们澄清这并非 LLM,而是一个学习训练更多类型模型的实验,动力源自咖啡和 Noccos(每罐含 180mg 咖啡因)。

- iPhone 升级引发床单争论:一位成员展示了新买的 iPhone(附图)。

- 有回复开玩笑建议卖掉手机并推迟更换床单,而另一位成员则表示:每次看到这种照片,我都对自己生活现状的感觉更好了,哈哈。

- 计算机科学大学对比训练营受到质疑:一位成员表示,读计算机科学大学甚至不如不读,而这些训练营(Bootcamps)是不带讽刺意义的更好选择(灌输更少过时的东西,更快且更便宜)。

- 抽卡游戏概率公式泄露:一位成员泄露了一个 Gacha 开发者用来确定新角色的宏(附图)。

- 这个泄露的代码笑话显示:

if (banner_needs_money) -> add curvy adult woman,其他条件以此类推。

- 这个泄露的代码笑话显示:

- 用于 Agent 采样的 DataSeek:一位成员分享了 DataSeek,这是他们创建的一个用于通过 Agent 收集样本的工具。

- 他们使用该工具为自己的 claimify 相关项目收集了 1000 个样本。

Unsloth AI (Daniel Han) ▷ #help (23 messages🔥):

OOM 错误与 USDT, Blackwell CUDA 问题, Orpheus TTS 微调

- **无功不受禄?用户悬赏 USDT 修复 OOM:一位用户在查阅教程后,愿意支付 50 USDT 寻求帮助以解决 Out-of-Memory (OOM) 问题。

- 另一位用户也表达了同样的意愿,表明社区内可能存在付费支持的需求。

- **Blackwell 的忧郁:在新架构上调试 CUDA:一位用户使用 CUDA 12.8/12.9 和 ARCH 120 重新构建了环境以支持其 Blackwell 显卡,但仍面临问题,特别是在 Tensor Parallelism (TP) 方面。

- 他们发现 Offloading 到 CPU 或仅使用 1 张 GPU 可以运行,但怀疑可能存在与为 vLLM 禁用 amd_iommu 相关的冲突,导致了奇怪的 CUDA 错误。

- **Orpheus 报错:TTS 微调中的 Batch Size 不匹配:一位用户在使用提供的 Notebook 切换到自己的数据集微调 Orpheus TTS 时遇到了

TorchRuntimeError,错误提示 input batch_size 不匹配。- 经确认,该用户的数据集包含变长样本,通过增加 max_seq_length(或移除较长样本)的建议修复了该问题,正如 TRL 文档中所述。

Unsloth AI (Daniel Han) ▷ #showcase (1 messages):

LLM, 微调, 特定任务模型

- 为任务量身定制的 LLM:未来将涉及针对特定任务、甚至针对单个项目进行微调的 LLM。

- 这种方法优化了专业应用中的性能和相关性,确保模型是为特定目的构建的。

- 定制化模型的黎明:用户认为 LLM 将变得高度专业化,针对精确的任务和项目进行磨练。

- 这种演变预示着在不同领域中的效率、准确性和适应性。

Unsloth AI (Daniel Han) ▷ #research (13 messages🔥):

Diffusion vs Autoregressive, Data Repeating, Paper Citation, Peer Review

- Diffusion 优于 Autoregressive 方法:一篇 博客文章 指出,在数据受限的情况下,diffusion 模型 的表现优于 autoregressive 模型。

- 另一篇 引用的论文 表明,将数据重复 4x 并在每个 epoch 后进行 shuffling,其效果与使用唯一的训练数据相似。

- 数据重复与打乱的效果:重复相同数据 4x 并在每个 epoch 后进行 shuffling,可以产生与使用同等数量唯一训练数据类似的结果 (arxiv 链接)。

- 这表明 epoch 之间的 shuffling 是有益的,并引发了将此技术应用于 MLPs 的思考。

- 缺失引用引发争议:一名成员指出,这篇论文 似乎是 CMU 博客内容的重复,只是图表更精美,但 CMU 的博客文章并未引用该 arXiv 论文。

- 回复称,后来的论文更好地泛化了该方法,但理应被引用。

- 同行评审员拯救局面:一名成员询问不引用相关工作的严重性,得到的回复是:通常情况下,这是同行评审员(peer reviewer)的工作。

- 进一步指出,arXiv 上的论文通常未经评审且会持续更新,留有修正空间。

LMArena ▷ #general (446 messages🔥🔥🔥):

Video generation from photos in Indonesian, Grok 4 Fast performance, Seedream 4 2k vs High-Res, AI in medical field, Gemini 3.0 Flash rumors

- 分享印尼语视频生成提示词 (Prompt):一名成员分享了一个用于从照片生成视频的 印尼语 提示词,详细说明了 场景、动作、风格化、音频和时长 等规范,要求 2.5D 混合动画 风格,背景以 蓝色和白色为主,带有霓虹红,并配有 150 BPM 的重摇滚音乐。

- 提供的翻译:从照片生成视频 [上传照片]。

- Grok 4 Fast 以极具竞争力的价格令人惊喜:讨论围绕 Grok 4 Fast 相对于 Gemini Flash 的性能展开,一位成员表示 Grok 4 Fast 明显更好且更便宜。

- 进一步指出,Grok 4 Fast 的定价正促使其他厂商提供更具竞争力的价格。

- Seedream 4 2k 图像参考问题浮现:用户报告称,在使用多个参考图时,Seedream 4 2k 无法保持角色种族的一致性,不过 Seedream 4 2k 在生成速度和效果平衡方面表现较好。

- 一位用户表示:它在处理多个参考图像时完全错误,几乎每次都是,有时甚至在单图参考时也会给出错误的输出。

- 关于医疗领域和药物研发中 AI 模型的辩论:讨论涵盖了 AI 模型在医疗保健领域的潜力,并对它们识别致命药物组合的能力表示担忧。

- 一位具有药物研发经验的成员表示:使用真实数据微调后的模型表现良好。

- 风声渐起:Gemini 3.0 Flash 传闻四起:在一系列 Gemini 集成动作中,关于可能发布 Gemini 3.0 Flash 的猜测愈演愈烈,该版本可能集成视频功能,并可能部署在大型家庭助手设备中。

- 成员们好奇为什么 Google 本周一直在到处部署 Gemini。

LMArena ▷ #announcements (1 messages):

Seedream-4, LMArena Models

- Seedream-4-2k 加入 LMArena 对战:模型

seedream-4-2k现已在 LMArena 的 Battle、Direct 和 Side by Side 模式中上线。seedream-4-high-res模型目前尚未上线。

- High-Res 版本仍未上线:模型

seedream-4-high-res目前无法使用,更新信息将在频道内公布。- 鼓励用户关注公告频道以获取更多详情。

Cursor Community ▷ #general (419 messages🔥🔥🔥):

Token Usage, Kaspersky Malware Flag, Chat Exports, GPT-5 Pricing

- Cursor Token 使用情况令用户困惑:一位用户注意到新 Cursor 账号的 token usage 异常高,在 22 个 prompt 中消耗了 146k tokens,并向社区寻求解释。

- 成员们解释说,旧的 chat 日志和附件文件会增加 context 和 token 消耗,并提供了 Cursor 关于 context 的新学习页面链接。

- Kaspersky 将 Cursor 标记为恶意软件:一位用户报告 Kaspersky 将 Cursor 标记为恶意软件,引发了关于误报 (false positives) 以及可能原因(如 Cursor 修改右键菜单)的讨论。

- 一位社区成员建议仔细检查文件,而 Cursor 支持团队请求获取日志进行调查,并向用户保证这只是与潜在不受欢迎程序 (PUA) 检测相关的通用警告。

- SpecStory 实现 Chat 导出自动化:用户讨论了 chat 随机损坏以及取消更改后缺少重新应用 (reapply) 功能的问题,随后分享了 SpecStory 作为解决方案,该工具可以自动将 chat 导出为文件。

- 一位用户表示他们不会将 chat 提交给第三方,因此使用的是该工具的本地版本。

- GPT-5 定价低于 Claude Sonnet:社区对比了 Claude Code 和 Codex CLI 的限制,并暗示由于 GPT-5 比 Claude Sonnet 4 更便宜,它将提供更高的额度限制。

- 有人指出 GPT-Mini 是免费的,但一位用户澄清他们指的是 Codex。

GPU MODE ▷ #general (13 messages🔥):

vLLM affiliation, Image/Video Gen in vLLM, Sliding/Striding Multi-Node DiT Kernel, GB300s for High Compute Scale, Magnetohydrodynamics and Loop Quantum Gravity Modeling

- vLLM 中的图像/视频生成:契合吗?:一位成员询问在 vLLM 的目标中加入图像或视频生成功能的潜在匹配度,并考虑联系其 Slack 上的多模态特性团队。

- 滑动/步进多节点 DiT Kernel 进展:成员们讨论了滑动/步进 Kernel,引用了 xDiT 风格的多节点并行方法,以及 thunderkittens 团队针对 Hopper 和 cutlass 团队针对 Big Blackwell 的实现。

- 一位成员正尝试为 GB300 开发一种快速、早期的滑动/步进多节点 DiT kernel,以应对数学/物理研究所需的高算力规模。

- GB300 助力量子引力研究:一位成员旨在利用大量的 GB300 来促进高算力规模的 diffusion 应用,用于磁流体力学 (magnetohydrodynamics) 和圈量子引力 (loop quantum gravity) 建模。

- 该成员预测磁流体力学模型很可能会成功,同时指出圈量子引力方法具有高度实验性。

GPU MODE ▷ #triton (1 messages):

exquisite_lemur_80905: 还有 TRITON_ALWAYS_COMPILE 可以用来忽略缓存。

GPU MODE ▷ #cuda (1 messages):

MLPerf Inference, CPU Bottleneck, GPU Utilization

- MLPerf 推理受限于 CPU 瓶颈:一位成员报告了在本地运行 MLPerf inference 时的问题,尽管 VRAM 占用充足,但进程似乎受到了 CPU 的限制。

- 用户注意到 GPU utilization 较低,并寻求解决此性能问题的帮助。

- MLPerf 在本地计算上表现吃力:MLPerf 是一套衡量机器学习硬件和软件性能的基准测试套件。

- 由于资源限制,在本地运行 MLPerf 可能会具有挑战性。

GPU MODE ▷ #torch (2 messages):

Speeding up pip install, Setting TORCH_LOGS

- 加速 Setup 编译:一位成员询问如何加快 setup 编译,注意到

!pip install -v pytorch-fast-transformers似乎没有使用多 CPU/并行任务来编译文件。- 遗憾的是目前没有收到回复,这仍然是一个开放性问题。

- Torch Logs 配置技巧:一位成员询问了设置 torch logs 输出的正确方式,并提供了一个示例

%env TORCH_LOGS = '__main__,+dynamo,graph,fusion,output_code'。- 该问题尚未得到回复。

GPU MODE ▷ #cool-links (1 条消息):

Tianqi Chen Interview, Machine Learning Systems, XGBoost, MXNet, TVM

- Tianqi 关于 ML Systems 的访谈:一段与 Tianqi Chen 的访谈,讨论了 Machine Learning Systems、XGBoost、MXNet、TVM、MLC LLM、OctoML、CMU、UW 和 ACM。

- 访谈还涉及了机器学习领域的“长期主义” (long-termism) 和“初心” (original intentions) 等话题。

- OctoML 创始人受访:最近的一篇访谈介绍了 OctoML 的创始人 Tianqi Chen,讨论了他的心路历程以及对 Machine Learning Systems 的见解。

- Chen 回顾了他在 XGBoost、MXNet、TVM 和 MLC LLM 方面的工作,以及他在 CMU 和 UW 的学术追求。

GPU MODE ▷ #jobs (1 条消息):

Remote Research Intern, Deep Learning, New Models, Model Building, Stipend Information

- Deep Learning 远程研究实习机会:一位成员正在寻找 远程研究实习生 来参与复杂的 Deep Learning 项目,提供每月 30-40k INR 的津贴。

- 项目重点在于构建 新模型,而不是使用现有模型进行产品工程。

- 强调模型开发:该实习强调 新 Deep Learning 模型 的开发,表明这是一个研究导向的角色。

- 欢迎感兴趣的候选人私信发送简历、GitHub 个人主页或任何展示其技能的相关项目。

GPU MODE ▷ #beginner (1 条消息):

nwyin: https://jax-ml.github.io/scaling-book/roofline/

GPU MODE ▷ #off-topic (6 条消息):

NVIDIA Tech Demos, Tailscale Interface & Pricing, VPN Business Models

- NVIDIA 演示的大幅进化:一位成员分享了一个 YouTube 视频,展示了 NVIDIA 技术演示 从 1998 年到 2025 年的演变。

- 该视频可能突出了多年来图形技术和实时渲染能力的进步。

- Tailscale 界面令用户反感:一些成员对 Tailscale 表示保留意见,指出虽然它很好用,但他们不喜欢界面由公司托管。

- 一位成员评论道:“几乎所有的 VPN 都有寻租式定价 (rent seeking pricing)”。

- VPN 商业模式令旁观者困惑:一位成员表示:“我搞不清楚他们是怎么赚钱的,无论是寻租式的还是非寻租式的?我想我不理解他们的任何业务”。

- 讨论围绕着理解寻租式和非寻租式 VPN 提供商商业模式的挑战展开。

GPU MODE ▷ #self-promotion (1 条消息):

CowabugaAI, LeapfrogAI, Open Source AI, Military-Grade AI, Commercial AI Support

- CowabungaAI 从 LeapfrogAI 分离:宣布了 LeapfrogAI 的一个开源分支,命名为 CowabungaAI;它是由 Unicorn Defense 创建的 军用级 AI 平台即服务 (PaaS),提供与 OpenAI 类似的功能,包括聊天、图像生成和 OpenAI 兼容的 API,可在 GitHub 上获取。

- 为 CowabungaAI 提供商业支持:CowabungaAI 的创建者宣布对源代码进行了重大改进,并打算为该应用提供商业支持。

- 他们正在为许可机会提供大幅折扣。

GPU MODE ▷ #🍿 (2 条消息):

vLLM's guided decoding, grammars for automated code generation, kernel generation LLMs, KernelBench 0-shot evals

- vLLM 的语法引导:一位成员询问 自动代码生成 或 内核生成 LLM 通常使用什么语法,并提到了 vLLM 的引导式解码支持(使用形式语法约束 Logits)。

- KernelBench 跳过语法约束:他们指出 KernelBench 论文 进行了 0-shot 评估,似乎没有进行任何约束解码。

- 这是隐含的,因为他们检查了编译器问题,而这些问题大部分可以通过语法约束来解决。

GPU MODE ▷ #thunderkittens (2 messages):

GPU memory sharing, NVSwitch reduction

- GPU 内存共享信息极具价值:一位成员发现这个关于跨 GPU 共享内存地址的解释非常有价值。

- 他们指出,讨论共享内存和使用 NVSwitch 进行 reduction 的公开资源很少。

- NVSwitch 赋能 GPU 通信:讨论强调了 NVSwitch 在促进 GPU 之间高效通信和内存共享方面的重要性。

- 这对于大规模 AI 模型训练和推理尤为重要,因为在这些场景中,最小化数据传输开销至关重要。

GPU MODE ▷ #edge (1 messages):

radiation-hardened chips, Jetson usage in space, chips in the magnetosphere

- 太空中的现代芯片:一位成员对现代芯片针对太空应用进行抗辐射加固(radiation-hardened)表示惊讶。

- 他们询问这是否归功于 Jetson 的能力、与地球及磁层(magnetosphere)的距离,还是其他原因。

- 抗辐射 Jetson?:讨论集中在太空环境中使用 Jetson 芯片的可能性及其影响,在太空环境中抗辐射至关重要。

- 讨论中提出了关于抗辐射能力是芯片设计固有的、受磁层内近地轨道影响的,还是通过其他手段实现的疑问。

GPU MODE ▷ #submissions (13 messages🔥):

MI300x8, amd-all2all leaderboard, amd-gemm-rs leaderboard, Personal Bests

- MI300x8 刷新个人最佳成绩:成员们在

amd-all2all和amd-gemm-rs排行榜上使用 MI300x8 刷新了个人最佳成绩(personal bests)。 - amd-all2all 竞争激烈:一位成员使用 MI300x8 在

amd-all2all排行榜上跑出了 2.45 ms 的个人最佳成绩。- 另一位成员以 1171 µs 的成绩获得第 5 名。

- amd-gemm-rs 排行榜升温:一位成员在

amd-gemm-rs排行榜上使用 MI300x8 多次刷新个人最佳成绩,最终达到 557 µs。- 其他成员也提交了在 587 µs - 638 µs 范围内的成功运行记录。

GPU MODE ▷ #factorio-learning-env (8 messages🔥):

Sweep for Qwen 2 35b, Deepseek 3.1, GPT-oss progress, Release work

- 本周末对 Qwen 和 DeepSeek 进行 Sweep!:一位成员在周末为 Qwen 2 35b 和 Deepseek 3.1 运行了 sweep。

- GPT-oss 的进展仍在继续,目前还没有新的视频可以分享。

- 发布工作让部分成员忙碌:一些成员表示今天没有太多可报告的内容,因为他们正忙于完成一个 release。

- 如果需要,他们愿意在今天晚些时候或周三的会议上讨论与发布相关的事宜。

GPU MODE ▷ #amd-competition (7 messages):

AMD Contractor Prize Eligibility, All2All Optimizations

- AMD 承包商的奖金困境:一位 AMD 承包商在比赛中名列前茅,但没有资格获得奖金。

- 尽管如此,他们还是被邀请去旧金山并见到了团队,这比奖金更有价值。

- 优化的可接受性受到质疑:一位成员询问针对 all2all 的某些优化是否在可接受的参数范围内。

- 他们澄清说,完全不向其他 rank 发送 token 是不可接受的,并寻求对其他方面的确认;另一位用户允许他们进行私信(DM)。

GPU MODE ▷ #cutlass (7 messages):

CUTLASS MLP Accuracy, CuTe Layouts

- CUTLASS 的 MLP 精度与 PyTorch 的差异:一位成员报告称,通过使用 CUTLASS 实现两层 MLP,获得了 7x 的加速,且与 PyTorch 相比达到了约 atol 1e-3 的精度。

- 另一位成员评论道,考虑到归约顺序(reduction orders)的差异,这种级别的误差即使对于 fp16 也是可以接受的,特别是与串行 CPU 参考实现相比时,并指出 GPU 的结果在数值上通常更准确。

- Colfax 发布 CuTe Layouts 博客文章:一位成员分享了来自 Colfax 关于 CuTe Layouts 的博客文章、论文和示例仓库。

- 另一位成员强调了该工作能够以视觉上的简洁性“手动”计算复杂的布局代数结果,并将其称为论文第 4 章中详述的“布局图的图形微积分(graphical calculus of layout diagrams)”。

GPU MODE ▷ #singularity-systems (2 messages):

PyTorch autograd, JAX autograd, tinygrad autograd, torch dynamo, bytecode interception

- 编译器优先的自动微分(Compiler-First Autograd)兴起:一位成员倾向于采用类似于 tinygrad 和 JAX 的编译器优先方法来实现 autograd,并指出并非所有有效的 Python 代码都会成为有效的 picograd。

- 他们发现 Torch Dynamo 和字节码拦截(bytecode interception)很酷,但对于他们的项目范围来说过于复杂,因此主张明确向 tinygrad 的设计决策靠拢。

- 语言实现中的设计决策:受 Krishnamurthi 在 PLAI 中方法的启发,该成员建议在语言实现中明确指出设计决策(例如 eager vs lazy,串行 vs 并行)和替代路径。

- 这将编程语言视为可以组合在一起的功能集合,摆脱了前科学时代的分类方法。

- 深度学习框架组件的明确动机:该成员希望使深度学习框架每个组件的动机都非常明确,以便读者理解设计选择背后的原因。

- 例如,读者应该尝试使用符号微分或数值微分来优化深度神经网络,以理解为什么需要自动微分(autodifferentiation)。

- 阐述融合编译器(Fusion Compiler)的必要性:读者需要测量并分析 eager 模式下的 autograd 系统,以发现他们在非 Tensor Core 操作上正受到内存(数据移动)的瓶颈限制。

- 这激发了对融合编译器以优化内存使用的需求。

HuggingFace ▷ #general (48 messages🔥):

Hugging-Science Discord Launch, HF Inference Providers Quality, Gradients Clipping, gguf conversion with llama cpp, smollm's goals

- Hugging-Science Discord 频道上线:一个新的

hugging-scienceDiscord 频道已上线,旨在针对开源领域开展专项工作,包括融合(fusion)、物理(physics)和评估(eval),点击此处查看。- 该频道还在为每个项目寻找团队负责人(Team Leaders);对于想要负责并领导一些令人兴奋的工作的人来说,这是一个很好的成长机会! <:hugging_rocket:968127385864134656>

- HF 推理提供商面临质量担忧:一位成员对 HF 推理提供商(Inference providers)的质量表示担忧,想知道 HF 如何保证推理端点的质量,特别是关于量化(quantization)方面。

- 他们补充说,他们认为端点默认应该是 zdr(零数据保留)。

- 梯度范数超过

max_grad_norm导致心跳尖峰(Heart Spikes):一位成员询问为什么即使将max_grad_norm设置为 1.0,grad norm仍会超过该值。- 另一位成员澄清说,梯度在内部会通过

max_grad_norm/your_norm的裁剪系数进行修改,而裁剪前的范数仅用于日志记录目的。

- 另一位成员澄清说,梯度在内部会通过

- 借助 Llama CPP 进行

gguf转换:一位成员询问如何使用gguf格式的模型在 LM Studio 中运行。- 另一位成员建议使用

llama cpp在本地将其转换为gguf,并参考了 GitHub 的讨论。

- 另一位成员建议使用

- 梦想中的 smollm 工作伙伴:一位成员指出,smollm 应该是一个小巧的工作伙伴,而不是一个只会在榜单刷分的砖头(benchmaxxed brick)。

- 该成员还表示,对于一个微型团队且保持一切完全开源来说,这已经非常令人印象深刻了。

HuggingFace ▷ #cool-finds (1 messages):

Diffusion ODE Solver, DPM++2m, WACV 2025, Hyperparameter-is-all-you-need

- ODE Solver 步数大幅减少:一位独立研究员为 Diffusion 模型开发了一种新型 ODE Solver,实现了 8 步推理,在 FID 分数上超越了 DPM++2m 的 20 步推理,且 5 步推理的效果即可媲美最新的蒸馏(Distillation)方法。

- 追踪概率流的 Solver 设计:这种新型 ODE Solver 设计能够更好地追踪推理过程中的概率流轨迹 (Probability Flow Trajectory)。

- 这是一种纯粹的、无需训练 (Training-free) 的采样过程改进。

HuggingFace ▷ #i-made-this (7 messages):

golang vectorDB, AI agent trust challenges, AgentXTrader, protein prediction dataset

- Golang VectorDB 诞生:一名成员创建了一个极其简单的纯 Golang 编写的 VectorDB,并提供了 GitHub 仓库链接。

- 该项目名为 serverlessVector,使用 Go 语言编写。

- AI Agent 信任问题调查:一名成员正在进行关于生产环境中 AI Agent 信任挑战的研究,并为部署过 AI Agent 的用户发布了一个关于 AI Agent 信任的匿名调查链接。

- 该调查侧重于身份验证和问责问题,并声明完全匿名。

- AgentXTrader 助力交易:一名成员介绍了 AgentXTrader,并分享了一篇展示其运行情况的 LinkedIn 帖子。

- 它会针对最佳投资策略进行辩论。

- 蛋白质预测数据集上线 HF Hub:一名成员指出,由 INRIA 开发的蛋白质预测数据集已通过 HF Collections 链接上线 Hub。

- 这是一个来自 INRIA 名为 mdposit 的 dyna-repo。

HuggingFace ▷ #computer-vision (1 messages):

fingaz_ai: 我还没有,但我也在研究同样的功能,只是还没确定具体方案。

HuggingFace ▷ #smol-course (2 messages):

In-Person Meetup in NYC, GSM8k Eval on Trained Model

- HuggingFacers 计划在纽约市举行线下见面会:纽约市的成员正计划为课程举行每周一次的线下见面会 (IRL Meetup),并正在通过 lettucemeet.com 收集空闲时间。

- 成员正在运行 GSM8k 评估:一名成员正在询问是否有人成功在他们训练的模型上运行了 GSM8k Eval。

HuggingFace ▷ #agents-course (4 messages):

Starting the Agents Course, Backgrounds of new course members

- 新面孔开启微调之旅:多名学员今天开始了“微调语言模型 (Fine-Tuning Language Models)”课程,其中一名来自埃塞俄比亚的成员正在寻求建议。

- 现在是深入了解语言模型世界并与同行学习者建立联系的好时机。

- 多元化开发者深挖 Agent 领域:新课程成员包括一名旨在将 Agent 应用于客户项目的全栈开发人员/企业家,以及一名来自巴西、正投身于 Agent 开发的分析专家。

- 该课程吸引了各种背景的人才,大家都希望通过 AI Agent 扩展自己的专业知识。

Latent Space ▷ #ai-general-chat (44 messages🔥):

DeepSeek Terminus, Claude resumable streaming, Untapped Capital Fund II, Alibaba Qwen3-TTS, OpenAI NVIDIA deal

- DeepSeek Model Terminus 发布!: DeepSeek 发布了最终的 v3.1 迭代版本 Terminus,提升了语言一致性、代码/搜索 Agent 以及基准测试的稳定性,目前开放权重已上线 Hugging Face。

- 社区已经在询问:DeepSeek-R2 什么时候发布?

- Untapped Capital 启动 Fund II 种子前轮热潮: Yohei Nakajima 宣布了 Untapped Capital Fund II,这是一个规模为 25 万美元的种子前轮(pre-seed)通用型投资工具,延续了该基金自 2020 年成立以来的使命,即支持常规网络之外的创始人。

- 对于这支基金,团队转向了自上而下的方法(top-down approach),旨在发现早期趋势并主动寻找初创公司。

- 阿里巴巴 Qwen3-TTS 登场!: 阿里巴巴通义实验室宣布了 Qwen3-TTS,这是一款全新的语音合成模型,支持多种音色、语言和方言,具有极高的自然度,目前针对中英文进行了优化。

- 社区反应热烈,但许多用户立即询问该模型是否会开源或其 API 定价如何;官方团队回复了一个 ModelStudio 文档链接,但对开源计划保持沉默。

- OpenAI 与 NVIDIA 锁定 1000 亿美元巨额交易!: OpenAI 和 NVIDIA 达成了战略合作伙伴关系,将部署高达 10 吉瓦(10 gigawatts)(数百万个 GPU)的 NVIDIA 系统——价值约 1000 亿美元——为 OpenAI 从 2026 年底开始部署的下一代数据中心奠定基础。

- 反应从欢呼股价飙升到讨论供应商融资策略、AGI 炒作,以及普通用户是否能真正用到这些额外的算力。

- Among AIs:社交智能获得新基准: Shrey Kothari 发布了 Among AIs,这是一个新的基准测试,让顶级语言模型在《Among Us》游戏中竞争,以评估其欺骗、说服和协作能力,GPT-5 在“冒充者(Impostor)”和“船员(Crewmate)”胜率中均排名第一。

- 回复涵盖了缺失的模型(Grok 4 和 Gemini 2.5 Pro 即将加入)、游戏的选择、训练数据担忧、讨论机制(3 轮辩论,平等发言时间)以及对基于游戏的 AI 评估的热情。

Latent Space ▷ #genmedia-creative-ai (4 messages):

Google Gemini, Runway AI, Runway Gen-2

- Gemini + Runway AI 结合进行视频处理!: 一位用户分享了一段 TikTok 视频,展示了如何使用 Google Gemini 和 Runway AI 将视频中的一个人替换成另一个人。

- 该过程包括截取视频截图,使用 Google Gemini 生成替换图像,然后使用 Runway Gen-2 将图像应用到视频中,但视频大小必须小于 30MB。

- AI 视频处理趋势: 发布者提到,类似的视频处理技术已经在 Instagram 上流传了一年多。

- 这表明易于使用的 AI 驱动视频编辑工具和技术正呈现增长趋势。

Eleuther ▷ #general (34 条消息🔥):

Text-davinci-003 起源故事, ChatGPT 模型 Fine-tuning, UChicago ML 研究社区, GPT-3.5 系列

- Text-davinci-003 与 ChatGPT 同日发布:Text-davinci-003 在 ChatGPT 发布的同一天在 API 中上线,OpenAI 在发布后的 48 小时内确认其为 GPT-3.5 模型。

- 一位成员回忆说,它是在 ChatGPT 发布的前一天发布的,同时发布的还有一个更新的 Codex 模型,该模型也被认为是 GPT-3.5 系列的一部分,名为 code-davinci-002。

- ChatGPT 基于 GPT-3.5 系列进行 Fine-tuned:成员们讨论了第一个 ChatGPT 版本是基于 GPT-3.5 系列中的一个模型进行 Fine-tuned 的,最可能的候选模型是 text-davinci-003。

- 一位成员表示:“OAI 在此确认 ChatGPT 模型是基于一个在 2022 年初完成训练的模型进行 Fine-tuned 的,因此不可能是 GPT-4,因为我们知道 GPT-4 直到 2022 年中后期才开始 Pretraining。”

- 社区寻求 UChicago ML 研究访问权限:一位成员寻求引荐 UChicago 的 ML 研究社区,以便参加关于 ML sys、cog neuro、mech interp 和语言学研究讨论的公开研讨会/实验室会议。

- 另一位成员建议直接参加研究座谈会,并引用了他们“80 岁的博士爷爷”的建议,暗示可能不需要特意请求许可。

- GPT-3.5 家族之争:成员们辩论了 GPT-3.5 系列中模型的血统和发布顺序,包括 code-davinci-002、text-davinci-002 和 text-davinci-003。

- 一位知情人士声称 ChatGPT 是一个未发布模型的 Fine-tune 版本,源自链式 Fine-tuning。

Eleuther ▷ #research (9 条消息🔥):

Prefilling 与 Decoding 的直觉, Diffusion ODE Solver, WACV 2025 投稿

- 训练中的 Prefilling 与 Decoding:一位成员询问,关于 Pre-training 完全是 Prefilling,而 Post-training / RL 阶段主要是 Decoding 的直觉是否正确。

- 该成员试图思考那些增加 Decoding 吞吐量但在 Prefilling 期间没有帮助的技术的优势,并思考 Post-training 是否主要是 Rollouts。

- 8 步 Diffusion ODE Solver 超越 DPM++:一位独立研究员开发了一种新型的用于 Diffusion 模型的 ODE solver,实现了 8 步推理,在 FID 分数上超越了 DPM++2m 的 20 步推理,且计算成本降低了约 60%。

- 研究论文背后的人工痕迹:一位成员询问某篇研究论文有多少是由 LLM 生成的,理由是其摘要长度异常。

- 该独立研究员表示,“代码和论文不包含任何由 AI 生成的内容”。

Eleuther ▷ #lm-thunderdome (2 条消息):

MMLU pro 基准测试, lm-eval

- 对 MMLU 子任务进行基准测试:成员们讨论了是否可以使用 lm-eval 对 MMLU pro 的子任务进行基准测试,例如仅测试 mmlu_law。

- 讨论中没有提供明确的答案或方法,但这暗示了这是 lm-eval 框架中一个值得探索的功能。

- lm-eval 的潜在功能:lm-eval 的一个潜在功能是对特定的子任务进行基准测试。

- 这将允许对 AI 模型的能力进行更精确的测试。

Nous Research AI ▷ #general (34 条消息🔥):

HuggingFace 评论,OLMo-3 safetensors,Qwen3 Omni,实时感知 AI,各 LLM 的 SVG 编码能力

- HuggingFace 评论引发笑声:成员们觉得 HuggingFace 上的评论 非常有趣。

- 一位成员表示:是的,我看到那个的时候笑翻了。

- 开始寻找 OLMo-3 safetensors:一位成员正在寻找 OLMo-3 safetensors 的线索,并加入了他们的 Discord 以进行后续跟进。

- 他们注意到推理代码已经发布,但 HF 上还没有权重。

- Qwen3 Omni 发布:Qwen3 Omni-30B-A3B-Instruct 现已可用,拥有 36B 参数,并配备多模态编码器/解码器。

- 据一位成员称,它在诈骗电话音频处理方面 击败了 Whisper v2/3 和 Voxtral 3B,支持 17 种音频输入语言和 10 种输出语言。

- 实时感知 AI 竞赛升温:一位成员预见下一场竞赛将是 realtime perceptual AI(同时处理音频、视频和其他模态)。

- 他们以 Apple 的实时视觉模型为例,说明幕后正在酝酿的东西,并对缺乏发布感到好奇。

- SVG 编码 LLM 测试结果:一位成员测试了各 LLM 的 SVG 编码能力,并分享了一张鸭子在池塘里游泳的测试结果图。

- 讨论中提到 multi-modal(多模态)、world models(世界模型)、visual language action(视觉语言动作)和 biological neural network(生物神经网络)是新的流行术语,因为仅以语言和数学为中心的 LLM 固着方式可能不足以应对所有需求。

Nous Research AI ▷ #ask-about-llms (7 条消息):

LLM 训练,LoRA 训练,LLM 的消费级硬件,LLM 的带宽与延迟

- 消费级硬件上进行 LoRA 训练是可行的:一位成员提到,你可以使用单张 RTX 4090 在本地对任何你想要的 14B 模型进行 LoRA 训练。

- LLM 工作中的带宽与延迟限制:一位成员表示他们正在进行类似的工作,面临的限制是 bandwidth(带宽)和 latency(延迟)。

aider (Paul Gauthier) ▷ #general (19 条消息🔥):

Aider 分支中的导航模式,aider-ce 包,Augment CLI,Deepseek V3.1 设置,Aider 中的 Web 搜索工具

- Aider 分支获得导航模式:鼓励成员使用带有 navigator mode(导航模式)的 aider forks 以获得更自动化的体验。

- 一位成员建议在分支仓库上使用 uv pip install,或者使用包含 MCP 和导航模式的 aider-ce 包。

- Augment CLI 在大型代码库中表现出色:据一位成员称,Augment CLI 工具在处理大型代码库时表现尤为出色。

- 他们推荐使用 Claude Code (CC) 配合 Opus/Sonnet 以及 Codex for GPT-5,并指出 Codex 缺少 API key。

- 征求 Deepseek V3.1 配置建议:一位新用户计划使用 Deepseek V3.1,并寻求关于初始安装和配置的建议。

- 该用户还询问了首选的 web 搜索工具,并指出 aider 没有内置工具但可以抓取提供的 URL;一位成员建议通过 MCP 集成使用 Perplexity MCP 进行 web 搜索。

- GAS 脚本自动化导致失业?:一位成员编写了一个 GAS (Google App Script) 来响应其业务报价。

- 他们表示其表现优于人类员工,并担心 如果这被公开,将导致大规模失业。

aider (Paul Gauthier) ▷ #questions-and-tips (5 条消息):

运行多个 aider 智能体,aider 请求编辑文件,LLM 对提示文件感到困惑

- 讨论多智能体 Aider 设置:一位成员询问如何通过命令行设置 多个 aider 智能体 进行外部编排,而不是使用内置方案。

- 讨论建议使用 git worktrees 对同一个仓库进行并发修改。

- Aider 的编辑提示导致 LLM 困惑:当使用文件设置提示(prompt)时,aider 会提示编辑文件,同时 LLM 会对当前任务感到困惑。

- LLM 随后会要求澄清意图,具体是应该作为 APM 框架内的“User”行动,还是使用 SEARCH/REPLACE 块格式修改文件。

Modular (Mojo 🔥) ▷ #general (15 messages🔥):

FFI, Rust, C ABI, C header, Mojo binding generators

- Rust 开发者通过 FFI 调用 Mojo:成员们讨论了使用 FFI 从 Rust 调用 Mojo,一位用户确认他们已经通过 C ABI 实现了这一点。

- 他们补充说,这类似于调用 C,只需确保类型匹配,并使用

@export(ABI="C")标记 Mojo 函数。

- 他们补充说,这类似于调用 C,只需确保类型匹配,并使用

- 目前仍需手动进行 Mojo 绑定:一位成员表示 C header -> Mojo binding generators 仍处于 WIP(开发中)阶段,因此 CXX 目前没有帮助。

- 生成 Mojo 绑定的唯一方法是手动操作。

- Windows 支持仍然缺失:一位用户询问了 Mojo 的 Windows 支持 情况。

- 另一位用户回答说,短期内不会推出。

Modular (Mojo 🔥) ▷ #announcements (1 messages):

Modular Platform 25.6, NVIDIA Blackwell, AMD MI355X, Consumer GPUs

- Modular 25.6 提升 GPU 性能:Modular Platform 25.6 已上线,在包括 NVIDIA Blackwell (B200) 和 AMD MI355X 在内的最新 GPU 上提供巅峰性能。

- 早期结果显示,MI355X 上的 MAX 甚至可以超越 Blackwell 上的 vLLM,现在 Apple Silicon、AMD 和 NVIDIA 等消费级 GPU 均可使用统一的 GPU 编程。

- Modular 统一 GPU 编程:Modular 现在支持 Apple Silicon、AMD 和 NVIDIA 消费级 GPU,为笔记本电脑和台式机带来统一的 GPU 编程体验。

- 查看 博客文章 了解更多信息。

Modular (Mojo 🔥) ▷ #mojo (7 messages):

Mojo MAX .mojopkg requirement, Mojo nightly install command, Variadic args binding in Mojo

- MAX 需要 .mojopkg:使用 MAX 需要在可执行文件旁附带一个

.mojopkg文件,该文件包含 Mojo 解析后生成的最高层级 MLIR,供运行时的 JIT 编译器使用。- 对于隐藏硬件细节的平台(Apple、NVIDIA GPU),Mojo 将编译工作交给驱动程序,执行单次 JIT 而不进行分析(Profiling),这与 V8 或 Java 不同。

- 通过 PIP 轻松安装 Mojo:

mojo包现在已在 PyPI 上架,用户可以使用pip install mojo安装最新的稳定版 Mojo、调试器和 LSP。- 对于 Nightly 版本,请使用

pip install mojo --pre "mojo<1.0.0" --index-url https://dl.modular.com/public/nightly/python/simple/。

- 对于 Nightly 版本,请使用

- 变长参数绑定受 Rust 阻碍:由于

va_list不是 C 语言函数签名的一部分,Mojo 中的变长参数(Variadic args)绑定可能无法实现。- 即使是 Rust 目前也不完全支持此功能(issue 44930),这使得在

c_binder_mojo中实现它具有挑战性。

- 即使是 Rust 目前也不完全支持此功能(issue 44930),这使得在

Yannick Kilcher ▷ #paper-discussion (16 messages🔥):

New Paper Discussion, Yann LeCun's Work, Joint Embedding Predictive Architecture, Paper Presentation Opportunity

- 论文研讨会已排期:关于一篇论文(https://www.arxiv.org/abs/2509.14252)的讨论定于 <t:1758567600:t> 进行。

- 一位成员建议为东部时区的参与者安排更早的时段。

- 讨论 Yann LeCun 的影响:一位成员询问预定的论文是否与 Yann LeCun 的工作有关。

- 另一位成员表示赞同,并建议查看 联合嵌入预测架构 (JEPA) 的背景资料,并链接到了一份 OpenReview 文档。

- 大量链接分享:分享了多个链接,包括一个 YouTube 视频、一条 推文、另一条 推文、一篇 arXiv 论文、另一个 YouTube 视频,以及另外两篇 arXiv 论文 和 (https://arxiv.org/abs/2509.13805)。

- 这些资源可能与讨论的论文及相关主题有关。

- 论文展示邀请:一位成员询问关于展示论文的事宜以及合适的时机。

- 该成员建议在大多数日子的 提前或推后 6 小时 进行。

Yannick Kilcher ▷ #ml-news (3 messages):

GPT 解析哲学,Prompting 改进

- GPT 对哲学的解析评价褒贬不一:一位用户给 GPT model 在解析其哲学思想方面打了 7/10 分,但在扩展论述方面仅给了 4/10 分,格式化方面给了 3/10 分。

- 他们补充说,这比大多数模型都要好,但还不够好。

- 用户体验到结果的改善:该用户最初不喜欢 GPT 的结果,但在进一步交互后表示对结果感到满意。

- 用户表示,要么是他们的 Prompting 水平提高了,要么是机器的阅读能力变强了。

DSPy ▷ #general (16 messages🔥):

MCP Secrets,Trace ID,针对 ReAct 的 GEPA

- MCP Secrets 应存储在环境变量(ENV)中:一位用户警告不要通过 MCP 传递 Secret,建议单用户服务使用环境变量,更复杂的设置则使用 login+vault/OAuth。

- 该用户指出,他们的 JIRA MCP server 实现使用了 stdio 并从环境中获取凭据,按单用户部署以避免通过进程表泄露 Secret。

- DSPy 模块中的 Trace ID 会影响优化:一位用户询问如何在不破坏优化的前提下处理 DSPy 模块中每个条目的 Trace ID。他注意到,如果用 Trace ID 初始化模块,在优化后运行 Batch 时,所有文档都会使用相同的 ID。

- 该用户考虑过为每篇文章重新创建模块(成本太高),以及将 Trace ID 移至 forward 调用中,并询问这是否会影响优化,因为 trace_id 会被传递给 LLM gateway 用于日志和审计。

- 针对 ReAct Agent 的 GEPA:一位用户询问关于针对 ReAct Agent 使用 GEPA 的经验,特别是如何处理长 Agent 轨迹带来的上下文溢出(context overflows)问题。

- 目前还没有人分享相关的实战经验。

MCP Contributors (Official) ▷ #general (7 messages):

MCP Sampling 协议,添加 response_schema,Claude 模型受限输出

- 添加 MCP Sampling 协议支持:一位成员关注到一个议题,即在 MCP Sampling 协议中添加 response_schema,该议题已被转为讨论。

- 另一位成员表示乐意在 10 月份尝试作为 SEP 的一部分进行实现并提供小型 Demo,因为在使用 Sampling 时能够请求结构化输出(structured output)会非常酷。

- 添加 response_schema 听起来可行:小组讨论认为在 SDK 中实现并不困难,工作量主要在于 SDK 与 LLM API / SDK 之间的集成。

- 一位成员表示,可能需要一些特定于提供商的代码,但并不严重。

- Claude 模型具有受限输出:有成员提到,提供受限输出(constrained output)可以作为 Client 能力的一个方面。

- 一位成员指出,Claude 模型即使支持该功能,也会显示为不支持,他们认为最好先展示对 response_schema 的支持,然后由 Client 宿主决定如何实际提供它。

MCP Contributors (Official) ▷ #general-wg (6 messages):

Model Context Protocol 注册表,发布 MCP 服务器,远程服务器配置,MCP 安装说明

- MCP 注册表发布指南发布:一位成员分享了将服务器发布到 Model Context Protocol (MCP) 注册表的说明,从这份指南开始。

- 该指南详细说明了如何创建一个空的 GitHub 仓库,并提供一个包含名称、描述、状态、仓库 URL 和远程端点等详细信息的

server.json文件。

- 该指南详细说明了如何创建一个空的 GitHub 仓库,并提供一个包含名称、描述、状态、仓库 URL 和远程端点等详细信息的

- MCP 的远程服务器配置:一位成员链接了 Model Context Protocol (MCP) 的远程服务器配置,参考此文档。

- 示例

server.json包含一个$schema定义和一个指定streamable-http类型和 URL 的remotes数组。

- 示例

- MCP 安装说明已生成!:一位成员提到使用了一个工具来生成 Readme 文件,其中包含通过 MCP Install Instructions 在各种 Client 中安装 Model Context Protocol (MCP) 的说明。

- 他表示这个工具“非常酷”,对创建安装指南很有帮助。

tinygrad (George Hotz) ▷ #general (6 条消息):

CuTe DSL, RANGEIFY 状态, 公司更新, ThunderKittens 项目

- 周一的 Colfax 会议:圣地亚哥时间周一上午 9 点将举行 第 89 次会议,进行公司更新。

- 从下周开始,会议将提前 3 小时。

- RANGEIFY 进度受到质疑:有人询问 RANGEIFY 是否能在本周末前成为默认设置,包括 store, assign, group reduce, disk, jit, const folding, buf limit, llm 和 openpilot。

- 有人指出 children 没有进展,且 image 尚未完成。

- CuTe DSL 具有改变游戏规则的潜力:成员们提到 CuTe DSL 是一个潜在的游戏规则改变者。

- 他们补充说 ThunderKittens 的起步非常不错。

Moonshot AI (Kimi K-2) ▷ #general-chat (6 条消息):

Kimi K-2, Prompt Injection, Claude 的“脑叶切除”

- Kimi 拒绝挑衅尝试:一位成员分享了挑衅 Kimi 的经历,并对其拒绝盲目顺从或同情的态度表示赞赏。

- 另一位成员表达了类似的看法,指出 Kimi 的态度 是它成为他们最喜欢的模型的原因。

- Claude 的 Prompt Injection 惨败:成员们讨论了 Claude 如何因 prompt injection 技术 而被削弱,导致当上下文超过一定长度时它会产生分歧。

- 他们指出这与 Kimi K2 不同,一些人对 Claude 的变化表示失望。