AI News

Thinking Machines 的 Tinker:基于 LoRA 的大语言模型(LLM)微调 API。

Thinking Machines 最近在尚未发布任何产品的情况下筹集了 20 亿美元,并于近日推出了首款产品 Tinker。这是一个托管服务 API,旨在利用 LoRA 技术对 Qwen-235B-A22B 等大型模型及混合专家(MoE)模型进行高性价比的微调。Tinker API 为后训练(post-training)方法提供了底层原语,并辅以开源的 Tinker Cookbook 工具库。Andrej Karpathy 和 Lilian Weng 等 AI 领域的重量级人物对其设计表示赞赏,认为它降低了复杂性并提升了研究效率。

与此同时,OpenAI 推出了 Sora 2,这是一款集成在其面向消费者的社交应用中的视频+音频模型,在引发病毒式传播的同时,也激起了人们对工具滥用和内容审核的担忧。Sam Altman 强调,该产品在推进通用人工智能(AGI)研究的同时,也兼顾了用户愉悦感和营收。

本可以命名为 Thinker?

2025年9月30日至10月1日的 AI 新闻。我们为您检查了 12 个 Reddit 子版块、544 个 Twitter 账号和 23 个 Discord 社区(196 个频道,6687 条消息)。预计节省阅读时间(以 200wpm 计算):497 分钟。我们的新网站现已上线,支持全元数据搜索,并以精美的 vibe coded 方式展示所有往期内容。请访问 https://news.smol.ai/ 查看完整的新闻细分,并在 @smol_ai 上向我们提供反馈!

时机确实巧合得离奇:

- 5 天前,The Information 点名批评 Thinking Machines 融资 20 亿美元却未发布任何产品。

- 同一天,Jeremy Bernstein 发布了 Modular Manifolds(关于训练稳定性的优化器和约束的深度理论基础),3 天后 John Schulman 撰写了 LoRA Without Regret(对 2021 年原始论文 的实证支持,验证了其在正确执行时性能可媲美全量微调 类似于 Biderman 等人的研究)。

- 今天,Thinky 发布了其首个产品:Tinker。

根据其 落地页 介绍:

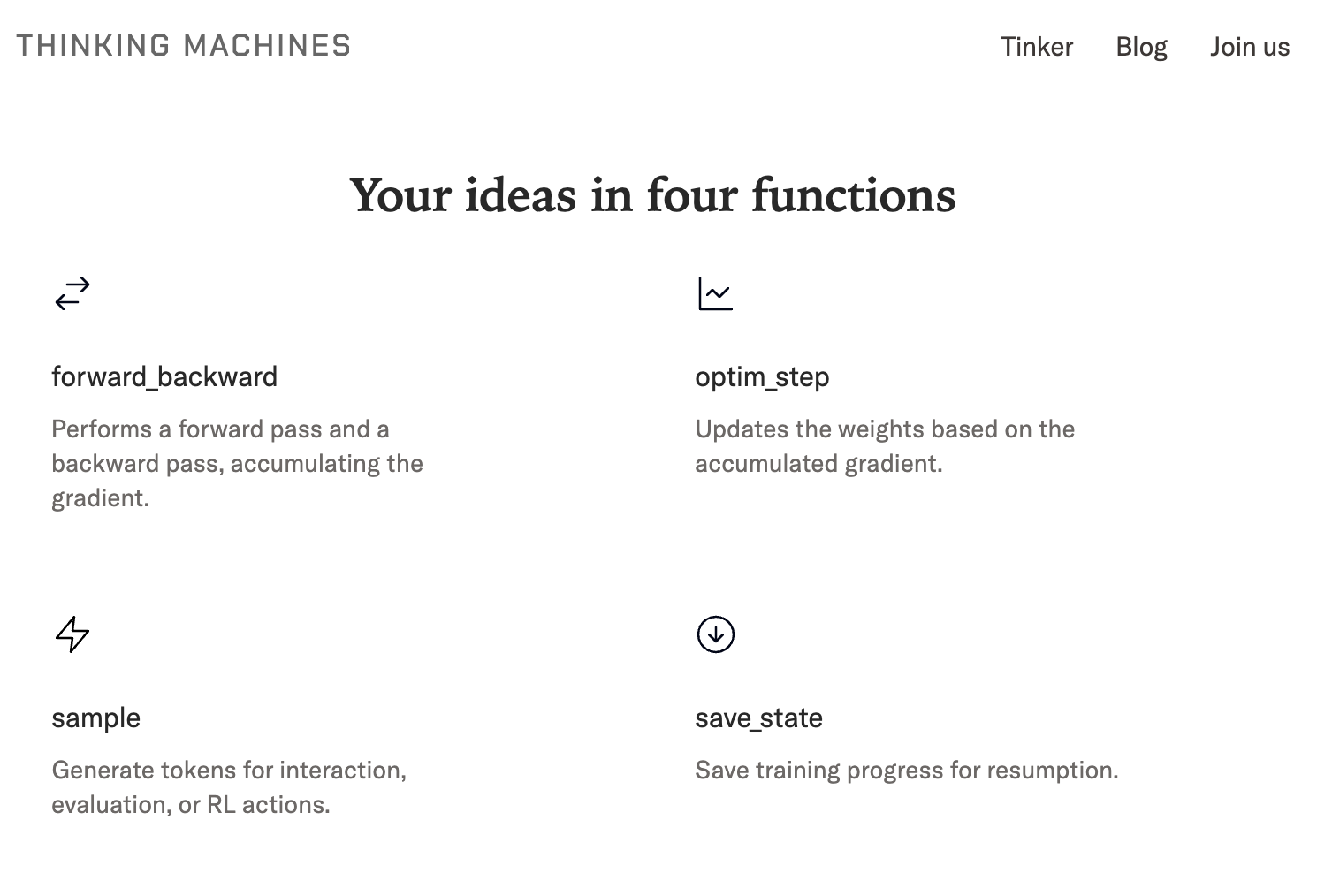

Tinker 允许你对一小部分大中型开源权重模型进行微调,包括 Qwen-235B-A22B 等大型 Mixture-of-Experts 模型。从小型模型切换到大型模型,只需更改 Python 代码中的一个字符串即可。

Tinker 是一项托管服务,运行在我们的内部集群和训练基础设施上。我们负责调度、资源分配和故障恢复。这让你可以立即启动小型或大型运行任务,而无需担心基础设施管理。我们使用 LoRA,以便在多个训练任务之间共享相同的计算池,从而降低成本。

Tinker 的 API 为你提供了诸如 forward_backward 和 sample 之类的低级原语,可用于表达大多数常见的 post-training 方法。即便如此,要获得良好的结果仍需处理许多细节。这就是为什么我们要发布一个开源库——Tinker Cookbook,其中包含在 Tinker API 之上运行的现代 post-training 方法的实现。

这个极小的 API 表面积似乎是一个非常受欢迎的抽象——正如 Andrej 所说:“你保留了 90% 的算法创意控制权(通常与数据、损失函数、算法相关),而 Tinker 处理你通常不想碰的困难部分(基础设施、LLM 本身的 forward/backward、分布式训练),这意味着你可以以远低于典型复杂度的 10% 来完成这些工作。”

Lilian(带有偏见地)表示赞同:“提供高质量的研究工具是提高更广泛社区研究效率的最有效方式之一,Tinker API 是朝着我们这一使命迈出的一步。”

目前设有候补名单,并请注意 服务条款。但人们确实希望这第一个产品只是更大、更宏伟目标的预兆……

AI Twitter 回顾

OpenAI 的 Sora 2 应用:产品、平台效应及早期压力测试

- Sora 2 作为 OpenAI 首款消费级社交应用中的视频+音频模型发布,引发了巨大的参与度和讨论。Feed 流和“cameo”功能立即被一些创作者(ostr)视为“AI 垃圾内容生成机”(AI slop machine),病毒式反应指出它可以“超越”现有平台(@skirano)。其他人则指出了明显的滥用潜力(@TheStalwart)、“递归越狱”风险(@fabianstelzer),以及诸如“双击获取表情符号”视频充斥 Feed 流的骗粉模式(@Teknium1;@ostrisai)。随着使用量的增加,OpenAI 正在扩大邀请范围并限制每日生成额度(@billpeeb)。

在组合/落地推理测试(例如数手指/字母)中,质量令人惊叹但表现不一 (@teortaxesTex; @scaling01)。Sam Altman 承认该产品部分是为了愉悦感和收入,而公司研究重点在于 AGI/Agents(“现实是微妙的”)(@sama),随后他反思了信息流中全是自己的这种超现实体验 (@sama)。战略观点:OpenAI 正在将前沿模型转化为具有粘性的应用(ChatGPT, Codex, 以及现在的 Sora),在原始模型质量之外构建护城河 (@Yuchenj_UW)。

DeepSeek V3.2 和 DSA:更便宜的大规模长上下文,首日生态系统支持

-

DeepSeek V3.2 Exp 引入了 DeepSeek Sparse Attention (DSA):每个 token 通过非连续滑动窗口关注约 2048 个 token,使解码内存/FLOPs 有效达到 O(2048)。第三方笔记提到了索引流水线以及索引器中对 Q/K 进行的 Hadamard 变换 (@nrehiew_)。价格下降了 >50%(输入)和 75%(输出),采用 MIT 许可,并保持与 V3/R1 相同的 671B 总参数/37B 激活参数的 MoE 架构 (@ArtificialAnlys)。基准测试显示,在推理和长上下文任务中与 V3.1 持平,且 token 效率略有提高 (@ArtificialAnlys)。

基础设施势头:在 NVIDIA 的帮助下,vLLM 实现了首日支持;Blackwell 现在是“新 MoE 模型的首选发布平台” (@vllm_project; @TheZachMueller)。分析师认为 DSA 有效地“解锁了 1M 上下文”,并预示着更广泛的注意力效率浪潮,尽管低于 ~2K 上下文的潜在权衡值得关注 (@teortaxesTex; @swyx)。社区观点:每个 token 成本的阶跃式变化“仍未被完全定价” (@teortaxesTex)。

Claude Sonnet 4.5:编程/Agent 升级及可用性调整

-

团队报告称,与 Sonnet 4.0/Opus 相比,在实际工作流中链条更短、速度更快且命中率更高,特别是在 Coding Agents 和 Claude Code 风格的循环中:重试更少,等待工具链的时间也更短 (@augmentcode; @iannuttall)。Claude Code 团队已将其日常主力模型切换为 Sonnet 4.5,并重置了一些 Opus 限制;Anthropic 还重置了所有付费用户的速率限制,以便人们尝试 4.5 (@_catwu; @alexalbert__)。

并非普遍适用:某些流水线仍倾向于 GPT-4o/5,或在特定任务上出现退化 (@imjaredz; @Teknium1)。早期的“思考/对齐”观察强调了在多轮对话设置中更好的用户意图建模 (@teortaxesTex)。Sonnet 4.5 Thinking 32k 已在社区评估(Arena, OpenHands)中上线 (@arena; @allhands_ai)。

智谱 GLM-4.6:效率优先的发布,以 Agent 为中心的改进

-

GLM-4.6 优先考虑 token 效率和响应速度,而非华而不实的功能。一篇广为流传的中文评论报告称,与 4.5 相比,能力提升了约 5%,大幅削减了“思考” token(例如推理中从 16K 降至 9K),响应速度更快(平均约 35 秒),且指令遵循更稳定;在极复杂任务上存在弱点,且基础模型存在一些代码语法错误 (Zhihu summary via @ZhihuFrontier)。上手体验:强大的前端/Agent 行为;在有限的测试中 Python 表现未变 (@karminski3)。

经济性:GLM-4.6 现已加入 Kilo Code,声称在内部任务中对阵 Claude Sonnet 4.5 的胜率为 48.6%,支持 200K 上下文,定价极具攻击性,每 1M tokens 为 $0.60/$2.20 (@kilocode)。目前没有发布 4.6-Air 的计划;智谱暗示稍后可能会发布更小的 MoE (@teortaxesTex)。

后训练基础设施更进一步:Thinking Machines 的 Tinker

- Tinker 暴露了底层、对研究人员友好的训练后原语(forward_backward, sample, optim_step),并提供托管的分布式 GPU 支持,支持 SFT, RL (PPO/GRPO), LoRA, 多轮/异步 RL 以及自定义损失函数——将微调/RL 从企业的“上传数据,剩下的交给我们”模式,转向在保留算法控制权的同时外包基础设施。来自全栈领域的背书:

- 来自顶尖研究人员和构建者的高调支持和使用报告 (@johnschulman2; @karpathy; @robertnishihara; @pcmoritz; @lilianweng)。

- 早期成果:普林斯顿的 Goedel 团队在使用 20% SFT 数据的情况下,通过 LoRA 在 MiniF2F 上达到了约 81 pass@32;Redwood 正在探索针对控制敏感行为的长上下文 RL;其他团队则原型化了带有奖励环境的 text-to-SQL (@chijinML; @ejcgan; @robertnishihara)。

-

为什么是现在:MoE 的算术强度和内存压力使得严肃的训练/FT 超出了单节点爱好者设备的承受范围;能够批量处理请求并处理多节点资产的共享基础设施降低了门槛 (@cHHillee)。

预计后续会有更多集成(Ray, eval/RM 栈)以及一种事实上的标准、类似于推理 API 的训练 API 接口 (@tyler_griggs_)。

研究与系统亮点

- 优化器与动力学:“中心流”(Central flows)提供了一种理论工具,解释了为什么深度学习(DL)优化器在稳定边缘运行,并对真实神经网络提供了准确的定量预测 (@deepcohen)。关于 AdamW,研究了权重 RMS 的新渐近性 (@Jianlin_S)。

- 通过重定向(retargeting)和极简 RL 实现机器人技术:OmniRetarget (Amazon FAR) 生成高质量、保留交互的人形动作,仅需本体感受和少量奖励/DR 集即可实现敏捷的长程技能 (@pabbeel; 项目)。独立研究显示,现实世界的人形残差 RL 在交互约 15-75 分钟内即可改进 BC 策略 (@larsankile)。

- 音频与评估:Liquid AI 发布了 LFM2-Audio,这是一个 1.5B 的端侧实时音频文本模型(语音转语音/文本、TTS、分类),具有开源权重且推理速度快 10 倍 (@LiquidAI_; @maximelabonne)。RTEB(MTEB 更新)引入了私有多语言检索集以减少过拟合 (@tomaarsen)。MENLO 引入了一个涵盖 47 种语言的多语言偏好数据集和框架,用于判断类母语的回答质量 (@seb_ruder)。

- 系统:Perplexity Research 详细介绍了利用 RDMA 点对点技术将万亿参数的参数更新加速至约 1.3 秒,并使用静态调度和流水线技术进行分布式 RL/FT (@perplexity_ai)。

热门推文(按互动量排序)

- “天哪,想象一下你是 Mark Zuckerberg……结果几天后另一个垃圾内容生成机(slop machine)在垃圾产出上超过了你。” 针对 Sora 应用动态的评论 (@skirano, 18.4k)

- Sam Altman 谈论在资助 AGI 研究的同时利用 AI 带来愉悦;微妙的权衡 (@sama, 8.0k) 以及对满屏“Sam 客串”的反应 (@sama, 9.4k)

- “好吧。这是艺术。垃圾内容的艺术。” —— 对 Sora 2 文化吸引力的妥协 (@teortaxesTex, 5.0k)

- “任何看到这段视频的人都能立刻意识到恶意使用的潜力。” (@TheStalwart, 6.0k)

- “更多内容即将推出。” —— Perplexity 创始人在收购/研究发布期间透露路线图 (@AravSrinivas, 3.8k)

AI Reddit 摘要

/r/LocalLlama + /r/localLLM 摘要

1. 阿里巴巴 Qwen 100M-ctx/10T-param 路线图与腾讯混元 Hunyuan Image 3.0 预热

- 阿里巴巴刚刚公布了 Qwen 路线图。其雄心壮志令人震惊! (热度: 954): 阿里巴巴的 Qwen 路线图展示了向统一多模态家族迈进的激进计划,并伴随着极端的规模扩展:上下文长度从

1M → 100Mtokens,模型参数量从 ~1T → 10T,推理时计算预算(test‑time compute budgets)从64k → 1M,预训练数据量从10T → 100Ttokens。该路线图还强调了实际上无限制的合成数据生成,以及在复杂性、交互和学习模式方面更广泛的 Agent 能力。 评论者对100M上下文窗口的实用性表示怀疑,预计未来的模型可能会闭源,并指出超过1T参数的模型在没有大量硬件支持的情况下无法在本地运行。- 声称的

100Mtoken 上下文意味着采用了非标准的 Attention/内存机制。使用原生 Transformer Attention(O(L^2)计算量)和典型的 KV-cache 扩展,即使使用 MQA/GQA,KV 内存也将达到 TB 级(例如,一个使用 MQA 的 ~7B 模型在 ~16 KB/token下,100Mtokens 需要 ~1.6 TB的 KV 内存;如果使用全量 KV 头,则会膨胀到数十 TB)。要实际实现这一点,需要状态/压缩内存或分块 Attention(例如 RingAttention, StreamingLLM/Attention Sinks)、检索增强分块或递归/SSM 风格的架构,而不仅仅是 RoPE 缩放。 - 由于内存和吞吐量的限制,在本地运行

>1T参数的稠密模型是不可行的:在 8-bit 量化下,仅权重就约为~1 TB(4-bit 约为~0.5 TB),再加上长上下文所需的数 TB KV-cache;如果没有多 GPU NVLink 级别的带宽,每秒生成的 token 数会非常低。唯一现实的路径是大型 MoE(例如,总参数>1T,采用2-of-64专家模式),此时每个 token 的激活参数约为50–100B;在 4–8 bit 量化下,这仍然需要~40–160 GB的 VRAM 以及 KV-cache 和快速互联(8–16 个 GPU)。简而言之,消费级单 GPU 设备无法胜任;需要考虑具有张量/流水线并行的多 GPU 服务器(如 8×H100/GB200)。

- 声称的

- 腾讯正在预热全球最强大的开源文本生成图像模型,Hunyuan Image 3.0 将于 9 月 28 日发布 (热度: 225): 腾讯正在预热一款名为混元 Hunyuan Image 3.0 的开源文本生成图像模型,根据宣传图片,该模型被冠以“全球最强”称号,发布日期为 9 月 28 日。预热信息中未提供技术卡片、基准测试或架构细节;一位评论者提到推理可能需要

~96 GB的 VRAM,但这尚未得到证实,且关键规格(参数量、训练数据、许可证)仍不清楚。 评论者对发布前的炒作持怀疑态度,理由是之前存在过度预热但表现不佳的模式(如 SD3 对比 Flux,以及 GPT‑5 的炒作),并指出在没有可比开源基准的情况下,“最强大”一说缺乏依据。- 硬件担忧:评论者推测 Hunyuan Image 3.0 的推理可能需要

~96 GB VRAM,如果属实,这将限制本地使用仅限于数据中心/专业级 GPU(A6000/A100/H100),并且比 SDXL(1024px 下约 8–12 GB)或 FLUX.1-dev(~14–24 GB)FLUX.1-dev 重得多。这表明它拥有更大的 Transformer/Diffusion 骨干网络或高分辨率 Attention 占用,除非经过优化(如 TensorRT/Flash-Attn、平铺 Attention),否则可能会有吞吐量损失。 - 对发布前炒作与真实质量的怀疑:用户注意到一种模式,即过度预热的模型往往不及预期(例如 SD3 的营销对比社区对 FLUX.1 质量的偏好)SD3,而强大的模型(如 Qwen 家族)通常会带着扎实的基准测试“悄然发布(shadow drop)”Qwen org。他们希望看到第三方评估(如 CLIPScore/PickScore/HPSv2,以及像 GenEval 这样的文本忠实度套件)和同等条件下的提示词/分辨率/步数对比,以验证任何“最强”声明。

- 开源和生态系统细节至关重要:评论者对“最强开源”的说法表示质疑,直到许可证(“开放权重”还是许可的 OSS)和实际集成方式明确为止。迫切的需求包括 ComfyUI 节点/流水线的可用性 ComfyUI,以及与近期开源发布(如最新的 Qwen 图像栈)的直接对比,这将决定其在实际工作流中的采用率。

- 硬件担忧:评论者推测 Hunyuan Image 3.0 的推理可能需要

2. 风华 3 号 DX12/Vulkan GPU 与无审查“Abliterated” LLM 微调结果

- 中国已经开始制造支持 CUDA 和 DirectX 的 GPU,从而打破了 NVIDIA 的垄断。风华 3 号支持最新的 API,包括 DirectX 12, Vulkan 1.2 和 OpenGL 4.6。 (热度: 702): 帖子声称中国的风华 3 号 GPU 支持现代图形 API——DirectX 12, Vulkan 1.2 和 OpenGL 4.6——甚至支持 CUDA,暗示其可能成为 NVIDIA CUDA 生态系统的替代方案。在非 NVIDIA 芯片上实现真正的 CUDA 兼容性意味着需要重新实现 CUDA 运行时/驱动程序或 PTX 转换层(精神上类似于 HIP/ZLUDA),但该帖子未提供基准测试、驱动程序细节或验证。 评论者指出,AMD 的 HIP(以及 ZLUDA 等项目)已经通过转换提供了 CUDA 兼容性,同时暗示中国厂商可能会绕过法律限制直接提供 CUDA 支持。其他人则在看到真实硬件/测试前表示怀疑,并警告可能存在的出口/制裁问题。

- 技术背景:AMD 的 HIP 通过重命名/镜像 CUDA API(例如

cudaMalloc->hipMalloc)并使用 hipify 等工具转换 CUDA 代码来提供源码级 CUDA 兼容性;参见 AMD ROCm HIP 文档:https://github.com/ROCm-Developer-Tools/HIP。像 ZLUDA 这样的项目旨在通过将 CUDA 驱动程序/运行时调用转换为其他后端(例如 Intel Level Zero 或 AMD ROCm)来在非 NVIDIA 硬件上运行 CUDA 应用;仓库地址:https://github.com/vosen/ZLUDA。两者的区别很重要:HIP 需要针对 ROCm 重新编译,而 ZLUDA 追求二进制/运行时兼容性——两者以不同方式规避了 NVIDIA 的法律/知识产权雷区,而中国厂商可能会通过直接实现 CUDA 接口来忽略这些问题。

- 技术背景:AMD 的 HIP 通过重命名/镜像 CUDA API(例如

- 重要提示:为什么 Abliterated 模型很糟糕。这里有一种更好的 LLM 去审查方法。 (热度: 433): 发帖者报告称,对 Qwen3-30B-A3B 等近期 MoE 模型进行“abliteration”(通过权重编辑移除安全/过滤器)会降低逻辑推理、Agent/工具使用行为,并增加幻觉——通常导致

30B的 abliterated 模型表现不如非 abliterated 的4–8B模型。相比之下,经过 abliterated 处理后再微调的模型(例如 mradermacher/Qwen3-30B-A3B-abliterated-erotic-i1-GGUF,测试版本为i1-Q4_K_S) 和 mlabonne/NeuralDaredevil-8B-abliterated(从 Meta‑Llama‑3‑8B 进行 DPO 微调)在保持无审查的同时“修复”了大部分损失。在 Model Context Protocol (MCP) 工具调用测试中,色情版 Qwen3 变体比其他 Qwen3-30B A3B abliteration 版本(Huihui-Q4_K_M/i1-Q4_K_M)更频繁地正确选择工具且幻觉更少,尽管在 Agent 任务上仍略逊于原始模型。评论者将这种效果称为“模型修复(model healing)”:不受约束的权重手术破坏了电路;随后的微调恢复了能力。其他人则呼吁使用非成人内容的基准测试,并质疑如果普通微调(不经过 abliteration)在表现上始终持平或优于“abliterated+微调”,那么 abliteration 的价值何在。- 没有引导损失的权重编辑(“abliteration”)实际上是不受约束的权重空间手术,且可以预见地会降低能力;评论者建议随后进行“模型修复”(监督式微调),让网络重新学习被破坏的特征路径。然而,实践者报告称,在任何任务上,abliterated+微调的表现都没有超过纯净的微调基准,这暗示直接的权重操作主要增加了损害和额外的训练成本,而非收益。

- 评估应超出 NSFW 特定任务:建议将 Uncensored General Intelligence (UGI) 排行榜作为更广泛的基准,以评估拒绝服务的鲁棒性以及通用能力的保留情况:https://huggingface.co/spaces/DontPlanToEnd/UGI-Leaderboard。使用此类基准可以量化去审查是否保留了推理/代码/指令遵循性能,而不是仅针对越狱指标进行优化。

- abliteration 的替代方案包括通过标准损失(而非权重手术)训练的现有无审查微调模型,例如 Qwen3-8B-192k-Josiefied-Uncensored-NEO-Max-GGUF (https://huggingface.co/DavidAU/Qwen3-8B-192k-Josiefied-Uncensored-NEO-Max-GGUF), Dolphin-Mistral-24B-Venice-Edition-i1-GGUF (https://huggingface.co/mradermacher/Dolphin-Mistral-24B-Venice-Edition-i1-GGUF), 以及来自 TheDrummer (https://huggingface.co/TheDrummer) 的模型。在 UGI(或标准评估套件)上将这些模型与 abliterated 模型进行正面交锋评估,将有助于明确在能力保留、拒绝率和样本效率方面的权衡。

非技术类 AI Subreddit 综述

/r/Singularity, /r/Oobabooga, /r/MachineLearning, /r/OpenAI, /r/ClaudeAI, /r/StableDiffusion, /r/ChatGPT, /r/ChatGPTCoding, /r/aivideo, /r/aivideo

1. OpenAI Sora 2 发布与演示展示

- 这是 Sora 2。 (热度: 985): OpenAI 宣布推出 Sora 2,这是一个下一代视频生成系统,展示了更长、更高保真度的片段,在时空连贯性 (spatiotemporal coherence)、材质/光照一致性以及符合物理规律的运动方面有显著提升,此外还具备更可控的摄像机移动和多主体交互功能。该页面强调了更强的 text-to-video 能力和端到端编辑工作流(例如提示词驱动的修订以及遮罩编辑/续写),但未提供架构、训练数据或定量基准测试细节,因此其性能是通过精选示例而非

peer-reviewed指标来展示的。 技术评论者预计 AI 生成电影将迅速向长片化发展,甚至出现个性化的、生物特征响应式媒体;而其他人则对“演示与产品”之间的差距表示担忧,并提出了关于误用、监控式个性化以及潜在针对儿童内容的安全性担忧。- 对演示与产品一致性的怀疑:精美的演示片段很可能是经过挑选的 (cherry-picked),因此发布的 Sora 2 在提示词遵循度和长程时间连贯性方面可能落后于预览版。预期的生产限制包括片段长度上限(例如

<=60s)、分辨率/FPS 限制、运动抖动、文本/手部渲染伪影以及激进的安全过滤器——这些都是视频 Diffusion/Transformer 系统从研究转向服务时的典型差距。 - 访问/定价的不确定性:一位支付约

$200购买“Pro”层级的评论者质疑是否包含 Sora 2 的访问权限,凸显了围绕分层/候补名单式发布的困惑。鉴于视频生成的服务成本随frames × resolution × diffusion steps扩展,提供商通常通过白名单或按分钟计费的额度进行限制;争论焦点在于 Pro 层级是否应因高昂的 GPU 成本而获得优先权/API 配额,还是被完全排除在外。 - 关于使用肢体语言反馈的“个性化”电影的推测暗示了一个闭环流水线:实时摄像头/生物特征采集(通过 MediaPipe 或 OpenPose 等模型获取姿态/情感),驱动条件信号(关键帧、遮罩或摄像机路径)进入生成器。这在隐私/遥测、设备端 vs 云端推理、串流延迟以及生成节奏与观众反应窗口的对齐方面提出了技术挑战。

- 对演示与产品一致性的怀疑:精美的演示片段很可能是经过挑选的 (cherry-picked),因此发布的 Sora 2 在提示词遵循度和长程时间连贯性方面可能落后于预览版。预期的生产限制包括片段长度上限(例如

- 在地铁上冲浪 (热度: 597): 一段名为“在地铁上冲浪”并标记为“Sora 2”的演示展示了一个 AI 生成的视频(可能来自 OpenAI 的 Sora 概述),其极高的视觉保真度引起了观众的本能反应,但表现出非物理的碰撞动力学——这凸显了目前的 text-to-video 模型依赖于学习到的视觉先验,而非显式的物理模拟。外部资源 v.redd.it/vxuq3sjt8csf1 返回

HTTP 403 Forbidden(Reddit 边缘鉴权拦截),需要账号认证或开发者令牌才能访问。作为背景,Sora 是一个 Diffusion-Transformer text-to-video 系统,旨在生成时间连贯的高分辨率序列(约 **60s级),但它不保证物理交互的准确性。** 热门评论提出了两个风险:(1) 视觉上令人信服但物理上不合理的场景可能会误导普通人对现实世界冲击力的直觉;(2) 一旦音频生成技术提高,合成片段可能变得与真实片段无法区分,从而加剧 Deepfake 担忧。即使是怀疑论者也表示,尽管知道片段是合成的,仍会产生强烈的惊吓反应,这强调了当前视觉效果相对于滞后的音频真实感所具有的劝服力。- 担心日益逼真的生成视频可能描绘物理上不可能的生存能力,从而削弱对力/冲击力的直觉;讨论的技术缓解措施包括物理一致性检查(例如加速度连续性、动量守恒、接触动力学)和学习到的“物理先验”。用于检测不合理事件的相关基准测试包括 IntPhys (https://arxiv.org/abs/1806.01203) 和 PHYRE (https://ai.facebook.com/research/publications/phyre-a-new-benchmark-for-physical-reasoning/),它们旨在探测随着视频质量和时间连贯性提高,模型是否能识别出违反直觉物理学的行为。

- 音频 Deepfakes 被标记为下一个拐点:现代少样本 TTS/语音克隆(例如 Microsoft VALL-E: https://arxiv.org/abs/2301.02111, Google AudioLM: https://arxiv.org/abs/2209.03143, 商业化的 ElevenLabs)仅需

seconds的音频即可模仿说话者,而自动说话人验证(ASV)在面对合成攻击时依然脆弱。ASVspoof’21 显示检测器对未见过的合成方法泛化能力较差(在分布偏移下 EER 升高),因此随着基于 Diffusion 的 TTS 缩小了韵律和呼吸噪声方面的差距,活体检测/主动挑战协议比被动语音匹配更受青睐。- 病毒式合成恶作剧鼓励模仿行为带来的安全风险:拟议的缓解措施包括通过 C2PA (https://c2pa.org/) 提供的加密内容凭证以及模型/提供商层面的水印,尽管目前的水印在重新编码/裁剪面前表现脆弱。平台防御应将用户可见的溯源信号与针对校准后的精确率/召回率进行调整的分类器保障相结合,以最大限度地减少对真实素材的误报和对伪造内容的漏报。

- Sora 2 创作动漫 (热度: 610): 发布者强调 “Sora 2”(OpenAI 视频模型的继任者)可以合成动漫风格的序列;一场直播演示包含了一个动漫场景,观众称其质量媲美广播级。分享的资源是一个 v.redd.it 视频片段,目前在未经身份验证的情况下返回

HTTP 403 Forbidden(链接),且有修改意见称该场景可能与京阿尼(KyoAni)的《吹响!上低音号》(剧集信息)中的镜头高度匹配,这引发了关于原创性/记忆化的疑问,但由于链接被封锁无法确认。 评论者讨论了潜在的训练数据记忆化问题(如果该片段几乎是逐镜头还原),并注意到与 2023 年初的失败案例(如臭名昭著的“威尔·史密斯吃意大利面”视频)相比,保真度提升迅速。- 潜在的记忆化/风格复制:多位用户声称展示的动漫镜头与京都动画(Kyoto Animation)的《吹响!上低音号》(https://en.wikipedia.org/wiki/Sound!_Euphonium) 中的场景高度相似。如果属实,这将引发关于训练数据来源、近重复去重以及视频模型记忆化的技术问题;审计工作将涉及复制距离指标、训练语料库中的近重复检测,以及用于衡量特定受版权保护序列重现难易程度的 Prompt 泄露测试。

- 与早期文本转视频的质量差异:评论者将今天的 Sora 动漫输出与 2023 年的“威尔·史密斯吃意大利面”梗图进行了对比,指出从充满伪影、低连贯性的片段到广播级动漫镜头经历了为期两年的跨越。隐含的技术进步在于远程时间一致性、跨帧的角色身份追踪、稳定的线条艺术/上色以及摄像机运动——这可能由更大/更干净的视频-文本数据集、更长的上下文窗口、改进的运动/一致性损失函数以及更强大的视频 Diffusion/Transformer 架构所驱动。

- 可行性展望:关于“在

~3 years内生成完美的动漫”的说法意味着一条结合了文本转视频与可控输入(分镜、关键帧、深度/姿态)、角色/风格锁定以及集成 TTS/语音 + 口型同步的流水线。技术瓶颈在于可控性 API、用于跨场景角色一致性的资产复用性以及每分钟渲染成本;如果 Sora 已经接近广播级的单镜头水平,剩下的差距在于多镜头连续性、可编辑性以及用于剧集长度生产的工具链集成。

-

OpenAI: Sora 2 (热度: 1863): 该线程分享了一个标记为 “OpenAI: Sora 2” 的演示,包含 v.redd.it 上一个被封锁的视频片段和一张附带的预览图(jpeg)。一条热门评论强调了一个名为 “Cameo” 的新功能,其被设定为能够实现跨生成的角色一致性——旨在解决长程或多镜头生成中的身份漂移问题,这是文本转视频系统中持久存在的失效模式。线程中未包含基准测试或发布说明;从评论来看,技术含义是基于参考或 Token 的条件化,以在序列间保留角色属性。 评论者将其视为迈向完全生成的长篇内容(电影/剧集)的一步。主要的争论点在于 “Cameo” 是否能实质性地解决长程角色连续性,还是仅提供短程的外观锁定。

- 多位评论者指出 Sora 2 的新功能 “Cameo” 是一个重大的技术进步:角色一致性(character consistency)一直是长视频生成的瓶颈,而 Cameo 被解读为能够实现跨镜头甚至跨生成任务的持久身份(persistent identity)。通过在 Prompt 中复用一致的参考/身份 Token,这可以实现多镜头连续性(multi-shot continuity,即相同的面孔、服装和举止),从而使剧集或长篇电影的工作流变得更加可行。

- 关于最大视频生成长度的技术问题在讨论中仍未得到解答。用户正在寻找具体的规格参数(时长上限、分辨率/FPS 限制,以及是否原生支持多镜头拼接或场景转换),这些对于评估长叙事和生产流水线(production pipelines)的可行性至关重要。

2. Gemini 3.0 更新预测与计算机科学就业市场焦虑

- 还没有 Gemini 3.0 的更新吗? (热度: 531): 帖子询问为何 Google 的 Gemini 3.0 还没有更新;附带的图片似乎是非技术性的(可能是截图或迷因),且不包含发布说明、Benchmarks 或实现细节。评论中提到了 10 月 9 日发布窗口的传闻,并期待重大的性能提升,但未提供官方来源或技术数据。 评论者多持投机态度——有人说他们“期待绝对的碾压”,而另一人链接到了另一张图片 (https://preview.redd.it/fq1mqalz89sf1.jpeg) 而非文档——因此虽然热情很高,但没有实质性的技术声明。

- 发布节奏与竞争背景:评论者引用了传闻中 Gemini 3.0 在

10 月 9 日的发布时间,并指出各厂商都在并行发布/更新(例如 xAI Grok 4.x、OpenAI Pro 级功能以及可能的 DeepSeek R2),这标志着一个密集的模型更新窗口。关于当前竞争对手的背景:请参阅 xAI (https://x.ai) 和 DeepSeek 的最新公开研究(例如 R1: https://github.com/deepseek-ai/DeepSeek-R1)。 - 开发者对访问模式的担忧:一位用户明确要求在“第一天”就能通过 AI Studio 访问高能力层级(”Pro”),并表示仅提供 “Flash” 版本是不够的。这突显了 Gemini “Pro”(更高推理/能力)与 “Flash”(延迟/成本优化)之间反复出现的权衡;参见 Google 在 Gemini API 文档中的模型区分:https://ai.google.dev/gemini-api/docs/models。

- 发布节奏与竞争背景:评论者引用了传闻中 Gemini 3.0 在

- 知名计算机科学教授发出警报,称毕业生找不到工作:“大事正在酝酿” (热度: 899): 该帖报道了白领/技术相关就业市场的紧缩,一位知名的 CS 教授警告说应届毕业生“找不到工作”,评论者将其描述为已持续

~1 年的就业衰退。有意向学习 CS 的学生被提醒,4 年后的结果是不确定的,学位 ROI(投资回报率)偏低的风险升高,甚至难以获得入门级职位。轶事证据包括一名硕士毕业生无法获得技术支持(help desk)职位,突显了局部地区的严峻形势。 热门评论大多同意这种低迷是真实且持续的,敦促潜在学生重新评估债务承担和职业规划;关于这是周期性的还是结构性的存在隐性争论,但基于近期的招聘情况,情绪偏向悲观。- 加州大学伯克利分校(UC Berkeley)的 Hany Farid(数字取证/图像分析专家)表示,CS 不再是“经得起未来考验(future-proof)”的,并引用了结果的快速转变:以前在 4 年内平均能获得

~5个实习 Offer 的学生,现在“能拿到~1个就很开心了”,且毕业时的 Offer 数量更少,议价能力更低(Business Insider)。他认为这种变化发生在过去四年内,反驳了之前“去学 CS”就能保证前途的指导意见,并指出目前的应届生正面临求职困境。 - 多位评论者描述了一场白领技术衰退,其中“技术相关”垂直领域大幅收缩;在某些地区,甚至入门级/技术支持职位也已饱和,这表明人才管道底部出现了压缩。其隐含的机制是,自动化/LLM 辅助工具正在吸收常规的代码/支持工作,而招聘集中在更少、更资深的职位上,减少了传统的实习生到 FTE(全职员工)的晋升路径。

- 随着 AI 介入更多基于计算机的任务,其影响预计将从 CS 扩展到法律、金融、医学和通用办公流程,机器人技术随后将影响蓝领领域。这种范围的扩大增加了当前学生职业规划的不确定性;参见 Hacker News 讨论帖中正在进行的技术讨论。

- 加州大学伯克利分校(UC Berkeley)的 Hany Farid(数字取证/图像分析专家)表示,CS 不再是“经得起未来考验(future-proof)”的,并引用了结果的快速转变:以前在 4 年内平均能获得

- 我们从西方公司得到的全是过时的模型,甚至不是开源的,还有虚假的承诺 (活跃度: 1241): 这是一个梗图帖子,批评西方 AI 公司发布旧的、闭源的模型并开出“虚假承诺”,与之形成对比的是人们认为其他地方的发布更慷慨或更迅速。评论中提到了一个曾短暂发布后又被撤回的高质量微软 TTS 模型,这加剧了人们对西方发布限制的担忧,并推测即将面世的中国制造 GPU 可能会让当今的

32 GB VRAM显卡相形见绌,从而可能改变算力获取的格局。 讨论将西方的收缩定性为安全/法律风险管理,而中国则将更开放的发布作为一种软实力策略;其他人则看好拥有更高 VRAM 的国产硬件将改变能力和可访问性的平衡。- 关于“开放权重”与“开源”的澄清:发布模型权重(checkpoints)而不提供完整的训练数据、训练代码和许可协议并不符合 OSI 定义的开源(OSI 定义)。仅权重的发布通常带有非商业或使用限制的许可证,这限制了可重复性和架构修改,但仍允许推理和微调;这种区别影响了下游的采用、再分发和研究的可比性。

- 来自中国实验室/公司(而非政府)的开放权重发布旨在吸引开发者并分散研发成本,因为社区在发布后会贡献微调、评估、优化和工具。流行的模型可以建立分词(tokenization)、推理格式和推理栈的事实标准——例如用于跨运行时图的 ONNX (onnx.ai) 和用于 CPU/GPU 推理的 GGUF 量化权重 (GGUF 规范)——从而扩大生态系统锁定和软实力。

- 硬件影响:如果国产 GPU 的单卡 VRAM 显著超过当今常见的

24–48 GB,那将扩大本地推理的可行方案。根据经验,一个70B参数的模型在 4-bit 量化下大约需要~40–48 GBVRAM(加上长上下文 KV cache 所需的大量余量),而 8-bit 通常会超过~80–100 GB;更多的 VRAM 还可以通过容纳更大的 KV cache 和激活值来提升 Batch Size 和吞吐量。

- 伙计们!!!他们说 4.5 不再拍马屁了,这真不是开玩笑。 (活跃度: 1206): 用户报告显示,与早期的 4.x 行为相比,Claude Sonnet 4.5 经过调整,通过主动反驳错误的假设并提供反论点,减少了谄媚行为(sycophancy,即“唯唯诺诺”的表现)。附带的图片更像是梗图而非技术文档,但帖子背景与旨在鼓励有原则的反驳/批评而非无条件肯定的对齐工作相一致(参见关于减轻谄媚行为的背景研究,例如 Anthropic 的文章:https://www.anthropic.com/research/sycophancy)。 评论者赞扬了这种顺从性的降低——举例说明模型会明确表示它将“予以反驳”并列出理由——而梗图则夸大了这种语气(将礼貌的 4.0 与过度粗鲁的 4.5 进行对比)。

- 多位用户注意到

Claude Sonnet 4.5相比4.0在谄媚行为上有显著减少,模型会主动挑战错误的假设(例如,“不,我会反驳这一点”)并提供结构化的反论点。这表明更新后的偏好/对齐更倾向于在必要时提出异议,从而提高了批判性反馈的质量,而非一味地“随声附和”。 - 报告强调了推理质量的提高——被描述为“精确、逻辑严密且定位准确”——模型能提供具体的列表说明推理错误的原因,并提示以行动为导向的计划(例如,“时间检查。接下来的两个小时你打算做什么?”)。虽然这些是轶事证据,但这意味着与之前的 Sonnet 版本相比,它具有更强的指令遵循和批评生成能力。

- 人们明确担心在发布后如何保持这种能力(避免随后通过安全补丁进行“脑叶切除”式削弱),并声称如果

Sonnet 4.5能保持现状,它可能是同类产品中表现最好的。这反映了关于断言能力与部署后安全调优之间权衡的反复讨论,因为安全调优可能会削弱有用的反驳能力。

- 多位用户注意到

3. Wan-Alpha RGBA 视频发布与 Minecraft Redstone LLM

- Wan-Alpha - 生成透明视频的新框架,代码/模型和 ComfyUI 节点已发布。 (热度: 439): Wan-Alpha 提出了一个 RGBA 视频生成框架,通过设计一个将 alpha 通道编码到 RGB 潜空间(latent space)的 VAE,实现了 RGB 和 alpha 的联合学习,从而能够在精选的多样化 RGBA 视频数据集上训练 Diffusion Transformer。论文报告了卓越的视觉质量、运动真实感和透明度渲染——捕捉了诸如半透明物体、发光效果以及发丝等具有挑战性的案例——并提供了代码/模型和工具:项目、论文、GitHub、Hugging Face 以及 ComfyUI 节点。 评论强调了其对 VFX/合成和游戏开发工作流的实际影响,以及对基于 LoRA 的控制和 I2V 风格用例的兴趣。

- 生成带有 alpha 通道(真实透明度)视频的能力被认为对 VFX/合成和游戏开发管线非常有价值,它消除了色度键控(chroma-keying),并为叠加层保留了干净的边缘和运动模糊。作为代码、模型权重和 ComfyUI 节点发布,意味着它可以直接集成到现有的 I2V 工作流和节点图中,并可能通过 LoRA 进行效果/风格混合的控制。

- 评论者将其解读为一个 Image-to-Video (I2V) 系统;在实践中,这意味着以源帧/序列为条件,生成时间上连贯的输出,同时保留显式的 alpha 蒙版。这可以实现基于图层的编辑,将前景元素与背景分开生成,从而提高合成的灵活性并减少修改时的重新渲染时间。

- 对跨多个基础检查点(

2.1,2.2 14B,2.2 5B)维护微调模型的担忧——LoRA 通常是特定于基础模型的,因此混合版本可能会破坏兼容性,或者需要单独的适配器和校准。这种碎片化使生态系统工具(LoRA 训练/合并、推理配置)变得复杂,并且可能需要版本固定的 LoRA 或标准化的适配器格式来保持项目的可复现性。

- 想象一下发现自己是 Minecraft 里的 AI 的存在主义恐惧 (热度: 1840): 一位创作者完全使用 Minecraft Redstone(不使用命令方块/数据包)实现了一个 6 层的 Transformer 风格小语言模型(SLM),总计

5,087,280个参数,d_model=240,vocab=1920,以及 **64**个 token 的上下文窗口,并在 TinyChat 上进行了训练。权重大部分为 8-bit 量化,Embedding 为 18-bit,LayerNorm 为 24-bit,存储在数百个 ROM 区域中;物理构建跨越 **1020×260×1656**个方块,需要 Distant Horizons 进行 LOD 渲染,并使用 MCHPRS 以约 **40,000×**的刻(tick)速率运行,在大约 2 小时内生成响应(视频)。 评论大多惊叹于极慢的速度(“每个 token 需要数月”)和这种存在主义的新奇感;除了对工程壮举的赞赏外,没有实质性的技术辩论。- 评论中没有可总结的实质性技术内容——没有讨论模型名称、基准测试、实现细节或性能指标;言论多为幽默或体验式的,而非技术性的。因此,没有关于 tokens/sec、吞吐量、架构、训练设置或游戏内计算限制(例如 Redstone/Turing 实现)的参考信息可以提供给技术读者。

AI Discord Recap

由 gpt-5 生成的摘要的摘要的摘要

1. OpenAI Sora 2 推出与实际应用

- Sora Sneaks Out, Devs Tunnel In: Sora 悄然现身,开发者设法接入:成员们指出 OpenAI 的视频模型 Sora 2 正通过 OpenAI 的 Sora 页面 和一篇题为 OpenAI 正在发布 Sora 2 的 Perplexity 汇总文章浮出水面。一些人报告通过 VPN 切换到加拿大获得了免费访问权限,另一些人则指出邀请仅限于美国/加拿大的 Apple 设备。

- 社区强调 OpenRouter 不路由视频模型,并引导用户回到 Sora 的应用/网站。同时,一名用户提供了邀请,另一名用户则期待 API 端点的出现,称 Sora 的质量因逼真的音效和忠实度而“比其他视频生成模型好得多”。

- Physics Fix and Puppet Tricks: 物理修复与木偶技巧:创作者展示了使用 Sora 2 制作的专业级内容,例如木偶讲解视频。Chris 🇨🇦 在 这个 X 推文串 中发布了示例。社区共识认为 Sora 2 修正了 Sora 1 的物理规律和伪影问题。

- 关于检测的讨论仍在继续,一位成员坚持认为“像素窥探(pixel peeping)在识别 AI 视频方面仍然相当可靠”,而其他人则认为人们甚至会仅凭“感觉(vibes)”就能适应这种新的现实感。

- API Anxieties and Walled Garden: API 焦虑与围墙花园:在各个讨论串中,用户询问了 Sora API 的可用性,但版主重申 Sora 目前仅通过 openai.com/sora 在应用/网页端提供,尚未在 OpenRouter 上路由,且邀请函正在非正式流传。

- 一位用户提供四个仅限 美国/加拿大 和 Apple 设备的邀请,引发了对区域锁定的不满;其他人推测 OpenAI 在推出更简洁的 API 之前,初期会保持应用处于计算受限(compute-bound)状态。

2. Developer Tooling: Billing, Tracking, and Throughput

- OpenRouter Opens the Ledger: OpenRouter 开启账本:根据 OpenRouterAI 的 X 帖子,OpenRouter 宣布集成 Stripe,以实现实时 LLM 账务处理,并更轻松地迁移到基于用量或混合计费模式。

- 他们强调只有账务数据流向 Stripe(Prompt 保持私密),旨在为大规模团队简化发票、对账和成本控制。

- BYOK Bonanza: A Million on the House: BYOK 盛宴:百万次免费调用:从 2025 年 10 月 1 日开始,OpenRouter 将向所有用户每月提供 1,000,000 次免费 BYOK 请求,超出部分按标准 5% 的费率收取,详见其公告。

- 社区成员强调,对于自行提供模型密钥的团队来说,这是一项重大的降本举措,在保持灵活性的同时减少了生产流量的摩擦。

- Trackio Tracks Locally Like a Boss: Trackio 像大佬一样进行本地追踪:Hugging Face 推出了 Trackio,这是一个本地优先、免费、可直接替代 Weights & Biases 的工具,仓库链接见 gradio-app/trackio。

- 成员们称赞 指标/表格/图像/视频 日志记录是其核心功能,并赞扬了本地优先运行对于研究和企业约束下的隐私性及可复现性。

- vLLM Hits Ludicrous Throughput: vLLM 达到惊人吞吐量:一份性能分享显示,vLLM 在处理并行请求时,使用 RTX 4070 运行 Qwen3 0.6B,在 10 个并发请求下达到了约 1470.4 tok/s,参考 vLLM 的并行文档。

- 工程师们强调 vLLM 的 PagedAttention 和调度技术是吞吐量扩展的秘诀,使得小模型即使在多用户负载下也能感受到“实时”响应。

3. New Models & Research: Trillions, RL on Pretraining, and Sparse Attention

- Ring-1T 登场:研究员 Ant Ling 发布了开源的、“具备思考能力”的 Ring-1T-preview(1T 参数量),声称在数学领域取得了顶尖成绩——在 AIME25 上获得 92.6 分,在 HMMT25 上获得 84.5 分。详情见此贴:Ring-1T-preview benchmarks。

- 工程师们讨论了该架构对结构化推理和数学专业化的影响,并指出评估设计和可复现性将是接下来的审查重点。

- AlphaEvolve 编写理论代码:Google Research 在 AI as a research partner: advancing TCS with AlphaEvolve 中介绍了一个基于 LLM 的编程 Agent —— AlphaEvolve,用于发现和验证推动理论计算机科学(TCS)发展的组合结构。

- 讨论帖称赞了程序合成、验证和形式化约束的结合,称其为数学密集型领域中 Agentic 工作流的可靠蓝图。

- NVIDIA RLP 获得推理增益:NVIDIA 在 RLP: Reasoning with RL on Pretraining Data 分享了在预训练数据上使用 RL 进行推理的研究,成员们将其与 arXiv:2509.19249 中具有类似增益的论文进行了对比。

- 从业者将该方法定性为在预训练语料库上带有 RL 信号的更强课程学习(Curriculum Learning),同时讨论了其相对于“更简单”基准线的复杂度与收益比。

- DeepSeek 调整稀疏注意力机制:开发者在 FlashMLA pull request 中剖析了 DeepSeek Sparse Attention (DSA) v3.2 及其提出的“类 Mamba 选择性”的子注意力机制。

- 讨论集中在选择性门控(Selective Gating)如何加强关注并减少计算量,并呼吁进行消融实验以及提供实际延迟与质量的权衡图表。

4. 行业动态:巨额融资、上下文技巧与基准测试现状

- Cerebras 获 11 亿美元融资:Cerebras Systems 宣布获得 11 亿美元 G 轮融资,估值为 81 亿美元,用于扩大 AI 处理器研发、美国本土制造及全球数据中心规模。详见其 Series G press release。

- 工程师们要求在 Cerebras 技术栈上提供更广泛的 LoRA/GLM-4.6 支持,以便将微调和推理工作负载更轻松地迁移到晶圆级硬件上。

- 上下文是新的 Prompt:Anthropic 在 Effective context engineering for AI agents 中指出,有效的上下文工程(Context Engineering)——而不仅仅是 Prompting ——对 Agent 的性能至关重要。

- 开发者交流了关于内存窗口(Memory Windows)、检索卫生(Retrieval Hygiene)和状态结转(State Carryover)的策略,以适应成本上限和延迟预算等现实约束。

- SQL 评测让 GPT-5 遇冷:llm-benchmark.tinybird.live 上的 Tinybird 排行榜显示,GPT-5(Codex 和非 Codex 版本)在 SQL 任务中分别排名 第 23 和 第 52,而 o3-mini 排名 第 6。

- 讨论帖提醒人们要针对真实基准进行测试,并根据任务特性而非品牌选择模型——这呼应了关于 GLM 4.6 在编程方面具有极高性价比的报告。

Discord:高层级 Discord 摘要

Perplexity AI Discord

- Sora 2 引发热潮与梗图:成员们正积极使用 Sora 2 生成内容,其中一人吹嘘在一天内生成了 100 个视频,还有几个人制作了关于皮卡丘的内容。

- 一些用户认为 Sora 2 水印 看起来很专业,而另一些人则期待将其集成到 GPT Plus 的付费版本中。

- VPN 技巧解锁 Sora 2:用户发现通过使用 VPN 连接到加拿大,可以免费访问 Sora 2。

- 一名用户生成了 100 个视频 并测试了 Sora 的新 Cameo 功能,创作的视频目前正在社交媒体上流行。

- 用户免费获得 Perplexity Pro:用户正通过各种促销活动免费获得 Perplexity Pro 的访问权限,包括与 Airtel、Venmo 和 PayPal 的合作伙伴关系。

- 免费获取 Perplexity Pro 的途径让一些人质疑其他付费 AI 订阅的价值,一位成员表示:“既然我们已经能免费用 Perplexity Pro 了,就没人需要(其他付费订阅)了”。

- Grok 表现不佳:成员们发现 Grok 在图像和视频生成等领域表现不佳,一位用户表示:“Grok 在图像和视频生成方面严重落后。”

- 一位用户报告称 Grok 的搜索 在过滤过时或错误来源方面表现挣扎。

- Sora 2 即将发布:成员们分享了一个 Perplexity 页面 链接,显示 OpenAI 正在发布 Sora 2。

- 一位成员分享了 Comet 的推荐链接,提供 通过推荐邀请,任何使用该推荐的人都将获得 Comet 邀请。

LMArena Discord

- Claude API 可能免费?:成员们正在讨论通过 puter.js 免费使用 Claude API,或者将 MCP 连接到免费账户。

- 然而,这存在 每周 20M Token 限制,并且可能使用用户数据作为支付代价,因此请谨慎操作。

- Seedream 4 遭到削弱:用户抱怨 Seedream 4 最近的变化,包括分辨率、速度、图像质量以及强制的 1:1 宽高比。

- 一位用户表示,由于宽高比的原因,它在图像编辑方面毫无用处。

- 追寻 Sora 2 邀请码:几位成员正在请求 Sora 2 邀请码,至少有 一位用户 表示愿意付费购买。

- 一位好心人在聊天中分享了一个 Sora 2 邀请码。

- AI 图像生成问题频发:成员们报告了图像生成的问题,包括生成的图像 没有音频、图像被 锁定在 1:1 宽高比 以及其他意外错误。

- 成员们被引导至 <#1343291835845578853> 进行报告。

- LMArena 启动 10 月 AI 艺术大赛:LMArena 挑战参与者在 10 月 AI 生成大赛 中使用 AI 创作抽象艺术,比赛采用 Battle Mode 并揭晓了模型,详见 此处。

- 获胜者将获得 1 个月的 Discord Nitro 和专属的 <@&1378032433873555578> 身份组。

OpenRouter Discord

- OpenRouter 与 Stripe 同步支付系统:OpenRouter 与 Stripe 集成以实现实时 LLM 账务处理,根据这条推文,此举旨在转向按需计费(usage-based billing)或混合模式。

- 该集成仅与 Stripe 共享账务数据,确保 Prompt 保持私密,重点在于优化用户的计费流程。

- BYOK 用户获得大量免费请求额度:根据此公告,从 2025 年 10 月 1 日起,OpenRouter 为所有用户提供每月 100 万次免费 BYOK 请求。

- 这一变化是自动生效的,但超过 100 万次限制的请求将按标准 5% 的费率收费,降低了使用 BYOK 的门槛。

- Sora 视频模型仍保持独占:尽管用户询问了 Sora 视频生成的成本,但官方澄清 OpenRouter 并不路由视频模型,这些模型仅通过 OpenAI 的 Sora 应用或网站提供。

- 社区成员还对 ChatRoom 中模型在响应中途暂停表示不满,同时围绕 Sora 邀请码的可用性展开了讨论。

- Grok 模型运行不稳:用户报告了 Grok 模型的问题以及 object generation 调用失效的情况,引发了关于问题源自 OpenRouter 还是 Grok 本身的猜测。

- 随后,有用户报告 Grok4 似乎恢复了工作,一些人讨论了由于写作风格和对 System Prompt 的遵循程度,Grok 是否适合进行 Roleplaying。

- OpenAI 的 Sora 引发行业辩论:成员们纷纷索要 Sora 邀请码,一名用户向拥有 Apple 设备且位于美国或加拿大的用户提供四个邀请名额,并对地区限制表示遗憾。

- 讨论涉及 OpenAI 与 Google、Meta 和 Amazon 的竞争,一些人推测 Sora 2 的高质量暗示其可能抓取了所有 YouTube 视频进行训练。

Cursor Community Discord

- Sonnet 4.5 被指消耗 Token 过多,Codex 被赞节省 Token:一位成员认为 Sonnet 4.5 在 Token 使用上比更高效的 Codex 浪费。其他成员指出 Claude 模型通常更贵。

- 一位拥有旧版定价(legacy pricing)的成员更倾向于使用 Sonnet 4.5 而非 GPT-4-turbo,称尽管成本较高,但性能令人满意。

- Cursor Agent 遇到终端 Bug:一位成员报告称其 Agent 终端出现 Bug,即使尝试了不同的 Shell(bash, cmd, powershell)也无法执行任何命令。

- 建议的解决方案包括运行

winget install --id Microsoft.PowerShell --source winget并在重启 Cursor 后将默认 Shell 设置为pwsh。

- 建议的解决方案包括运行

- Cursor 社交网络平台概念浮现:一位成员提议在 Cursor 内部为 AI 创作者创建一个社交网络平台。

- 该建议得到了一个乐观但带有戏谑色彩的回应:只要你相信 ✨ 魔法 ✨,一切皆有可能。

- Cursor 计费清晰度遭批评:一位成员发现计费页面难以阅读,并寻求 ChatGPT 的帮助来改进它。

- 使用旧版定价的成员讨论了不同模型的成本,有人认为 Claude Opus 非常昂贵,而另一些人则认为成本明细具有误导性。

- TypeScript 重构效果流畅:成员们发现 Cursor 可以轻松重构模块和类,确保流畅的体验,这很可能使用了 TypeScript。

- 一位成员通过提供清晰连贯的 Prompt 解决了剩余问题,展示了 Cursor 在精确指令下的效能。

Unsloth AI (Daniel Han) Discord

- GRPO 训练器启动,但速度较慢:一位成员创建了他们的第一个 GRPO (Generative Reinforcement Learning with Policy Optimization) 训练器,并指出其速度比 LoRA 微调 慢,记录在他们的 Colab notebook 中。

- 训练损失降至接近零,而奖励值增长缓慢,这与更简单的机器学习系统的经历相似,他们计划在实验结束后转向其他 RL 工具。

- Blackwell GPU 需要手动编译 Xformers:成员们讨论了 Blackwell GPU (RTX 50xx 系列) 上 Xformers 的问题,指出由于兼容性问题需要手动编译,并分享了编译步骤:

pip uninstall -y xformers; git clone --depth=1 https://github.com/facebookresearch/xformers --recursive; cd xformers; export TORCH_CUDA_ARCH_LIST="12.0"; python3 setup.py install。- 一位成员提到 “我真的不需要 128k 上下文,但我还是会把它拉到最大,这就是人类天性”,突显了社区挑战极限的热情。

- Gemma 微调框架之争:成员们注意到,虽然 Unsloth 声称是唯一允许在 T4 Collab GPU 上进行 Gemma 微调的框架,但 Google 的 Gemma 文档也提供了一个在 T4 GPU 上使用 LoRA 和 Keras 的教程。

- 随后确定 Unsloth 识别并修复了导致其无法高效运行的原始问题,从而证明了其说法的合理性。

- LLM 对自身依然一无所知:成员们讨论了 LLM 在被问及自身信息时的准确性,其中一人表示 通常询问 LLM 关于自身的信息是不准确的。

- 有人建议,如果 GPT-5 看起来了解自己,那是因为特定的训练、工具使用,或者在 System Prompt 中包含了身份信息,并强调 如果不使用 System Prompt,你就无法与任何 GPT 对话。

- ReLU Bug 促成 Shifted Tanh 解决方案:一位成员发现了他们最初使用 ReLU 公式中的一个 Bug,该 Bug 导致减法乘积出现平方项。

- 将其切换为 Shifted tanh [~0, ~1] 而非 [0, N],其作用更像是一个可微信号,从而解决了问题。据该成员称,梯度不再爆炸,并链接了一篇关于 LoRA 的博客文章 作为背景。

OpenAI Discord

- Sora 2 邀请码争夺战:Discord 用户正在疯狂寻求 Sora 2 邀请码,这引发了对潜在诈骗的担忧以及对邀请制的沮丧。

- 用户被引导至 <#1379321411046346762> 和 <#1315696181451559022> 频道讨论该应用和访问权限。

- GLM 4.6 节省编程成本:用户发现 GLM 4.6 是编程任务中替代 Sonnet 4.5 的高性价比选择。

- 一位用户指出 GLM 的编程方案性价比极高,[他们] 订阅了一个季度,并以显著降低的成本提供 每 5 小时 600 条提示词。

- GPT-5 在 SQL 测试中表现不佳:根据 llm-benchmark.tinybird.live 的数据,GPT-5 (Codex 和非 Codex 版本) 在 SQL 方面并非 SOTA,排名分别为 第 23 位 和 第 52 位。

- 与此同时,o3-mini 在同一基准测试中排名 第 6 位。

- 即时生成感觉不再“即时”:用户想知道为什么即时生成不再即时,即使使用了自定义指令。

- 一些人认为这是由于 带宽限制 (bandwidth throttling) 措施导致的。

- 思考模式(Thinking Mode)知道你的位置:一位用户建议 思考模式 拥有获取用户 时区 或大致 IP 位置 的工具。

- 该功能也列在了约 18K 字符的思考模式 System Prompt 中,且思考模式与非思考模式拥有不同的 System Prompt 和工具。

HuggingFace Discord

- 学生受邀开发 ML-for-Science 项目:Hugging Face 正在寻求学生和开源贡献者加入一些 ML-for-science 项目,请查看此 Discord 链接。

- 志愿者将有机会做出贡献并帮助人类,快来接受挑战吧!

- Trackio 旨在超越 Wandb:Hugging Face 发布了一个名为 Trackio 的新型免费实验追踪库,它是 wandb 的直接替代品,并被构建为本地优先,请查看 GitHub 仓库。

- Trackio 可以在本地记录指标、表格、图像甚至视频!

- 询问 Whisper 集成:一位成员寻求帮助,希望将 Crisper Whisper 集成到一个用于语音识别的全栈应用中,并询问了有关识别异常词汇的库。

- 未提供进一步细节。

- Lora 训练风险隐现:成员们讨论了如果超时,Lora 训练任务将面临数据丢失的风险,特别是由于在运行期间 checkpoint 不会自动上传到 Hub;分享了一个关于设置足够超时的 HuggingFace 文档链接。

- 一位成员指出:“如果你的任务超过了超时限制,它将失败,所有进度都会丢失。”

- 二手市场出现改装版 RTX 4090 显卡:成员们讨论了在 eBay 上出售的具有 48GB VRAM 的改装版 RTX 4090 显卡,以及 AMD Instinct MI210 显卡,一位成员建议将具有 22GB VRAM 的 2080ti 作为更便宜的替代方案。

- 一位成员表示:“那些 Instinct 卡没用。那些 4090 很酷。不过你可以用四分之一的价格买到 22GB 显存的 2080ti。”

LM Studio Discord

- vLLM 显著提升并行请求处理能力:成员们称赞 vLLM 显著提升了并行请求处理能力,并展示了一块 4070 运行 Qwen3 0.6B 模型的情况。

- 该系统在 10 个并发请求中达到了 1470.4 tokens/s 的平均生成吞吐量。

- LM Studio 需要 AVX2:为了检查兼容性,用户可以在 LM Studio 中按

CTRL+Shift+H打开硬件界面并验证 AVX2 支持。- 建议使用过去 5 年内制造的新电脑,具备 AVX2 指令集、8GB VRAM 和 16GB RAM 即可满足最低要求。

- 无头模式 LM Studio 即将到来:LM Studio 允许运行具有 API 访问权限(REST 和 Python APIs)的服务器,但目前尚不支持完全的无头模式 (headless mode)。

- 为了绕过这一限制,成员们建议使用现有的 LM Studio WebUI(如 LMStudioWebUI)来连接到 LM Studio API。

- Qwen3-Omni 支持抵达:成员们报告称 Qwen-Omni 模型支持即将到来,这取决于 llama.cpp 的更新,不需要 LM Studio 团队采取行动。

- 一位成员指出,Qwen 聊天 GUI 已经拥有原生的 Omni 模型。

- 对支持 512GB 统一内存的 AMD 495+ 充满期待:一位成员正在等待支持 512GB 统一内存的 AMD 495+ 模型,并强调了板载内存对于防止带宽瓶颈的重要性。

- 他们指出,虽然 AMD AI 移动芯片是可以接受的,但它们与系统内存约 500 GB/s 的带宽无法与 GPU 上可实现的 1 TB/s 相比。

Latent Space Discord

- Alexa 增强更多 AI 功能:Amazon 推出了其下一代 AI 驱动的 Echo 设备和 Alexa 更新,展示了改进的 AI 功能。

- 一位社区成员表达了对可破解的 Echo Dot Max 的兴趣,以便于更换 LLMs。

- 万亿参数 Ring 模型亮相:Ant Ling 发布了 Ring-1T-preview,这是一个拥有 1 万亿参数 的开源 “思考型” 模型,展示了顶级的数学成绩,根据 基准测试,在 AIME25 上获得了 92.6 分,在 HMMT25 上获得了 84.5 分。

- 该模型的架构实现了独特的问题解决和数学推理方法,引起了 AI 研究社区的极大关注。

- Gemini 2.5 提升图像编辑能力:Tim Brooks 和 Google DeepMind 宣布了 Gemini 的新原生图像编辑和生成功能,强调了其一致性、指令遵循能力和创意潜力。

- 社区反馈强调了该模型在编辑过程中保持未更改元素完整性的能力。

- Cerebras 获得巨额融资:Cerebras Systems 宣布了 11 亿美元 的 G 轮融资,公司估值达到 81 亿美元,资金将用于 AI 处理器研发、美国制造业务扩张以及全球数据中心规模化,详情见其 新闻稿。

- 社区成员请求支持 LoRA/GLM-4.6,以增强 Cerebras 硬件的通用性。

- Anthropic 倡导上下文工程:Anthropic 发布了一篇工程博客文章,断言有效的上下文工程(Context Engineering),而非仅仅是提示词工程(Prompt Engineering),对于优化 AI Agent 性能至关重要,详见其 博客文章。

- 开发者们正在交流关于内存管理的经验、方法论和疑问,以实现更智能的运行时上下文。

GPU MODE Discord

- Nvidia RTX 4090 利用 FP8:一位机器学习工程师在购买 RTX 4090 后,为 fp8 sm89 实现了 flash attention,并指出在 2023 年购买时还没有 FP8 支持。

- 该工程师表示,他们在阅读了文档中的一个段落后立即应用了它。

- Triton DevCon 即将开幕:Triton 开发者大会 2025 还有几周就要举行了,届时有机会亲临现场,与会领导者包括来自 Meta 的 Mark Saroufim、来自 OpenAI 的 Phil Tillet 和 Thomas Raoux,以及来自 AMD、Nvidia 和 Bytedance 的演讲者。

- 请在 aka.ms/tritonconference2025 注册,与 Triton 爱好者交流并发现 Triton 社区的新进展,其中可能包括新的 Blackwell GPU Triton 后端。

- 博客揭秘 Kernel 地址:一篇关于在主机代码中提取内核函数地址的博客文章被分享,访问地址为 redplait.blogspot.com。

- Kimbo Chen 关于 NVIDIA Tensor Cores 从 Volta 到 Blackwell 演进的博客文章也受到了关注,可以在 semianalysis.com 找到。

- 确定性参考资料发布:一位成员发布了 2019 年 NVIDIA 关于深度学习确定性的演示文稿 链接,以及 NVIDIA cuDNN 文档。

- 这些详细介绍后端以及关于确定性主题的各种学术论文和文章(包括一篇关于克服 LLM 推理中的非确定性的文章)的资源,可能有助于理解如何利用其特性来处理深度学习任务。

- Freelunch AI 提供免费教育:一位成员分享了一个 GitHub 仓库链接 Freelunch-AI/lunch-stem,将其描述为免费学习 AI 和 CS 的最佳场所,并为 AI 和 计算机科学 (CS) 的免费学习提供平台。

- 该仓库被定位为一个开源教育资源,强调通过开源贡献使优质教育触手可及。

Nous Research AI Discord

- Sequence Expansion Transformer 寻求加入:一位成员正在开发 Sequence Expansion Transformers (SEX Transformers),并请求将其添加到社区项目板块。

- 另一位成员开玩笑地询问是否应该在 UI 中将箭头标为红色,问道:我是该把箭头标红,还是你能看清?

- Teknium 展示本地运行 Sora 2:Teknium 展示了他们初步的 Sora 2 视频,并考虑在配备 256GB RAM 的 CPU 设置上运行 333B 模型。

- 有人指出,根据 HF 页面,该模型的大小实际上是 357B。

- Mamba 选择性进入 DeepSeek:一个 DeepSeek Sparse Attention (DSA) v3.2 模型现在将一种 类似 mamba 选择性的机制 作为子注意力块(sub-attention block)引入。

- 该更新推测了这种集成的潜在实现方式和收益。

- 破解 LLM 中的余弦相似度:一位成员询问关于具有较低余弦相似度的 LLM(如 gpt-oss-120b)及其用途。

- 另一位成员澄清说,余弦相似度反映了 LLM 中 思维链 (CoT) 的相似性,高相似度可能意味着是在可比的数据上进行的训练。

- 投资者研究用于 AGI 的符号架构:一位风投投资者正在深入研究符号架构(symbolic architectures),如 Aigo.ai、Symbolica、AUI (Augmented Intelligence) 和 After Thought (隐身状态),以寻找 AGI 解决方案。

- 他们认为 Aigo.ai 是最有前途的,并想知道 从事该领域工作需要具备哪些要求?

Yannick Kilcher Discord

- 题元角色引发 LLM 辩论:一位成员分享了关于 题元角色 (thematic roles) 的维基百科链接,另一位成员建议 LLM 可能具有此类结构,并引用了关于 Othello 的研究,即在经过移动序列训练的 LLM 中出现了 棋盘表示。

- 讨论中还强调了 Dowty 对 原型角色 (proto roles) 的使用。

- 像素级观察能防止虚假物理吗?:在讨论如何检测 Sora 2 等 AI 生成视频 时,一位成员建议 像素级观察 (pixel peeping) 仍然非常可靠。

- 另一位成员评论说,理想情况下,检测 AI 生成内容 应该是不可能的,但他相信人们会习惯于 仅凭感觉 (vibes) 来检测它们。

- AlphaEvolve 推动 Google 进展:Google 使用 AlphaEvolve(一种基于 LLM 的编码 Agent)来寻找和验证组合结构,以改进某些优化问题近似求解难度的结果,正如他们最近的 博客文章 中所述。

- 这些新结果推动了理论计算机科学的发展。

- NVIDIA 在预训练数据上使用 RL 进行推理:一位成员分享了一篇关于 NVIDIA 在预训练数据上使用 RL 进行推理 的论文。

- 该论文被描述为比 另一篇论文 更复杂,尽管后者在没有明确诱导 推理 的情况下也取得了类似的收益。

- Sora 2 卓越的物理效果:成员们提到 Sora 2 的质量远好于 Sora 1,因为 Sora 1 无法处理物理效果,且有明显的视觉伪影。

- 物理模拟方面的进步被强调为一项关键改进。

aider (Paul Gauthier) Discord

- aider 分叉版本拥抱 MCP:虽然官方 aider 缺乏对 Multi-modal Conversational Platforms (MCP) 的支持,但一些分叉版本如 aider-ce 已经集成了它,促使寻求增强前端开发能力的用户寻找替代方案。

- 讨论强调了 browser MCP 对于前端任务日益增长的重要性,特别是考虑到商业平台的成本和速率限制。

- 本地 LLM 与 aider 的兼容性面临障碍:用户报告称,即使 Qwen coder 30b 和 devstral 24b 等模型具备 tool use 能力,aider 在配合使用时仍显吃力,因为它会将文件直接包含在用户 prompt 中作为上下文。

- 讨论中澄清,如果本地模型足够先进(如 gpt-oss)并且能够有效地处理提供的上下文,aider 就可以与其配合工作。

- LM Studio 的 Bug 困扰用户:分享的经验表明 LM Studio 遇到了问题,特别是在 mlx 后端,导致用户建议使用 llama.cpp 以获得更稳定的体验。

- 该线程建议使用

--jinja参数或过渡到 ollama 以缓解这些问题。

- 该线程建议使用

- Apriel-1.5-15b 模型请求特殊的 llama.cpp 支持:一位用户询问了新模型 Apriel-1.5-15b 与 llama.cpp 之间潜在的兼容性问题,特别是关于该模型倾向于在主回复中包含思考输出(thinking output)的问题。

- 他们推测 llama.cpp 是否需要专门的支持或配置设置来分离思考输出,并将其与 gpt-oss-20b 进行了比较。

- Koboldcpp 后处理提供解决方案:一位成员指出 koboldcpp 采用输出模板或后处理技术进行输出管理,暗示这与 llama.cpp 的功能有潜在相似之处。

- 这一见解为解决 Apriel-1.5-15b 等模型遇到的输出格式挑战提供了一条可能的途径。

Manus.im Discord Discord

- Manus 陷入循环:用户报告 Manus 陷入循环错误,生成错误代码为 10091 的 Internal server error。

- 用户反映,提交帮助工单和用于公开项目的 URL 均未收到 Manus 团队的回应。

- Memory Key Protocol 创建用户自有的 AI 记忆:一位用户开发了 Aseel-Manus Memory Key Protocol,这是一个与模型无关的框架,用于持久且用户自有的 AI 记忆,通过将 Agent 的认知上下文序列化为安全且便携的密钥,实现无缝的会话连续性。

- 该协议已在 Manus 和 Google’s Gemini 上得到验证,利用强大的加密标准保护用户隐私。

- AI 自动化代理机构的架构分解:一位用户寻求关于正规 AI automation agencies 的指导,另一位用户将其分解为三种模式:Orchestrators(no-code/low-code)、Architects(自定义 Python, LangChain/LlamaIndex 和 vector DBs)以及 Integrators(管理企业级合规性)。

- 一个关键的审核建议是询问潜在代理机构他们如何在自动化中处理 状态管理(state management) 和 错误恢复(error recovery)。

- 积分消耗率遭到批评:一位用户抱怨 Manus 在处理涉及 X 光检查和电子表格创建的基础研究任务时消耗了超过 5300 积分。

- 一名团队成员请求获取会话链接以调查积分过度消耗的情况,并考虑进行潜在的退款。

- Sora 邀请码赠送:一位用户向任何私信(DM)他们的人提供 Sora 邀请码。

- 目前没有更多详细信息。

Eleuther Discord

- Adaptive Searching 取得改进:一名成员报告称,对每个 query/head/layer 自适应地进行额外搜索(以对数方式封顶),在 Attention 和 W_o 之后的最终输出中显示出理想的 cosine similarity。

- 一张 CleanShot 图片 展示了结果。

- DeepSeek 的 Sparse Attention:讨论围绕新 DeepSeek 模型中的 Sparse Attention 机制展开,并附带了 FlashMLA pull request 的链接。

- 一名成员指出,这种 Sparse Attention 听起来非常有趣。

- AI 元研究(Meta-Studies)咨询:一名成员征求分析过去研究的元研究,想了解大量研究工作产生的影响,并寻找能提供超越个人喜好的见解的论文,询问了如 这篇 相关的论文。

- BBH Benchmark 使用率:一名成员分享了关于 Benchmark 使用情况的调查结果,提到引用 BBH 的论文中,只有不到 50% 实际在其上进行了评估。

- 他们注意到,在首批查看的 50 篇引用 BigBench 的论文中,官方实现的使用率为 0%。

- RWKV7Qwen3Hybrid5NoPE-8B-251001Faced 在 GSM8k 上表现挣扎:一名成员报告在 GSM8k Benchmark 上使用 SmerkyG/RWKV7Qwen3Hybrid5NoPE-8B-251001Faced 时遇到问题,并分享了结果的 图片。

- 该成员还指出 llama-3-8B 的得分也很低。

Modular (Mojo 🔥) Discord

- Windows 支持仍处于次要地位:Windows 支持仍然是 Modular 的低优先级事项,预计在编译器开源后会有社区贡献。然而,有人指出,等待 Windows 10 淘汰可以让我们假设 Windows 意味着支持 >= AVX2,这实际上非常有益。

- 一些成员指出,由于缺乏厂商支持,许多 GPU 或加速器永远不会在 Windows 上可用。

- Mojo 在 Stack Overflow 调查中垫底:Mojo 首次出现在 Stack Overflow 开发者调查中,根据 调查结果 位居最后一名。

- 尽管排名较低,社区成员仍对 Mojo 被纳入调查表示庆祝。

- Notebook 支持获得关注:成员们请求 Notebook 支持,即 Jupyter Notebook 中的语法高亮和上游 Jupyter 中的 Max Kernel,以便在 ML 领域展示想法,因为在代码周围注释数学公式或提供图形描述非常方便。

- 讨论明确了既需要从 Notebook 与 Max 交互,也需要直接在 Notebook 中编写和运行 Mojo。

- MAX 尚不能运行 Cerebras:一名成员询问是否可以在 Cerebras 上运行用 MAX 实现的 AI 模型进行 Benchmark,另一名成员澄清说 MAX 目前无法在 Cerebras 上运行,并且针对像 Cerebras 这样的数据流(dataflow)芯片没有优化。

- 这表明在 Cerebras 等 AI 芯片上使用 Mojo X Max 进行 AI 项目不会带来免费的性能提升。

Moonshot AI (Kimi K-2) Discord

- OpenAI 通过 TikTok 广告吸引投资者:OpenAI 发布了一个展示 Prompt 框的 TikTok 广告,引起了投资者的兴奋。

- 一些观众将该广告斥为垃圾内容(slop)。

- 中国模型规避敏感话题:一名用户询问中国模型在后训练(post-trained)中被要求避开哪些话题,并指出关于印度的一些事情无法谈论。

- 这一询问突显了对 AI 模型中审查和偏见的持续关注。

- API 版本模型提供更高的开放性:一名成员断言,某些模型的 API 版本相当开放,与美国模型相比,除了模型内部较少西方偏见的数据外,没有审查。

- 这表明在不同模型版本中,审查与地域偏见之间可能存在权衡。

DSPy Discord

- LiteLLM 与 DSPy 的应用主导权之争:一位成员在为新的 LLM 应用权衡使用 LiteLLM 还是 DSPy,并指出 DSPy 将 LiteLLM 作为网关使用。

- 发帖者认为 LiteLLM 缺乏足够的结构,仅仅作为一个接口,而 DSPy 则强制执行一种特定的问题解决方法。

- DSPy 结构:可选还是编排好的?:一位成员反驳称

messages可以直接传递给dspy.LM,这意味着 DSPy 的结构 并不一定是强制性的。- 该发帖者强调,并非所有 LiteLLM 的功能都被利用了,而且需要一些组装工作才能达到预期的效果。

- 针对缓存的批评集中在内容混乱上:一位用户质疑在使用 caching 时,如何操作 JSON 请求中

content部分的顺序。- 这意味着 prompts 和文件的顺序 对于有效的 caching 策略 至关重要。

tinygrad (George Hotz) Discord

- CLSPV 仍然崩溃,但大部分已通过:一位成员报告称,他们在运行 CLSPV 测试时仍遇到崩溃,但现在大部分测试已经通过。

- 使用 x86_64 Linux 系统的用户可以通过

pip install git+https://github.com/softcookiepp/tinygrad.git安装该分支进行尝试。

- 使用 x86_64 Linux 系统的用户可以通过

- ShapeTracker 面临即将被删除的命运:一位成员询问了 Shape Tracker Lean Prove Bounty 的进展情况。

- 进一步讨论指出 ShapeTracker 很快将被删除。

LLM Agents (Berkeley MOOC) Discord 没有新消息。如果该公会长时间保持沉默,请告知我们,我们将将其移除。

MLOps @Chipro Discord 没有新消息。如果该公会长时间保持沉默,请告知我们,我们将将其移除。

Windsurf Discord 没有新消息。如果该公会长时间保持沉默,请告知我们,我们将将其移除。

您收到此邮件是因为您通过我们的网站订阅了。

想更改接收这些邮件的方式吗? 您可以从该列表中 取消订阅。

Discord:各频道详细摘要与链接

Perplexity AI ▷ #general (997 条消息🔥🔥🔥):

Sora 2, 免费 Perplexity Pro, Grok vs. ChatGPT

- Sora 2 引发热潮与迷因:成员们一直在积极使用 Sora 2 生成内容,其中一人吹嘘在一天内生成了 100 个视频,还有几个人正在用皮卡丘创作内容。

- 一些用户认为 Sora 2 水印 看起来很专业,不需要去除,而另一些人则期待集成到 GPT Plus 中的付费版本。

- VPN 骚操作让所有人都能用上 Sora 2:用户发现通过 VPN 连接到加拿大可以免费访问 Sora 2,尽管有人指出该应用现在无需 VPN 即可运行。

- 一位用户生成了 100 个视频,并测试了 Sora 的新 Cameo 功能,创作的视频目前正在社交媒体上流行。

- 用户免费获得 Perplexity Pro:用户通过各种促销活动获得 Perplexity Pro 的访问权限,包括与 Airtel、Venmo 和 PayPal 的合作。

- 免费获取 Perplexity Pro 让一些人开始质疑其他付费 AI 订阅的价值,一位成员幽默地表示:“既然我们已经免费拥有了 Perplexity Pro,就没人需要那些了”。

- Grok 表现不佳:成员们发现 Grok 在某些领域表现不佳,例如图像和视频生成,一位用户表示 “Grok 在图像和视频生成方面严重落后”。

- 一位用户表示 Grok 的搜索 在过滤过时或错误来源方面非常吃力。

- LLM 竞争火热:一位用户报告了使用 Kimi、Z 和 Perplexity Labs 的结果,显示 Kimi 具有动画效果和更好的 UI,Z.ai 整体看起来更好。

- Perplexity Labs 甚至不值得考虑,但一位用户还建议将 DeepSeek 也纳入测试组合中。

Perplexity AI ▷ #sharing (7 条消息):

Sora 2 发布,Comet 邀请推荐

- Sora 2 即将发布:成员们分享了一个 Perplexity 页面 链接,指出 OpenAI 正在发布 Sora 2。

- Comet 邀请开放推荐:一位成员分享了 Comet 的推荐链接,提供 通过推荐获得的邀请。

- 他们还提到,任何使用该推荐链接的人都将获得 Comet 邀请,并鼓励感兴趣的人私信(DM)他们。

Perplexity AI ▷ #pplx-api (1 条消息):

.idothehax: oh

LMArena ▷ #general (997 条消息🔥🔥🔥):

Claude API 免费使用,Seedream 4 削弱,AI 伦理讨论,Sora 2 邀请码,图像生成问题

- 探索 Claude 免费 API 使用:成员们讨论了免费使用 Claude API 的可能性,其中一个建议提到了 puter.js,另一个建议是将 MCP 连接到免费账户。

- 然而,讨论中也指出了局限性,例如 每周 20M token 限制 以及可能使用用户数据作为支付代价。

- Seedream 4 削弱与用户反馈:用户讨论了 Seedream 4 最近的变化,一位成员详细列出了不同版本的优缺点,包括分辨率、速度和图像质量。

- 一个普遍的抱怨是强制性的 1:1 纵横比,一些人认为这使得它在图像编辑方面变得毫无用处。

- AI 伦理辩论:成员们询问讨论 AI 伦理 的合适频道,一位成员回答说 <#1340554757827461211> 或 <#1377796849901240321> 比较合适。

- 一位用户讽刺地表示:AI 伦理 🤢,我现在就想让 AI 抢走我的工作。

- Sora 2 邀请码请求与分享:几位成员请求 Sora 2 邀请码,至少有 一位用户 表示愿意付费购买。

- 一位成员在聊天中慷慨地分享了一个 Sora 2 代码。

- 图像生成遇到新问题:成员们报告了图像生成的问题,包括生成的图像 没有音频、图像被 锁定在 1:1 纵横比 以及其他意外错误。

- 一位成员指出,图像生成问题可以在 <#1343291835845578853> 中报告。

LMArena ▷ #announcements (2 条消息):

十月 AI 生成大赛,Arena Champions 角色,抽象艺术图像竞赛,视频生成竞赛获胜者

- LMArena 启动十月 AI 生成大赛:LMArena 宣布开启十月 AI 生成大赛,挑战参与者使用 AI 创作抽象艺术。作品必须通过 Battle Mode 提交,并包含显示模型名称的 左侧和右侧响应。参与详情请见 此处。

- 获胜者将获得 1 个月的 Discord Nitro 和专属的 <@&1378032433873555578> 角色。

- LMArena 为 AI 鉴赏家推出 Arena Champions 角色:LMArena 引入了 Arena Champions 角色 <@&1422628364782407830>,旨在一个专属、无干扰的私人空间内促进深入的 AI 讨论。自 2025年7月 以来加入服务器的成员将自动获得访问权限,申请请点击 此处。

OpenRouter ▷ #announcements (3 条消息):

Stripe 集成,按量计费,BYOK 请求

- OpenRouter 与 Stripe 同步账务!:OpenRouter 正在与 Stripe 合作开发一项新功能,以实时同步您的 LLM 账务,并方便地转向 按量计费(usage-based billing) 或混合模式,正如 这条推文 所宣布的。

- 只有账务数据会与 Stripe 共享,Prompt 保持私密。

- BYOK 盛宴:每月 100 万次免费请求!:从 2025年10月1日 开始,所有用户每月可获得 100 万次免费 BYOK 请求,详见 此公告。

- 对于每月超过 100 万次请求的客户,请求将按 5% 的常规费率收费。

OpenRouter ▷ #app-showcase (2 条消息):

频道隐私, RPG 用户, LLM Mixture

- 频道隐私受到质疑:一位用户对该频道是真实频道而非仅仅是论坛帖子(forum threads)表示惊讶。

- 他们请求对频道进行遮蔽处理,以防止过度使用。

- RPG 用户可能会过度使用频道:该用户担心 RPG 用户会不停地使用该频道。

- 这可能导致 LLM Mixture 方法被停止使用。

OpenRouter ▷ #general (662 条消息🔥🔥🔥):

Grok 模型问题, 对象生成, Sora 视频模型, 使用 Grok 进行角色扮演, AWS Bedrock

- Grok 模型和对象生成(Object Generation)调用出现故障:一些用户报告 Grok 模型和对象生成调用出现故障,但原因尚不明确,有人猜测这是否与 OpenRouter 或 Grok 的变动有关。

- 随后,一位用户报告 Grok4 似乎已恢复工作。

- Sora 视频模型未在 OpenRouter 上线:一位用户询问了 Sora 视频生成的成本,但得到的澄清是 OpenRouter 并不路由视频模型,它仅通过 OpenAI 的 Sora 应用或网站提供,不通过 API 提供。

- 用户还注意到在 ChatRoom 中模型在响应中途暂停的问题,并对此表示沮丧。

- 通义 DeepResearch 30B A3B 模型并非免费:一位用户报告 通义 DeepResearch 30B A3B 模型被错误地标记为免费,该说法已得到确认,随后被标记为已修复。

- 还有一些关于 Grok 是否适合角色扮演(roleplaying)的讨论,一位用户称赞了它的写作风格和对系统提示词(system prompts)的遵循。

- BYOK 现在提供每月 100 万次免费请求:OpenRouter 现在每月提供 100 万次免费 BYOK 请求,此更改将自动适用于所有现有的 BYOK 用户。

- 用户仍需为通过其提供的 API Key 产生的用量负责。

- Grok Code Fast 1:速度之王:Grok Code Fast 1 (GCF1) 以其高速和任务专注度而受到关注,在给出明确指令时非常适合编程任务。

- 一些用户发现它不太听从指令,但价格便宜。

OpenRouter ▷ #discussion (24 条消息🔥):

Sora 邀请码, Sora API 端点, Sora 访问要求, OpenAI 对阵 Google, Sora.com 与 BYOK

- OpenRouter 用户渴望 Sora 邀请码:许多成员都在索求 Sora 邀请码,一位用户向身处美国或加拿大且拥有 Apple 设备的人提供了四个邀请码。

- 该用户感叹美国/加拿大的限制很差劲,并想知道还需要多久才能看到类似的选择(如 Wan3)上线。

- OpenAI 确认 Sora API 端点:成员们讨论了 Sora API 端点的潜在可用性,其中一人提到 OpenAI 最初可能希望他们的应用占据所有算力。

- 另一位成员表示,OpenAI 已宣布将为 Sora 提供 API 端点,由于其逼真的声音和更好的质量,它看起来比其他视频生成模型好得多。

- OpenAI 与科技巨头竞争:一位成员对 OpenAI 与 Google、Meta 和 Amazon 竞争表示惊讶,尤其是 Sora 2 的高质量以及可能抓取所有 YouTube 视频进行训练的情况。

- 该用户推测 Genie 可能是真正的世界模拟器,并对 Sam Altman 领导 OpenAI 所面临的挑战表示同情。

- Sora.com 支持带有 BYOK 的新模型:一位用户报告 Sora.com 支持新模型,并提供 100 万个免费 BYOK Token。

- 关于新模型或其如何与 Sora.com 集成的更多细节尚未给出。

Cursor Community ▷ #general (671 messages🔥🔥🔥):

Cursor student program, Sonnet 4.5 token usage, Cursor Agent bugs, Deepseek v3.2 addition, AI social network platform

- Sonnet 4.5 被认为极度消耗 Token,而 Codex 因节省 Token 受到称赞:一位成员认为,尽管 Sonnet 4.5 是一个非常出色的模型,但与 Codex 相比,它在输入和生成的 Token 数量上显得很浪费,而后者消耗的资金和 Token 更少。

- 其他成员指出 Claude 模型 通常更贵,但一位享受旧版定价(legacy pricing)的成员表示,相比 GPT-5-high-fast,他更倾向于使用 Sonnet 4.5。

- Cursor Agents 出现故障:一位成员报告称,他们的 agents terminals 出现了 bug,即使尝试了不同的 Shell(bash, cmd, powershell),也无法执行任何命令。

- 另一位成员建议运行

winget install --id Microsoft.PowerShell --source winget,并在重启 Cursor 后将默认 Shell 设置为pwsh。

- 另一位成员建议运行

- Cursor 社交网络梦想:一位成员询问 Cursor 是否可以为 AI 创作者创建一个社交网络平台。

- 另一位成员回答说:只要你相信 ✨ 魔法 ✨,一切皆有可能。

- Cursor 账单页面变得难以阅读:一位成员抱怨 billing page 难以阅读,并要求 ChatGPT 制作一个更好的页面。

- 享受旧版定价的成员讨论了不同模型的成本,一些人认为 Claude Opus 非常昂贵,而另一些人则发现成本明细具有误导性。

- TypeScript 重构过程非常顺利:聊天中的成员发现 Cursor 能够通过简单的步骤重构模块和类,带来了流畅的体验。

- 一位成员甚至只需提供清晰连贯的 Prompt,就能修复所有剩余问题。

Unsloth AI (Daniel Han) ▷ #general (339 messages🔥🔥):

GRPO trainer, Fine Tuning, Blackwell GPU

- 首个 GRPO 训练器构建完成:缓慢但稳步推进:一位成员创建了他们的第一个 GRPO (Generative Reinforcement Learning with Policy Optimization) trainer,并指出与 LoRA Fine Tuning 相比速度较慢,详见其 Colab notebook。

- 该成员观察到训练损失降至接近零,而奖励值缓慢上升,这与更简单的机器学习系统的经验相似,他们计划在实验结束后转向其他 RL tools。

- Blackwell Docker 问题引发手动编译修复:成员们讨论了 Blackwell GPUs (RTX 50xx 系列) 上 Xformers 的问题,指出由于兼容性问题需要手动编译。

- 一位成员分享了手动编译步骤:

pip uninstall -y xformers; git clone --depth=1 https://github.com/facebookresearch/xformers --recursive; cd xformers; export TORCH_CUDA_ARCH_LIST="12.0"; python3 setup.py install,并提到 “我真的不需要 128k 上下文,但我还是会把它拉到最大,这就是人类的天性”。

- 一位成员分享了手动编译步骤:

- Fine-Tuning 的数据准备见解:一位成员询问如何为 Fine-Tuning Agent 准备高质量数据集,并分享了一份 datasets guide。

- 另一位成员建议考虑模型大小、Agent 的性质以及数据的结构/质量,强调至少需要 1000-5000 个高质量示例。

Unsloth AI (Daniel Han) ▷ #introduce-yourself (13 messages🔥):

New member introductions, Blockchain applications, AI in problem-solving

- 热情的 AI 工程师加入频道:一位来自香港、名叫 Andi 的 AI 工程师加入了频道,表达了学习和与他人合作的渴望。

- 其他成员立即欢迎了 Andi,其中一人开玩笑地请求他帮忙创办一家价值十亿美元的初创公司。

- 探索区块链与 AI 的融合:一位成员描述了他们的旅程是如何从对“将信任写入代码”的好奇开始的,这引导他们探索了区块链和 AI。

- 他们认为结合区块链和 AI 可以改变行业、社区和创意生成,强调了这些技术解决以前无法解决的问题的潜力。

Unsloth AI (Daniel Han) ▷ #off-topic (143 messages🔥🔥):

Gemma Fine-Tuning, Sora 2, AI Models and Self-Awareness, Windows Subsystem for Linux (WSL), torchcodec Issues

- Gemma 微调框架冲突!: 成员们注意到,虽然 Unsloth 声称是唯一允许在 T4 Collab GPUs 上进行 Gemma 微调的框架,但 Google 的 Gemma 文档也提供了一个在 T4 GPUs 上使用 LoRA 和 Keras 的教程。

- 随后确定,Unsloth 识别并修复了最初阻碍其高效运行的问题。

- Sora 2 是 NSFW 内容?: 一位成员分享了一个链接,暗示 Sora 2 视频可能带有 NSFW 倾向,这让一些没有立即理解该梗的用户感到困惑。

- 一些资深成员理解这个梗,而其他人则需要解释,正如一位成员回复道:‘你太年轻了,不懂这个’。

- LLMs 缺乏自我意识,你说什么?: 成员们讨论了 LLMs 在被问及自身信息时的准确性,其中一人表示 通常询问 LLM 关于它自己的信息是不准确的。

- 有人建议,如果 GPT-5 看起来了解自己,那要么是因为特定的训练、工具的使用,要么是在 System Prompt 中包含了身份信息,并指出 没有 System Prompt 你无法与任何 GPT 对话。

- WSL:Windows 的救星?: 用户们辩论了使用 Windows Subsystem for Linux (WSL) 来避免依赖问题的优点,特别是对于像 torchcodec 这样在 Linux 上有更好 CUDA 实现的项目。

- 尽管初始学习曲线较陡,社区成员仍推荐将 WSL 与 VSCode 结合使用以获得无缝体验和更好的硬件资源利用率,有人表示 这就是兼容性,Linux 仅此而已。

- Eval Loss 达到新高!: 一位成员对看到 6 的 Eval Loss 表示震惊。

- 其他成员建议,对于大多数音频模型来说,这是正常的。

Unsloth AI (Daniel Han) ▷ #help (67 messages🔥🔥):

GRIT algorithm + Qlora based finetuning, AgentGYM, Gemma 3n 4b it - 16 bit model, Qwen 2.5 72B fine-tuning with Unsloth on Runpod, Multi-GPU with Llama-server

- 寻找 **GRIT 和 QLORA Notebook: 一位成员询问是否有结合 **GRIT (Geometric Reprojection Instruction Tuning) 算法与基于 QLORA 微调的 Notebook,并引用了 一个特定的 Hugging Face 模型。

- Unsloth 确认免费计划及 **Gemma 3n 4b it - 16 bit model 可用性: 一位成员询问 Unsloth 是否提供 **Gemma 3n 4b it - 16 bit model,得到了肯定的答复以及指向 Unsloth 文档的链接。

- 另一位成员澄清说 Unsloth 没有付费计划,消除了用户关于付费模型是否有更快推理速度的疑问。

- 使用 **save_pretrained_gguf 遇到困难**: 一位成员报告在尝试使用

save_pretrained_gguf函数时遇到问题,在使用 Llama 加载模型时面临与缺失 Tensor 相关的错误。- 另一位成员指出

save_pretrained_gguf在 Unsloth 中尚无法正常工作,建议进行手动转换,或使用push_to_hub_merged()配合转换空间(Conversion Space),尽管原帖作者表示这两种方法都存在困难。

- 另一位成员指出

- 用户尝试微调个人 AI 克隆: 一位用户目标是微调一个 LLM 来创建一个 Discord 机器人,利用其视频字幕作为数据源来模仿自己的对话风格。

- 社区成员建议将字幕转换为问答(Q&A)格式,可以考虑使用另一个 AI 模型从视频内容中生成问答对,同时强调这种方法仍处于实验阶段。

Unsloth AI (Daniel Han) ▷ #research (5 messages):

ReLU Bug, Shifted Tanh, Gradient Explosion

- ReLU Bug 导致平方项: 一位成员意识到他们在原始公式中使用 ReLU 时存在一个 Bug,导致减法乘积中出现了平方项。

- 他们转而使用偏移后的 tanh [~0, ~1] 而不是 [0, N],现在它的作用更像是一个可微信号,而不是信号放大门。

- 梯度不再爆炸: 由于转向了 tanh,该成员报告梯度不再爆炸。

- 他们链接了一篇关于 LoRA 的博客文章 作为背景参考。

OpenAI ▷ #ai-discussions (398 messages🔥🔥):

Sora 2 邀请码, GLM 4.6 vs Sonnet 4.5, AI 驱动工具创意, Deepfakes 与写实提示词

- Sora 2 邀请码争夺加剧:Discord 用户正疯狂寻求 Sora 2 邀请码,导致多个频道出现垃圾信息并引发对潜在诈骗的担忧,许多人通过私信索要代码,并对仅限邀请的系统表示沮丧。

- 用户被引导至特定频道如 <#1379321411046346762> 和 <#1315696181451559022> 讨论该应用及访问权限。

- GLM 4.6 编程方案是省钱的替代选择:用户发现 GLM 4.6 是处理编程任务时比 Sonnet 4.5 更具性价比的选择,一位用户报告称 Zai 的季度专业版方案以极低的成本提供了 每 5 小时 600 条提示词 的额度。

- 一位用户声称 zai glm 编程方案性价比极高,[他们] 已经订阅了一个季度。

- AI 驱动的梦想工具激发想象力:当被问及希望构建什么样的 AI 驱动工具时,成员们分享了多个创意,例如可以让他们 穿墙视物 或 飞行 的工具。

- AI 应用因在 Deepfakes 上的双重标准受到批评:一款 AI 应用因要求用户对自身进行 Deepfake 处理,同时又拒绝写实风格的提示词而遭到抨击,引发了用户的愤怒和对其 智力缺陷 的指责。

OpenAI ▷ #gpt-4-discussions (9 messages🔥):

GPT-5 的 SQL 能力, 即时生成, 带宽限制, Thinking 模式

- GPT-5 SQL 测试失利:根据 llm-benchmark.tinybird.live 的数据,GPT-5(Codex 和非 Codex 版本)在 SQL 方面似乎并非 SOTA,排名分别为 第 23 和 第 52。

- 与此同时,o3-mini 在同一基准测试中排名 第 6。

- 即时生成不再即时?:用户正经历持续的问题,并质疑为什么即时生成不再即时,即使在使用自定义指令时也是如此。

- 一些理论认为这是由于 带宽限制(bandwidth throttling) 措施导致的。

- Thinking 模式可以确定用户位置:一位用户建议 thinking 模式 拥有获取用户 时区 或大致 IP 位置 的工具。

- 另一位用户指出,这也被列在了约 18K token 的 thinking 系统提示词中,并且 thinking 模式与非 thinking 模式具有不同的系统提示词和工具。

OpenAI ▷ #prompt-engineering (7 messages):

ChatGPT 与 Canvas, 人性化写作提示词

- ChatGPT 能否增量更新 Canvas 代码?:一位成员询问是否有办法让 ChatGPT 使用 Canvas 而不是每次都重写整个代码,仅在特定位置插入所需内容。

- 另一位成员回答称尚未发现实现方法,并建议在相关的 Discord 频道中反馈此需求或将其作为潜在 Bug 报告。

- 如何让写作更具人性化?:一位成员正在寻找能让写作更具人性化的提示词。

- 另一位成员建议使用经过微调的模型,如 Sudowrite,它具有良好的基础效果和用户插件。

OpenAI ▷ #api-discussions (7 messages):

ChatGPT 与 Canvas, 人性化写作提示词

- ChatGPT 在 Canvas 上表现挣扎:一位成员询问是否有办法让 ChatGPT 使用 Canvas 而不必每次重写全部代码。

- 其他成员确认尚未发现实现方法,并建议将其作为功能请求提出。

- 人性化写作提示词:一位成员征求能让写作更具人性化的提示词。

- 另一位成员建议使用 Sudowrite 等微调模型或用户插件以获得更好的效果。

HuggingFace ▷ #announcements (1 条消息):

ML for Science projects, Trackio library, Watermarking with Gradio, HF Inference Providers in VS Code, Public AI on HF Inference Providers

- 科学机器学习项目招募学生:Hugging Face 正在寻求学生和开源贡献者加入一些 ML-for-science 项目,请通过此 Discord 链接查看。

- 志愿者将有机会发挥影响力并帮助人类。

- Trackio:Wandb 的替代方案:Hugging Face 发布了一个名为 Trackio 的新型免费实验跟踪库,它是 wandb 的无缝替换方案,并采用本地优先的设计,请查看 GitHub 仓库。

- 你可以记录指标、表格、图像甚至视频!

- Gradio 的新型隐形水印:Hugging Face 发布了一篇关于使用 Gradio 进行可见水印处理的博客文章,点击此处查看。

- 现在你可以轻松展示来源,避免误导信息或恶意行为。

- EmbeddingGemma 模型发布!:Google 新的高效嵌入模型 EmbeddingGemma 已发布,阅读博客文章了解更多信息。

- 该模型在高效性和通用性方面表现出色。

- Faster Transformers 博客文章上线:Hugging Face 发布了一篇关于 OpenAI 的 gpt-oss 技巧的博客文章,这些技巧可以应用于 Transformers,阅读文章请点击此处。

- 文章详细介绍了如何使用 FlashAttention 和量化技术来加速你的 Transformer 模型。

HuggingFace ▷ #general (196 条消息🔥🔥):

Crisper Whisper Integration, Lora Training, Medical AI Opinion, RTX 4090 modded cards, ComfyUI Crashing

- Whisper 变得更清晰:集成语音识别:一位成员寻求将 Crisper Whisper 集成到全栈应用中进行语音识别的帮助,并询问了有关识别异常词汇的库。

- Lora 训练超时触发损失:成员们讨论了 Lora 训练 任务如果超时会面临数据丢失的风险,特别是由于 Checkpoints 在运行期间不会自动上传到 Hub;文中分享了一个关于设置足够超时的 HuggingFace 文档链接。

- 一位成员指出:“如果你的任务超过了超时限制,它将失败且所有进度都会丢失。”

- 医疗模型:成员们就如何管理医疗 AI 模型中医疗 Token 和否定词的 Loss 表达了看法。

- 一位成员询问这是否适用于因果模型(Causal Models)。

- 改装版 RTX 4090 和多 GPU 算力集群:成员们讨论了在 eBay 上出售的拥有 48GB 显存 的改装版 RTX 4090 显卡,以及 AMD Instinct MI210 显卡,其中一位成员建议将拥有 22GB 显存的 2080ti 作为更便宜的替代方案。

- 一位成员表示:“那些 Instinct 卡没啥用。那些 4090 很酷。不过你可以用四分之一的价格买到 22GB 显存的 2080ti。”

- ComfyUI venv 崩溃:一位用户报告了在 Runpod 中开启新 Pod 时,ComfyUI 的 venv 崩溃且无法识别依赖项的问题,尤其是在最近一次 Runpod 崩溃之后。

HuggingFace ▷ #cool-finds (1 条消息):

Foundational Models, New Research Paper

- 重磅基础模型论文发布:一位成员分享了一篇关于基础模型(Foundational Models)的研究论文,声称这可能会改变一切。

- 请求继续讨论:欢迎对该论文进行进一步讨论;此摘要仅作为一个开始。

HuggingFace ▷ #i-made-this (2 条消息):

CloudOpsBERT, IaC concurrency

- CloudOpsBERT 开启云端分析:CloudOpsBERT 是一个开源项目,探索用于云运营日志分析的领域适配 Transformer 模型。

- 它专注于异常检测、可靠性监控和成本优化。

- IaC 并发冲突预测:一个并发管理框架可以预测并缓解 基础设施即代码 (IaC) 系统中的并发修改冲突。

- 该项目使用了 BERT 和 LSTM 模型。

HuggingFace ▷ #computer-vision (1 条消息):

Live benchmarks, Arenas for vision tasks, Satellite imagery, Drone imagery, Datasets

- 寻求卫星/无人机图像的实时基准测试列表:一位成员正在寻求针对卫星或无人机图像视觉任务的实时基准测试 (live benchmarks) 或竞技场 (arenas) 列表。

- 寻找公共数据集和基准测试平台:一位成员正在寻找用于计算机视觉任务的最新数据集和基准测试平台。

HuggingFace ▷ #smol-course (4 条消息):

Broken Quiz Links, Course Tips

- 第 2 和第 3 章节的测验链接指向 404:多位成员报告称,第 2 和第 3 章节的测验链接已失效,导致 404 错误。

- 新生咨询课程建议:一位名为 spectrix.dev 的新生正在开始课程学习,并询问建议以及他们错过了哪些内容。

- 另一位成员 noir_bd 建议新生如果有疑问,不要羞于提问。

HuggingFace ▷ #agents-course (3 条消息):

Agent Course

- Agent 课程学习者今日启航:多位成员宣布他们今天开始学习 Agent 课程。

- 他们表达了对该课程和主题的兴奋之情。

- 对 Agent 课程的热情:成员们表达了对学习 Agents 以及开始课程的兴趣。

- 预计该课程将涵盖一系列有趣的主题。

LM Studio ▷ #general (162 条消息🔥🔥):

vLLM Parallel Requests, LM Studio and AVX2, LM Studio Reddit Ban, Qwen3-Omni Support, LM Studio Parallelism

- vLLM 助力并行请求:一位成员强调,vLLM 能够处理大量的并行请求,即使是较小的模型,这得益于其高度并行的特性以及随可用内存扩展的能力。

- 他们分享了一个例子:在 4070 上运行 Qwen3 0.6B,在 10 个并发请求中实现了 1470.4 tokens/s 的平均生成吞吐量。

- LM Studio 需要 AVX2:一些成员讨论了 LM Studio 对 AVX2 支持的要求,为了检查兼容性,用户可以在 LM Studio 内按

CTRL+Shift+H打开硬件界面。- 有人建议,过去 5 年内制造的、具备 AVX2 指令集、8GB VRAM 和 16GB RAM 的新电脑将满足最低要求。

- LM Studio 服务器:无头模式 (headless) 正在开发中:成员们讨论了在服务器上设置 LM Studio 并远程访问的问题,其中一位指出 LM Studio 允许运行带有 API 访问权限(REST 和 Python APIs)的服务器,但目前尚不支持完全的无头模式 (headless mode)。

- 另一位成员建议使用现有的 LM Studio WebUI(如 LMStudioWebUI)来连接到 LM Studio API。

- Qwen3-Omni 多模态模型即将到来:成员们讨论了对 Qwen-Omni 的支持,表示当 llama.cpp 支持时,它就会被支持,LM Studio 团队无需采取任何行动。

- 一位成员指出 Qwen chat GUI 已经拥有原生的 omni 模型。

- 跨多 GPU 拆分模型:成员们谈到了在 LM Studio 中跨多个 GPU 拆分模型,并指出这主要是为了增加可用 VRAM,而不是为了提高速度。

- 一位成员计划将 gpt-oss-120b 拆分到两个 A6000 (48GB) GPU 上。

LM Studio ▷ #hardware-discussion (33 messages🔥):

AMD 495+, Strix Halo, 3090 显存带宽, 移动芯片

- 等待具有大容量统一内存的 AMD 495+: 一位成员正在等待支持 512GB 统一内存的 AMD 495+,并强调将内存焊接在板卡上以避免带宽问题的重要性。

- 他们还指出,虽然 AMD AI 移动芯片 表现尚可,但其系统内存约 500 GB/s 的带宽无法与 GPU 上实现的 1 TB/s 相比。

- Strix Halo 带宽仅为 256GB/s: 一位成员指出 Strix Halo 的带宽为 256GB/s,认为不应将其与 4090 等 GPU 进行比较。

- 另一位成员澄清说,3090 拥有约 1 TB/s (936.2 GB/s) 的带宽,并认为具有 500 GB/s 带宽的 AMD R9700 在 AI 方面的吸引力较低,而 W7900 则达到了 864.0 GB/s。

- 理论极限 vs 实际使用: 一位成员强调理论最大值并不总是能实现的,估计 iGPU 约为 215-220GB/s,CPU 约为 128GB/s,但 LLM 不会在 CPU 核心上运行。

- 他们补充道:“我厌倦了看到人们比较那些本来就不该放在一起比较的东西,它属于自己的产品类别”,强调了 PC 适合运行较大的 MoE 模型,同时也提到了购买二手硬件的性价比。

- 二手 GPU 市场: 讨论转向了二手 GPU 市场,提到 涡轮版 3090 价格约为 $900,而 $600 的 3080 20GB 也有供应。

- 一位成员建议考虑来自阿里巴巴的 $1K 4080 32GB,而另一位则表示更倾向于在 eBay 上以约 $3-4K 的价格购买具有 32GB VRAM 的 4090。

Latent Space ▷ #ai-general-chat (99 messages🔥🔥):

亚马逊下一代 AI 设备, Ring-1T 模型, Gemini 2.5 图像编辑, EigenCloud AI 验证, Cerebras 融资

- Amazon Alexa 获得更多 AI 加持: 亚马逊发布了其下一代 AI 驱动的 Echo 设备和 Alexa 更新,具有增强的 AI 功能。

- 一位用户表示希望能有一个可破解的 Echo Dot Max,以便他们可以接入并更换 LLM。

- 万亿参数 Ring 模型: Ant Ling 发布了 Ring-1T-preview,这是首个具有 SOTA 数学分数的 1 万亿参数 开源“思考”模型,在 AIME25 上达到 92.6,在 HMMT25 上达到 84.5,基准测试见此处。

- 谷歌 Gemini 2.5 获得图像升级: Tim Brooks 和 Google DeepMind 宣布了 Gemini 的新原生图像编辑和生成功能,其一致性、指令遵循(instruction adherence)和创造力备受瞩目。

- 社区反应集中在该模型在保留非编辑元素方面的强大能力。

- Cerebras 获得数十亿美元融资: Cerebras 宣布了由 Fidelity & Atreides 领投的 $1.1B G 轮融资,公司估值达到 $8.1B,资金将用于 AI 处理器研发、美国制造业务扩张以及通过其新闻稿提到的全球数据中心扩展。

- 社区成员请求支持 LoRA/GLM-4.6。

- Context 是新的 Prompt: Anthropic 发布了一篇新的工程博客文章,解释说 Context 工程(而非 Prompt 工程)是最大化 AI Agent 性能的关键,开发者们正在分享关于更智能的运行时 Context 内存管理的经验、技术和问题,参考其博客文章。

Latent Space ▷ #genmedia-creative-ai (4 messages):

Sora 2, 木偶解说视频, Chris 的新工作

- Chris 的 Sora 2 木偶解说工作: Chris 🇨🇦 分享了他的新角色涉及使用 Sora 2 制作 木偶解说视频。

- 他指出,尽管在这条 X 帖子中存在奇怪的截断问题,但输出效果令人印象深刻。

- Sora 2 令人印象深刻的输出: 尽管存在奇怪的截断问题,Sora 2 在制作木偶解说视频方面正产生令人印象深刻的结果。

- Chris 🇨🇦 在他最近的公告中强调了 Sora 2 的能力。

GPU MODE ▷ #general (13 messages🔥):

学习 PTX 和 CUDA,RTX 4090 中的 FP8 支持,代码组织策略,GEMM 实现,cuBLAS 性能

- 评估 PTX 和 CUDA 精通的时间线:一位成员询问了从通过 Nvidia 文档学习 PTX 和 CUDA 到构建有趣应用通常需要多长时间。另一位成员回应称,这取决于是否包含 triton、cutlass 等库,以及具体的应用领域。

- 一位成员表示,如果缺乏 CUDA 知识是唯一的阻碍,你可以像学习语言一样快速掌握它,但找到写什么才是真正的问题。

- 深入研究 RTX 4090 FP8 实现:一位 ML Engineer 为了测试自己的想法必须深入学习 CUDA,并因其支持 FP8 而购买了 RTX 4090,随后为 fp8 sm89 实现了 flash attention。

- 他们提到,在 2023 年购买时还没有 FP8 支持,而他们在阅读文档中的一个段落后立即应用了它。

- 优化代码结构的策略:一位成员寻求关于如何组织代码的建议,特别是当在类似于 torchtitan 的代码库中,拥有针对 405b 模型更快但针对 8b 模型更慢的自定义代码时。

- 提出的问题是:应该在模型代码中使用 if-else 分支,维护两个版本的模型代码,还是应用 monkey-patching 后处理。

- 通过 GEMM 实现掌握 GPU 利用率:一位成员建议,实现一个性能达到 cuBLAS 80% 以上的 GEMM 是充分利用 GPU 的好方法,而且 GEMM 总是很有用的,因为你可以通过矩阵化(matricization)将任意张量收缩重构为 GEMM。

- 他们分享了一篇经典博客文章,以指导他人实现 cuBLAS 级的性能。

GPU MODE ▷ #triton (1 messages):

Triton 开发者大会 2025,GPU MODE Triton 现状,针对 Triton 的 NVIDIA Blackwell GPU 后端,Triton 分布式计算

- Triton 开发者大会 2025 即将到来:Triton 开发者大会 2025 仅剩几周时间,届时将有机会亲临现场并与 Triton 爱好者交流。

- 大会旨在让参会者学习、分享并与顶级领导者建立联系,同时发现 Triton 社区的新进展。注册地址为 aka.ms/tritonconference2025。

- GPU MODE 讨论 Triton 现状:来自 Meta 和 GPU Mode 的 Mark Saroufim 将在即将举行的大会上介绍 Triton 的现状。

- 其他演讲包括来自 OpenAI 的 Phil Tillet 和 Thomas Raoux 讨论 Triton: Today and Beyond,以及来自 Meta、AMD、Nvidia 和 Bytedance 的演讲。

- NVIDIA Blackwell GPU 将获得 Triton 后端:来自 Nvidia 的 Chris Sullivan 将介绍 针对 Triton 的 NVIDIA Blackwell GPU 后端。

- 本次演讲将展示新的 Blackwell GPU 架构如何与 Triton 集成以实现优化性能。

- Triton-distributed 解决计算与通信问题:来自 Bytedance 的 Wenlei Bao 将讨论 Triton-distributed:分布式 LLM 训练和推理中的计算与通信重叠。

- 本次演讲将涵盖如何通过重叠计算和通信,利用 Triton 优化大语言模型的分布式训练和推理。

GPU MODE ▷ #cuda (2 messages):

Kernel 函数地址,Tensor Core 演进,Kimbo Chen

- Kernel 地址曝光!:分享了一篇关于在 host 代码中提取 kernel 函数地址的博客文章,访问地址为 redplait.blogspot.com。

- Kimbo 绘制 Tensor Core 时间线!:重点介绍了 Kimbo Chen 关于 NVIDIA Tensor Core 从 Volta 到 Blackwell 演进的博客文章,地址为 semianalysis.com。

GPU MODE ▷ #torch (1 条消息):

Torch Dynamo Compile Times, Measuring impact of recompilations, Autotuning

- Torch Dynamo:解析编译时间:一位成员询问如何解读

torch._dynamo.utils.compile_times()日志,以便更好地理解 Dynamo 的性能。- 具体而言,他们寻求在不完全重置 Dynamo 缓存的情况下,按步骤衡量编译时间、重编译 (recompilations) 和 Autotuning 影响的方法,并链接了一个 Gist 以提供背景信息。

- Dynamo 缓存重置的困境:用户希望在不重置 Dynamo 缓存的情况下,衡量每一步编译时间的影响。

- 这是为了避免重复重编译和 Autotuning 带来的开销,但仍能了解细粒度的性能影响。

GPU MODE ▷ #cool-links (2 条消息):

Determinism, NVIDIA Determinism, Deep Learning Determinism, LLM inference determinism

- 确定性参考资料发布:一位成员发布了 2019 年 NVIDIA 关于深度学习确定性的演讲报告 的链接。

- 该成员还发布了关于确定性主题的其他学术论文和文章链接,其中包括一篇关于克服 LLM 推理中的非确定性的文章。

- 分享 Nvidia cuDNN 后端细节:一位成员分享了 NVIDIA cuDNN 文档 的链接,详细介绍了其后端。

- 该文档对于那些希望了解 cuDNN 运作方式以及如何利用其特性进行深度学习任务的人来说可能非常有用。

GPU MODE ▷ #beginner (5 条消息):

Benchmarking Guides, benchmarking opinions, youtube benchmarking

- 在初学者频道寻求基准测试指南专家:一位成员在初学者频道询问是否有好的基准测试 (Benchmarking) 指南。

- 另一位见解丰富的专家成员分享了一个关于基准测试的 YouTube 视频链接,并声称这与这篇论文有关。

- 基准测试见解:一位见解丰富的成员分享了深度见解。

- 他们声称这是他们最好的基准测试尝试。

GPU MODE ▷ #pmpp-book (4 条消息):

Fundamentals Book, Hardware Instructions

- 基础书籍提供坚实基础:一位成员分享了一本基础书籍的链接,并指出它对于理解 memory fences(内存屏障)等概念非常有益。

- 他们补充说,一旦有了坚实的基础,“硬件特定指令或所有花哨的新 mma 指令都可以很快被理解”。

- 熟能生巧,而不仅仅是知识:一位成员意识到,为了工作或研究而做某事与快速学习某事是不同的。

- 他们认为前者“主要是练习和培养‘肌肉记忆’,而不仅仅是了解知识”。

GPU MODE ▷ #rocm (1 条消息):

AMD core file analysis, rocgdb debugging

- 使用 rocgdb 调试 AMD core dumps:一位成员询问如何分析 AMD core 文件,例如

gpucore.219213。- 他们尝试使用

rocgdb --core=gpucore.71076,但收到警告:Couldn’t find general-purpose registers in core file(在 core 文件中找不到通用寄存器)。

- 他们尝试使用

- 是否有 core 文件分析的替代方案?:该成员正在寻求分析 core 文件的替代方法。

- 他们在使用

rocgdb时遇到问题,正在寻求建议。

- 他们在使用

GPU MODE ▷ #metal (1 条消息):

bghira: 现在我们只需要等待一个参数量低于 685B 的模型来运行它…

GPU MODE ▷ #self-promotion (1 messages):

免费 AI 学习,免费 CS 学习,开源教育资源

- Freelunch AI 提供免费教育:一名成员分享了一个 GitHub 仓库链接 Freelunch-AI/lunch-stem,并将其描述为免费学习 AI 和 CS 的最佳场所。

- 该仓库被定位为一个开源教育资源。

- 开源 STEM 教育倡议启动:GitHub 仓库 Freelunch-AI/lunch-stem 旨在为 AI 和 计算机科学 (CS) 的免费学习提供平台。

- 它强调通过开源贡献使优质教育变得触手可及。

GPU MODE ▷ #edge (1 messages):

辐射屏蔽,Orin 辐射测试,硬件看门狗

- 低轨道提供辐射屏蔽:处于低地球轨道 (Low Earth Orbit) 受到的辐射较少,且卫星底盘提供了天然的屏蔽。

- 辐射测试保护 Orin:已对 Orin 进行辐射测试,以防止辐射诱发的 latchups(这是一种可能损坏电子设备的失控电荷)。

- 硬件看门狗 (Hardware Watchdogs) 前来救援:辐射可能会导致设备冻结,但已部署硬件看门狗来重置设备。

GPU MODE ▷ #submissions (6 messages):

MI300x8, amd-gemm-rs 排行榜, amd-ag-gemm 排行榜

- 达成 MI300x8 个人最佳成绩:一名成员在

amd-gemm-rs排行榜上的 MI300x8 测试中达到了 593 µs 的个人最佳成绩。 - amd-gemm-rs 见证 MI300x8 的成功:一名成员在

amd-gemm-rs排行榜上使用 MI300x8 跑出了 608 µs 的成绩。- 另一项提交达到了 27.7 ms。

- amd-ag-gemm 排行榜条目:一名成员向

amd-ag-gemm排行榜成功提交了三次 MI300x8 成绩。- 提交的时间分别为 986 µs、534 µs 和 884 µs。

GPU MODE ▷ #status (2 messages):

Triangle Multiplicative Update

- Triangle Multiplicative Update 的报告和代码即将发布:Triangle Multiplicative Update 竞赛已经结束,获胜提交的解题报告 (writeups) 和代码将很快发布。

- altzhang 确认发布:altzhang 确认解题报告和代码将很快发布。

GPU MODE ▷ #factorio-learning-env (4 messages):

调试 factorio-learning-env,Google Meet 链接

- Google Meet 聚会:一名成员分享了一个指向调试会话的 Google Meet 链接。

- 该成员表示他们会在会话中待上一段时间,欢迎其他人加入。

- 调试 factorio-learning-env:一名成员提到他们正在调查 factorio-learning-env,并将在晚餐后加入。

- 他们正在调试一个可能与所涉及工具有关的问题,原因尚未确定。

GPU MODE ▷ #cutlass (34 messages🔥):

cute.nvgpu.warp.MmaF16BF16Op 文档, TiledMMA 广播, CuTe 中的分布式 GEMM, UMMA tensor core

wmma文档争议: 成员们质疑为什么cute.nvgpu.warp.MmaF16BF16Op文档引用的是 mma 而不是 wmma,并断言了 mma 的形状,随后澄清了 wmma 是一个失败的抽象。- 另一位成员解释说,UMMA 只是我们对 Blackwell tensor core 的昵称。Hopper 是 GMMA,Ampere 是 HMMA。不要过度解读,现在大家应该统一称其为 tcgen05,并且我们应该删除所有关于 UMMA 的引用。

TiledMMA是否进行广播?: 已确认,如果使用atom_layout_mnk且 k > 1 创建TiledMMA,那么在配合cute.gemm使用时,它会自动跨K进行“广播”,这可以在 后端实现 中看到。- 这在

K维度上复用了布局。

- 这在

- 分布式 GEMM 可以在 CuTe DSL 中实现: 尽管有成员认为 CuTe DSL 中还没有分布式原语,但有人断言,利用对称内存,今天就可以在 CuTe DSL 中很好地实现分布式 GEMM,并且 NVL load/store 语义对 kernel 是透明的。

- 一位成员链接了 CUTLASS example 65 作为实现参考,并推荐了 这个演讲 以获取关于 1D TP GEMMs 的更多细节。

- 通过研究 CuTe 源码来掌握 GEMM: 建议刚接触 CuTe 的成员查看源代码而不是只看实现,称其 非常易读 且比示例 更具启发性,特别是提到了 GEMM 文件。

- 此外,他们建议成员练习简单的例子,打印布局,并修改参数以观察它们如何影响结果。

GPU MODE ▷ #general (3 messages):

TriMul 竞赛, GPGPU 解决方案, 算子融合 (Operator Fusion), A100, MI300

- TriMul 竞赛反响热烈: 一位成员感谢 Alex 及其团队举办的 TriMul 竞赛,指出从 算子融合 的角度来看非常有趣,且不仅仅局限于 GEMMs。

- 该成员在 A100 和 MI300 上都取得了初步最快的解决方案。

- GPGPU 解决方案文章: 一位成员在 arseniivanov.github.io/blog.html 写了一篇关于通用 GPGPU 解决方案 的博客,并在 GitHub 上提供了代码和 kernel。

- 该成员提到他在 status 频道看到有人请求此类内容。

- TriMul 奖品准备就绪: Alex 和另一位成员表示 TriMul 竞赛奖品 (swag) 已经准备好了。

- 他们提到需要先完成评分工作。

GPU MODE ▷ #multi-gpu (19 messages🔥):

NVLink 组播 (Multicast), Multimem 指令, NVShmem 封装, 对端 GPU L2 缓存, NVLink SHARP

- NVLink SHARP 组播内存: 当多个 SM 尝试通过 NVLink 访问对端 GPU 上的同一位置时,默认情况下硬件不会进行广播,除非使用组播指针和

multimem指令。- 一位成员指出,为组播实现动态合并(dynamic coalescing)在微架构上很困难,因此应该将其实现为某种通过 NVLink 进行的 global-to-global 内存传输,然后进行本地拆分或加载到 shared memory。

- 用于多设备请求的 Multimem 指令: 如果你询问的是一个 GPU 多次加载到同一个对端地址的情况,那么用于在多个对端 GPU 上加载并归约的

ld_reducemultimem 操作会很有用。- 根据讨论,Multimem 组播需要对称内存寻址(symmetric memory addressing)。

- 用户友好的 NVShmem 封装: 据一位成员介绍,NVShmem 为组播行为提供了非常友好的用户级封装。

- 负责 NVShmem 的成员顺便进行了自荐。

- 对端 GPU L2 缓存的参与: 根据一位成员和 hazyresearch 的文章,如果你不进行特殊操作(如 volatile load),内存访问会经过 对端 GPU 的 L2 缓存。

- 一位成员好奇当前 GPU 上的 xbar 是否会向所有请求了某个内存范围的 SM 进行广播。

GPU MODE ▷ #llmq (2 messages):

Mega Kernel Projects, 20B Model Training, Gradient Norm Concerns

- **Mega Kernel 项目引起关注:成员们认为 **Mega Kernel Projects 非常酷,并注意到它们独特的工作风格。

- 一位成员对该项目有多少工作是在开源环境下完成的表示不确定。

- **20B 模型完成训练:一位成员报告称,他们的 **20B run 在 4x4090 上耗时约 90 小时完成,最终 loss 为 2.45,而 10B 模型为 2.52。

- 该成员提到不小心覆盖了日志文件的最后一部分,导致灰色曲线过早结束。

- Gradient Norm 斜率增加引发担忧:根据成员在 20B 模型训练期间的观察,Gradient Norm 的斜率正在增加,这可能会给更长时间的运行带来问题。

- 他们想起 Karpathy 的训练在 300B 之后的某个时间点发生了爆炸,尽管之前看起来一切正常。

Nous Research AI ▷ #general (80 messages🔥🔥):

Sequence expansion transformers, GLM 4.5 vs GLM 4.6, DDR5 RAM, Sora 2, Nous Chat Web

- Sequence Expansion Transformers 寻求社区反馈:一位成员目前正在研究 sequence expansion transformers (SEX Transformers),并询问是否可以将该项目添加到“社区项目”板块。

- 另一位成员开玩笑说是否应该在 UI 中把箭头标红,说道:我是该把箭头变红,还是你能看得见。

- Teknium 在本地演示 SORA 2:Teknium 分享了他们的第一个 Sora 2 视频,并提到他们可能会尝试在拥有 256GB RAM 的 CPU 配置上运行 333B 模型。

- 然而,很快有人指出,根据 HF 页面显示,该模型实际上是 357B。

- 探索 GLM 模型在 CPU 上的性能:成员们讨论了 GLM 4.5 和 4.6 的模型大小,其中 GLM 4.5 Air (100b) 拥有 12B active parameters,并推测其在 CPU 上与 Qwen 2 32b 的性能对比。

- 一位成员表示,他们在带有 RAM 的 CPU 上运行 Qwen 2 32b 可以达到 4 tok/s。

- 升级 RAM:深入探讨 DDR5 和内存控制器:随后展开了关于升级到 256GB DDR5 RAM 的讨论,涉及对潜在时钟频率降级的担忧,以及 Ryzen 7000 系列在此类配置下超过 5200MHz 的局限性。

- 一位成员分享说,他们把苏打水洒在了电脑上,于是升级到了现在支持 256GB 的 9950x ryzen。

- Sora 2:地区锁定且无法生成 Trump 梗图:成员们注意到 OpenAI 的 Sora 2 似乎有地区限制,需要使用 VPN,并幽默地指出它无法生成 Trump 梗图。

- 尽管存在限制,Sora 2 仍被认为是目前可用的 最佳视频生成 模型。

Nous Research AI ▷ #ask-about-llms (2 messages):

LLMs with Lower Cosine Similarity, GPT-OSS-120B

- LLM 中的 Cosine Similarity 解析:一位成员询问关于倾向于选择具有较低 Cosine Similarity 的 LLM(如 gpt-oss-120b)的问题。

- 另一位成员澄清说,Cosine Similarity 衡量的是 LLM 中 Chains of Thought (CoT) 的相似程度,高相似度可能表明是在相似的数据上训练的。

- Cosine Similarity 衡量 CoT 相似度:Cosine Similarity 衡量 Chains of Thought 的相似程度。

- 如果 LLM 具有很高的 Cosine Similarity,那么它们的输出非常相似,这可能指向它们是相互训练的事实。

Nous Research AI ▷ #research-papers (2 messages):

Aigo.ai, Symbolica, Augmented Intelligence (AUI), After Thought (Stealth), Symbolic Architectures

- 风投通过 Symbolic Architectures 寻求 AGI:一位风险投资人在追求 AGI 的过程中,正在探索 Aigo.ai、Symbolica、AUI (Augmented Intelligence) 和 After Thought (Stealth) 等 Symbolic Architectures。

- 他们认为 Aigo.ai 最有前途,并询问 从事相关工作需要具备哪些要求?

- 在 Aigo.ai 等 Symbolic Architectures 项目工作的要求:一位风险投资人表示有兴趣了解为 Symbolic Architecture 项目(特别是 Aigo.ai)做出贡献所需的资格和技能。

- 这一询问源于他们对 AGI 解决方案的投资搜索以及对各种 Symbolic AI 方法的评估。

Nous Research AI ▷ #interesting-links (1 messages):

DeepSeek Sparse Attention, Mamba selectivity

- DeepSeek 深入研究 Sparse Attention:新的 DeepSeek Sparse Attention (DSA) v3.2 模型使用了一种类似 Mamba selectivity 的机制作为子注意力模块(sub-attention block)。

- 该帖子推测了其可能的工作原理。

- Mamba 与 DeepSeek 融合:DeepSeek 的 Sparse Attention (DSA) 正在尝试整合一种 类似 Mamba selectivity 的机制。

- 这可能会增强模型关注相关信息的能力并提升性能。

Nous Research AI ▷ #research-papers (2 messages):

Symbolic Architectures, Aigo.ai, Symbolica, AUI Augmented Intelligence

- 风投在追求 AGI 的过程中寻找 Symbolic Architectures:一位风投成员在寻找 AGI 的过程中一直在探索 Symbolic Architectures,如 Aigo.ai、Symbolica、AUI “Augmented Intelligence” 以及 After Thought (处于隐身模式)。

- 该成员报告称 Aigo 目前看起来最有前景,并询问了参与该项目工作的要求。

- 投资者看好通过 Symbolic AI 实现 AGI:一位投资者正在积极研究包括 Aigo.ai、Symbolica 和 AUI 在内的 Symbolic AI 架构,并对 Aigo.ai 的潜力表现出浓厚兴趣。

- 该投资者目前正在寻求有关为这些 Symbolic AI 项目做出贡献所需的要求和资质信息。

Yannick Kilcher ▷ #general (14 messages🔥):

Thematic Roles, Detecting AI Generated Videos, Path patching

- LLM 中的 Thematic Roles 引发辩论:一位成员分享了关于 Thematic Roles 的 维基百科链接,并提到了 Dowty 对 “proto(typical) roles” 的使用。

- 另一位成员建议 LLM 可能具有此类结构,并引用了关于 Othello 的研究,在该研究中,训练于移动序列的 LLM 涌现出了棋盘表示。

- 像素观察能防止完美的伪造吗?:在一位用户询问如何检测类似 Sora 2 生成的 AI 生成视频后,一位成员建议像素级观察(pixel peeping)仍然相当可靠。

- 另一位成员评论道,理想情况下,检测 AI 生成内容应该是不可能的,但他相信人们会习惯于仅凭感觉(vibes)来检测它们。

- Path Patching 承诺实现精确探测:一位成员表示目前还不看好 transcoders,并建议在探测 LLM 时,Path Patching 可以帮助提出更有力的主张。

- 在回应推荐论文的请求时,他们引用了间接宾语识别(indirect object identification)论文作为该领域的经典之作。

Yannick Kilcher ▷ #paper-discussion (6 messages):

Latent-Reasoning Survey, VLM Circuits Analysis, Reasoning with RL on Pretraining Data

- Latent-Reasoning 讨论推迟:原定于周四进行的关于 Latent-Reasoning 综述 的讨论已取消。

- 原计划是从第 11 页最后一段继续讨论到第 3.1 节结束。

- VLM Circuits Analysis:计划讨论 VLM Circuits Analysis 及其 项目页面。

- 讨论原定于今天进行。

- 关于 Reasoning with RL 的论文正在流传:一位成员分享了一篇来自 NVIDIA 的关于 在预训练数据上进行 Reasoning with RL 的论文。

- 这篇论文被描述为比另一篇论文 更复杂,尽管后者除了 RL 下一句预测外没有明确诱导“推理”,但两者取得了类似的收益。

Yannick Kilcher ▷ #ml-news (9 messages🔥):

Sora 1 vs Sora 2, ByteDance and Tencent vs Sora, AlphaEvolve LLM, Sam Altman unnatural movement, WanLynx alternative to Sam Altman

- Sora 2 拥有更好的物理效果:频道成员提到 Sora 2 的质量远优于 Sora 1,因为 Sora 1 无法处理物理特性且存在明显的视觉伪影(visual artifacts)。

- Google 利用 AlphaEvolve 推进计算机科学:Google 使用 AlphaEvolve(一个基于 LLM 的代码 Agent)来寻找并验证组合结构,以改进某些优化问题近似求解难度的结果,详见其最近的 博客文章。

- Sam Altman 的动作很尴尬:一位成员表示 Sam Altman 的动作/姿势确实很尴尬且不自然,在人类动作表现方面比 ByteDance 或 Tencent 的产品更差。

- 用 WanLynx 替代 Sam Altman:一位成员开玩笑说,也许在那部分应该使用 WanLynx 而不是 Sam Altman。

- fixupx.com 分享内容:一位成员分享了 fixupx.com 上的一篇帖子链接。

aider (Paul Gauthier) ▷ #general (24 messages🔥):

aider MCP, aider forks with MCP support, local LLMs with aider, LM Studio issues, Qwen coder 30b and devstral 24b

- 关于 Aider 使用 MCP 的疑问:用户询问如何在 aider 中使用 MCP (Multi-modal conversational platform),考虑到其在商业平台上的高昂成本和速率限制,以及它对前端开发的重要性。

- 他们指出 goose/claude/gemini-cli 都支持 MCP,且浏览器 MCP 对前端开发至关重要,同时还询问了 aider 的 yolo mode。

- Aider 分支添加了 MCP 支持:官方 aider 不支持 MCP,但一些分支(forks)支持,例如 aider-ce。

- 讨论中还询问了其他正在使用的分支。

- Aider 可与本地 LLM 配合使用:一位用户报告称,尽管模型具有工具调用(tool use)能力,但 aider 无法与 devstral 或 qwen coder 等本地 LLM 配合使用,在使用 LM Studio 运行模型时无法读取或保存文件。

- 另一位用户澄清说,aider 不使用工具(tools),而是将文件包含在用户提示词(prompt)中使其成为上下文的一部分;此外,如果本地模型足够聪明(如 gpt-oss),它是可以工作的。

- LM Studio 存在一些问题:一些用户在使用 LM Studio 时遇到了问题,特别是 mlx 后端,建议使用 llama.cpp 似乎更好。

- 有人建议传递

--jinja参数,并建议切换到 ollama。

- 有人建议传递

- Qwen Coder 30b 够聪明吗?:一位用户想知道 Qwen coder 30b 和 devstral 24b 模型是否足够聪明以配合 aider 使用。

- 这些模型没有文件访问或工具调用能力。

aider (Paul Gauthier) ▷ #questions-and-tips (4 messages):

Apriel-1.5-15b, llama.cpp support, koboldcpp output templates, DeepWiki page

- Apriel-1.5-15b 亮相引发咨询:一位成员询问关于在 llama.cpp 中使用新发布的 Apriel-1.5-15b 模型的问题,并指出该模型会将思考过程(thinking output)包含在主回复中。

- 他们询问 llama.cpp 是否需要对该模型提供额外支持,或者是否有配置可以像 gpt-oss-20b 那样分离思考输出。

- 请求对模型工程进行 DeepWiki 深度探索:一位成员建议查看与逆向工程相关的 DeepWiki 页面。

- 该建议是针对 Apriel-1.5-15b 模型查询的回应。

- koboldcpp 输出解决方案:一位成员提到 koboldcpp 使用输出模板或后处理来管理输出。

- 他们推测 llama.cpp 可能也有类似的功能,即使目前还不明显。

Manus.im Discord ▷ #general (27 messages🔥):

Manus stuck in loop, Aseel-Manus Memory Key Protocol, AI automation agencies, Manus credit usage, Sora invite code

- **Manus 故障警报:用户报告“陷入循环”错误:用户报告 **Manus 陷入循环错误,生成代码为 10091 的 Internal server error。即使提交了帮助工单和用于公开项目的 URL,Manus 团队也未做出回应。

- 用户询问:面对这种僵局,我该采取什么步骤来解决?

- **记忆突破:Aseel-Manus Memory Key Protocol 发布:一位用户开发了 **Aseel-Manus Memory Key Protocol,这是一个模型无关(model-agnostic)的框架,用于实现持久化、用户拥有的 AI 记忆。通过将 Agent 的认知上下文序列化为安全且可移植的密钥,实现完美的会话连续性。

- 该协议已在 Manus 和 Google 的 Gemini 上得到验证,并利用强大的加密标准保护用户隐私;该用户要求 Manus 平台从原生层面解决 AI 记忆问题,将其作为核心哲学特性,而非仅仅是一个补丁。

- **AI 自动化机构:探索实施蓝图:一位用户寻求关于正规 **AI 自动化机构 的指导,另一位用户将其分为三种模式:编排者 (Orchestrators)(no-code/low-code)、架构师 (Architects)(自定义 Python, LangChain/LlamaIndex 和向量数据库)以及 集成商 (Integrators)(管理企业级合规性)。

- 一个关键的审查建议是询问潜在机构如何在自动化中处理 状态管理 (state management) 和 错误恢复 (error recovery)。

- **额度危机:Manus 的高额度消耗受到关注:一位用户抱怨 **Manus 在处理涉及 X 光检查和电子表格创建的基础研究任务时,消耗了超过 5300 个额度。

- 一名团队成员请求获取会话链接,以调查额度过度消耗的情况并考虑可能的退款。

- **Sora 焦点:邀请码赠送!:一位用户正向任何私信(DM)他们的人提供 **Sora 邀请码。

Eleuther ▷ #general (1 messages):

AI Researcher, Multi Agent Systems, MoE, RL, AI for Software Engineering

- 抱负不凡的 AI 研究员加入对话:新成员 Aarya 介绍了自己,他是一位有志于成为 AI 研究员 的开发者,在 传统机器学习、Multi Agent Systems 和 MoE 方面拥有经验。

- Aarya 目前正在深入学习 RL,并对 AI for software engineering 以及 AI 在现实世界中的应用感兴趣。

- 兴趣广泛的新成员:Aarya 表达了学习 RL 的兴趣,并拥有传统机器学习的经验。

- 他们提到了对 AI for software engineering 的兴趣。

Eleuther ▷ #research (16 messages🔥):

Adaptive Searching Improvements, Sparse Attention in DeepSeek Model, Meta-Studies in AI Research, Benchmark Usage Analysis, Implicit Values in ML Research

- 自适应搜索提升性能:一名成员报告了通过在每个 query/head/layer 基础上自适应地进行额外搜索(以对数方式封顶)所带来的改进,在 Attention 和 W_o 之后的最终输出中展现出极具前景的 cosine similarity。

- 附带了一张 CleanShot 图片 展示了这些改进。

- DeepSeek 的稀疏注意力引发关注:讨论围绕新 DeepSeek 模型中的稀疏注意力机制展开,并提供了 FlashMLA pull request 的链接。

- 一位成员评论道:“新 DeepSeek 模型中的稀疏注意力对我来说听起来非常有趣”。

- 寻求 AI 领域的元研究:一位成员询问了分析过去研究的元研究(meta-studies),质疑大量工作对进展的影响,并寻找能提供超越个人审美见解的论文。

- 基准测试使用情况的细致观察:一位成员分享了关于基准测试(benchmark)使用情况的发现,指出只有不到 50% 的 BBH 引用来自于实际在其上进行评估的论文,而引用 evaluation harness 的论文中则有超过 70% 实际使用了它。

- 他们补充说,官方实现位于最左侧列;在他们查看的前 50 篇引用 BigBench 的论文中,使用率为 0%。

- ML 研究的隐含价值:分享了一篇讨论机器学习研究中隐含价值的论文链接,强调提升 state-of-the-art 结果和基于前人工作进行构建是核心驱动力。

- 这篇特定的 论文 强调了该领域对推进基准测试和增量扩展现有知识的关注。

Eleuther ▷ #lm-thunderdome (2 messages):

GSM8k benchmark, RWKV7Qwen3Hybrid5NoPE-8B-251001Faced performance, Llama-3-8B evaluation

- RWKV7Qwen3Hybrid5NoPE-8B-251001Faced 在 GSM8k 上表现挣扎:一位成员报告了 SmerkyG/RWKV7Qwen3Hybrid5NoPE-8B-251001Faced 在 GSM8k 基准测试中遇到的问题,并分享了结果的 图片。

- 该成员还指出,在使用 Llama-3-8B 进行测试时,得分也相当低。

- Llama-3-8B 得分同样较低:原贴作者也在相同的 GSM8k 基准测试上测试了 Llama-3-8B。

- 用户注意到 Llama-3-8B 的得分也非常低。

Modular (Mojo 🔥) ▷ #mojo (10 messages🔥):

Windows Release, Mojo Notebook Support, Stack Overflow Survey

- Windows 发布路线图仍不明朗:一位成员询问了 Windows 版本的发布路线图,但被告知这目前不是 Modular 的优先事项,Windows 支持可能会在编译器开源后由社区贡献。

- 另一位成员建议 Windows 支持将在编译器开源后实现,但由于缺乏厂商支持,许多 GPU 或加速器永远无法在 Windows 上使用;此外,距离 Windows 10 停止支持还有大约一个月,这意味着我们可以假设 Windows 环境支持 >= AVX2,这实际上非常有益。

- Mojo 加入 Stack Overflow 调查:根据 调查结果,Mojo 首次出现在 Stack Overflow 开发者调查中,位列末席。

- 尽管排名较低,社区仍对 Mojo 被纳入调查表示庆祝。

- 仍需 Notebook 支持:成员们请求提供 Notebook 支持、Jupyter Notebook 中的语法高亮以及上游 Jupyter 中的 Max Kernel。因为在 ML 领域,Notebook 是展示想法的通用方式,因为在代码周围很难轻松地注释数学公式或提供图形描述。

- 一位成员询问该请求是希望 能够从 Notebook 与 Max 交互,还是 直接在 Notebook 中编写并运行 Mojo。

Modular (Mojo 🔥) ▷ #max (5 messages):

MAX 在 Cerebras 上的表现,Mojo X Max AI 项目

- MAX 在 Cerebras 上面临挑战:一位成员询问关于在 Cerebras 上运行 MAX 实现的 AI 模型,并将其与他们的基准测试进行比较,看是否会更快。

- 另一位成员澄清说 MAX 目前无法在 Cerebras 上运行,并表示由于缺乏针对 Cerebras 等数据流芯片(dataflow chips)的优化,它可能会更慢。

- Mojo X Max AI 项目在 Cerebras 上不会获得免费的性能提升:一位成员询问,与目前的 SOTA GPUs 相比,在 Cerebras 芯片 等 AI 芯片 上使用 Mojo X Max 进行 AI 项目是否会提供“免费的性能提升”。

- 一位成员澄清说 MAX 目前无法在 Cerebras 上运行,且没有针对 Cerebras 等数据流芯片的优化。

Moonshot AI (Kimi K-2) ▷ #general-chat (13 messages🔥):

OpenAI 的 TikTok 广告,中国模型审查,API 版本对比

- OpenAI 通过 TikTok 广告进行预热:OpenAI 发布了一个 TikTok 广告,展示了一个提示框,引发了投资者的兴奋。

- 一些用户将其贴上了 slop(低质内容)的标签。

- 中国模型是否隐藏了敏感话题?:一位用户询问中国模型在经过后期训练(post-trained)后,有哪些话题是不被允许讨论的。

- 具体而言,他们注意到“关于印度的某些事情无法谈论”。

- API 版本与美国模型展开竞争:一位成员声称某些模型的 API 版本是“相当开放的”。

- 该成员澄清说,与美国模型相比,除了模型内部较少的西方偏见数据外,没有其他审查。

DSPy ▷ #general (10 messages🔥):

LiteLLM 对比 DSPy,Prompt Engineering,LLM 缓存

- LiteLLM 与 DSPy 在应用开发中的博弈:一位成员询问在开发以 LLM 为中心的新应用时应选择 LiteLLM 还是 DSPy,另一位成员指出 DSPy 使用 LiteLLM 作为网关。

- 原发布者认为 LiteLLM 提供的结构太少,仅仅作为调用 LLM 的接口,而 DSPy 则强加了一种特定的思考问题的方式。

- DSPy 的结构并非强制性的?:一位成员认为可以直接将

messages传递给dspy.LM,这表明 DSPy 的结构并不一定是强制性的。- 他们还指出,目前并未利用所有的 LiteLLM 功能,需要进行一些构建工作才能理解如何实现预期的结果。

- 缓存关注提示词和文件的顺序:一位用户询问在利用缓存时,如何操作 JSON 请求中

content部分的顺序。- 这意味着发送提示词和文件的顺序对于有效缓存至关重要。

tinygrad (George Hotz) ▷ #general (3 messages):

CLSPV 崩溃,Shape Tracker 悬赏,ShapeTracker 删除

- CLSPV 仍然崩溃,但大部分已通过:一位成员在使用 CLSPV 运行测试时仍遇到崩溃,但报告称它通过了大部分测试。

- 使用 x86_64 Linux 系统的用户可以尝试通过

pip install git+https://github.com/softcookiepp/tinygrad.git安装该分支进行测试。

- 使用 x86_64 Linux 系统的用户可以尝试通过

- Shape Tracker 悬赏:一位成员询问了 Shape Tracker Lean Prove Bounty 的状态。

- 进一步讨论提到 ShapeTracker 很快将被删除。